801afcbdad2c2ed8b79ce4a4f97d7755.ppt

- Количество слайдов: 10

Харьковский национальный университет радиоэлектроники Проблемная научно-исследовательская лаборатория АСУ Control Systems Research Laboratory ГИБРИДНЫЙ ЕМ-АЛГОРИТМ ВЕРОЯТНОСТНОЙ КЛАСТЕРИЗАЦИИ ПОТОКОВ ДАННЫХ Анастасия Дейнеко, к. т. н. , н. с. ПНИЛ АСУ

• Dynamic Data Mining; • Dynamic Stream Mining; • Big Data; • VLDB – Very Large Data Base; • Сomputational Intelligence (Вычислительный интеллект); • Artificial Neural Networks (искусственные нейронные сети); • Soft Computing(мягкие вычисления); • Fuzzy Logic (нечеткая логика). • Soft Algorithms (мягкие алгоритмы); • Probabilistic Model-Based Algorithms (Вероятностные алгоритмы) Expectation-Maximization algorithm (ЕМ-алгоритм).

Задача кластеризации - Это задача классификации БЕЗ учителя; - Это задача разбиения заданной выборки объектов (ситуаций) на непересекающиеся подмножества, называемые кластерами, так, чтобы каждый кластер состоял из схожих объектов, а объекты разных кластеров существенно отличались.

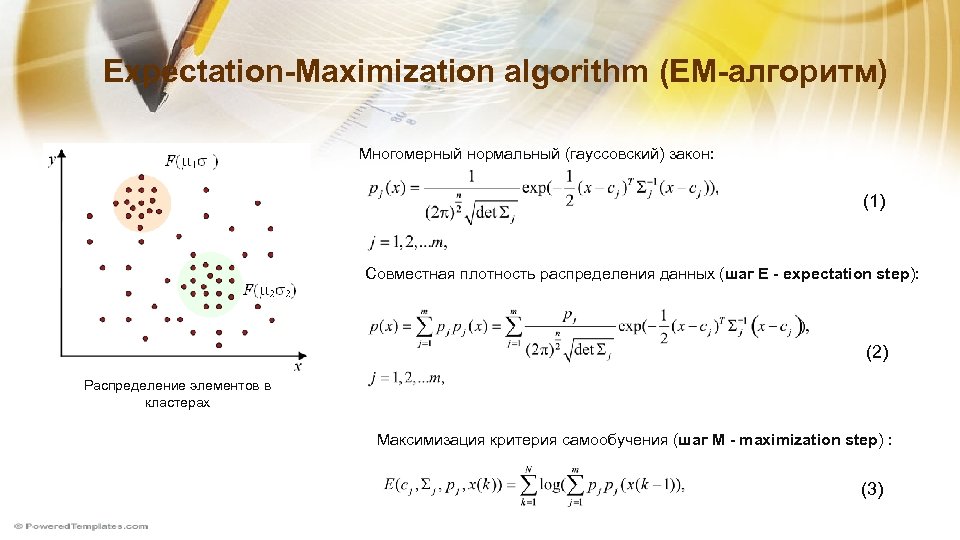

Expectation-Maximization algorithm (ЕМ-алгоритм) Многомерный нормальный (гауссовский) закон: (1) Совместная плотность распределения данных (шаг Е - expectation step): (2) Распределение элементов в кластерах Максимизация критерия самообучения (шаг М - maximization step) : (3)

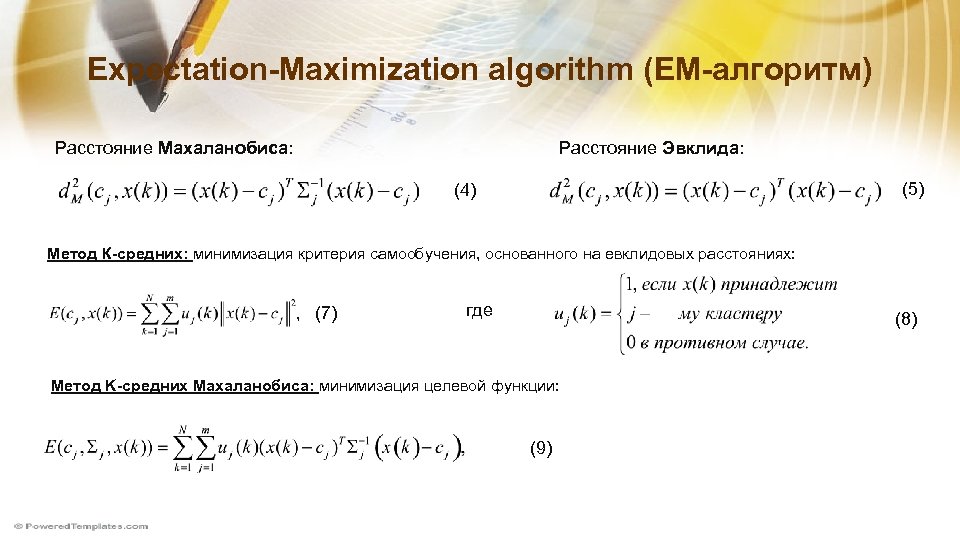

Expectation-Maximization algorithm (ЕМ-алгоритм) Расстояние Махаланобиса: Расстояние Эвклида: (5) (4) Метод К-средних: минимизация критерия самообучения, основанного на евклидовых расстояниях: , (7) где (8) Метод K-средних Махаланобиса: минимизация целевой функции: (9)

Недостатки EM-алгоритма 1) исходные данные должны иметь случайную природу и подчиняться нормальному закону распределения; 2) на М-этапе возможно «застревание» процесса оптимизации в локальных экстремумах; 3) с вычислительной точки зрения это все-таки довольно громоздкая процедура; 4) подразумевается, что весь массив данных, подлежащих кластеризации, задан заранее и не изменяется в процессе обработки. В связи с этим представляется целесообразной разработка числено простого алгоритма кластеризации, основанного на метрике Махаланобиса, учитывающего возможность взаимного перекрытия формируемых кластеров и позволяющего анализировать поток данных, последовательно поступающих на обработку в on-line режиме.

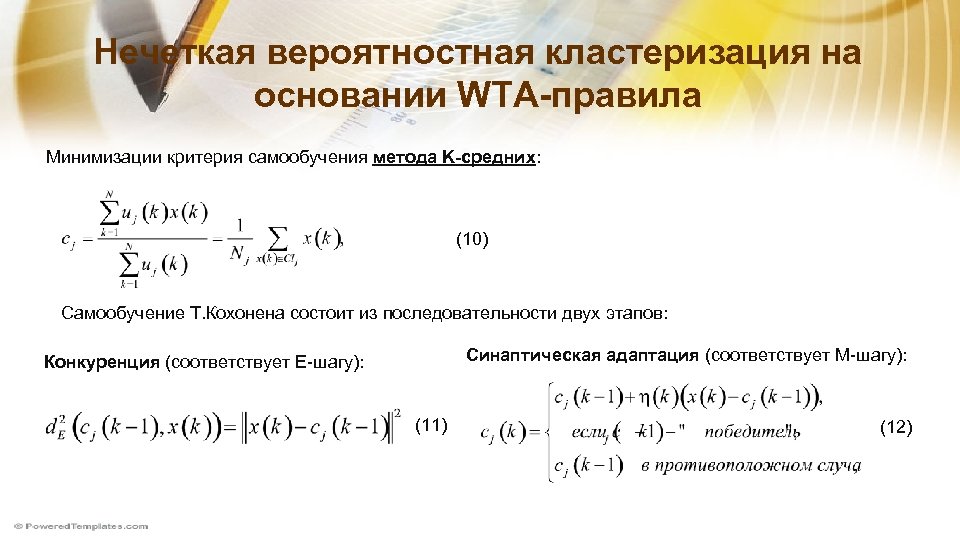

Нечеткая вероятностная кластеризация на основании WTA-правила Минимизации критерия самообучения метода K-средних: (10) Самообучение Т. Кохонена состоит из последовательности двух этапов: Синаптическая адаптация (соответствует М-шагу): Конкуренция (соответствует Е-шагу): (11) (12)

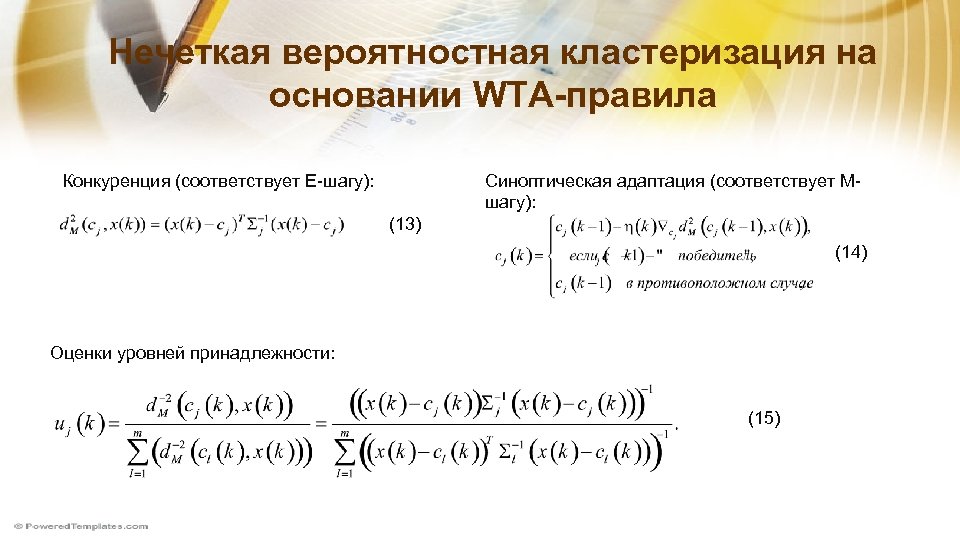

Нечеткая вероятностная кластеризация на основании WTA-правила Конкуренция (соответствует Е-шагу): Синоптическая адаптация (соответствует Мшагу): (13) (14) Оценки уровней принадлежности: (15)

Выводы • Предложенная процедура нечеткой вероятностной кластеризации, являясь своеобразным гибридом ЕМ-алгоритма, метода K-средних Махаланобиса, алгоритмов нечеткой кластеризации Бездека и Гата-Гевы и нечеткой кластеризующей нейронной сети Кохонена в ее адаптивном варианте, характеризуется вычислительной простотой и позволяет анализировать данные, последовательно поступающие на обработку в on-line режиме. • Предложен мягкий вероятностный нечеткий алгоритм кластеризации многомерных данных, последовательно поступающих на обработку в режиме реального времени. Развиваемый подход предназначен для решения задач Dynamic Stream Mining в условиях перекрывающихся классов, по сравнению со своими прототипами значительно проще в вычислительной реализации, не использует никаких вероятностных предположений о природе обрабатываемых данных.

Список литературы • Aggarwal C. C. Data Mining. / C. C. Aggarwal // Cham: Springer, Int. Publ. – Switzerland. – 2015. – 734 p. • Aggarwal C. C. Data Clustering. Algorithms and Application. / C. C. Aggarwal, C. K. Reddy // Boca Raton: CRC Press. – 2014. – 648 p. • Gath, I. and Geva, A. B. , Unsupervised optimal fuzzy clustering, Pattern Analysis and Machine Intelligence, 1989. vol. 2, no. 7, pp. 773 -787. • Bezdek, J. C. Keller, J. , Krishnapuram, R. and Pal, N. , Fuzzy Models and Algorithms for Pattern Recognition and. Image Processing. The Handbooks of Fuzzy Sets, Kluwer, Dordrecht, Netherlands: Springer, 1999. vol. 4, 776 p. • Dempster, A. P. , Laird, N. M. and Rubin, D. B. , Maximum likelihood from incomplete data via the EM algorithm, J. of the Royal Statistical Society, 1977, Ser. B, vol. 39, no. 1, рр. 1 -38. • Hathaway, R. , Another interpretation of the EM algorithm for mixture distributions. J. of Statistics & Probability Letters, 1986, vol. 4, pp. 53 -56. • Meng, X. L. and Rubin, D. B. , Maximum likelihood estimation via the ECM algorithm: a general framework, Biometrica, 1993, vol. 80, рр. 267 -278. • Liu, C. and Rubin, D. B. , The ECME algorithm: A simple extension of EM and ECM with faster monotone convergence, Biometrica, 1994, vol. 81, рр. 633 -648. • Fessler, J. A. and Hero, A. O. , Space – alternating generalized EM algorithm, IEEE Trans. on Signal Processing, 1994. vol . 42, pp. 2664 -2677. • Friedman, J. , Hastie, T. and Tibshirani, R. , The Elements of Statistical Learning. Data Mining, Inference and Prediction, Berlin: Springer, 2003, 552 p. • Bodyanskiy Ye. Evolving neuro-fuzzy systems with kernel activation functions. Their adaptive learning for Data Mining tasks / Ye. Bodyanskiy, O. Tyshchenko, A. Deineko // Saarbrucken: LAP LAMBERT Academic Publishing – 2015 – 64 p.

801afcbdad2c2ed8b79ce4a4f97d7755.ppt