32c7255bb1c9becb563876c3d2c91853.ppt

- Количество слайдов: 54

W 4: Statystyka, Zastosowania Inżynieria Języka Nina Suszczańska, Politechnika Śląska, 2006

W 4: Statystyka, Zastosowania Inżynieria Języka Nina Suszczańska, Politechnika Śląska, 2006

INŻYNIERIA JĘZYKA 20. 05. 2006 Plan l. W 1: Lingwistyka l. W 2: Gramatyki l. W 3: Składnia, Semantyka l. W 4: Statystyka, Zastosowania 2 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Plan l. W 1: Lingwistyka l. W 2: Gramatyki l. W 3: Składnia, Semantyka l. W 4: Statystyka, Zastosowania 2 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka, Modele statystyczne l HMM (Hidden Markov Model), czyli ukryte modeli Markowa l prawdopodobieństwo warunkowe l Przykład: potrzebna jest reprezentacja wartości prawdopodobieństwa tego, że wystąpi słowo „dog”, jeśli przed nim wystąpi słowo „the”, lub „prawda, że słowo jest N, jeżeli przed nim jest ADJ, który poprzedzony jest DET”. 3 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka, Modele statystyczne l HMM (Hidden Markov Model), czyli ukryte modeli Markowa l prawdopodobieństwo warunkowe l Przykład: potrzebna jest reprezentacja wartości prawdopodobieństwa tego, że wystąpi słowo „dog”, jeśli przed nim wystąpi słowo „the”, lub „prawda, że słowo jest N, jeżeli przed nim jest ADJ, który poprzedzony jest DET”. 3 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (2) l Notacja: – – – l l l P () I = C - prawdopodobieństwo - tego - to co dane - jest - przeliczenie czegoś – pewnych obiektów Każde słowo w tekscie będziemy numerować 1 m. Wtedy dla „prawdopodobieństwa, że słowem drugim będzie „dog”, jeżeli pierwszym słowem jest „the” (przy wykonaniu warunku) : P( W 2 = „dog” | W 1 = „the” ) wi zamiast: i-te słowo ze słownika P( W 2 = wj | W 1 = wi ) Po prostu liczymy ile razy wypadnie słowo wj po wi i obliczamy stosunek wiwj do wszystkich wi w tekście Czyli będziemy zliczać wszystkie wystąpienia „the” w naszym tekście, oraz te „the”, które poprzedzają słowo „dog” 4 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (2) l Notacja: – – – l l l P () I = C - prawdopodobieństwo - tego - to co dane - jest - przeliczenie czegoś – pewnych obiektów Każde słowo w tekscie będziemy numerować 1 m. Wtedy dla „prawdopodobieństwa, że słowem drugim będzie „dog”, jeżeli pierwszym słowem jest „the” (przy wykonaniu warunku) : P( W 2 = „dog” | W 1 = „the” ) wi zamiast: i-te słowo ze słownika P( W 2 = wj | W 1 = wi ) Po prostu liczymy ile razy wypadnie słowo wj po wi i obliczamy stosunek wiwj do wszystkich wi w tekście Czyli będziemy zliczać wszystkie wystąpienia „the” w naszym tekście, oraz te „the”, które poprzedzają słowo „dog” 4 z 54

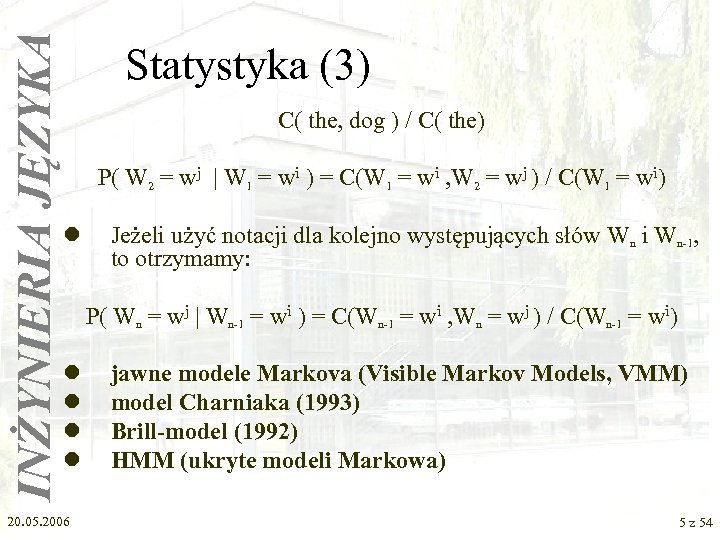

INŻYNIERIA JĘZYKA Statystyka (3) C( the, dog ) / C( the) P( W 2 = wj | W 1 = wi ) = C(W 1 = wi , W 2 = wj ) / C(W 1 = wi) l Jeżeli użyć notacji dla kolejno występujących słów Wn i Wn-1, to otrzymamy: P( Wn = wj | Wn-1 = wi ) = C(Wn-1 = wi , Wn = wj ) / C(Wn-1 = wi) l l 20. 05. 2006 jawne modele Markova (Visible Markov Models, VMM) model Charniaka (1993) Brill-model (1992) HMM (ukryte modeli Markowa) 5 z 54

INŻYNIERIA JĘZYKA Statystyka (3) C( the, dog ) / C( the) P( W 2 = wj | W 1 = wi ) = C(W 1 = wi , W 2 = wj ) / C(W 1 = wi) l Jeżeli użyć notacji dla kolejno występujących słów Wn i Wn-1, to otrzymamy: P( Wn = wj | Wn-1 = wi ) = C(Wn-1 = wi , Wn = wj ) / C(Wn-1 = wi) l l 20. 05. 2006 jawne modele Markova (Visible Markov Models, VMM) model Charniaka (1993) Brill-model (1992) HMM (ukryte modeli Markowa) 5 z 54

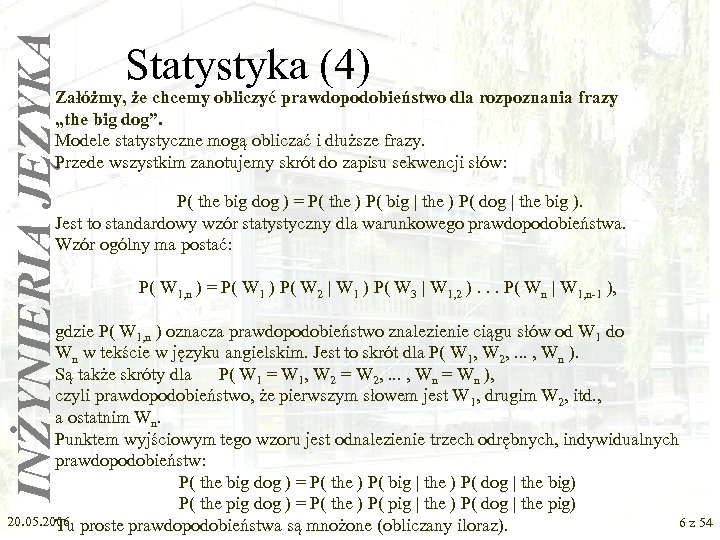

INŻYNIERIA JĘZYKA Statystyka (4) Załóżmy, że chcemy obliczyć prawdopodobieństwo dla rozpoznania frazy „the big dog”. Modele statystyczne mogą obliczać i dłuższe frazy. Przede wszystkim zanotujemy skrót do zapisu sekwencji słów: P( the big dog ) = P( the ) P( big | the ) P( dog | the big ). Jest to standardowy wzór statystyczny dla warunkowego prawdopodobieństwa. Wzór ogólny ma postać: P( W 1, n ) = P( W 1 ) P( W 2 | W 1 ) P( W 3 | W 1, 2 ). . . P( Wn | W 1, n-1 ), gdzie P( W 1, n ) oznacza prawdopodobieństwo znalezienie ciągu słów od W 1 do Wn w tekście w języku angielskim. Jest to skrót dla P( W 1, W 2, . . . , Wn ). Są także skróty dla P( W 1 = W 1, W 2 = W 2, . . . , Wn = Wn ), czyli prawdopodobieństwo, że pierwszym słowem jest W 1, drugim W 2, itd. , a ostatnim Wn. Punktem wyjściowym tego wzoru jest odnalezienie trzech odrębnych, indywidualnych prawdopodobieństw: P( the big dog ) = P( the ) P( big | the ) P( dog | the big) P( the pig dog ) = P( the ) P( pig | the ) P( dog | the pig) 20. 05. 2006 proste prawdopodobieństwa są mnożone (obliczany iloraz). 6 z 54 Tu

INŻYNIERIA JĘZYKA Statystyka (4) Załóżmy, że chcemy obliczyć prawdopodobieństwo dla rozpoznania frazy „the big dog”. Modele statystyczne mogą obliczać i dłuższe frazy. Przede wszystkim zanotujemy skrót do zapisu sekwencji słów: P( the big dog ) = P( the ) P( big | the ) P( dog | the big ). Jest to standardowy wzór statystyczny dla warunkowego prawdopodobieństwa. Wzór ogólny ma postać: P( W 1, n ) = P( W 1 ) P( W 2 | W 1 ) P( W 3 | W 1, 2 ). . . P( Wn | W 1, n-1 ), gdzie P( W 1, n ) oznacza prawdopodobieństwo znalezienie ciągu słów od W 1 do Wn w tekście w języku angielskim. Jest to skrót dla P( W 1, W 2, . . . , Wn ). Są także skróty dla P( W 1 = W 1, W 2 = W 2, . . . , Wn = Wn ), czyli prawdopodobieństwo, że pierwszym słowem jest W 1, drugim W 2, itd. , a ostatnim Wn. Punktem wyjściowym tego wzoru jest odnalezienie trzech odrębnych, indywidualnych prawdopodobieństw: P( the big dog ) = P( the ) P( big | the ) P( dog | the big) P( the pig dog ) = P( the ) P( pig | the ) P( dog | the pig) 20. 05. 2006 proste prawdopodobieństwa są mnożone (obliczany iloraz). 6 z 54 Tu

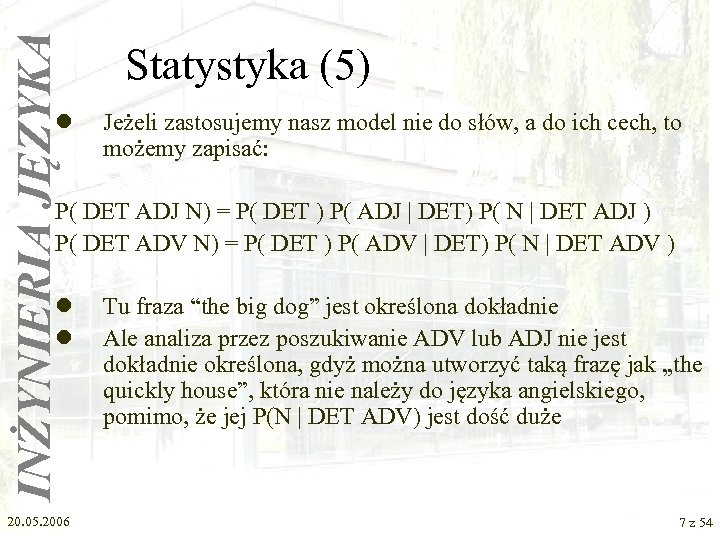

INŻYNIERIA JĘZYKA l Statystyka (5) Jeżeli zastosujemy nasz model nie do słów, a do ich cech, to możemy zapisać: P( DET ADJ N) = P( DET ) P( ADJ | DET) P( N | DET ADJ ) P( DET ADV N) = P( DET ) P( ADV | DET) P( N | DET ADV ) l l 20. 05. 2006 Tu fraza “the big dog” jest określona dokładnie Ale analiza przez poszukiwanie ADV lub ADJ nie jest dokładnie określona, gdyż można utworzyć taką frazę jak „the quickly house”, która nie należy do języka angielskiego, pomimo, że jej P(N | DET ADV) jest dość duże 7 z 54

INŻYNIERIA JĘZYKA l Statystyka (5) Jeżeli zastosujemy nasz model nie do słów, a do ich cech, to możemy zapisać: P( DET ADJ N) = P( DET ) P( ADJ | DET) P( N | DET ADJ ) P( DET ADV N) = P( DET ) P( ADV | DET) P( N | DET ADV ) l l 20. 05. 2006 Tu fraza “the big dog” jest określona dokładnie Ale analiza przez poszukiwanie ADV lub ADJ nie jest dokładnie określona, gdyż można utworzyć taką frazę jak „the quickly house”, która nie należy do języka angielskiego, pomimo, że jej P(N | DET ADV) jest dość duże 7 z 54

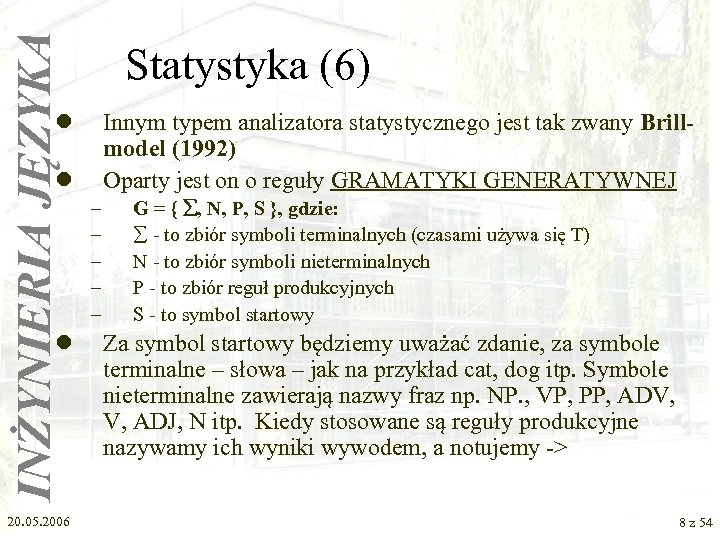

INŻYNIERIA JĘZYKA Statystyka (6) l Innym typem analizatora statystycznego jest tak zwany Brillmodel (1992) Oparty jest on o reguły GRAMATYKI GENERATYWNEJ l l 20. 05. 2006 – – – G = { , N, P, S }, gdzie: - to zbiór symboli terminalnych (czasami używa się T) N - to zbiór symboli nieterminalnych P - to zbiór reguł produkcyjnych S - to symbol startowy Za symbol startowy będziemy uważać zdanie, za symbole terminalne – słowa – jak na przykład cat, dog itp. Symbole nieterminalne zawierają nazwy fraz np. NP. , VP, PP, ADV, V, ADJ, N itp. Kiedy stosowane są reguły produkcyjne nazywamy ich wyniki wywodem, a notujemy -> 8 z 54

INŻYNIERIA JĘZYKA Statystyka (6) l Innym typem analizatora statystycznego jest tak zwany Brillmodel (1992) Oparty jest on o reguły GRAMATYKI GENERATYWNEJ l l 20. 05. 2006 – – – G = { , N, P, S }, gdzie: - to zbiór symboli terminalnych (czasami używa się T) N - to zbiór symboli nieterminalnych P - to zbiór reguł produkcyjnych S - to symbol startowy Za symbol startowy będziemy uważać zdanie, za symbole terminalne – słowa – jak na przykład cat, dog itp. Symbole nieterminalne zawierają nazwy fraz np. NP. , VP, PP, ADV, V, ADJ, N itp. Kiedy stosowane są reguły produkcyjne nazywamy ich wyniki wywodem, a notujemy -> 8 z 54

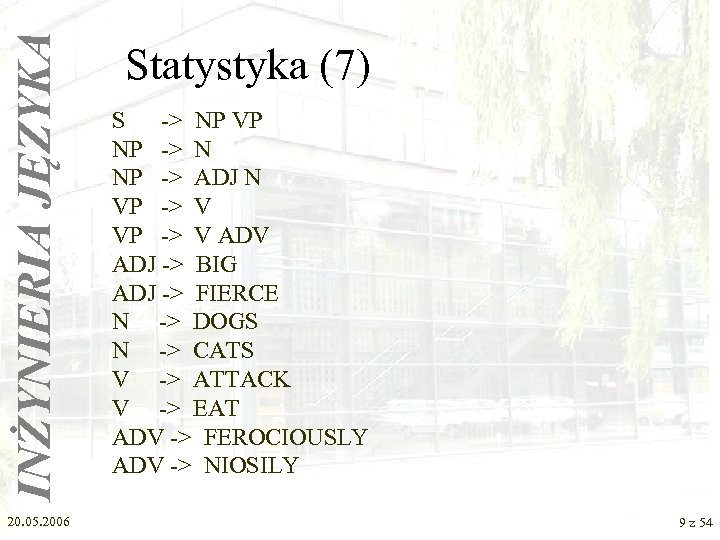

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (7) S -> NP VP NP -> N NP -> ADJ N VP -> V ADV ADJ -> BIG ADJ -> FIERCE N -> DOGS N -> CATS V -> ATTACK V -> EAT ADV -> FEROCIOUSLY ADV -> NIOSILY 9 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (7) S -> NP VP NP -> N NP -> ADJ N VP -> V ADV ADJ -> BIG ADJ -> FIERCE N -> DOGS N -> CATS V -> ATTACK V -> EAT ADV -> FEROCIOUSLY ADV -> NIOSILY 9 z 54

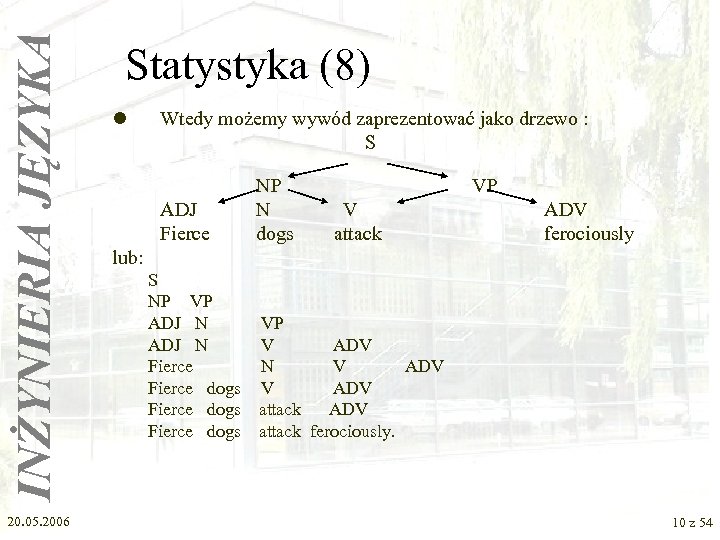

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (8) l Wtedy możemy wywód zaprezentować jako drzewo : S ADJ Fierce NP N dogs VP V attack ADV ferociously lub: S NP VP ADJ N V ADV Fierce dogs attack ADV Fierce dogs attack ferociously. 10 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (8) l Wtedy możemy wywód zaprezentować jako drzewo : S ADJ Fierce NP N dogs VP V attack ADV ferociously lub: S NP VP ADJ N V ADV Fierce dogs attack ADV Fierce dogs attack ferociously. 10 z 54

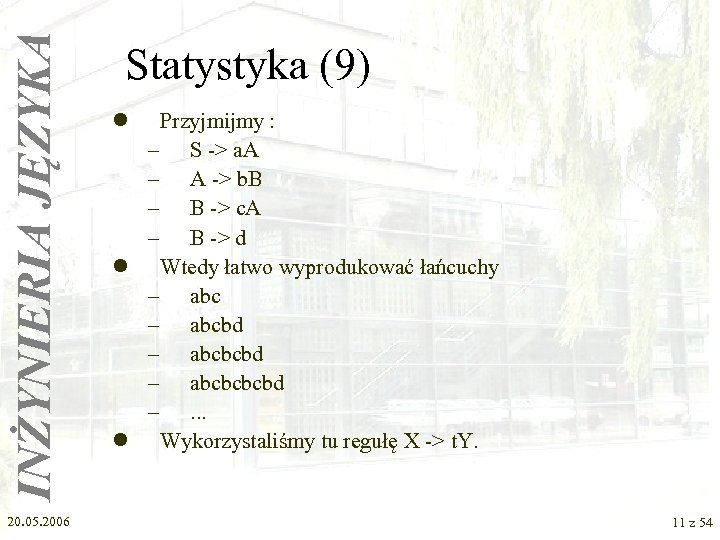

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (9) l Przyjmijmy : – S -> a. A – A -> b. B – B -> c. A – B -> d l Wtedy łatwo wyprodukować łańcuchy – abcbd – abcbcbcbd –. . . l Wykorzystaliśmy tu regułę X -> t. Y. 11 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (9) l Przyjmijmy : – S -> a. A – A -> b. B – B -> c. A – B -> d l Wtedy łatwo wyprodukować łańcuchy – abcbd – abcbcbcbd –. . . l Wykorzystaliśmy tu regułę X -> t. Y. 11 z 54

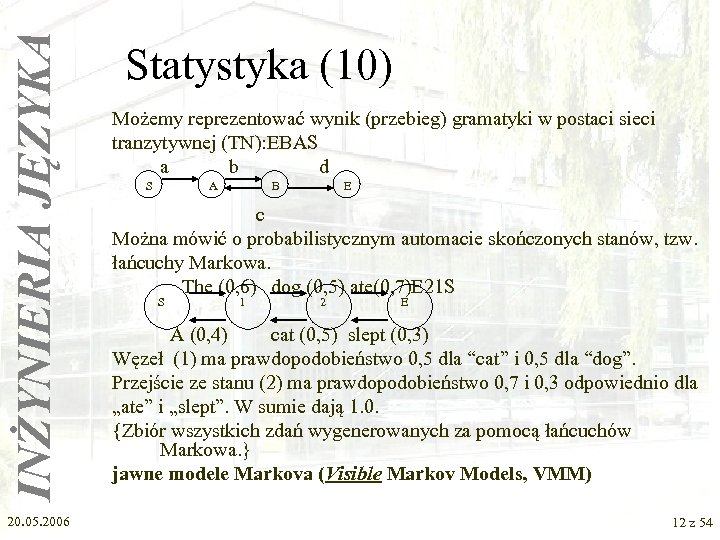

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (10) Możemy reprezentować wynik (przebieg) gramatyki w postaci sieci tranzytywnej (TN): EBAS a b d S A B E c Można mówić o probabilistycznym automacie skończonych stanów, tzw. łańcuchy Markowa. The (0, 6) dog (0, 5) ate(0, 7)E 21 S S 1 2 E A (0, 4) cat (0, 5) slept (0, 3) Węzeł (1) ma prawdopodobieństwo 0, 5 dla “cat” i 0, 5 dla “dog”. Przejście ze stanu (2) ma prawdopodobieństwo 0, 7 i 0, 3 odpowiednio dla „ate” i „slept”. W sumie dają 1. 0. {Zbiór wszystkich zdań wygenerowanych za pomocą łańcuchów Markowa. } jawne modele Markova (Visible Markov Models, VMM) 12 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (10) Możemy reprezentować wynik (przebieg) gramatyki w postaci sieci tranzytywnej (TN): EBAS a b d S A B E c Można mówić o probabilistycznym automacie skończonych stanów, tzw. łańcuchy Markowa. The (0, 6) dog (0, 5) ate(0, 7)E 21 S S 1 2 E A (0, 4) cat (0, 5) slept (0, 3) Węzeł (1) ma prawdopodobieństwo 0, 5 dla “cat” i 0, 5 dla “dog”. Przejście ze stanu (2) ma prawdopodobieństwo 0, 7 i 0, 3 odpowiednio dla „ate” i „slept”. W sumie dają 1. 0. {Zbiór wszystkich zdań wygenerowanych za pomocą łańcuchów Markowa. } jawne modele Markova (Visible Markov Models, VMM) 12 z 54

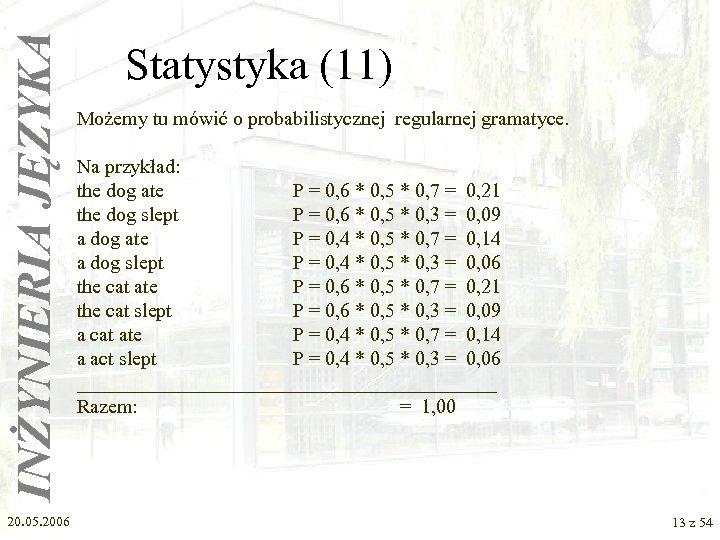

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (11) Możemy tu mówić o probabilistycznej regularnej gramatyce. Na przykład: the dog ate P = 0, 6 * 0, 5 * 0, 7 = 0, 21 the dog slept P = 0, 6 * 0, 5 * 0, 3 = 0, 09 a dog ate P = 0, 4 * 0, 5 * 0, 7 = 0, 14 a dog slept P = 0, 4 * 0, 5 * 0, 3 = 0, 06 the cat ate P = 0, 6 * 0, 5 * 0, 7 = 0, 21 the cat slept P = 0, 6 * 0, 5 * 0, 3 = 0, 09 a cat ate P = 0, 4 * 0, 5 * 0, 7 = 0, 14 a act slept P = 0, 4 * 0, 5 * 0, 3 = 0, 06 _____________________ Razem: = 1, 00 13 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Statystyka (11) Możemy tu mówić o probabilistycznej regularnej gramatyce. Na przykład: the dog ate P = 0, 6 * 0, 5 * 0, 7 = 0, 21 the dog slept P = 0, 6 * 0, 5 * 0, 3 = 0, 09 a dog ate P = 0, 4 * 0, 5 * 0, 7 = 0, 14 a dog slept P = 0, 4 * 0, 5 * 0, 3 = 0, 06 the cat ate P = 0, 6 * 0, 5 * 0, 7 = 0, 21 the cat slept P = 0, 6 * 0, 5 * 0, 3 = 0, 09 a cat ate P = 0, 4 * 0, 5 * 0, 7 = 0, 14 a act slept P = 0, 4 * 0, 5 * 0, 3 = 0, 06 _____________________ Razem: = 1, 00 13 z 54

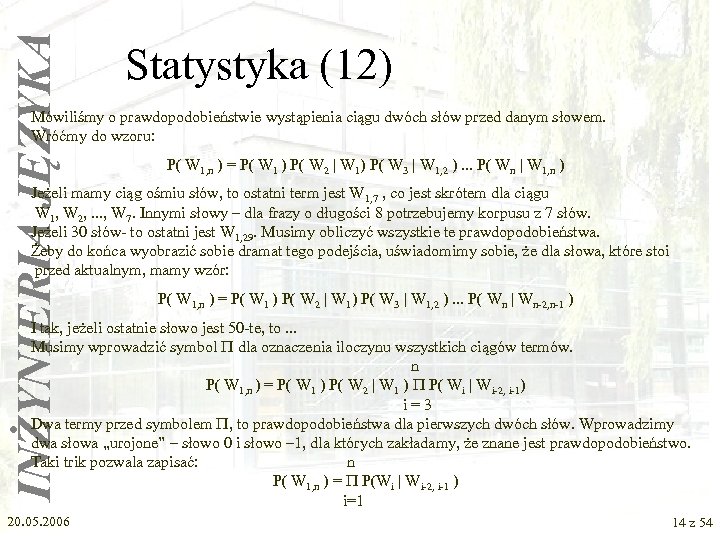

INŻYNIERIA JĘZYKA Statystyka (12) Mówiliśmy o prawdopodobieństwie wystąpienia ciągu dwóch słów przed danym słowem. Wróćmy do wzoru: P( W 1, n ) = P( W 1 ) P( W 2 | W 1) P( W 3 | W 1, 2 ). . . P( Wn | W 1, n ) Jeżeli mamy ciąg ośmiu słów, to ostatni term jest W 1, 7 , co jest skrótem dla ciągu W 1, W 2, . . . , W 7. Innymi słowy – dla frazy o długości 8 potrzebujemy korpusu z 7 słów. Jeżeli 30 słów- to ostatni jest W 1, 29. Musimy obliczyć wszystkie te prawdopodobieństwa. Żeby do końca wyobrazić sobie dramat tego podejścia, uświadomimy sobie, że dla słowa, które stoi przed aktualnym, mamy wzór: P( W 1, n ) = P( W 1 ) P( W 2 | W 1) P( W 3 | W 1, 2 ). . . P( Wn | Wn-2, n-1 ) I tak, jeżeli ostatnie słowo jest 50 -te, to. . . Musimy wprowadzić symbol dla oznaczenia iloczynu wszystkich ciągów termów. n P( W 1, n ) = P( W 1 ) P( W 2 | W 1 ) P( Wi | Wi-2, i-1) i=3 Dwa termy przed symbolem , to prawdopodobieństwa dla pierwszych dwóch słów. Wprowadzimy dwa słowa „urojone” – słowo 0 i słowo – 1, dla których zakładamy, że znane jest prawdopodobieństwo. Taki trik pozwala zapisać: n P( W 1, n ) = P(Wi | Wi-2, i-1 ) i=1 20. 05. 2006 14 z 54

INŻYNIERIA JĘZYKA Statystyka (12) Mówiliśmy o prawdopodobieństwie wystąpienia ciągu dwóch słów przed danym słowem. Wróćmy do wzoru: P( W 1, n ) = P( W 1 ) P( W 2 | W 1) P( W 3 | W 1, 2 ). . . P( Wn | W 1, n ) Jeżeli mamy ciąg ośmiu słów, to ostatni term jest W 1, 7 , co jest skrótem dla ciągu W 1, W 2, . . . , W 7. Innymi słowy – dla frazy o długości 8 potrzebujemy korpusu z 7 słów. Jeżeli 30 słów- to ostatni jest W 1, 29. Musimy obliczyć wszystkie te prawdopodobieństwa. Żeby do końca wyobrazić sobie dramat tego podejścia, uświadomimy sobie, że dla słowa, które stoi przed aktualnym, mamy wzór: P( W 1, n ) = P( W 1 ) P( W 2 | W 1) P( W 3 | W 1, 2 ). . . P( Wn | Wn-2, n-1 ) I tak, jeżeli ostatnie słowo jest 50 -te, to. . . Musimy wprowadzić symbol dla oznaczenia iloczynu wszystkich ciągów termów. n P( W 1, n ) = P( W 1 ) P( W 2 | W 1 ) P( Wi | Wi-2, i-1) i=3 Dwa termy przed symbolem , to prawdopodobieństwa dla pierwszych dwóch słów. Wprowadzimy dwa słowa „urojone” – słowo 0 i słowo – 1, dla których zakładamy, że znane jest prawdopodobieństwo. Taki trik pozwala zapisać: n P( W 1, n ) = P(Wi | Wi-2, i-1 ) i=1 20. 05. 2006 14 z 54

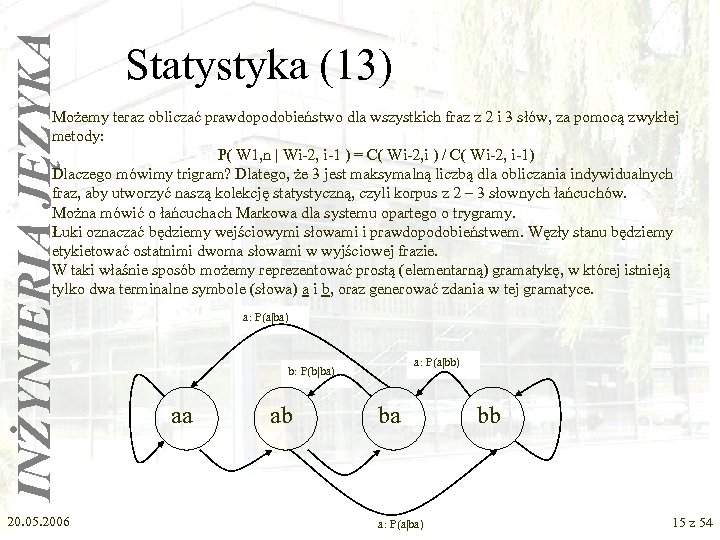

INŻYNIERIA JĘZYKA Statystyka (13) Możemy teraz obliczać prawdopodobieństwo dla wszystkich fraz z 2 i 3 słów, za pomocą zwykłej metody: P( W 1, n | Wi-2, i-1 ) = C( Wi-2, i ) / C( Wi-2, i-1) Dlaczego mówimy trigram? Dlatego, że 3 jest maksymalną liczbą dla obliczania indywidualnych fraz, aby utworzyć naszą kolekcję statystyczną, czyli korpus z 2 – 3 słownych łańcuchów. Można mówić o łańcuchach Markowa dla systemu opartego o trygramy. Łuki oznaczać będziemy wejściowymi słowami i prawdopodobieństwem. Węzły stanu będziemy etykietować ostatnimi dwoma słowami w wyjściowej frazie. W taki właśnie sposób możemy reprezentować prostą (elementarną) gramatykę, w której istnieją tylko dwa terminalne symbole (słowa) a i b, oraz generować zdania w tej gramatyce. 20. 05. 2006 a: P(a|ba) a: P(a|bb) b: P(b|ba) aa ab ba a: P(a|ba) bb 15 z 54

INŻYNIERIA JĘZYKA Statystyka (13) Możemy teraz obliczać prawdopodobieństwo dla wszystkich fraz z 2 i 3 słów, za pomocą zwykłej metody: P( W 1, n | Wi-2, i-1 ) = C( Wi-2, i ) / C( Wi-2, i-1) Dlaczego mówimy trigram? Dlatego, że 3 jest maksymalną liczbą dla obliczania indywidualnych fraz, aby utworzyć naszą kolekcję statystyczną, czyli korpus z 2 – 3 słownych łańcuchów. Można mówić o łańcuchach Markowa dla systemu opartego o trygramy. Łuki oznaczać będziemy wejściowymi słowami i prawdopodobieństwem. Węzły stanu będziemy etykietować ostatnimi dwoma słowami w wyjściowej frazie. W taki właśnie sposób możemy reprezentować prostą (elementarną) gramatykę, w której istnieją tylko dwa terminalne symbole (słowa) a i b, oraz generować zdania w tej gramatyce. 20. 05. 2006 a: P(a|ba) a: P(a|bb) b: P(b|ba) aa ab ba a: P(a|ba) bb 15 z 54

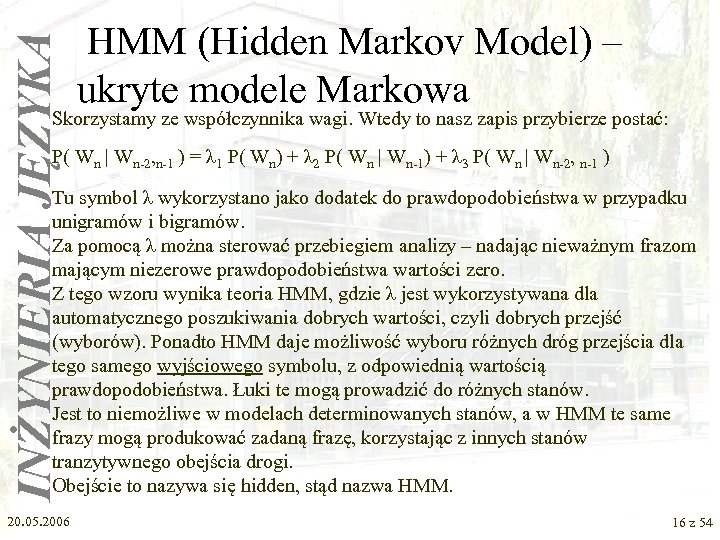

INŻYNIERIA JĘZYKA HMM (Hidden Markov Model) – ukryte modele Markowa Skorzystamy ze współczynnika wagi. Wtedy to nasz zapis przybierze postać: P( Wn | Wn-2, n-1 ) = λ 1 P( Wn) + λ 2 P( Wn | Wn-1) + λ 3 P( Wn | Wn-2, n-1 ) Tu symbol λ wykorzystano jako dodatek do prawdopodobieństwa w przypadku unigramów i bigramów. Za pomocą λ można sterować przebiegiem analizy – nadając nieważnym frazom mającym niezerowe prawdopodobieństwa wartości zero. Z tego wzoru wynika teoria HMM, gdzie λ jest wykorzystywana dla automatycznego poszukiwania dobrych wartości, czyli dobrych przejść (wyborów). Ponadto HMM daje możliwość wyboru różnych dróg przejścia dla tego samego wyjściowego symbolu, z odpowiednią wartością prawdopodobieństwa. Łuki te mogą prowadzić do różnych stanów. Jest to niemożliwe w modelach determinowanych stanów, a w HMM te same frazy mogą produkować zadaną frazę, korzystając z innych stanów tranzytywnego obejścia drogi. Obejście to nazywa się hidden, stąd nazwa HMM. 20. 05. 2006 16 z 54

INŻYNIERIA JĘZYKA HMM (Hidden Markov Model) – ukryte modele Markowa Skorzystamy ze współczynnika wagi. Wtedy to nasz zapis przybierze postać: P( Wn | Wn-2, n-1 ) = λ 1 P( Wn) + λ 2 P( Wn | Wn-1) + λ 3 P( Wn | Wn-2, n-1 ) Tu symbol λ wykorzystano jako dodatek do prawdopodobieństwa w przypadku unigramów i bigramów. Za pomocą λ można sterować przebiegiem analizy – nadając nieważnym frazom mającym niezerowe prawdopodobieństwa wartości zero. Z tego wzoru wynika teoria HMM, gdzie λ jest wykorzystywana dla automatycznego poszukiwania dobrych wartości, czyli dobrych przejść (wyborów). Ponadto HMM daje możliwość wyboru różnych dróg przejścia dla tego samego wyjściowego symbolu, z odpowiednią wartością prawdopodobieństwa. Łuki te mogą prowadzić do różnych stanów. Jest to niemożliwe w modelach determinowanych stanów, a w HMM te same frazy mogą produkować zadaną frazę, korzystając z innych stanów tranzytywnego obejścia drogi. Obejście to nazywa się hidden, stąd nazwa HMM. 20. 05. 2006 16 z 54

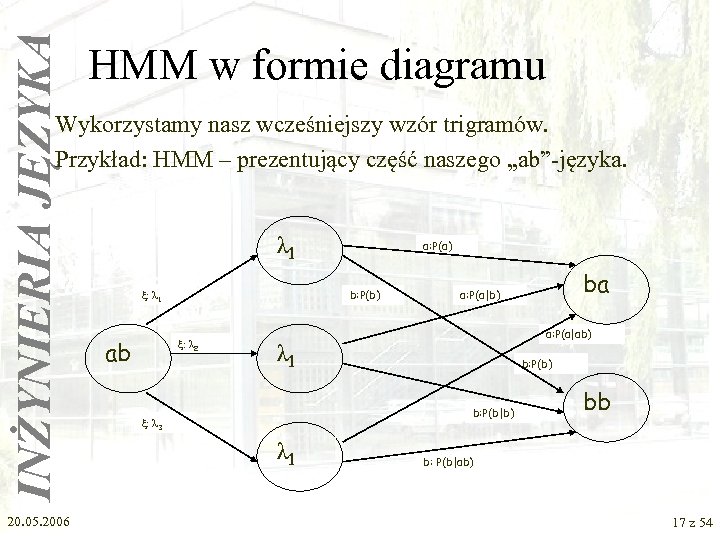

INŻYNIERIA JĘZYKA HMM w formie diagramu Wykorzystamy nasz wcześniejszy wzór trigramów. Przykład: HMM – prezentujący część naszego „ab”-języka. 20. 05. 2006 λ 1 b: P(b) ξ: λ 1 ab a: P(a) ξ: λ 2 a: P(a|ab) λ 1 b: P(b) b: P(b|b) ξ: λ 3 λ 1 ba a: P(a|b) bb b: P(b|ab) 17 z 54

INŻYNIERIA JĘZYKA HMM w formie diagramu Wykorzystamy nasz wcześniejszy wzór trigramów. Przykład: HMM – prezentujący część naszego „ab”-języka. 20. 05. 2006 λ 1 b: P(b) ξ: λ 1 ab a: P(a) ξ: λ 2 a: P(a|ab) λ 1 b: P(b) b: P(b|b) ξ: λ 3 λ 1 ba a: P(a|b) bb b: P(b|ab) 17 z 54

INŻYNIERIA JĘZYKA l l l 20. 05. 2006 HMM w formie diagramu W tym diagramie, drzewo „pseudostanów” (stany λ) jest wykorzystane zgodnie ze stałymi we wzorze. Łuki obchodzą te węzły i podają na wyjściu symbol ξ z prawdopodobieństwem równym stałej λ w tym węźle. Nieistniejące (ukryte) słowa są trikiem charakteryzującym diagram. Wykorzystanie takiego diagramu powoduje obliczenie prawdopodobieństwa łańcuchów (fraz) słów, z wykorzystaniem krzyżujących się łuków. W przypadku tym odpowiednio obliczone prawdopodobieństwo przenoszone jest od jednego stanu – do drugiego. Warunek: obliczamy sumę jedynie dla nie-pseudostanów; wtedy sumujemy wszystkie łuki między „dobrymi” stanami. Dal serii przechodzenia stanów – robimy iloczyn tych sum. I tak – prawdopodobieństwo przejścia od stanu „ab” do stanu „ba” (do wyjścia „a”) jest sumą: λ 1 P( a ) + λ 2 P( b ) + λ 3 P( a | ab) W chwili obecnej ukryte modele Markowa są wykorzystywane np. w analizatorach statystycznych, w których opracowane są efektywne algorytmy dla rozwiązania problemu sumowania wszystkich przejść. 18 z 54

INŻYNIERIA JĘZYKA l l l 20. 05. 2006 HMM w formie diagramu W tym diagramie, drzewo „pseudostanów” (stany λ) jest wykorzystane zgodnie ze stałymi we wzorze. Łuki obchodzą te węzły i podają na wyjściu symbol ξ z prawdopodobieństwem równym stałej λ w tym węźle. Nieistniejące (ukryte) słowa są trikiem charakteryzującym diagram. Wykorzystanie takiego diagramu powoduje obliczenie prawdopodobieństwa łańcuchów (fraz) słów, z wykorzystaniem krzyżujących się łuków. W przypadku tym odpowiednio obliczone prawdopodobieństwo przenoszone jest od jednego stanu – do drugiego. Warunek: obliczamy sumę jedynie dla nie-pseudostanów; wtedy sumujemy wszystkie łuki między „dobrymi” stanami. Dal serii przechodzenia stanów – robimy iloczyn tych sum. I tak – prawdopodobieństwo przejścia od stanu „ab” do stanu „ba” (do wyjścia „a”) jest sumą: λ 1 P( a ) + λ 2 P( b ) + λ 3 P( a | ab) W chwili obecnej ukryte modele Markowa są wykorzystywane np. w analizatorach statystycznych, w których opracowane są efektywne algorytmy dla rozwiązania problemu sumowania wszystkich przejść. 18 z 54

INŻYNIERIA JĘZYKA Statystyka (14) l LITERATURA: 20. 05. 2006 – Charniak E. , Statisticae Language Learning. (Breadfotd/ MIT Press) (1993) – Brill, E. , A simple Rule-Based Part of Speech Tagger Proces. 3 rd Conf. on Applied Natural Language Processing (Trento, Italy) (1992) – Jurafsky & Martin; – Dr. Jan Hajič, CS Dept. , Johns Hopkins Univ. Introduction to Natural Language Processing (600. 465), hajic@cs. jhu. edu, www. cs. jhu. edu/~hajic 19 z 54

INŻYNIERIA JĘZYKA Statystyka (14) l LITERATURA: 20. 05. 2006 – Charniak E. , Statisticae Language Learning. (Breadfotd/ MIT Press) (1993) – Brill, E. , A simple Rule-Based Part of Speech Tagger Proces. 3 rd Conf. on Applied Natural Language Processing (Trento, Italy) (1992) – Jurafsky & Martin; – Dr. Jan Hajič, CS Dept. , Johns Hopkins Univ. Introduction to Natural Language Processing (600. 465), hajic@cs. jhu. edu, www. cs. jhu. edu/~hajic 19 z 54

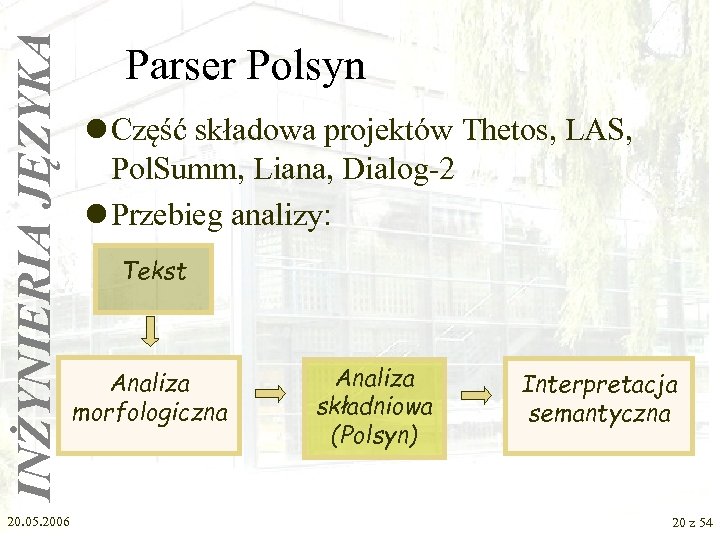

INŻYNIERIA JĘZYKA 20. 05. 2006 Parser Polsyn l Część składowa projektów Thetos, LAS, Pol. Summ, Liana, Dialog-2 l Przebieg analizy: Tekst Analiza morfologiczna Analiza składniowa (Polsyn) Interpretacja semantyczna 20 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Parser Polsyn l Część składowa projektów Thetos, LAS, Pol. Summ, Liana, Dialog-2 l Przebieg analizy: Tekst Analiza morfologiczna Analiza składniowa (Polsyn) Interpretacja semantyczna 20 z 54

INŻYNIERIA JĘZYKA Struktura zdania w SGGP Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. 20. 05. 2006 21 z 54

INŻYNIERIA JĘZYKA Struktura zdania w SGGP Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. 20. 05. 2006 21 z 54

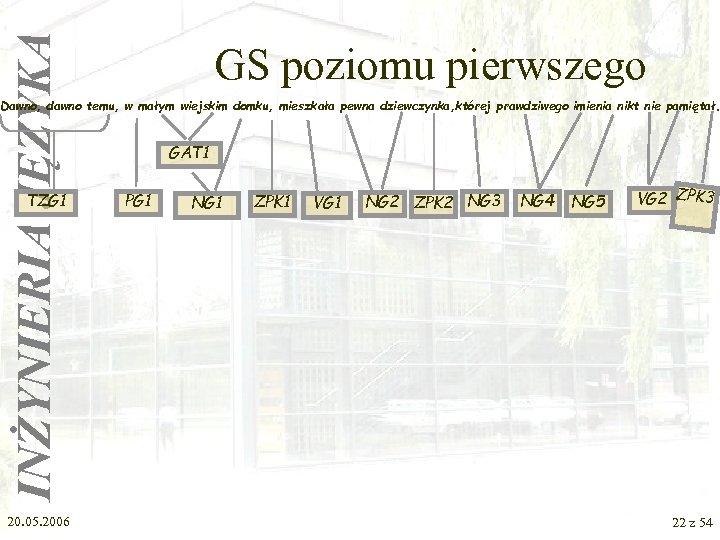

INŻYNIERIA JĘZYKA GS poziomu pierwszego Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. TZG 1 20. 05. 2006 GAT 1 PG 1 NG 1 ZPK 1 VG 1 NG 2 ZPK 2 NG 3 NG 4 NG 5 VG 2 ZPK 3 22 z 54

INŻYNIERIA JĘZYKA GS poziomu pierwszego Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. TZG 1 20. 05. 2006 GAT 1 PG 1 NG 1 ZPK 1 VG 1 NG 2 ZPK 2 NG 3 NG 4 NG 5 VG 2 ZPK 3 22 z 54

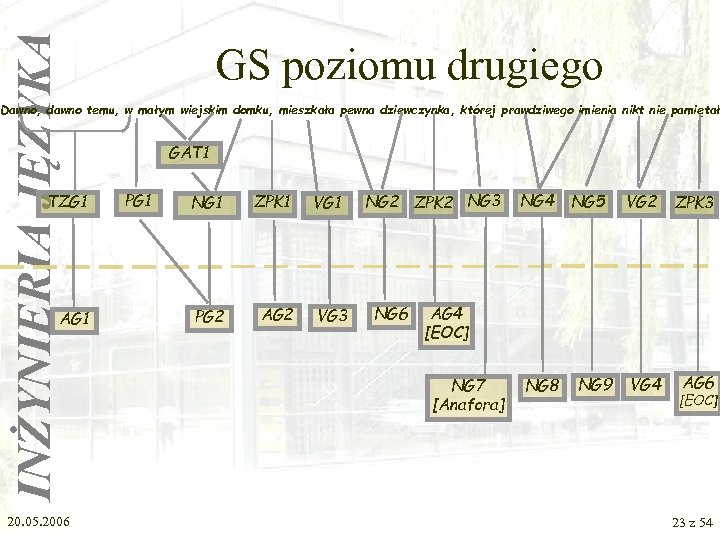

INŻYNIERIA JĘZYKA GS poziomu drugiego Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał TZG 1 AG 1 20. 05. 2006 GAT 1 PG 1 NG 1 ZPK 1 PG 2 AG 2 VG 1 VG 3 NG 2 ZPK 2 NG 3 NG 6 NG 4 NG 5 VG 2 ZPK 3 VG 4 AG 6 AG 4 [EOC] NG 7 [Anafora] NG 8 NG 9 [EOC] 23 z 54

INŻYNIERIA JĘZYKA GS poziomu drugiego Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał TZG 1 AG 1 20. 05. 2006 GAT 1 PG 1 NG 1 ZPK 1 PG 2 AG 2 VG 1 VG 3 NG 2 ZPK 2 NG 3 NG 6 NG 4 NG 5 VG 2 ZPK 3 VG 4 AG 6 AG 4 [EOC] NG 7 [Anafora] NG 8 NG 9 [EOC] 23 z 54

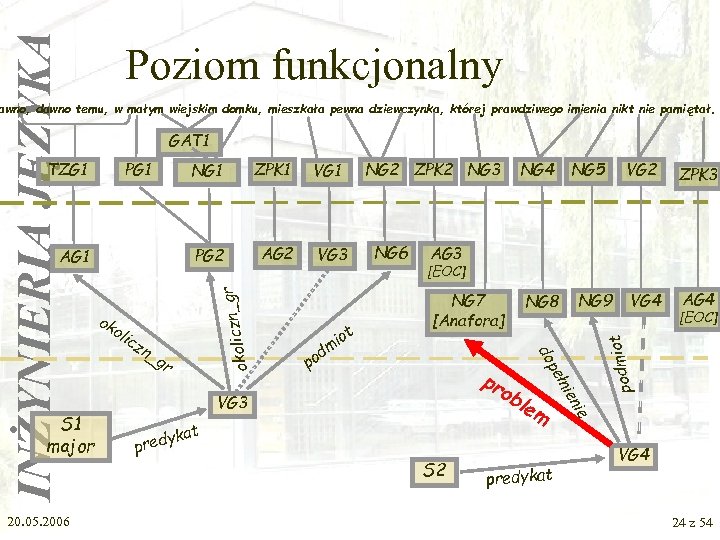

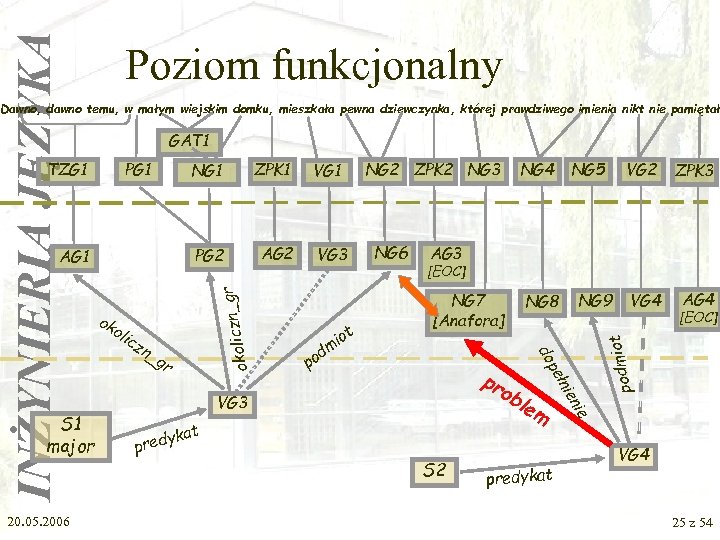

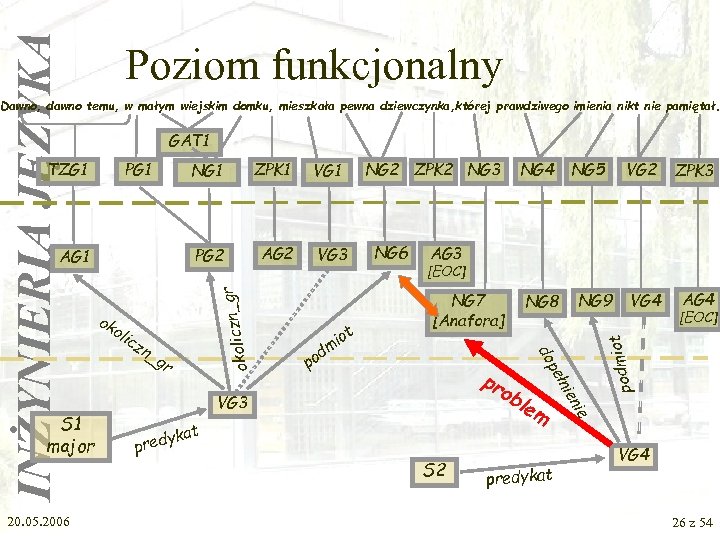

INŻYNIERIA JĘZYKA Poziom funkcjonalny awno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. GAT 1 PG 2 cz n_ gr okolicz oli iot dm NG 6 NG 5 VG 2 ZPK 3 VG 4 AG 3 [EOC] NG 7 [Anafora] po ob S 2 NG 9 NG 8 lem predykat [EOC] ie en pr VG 3 kat redy p NG 4 łni 20. 05. 2006 VG 3 NG 2 ZPK 2 NG 3 pe do S 1 major ok AG 2 VG 1 n_gr AG 1 ZPK 1 ot NG 1 podmi PG 1 TZG 1 VG 4 24 z 54

INŻYNIERIA JĘZYKA Poziom funkcjonalny awno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. GAT 1 PG 2 cz n_ gr okolicz oli iot dm NG 6 NG 5 VG 2 ZPK 3 VG 4 AG 3 [EOC] NG 7 [Anafora] po ob S 2 NG 9 NG 8 lem predykat [EOC] ie en pr VG 3 kat redy p NG 4 łni 20. 05. 2006 VG 3 NG 2 ZPK 2 NG 3 pe do S 1 major ok AG 2 VG 1 n_gr AG 1 ZPK 1 ot NG 1 podmi PG 1 TZG 1 VG 4 24 z 54

INŻYNIERIA JĘZYKA Poziom funkcjonalny Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał GAT 1 PG 2 cz n_ gr okolicz oli iot dm NG 6 NG 5 VG 2 ZPK 3 VG 4 AG 3 [EOC] NG 7 [Anafora] po ob S 2 NG 9 NG 8 lem predykat [EOC] ie en pr VG 3 kat redy p NG 4 łni 20. 05. 2006 VG 3 NG 2 ZPK 2 NG 3 pe do S 1 major ok AG 2 VG 1 n_gr AG 1 ZPK 1 ot NG 1 podmi PG 1 TZG 1 VG 4 25 z 54

INŻYNIERIA JĘZYKA Poziom funkcjonalny Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał GAT 1 PG 2 cz n_ gr okolicz oli iot dm NG 6 NG 5 VG 2 ZPK 3 VG 4 AG 3 [EOC] NG 7 [Anafora] po ob S 2 NG 9 NG 8 lem predykat [EOC] ie en pr VG 3 kat redy p NG 4 łni 20. 05. 2006 VG 3 NG 2 ZPK 2 NG 3 pe do S 1 major ok AG 2 VG 1 n_gr AG 1 ZPK 1 ot NG 1 podmi PG 1 TZG 1 VG 4 25 z 54

INŻYNIERIA JĘZYKA Poziom funkcjonalny Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. GAT 1 PG 2 cz n_ gr okolicz oli iot dm NG 6 NG 5 VG 2 ZPK 3 VG 4 AG 3 [EOC] NG 7 [Anafora] po ob S 2 NG 9 NG 8 lem predykat [EOC] ie en pr VG 3 kat redy p NG 4 łni 20. 05. 2006 VG 3 NG 2 ZPK 2 NG 3 pe do S 1 major ok AG 2 VG 1 n_gr AG 1 ZPK 1 ot NG 1 podmi PG 1 TZG 1 VG 4 26 z 54

INŻYNIERIA JĘZYKA Poziom funkcjonalny Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. GAT 1 PG 2 cz n_ gr okolicz oli iot dm NG 6 NG 5 VG 2 ZPK 3 VG 4 AG 3 [EOC] NG 7 [Anafora] po ob S 2 NG 9 NG 8 lem predykat [EOC] ie en pr VG 3 kat redy p NG 4 łni 20. 05. 2006 VG 3 NG 2 ZPK 2 NG 3 pe do S 1 major ok AG 2 VG 1 n_gr AG 1 ZPK 1 ot NG 1 podmi PG 1 TZG 1 VG 4 26 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Anafora w SGGP l W SGGP przez anaforę rozumiemy relację nie między pojedynczymi słowami, a między GS l W naszym przykładzie: – NG 7 - anafora – NG 6 - antecedent NG 7 l Przykłady inne: Jej mamusia także lubiła używać tego imienia, bo pasowało do dziewczynki. Wtedy wybiła północ i stało się to, co zapowiedziała wróżka. 27 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Anafora w SGGP l W SGGP przez anaforę rozumiemy relację nie między pojedynczymi słowami, a między GS l W naszym przykładzie: – NG 7 - anafora – NG 6 - antecedent NG 7 l Przykłady inne: Jej mamusia także lubiła używać tego imienia, bo pasowało do dziewczynki. Wtedy wybiła północ i stało się to, co zapowiedziała wróżka. 27 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Analiza semantyczna l l l Predykatywno-argumentowy model zdania Relacja n-arna Zbiór relacji binarnych Relacje wyprowadzone Interpretacja semantyczna 28 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Analiza semantyczna l l l Predykatywno-argumentowy model zdania Relacja n-arna Zbiór relacji binarnych Relacje wyprowadzone Interpretacja semantyczna 28 z 54

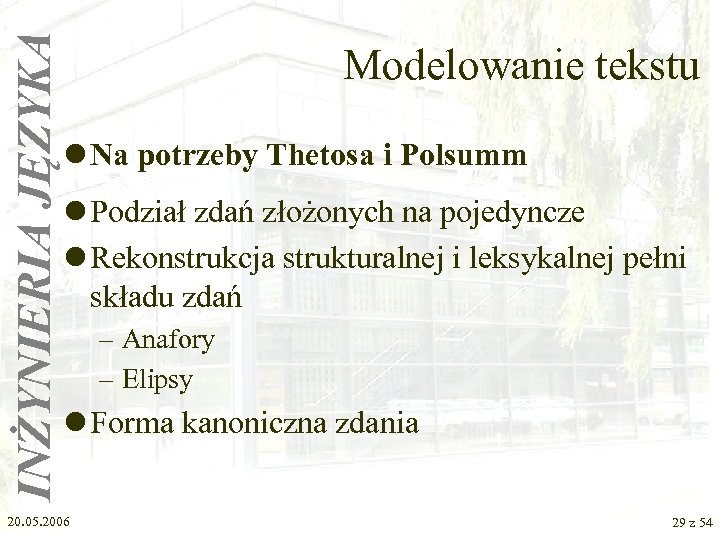

INŻYNIERIA JĘZYKA Modelowanie tekstu l Na potrzeby Thetosa i Polsumm l Podział zdań złożonych na pojedyncze l Rekonstrukcja strukturalnej i leksykalnej pełni składu zdań – Anafory – Elipsy l Forma kanoniczna zdania 20. 05. 2006 29 z 54

INŻYNIERIA JĘZYKA Modelowanie tekstu l Na potrzeby Thetosa i Polsumm l Podział zdań złożonych na pojedyncze l Rekonstrukcja strukturalnej i leksykalnej pełni składu zdań – Anafory – Elipsy l Forma kanoniczna zdania 20. 05. 2006 29 z 54

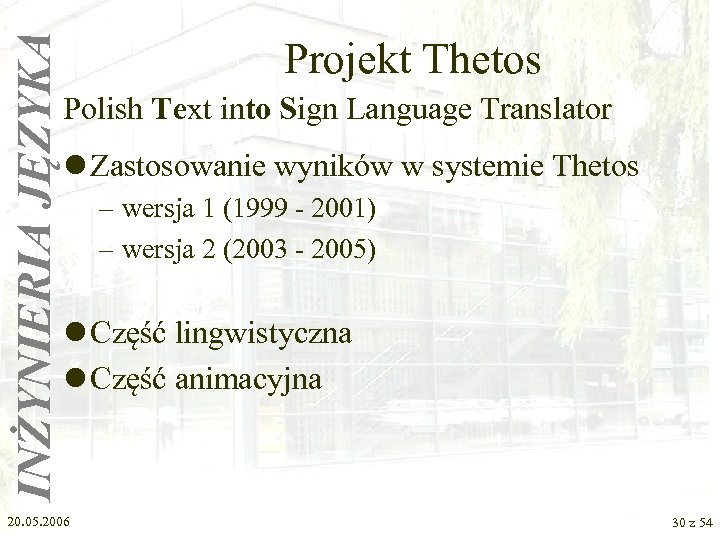

INŻYNIERIA JĘZYKA Projekt Thetos Polish Text into Sign Language Translator l Zastosowanie wyników w systemie Thetos – wersja 1 (1999 - 2001) – wersja 2 (2003 - 2005) l Część lingwistyczna l Część animacyjna 20. 05. 2006 30 z 54

INŻYNIERIA JĘZYKA Projekt Thetos Polish Text into Sign Language Translator l Zastosowanie wyników w systemie Thetos – wersja 1 (1999 - 2001) – wersja 2 (2003 - 2005) l Część lingwistyczna l Część animacyjna 20. 05. 2006 30 z 54

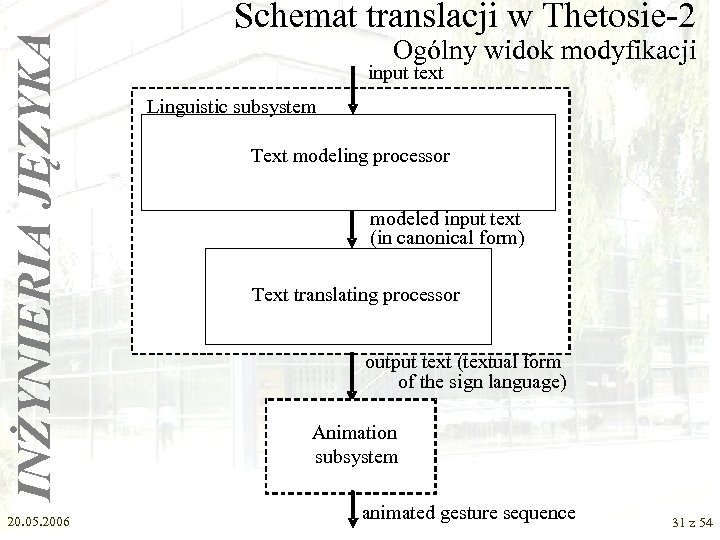

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Ogólny widok modyfikacji input text Linguistic subsystem Text modeling processor modeled input text (in canonical form) Text translating processor output text (textual form of the sign language) Animation subsystem animated gesture sequence 31 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Ogólny widok modyfikacji input text Linguistic subsystem Text modeling processor modeled input text (in canonical form) Text translating processor output text (textual form of the sign language) Animation subsystem animated gesture sequence 31 z 54

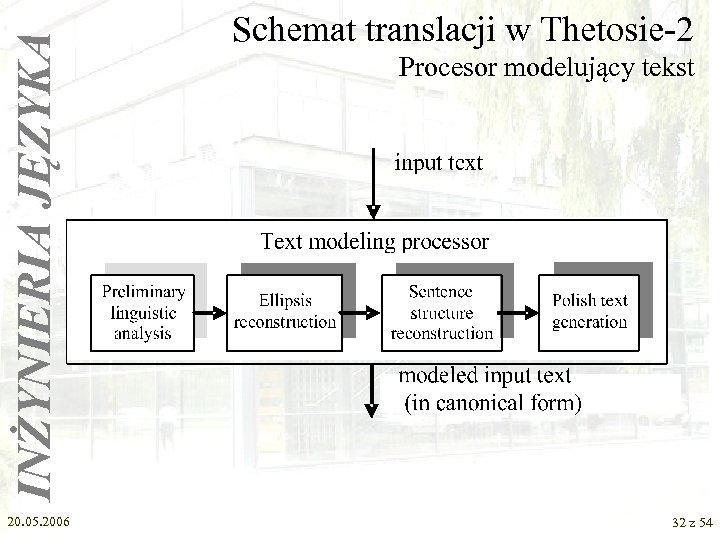

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Procesor modelujący tekst 32 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Procesor modelujący tekst 32 z 54

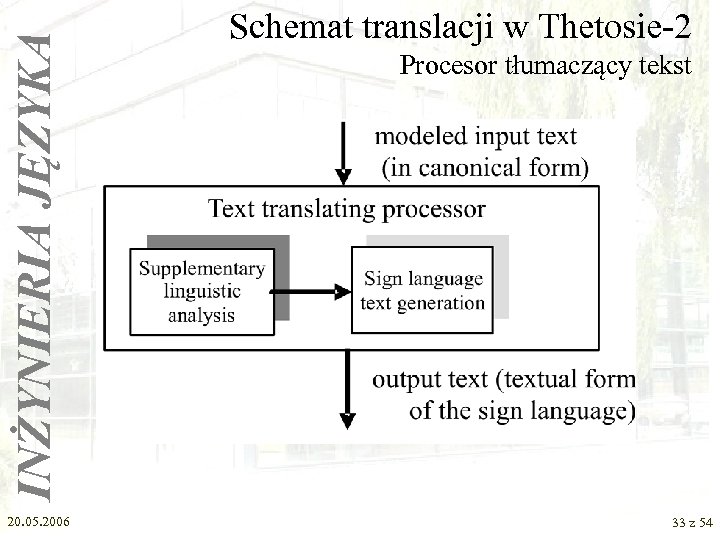

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Procesor tłumaczący tekst 33 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Procesor tłumaczący tekst 33 z 54

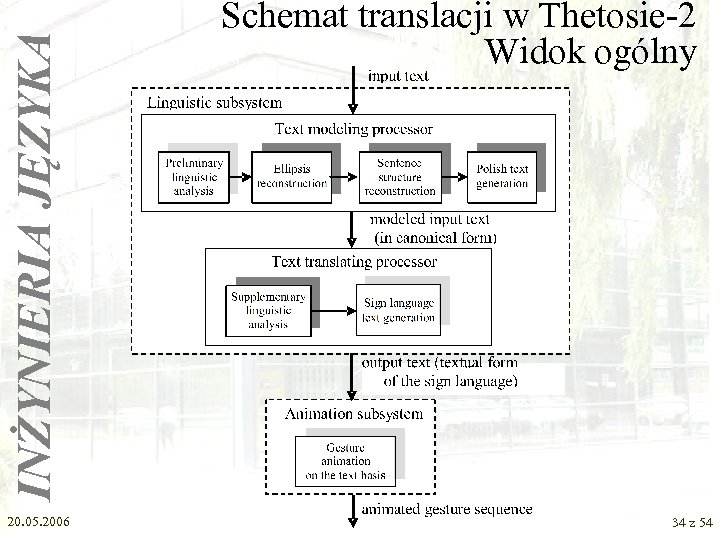

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Widok ogólny 34 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat translacji w Thetosie-2 Widok ogólny 34 z 54

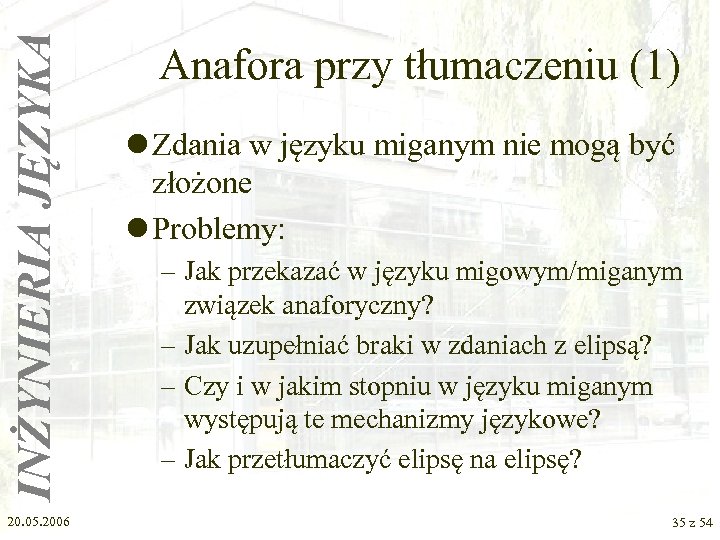

INŻYNIERIA JĘZYKA 20. 05. 2006 Anafora przy tłumaczeniu (1) l Zdania w języku miganym nie mogą być złożone l Problemy: – Jak przekazać w języku migowym/miganym związek anaforyczny? – Jak uzupełniać braki w zdaniach z elipsą? – Czy i w jakim stopniu w języku miganym występują te mechanizmy językowe? – Jak przetłumaczyć elipsę na elipsę? 35 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Anafora przy tłumaczeniu (1) l Zdania w języku miganym nie mogą być złożone l Problemy: – Jak przekazać w języku migowym/miganym związek anaforyczny? – Jak uzupełniać braki w zdaniach z elipsą? – Czy i w jakim stopniu w języku miganym występują te mechanizmy językowe? – Jak przetłumaczyć elipsę na elipsę? 35 z 54

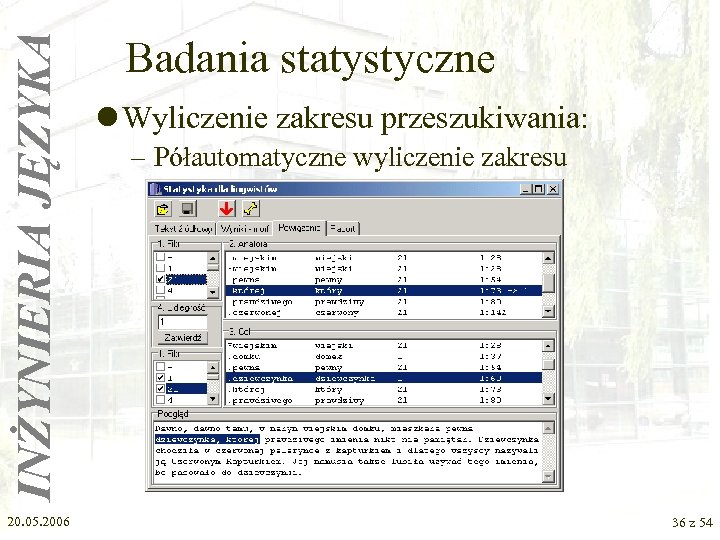

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne l Wyliczenie zakresu przeszukiwania: – Półautomatyczne wyliczenie zakresu 36 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne l Wyliczenie zakresu przeszukiwania: – Półautomatyczne wyliczenie zakresu 36 z 54

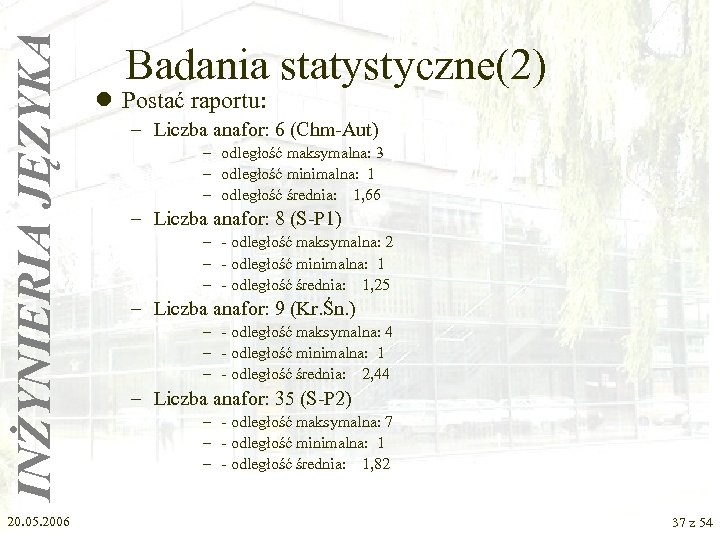

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne(2) l Postać raportu: – Liczba anafor: 6 (Chm-Aut) – odległość maksymalna: 3 – odległość minimalna: 1 – odległość średnia: 1, 66 – Liczba anafor: 8 (S-P 1) – - odległość maksymalna: 2 – - odległość minimalna: 1 – - odległość średnia: 1, 25 – Liczba anafor: 9 (Kr. Śn. ) – - odległość maksymalna: 4 – - odległość minimalna: 1 – - odległość średnia: 2, 44 – Liczba anafor: 35 (S-P 2) – - odległość maksymalna: 7 – - odległość minimalna: 1 – - odległość średnia: 1, 82 37 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne(2) l Postać raportu: – Liczba anafor: 6 (Chm-Aut) – odległość maksymalna: 3 – odległość minimalna: 1 – odległość średnia: 1, 66 – Liczba anafor: 8 (S-P 1) – - odległość maksymalna: 2 – - odległość minimalna: 1 – - odległość średnia: 1, 25 – Liczba anafor: 9 (Kr. Śn. ) – - odległość maksymalna: 4 – - odległość minimalna: 1 – - odległość średnia: 2, 44 – Liczba anafor: 35 (S-P 2) – - odległość maksymalna: 7 – - odległość minimalna: 1 – - odległość średnia: 1, 82 37 z 54

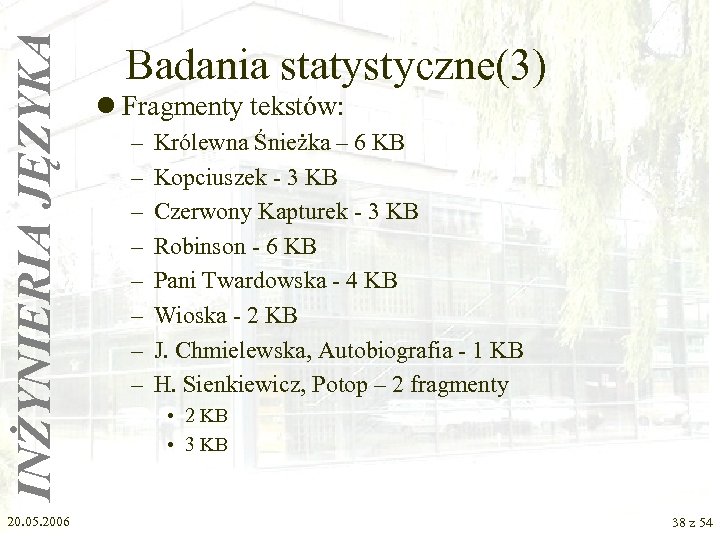

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne(3) l Fragmenty tekstów: – – – – Królewna Śnieżka – 6 KB Kopciuszek - 3 KB Czerwony Kapturek - 3 KB Robinson - 6 KB Pani Twardowska - 4 KB Wioska - 2 KB J. Chmielewska, Autobiografia - 1 KB H. Sienkiewicz, Potop – 2 fragmenty • 2 KB • 3 KB 38 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne(3) l Fragmenty tekstów: – – – – Królewna Śnieżka – 6 KB Kopciuszek - 3 KB Czerwony Kapturek - 3 KB Robinson - 6 KB Pani Twardowska - 4 KB Wioska - 2 KB J. Chmielewska, Autobiografia - 1 KB H. Sienkiewicz, Potop – 2 fragmenty • 2 KB • 3 KB 38 z 54

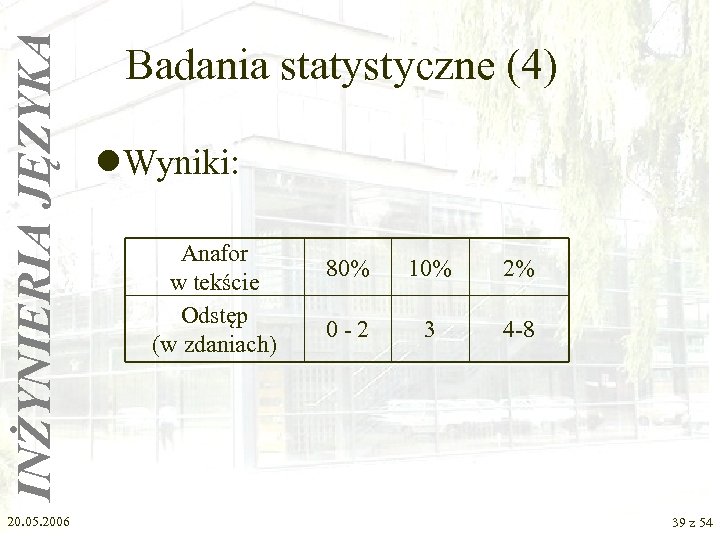

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne (4) l. Wyniki: Anafor w tekście Odstęp (w zdaniach) 80% 10% 2% 0 -2 3 4 -8 39 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne (4) l. Wyniki: Anafor w tekście Odstęp (w zdaniach) 80% 10% 2% 0 -2 3 4 -8 39 z 54

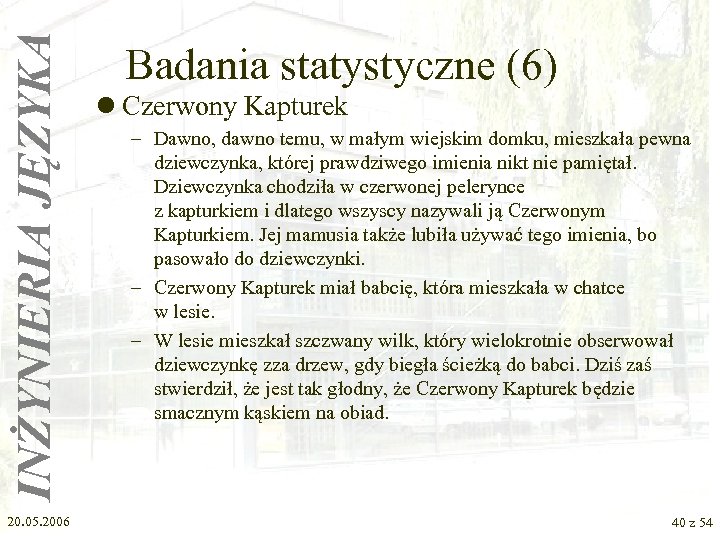

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne (6) l Czerwony Kapturek – Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. Dziewczynka chodziła w czerwonej pelerynce z kapturkiem i dlatego wszyscy nazywali ją Czerwonym Kapturkiem. Jej mamusia także lubiła używać tego imienia, bo pasowało do dziewczynki. – Czerwony Kapturek miał babcię, która mieszkała w chatce w lesie. – W lesie mieszkał szczwany wilk, który wielokrotnie obserwował dziewczynkę zza drzew, gdy biegła ścieżką do babci. Dziś zaś stwierdził, że jest tak głodny, że Czerwony Kapturek będzie smacznym kąskiem na obiad. 40 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Badania statystyczne (6) l Czerwony Kapturek – Dawno, dawno temu, w małym wiejskim domku, mieszkała pewna dziewczynka, której prawdziwego imienia nikt nie pamiętał. Dziewczynka chodziła w czerwonej pelerynce z kapturkiem i dlatego wszyscy nazywali ją Czerwonym Kapturkiem. Jej mamusia także lubiła używać tego imienia, bo pasowało do dziewczynki. – Czerwony Kapturek miał babcię, która mieszkała w chatce w lesie. – W lesie mieszkał szczwany wilk, który wielokrotnie obserwował dziewczynkę zza drzew, gdy biegła ścieżką do babci. Dziś zaś stwierdził, że jest tak głodny, że Czerwony Kapturek będzie smacznym kąskiem na obiad. 40 z 54

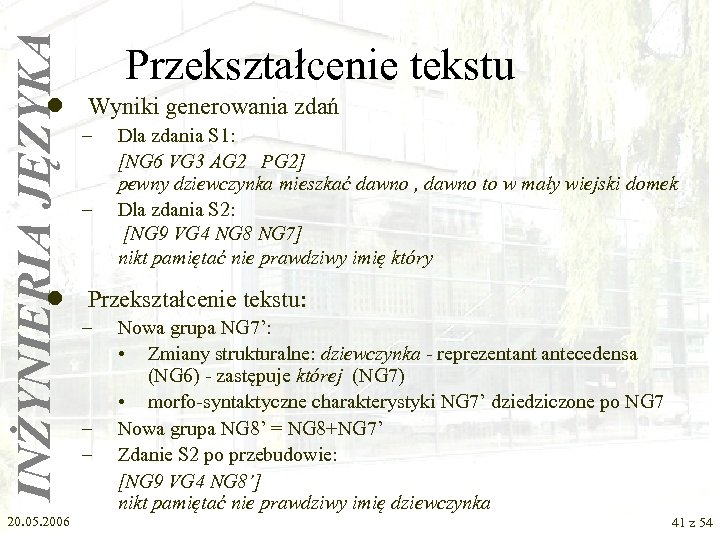

INŻYNIERIA JĘZYKA Przekształcenie tekstu l Wyniki generowania zdań – – Dla zdania S 1: [NG 6 VG 3 AG 2 PG 2] pewny dziewczynka mieszkać dawno , dawno to w mały wiejski domek Dla zdania S 2: [NG 9 VG 4 NG 8 NG 7] nikt pamiętać nie prawdziwy imię który l Przekształcenie tekstu: 20. 05. 2006 – – – Nowa grupa NG 7’: • Zmiany strukturalne: dziewczynka - reprezentant antecedensa (NG 6) - zastępuje której (NG 7) • morfo-syntaktyczne charakterystyki NG 7’ dziedziczone po NG 7 Nowa grupa NG 8’ = NG 8+NG 7’ Zdanie S 2 po przebudowie: [NG 9 VG 4 NG 8’] nikt pamiętać nie prawdziwy imię dziewczynka 41 z 54

INŻYNIERIA JĘZYKA Przekształcenie tekstu l Wyniki generowania zdań – – Dla zdania S 1: [NG 6 VG 3 AG 2 PG 2] pewny dziewczynka mieszkać dawno , dawno to w mały wiejski domek Dla zdania S 2: [NG 9 VG 4 NG 8 NG 7] nikt pamiętać nie prawdziwy imię który l Przekształcenie tekstu: 20. 05. 2006 – – – Nowa grupa NG 7’: • Zmiany strukturalne: dziewczynka - reprezentant antecedensa (NG 6) - zastępuje której (NG 7) • morfo-syntaktyczne charakterystyki NG 7’ dziedziczone po NG 7 Nowa grupa NG 8’ = NG 8+NG 7’ Zdanie S 2 po przebudowie: [NG 9 VG 4 NG 8’] nikt pamiętać nie prawdziwy imię dziewczynka 41 z 54

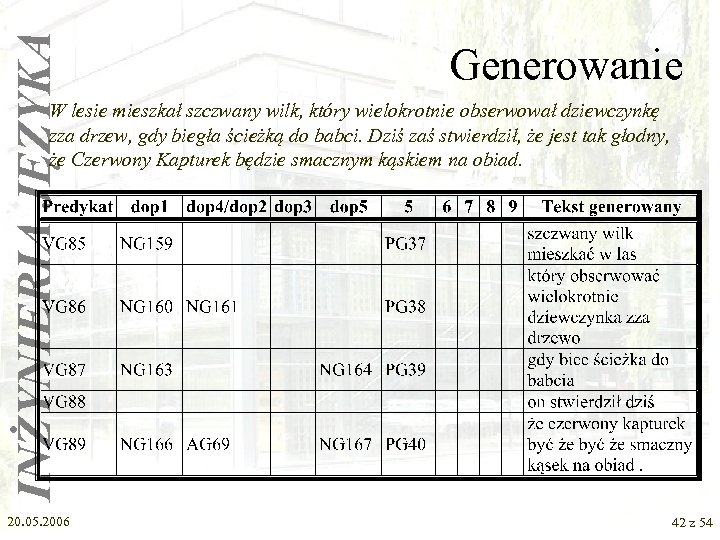

INŻYNIERIA JĘZYKA Generowanie W lesie mieszkał szczwany wilk, który wielokrotnie obserwował dziewczynkę zza drzew, gdy biegła ścieżką do babci. Dziś zaś stwierdził, że jest tak głodny, że Czerwony Kapturek będzie smacznym kąskiem na obiad. 20. 05. 2006 42 z 54

INŻYNIERIA JĘZYKA Generowanie W lesie mieszkał szczwany wilk, który wielokrotnie obserwował dziewczynkę zza drzew, gdy biegła ścieżką do babci. Dziś zaś stwierdził, że jest tak głodny, że Czerwony Kapturek będzie smacznym kąskiem na obiad. 20. 05. 2006 42 z 54

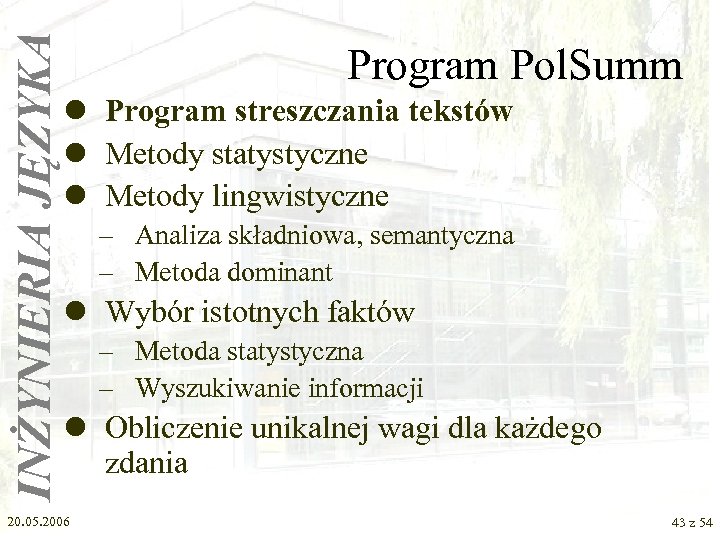

INŻYNIERIA JĘZYKA Program Pol. Summ l Program streszczania tekstów l Metody statystyczne l Metody lingwistyczne – Analiza składniowa, semantyczna – Metoda dominant l Wybór istotnych faktów – Metoda statystyczna – Wyszukiwanie informacji l Obliczenie unikalnej wagi dla każdego zdania 20. 05. 2006 43 z 54

INŻYNIERIA JĘZYKA Program Pol. Summ l Program streszczania tekstów l Metody statystyczne l Metody lingwistyczne – Analiza składniowa, semantyczna – Metoda dominant l Wybór istotnych faktów – Metoda statystyczna – Wyszukiwanie informacji l Obliczenie unikalnej wagi dla każdego zdania 20. 05. 2006 43 z 54

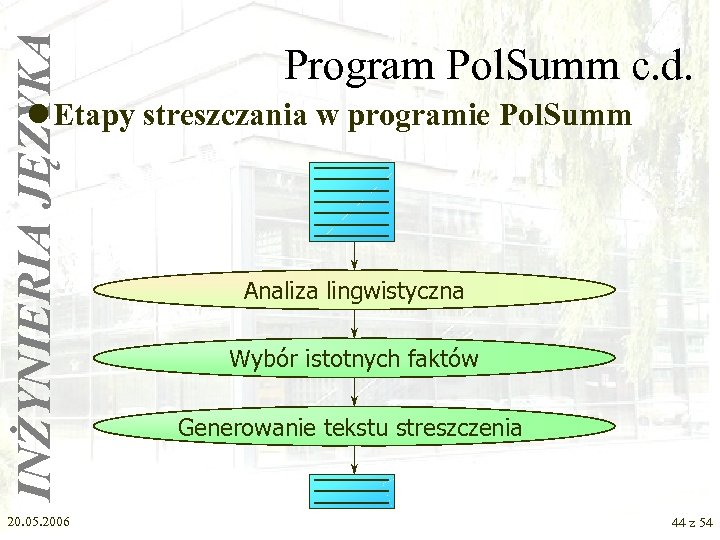

INŻYNIERIA JĘZYKA Program Pol. Summ c. d. l Etapy streszczania w programie Pol. Summ 20. 05. 2006 Analiza lingwistyczna Wybór istotnych faktów Generowanie tekstu streszczenia 44 z 54

INŻYNIERIA JĘZYKA Program Pol. Summ c. d. l Etapy streszczania w programie Pol. Summ 20. 05. 2006 Analiza lingwistyczna Wybór istotnych faktów Generowanie tekstu streszczenia 44 z 54

INŻYNIERIA JĘZYKA Serwer lingwistyczny LAS (1) l Stanowisko badawcze l Serwer analizy lingwistycznej LAS (Linguistics Analysis Server) 45 z 54 l http: //thetos. zo. iinf. polsl. gliwice. pl/las 2/ l http: //thetos. zo. iinf. polsl. gliwice. pl/forum/

INŻYNIERIA JĘZYKA Serwer lingwistyczny LAS (1) l Stanowisko badawcze l Serwer analizy lingwistycznej LAS (Linguistics Analysis Server) 45 z 54 l http: //thetos. zo. iinf. polsl. gliwice. pl/las 2/ l http: //thetos. zo. iinf. polsl. gliwice. pl/forum/

INŻYNIERIA JĘZYKA 20. 05. 2006 Serwer lingwistyczny LAS (2) l l l Analiza morfologiczna Analiza składniowa Thetos Polsumm Modelowanie tekstu Słowniki ? ? ? 46 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Serwer lingwistyczny LAS (2) l l l Analiza morfologiczna Analiza składniowa Thetos Polsumm Modelowanie tekstu Słowniki ? ? ? 46 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Serwer lingwistyczny LAS (3) l Forum 47 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Serwer lingwistyczny LAS (3) l Forum 47 z 54

INŻYNIERIA JĘZYKA System LIAna (1) l Opracowanie oprogramowania wspomagającego analityka obiektowego l Opracowanie elementów metodyki LIA (Linguistically based Information Analysis) dla języka polskiego 20. 05. 2006 – algorytmy automatycznej identyfikacji kluczowych abstrakcji: • • wydzielenie kandydatów na klasy, obiekty lub atrybuty wydzielenie kandydatów na relacje, zdarzenia lub metody – algorytmy inne: • • • wyszukiwanie kontekstów dla zidentyfikowanych pojęć podejmowanie decyzji na podstawie macierzy kontekstowej sporządzenie arkuszu roboczego analityka (tezaurus, baza doświadczenia) itd. 48 z 54

INŻYNIERIA JĘZYKA System LIAna (1) l Opracowanie oprogramowania wspomagającego analityka obiektowego l Opracowanie elementów metodyki LIA (Linguistically based Information Analysis) dla języka polskiego 20. 05. 2006 – algorytmy automatycznej identyfikacji kluczowych abstrakcji: • • wydzielenie kandydatów na klasy, obiekty lub atrybuty wydzielenie kandydatów na relacje, zdarzenia lub metody – algorytmy inne: • • • wyszukiwanie kontekstów dla zidentyfikowanych pojęć podejmowanie decyzji na podstawie macierzy kontekstowej sporządzenie arkuszu roboczego analityka (tezaurus, baza doświadczenia) itd. 48 z 54

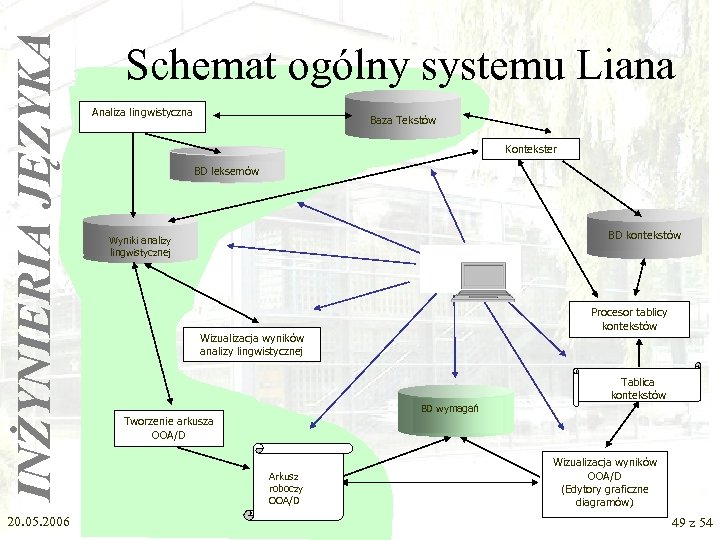

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat ogólny systemu Liana Analiza lingwistyczna Baza Tekstów Kontekster BD leksemów BD kontekstów Wyniki analizy lingwistycznej Procesor tablicy kontekstów Wizualizacja wyników analizy lingwistycznej Tablica kontekstów BD wymagań Tworzenie arkusza OOA/D Arkusz roboczy OOA/D Wizualizacja wyników OOA/D (Edytory graficzne diagramów) 49 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Schemat ogólny systemu Liana Analiza lingwistyczna Baza Tekstów Kontekster BD leksemów BD kontekstów Wyniki analizy lingwistycznej Procesor tablicy kontekstów Wizualizacja wyników analizy lingwistycznej Tablica kontekstów BD wymagań Tworzenie arkusza OOA/D Arkusz roboczy OOA/D Wizualizacja wyników OOA/D (Edytory graficzne diagramów) 49 z 54

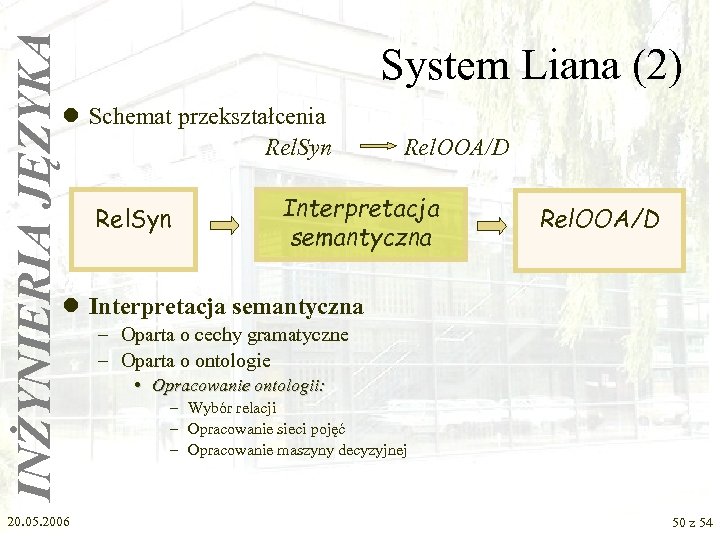

INŻYNIERIA JĘZYKA System Liana (2) l Schemat przekształcenia Rel. Syn Rel. OOA/D Interpretacja semantyczna Rel. OOA/D l Interpretacja semantyczna 20. 05. 2006 – Oparta o cechy gramatyczne – Oparta o ontologie • Opracowanie ontologii: – Wybór relacji – Opracowanie sieci pojęć – Opracowanie maszyny decyzyjnej 50 z 54

INŻYNIERIA JĘZYKA System Liana (2) l Schemat przekształcenia Rel. Syn Rel. OOA/D Interpretacja semantyczna Rel. OOA/D l Interpretacja semantyczna 20. 05. 2006 – Oparta o cechy gramatyczne – Oparta o ontologie • Opracowanie ontologii: – Wybór relacji – Opracowanie sieci pojęć – Opracowanie maszyny decyzyjnej 50 z 54

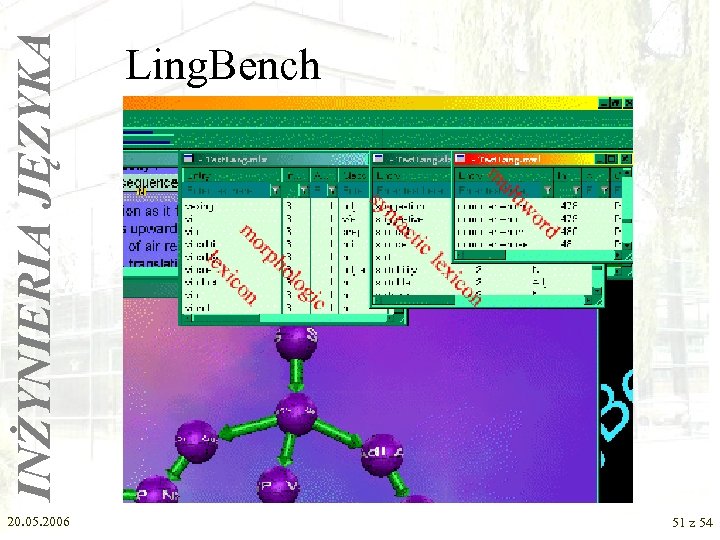

INŻYNIERIA JĘZYKA 20. 05. 2006 Ling. Bench 51 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Ling. Bench 51 z 54

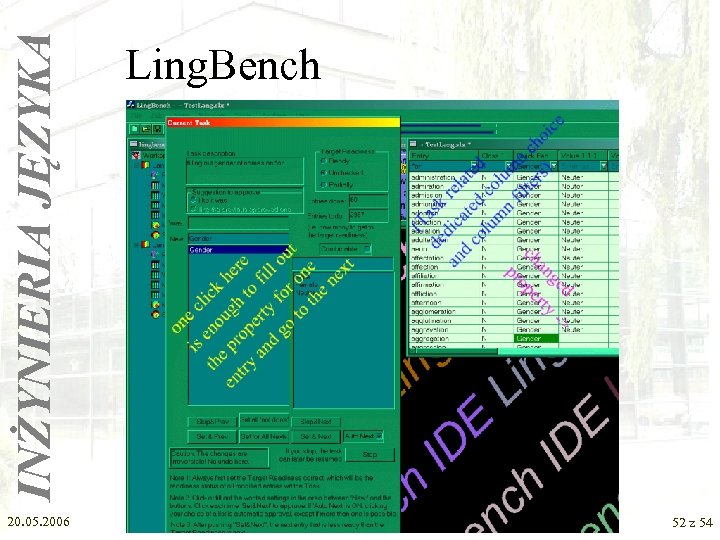

INŻYNIERIA JĘZYKA 20. 05. 2006 Ling. Bench 52 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Ling. Bench 52 z 54

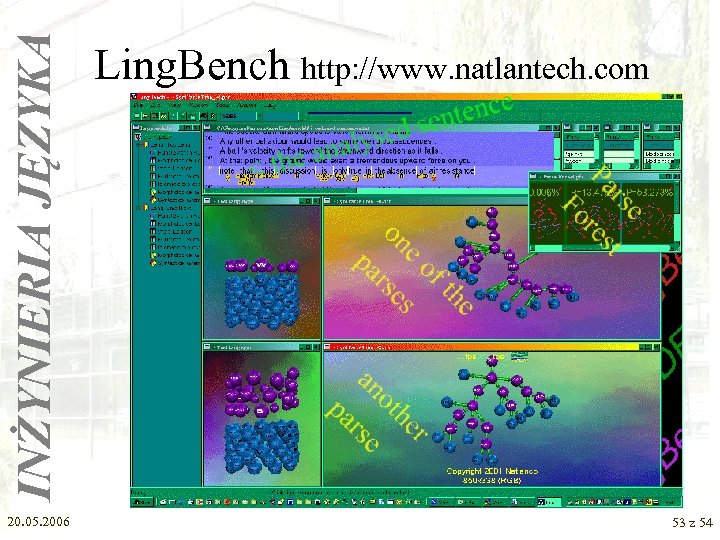

INŻYNIERIA JĘZYKA 20. 05. 2006 Ling. Bench http: //www. natlantech. com 53 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 Ling. Bench http: //www. natlantech. com 53 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 54 z 54

INŻYNIERIA JĘZYKA 20. 05. 2006 54 z 54