Введение в теорию информации Паначёв Максим Александрович / ассистент кафедры вычислительной математики ИМКН / Солодушкин Святослав Игоревич / к. ф. -м. н. , доцент кафедры вычислительной математики ИМКН) /

Введение в теорию информации Паначёв Максим Александрович / ассистент кафедры вычислительной математики ИМКН / Солодушкин Святослав Игоревич / к. ф. -м. н. , доцент кафедры вычислительной математики ИМКН) /

Клод Шеннон • В 1948 году, исследуя проблему рациональной передачи информации через зашумлённый коммуникационный канал, Клод Шеннон разработал математическую теорию обработки, передачи и хранения информации. • Его идеи легли в основу двух фундаментальных научных направлений: теории информации и теории кодирования.

Клод Шеннон • В 1948 году, исследуя проблему рациональной передачи информации через зашумлённый коммуникационный канал, Клод Шеннон разработал математическую теорию обработки, передачи и хранения информации. • Его идеи легли в основу двух фундаментальных научных направлений: теории информации и теории кодирования.

Информация • Рассмотрим следующую модель: Источник (Отправитель) Канал передачи данных Приёмник (Получатель) • Поток данных от источника к приёмнику может как непрерывным, так и дискретным (в виде сообщений).

Информация • Рассмотрим следующую модель: Источник (Отправитель) Канал передачи данных Приёмник (Получатель) • Поток данных от источника к приёмнику может как непрерывным, так и дискретным (в виде сообщений).

Количество информации • Количество информации (по Шеннону) – это мера уменьшения неопределённости знаний приёмника (получателя). • Информацию принято измерять в битах. • За единицу количества информации (1 бит) принимают то количество, которое содержит сообщение, уменьшающее неопределенность знаний в два раза. • Как оценить количество информации, содержащееся в полученном сообщении?

Количество информации • Количество информации (по Шеннону) – это мера уменьшения неопределённости знаний приёмника (получателя). • Информацию принято измерять в битах. • За единицу количества информации (1 бит) принимают то количество, которое содержит сообщение, уменьшающее неопределенность знаний в два раза. • Как оценить количество информации, содержащееся в полученном сообщении?

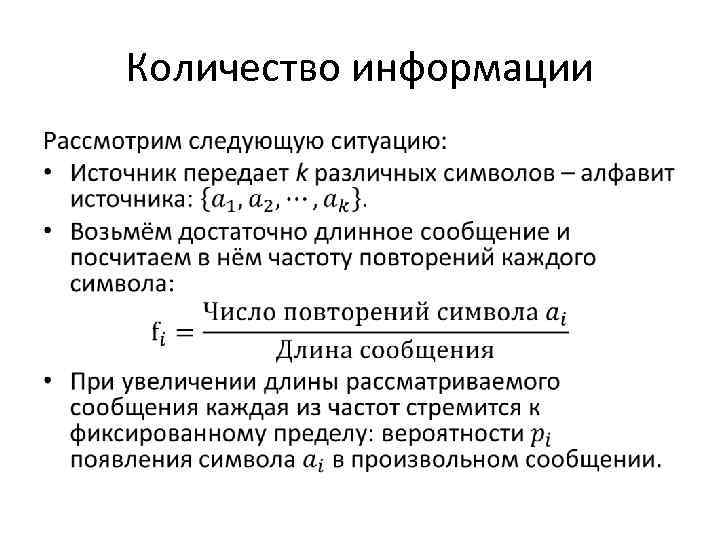

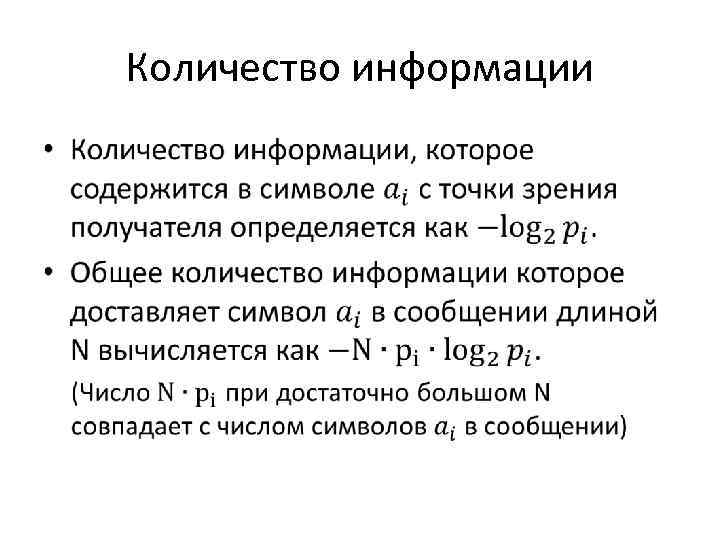

Количество информации •

Количество информации •

Количество информации •

Количество информации •

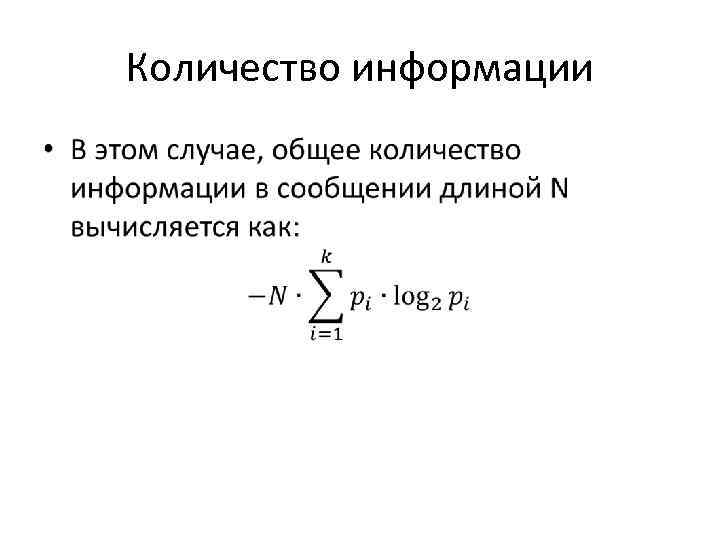

Количество информации •

Количество информации •

Количество информации •

Количество информации •

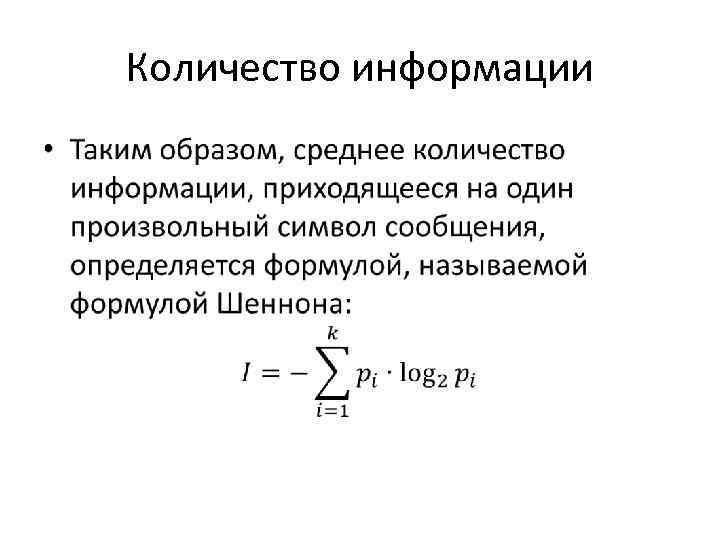

Количество информации • Формула Шеннона позволяет определить степень информативности источника, т. е. меру уменьшения неопределённости знаний приёмника при получении очередного символа сообщения.

Количество информации • Формула Шеннона позволяет определить степень информативности источника, т. е. меру уменьшения неопределённости знаний приёмника при получении очередного символа сообщения.

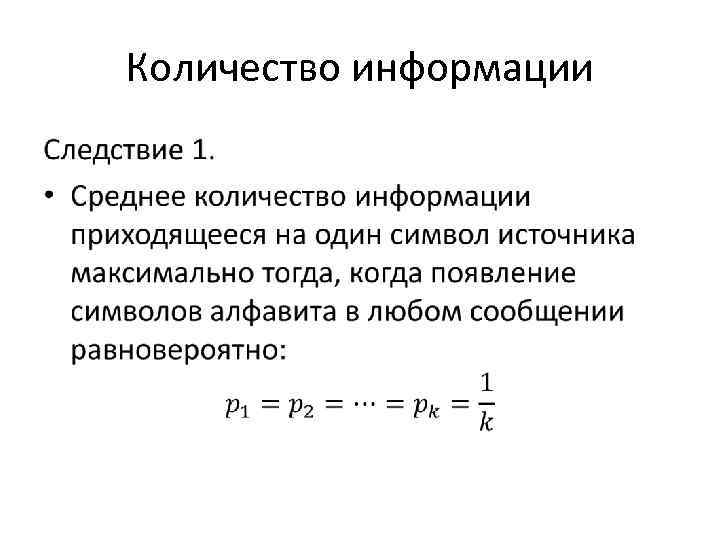

Количество информации •

Количество информации •

Количество информации Следствие 2. • Информативность сообщений, поступающих от источника, алфавит которого состоит только из одного символа, равна нулю. • С точки зрения получателя такой источник является абсолютно бесполезным.

Количество информации Следствие 2. • Информативность сообщений, поступающих от источника, алфавит которого состоит только из одного символа, равна нулю. • С точки зрения получателя такой источник является абсолютно бесполезным.

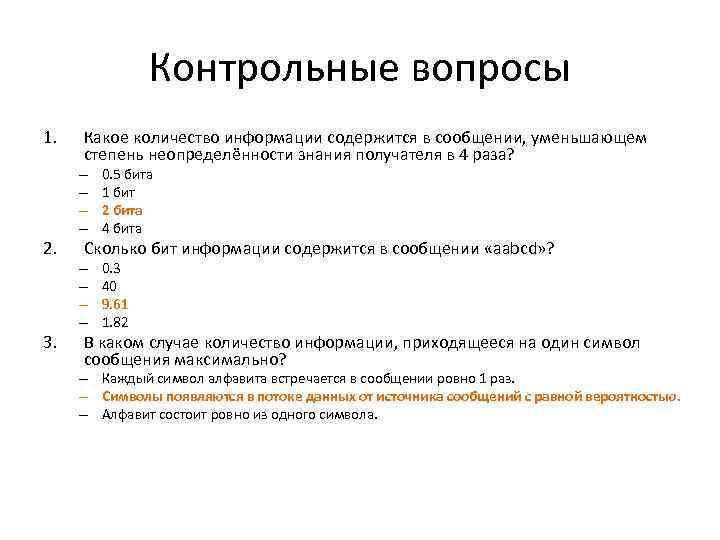

Контрольные вопросы 1. Какое количество информации содержится в сообщении, уменьшающем степень неопределённости знания получателя в 4 раза? – – 2. 3. 0. 5 бита 1 бит 2 бита 4 бита Сколько бит информации содержится в сообщении «aabcd» ? – – 0. 3 40 9. 61 1. 82 В каком случае количество информации, приходящееся на один символ сообщения максимально? – Каждый символ алфавита встречается в сообщении ровно 1 раз. – Символы появляются в потоке данных от источника сообщений с равной вероятностью. – Алфавит состоит ровно из одного символа.

Контрольные вопросы 1. Какое количество информации содержится в сообщении, уменьшающем степень неопределённости знания получателя в 4 раза? – – 2. 3. 0. 5 бита 1 бит 2 бита 4 бита Сколько бит информации содержится в сообщении «aabcd» ? – – 0. 3 40 9. 61 1. 82 В каком случае количество информации, приходящееся на один символ сообщения максимально? – Каждый символ алфавита встречается в сообщении ровно 1 раз. – Символы появляются в потоке данных от источника сообщений с равной вероятностью. – Алфавит состоит ровно из одного символа.