СЕА1-Измер_инф_для метод_семинара.ppt

- Количество слайдов: 7

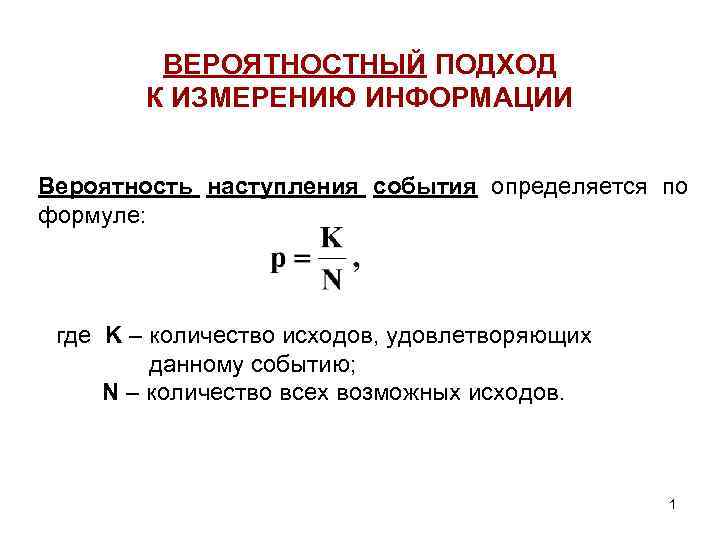

ВЕРОЯТНОСТНЫЙ ПОДХОД К ИЗМЕРЕНИЮ ИНФОРМАЦИИ Вероятность наступления события определяется по формуле: где K – количество исходов, удовлетворяющих данному событию; N – количество всех возможных исходов. 1

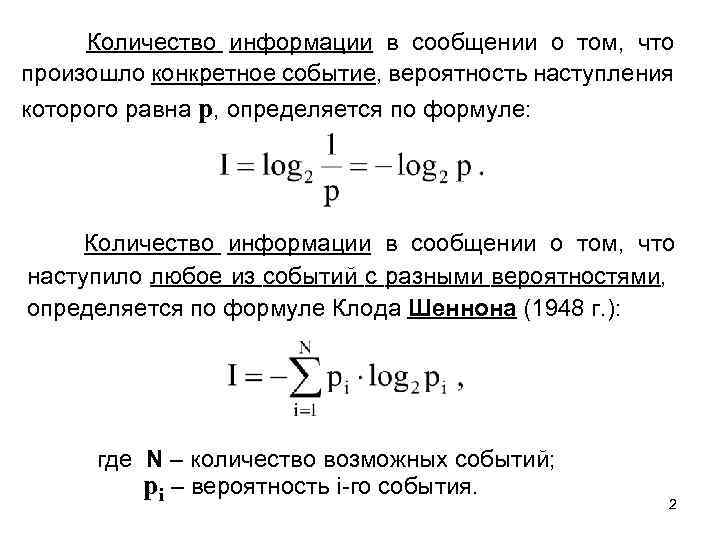

Количество информации в сообщении о том, что произошло конкретное событие, вероятность наступления которого равна p, определяется по формуле: Количество информации в сообщении о том, что наступило любое из событий с разными вероятностями, определяется по формуле Клода Шеннона (1948 г. ): где N – количество возможных событий; pi – вероятность i-го события. 2

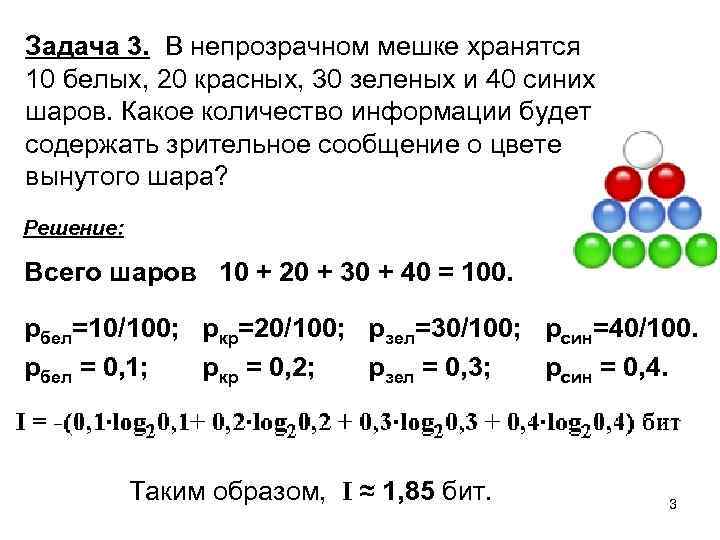

Задача 3. В непрозрачном мешке хранятся 10 белых, 20 красных, 30 зеленых и 40 синих шаров. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шара? Решение: Всего шаров 10 + 20 + 30 + 40 = 100. pбел=10/100; pкр=20/100; pзел=30/100; pсин=40/100. pбел = 0, 1; pкр = 0, 2; pзел = 0, 3; pсин = 0, 4. Таким образом, I ≈ 1, 85 бит. 3

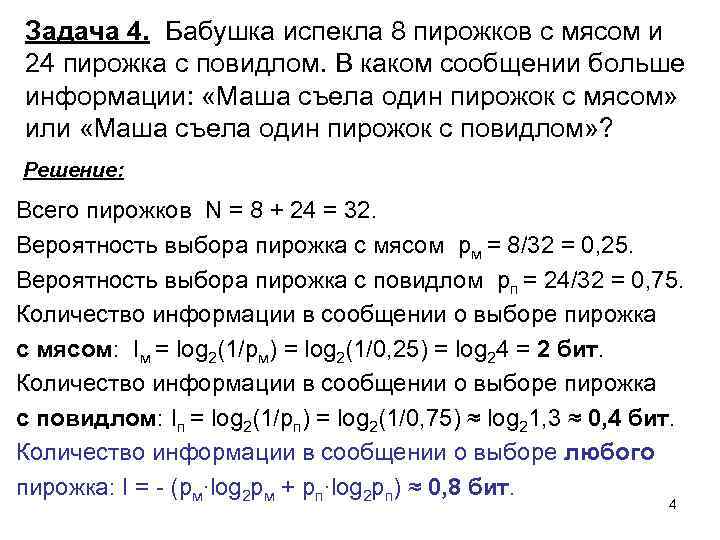

Задача 4. Бабушка испекла 8 пирожков с мясом и 24 пирожка с повидлом. В каком сообщении больше информации: «Маша съела один пирожок с мясом» или «Маша съела один пирожок с повидлом» ? Решение: Всего пирожков N = 8 + 24 = 32. Вероятность выбора пирожка с мясом pм = 8/32 = 0, 25. Вероятность выбора пирожка с повидлом pп = 24/32 = 0, 75. Количество информации в сообщении о выборе пирожка с мясом: Iм = log 2(1/pм) = log 2(1/0, 25) = log 24 = 2 бит. Количество информации в сообщении о выборе пирожка с повидлом: Iп = log 2(1/pп) = log 2(1/0, 75) ≈ log 21, 3 ≈ 0, 4 бит. Количество информации в сообщении о выборе любого пирожка: I = - (рм∙log 2 pм + рп∙log 2 pп) ≈ 0, 8 бит. 4

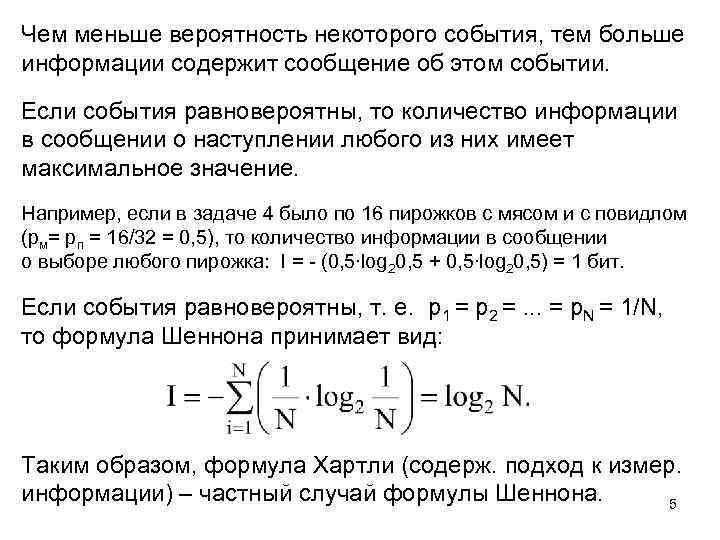

Чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии. Если события равновероятны, то количество информации в сообщении о наступлении любого из них имеет максимальное значение. Например, если в задаче 4 было по 16 пирожков с мясом и с повидлом (pм= pп = 16/32 = 0, 5), то количество информации в сообщении о выборе любого пирожка: I = - (0, 5∙log 20, 5 + 0, 5∙log 20, 5) = 1 бит. Если события равновероятны, т. е. p 1 = p 2 =. . . = p. N = 1/N, то формула Шеннона принимает вид: Таким образом, формула Хартли (содерж. подход к измер. информации) – частный случай формулы Шеннона. 5

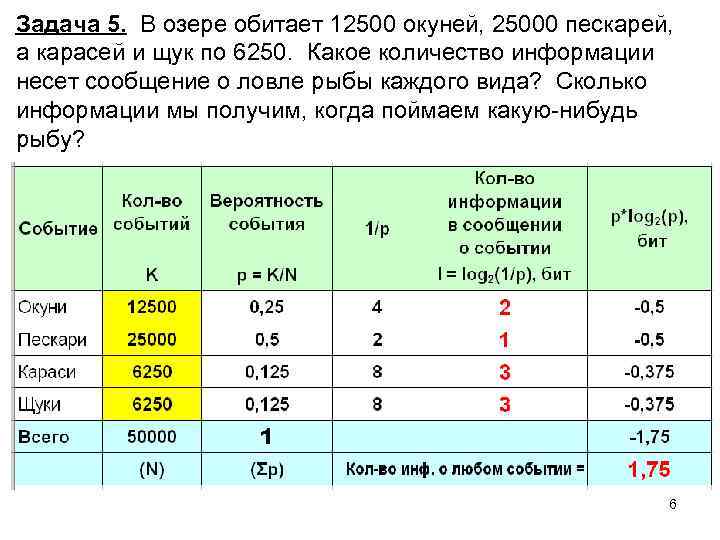

Задача 5. В озере обитает 12500 окуней, 25000 пескарей, а карасей и щук по 6250. Какое количество информации несет сообщение о ловле рыбы каждого вида? Сколько информации мы получим, когда поймаем какую-нибудь рыбу? 6

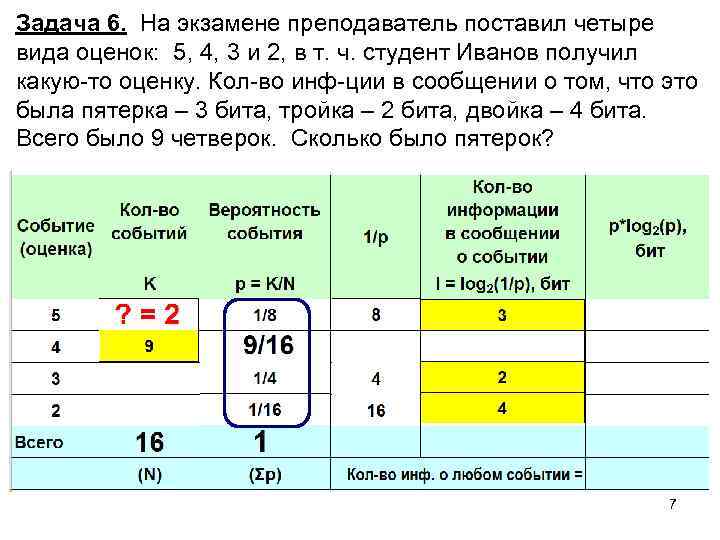

Задача 6. На экзамене преподаватель поставил четыре вида оценок: 5, 4, 3 и 2, в т. ч. студент Иванов получил какую-то оценку. Кол-во инф-ции в сообщении о том, что это была пятерка – 3 бита, тройка – 2 бита, двойка – 4 бита. Всего было 9 четверок. Сколько было пятерок? 7

СЕА1-Измер_инф_для метод_семинара.ppt