Нейронные сети.pptx

- Количество слайдов: 18

Титивец Валентина, Старовойтова Елена

Титивец Валентина, Старовойтова Елена

Начало (1943 -1950 гг. ) В этой время были опубликованы две основополагающие работы. В 1943 году вышла статья У. Маккалока и У. Питтса, в которой были представлены первые математические модели нейронных сетейгде предлагалась схема компьютера, основанного на аналогии с работой человеческого мозга. Они создали упрощенную модель нервной клетки – нейрон. В 1949 Д. О. Хебб в своей книге “Организация поведения” описал первый алгоритм обучения нейронной сети. Золотая эра (1951 -1969 гг. ) Изобретенный Ф. Розенблаттом в 1957 г. перцептрон приобрел широкую популярность. Модель использовали (вполне успешно) в первых алгоритмах распознавания образов и прогнозирования погоды. Казалось, что изобретение перцептрона приближает к созданию первого искусственного интеллекта. Однако, несмотря на популярность концепции нейронных сетей, исследования не получили развития. Отсутствие конференций или других организованных встреч исследователей привело к тому, что было создано несколько независимых парадигм нейронных сетей, многие из которых оказались востребованными в будущем. В 1969 вышла работа М. Минского с критикой перцептрона: Минский показал, какие задачи перцептрон решать не способен и что, при определенных условиях, перцептрон крайне неэффективен. После публикации этой работы интерес научного сообщества к нейронным сетям резко спал.

Начало (1943 -1950 гг. ) В этой время были опубликованы две основополагающие работы. В 1943 году вышла статья У. Маккалока и У. Питтса, в которой были представлены первые математические модели нейронных сетейгде предлагалась схема компьютера, основанного на аналогии с работой человеческого мозга. Они создали упрощенную модель нервной клетки – нейрон. В 1949 Д. О. Хебб в своей книге “Организация поведения” описал первый алгоритм обучения нейронной сети. Золотая эра (1951 -1969 гг. ) Изобретенный Ф. Розенблаттом в 1957 г. перцептрон приобрел широкую популярность. Модель использовали (вполне успешно) в первых алгоритмах распознавания образов и прогнозирования погоды. Казалось, что изобретение перцептрона приближает к созданию первого искусственного интеллекта. Однако, несмотря на популярность концепции нейронных сетей, исследования не получили развития. Отсутствие конференций или других организованных встреч исследователей привело к тому, что было создано несколько независимых парадигм нейронных сетей, многие из которых оказались востребованными в будущем. В 1969 вышла работа М. Минского с критикой перцептрона: Минский показал, какие задачи перцептрон решать не способен и что, при определенных условиях, перцептрон крайне неэффективен. После публикации этой работы интерес научного сообщества к нейронным сетям резко спал.

Период забвения (1972 -1983 гг. ) В это время были опубликованы работы Т. Кохонена, в которых была предложена новая парадигма нейронных сетей – самоорганизующиеся карты Кохонена. В 1974 г. П. Вербос изобрел алгоритм обратного распространения ошибки, ставший в дальнейшем одним из основных методов обучения нейронных сетей (фактически, этот метод реализует принцип обратной связи). Возрождение (1985 - ) Благодаря работам Дж. Хопфилда, предложившего свою схему нейронной сети и методы ее использования для решения некоторых задач (в т. ч. задачи о коммивояжере), возвращается интерес к нейронным сетям. В это время получает существенное развитие алгоритм обратного распространения ошибки. С использованием этого алгоритма критика М. Минского полностью опровергается. В настоящее время нейронные сети – популярный инструмент машинного обучения и объект множества исследований.

Период забвения (1972 -1983 гг. ) В это время были опубликованы работы Т. Кохонена, в которых была предложена новая парадигма нейронных сетей – самоорганизующиеся карты Кохонена. В 1974 г. П. Вербос изобрел алгоритм обратного распространения ошибки, ставший в дальнейшем одним из основных методов обучения нейронных сетей (фактически, этот метод реализует принцип обратной связи). Возрождение (1985 - ) Благодаря работам Дж. Хопфилда, предложившего свою схему нейронной сети и методы ее использования для решения некоторых задач (в т. ч. задачи о коммивояжере), возвращается интерес к нейронным сетям. В это время получает существенное развитие алгоритм обратного распространения ошибки. С использованием этого алгоритма критика М. Минского полностью опровергается. В настоящее время нейронные сети – популярный инструмент машинного обучения и объект множества исследований.

Элементом клеточной структуры мозга является нервная клетка - нейрон. Нейрон в своем строении имеет много общих черт с другими клетками биоткани: тело нейрона окружено плазматической мембраной, внутри которой находится цитоплазма, ядро и другие составляющие клетки. Однако нервная клетка существенно отличается от иных по своему функциональному назначению. Нейрон выполняет прием, элементарное преобразование и дальнейшую передачу информации другим нейронам. Информация переносится в виде импульсов нервной активности, имеющих электрохимическую природу. Нейроны крайне разнообразны по форме, которая зависит от их местонахождения в нервной системе и особенностей фунционирования. Тело клетки содержит множество ветвящихся отростков двух типов. Отростки первого типа, называемые дендритами за их сходство с кроной раскидистого дерева, служат в качестве входных каналов для нервных импульсов от других нейронов. Эти импульсы поступают в сому или тело клетки размером от 3 до 100 микрон, вызывая ее специфическое возбуждение, которое затем распространяется по выводному отростку второго типа - аксону. Длина аксонов обычно заметно превосходит размеры дентритов, в отдельных случаях достигая десятков сантиметров и даже метров. Гигантский аксон кальмара имеет толщину около миллиметра, и именно наблюдение за ним послужило выяснению механизма передачи нервных импульсов между нейронами. Взаимодействующие между собой посредством передачи через отростки возбуждений нейроны формируют нейронные сети. Общее число нейронов в центральной нервной системе человека достигает 1010 - 1011, при этом каждая нервная клетка связана в среднем с 103 - 104 других нейронов. Установлено, что в головном мозге совокупность нейронов в объеме масштаба 1 мм 3 формирует относительно независимую локальную сеть, несущую определенную функциональную нагрузку.

Элементом клеточной структуры мозга является нервная клетка - нейрон. Нейрон в своем строении имеет много общих черт с другими клетками биоткани: тело нейрона окружено плазматической мембраной, внутри которой находится цитоплазма, ядро и другие составляющие клетки. Однако нервная клетка существенно отличается от иных по своему функциональному назначению. Нейрон выполняет прием, элементарное преобразование и дальнейшую передачу информации другим нейронам. Информация переносится в виде импульсов нервной активности, имеющих электрохимическую природу. Нейроны крайне разнообразны по форме, которая зависит от их местонахождения в нервной системе и особенностей фунционирования. Тело клетки содержит множество ветвящихся отростков двух типов. Отростки первого типа, называемые дендритами за их сходство с кроной раскидистого дерева, служат в качестве входных каналов для нервных импульсов от других нейронов. Эти импульсы поступают в сому или тело клетки размером от 3 до 100 микрон, вызывая ее специфическое возбуждение, которое затем распространяется по выводному отростку второго типа - аксону. Длина аксонов обычно заметно превосходит размеры дентритов, в отдельных случаях достигая десятков сантиметров и даже метров. Гигантский аксон кальмара имеет толщину около миллиметра, и именно наблюдение за ним послужило выяснению механизма передачи нервных импульсов между нейронами. Взаимодействующие между собой посредством передачи через отростки возбуждений нейроны формируют нейронные сети. Общее число нейронов в центральной нервной системе человека достигает 1010 - 1011, при этом каждая нервная клетка связана в среднем с 103 - 104 других нейронов. Установлено, что в головном мозге совокупность нейронов в объеме масштаба 1 мм 3 формирует относительно независимую локальную сеть, несущую определенную функциональную нагрузку.

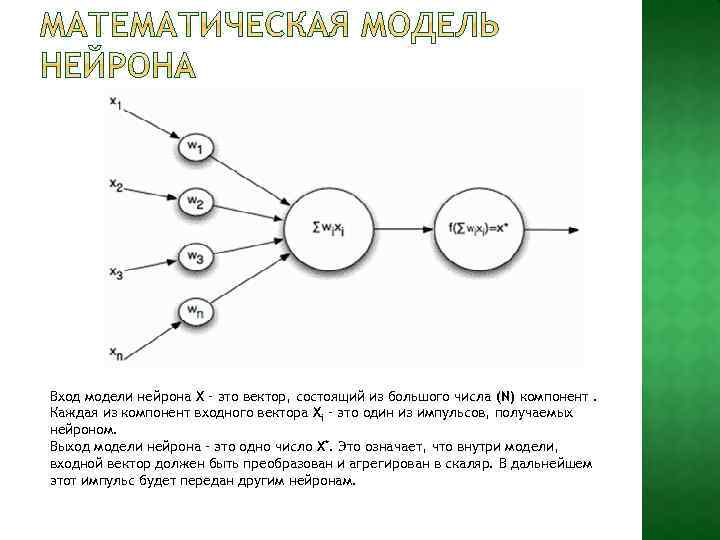

Вход модели нейрона X – это вектор, состоящий из большого числа (N) компонент. Каждая из компонент входного вектора Xi – это один из импульсов, получаемых нейроном. Выход модели нейрона – это одно число X*. Это означает, что внутри модели, входной вектор должен быть преобразован и агрегирован в скаляр. В дальнейшем этот импульс будет передан другим нейронам.

Вход модели нейрона X – это вектор, состоящий из большого числа (N) компонент. Каждая из компонент входного вектора Xi – это один из импульсов, получаемых нейроном. Выход модели нейрона – это одно число X*. Это означает, что внутри модели, входной вектор должен быть преобразован и агрегирован в скаляр. В дальнейшем этот импульс будет передан другим нейронам.

Известно, что при получении импульса синапс нейрона изменяет его. Математически этот процесс изменения можно описать следующим образом: для каждой из компонент входа Xi задают вес. Импульс, прошедший через синапс, принимает вид Wi. Xi. Заметим, что веса могут быть назначены при инициализации модели, а могут быть переменными и измеряться в ходе расчетов. Веса – это внутренние параметры сети, о которых шла речь выше. Говоря об обучении сети, имеют в виду нахождение весов синапса. Сложение полученных импульсов. Агрегирование полученных импульсов – это вычисление их суммы ∑Wi. Xi. Будет активирован нейрон или нет, определяется вычислением так называемой передаточной, или активационной, функции нейрона f(∑Wi. Xi). Если значение функции превышает некоторый заранее определенный порог, то нейрон активирован и передает импульс следующим нейронам в сети

Известно, что при получении импульса синапс нейрона изменяет его. Математически этот процесс изменения можно описать следующим образом: для каждой из компонент входа Xi задают вес. Импульс, прошедший через синапс, принимает вид Wi. Xi. Заметим, что веса могут быть назначены при инициализации модели, а могут быть переменными и измеряться в ходе расчетов. Веса – это внутренние параметры сети, о которых шла речь выше. Говоря об обучении сети, имеют в виду нахождение весов синапса. Сложение полученных импульсов. Агрегирование полученных импульсов – это вычисление их суммы ∑Wi. Xi. Будет активирован нейрон или нет, определяется вычислением так называемой передаточной, или активационной, функции нейрона f(∑Wi. Xi). Если значение функции превышает некоторый заранее определенный порог, то нейрон активирован и передает импульс следующим нейронам в сети

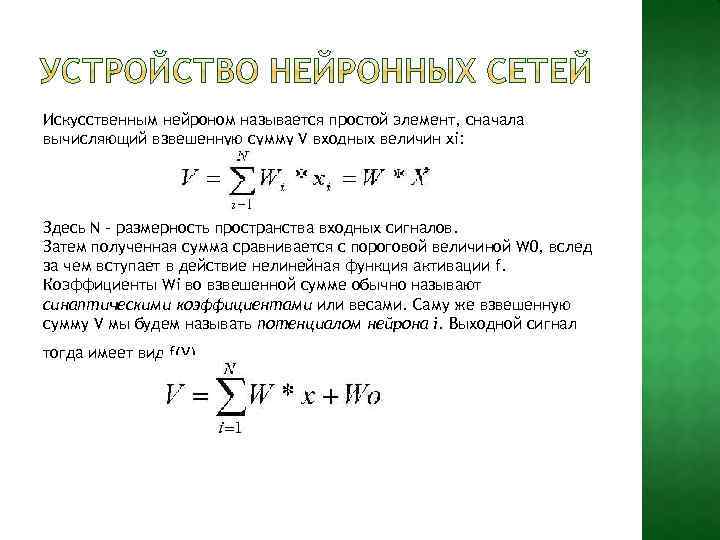

Искусственным нейроном называется простой элемент, сначала вычисляющий взвешенную сумму V входных величин xi: Здесь N – размерность пространства входных сигналов. Затем полученная сумма сравнивается с пороговой величиной W 0, вслед за чем вступает в действие нелинейная функция активации f. Коэффициенты Wi во взвешенной сумме обычно называют синаптическими коэффициентами или весами. Саму же взвешенную сумму V мы будем называть потенциалом нейрона i. Выходной сигнал тогда имеет вид f(V).

Искусственным нейроном называется простой элемент, сначала вычисляющий взвешенную сумму V входных величин xi: Здесь N – размерность пространства входных сигналов. Затем полученная сумма сравнивается с пороговой величиной W 0, вслед за чем вступает в действие нелинейная функция активации f. Коэффициенты Wi во взвешенной сумме обычно называют синаптическими коэффициентами или весами. Саму же взвешенную сумму V мы будем называть потенциалом нейрона i. Выходной сигнал тогда имеет вид f(V).

1. Нейронные сети, использующие обучение с учителем. Обучение с учителем предполагает, что для каждого входного вектора существует целевой вектор, представляющий собой требуемый выход. Вместе они называются обучающей парой. Обычно сеть обучается на некотором числе таких обучающих пар. Предъявляется выходной вектор, вычисляется выход сети и сравнивается с соответствующим целевым вектором. Далее веса изменяются в соответствии с алгоритмом, стремящимся минимизировать ошибку. Векторы обучающего множества предъявляются последовательно, вычисляются ошибки и веса подстраиваются для каждого вектора до тех пор, пока ошибка по всему обучающему массиву не достигнет приемлемого уровня. 2. Нейронные сети, использующие обучение без учителя. Обучение без учителя является намного более правдоподобной моделью обучения с точки зрения биологических корней искусственных нейронных сетей. Развитая Кохоненом и многими другими, она не нуждается в целевом векторе для выходов и, следовательно, не требует сравнения с предопределенными идеальными ответами. Обучающее множество состоит лишь из входных векторов. Обучающий алгоритм подстраивает веса сети так, чтобы получались согласованные выходные векторы, т. е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы. Процесс обучения, следовательно, выделяет статистические свойства обучающего множества и группирует сходные векторы в классы.

1. Нейронные сети, использующие обучение с учителем. Обучение с учителем предполагает, что для каждого входного вектора существует целевой вектор, представляющий собой требуемый выход. Вместе они называются обучающей парой. Обычно сеть обучается на некотором числе таких обучающих пар. Предъявляется выходной вектор, вычисляется выход сети и сравнивается с соответствующим целевым вектором. Далее веса изменяются в соответствии с алгоритмом, стремящимся минимизировать ошибку. Векторы обучающего множества предъявляются последовательно, вычисляются ошибки и веса подстраиваются для каждого вектора до тех пор, пока ошибка по всему обучающему массиву не достигнет приемлемого уровня. 2. Нейронные сети, использующие обучение без учителя. Обучение без учителя является намного более правдоподобной моделью обучения с точки зрения биологических корней искусственных нейронных сетей. Развитая Кохоненом и многими другими, она не нуждается в целевом векторе для выходов и, следовательно, не требует сравнения с предопределенными идеальными ответами. Обучающее множество состоит лишь из входных векторов. Обучающий алгоритм подстраивает веса сети так, чтобы получались согласованные выходные векторы, т. е. чтобы предъявление достаточно близких входных векторов давало одинаковые выходы. Процесс обучения, следовательно, выделяет статистические свойства обучающего множества и группирует сходные векторы в классы.

1. Сети прямого распространения – все связи направлены строго от входных нейронов к выходным. К таким сетям относятся, например: простейший персептрон (разработанный Розенблаттом) и многослойный персептрон. 2. Реккурентные нейронные сети – сигнал с выходных нейронов или нейронов скрытого слоя частично передается обратно на входы нейронов входного слоя. 3. Радиально базисные функции – вид нейронной сети, имеющий скрытый слой из радиальных элементов и выходной слой из линейных элементов. Сети этого типа довольно компактны и быстро обучаются. Предложены в работах Broomhead and Lowe (1988) и Moody and Darkin (1989). 4. Самоорганизующиеся карты или Сети Кохонена – такой класс сетей, как правило, обучается без учителя и успешно применяется в задачах распознавания. Сети такого класса способны выявлять новизну во входных данных: если после обучения сеть встретится с набором данных, непохожим ни на один из известных образцов, то она не сможет классифицировать такой набор и тем самым выявит его новизну. Сеть Кохонена имеет всего два слоя: входной и выходной, составленный из радиальных элементов

1. Сети прямого распространения – все связи направлены строго от входных нейронов к выходным. К таким сетям относятся, например: простейший персептрон (разработанный Розенблаттом) и многослойный персептрон. 2. Реккурентные нейронные сети – сигнал с выходных нейронов или нейронов скрытого слоя частично передается обратно на входы нейронов входного слоя. 3. Радиально базисные функции – вид нейронной сети, имеющий скрытый слой из радиальных элементов и выходной слой из линейных элементов. Сети этого типа довольно компактны и быстро обучаются. Предложены в работах Broomhead and Lowe (1988) и Moody and Darkin (1989). 4. Самоорганизующиеся карты или Сети Кохонена – такой класс сетей, как правило, обучается без учителя и успешно применяется в задачах распознавания. Сети такого класса способны выявлять новизну во входных данных: если после обучения сеть встретится с набором данных, непохожим ни на один из известных образцов, то она не сможет классифицировать такой набор и тем самым выявит его новизну. Сеть Кохонена имеет всего два слоя: входной и выходной, составленный из радиальных элементов

Главное отличие и преимущество нейросетей перед классическими средствами прогнозирования и классификации заключается в их способности к обучению. Так что же такое обучение нейросетей? На этапе обучения происходит вычисление синаптических коэффициентов в процессе решения нейронной сетью задач, в которых нужный ответ определяется не по правилам, а с помощью примеров, сгруппированных в обучающие множества. Так что нейросеть на этапе обучения сама выполняет роль эксперта в процессе подготовки данных для построения экспертной системы. Предполагается, что правила находятся в структуре обучающих данных. Для обучения нейронной сети требуются обучающие данные. Они должны отвечать свойствам представительности и случайности или последовательности. Все зависит от класса решаемой задачи. Такие данные представляют собой ряды примеров с указанием для каждого из них значением выходного параметра, которое было бы желательно получить. Действия, которые при этом происходят, можно назвать контролируемым обучением: "учитель" подаем на вход сети вектор исходных данных, а на выходной узел сообщает желаемое значение результата вычислений. Контролируемое обучение нейросети можно рассматривать как решение оптимизационной задачи. Ее целью является минимизация функции ошибок Е на данном множестве примеров путем выбора значений весов W. Достижение минимума называется сходимостью процесса обучения. Именно возможность этого и доказал Розенблатт.

Главное отличие и преимущество нейросетей перед классическими средствами прогнозирования и классификации заключается в их способности к обучению. Так что же такое обучение нейросетей? На этапе обучения происходит вычисление синаптических коэффициентов в процессе решения нейронной сетью задач, в которых нужный ответ определяется не по правилам, а с помощью примеров, сгруппированных в обучающие множества. Так что нейросеть на этапе обучения сама выполняет роль эксперта в процессе подготовки данных для построения экспертной системы. Предполагается, что правила находятся в структуре обучающих данных. Для обучения нейронной сети требуются обучающие данные. Они должны отвечать свойствам представительности и случайности или последовательности. Все зависит от класса решаемой задачи. Такие данные представляют собой ряды примеров с указанием для каждого из них значением выходного параметра, которое было бы желательно получить. Действия, которые при этом происходят, можно назвать контролируемым обучением: "учитель" подаем на вход сети вектор исходных данных, а на выходной узел сообщает желаемое значение результата вычислений. Контролируемое обучение нейросети можно рассматривать как решение оптимизационной задачи. Ее целью является минимизация функции ошибок Е на данном множестве примеров путем выбора значений весов W. Достижение минимума называется сходимостью процесса обучения. Именно возможность этого и доказал Розенблатт.

По сравнению с линейными методами статистики (линейная регрессия, авторегрессия, линейный дискриминант) нейросети позволяют эффективно строить нелинейные зависимости, более точно описывающие наборы данных. Для сжатия и визуализации данных в статистике разработан метод линейных главных компонент. Нейросети- автоассоциаторы позволяют эффективнее сжимать данные за счет построения нелинейных отображений и визуализировать данные в пространстве меньшего числа нелинейных главных компонент. По сравнению с методами непараметрической статистики нейронная сеть с радиальными базисными функциями позволяет сокращать число ядер, оптимизировать координаты и размытость каждого ядра. Это позволяет при сохранении парадигмы локальной ядерной аппроксимации ускорять дальнейший процесс принятия решения. При обучении нейронной сети вместо критерия качества в виде наименьших квадратов можно использовать робастные критерии, дополнительно вести оптимизацию и других свойств нейронной сети (например, добавляя критерии регуляризации решения или оптимизации структуры нейронной сети). Алгоритмы обучения нейронной сети при этом остаются неизменными. Необходимость решения прямой и обратной задач обычно требует построения двух моделей. При использовании же нейронных сетей можно обойтись одной сетью, обученной решать прямую задачу

По сравнению с линейными методами статистики (линейная регрессия, авторегрессия, линейный дискриминант) нейросети позволяют эффективно строить нелинейные зависимости, более точно описывающие наборы данных. Для сжатия и визуализации данных в статистике разработан метод линейных главных компонент. Нейросети- автоассоциаторы позволяют эффективнее сжимать данные за счет построения нелинейных отображений и визуализировать данные в пространстве меньшего числа нелинейных главных компонент. По сравнению с методами непараметрической статистики нейронная сеть с радиальными базисными функциями позволяет сокращать число ядер, оптимизировать координаты и размытость каждого ядра. Это позволяет при сохранении парадигмы локальной ядерной аппроксимации ускорять дальнейший процесс принятия решения. При обучении нейронной сети вместо критерия качества в виде наименьших квадратов можно использовать робастные критерии, дополнительно вести оптимизацию и других свойств нейронной сети (например, добавляя критерии регуляризации решения или оптимизации структуры нейронной сети). Алгоритмы обучения нейронной сети при этом остаются неизменными. Необходимость решения прямой и обратной задач обычно требует построения двух моделей. При использовании же нейронных сетей можно обойтись одной сетью, обученной решать прямую задачу

1. Высокая точность прогноза. 2. Адаптация к решаемой задаче. 3. Стандартные решения нестандартных задач. 4. Вместо программирования - обучение. 5. Извлечение знаний из данных (реализация логики открытия). 6. Возможность быстрой корректировки прогноза при получении новых данных. 7. Высокая эффективность программного обеспечения на параллельных ЭВМ.

1. Высокая точность прогноза. 2. Адаптация к решаемой задаче. 3. Стандартные решения нестандартных задач. 4. Вместо программирования - обучение. 5. Извлечение знаний из данных (реализация логики открытия). 6. Возможность быстрой корректировки прогноза при получении новых данных. 7. Высокая эффективность программного обеспечения на параллельных ЭВМ.

1. Отсутствие объяснительной компоненты. 2. Большое время обучения. 3. Трудность формирования топологии сети. 4. Использование коннекционистского подхода к формализации нейронной сети. 5. Необходимость достаточной представительности обучающей выборки. 6. Эвристичность параметров алгоритмов обучения различных типов нейронных сетей.

1. Отсутствие объяснительной компоненты. 2. Большое время обучения. 3. Трудность формирования топологии сети. 4. Использование коннекционистского подхода к формализации нейронной сети. 5. Необходимость достаточной представительности обучающей выборки. 6. Эвристичность параметров алгоритмов обучения различных типов нейронных сетей.

Экономика и бизнес: прогнозирование временных рядов (курсов валют, цен на сырьё, объемов продаж, . . ), автоматический трейдинг, оценка рисков невозврата кредитов, предсказание банкротств, оценка стоимости недвижимости, выявление переоцененных и недооцененных компаний, рейтингование, оптимизация товарных и денежных потоков, считывание и распознавание чеков и документов, безопасность транзакций по пластиковым картам. Медицина: постановка диагноза, обработка медицинских изображений, мониторинг состояния пациента, анализ эффективности лечения, очистка показаний приборов от шумов. Авионика: обучаемые автопилоты, распознавание сигналов радаров, адаптивное пилотирование сильно поврежденного самолета, беспилотные летательные аппараты. Связь: сжатие видеоинформации, быстрое кодированиедекодирование, оптимизация сотовых сетей и схем маршрутизации пакетов. Интернет: ассоциативный поиск информации, электронные секретари и автономные агенты в интернете, фильтрация информации, блокировка спама, автоматическая рубрикация новостевых лент, адресные реклама и маркетинг для электронной торговли.

Экономика и бизнес: прогнозирование временных рядов (курсов валют, цен на сырьё, объемов продаж, . . ), автоматический трейдинг, оценка рисков невозврата кредитов, предсказание банкротств, оценка стоимости недвижимости, выявление переоцененных и недооцененных компаний, рейтингование, оптимизация товарных и денежных потоков, считывание и распознавание чеков и документов, безопасность транзакций по пластиковым картам. Медицина: постановка диагноза, обработка медицинских изображений, мониторинг состояния пациента, анализ эффективности лечения, очистка показаний приборов от шумов. Авионика: обучаемые автопилоты, распознавание сигналов радаров, адаптивное пилотирование сильно поврежденного самолета, беспилотные летательные аппараты. Связь: сжатие видеоинформации, быстрое кодированиедекодирование, оптимизация сотовых сетей и схем маршрутизации пакетов. Интернет: ассоциативный поиск информации, электронные секретари и автономные агенты в интернете, фильтрация информации, блокировка спама, автоматическая рубрикация новостевых лент, адресные реклама и маркетинг для электронной торговли.

Автоматизация производства: оптимизация режимов производственного процесса, контроль качества продукции, мониторинг и визуализация многомерной диспетчерской информации, предупреждение аварийных ситуаций, робототехника. Политологические и социологические технологии: предсказание результатов выборов, анализ опросов, предсказание динамики рейтингов, выявление значимых факторов, кластеризация электората, исследование и визуализация социальной динамики населения. Безопасность и охранные системы: распознавание лиц; идентификация личности по отпечаткам пальцев, голосу, подписи, лицу; распознавание автомобильных номеров, анализ аэрокосмических снимков, мониторинг информационных потоков в компьютерной сети и обнаружение вторжений, обнаружение подделок. Ввод и обработка информации: распознавание рукописных текстов, отсканированных почтовых, платежных, финансовых и бухгалтерских документов. Геологоразведка: анализ сейсмических данных, ассоциативные методики поиска полезных ископаемых, оценка ресурсов месторождений.

Автоматизация производства: оптимизация режимов производственного процесса, контроль качества продукции, мониторинг и визуализация многомерной диспетчерской информации, предупреждение аварийных ситуаций, робототехника. Политологические и социологические технологии: предсказание результатов выборов, анализ опросов, предсказание динамики рейтингов, выявление значимых факторов, кластеризация электората, исследование и визуализация социальной динамики населения. Безопасность и охранные системы: распознавание лиц; идентификация личности по отпечаткам пальцев, голосу, подписи, лицу; распознавание автомобильных номеров, анализ аэрокосмических снимков, мониторинг информационных потоков в компьютерной сети и обнаружение вторжений, обнаружение подделок. Ввод и обработка информации: распознавание рукописных текстов, отсканированных почтовых, платежных, финансовых и бухгалтерских документов. Геологоразведка: анализ сейсмических данных, ассоциативные методики поиска полезных ископаемых, оценка ресурсов месторождений.