Теория оптимального управления5.ppt

- Количество слайдов: 53

Теория оптимального управления Доцент кафедры Корабельных систем управления, к. т. н. Зуев Владимир Александрович

Понятие оптимальности Оптимальных систем "ВООБЩЕ" не существует. Под оптимальной системой понимается система, наилучшая с точки зрения какого-либо критерия при определенных условиях. Система может быть оптимальной по быстродействию, но не самой лучшей по потреблению энергии и наоборот. Неправильная постановка целей оптимизации (неправильный выбор критерия) может привести к получению абсурдных, бесполезных результатов.

Основные задачи построения оптимальных систем Поиск оптимума функции Выбор предпочтительного варианта системы Поиск оптимума функционала (синтез системы управления)

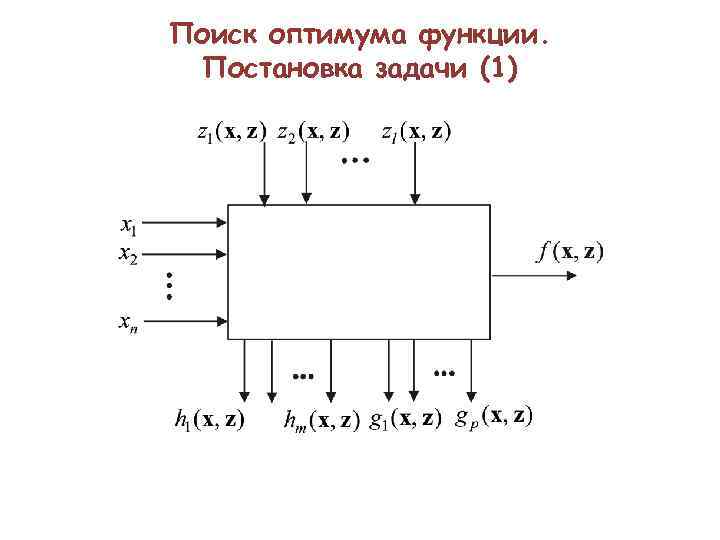

Поиск оптимума функции. Постановка задачи (1)

Поиск оптимума функции. Постановка задачи (2) В первую группу входят воздействия , которые могут произвольно изменяться в процессе эксперимента. Такие входные воздействия назовем управляемыми переменными или параметрами. Управляемые переменные независимы друг от друга и в процессе оптимизации могут изменяться в заданных пределах. Вторую группу составляют переменные , которые в процессе эксперимента не контролируются или изменяются случайным образом.

Поиск оптимума функции. Постановка задачи (3) Целевая функция Показатели качества функционирования объекта

Поиск оптимума функции. Постановка задачи. Итог , В самом общем смысле задача математического программирования заключается в отыскании экстремума целевой функции при заданных ограничениях в виде равенств и (или) неравенств, наложенных на остальные показатели качества. Формально задача математического программирования может быть сформулирована следующим образом: Минимизировать при m ограничениях в виде равенств и при (p-m) ограничениях в виде неравенств ,

Основные определения (1) Точка доставляет глобальный минимум функции на множестве Точка и для всех является точкой строгого глобального минимума функции на множестве Точка , если и для всех доставляет локальный минимум функции на множестве , если при некотором достаточно малом выполняется неравенство для всех

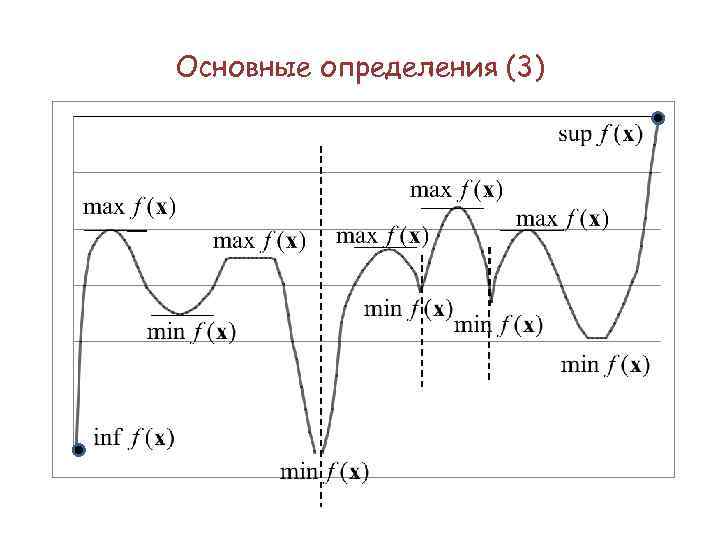

Основные определения (2) В большинстве случаев экстремум целевой функции лежит не внутри допустимой области, а на ее границе. Поэтому при решении практических задач, как правило, возникает задача определения условных, а не безусловных экстремумов. infinimum (наинизшее) supremum (наивысшее),

Основные определения (3)

Математическое программирование В общем виде задача математического программирования формулируется следующим образом: Минимизировать при m ограничениях в виде равенств и при (p-m) ограничениях в виде неравенств Если функции линейные, задача оптимизации называется задачей линейного программирования. Если хотя бы одна из перечисленных функций нелинейная – задачей нелинейного программирования. Если все или некоторые переменные не могут изменяться непрерывно, возникает задача дискретного (целочисленного) программирования, которая в свою очередь может быть линейной или нелинейной.

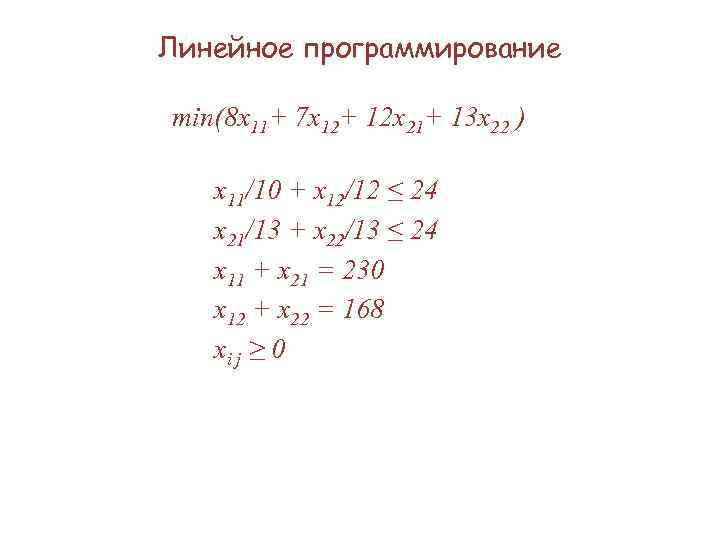

Линейное программирование i j Задание 10 т/час 8 $/т 12 т/час 7 $/т x 12 13 т/час 12 $/т 13 т/час 13 $/т x 21 Погрузчик 2 Склад 2 x 11 Погрузчик 1 Склад 1 x 22 230 168 min(8 x 11+7 x 12+12 x 21+13 x 22 ) 24 час

Линейное программирование min(8 x 11+ 7 x 12+ 12 x 21+ 13 x 22 ) x 11/10 + x 12/12 ≤ 24 x 21/13 + x 22/13 ≤ 24 x 11 + x 21 = 230 x 12 + x 22 = 168 xi j ≥ 0

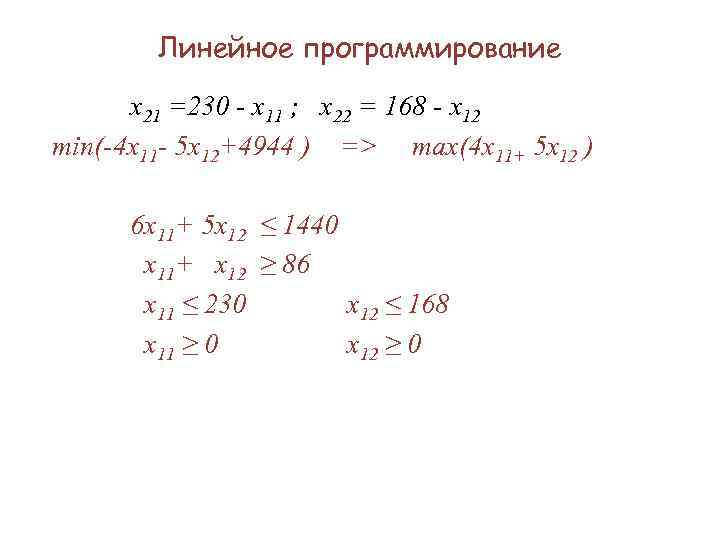

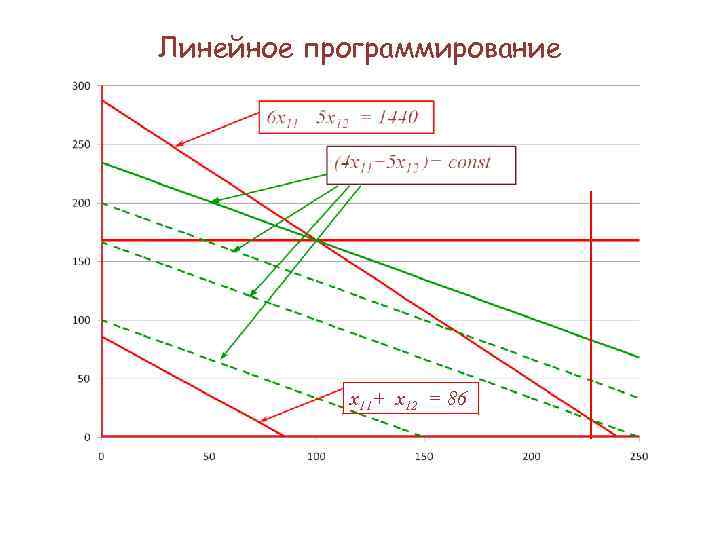

Линейное программирование x 21 =230 - x 11 ; x 22 = 168 - x 12 min(-4 x 11 - 5 x 12+4944 ) => max(4 x 11+ 5 x 12 ) 6 x 11+ 5 x 12 ≤ 1440 x 11+ x 12 ≥ 86 x 11 ≤ 230 x 12 ≤ 168 x 11 ≥ 0 x 12 ≥ 0

Линейное программирование x 11+ x 12 = 86

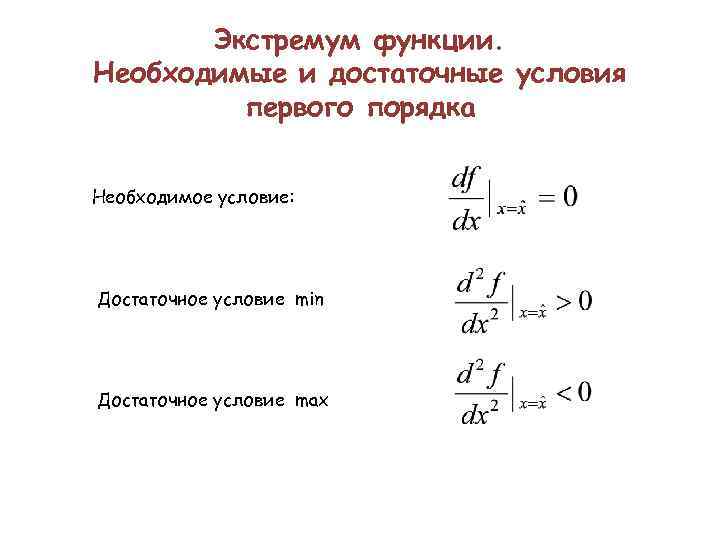

Экстремум функции. Необходимые и достаточные условия первого порядка Необходимое условие: Достаточное условие min Достаточное условие max

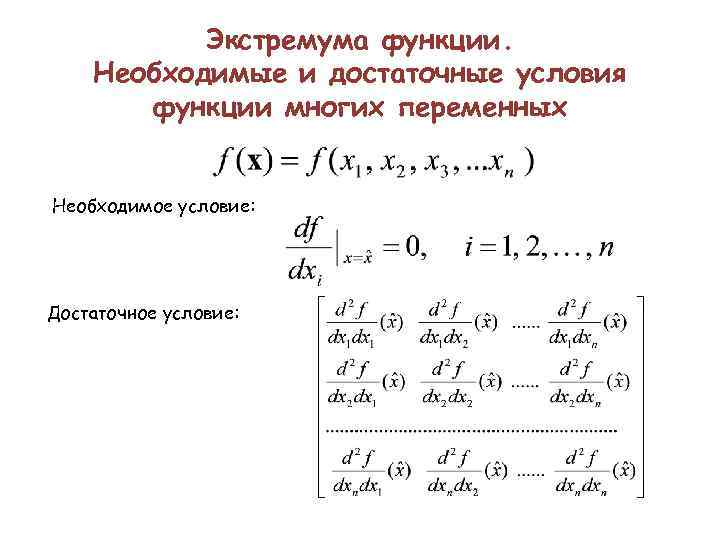

Экстремума функции. Необходимые и достаточные условия функции многих переменных Необходимое условие: Достаточное условие:

Нелинейное программирование Поисковая оптимизация заключается в следующем: В точках вычисляются значения функции , и по этим результатам требуется определить оценку локального экстремума. При этом наиболее важными являются вопросы о том, как выбирать точки последовательности и об остановке вычислений (т. е. об усечении последовательности по достижении заданной точности решения задачи). В дальнейшем для определенности будем рассматривать задачу минимизации показателя.

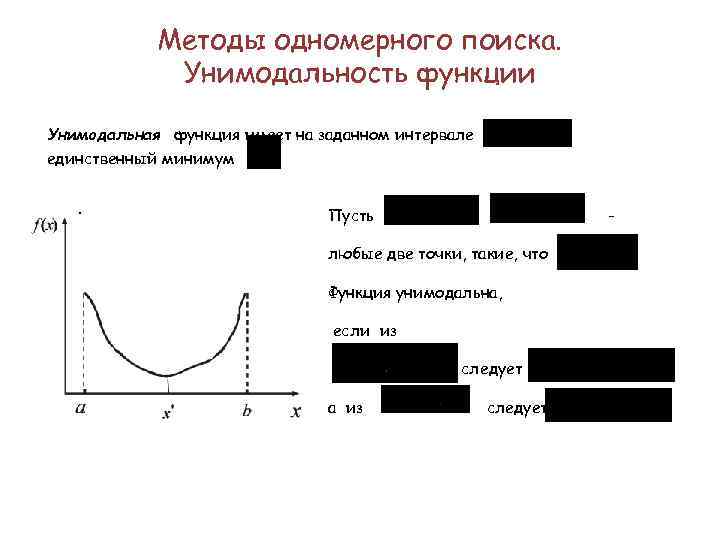

Методы одномерного поиска. Унимодальность функции Унимодальная функция имеет на заданном интервале единственный минимум. Пусть - любые две точки, такие, что Функция унимодальна, если из следует а из следует

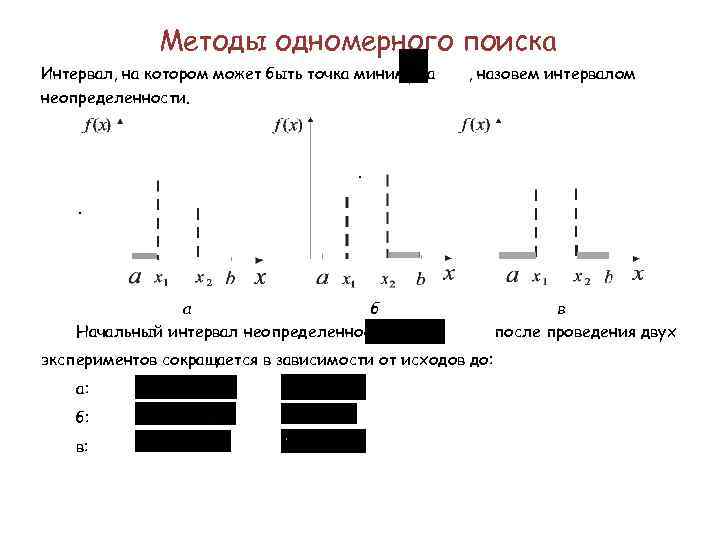

Методы одномерного поиска Интервал, на котором может быть точка минимума неопределенности. , назовем интервалом . . а б Начальный интервал неопределенности экспериментов сокращается в зависимости от исходов до: а: б: в: в после проведения двух

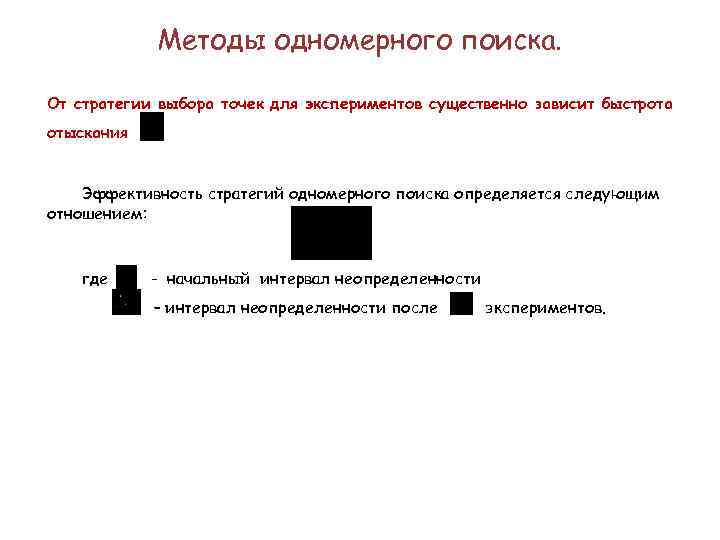

Методы одномерного поиска. От стратегии выбора точек для экспериментов существенно зависит быстрота отыскания Эффективность стратегий одномерного поиска определяется следующим отношением: где - начальный интервал неопределенности – интервал неопределенности после экспериментов.

Методы одномерного поиска. Метод дихотомии (деления на 2) .

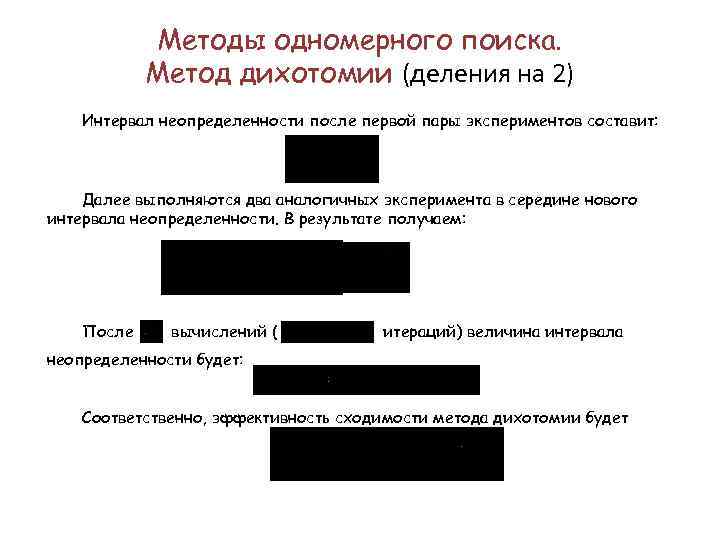

Методы одномерного поиска. Метод дихотомии (деления на 2) Интервал неопределенности после первой пары экспериментов составит: . . Далее выполняются два аналогичных эксперимента в середине нового интервала неопределенности. В результате получаем: После вычислений ( итераций) величина интервала неопределенности будет: Соответственно, эффективность сходимости метода дихотомии будет

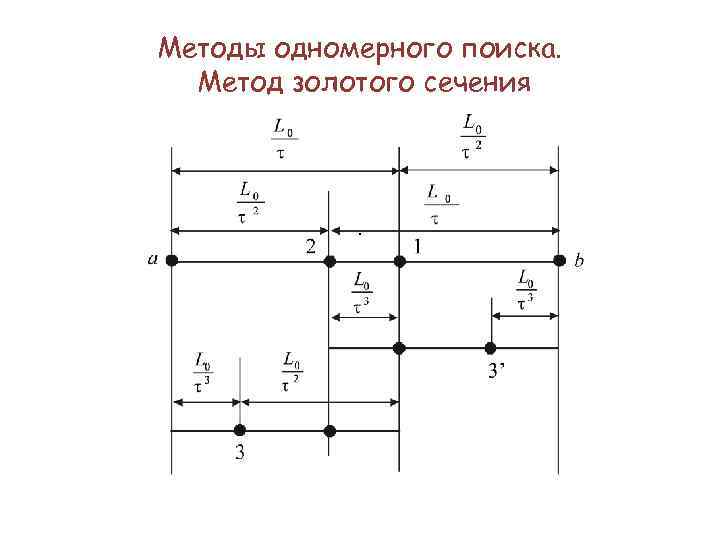

Методы одномерного поиска. Метод золотого сечения Интервал неопределенности разобьем на отрезки таким образом, чтобы соблюдались соотношения. Отсюда Положительный корень уравнения

Методы одномерного поиска. Метод золотого сечения .

Методы одномерного поиска. Метод золотого сечения Таким образом, для первой итерации требуются два измерения, а для всех последующих – по одному. Соответственно эффективность сходимости алгоритма .

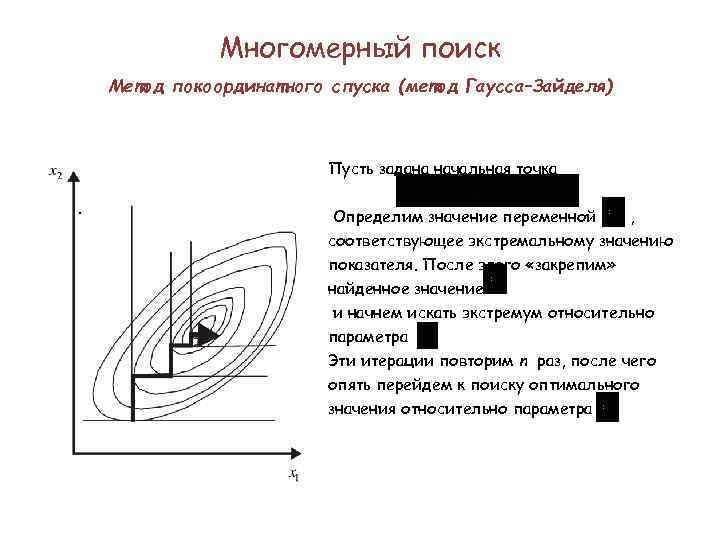

Многомерный поиск Метод покоординатного спуска (метод Гаусса–Зайделя) Пусть задана начальная точка. Определим значение переменной , соответствующее экстремальному значению показателя. После этого «закрепим» найденное значение и начнем искать экстремум относительно параметра Эти итерации повторим n раз, после чего опять перейдем к поиску оптимального значения относительно параметра

![Многомерный поиск Градиентные методы (1) . grad = =[ ] Градиент скалярной функции в Многомерный поиск Градиентные методы (1) . grad = =[ ] Градиент скалярной функции в](https://present5.com/presentation/3/15226612_163105974.pdf-img/15226612_163105974.pdf-29.jpg)

Многомерный поиск Градиентные методы (1) . grad = =[ ] Градиент скалярной функции в некоторой точке направлен в сторону наискорейшего возрастания функции и ортогонален линии уровня. (поверхности) постоянного значения функции , проходящей через точку. Вектор, противоположный градиенту, – антиградиент – направлен в сторону наискорейшего убывания функции. Итерационный процесс Все итерационные методы, в которых движение на каждом шаге совпадает с антиградиентом (градиентом) функции, называются градиентными методами.

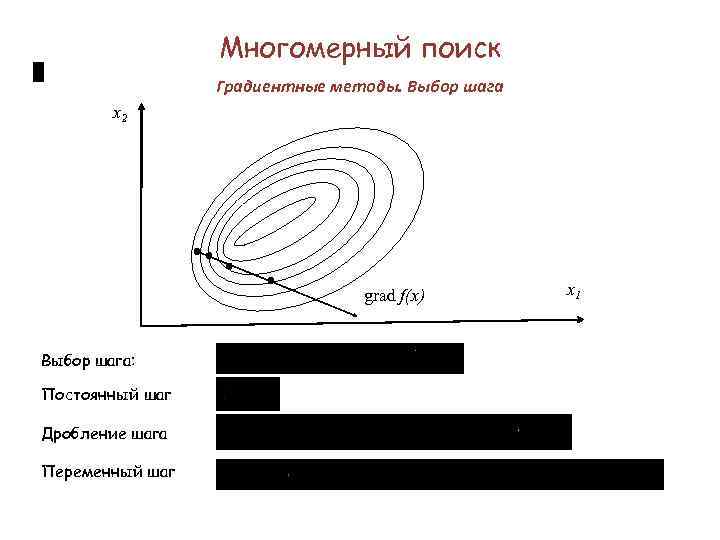

Многомерный поиск Градиентные методы. Выбор шага x 2 grad f(x) Выбор шага: Постоянный шаг Дробление шага Переменный шаг x 1

Многомерный поиск Градиентные методы (2) .

Многомерный поиск Градиентные методы. Построение градиента Выбор шага: Постоянный шаг Дробление шага Переменный шаг

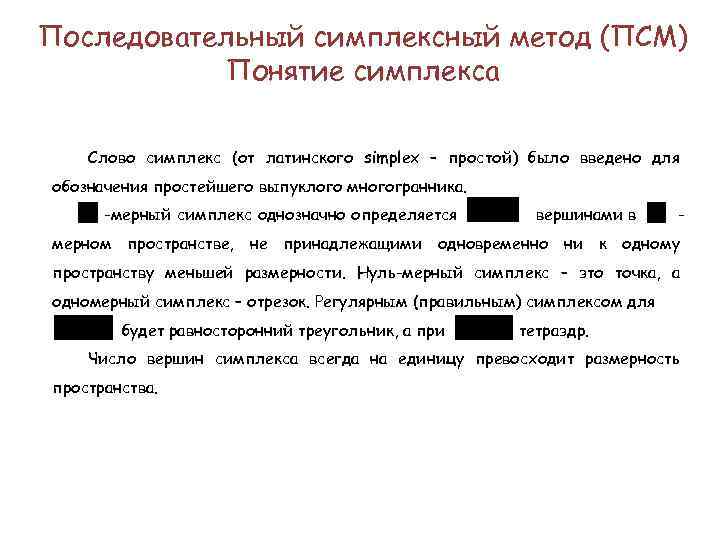

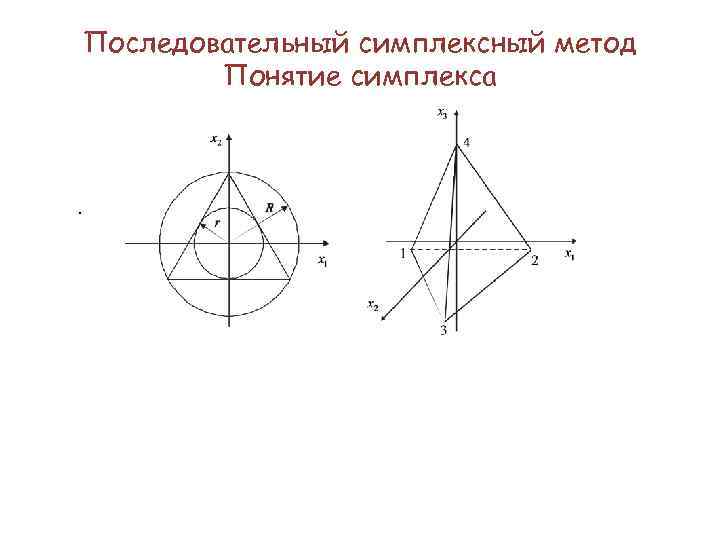

Последовательный симплексный метод (ПСМ) Понятие симплекса Слово симплекс (от латинского simplex – простой) было введено для обозначения простейшего выпуклого многогранника. -мерный симплекс однозначно определяется вершинами в - мерном пространстве, не принадлежащими одновременно ни к одному пространству меньшей размерности. Нуль-мерный симплекс – это точка, а одномерный симплекс – отрезок. Регулярным (правильным) симплексом для будет равносторонний треугольник, а при – тетраэдр. Число вершин симплекса всегда на единицу превосходит размерность пространства.

Последовательный симплексный метод Понятие симплекса .

Последовательный симплексный метод Координаты вершин симплекса . - длина ребра симплекса, i = 1, 2, …n

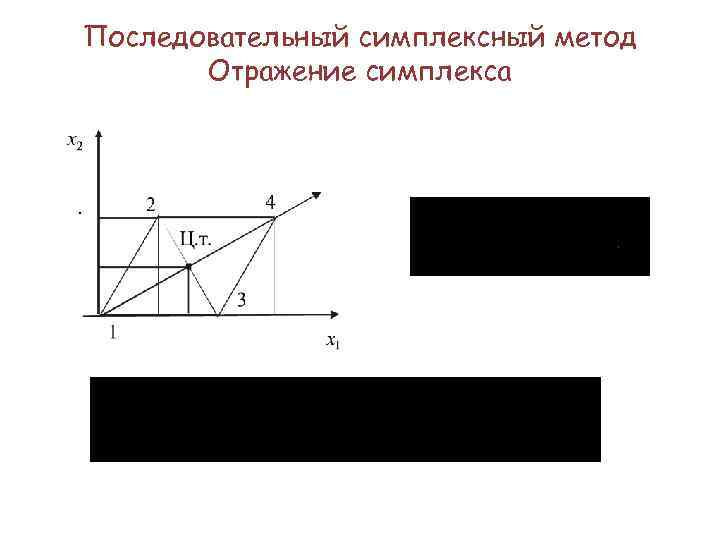

Последовательный симплексный метод Отражение симплекса .

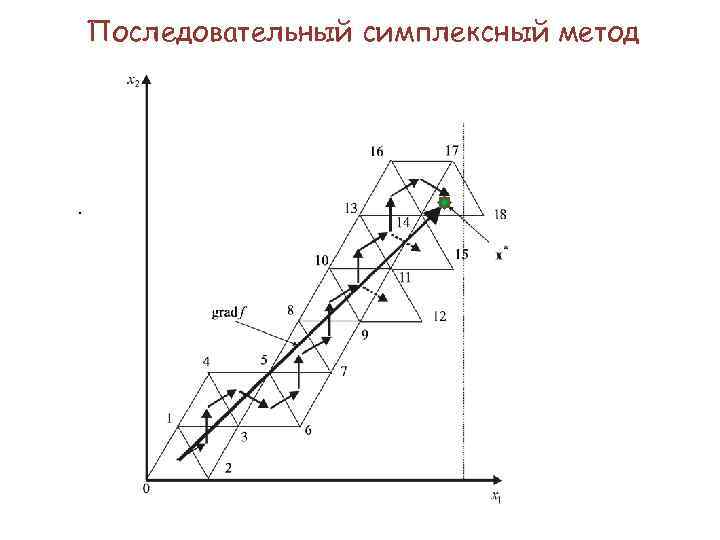

Последовательный симплексный метод .

Последовательный симплексный метод Особые случаи «колебания» . 3 1 4’ 2 4

Последовательный симплексный метод Особые случаи Выход за ограничения . 3 1 4’ 2 4 5

Последовательный симплексный метод Особые случаи «Зацикливание» 3 4 . 1 5 2 7 6

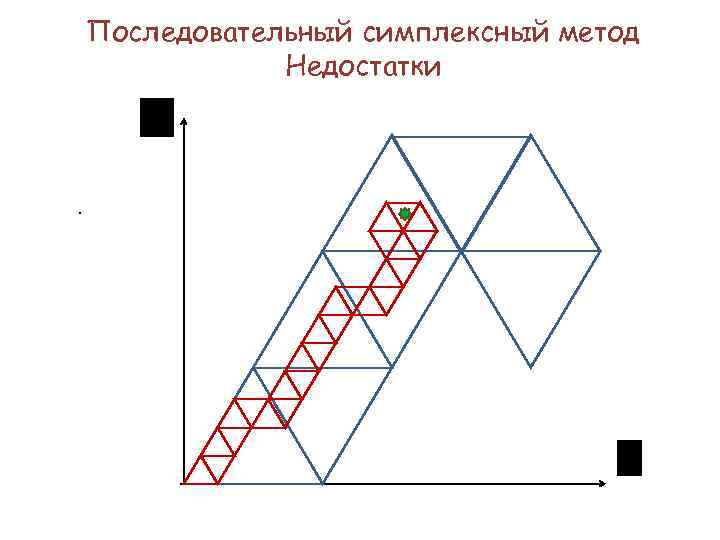

Последовательный симплексный метод Недостатки .

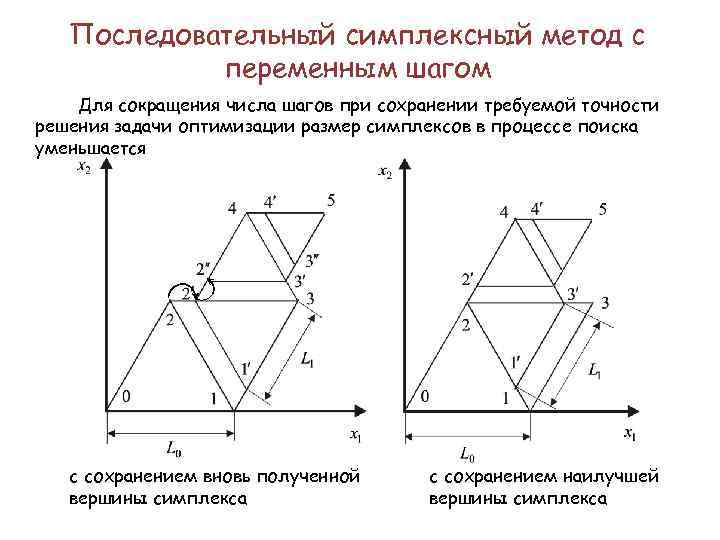

Последовательный симплексный метод с переменным шагом Для сокращения числа шагов при сохранении требуемой точности решения задачи оптимизации размер симплексов в процессе поиска уменьшается с сохранением вновь полученной вершины симплекса с сохранением наилучшей вершины симплекса

Последовательный симплексный метод с переменным шагом Законы изменения размеров симплекса 1. 2 1 0. 8 0. 6 0. 4 0. 2 0 0 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20

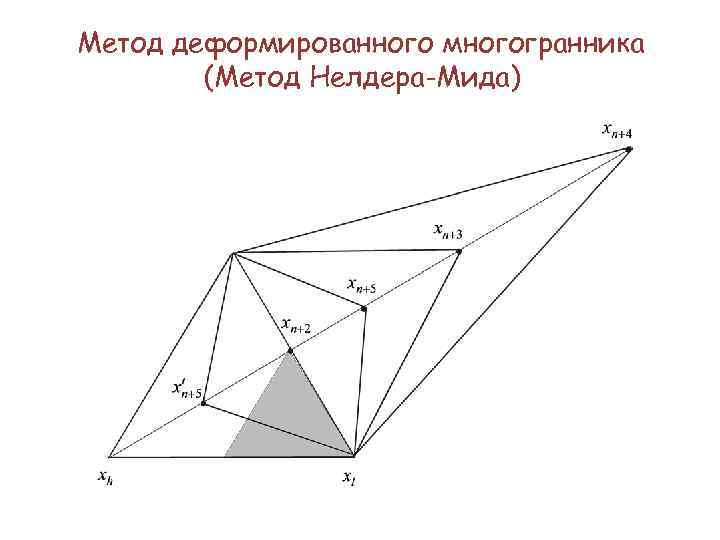

Метод деформированного многогранника (Метод Нелдера-Мида)

, : Метод деформированного многогранника (Метод Нелдера-Мида) , 1. ОТРАЖЕНИЕ 2. РАСТЯЖЕНИЕ 3. СЖАТИЕ 4. РЕДУКЦИЯ

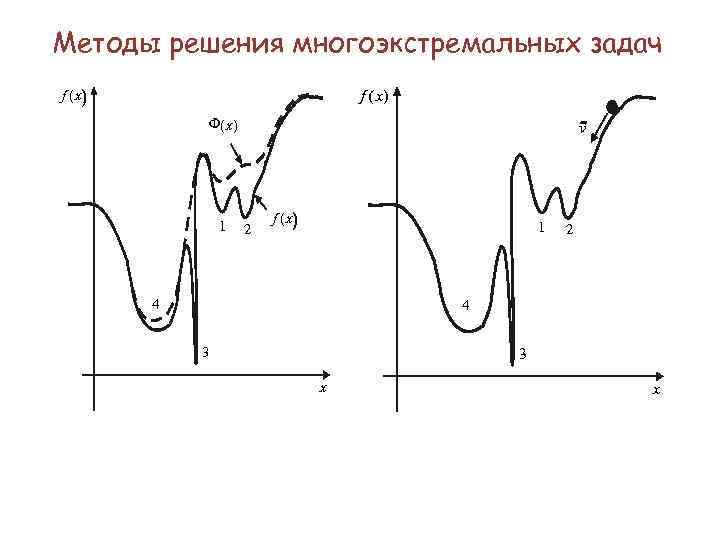

Методы решения многоэкстремальных задач Локальный спуск из последовательности случайно или регулярно выбираемых начальных точек

). Методы решения многоэкстремальных задач Случайный поиск (моделирование процессов случайного блуждания в заданной области) Норма вектора ограничена (т. е. точка находится в достаточно малой окрестности точки

Методы решения многоэкстремальных задач f (x ) f (x) r v F(x) 1 2 f (x) 1 4 2 4 3 3 x x

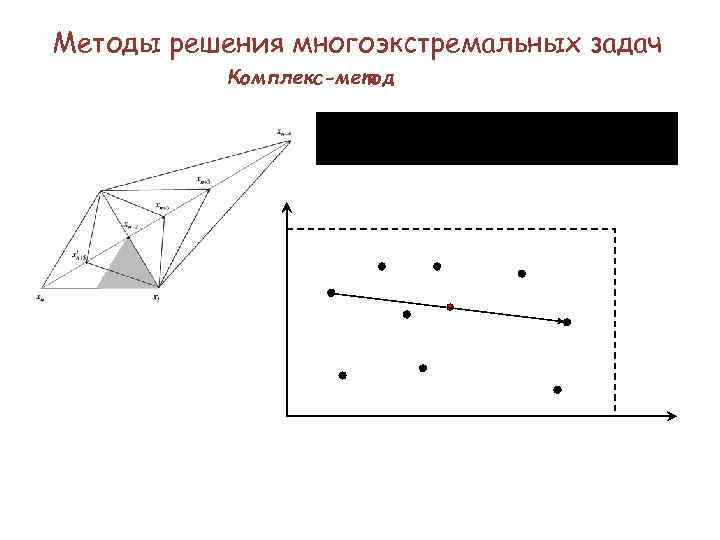

Методы решения многоэкстремальных задач Комплекс-метод

Методы решения многоэкстремальных задач Несвязанные области оптимизации Задача: • имеется множество точек в замкнутом пространстве параметров; • необходимо определить наличие непересекающихся подмножеств точек, входящих в данное множество, достаточно далеко отстоящих друг от друга; • если такие подмножества (кластеры) существуют, необходимо определить их центры.

Методы решения многоэкстремальных задач Несвязанные области оптимизации

Методы решения многоэкстремальных задач Несвязанные области оптимизации

Методы решения многоэкстремальных задач Несвязанные области оптимизации

Теория оптимального управления5.ppt