Теория информации Источники сообщений 1

Теория информации Источники сообщений 1 Лекция 4. Источники сообщений

Теория информации Источником сообщений может быть любой объект, состояние которого изменяется во времени, и информация о его состоянии предназначена для передачи и хранения. Дискретный источник – это объект, имеющий конечное множество состояний. Непрерывный источник – это объект, имеющий непрерывное множество состояний. Лекция 4. Источники сообщений

Теория информации Случайный дискретный источник информации можно трактовать как систему правил, которые в сочетании с результатами последовательности случайных экспериментов (выборов, проводимых в соответствии с определенными вероятностями) задают последовательность событий, порождаемую на выходе источника. Лекция 4. Источники сообщений

Теория информации Обозначим через a 1 , a 2 , . . . , a i последовательнос событий, порождаемых источником. Каждое частное событие может быть любой из L букв a 1 , a 2, . . . , ak, . . . , a. L множества А. A i - множество букв, соответствующих i -му событию , хотя элементы множества будут одни и те же для всех целых i>0. Лекция 4. Источники сообщений

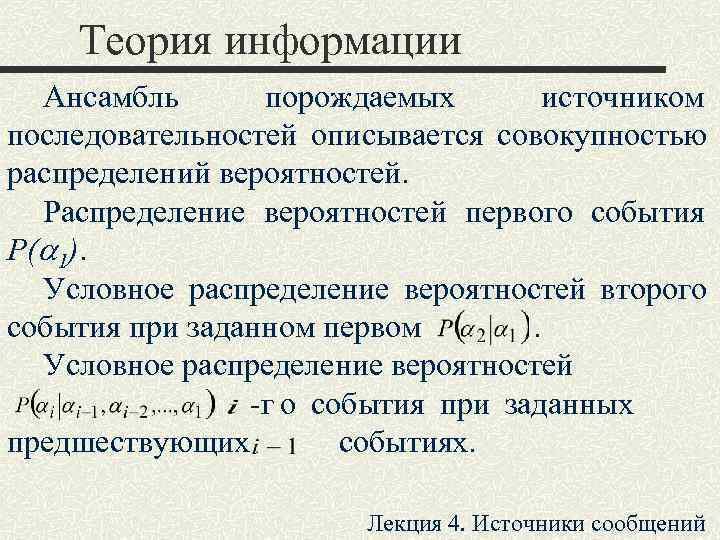

Теория информации Ансамбль порождаемых источником последовательностей описывается совокупностью распределений вероятностей. Распределение вероятностей первого события P(a 1). Условное распределение вероятностей второго события при заданном первом . Условное распределение вероятностей -г o события при заданных предшествующих событиях. Лекция 4. Источники сообщений

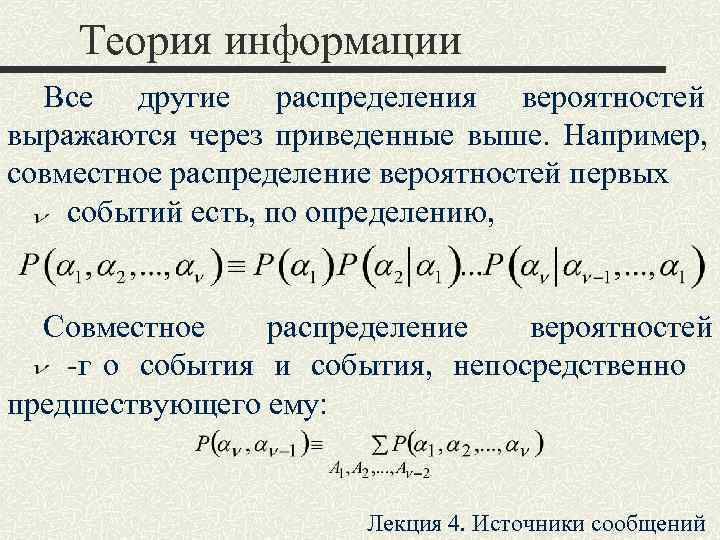

Теория информации Все другие распределения вероятностей выражаются через приведенные выше. Например, совместное распределение вероятностей первых событий есть, по определению, Совместное распределение вероятностей -г o события и события, непосредственно предшествующего ему: Лекция 4. Источники сообщений

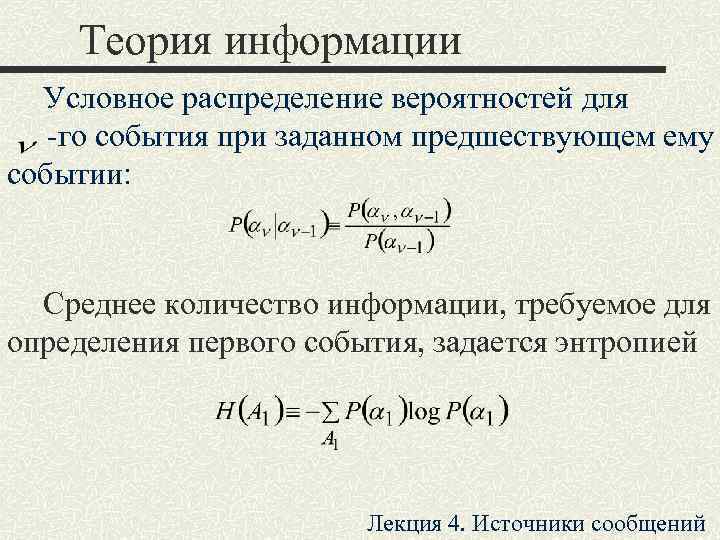

Теория информации Условное распределение вероятностей для -гo события при заданном предшествующем ему событии: Среднее количество информации, требуемое для определения первого события, задается энтропией Лекция 4. Источники сообщений

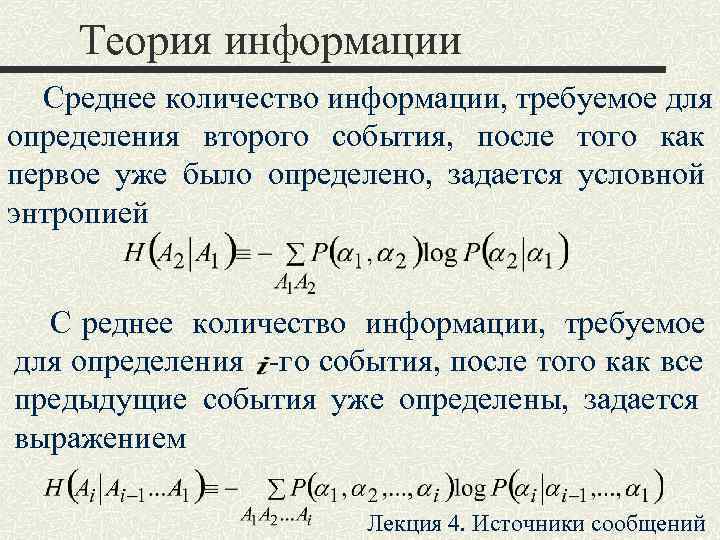

Теория информации Среднее количество информации, требуемое для определения второго события, после того как первое уже было определено, задается условной энтропией С реднее количество информации, требуемое для определения -гo события, после того как все предыдущие события уже определены, задается выражением Лекция 4. Источники сообщений

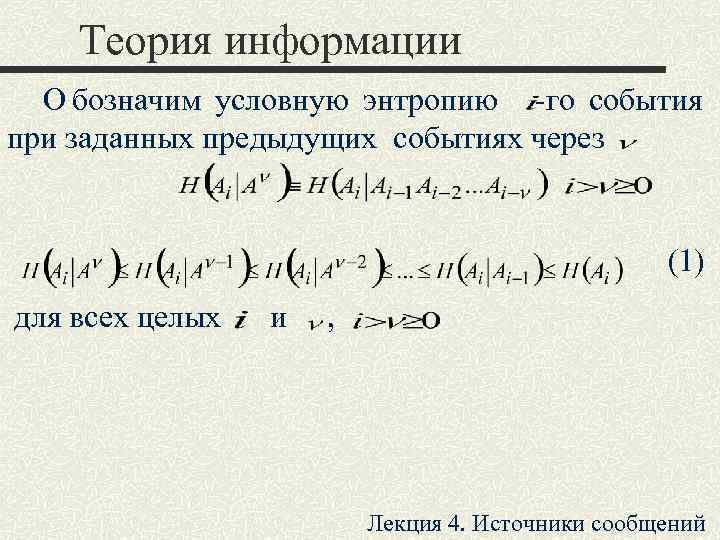

Теория информации О бозначим условную энтропию -го события при заданных предыдущих событиях через (1) для всех целых и , Лекция 4. Источники сообщений

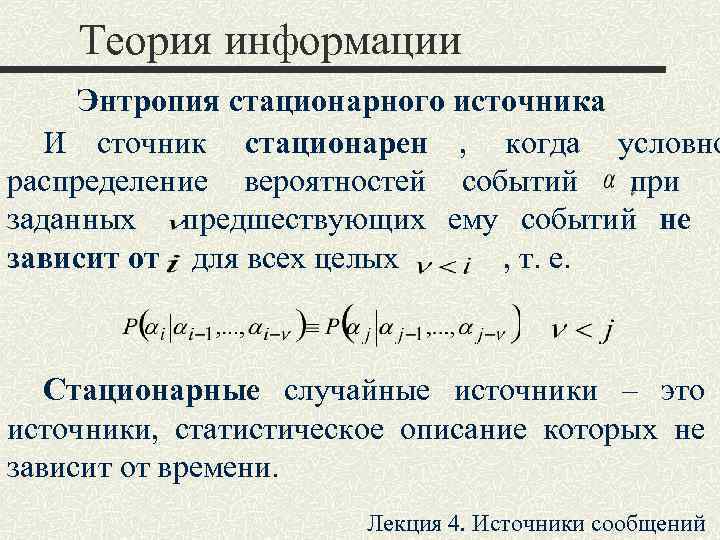

Теория информации Энтропия стационарного источника И сточник стационарен , когда условно распределение вероятностей событий при заданных предшествующих ему событий не зависит от для всех целых , т. е. Стационарные случайные источники – это источники, статистическое описание которых не зависит от времени. Лекция 4. Источники сообщений

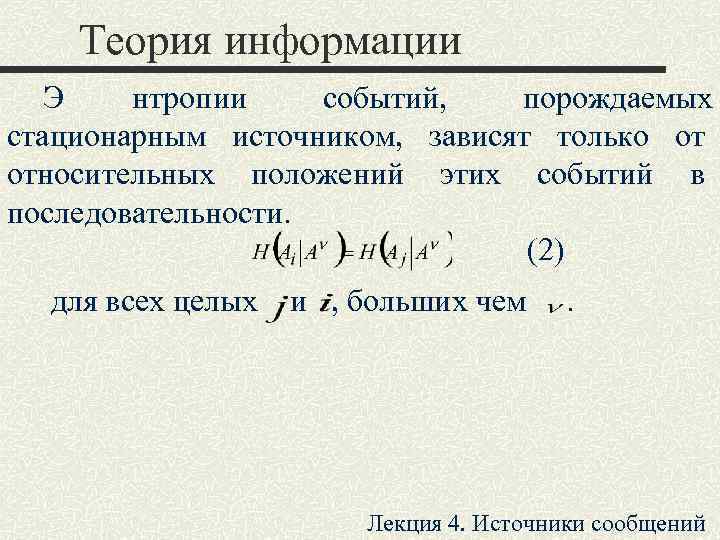

Теория информации Э нтропии событий, порождаемых стационарным источником, зависят только от относительных положений этих событий в последовательности. (2) для всех целых и , больших чем . Лекция 4. Источники сообщений

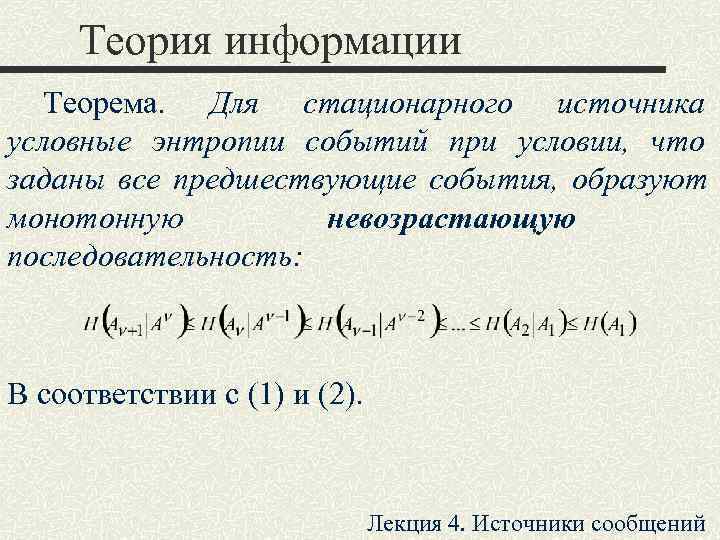

Теория информации Теорема. Для стационарного источника условные энтропии событий при условии, что заданы все предшествующие события, образуют монотонную невозрастающую последовательность: В соответствии с (1) и (2). Лекция 4. Источники сообщений

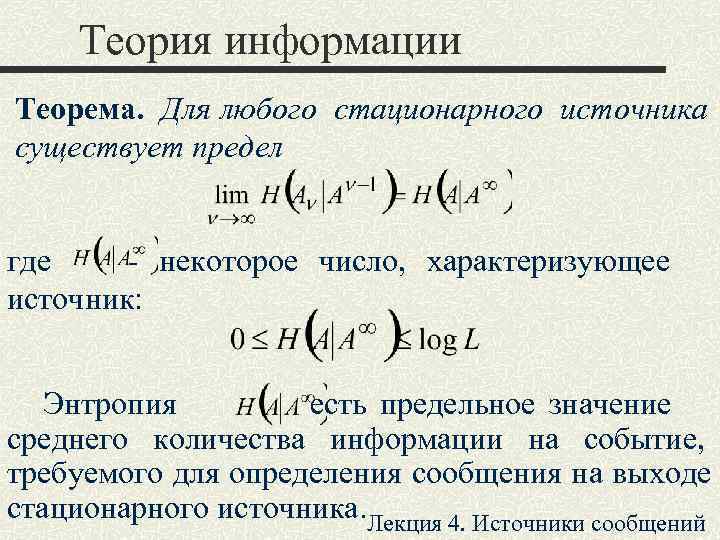

Теория информации Теорема. Для любого стационарного источника существует предел где - некоторое число, характеризующее источник: Энтропия есть предельное значение среднего количества информации на событие, требуемого для определения сообщения на выходе стационарного источника. Лекция 4. Источники сообщений

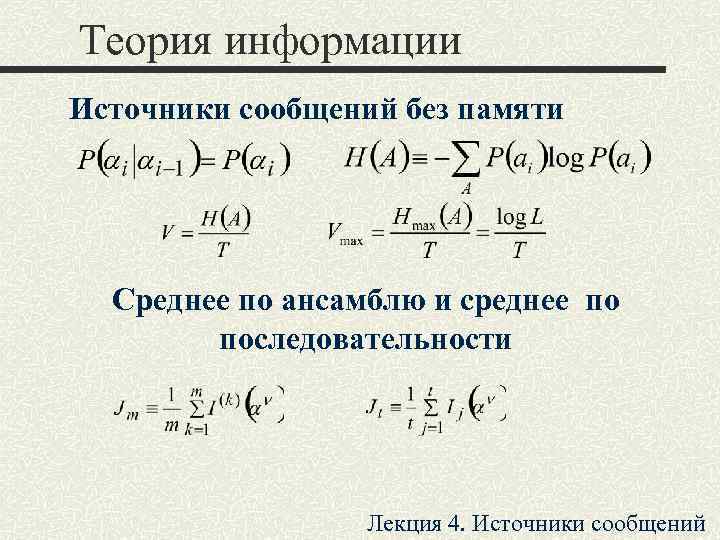

Теория информации Источники сообщений без памяти Среднее по ансамблю и среднее по последовательности Лекция 4. Источники сообщений

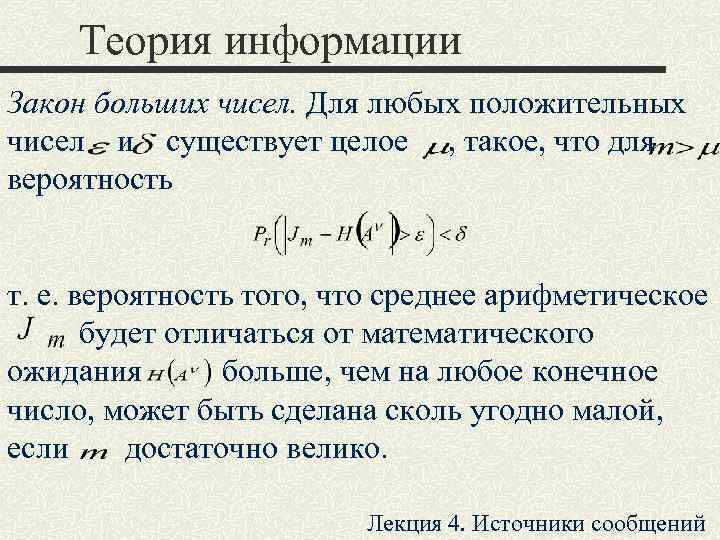

Теория информации Закон больших чисел. Для любых положительных чисел и существует целое , такое, что для вероятность т. е. вероятность того, что среднее арифметическое будет отличаться от математического ожидания больше, чем на любое конечное число, может быть сделана сколь угодно малой, если достаточно велико. Лекция 4. Источники сообщений

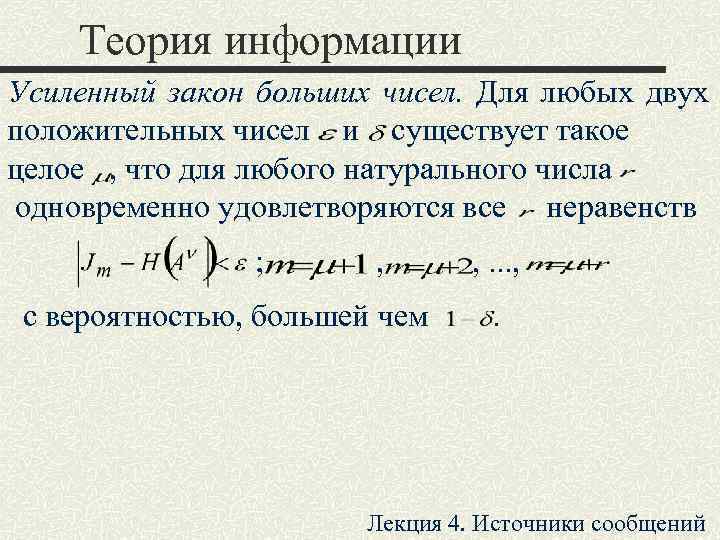

Теория информации Усиленный закон больших чисел. Для любых двух положительных чисел и существует такое целое , что для любого натурального числа одновременно удовлетворяются все неравенств ; , , . . . , с вероятностью, большей чем . Лекция 4. Источники сообщений

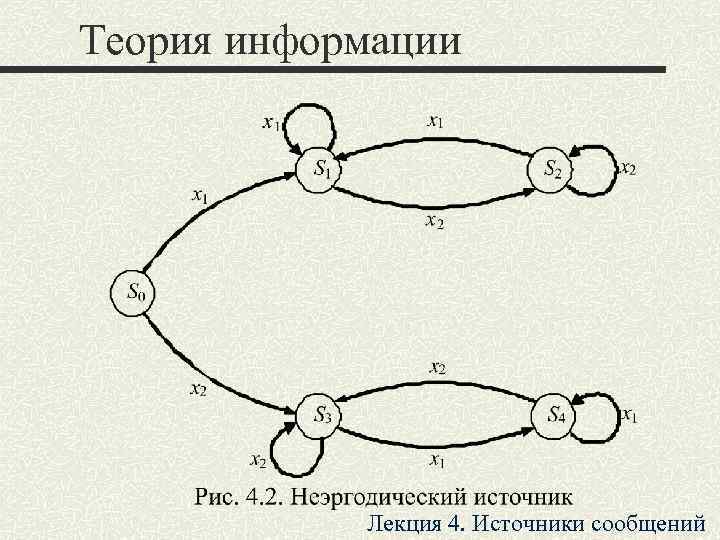

Теория информации Если среднее значение по последовательности одно и то же для всех сообщений на выходе источника, для которых оно существует, то это среднее совпадает со средним по ансамблю . Такое совпадение средних по последовательностям с соответствующими средними по ансамблям является свойством подкласса стационарных источников, называемых эргодическими. Лекция 4. Источники сообщений

Теория информации Марковские источники Важнейшей характеристикой последовательности состояний марковск ого источника является то, что каждое состояние этой последовательности зависит только от непосредственно предшествующего ему состояния. Лекция 4. Источники сообщений

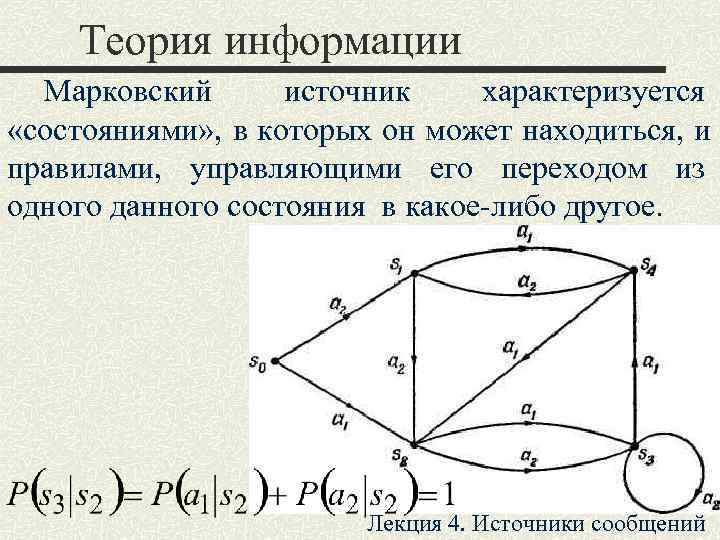

Теория информации Марковский источник характеризуется «состояниями» , в которых он может находиться, и правилами, управляющими его переходом из одного данного состояния в какое-либо другое. Лекция 4. Источники сообщений

Теория информации Лекция 4. Источники сообщений

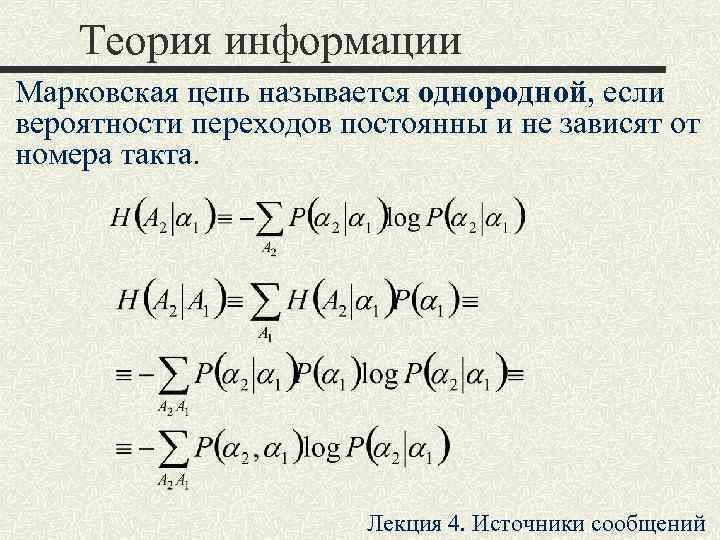

Теория информации Марковская цепь называется однородной, если вероятности переходов постоянны и не зависят от номера такта. Лекция 4. Источники сообщений

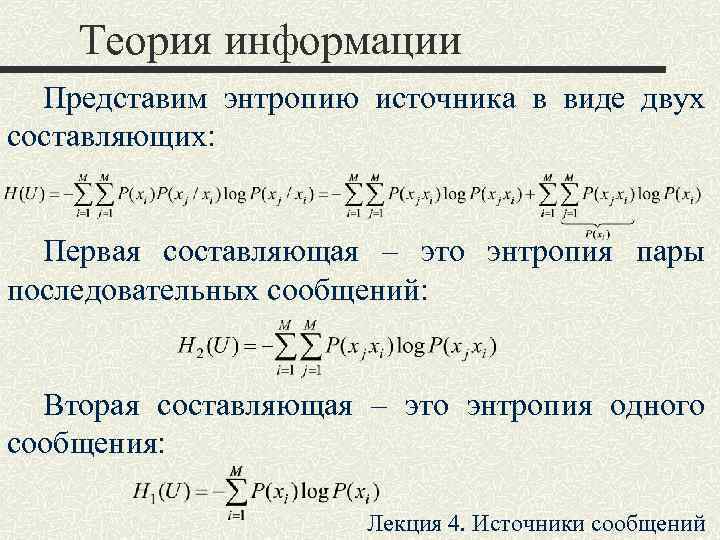

Теория информации Представим энтропию источника в виде двух составляющих: Первая составляющая – это энтропия пары последовательных сообщений: Вторая составляющая – это энтропия одного сообщения: Лекция 4. Источники сообщений

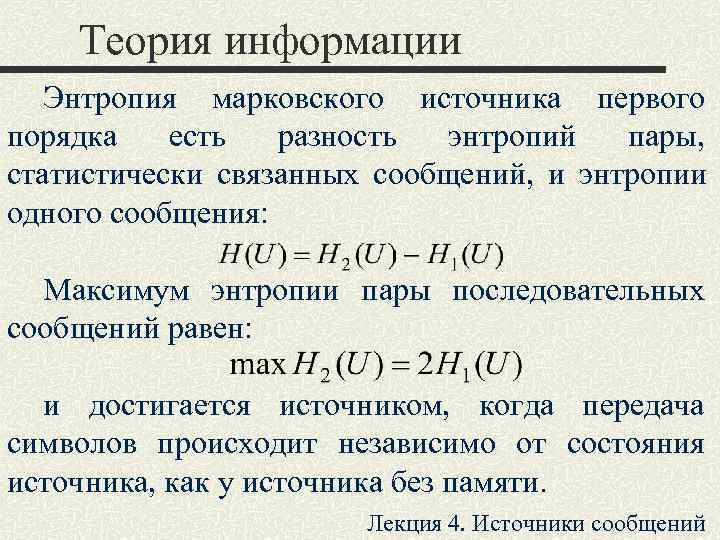

Теория информации Энтропия марковского источника первого порядка есть разность энтропий пары, статистически связанных сообщений, и энтропии одного сообщения: Максимум энтропии пары последовательных сообщений равен: и достигается источником, когда передача символов происходит независимо от состояния источника, как у источника без памяти. Лекция 4. Источники сообщений

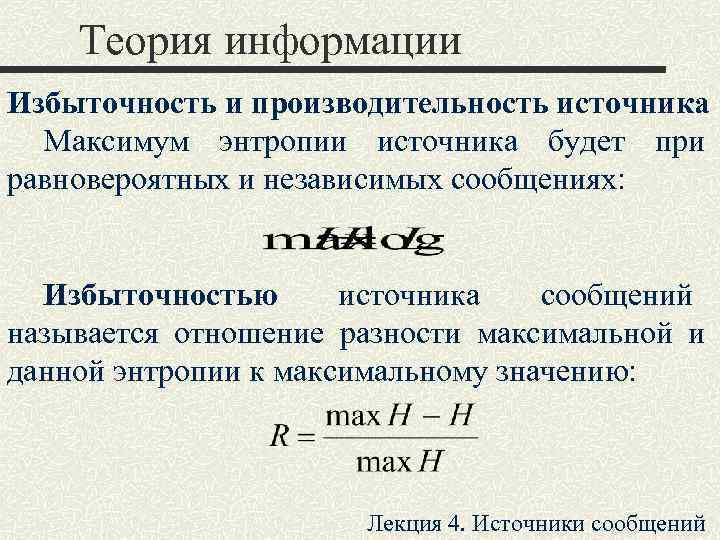

Теория информации Избыточность и производительность источника Максимум энтропии источника будет при равновероятных и независимых сообщениях: Избыточностью источника сообщений называется отношение разности максимальной и данной энтропии к максимальному значению: Лекция 4. Источники сообщений

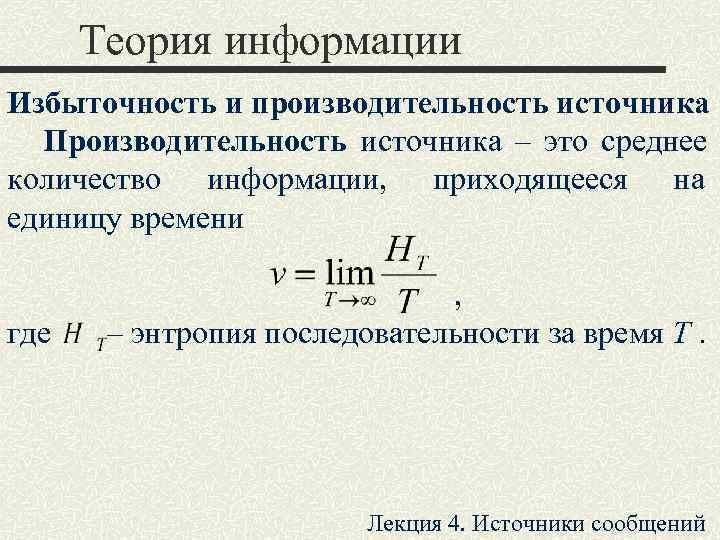

Теория информации Избыточность и производительность источника Производительность источника – это среднее количество информации, приходящееся на единицу времени , где – энтропия последовательности за время Т. Лекция 4. Источники сообщений

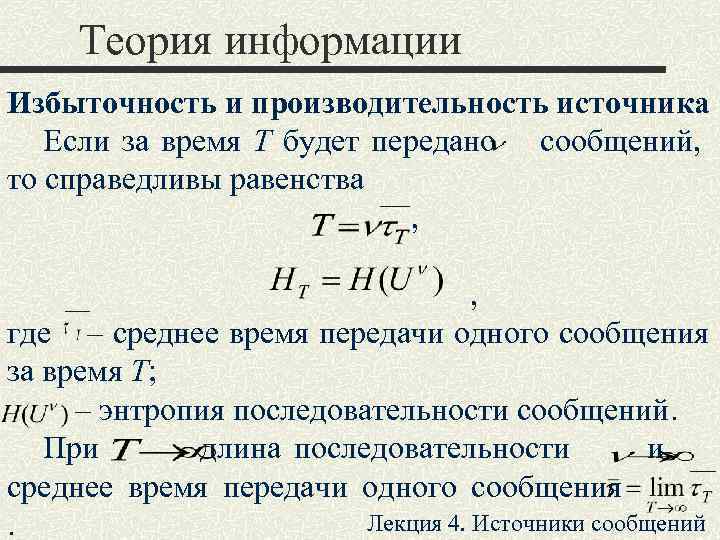

Теория информации Избыточность и производительность источника Если за время Т будет передано сообщений, то справедливы равенства , где – среднее время передачи одного сообщения за время Т; – энтропия последовательности сообщений. При длина последовательности среднее время передачи одного сообщения . Лекция 4. Источники сообщений

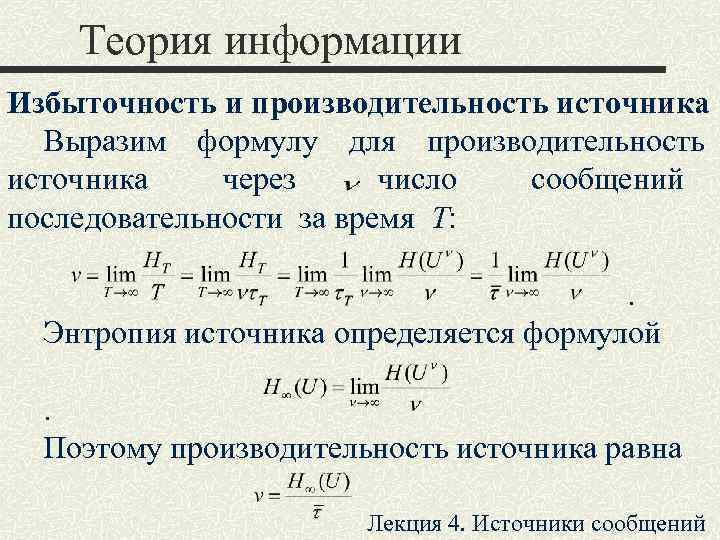

Теория информации Избыточность и производительность источника Выразим формулу для производительность источника через число сообщений последовательности за время Т: . Энтропия источника определяется формулой . Поэтому производительность источника равна Лекция 4. Источники сообщений

Лекция 3-4 Источники сообщений.ppt

- Количество слайдов: 27