2013_Тема 2.Модель парной регрессии Леванова.ppt

- Количество слайдов: 17

Тема 2. Модель парной регрессии. (Леванова) 1. Уравнение и вид функции парной регрессии. 2. Оценка параметров уравнения линейной регрессии. Метод наименьших квадратов. Экономический смысл параметров. 3. Оценка адекватности модели и существенности параметров линейной регрессии. 4. Нелинейная регрессия. Применение модели в экономике. Ключевые слова: Спецификация модели. Результативный признак, признак-фактор и стохастическая переменная в модели. Параметры регрессии. Метод наименьших квадратов. Стандартное отклонение случайной величины. Коэффициент вариации случайной величины. Коэффициент корреляции. Коэффициент детерминации. Общая сумма квадратов отклонений. Факторная сумма квадратов отклонений. Остаточная сумма квадратов отклонений. Число степеней свободы. Дисперсия на одну степень свободы. F - критерий Фишера. Стандартные ошибки коэффициентов уравнения регрессии. t – критерий Стьюдента. Доверительные интервалы. Интервалы прогноза. Средняя ошибка аппроксимации.

Тема 2. Модель парной регрессии. (Леванова) 1. Уравнение и вид функции парной регрессии. 2. Оценка параметров уравнения линейной регрессии. Метод наименьших квадратов. Экономический смысл параметров. 3. Оценка адекватности модели и существенности параметров линейной регрессии. 4. Нелинейная регрессия. Применение модели в экономике. Ключевые слова: Спецификация модели. Результативный признак, признак-фактор и стохастическая переменная в модели. Параметры регрессии. Метод наименьших квадратов. Стандартное отклонение случайной величины. Коэффициент вариации случайной величины. Коэффициент корреляции. Коэффициент детерминации. Общая сумма квадратов отклонений. Факторная сумма квадратов отклонений. Остаточная сумма квадратов отклонений. Число степеней свободы. Дисперсия на одну степень свободы. F - критерий Фишера. Стандартные ошибки коэффициентов уравнения регрессии. t – критерий Стьюдента. Доверительные интервалы. Интервалы прогноза. Средняя ошибка аппроксимации.

Основные теоретические аспекты темы. Парная регрессия – регрессия между двумя переменными y и x, то есть модель вида: y=f(x)+ε, где: y - зависимая переменная (результативный признак), x – независимая, объясняющая, переменная (признак- фактор), ε - возмущение или стохастическая переменная, включающая влияние неучтенных в модели факторов

Основные теоретические аспекты темы. Парная регрессия – регрессия между двумя переменными y и x, то есть модель вида: y=f(x)+ε, где: y - зависимая переменная (результативный признак), x – независимая, объясняющая, переменная (признак- фактор), ε - возмущение или стохастическая переменная, включающая влияние неучтенных в модели факторов

Основные типы функций, используемые при количественной оценке связей: 1) линейная yt = 0 + 1 х1 t +. . . + n хnt + t, (1. 2) 2) правая полулогарифмическая yt= 0 + 1 lnx 1 t +. . . + n lnхnt + t, (1. 3) 3) степенная 4) гиперболическая yt = 0 + 1 /х1 t +. . . + n /хnt+ t, (1. 5) 5) логарифмическая гиперболическая lnyt = 0 + 1 /х1 t +. . . + n /хnt+ t, (1. 6) 6) обратная линейная (функция Торнквиста) 1/yt= 0+ 1 /х1 t+. . . + n /хnt + t, (1. 7)

Основные типы функций, используемые при количественной оценке связей: 1) линейная yt = 0 + 1 х1 t +. . . + n хnt + t, (1. 2) 2) правая полулогарифмическая yt= 0 + 1 lnx 1 t +. . . + n lnхnt + t, (1. 3) 3) степенная 4) гиперболическая yt = 0 + 1 /х1 t +. . . + n /хnt+ t, (1. 5) 5) логарифмическая гиперболическая lnyt = 0 + 1 /х1 t +. . . + n /хnt+ t, (1. 6) 6) обратная линейная (функция Торнквиста) 1/yt= 0+ 1 /х1 t+. . . + n /хnt + t, (1. 7)

Метод наименьших квадратов – метод оценивания параметров линейной регрессии, минимизирующий сумму квадратов отклонений наблюдений зависимой переменной от искомой линейной функции. Q= Σ εI 2 Σ (yi –f(x))2 →min где: yi – статистические значения зависимой переменной; f(xi) - теоретические значения зависимой переменной, рассчитанные с помощью уравнения регрессии.

Метод наименьших квадратов – метод оценивания параметров линейной регрессии, минимизирующий сумму квадратов отклонений наблюдений зависимой переменной от искомой линейной функции. Q= Σ εI 2 Σ (yi –f(x))2 →min где: yi – статистические значения зависимой переменной; f(xi) - теоретические значения зависимой переменной, рассчитанные с помощью уравнения регрессии.

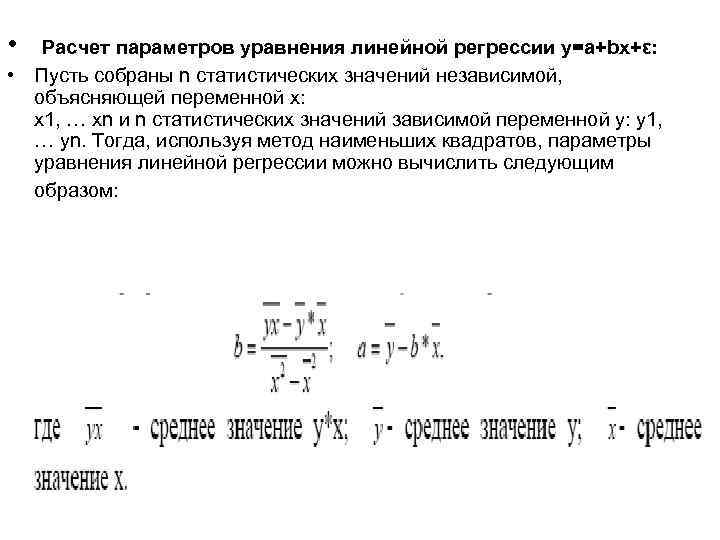

• Расчет параметров уравнения линейной регрессии y=a+bx+ε: • Пусть собраны n статистических значений независимой, объясняющей переменной x: x 1, … xn и n статистических значений зависимой переменной y: y 1, … yn. Тогда, используя метод наименьших квадратов, параметры уравнения линейной регрессии можно вычислить следующим образом:

• Расчет параметров уравнения линейной регрессии y=a+bx+ε: • Пусть собраны n статистических значений независимой, объясняющей переменной x: x 1, … xn и n статистических значений зависимой переменной y: y 1, … yn. Тогда, используя метод наименьших квадратов, параметры уравнения линейной регрессии можно вычислить следующим образом:

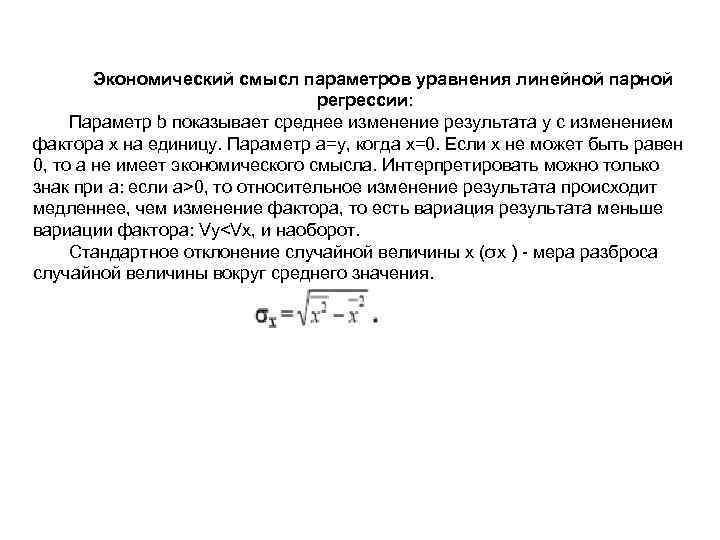

Экономический смысл параметров уравнения линейной парной регрессии: Параметр b показывает среднее изменение результата y с изменением фактора x на единицу. Параметр a=y, когда x=0. Если x не может быть равен 0, то a не имеет экономического смысла. Интерпретировать можно только знак при а: если а>0, то относительное изменение результата происходит медленнее, чем изменение фактора, то есть вариация результата меньше вариации фактора: Vy

Экономический смысл параметров уравнения линейной парной регрессии: Параметр b показывает среднее изменение результата y с изменением фактора x на единицу. Параметр a=y, когда x=0. Если x не может быть равен 0, то a не имеет экономического смысла. Интерпретировать можно только знак при а: если а>0, то относительное изменение результата происходит медленнее, чем изменение фактора, то есть вариация результата меньше вариации фактора: Vy

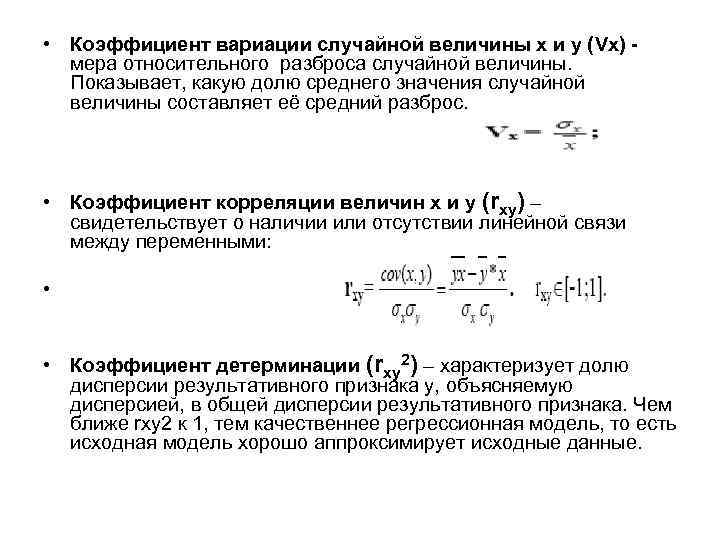

• Коэффициент вариации случайной величины x и y (Vx) мера относительного разброса случайной величины. Показывает, какую долю среднего значения случайной величины составляет её средний разброс. • Коэффициент корреляции величин x и y (rxy) – свидетельствует о наличии или отсутствии линейной связи между переменными: • • Коэффициент детерминации (rxy 2) – характеризует долю дисперсии результативного признака y, объясняемую дисперсией, в общей дисперсии результативного признака. Чем ближе rxy 2 к 1, тем качественнее регрессионная модель, то есть исходная модель хорошо аппроксимирует исходные данные.

• Коэффициент вариации случайной величины x и y (Vx) мера относительного разброса случайной величины. Показывает, какую долю среднего значения случайной величины составляет её средний разброс. • Коэффициент корреляции величин x и y (rxy) – свидетельствует о наличии или отсутствии линейной связи между переменными: • • Коэффициент детерминации (rxy 2) – характеризует долю дисперсии результативного признака y, объясняемую дисперсией, в общей дисперсии результативного признака. Чем ближе rxy 2 к 1, тем качественнее регрессионная модель, то есть исходная модель хорошо аппроксимирует исходные данные.

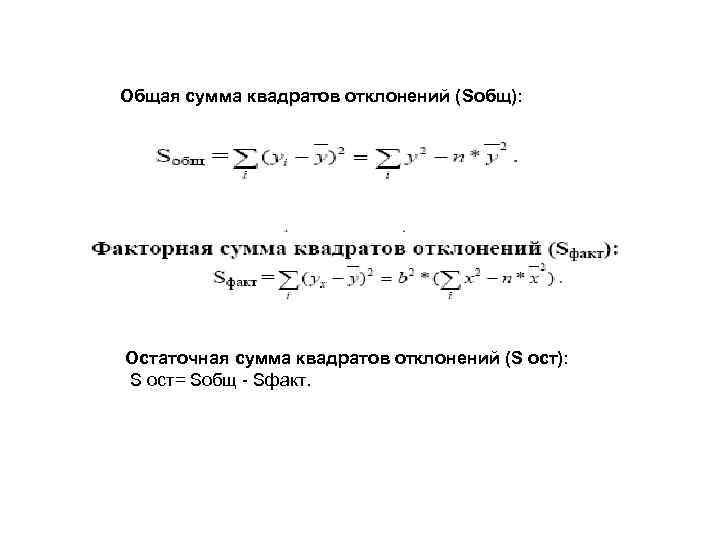

Общая сумма квадратов отклонений (Sобщ): Остаточная сумма квадратов отклонений (S ост): S ост= Sобщ - Sфакт.

Общая сумма квадратов отклонений (Sобщ): Остаточная сумма квадратов отклонений (S ост): S ост= Sобщ - Sфакт.

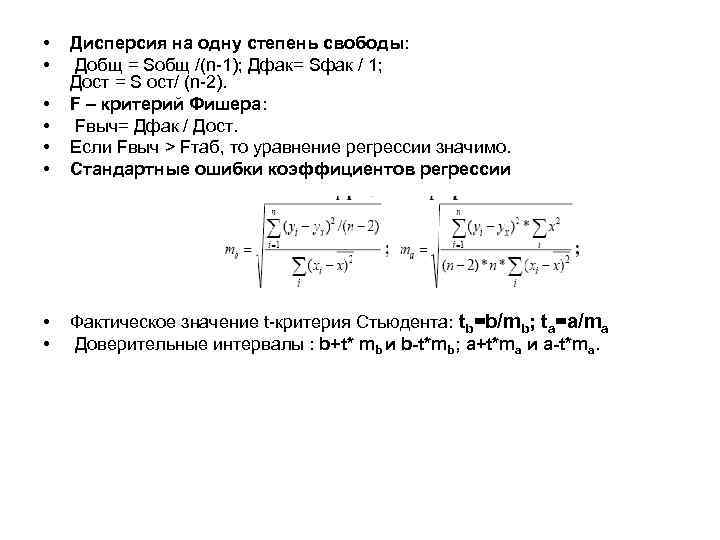

• • • Дисперсия на одну степень свободы: Добщ = Sобщ /(n-1); Дфак= Sфак / 1; Дост = S ост/ (n-2). F – критерий Фишера: Fвыч= Дфак / Дост. Если Fвыч > Fтаб, то уравнение регрессии значимо. Стандартные ошибки коэффициентов регрессии • • Фактическое значение t-критерия Стьюдента: tb=b/mb; ta=a/ma Доверительные интервалы : b+t* mb и b-t*mb; a+t*ma и a-t*ma.

• • • Дисперсия на одну степень свободы: Добщ = Sобщ /(n-1); Дфак= Sфак / 1; Дост = S ост/ (n-2). F – критерий Фишера: Fвыч= Дфак / Дост. Если Fвыч > Fтаб, то уравнение регрессии значимо. Стандартные ошибки коэффициентов регрессии • • Фактическое значение t-критерия Стьюдента: tb=b/mb; ta=a/ma Доверительные интервалы : b+t* mb и b-t*mb; a+t*ma и a-t*ma.

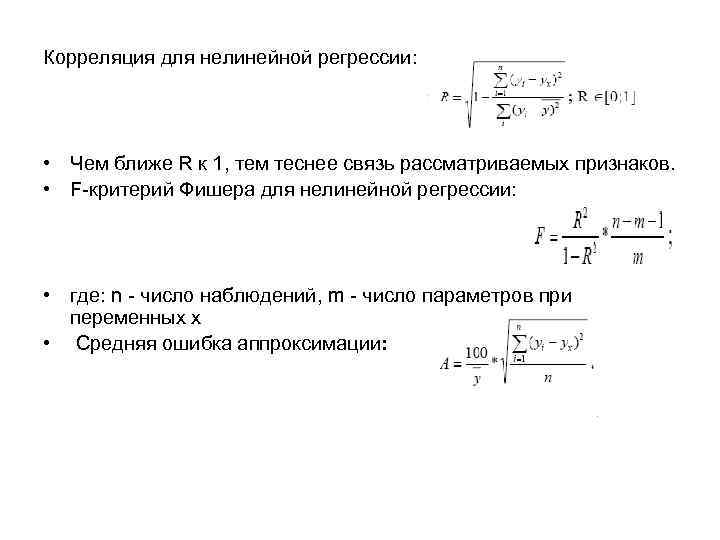

Корреляция для нелинейной регрессии: • Чем ближе R к 1, тем теснее связь рассматриваемых признаков. • F-критерий Фишера для нелинейной регрессии: • где: n - число наблюдений, m - число параметров при переменных х • Средняя ошибка аппроксимации:

Корреляция для нелинейной регрессии: • Чем ближе R к 1, тем теснее связь рассматриваемых признаков. • F-критерий Фишера для нелинейной регрессии: • где: n - число наблюдений, m - число параметров при переменных х • Средняя ошибка аппроксимации:

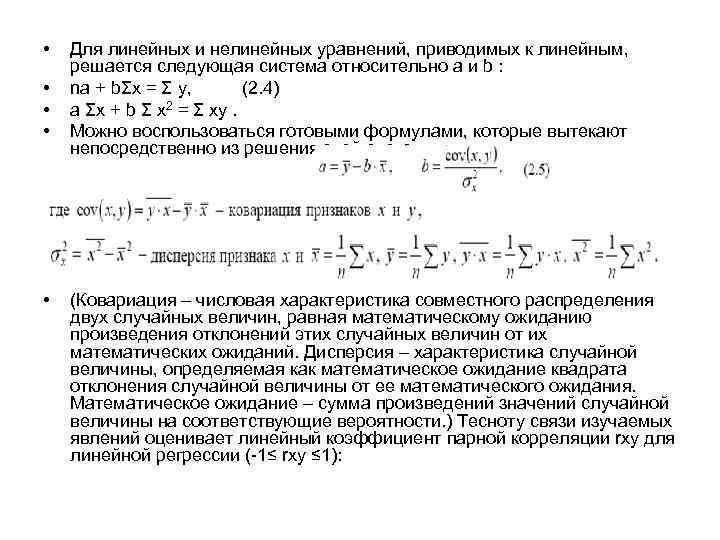

• • • Для линейных и нелинейных уравнений, приводимых к линейным, решается следующая система относительно a и b : na + bΣx = Σ y, (2. 4) a Σx + b Σ x 2 = Σ xy. Можно воспользоваться готовыми формулами, которые вытекают непосредственно из решения этой системы: (Ковариация – числовая характеристика совместного распределения двух случайных величин, равная математическому ожиданию произведения отклонений этих случайных величин от их математических ожиданий. Дисперсия – характеристика случайной величины, определяемая как математическое ожидание квадрата отклонения случайной величины от ее математического ожидания. Математическое ожидание – сумма произведений значений случайной величины на соответствующие вероятности. ) Тесноту связи изучаемых явлений оценивает линейный коэффициент парной корреляции rxy для линейной регрессии (-1≤ rxy ≤ 1):

• • • Для линейных и нелинейных уравнений, приводимых к линейным, решается следующая система относительно a и b : na + bΣx = Σ y, (2. 4) a Σx + b Σ x 2 = Σ xy. Можно воспользоваться готовыми формулами, которые вытекают непосредственно из решения этой системы: (Ковариация – числовая характеристика совместного распределения двух случайных величин, равная математическому ожиданию произведения отклонений этих случайных величин от их математических ожиданий. Дисперсия – характеристика случайной величины, определяемая как математическое ожидание квадрата отклонения случайной величины от ее математического ожидания. Математическое ожидание – сумма произведений значений случайной величины на соответствующие вероятности. ) Тесноту связи изучаемых явлений оценивает линейный коэффициент парной корреляции rxy для линейной регрессии (-1≤ rxy ≤ 1):

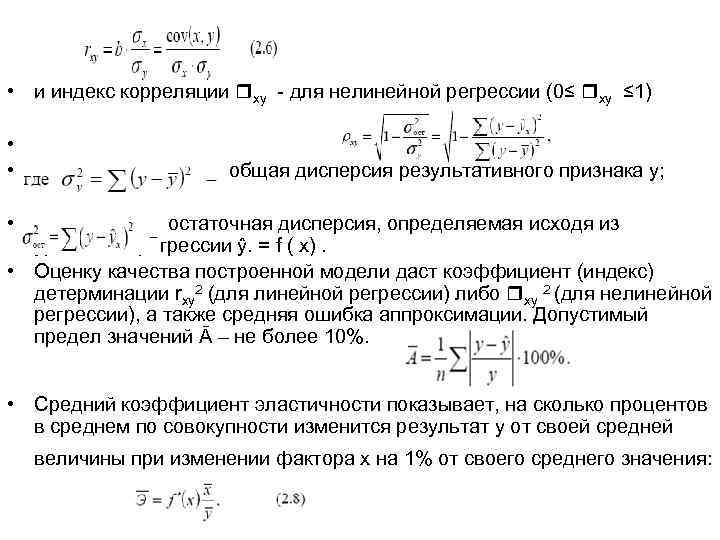

• и индекс корреляции xy - для нелинейной регрессии (0≤ xy ≤ 1) • • общая дисперсия результативного признака у; • остаточная дисперсия, определяемая исходя из уравнения регрессии ŷ. = f ( x). • Оценку качества построенной модели даст коэффициент (индекс) детерминации rxy 2 (для линейной регрессии) либо xy 2 (для нелинейной регрессии), а также средняя ошибка аппроксимации. Допустимый предел значений Ā – не более 10%. • Средний коэффициент эластичности показывает, на сколько процентов в среднем по совокупности изменится результат у от своей средней величины при изменении фактора x на 1% от своего среднего значения:

• и индекс корреляции xy - для нелинейной регрессии (0≤ xy ≤ 1) • • общая дисперсия результативного признака у; • остаточная дисперсия, определяемая исходя из уравнения регрессии ŷ. = f ( x). • Оценку качества построенной модели даст коэффициент (индекс) детерминации rxy 2 (для линейной регрессии) либо xy 2 (для нелинейной регрессии), а также средняя ошибка аппроксимации. Допустимый предел значений Ā – не более 10%. • Средний коэффициент эластичности показывает, на сколько процентов в среднем по совокупности изменится результат у от своей средней величины при изменении фактора x на 1% от своего среднего значения:

• • • После того как найдено уравнение линейной регрессии, проводится оценка значимости как уравнения в целом, так и отдельных его параметров. Проверить значимость уравнения регрессии – значит установить, соответствует ли математическая модель, выражающая зависимость между переменными, экспериментальным данным и достаточно ли включенных в уравнение объясняющих переменных (одной или нескольких) для описания зависимой переменной. Оценка значимости уравнения регрессии в целом производится на основе F-критерия Фишера, которому предшествует дисперсионный анализ. Согласно основной идее дисперсионного анализа, общая сумма квадратов отклонений переменной y от среднего значения y раскладывается на две части – «объясненную» и «необъясненную» : • где • – сумма квадратов отклонений, объясненная регрессией (или факторная сумма квадратов отклонений); • – остаточная сумма квадратов отклонений, характеризующая влияние неучтенных в модели факторов. общая сумма квадратов отклонений;

• • • После того как найдено уравнение линейной регрессии, проводится оценка значимости как уравнения в целом, так и отдельных его параметров. Проверить значимость уравнения регрессии – значит установить, соответствует ли математическая модель, выражающая зависимость между переменными, экспериментальным данным и достаточно ли включенных в уравнение объясняющих переменных (одной или нескольких) для описания зависимой переменной. Оценка значимости уравнения регрессии в целом производится на основе F-критерия Фишера, которому предшествует дисперсионный анализ. Согласно основной идее дисперсионного анализа, общая сумма квадратов отклонений переменной y от среднего значения y раскладывается на две части – «объясненную» и «необъясненную» : • где • – сумма квадратов отклонений, объясненная регрессией (или факторная сумма квадратов отклонений); • – остаточная сумма квадратов отклонений, характеризующая влияние неучтенных в модели факторов. общая сумма квадратов отклонений;

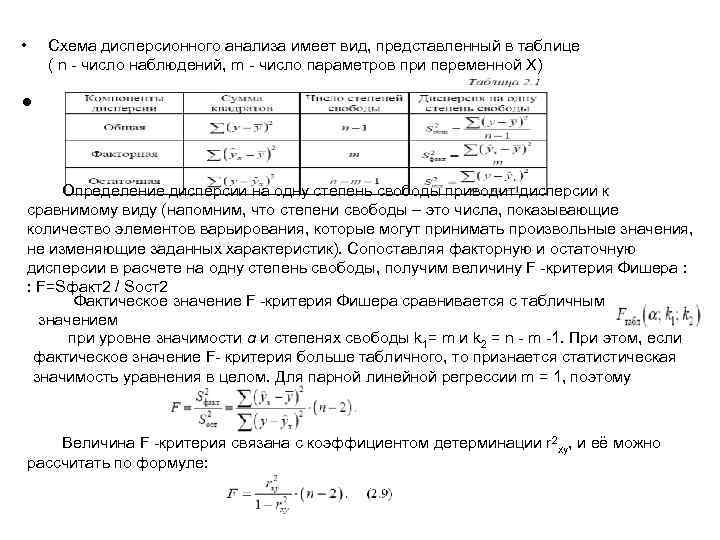

• Схема дисперсионного анализа имеет вид, представленный в таблице ( n - число наблюдений, m - число параметров при переменной Х) • Определение дисперсии на одну степень свободы приводит дисперсии к сравнимому виду (напомним, что степени свободы – это числа, показывающие количество элементов варьирования, которые могут принимать произвольные значения, не изменяющие заданных характеристик). Сопоставляя факторную и остаточную дисперсии в расчете на одну степень свободы, получим величину F -критерия Фишера : : F=Sфакт2 / Sост2 Фактическое значение F -критерия Фишера сравнивается с табличным значением при уровне значимости α и степенях свободы k 1= m и k 2 = n - m -1. При этом, если фактическое значение F- критерия больше табличного, то признается статистическая значимость уравнения в целом. Для парной линейной регрессии m = 1, поэтому Величина F -критерия связана с коэффициентом детерминации r 2 xy, и её можно рассчитать по формуле:

• Схема дисперсионного анализа имеет вид, представленный в таблице ( n - число наблюдений, m - число параметров при переменной Х) • Определение дисперсии на одну степень свободы приводит дисперсии к сравнимому виду (напомним, что степени свободы – это числа, показывающие количество элементов варьирования, которые могут принимать произвольные значения, не изменяющие заданных характеристик). Сопоставляя факторную и остаточную дисперсии в расчете на одну степень свободы, получим величину F -критерия Фишера : : F=Sфакт2 / Sост2 Фактическое значение F -критерия Фишера сравнивается с табличным значением при уровне значимости α и степенях свободы k 1= m и k 2 = n - m -1. При этом, если фактическое значение F- критерия больше табличного, то признается статистическая значимость уравнения в целом. Для парной линейной регрессии m = 1, поэтому Величина F -критерия связана с коэффициентом детерминации r 2 xy, и её можно рассчитать по формуле:

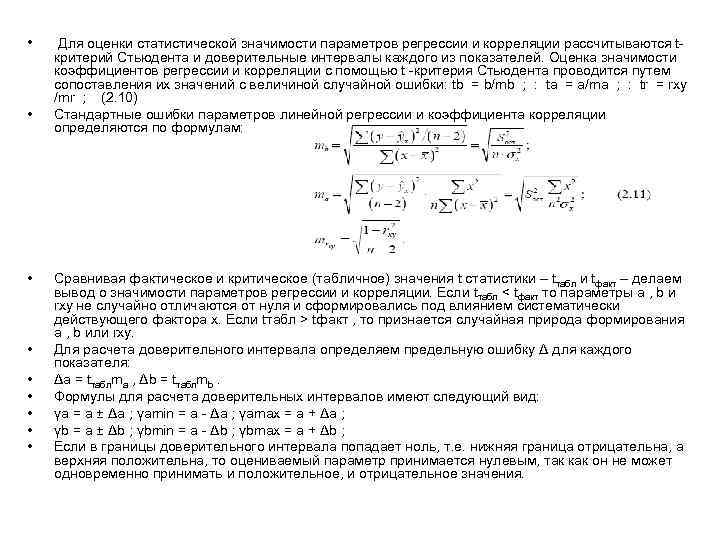

• • • Для оценки статистической значимости параметров регрессии и корреляции рассчитываются tкритерий Стьюдента и доверительные интервалы каждого из показателей. Оценка значимости коэффициентов регрессии и корреляции с помощью t -критерия Стьюдента проводится путем сопоставления их значений с величиной случайной ошибки: tb = b/mb ; : ta = a/ma ; : tr = rxy /mr ; (2. 10) Стандартные ошибки параметров линейной регрессии и коэффициента корреляции определяются по формулам: Сравнивая фактическое и критическое (табличное) значения t статистики – tтабл и tфакт – делаем вывод о значимости параметров регрессии и корреляции. Если tтабл < tфакт то параметры a , b и rxy не случайно отличаются от нуля и сформировались под влиянием систематически действующего фактора x. Если tтабл > tфакт , то признается случайная природа формирования a , b или rxy. Для расчета доверительного интервала определяем предельную ошибку Δ для каждого показателя: Δa = tтаблma , Δb = tтаблmb. Формулы для расчета доверительных интервалов имеют следующий вид: γa = a ± Δa ; γamin = a - Δa ; γamax = a + Δa ; γb = a ± Δb ; γbmin = a - Δb ; γbmax = a + Δb ; Если в границы доверительного интервала попадает ноль, т. е. нижняя граница отрицательна, а верхняя положительна, то оцениваемый параметр принимается нулевым, так как он не может одновременно принимать и положительное, и отрицательное значения.

• • • Для оценки статистической значимости параметров регрессии и корреляции рассчитываются tкритерий Стьюдента и доверительные интервалы каждого из показателей. Оценка значимости коэффициентов регрессии и корреляции с помощью t -критерия Стьюдента проводится путем сопоставления их значений с величиной случайной ошибки: tb = b/mb ; : ta = a/ma ; : tr = rxy /mr ; (2. 10) Стандартные ошибки параметров линейной регрессии и коэффициента корреляции определяются по формулам: Сравнивая фактическое и критическое (табличное) значения t статистики – tтабл и tфакт – делаем вывод о значимости параметров регрессии и корреляции. Если tтабл < tфакт то параметры a , b и rxy не случайно отличаются от нуля и сформировались под влиянием систематически действующего фактора x. Если tтабл > tфакт , то признается случайная природа формирования a , b или rxy. Для расчета доверительного интервала определяем предельную ошибку Δ для каждого показателя: Δa = tтаблma , Δb = tтаблmb. Формулы для расчета доверительных интервалов имеют следующий вид: γa = a ± Δa ; γamin = a - Δa ; γamax = a + Δa ; γb = a ± Δb ; γbmin = a - Δb ; γbmax = a + Δb ; Если в границы доверительного интервала попадает ноль, т. е. нижняя граница отрицательна, а верхняя положительна, то оцениваемый параметр принимается нулевым, так как он не может одновременно принимать и положительное, и отрицательное значения.

• Если в границы доверительного интервала попадает ноль, т. е. нижняя граница отрицательна, а верхняя положительна, то оцениваемый параметр принимается нулевым, так как он не может одновременно принимать и положительное, и отрицательное значения. • Существует связь между t -критерием Стьюдента и F – критерием Фишера: • В прогнозных расчётах по уравнению регрессии определяется предсказываемое индивидуальное значение y 0 как точечный прогноз при x = x 0, т. е. путем подстановки в линейное уравнение ŷx = a + b. x соответствующего значения x. Однако точечный прогноз явно нереален, поэтому он дополняется расчетом стандартной ошибки • где , и построением доверительного интервала прогнозного значения y*0:

• Если в границы доверительного интервала попадает ноль, т. е. нижняя граница отрицательна, а верхняя положительна, то оцениваемый параметр принимается нулевым, так как он не может одновременно принимать и положительное, и отрицательное значения. • Существует связь между t -критерием Стьюдента и F – критерием Фишера: • В прогнозных расчётах по уравнению регрессии определяется предсказываемое индивидуальное значение y 0 как точечный прогноз при x = x 0, т. е. путем подстановки в линейное уравнение ŷx = a + b. x соответствующего значения x. Однако точечный прогноз явно нереален, поэтому он дополняется расчетом стандартной ошибки • где , и построением доверительного интервала прогнозного значения y*0:

• Вопросы для обсуждения: • 1. Объясните, чем вызвано появление в модели парной регрессии стохастической переменной ε ? • 2. Почему перед построением модели парной линейной регрессии необходимо рассчитывать коэффициент корреляции? • 3. Объясните смысл понятия «число степеней свободы» . • 4. По каким вычислениям можно судить о значимости модели в целом? • 5. Зачем необходимо рассчитывать t-критерий Стьюдента? • 6. Зачем необходимо оценивать интервалы прогноза по линейному уравнению регрессии? • 7. В каких пределах должна находиться ошибка аппроксимации, чтобы можно было сделать вывод о хорошем подборе модели к исходным данным?

• Вопросы для обсуждения: • 1. Объясните, чем вызвано появление в модели парной регрессии стохастической переменной ε ? • 2. Почему перед построением модели парной линейной регрессии необходимо рассчитывать коэффициент корреляции? • 3. Объясните смысл понятия «число степеней свободы» . • 4. По каким вычислениям можно судить о значимости модели в целом? • 5. Зачем необходимо рассчитывать t-критерий Стьюдента? • 6. Зачем необходимо оценивать интервалы прогноза по линейному уравнению регрессии? • 7. В каких пределах должна находиться ошибка аппроксимации, чтобы можно было сделать вывод о хорошем подборе модели к исходным данным?