ЛекцииТОИ-БИ.ppt

- Количество слайдов: 190

Российский государственный университет им. И. Канта Факультет информатики и прикладной математики Кафедра компьютерного моделирования и информационных систем ТЕОРЕТИЧЕСКИЕ ОСНОВЫ ИНФОРМАТИКИ Александр Васильевич Колесников доктор технических наук, профессор Калининград, 2010

Российский государственный университет им. И. Канта Факультет информатики и прикладной математики Кафедра компьютерного моделирования и информационных систем ТЕОРЕТИЧЕСКИЕ ОСНОВЫ ИНФОРМАТИКИ Александр Васильевич Колесников доктор технических наук, профессор Калининград, 2010

Понятие информатики Информатика - научная дисциплина, изучающая вопросы поиска, сбора, хранения, преобразования и использования информации в различных сферах человеческой деятельности.

Понятие информатики Информатика - научная дисциплина, изучающая вопросы поиска, сбора, хранения, преобразования и использования информации в различных сферах человеческой деятельности.

Структура современной информатики Рассмотрим составные части «ядра» самостоятельные научные дисциплины. информатики - относительно Теоретическая информатика - часть информатики, включающая математические разделы: теория алгоритмов и автоматов, теория информации и теория кодирования, теория формальных языков и грамматик, исследование операций, искусственный интеллект. Эта часть информатики использует математические методы для изучения процессов обработки информации. Вычислительная техника - раздел, в котором разрабатываются общие принципы построения архитектур вычислительных систем. Примеры классических решений – фон-Неймановская архитектура компьютеров первых поколений, шинная архитектура ЭВМ старших поколений, архитектура параллельной (многопроцессорной) обработки информации.

Структура современной информатики Рассмотрим составные части «ядра» самостоятельные научные дисциплины. информатики - относительно Теоретическая информатика - часть информатики, включающая математические разделы: теория алгоритмов и автоматов, теория информации и теория кодирования, теория формальных языков и грамматик, исследование операций, искусственный интеллект. Эта часть информатики использует математические методы для изучения процессов обработки информации. Вычислительная техника - раздел, в котором разрабатываются общие принципы построения архитектур вычислительных систем. Примеры классических решений – фон-Неймановская архитектура компьютеров первых поколений, шинная архитектура ЭВМ старших поколений, архитектура параллельной (многопроцессорной) обработки информации.

Структура современной информатики Программирование - деятельность, связанная с разработкой системного (алгоритмические языки и компиляторы, интерфейсы, ОС) и прикладного (редакторы текстов, машинная графика, СУБД) программного обеспечения. Информационные системы - раздел информатики, связанный с анализом потоков информации в сложных системах, их оптимизацией, структурированием, принципами хранения и поиска информации. Искусственный интеллект - область информатики, изучающая вычисления, позволяющие чувствовать, рассуждать и действовать. Основные направления разработок - моделирование рассуждений, компьютерная лингвистика, машинный перевод, создание экспертных систем, распознавание образов и другие.

Структура современной информатики Программирование - деятельность, связанная с разработкой системного (алгоритмические языки и компиляторы, интерфейсы, ОС) и прикладного (редакторы текстов, машинная графика, СУБД) программного обеспечения. Информационные системы - раздел информатики, связанный с анализом потоков информации в сложных системах, их оптимизацией, структурированием, принципами хранения и поиска информации. Искусственный интеллект - область информатики, изучающая вычисления, позволяющие чувствовать, рассуждать и действовать. Основные направления разработок - моделирование рассуждений, компьютерная лингвистика, машинный перевод, создание экспертных систем, распознавание образов и другие.

Определение понятия «информация» Слово «информация» (от лат. «сообщение» , «разъяснение» ) - основополагающий термин информатики. Впервые введен в книге Н. Винера «Кибернетика» . В узком смысле - "количество информации". Информация - это содержание сообщения, сигнала, памяти, а также сведения, содержащиеся в сообщении, сигнале или памяти. Информация - сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределённости , неполноты знаний.

Определение понятия «информация» Слово «информация» (от лат. «сообщение» , «разъяснение» ) - основополагающий термин информатики. Впервые введен в книге Н. Винера «Кибернетика» . В узком смысле - "количество информации". Информация - это содержание сообщения, сигнала, памяти, а также сведения, содержащиеся в сообщении, сигнале или памяти. Информация - сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределённости , неполноты знаний.

Понятие информации В 1948 году К. Шеннон, закладывая основы теории связи предложил определять информацию с точки зрения обмена данными между источником и приемником. Клод Элвуд Шеннон, американский математик, инженер, доктор наук, профессор, основатель теории информации Данные (от лат. data) — представление фактов и идей в формализованном виде, пригодном для передачи и обработки в некотором информационном процессе.

Понятие информации В 1948 году К. Шеннон, закладывая основы теории связи предложил определять информацию с точки зрения обмена данными между источником и приемником. Клод Элвуд Шеннон, американский математик, инженер, доктор наук, профессор, основатель теории информации Данные (от лат. data) — представление фактов и идей в формализованном виде, пригодном для передачи и обработки в некотором информационном процессе.

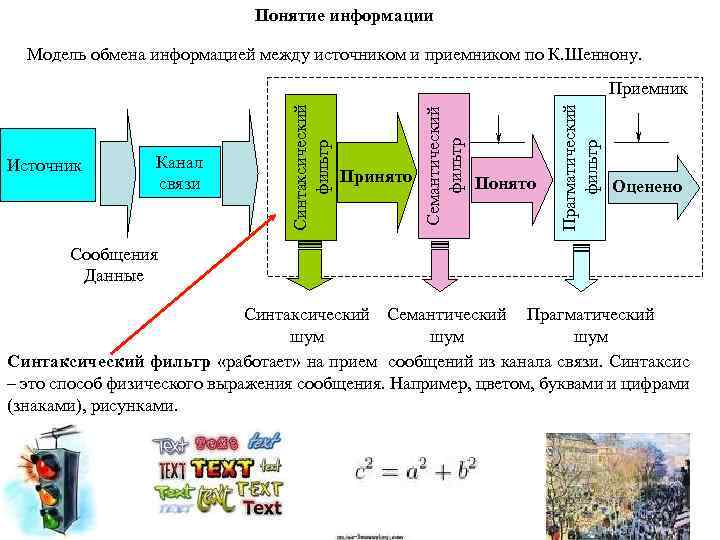

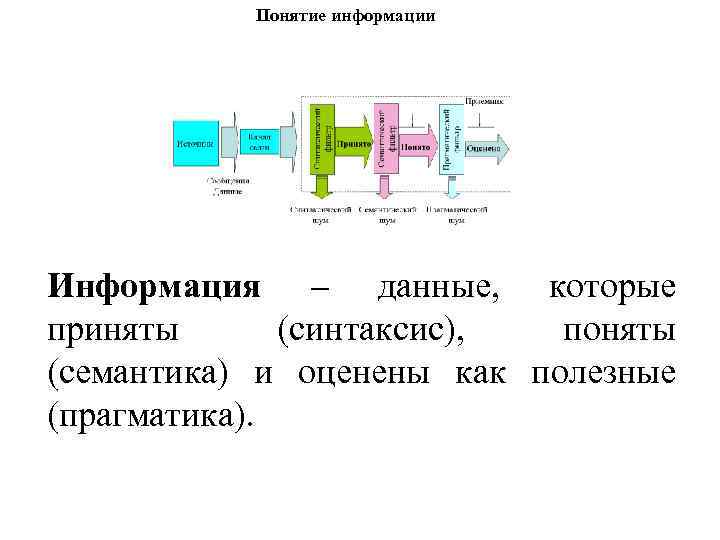

Понятие информации Модель обмена информацией между источником и приемником по К. Шеннону. Принято Понято Прагматический фильтр Канал связи Семантический фильтр Источник Синтаксический фильтр Приемник Оценено Сообщения Данные Синтаксический Семантический Прагматический шум шум Синтаксический фильтр «работает» на прием сообщений из канала связи. Синтаксис – это способ физического выражения сообщения. Например, цветом, буквами и цифрами (знаками), рисунками.

Понятие информации Модель обмена информацией между источником и приемником по К. Шеннону. Принято Понято Прагматический фильтр Канал связи Семантический фильтр Источник Синтаксический фильтр Приемник Оценено Сообщения Данные Синтаксический Семантический Прагматический шум шум Синтаксический фильтр «работает» на прием сообщений из канала связи. Синтаксис – это способ физического выражения сообщения. Например, цветом, буквами и цифрами (знаками), рисунками.

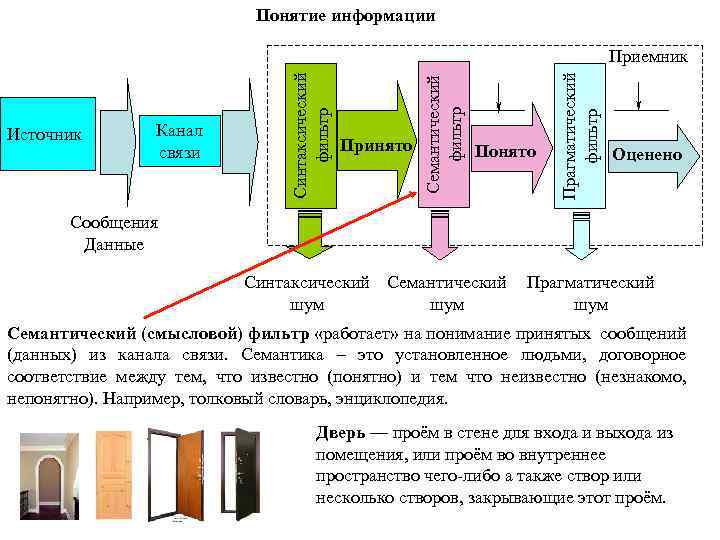

Понятие информации Принято Понято Прагматический фильтр Канал связи Семантический фильтр Источник Синтаксический фильтр Приемник Оценено Сообщения Данные Синтаксический Семантический Прагматический шум шум Семантический (смысловой) фильтр «работает» на понимание принятых сообщений (данных) из канала связи. Семантика – это установленное людьми, договорное соответствие между тем, что известно (понятно) и тем что неизвестно (незнакомо, непонятно). Например, толковый словарь, энциклопедия. Дверь — проём в стене для входа и выхода из помещения, или проём во внутреннее пространство чего-либо а также створ или несколько створов, закрывающие этот проём.

Понятие информации Принято Понято Прагматический фильтр Канал связи Семантический фильтр Источник Синтаксический фильтр Приемник Оценено Сообщения Данные Синтаксический Семантический Прагматический шум шум Семантический (смысловой) фильтр «работает» на понимание принятых сообщений (данных) из канала связи. Семантика – это установленное людьми, договорное соответствие между тем, что известно (понятно) и тем что неизвестно (незнакомо, непонятно). Например, толковый словарь, энциклопедия. Дверь — проём в стене для входа и выхода из помещения, или проём во внутреннее пространство чего-либо а также створ или несколько створов, закрывающие этот проём.

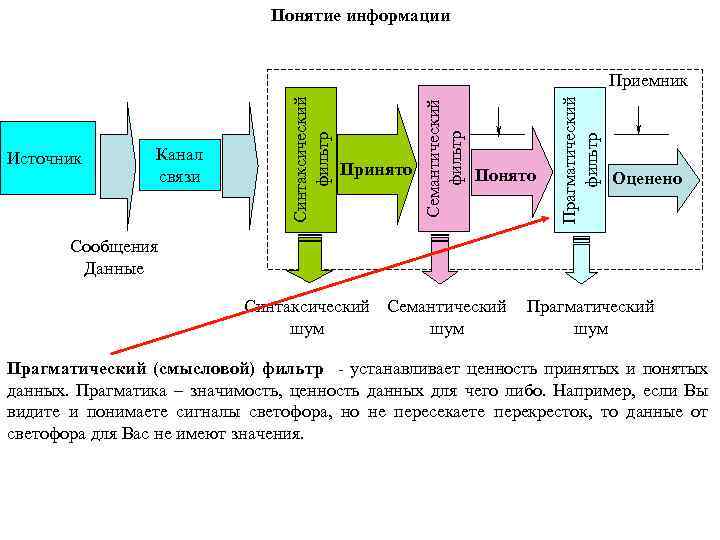

Понятие информации Принято Понято Прагматический фильтр Канал связи Семантический фильтр Источник Синтаксический фильтр Приемник Оценено Сообщения Данные Синтаксический Семантический Прагматический шум шум Прагматический (смысловой) фильтр - устанавливает ценность принятых и понятых данных. Прагматика – значимость, ценность данных для чего либо. Например, если Вы видите и понимаете сигналы светофора, но не пересекаете перекресток, то данные от светофора для Вас не имеют значения.

Понятие информации Принято Понято Прагматический фильтр Канал связи Семантический фильтр Источник Синтаксический фильтр Приемник Оценено Сообщения Данные Синтаксический Семантический Прагматический шум шум Прагматический (смысловой) фильтр - устанавливает ценность принятых и понятых данных. Прагматика – значимость, ценность данных для чего либо. Например, если Вы видите и понимаете сигналы светофора, но не пересекаете перекресток, то данные от светофора для Вас не имеют значения.

Понятие информации Информация – данные, которые приняты (синтаксис), поняты (семантика) и оценены как полезные (прагматика).

Понятие информации Информация – данные, которые приняты (синтаксис), поняты (семантика) и оценены как полезные (прагматика).

Пирамида знаний Мудрость Метазнания Способность использовать знания наилучшим образом Знания о знаниях Знания Способность использовать информацию Информация Потенциальный источник знаний Данные Шум Потенциальный источник информации Отсутствие видимых признаков информации «Чтобы тратить деньги с умом, нужно потратиться хорошо на ум. Леонид Сухоруков» . «Два – это число четное» . «Если x – число четное, то x + 2 – число четное» .

Пирамида знаний Мудрость Метазнания Способность использовать знания наилучшим образом Знания о знаниях Знания Способность использовать информацию Информация Потенциальный источник знаний Данные Шум Потенциальный источник информации Отсутствие видимых признаков информации «Чтобы тратить деньги с умом, нужно потратиться хорошо на ум. Леонид Сухоруков» . «Два – это число четное» . «Если x – число четное, то x + 2 – число четное» .

Меры информации Количество информации - числовая величина, адекватно характеризующая актуализируемую информацию по разнообразию, сложности, структурированности (упорядоченности), определенности, выбору состояний отображаемой системы. Точная наука невозможна без измерений. Для измерений необходимы опорные метки — меры. Чтобы стать общепринятыми, они должны быть простыми, понятными и общедоступными. Мера количества информации – то с помощью чего измеряют информацию.

Меры информации Количество информации - числовая величина, адекватно характеризующая актуализируемую информацию по разнообразию, сложности, структурированности (упорядоченности), определенности, выбору состояний отображаемой системы. Точная наука невозможна без измерений. Для измерений необходимы опорные метки — меры. Чтобы стать общепринятыми, они должны быть простыми, понятными и общедоступными. Мера количества информации – то с помощью чего измеряют информацию.

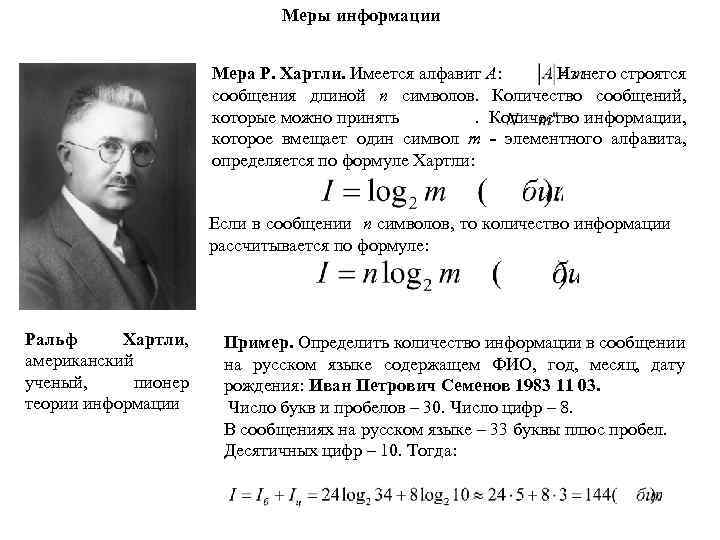

Меры информации Мера Р. Хартли. Имеется алфавит A: . Из него строятся сообщения длиной n символов. Количество сообщений, которые можно принять . Количество информации, которое вмещает один символ m - элементного алфавита, определяется по формуле Хартли: Если в сообщении n символов, то количество информации рассчитывается по формуле: Ральф Хартли, американский ученый, пионер теории информации Пример. Определить количество информации в сообщении на русском языке содержащем ФИО, год, месяц, дату рождения: Иван Петрович Семенов 1983 11 03. Число букв и пробелов – 30. Число цифр – 8. В сообщениях на русском языке – 33 буквы плюс пробел. Десятичных цифр – 10. Тогда:

Меры информации Мера Р. Хартли. Имеется алфавит A: . Из него строятся сообщения длиной n символов. Количество сообщений, которые можно принять . Количество информации, которое вмещает один символ m - элементного алфавита, определяется по формуле Хартли: Если в сообщении n символов, то количество информации рассчитывается по формуле: Ральф Хартли, американский ученый, пионер теории информации Пример. Определить количество информации в сообщении на русском языке содержащем ФИО, год, месяц, дату рождения: Иван Петрович Семенов 1983 11 03. Число букв и пробелов – 30. Число цифр – 8. В сообщениях на русском языке – 33 буквы плюс пробел. Десятичных цифр – 10. Тогда:

Меры информации Мера Хартли Поскольку измерения можно делать в различных системах, то формула Хартли для одного символа алфавита имеет вид: где k – коэффициент пропорциональности (масштабирования). Если измерение в экспоненциальной системе, то k = 1, H = ln m (нат); Если измерение в двоичной системе, то k = 1/ ln 2 = 1, 43; (бит); Если измерение в десятичной системе, то k = 1/ln 10 =0, 43; H = lg m (дит). Формула Хартли отвлечена от семантических и качественных свойств информации. Это положительная сторона формулы. Но имеется и минус: формула не учитывает вероятность появления символа в сообщении. Вероя тность — численная мера возможности наступления события. На практике вероятность события — это отношение количества тех наблюдений, при которых рассматриваемое событие наступило, к общему количеству наблюдений. Такая трактовка допустима при достаточно большого количества наблюдений.

Меры информации Мера Хартли Поскольку измерения можно делать в различных системах, то формула Хартли для одного символа алфавита имеет вид: где k – коэффициент пропорциональности (масштабирования). Если измерение в экспоненциальной системе, то k = 1, H = ln m (нат); Если измерение в двоичной системе, то k = 1/ ln 2 = 1, 43; (бит); Если измерение в десятичной системе, то k = 1/ln 10 =0, 43; H = lg m (дит). Формула Хартли отвлечена от семантических и качественных свойств информации. Это положительная сторона формулы. Но имеется и минус: формула не учитывает вероятность появления символа в сообщении. Вероя тность — численная мера возможности наступления события. На практике вероятность события — это отношение количества тех наблюдений, при которых рассматриваемое событие наступило, к общему количеству наблюдений. Такая трактовка допустима при достаточно большого количества наблюдений.

Меры информации Мера К. Шеннона Мера К. Шеннона учитывает вероятность появления символа в сообщении. Мало информации Много информации Повседневный опыт подсказывает, что часто происходящие события, дают нам мало информации. Возьмем, сообщение «студенты внимательны на лекции» . Это привычное известие не привлекло бы к себе никакого внимания, в то время, как сообщение «студент доказал теорему» университетская газеты напечатала бы крупным шрифтом. Вывод: частые, ожидаемые события несут мало информации и, наоборот, редкие, т. е. неожиданные события, обладают высоким информационным содержанием. Следовательно, информация (I) и вероятность (p) находятся в обратно пропорциональной зависимости.

Меры информации Мера К. Шеннона Мера К. Шеннона учитывает вероятность появления символа в сообщении. Мало информации Много информации Повседневный опыт подсказывает, что часто происходящие события, дают нам мало информации. Возьмем, сообщение «студенты внимательны на лекции» . Это привычное известие не привлекло бы к себе никакого внимания, в то время, как сообщение «студент доказал теорему» университетская газеты напечатала бы крупным шрифтом. Вывод: частые, ожидаемые события несут мало информации и, наоборот, редкие, т. е. неожиданные события, обладают высоким информационным содержанием. Следовательно, информация (I) и вероятность (p) находятся в обратно пропорциональной зависимости.

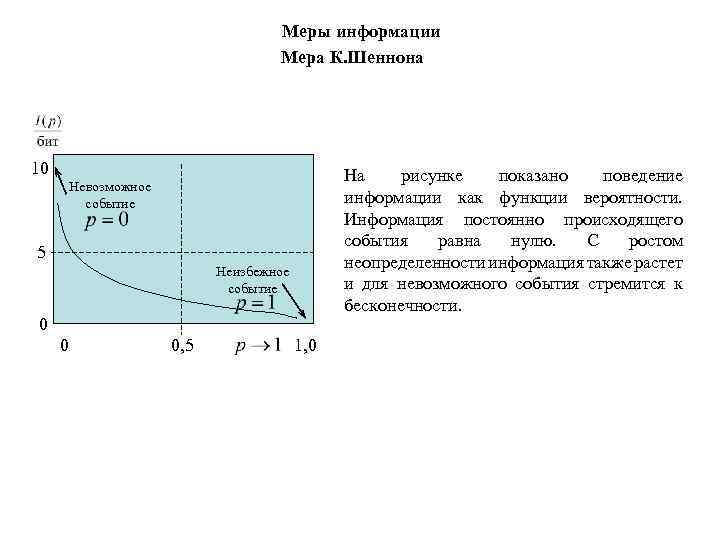

Меры информации Мера К. Шеннона 10 На рисунке показано поведение информации как функции вероятности. Информация постоянно происходящего события равна нулю. С ростом неопределенности информация также растет и для невозможного события стремится к бесконечности. Невозможное событие 5 Неизбежное событие 0 0 0, 5 1, 0

Меры информации Мера К. Шеннона 10 На рисунке показано поведение информации как функции вероятности. Информация постоянно происходящего события равна нулю. С ростом неопределенности информация также растет и для невозможного события стремится к бесконечности. Невозможное событие 5 Неизбежное событие 0 0 0, 5 1, 0

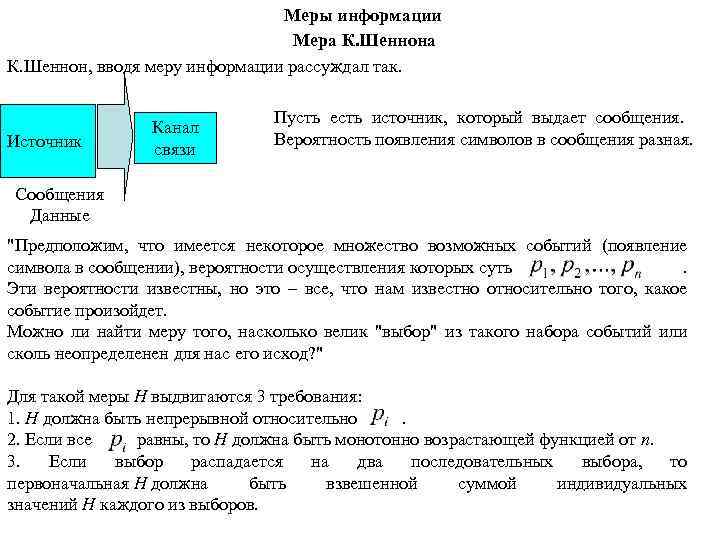

Меры информации Мера К. Шеннон, вводя меру информации рассуждал так. Источник Канал связи Пусть есть источник, который выдает сообщения. Вероятность появления символов в сообщения разная. Сообщения Данные "Предположим, что имеется некоторое множество возможных событий (появление символа в сообщении), вероятности осуществления которых суть . Эти вероятности известны, но это – все, что нам известно относительно того, какое событие произойдет. Можно ли найти меру того, насколько велик "выбор" из такого набора событий или сколь неопределенен для нас его исход? " Для такой меры Н выдвигаются 3 требования: 1. Н должна быть непрерывной относительно . 2. Если все равны, то Н должна быть монотонно возрастающей функцией от n. 3. Если выбор распадается на два последовательных выбора, то первоначальная Н должна быть взвешенной суммой индивидуальных значений Н каждого из выборов.

Меры информации Мера К. Шеннон, вводя меру информации рассуждал так. Источник Канал связи Пусть есть источник, который выдает сообщения. Вероятность появления символов в сообщения разная. Сообщения Данные "Предположим, что имеется некоторое множество возможных событий (появление символа в сообщении), вероятности осуществления которых суть . Эти вероятности известны, но это – все, что нам известно относительно того, какое событие произойдет. Можно ли найти меру того, насколько велик "выбор" из такого набора событий или сколь неопределенен для нас его исход? " Для такой меры Н выдвигаются 3 требования: 1. Н должна быть непрерывной относительно . 2. Если все равны, то Н должна быть монотонно возрастающей функцией от n. 3. Если выбор распадается на два последовательных выбора, то первоначальная Н должна быть взвешенной суммой индивидуальных значений Н каждого из выборов.

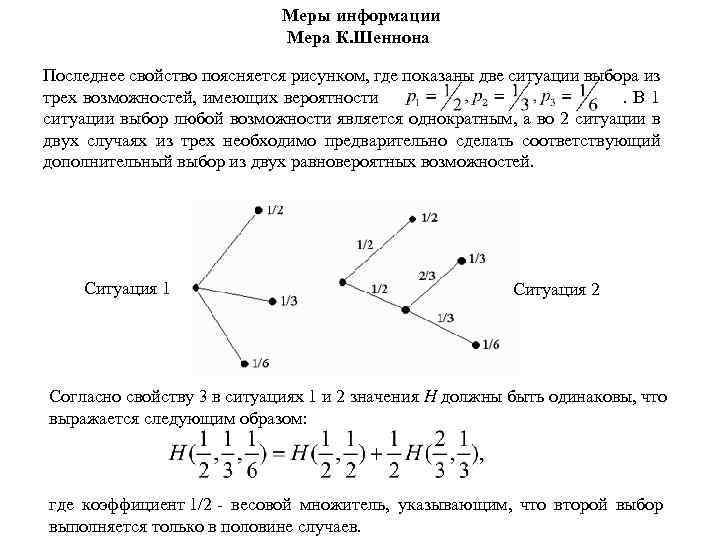

Меры информации Мера К. Шеннона Последнее свойство поясняется рисунком, где показаны две ситуации выбора из трех возможностей, имеющих вероятности . В 1 ситуации выбор любой возможности является однократным, а во 2 ситуации в двух случаях из трех необходимо предварительно сделать соответствующий дополнительный выбор из двух равновероятных возможностей. Ситуация 1 Ситуация 2 Согласно свойству 3 в ситуациях 1 и 2 значения Н должны быть одинаковы, что выражается следующим образом: где коэффициент 1/2 - весовой множитель, указывающим, что второй выбор выполняется только в половине случаев.

Меры информации Мера К. Шеннона Последнее свойство поясняется рисунком, где показаны две ситуации выбора из трех возможностей, имеющих вероятности . В 1 ситуации выбор любой возможности является однократным, а во 2 ситуации в двух случаях из трех необходимо предварительно сделать соответствующий дополнительный выбор из двух равновероятных возможностей. Ситуация 1 Ситуация 2 Согласно свойству 3 в ситуациях 1 и 2 значения Н должны быть одинаковы, что выражается следующим образом: где коэффициент 1/2 - весовой множитель, указывающим, что второй выбор выполняется только в половине случаев.

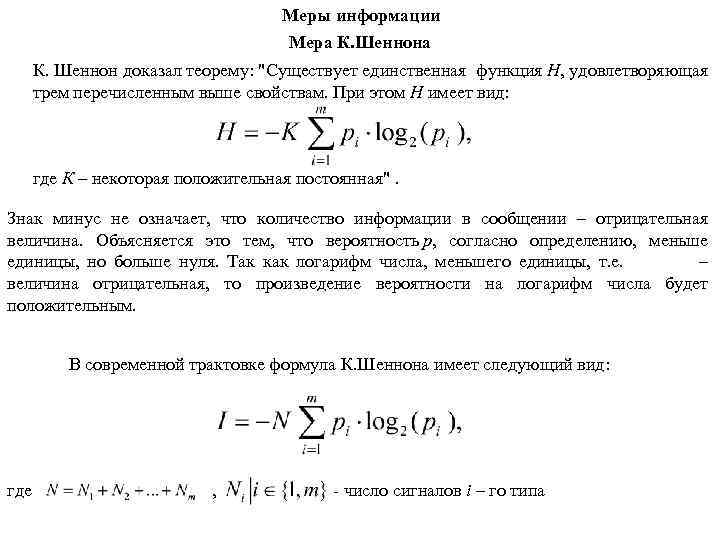

Меры информации Мера К. Шеннон доказал теорему: "Существует единственная функция Н, удовлетворяющая трем перечисленным выше свойствам. При этом Н имеет вид: где К – некоторая положительная постоянная". Знак минус не означает, что количество информации в сообщении – отрицательная величина. Объясняется это тем, что вероятность р, согласно определению, меньше единицы, но больше нуля. Так как логарифм числа, меньшего единицы, т. е. – величина отрицательная, то произведение вероятности на логарифм числа будет положительным. В современной трактовке формула К. Шеннона имеет следующий вид: где , - число сигналов i – го типа

Меры информации Мера К. Шеннон доказал теорему: "Существует единственная функция Н, удовлетворяющая трем перечисленным выше свойствам. При этом Н имеет вид: где К – некоторая положительная постоянная". Знак минус не означает, что количество информации в сообщении – отрицательная величина. Объясняется это тем, что вероятность р, согласно определению, меньше единицы, но больше нуля. Так как логарифм числа, меньшего единицы, т. е. – величина отрицательная, то произведение вероятности на логарифм числа будет положительным. В современной трактовке формула К. Шеннона имеет следующий вид: где , - число сигналов i – го типа

Меры информации Мера Шеннона Чтобы определить среднее количество информации, приходящееся на один сигнал, т. е. удельную информативность источника, нужно это число разделить на N. При неограниченном росте приблизительное равенство перейдет в точное. В результате будет получено асимптотическое соотношение – формула Шеннона: Формула, предложенная Хартли, представляет собой частный случай более общей формулы Шеннона. Если в формуле Шеннона принять, что , то:

Меры информации Мера Шеннона Чтобы определить среднее количество информации, приходящееся на один сигнал, т. е. удельную информативность источника, нужно это число разделить на N. При неограниченном росте приблизительное равенство перейдет в точное. В результате будет получено асимптотическое соотношение – формула Шеннона: Формула, предложенная Хартли, представляет собой частный случай более общей формулы Шеннона. Если в формуле Шеннона принять, что , то:

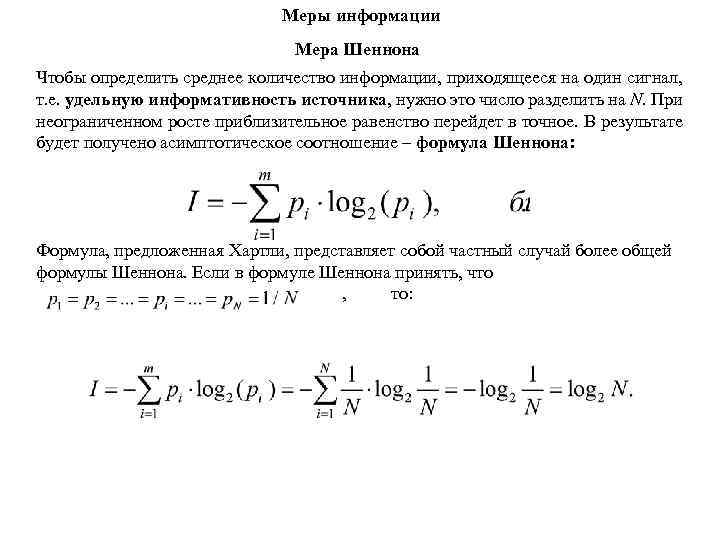

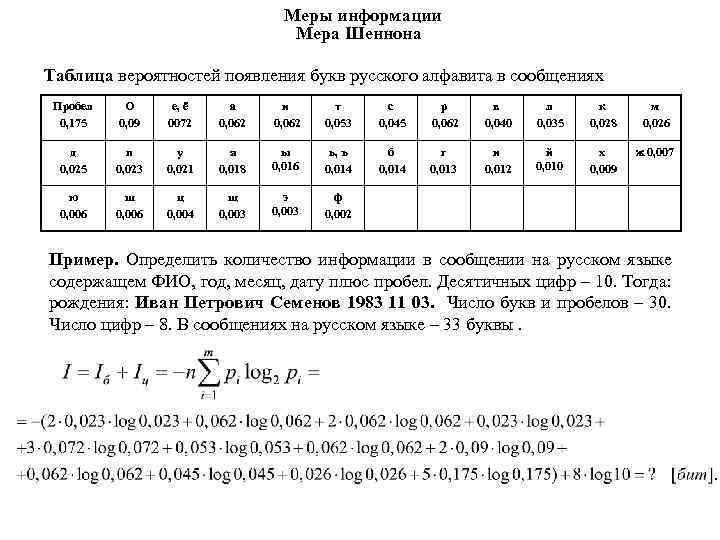

Меры информации Мера Шеннона Таблица вероятностей появления букв русского алфавита в сообщениях Пробел 0, 175 О 0, 09 е, ё 0072 а 0, 062 и 0, 062 т 0, 053 с 0, 045 р 0, 062 в 0, 040 л 0, 035 к 0, 028 м 0, 026 д 0, 025 п 0, 023 у 0, 021 я 0, 018 ы 0, 016 ь, ъ 0, 014 б 0, 014 г 0, 013 и 0, 012 й 0, 010 х 0, 009 ж 0, 007 ю 0, 006 ш 0, 006 ц 0, 004 щ 0, 003 э 0, 003 ф 0, 002 Пример. Определить количество информации в сообщении на русском языке содержащем ФИО, год, месяц, дату плюс пробел. Десятичных цифр – 10. Тогда: рождения: Иван Петрович Семенов 1983 11 03. Число букв и пробелов – 30. Число цифр – 8. В сообщениях на русском языке – 33 буквы.

Меры информации Мера Шеннона Таблица вероятностей появления букв русского алфавита в сообщениях Пробел 0, 175 О 0, 09 е, ё 0072 а 0, 062 и 0, 062 т 0, 053 с 0, 045 р 0, 062 в 0, 040 л 0, 035 к 0, 028 м 0, 026 д 0, 025 п 0, 023 у 0, 021 я 0, 018 ы 0, 016 ь, ъ 0, 014 б 0, 014 г 0, 013 и 0, 012 й 0, 010 х 0, 009 ж 0, 007 ю 0, 006 ш 0, 006 ц 0, 004 щ 0, 003 э 0, 003 ф 0, 002 Пример. Определить количество информации в сообщении на русском языке содержащем ФИО, год, месяц, дату плюс пробел. Десятичных цифр – 10. Тогда: рождения: Иван Петрович Семенов 1983 11 03. Число букв и пробелов – 30. Число цифр – 8. В сообщениях на русском языке – 33 буквы.

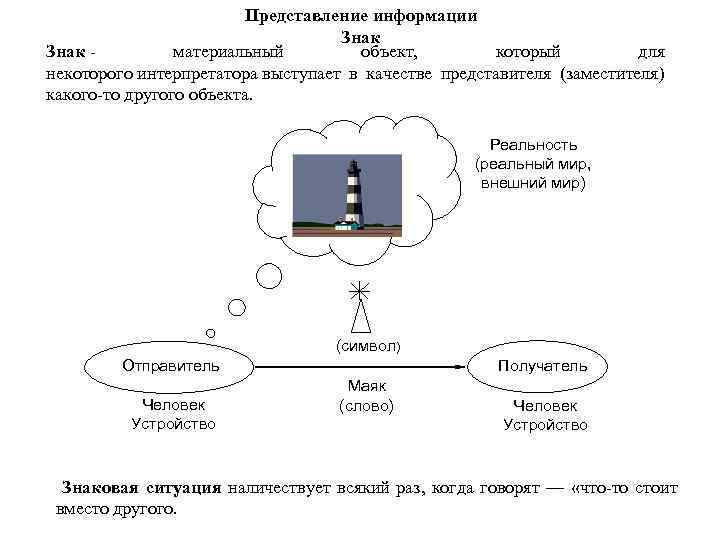

Представление информации Знак - материальный объект, который для некоторого интерпретатора выступает в качестве представителя (заместителя) какого-то другого объекта. Реальность (реальный мир, внешний мир) (символ) Отправитель Человек Устройство Получатель Маяк (слово) Человек Устройство Знаковая ситуация наличествует всякий раз, когда говорят — «что-то стоит вместо другого.

Представление информации Знак - материальный объект, который для некоторого интерпретатора выступает в качестве представителя (заместителя) какого-то другого объекта. Реальность (реальный мир, внешний мир) (символ) Отправитель Человек Устройство Получатель Маяк (слово) Человек Устройство Знаковая ситуация наличествует всякий раз, когда говорят — «что-то стоит вместо другого.

Знаковая система — совокупность условных знаков и правил их взаимосвязи. Это мощный инструмент решения задач. Чтобы задать знаковую систему необходимо: 1) определить набор базисных знаков, придавая каждому из них какое-то определенное значение; 2) сформулировать правила, определяющие какие производные знаки, построенные из нашего набора знаков корректные, а какие — нет. Набор таких правил - это грамматика знаковой системы. Высказывание в терминах знаковой системы, может содержать определенный смысл. Если субъекту известны правила прочтения знаков этой системы, то эти записи могут быть восприняты им, и могут сформировать соответствующую мысль. Примеры знаковых систем Язык. Система счисления. Музыка. Религия. Мода.

Знаковая система — совокупность условных знаков и правил их взаимосвязи. Это мощный инструмент решения задач. Чтобы задать знаковую систему необходимо: 1) определить набор базисных знаков, придавая каждому из них какое-то определенное значение; 2) сформулировать правила, определяющие какие производные знаки, построенные из нашего набора знаков корректные, а какие — нет. Набор таких правил - это грамматика знаковой системы. Высказывание в терминах знаковой системы, может содержать определенный смысл. Если субъекту известны правила прочтения знаков этой системы, то эти записи могут быть восприняты им, и могут сформировать соответствующую мысль. Примеры знаковых систем Язык. Система счисления. Музыка. Религия. Мода.

Представление информации Семиотика Системы средств, используемые человеком для обмена информацией - знаковые или семиотическими, т. е. системами знаков и правил их потребления. Наука, изучающая знаковые системы называется СЕМИОТИКОЙ или семиологией ( от греч. слова sema — знак). Основателем семиотики - американский логик, философ и естествоиспытатель Чарльз Пирс, который и предложил её название. Современная фрактальная семиотика Чарльз Пирс, американский философ, логик, математик, основатель семиотики

Представление информации Семиотика Системы средств, используемые человеком для обмена информацией - знаковые или семиотическими, т. е. системами знаков и правил их потребления. Наука, изучающая знаковые системы называется СЕМИОТИКОЙ или семиологией ( от греч. слова sema — знак). Основателем семиотики - американский логик, философ и естествоиспытатель Чарльз Пирс, который и предложил её название. Современная фрактальная семиотика Чарльз Пирс, американский философ, логик, математик, основатель семиотики

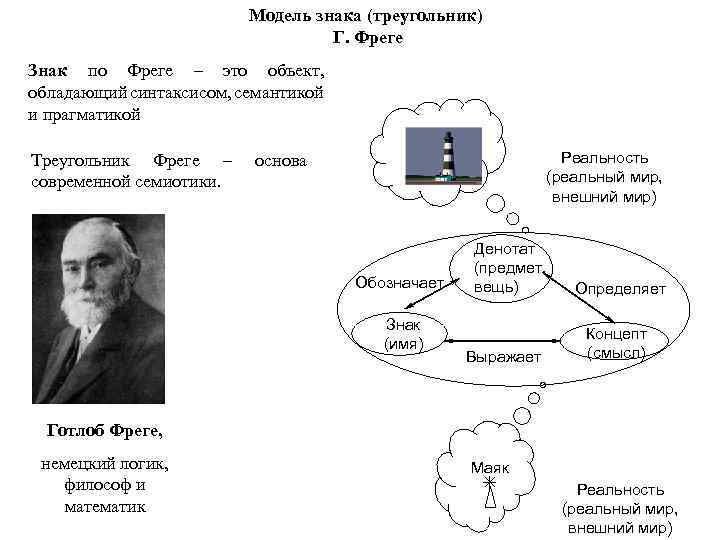

Модель знака (треугольник) Г. Фреге Знак по Фреге – это объект, обладающий синтаксисом, семантикой и прагматикой Треугольник Фреге – современной семиотики. Реальность (реальный мир, внешний мир) основа Обозначает Знак (имя) Денотат (предмет, вещь) Выражает Определяет Концепт (смысл) Готлоб Фреге, немецкий логик, философ и математик Маяк Реальность (реальный мир, внешний мир)

Модель знака (треугольник) Г. Фреге Знак по Фреге – это объект, обладающий синтаксисом, семантикой и прагматикой Треугольник Фреге – современной семиотики. Реальность (реальный мир, внешний мир) основа Обозначает Знак (имя) Денотат (предмет, вещь) Выражает Определяет Концепт (смысл) Готлоб Фреге, немецкий логик, философ и математик Маяк Реальность (реальный мир, внешний мир)

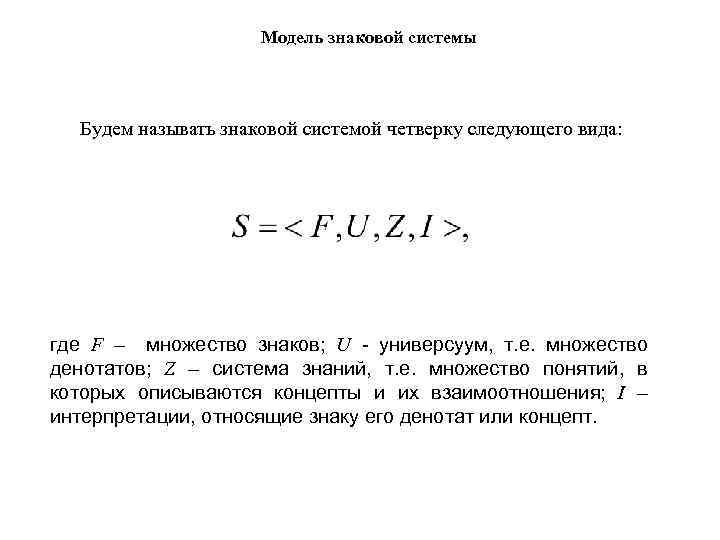

Модель знаковой системы Будем называть знаковой системой четверку следующего вида: где F – множество знаков; U - универсуум, т. е. множество денотатов; Z – система знаний, т. е. множество понятий, в которых описываются концепты и их взаимоотношения; I – интерпретации, относящие знаку его денотат или концепт.

Модель знаковой системы Будем называть знаковой системой четверку следующего вида: где F – множество знаков; U - универсуум, т. е. множество денотатов; Z – система знаний, т. е. множество понятий, в которых описываются концепты и их взаимоотношения; I – интерпретации, относящие знаку его денотат или концепт.

Естественный язык как знаковая система Основная и всеобъемлющая знаковая система, обеспечивающая развитие интеллекта человека и процессы познания - это естественный язык. 1) Естественный язык — это любой язык, практикуемый в общении людей. Естественными языками являются все разговорные языки — например: русский, английский, или китайский. 2) Естественный язык - это система, которая осуществляет функции знаковой поддержки различных интеллектуальных операций, в том числе базовых операций обобщения и абстракции.

Естественный язык как знаковая система Основная и всеобъемлющая знаковая система, обеспечивающая развитие интеллекта человека и процессы познания - это естественный язык. 1) Естественный язык — это любой язык, практикуемый в общении людей. Естественными языками являются все разговорные языки — например: русский, английский, или китайский. 2) Естественный язык - это система, которая осуществляет функции знаковой поддержки различных интеллектуальных операций, в том числе базовых операций обобщения и абстракции.

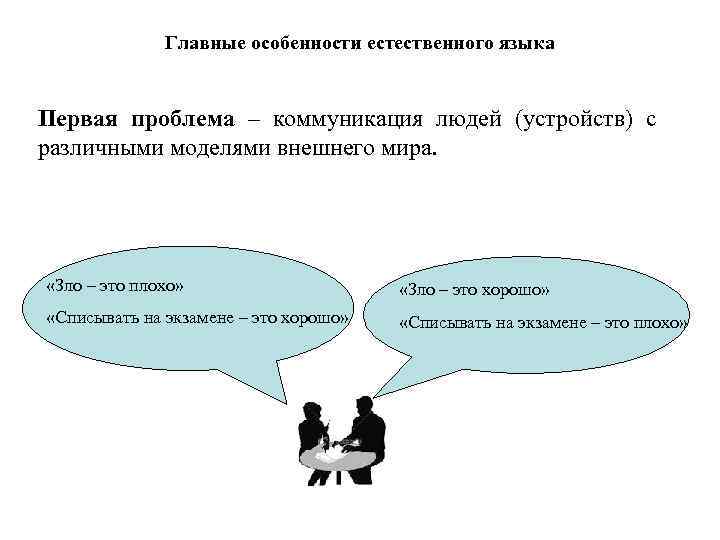

Главные особенности естественного языка Первая проблема – коммуникация людей (устройств) с различными моделями внешнего мира. «Зло – это плохо» «Зло – это хорошо» «Списывать на экзамене – это хорошо» «Списывать на экзамене – это плохо»

Главные особенности естественного языка Первая проблема – коммуникация людей (устройств) с различными моделями внешнего мира. «Зло – это плохо» «Зло – это хорошо» «Списывать на экзамене – это хорошо» «Списывать на экзамене – это плохо»

Особенности естественного языка Вторая проблема. Знаки ЕЯ – это слова и словосочетания. В немногих случаях в этих словах содержится прямая информация о назначении или особенностях того, что этим словом обозначается. Американский исследователь языка Г. Форстер писал: «Понятие розы так же мало обладает ароматом, как мало понятие прыжка прыгает» . И смысловая нагрузка, которая имеется в словах «рукомойник» и «пароход» , - это скорее исключение из общего правила, чем закономерность. Текст на естественном языке «Он увидел на воде прекрасно пахнущую алую розу» .

Особенности естественного языка Вторая проблема. Знаки ЕЯ – это слова и словосочетания. В немногих случаях в этих словах содержится прямая информация о назначении или особенностях того, что этим словом обозначается. Американский исследователь языка Г. Форстер писал: «Понятие розы так же мало обладает ароматом, как мало понятие прыжка прыгает» . И смысловая нагрузка, которая имеется в словах «рукомойник» и «пароход» , - это скорее исключение из общего правила, чем закономерность. Текст на естественном языке «Он увидел на воде прекрасно пахнущую алую розу» .

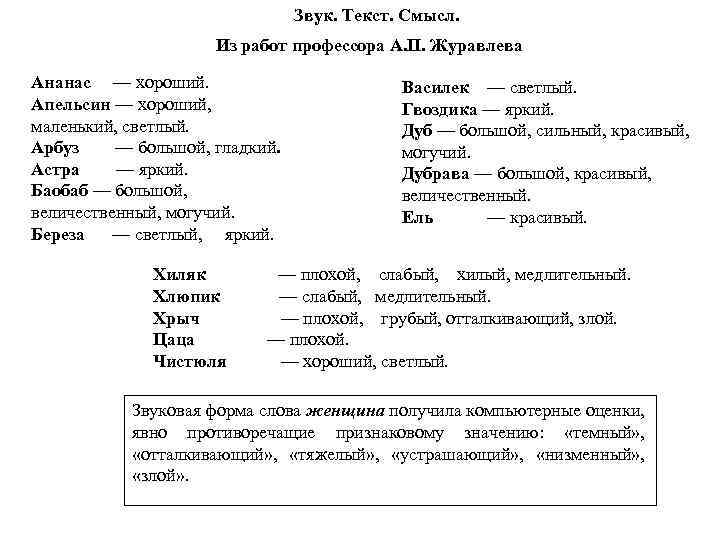

Звук. Текст. Смысл. Из работ профессора А. П. Журавлева Ананас — хороший. Василек — светлый. Апельсин — хороший, Гвоздика — яркий. маленький, светлый. Дуб — большой, сильный, красивый, Арбуз — большой, гладкий. могучий. Астра — яркий. Дубрава — большой, красивый, Баобаб — большой, величественный, могучий. Ель — красивый. Береза — светлый, яркий. Хиляк — плохой, слабый, хилый, медлительный. Хлюпик — слабый, медлительный. Хрыч — плохой, грубый, отталкивающий, злой. Цаца — плохой. Чистюля — хороший, светлый. Звуковая форма слова женщина получила компьютерные оценки, явно противоречащие признаковому значению: «темный» , «отталкивающий» , «тяжелый» , «устрашающий» , «низменный» , «злой» .

Звук. Текст. Смысл. Из работ профессора А. П. Журавлева Ананас — хороший. Василек — светлый. Апельсин — хороший, Гвоздика — яркий. маленький, светлый. Дуб — большой, сильный, красивый, Арбуз — большой, гладкий. могучий. Астра — яркий. Дубрава — большой, красивый, Баобаб — большой, величественный, могучий. Ель — красивый. Береза — светлый, яркий. Хиляк — плохой, слабый, хилый, медлительный. Хлюпик — слабый, медлительный. Хрыч — плохой, грубый, отталкивающий, злой. Цаца — плохой. Чистюля — хороший, светлый. Звуковая форма слова женщина получила компьютерные оценки, явно противоречащие признаковому значению: «темный» , «отталкивающий» , «тяжелый» , «устрашающий» , «низменный» , «злой» .

Искусственные языки Языки программирования и компьютерные языки — языки для автоматической обработки информации с помощью ЭВМ. Например, язык программирования Паскаль и язык моделирования GPSS. Информационные языки— языки, используемые в различных системах обработки информации. Например, язык команд и иконок операционной системы. Формализованные языки науки — языки, предназначенные для символической записи фактов и теорий математики, логики, химии и других наук. Например, язык исчисления высказываний в математической логики, язык теории множеств и отношений дискретной математики.

Искусственные языки Языки программирования и компьютерные языки — языки для автоматической обработки информации с помощью ЭВМ. Например, язык программирования Паскаль и язык моделирования GPSS. Информационные языки— языки, используемые в различных системах обработки информации. Например, язык команд и иконок операционной системы. Формализованные языки науки — языки, предназначенные для символической записи фактов и теорий математики, логики, химии и других наук. Например, язык исчисления высказываний в математической логики, язык теории множеств и отношений дискретной математики.

Формализованный язык - в широком смысле – любая совокупность некоторым образом специализированных языковых средств с (более или менее) точно фиксированными правилами образования «выражений» (синтаксис. ) и приписывания этим выражениям определённого смысла (семантика). Использование формализованного языка – характерная особенность математической логики, которую часто и определяют как «предмет формальной логики, изучаемый посредством построения формализованных языков» . В отличие от естественных языков формальным языкам присущи четко сформулированные правила семантической интерпретации и синтаксического преобразования используемых знаков, а также то, что смысл и значение знаков не изменяется в зависимости от каких-либо прагматических обстоятельств (например, от контекста).

Формализованный язык - в широком смысле – любая совокупность некоторым образом специализированных языковых средств с (более или менее) точно фиксированными правилами образования «выражений» (синтаксис. ) и приписывания этим выражениям определённого смысла (семантика). Использование формализованного языка – характерная особенность математической логики, которую часто и определяют как «предмет формальной логики, изучаемый посредством построения формализованных языков» . В отличие от естественных языков формальным языкам присущи четко сформулированные правила семантической интерпретации и синтаксического преобразования используемых знаков, а также то, что смысл и значение знаков не изменяется в зависимости от каких-либо прагматических обстоятельств (например, от контекста).

Основные объекты теории формальных языков – цепочки символов. Алфавит (иногда говорят – словарь) – непустое множество , элементы которого – это символы (слова) – Цепочки символов над алфавитом - это конечные упорядоченные последовательности символов. Пример. Пусть имеем алфавит . Тогда существуют цепочки: e, a, b, c, ab, ba, …, aaabb, bbbbaacc, ….

Основные объекты теории формальных языков – цепочки символов. Алфавит (иногда говорят – словарь) – непустое множество , элементы которого – это символы (слова) – Цепочки символов над алфавитом - это конечные упорядоченные последовательности символов. Пример. Пусть имеем алфавит . Тогда существуют цепочки: e, a, b, c, ab, ba, …, aaabb, bbbbaacc, ….

Основные объекты теории формальных языков Пустая цепочка обозначается e. Длина цепочки – это число содержащихся в ней символов: = 8. Множество всех возможных цепочек над алфавитом обозначается . Для цепочек символов естественным образом определена операция конкатенации (склеивания): . По определению . Иногда вместо пишут . Язык над словарем - некоторое множество цепочек символов, то есть подмножество множества .

Основные объекты теории формальных языков Пустая цепочка обозначается e. Длина цепочки – это число содержащихся в ней символов: = 8. Множество всех возможных цепочек над алфавитом обозначается . Для цепочек символов естественным образом определена операция конкатенации (склеивания): . По определению . Иногда вместо пишут . Язык над словарем - некоторое множество цепочек символов, то есть подмножество множества .

Способы описания формальных языков Словесное описание – перечисление всех свойств цепочек символов, принадлежащих данному языку. Алгебраическое описание – указание, как с помощью алгебраических правил конструируются цепочки данного языка. Порождающие правила – набор инструкций, по которым, исходя из некоторого начального множества символов (может быть и одного), строятся все цепочки языка. Такой способ часто используется при описании языков программирования. Алгоритм распознавания – последовательность действий, с помощью которой может быть проведен анализ цепочки символов и установлено – принадлежит эта цепочку языку или нет. Удобно рассматривать в некоторое устройства - распознающий автомат, который переходит из состояния в состояние, в зависимости от того, какой символ поступает на его вход.

Способы описания формальных языков Словесное описание – перечисление всех свойств цепочек символов, принадлежащих данному языку. Алгебраическое описание – указание, как с помощью алгебраических правил конструируются цепочки данного языка. Порождающие правила – набор инструкций, по которым, исходя из некоторого начального множества символов (может быть и одного), строятся все цепочки языка. Такой способ часто используется при описании языков программирования. Алгоритм распознавания – последовательность действий, с помощью которой может быть проведен анализ цепочки символов и установлено – принадлежит эта цепочку языку или нет. Удобно рассматривать в некоторое устройства - распознающий автомат, который переходит из состояния в состояние, в зависимости от того, какой символ поступает на его вход.

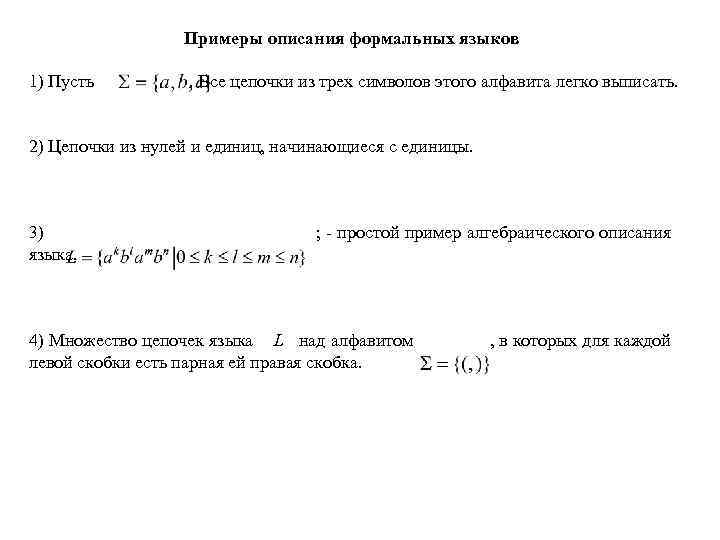

Примеры описания формальных языков 1) Пусть . Все цепочки из трех символов этого алфавита легко выписать. 2) Цепочки из нулей и единиц, начинающиеся с единицы. 3) ; - простой пример алгебраического описания языка. 4) Множество цепочек языка L над алфавитом , в которых для каждой левой скобки есть парная ей правая скобка.

Примеры описания формальных языков 1) Пусть . Все цепочки из трех символов этого алфавита легко выписать. 2) Цепочки из нулей и единиц, начинающиеся с единицы. 3) ; - простой пример алгебраического описания языка. 4) Множество цепочек языка L над алфавитом , в которых для каждой левой скобки есть парная ей правая скобка.

Применение формальных языков Формальные языки широко применяются в науке и технике. Формальный язык - средство более точного представления знаний, чем естественный язык, а следовательно, средством более точного и объективного обмена информацией между людьми. Формальные языки часто конструируются на базе языка математики. С точки зрения информатики, среди формальных языков наиболее значительную роль играют язык алгебры логики и языки программирования. Возникновение языков программирования приходится на начало 50 -х годов XX века. Языков программирования и их разновидностей насчитывается несколько тысяч.

Применение формальных языков Формальные языки широко применяются в науке и технике. Формальный язык - средство более точного представления знаний, чем естественный язык, а следовательно, средством более точного и объективного обмена информацией между людьми. Формальные языки часто конструируются на базе языка математики. С точки зрения информатики, среди формальных языков наиболее значительную роль играют язык алгебры логики и языки программирования. Возникновение языков программирования приходится на начало 50 -х годов XX века. Языков программирования и их разновидностей насчитывается несколько тысяч.

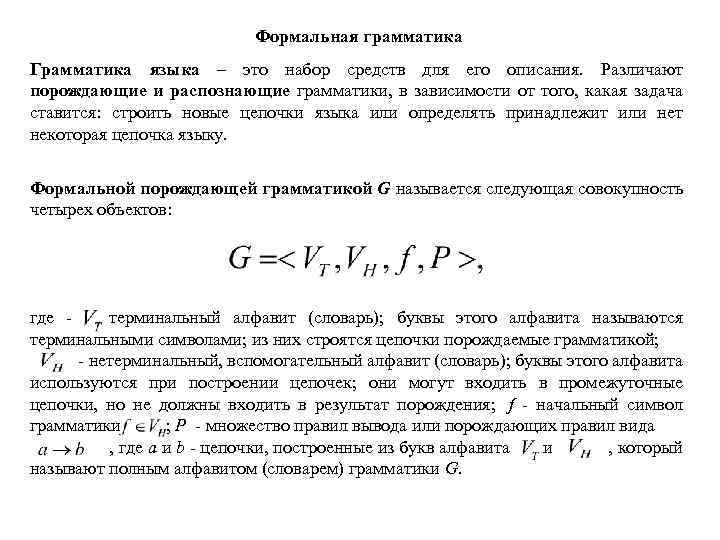

Формальная грамматика Грамматика языка – это набор средств для его описания. Различают порождающие и распознающие грамматики, в зависимости от того, какая задача ставится: строить новые цепочки языка или определять принадлежит или нет некоторая цепочка языку. Формальной порождающей грамматикой G называется следующая совокупность четырех объектов: где - терминальный алфавит (словарь); буквы этого алфавита называются терминальными символами; из них строятся цепочки порождаемые грамматикой; - нетерминальный, вспомогательный алфавит (словарь); буквы этого алфавита используются при построении цепочек; они могут входить в промежуточные цепочки, но не должны входить в результат порождения; f - начальный символ грамматики ; P - множество правил вывода или порождающих правил вида , где a и b - цепочки, построенные из букв алфавита и , который называют полным алфавитом (словарем) грамматики G.

Формальная грамматика Грамматика языка – это набор средств для его описания. Различают порождающие и распознающие грамматики, в зависимости от того, какая задача ставится: строить новые цепочки языка или определять принадлежит или нет некоторая цепочка языку. Формальной порождающей грамматикой G называется следующая совокупность четырех объектов: где - терминальный алфавит (словарь); буквы этого алфавита называются терминальными символами; из них строятся цепочки порождаемые грамматикой; - нетерминальный, вспомогательный алфавит (словарь); буквы этого алфавита используются при построении цепочек; они могут входить в промежуточные цепочки, но не должны входить в результат порождения; f - начальный символ грамматики ; P - множество правил вывода или порождающих правил вида , где a и b - цепочки, построенные из букв алфавита и , который называют полным алфавитом (словарем) грамматики G.

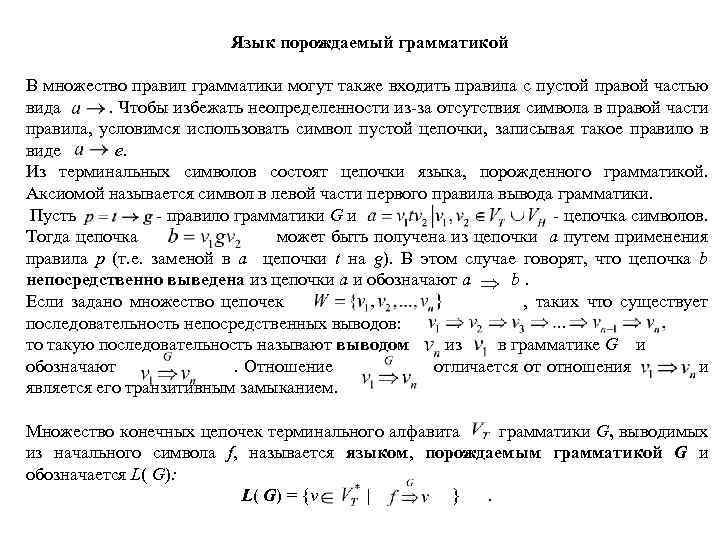

Язык порождаемый грамматикой В множество правил грамматики могут также входить правила с пустой правой частью вида . Чтобы избежать неопределенности из-за отсутствия символа в правой части правила, условимся использовать символ пустой цепочки, записывая такое правило в виде e. Из терминальных символов состоят цепочки языка, порожденного грамматикой. Аксиомой называется символ в левой части первого правила вывода грамматики. Пусть - правило грамматики G и - цепочка символов. Тогда цепочка может быть получена из цепочки a путем применения правила p (т. е. заменой в a цепочки t на g). В этом случае говорят, что цепочка b непосредственно выведена из цепочки a и обозначают a b. Если задано множество цепочек , таких что существует последовательность непосредственных выводов: то такую последовательность называют выводом из в грамматике G и обозначают . Отношение отличается от отношения и является его транзитивным замыканием. Множество конечных цепочек терминального алфавита грамматики G, выводимых из начального символа f, называется языком, порождаемым грамматикой G и обозначается L( G): L( G) = {v | } .

Язык порождаемый грамматикой В множество правил грамматики могут также входить правила с пустой правой частью вида . Чтобы избежать неопределенности из-за отсутствия символа в правой части правила, условимся использовать символ пустой цепочки, записывая такое правило в виде e. Из терминальных символов состоят цепочки языка, порожденного грамматикой. Аксиомой называется символ в левой части первого правила вывода грамматики. Пусть - правило грамматики G и - цепочка символов. Тогда цепочка может быть получена из цепочки a путем применения правила p (т. е. заменой в a цепочки t на g). В этом случае говорят, что цепочка b непосредственно выведена из цепочки a и обозначают a b. Если задано множество цепочек , таких что существует последовательность непосредственных выводов: то такую последовательность называют выводом из в грамматике G и обозначают . Отношение отличается от отношения и является его транзитивным замыканием. Множество конечных цепочек терминального алфавита грамматики G, выводимых из начального символа f, называется языком, порождаемым грамматикой G и обозначается L( G): L( G) = {v | } .

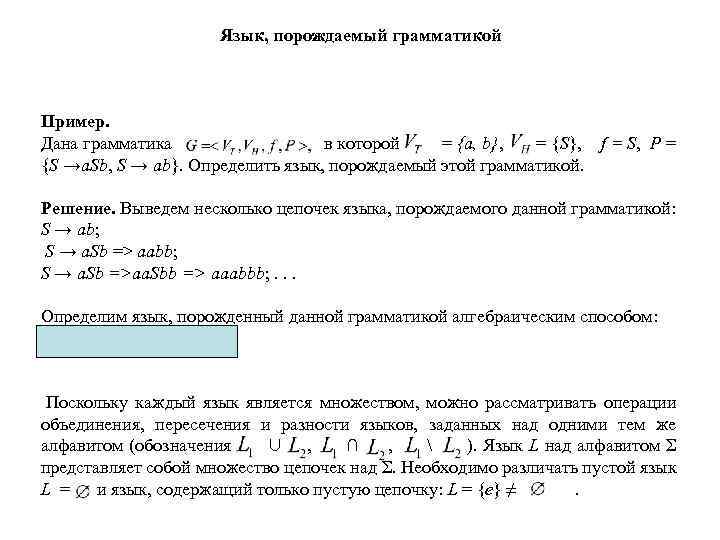

Язык, порождаемый грамматикой Пример. Дана грамматика в которой = {а, b}, = {S}, f = S, Р = {S →a. Sb, S → ab}. Определить язык, порождаемый этой грамматикой. Решение. Выведем несколько цепочек языка, порождаемого данной грамматикой: S → ab; S → a. Sb => aabb; S → a. Sb =>aa. Sbb => aaabbb; . . . Определим язык, порожденный данной грамматикой алгебраическим способом: L(G) = { | n > 0}. Поскольку каждый язык является множеством, можно рассматривать операции объединения, пересечения и разности языков, заданных над одними тем же алфавитом (обозначения ∪ , ∩ , ). Язык L над алфавитом Σ представляет собой множество цепочек над Σ. Необходимо различать пустой язык L = и язык, содержащий только пустую цепочку: L = {e} ≠ .

Язык, порождаемый грамматикой Пример. Дана грамматика в которой = {а, b}, = {S}, f = S, Р = {S →a. Sb, S → ab}. Определить язык, порождаемый этой грамматикой. Решение. Выведем несколько цепочек языка, порождаемого данной грамматикой: S → ab; S → a. Sb => aabb; S → a. Sb =>aa. Sbb => aaabbb; . . . Определим язык, порожденный данной грамматикой алгебраическим способом: L(G) = { | n > 0}. Поскольку каждый язык является множеством, можно рассматривать операции объединения, пересечения и разности языков, заданных над одними тем же алфавитом (обозначения ∪ , ∩ , ). Язык L над алфавитом Σ представляет собой множество цепочек над Σ. Необходимо различать пустой язык L = и язык, содержащий только пустую цепочку: L = {e} ≠ .

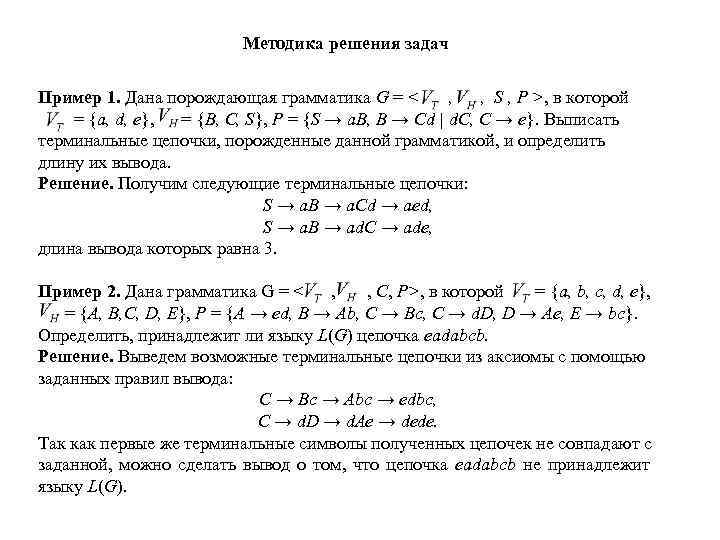

Методика решения задач Пример 1. Дана порождающая грамматика G = < , , S , Р >, в которой = {a, d, е}, = {В, С, S}, Р = {S → а. В, В → Cd | d. C, С → е}. Выписать терминальные цепочки, порожденные данной грамматикой, и определить длину их вывода. Решение. Получим следующие терминальные цепочки: S → а. В → a. Cd → aed, S → а. В → ad. C → ade, длина вывода которых равна 3. Пример 2. Дана грамматика G = < , , C, Р>, в которой = {a, b, c, d, е}, = {A, В, С, D, E}, Р = {A → ed, В → Ab, С → Bc, С → d. D, D → Ae, E → bc}. Определить, принадлежит ли языку L(G) цепочка eadabcb. Решение. Выведем возможные терминальные цепочки из аксиомы с помощью заданных правил вывода: С → Bc → Abc → edbc, С → d. D → d. Ae → dede. Так как первые же терминальные символы полученных цепочек не совпадают с заданной, можно сделать вывод о том, что цепочка eadabcb не принадлежит языку L(G).

Методика решения задач Пример 1. Дана порождающая грамматика G = < , , S , Р >, в которой = {a, d, е}, = {В, С, S}, Р = {S → а. В, В → Cd | d. C, С → е}. Выписать терминальные цепочки, порожденные данной грамматикой, и определить длину их вывода. Решение. Получим следующие терминальные цепочки: S → а. В → a. Cd → aed, S → а. В → ad. C → ade, длина вывода которых равна 3. Пример 2. Дана грамматика G = < , , C, Р>, в которой = {a, b, c, d, е}, = {A, В, С, D, E}, Р = {A → ed, В → Ab, С → Bc, С → d. D, D → Ae, E → bc}. Определить, принадлежит ли языку L(G) цепочка eadabcb. Решение. Выведем возможные терминальные цепочки из аксиомы с помощью заданных правил вывода: С → Bc → Abc → edbc, С → d. D → d. Ae → dede. Так как первые же терминальные символы полученных цепочек не совпадают с заданной, можно сделать вывод о том, что цепочка eadabcb не принадлежит языку L(G).

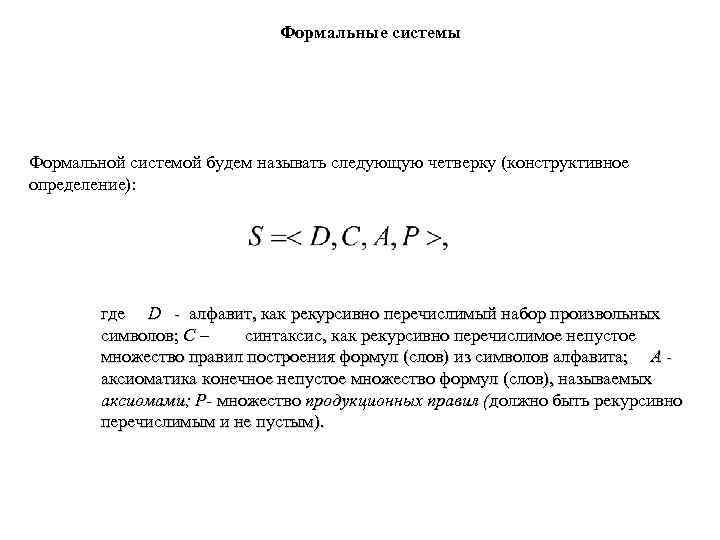

Формальные системы Формальной системой будем называть следующую четверку (конструктивное определение): где D - алфавит, как рекурсивно перечислимый набор произвольных символов; C – синтаксис, как рекурсивно перечислимое непустое множество правил построения формул (слов) из символов алфавита; A - аксиоматика конечное непустое множество формул (слов), называемых аксиомами; P- множество продукционных правил (должно быть рекурсивно перечислимым и не пустым).

Формальные системы Формальной системой будем называть следующую четверку (конструктивное определение): где D - алфавит, как рекурсивно перечислимый набор произвольных символов; C – синтаксис, как рекурсивно перечислимое непустое множество правил построения формул (слов) из символов алфавита; A - аксиоматика конечное непустое множество формул (слов), называемых аксиомами; P- множество продукционных правил (должно быть рекурсивно перечислимым и не пустым).

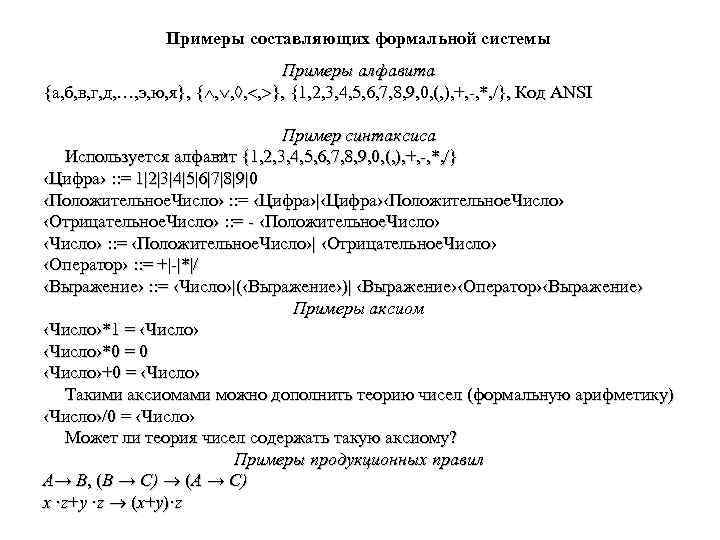

Примеры составляющих формальной системы Примеры алфавита {а, б, в, г, д, …, э, ю, я}, { , , }, {1, 2, 3, 4, 5, 6, 7, 8, 9, 0, (, ), +, -, *, /}, Код ANSI Пример синтаксиса Используется алфавит {1, 2, 3, 4, 5, 6, 7, 8, 9, 0, (, ), +, -, *, /} ‹Цифра› : : = 1|2|3|4|5|6|7|8|9|0 ‹Положительное. Число› : : = ‹Цифра›|‹Цифра›‹Положительное. Число› ‹Отрицательное. Число› : : = - ‹Положительное. Число› ‹Число› : : = ‹Положительное. Число›| ‹Отрицательное. Число› ‹Оператор› : : = +|-|*|/ ‹Выражение› : : = ‹Число›|(‹Выражение›)| ‹Выражение›‹Оператор›‹Выражение› Примеры аксиом ‹Число›*1 = ‹Число›*0 = 0 ‹Число›+0 = ‹Число› Такими аксиомами можно дополнить теорию чисел (формальную арифметику) ‹Число›/0 = ‹Число› Может ли теория чисел содержать такую аксиому? Примеры продукционных правил A→ B, (В → C) (A → C) x ·z+y ·z (x+y)·z

Примеры составляющих формальной системы Примеры алфавита {а, б, в, г, д, …, э, ю, я}, { , , }, {1, 2, 3, 4, 5, 6, 7, 8, 9, 0, (, ), +, -, *, /}, Код ANSI Пример синтаксиса Используется алфавит {1, 2, 3, 4, 5, 6, 7, 8, 9, 0, (, ), +, -, *, /} ‹Цифра› : : = 1|2|3|4|5|6|7|8|9|0 ‹Положительное. Число› : : = ‹Цифра›|‹Цифра›‹Положительное. Число› ‹Отрицательное. Число› : : = - ‹Положительное. Число› ‹Число› : : = ‹Положительное. Число›| ‹Отрицательное. Число› ‹Оператор› : : = +|-|*|/ ‹Выражение› : : = ‹Число›|(‹Выражение›)| ‹Выражение›‹Оператор›‹Выражение› Примеры аксиом ‹Число›*1 = ‹Число›*0 = 0 ‹Число›+0 = ‹Число› Такими аксиомами можно дополнить теорию чисел (формальную арифметику) ‹Число›/0 = ‹Число› Может ли теория чисел содержать такую аксиому? Примеры продукционных правил A→ B, (В → C) (A → C) x ·z+y ·z (x+y)·z

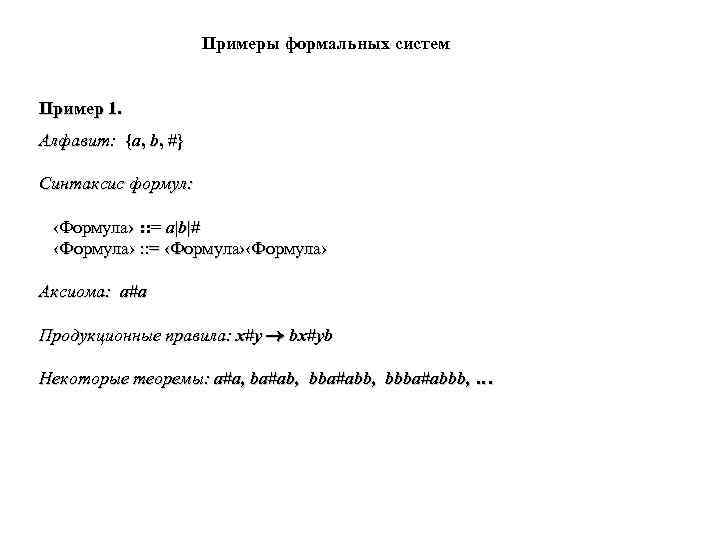

Примеры формальных систем Пример 1. Алфавит: {а, b, #} Синтаксис формул: ‹Формула› : : = а|b|# ‹Формула› : : = ‹Формула› Аксиома: а#а Продукционные правила: x#y bx#yb Некоторые теоремы: а#а, ba#аb, bba#аbb, bbba#аbbb, …

Примеры формальных систем Пример 1. Алфавит: {а, b, #} Синтаксис формул: ‹Формула› : : = а|b|# ‹Формула› : : = ‹Формула› Аксиома: а#а Продукционные правила: x#y bx#yb Некоторые теоремы: а#а, ba#аb, bba#аbb, bbba#аbbb, …

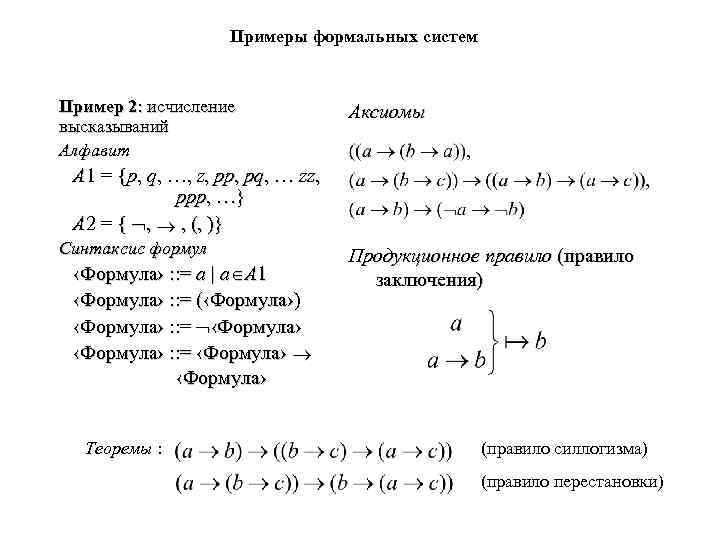

Примеры формальных систем Пример 2: исчисление высказываний Алфавит Аксиомы A 1 = {p, q, …, z, pp, рq, … zz, ppp, …} A 2 = { , , (, )} Синтаксис формул ‹Формула› : : = a | a A 1 ‹Формула› : : = (‹Формула›) ‹Формула› : : = ‹Формула› Продукционное правило (правило заключения) Теоремы : (правило силлогизма) (правило перестановки)

Примеры формальных систем Пример 2: исчисление высказываний Алфавит Аксиомы A 1 = {p, q, …, z, pp, рq, … zz, ppp, …} A 2 = { , , (, )} Синтаксис формул ‹Формула› : : = a | a A 1 ‹Формула› : : = (‹Формула›) ‹Формула› : : = ‹Формула› Продукционное правило (правило заключения) Теоремы : (правило силлогизма) (правило перестановки)

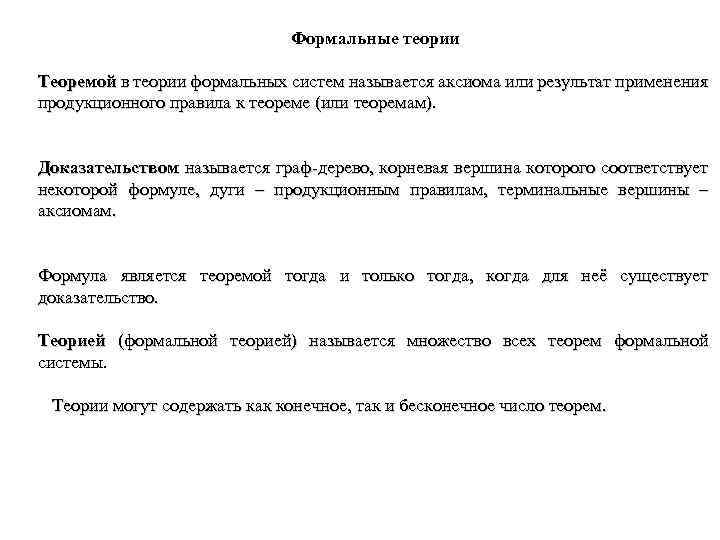

Формальные теории Теоремой в теории формальных систем называется аксиома или результат применения продукционного правила к теореме (или теоремам). Доказательством называется граф-дерево, корневая вершина которого соответствует некоторой формуле, дуги – продукционным правилам, терминальные вершины – аксиомам. Формула является теоремой тогда и только тогда, когда для неё существует доказательство. Теорией (формальной теорией) называется множество всех теорем формальной системы. Теории могут содержать как конечное, так и бесконечное число теорем.

Формальные теории Теоремой в теории формальных систем называется аксиома или результат применения продукционного правила к теореме (или теоремам). Доказательством называется граф-дерево, корневая вершина которого соответствует некоторой формуле, дуги – продукционным правилам, терминальные вершины – аксиомам. Формула является теоремой тогда и только тогда, когда для неё существует доказательство. Теорией (формальной теорией) называется множество всех теорем формальной системы. Теории могут содержать как конечное, так и бесконечное число теорем.

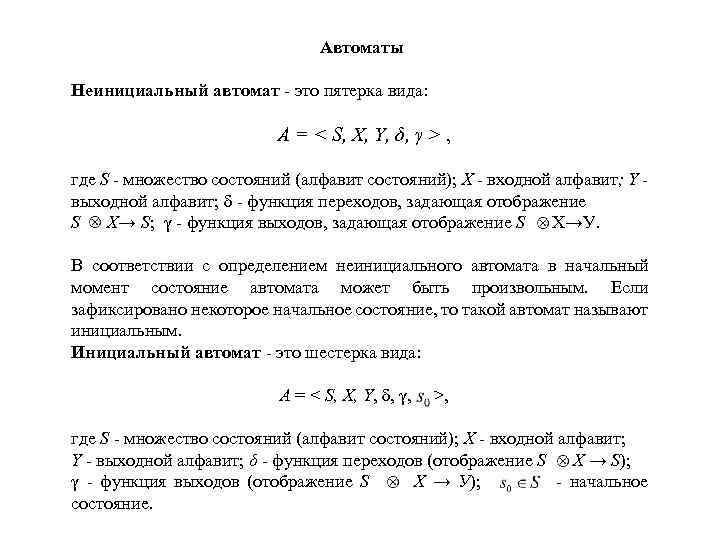

Автоматы Неинициальный автомат - это пятерка вида: А = < S, X, Y, δ, γ > , где S - множество состояний (алфавит состояний); Х - входной алфавит; Y - выходной алфавит; δ - функция переходов, задающая отображение S Х→ S; γ - функция выходов, задающая отображение S Х→У. В соответствии с определением неинициального автомата в начальный момент состояние автомата может быть произвольным. Если зафиксировано некоторое начальное состояние, то такой автомат называют инициальным. Инициальный автомат - это шестерка вида: А = < S, X, Y, δ, γ, >, где S - множество состояний (алфавит состояний); Х - входной алфавит; Y - выходной алфавит; δ - функция переходов (отображение S Х → S); γ - функция выходов (отображение S Х → У); - начальное состояние.

Автоматы Неинициальный автомат - это пятерка вида: А = < S, X, Y, δ, γ > , где S - множество состояний (алфавит состояний); Х - входной алфавит; Y - выходной алфавит; δ - функция переходов, задающая отображение S Х→ S; γ - функция выходов, задающая отображение S Х→У. В соответствии с определением неинициального автомата в начальный момент состояние автомата может быть произвольным. Если зафиксировано некоторое начальное состояние, то такой автомат называют инициальным. Инициальный автомат - это шестерка вида: А = < S, X, Y, δ, γ, >, где S - множество состояний (алфавит состояний); Х - входной алфавит; Y - выходной алфавит; δ - функция переходов (отображение S Х → S); γ - функция выходов (отображение S Х → У); - начальное состояние.

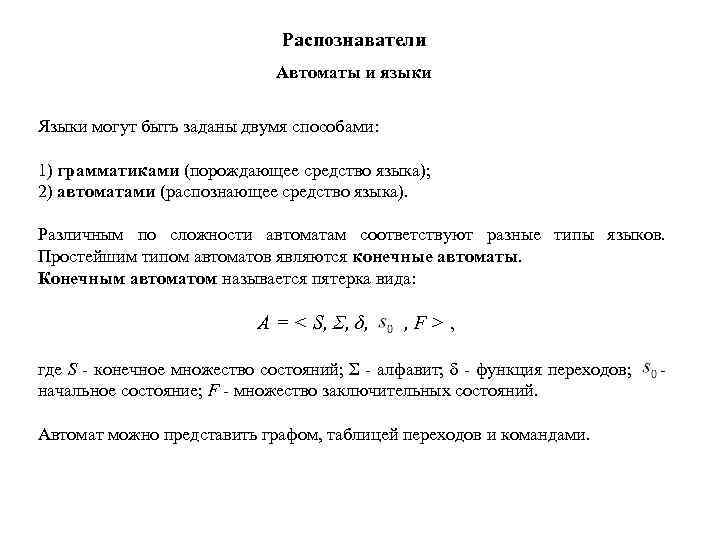

Распознаватели Автоматы и языки Языки могут быть заданы двумя способами: 1) грамматиками (порождающее средство языка); 2) автоматами (распознающее средство языка). Различным по сложности автоматам соответствуют разные типы языков. Простейшим типом автоматов являются конечные автоматы. Конечным автоматом называется пятерка вида: А = < S, Σ, δ, , F > , где S - конечное множество состояний; Σ - алфавит; δ - функция переходов; - начальное состояние; F - множество заключительных состояний. Автомат можно представить графом, таблицей переходов и командами.

Распознаватели Автоматы и языки Языки могут быть заданы двумя способами: 1) грамматиками (порождающее средство языка); 2) автоматами (распознающее средство языка). Различным по сложности автоматам соответствуют разные типы языков. Простейшим типом автоматов являются конечные автоматы. Конечным автоматом называется пятерка вида: А = < S, Σ, δ, , F > , где S - конечное множество состояний; Σ - алфавит; δ - функция переходов; - начальное состояние; F - множество заключительных состояний. Автомат можно представить графом, таблицей переходов и командами.

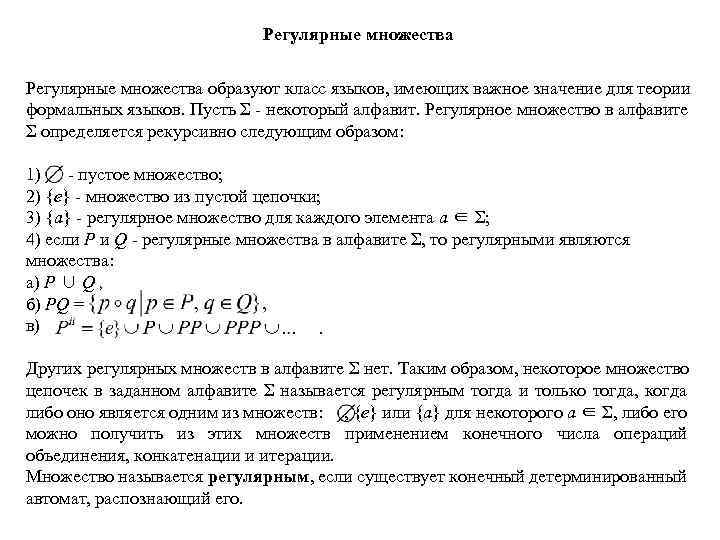

Регулярные множества образуют класс языков, имеющих важное значение для теории формальных языков. Пусть Σ - некоторый алфавит. Регулярное множество в алфавите Σ определяется рекурсивно следующим образом: 1) - пустое множество; 2) {e} - множество из пустой цепочки; 3) {a} - регулярное множество для каждого элемента a ∈ Σ; 4) если P и Q - регулярные множества в алфавите Σ, то регулярными являются множества: а) P ∪ Q , б) PQ = в) Других регулярных множеств в алфавите Σ нет. Таким образом, некоторое множество цепочек в заданном алфавите Σ называется регулярным тогда и только тогда, когда либо оно является одним из множеств: , {e} или {a} для некоторого a ∈ Σ, либо его можно получить из этих множеств применением конечного числа операций объединения, конкатенации и итерации. Множество называется регулярным, если существует конечный детерминированный автомат, распознающий его.

Регулярные множества образуют класс языков, имеющих важное значение для теории формальных языков. Пусть Σ - некоторый алфавит. Регулярное множество в алфавите Σ определяется рекурсивно следующим образом: 1) - пустое множество; 2) {e} - множество из пустой цепочки; 3) {a} - регулярное множество для каждого элемента a ∈ Σ; 4) если P и Q - регулярные множества в алфавите Σ, то регулярными являются множества: а) P ∪ Q , б) PQ = в) Других регулярных множеств в алфавите Σ нет. Таким образом, некоторое множество цепочек в заданном алфавите Σ называется регулярным тогда и только тогда, когда либо оно является одним из множеств: , {e} или {a} для некоторого a ∈ Σ, либо его можно получить из этих множеств применением конечного числа операций объединения, конкатенации и итерации. Множество называется регулярным, если существует конечный детерминированный автомат, распознающий его.

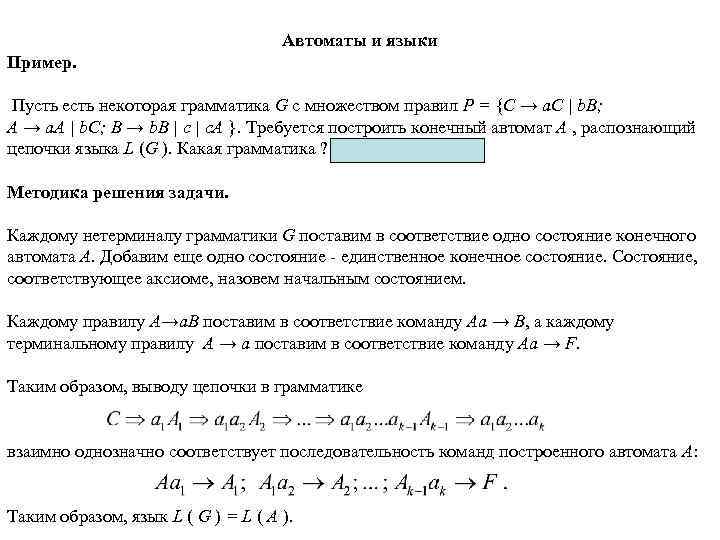

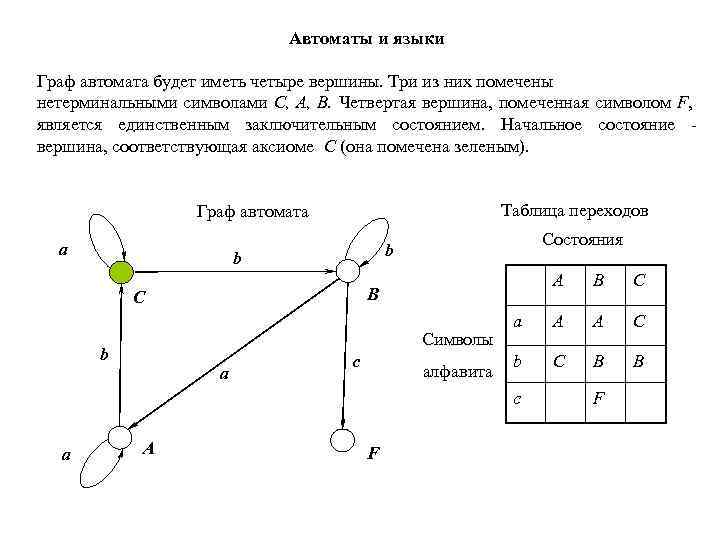

Автоматы и языки Пример. Пусть есть некоторая грамматика G с множеством правил P = {C → a. C | b. B; A → a. A | b. C; B → b. B | с | c. A }. Требуется построить конечный автомат А , распознающий цепочки языка L (G ). Какая грамматика ? Праворекурсивная. Методика решения задачи. Каждому нетерминалу грамматики G поставим в соответствие одно состояние конечного автомата A. Добавим еще одно состояние - единственное конечное состояние. Состояние, соответствующее аксиоме, назовем начальным состоянием. Каждому правилу A→a. B поставим в соответствие команду Aa → B, а каждому терминальному правилу A → a поставим в соответствие команду Aa → F. Таким образом, выводу цепочки в грамматике взаимно однозначно соответствует последовательность команд построенного автомата A: Таким образом, язык L ( G ) = L ( A ).

Автоматы и языки Пример. Пусть есть некоторая грамматика G с множеством правил P = {C → a. C | b. B; A → a. A | b. C; B → b. B | с | c. A }. Требуется построить конечный автомат А , распознающий цепочки языка L (G ). Какая грамматика ? Праворекурсивная. Методика решения задачи. Каждому нетерминалу грамматики G поставим в соответствие одно состояние конечного автомата A. Добавим еще одно состояние - единственное конечное состояние. Состояние, соответствующее аксиоме, назовем начальным состоянием. Каждому правилу A→a. B поставим в соответствие команду Aa → B, а каждому терминальному правилу A → a поставим в соответствие команду Aa → F. Таким образом, выводу цепочки в грамматике взаимно однозначно соответствует последовательность команд построенного автомата A: Таким образом, язык L ( G ) = L ( A ).

Автоматы и языки Граф автомата будет иметь четыре вершины. Три из них помечены нетерминальными символами C, A, B. Четвертая вершина, помеченная символом F, является единственным заключительным состоянием. Начальное состояние вершина, соответствующая аксиоме C (она помечена зеленым). Таблица переходов Граф автомата a Состояния b b A C Символы b B C a A A C b C B B B a c алфавита c a A F F

Автоматы и языки Граф автомата будет иметь четыре вершины. Три из них помечены нетерминальными символами C, A, B. Четвертая вершина, помеченная символом F, является единственным заключительным состоянием. Начальное состояние вершина, соответствующая аксиоме C (она помечена зеленым). Таблица переходов Граф автомата a Состояния b b A C Символы b B C a A A C b C B B B a c алфавита c a A F F

Каждому правилу грамматики поставим в соответствие команду конечного автомата: Ca → C - в начальном состоянии при поступлении на вход терминального символа а автомат остается в том же состоянии C; Cb → B - из начального состояния при поступлении на вход терминала b автомат переходит в состояние B; Bb → B - в состоянии В при поступлении на вход терминала b автомат остается в том же состоянии B; Bc → F - из состояния В при поступлении на вход терминала c автомат переходит в заключительное состояние F; Bc → A - из состояния В при поступлении на вход терминала c автомат переходит в состояние А; Aa → A - в состоянии А при поступлении на вход терминала а автомат остается в этом же состоянии А; Ab → C - из состояния A при поступлении на вход терминала b автомат переходит в состояние C. Полученный недетерминированный конечный автомат распознает цепочки языка, порождаемые праворекурсивной грамматикой G.

Каждому правилу грамматики поставим в соответствие команду конечного автомата: Ca → C - в начальном состоянии при поступлении на вход терминального символа а автомат остается в том же состоянии C; Cb → B - из начального состояния при поступлении на вход терминала b автомат переходит в состояние B; Bb → B - в состоянии В при поступлении на вход терминала b автомат остается в том же состоянии B; Bc → F - из состояния В при поступлении на вход терминала c автомат переходит в заключительное состояние F; Bc → A - из состояния В при поступлении на вход терминала c автомат переходит в состояние А; Aa → A - в состоянии А при поступлении на вход терминала а автомат остается в этом же состоянии А; Ab → C - из состояния A при поступлении на вход терминала b автомат переходит в состояние C. Полученный недетерминированный конечный автомат распознает цепочки языка, порождаемые праворекурсивной грамматикой G.

Преобразователи Автоматы с выходом называются преобразователями. В зависимости от вида функции, отображающей множество состояний и входных символов в множество выходных символов и новых состояний, различают разные виды преобразователей. Рассмотрим конечные автоматы-преобразователи. Конечным преобразователем называется шестерка вида: P = < S, X, Y, f, q, >, где S - конечное множество состояний; X - входной алфавит; Y - выходной алфавит; f - функция переходов; q - функция выходов; - начальное состояние. Типы отображений f и q определяют различные виды автоматов. Если q – отображение S X в Y, то конечный преобразователь называется синхронным. В общем случае это отображение имеет вид S X → Y*. Пусть P = < S, X, Y, f, q, > - конечный преобразователь. Тогда отображение Q(x) = q( , x), определенное для любой цепочки x ∈ X*, называется конечным преобразованием. Чтобы выходную цепочку y можно было считать переводом входной цепочки x, цепочка x должна перевести преобразователь из начального состояния в заключительное.

Преобразователи Автоматы с выходом называются преобразователями. В зависимости от вида функции, отображающей множество состояний и входных символов в множество выходных символов и новых состояний, различают разные виды преобразователей. Рассмотрим конечные автоматы-преобразователи. Конечным преобразователем называется шестерка вида: P = < S, X, Y, f, q, >, где S - конечное множество состояний; X - входной алфавит; Y - выходной алфавит; f - функция переходов; q - функция выходов; - начальное состояние. Типы отображений f и q определяют различные виды автоматов. Если q – отображение S X в Y, то конечный преобразователь называется синхронным. В общем случае это отображение имеет вид S X → Y*. Пусть P = < S, X, Y, f, q, > - конечный преобразователь. Тогда отображение Q(x) = q( , x), определенное для любой цепочки x ∈ X*, называется конечным преобразованием. Чтобы выходную цепочку y можно было считать переводом входной цепочки x, цепочка x должна перевести преобразователь из начального состояния в заключительное.

Автоматы Мили и Мура являются неинициальными автоматами. В отображении Q(x) = q( , x) зафиксируем начальное состояние , в котором автомат находится в начальный момент времени. Оно существенно влияет на процесс конечного преобразования, так как определяет не только результирующую цепочку, но и множество входных цепочек. Рассмотрим поведение инициальных автоматов, которые могут начинать работать из любого указанного состояния. Такой автомат получает на вход одну цепочку бесконечной длины и перерабатывает её. Реакция такого преобразователя на определенные воздействия непредсказуема, если неизвестно его начальное состояние. Поэтому необходимо решить две задачи, имеющие важное практическое значение: 1) определение того состояния автомата, в котором он находится в момент, начиная с которого исследуется его поведение; 2) распознавание конечного состояния, в которое перешел автомат после завершения испытательной операции. Это состояние будет начальным для следующей серии испытаний. Эти задачи анализа получили название экспериментов по распознаванию состояния.

Автоматы Мили и Мура являются неинициальными автоматами. В отображении Q(x) = q( , x) зафиксируем начальное состояние , в котором автомат находится в начальный момент времени. Оно существенно влияет на процесс конечного преобразования, так как определяет не только результирующую цепочку, но и множество входных цепочек. Рассмотрим поведение инициальных автоматов, которые могут начинать работать из любого указанного состояния. Такой автомат получает на вход одну цепочку бесконечной длины и перерабатывает её. Реакция такого преобразователя на определенные воздействия непредсказуема, если неизвестно его начальное состояние. Поэтому необходимо решить две задачи, имеющие важное практическое значение: 1) определение того состояния автомата, в котором он находится в момент, начиная с которого исследуется его поведение; 2) распознавание конечного состояния, в которое перешел автомат после завершения испытательной операции. Это состояние будет начальным для следующей серии испытаний. Эти задачи анализа получили название экспериментов по распознаванию состояния.

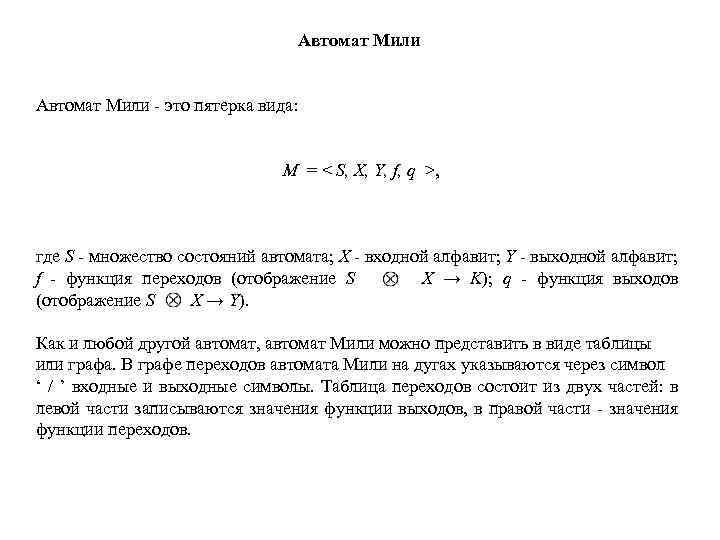

Автомат Мили - это пятерка вида: M = < S, X, Y, f, q >, где S - множество состояний автомата; X - входной алфавит; Y - выходной алфавит; f - функция переходов (отображение S X → K); q - функция выходов (отображение S X → Y). Как и любой другой автомат, автомат Мили можно представить в виде таблицы или графа. В графе переходов автомата Мили на дугах указываются через символ ‘ / ’ входные и выходные символы. Таблица переходов состоит из двух частей: в левой части записываются значения функции выходов, в правой части - значения функции переходов.

Автомат Мили - это пятерка вида: M = < S, X, Y, f, q >, где S - множество состояний автомата; X - входной алфавит; Y - выходной алфавит; f - функция переходов (отображение S X → K); q - функция выходов (отображение S X → Y). Как и любой другой автомат, автомат Мили можно представить в виде таблицы или графа. В графе переходов автомата Мили на дугах указываются через символ ‘ / ’ входные и выходные символы. Таблица переходов состоит из двух частей: в левой части записываются значения функции выходов, в правой части - значения функции переходов.

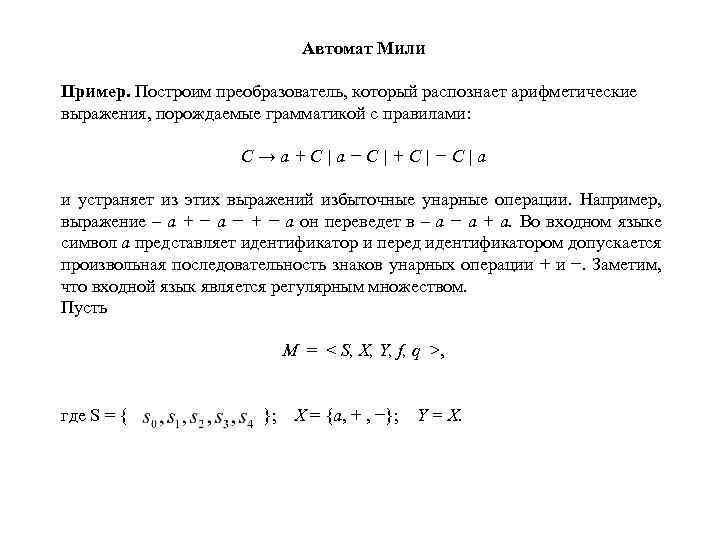

Автомат Мили Пример. Построим преобразователь, который распознает арифметические выражения, порождаемые грамматикой с правилами: C → a + C | a − C | + C | − C | a и устраняет из этих выражений избыточные унарные операции. Например, выражение – a + − а − + − а он переведет в – а − а + а. Во входном языке символ а представляет идентификатор и перед идентификатором допускается произвольная последовательность знаков унарных операции + и −. Заметим, что входной язык является регулярным множеством. Пусть M = < S, X, Y, f, q >, где S = { }; X = {a, + , −}; Y = X.

Автомат Мили Пример. Построим преобразователь, который распознает арифметические выражения, порождаемые грамматикой с правилами: C → a + C | a − C | + C | − C | a и устраняет из этих выражений избыточные унарные операции. Например, выражение – a + − а − + − а он переведет в – а − а + а. Во входном языке символ а представляет идентификатор и перед идентификатором допускается произвольная последовательность знаков унарных операции + и −. Заметим, что входной язык является регулярным множеством. Пусть M = < S, X, Y, f, q >, где S = { }; X = {a, + , −}; Y = X.

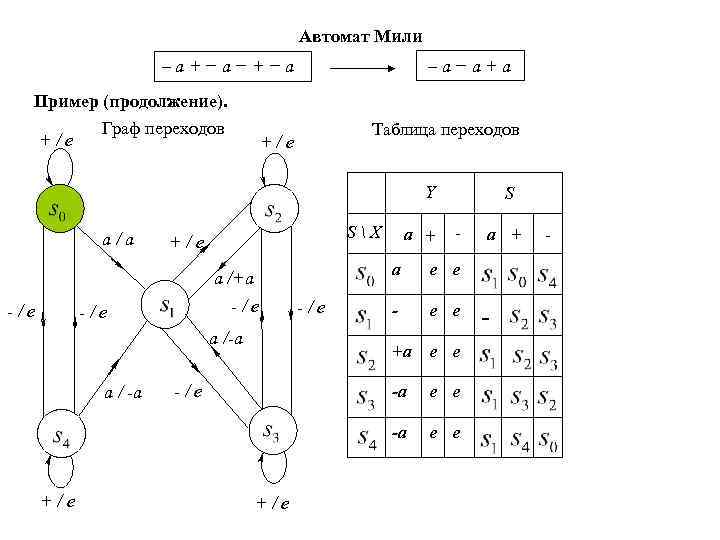

Автомат Мили – а − а + а – a + − а − + − а Пример (продолжение). +/e Граф переходов Таблица переходов +/e Y a/a SX +/e -/e - a a /+a -/e a + S a /-a -/e e e - e e +a e e -/e +/e -a +/e e e -a a / -a a + e e - -

Автомат Мили – а − а + а – a + − а − + − а Пример (продолжение). +/e Граф переходов Таблица переходов +/e Y a/a SX +/e -/e - a a /+a -/e a + S a /-a -/e e e - e e +a e e -/e +/e -a +/e e e -a a / -a a + e e - -

Автомат Мили Преобразователь М начинает работу в состоянии и, чередуя состояния и на входном символе « − » , определяет, четное или нечетное число знаков « − » предшествует первому символу а . Когда появляется а, преобразователь М переходит в состояние , допуская вход, и выдает а или − а в зависимости от того, четно или нечетно число появившихся минусов. Для следующих символов а он подсчитывает, четно или нечетно число предшествующих минусов, с помощью состояний и . Единственное различие между парами состоит в том, что если символу а предшествует четное число минусов, то первая из них выдает +а , а не только а.

Автомат Мили Преобразователь М начинает работу в состоянии и, чередуя состояния и на входном символе « − » , определяет, четное или нечетное число знаков « − » предшествует первому символу а . Когда появляется а, преобразователь М переходит в состояние , допуская вход, и выдает а или − а в зависимости от того, четно или нечетно число появившихся минусов. Для следующих символов а он подсчитывает, четно или нечетно число предшествующих минусов, с помощью состояний и . Единственное различие между парами состоит в том, что если символу а предшествует четное число минусов, то первая из них выдает +а , а не только а.

Автомат Мура - это «пятерка» вида: U = < S, X, Y, f, h > , где S - множество состояний автомата; X - входной алфавит; Y - выходной алфавит;

Автомат Мура - это «пятерка» вида: U = < S, X, Y, f, h > , где S - множество состояний автомата; X - входной алфавит; Y - выходной алфавит;

Основоположники теории алгоритмов Курт Гёдель, австрийский математик, доказал теорему и неполноте, основатель теории алгоритмов Алонзо Черч, профессор, американский математик и логик, основоположник теории алгоритмов, разработка лямбдаисчисления Стивен Клини, американский логик, математик, основоположник теории рекурсивных функций

Основоположники теории алгоритмов Курт Гёдель, австрийский математик, доказал теорему и неполноте, основатель теории алгоритмов Алонзо Черч, профессор, американский математик и логик, основоположник теории алгоритмов, разработка лямбдаисчисления Стивен Клини, американский логик, математик, основоположник теории рекурсивных функций

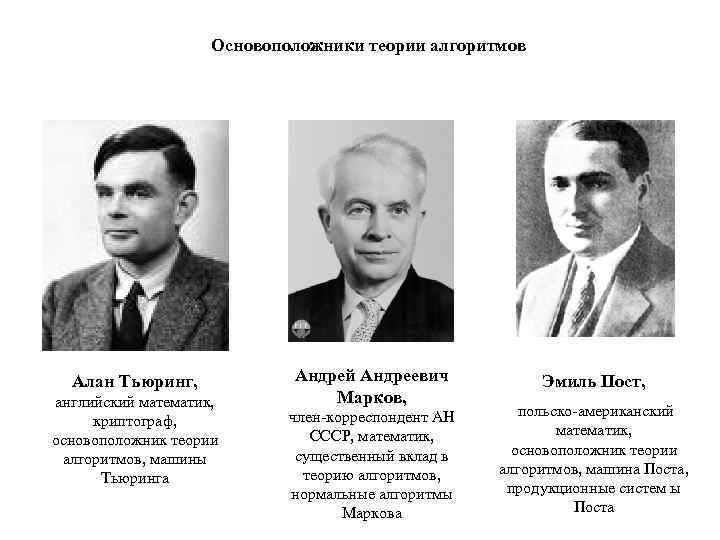

Основоположники теории алгоритмов Алан Тьюринг, английский математик, криптограф, основоположник теории алгоритмов, машины Тьюринга Андрей Андреевич Марков, член-корреспондент АН СССР, математик, существенный вклад в теорию алгоритмов, нормальные алгоритмы Маркова Эмиль Пост, польско-американский математик, основоположник теории алгоритмов, машина Поста, продукционные систем ы Поста

Основоположники теории алгоритмов Алан Тьюринг, английский математик, криптограф, основоположник теории алгоритмов, машины Тьюринга Андрей Андреевич Марков, член-корреспондент АН СССР, математик, существенный вклад в теорию алгоритмов, нормальные алгоритмы Маркова Эмиль Пост, польско-американский математик, основоположник теории алгоритмов, машина Поста, продукционные систем ы Поста

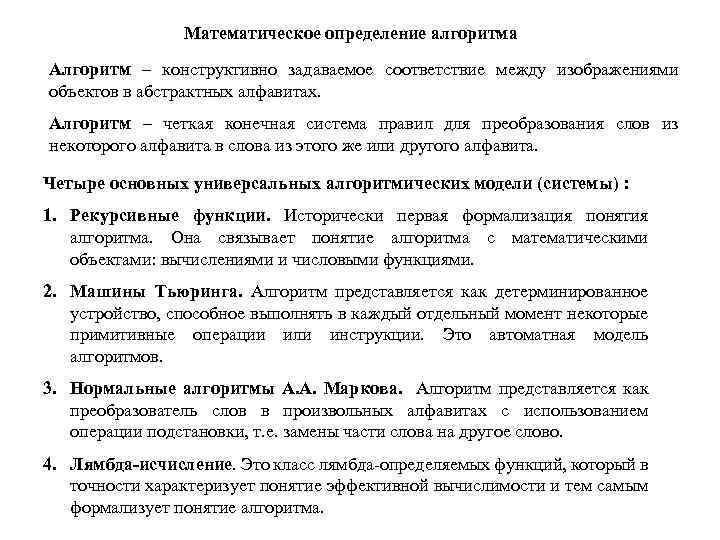

Понятие теории алгоритмов Теория алгоритмов — наука, изучающая общие свойства и закономерности алгоритмов и разнообразные формальные модели их представления. Задачи теории алгоритмов: формальное доказательство алгоритмической неразрешимости задач, асимптотический анализ сложности алгоритмов, классификация алгоритмов в соответствии с классами сложности, разработка критериев сравнительной оценки качества алгоритмов и т. п.

Понятие теории алгоритмов Теория алгоритмов — наука, изучающая общие свойства и закономерности алгоритмов и разнообразные формальные модели их представления. Задачи теории алгоритмов: формальное доказательство алгоритмической неразрешимости задач, асимптотический анализ сложности алгоритмов, классификация алгоритмов в соответствии с классами сложности, разработка критериев сравнительной оценки качества алгоритмов и т. п.

История возникновения теории алгоритмов Развитие теории алгоритмов начинается с доказательства Куртом Гёделем теорем о неполноте формальных систем, включающих арифметику, первая из которых была доказана в 1931 г. В связи с этим было высказано предположение о невозможности алгоритмического решения многих математических задач и возникла потребность в стандартизации понятия алгоритм. Первые стандартизованные варианты понятия алгоритм (модели алгоритмов) были разработаны в 30 -х годах XX века в работах Алана Тьюринга, Алонзо Чёрча, Эмиля Поста. Основываясь на работах Гёделя, Стивен Клини ввел понятие рекурсивной функции. Десятью годами позже Андрей Андреевич Марков ввел еще одну модель – нормальный алгоритм. Значительный вклад в теорию алгоритмов внесли Алексей Андреевич Ляпунов, Дональд Кнут, Альфред Ахо, Джеффри Ульман.

История возникновения теории алгоритмов Развитие теории алгоритмов начинается с доказательства Куртом Гёделем теорем о неполноте формальных систем, включающих арифметику, первая из которых была доказана в 1931 г. В связи с этим было высказано предположение о невозможности алгоритмического решения многих математических задач и возникла потребность в стандартизации понятия алгоритм. Первые стандартизованные варианты понятия алгоритм (модели алгоритмов) были разработаны в 30 -х годах XX века в работах Алана Тьюринга, Алонзо Чёрча, Эмиля Поста. Основываясь на работах Гёделя, Стивен Клини ввел понятие рекурсивной функции. Десятью годами позже Андрей Андреевич Марков ввел еще одну модель – нормальный алгоритм. Значительный вклад в теорию алгоритмов внесли Алексей Андреевич Ляпунов, Дональд Кнут, Альфред Ахо, Джеффри Ульман.

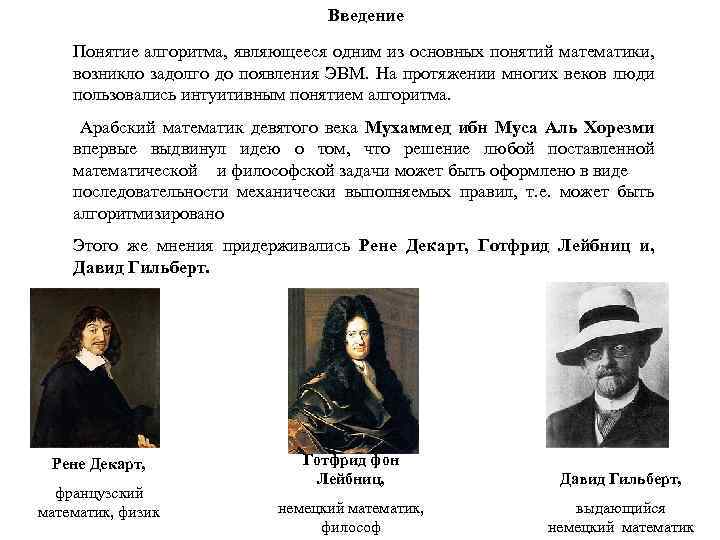

Введение Понятие алгоритма, являющееся одним из основных понятий математики, возникло задолго до появления ЭВМ. На протяжении многих веков люди пользовались интуитивным понятием алгоритма. Арабский математик девятого века Мухаммед ибн Муса Аль Хорезми впервые выдвинул идею о том, что решение любой поставленной математической и философской задачи может быть оформлено в виде последовательности механически выполняемых правил, т. е. может быть алгоритмизировано Этого же мнения придерживались Рене Декарт, Готфрид Лейбниц и, Давид Гильберт. Рене Декарт, французский математик, физик Готфрид фон Лейбниц, Давид Гильберт, немецкий математик, философ выдающийся немецкий математик

Введение Понятие алгоритма, являющееся одним из основных понятий математики, возникло задолго до появления ЭВМ. На протяжении многих веков люди пользовались интуитивным понятием алгоритма. Арабский математик девятого века Мухаммед ибн Муса Аль Хорезми впервые выдвинул идею о том, что решение любой поставленной математической и философской задачи может быть оформлено в виде последовательности механически выполняемых правил, т. е. может быть алгоритмизировано Этого же мнения придерживались Рене Декарт, Готфрид Лейбниц и, Давид Гильберт. Рене Декарт, французский математик, физик Готфрид фон Лейбниц, Давид Гильберт, немецкий математик, философ выдающийся немецкий математик

Определение понятия «алгоритм» Алгоритм – это конечный набор четких, недвусмысленных инструкций, следуя которым можно по входным данным определенного вида получать на выходе некоторый результат. Примеры. 1) Алгоритм сложения чисел в столбик. Если два натуральных числа в десятичной записи, то, следуя известному алгоритму, изучаемому в начальной школе, можно получить десятичную запись их суммы. 2) Алгоритмы построения циркулем и линейкой, изучаемые в средней школе. Например, алгоритм нахождения середины отрезка или алгоритм построения биссектрисы заданного угла. 3) Алгоритм решения квадратных уравнений. Подставляя в известную со школы формулу коэффициенты уравнения, можно вычислить количество его корней и сами корни (если они есть).

Определение понятия «алгоритм» Алгоритм – это конечный набор четких, недвусмысленных инструкций, следуя которым можно по входным данным определенного вида получать на выходе некоторый результат. Примеры. 1) Алгоритм сложения чисел в столбик. Если два натуральных числа в десятичной записи, то, следуя известному алгоритму, изучаемому в начальной школе, можно получить десятичную запись их суммы. 2) Алгоритмы построения циркулем и линейкой, изучаемые в средней школе. Например, алгоритм нахождения середины отрезка или алгоритм построения биссектрисы заданного угла. 3) Алгоритм решения квадратных уравнений. Подставляя в известную со школы формулу коэффициенты уравнения, можно вычислить количество его корней и сами корни (если они есть).

Математик и артиллерист Физик сказал мне, что полет тела в атмосфере подчиняется таким-то и таким-то законам. Дайте мне формулу, я подставлю в нее массу снаряда, начальную скорость, угол наклона ствола и определю куда попадет снаряд. Артиллерист Вынужден тебя огорчить, формулы не существует. Вот тебе алгоритм, иди к программисту, он напишет программу. Будешь вводить исходные данные и она будет вычислять координаты падения снаряда с некоторой точностью. Математик Дело сделано. А зачем мне нужен был математик? Ах да. Он дал мне алгоритм ! Программист

Математик и артиллерист Физик сказал мне, что полет тела в атмосфере подчиняется таким-то и таким-то законам. Дайте мне формулу, я подставлю в нее массу снаряда, начальную скорость, угол наклона ствола и определю куда попадет снаряд. Артиллерист Вынужден тебя огорчить, формулы не существует. Вот тебе алгоритм, иди к программисту, он напишет программу. Будешь вводить исходные данные и она будет вычислять координаты падения снаряда с некоторой точностью. Математик Дело сделано. А зачем мне нужен был математик? Ах да. Он дал мне алгоритм ! Программист

Алгоритмы и математика На ранних этапах своего развития математика была ничем иным, как набором алгоритмов «на все случаи жизни» . Сегодняшняя математика – это скорее набор теорем, а не набор алгоритмов. Для конечного потребителя «математического продукта» математика по- прежнему – набор алгоритмов. Алгоритмы – это «продукт» математики, как древней, так и современно, то, что она дает на выходе.

Алгоритмы и математика На ранних этапах своего развития математика была ничем иным, как набором алгоритмов «на все случаи жизни» . Сегодняшняя математика – это скорее набор теорем, а не набор алгоритмов. Для конечного потребителя «математического продукта» математика по- прежнему – набор алгоритмов. Алгоритмы – это «продукт» математики, как древней, так и современно, то, что она дает на выходе.

Алгоритмы и математика Математик сделал свое дело. Он сидел, погружаясь в абстракции, строил гипотезы, доказал пару теорем, а в результате выдал … алгоритм. Алгоритмы важны для математики. Они ее конечный продукт, оправдывающий присутствие этой науки во «внешнем мире» . Теоремы и леммы никому, кроме самих математиков , не нужны. Если бы еще и алгоритмы никого кроме математиков не интересовали, тот тогда математикой могли бы заниматься лишь обеспеченные люди, которые могут позволить себе эту роскошь. Ситуация намеренно упрощена. Математика – это язык науки. Значит алгоритмы – это язык математика и его нужно знать.

Алгоритмы и математика Математик сделал свое дело. Он сидел, погружаясь в абстракции, строил гипотезы, доказал пару теорем, а в результате выдал … алгоритм. Алгоритмы важны для математики. Они ее конечный продукт, оправдывающий присутствие этой науки во «внешнем мире» . Теоремы и леммы никому, кроме самих математиков , не нужны. Если бы еще и алгоритмы никого кроме математиков не интересовали, тот тогда математикой могли бы заниматься лишь обеспеченные люди, которые могут позволить себе эту роскошь. Ситуация намеренно упрощена. Математика – это язык науки. Значит алгоритмы – это язык математика и его нужно знать.

Математик и артиллерист (продолжение) Ничего не могу придумать. Задача очень сложная. Буду думать еще. Я тут провел исследования и доказал, что алгоритма для решения Вашей задачи не существует. Еще два варианта ответа математика артиллеристу.

Математик и артиллерист (продолжение) Ничего не могу придумать. Задача очень сложная. Буду думать еще. Я тут провел исследования и доказал, что алгоритма для решения Вашей задачи не существует. Еще два варианта ответа математика артиллеристу.

Неразрешимые математические задачи Известно множество примеров задач, для которых не существует алгоритма их решения. Бывают ситуации, когда алгоритм, возможно, и есть, но найти его экономически нецелесообразно (например, мало на это времени и средств). В первом случае задачи называют «неразрешимые задачи» . Во втором случае задачи трудноформализуемые задачи» . называют «слабоструктурированные,

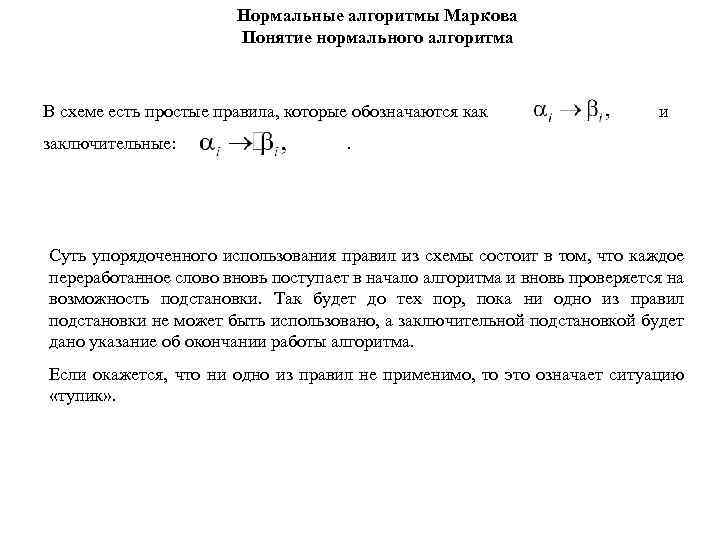

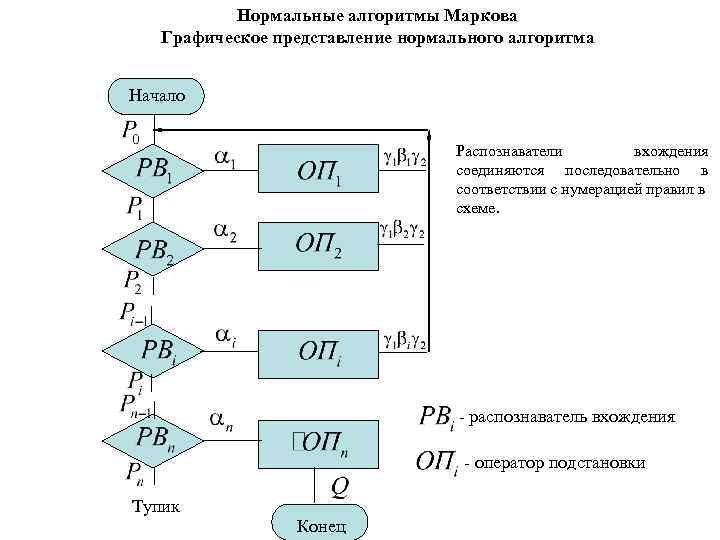

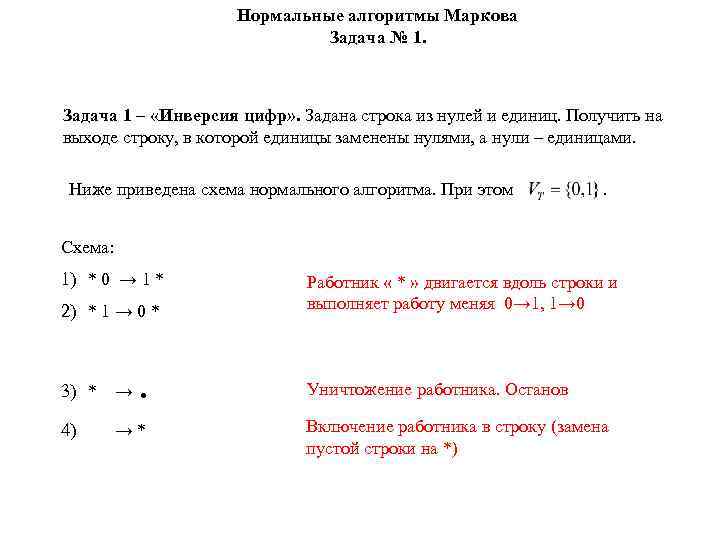

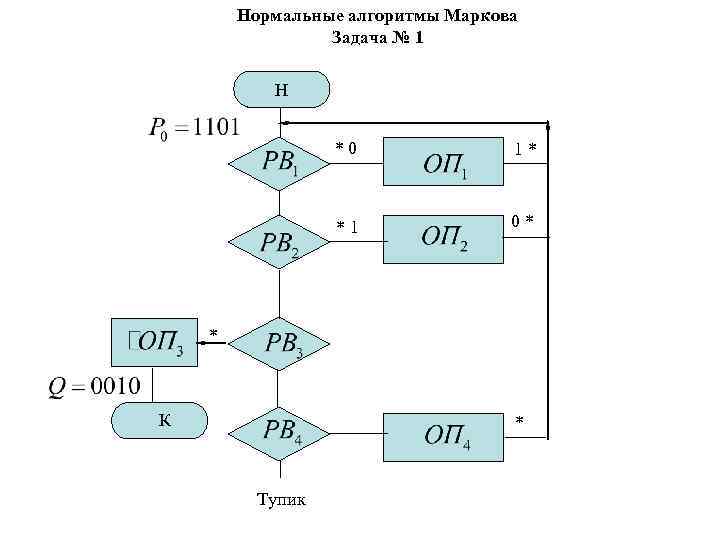

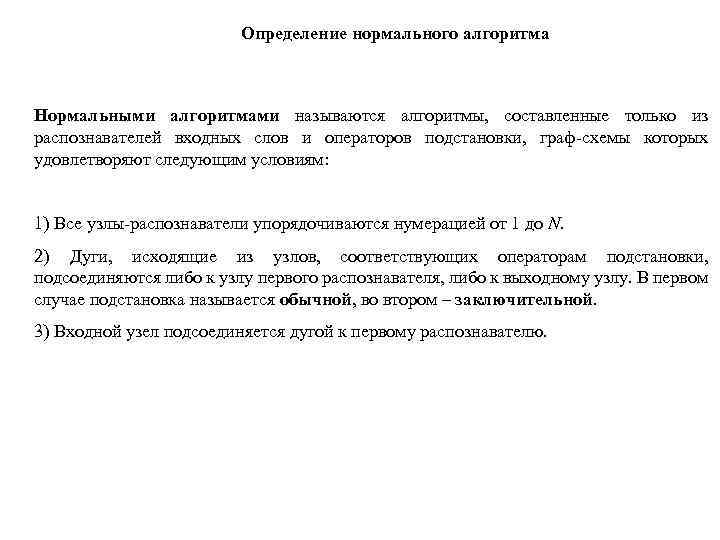

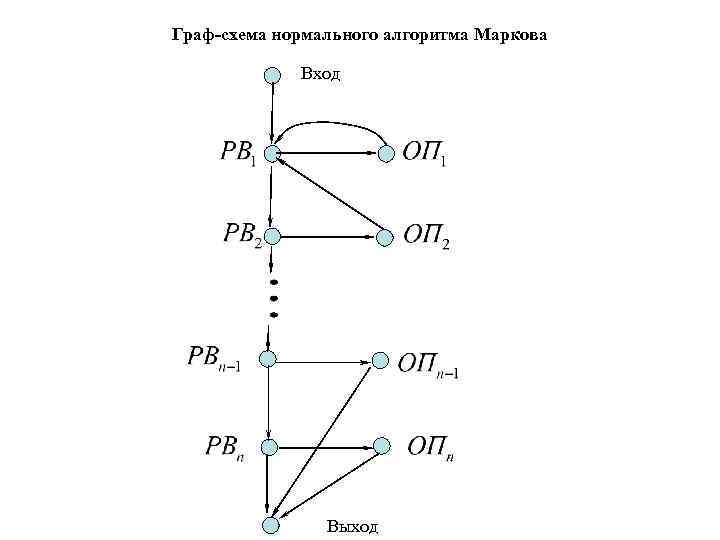

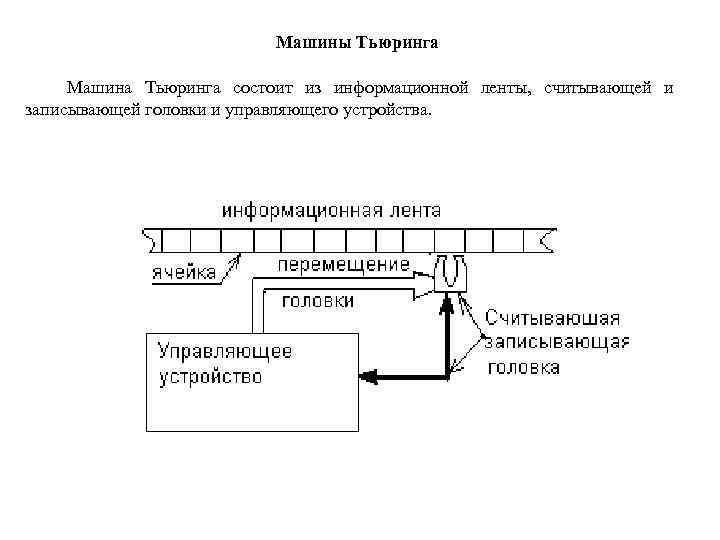

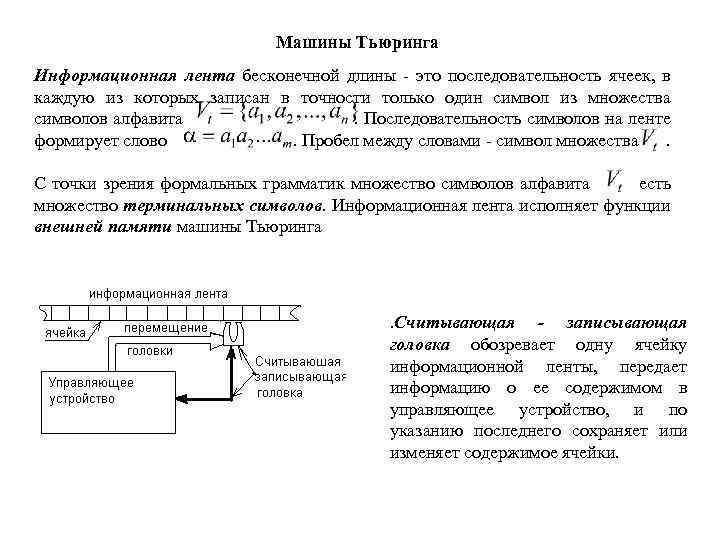

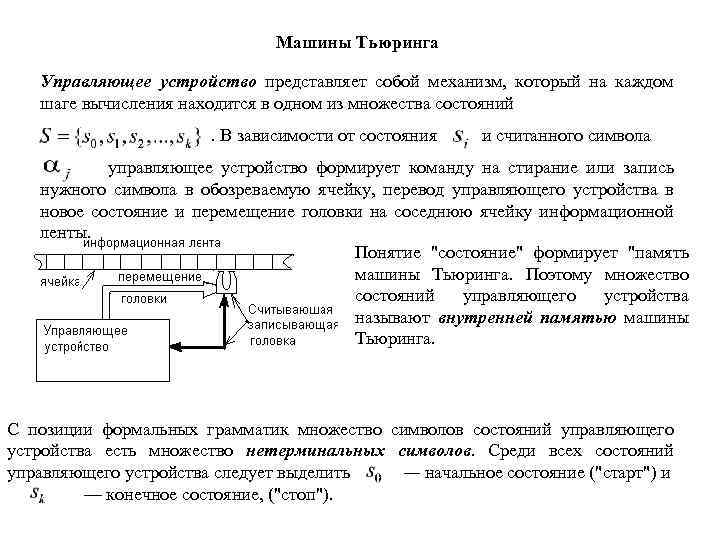

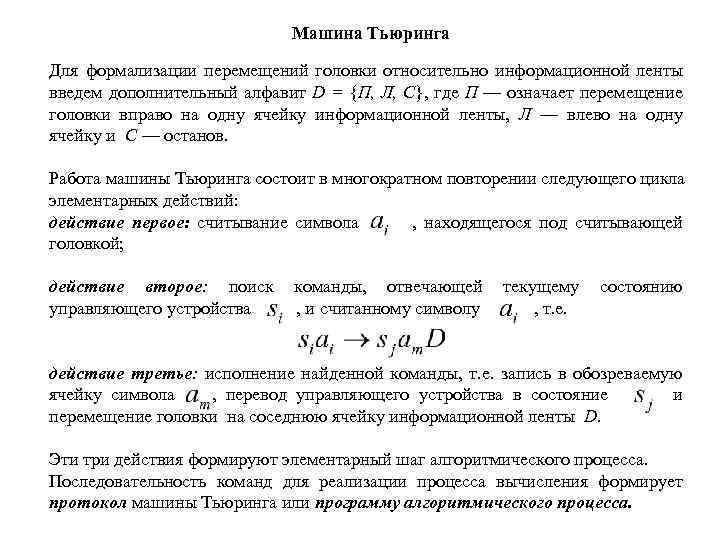

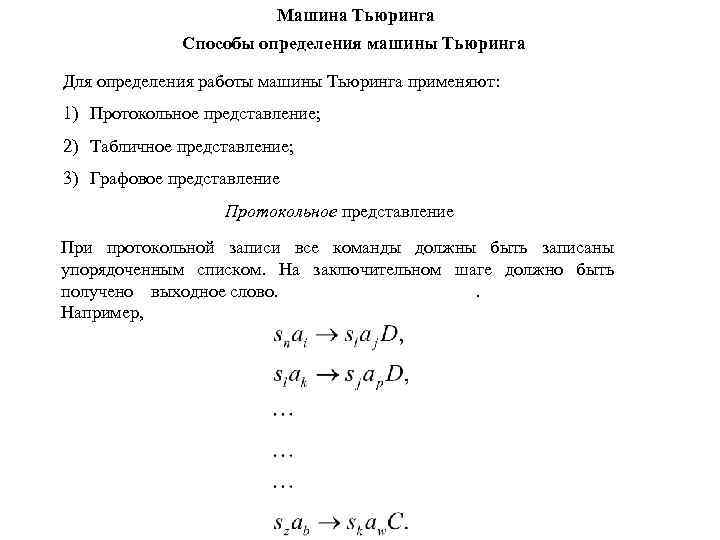

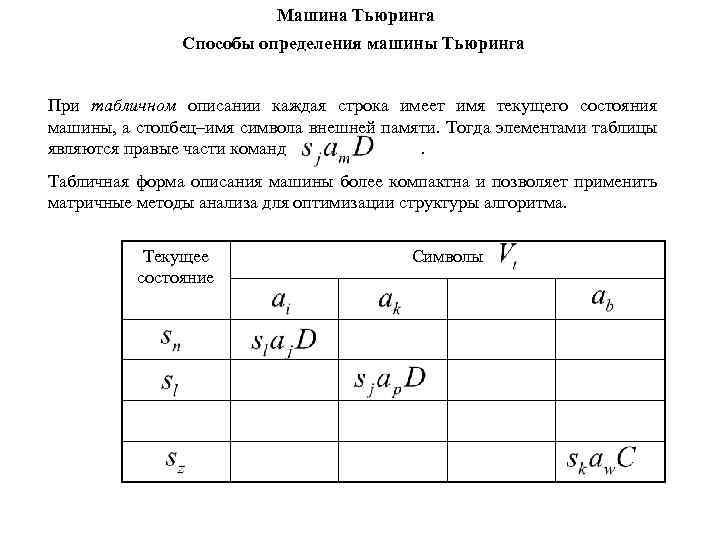

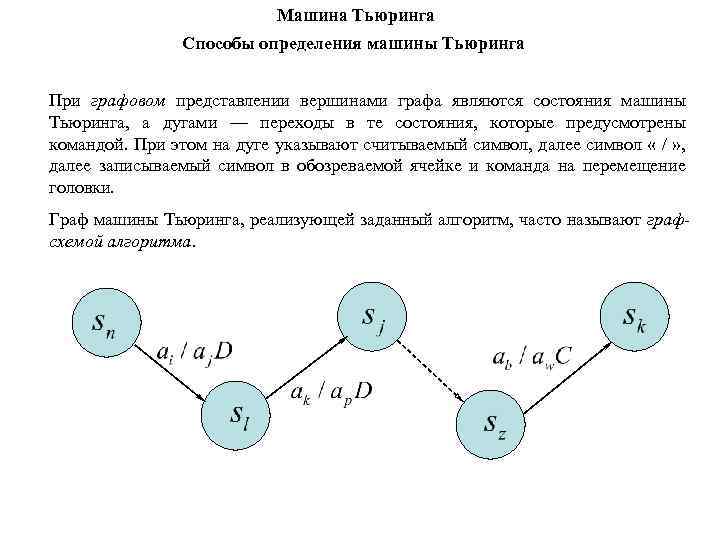

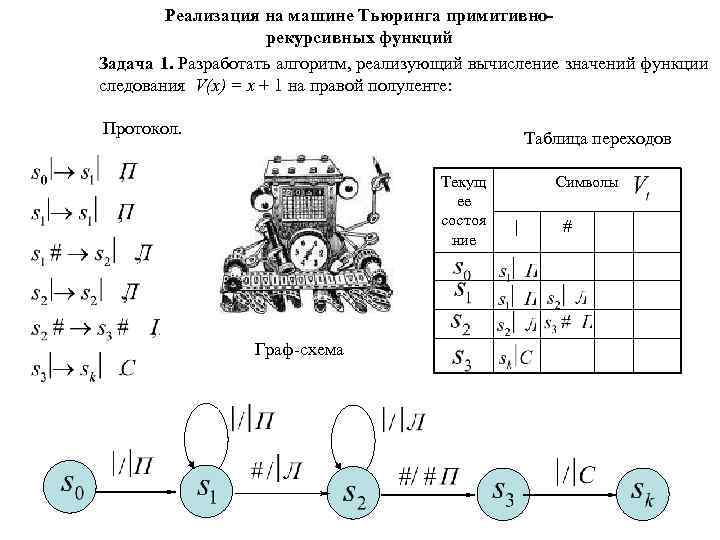

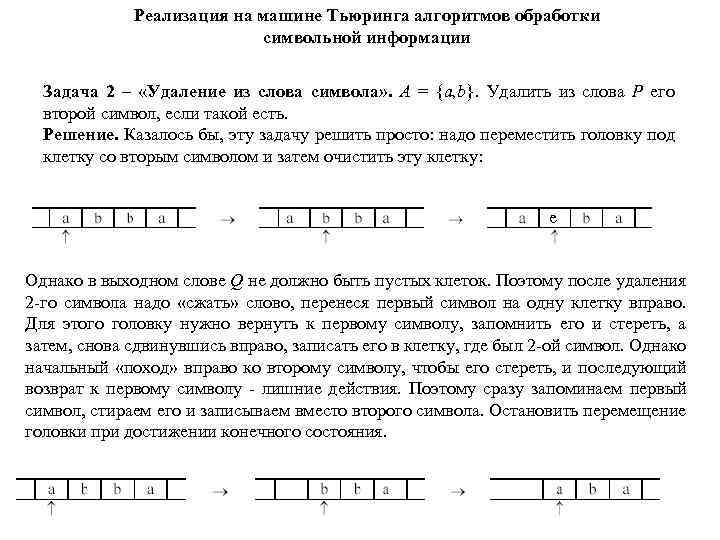

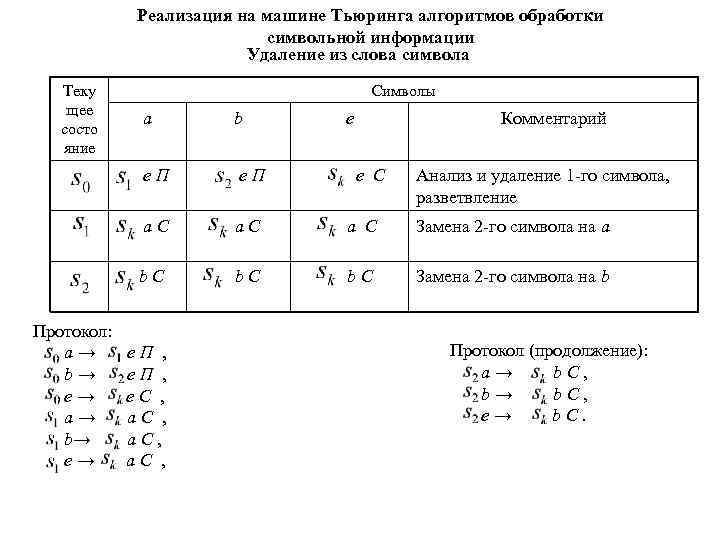

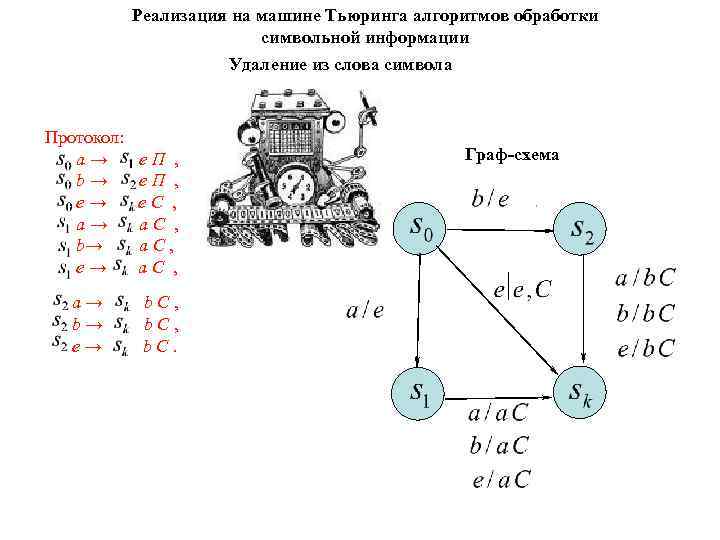

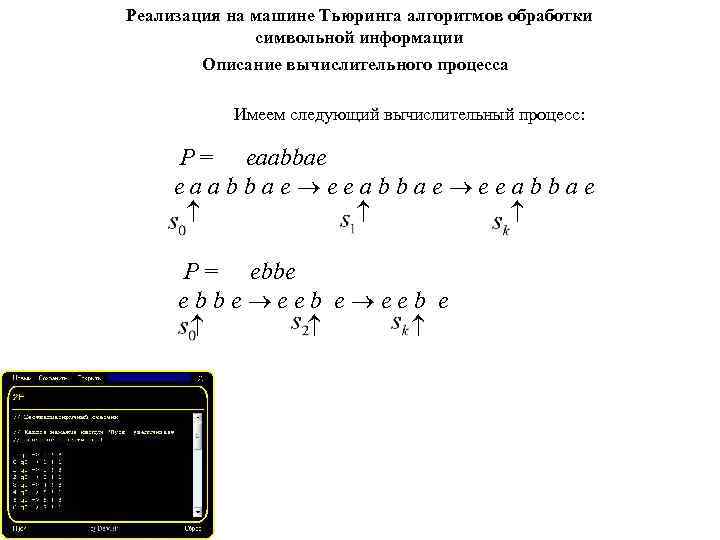

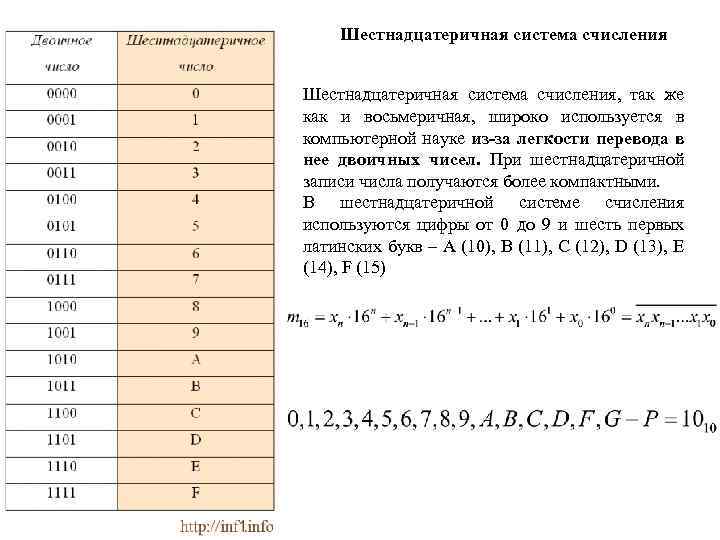

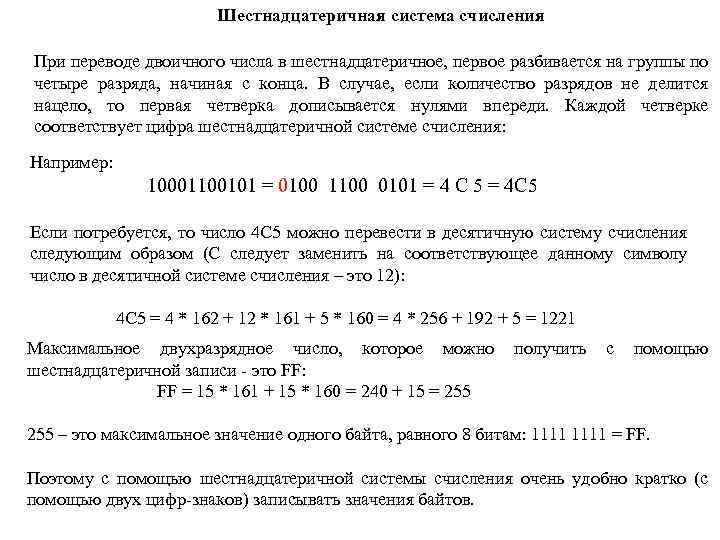

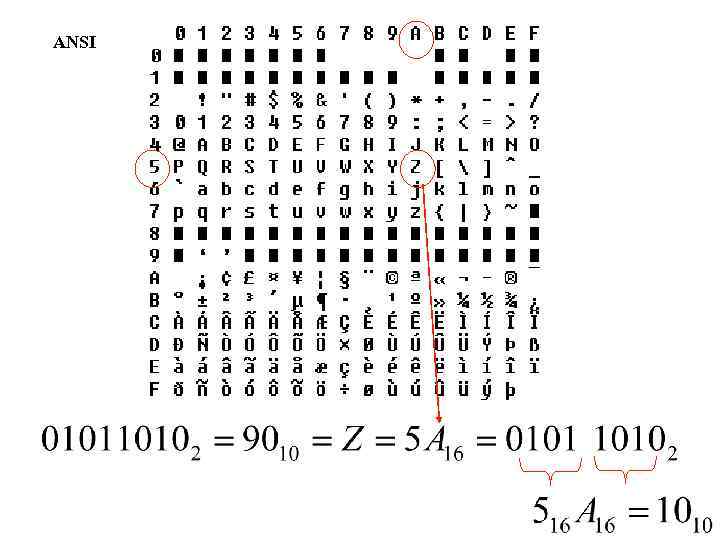

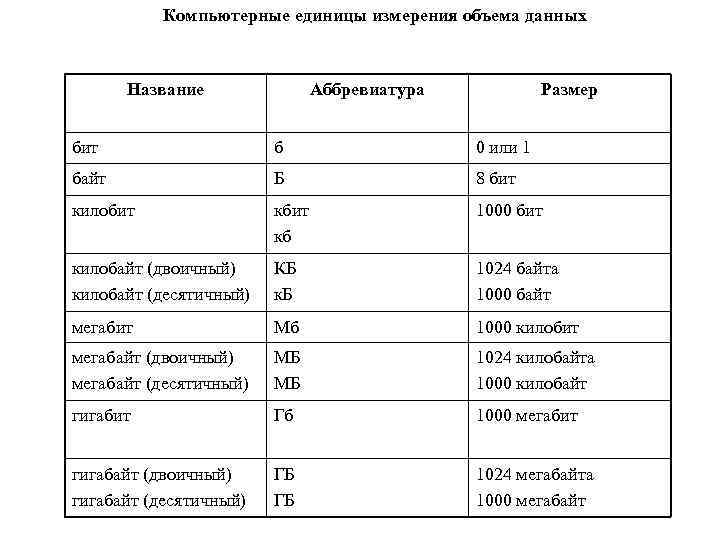

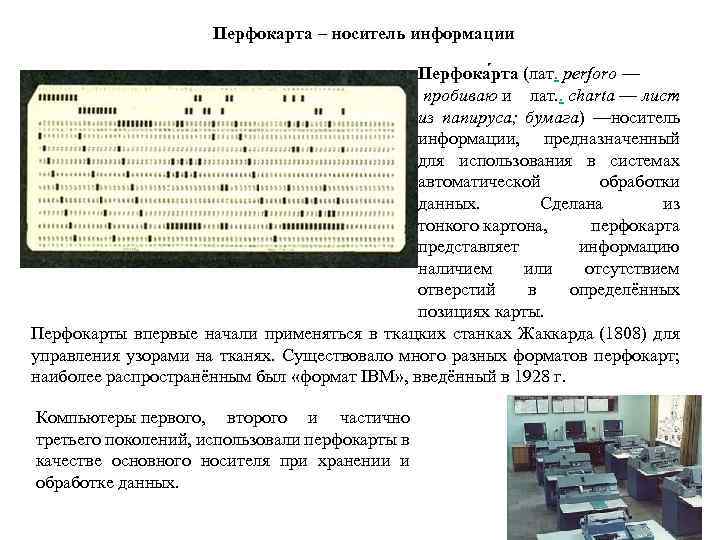

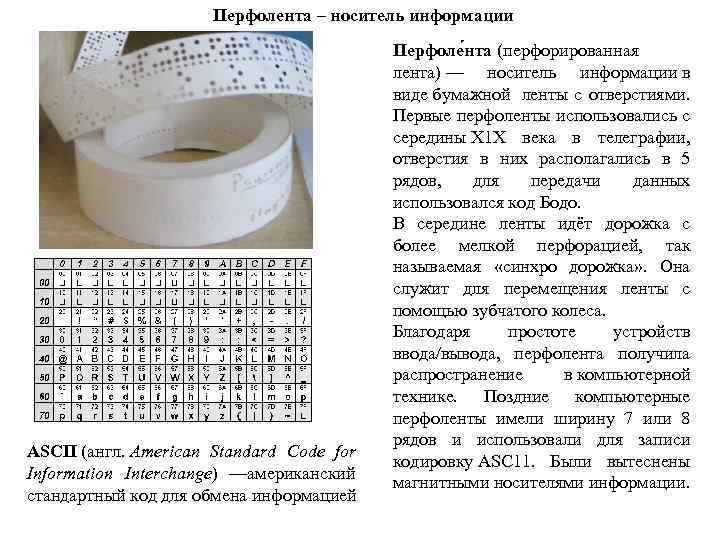

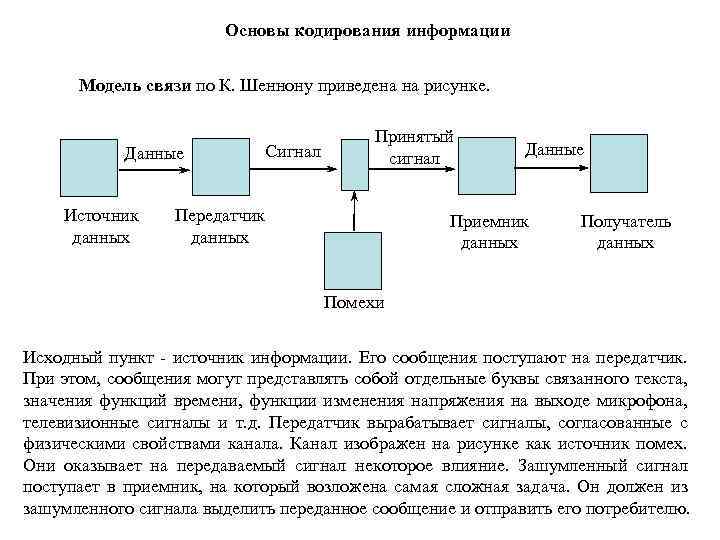

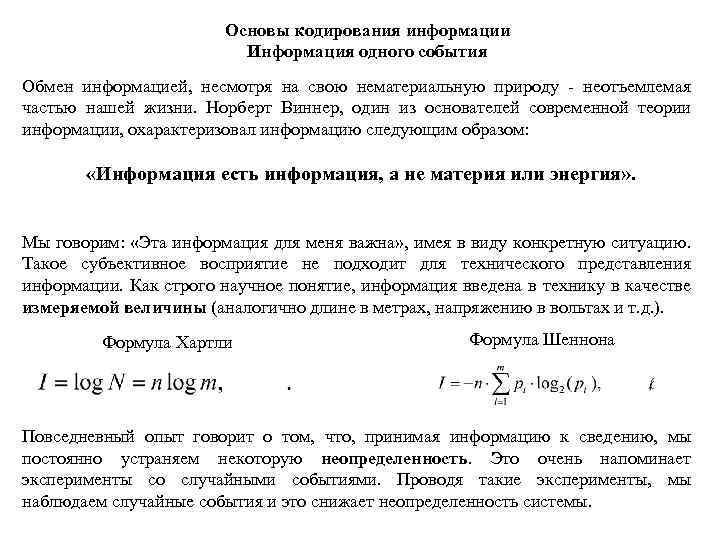

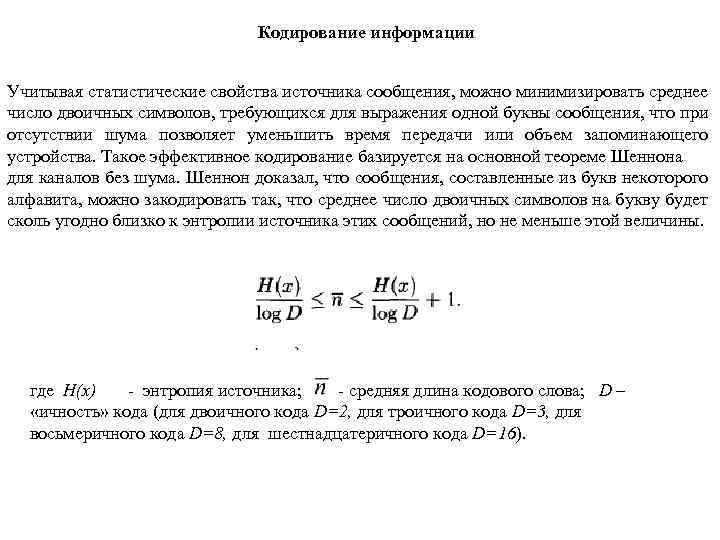

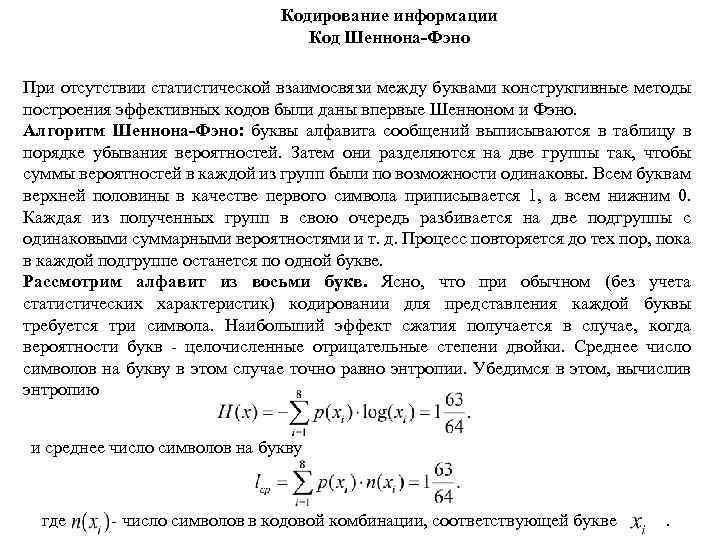

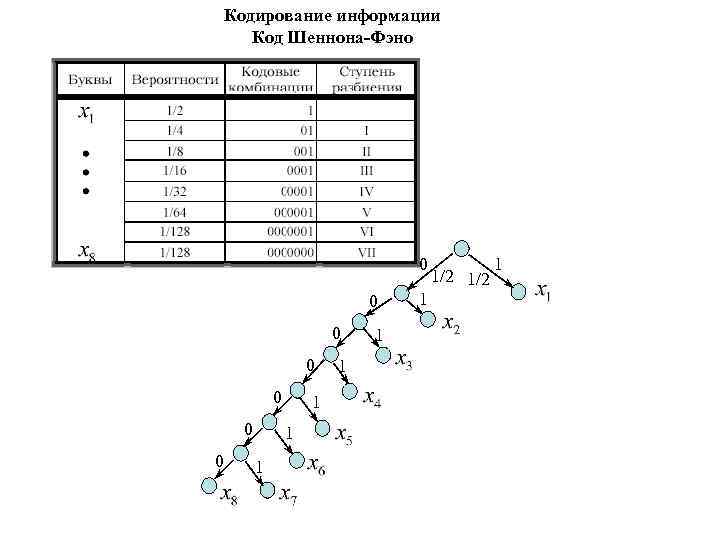

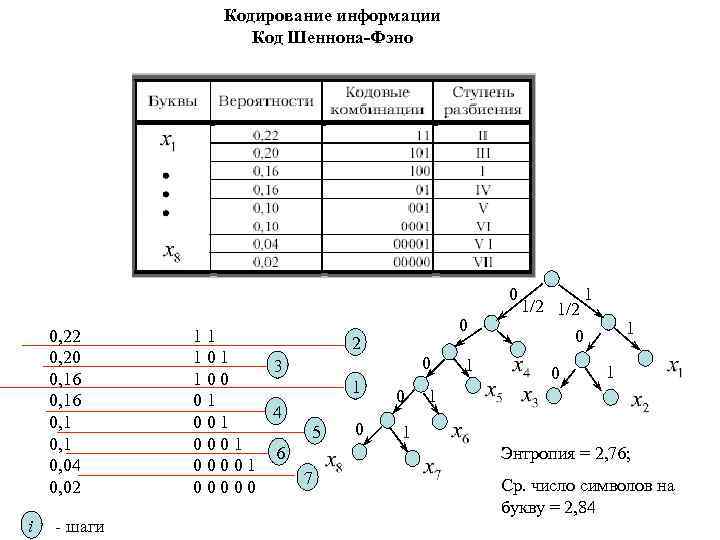

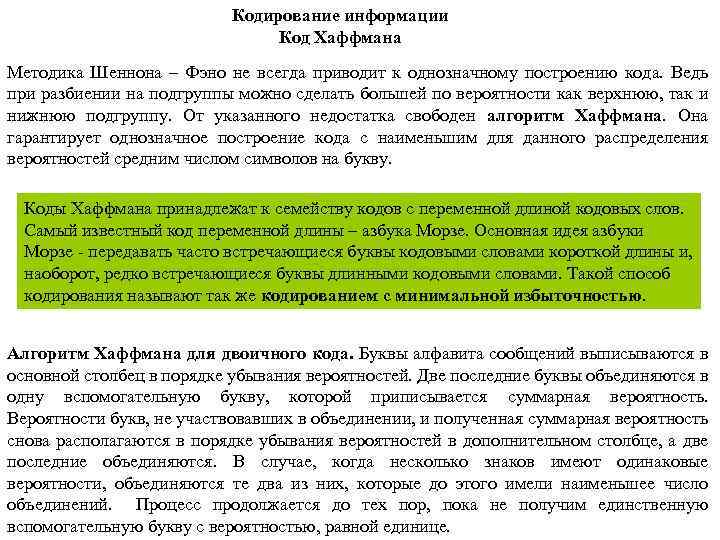

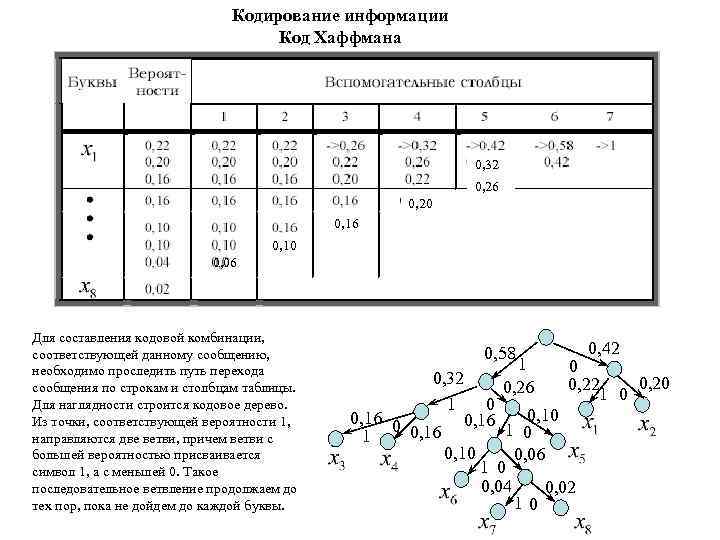

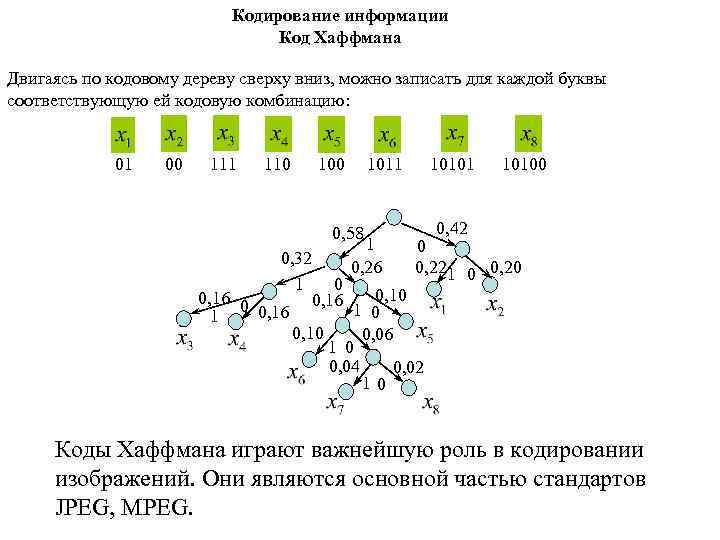

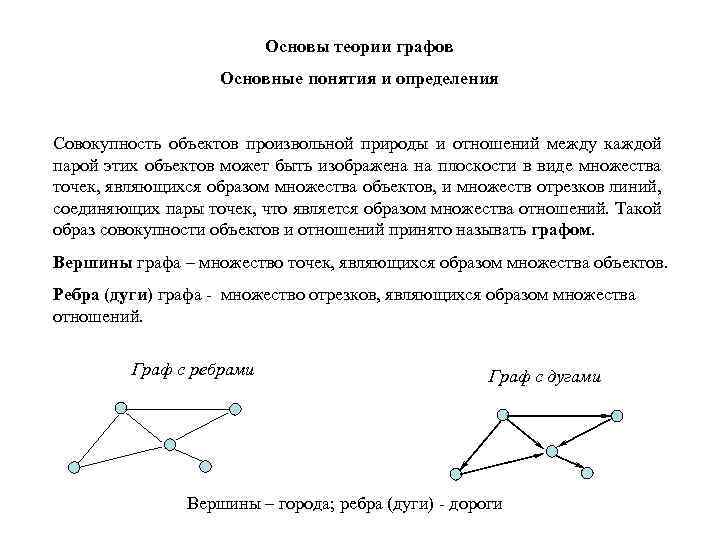

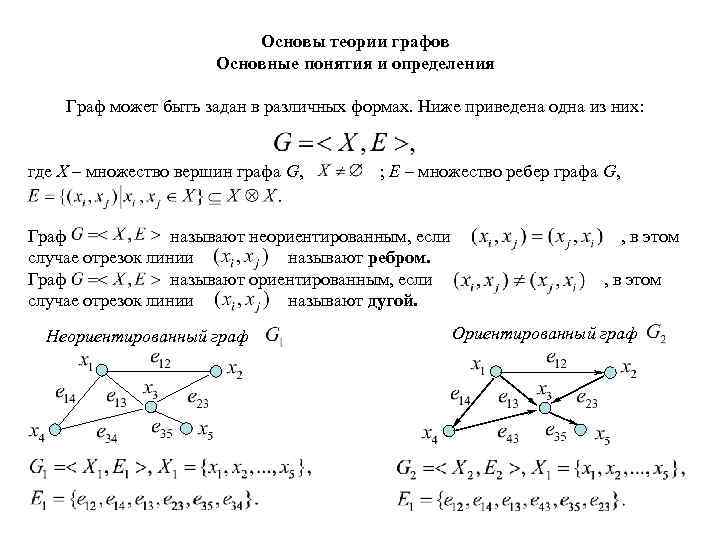

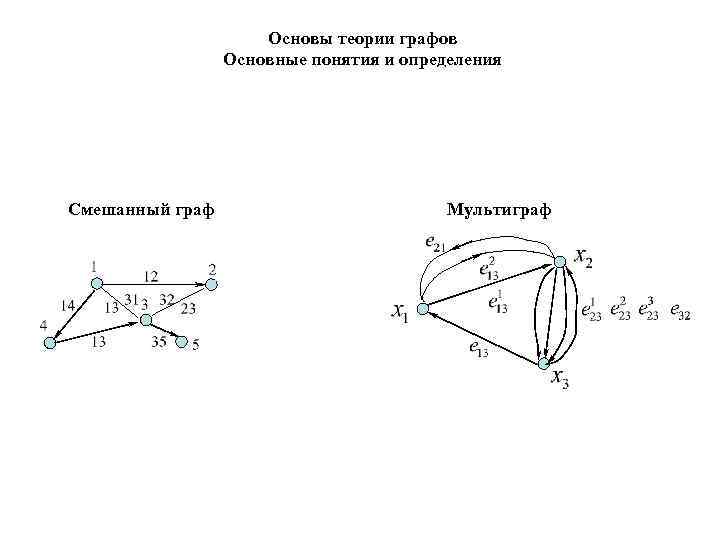

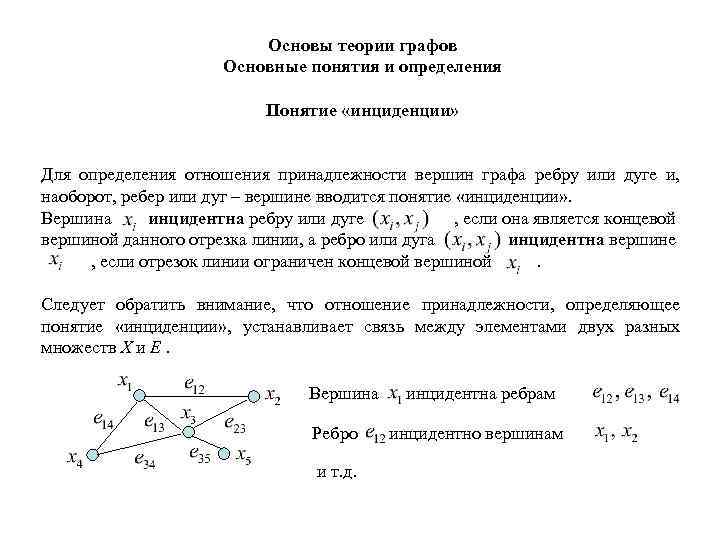

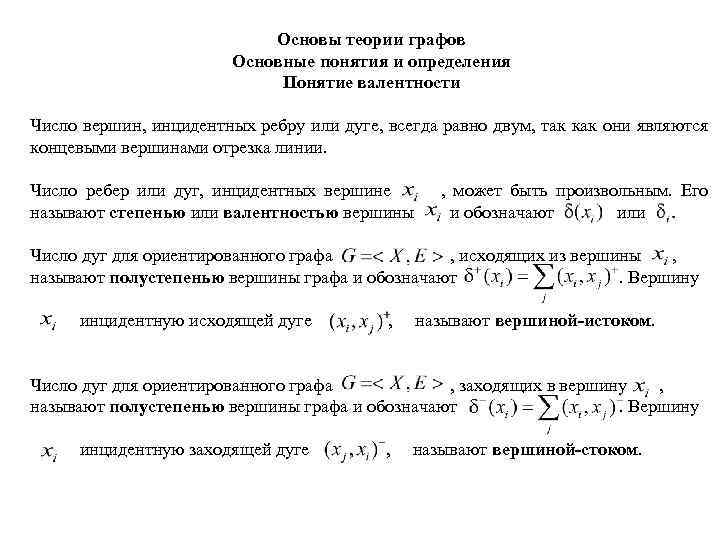

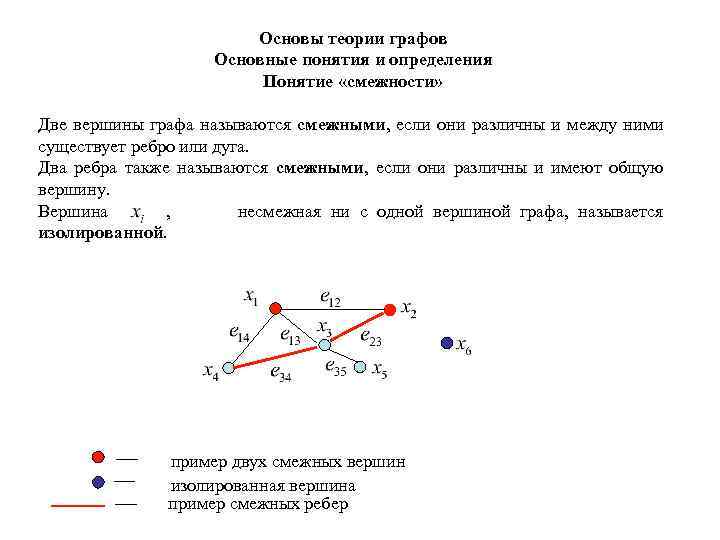

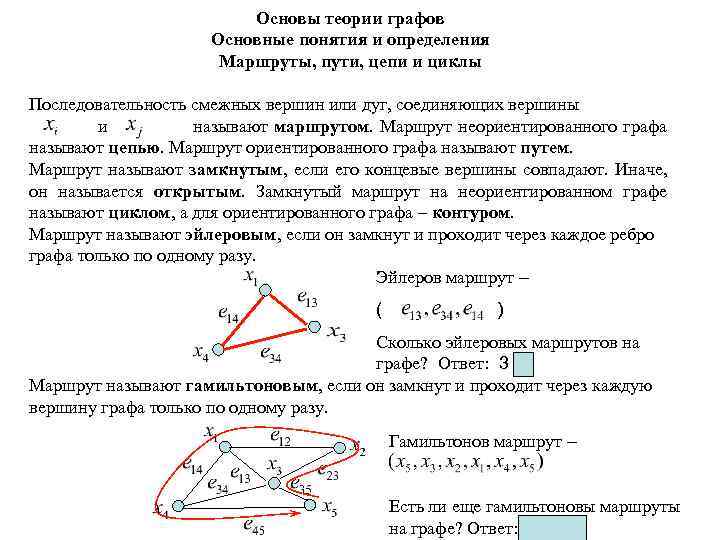

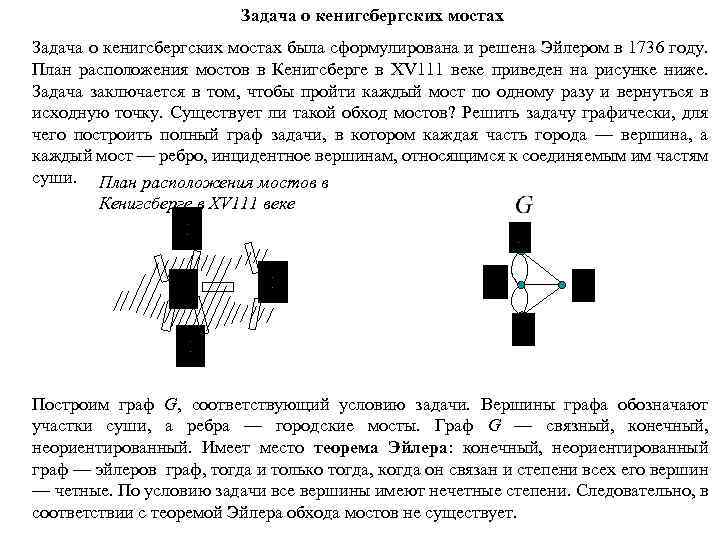

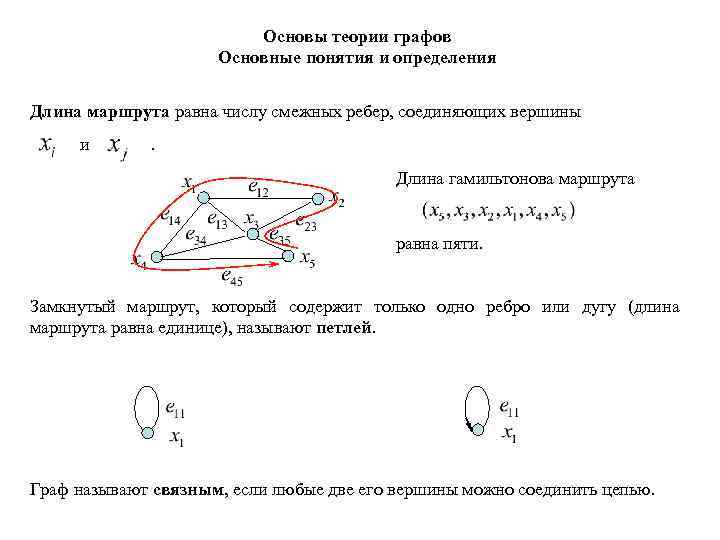

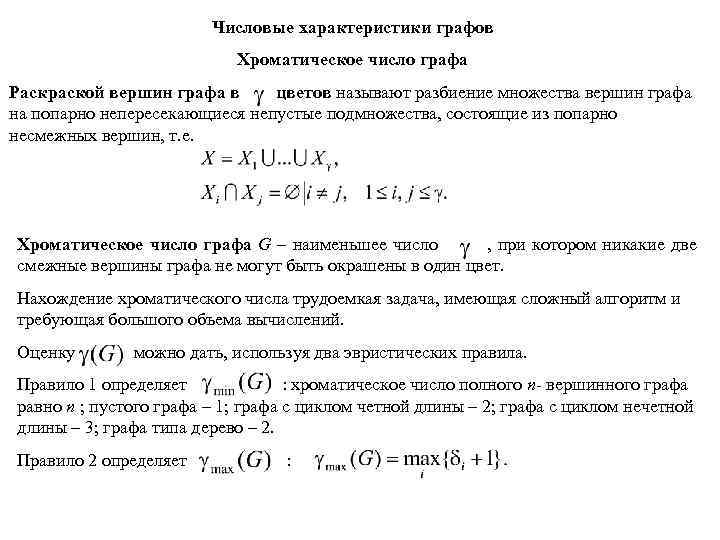

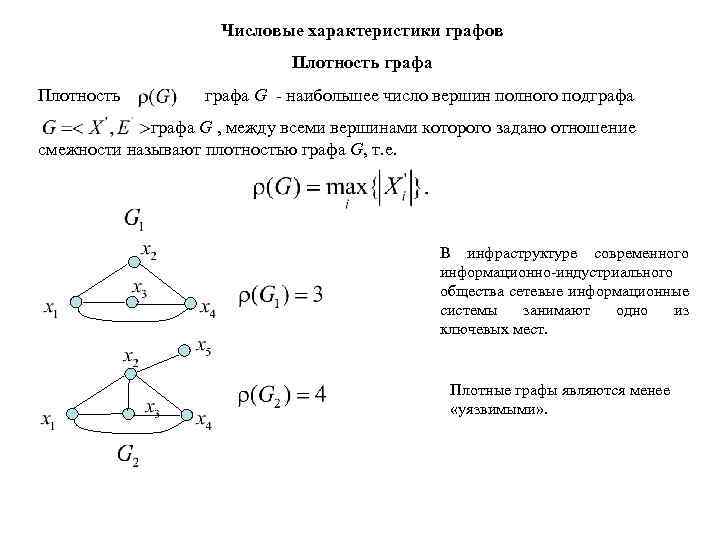

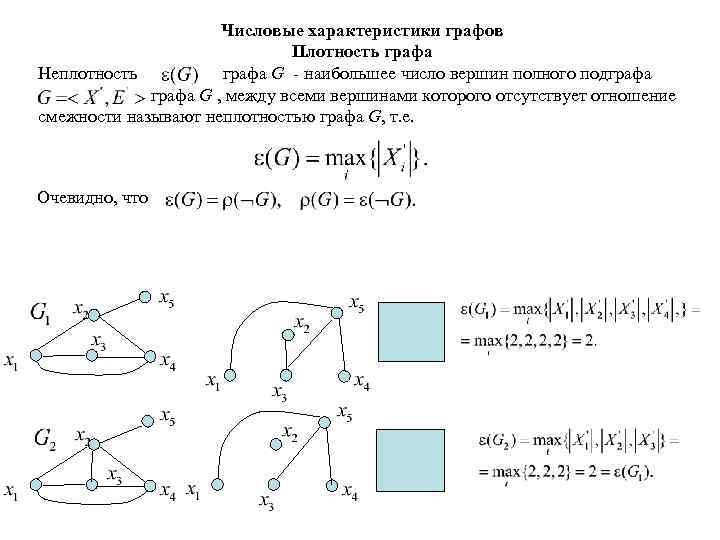

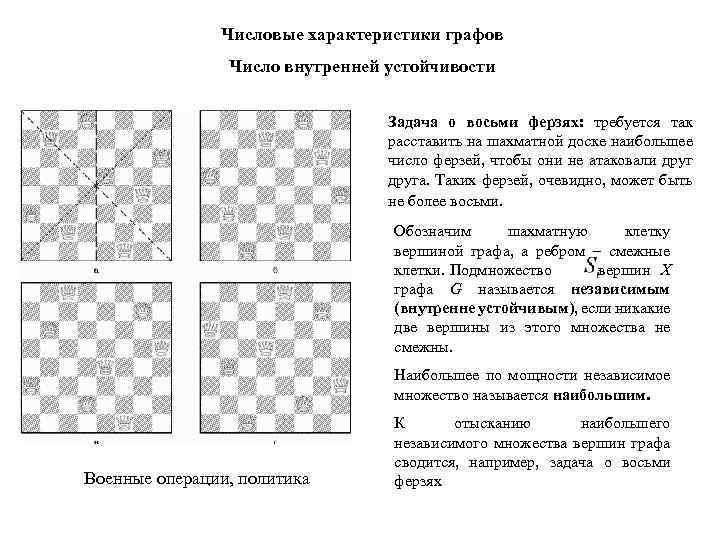

Неразрешимые математические задачи Известно множество примеров задач, для которых не существует алгоритма их решения. Бывают ситуации, когда алгоритм, возможно, и есть, но найти его экономически нецелесообразно (например, мало на это времени и средств). В первом случае задачи называют «неразрешимые задачи» . Во втором случае задачи трудноформализуемые задачи» . называют «слабоструктурированные,