ЭМ.ppt

- Количество слайдов: 18

Проверка исходных данных на мультиколлинеарность Одним из основных препятствий эффективного применения множественного регрессионного анализа является мультиколлинеарность. Она возникает в случаях существования достаточно тесных линейных статистических связей между объясняющими переменными X 1, X 2, X 3 , . Xk. В результате мультиколлинеарности матрица парных коэффициентов корреляции становится слабообусловленной, близкой к вырожденной.

Проверка исходных данных на мультиколлинеарность Одним из основных препятствий эффективного применения множественного регрессионного анализа является мультиколлинеарность. Она возникает в случаях существования достаточно тесных линейных статистических связей между объясняющими переменными X 1, X 2, X 3 , . Xk. В результате мультиколлинеарности матрица парных коэффициентов корреляции становится слабообусловленной, близкой к вырожденной.

На практике о наличии мультиколлинеарности обычно судят по матрице парных коэффициентов корреляции. Если один из элементов матрицы R больше 0, 8 , т. е. | rij | > 0, 8 , то считают, что имеет место мультиколлинеарность.

На практике о наличии мультиколлинеарности обычно судят по матрице парных коэффициентов корреляции. Если один из элементов матрицы R больше 0, 8 , т. е. | rij | > 0, 8 , то считают, что имеет место мультиколлинеарность.

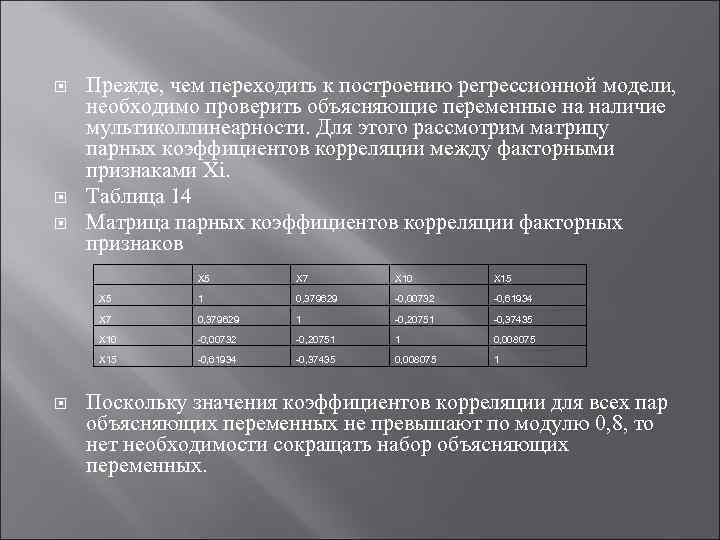

Прежде, чем переходить к построению регрессионной модели, необходимо проверить объясняющие переменные на наличие мультиколлинеарности. Для этого рассмотрим матрицу парных коэффициентов корреляции между факторными признаками Xi. Таблица 14 Матрица парных коэффициентов корреляции факторных признаков X 7 X 10 X 15 X 5 1 0, 379629 -0, 00732 -0, 61934 X 7 0, 379629 1 -0, 20751 -0, 37435 X 10 -0, 00732 -0, 20751 1 0, 008075 X 15 X 5 -0, 61934 -0, 37435 0, 008075 1 Поскольку значения коэффициентов корреляции для всех пар объясняющих переменных не превышают по модулю 0, 8, то нет необходимости сокращать набор объясняющих переменных.

Прежде, чем переходить к построению регрессионной модели, необходимо проверить объясняющие переменные на наличие мультиколлинеарности. Для этого рассмотрим матрицу парных коэффициентов корреляции между факторными признаками Xi. Таблица 14 Матрица парных коэффициентов корреляции факторных признаков X 7 X 10 X 15 X 5 1 0, 379629 -0, 00732 -0, 61934 X 7 0, 379629 1 -0, 20751 -0, 37435 X 10 -0, 00732 -0, 20751 1 0, 008075 X 15 X 5 -0, 61934 -0, 37435 0, 008075 1 Поскольку значения коэффициентов корреляции для всех пар объясняющих переменных не превышают по модулю 0, 8, то нет необходимости сокращать набор объясняющих переменных.

Но если бы в нашем случае имела место мультиколлинеарность?

Но если бы в нашем случае имела место мультиколлинеарность?

Метод главных компонент применяется для исключения или уменьшения мультиколлинеарности объясняющих переменных регрессии. Основная идея заключается в сокращении числа объясняющих переменных до наиболее существенно влияющих факторов.

Метод главных компонент применяется для исключения или уменьшения мультиколлинеарности объясняющих переменных регрессии. Основная идея заключается в сокращении числа объясняющих переменных до наиболее существенно влияющих факторов.

Это достигается путем линейного преобразования всех объясняющих переменных в новые переменные, так называемые, главные компоненты.

Это достигается путем линейного преобразования всех объясняющих переменных в новые переменные, так называемые, главные компоненты.

При этом требуется, чтобы выделению первой главной компоненты соответствовал максимум общей дисперсии всех объясняющих переменных Второй компоненте — максимум оставшейся дисперсии, после того как влияние первой главной компоненты исключается

При этом требуется, чтобы выделению первой главной компоненты соответствовал максимум общей дисперсии всех объясняющих переменных Второй компоненте — максимум оставшейся дисперсии, после того как влияние первой главной компоненты исключается

Процедура вычислений по методу главных компонент состоит из следующих шагов: 1. Строится матрица, элементами которой являются отклонения результатов наблюдений над n переменными от соответствующих средних

Процедура вычислений по методу главных компонент состоит из следующих шагов: 1. Строится матрица, элементами которой являются отклонения результатов наблюдений над n переменными от соответствующих средних

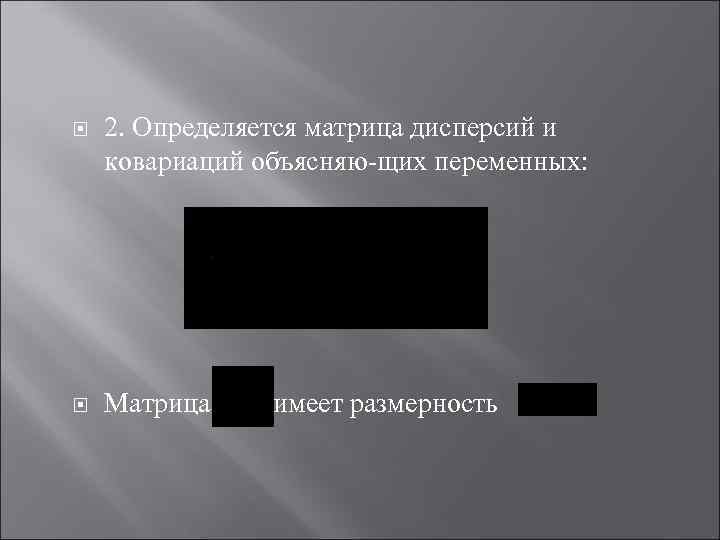

2. Определяется матрица дисперсий и ковариаций объясняю щих переменных: Матрица имеет размерность

2. Определяется матрица дисперсий и ковариаций объясняю щих переменных: Матрица имеет размерность

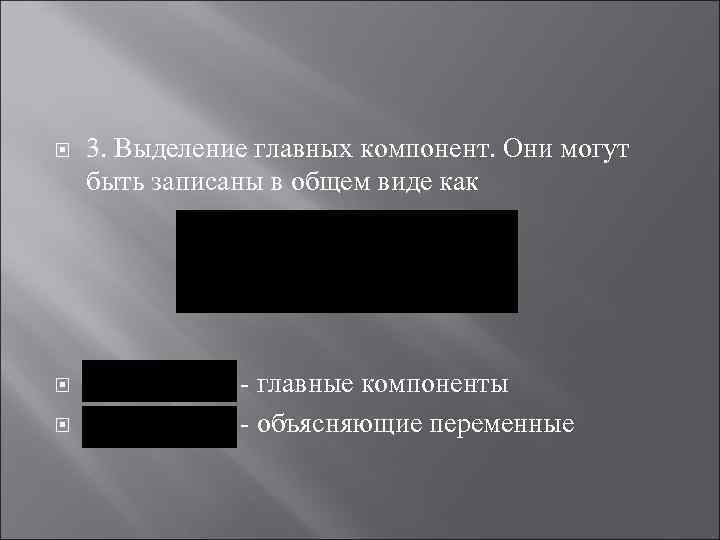

3. Выделение главных компонент. Они могут быть записаны в общем виде как главные компоненты объясняющие переменные

3. Выделение главных компонент. Они могут быть записаны в общем виде как главные компоненты объясняющие переменные

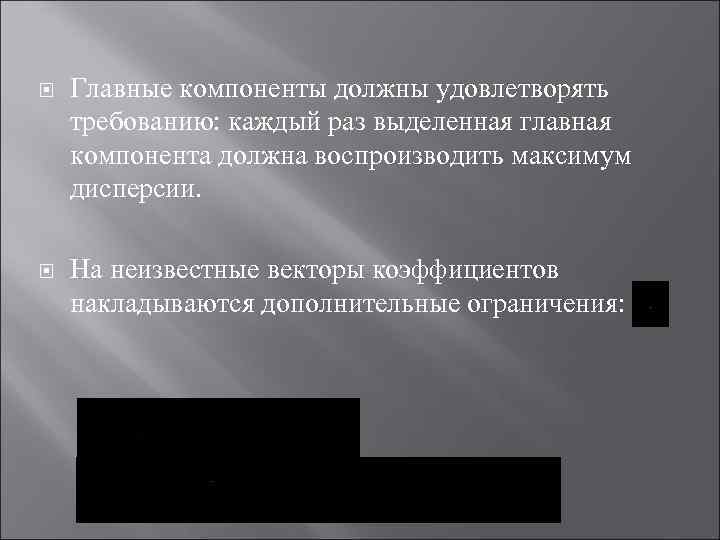

Главные компоненты должны удовлетворять требованию: каждый раз выделенная главная компонента должна воспроизводить максимум дисперсии. На неизвестные векторы коэффициентов накладываются дополнительные ограничения:

Главные компоненты должны удовлетворять требованию: каждый раз выделенная главная компонента должна воспроизводить максимум дисперсии. На неизвестные векторы коэффициентов накладываются дополнительные ограничения:

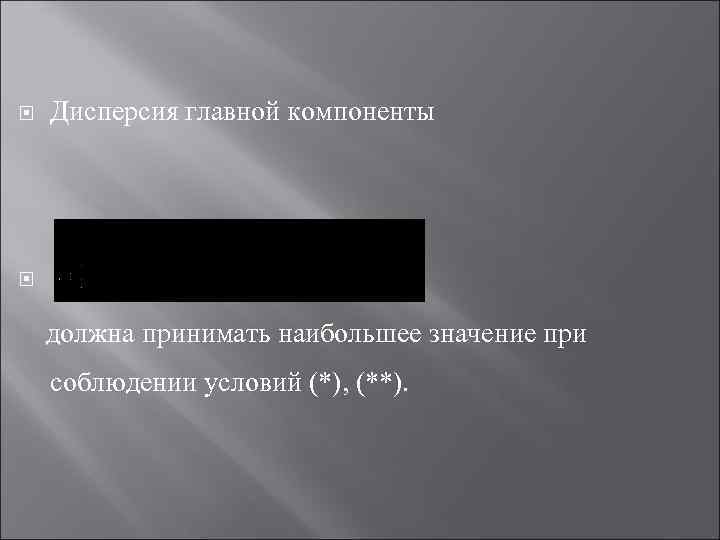

Дисперсия главной компоненты должна принимать наибольшее значение при соблюдении условий (*), (**).

Дисперсия главной компоненты должна принимать наибольшее значение при соблюдении условий (*), (**).

4. Определяются собственные значения матрицы и соответствующие собственные вектора

4. Определяются собственные значения матрицы и соответствующие собственные вектора

По мере выделения главных компонент доля общей дисперсии становится все меньше и меньше. Процедуру вычисления главных компонент прекращают в тот момент, когда собственные значения, соответствующие каждый раз наибольшим дисперсиям, становятся пренебрежимо малыми.

По мере выделения главных компонент доля общей дисперсии становится все меньше и меньше. Процедуру вычисления главных компонент прекращают в тот момент, когда собственные значения, соответствующие каждый раз наибольшим дисперсиям, становятся пренебрежимо малыми.

С помощью главных компонент оцениваются параметры регрессии и вычисляются значения регрессии

С помощью главных компонент оцениваются параметры регрессии и вычисляются значения регрессии

Недостатки метода главных компонент: главным компонентам, как правило, трудно подобрать экономические аналоги. оценки параметров регрессии получают не по исходным объясняющим переменным, а по главным компонентам

Недостатки метода главных компонент: главным компонентам, как правило, трудно подобрать экономические аналоги. оценки параметров регрессии получают не по исходным объясняющим переменным, а по главным компонентам

Вывод: Метод главных компонент применяется в основном для оценки значений регрессии и для определения прогнозных значений зависимой переменной, что также является целью регрессионного анализа.

Вывод: Метод главных компонент применяется в основном для оценки значений регрессии и для определения прогнозных значений зависимой переменной, что также является целью регрессионного анализа.