Классификатор Байеса.ppt

- Количество слайдов: 7

Поняття класифікації 1 Задача класифікації – з’ясувати до якого з відомих класів відноситься об’єкт Х, тобто – по значеннях незалежних змінних хі Х (атрибутів об ’єкта) визначити значення залежної змінної С (мітки класу): С=f(хі) Процедура класифікації складається з двох етапів: (1) Побудова моделі опису попередньо визначених (2) Застосування моделі до класів - навчання (на прикладах) з вчителем аналізованих об ’єктів Геометрична інтерпретація результатів класифікації: Основні проблеми задач класифікації: незадовільна якість вхідних даних; різна значущість атрибутів; проблеми overfitting (надчутливості) і underfitting (поганої чутливості). Існує велика кількість методів і алгоритмів класифікації для різних проблемних областей. Їх поділяють на статистичні (регресія, байєсівськf класифікація та ін. ) і і методи машинного навчання (дерева рішень, правила рішення, нейронні мережі, метод kнайближчих сусідів та ін).

Поняття класифікації 1 Задача класифікації – з’ясувати до якого з відомих класів відноситься об’єкт Х, тобто – по значеннях незалежних змінних хі Х (атрибутів об ’єкта) визначити значення залежної змінної С (мітки класу): С=f(хі) Процедура класифікації складається з двох етапів: (1) Побудова моделі опису попередньо визначених (2) Застосування моделі до класів - навчання (на прикладах) з вчителем аналізованих об ’єктів Геометрична інтерпретація результатів класифікації: Основні проблеми задач класифікації: незадовільна якість вхідних даних; різна значущість атрибутів; проблеми overfitting (надчутливості) і underfitting (поганої чутливості). Існує велика кількість методів і алгоритмів класифікації для різних проблемних областей. Їх поділяють на статистичні (регресія, байєсівськf класифікація та ін. ) і і методи машинного навчання (дерева рішень, правила рішення, нейронні мережі, метод kнайближчих сусідів та ін).

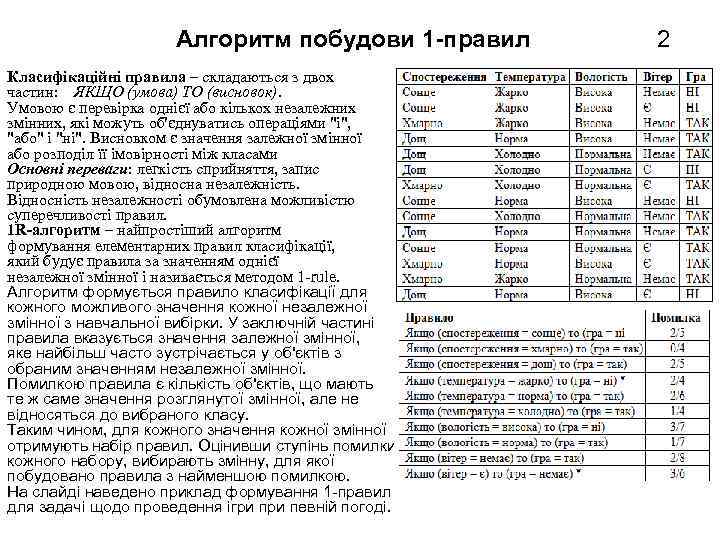

Алгоритм побудови 1 -правил Класифікаційні правила – складаються з двох частин: ЯКЩО (умова) ТО (висновок). Умовою є перевірка однієї або кількох незалежних змінних, які можуть об'єднуватись операціями "і", "або" і "ні". Висновком є значення залежної змінної або розподіл її імовірності між класами Основні переваги: легкість сприйняття, запис природною мовою, відносна незалежність. Відносність незалежності обумовлена можливістю суперечливості правил. 1 R-алгоритм – найпростіший алгоритм формування елементарних правил класифікації, який будує правила за значенням однієї незалежної змінної і називається методом 1 -rule. Алгоритм формується правило класифікації для кожного можливого значення кожної незалежної змінної з навчальної вибірки. У заключній частині правила вказується значення залежної змінної, яке найбільш часто зустрічається у об'єктів з обраним значенням незалежної змінної. Помилкою правила є кількість об'єктів, що мають те ж саме значення розглянутої змінної, але не відносяться до вибраного класу. Таким чином, для кожного значення кожної змінної отримують набір правил. Оцінивши ступінь помилки кожного набору, вибирають змінну, для якої побудовано правила з найменшою помилкою. На слайді наведено приклад формування 1 -правил для задачі щодо проведення ігри певній погоді. 2

Алгоритм побудови 1 -правил Класифікаційні правила – складаються з двох частин: ЯКЩО (умова) ТО (висновок). Умовою є перевірка однієї або кількох незалежних змінних, які можуть об'єднуватись операціями "і", "або" і "ні". Висновком є значення залежної змінної або розподіл її імовірності між класами Основні переваги: легкість сприйняття, запис природною мовою, відносна незалежність. Відносність незалежності обумовлена можливістю суперечливості правил. 1 R-алгоритм – найпростіший алгоритм формування елементарних правил класифікації, який будує правила за значенням однієї незалежної змінної і називається методом 1 -rule. Алгоритм формується правило класифікації для кожного можливого значення кожної незалежної змінної з навчальної вибірки. У заключній частині правила вказується значення залежної змінної, яке найбільш часто зустрічається у об'єктів з обраним значенням незалежної змінної. Помилкою правила є кількість об'єктів, що мають те ж саме значення розглянутої змінної, але не відносяться до вибраного класу. Таким чином, для кожного значення кожної змінної отримують набір правил. Оцінивши ступінь помилки кожного набору, вибирають змінну, для якої побудовано правила з найменшою помилкою. На слайді наведено приклад формування 1 -правил для задачі щодо проведення ігри певній погоді. 2

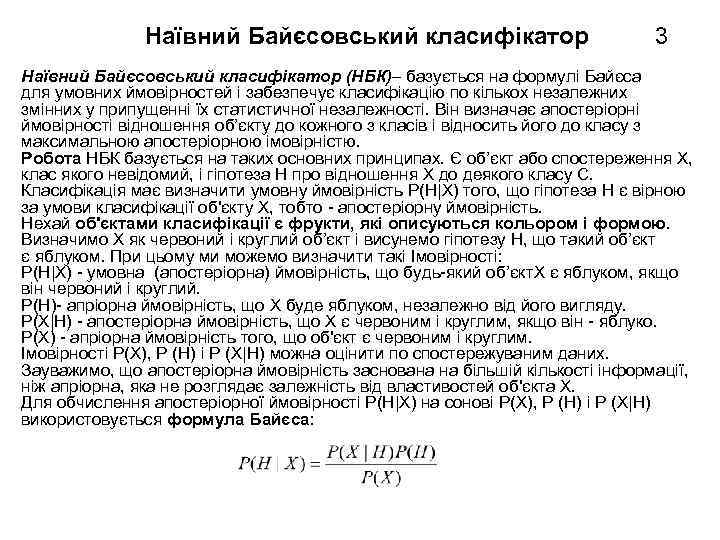

Наївний Байєсовський класифікатор 3 Наївний Байєсовський класифікатор (НБК)– базується на формулі Байєса для умовних ймовірностей і забезпечує класифікацію по кількох незалежних змінних у припущенні їх статистичної незалежності. Він визначає апостеріорні ймовірності відношення об’єкту до кожного з класів і відносить його до класу з максимальною апостеріорною імовірністю. Робота НБК базується на таких основних принципах. Є об’єкт або спостереження X, клас якого невідомий, і гіпотеза Н про відношення X до деякого класу С. Класифікація має визначити умовну ймовірність Р(Н|Х) того, що гіпотеза Н є вірною за умови класифікації об'єкту X, тобто - апостеріорну ймовірність. Нехай об'єктами класифікації є фрукти, які описуються кольором і формою. Визначимо X як червоний і круглий об’єкт і висунемо гіпотезу Н, що такий об’єкт є яблуком. При цьому ми можемо визначити такі Імовірності: Р(Н|X) - умовна (апостеріорна) ймовірність, що будь-який об’єкт. X є яблуком, якщо він червоний і круглий. Р(Н)- апріорна ймовірність, що Х буде яблуком, незалежно від його вигляду. Р(Х|Н) - апостеріорна ймовірність, що X є червоним і круглим, якщо він - яблуко. Р(Х) - апріорна ймовірність того, що об'єкт є червоним і круглим. Імовірності Р(Х), Р (Н) і Р (Х|Н) можна оцінити по спостережуваним даних. Зауважимо, що апостеріорна ймовірність заснована на більшій кількості інформації, ніж апріорна, яка не розглядає залежність від властивостей об'єкта X. Для обчислення апостеріорної ймовірності Р(Н|X) на сонові Р(Х), Р (Н) і Р (Х|Н) використовується формула Байєса:

Наївний Байєсовський класифікатор 3 Наївний Байєсовський класифікатор (НБК)– базується на формулі Байєса для умовних ймовірностей і забезпечує класифікацію по кількох незалежних змінних у припущенні їх статистичної незалежності. Він визначає апостеріорні ймовірності відношення об’єкту до кожного з класів і відносить його до класу з максимальною апостеріорною імовірністю. Робота НБК базується на таких основних принципах. Є об’єкт або спостереження X, клас якого невідомий, і гіпотеза Н про відношення X до деякого класу С. Класифікація має визначити умовну ймовірність Р(Н|Х) того, що гіпотеза Н є вірною за умови класифікації об'єкту X, тобто - апостеріорну ймовірність. Нехай об'єктами класифікації є фрукти, які описуються кольором і формою. Визначимо X як червоний і круглий об’єкт і висунемо гіпотезу Н, що такий об’єкт є яблуком. При цьому ми можемо визначити такі Імовірності: Р(Н|X) - умовна (апостеріорна) ймовірність, що будь-який об’єкт. X є яблуком, якщо він червоний і круглий. Р(Н)- апріорна ймовірність, що Х буде яблуком, незалежно від його вигляду. Р(Х|Н) - апостеріорна ймовірність, що X є червоним і круглим, якщо він - яблуко. Р(Х) - апріорна ймовірність того, що об'єкт є червоним і круглим. Імовірності Р(Х), Р (Н) і Р (Х|Н) можна оцінити по спостережуваним даних. Зауважимо, що апостеріорна ймовірність заснована на більшій кількості інформації, ніж апріорна, яка не розглядає залежність від властивостей об'єкта X. Для обчислення апостеріорної ймовірності Р(Н|X) на сонові Р(Х), Р (Н) і Р (Х|Н) використовується формула Байєса:

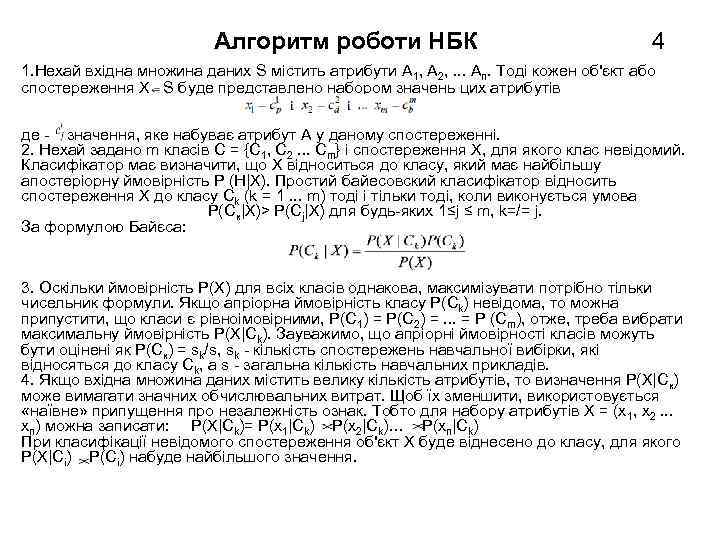

Алгоритм роботи НБК 4 1. Нехай вхідна множина даних S містить атрибути А 1, А 2, . . . Аn. Тоді кожен об'єкт або спостереження X S буде представлено набором значень цих атрибутів де - значення, яке набуває атрибут А у даному спостереженні. 2. Нехай задано m класів С = {С 1, С 2. . . Сm} і спостереження X, для якого клас невідомий. Класифікатор має визначити, що X відноситься до класу, який має найбільшу апостеріорну ймовірність Р (Н|X). Простий байесовский класифікатор відносить спостереження X до класу Сk (k = 1. . . m) тоді і тільки тоді, коли виконується умова Р(Ск|X)> Р(Сj|X) для будь-яких 1≤j ≤ m, k=/= j. За формулою Байєса: 3. Оскільки ймовірність Р(Х) для всіх класів однакова, максимізувати потрібно тільки чисельник формули. Якщо апріорна ймовірність класу Р(Сk) невідома, то можна припустити, що класи є рівноімовірними, Р(С 1) = Р(С 2) =. . . = Р (Сm), отже, треба вибрати максимальну ймовірність Р(Х|Сk). Зауважимо, що апріорні ймовірності класів можуть бути оцінені як Р(Ск) = sk/s, sk - кількість спостережень навчальної вибірки, які відносяться до класу Сk, а s - загальна кількість навчальних прикладів. 4. Якщо вхідна множина даних містить велику кількість атрибутів, то визначення Р(Х|Ск) може вимагати значних обчислювальних витрат. Щоб їх зменшити, використовується «наївне» припущення про незалежність ознак. Тобто для набору атрибутів X = (х 1, х2. . . хn) можна записати: Р(Х|Сk)= Р(х1|Сk) Р(х2|Сk)… Р(хn|Сk) При класифікації невідомого спостереження об'єкт X буде віднесено до класу, для якого Р(Х|Сі) P(Сі) набуде найбільшого значення.

Алгоритм роботи НБК 4 1. Нехай вхідна множина даних S містить атрибути А 1, А 2, . . . Аn. Тоді кожен об'єкт або спостереження X S буде представлено набором значень цих атрибутів де - значення, яке набуває атрибут А у даному спостереженні. 2. Нехай задано m класів С = {С 1, С 2. . . Сm} і спостереження X, для якого клас невідомий. Класифікатор має визначити, що X відноситься до класу, який має найбільшу апостеріорну ймовірність Р (Н|X). Простий байесовский класифікатор відносить спостереження X до класу Сk (k = 1. . . m) тоді і тільки тоді, коли виконується умова Р(Ск|X)> Р(Сj|X) для будь-яких 1≤j ≤ m, k=/= j. За формулою Байєса: 3. Оскільки ймовірність Р(Х) для всіх класів однакова, максимізувати потрібно тільки чисельник формули. Якщо апріорна ймовірність класу Р(Сk) невідома, то можна припустити, що класи є рівноімовірними, Р(С 1) = Р(С 2) =. . . = Р (Сm), отже, треба вибрати максимальну ймовірність Р(Х|Сk). Зауважимо, що апріорні ймовірності класів можуть бути оцінені як Р(Ск) = sk/s, sk - кількість спостережень навчальної вибірки, які відносяться до класу Сk, а s - загальна кількість навчальних прикладів. 4. Якщо вхідна множина даних містить велику кількість атрибутів, то визначення Р(Х|Ск) може вимагати значних обчислювальних витрат. Щоб їх зменшити, використовується «наївне» припущення про незалежність ознак. Тобто для набору атрибутів X = (х 1, х2. . . хn) можна записати: Р(Х|Сk)= Р(х1|Сk) Р(х2|Сk)… Р(хn|Сk) При класифікації невідомого спостереження об'єкт X буде віднесено до класу, для якого Р(Х|Сі) P(Сі) набуде найбільшого значення.

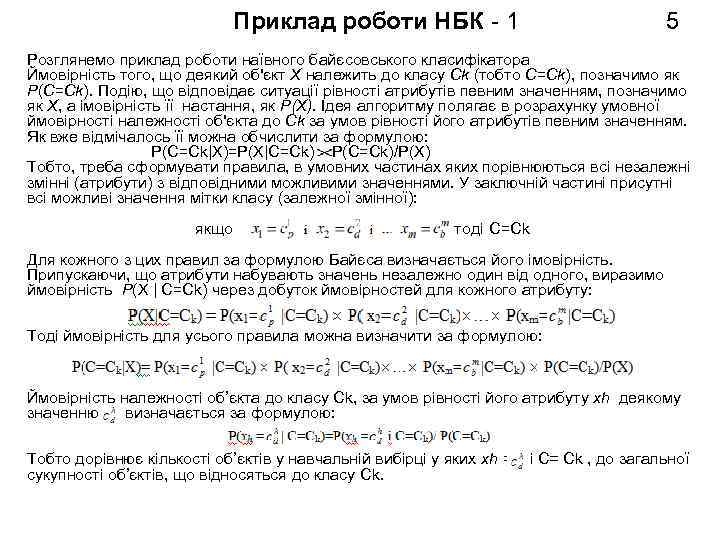

Приклад роботи НБК - 1 5 Розглянемо приклад роботи наївного байєсовського класифікатора Ймовірність того, що деякий об'єкт Х належить до класу Сk (тобто С=Сk), позначимо як P(C=Сk). Подію, що відповідає ситуації рівності атрибутів певним значенням, позначимо як X, а імовірність її настання, як P(X). Ідея алгоритму полягає в розрахунку умовної ймовірності належності об'єкта до Ck за умов рівності його атрибутів певним значенням. Як вже відмічалось її можна обчислити за формулою: P(C=Ck|X)=P(X|C=Ck) P(C=Ck)/P(X) Тобто, треба сформувати правила, в умовних частинах яких порівнюються всі незалежні змінні (атрибути) з відповідними можливими значеннями. У заключній частині присутні всі можливі значення мітки класу (залежної змінної): якщо , тоді C=Ck Для кожного з цих правил за формулою Байєса визначається його імовірність. Припускаючи, що атрибути набувають значень незалежно один від одного, виразимо ймовірність P(X | C=Ck) через добуток ймовірностей для кожного атрибуту: Тоді ймовірність для усього правила можна визначити за формулою: Ймовірність належності об’єкта до класу Ck, за умов рівності його атрибуту xh деякому значенню визначається за формулою: Тобто дорівнює кількості об’єктів у навчальній вибірці у яких xh = сукупності об’єктів, що відносяться до класу Ck. і C= Ck , до загальної

Приклад роботи НБК - 1 5 Розглянемо приклад роботи наївного байєсовського класифікатора Ймовірність того, що деякий об'єкт Х належить до класу Сk (тобто С=Сk), позначимо як P(C=Сk). Подію, що відповідає ситуації рівності атрибутів певним значенням, позначимо як X, а імовірність її настання, як P(X). Ідея алгоритму полягає в розрахунку умовної ймовірності належності об'єкта до Ck за умов рівності його атрибутів певним значенням. Як вже відмічалось її можна обчислити за формулою: P(C=Ck|X)=P(X|C=Ck) P(C=Ck)/P(X) Тобто, треба сформувати правила, в умовних частинах яких порівнюються всі незалежні змінні (атрибути) з відповідними можливими значеннями. У заключній частині присутні всі можливі значення мітки класу (залежної змінної): якщо , тоді C=Ck Для кожного з цих правил за формулою Байєса визначається його імовірність. Припускаючи, що атрибути набувають значень незалежно один від одного, виразимо ймовірність P(X | C=Ck) через добуток ймовірностей для кожного атрибуту: Тоді ймовірність для усього правила можна визначити за формулою: Ймовірність належності об’єкта до класу Ck, за умов рівності його атрибуту xh деякому значенню визначається за формулою: Тобто дорівнює кількості об’єктів у навчальній вибірці у яких xh = сукупності об’єктів, що відносяться до класу Ck. і C= Ck , до загальної

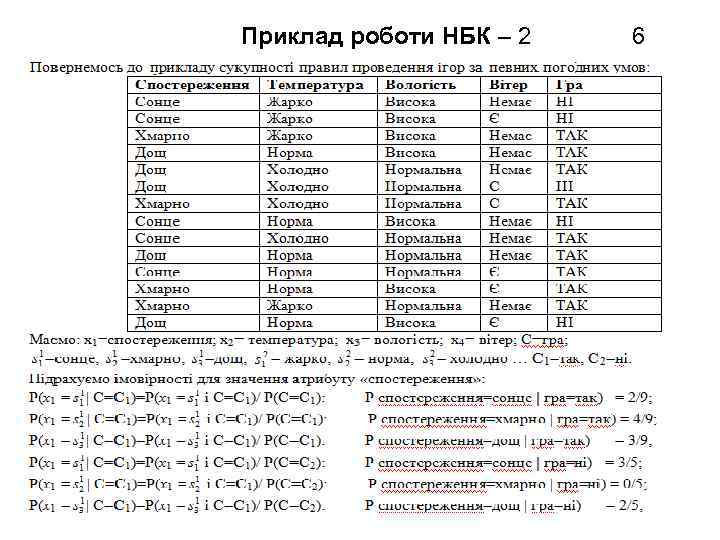

Приклад роботи НБК – 2 6

Приклад роботи НБК – 2 6

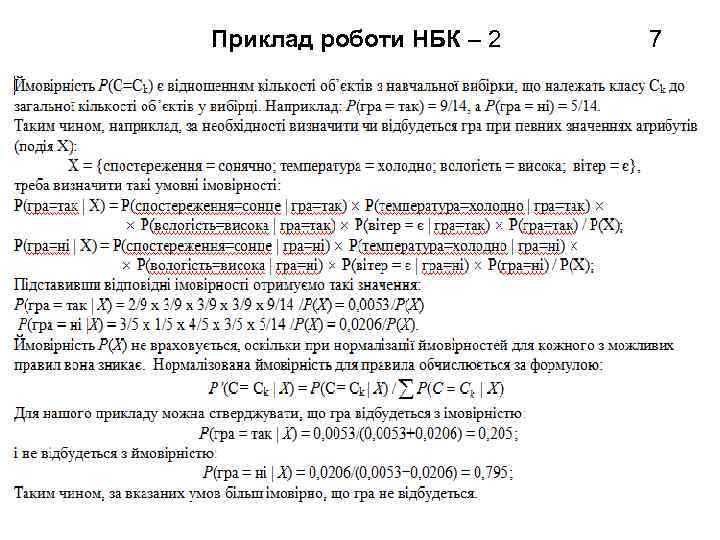

Приклад роботи НБК – 2 7

Приклад роботи НБК – 2 7