Понятие информации и ее измерение.

Понятие информации и ее измерение.

Информация • Понятие информация является одним из фундаментальных в современной науке вообще и базовым для изучаемой нами информатики. Информацию наряду с веществом и энергией рассматривают в качестве важнейшей сущности мира, в котором мы живем. Однако, если задаться целью формально определить понятие “информация”, то сделать это будет чрезвычайно сложно. Аналогичными “неопределяемыми” понятиями, например, в математике является “точка” или “прямая”. Так, можно сделать некоторые утверждения, связанные с этими математическими понятиями, но сами они не могут быть определены с помощью более элементарных понятий.

Информация • Понятие информация является одним из фундаментальных в современной науке вообще и базовым для изучаемой нами информатики. Информацию наряду с веществом и энергией рассматривают в качестве важнейшей сущности мира, в котором мы живем. Однако, если задаться целью формально определить понятие “информация”, то сделать это будет чрезвычайно сложно. Аналогичными “неопределяемыми” понятиями, например, в математике является “точка” или “прямая”. Так, можно сделать некоторые утверждения, связанные с этими математическими понятиями, но сами они не могут быть определены с помощью более элементарных понятий.

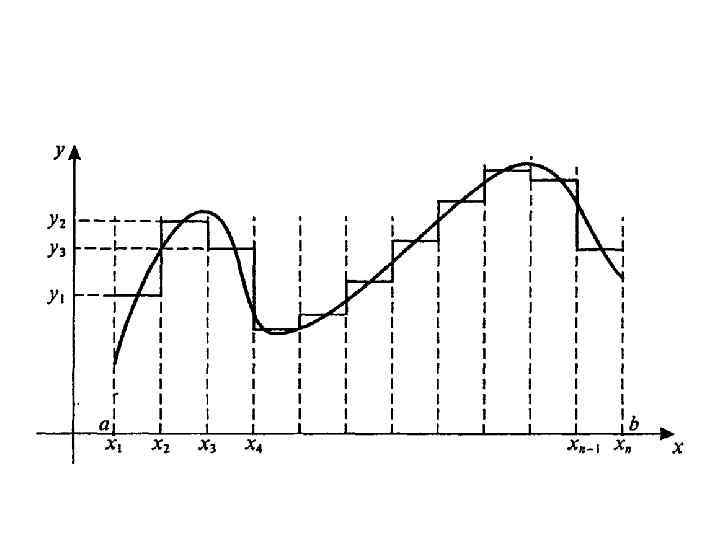

Кодирование и квантование сигналов • Сообщения и сигналы. • Для того, чтобы передать сообщение от источника к потребителю, оно должно быть как либо "зафиксировано". Следовательно, под сообщением подразумевают информацию, выраженную в определенной форме и подлежащую передаче. Сообщение - это форма представления информации Сообщение для передачи его в соответствующий адрес должно быть предварительно преобразовано в сигнал. Под сигналом понимается изменяющаяся физическая величина, отображающее сообщение. Сигнал - материальный переносчик сообщения

Кодирование и квантование сигналов • Сообщения и сигналы. • Для того, чтобы передать сообщение от источника к потребителю, оно должно быть как либо "зафиксировано". Следовательно, под сообщением подразумевают информацию, выраженную в определенной форме и подлежащую передаче. Сообщение - это форма представления информации Сообщение для передачи его в соответствующий адрес должно быть предварительно преобразовано в сигнал. Под сигналом понимается изменяющаяся физическая величина, отображающее сообщение. Сигнал - материальный переносчик сообщения

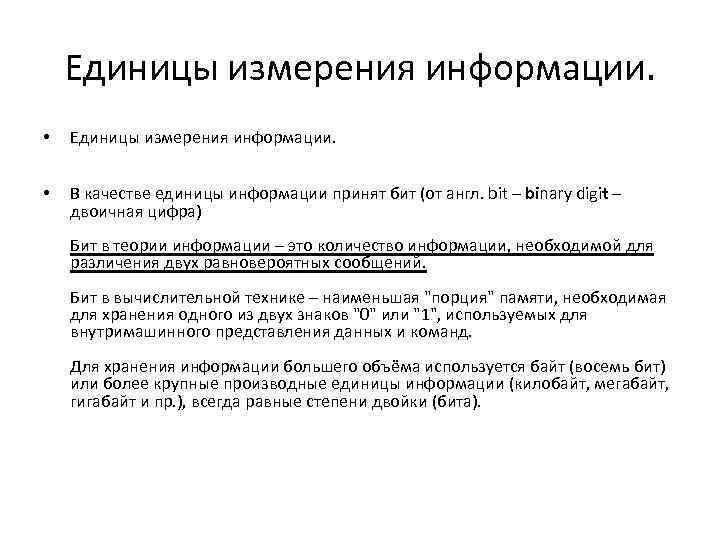

Единицы измерения информации. • В качестве единицы информации принят бит (от англ. bit – binary digit – двоичная цифра) Бит в теории информации – это количество информации, необходимой для различения двух равновероятных сообщений. Бит в вычислительной технике – наименьшая "порция" памяти, необходимая для хранения одного из двух знаков "0" или "1", используемых для внутримашинного представления данных и команд. Для хранения информации большего объёма используется байт (восемь бит) или более крупные производные единицы информации (килобайт, мегабайт, гигабайт и пр. ), всегда равные степени двойки (бита).

Единицы измерения информации. • В качестве единицы информации принят бит (от англ. bit – binary digit – двоичная цифра) Бит в теории информации – это количество информации, необходимой для различения двух равновероятных сообщений. Бит в вычислительной технике – наименьшая "порция" памяти, необходимая для хранения одного из двух знаков "0" или "1", используемых для внутримашинного представления данных и команд. Для хранения информации большего объёма используется байт (восемь бит) или более крупные производные единицы информации (килобайт, мегабайт, гигабайт и пр. ), всегда равные степени двойки (бита).

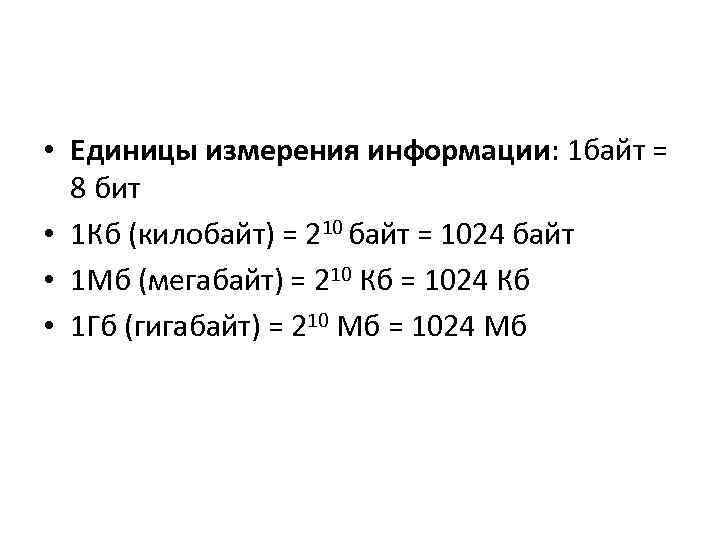

• Единицы измерения информации: 1 байт = 8 бит • 1 Кб (килобайт) = 210 байт = 1024 байт • 1 Мб (мегабайт) = 210 Кб = 1024 Кб • 1 Гб (гигабайт) = 210 Мб = 1024 Мб

• Единицы измерения информации: 1 байт = 8 бит • 1 Кб (килобайт) = 210 байт = 1024 байт • 1 Мб (мегабайт) = 210 Кб = 1024 Кб • 1 Гб (гигабайт) = 210 Мб = 1024 Мб