SAI_04_neiro_00.ppt

- Количество слайдов: 28

Персептрони, дослідження в області нейронних мереж. Модель нейронної мережі зі зворотним поширенням помилки. Системи штучного інтелекту

Основні визначення Розпізнавання образів — це віднессення данных до визначеного класу за допомогою признаків, що характеризують ці дані, з загальной маси даних Гіпотеза компактності: образам відповідають компактні множини у просторі ознак

Адаптація та навчання • Адаптація — це процес зміни параметрів та структури системи, а можливо, й управляючих впливів на основі поточної інформації з метою досягнення визначеного стану системи за умовами початковоъ невизначеносты та умовах функціонування, що змінюються. • Навчання — це процес, завдяки якому система поступово набуває здатності відповідати потрібними реакціями на визначені сукупності звнішніх факторів.

Розпізнавання мови

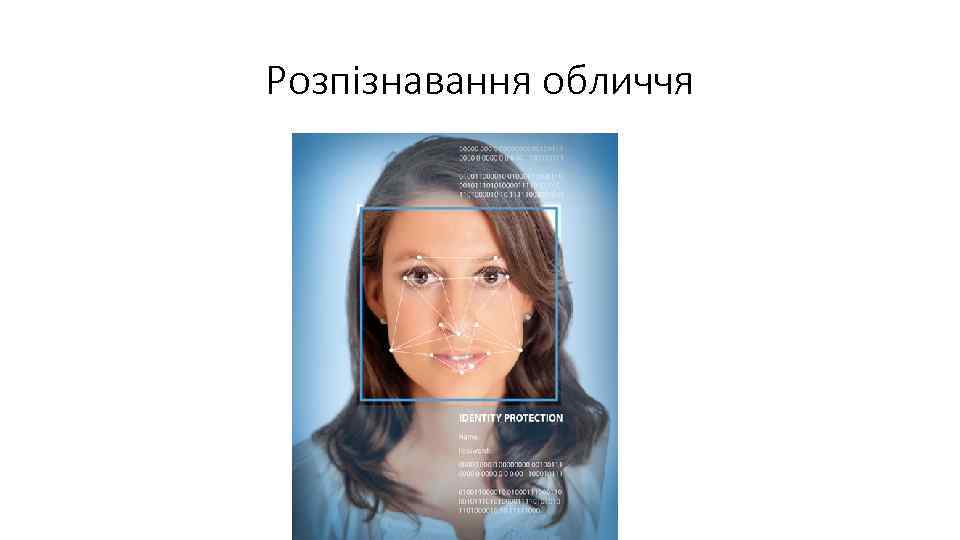

Розпізнавання обличчя

Розпізнавання рукопису

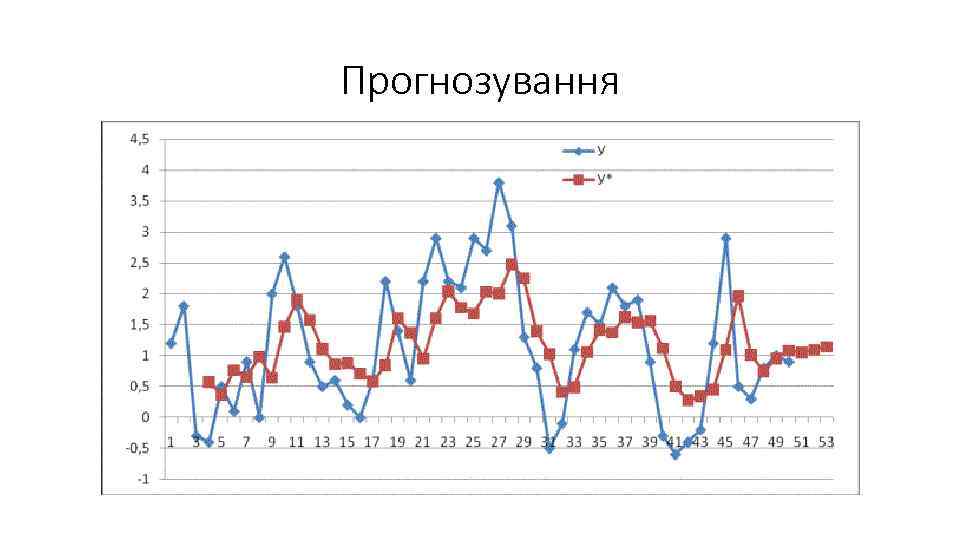

Прогнозування

Керування

Керування

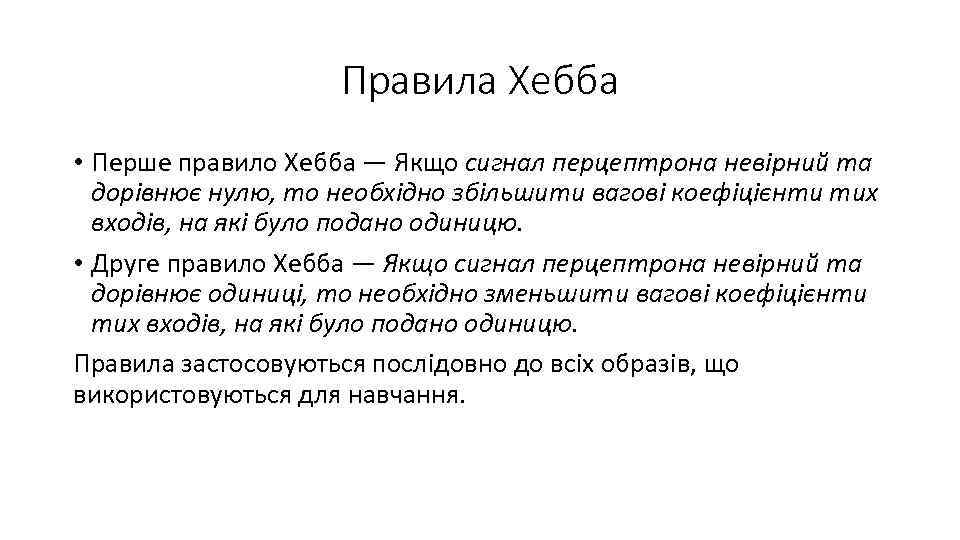

Правила Хебба • Перше правило Хебба — Якщо сигнал перцептрона невірний та дорівнює нулю, то необхідно збільшити вагові коефіцієнти тих входів, на які було подано одиницю. • Друге правило Хебба — Якщо сигнал перцептрона невірний та дорівнює одиниці, то необхідно зменьшити вагові коефіцієнти тих входів, на які було подано одиницю. Правила застосовуються послідовно до всіх образів, що використовуються для навчання.

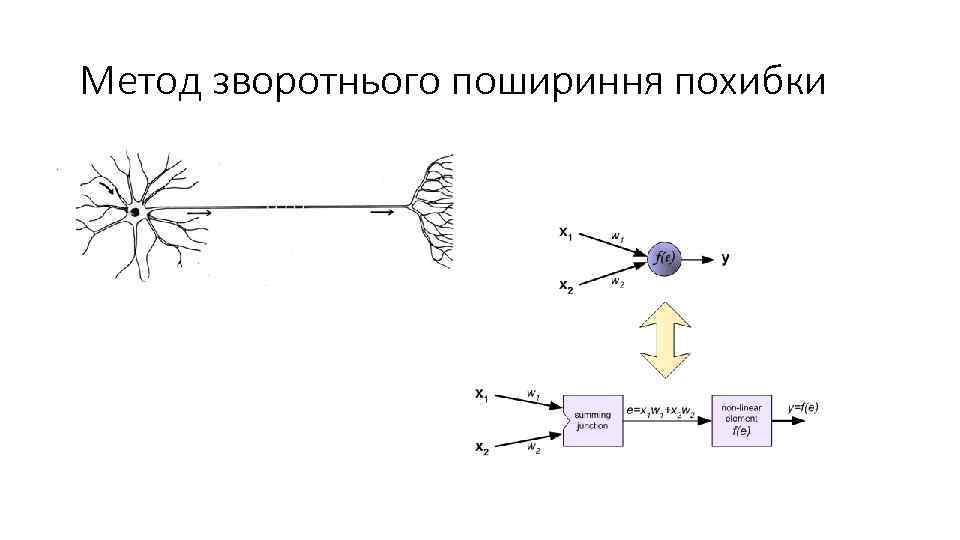

Метод зворотнього пошириння похибки

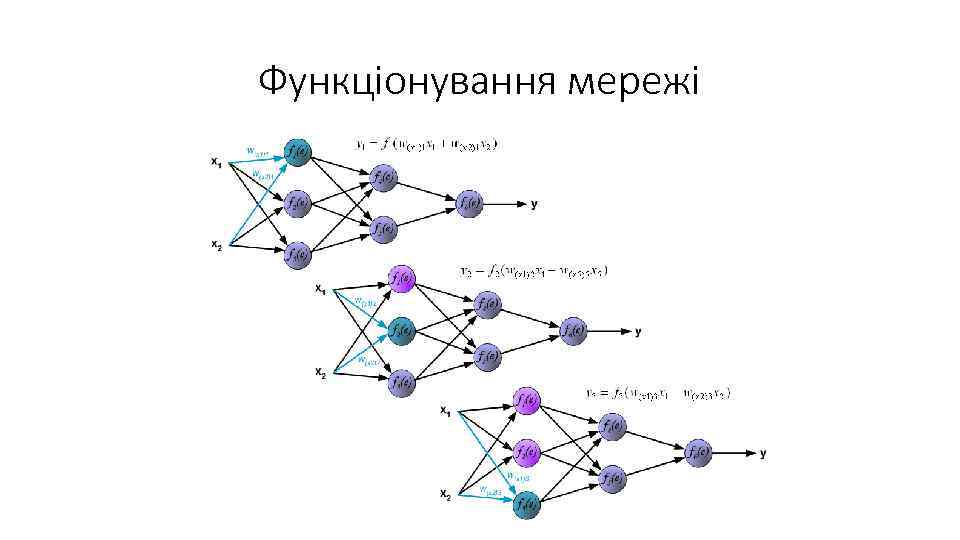

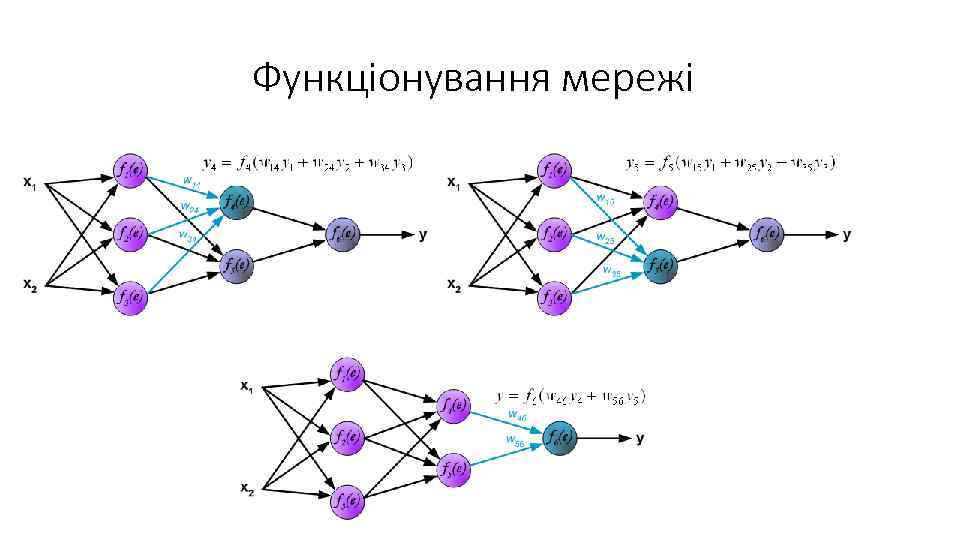

Функціонування мережі

Функціонування мережі

Зворотнє поширення похибки

Зворотнє поширення похибки

Зворотнє поширення похибки

Зворотнє поширення похибки

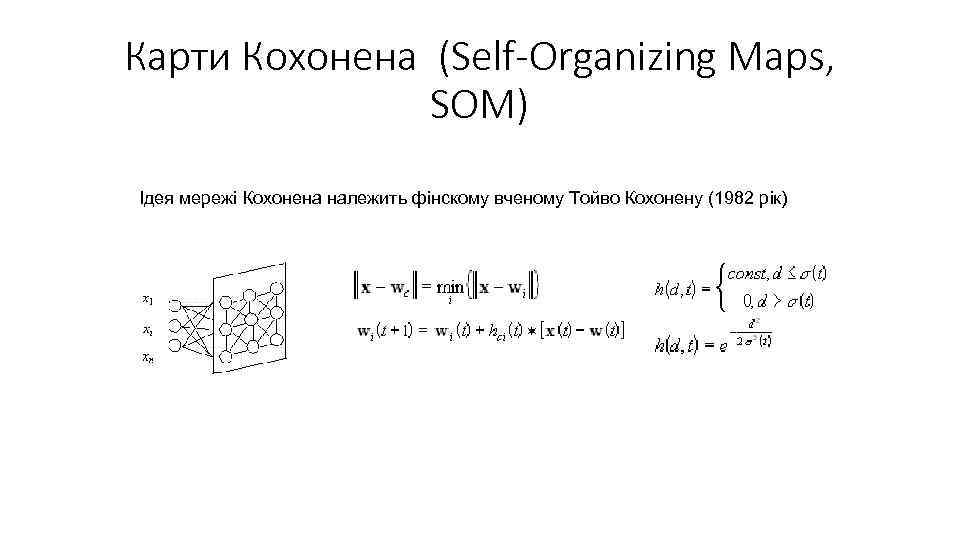

Карти Кохонена (Self-Organizing Maps, SOM) Ідея мережі Кохонена належить фінскому вченому Тойво Кохонену (1982 рік)

Навчання мережі Кохонена

Мережа Хопфілда

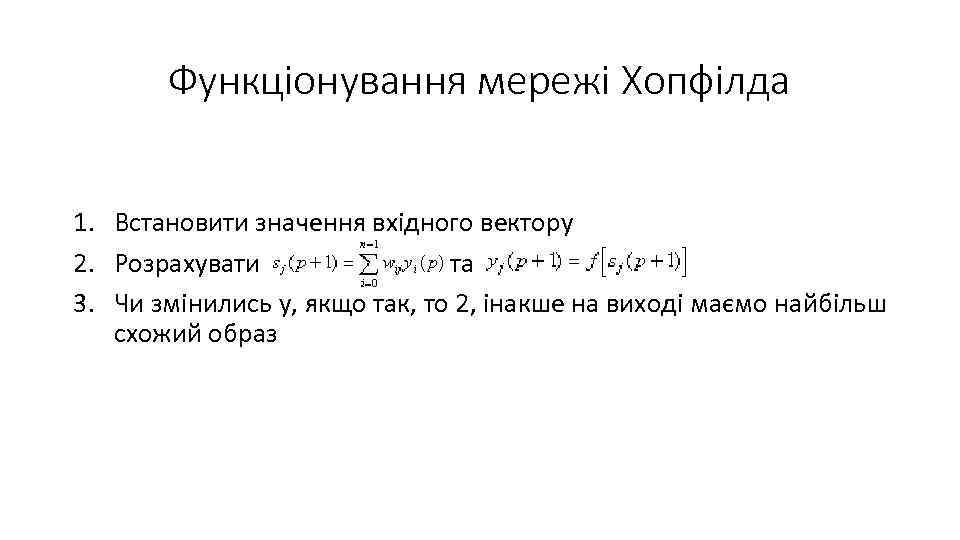

Функціонування мережі Хопфілда 1. Встановити значення вхідного вектору 2. Розрахувати та 3. Чи змінились y, якщо так, то 2, інакше на виході маємо найбільш схожий образ

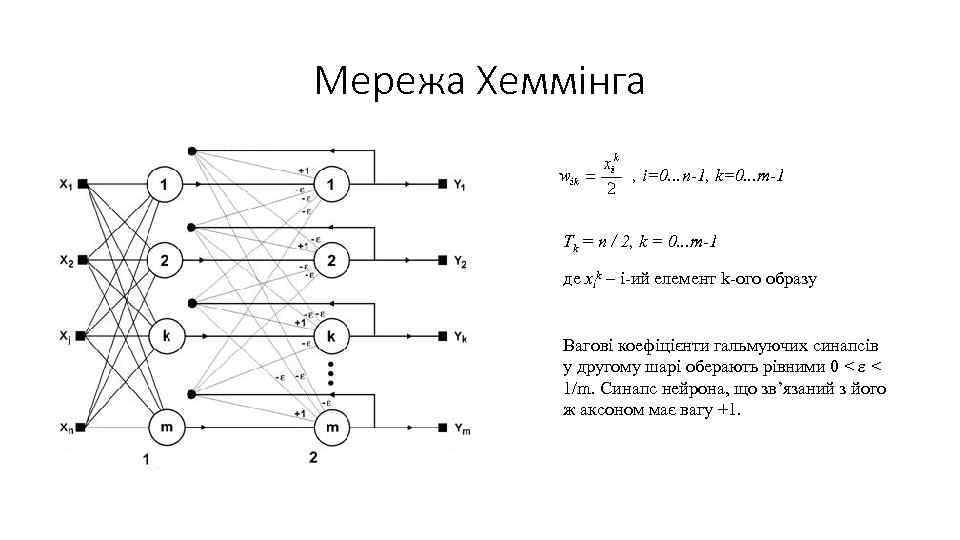

Мережа Хеммінга , i=0. . . n-1, k=0. . . m-1 Tk = n / 2, k = 0. . . m-1 де xik – i-ий елемент k-ого образу Вагові коефіцієнти гальмуючих синапсів у другому шарі оберають рівними 0 < e < 1/m. Синапс нейрона, що зв’язаний з його ж аксоном має вагу +1.

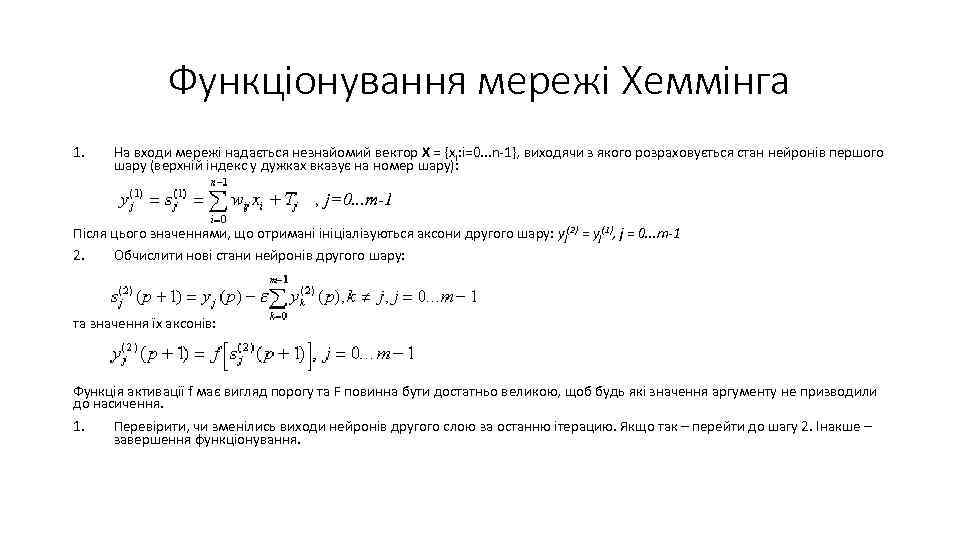

Функціонування мережі Хеммінга 1. На входи мережі надається незнайомий вектор X = {xi: i=0. . . n-1}, виходячи з якого розраховується стан нейронів першого шару (верхній індекс у дужках вказує на номер шару): , j=0. . . m-1 Після цього значеннями, що отримані ініціалізуються аксони другого шару: yj(2) = yj(1), j = 0. . . m-1 2. Обчислити нові стани нейронів другого шару: та значення їх аксонів: Функція активації f має вигляд порогу та F повинна бути достатньо великою, щоб будь які значення аргументу не призводили до насичення. 1. Перевірити, чи зменілись виходи нейронів другого слою за останню ітерацию. Якщо так – перейти до шагу 2. Інакше – завершення функціонування.

Реалізація • Програмна з використанням матриць • Програмна з використанням об’єктної моделі • Апаратна на ПЛІС (FPGA)

Програмна з використанням матриць

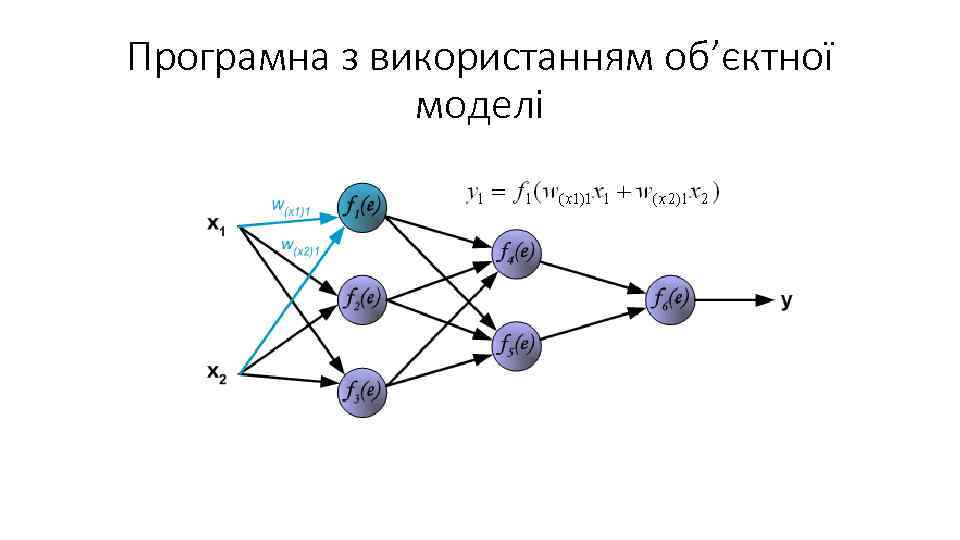

Програмна з використанням об’єктної моделі

Апаратна на ПЛІС (FPGA)

Література • Ф. Уоссермен, Нейрокомпьютерная техника, М. , Мир, 1992. • Саймон Хайкин, Нейронные сети: полный курс, 2 -е издание. : Пер. с англ. – М. : Издательский дом «Вильямс» , 2006. – 1104 с.

SAI_04_neiro_00.ppt