ЛЕКЦИЯ 3 Парная регрессия.ppt

- Количество слайдов: 18

Парная регрессия

Парная регрессия

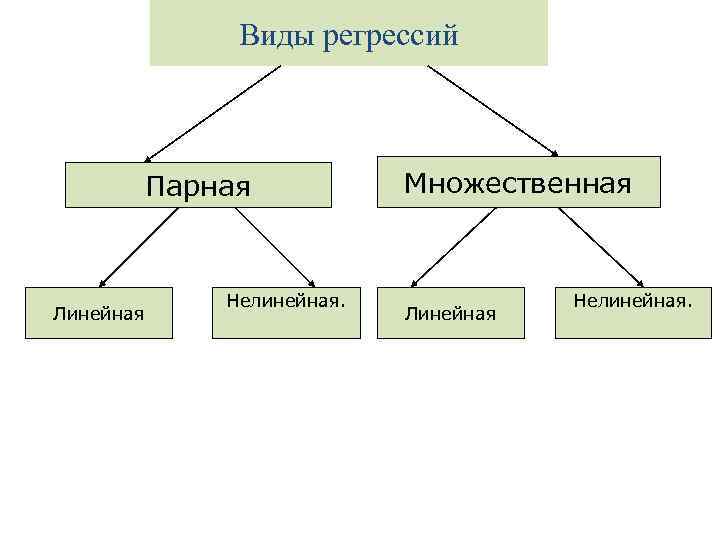

Виды регрессий Парная Линейная Нелинейная. Множественная Линейная Нелинейная.

Виды регрессий Парная Линейная Нелинейная. Множественная Линейная Нелинейная.

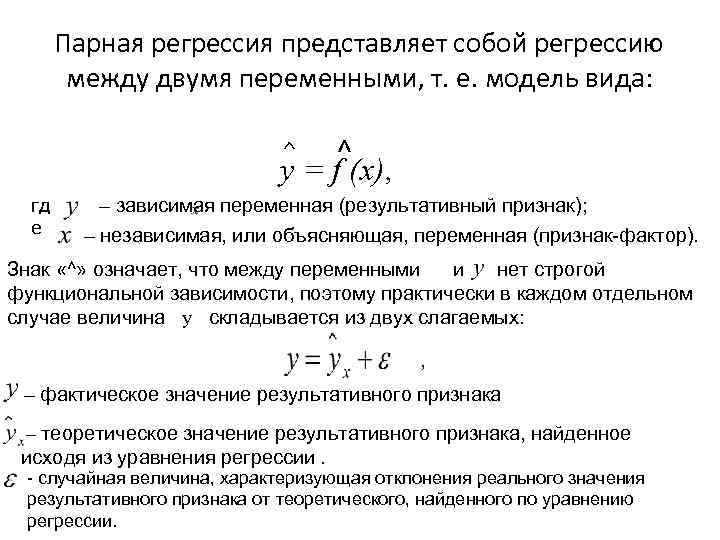

Парная регрессия представляет собой регрессию между двумя переменными, т. е. модель вида: ^ y = f (x), ^ гд е – зависимая переменная (результативный признак); – независимая, или объясняющая, переменная (признак-фактор). Знак «^» означает, что между переменными и нет строгой функциональной зависимости, поэтому практически в каждом отдельном случае величина у складывается из двух слагаемых: , – фактическое значение результативного признака – теоретическое значение результативного признака, найденное исходя из уравнения регрессии. - случайная величина, характеризующая отклонения реального значения результативного признака от теоретического, найденного по уравнению регрессии.

Парная регрессия представляет собой регрессию между двумя переменными, т. е. модель вида: ^ y = f (x), ^ гд е – зависимая переменная (результативный признак); – независимая, или объясняющая, переменная (признак-фактор). Знак «^» означает, что между переменными и нет строгой функциональной зависимости, поэтому практически в каждом отдельном случае величина у складывается из двух слагаемых: , – фактическое значение результативного признака – теоретическое значение результативного признака, найденное исходя из уравнения регрессии. - случайная величина, характеризующая отклонения реального значения результативного признака от теоретического, найденного по уравнению регрессии.

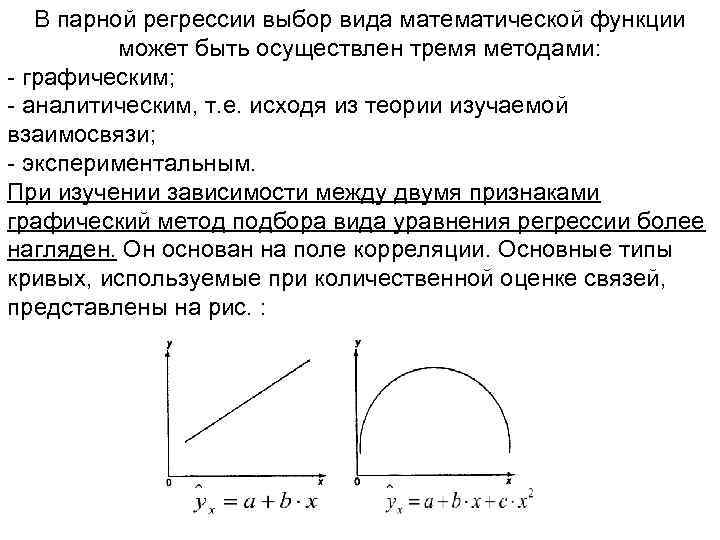

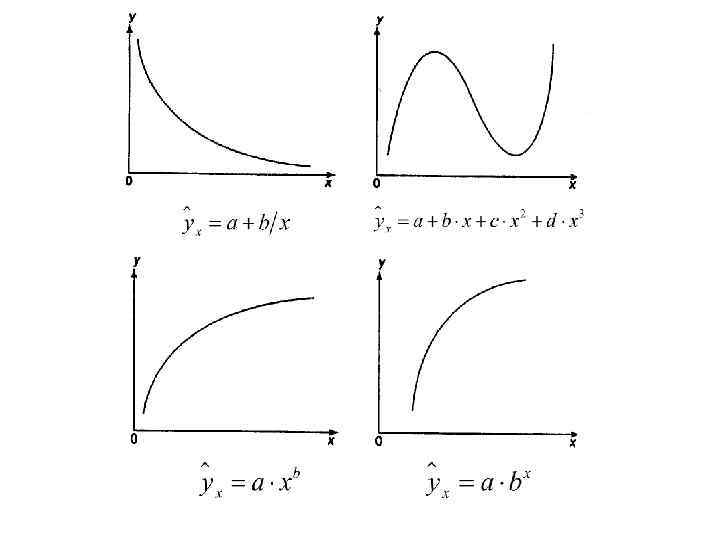

В парной регрессии выбор вида математической функции может быть осуществлен тремя методами: - графическим; - аналитическим, т. е. исходя из теории изучаемой взаимосвязи; - экспериментальным. При изучении зависимости между двумя признаками графический метод подбора вида уравнения регрессии более нагляден. Он основан на поле корреляции. Основные типы кривых, используемые при количественной оценке связей, представлены на рис. :

В парной регрессии выбор вида математической функции может быть осуществлен тремя методами: - графическим; - аналитическим, т. е. исходя из теории изучаемой взаимосвязи; - экспериментальным. При изучении зависимости между двумя признаками графический метод подбора вида уравнения регрессии более нагляден. Он основан на поле корреляции. Основные типы кривых, используемые при количественной оценке связей, представлены на рис. :

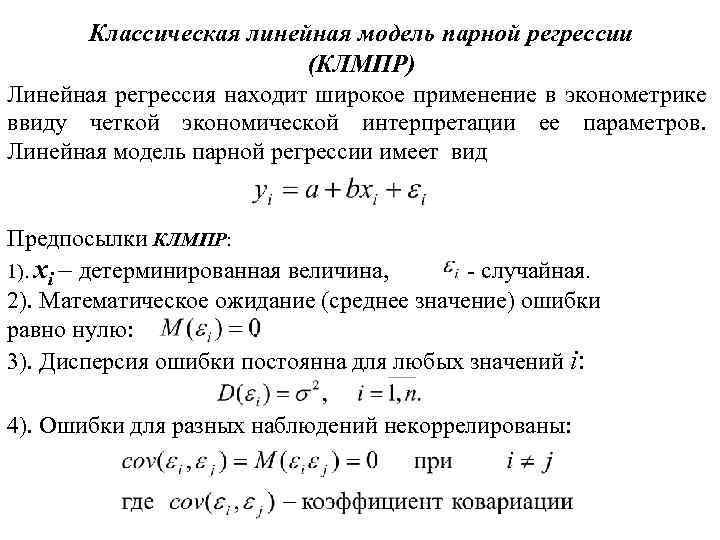

Классическая линейная модель парной регрессии (КЛМПР) Линейная регрессия находит широкое применение в эконометрике ввиду четкой экономической интерпретации ее параметров. Линейная модель парной регрессии имеет вид Предпосылки КЛМПР: 1). xi – детерминированная величина, - случайная. 2). Математическое ожидание (среднее значение) ошибки равно нулю: . 3). Дисперсия ошибки постоянна для любых значений i: 4). Ошибки для разных наблюдений некоррелированы:

Классическая линейная модель парной регрессии (КЛМПР) Линейная регрессия находит широкое применение в эконометрике ввиду четкой экономической интерпретации ее параметров. Линейная модель парной регрессии имеет вид Предпосылки КЛМПР: 1). xi – детерминированная величина, - случайная. 2). Математическое ожидание (среднее значение) ошибки равно нулю: . 3). Дисперсия ошибки постоянна для любых значений i: 4). Ошибки для разных наблюдений некоррелированы:

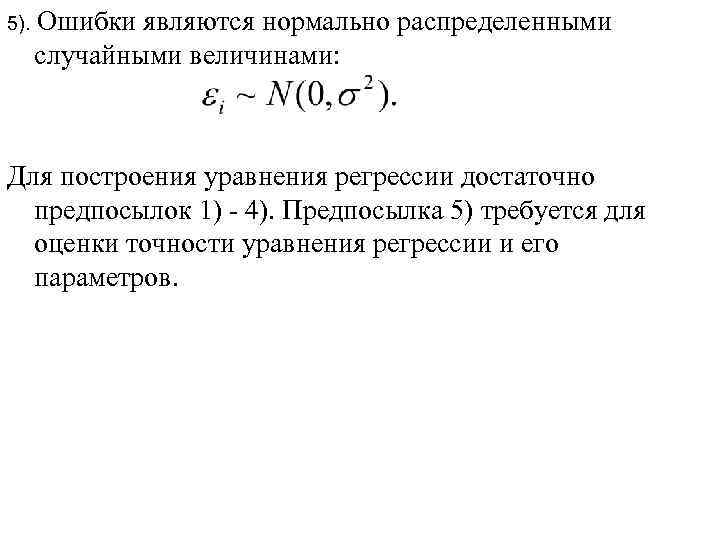

5). Ошибки являются нормально распределенными случайными величинами: Для построения уравнения регрессии достаточно предпосылок 1) - 4). Предпосылка 5) требуется для оценки точности уравнения регрессии и его параметров.

5). Ошибки являются нормально распределенными случайными величинами: Для построения уравнения регрессии достаточно предпосылок 1) - 4). Предпосылка 5) требуется для оценки точности уравнения регрессии и его параметров.

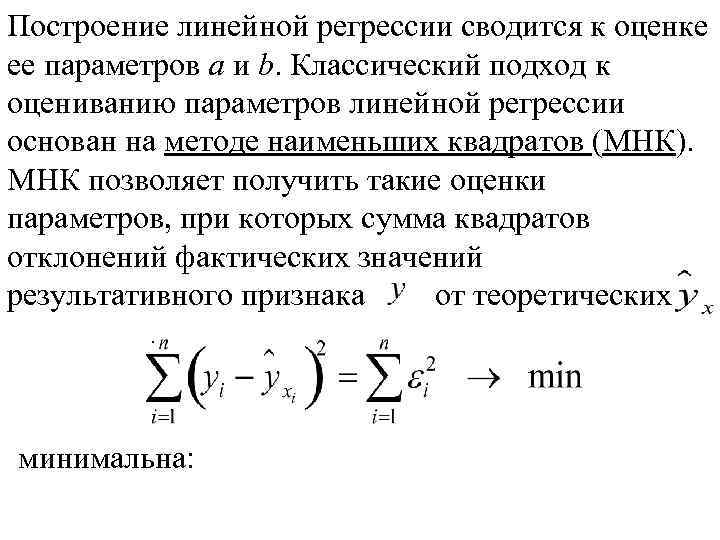

Построение линейной регрессии сводится к оценке ее параметров a и b. Классический подход к оцениванию параметров линейной регрессии основан на методе наименьших квадратов (МНК). МНК позволяет получить такие оценки параметров, при которых сумма квадратов отклонений фактических значений результативного признака от теоретических. минимальна:

Построение линейной регрессии сводится к оценке ее параметров a и b. Классический подход к оцениванию параметров линейной регрессии основан на методе наименьших квадратов (МНК). МНК позволяет получить такие оценки параметров, при которых сумма квадратов отклонений фактических значений результативного признака от теоретических. минимальна:

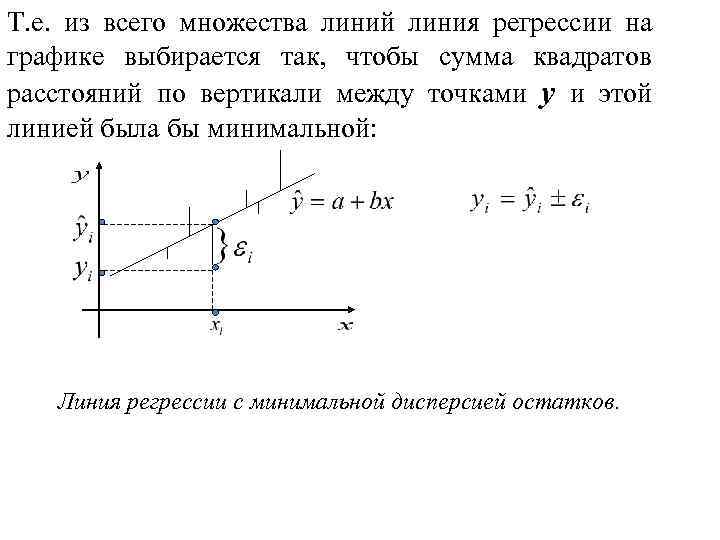

Т. е. из всего множества линий линия регрессии на графике выбирается так, чтобы сумма квадратов расстояний по вертикали между точками у и этой линией была бы минимальной: Линия регрессии с минимальной дисперсией остатков.

Т. е. из всего множества линий линия регрессии на графике выбирается так, чтобы сумма квадратов расстояний по вертикали между точками у и этой линией была бы минимальной: Линия регрессии с минимальной дисперсией остатков.

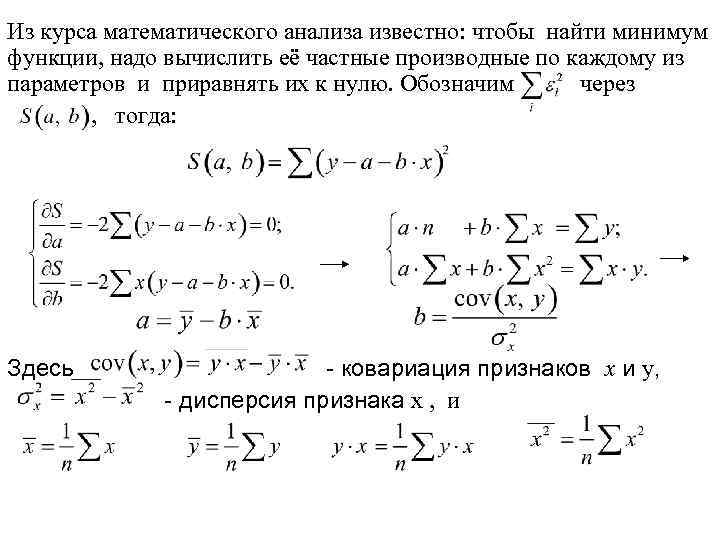

Из курса математического анализа известно: чтобы найти минимум функции, надо вычислить её частные производные по каждому из параметров и приравнять их к нулю. Обозначим через , тогда: Здесь - ковариация признаков х и у, - дисперсия признака х , и

Из курса математического анализа известно: чтобы найти минимум функции, надо вычислить её частные производные по каждому из параметров и приравнять их к нулю. Обозначим через , тогда: Здесь - ковариация признаков х и у, - дисперсия признака х , и

• Ковариация – числовая характеристика совместного распределения двух случайных величин, равная математическому ожиданию произведения отклонений этих случайных величин от их математических ожиданий. • Дисперсия – характеристика случайной величины, определяемая как математическое ожидание квадрата отклонения случайной величины от ее математического ожидания. • Математическое ожидание – сумма произведений значений случайной величины на соответствующие вероятности. • Параметр называется коэффициентом регрессии. Его величина показывает среднее изменение результата с изменением фактора на одну единицу.

• Ковариация – числовая характеристика совместного распределения двух случайных величин, равная математическому ожиданию произведения отклонений этих случайных величин от их математических ожиданий. • Дисперсия – характеристика случайной величины, определяемая как математическое ожидание квадрата отклонения случайной величины от ее математического ожидания. • Математическое ожидание – сумма произведений значений случайной величины на соответствующие вероятности. • Параметр называется коэффициентом регрессии. Его величина показывает среднее изменение результата с изменением фактора на одну единицу.

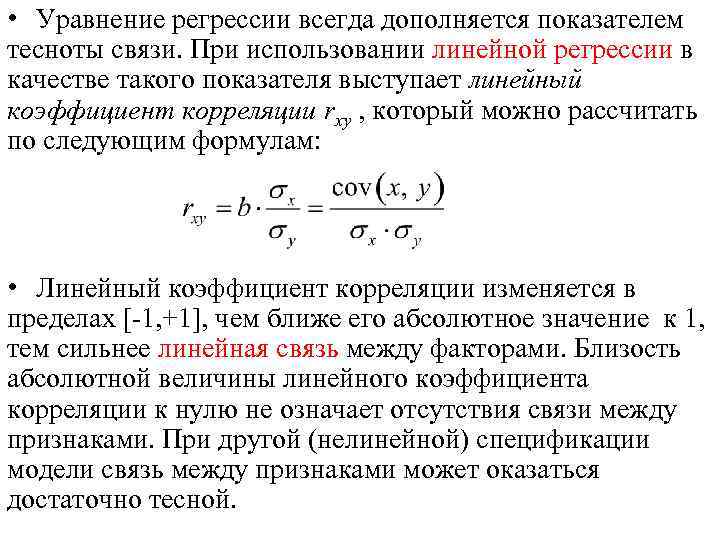

• Уравнение регрессии всегда дополняется показателем тесноты связи. При использовании линейной регрессии в качестве такого показателя выступает линейный коэффициент корреляции rxy , который можно рассчитать по следующим формулам: • Линейный коэффициент корреляции изменяется в пределах [-1, +1], чем ближе его абсолютное значение к 1, тем сильнее линейная связь между факторами. Близость абсолютной величины линейного коэффициента корреляции к нулю не означает отсутствия связи между признаками. При другой (нелинейной) спецификации модели связь между признаками может оказаться достаточно тесной.

• Уравнение регрессии всегда дополняется показателем тесноты связи. При использовании линейной регрессии в качестве такого показателя выступает линейный коэффициент корреляции rxy , который можно рассчитать по следующим формулам: • Линейный коэффициент корреляции изменяется в пределах [-1, +1], чем ближе его абсолютное значение к 1, тем сильнее линейная связь между факторами. Близость абсолютной величины линейного коэффициента корреляции к нулю не означает отсутствия связи между признаками. При другой (нелинейной) спецификации модели связь между признаками может оказаться достаточно тесной.

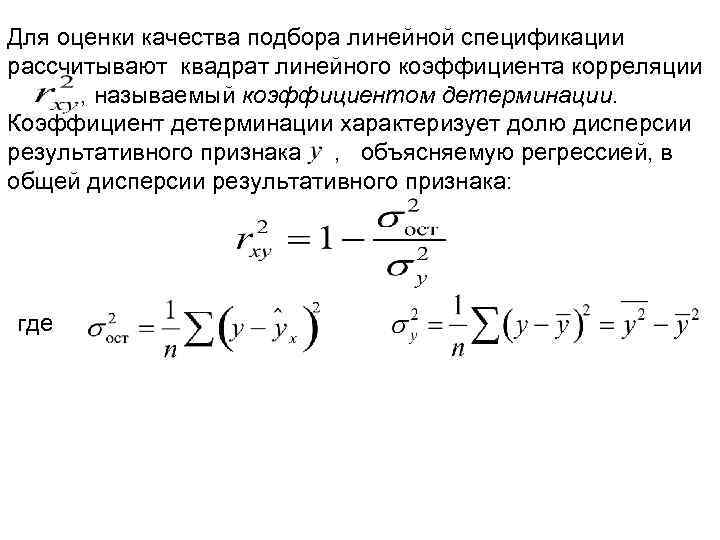

Для оценки качества подбора линейной спецификации рассчитывают квадрат линейного коэффициента корреляции , называемый коэффициентом детерминации. Коэффициент детерминации характеризует долю дисперсии результативного признака , объясняемую регрессией, в общей дисперсии результативного признака: где

Для оценки качества подбора линейной спецификации рассчитывают квадрат линейного коэффициента корреляции , называемый коэффициентом детерминации. Коэффициент детерминации характеризует долю дисперсии результативного признака , объясняемую регрессией, в общей дисперсии результативного признака: где

Если уравнение регрессии проходит через все точки корреляционного поля, что возможно только при функциональной связи х и у (когда все точки лежат на линии регрессии), то фактические значения результативного признака совпадают с теоретическими, т. е. они полностью обусловлены влиянием фактора х. В этом случае остаточная дисперсия равна нулю. Чем меньше величина остаточной дисперсии, тем меньше влияние не учитываемых в уравнении регрессии факторов и тем лучше уравнение регрессии подходит к исходным данным.

Если уравнение регрессии проходит через все точки корреляционного поля, что возможно только при функциональной связи х и у (когда все точки лежат на линии регрессии), то фактические значения результативного признака совпадают с теоретическими, т. е. они полностью обусловлены влиянием фактора х. В этом случае остаточная дисперсия равна нулю. Чем меньше величина остаточной дисперсии, тем меньше влияние не учитываемых в уравнении регрессии факторов и тем лучше уравнение регрессии подходит к исходным данным.

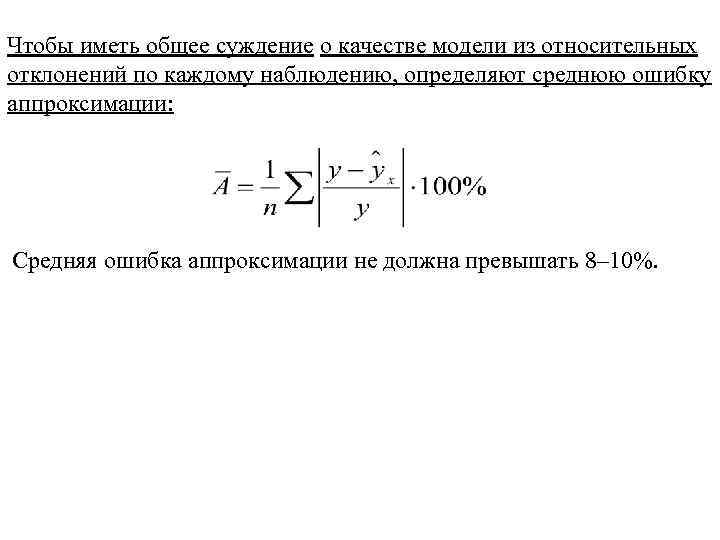

Чтобы иметь общее суждение о качестве модели из относительных отклонений по каждому наблюдению, определяют среднюю ошибку аппроксимации: Средняя ошибка аппроксимации не должна превышать 8– 10%.

Чтобы иметь общее суждение о качестве модели из относительных отклонений по каждому наблюдению, определяют среднюю ошибку аппроксимации: Средняя ошибка аппроксимации не должна превышать 8– 10%.

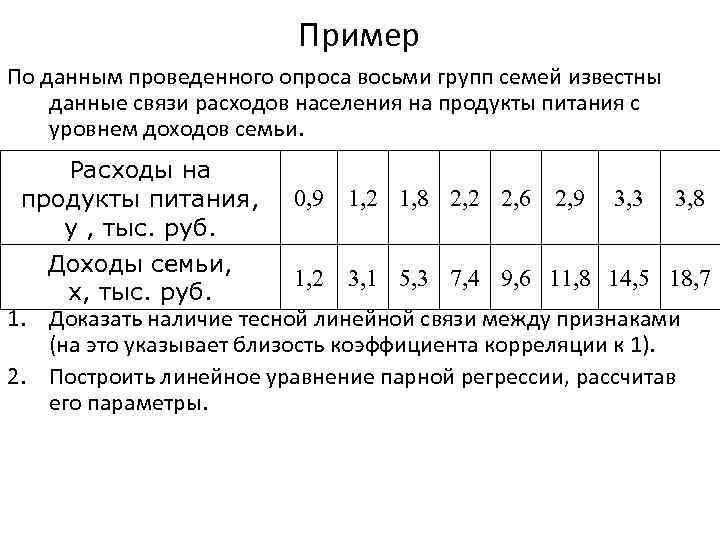

Пример По данным проведенного опроса восьми групп семей известны данные связи расходов населения на продукты питания с уровнем доходов семьи. Расходы на продукты питания, у , тыс. руб. 0, 9 1, 2 1, 8 2, 2 2, 6 2, 9 3, 3 3, 8 Доходы семьи, 1, 2 3, 1 5, 3 7, 4 9, 6 11, 8 14, 5 18, 7 х, тыс. руб. 1. Доказать наличие тесной линейной связи между признаками (на это указывает близость коэффициента корреляции к 1). 2. Построить линейное уравнение парной регрессии, рассчитав его параметры.

Пример По данным проведенного опроса восьми групп семей известны данные связи расходов населения на продукты питания с уровнем доходов семьи. Расходы на продукты питания, у , тыс. руб. 0, 9 1, 2 1, 8 2, 2 2, 6 2, 9 3, 3 3, 8 Доходы семьи, 1, 2 3, 1 5, 3 7, 4 9, 6 11, 8 14, 5 18, 7 х, тыс. руб. 1. Доказать наличие тесной линейной связи между признаками (на это указывает близость коэффициента корреляции к 1). 2. Построить линейное уравнение парной регрессии, рассчитав его параметры.

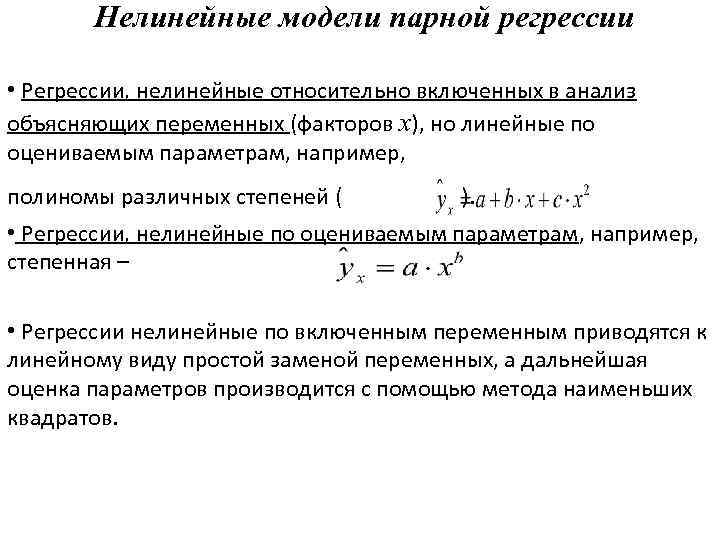

Нелинейные модели парной регрессии • Регрессии, нелинейные относительно включенных в анализ объясняющих переменных (факторов х), но линейные по оцениваемым параметрам, например, полиномы различных степеней ( ). • Регрессии, нелинейные по оцениваемым параметрам, например, степенная – • Регрессии нелинейные по включенным переменным приводятся к линейному виду простой заменой переменных, а дальнейшая оценка параметров производится с помощью метода наименьших квадратов.

Нелинейные модели парной регрессии • Регрессии, нелинейные относительно включенных в анализ объясняющих переменных (факторов х), но линейные по оцениваемым параметрам, например, полиномы различных степеней ( ). • Регрессии, нелинейные по оцениваемым параметрам, например, степенная – • Регрессии нелинейные по включенным переменным приводятся к линейному виду простой заменой переменных, а дальнейшая оценка параметров производится с помощью метода наименьших квадратов.

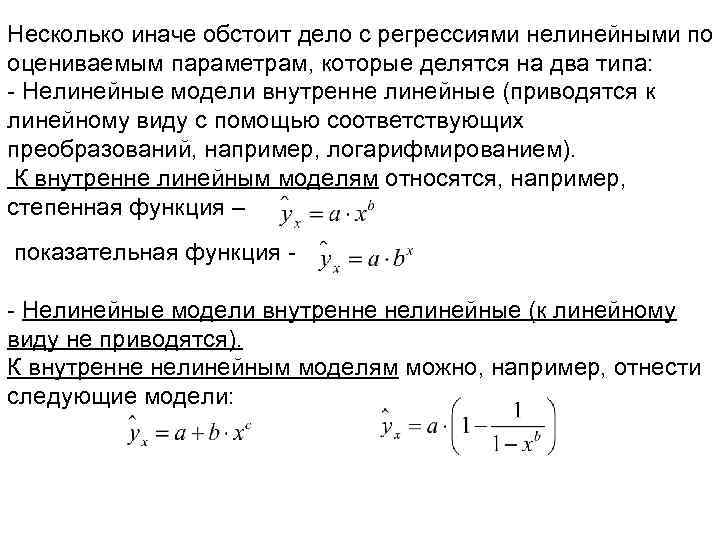

Несколько иначе обстоит дело с регрессиями нелинейными по оцениваемым параметрам, которые делятся на два типа: - Нелинейные модели внутренне линейные (приводятся к линейному виду с помощью соответствующих преобразований, например, логарифмированием). К внутренне линейным моделям относятся, например, степенная функция – показательная функция - - Нелинейные модели внутренне нелинейные (к линейному виду не приводятся). К внутренне нелинейным моделям можно, например, отнести следующие модели:

Несколько иначе обстоит дело с регрессиями нелинейными по оцениваемым параметрам, которые делятся на два типа: - Нелинейные модели внутренне линейные (приводятся к линейному виду с помощью соответствующих преобразований, например, логарифмированием). К внутренне линейным моделям относятся, например, степенная функция – показательная функция - - Нелинейные модели внутренне нелинейные (к линейному виду не приводятся). К внутренне нелинейным моделям можно, например, отнести следующие модели: