ТПР презентация 5.pptx

- Количество слайдов: 28

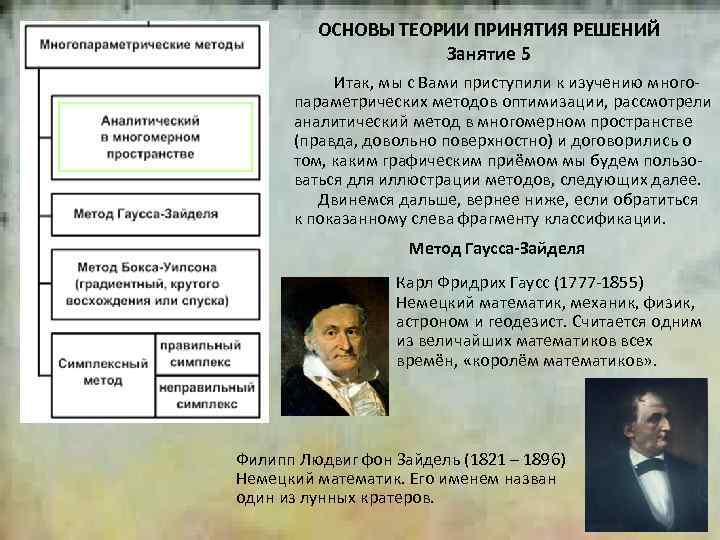

ОСНОВЫ ТЕОРИИ ПРИНЯТИЯ РЕШЕНИЙ Занятие 5 2 Итак, мы с Вами приступили к изучению многопараметрических методов оптимизации, рассмотрели аналитический метод в многомерном пространстве (правда, довольно поверхностно) и договорились о том, каким графическим приёмом мы будем пользоваться для иллюстрации методов, следующих далее. Двинемся дальше, вернее ниже, если обратиться к показанному слева фрагменту классификации. Метод Гаусса-Зайделя Карл Фридрих Гаусс (1777 -1855) Немецкий математик, механик, физик, астроном и геодезист. Считается одним из величайших математиков всех времён, «королём математиков» . Филипп Людвиг фон Зайдель (1821 – 1896) Немецкий математик. Его именем назван один из лунных кратеров.

ОСНОВЫ ТЕОРИИ ПРИНЯТИЯ РЕШЕНИЙ Занятие 5 2 Итак, мы с Вами приступили к изучению многопараметрических методов оптимизации, рассмотрели аналитический метод в многомерном пространстве (правда, довольно поверхностно) и договорились о том, каким графическим приёмом мы будем пользоваться для иллюстрации методов, следующих далее. Двинемся дальше, вернее ниже, если обратиться к показанному слева фрагменту классификации. Метод Гаусса-Зайделя Карл Фридрих Гаусс (1777 -1855) Немецкий математик, механик, физик, астроном и геодезист. Считается одним из величайших математиков всех времён, «королём математиков» . Филипп Людвиг фон Зайдель (1821 – 1896) Немецкий математик. Его именем назван один из лунных кратеров.

2 Основные принципы метода Гаусса-Зайделя Предлагается двигаться к оптимуму, выполняя серии дискретных опытов. В каждой серии следует с заданным шагом изменять только один из факторов, а остальные факторы сохранять неизменными. Серию надо продолжать до тех пор, пока движение приводит к улучшению критерия оптимизации Если критерий оптимизации начал ухудшаться, серию надо остановить, выбрать тот из опытов, который дал наилучший результат, и использовать его координаты для планирования новой серии, в которой изменяться будет уже другой фактор. Если изменение любого из факторов приводит к ухудшению результата, можно принять одно из двух решений: • успокоиться на этом и считать оптимальными координаты того опыта, который дал наилучшее значение критерия; • если ресурсы не исчерпаны и Заказчик требует дальнейшего улучшения, можно продолжить поиск в окрестности найденного экстремума, уменьшив шаги движения.

2 Основные принципы метода Гаусса-Зайделя Предлагается двигаться к оптимуму, выполняя серии дискретных опытов. В каждой серии следует с заданным шагом изменять только один из факторов, а остальные факторы сохранять неизменными. Серию надо продолжать до тех пор, пока движение приводит к улучшению критерия оптимизации Если критерий оптимизации начал ухудшаться, серию надо остановить, выбрать тот из опытов, который дал наилучший результат, и использовать его координаты для планирования новой серии, в которой изменяться будет уже другой фактор. Если изменение любого из факторов приводит к ухудшению результата, можно принять одно из двух решений: • успокоиться на этом и считать оптимальными координаты того опыта, который дал наилучшее значение критерия; • если ресурсы не исчерпаны и Заказчик требует дальнейшего улучшения, можно продолжить поиск в окрестности найденного экстремума, уменьшив шаги движения.

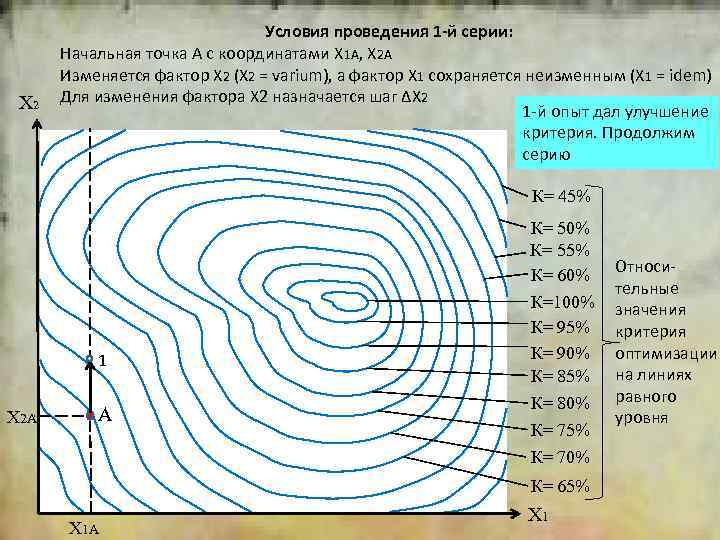

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 1 -й опыт дал улучшение критерия. Продолжим серию К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 1 -й опыт дал улучшение критерия. Продолжим серию К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

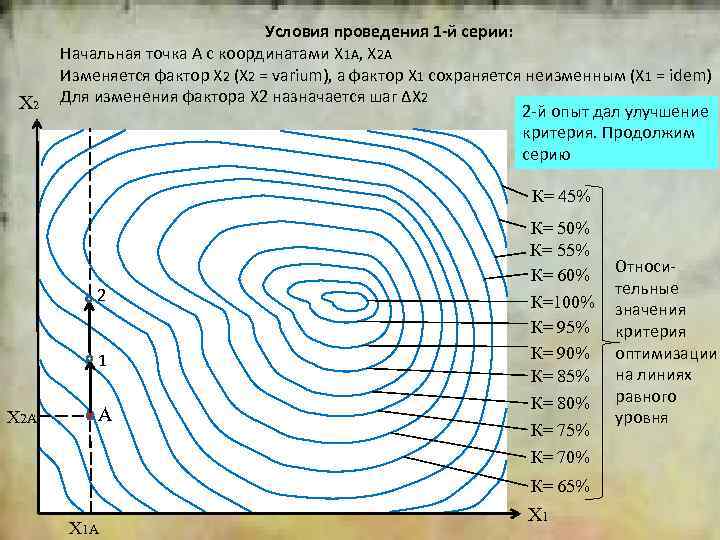

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 2 -й опыт дал улучшение критерия. Продолжим серию К= 45% 2 К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 2 -й опыт дал улучшение критерия. Продолжим серию К= 45% 2 К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

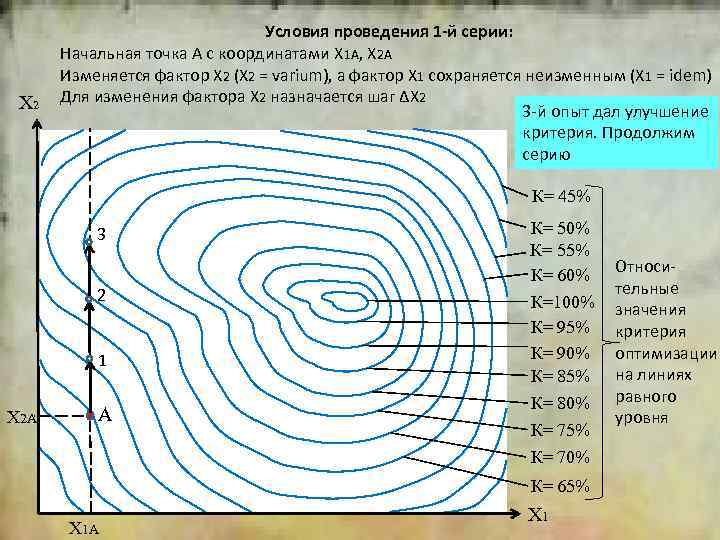

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 3 -й опыт дал улучшение критерия. Продолжим серию К= 45% 3 2 К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 3 -й опыт дал улучшение критерия. Продолжим серию К= 45% 3 2 К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

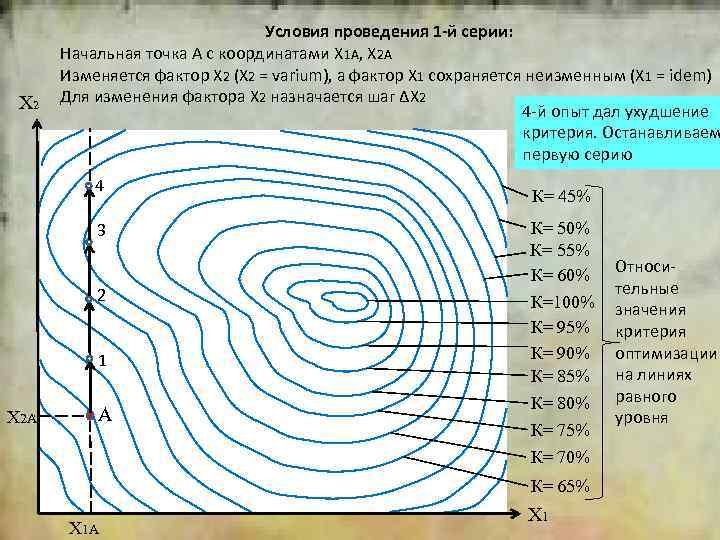

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 4 -й опыт дал ухудшение критерия. Останавливаем первую серию 4 3 2 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 Условия проведения 1 -й серии: Начальная точка А с координатами Х 1 А, Х 2 А Изменяется фактор Х 2 (Х 2 = varium), а фактор Х 1 сохраняется неизменным (Х 1 = idem) Для изменения фактора Х 2 назначается шаг ΔХ 2 4 -й опыт дал ухудшение критерия. Останавливаем первую серию 4 3 2 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

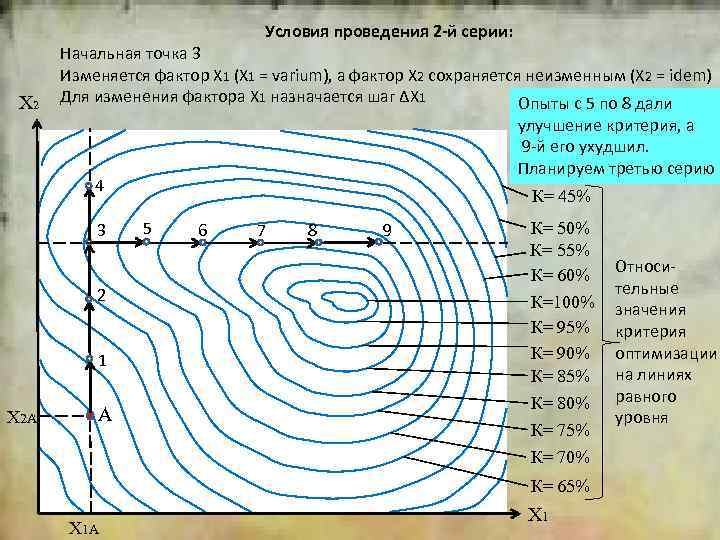

2 Условия проведения 2 -й серии: X 2 Начальная точка 3 Изменяется фактор Х 1 (Х 1 = varium), а фактор Х 2 сохраняется неизменным (Х 2 = idem) Для изменения фактора Х 1 назначается шаг ΔХ 1 Опыты с 5 по 8 дали улучшение критерия, а 9 -й его ухудшил. Планируем третью серию 4 3 2 К= 45% 5 6 7 К= 8 8 9 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 Условия проведения 2 -й серии: X 2 Начальная точка 3 Изменяется фактор Х 1 (Х 1 = varium), а фактор Х 2 сохраняется неизменным (Х 2 = idem) Для изменения фактора Х 1 назначается шаг ΔХ 1 Опыты с 5 по 8 дали улучшение критерия, а 9 -й его ухудшил. Планируем третью серию 4 3 2 К= 45% 5 6 7 К= 8 8 9 К= 7 К= 6 К= 5 К= 4 1 X 2 А А К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

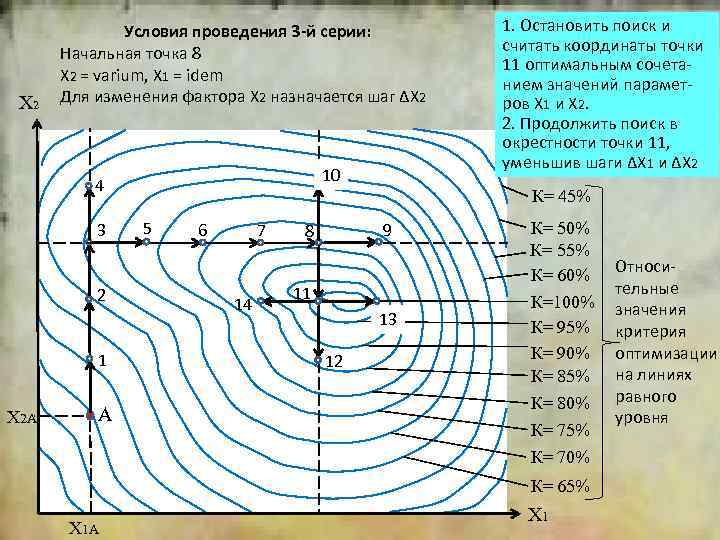

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 10 4 3 2 К= 45% 5 6 7 К= 8 9 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А 2 А вот куда двигаться: вверх или вниз? Форма «горы» нам априори не известна, поэтому выбираем наугад. Допустим, решили двигаться вверх. Увы, опыт 10 ухудшил результат. К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 10 4 3 2 К= 45% 5 6 7 К= 8 9 8 К= 7 К= 6 К= 5 К= 4 1 X 2 А А 2 А вот куда двигаться: вверх или вниз? Форма «горы» нам априори не известна, поэтому выбираем наугад. Допустим, решили двигаться вверх. Увы, опыт 10 ухудшил результат. К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 2 К= 45% 5 6 7 К= 8 9 8 К= 7 К= 6 11 К= 5 К= 4 1 X 2 А А Стало быть, наш выбор не удачен. Поменяем направление на противоположное (опыт 11). 10 4 3 2 К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 2 К= 45% 5 6 7 К= 8 9 8 К= 7 К= 6 11 К= 5 К= 4 1 X 2 А А Стало быть, наш выбор не удачен. Поменяем направление на противоположное (опыт 11). 10 4 3 2 К= 3 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

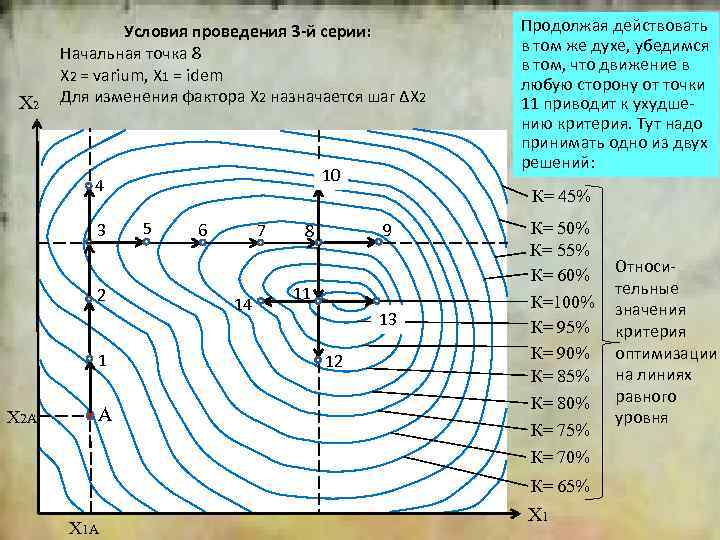

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 10 4 3 2 1 X 2 А А 2 Продолжая действовать в том же духе, убедимся в том, что движение в любую сторону от точки 11 приводит к ухудшению критерия. Тут надо принимать одно из двух решений: К= 45% 5 6 7 14 К= 8 9 8 К= 7 К= 6 11 К= 5 13 К= 4 12 К= 3 К= 50% К= 55% К= 60% К= 2 К= 80% К= 75% К= 1 К=100% К= 95% К= 90% К= 85% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 10 4 3 2 1 X 2 А А 2 Продолжая действовать в том же духе, убедимся в том, что движение в любую сторону от точки 11 приводит к ухудшению критерия. Тут надо принимать одно из двух решений: К= 45% 5 6 7 14 К= 8 9 8 К= 7 К= 6 11 К= 5 13 К= 4 12 К= 3 К= 50% К= 55% К= 60% К= 2 К= 80% К= 75% К= 1 К=100% К= 95% К= 90% К= 85% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 10 4 3 2 1 X 2 А А 2 1. Остановить поиск и считать координаты точки 11 оптимальным сочетанием значений параметров Х 1 и Х 2. 2. Продолжить поиск в окрестности точки 11, уменьшив шаги ΔХ 1 и ΔХ 2 К= 45% 5 6 7 14 К= 8 9 8 К= 7 К= 6 11 К= 5 13 К= 4 12 К= 3 К= 50% К= 55% К= 60% К= 2 К= 80% К= 75% К= 1 К=100% К= 95% К= 90% К= 85% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

X 2 Условия проведения 3 -й серии: Начальная точка 8 Х 2 = varium, Х 1 = idem Для изменения фактора Х 2 назначается шаг ΔХ 2 10 4 3 2 1 X 2 А А 2 1. Остановить поиск и считать координаты точки 11 оптимальным сочетанием значений параметров Х 1 и Х 2. 2. Продолжить поиск в окрестности точки 11, уменьшив шаги ΔХ 1 и ΔХ 2 К= 45% 5 6 7 14 К= 8 9 8 К= 7 К= 6 11 К= 5 13 К= 4 12 К= 3 К= 50% К= 55% К= 60% К= 2 К= 80% К= 75% К= 1 К=100% К= 95% К= 90% К= 85% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

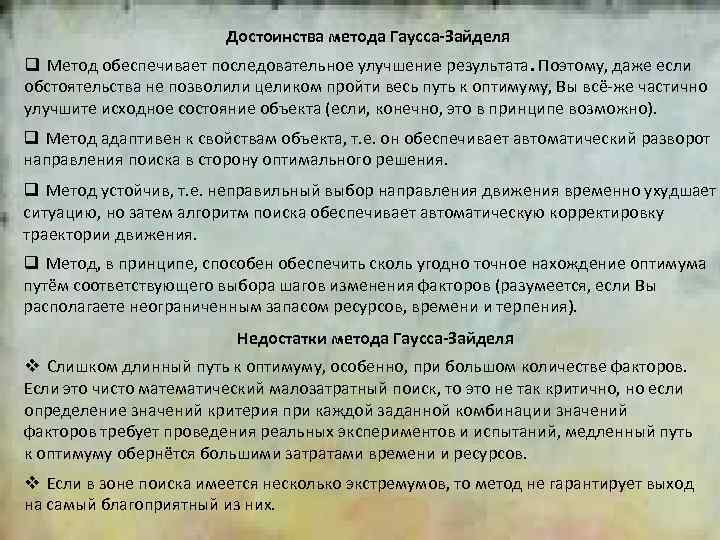

Достоинства метода Гаусса-Зайделя 2 q Метод обеспечивает последовательное улучшение результата. Поэтому, даже если обстоятельства не позволили целиком пройти весь путь к оптимуму, Вы всё-же частично улучшите исходное состояние объекта (если, конечно, это в принципе возможно). q Метод адаптивен к свойствам объекта, т. е. он обеспечивает автоматический разворот направления поиска в сторону оптимального решения. q Метод устойчив, т. е. неправильный выбор направления движения временно ухудшает ситуацию, но затем алгоритм поиска обеспечивает автоматическую корректировку траектории движения. q Метод, в принципе, способен обеспечить сколь угодно точное нахождение оптимума путём соответствующего выбора шагов изменения факторов (разумеется, если Вы располагаете неограниченным запасом ресурсов, времени и терпения). Недостатки метода Гаусса-Зайделя v Слишком длинный путь к оптимуму, особенно, при большом количестве факторов. Если это чисто математический малозатратный поиск, то это не так критично, но если определение значений критерия при каждой заданной комбинации значений факторов требует проведения реальных экспериментов и испытаний, медленный путь к оптимуму обернётся большими затратами времени и ресурсов. v Если в зоне поиска имеется несколько экстремумов, то метод не гарантирует выход на самый благоприятный из них.

Достоинства метода Гаусса-Зайделя 2 q Метод обеспечивает последовательное улучшение результата. Поэтому, даже если обстоятельства не позволили целиком пройти весь путь к оптимуму, Вы всё-же частично улучшите исходное состояние объекта (если, конечно, это в принципе возможно). q Метод адаптивен к свойствам объекта, т. е. он обеспечивает автоматический разворот направления поиска в сторону оптимального решения. q Метод устойчив, т. е. неправильный выбор направления движения временно ухудшает ситуацию, но затем алгоритм поиска обеспечивает автоматическую корректировку траектории движения. q Метод, в принципе, способен обеспечить сколь угодно точное нахождение оптимума путём соответствующего выбора шагов изменения факторов (разумеется, если Вы располагаете неограниченным запасом ресурсов, времени и терпения). Недостатки метода Гаусса-Зайделя v Слишком длинный путь к оптимуму, особенно, при большом количестве факторов. Если это чисто математический малозатратный поиск, то это не так критично, но если определение значений критерия при каждой заданной комбинации значений факторов требует проведения реальных экспериментов и испытаний, медленный путь к оптимуму обернётся большими затратами времени и ресурсов. v Если в зоне поиска имеется несколько экстремумов, то метод не гарантирует выход на самый благоприятный из них.

2 В чём причина медлительности метода Гаусса-Зайделя? Представьте себе альпинистов, идущих к вершине горы по кусочно-линейной траектории, содержащей только широтные (запад-восток) и меридиональные (север-юг) участки. Наверное, они очень нескоро водрузят победный флаг на вершине. Нельзя ли как-то сократить этот путь? Понятно, что кратчайшей траекторией была бы прямая, соединяющая отправную точку с вершиной. Но реальным альпинистам так двигаться не позволяет сложная форма склонов. Да и вершина горы людям, стоящим у её подножья, обычно не видна. Тем не менее, можно форсировать восхождение, если осмотреться вокруг и начать движение в направлении наиболее крутого склона. Нам с Вами форма склонов нашей математической горы помешать не может, а вот второе препятствие значимо и для нас: мы тоже не видим вершину. Ну что же, давайте поступим аналогичным образом: изучим свойства нашего объекта в окрестности отправной точки и будем двигаться в том направлении, в котором функция K = f(X 1, X 2) изменяется с максимальной скоростью. Вектор, указывающий направление наибольшей интенсивности изменения функции, математики называют градиентом. Значит, и придуманный нами метод, можно назвать градиентным. Справедливости ради надо указать, что его ещё раньше – в 1951 году – предложили Box и Wilson. С тех пор его так и называют: метод Бокса-Уилсона. А также метод «крутого восхождения» (если нужен максимум критерия) или «наискорейшего спуска» (если нужен минимум).

2 В чём причина медлительности метода Гаусса-Зайделя? Представьте себе альпинистов, идущих к вершине горы по кусочно-линейной траектории, содержащей только широтные (запад-восток) и меридиональные (север-юг) участки. Наверное, они очень нескоро водрузят победный флаг на вершине. Нельзя ли как-то сократить этот путь? Понятно, что кратчайшей траекторией была бы прямая, соединяющая отправную точку с вершиной. Но реальным альпинистам так двигаться не позволяет сложная форма склонов. Да и вершина горы людям, стоящим у её подножья, обычно не видна. Тем не менее, можно форсировать восхождение, если осмотреться вокруг и начать движение в направлении наиболее крутого склона. Нам с Вами форма склонов нашей математической горы помешать не может, а вот второе препятствие значимо и для нас: мы тоже не видим вершину. Ну что же, давайте поступим аналогичным образом: изучим свойства нашего объекта в окрестности отправной точки и будем двигаться в том направлении, в котором функция K = f(X 1, X 2) изменяется с максимальной скоростью. Вектор, указывающий направление наибольшей интенсивности изменения функции, математики называют градиентом. Значит, и придуманный нами метод, можно назвать градиентным. Справедливости ради надо указать, что его ещё раньше – в 1951 году – предложили Box и Wilson. С тех пор его так и называют: метод Бокса-Уилсона. А также метод «крутого восхождения» (если нужен максимум критерия) или «наискорейшего спуска» (если нужен минимум).

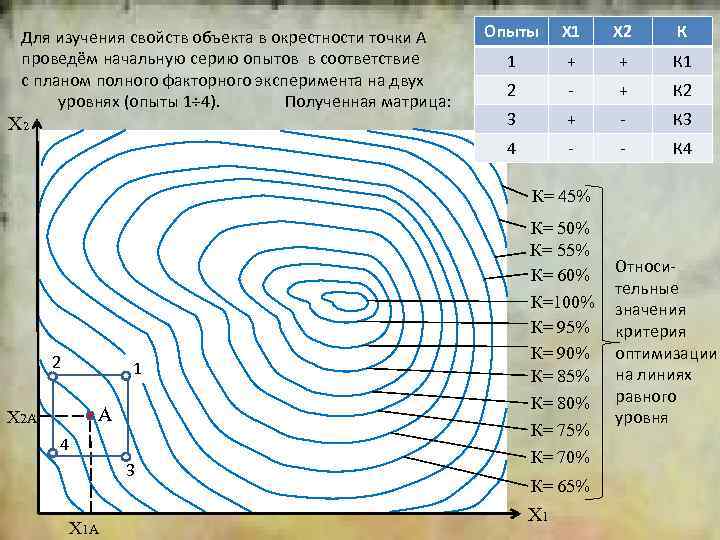

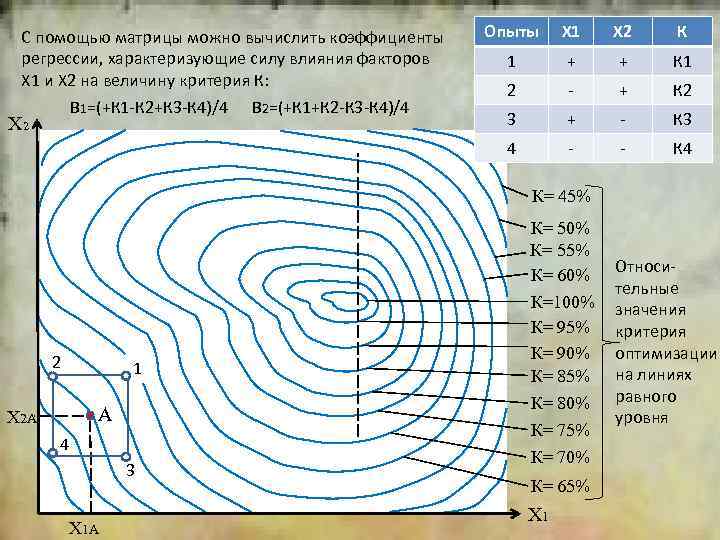

2 X 2 Опыты Х 1 Х 2 К 1 + + К 1 2 - + К 2 3 + - К 3 4 Для изучения свойств объекта в окрестности точки А проведём начальную серию опытов в соответствие с планом полного факторного эксперимента на двух уровнях (опыты 1÷ 4). Полученная матрица: - - К 4 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 1 К= 2 А X 2 А К= 1 4 3 X 1 А К= 3 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 Опыты Х 1 Х 2 К 1 + + К 1 2 - + К 2 3 + - К 3 4 Для изучения свойств объекта в окрестности точки А проведём начальную серию опытов в соответствие с планом полного факторного эксперимента на двух уровнях (опыты 1÷ 4). Полученная матрица: - - К 4 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 1 К= 2 А X 2 А К= 1 4 3 X 1 А К= 3 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 В 1=(+К 1 -К 2+К 3 -К 4)/4 В 2=(+К 1+К 2 -К 3 -К 4)/4 X 2 Опыты Х 1 Х 2 К 1 + + К 1 2 - + К 2 3 + - К 3 4 С помощью матрицы можно вычислить коэффициенты регрессии, характеризующие силу влияния факторов Х 1 и Х 2 на величину критерия К: - - К 4 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 1 К= 2 А X 2 А К= 1 4 3 X 1 А К= 3 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 В 1=(+К 1 -К 2+К 3 -К 4)/4 В 2=(+К 1+К 2 -К 3 -К 4)/4 X 2 Опыты Х 1 Х 2 К 1 + + К 1 2 - + К 2 3 + - К 3 4 С помощью матрицы можно вычислить коэффициенты регрессии, характеризующие силу влияния факторов Х 1 и Х 2 на величину критерия К: - - К 4 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 1 К= 2 А X 2 А К= 1 4 3 X 1 А К= 3 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 1 К= 2 А X 2 А К= 1 4 3 X 1 А К= 3 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 X 2 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 1 К= 2 А X 2 А К= 1 4 3 X 1 А К= 3 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

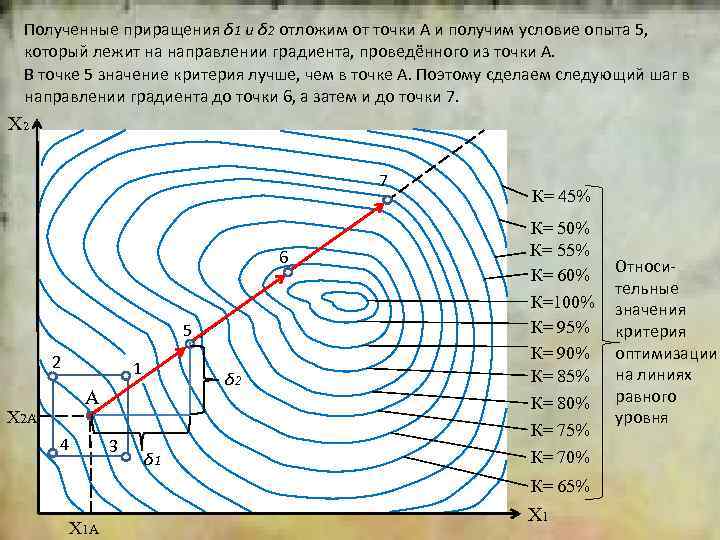

2 Полученные приращения δ 1 и δ 2 отложим от точки А и получим условие опыта 5, который лежит на направлении градиента, проведённого из точки А. В точке 5 значение критерия лучше, чем в точке А. Поэтому сделаем следующий шаг в направлении градиента до точки 6, а затем и до точки 7. X 2 7 К= 8 К= 7 6 К= 5 5 2 1 δ 2 А X 2 А 4 3 К= 4 К= 3 К= 2 К= 1 δ 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 Полученные приращения δ 1 и δ 2 отложим от точки А и получим условие опыта 5, который лежит на направлении градиента, проведённого из точки А. В точке 5 значение критерия лучше, чем в точке А. Поэтому сделаем следующий шаг в направлении градиента до точки 6, а затем и до точки 7. X 2 7 К= 8 К= 7 6 К= 5 5 2 1 δ 2 А X 2 А 4 3 К= 4 К= 3 К= 2 К= 1 δ 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 В точке 7 значение критерия стало хуже, чем в точке 6. Поэтому на этом процесс останавливаем, и считаем оптимальным сочетанием значений факторов Х 1 и Х 2 координаты точки 6. X 2 7 К= 8 К= 7 6 К= 5 5 2 1 δ 2 А X 2 А 4 3 К= 4 К= 3 К= 2 К= 1 δ 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 В точке 7 значение критерия стало хуже, чем в точке 6. Поэтому на этом процесс останавливаем, и считаем оптимальным сочетанием значений факторов Х 1 и Х 2 координаты точки 6. X 2 7 К= 8 К= 7 6 К= 5 5 2 1 δ 2 А X 2 А 4 3 К= 4 К= 3 К= 2 К= 1 δ 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 А X 1 Относительные значения критерия оптимизации на линиях равного уровня

Достоинство метода Бокса-Уилсона 2 q Метод обеспечивает быстрое продвижение к оптимуму, а значит и существенное сокращение количество опытов (по сравнению с методом Гаусса-Зайделя). Недостатки метода Бокса-Уилсона v Метод не адаптивен к свойствам объекта, т. е. он не обеспечивает автоматический разворот направления поиска в сторону оптимального решения. Движение происходит строго в направлении градиента, определённого в окрестности исходной точки. v Метод не обеспечивает сколь угодно точное нахождение оптимума по двум причинам: − погрешности, допущенные при проведении предварительного плана эксперимента, приведут к тому, что выбранное направление движения будет несколько отличаться от направления градиента; − направление градиента, даже совершенно точно определённое, далеко не всегда совпадает с направлением на экстремум. Степень расхождения зависит от свойств объекта: Примечание: градиент всегда направлен по нормали к линии равного уровня

Достоинство метода Бокса-Уилсона 2 q Метод обеспечивает быстрое продвижение к оптимуму, а значит и существенное сокращение количество опытов (по сравнению с методом Гаусса-Зайделя). Недостатки метода Бокса-Уилсона v Метод не адаптивен к свойствам объекта, т. е. он не обеспечивает автоматический разворот направления поиска в сторону оптимального решения. Движение происходит строго в направлении градиента, определённого в окрестности исходной точки. v Метод не обеспечивает сколь угодно точное нахождение оптимума по двум причинам: − погрешности, допущенные при проведении предварительного плана эксперимента, приведут к тому, что выбранное направление движения будет несколько отличаться от направления градиента; − направление градиента, даже совершенно точно определённое, далеко не всегда совпадает с направлением на экстремум. Степень расхождения зависит от свойств объекта: Примечание: градиент всегда направлен по нормали к линии равного уровня

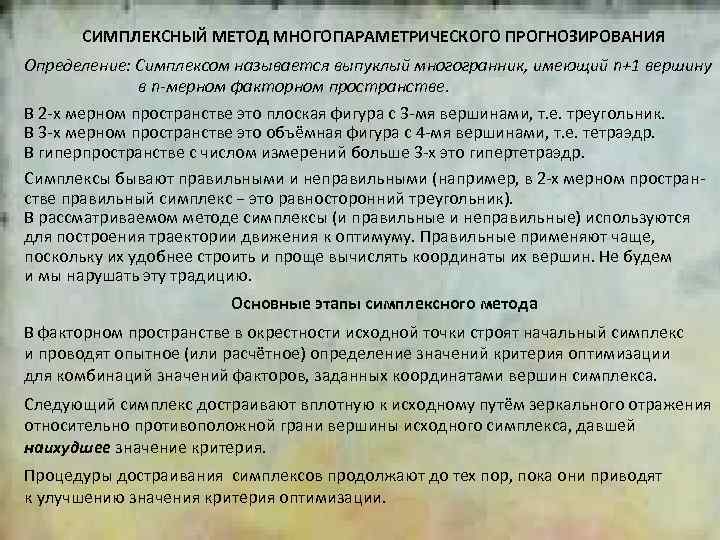

СИМПЛЕКСНЫЙ МЕТОД МНОГОПАРАМЕТРИЧЕСКОГО ПРОГНОЗИРОВАНИЯ 2 Определение: Симплексом называется выпуклый многогранник, имеющий n+1 вершину в n-мерном факторном пространстве. В 2 -х мерном пространстве это плоская фигура с 3 -мя вершинами, т. е. треугольник. В 3 -х мерном пространстве это объёмная фигура с 4 -мя вершинами, т. е. тетраэдр. В гиперпространстве с числом измерений больше 3 -х это гипертетраэдр. Симплексы бывают правильными и неправильными (например, в 2 -х мерном пространстве правильный симплекс − это равносторонний треугольник). В рассматриваемом методе симплексы (и правильные и неправильные) используются для построения траектории движения к оптимуму. Правильные применяют чаще, поскольку их удобнее строить и проще вычислять координаты их вершин. Не будем и мы нарушать эту традицию. Основные этапы симплексного метода В факторном пространстве в окрестности исходной точки строят начальный симплекс и проводят опытное (или расчётное) определение значений критерия оптимизации для комбинаций значений факторов, заданных координатами вершин симплекса. Следующий симплекс достраивают вплотную к исходному путём зеркального отражения относительно противоположной грани вершины исходного симплекса, давшей наихудшее значение критерия. Процедуры достраивания симплексов продолжают до тех пор, пока они приводят к улучшению значения критерия оптимизации.

СИМПЛЕКСНЫЙ МЕТОД МНОГОПАРАМЕТРИЧЕСКОГО ПРОГНОЗИРОВАНИЯ 2 Определение: Симплексом называется выпуклый многогранник, имеющий n+1 вершину в n-мерном факторном пространстве. В 2 -х мерном пространстве это плоская фигура с 3 -мя вершинами, т. е. треугольник. В 3 -х мерном пространстве это объёмная фигура с 4 -мя вершинами, т. е. тетраэдр. В гиперпространстве с числом измерений больше 3 -х это гипертетраэдр. Симплексы бывают правильными и неправильными (например, в 2 -х мерном пространстве правильный симплекс − это равносторонний треугольник). В рассматриваемом методе симплексы (и правильные и неправильные) используются для построения траектории движения к оптимуму. Правильные применяют чаще, поскольку их удобнее строить и проще вычислять координаты их вершин. Не будем и мы нарушать эту традицию. Основные этапы симплексного метода В факторном пространстве в окрестности исходной точки строят начальный симплекс и проводят опытное (или расчётное) определение значений критерия оптимизации для комбинаций значений факторов, заданных координатами вершин симплекса. Следующий симплекс достраивают вплотную к исходному путём зеркального отражения относительно противоположной грани вершины исходного симплекса, давшей наихудшее значение критерия. Процедуры достраивания симплексов продолжают до тех пор, пока они приводят к улучшению значения критерия оптимизации.

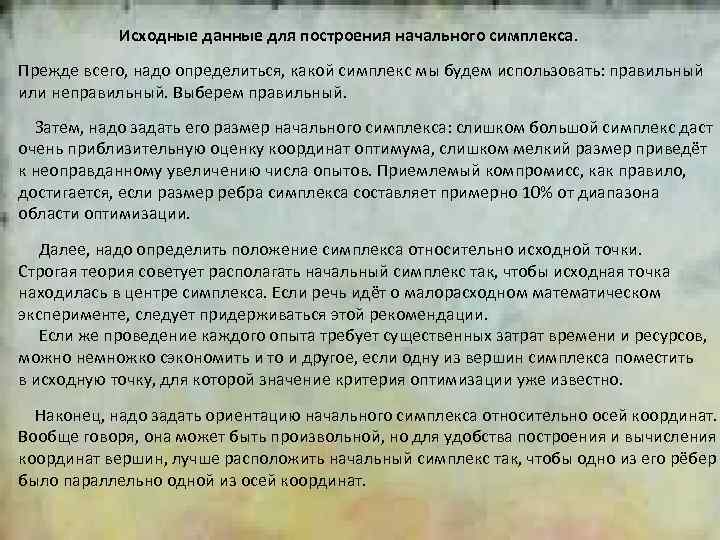

Исходные данные для построения начального симплекса. 2 Прежде всего, надо определиться, какой симплекс мы будем использовать: правильный или неправильный. Выберем правильный. Затем, надо задать его размер начального симплекса: слишком большой симплекс даст очень приблизительную оценку координат оптимума, слишком мелкий размер приведёт к неоправданному увеличению числа опытов. Приемлемый компромисс, как правило, достигается, если размер ребра симплекса составляет примерно 10% от диапазона области оптимизации. Далее, надо определить положение симплекса относительно исходной точки. Строгая теория советует располагать начальный симплекс так, чтобы исходная точка находилась в центре симплекса. Если речь идёт о малорасходном математическом эксперименте, следует придерживаться этой рекомендации. Если же проведение каждого опыта требует существенных затрат времени и ресурсов, можно немножко сэкономить и то и другое, если одну из вершин симплекса поместить в исходную точку, для которой значение критерия оптимизации уже известно. Наконец, надо задать ориентацию начального симплекса относительно осей координат. Вообще говоря, она может быть произвольной, но для удобства построения и вычисления координат вершин, лучше расположить начальный симплекс так, чтобы одно из его рёбер было параллельно одной из осей координат.

Исходные данные для построения начального симплекса. 2 Прежде всего, надо определиться, какой симплекс мы будем использовать: правильный или неправильный. Выберем правильный. Затем, надо задать его размер начального симплекса: слишком большой симплекс даст очень приблизительную оценку координат оптимума, слишком мелкий размер приведёт к неоправданному увеличению числа опытов. Приемлемый компромисс, как правило, достигается, если размер ребра симплекса составляет примерно 10% от диапазона области оптимизации. Далее, надо определить положение симплекса относительно исходной точки. Строгая теория советует располагать начальный симплекс так, чтобы исходная точка находилась в центре симплекса. Если речь идёт о малорасходном математическом эксперименте, следует придерживаться этой рекомендации. Если же проведение каждого опыта требует существенных затрат времени и ресурсов, можно немножко сэкономить и то и другое, если одну из вершин симплекса поместить в исходную точку, для которой значение критерия оптимизации уже известно. Наконец, надо задать ориентацию начального симплекса относительно осей координат. Вообще говоря, она может быть произвольной, но для удобства построения и вычисления координат вершин, лучше расположить начальный симплекс так, чтобы одно из его рёбер было параллельно одной из осей координат.

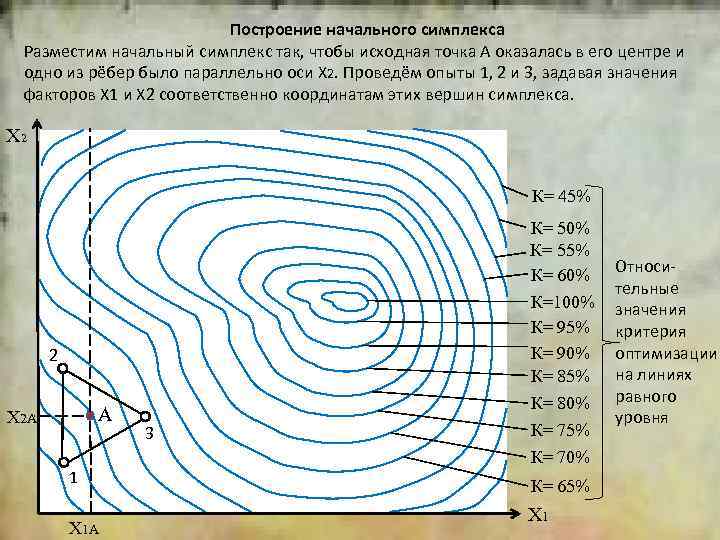

Построение начального симплекса Разместим начальный симплекс так, чтобы исходная точка А оказалась в его центре и одно из рёбер было параллельно оси Х 2. Проведём опыты 1, 2 и 3, задавая значения факторов Х 1 и Х 2 соответственно координатам этих вершин симплекса. 2 X 2 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 К= 3 А X 2 А 1 X 1 А К= 2 3 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

Построение начального симплекса Разместим начальный симплекс так, чтобы исходная точка А оказалась в его центре и одно из рёбер было параллельно оси Х 2. Проведём опыты 1, 2 и 3, задавая значения факторов Х 1 и Х 2 соответственно координатам этих вершин симплекса. 2 X 2 К= 45% К= 8 К= 7 К= 6 К= 5 К= 4 2 К= 3 А X 2 А 1 X 1 А К= 2 3 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

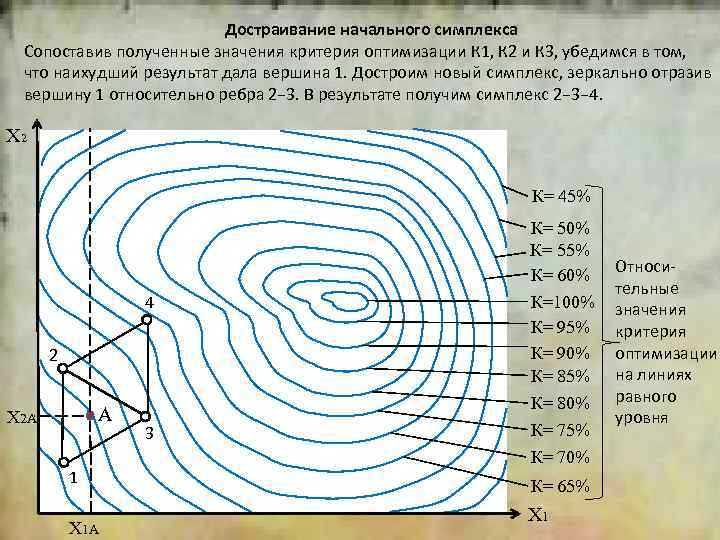

2 Достраивание начального симплекса Сопоставив полученные значения критерия оптимизации К 1, К 2 и К 3, убедимся в том, что наихудший результат дала вершина 1. Достроим новый симплекс, зеркально отразив вершину 1 относительно ребра 2− 3. В результате получим симплекс 2− 3− 4. X 2 К= 45% К= 8 К= 7 К= 6 4 К= 5 К= 4 2 К= 3 А X 2 А 1 X 1 А К= 2 3 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 Достраивание начального симплекса Сопоставив полученные значения критерия оптимизации К 1, К 2 и К 3, убедимся в том, что наихудший результат дала вершина 1. Достроим новый симплекс, зеркально отразив вершину 1 относительно ребра 2− 3. В результате получим симплекс 2− 3− 4. X 2 К= 45% К= 8 К= 7 К= 6 4 К= 5 К= 4 2 К= 3 А X 2 А 1 X 1 А К= 2 3 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

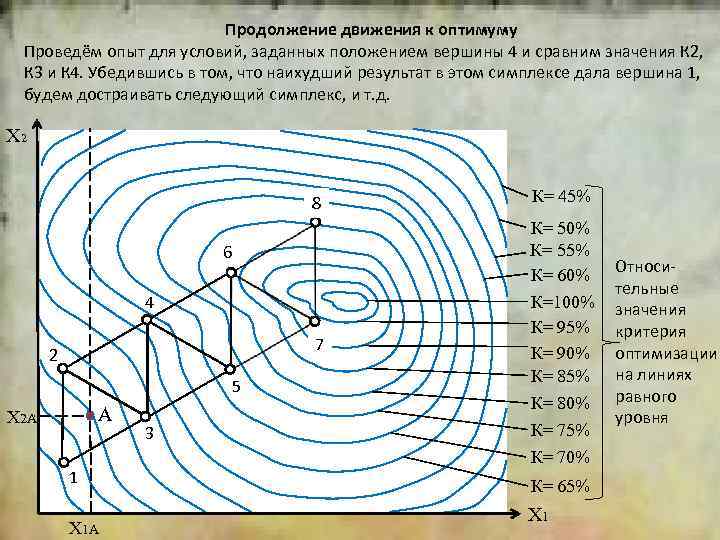

2 Продолжение движения к оптимуму Проведём опыт для условий, заданных положением вершины 4 и сравним значения К 2, К 3 и К 4. Убедившись в том, что наихудший результат в этом симплексе дала вершина 1, будем достраивать следующий симплекс, и т. д. X 2 8 К= 7 К= 6 6 4 К= 5 7 2 5 А X 2 А 1 X 1 А 3 К= 4 К= 3 К= 2 К= 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 Продолжение движения к оптимуму Проведём опыт для условий, заданных положением вершины 4 и сравним значения К 2, К 3 и К 4. Убедившись в том, что наихудший результат в этом симплексе дала вершина 1, будем достраивать следующий симплекс, и т. д. X 2 8 К= 7 К= 6 6 4 К= 5 7 2 5 А X 2 А 1 X 1 А 3 К= 4 К= 3 К= 2 К= 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

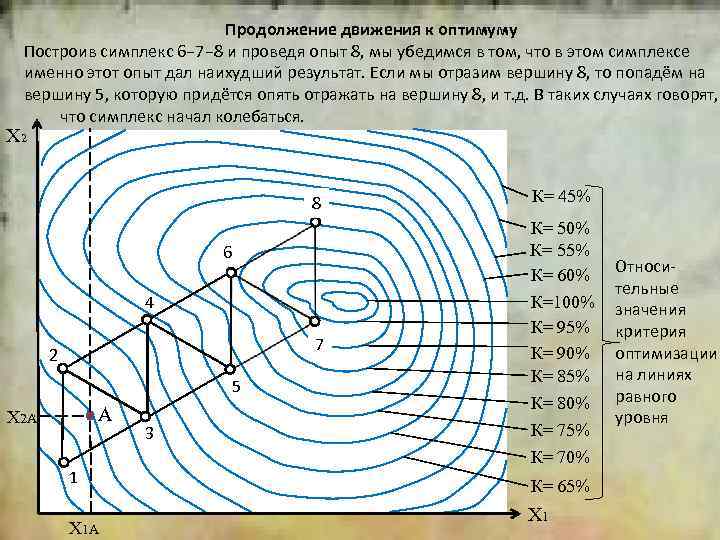

2 Продолжение движения к оптимуму Построив симплекс 6− 7− 8 и проведя опыт 8, мы убедимся в том, что в этом симплексе именно этот опыт дал наихудший результат. Если мы отразим вершину 8, то попадём на вершину 5, которую придётся опять отражать на вершину 8, и т. д. В таких случаях говорят, что симплекс начал колебаться. X 2 8 К= 7 К= 6 6 4 К= 5 7 2 5 А X 2 А 1 X 1 А 3 К= 4 К= 3 К= 2 К= 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 Продолжение движения к оптимуму Построив симплекс 6− 7− 8 и проведя опыт 8, мы убедимся в том, что в этом симплексе именно этот опыт дал наихудший результат. Если мы отразим вершину 8, то попадём на вершину 5, которую придётся опять отражать на вершину 8, и т. д. В таких случаях говорят, что симплекс начал колебаться. X 2 8 К= 7 К= 6 6 4 К= 5 7 2 5 А X 2 А 1 X 1 А 3 К= 4 К= 3 К= 2 К= 1 К= 45% К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

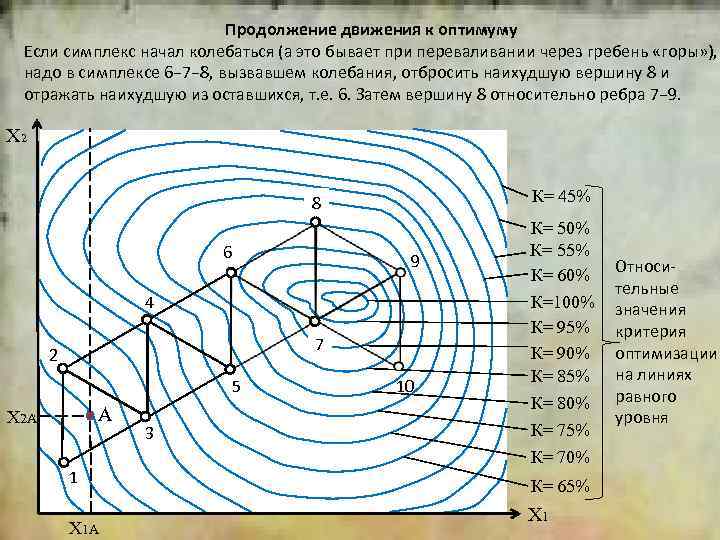

2 Продолжение движения к оптимуму Если симплекс начал колебаться (а это бывает при переваливании через гребень «горы» ), надо в симплексе 6− 7− 8, вызвавшем колебания, отбросить наихудшую вершину 8 и отражать наихудшую из оставшихся, т. е. 6. Затем вершину 8 относительно ребра 7− 9. X 2 8 К= 7 К= 6 6 4 2 5 А 1 X 1 А 3 9 К= 5 7 X 2 А К= 45% К= 4 К= 3 10 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 Продолжение движения к оптимуму Если симплекс начал колебаться (а это бывает при переваливании через гребень «горы» ), надо в симплексе 6− 7− 8, вызвавшем колебания, отбросить наихудшую вершину 8 и отражать наихудшую из оставшихся, т. е. 6. Затем вершину 8 относительно ребра 7− 9. X 2 8 К= 7 К= 6 6 4 2 5 А 1 X 1 А 3 9 К= 5 7 X 2 А К= 45% К= 4 К= 3 10 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

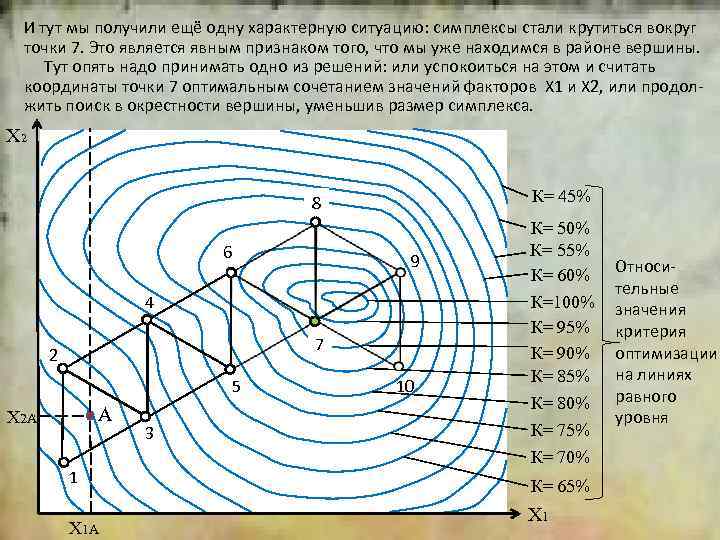

2 И тут мы получили ещё одну характерную ситуацию: симплексы стали крутиться вокруг точки 7. Это является явным признаком того, что мы уже находимся в районе вершины. Тут опять надо принимать одно из решений: или успокоиться на этом и считать координаты точки 7 оптимальным сочетанием значений факторов Х 1 и Х 2, или продолжить поиск в окрестности вершины, уменьшив размер симплекса. X 2 8 К= 7 К= 6 6 4 2 5 А 1 X 1 А 3 9 К= 5 7 X 2 А К= 45% К= 4 К= 3 10 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

2 И тут мы получили ещё одну характерную ситуацию: симплексы стали крутиться вокруг точки 7. Это является явным признаком того, что мы уже находимся в районе вершины. Тут опять надо принимать одно из решений: или успокоиться на этом и считать координаты точки 7 оптимальным сочетанием значений факторов Х 1 и Х 2, или продолжить поиск в окрестности вершины, уменьшив размер симплекса. X 2 8 К= 7 К= 6 6 4 2 5 А 1 X 1 А 3 9 К= 5 7 X 2 А К= 45% К= 4 К= 3 10 К= 2 К= 1 К= 50% К= 55% К= 60% К=100% К= 95% К= 90% К= 85% К= 80% К= 75% К= 70% К= 65% X 1 Относительные значения критерия оптимизации на линиях равного уровня

Достоинства симплексного метода Они те же, что и у метода Гаусса-Зайделя: q Постепенное улучшение результатов. q Адаптивность к свойствам объекта. q Устойчивость к случайным сбоям (если в результате ошибочно проведённого опыта отражена будет не та вершина, траектория сделает шаг в сторону, но далее опять развернётся в нужном направлении (если, конечно, Вы не будете совершать грубые ошибки во всех опытах подряд). q Изменяя размер симплекса тоже можно, как и в методе Гаусса-Зайделя, добиться нужной точности решения оптимизационной задачи. q По сравнению с методом Гаусса-Зайделя, симплексный метод быстрее приводит к оптимуму (при правильном выборе размера симплекса). Правда, всё-таки не так быстро, как градиентный. То есть, по этому показателю он занимает промежуточ ное положение между методами Гаусса-Зайделя и Бокса-Уилсона. Наша следующая тема − многокритериальная оптимизация. Но это уже через неделю. А пока − до свидания! 2

Достоинства симплексного метода Они те же, что и у метода Гаусса-Зайделя: q Постепенное улучшение результатов. q Адаптивность к свойствам объекта. q Устойчивость к случайным сбоям (если в результате ошибочно проведённого опыта отражена будет не та вершина, траектория сделает шаг в сторону, но далее опять развернётся в нужном направлении (если, конечно, Вы не будете совершать грубые ошибки во всех опытах подряд). q Изменяя размер симплекса тоже можно, как и в методе Гаусса-Зайделя, добиться нужной точности решения оптимизационной задачи. q По сравнению с методом Гаусса-Зайделя, симплексный метод быстрее приводит к оптимуму (при правильном выборе размера симплекса). Правда, всё-таки не так быстро, как градиентный. То есть, по этому показателю он занимает промежуточ ное положение между методами Гаусса-Зайделя и Бокса-Уилсона. Наша следующая тема − многокритериальная оптимизация. Но это уже через неделю. А пока − до свидания! 2