1_лекция_ИНФОРМАЦИЯ.pptx

- Количество слайдов: 10

ОСНОВЫ ТЕОРИИ ИНФОРМАЦИИ, ИНФОРМАТИКИ План 1. Информатика и ее основные задачи. 2. Понятие информации, ее виды и свойства. 3. Измерение количества информации. 1

ОСНОВЫ ТЕОРИИ ИНФОРМАЦИИ, ИНФОРМАТИКИ План 1. Информатика и ее основные задачи. 2. Понятие информации, ее виды и свойства. 3. Измерение количества информации. 1

Термин информатика (от фр. Informatique) возник в 60 -х годах 20 века. Образован путем слияния слов информация (Informacion ) и автоматика (Automatique). Развитие микропроцессорной техники, в середине 70 -х годов, привело к тому, что информатика выделилась в самостоятельную область науки, занимающейся изучением свойств информации, а также процессами ее передачи и обработки с помощью электронных вычислительных машин. 2

Термин информатика (от фр. Informatique) возник в 60 -х годах 20 века. Образован путем слияния слов информация (Informacion ) и автоматика (Automatique). Развитие микропроцессорной техники, в середине 70 -х годов, привело к тому, что информатика выделилась в самостоятельную область науки, занимающейся изучением свойств информации, а также процессами ее передачи и обработки с помощью электронных вычислительных машин. 2

2. 1. Понятие информации Термин информация происходит от латинского informatio, что означает разъяснение, осведомление, изложение. Ø С позиции материалистической философии информация рассматривается как свойство материи. Информация есть отражение реального мира с помощью сведений (сообщений). Сообщение - это форма представления информации в виде речи, текста, изображения, цифровых данных, таблиц и т. п. Правовое определение понятия «информация» дано в федеральном законе от 27 июля 2006 года № 149 -ФЗ «ОБ ИНФОРМАЦИИ, ИНФОРМАЦИОННЫХ ТЕХНОЛОГИЯХ И О ЗАЩИТЕ ИНФОРМАЦИИ» (Статья 2): «Информация — сведения (сообщения, данные) независимо от формы их 3 представления» .

2. 1. Понятие информации Термин информация происходит от латинского informatio, что означает разъяснение, осведомление, изложение. Ø С позиции материалистической философии информация рассматривается как свойство материи. Информация есть отражение реального мира с помощью сведений (сообщений). Сообщение - это форма представления информации в виде речи, текста, изображения, цифровых данных, таблиц и т. п. Правовое определение понятия «информация» дано в федеральном законе от 27 июля 2006 года № 149 -ФЗ «ОБ ИНФОРМАЦИИ, ИНФОРМАЦИОННЫХ ТЕХНОЛОГИЯХ И О ЗАЩИТЕ ИНФОРМАЦИИ» (Статья 2): «Информация — сведения (сообщения, данные) независимо от формы их 3 представления» .

Ø Концепция Клода Шеннона (1916– 2001 г. ), американского инженера и математика, основателя теории информации, отражает количественный подход и определяет информацию как меру снятия неопределенности (энтропию) события. Информация – это снятая неопределенность, или результат выбора из набора возможных альтернатив. Этот подход, не учитывает смысловую сторону (семантику) информации, но оказался весьма полезным в технике связи и вычислительной технике. 4

Ø Концепция Клода Шеннона (1916– 2001 г. ), американского инженера и математика, основателя теории информации, отражает количественный подход и определяет информацию как меру снятия неопределенности (энтропию) события. Информация – это снятая неопределенность, или результат выбора из набора возможных альтернатив. Этот подход, не учитывает смысловую сторону (семантику) информации, но оказался весьма полезным в технике связи и вычислительной технике. 4

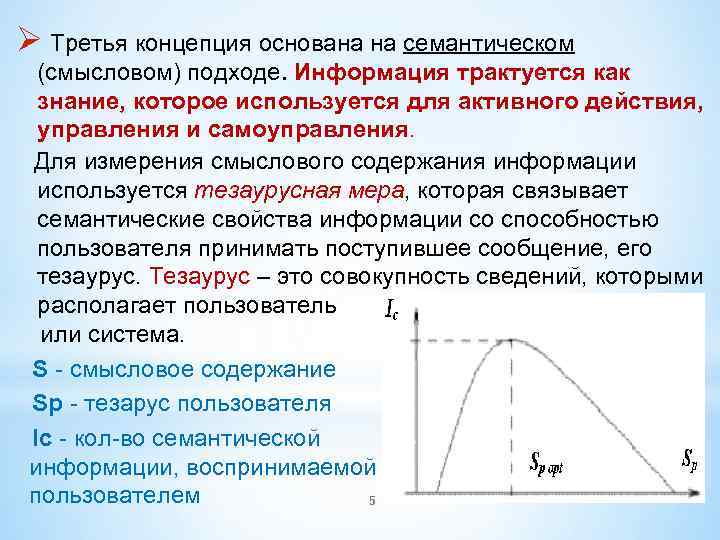

Ø Третья концепция основана на семантическом (смысловом) подходе. Информация трактуется как знание, которое используется для активного действия, управления и самоуправления. Для измерения смыслового содержания информации используется тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение, его тезаурус. Тезаурус – это совокупность сведений, которыми располагает пользователь или система. S - смысловое содержание Sp - тезарус пользователя Ic - кол-во семантической информации, воспринимаемой пользователем 5

Ø Третья концепция основана на семантическом (смысловом) подходе. Информация трактуется как знание, которое используется для активного действия, управления и самоуправления. Для измерения смыслового содержания информации используется тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение, его тезаурус. Тезаурус – это совокупность сведений, которыми располагает пользователь или система. S - смысловое содержание Sp - тезарус пользователя Ic - кол-во семантической информации, воспринимаемой пользователем 5

Обобщив данные подходы, можно дать следующее определение информации: Информация — сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний. Сведения - это знания выраженные в сигналах, сообщениях, известиях, уведомлениях и т. д. Результат регистрации сигналов, сообщений информатика рассматривает как данные. Для того чтобы данные стали информацией, требуется множество взаимосвязанных методов (естественных, аппаратных, программных) для их воспроизведения. Сигналы Данные Методы Информация - это продукт взаимодействия данных и методов, рассмотренный в контексте этого взаимодействия. 6

Обобщив данные подходы, можно дать следующее определение информации: Информация — сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний. Сведения - это знания выраженные в сигналах, сообщениях, известиях, уведомлениях и т. д. Результат регистрации сигналов, сообщений информатика рассматривает как данные. Для того чтобы данные стали информацией, требуется множество взаимосвязанных методов (естественных, аппаратных, программных) для их воспроизведения. Сигналы Данные Методы Информация - это продукт взаимодействия данных и методов, рассмотренный в контексте этого взаимодействия. 6

2. 2. Виды информации Все многообразие информации можно сгруппировать по различным признакам: По форме – дискретная, аналоговая По содержанию - научная, производственная, управленческая, правовая и др. По способам отображения (кодирования) - символьная, текстовая, графическая, музыкальная, видеоинформация, комбинированная. По способу передачи и восприятия - зрительная, слуховая, тактильная, вкусовая, машинно-ориентированная. 7

2. 2. Виды информации Все многообразие информации можно сгруппировать по различным признакам: По форме – дискретная, аналоговая По содержанию - научная, производственная, управленческая, правовая и др. По способам отображения (кодирования) - символьная, текстовая, графическая, музыкальная, видеоинформация, комбинированная. По способу передачи и восприятия - зрительная, слуховая, тактильная, вкусовая, машинно-ориентированная. 7

2. 3. Свойства информации Как и всякий объект, информация обладает свойствами. Достоверность - соответствие объективной реальности как настоящей, так и прошедшей. Адекватность - степень соответствия информации, получаемой потребителем, тому, что автор вложил в ее содержание. Полнота – количество информации, необходимое для принятия решения. Надежность - степень доверия к содержанию. Ценность - пригодность информации к практическому использованию. Избыточность - наличие в сообщении дублирующих данных. 8

2. 3. Свойства информации Как и всякий объект, информация обладает свойствами. Достоверность - соответствие объективной реальности как настоящей, так и прошедшей. Адекватность - степень соответствия информации, получаемой потребителем, тому, что автор вложил в ее содержание. Полнота – количество информации, необходимое для принятия решения. Надежность - степень доверия к содержанию. Ценность - пригодность информации к практическому использованию. Избыточность - наличие в сообщении дублирующих данных. 8

• Меры информации. Измерение количества информации (количество и объем информации) Информацию необходимо оценивать как с качественной, так и с количественной стороны. Синтаксическая мера (количество и объем информации) шенноновский подход (энтропийная), компьютерный подход). Семантическая мера (смысловая)-тезарусная. Прагматическая мера – ценность, полезность использования. 9

• Меры информации. Измерение количества информации (количество и объем информации) Информацию необходимо оценивать как с качественной, так и с количественной стороны. Синтаксическая мера (количество и объем информации) шенноновский подход (энтропийная), компьютерный подход). Семантическая мера (смысловая)-тезарусная. Прагматическая мера – ценность, полезность использования. 9

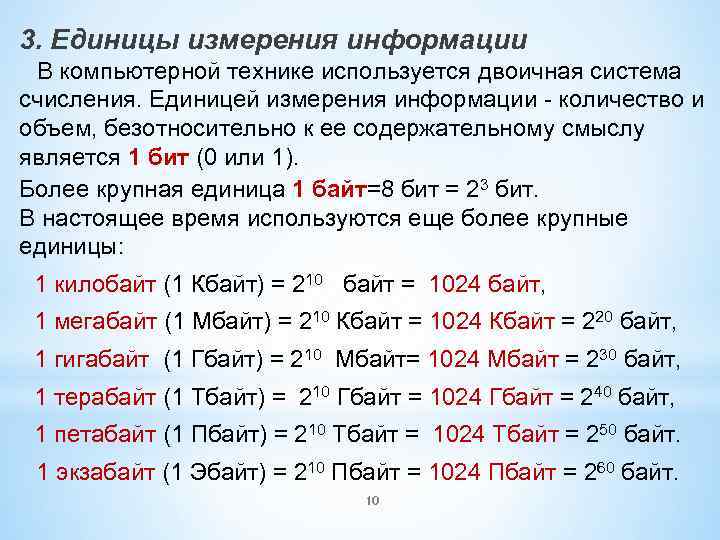

3. Единицы измерения информации В компьютерной технике используется двоичная система счисления. Единицей измерения информации - количество и объем, безотносительно к ее содержательному смыслу является 1 бит (0 или 1). Более крупная единица 1 байт=8 бит = 23 бит. В настоящее время используются еще более крупные единицы: 1 килобайт (1 Кбайт) = 210 байт = 1024 байт, 1 мегабайт (1 Мбайт) = 210 Кбайт = 1024 Кбайт = 220 байт, 1 гигабайт (1 Гбайт) = 210 Мбайт= 1024 Мбайт = 230 байт, 1 терабайт (1 Тбайт) = 210 Гбайт = 1024 Гбайт = 240 байт, 1 петабайт (1 Пбайт) = 210 Тбайт = 1024 Тбайт = 250 байт. 1 экзабайт (1 Эбайт) = 210 Пбайт = 1024 Пбайт = 260 байт. 10

3. Единицы измерения информации В компьютерной технике используется двоичная система счисления. Единицей измерения информации - количество и объем, безотносительно к ее содержательному смыслу является 1 бит (0 или 1). Более крупная единица 1 байт=8 бит = 23 бит. В настоящее время используются еще более крупные единицы: 1 килобайт (1 Кбайт) = 210 байт = 1024 байт, 1 мегабайт (1 Мбайт) = 210 Кбайт = 1024 Кбайт = 220 байт, 1 гигабайт (1 Гбайт) = 210 Мбайт= 1024 Мбайт = 230 байт, 1 терабайт (1 Тбайт) = 210 Гбайт = 1024 Гбайт = 240 байт, 1 петабайт (1 Пбайт) = 210 Тбайт = 1024 Тбайт = 250 байт. 1 экзабайт (1 Эбайт) = 210 Пбайт = 1024 Пбайт = 260 байт. 10