Лкция_7_Распознавание образов_спец_вопросы.ppt

- Количество слайдов: 38

Основы распознавания образов Современные компьютерные технологии в науке

Три типа задач распознавания образов • Классификация - разделить исходное множество объектов на заданное или произвольное число классов • Построение решающего правила (обучение) - исследовать объекты, принадлежащие разным классам, и построить формальное правило (алгоритм), позволяющее определять к какому классу принадлежит тот или иной объект. • Распознавание - отнести вновь предъявленный объект к одному из известных классов.

Задача классификации - разделение множества объектов на классы. • Идея классификации одна из наиболее фундаментальных и конструктивных идей в науке и любой интеллектуальной деятельности. Умение правильно разделять и группировать множество окружающих нас предметов, объектов и явлений по их сходству или различию чрезвычайно важно для выживания и достижения успеха (съедобное и ядовитое, опасное и полезное, важное и ненужное). • 1. Ai =A • 2. Ai Aj= • 3. aik Ak , каждый объект включается в один и только один класс(образ). Каждый класс содержит как минимум 1 объект. Объекты, отнесенные к одному классу должны быть максимально «похожи» . Объекты, отнесенные к разным классам, должны быть максимально «различны» .

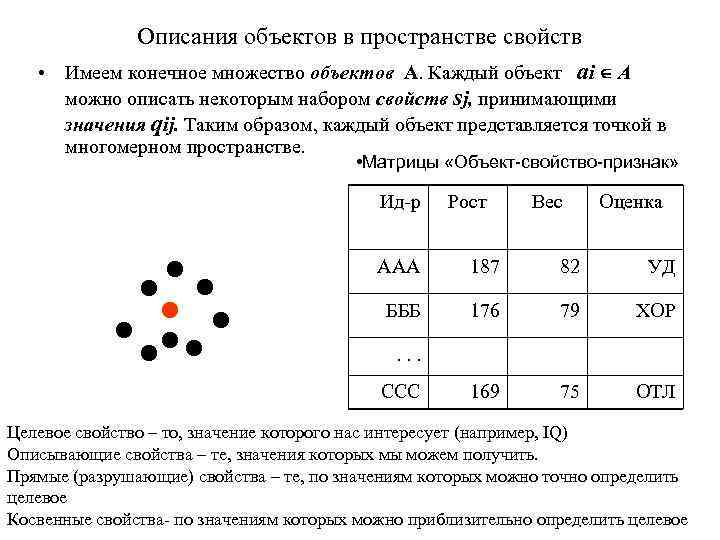

Описания объектов в пространстве свойств • Имеем конечное множество объектов А. Каждый объект аi А можно описать некоторым набором свойств sj, принимающими значения qij. Таким образом, каждый объект представляется точкой в многомерном пространстве. . • Матрицы «Объект-свойство-признак» Ид-р Рост Вес Оценка ААА 187 82 УД БББ 176 79 ХОР 169 75 ОТЛ . . . ССС Целевое свойство – то, значение которого нас интересует (например, IQ) Описывающие свойства – те, значения которых мы можем получить. Прямые (разрушающие) свойства – те, по значениям которых можно точно определить целевое Косвенные свойства- по значениям которых можно приблизительно определить целевое

ПРОЦЕДУРЫ КЛАССИФИКАЦИИ/РАСПОЗНАВАНИЯ БАЗИРУЮТСЯ НА РАЗНЫХ СПОСОБАХ ОПРЕДЕЛЕНИЯ РАССТОЯНИЯ В ПРОСТРАНСТВЕ СВОЙСТВ. R 1(х, у) – расстояние между двумя точками в пространстве свойств R 2(х, У) – расстояние между точкой и множеством точек R 3(Х, У) – расстояние между двумя множествами точек

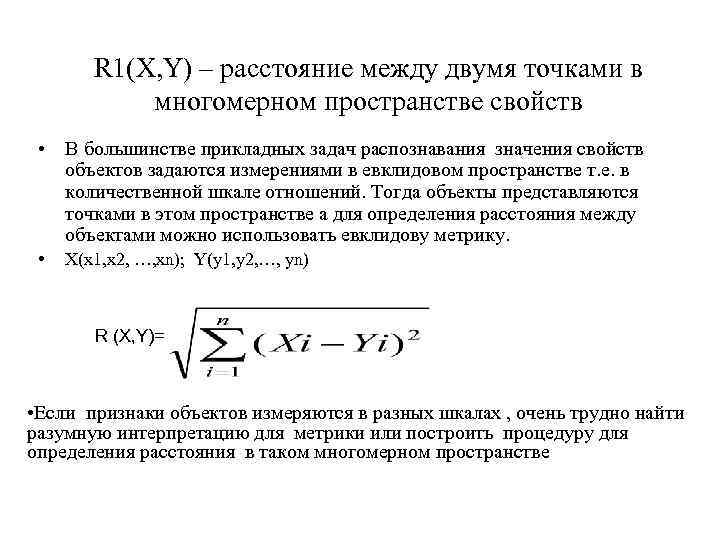

R 1(X, Y) – расстояние между двумя точками в многомерном пространстве свойств • В большинстве прикладных задач распознавания значения свойств объектов задаются измерениями в евклидовом пространстве т. е. в количественной шкале отношений. Тогда объекты представляются точками в этом пространстве а для определения расстояния между объектами можно использовать евклидову метрику. • X(х1, х2, …, хn); Y(y 1, y 2, …, yn) R (X, Y)= • Если признаки объектов измеряются в разных шкалах , очень трудно найти разумную интерпретацию для метрики или построить процедуру для определения расстояния в таком многомерном пространстве

АЛГОРИТМЫ КЛАССИФИКАЦИИ Метод ближайшего соседа Группы, состоящие вначале из одного индивидуума, объединяются исходя из расстояния в пространстве свойств. Группы, между которыми расстояния самые маленькие, объединяются. Каждое объединение уменьшает число исходных групп на единицу. Расстояние между группами определяется как расстояние между ближайшими членами групп. Метод приводит к образованию цепных кластеров . . . .

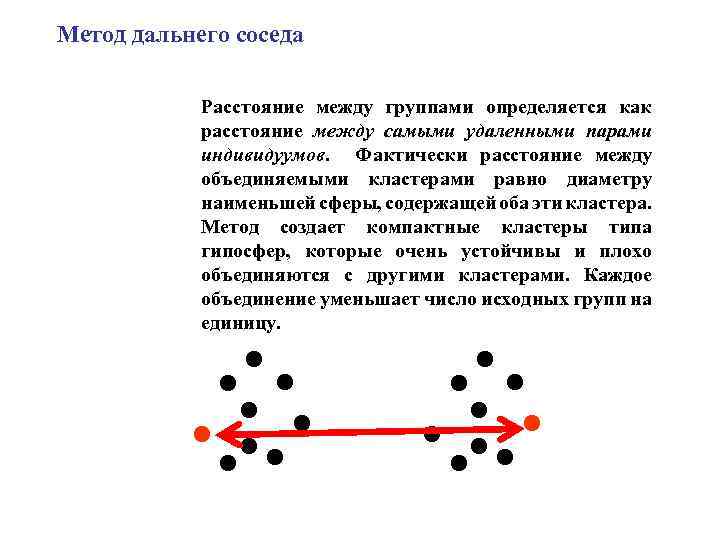

Метод дальнего соседа Расстояние между группами определяется как расстояние между самыми удаленными парами индивидуумов. Фактически расстояние между объединяемыми кластерами равно диаметру наименьшей сферы, содержащей оба эти кластера. Метод создает компактные кластеры типа гипосфер, которые очень устойчивы и плохо объединяются с другими кластерами. Каждое объединение уменьшает число исходных групп на единицу. . . . .

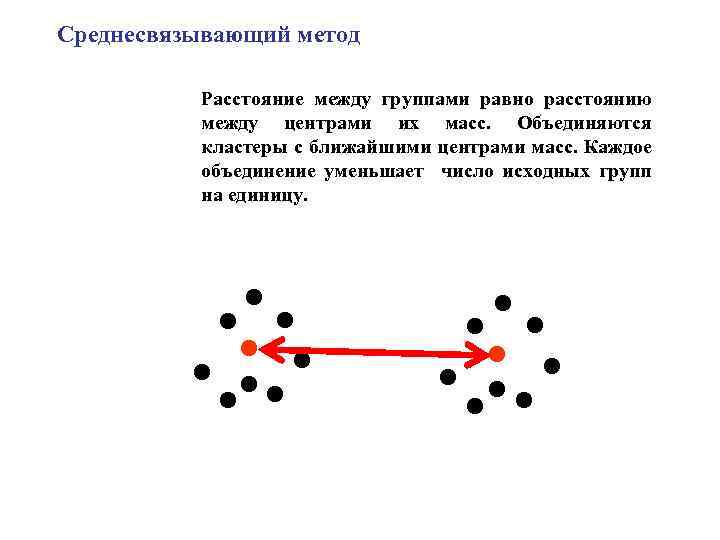

Среднесвязывающий метод Расстояние между группами равно расстоянию между центрами их масс. Объединяются кластеры с ближайшими центрами масс. Каждое объединение уменьшает число исходных групп на единицу. . . . .

Метод k-средних ISODATA Выбирается k исходных кластеров (например, k первых элементов). В качестве критерия используется минимальное расстояние внутри кластера относительно среднего. Как только элемент включается в кластер рассчитывается новое средние (центр) кластера. Процедура продолжается пока все точки не отнесены по группам Выбирается k исходных кластеров и относят все элементы в соответствии с внутрикластерным критерием минимальности (суммарное расстояние между точками кластера). После того как все элементы разделены на k кластеров, рассчитываются новые средние (центры) кластеров и вся процедура повторяется, до тех пор, пока не перестает улучшаться внутрекластерный критерий

РЕШЕНИЕ ЗАДАЧИ РАСПОЗНАВАНИЯ ВКЛЮЧАЕТ ТРИ ЭТАПА: 1. Обучение - на материалах обучающей выборки строится решающее правило; 2. Тестирование - решающее правило проверяется на материалах экзамена; 3. Оценка качества распознавания

Сложность решения задачи распознавания определяется сложностью построения решающих правил, которая в свою очередь зависит от особенностей объектов распознавания, точнее - от специфики их «образов» . Для распознавания статических образов (СО) применяются статические решающие правила (СРП), а для распознавания динамических образов (ДО) – динамические решающие правила (ДРП). СРП могут быть как простыми (однокритериальными) так и сложными (многокритериальными). ДО можно представить в виде упорядоченного ряда СО, каждый из которых отвечает определенному периоду жизненного цикла ДО. Соответственно ДРП представляет собой упорядоченную последовательность СРП, каждое из которых применяется в определенный период времени.

ОБУЧЕНИЕ Определение критериев и правил распознавания объектов (решающих правил) по их описаниям. Формируется исходное множество объектов, для которых известно к какому классу они относятся Исходное множество делятся на две части: материал «обучения» и материал «экзамена» . Материал «обучения» используется для построения решающих правил. Материал «экзамена» используется для проверки решающих правил.

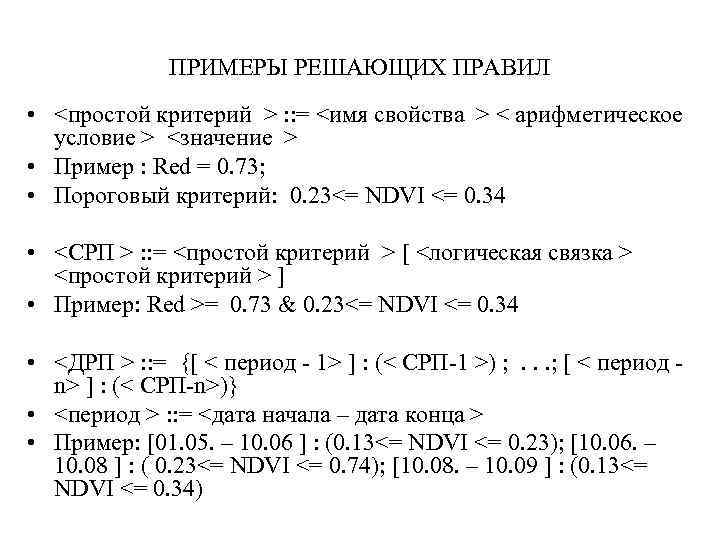

ПРИМЕРЫ РЕШАЮЩИХ ПРАВИЛ • <простой критерий > : : = <имя свойства > < арифметическое условие > <значение > • Пример : Red = 0. 73; • Пороговый критерий: 0. 23<= NDVI <= 0. 34 • <СРП > : : = <простой критерий > [ <логическая связка > <простой критерий > ] • Пример: Red >= 0. 73 & 0. 23<= NDVI <= 0. 34 • <ДРП > : : = {[ < период - 1> ] : (< СРП-1 >) ; . . . ; [ < период n> ] : (< СРП-n>)} • <период > : : = <дата начала – дата конца > • Пример: [01. 05. – 10. 06 ] : (0. 13<= NDVI <= 0. 23); [10. 06. – 10. 08 ] : ( 0. 23<= NDVI <= 0. 74); [10. 08. – 10. 09 ] : (0. 13<= NDVI <= 0. 34)

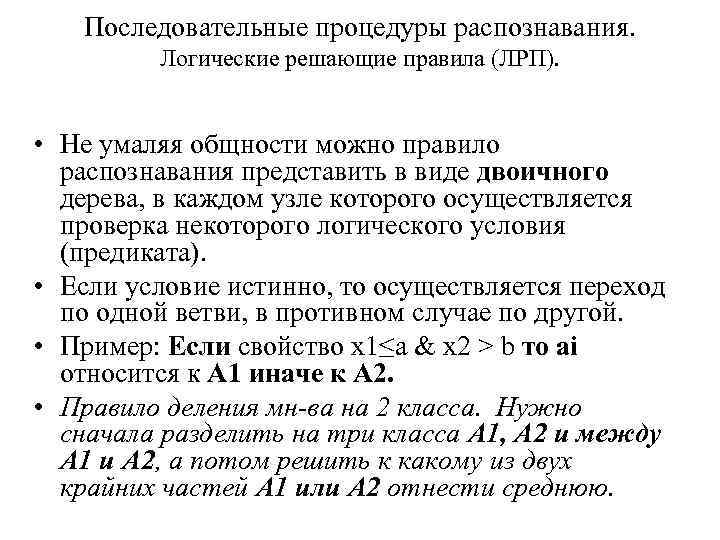

Последовательные процедуры распознавания. Логические решающие правила (ЛРП). • Не умаляя общности можно правило распознавания представить в виде двоичного дерева, в каждом узле которого осуществляется проверка некоторого логического условия (предиката). • Если условие истинно, то осуществляется переход по одной ветви, в противном случае по другой. • Пример: Если свойство х1≤а & x 2 > b то аi относится к А 1 иначе к А 2. • Правило деления мн-ва на 2 класса. Нужно сначала разделить на три класса А 1, А 2 и между А 1 и А 2, а потом решить к какому из двух крайних частей А 1 или А 2 отнести среднюю.

ТЕСТИРОВАНИЕ. Построенные правила применяются для контрольного распознавания объектов из материала «экзамена» и оценивается качество распознавания.

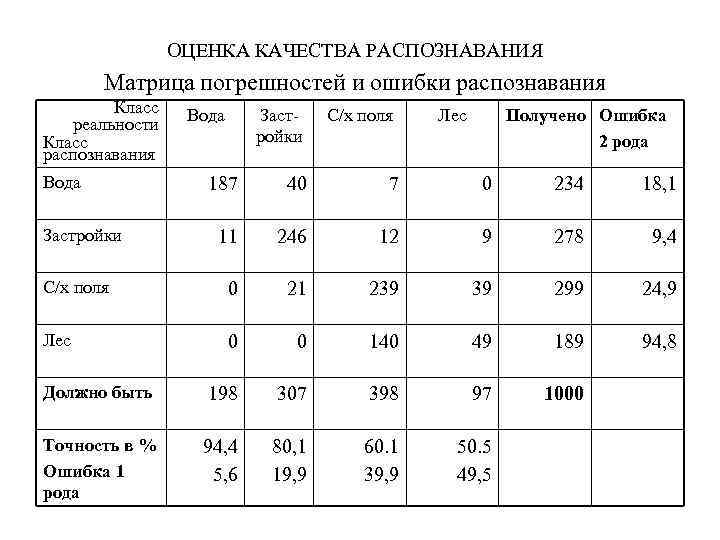

ОЦЕНКА КАЧЕСТВА РАСПОЗНАВАНИЯ Матрица погрешностей и ошибки распознавания Класс реальности Класс распознавания Вода Застройки С/х поля Лес Получено Ошибка 2 рода 187 40 7 0 234 18, 1 11 246 12 9 278 9, 4 С/х поля 0 21 239 39 299 24, 9 Лес 0 0 140 49 189 94, 8 Должно быть 198 307 398 97 1000 Точность в % Ошибка 1 рода 94, 4 5, 6 80, 1 19, 9 60. 1 39, 9 50. 5 49, 5 Застройки

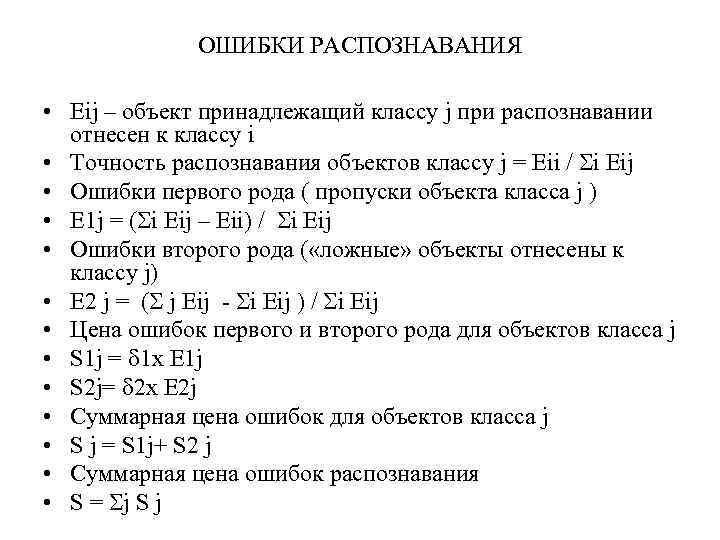

ОШИБКИ РАСПОЗНАВАНИЯ • Еij – объект принадлежащий классу j при распознавании отнесен к классу i • Точность распознавания объектов классу j = Еii / i Еij • Ошибки первого рода ( пропуски объекта класса j ) • Е 1 j = ( i Еij – Еii) / i Еij • Ошибки второго рода ( «ложные» объекты отнесены к классу j) • Е 2 j = ( j Еij - i Еij ) / i Еij • Цена ошибок первого и второго рода для объектов класса j • S 1 j = 1 х Е 1 j • S 2 j= 2 х Е 2 j • Суммарная цена ошибок для объектов класса j • S j = S 1 j+ S 2 j • Суммарная цена ошибок распознавания • S = j S j

«Обучения» продолжается до тех пор, пока на «экзамене» не будет достигнута приемлемая суммарная цена ошибок распознавания 1 и 2 -го рода для всех классов объектов. Рекомендуется: В процессе обучения периодически «перемешивать» материал «обучения» материал «экзамена» . . и

Описание «образов» является наиболее ответственной процедурой • Важную роль в процессе построения описаний играет процедура оценки информативности признаков. • Информативность является количественной характеристикой важности (вклада) признака для корректного распознавания образа. • Кандидатов в сборную команду для участия в математической и спортивной Олимпиадах отбирают по разным соображениям. Таким образом, для каждой задачи нужно строить свою систему информативных признаков.

Критерии информативности признаков • Главным критерием информативности системы признаков является величина потерь от ошибок распознавания S, которая вычисляется по контрольной выборке в процессе экзамена. Виды критериев • Минимум ошибок первого рода. • Минимум ошибок второго рода. • Суммарный минимум ошибок ( с весами) • Минимум потерь от ошибок ( с учетом цены ошибки)

Достаточные и необходимые системы признаков. Прагматический подход. • Хn - первоначальный набор признаков, который определяется на основе опыта и интуиции специалиста, решающего задачу. • Достаточной считается система признаков Хd Хn, которая при заданном наборе образов (классов ) А= {Ai: i=1, k} и решающем правиле R, обеспечивает распознавание с погрешностью не превышающей заданную величину S при затратах Р. Здесь S определяет величину потерь от ошибок распознавания, а Р – стоимость измерения признаков Хd. • Достаточная система, обеспечивающая распознавание с заданной погрешностью при минимальных затратах на измерение, является необходимой. Таким образом, задача выбора необходимой системы признаков при заданных А, R, S и Хn сводиться к выбору такой Хd* Хn , для которой Р(Хd *) =Min. • В общем случае величина Р зависит от вида и количества признаков, а также точности их измерения. В первую очередь целесообразно минимизировать количество признаков, т. е. следует искать Хd с минимальным число признаков.

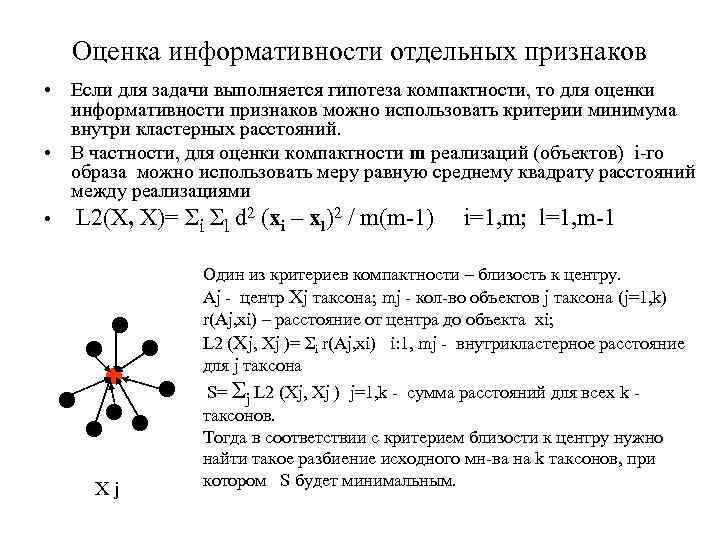

Оценка информативности отдельных признаков • Если для задачи выполняется гипотеза компактности, то для оценки информативности признаков можно использовать критерии минимума внутри кластерных расстояний. • В частности, для оценки компактности m реализаций (объектов) i-го образа можно использовать меру равную среднему квадрату расстояний между реализациями • L 2(X, X)= Σi Σl d 2 (xi – xl)2 / m(m-1) i=1, m; l=1, m-1 . . Xj Один из критериев компактности – близость к центру. Aj - центр Xj таксона; mj - кол-во объектов j таксона (j=1, k) r(Aj, xi) – расстояние от центра до объекта xi; L 2 (Xj, Xj )= Σi r(Aj, xi) i: 1, mj - внутрикластерное расстояние для j таксона S= Σj L 2 (Xj, Xj ) j=1, k - сумма расстояний для всех k таксонов. Тогда в соответствии с критерием близости к центру нужно найти такое разбиение исходного мн-ва на k таксонов, при котором S будет минимальным.

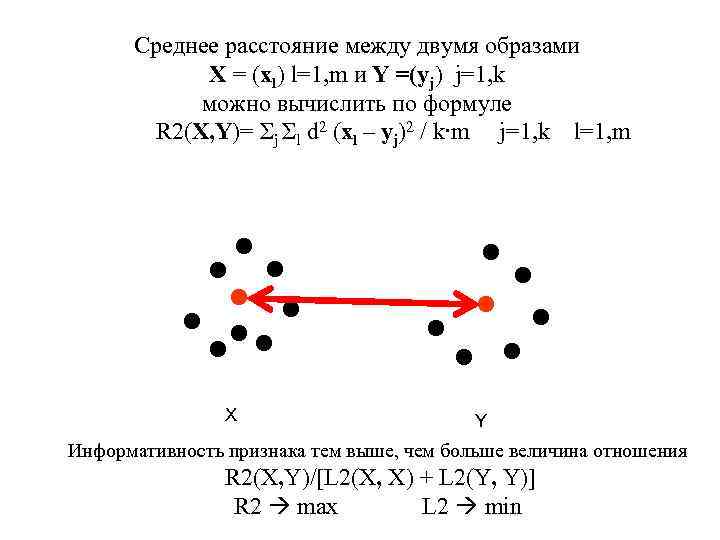

Среднее расстояние между двумя образами X = (xl) l=1, m и Y =(yj) j=1, k можно вычислить по формуле R 2(X, Y)= Σj Σl d 2 (xl – yj)2 / k∙m j=1, k l=1, m . . X . . . . Y Информативность признака тем выше, чем больше величина отношения R 2(X, Y)/[L 2(X, X) + L 2(Y, Y)] R 2 max L 2 min

• Если признаки не зависят друг от друга, то можно последовательно оценить информативность всех n признаков Хn и выбрать из них d наиболее информативных. • В реальных ситуациях условие независимости признаков, как правило, не выполняется, и, следовательно, при выборе наиболее информативного подмножества признаков оценками их индивидуальной информативности руководствоваться нельзя.

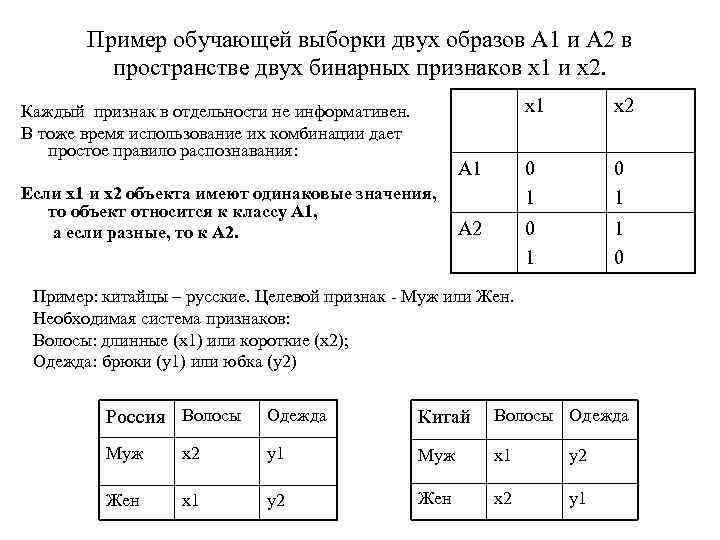

Пример обучающей выборки двух образов А 1 и А 2 в пространстве двух бинарных признаков х1 и х2. х1 Если х1 и х2 объекта имеют одинаковые значения, то объект относится к классу А 1, а если разные, то к А 2. х2 А 1 Каждый признак в отдельности не информативен. В тоже время использование их комбинации дает простое правило распознавания: 0 1 А 2 0 1 1 0 Пример: китайцы – русские. Целевой признак - Муж или Жен. Необходимая система признаков: Волосы: длинные (х1) или короткие (х2); Одежда: брюки (у1) или юбка (у2) Россия Волосы Одежда Китай Волосы Одежда Муж х2 у1 Муж х1 у2 Жен х2 у1

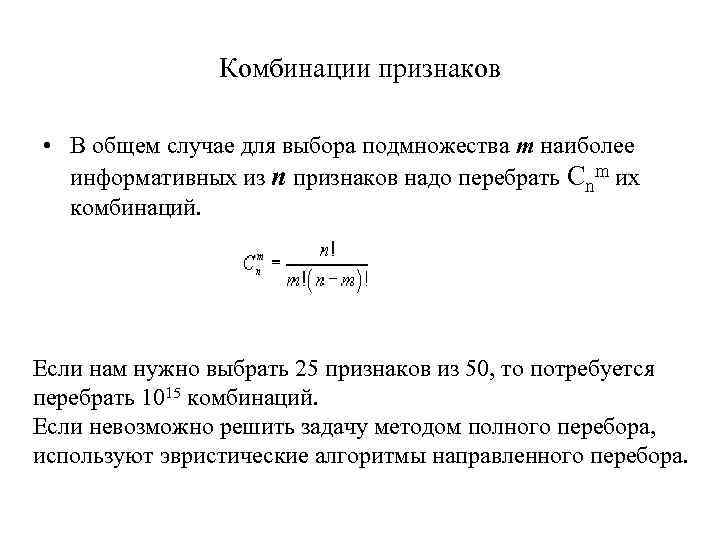

Комбинации признаков • В общем случае для выбора подмножества m наиболее информативных из n признаков надо перебрать Сnm их комбинаций. Если нам нужно выбрать 25 признаков из 50, то потребуется перебрать 1015 комбинаций. Если невозможно решить задачу методом полного перебора, используют эвристические алгоритмы направленного перебора.

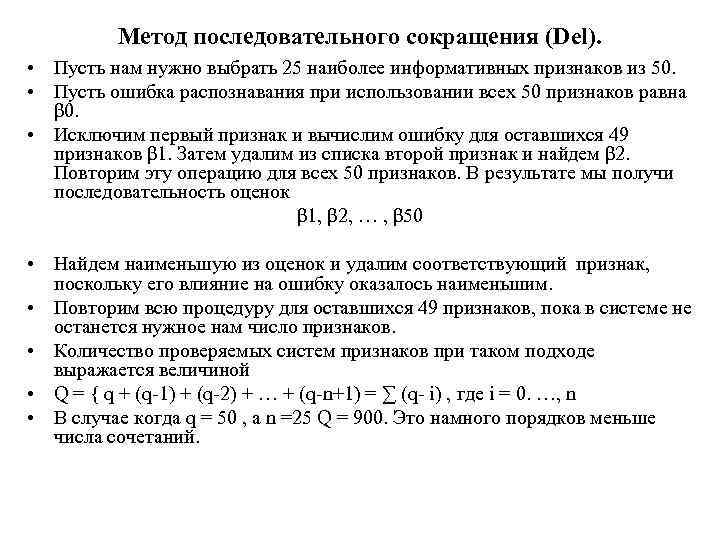

Метод последовательного сокращения (Del). • Пусть нам нужно выбрать 25 наиболее информативных признаков из 50. • Пусть ошибка распознавания при использовании всех 50 признаков равна β 0. • Исключим первый признак и вычислим ошибку для оставшихся 49 признаков β 1. Затем удалим из списка второй признак и найдем β 2. Повторим эту операцию для всех 50 признаков. В результате мы получи последовательность оценок β 1, β 2, … , β 50 • Найдем наименьшую из оценок и удалим соответствующий признак, поскольку его влияние на ошибку оказалось наименьшим. • Повторим всю процедуру для оставшихся 49 признаков, пока в системе не останется нужное нам число признаков. • Количество проверяемых систем признаков при таком подходе выражается величиной • Q = { q + (q-1) + (q-2) + … + (q-n+1) = ∑ (q- i) , где i = 0. …, n • В случае когда q = 50 , а n =25 Q = 900. Это намного порядков меньше числа сочетаний.

Метод последовательного добавления признаков (Add). • Вначале оценим количество ошибок по каждому исходному признаку. Выберем наиболее информативный признак и включим его в систему. Затем, последовательно сочетаем этот признак с оставшимися и оцениваем полученные пары. Берем за основу наиболее информативную пару и начинаем оценивать тройки и т. д. , пока не выберем нужное количество признаков. Таким образом, мы шаг за шагом строим последовательность наиболее информативных признаков • x 1, x 2, x 3 • … • x 1, x 2, x 3, …, xm • Трудоемкость этого алгоритма примерно такая же как и Del, а результаты обычно лучше.

Комбинированный метод • Можно модифицировать выбор подмножества наиболее информативных признаков комбинируя вышеописанные алгоритмы. Первая стратегия (Add-Del) предусматривает, что в начале с помощью Add выбирается n 1 информативных признаков, а затем n 2 из них удаляется методом Del. Такое чередование продолжается до тех пор, пока не будет набрано нужное подмножество. • Возможна и обратная стратегия (Del-Add). В начале работает алгоритм Del, который отбирает n 1 информативных признаков, затем включается алгоритм Add, который добавляет в систему n 2 признаков и т. д. • Опыт показывает, что наиболее эффективное является стратегия Add-Del, а n 2 целесообразно выбирать равным n 1/3.

Метод случайного поиска с адаптацией (СПА) Шаг 1 • Возьмем 0 -1 отрезок и разобьем его на n равных частей (интервалов), так что бы каждому признаку хi (i=1, n) соответствовал свой интервал. • Вначале все интервалы имеют одинаковую длину 1/ n. • Запускаем датчик случайных чисел с равномерным распределением в диапазоне (0 -1). Если число попадает в i-ый интервал, то включаем iый признак в базовое подмножество. После n 1 пусков датчика получаем базовое подмножество из n 1 признаков. • Оценим информативность построенного подмножества на обучающей выборке. Предположим, что число ошибок распознавания равно β 0.

Метод случайного поиска с адаптацией (СПА) Шаг 2 • Повторим описанную процедуру выборки n 1 -мерных подмножеств признаков и оценки их качества r раз. • В результате мы получим список оценок β 0, β 1, … , β r. На основе этих оценок выберем наилучшее и наихудшее подмножество признаков и проведем процедуру «поощрения-наказания» . • Участки, соответствующие признакам, попавшим в подмножество с наилучшей оценкой, поощряются, путем расширения на величину h (h << 1/ n) , а участки, соответствующие признакам из наихудшего подмножества- наказываются сокращением длины на такую же величину. • Если некоторый признак попадает и в наилучшее и в наихудшее подмножество, то его длина не изменяется. • Общая длина всех интервалов остается равной 1.

Метод случайного поиска с адаптацией (СПА) Шаг 3 • Повторим процесс случайного выбора сначала еще r раз и построим новые оценки. Но теперь вероятность попадания разных признаков в базовые подмножества будет различной. Поощренным признакам соответствуют интервалы большей длины и они имеют большие шансы попасть в базовые подмножества. • Повторим процедуру поощрения и наказания с учетом итоговых оценок второй серии испытаний. Таким образом интервалы, соответствующие признакам регулярно попадающим в наилучшее базовое подмножество, будут постепенно увеличиваться. И наоборот, интервалы, соответствующие признакам регулярно попадающим в наихудшее базовое подмножество, будут постепенно уменьшаться. • После некоторого числа циклов (R ), включающих процедуры выборки и адаптации, процесс стабилизируется, поскольку практически весь отрезок будет поделен на интервалы соответствующие наиболее «удачливым» признакам. • Повторение базового подмножества признаков является сигналом к завершению процесса формирования наиболее информативного подмножества признаков.

Метод случайного поиска с адаптацией (СПА) Выводы • Скорость сходимости алгоритма и качество полученных решений зависит от величины h. При больших значениях h процесс завершается быстрее, но качество решения получается хуже, чем при малых h. Малые значения h отвечают более гибкой тактике поощрений и наказаний. • Если считать, что признак наказываемый на всех R шагах все еще сохраняет ненулевую длину интервала = lmin, то величину h можно выбрать из соотношения (1/ n - Rh)≥ lmin. • Алгоритм СПА позволяет строить базовые подмножества наиболее информативных признаков за приемлемое время и дает более качественные решения по сравнению с алгоритмами Add и Del. • СПА является прообразом генетических алгоритмов

Последовательные процедуры распознавания • Пусть Х={xi: i= 1…n} –вектор описания объекта • При последовательной классификации сначала проверяется одно подмножество компонент вектора описания (n 1), а затем в зависимости от результатов этих тестов, выбирается новая совокупность тестов, использующая другие компоненты описания (n 2) и т. д. до тех пор, пока не будет ясен результат классификации. • Последовательные процедуры удобно представить в виде дерева, ветви которого соответствуют различным последовательностям тестов (каждый узел- тест). • В общем случае последовательные процедуры являются более мощными, чем параллельные, хотя и требуют для реализации больше ресурсов и времени.

Выбор решающего правила • Xn - все множество объектов • Хd Хn – обучающая выборка • Следует помнить, что в общем случае можно построить несколько правил, которые будут давать одинаковый результат для объектов из мн-ва Хd и разные – для объектов из Xn - Xd. • Для того чтобы выбрать из них какое-то одно, следует привлекать дополнительные соображения, такие как минимизация числа используемых признаков или минимизация самого длинного пути на тестовом графе. . . Хd . . . Xn

Алгоритмический подход. Комбинирование элементарных правил • В общем случае можно построить мн-во решающих правил распознавания (парадокс формализации: мощность мн-ва правил не уступает мощности базового мн-ва объектов) и возникает проблема выбора (или конструиро-вания) оптимального решающего правила (РП). • Метод коллективов РП (районирование пространства описания образов). • Обычно каждое правило хорошо работает только в ограниченной области пространства описания образов. Поэтому подбирается такой коллектив правил (набор), который обеспечивает устойчивое распознавание по всей области (каждый в своей локальной зоне – части пространства). Для каждой подобласти выбирается свое решающее правило. • Поиск «умников» среди спортсменов и ученых может потребовать разных РП, так же как и среди штангистов, футболистов и баскетболистов

Метод комитетов Для распознавания объектов применяется мн-во правил. Решение выбирается на основе голосования. Недостатки: отсутствие компетентности нельзя заменить увеличением числа экспертов. Большинство, далеко не всегда, право. • Эксперты бывают разные( разный опыт). • Хорошие эксперты попадаются редко. . .

Лкция_7_Распознавание образов_спец_вопросы.ppt