Нечеткая логика.ppt

- Количество слайдов: 62

Основы нечеткой логики Логико-лингвистические модели

Основы нечеткой логики Логико-лингвистические модели

Часть I Основы теории нечеткой логики 2

Часть I Основы теории нечеткой логики 2

Откуда всё это взялось? Люди, в силу природного эгоизма, склонны оценивать любые данные с точки зрения полезности для СЕБЯ: становятся важны не сами количественные данные, а их интерпретация КАКИЕ понятия, категории использовать для этого? ? ? Большая часть используемых нами понятий по своей природе нечетки и размыты: КАК построить пороговую функцию принадлежности для множеств «взрослый» , «холодный» , «качественный» , «быстрый» и т. д. ? ? ? Множества, для которых функция принадлежности представляет собой не жесткий порог (принадлежит/не принадлежит), а плавную кривую (часто упрощаемую ломаной линией), пробегающую все значения от нуля до единицы – нечеткие множества (fuzzy sets) Барт Коско, один из классиков нечеткой логики: “Бинарная логика - не более чем роковая ошибка античной цивилизации. ” 3

Откуда всё это взялось? Люди, в силу природного эгоизма, склонны оценивать любые данные с точки зрения полезности для СЕБЯ: становятся важны не сами количественные данные, а их интерпретация КАКИЕ понятия, категории использовать для этого? ? ? Большая часть используемых нами понятий по своей природе нечетки и размыты: КАК построить пороговую функцию принадлежности для множеств «взрослый» , «холодный» , «качественный» , «быстрый» и т. д. ? ? ? Множества, для которых функция принадлежности представляет собой не жесткий порог (принадлежит/не принадлежит), а плавную кривую (часто упрощаемую ломаной линией), пробегающую все значения от нуля до единицы – нечеткие множества (fuzzy sets) Барт Коско, один из классиков нечеткой логики: “Бинарная логика - не более чем роковая ошибка античной цивилизации. ” 3

Для чего нужна нечеткая логика? КАК на основе таких понятий (представленных нечеткими множествами) смоделировать процесс человеческих рассуждений ? ? ? создание аппарата, способного моделировать рассуждения на основе сложных причинно-следственных связей – нечеткой логики и нечеткого вывода Нечеткая логика - надмножество булевой логики, расширенной с целью обработки значений истинности между «полностью истинным» и «полностью ложным» на основе нечетких множеств разработана профессором Калифорнийского университета Беркли Лотфи А. Заде (Lotfi A. Zadeh) в работах: «Fuzzy sets» (1965 г) и «Fuzzy logic» (1975 г). University of California, Berkeley Professor Lotfi A. Zadeh 4

Для чего нужна нечеткая логика? КАК на основе таких понятий (представленных нечеткими множествами) смоделировать процесс человеческих рассуждений ? ? ? создание аппарата, способного моделировать рассуждения на основе сложных причинно-следственных связей – нечеткой логики и нечеткого вывода Нечеткая логика - надмножество булевой логики, расширенной с целью обработки значений истинности между «полностью истинным» и «полностью ложным» на основе нечетких множеств разработана профессором Калифорнийского университета Беркли Лотфи А. Заде (Lotfi A. Zadeh) в работах: «Fuzzy sets» (1965 г) и «Fuzzy logic» (1975 г). University of California, Berkeley Professor Lotfi A. Zadeh 4

Примеры использования нечеткой логики q Движением пригородных поездов до японского города Сендай, начиная с 1987 года управляет система, основанная на нечеткой логике q Создание управляющего микропроцессора на основе нечеткой логики, способного автоматически решать «задачу о собаке, догоняющей кота» (Министерство обороны США) q Matsuhita в феврале 1991 года анонсировала первую «интеллектуальную» стиральную машину, в системе управления которой применялась нечеткая логика q Решения сложнейших задач прогнозирования различных финансовых индикаторов (японская корпорация Yamaichi) q Один из отечественных программных продуктов - пакет “Бизнес-прогноз” для оценки прибыльности инвестиционных проектов. Замечание: Нечеткие системы управления и прогнозирования основаны на нечеткой базе знаний и использовании лингвистических переменных. В основу функционирования положен механизм нечеткого вывода. 5

Примеры использования нечеткой логики q Движением пригородных поездов до японского города Сендай, начиная с 1987 года управляет система, основанная на нечеткой логике q Создание управляющего микропроцессора на основе нечеткой логики, способного автоматически решать «задачу о собаке, догоняющей кота» (Министерство обороны США) q Matsuhita в феврале 1991 года анонсировала первую «интеллектуальную» стиральную машину, в системе управления которой применялась нечеткая логика q Решения сложнейших задач прогнозирования различных финансовых индикаторов (японская корпорация Yamaichi) q Один из отечественных программных продуктов - пакет “Бизнес-прогноз” для оценки прибыльности инвестиционных проектов. Замечание: Нечеткие системы управления и прогнозирования основаны на нечеткой базе знаний и использовании лингвистических переменных. В основу функционирования положен механизм нечеткого вывода. 5

q Чтобы понять, что дает применение нечеткой логики в системах управления, рассмотрим простой пример. Представьте себе, что вам необходимо разработать систему управления тяжелым длинномерным грузовиком, способную автоматически загонять его в узкий гараж из произвольной начальной точки. Если вы попытаетесь решить эту задачу классическим способом, то вам можно только посочувствовать. Придется в буквальном смысле слова увешать автомобиль всевозможными датчиками и акселерометрами, после чего привлечь пару докторов наук для составления отнюдь не простой системы уравнений в частных производных. q Использование нечеткой логики принципиально упрощает задачу. Прежде всего, используя лишь три нечетких параметра - скорость и ориентацию автомобиля и расстояние до гаража, вы получаете исчерпывающее описание текущей ситуации. Далее вы строите простую и естественную систему нечетких правил типа : q <Если до гаража достаточно далеко, скорость невелика, а нос смотрит влево возьми правее>. . 6

q Чтобы понять, что дает применение нечеткой логики в системах управления, рассмотрим простой пример. Представьте себе, что вам необходимо разработать систему управления тяжелым длинномерным грузовиком, способную автоматически загонять его в узкий гараж из произвольной начальной точки. Если вы попытаетесь решить эту задачу классическим способом, то вам можно только посочувствовать. Придется в буквальном смысле слова увешать автомобиль всевозможными датчиками и акселерометрами, после чего привлечь пару докторов наук для составления отнюдь не простой системы уравнений в частных производных. q Использование нечеткой логики принципиально упрощает задачу. Прежде всего, используя лишь три нечетких параметра - скорость и ориентацию автомобиля и расстояние до гаража, вы получаете исчерпывающее описание текущей ситуации. Далее вы строите простую и естественную систему нечетких правил типа : q <Если до гаража достаточно далеко, скорость невелика, а нос смотрит влево возьми правее>. . 6

Лингвистическая переменная Опр1 (упрощенное): Лингвистическая переменная - переменная, принимающая значения из множества слов или словосочетаний некоторого естественного или искусственного языка. Пример1: Давление = { большое, низкое, среднее } Пример1: Опр2 (полное): термы (T) Лингвистическая переменная - набор < b, T, X, G, M >, где • b – наименование лингвистической переменной; • Т – множество ее значений (базовое терм-множество), представляющих собой наименования нечетких переменных на области определения X; • G – синтаксическая процедура, позволяющая генерировать новые термы. Множество T G(T), где G(T) - множество сгенерированных термов, – расширенное терм-множество; • М – семантическая процедура, превращающая каждый терм из G(T) в нечеткую переменную. нечеткие переменные Пример1: G(T)={ низкое или среднее, очень большое …} Пример1: 7

Лингвистическая переменная Опр1 (упрощенное): Лингвистическая переменная - переменная, принимающая значения из множества слов или словосочетаний некоторого естественного или искусственного языка. Пример1: Давление = { большое, низкое, среднее } Пример1: Опр2 (полное): термы (T) Лингвистическая переменная - набор < b, T, X, G, M >, где • b – наименование лингвистической переменной; • Т – множество ее значений (базовое терм-множество), представляющих собой наименования нечетких переменных на области определения X; • G – синтаксическая процедура, позволяющая генерировать новые термы. Множество T G(T), где G(T) - множество сгенерированных термов, – расширенное терм-множество; • М – семантическая процедура, превращающая каждый терм из G(T) в нечеткую переменную. нечеткие переменные Пример1: G(T)={ низкое или среднее, очень большое …} Пример1: 7

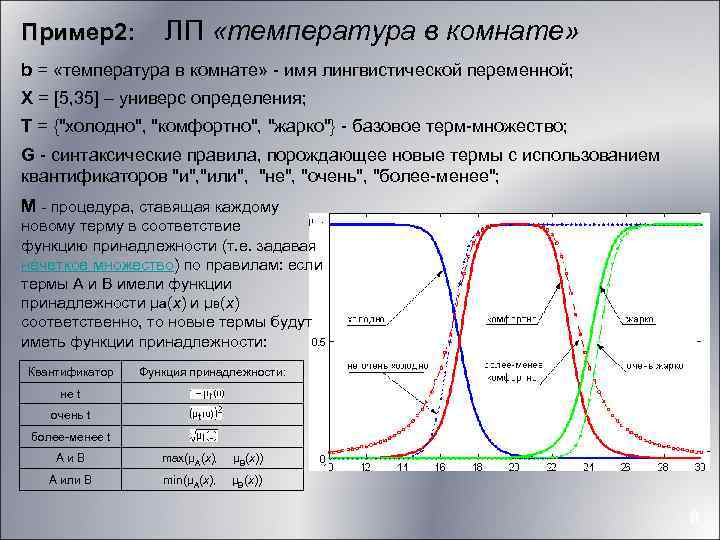

Пример2: ЛП «температура в комнате» b = «температура в комнате» - имя лингвистической переменной; X = [5, 35] – универс определения; T = {"холодно", "комфортно", "жарко"} - базовое терм-множество; G - синтаксические правила, порождающее новые термы с использованием квантификаторов "и", "или", "не", "очень", "более-менее"; М - процедура, ставящая каждому новому терму в соответствие функцию принадлежности (т. е. задавая нечеткое множество) по правилам: если термы А и В имели функции принадлежности μа(x) и μB(x) соответственно, то новые термы будут иметь функции принадлежности: Квантификатор Функция принадлежности: не t очень t более-менее t А и В max(μA(x), μB(x)) А или В min(μA(x), μB(x)) 8

Пример2: ЛП «температура в комнате» b = «температура в комнате» - имя лингвистической переменной; X = [5, 35] – универс определения; T = {"холодно", "комфортно", "жарко"} - базовое терм-множество; G - синтаксические правила, порождающее новые термы с использованием квантификаторов "и", "или", "не", "очень", "более-менее"; М - процедура, ставящая каждому новому терму в соответствие функцию принадлежности (т. е. задавая нечеткое множество) по правилам: если термы А и В имели функции принадлежности μа(x) и μB(x) соответственно, то новые термы будут иметь функции принадлежности: Квантификатор Функция принадлежности: не t очень t более-менее t А и В max(μA(x), μB(x)) А или В min(μA(x), μB(x)) 8

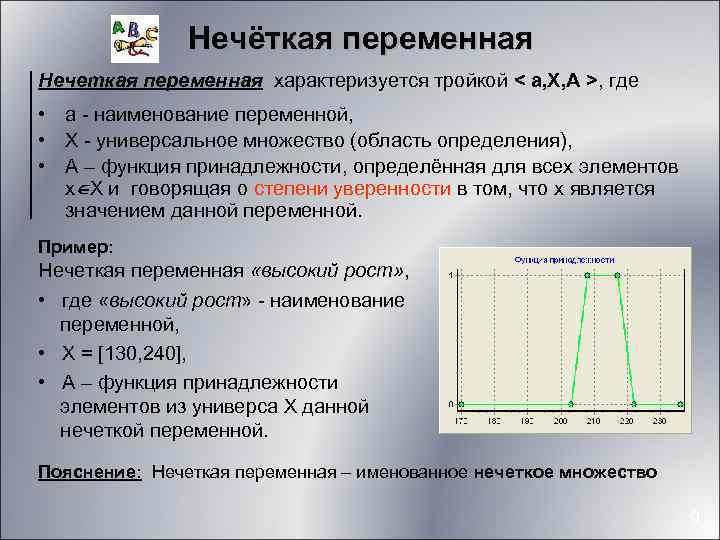

Нечёткая переменная Нечеткая переменная характеризуется тройкой < a, X, A >, где • a - наименование переменной, • X - универсальное множество (область определения), • A – функция принадлежности, определённая для всех элементов x X и говорящая о степени уверенности в том, что х является значением данной переменной. Пример: Нечеткая переменная «высокий рост» , • где «высокий рост» - наименование переменной, • Х = [130, 240], • А – функция принадлежности элементов из универса X данной нечеткой переменной. Пояснение: Нечеткая переменная – именованное нечеткое множество 9

Нечёткая переменная Нечеткая переменная характеризуется тройкой < a, X, A >, где • a - наименование переменной, • X - универсальное множество (область определения), • A – функция принадлежности, определённая для всех элементов x X и говорящая о степени уверенности в том, что х является значением данной переменной. Пример: Нечеткая переменная «высокий рост» , • где «высокий рост» - наименование переменной, • Х = [130, 240], • А – функция принадлежности элементов из универса X данной нечеткой переменной. Пояснение: Нечеткая переменная – именованное нечеткое множество 9

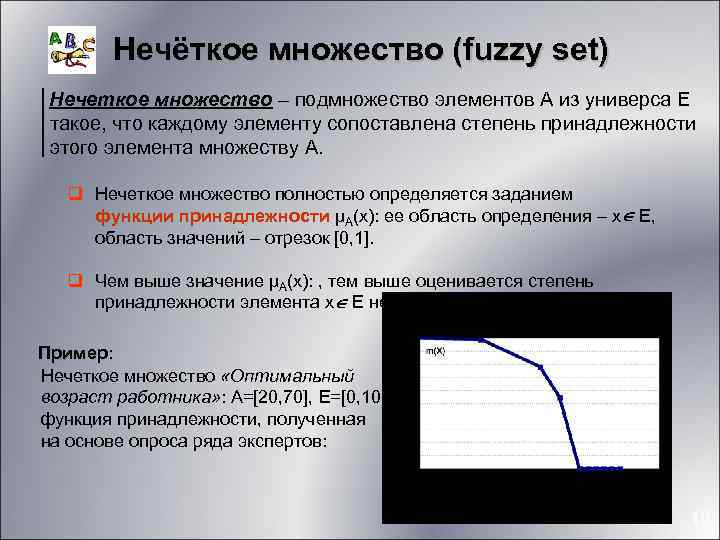

Нечёткое множество (fuzzy set) Нечеткое множество – подмножество элементов А из универса Е такое, что каждому элементу сопоставлена степень принадлежности этого элемента множеству A. q Нечеткое множество полностью определяется заданием функции принадлежности μА(x): ее область определения – x Е, область значений – отрезок [0, 1]. q Чем выше значение μА(x): , тем выше оценивается степень принадлежности элемента x E нечеткому множеству А. Пример: Нечеткое множество «Оптимальный возраст работника» : A=[20, 70], E=[0, 100], функция принадлежности, полученная на основе опроса ряда экспертов: 10

Нечёткое множество (fuzzy set) Нечеткое множество – подмножество элементов А из универса Е такое, что каждому элементу сопоставлена степень принадлежности этого элемента множеству A. q Нечеткое множество полностью определяется заданием функции принадлежности μА(x): ее область определения – x Е, область значений – отрезок [0, 1]. q Чем выше значение μА(x): , тем выше оценивается степень принадлежности элемента x E нечеткому множеству А. Пример: Нечеткое множество «Оптимальный возраст работника» : A=[20, 70], E=[0, 100], функция принадлежности, полученная на основе опроса ряда экспертов: 10

Нечёткое множество: пример • Проиллюстрируем еще раз на простом примере. Формализуем неточное определение "горячий чай". В качестве x (область рассуждений) будет выступать шкала температуры в градусах Цельсия. Очевидно, что она будет изменяется от 0 до 100 градусов. Нечеткое множество для понятия "горячий чай" может выглядеть следующим образом: • C={0/0; 0/10; 0/20; 0, 15/30; 0, 30/40; 0, 60/50; 0, 80/60; 0, 90/70; 1/80; 1/90; 1/100}. • Так, чай с температурой 60 С принадлежит к множеству "Горячий" со степенью принадлежности 0, 80. Для одного человека чай при температуре 60 С может оказаться горячим, для другого – не слишком горячим. Именно в этом и проявляется нечеткость задания соответствующего множества 11

Нечёткое множество: пример • Проиллюстрируем еще раз на простом примере. Формализуем неточное определение "горячий чай". В качестве x (область рассуждений) будет выступать шкала температуры в градусах Цельсия. Очевидно, что она будет изменяется от 0 до 100 градусов. Нечеткое множество для понятия "горячий чай" может выглядеть следующим образом: • C={0/0; 0/10; 0/20; 0, 15/30; 0, 30/40; 0, 60/50; 0, 80/60; 0, 90/70; 1/80; 1/90; 1/100}. • Так, чай с температурой 60 С принадлежит к множеству "Горячий" со степенью принадлежности 0, 80. Для одного человека чай при температуре 60 С может оказаться горячим, для другого – не слишком горячим. Именно в этом и проявляется нечеткость задания соответствующего множества 11

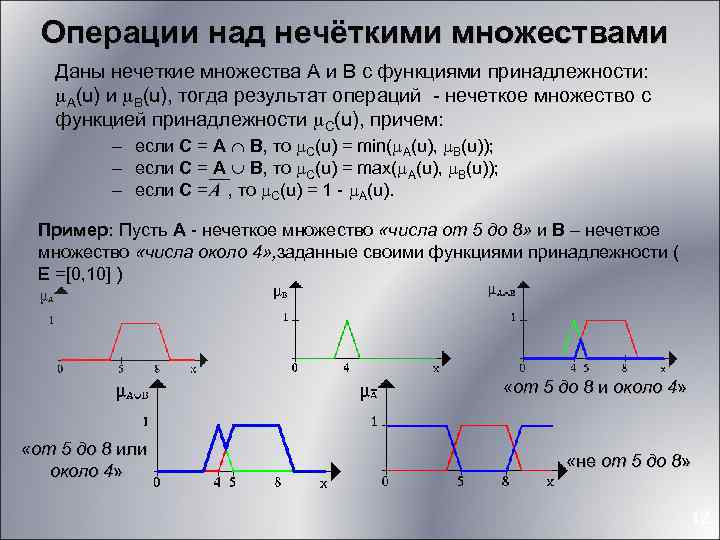

Операции над нечёткими множествами Даны нечеткие множества А и В с функциями принадлежности: А(u) и B(u), тогда результат операций - нечеткое множество с функцией принадлежности C(u), причем: – если С = А В, то C(u) = min( А(u), B(u)); – если С = А В, то C(u) = max( А(u), B(u)); – если С = , то C(u) = 1 - А(u). Пример: Пусть A - нечеткое множество «числа от 5 до 8» и B – нечеткое множество «числа около 4» , заданные своими функциями принадлежности ( E =[0, 10] ) «от 5 до 8 и около 4» «от 5 до 8 или около 4» «не от 5 до 8» 12

Операции над нечёткими множествами Даны нечеткие множества А и В с функциями принадлежности: А(u) и B(u), тогда результат операций - нечеткое множество с функцией принадлежности C(u), причем: – если С = А В, то C(u) = min( А(u), B(u)); – если С = А В, то C(u) = max( А(u), B(u)); – если С = , то C(u) = 1 - А(u). Пример: Пусть A - нечеткое множество «числа от 5 до 8» и B – нечеткое множество «числа около 4» , заданные своими функциями принадлежности ( E =[0, 10] ) «от 5 до 8 и около 4» «от 5 до 8 или около 4» «не от 5 до 8» 12

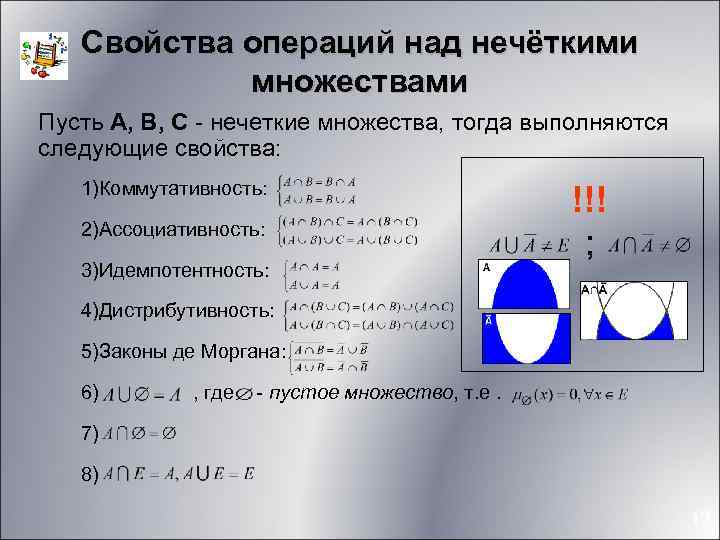

Свойства операций над нечёткими множествами Пусть А, В, С - нечеткие множества, тогда выполняются следующие свойства: 1)Коммутативность: 2)Ассоциативность: 3)Идемпотентность: !!! ; 4)Дистрибутивность: 5)Законы де Моргана: 6) , где - пустое множество, т. е. 7) 8) 13

Свойства операций над нечёткими множествами Пусть А, В, С - нечеткие множества, тогда выполняются следующие свойства: 1)Коммутативность: 2)Ассоциативность: 3)Идемпотентность: !!! ; 4)Дистрибутивность: 5)Законы де Моргана: 6) , где - пустое множество, т. е. 7) 8) 13

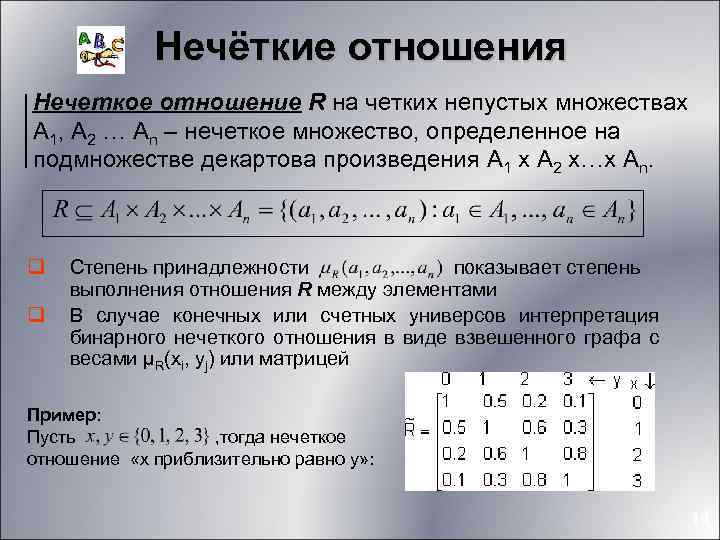

Нечёткие отношения Нечеткое отношение R на четких непустых множествах A 1, A 2 … An – нечеткое множество, определенное на подмножестве декартова произведения A 1 x A 2 x…x An. q q Степень принадлежности показывает степень выполнения отношения R между элементами В случае конечных или счетных универсов интерпретация бинарного нечеткого отношения в виде взвешенного графа с весами μR(xi, yj) или матрицей Пример: Пусть , тогда нечеткое отношение «x приблизительно равно y» : 14

Нечёткие отношения Нечеткое отношение R на четких непустых множествах A 1, A 2 … An – нечеткое множество, определенное на подмножестве декартова произведения A 1 x A 2 x…x An. q q Степень принадлежности показывает степень выполнения отношения R между элементами В случае конечных или счетных универсов интерпретация бинарного нечеткого отношения в виде взвешенного графа с весами μR(xi, yj) или матрицей Пример: Пусть , тогда нечеткое отношение «x приблизительно равно y» : 14

Функции принадлежности Рассмотрим такое нечеткое понятие как "Цена акции". Это и есть название лингвистической переменной. Сформируем для нее базовое терм-множество, которое будет состоять из трех нечетких переменных: "Низкая", "Умеренная", "Высокая" и зададим область рассуждений в виде X=[100; 200] (единиц). Последнее, что осталось сделать – построить функции принадлежности для каждого лингвистического терма из базового терм-множества T. Наиболее распространенные типовые формы кривых для задания функций принадлежности: треугольная, трапецеидальная и гауссова.

Функции принадлежности Рассмотрим такое нечеткое понятие как "Цена акции". Это и есть название лингвистической переменной. Сформируем для нее базовое терм-множество, которое будет состоять из трех нечетких переменных: "Низкая", "Умеренная", "Высокая" и зададим область рассуждений в виде X=[100; 200] (единиц). Последнее, что осталось сделать – построить функции принадлежности для каждого лингвистического терма из базового терм-множества T. Наиболее распространенные типовые формы кривых для задания функций принадлежности: треугольная, трапецеидальная и гауссова.

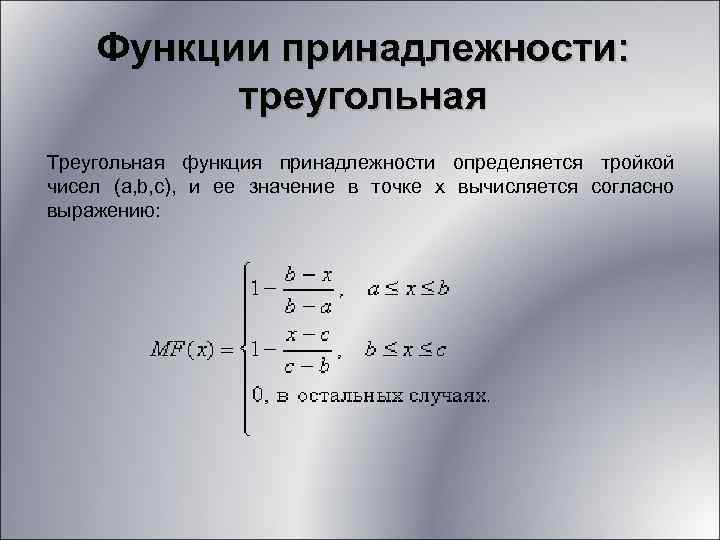

Функции принадлежности: треугольная Треугольная функция принадлежности определяется тройкой чисел (a, b, c), и ее значение в точке x вычисляется согласно выражению:

Функции принадлежности: треугольная Треугольная функция принадлежности определяется тройкой чисел (a, b, c), и ее значение в точке x вычисляется согласно выражению:

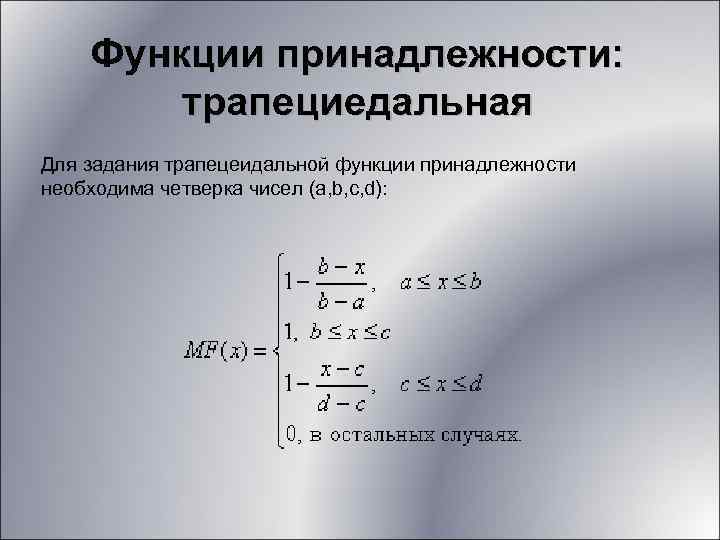

Функции принадлежности: трапециедальная Для задания трапецеидальной функции принадлежности необходима четверка чисел (a, b, c, d):

Функции принадлежности: трапециедальная Для задания трапецеидальной функции принадлежности необходима четверка чисел (a, b, c, d):

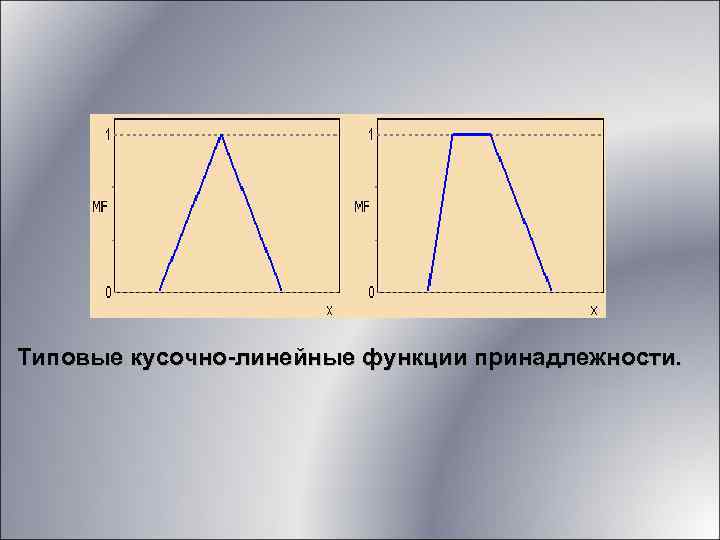

Типовые кусочно-линейные функции принадлежности.

Типовые кусочно-линейные функции принадлежности.

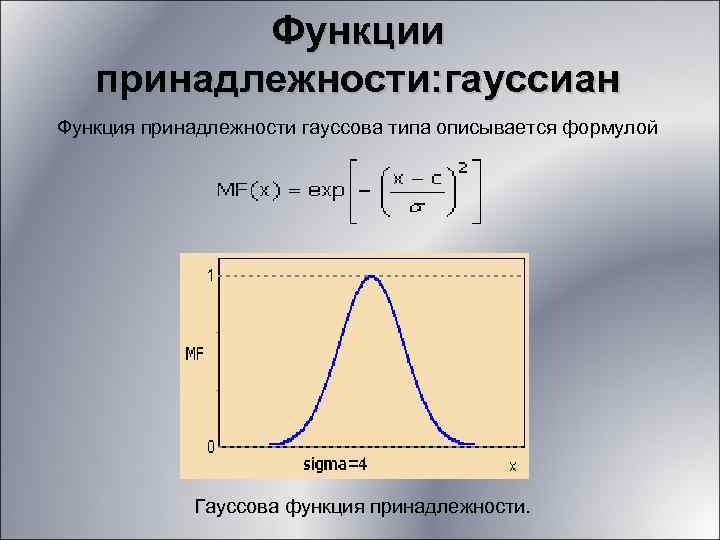

Функции принадлежности: гауссиан Функция принадлежности гауссова типа описывается формулой Гауссова функция принадлежности.

Функции принадлежности: гауссиан Функция принадлежности гауссова типа описывается формулой Гауссова функция принадлежности.

Описание лингвистической переменной "Цена акции" Цена акции. Сформируем для нее базовое терм-множество, которое будет состоять из трех нечетких переменных: "Низкая", "Умеренная", "Высокая" и зададим область рассуждений в виде X=[100; 200] (единиц)

Описание лингвистической переменной "Цена акции" Цена акции. Сформируем для нее базовое терм-множество, которое будет состоять из трех нечетких переменных: "Низкая", "Умеренная", "Высокая" и зададим область рассуждений в виде X=[100; 200] (единиц)

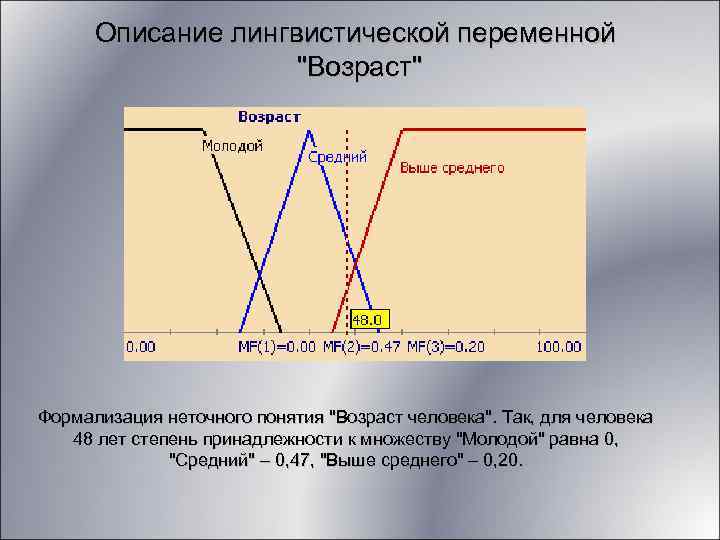

Описание лингвистической переменной "Возраст" Формализация неточного понятия "Возраст человека". Так, для человека 48 лет степень принадлежности к множеству "Молодой" равна 0, "Средний" – 0, 47, "Выше среднего" – 0, 20.

Описание лингвистической переменной "Возраст" Формализация неточного понятия "Возраст человека". Так, для человека 48 лет степень принадлежности к множеству "Молодой" равна 0, "Средний" – 0, 47, "Выше среднего" – 0, 20.

Нечеткий логический вывод • Основой для проведения операции нечеткого логического вывода является база правил, содержащая нечеткие высказывания в форме "Если-то" и функции принадлежности для соответствующих лингвистических термов. При этом должны соблюдаться следующие условия: • Существует хотя бы одно правило для каждого лингвистического терма выходной переменной. • Для любого терма входной переменной имеется хотя бы одно правило, в котором этот терм используется в качестве предпосылки (левая часть правила). • В противном случае имеет место неполная база нечетких правил. 22

Нечеткий логический вывод • Основой для проведения операции нечеткого логического вывода является база правил, содержащая нечеткие высказывания в форме "Если-то" и функции принадлежности для соответствующих лингвистических термов. При этом должны соблюдаться следующие условия: • Существует хотя бы одно правило для каждого лингвистического терма выходной переменной. • Для любого терма входной переменной имеется хотя бы одно правило, в котором этот терм используется в качестве предпосылки (левая часть правила). • В противном случае имеет место неполная база нечетких правил. 22

Нечеткий логический вывод Пусть в базе правил имеется m правил вида: R 1: ЕСЛИ x 1 это A 11 … И … xn это A 1 n, ТО y это B 1 … Ri: ЕСЛИ x 1 это Ai 1 … И … xn это Ain, ТО y это Bi … Rm: ЕСЛИ x 1 это Ai 1 … И … xn это Amn, ТО y это Bm, где xk , k=1. . n – входные переменные; y – выходная переменная; Aik – заданные нечеткие множества с функциями принадлежности. Результатом нечеткого вывода является четкое значение переменной y* на основе заданных четких значений xk , k=1. . n. 23

Нечеткий логический вывод Пусть в базе правил имеется m правил вида: R 1: ЕСЛИ x 1 это A 11 … И … xn это A 1 n, ТО y это B 1 … Ri: ЕСЛИ x 1 это Ai 1 … И … xn это Ain, ТО y это Bi … Rm: ЕСЛИ x 1 это Ai 1 … И … xn это Amn, ТО y это Bm, где xk , k=1. . n – входные переменные; y – выходная переменная; Aik – заданные нечеткие множества с функциями принадлежности. Результатом нечеткого вывода является четкое значение переменной y* на основе заданных четких значений xk , k=1. . n. 23

Нечеткий логический вывод В общем случае механизм логического вывода включает четыре этапа: введение нечеткости (фазификация), нечеткий вывод, композиция и приведение к четкости, или дефазификация.

Нечеткий логический вывод В общем случае механизм логического вывода включает четыре этапа: введение нечеткости (фазификация), нечеткий вывод, композиция и приведение к четкости, или дефазификация.

Алгоритмы нечеткого вывода различаются главным образом видом используемых правил, логических операций и разновидностью метода дефазификации. Разработаны модели нечеткого вывода Мамдани, Сугено, Ларсена, Цукамото. 25

Алгоритмы нечеткого вывода различаются главным образом видом используемых правил, логических операций и разновидностью метода дефазификации. Разработаны модели нечеткого вывода Мамдани, Сугено, Ларсена, Цукамото. 25

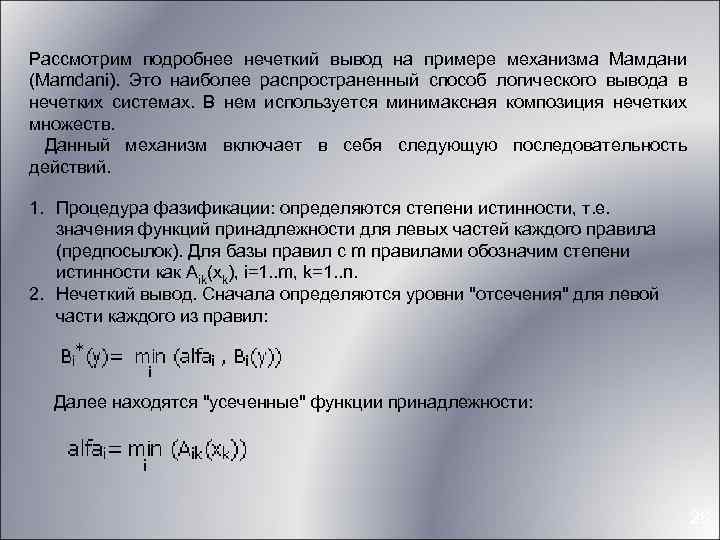

Рассмотрим подробнее нечеткий вывод на примере механизма Мамдани (Mamdani). Это наиболее распространенный способ логического вывода в нечетких системах. В нем используется минимаксная композиция нечетких множеств. Данный механизм включает в себя следующую последовательность действий. 1. Процедура фазификации: определяются степени истинности, т. е. значения функций принадлежности для левых частей каждого правила (предпосылок). Для базы правил с m правилами обозначим степени истинности как Aik(xk), i=1. . m, k=1. . n. 2. Нечеткий вывод. Сначала определяются уровни "отсечения" для левой части каждого из правил: Далее находятся "усеченные" функции принадлежности: 26

Рассмотрим подробнее нечеткий вывод на примере механизма Мамдани (Mamdani). Это наиболее распространенный способ логического вывода в нечетких системах. В нем используется минимаксная композиция нечетких множеств. Данный механизм включает в себя следующую последовательность действий. 1. Процедура фазификации: определяются степени истинности, т. е. значения функций принадлежности для левых частей каждого правила (предпосылок). Для базы правил с m правилами обозначим степени истинности как Aik(xk), i=1. . m, k=1. . n. 2. Нечеткий вывод. Сначала определяются уровни "отсечения" для левой части каждого из правил: Далее находятся "усеченные" функции принадлежности: 26

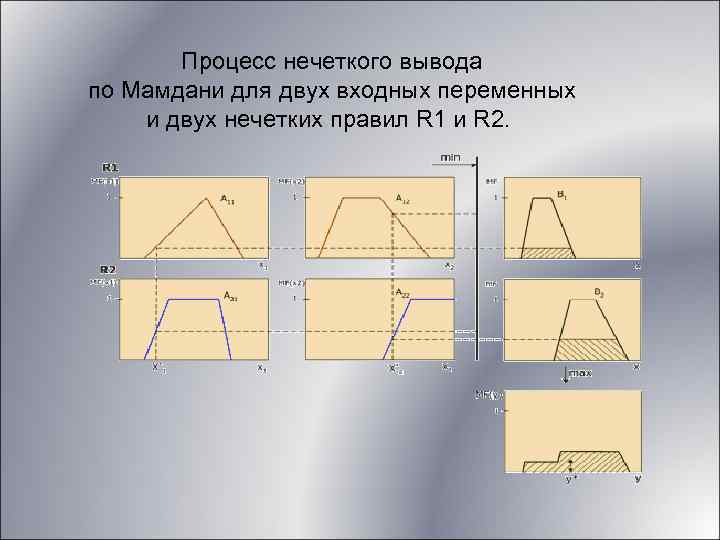

3. Композиция, или объединение полученных усеченных функций, для чего используется максимальная композиция нечетких множеств: где MF(y) – функция принадлежности итогового нечеткого множества. 4. Дефазификация, или приведение к четкости. Существует несколько методов дефазификации. Например, метод среднего центра, или центроидный метод: Геометрический смысл такого значения – центр тяжести для кривой MF(y). Рисунок графически показывает процесс нечеткого вывода по Мамдани для двух входных переменных и двух нечетких правил R 1 и R 2. 27

3. Композиция, или объединение полученных усеченных функций, для чего используется максимальная композиция нечетких множеств: где MF(y) – функция принадлежности итогового нечеткого множества. 4. Дефазификация, или приведение к четкости. Существует несколько методов дефазификации. Например, метод среднего центра, или центроидный метод: Геометрический смысл такого значения – центр тяжести для кривой MF(y). Рисунок графически показывает процесс нечеткого вывода по Мамдани для двух входных переменных и двух нечетких правил R 1 и R 2. 27

Процесс нечеткого вывода по Мамдани для двух входных переменных и двух нечетких правил R 1 и R 2.

Процесс нечеткого вывода по Мамдани для двух входных переменных и двух нечетких правил R 1 и R 2.

Интеграция с интеллектуальными парадигмами Гибридизация методов интеллектуальной обработки информации – девиз, под которым прошли 90 -е годы у западных и американских исследователей. В результате объединения нескольких технологий искусственного интеллекта появился специальный термин – "мягкие вычисления" (soft computing), который ввел Л. Заде в 1994 году. В настоящее время мягкие вычисления объединяют такие области как: нечеткая логика, искусственные нейронные сети, вероятностные рассуждения и эволюционные алгоритмы. Они дополняют друга и используются в различных комбинациях для создания гибридных интеллектуальных систем. Влияние нечеткой логики оказалось, пожалуй, самым обширным. Подобно тому, как нечеткие множества расширили рамки классической математическую теорию множеств, нечеткая логика "вторглась" практически в большинство методов Data Mining, наделив их новой функциональностью. Ниже приводятся наиболее интересные примеры таких объединений 29

Интеграция с интеллектуальными парадигмами Гибридизация методов интеллектуальной обработки информации – девиз, под которым прошли 90 -е годы у западных и американских исследователей. В результате объединения нескольких технологий искусственного интеллекта появился специальный термин – "мягкие вычисления" (soft computing), который ввел Л. Заде в 1994 году. В настоящее время мягкие вычисления объединяют такие области как: нечеткая логика, искусственные нейронные сети, вероятностные рассуждения и эволюционные алгоритмы. Они дополняют друга и используются в различных комбинациях для создания гибридных интеллектуальных систем. Влияние нечеткой логики оказалось, пожалуй, самым обширным. Подобно тому, как нечеткие множества расширили рамки классической математическую теорию множеств, нечеткая логика "вторглась" практически в большинство методов Data Mining, наделив их новой функциональностью. Ниже приводятся наиболее интересные примеры таких объединений 29

Нечеткие нейронные сети • Нечеткие нейронные сети (fuzzy-neural networks) осуществляют выводы на основе аппарата нечеткой логики, однако параметры функций принадлежности настраиваются с использованием алгоритмов обучения НС. Поэтому для подбора параметров таких сетей применим метод обратного распространения ошибки, изначально предложенный для обучения многослойного персептрона. Для этого модуль нечеткого управления представляется в форме многослойной сети. • Нечеткая нейронная сеть как правило состоит из четырех слоев: слоя фазификации входных переменных, слоя агрегирования значений активации условия, слоя агрегирования нечетких правил и выходного слоя. Наибольшее распространение в настоящее время получили архитектуры нечеткой НС вида ANFIS и TSK. Доказано, что такие сети являются универсальными аппроксиматорами. Быстрые алгоритмы обучения и интерпретируемость накопленных знаний – эти факторы сделали сегодня нечеткие нейронные сети одним из самых перспективных и эффективных инструментов мягких вычислений. 30

Нечеткие нейронные сети • Нечеткие нейронные сети (fuzzy-neural networks) осуществляют выводы на основе аппарата нечеткой логики, однако параметры функций принадлежности настраиваются с использованием алгоритмов обучения НС. Поэтому для подбора параметров таких сетей применим метод обратного распространения ошибки, изначально предложенный для обучения многослойного персептрона. Для этого модуль нечеткого управления представляется в форме многослойной сети. • Нечеткая нейронная сеть как правило состоит из четырех слоев: слоя фазификации входных переменных, слоя агрегирования значений активации условия, слоя агрегирования нечетких правил и выходного слоя. Наибольшее распространение в настоящее время получили архитектуры нечеткой НС вида ANFIS и TSK. Доказано, что такие сети являются универсальными аппроксиматорами. Быстрые алгоритмы обучения и интерпретируемость накопленных знаний – эти факторы сделали сегодня нечеткие нейронные сети одним из самых перспективных и эффективных инструментов мягких вычислений. 30

Нечеткая кластеризация Нечеткие методы кластеризации, в отличие от четких методов (например, нейронные сети Кохонена), позволяют одному и тому же объекту принадлежать одновременно нескольким кластерам, но с различной степенью. Нечеткая кластеризация во многих ситуациях более "естественна", чем четкая, например, для объектов, расположенных на границе кластеров. Наиболее распространены: алгоритм нечеткой самоорганизации c-means и его обобщение в виде алгоритма Густафсона-Кесселя. Список можно продолжить и дальше: нечеткие деревья решений, нечеткие сети Петри, нечеткая ассоциативная память, нечеткие самоорганизующиеся карты и другие гибридные методы 31

Нечеткая кластеризация Нечеткие методы кластеризации, в отличие от четких методов (например, нейронные сети Кохонена), позволяют одному и тому же объекту принадлежать одновременно нескольким кластерам, но с различной степенью. Нечеткая кластеризация во многих ситуациях более "естественна", чем четкая, например, для объектов, расположенных на границе кластеров. Наиболее распространены: алгоритм нечеткой самоорганизации c-means и его обобщение в виде алгоритма Густафсона-Кесселя. Список можно продолжить и дальше: нечеткие деревья решений, нечеткие сети Петри, нечеткая ассоциативная память, нечеткие самоорганизующиеся карты и другие гибридные методы 31

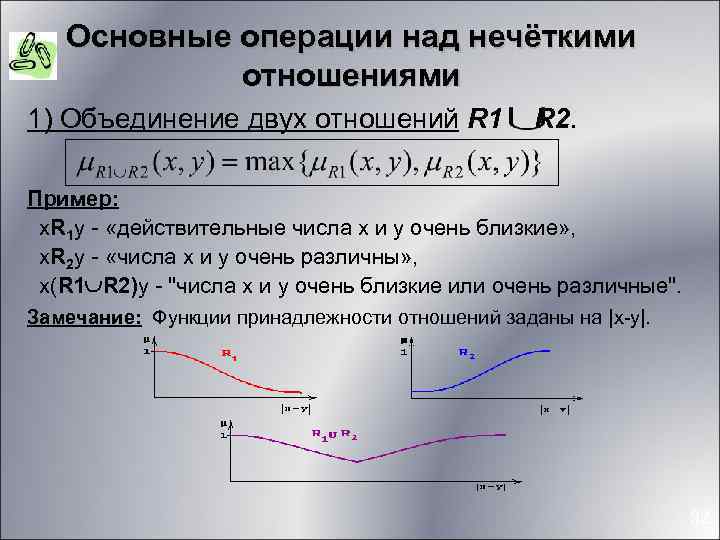

Основные операции над нечёткими отношениями 1) Объединение двух отношений R 1 R 2. Пример: x. R 1 y - «действительные числа x и y очень близкие» , x. R 2 y - «числа x и y очень различны» , x(R 1 R 2)y - "числа x и y очень близкие или очень различные". Замечание: Функции принадлежности отношений заданы на |x-y|. 32

Основные операции над нечёткими отношениями 1) Объединение двух отношений R 1 R 2. Пример: x. R 1 y - «действительные числа x и y очень близкие» , x. R 2 y - «числа x и y очень различны» , x(R 1 R 2)y - "числа x и y очень близкие или очень различные". Замечание: Функции принадлежности отношений заданы на |x-y|. 32

Дальше произвольная программа)) 33

Дальше произвольная программа)) 33

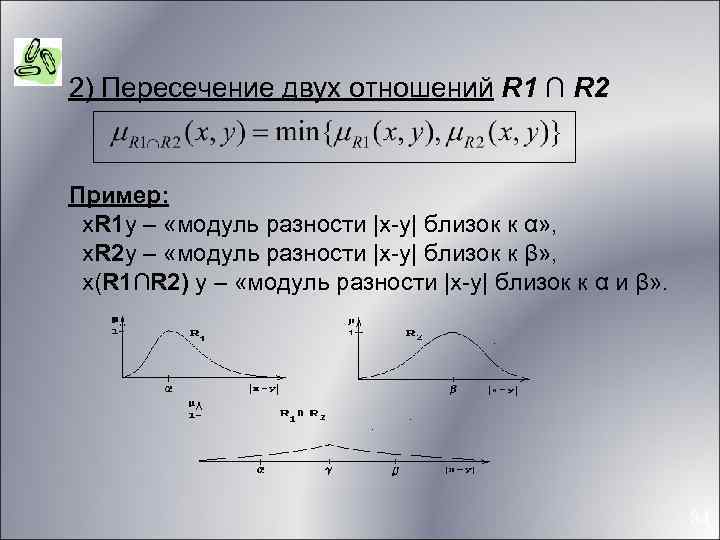

2) Пересечение двух отношений R 1 ∩ R 2 Пример: x. R 1 y – «модуль разности |x-y| близок к α» , x. R 2 y – «модуль разности |x-y| близок к β» , x(R 1∩R 2) y – «модуль разности |x-y| близок к α и β» . 34

2) Пересечение двух отношений R 1 ∩ R 2 Пример: x. R 1 y – «модуль разности |x-y| близок к α» , x. R 2 y – «модуль разности |x-y| близок к β» , x(R 1∩R 2) y – «модуль разности |x-y| близок к α и β» . 34

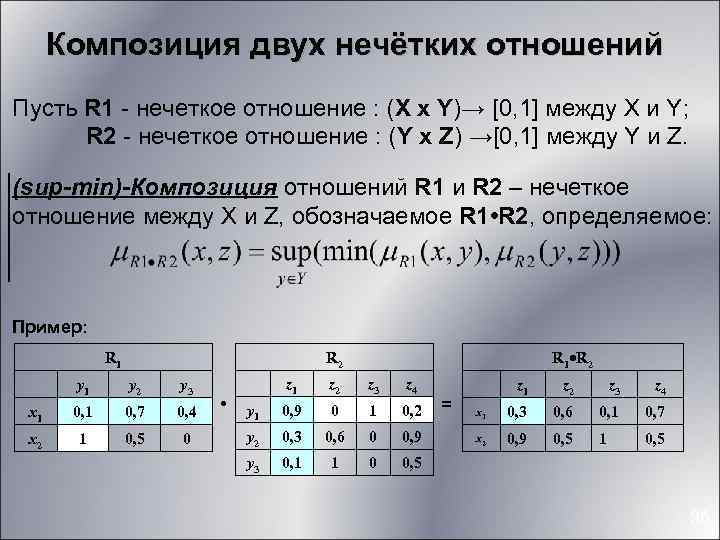

Композиция двух нечётких отношений Пусть R 1 - нечеткое отношение : (X x Y)→ [0, 1] между X и Y; R 2 - нечеткое отношение : (Y x Z) →[0, 1] между Y и Z. (sup-min)-Композиция отношений R 1 и R 2 – нечеткое отношение между X и Z, обозначаемое R 1 • R 2, определяемое: Пример: R 1·R 2 R 1 y 2 y 3 x 1 0, 7 0, 4 x 2 1 0, 5 0 • z 1 z 2 z 3 z 4 y 1 0, 9 0 1 0, 2 y 2 0, 3 0, 6 0 0, 9 y 3 0, 1 1 0 0, 5 z 1 z 2 z 3 z 4 x 1 0, 3 0, 6 0, 1 0, 7 x 2 0, 9 0, 5 1 0, 5 = 35

Композиция двух нечётких отношений Пусть R 1 - нечеткое отношение : (X x Y)→ [0, 1] между X и Y; R 2 - нечеткое отношение : (Y x Z) →[0, 1] между Y и Z. (sup-min)-Композиция отношений R 1 и R 2 – нечеткое отношение между X и Z, обозначаемое R 1 • R 2, определяемое: Пример: R 1·R 2 R 1 y 2 y 3 x 1 0, 7 0, 4 x 2 1 0, 5 0 • z 1 z 2 z 3 z 4 y 1 0, 9 0 1 0, 2 y 2 0, 3 0, 6 0 0, 9 y 3 0, 1 1 0 0, 5 z 1 z 2 z 3 z 4 x 1 0, 3 0, 6 0, 1 0, 7 x 2 0, 9 0, 5 1 0, 5 = 35

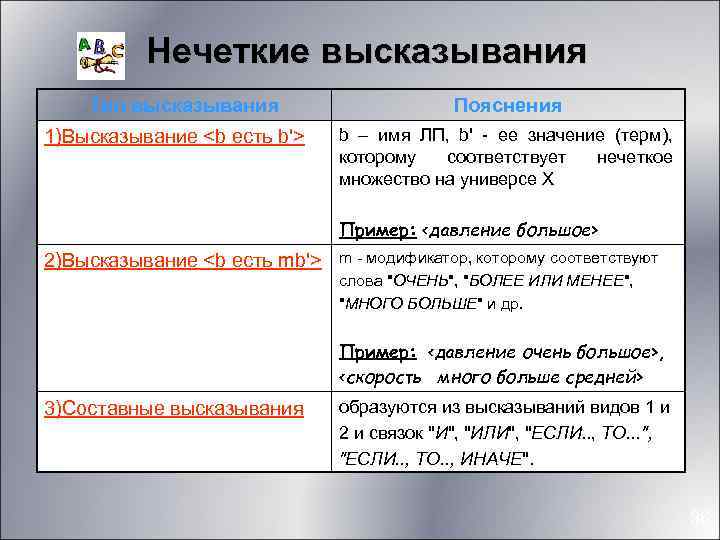

Нечеткие высказывания Тип высказывания 1)Высказывание Пояснения b – имя ЛП, b' - ее значение (терм), которому соответствует нечеткое множество на универсе Х Пример: <давление большое> 2)Высказывание m - модификатор, которому соответствуют слова "ОЧЕНЬ", "БОЛЕЕ ИЛИ МЕНЕЕ", "МНОГО БОЛЬШЕ" и др. Пример: <давление очень большое>, <скорость много больше средней> 3)Составные высказывания образуются из высказываний видов 1 и 2 и связок "И", "ИЛИ", "ЕСЛИ. . , ТО. . , ИНАЧЕ". 36

Нечеткие высказывания Тип высказывания 1)Высказывание Пояснения b – имя ЛП, b' - ее значение (терм), которому соответствует нечеткое множество на универсе Х Пример: <давление большое> 2)Высказывание m - модификатор, которому соответствуют слова "ОЧЕНЬ", "БОЛЕЕ ИЛИ МЕНЕЕ", "МНОГО БОЛЬШЕ" и др. Пример: <давление очень большое>, <скорость много больше средней> 3)Составные высказывания образуются из высказываний видов 1 и 2 и связок "И", "ИЛИ", "ЕСЛИ. . , ТО. . , ИНАЧЕ". 36

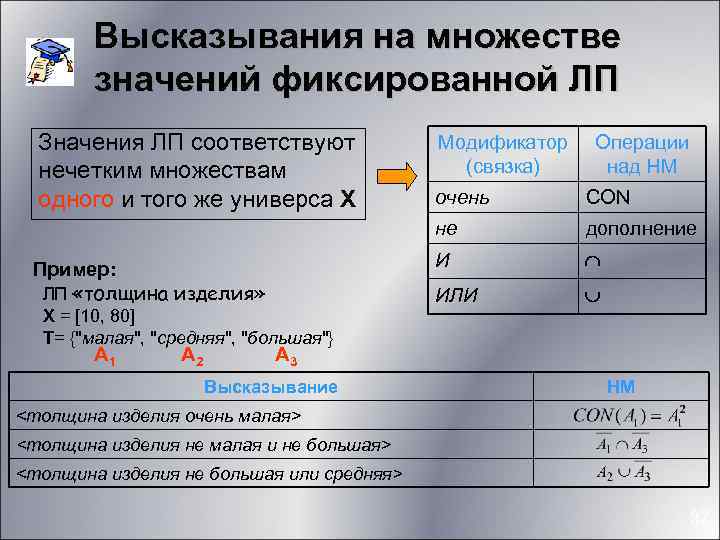

Высказывания на множестве значений фиксированной ЛП Значения ЛП соответствуют нечетким множествам одного и того же универса Х Модификатор (связка) Операции над НМ Х = [10, 80] T= {"малая", "средняя", "большая"} A 1 A 2 A 3 CON не Пример: ЛП «толщина изделия» очень дополнение И ИЛИ Высказывание <толщина изделия очень малая> НМ <толщина изделия не малая и не большая> <толщина изделия не большая или средняя> 37

Высказывания на множестве значений фиксированной ЛП Значения ЛП соответствуют нечетким множествам одного и того же универса Х Модификатор (связка) Операции над НМ Х = [10, 80] T= {"малая", "средняя", "большая"} A 1 A 2 A 3 CON не Пример: ЛП «толщина изделия» очень дополнение И ИЛИ Высказывание <толщина изделия очень малая> НМ <толщина изделия не малая и не большая> <толщина изделия не большая или средняя> 37

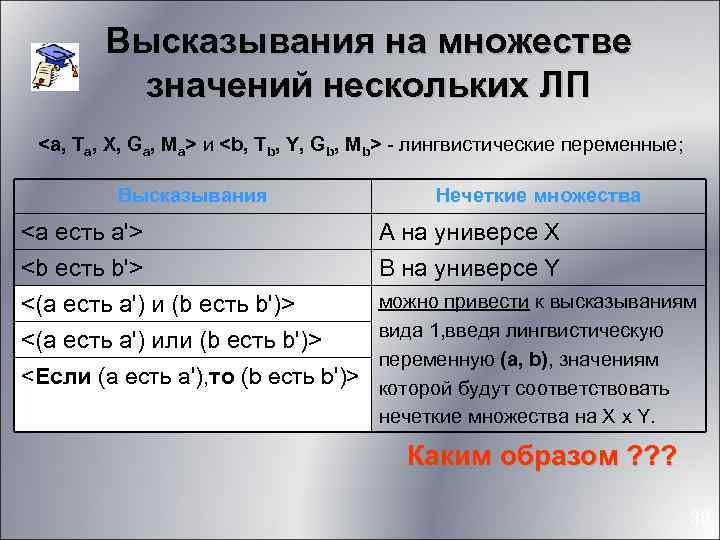

Высказывания на множестве значений нескольких ЛП

Высказывания на множестве значений нескольких ЛП

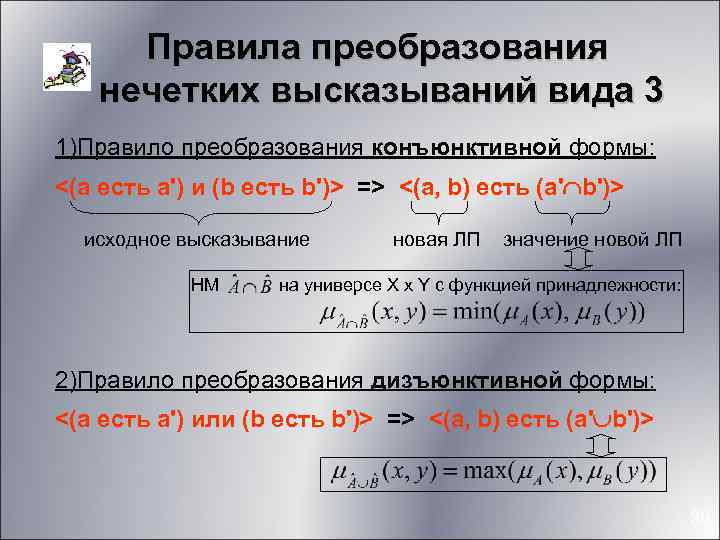

Правила преобразования нечетких высказываний вида 3 1)Правило преобразования конъюнктивной формы: <(a есть a') и (b есть b')> => <(a, b) есть (a' b')> исходное высказывание новая ЛП значение новой ЛП НМ на универсе X x Y c функцией принадлежности: 2)Правило преобразования дизъюнктивной формы: <(a есть a') или (b есть b')> => <(a, b) есть (a' b')> 39

Правила преобразования нечетких высказываний вида 3 1)Правило преобразования конъюнктивной формы: <(a есть a') и (b есть b')> => <(a, b) есть (a' b')> исходное высказывание новая ЛП значение новой ЛП НМ на универсе X x Y c функцией принадлежности: 2)Правило преобразования дизъюнктивной формы: <(a есть a') или (b есть b')> => <(a, b) есть (a' b')> 39

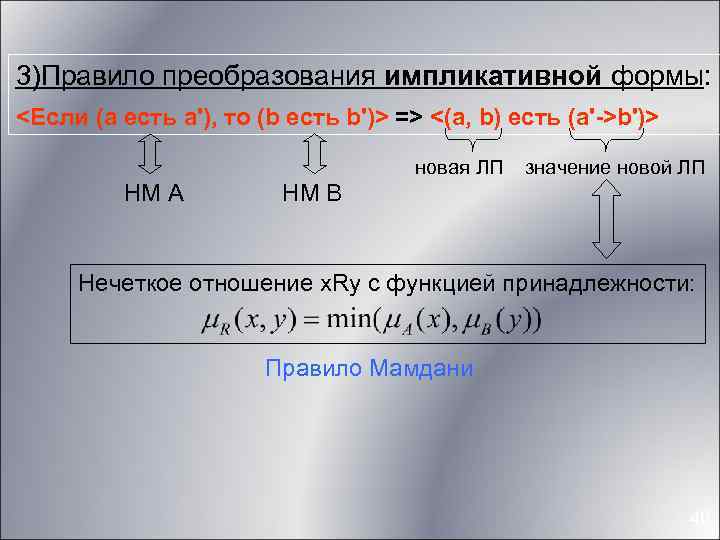

3)Правило преобразования импликативной формы: <Если (a есть a'), то (b есть b')> => <(a, b) есть (a'->b')> новая ЛП значение новой ЛП НМ A НМ B Нечеткое отношение x. Ry c функцией принадлежности: Правило Мамдани 40

3)Правило преобразования импликативной формы: <Если (a есть a'), то (b есть b')> => <(a, b) есть (a'->b')> новая ЛП значение новой ЛП НМ A НМ B Нечеткое отношение x. Ry c функцией принадлежности: Правило Мамдани 40

Что у нас теперь есть? q Формализовано понятие «лингвистическая переменная» q Введено понятие «нечеткое высказывание» , содержащее лингвистические переменные q Рассмотрены основные преобразования нечетких высказываний (логические связки) Заложен механизм формирования нечеткой базы знаний на основе правил типа «Если …, то…» 41

Что у нас теперь есть? q Формализовано понятие «лингвистическая переменная» q Введено понятие «нечеткое высказывание» , содержащее лингвистические переменные q Рассмотрены основные преобразования нечетких высказываний (логические связки) Заложен механизм формирования нечеткой базы знаний на основе правил типа «Если …, то…» 41

Часть II Логико-лингвистические модели Всего 13 слайдов 42

Часть II Логико-лингвистические модели Всего 13 слайдов 42

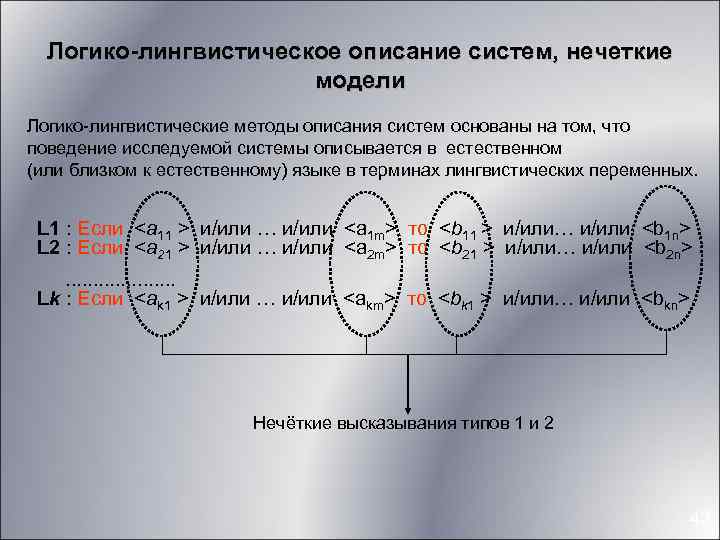

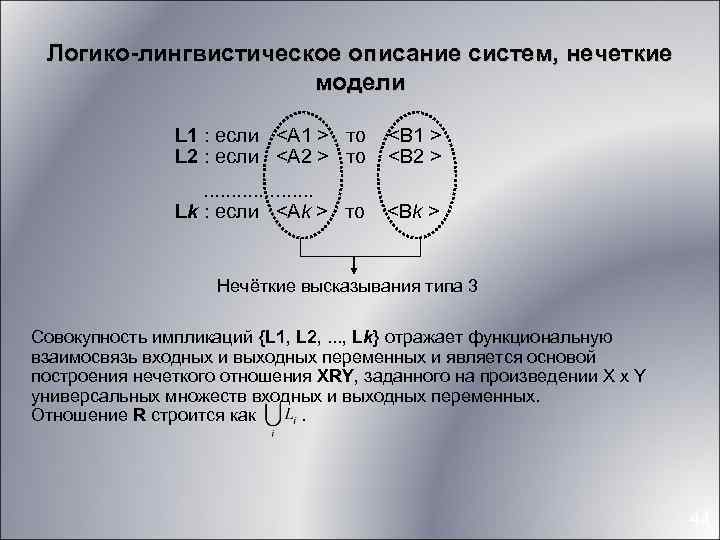

Логико-лингвистическое описание систем, нечеткие модели Логико-лингвистические методы описания систем основаны на том, что поведение исследуемой системы описывается в естественном (или близком к естественному) языке в терминах лингвистических переменных. L 1 : Если и/или … и/или то и/или… и/или L 2 : Если и/или … и/или то и/или… и/или . . Lk : Если

Логико-лингвистическое описание систем, нечеткие модели Логико-лингвистические методы описания систем основаны на том, что поведение исследуемой системы описывается в естественном (или близком к естественному) языке в терминах лингвистических переменных. L 1 : Если и/или … и/или то и/или… и/или L 2 : Если и/или … и/или то и/или… и/или . . Lk : Если

Логико-лингвистическое описание систем, нечеткие модели L 1 : если то L 2 : если то . . Lk : если

Логико-лингвистическое описание систем, нечеткие модели L 1 : если то L 2 : если то . . Lk : если

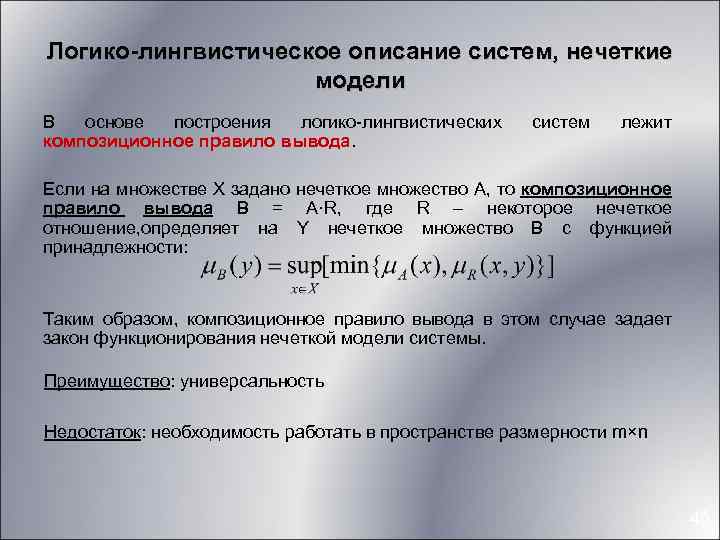

Логико-лингвистическое описание систем, нечеткие модели В основе построения логико-лингвистических композиционное правило вывода. систем лежит Если на множестве X задано нечеткое множество A, то композиционное правило вывода B = A·R, где R – некоторое нечеткое отношение, определяет на Y нечеткое множество B с функцией принадлежности: Таким образом, композиционное правило вывода в этом случае задает закон функционирования нечеткой модели системы. Преимущество: универсальность Недостаток: необходимость работать в пространстве размерности m×n 45

Логико-лингвистическое описание систем, нечеткие модели В основе построения логико-лингвистических композиционное правило вывода. систем лежит Если на множестве X задано нечеткое множество A, то композиционное правило вывода B = A·R, где R – некоторое нечеткое отношение, определяет на Y нечеткое множество B с функцией принадлежности: Таким образом, композиционное правило вывода в этом случае задает закон функционирования нечеткой модели системы. Преимущество: универсальность Недостаток: необходимость работать в пространстве размерности m×n 45

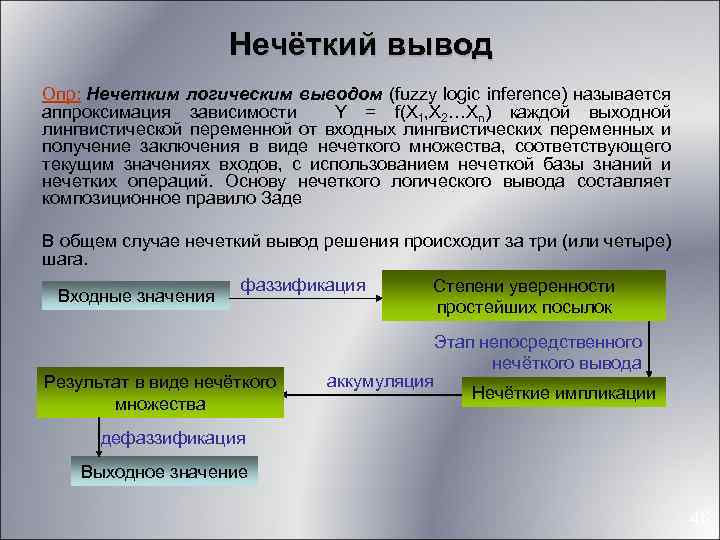

Нечёткий вывод Опр: Нечетким логическим выводом (fuzzy logic inference) называется аппроксимация зависимости Y = f(X 1, X 2…Xn) каждой выходной лингвистической переменной от входных лингвистических переменных и получение заключения в виде нечеткого множества, соответствующего текущим значениях входов, с использованием нечеткой базы знаний и нечетких операций. Основу нечеткого логического вывода составляет композиционное правило Заде В общем случае нечеткий вывод решения происходит за три (или четыре) шага. фаззификация Степени уверенности Входные значения простейших посылок Результат в виде нечёткого множества Этап непосредственного нечёткого вывода аккумуляция Нечёткие импликации дефаззификация Выходное значение 46

Нечёткий вывод Опр: Нечетким логическим выводом (fuzzy logic inference) называется аппроксимация зависимости Y = f(X 1, X 2…Xn) каждой выходной лингвистической переменной от входных лингвистических переменных и получение заключения в виде нечеткого множества, соответствующего текущим значениях входов, с использованием нечеткой базы знаний и нечетких операций. Основу нечеткого логического вывода составляет композиционное правило Заде В общем случае нечеткий вывод решения происходит за три (или четыре) шага. фаззификация Степени уверенности Входные значения простейших посылок Результат в виде нечёткого множества Этап непосредственного нечёткого вывода аккумуляция Нечёткие импликации дефаззификация Выходное значение 46

База знаний Общий вид правил в базе знаний: Если Лингвистическая Переменная 1 есть Терм Лингвистической Переменной 1 и Лингвистическая Переменная 2 есть Терм Лингвистической Переменной 2 и … и Лингвистическая Переменная N есть Терм Лингвистической Переменной N То Выходная Лингвистическая Переменная есть Терм Выходной Линг. Перем. Пример: Если Температура низкая и Расход малый То Давление низкое Лингвистическая Переменная 1 Терм Лингвистической Переменной 1 Лингвистическая Переменная 2 Выходная Лингвистическая Переменная Терм Лингвистической Переменной 2 Терм Выходной Лингвистической Переменной 47

База знаний Общий вид правил в базе знаний: Если Лингвистическая Переменная 1 есть Терм Лингвистической Переменной 1 и Лингвистическая Переменная 2 есть Терм Лингвистической Переменной 2 и … и Лингвистическая Переменная N есть Терм Лингвистической Переменной N То Выходная Лингвистическая Переменная есть Терм Выходной Линг. Перем. Пример: Если Температура низкая и Расход малый То Давление низкое Лингвистическая Переменная 1 Терм Лингвистической Переменной 1 Лингвистическая Переменная 2 Выходная Лингвистическая Переменная Терм Лингвистической Переменной 2 Терм Выходной Лингвистической Переменной 47

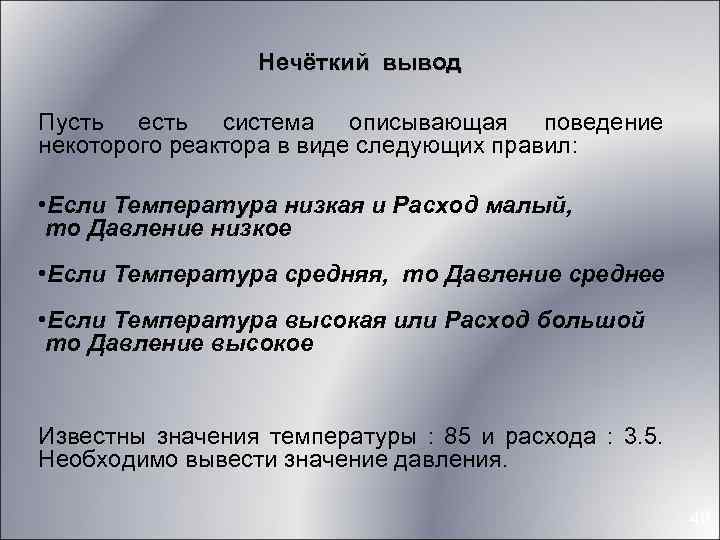

Нечёткий вывод Пусть есть система описывающая поведение некоторого реактора в виде следующих правил: • Если Температура низкая и Расход малый, то Давление низкое • Если Температура средняя, то Давление среднее • Если Температура высокая или Расход большой то Давление высокое Известны значения температуры : 85 и расхода : 3. 5. Необходимо вывести значение давления. 48

Нечёткий вывод Пусть есть система описывающая поведение некоторого реактора в виде следующих правил: • Если Температура низкая и Расход малый, то Давление низкое • Если Температура средняя, то Давление среднее • Если Температура высокая или Расход большой то Давление высокое Известны значения температуры : 85 и расхода : 3. 5. Необходимо вывести значение давления. 48

![Нечёткий вывод Температура. Унивёрс (множество возможных значений) – отрезок [0, 150]. Начальное множество термов Нечёткий вывод Температура. Унивёрс (множество возможных значений) – отрезок [0, 150]. Начальное множество термов](https://present5.com/presentation/12157441_169389905/image-49.jpg) Нечёткий вывод Температура. Унивёрс (множество возможных значений) – отрезок [0, 150]. Начальное множество термов {Высокая, Средняя, Низкая}. Функции принадлежности термов имеют следующий вид: Высокая Средняя Низкая Давление. Унивёрс – отрезок [0, 100]. Начальное множество термов {Высокое, Среднее, Низкое} Функции принадлежности термов имеют следующий вид: Высокое Среднее Низкое Расход. Унивёрс – отрезок [0, 8]. Начальное множество термов {Большой, Средний, Малый} Функции принадлежности термов имеют следующий вид Большой Средний Малый 49

Нечёткий вывод Температура. Унивёрс (множество возможных значений) – отрезок [0, 150]. Начальное множество термов {Высокая, Средняя, Низкая}. Функции принадлежности термов имеют следующий вид: Высокая Средняя Низкая Давление. Унивёрс – отрезок [0, 100]. Начальное множество термов {Высокое, Среднее, Низкое} Функции принадлежности термов имеют следующий вид: Высокое Среднее Низкое Расход. Унивёрс – отрезок [0, 8]. Начальное множество термов {Большой, Средний, Малый} Функции принадлежности термов имеют следующий вид Большой Средний Малый 49

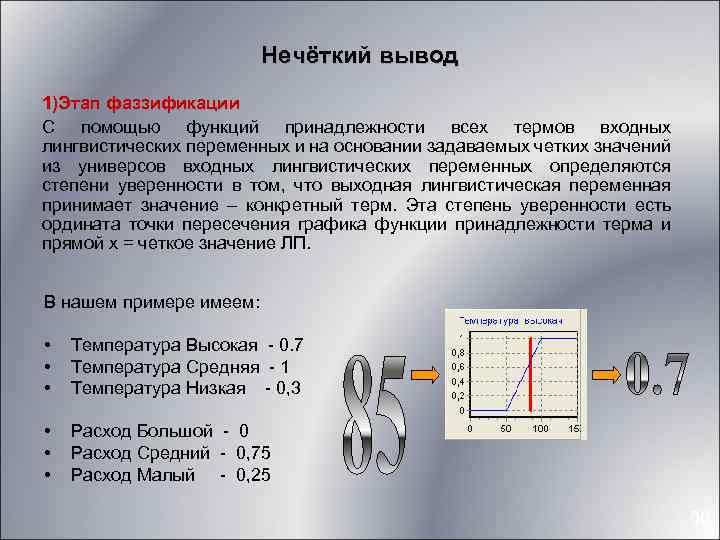

Нечёткий вывод 1)Этап фаззификации С помощью функций принадлежности всех термов входных лингвистических переменных и на основании задаваемых четких значений из универсов входных лингвистических переменных определяются степени уверенности в том, что выходная лингвистическая переменная принимает значение – конкретный терм. Эта степень уверенности есть ордината точки пересечения графика функции принадлежности терма и прямой x = четкое значение ЛП. В нашем примере имеем: • • • Температура Высокая - 0. 7 Температура Средняя - 1 Температура Низкая - 0, 3 • • • Расход Большой - 0 Расход Средний - 0, 75 Расход Малый - 0, 25 50

Нечёткий вывод 1)Этап фаззификации С помощью функций принадлежности всех термов входных лингвистических переменных и на основании задаваемых четких значений из универсов входных лингвистических переменных определяются степени уверенности в том, что выходная лингвистическая переменная принимает значение – конкретный терм. Эта степень уверенности есть ордината точки пересечения графика функции принадлежности терма и прямой x = четкое значение ЛП. В нашем примере имеем: • • • Температура Высокая - 0. 7 Температура Средняя - 1 Температура Низкая - 0, 3 • • • Расход Большой - 0 Расход Средний - 0, 75 Расход Малый - 0, 25 50

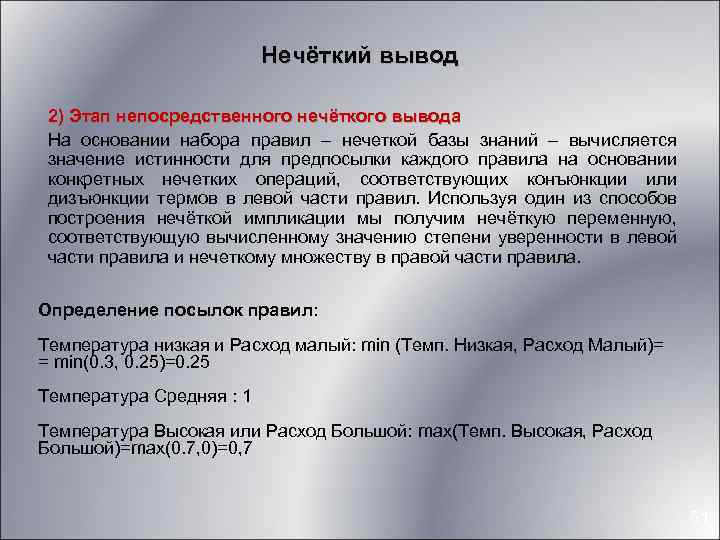

Нечёткий вывод 2) Этап непосредственного нечёткого вывода На основании набора правил – нечеткой базы знаний – вычисляется значение истинности для предпосылки каждого правила на основании конкретных нечетких операций, соответствующих конъюнкции или дизъюнкции термов в левой части правил. Используя один из способов построения нечёткой импликации мы получим нечёткую переменную, соответствующую вычисленному значению степени уверенности в левой части правила и нечеткому множеству в правой части правила. Определение посылок правил: Температура низкая и Расход малый: min (Темп. Низкая, Расход Малый)= = min(0. 3, 0. 25)=0. 25 Температура Средняя : 1 Температура Высокая или Расход Большой: max(Темп. Высокая, Расход Большой)=max(0. 7, 0)=0, 7 51

Нечёткий вывод 2) Этап непосредственного нечёткого вывода На основании набора правил – нечеткой базы знаний – вычисляется значение истинности для предпосылки каждого правила на основании конкретных нечетких операций, соответствующих конъюнкции или дизъюнкции термов в левой части правил. Используя один из способов построения нечёткой импликации мы получим нечёткую переменную, соответствующую вычисленному значению степени уверенности в левой части правила и нечеткому множеству в правой части правила. Определение посылок правил: Температура низкая и Расход малый: min (Темп. Низкая, Расход Малый)= = min(0. 3, 0. 25)=0. 25 Температура Средняя : 1 Температура Высокая или Расход Большой: max(Темп. Высокая, Расход Большой)=max(0. 7, 0)=0, 7 51

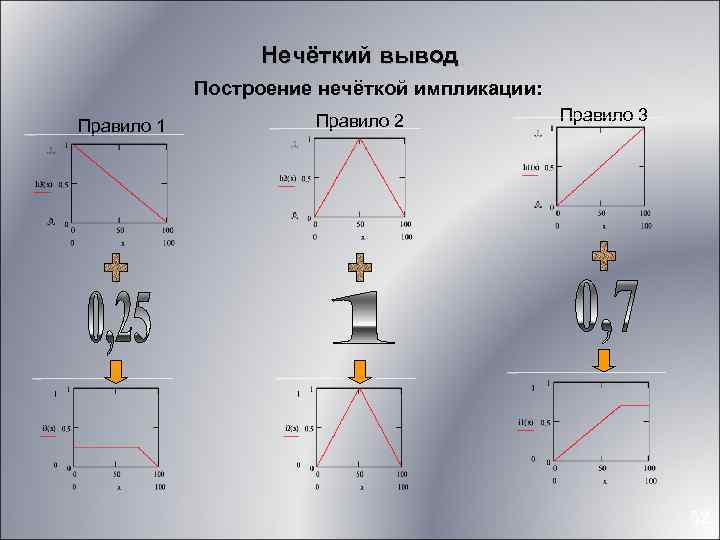

Нечёткий вывод Построение нечёткой импликации: Правило 1 Правило 2 Правило 3 52

Нечёткий вывод Построение нечёткой импликации: Правило 1 Правило 2 Правило 3 52

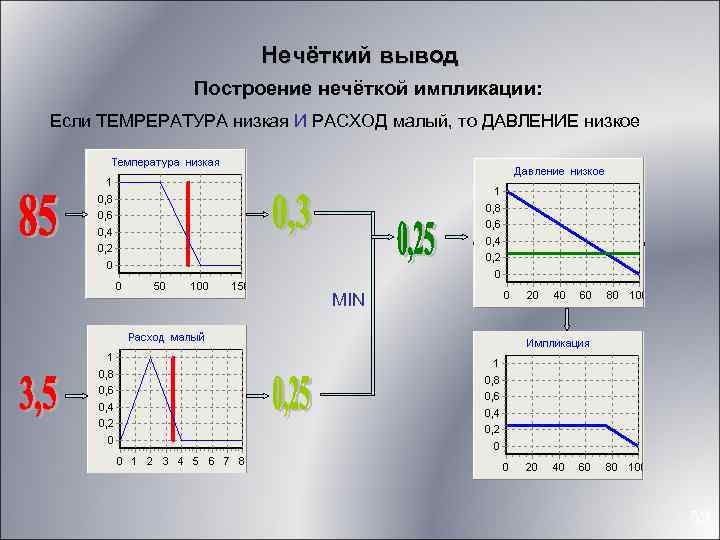

Нечёткий вывод Построение нечёткой импликации: Если ТЕМРЕРАТУРА низкая И РАСХОД малый, то ДАВЛЕНИЕ низкое MIN 53

Нечёткий вывод Построение нечёткой импликации: Если ТЕМРЕРАТУРА низкая И РАСХОД малый, то ДАВЛЕНИЕ низкое MIN 53

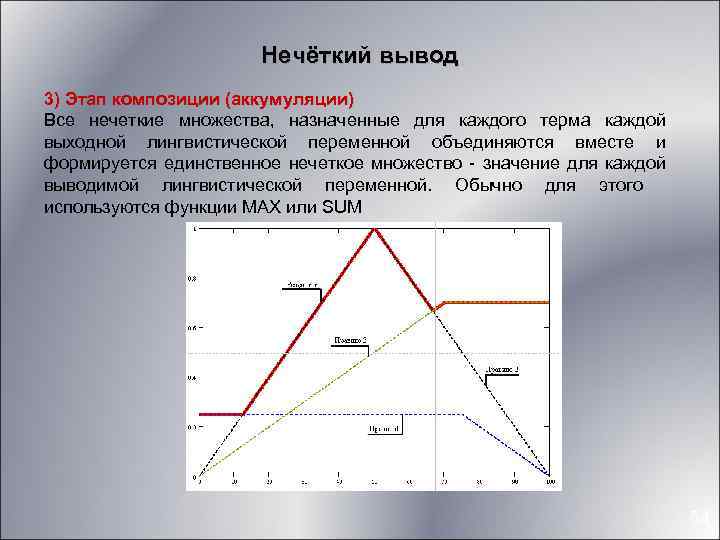

Нечёткий вывод 3) Этап композиции (аккумуляции) Все нечеткие множества, назначенные для каждого терма каждой выходной лингвистической переменной объединяются вместе и формируется единственное нечеткое множество - значение для каждой выводимой лингвистической переменной. Обычно для этого используются функции MAX или SUM 54

Нечёткий вывод 3) Этап композиции (аккумуляции) Все нечеткие множества, назначенные для каждого терма каждой выходной лингвистической переменной объединяются вместе и формируется единственное нечеткое множество - значение для каждой выводимой лингвистической переменной. Обычно для этого используются функции MAX или SUM 54

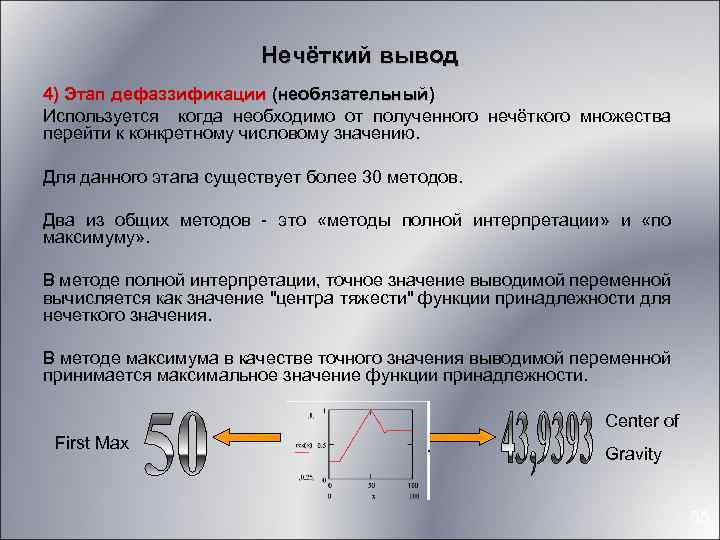

Нечёткий вывод 4) Этап дефаззификации (необязательный) Используется когда необходимо от полученного нечёткого множества перейти к конкретному числовому значению. Для данного этапа существует более 30 методов. Два из общих методов - это «методы полной интерпретации» и «по максимуму» . В методе полной интерпретации, точное значение выводимой переменной вычисляется как значение "центра тяжести" функции принадлежности для нечеткого значения. В методе максимума в качестве точного значения выводимой переменной принимается максимальное значение функции принадлежности. Center of First Max Gravity 55

Нечёткий вывод 4) Этап дефаззификации (необязательный) Используется когда необходимо от полученного нечёткого множества перейти к конкретному числовому значению. Для данного этапа существует более 30 методов. Два из общих методов - это «методы полной интерпретации» и «по максимуму» . В методе полной интерпретации, точное значение выводимой переменной вычисляется как значение "центра тяжести" функции принадлежности для нечеткого значения. В методе максимума в качестве точного значения выводимой переменной принимается максимальное значение функции принадлежности. Center of First Max Gravity 55

Часть III Описание примеров 56

Часть III Описание примеров 56

![Система “Набор баскетболистов” Лингвистические переменные • Рост баскетболиста Множество определения – [170, 236] Множество Система “Набор баскетболистов” Лингвистические переменные • Рост баскетболиста Множество определения – [170, 236] Множество](https://present5.com/presentation/12157441_169389905/image-57.jpg) Система “Набор баскетболистов” Лингвистические переменные • Рост баскетболиста Множество определения – [170, 236] Множество термов - {очень высокий, средний, низкий} • Техника игры баскетболиста Множество определения – [0, 100] Множество термов - {отличная, очень хорошая, средняя, плохая} • Уверенность принятия в команду Множество определения – [0, 100] Множество термов - {полная, средняя, малая, не берём} 57

Система “Набор баскетболистов” Лингвистические переменные • Рост баскетболиста Множество определения – [170, 236] Множество термов - {очень высокий, средний, низкий} • Техника игры баскетболиста Множество определения – [0, 100] Множество термов - {отличная, очень хорошая, средняя, плохая} • Уверенность принятия в команду Множество определения – [0, 100] Множество термов - {полная, средняя, малая, не берём} 57

Система “Набор баскетболистов”- Правила Входные лингвистические переменные Выходная линг. переменная Техника игры Рост игрока Уверенность отбора Отлично Очень высокий Полная Отлично Высокий Полная Отлично Не очень высокий Средняя Отлично Низкий Средняя Очень хорошо Очень высокий Полная Очень хорошо Высокий Полная Очень хорошо Не очень высокий Средняя Очень хорошо Низкий Средняя Хорошо Очень высокий Полная Хорошо Высокий Полная Хорошо Не очень высокий Средняя Хорошо Низкий Малая Не очень хорошо Очень высокий Средняя Не очень хорошо Высокий Средняя Не очень хорошо Не очень высокий Малая Не очень хорошо Низкий Не берём Плохо Очень высокий Малая Плохо Высокий Малая Плохо Не очень высокий Малая Плохо Низкий Не берём 61

Система “Набор баскетболистов”- Правила Входные лингвистические переменные Выходная линг. переменная Техника игры Рост игрока Уверенность отбора Отлично Очень высокий Полная Отлично Высокий Полная Отлично Не очень высокий Средняя Отлично Низкий Средняя Очень хорошо Очень высокий Полная Очень хорошо Высокий Полная Очень хорошо Не очень высокий Средняя Очень хорошо Низкий Средняя Хорошо Очень высокий Полная Хорошо Высокий Полная Хорошо Не очень высокий Средняя Хорошо Низкий Малая Не очень хорошо Очень высокий Средняя Не очень хорошо Высокий Средняя Не очень хорошо Не очень высокий Малая Не очень хорошо Низкий Не берём Плохо Очень высокий Малая Плохо Высокий Малая Плохо Не очень высокий Малая Плохо Низкий Не берём 61

![Система “Футбол” Лингвистические переменные • Разница потерь ведущих игроков Множество определения – [-6, 6] Система “Футбол” Лингвистические переменные • Разница потерь ведущих игроков Множество определения – [-6, 6]](https://present5.com/presentation/12157441_169389905/image-59.jpg) Система “Футбол” Лингвистические переменные • Разница потерь ведущих игроков Множество определения – [-6, 6] Множество термов - {большая скамейка, высокий, одинаковая скамейка, короткая скамейка} • Разница игровых динамик Множество определения – [-15, 15] Множество термов - {существенный проигрыш, выигрыш, существенный выигрыш} • Разница в классе команд Множество определения – [-13, 13] Множество термов - {лидер, верхняя половина, середина, нижняя половина, аутсайдер} 62

Система “Футбол” Лингвистические переменные • Разница потерь ведущих игроков Множество определения – [-6, 6] Множество термов - {большая скамейка, высокий, одинаковая скамейка, короткая скамейка} • Разница игровых динамик Множество определения – [-15, 15] Множество термов - {существенный проигрыш, выигрыш, существенный выигрыш} • Разница в классе команд Множество определения – [-13, 13] Множество термов - {лидер, верхняя половина, середина, нижняя половина, аутсайдер} 62

![Система “Футбол” Лингвистические переменные • Фактор поля Множество определения – [-2, 3] Множество термов Система “Футбол” Лингвистические переменные • Фактор поля Множество определения – [-2, 3] Множество термов](https://present5.com/presentation/12157441_169389905/image-60.jpg) Система “Футбол” Лингвистические переменные • Фактор поля Множество определения – [-2, 3] Множество термов - {абсолютная неудача, преимущество, абсолютное преимущество } • Встречи команд Множество определения – [-20, 20] Множество термов - {позорные встречи, равные встречи, разгромные встречи} • Результат матча Множество определения – [-3, 3] Множество термов - {крупный проигрыш, ничья, выигрыш, крупный выигрыш} 63

Система “Футбол” Лингвистические переменные • Фактор поля Множество определения – [-2, 3] Множество термов - {абсолютная неудача, преимущество, абсолютное преимущество } • Встречи команд Множество определения – [-20, 20] Множество термов - {позорные встречи, равные встречи, разгромные встречи} • Результат матча Множество определения – [-3, 3] Множество термов - {крупный проигрыш, ничья, выигрыш, крупный выигрыш} 63

Система “Футбол” - Правила № Разница потерь игроков Разница динамик Разница в классе Фактор поля Встреча команд Результат матча Важность правила 1 Большая скамейка Существенный выигрыш Лидер Абсолютное преимущество Разгромные встречи Крупный выигрыш 0, 5 2 Одинаковая скамейка Выигрыш Верхняя половина Преимущество Разгромные встречи Крупный выигрыш 0. 94844 3 Одинаковая скамейка Проигрыш Лидер Преимущество Разгромные встречи Крупный выигрыш 0, 5 4 Большая скамейка Выигрыш Верхняя половина Преимущество Равные встречи Крупный выигрыш 0. 6289 5 Одинаковая скамейка Выигрыш Середина Неудача Разгромные встречи Выигрыш 0, 5 6 Короткая скамейка Проигрыш Верхняя половина Преимущество Равные встречи Выигрыш 0. 75458 7 Одинаковая скамейка Выигрыш Середина Неудача Разгромные встречи Выигрыш 0, 5 8 Большая скамейка Существенный выигрыш Нижняя половина Преимущество Равные встречи Выигрыш 1 9 Одинаковая скамейка Выигрыш Середина Неудача Равные встречи Ничья 0. 00027162 10 Короткая скамейка Существенный проигрыш Середина Неудача Равные встречи Ничья 0. 22037 70

Система “Футбол” - Правила № Разница потерь игроков Разница динамик Разница в классе Фактор поля Встреча команд Результат матча Важность правила 1 Большая скамейка Существенный выигрыш Лидер Абсолютное преимущество Разгромные встречи Крупный выигрыш 0, 5 2 Одинаковая скамейка Выигрыш Верхняя половина Преимущество Разгромные встречи Крупный выигрыш 0. 94844 3 Одинаковая скамейка Проигрыш Лидер Преимущество Разгромные встречи Крупный выигрыш 0, 5 4 Большая скамейка Выигрыш Верхняя половина Преимущество Равные встречи Крупный выигрыш 0. 6289 5 Одинаковая скамейка Выигрыш Середина Неудача Разгромные встречи Выигрыш 0, 5 6 Короткая скамейка Проигрыш Верхняя половина Преимущество Равные встречи Выигрыш 0. 75458 7 Одинаковая скамейка Выигрыш Середина Неудача Разгромные встречи Выигрыш 0, 5 8 Большая скамейка Существенный выигрыш Нижняя половина Преимущество Равные встречи Выигрыш 1 9 Одинаковая скамейка Выигрыш Середина Неудача Равные встречи Ничья 0. 00027162 10 Короткая скамейка Существенный проигрыш Середина Неудача Равные встречи Ничья 0. 22037 70

Система “Футбол” - Правила № Разница потерь игроков Разница динамик Разница в классе Фактор поля Встреча команд Результат матча Важность правила 11 Одинаковая скамейка Проигрыш Нижняя половина Преимущество Позорные встречи Ничья 0. 10194 12 Большая скамейка Существенный проигрыш Верхняя половина Неудача Равные встречи Ничья 0. 083936 13 Большая скамейка Проигрыш Середина Абсолютная неудача Равные встречи Проигрыш 0. 013733 14 Одинаковая скамейка Выигрыш Нижняя половина Неудача Позорные встречи Проигрыш 0. 28575 15 Короткая скамейка Существенный проигрыш Середина Преимущество Позорные встречи Проигрыш 0. 30027 16 Одинаковая скамейка Проигрыш Аутсайдер Неудача Равные встречи Проигрыш 1 17 Короткая скамейка Существенный проигрыш Аутсайдер Абсолютная неудача Позорные встречи Крупный проигрыш 1 18 Одинаковая скамейка Существенный проигрыш Нижняя половина Неудача Позорные встречи Крупный проигрыш 1 19 Короткая скамейка Проигрыш Нижняя половина Абсолютная неудача Равные встречи Крупный проигрыш 1 20 Большая скамейка Существенный проигрыш Нижняя половина Неудача Позорные встречи Крупный проигрыш 1 71

Система “Футбол” - Правила № Разница потерь игроков Разница динамик Разница в классе Фактор поля Встреча команд Результат матча Важность правила 11 Одинаковая скамейка Проигрыш Нижняя половина Преимущество Позорные встречи Ничья 0. 10194 12 Большая скамейка Существенный проигрыш Верхняя половина Неудача Равные встречи Ничья 0. 083936 13 Большая скамейка Проигрыш Середина Абсолютная неудача Равные встречи Проигрыш 0. 013733 14 Одинаковая скамейка Выигрыш Нижняя половина Неудача Позорные встречи Проигрыш 0. 28575 15 Короткая скамейка Существенный проигрыш Середина Преимущество Позорные встречи Проигрыш 0. 30027 16 Одинаковая скамейка Проигрыш Аутсайдер Неудача Равные встречи Проигрыш 1 17 Короткая скамейка Существенный проигрыш Аутсайдер Абсолютная неудача Позорные встречи Крупный проигрыш 1 18 Одинаковая скамейка Существенный проигрыш Нижняя половина Неудача Позорные встречи Крупный проигрыш 1 19 Короткая скамейка Проигрыш Нижняя половина Абсолютная неудача Равные встречи Крупный проигрыш 1 20 Большая скамейка Существенный проигрыш Нижняя половина Неудача Позорные встречи Крупный проигрыш 1 71