Lektsia_2_3_OMM (1).ppt

- Количество слайдов: 18

Основи математичного моделювання доц. Бритик В. И. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 1

Корреляция и взаимосвязь величин n Значительная корреляция между двумя случайными величинами всегда является свидетельством существования некоторой статистической связи в данной выборке, но эта связь не обязательно должна наблюдаться для другой выборки и иметь причинноследственный характер. Часто заманчивая простота корреляционного исследования подталкивает исследователя делать ложные интуитивные выводы о наличии причинно-следственной связи между парами признаков, в то время как коэффициенты корреляции устанавливают лишь статистические взаимосвязи. Например, рассматривая пожары в конкретном городе, можно выявить весьма высокую корреляцию между ущербом, который нанес пожар, и количеством пожарных, участвовавших в ликвидации пожара, причём эта корреляция будет положительной. Из этого, однако, не следует вывод «бо льшее количество пожарных приводит к бо льшему ущербу» , и тем более не имеет смысла попытка минимизировать ущерб от пожаров путем ликвидации пожарных бригад. В то же время, отсутствие корреляции между двумя величинами ещё не значит, что между ними нет никакой связи. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 2

Показатели корреляции. Параметрические показатели корреляции Ковариация n Важной характеристикой совместного распределения двух случайных величин является ковариация (или корреляционный момент). Ковариация являетcя совместным центральным моментом второго порядка. Ковариация определяется как математическое ожидание произведения отклонений случайных величин: ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 3

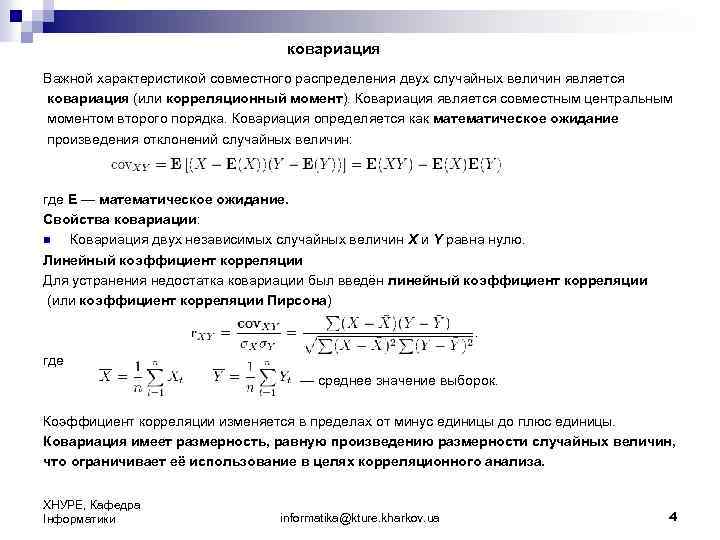

ковариация Важной характеристикой совместного распределения двух случайных величин является ковариация (или корреляционный момент). Ковариация являетcя совместным центральным моментом второго порядка. Ковариация определяется как математическое ожидание произведения отклонений случайных величин: где E — математическое ожидание. Свойства ковариации: n Ковариация двух независимых случайных величин X и Y равна нулю. Линейный коэффициент корреляции Для устранения недостатка ковариации был введён линейный коэффициент корреляции (или коэффициент корреляции Пирсона) где — среднее значение выборок. Коэффициент корреляции изменяется в пределах от минус единицы до плюс единицы. Ковариация имеет размерность, равную произведению размерности случайных величин, что ограничивает её использование в целях корреляционного анализа. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 4

Связь коэффициента регрессии с линейным коэффициентом корреляции Линейный коэффициент корреляции связан с коэффициентом регрессии в виде следующей зависимости: где -— коэффициент регрессии , - среднеквадратическое отклонение соответствующего факторного признака. Для графического представления подобной связи можно использовать прямоугольную систему координат с осями, которые соответствуют обеим переменным. Каждая пара значений маркируется при помощи определенного символа. Такой график называется «диаграммой рассеяния» . Метод вычисления коэффициента корреляции зависит от вида шкалы, к которой относятся переменные. Так, для измерения переменных с интервальной и количественной шкалами необходимо использовать коэффициент корреляции Пирсона (корреляция моментов произведений). Если по меньшей мере одна из двух переменных имеет порядковую шкалу, либо не является нормально распределённой, необходимо использовать ранговую корреляцию Спирмена или (тау) Кендалла. В случае, когда одна из двух переменных является дихотомической, используется точечная двухрядная корреляция, а если обе переменные являются дихотомическими: четырёхполевая корреляция. Расчёт коэффициента корреляции между двумя недихотомическими переменными не лишён смысла только тогда, когда связь между ними линейна (однонаправлена). ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 5

Задачи регрессионного анализа Рассмотрим основные задачи регрессионного анализа: установление формы зависимости, определение функции регрессии, оценка неизвестных значений зависимой переменной. Установление формы зависимости. Характер и форма зависимости между переменными могут образовывать следующие разновидности регрессии: n положительная линейная регрессия (выражается в равномерном росте функции); n положительная равноускоренно возрастающая регрессия; n положительная равнозамедленно возрастающая регрессия; n отрицательная линейная регрессия (выражается в равномерном падении функции); n отрицательная равноускоренно убывающая регрессия; n отрицательная равнозамедленно убывающая регрессия. n Однако описанные разновидности обычно встречаются не в чистом виде, а в сочетании друг с другом. В таком случае говорят о комбинированных формах регрессии. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 6

Определение функции регрессии. Вторая задача сводится к выяснению действия на зависимую переменную главных факторов или причин, при неизменных прочих равных условиях, и при условии исключения воздействия на зависимую переменную случайных элементов. Функция регрессии определяется в виде математического уравнения того или иного типа. Оценка неизвестных значений зависимой переменной. Решение этой задачи сводится к решению задачи одного из типов: n Оценка значений зависимой переменной внутри рассматриваемого интервала исходных данных, т. е. пропущенных значений; при этом решается задача интерполяции. n Оценка будущих значений зависимой переменной, т. е. нахождение значений вне заданного интервала исходных данных; при этом решается задача экстраполяции. Обе задачи решаются путем подстановки в уравнение регрессии найденных оценок параметров значений независимых переменных. Результат решения уравнения представляет собой оценку значения целевой (зависимой) переменной. Рассмотрим некоторые предположения, на которые опирается регрессионный анализ. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 7

Предположение линейности n n Предположение линейности, т. е. предполагается, что связь между рассматриваемыми переменными является линейной. Так, в рассматриваемом примере мы построили диаграмму рассеивания и смогли увидеть явную линейную связь. Если же на диаграмме рассеивания переменных мы видим явное отсутствие линейной связи, т. е. присутствует нелинейная связь, следует использовать нелинейные методы анализа. Предположение о нормальности остатков. Оно допускает, что распределение разницы предсказанных и наблюдаемых значений является нормальным. Для визуального определения характера распределения можно воспользоваться гистограммами остатков. При использовании регрессионного анализа следует учитывать его основное ограничение. Оно состоит в том, что регрессионный анализ позволяет обнаружить лишь зависимости, а не связи, лежащие в основе этих зависимостей. Регрессионный анализ дает возможность оценить степень связи между переменными путем вычисления предполагаемого значения переменной на основании нескольких известных значений. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 8

Последовательность этапов регрессионного анализа Этапы регрессионного анализа. n Формулировка задачи. На этом этапе формируются предварительные гипотезы о зависимости исследуемых явлений. n Определение зависимых и независимых (объясняющих) переменных. n Сбор статистических данных. Данные должны быть собраны для каждой из переменных, включенных в регрессионную модель. n Формулировка гипотезы о форме связи (простая или множественная, линейная или нелинейная). n Определение функции регрессии(заключается в расчете численных значений параметров уравнения регрессии) n Оценка точности регрессионного анализа. n Интерпретация полученных результатов. Полученные результаты регрессионного анализа сравниваются с предварительными гипотезами. Оценивается корректность и правдоподобие полученных результатов. n Предсказание неизвестных значений зависимой переменной. При помощи регрессионного анализа возможно решение задачи прогнозирования и классификации. Прогнозные значения вычисляются путем подстановки в уравнение регрессии параметров значений объясняющих переменных. Решение задачи классификации осуществляется таким образом: линия регрессии делит все множество объектов на два класса, и та часть множества, где значение функции больше нуля, принадлежит к одному классу, а та, где оно меньше нуля, - к другому классу. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 9

Простая линейная регрессия В простейшем случае регрессионного анализа исследуется связь между двумя показателями, которая устанавливается, конечно, не математическим путем, а в результате качественного анализа, позволяющего вскрыть внутреннюю сущность изучаемого явления и порождающих его причин. Сам же регрессионный анализ предназначен для количественного измерения выявленной связи, хотя он нередко способствует и уточнению выводов самого качественного анализа. n Таким образом, еще до математического расчета считается установленным, что связь между независимым показателем-фактором x и зависимой переменной у существует (или может существовать) и характеризуется функцией у =f(x). Одной из первых задач регрессионного анализа является установление вида этой функции, т. е. отыскание такого уравнения регрессии, которое наилучшим образом соответствует характеру изучаемой связи. n Простейшим уравнением, которое может характеризовать зависимость между двумя переменными, является уравнение прямой вида у = а + bх, где x и у — соответственно независимая и зависимая переменные, а и b— постоянные коэффициенты. n ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 10

Уравнение регрессии выглядит следующим образом: Y=a+b*X n При помощи этого уравнения переменная Y выражается через константу a и угол наклона прямой (или угловой коэффициент) b, умноженный на значение переменной X. Константу a также называют свободным членом, а угловой коэффициент b- коэффициентом регрессии или B-коэффициентом. n В большинстве случав (если не всегда) наблюдается определенный разброс наблюдений относительно регрессионной прямой. n Остаток- это отклонение отдельной точки (наблюдения) от линии регрессии (предсказанного значения). n Для решения задачи регрессионного анализа задаем входные интервалы X и Y. Входной интервал Y - это диапазон зависимых анализируемых данных, он должен включать один столбец. Входной интервал X - это диапазон независимых данных, которые необходимо проанализировать. Число входных диапазонов должно быть не больше 16. n Величина R-квадрат, называемая также мерой определенности, характеризует качество полученной регрессионной прямой. Это качество выражается степенью соответствия между исходными данными и регрессионной моделью (расчетными данными). Мера определенности всегда находится в пределах интервала [0; 1]. n В большинстве случаев значение R-квадрат находится между этими значениями, называемыми экстремальными, т. е. между нулем и единицей. n Если значение R-квадрата близко к единице, это означает, что построенная модель объясняет почти всю изменчивость соответствующих переменных. И наоборот, значение Rквадрата, близкое к нулю, означает плохое качество построенной модели. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 11

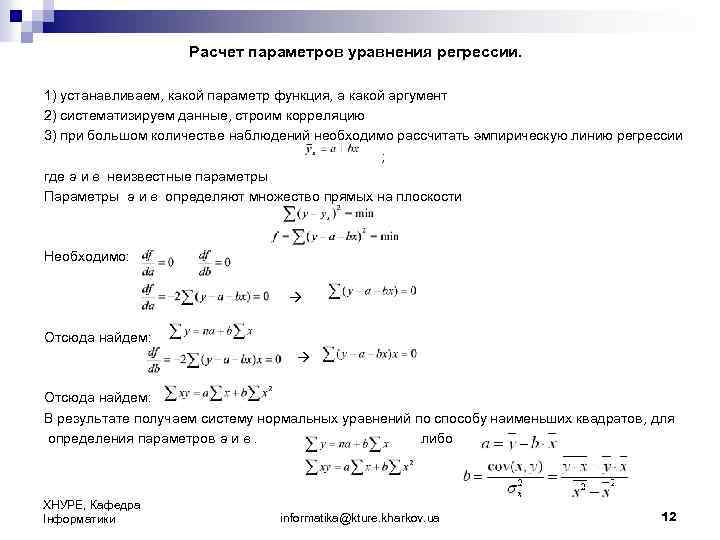

Расчет параметров уравнения регрессии. 1) устанавливаем, какой параметр функция, а какой аргумент 2) систематизируем данные, строим корреляцию 3) при большом количестве наблюдений необходимо рассчитать эмпирическую линию регрессии ; где а и в неизвестные параметры Параметры а и в определяют множество прямых на плоскости Необходимо: Отсюда найдем: В результате получаем систему нормальных уравнений по способу наименьших квадратов, для определения параметров а и в. либо ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 12

Анализ остатков n n n Для проверки адекватности модели можно использовать график остатков d = (y-yрасч) в зависимости от yрасч=i=1, 2, …, n. Если остатки попадают в горизонтальную полосу с центром на оси абсцисс, модель можно рассматривать как адекватную. Если полоса расширяется, когда у возрастает, это указывает на отсутствие постоянства дисперсии, в этом случае следует прибегнуть к преобразованию переменной у. График, показывающий линейный тренд, дает основание для введения в модель дополнительной независимой переменной. Анализ остатков очень важен при построении множественной регрессии, когда исходные данные не могут быть нанесены на исходную диаграмму, т. е. линейность предположенной связи может быть оценена в полной мере только через анализ остатков. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 13

коэффициент множественной корреляции n n n множественный R - коэффициент множественной корреляции R - выражает степень зависимости независимых переменных (X) и зависимой переменной (Y). Множественный R равен квадратному корню из коэффициента детерминации, эта величина принимает значения в интервале от нуля до единицы. В простом линейном регрессионном анализе множественный R равен коэффициенту корреляции Пирсона. Действительно, множественный R в нашем случае равен коэффициенту корреляции Пирсона из предыдущего примера (0, 998364). ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 14

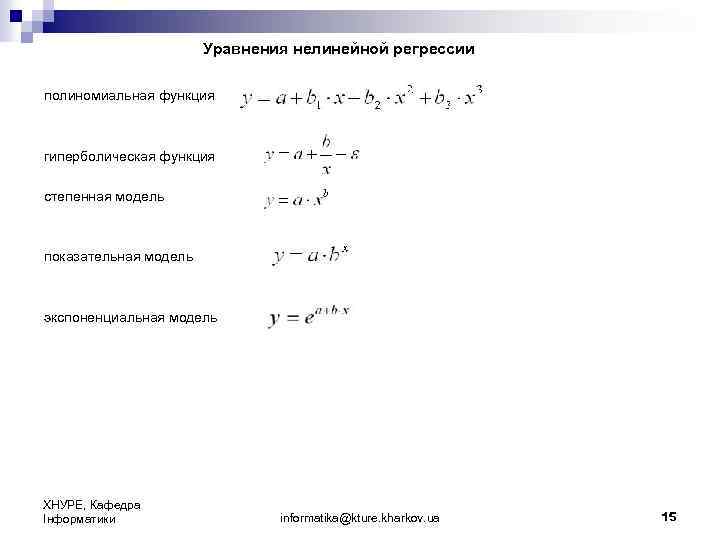

Уравнения нелинейной регрессии полиномиальная функция гиперболическая функция степенная модель показательная модель экспоненциальная модель ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 15

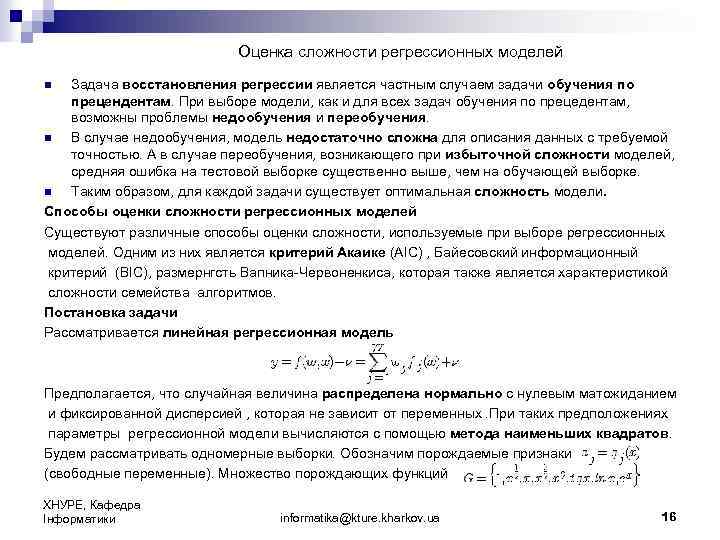

Оценка сложности регрессионных моделей Задача восстановления регрессии является частным случаем задачи обучения по прецендентам. При выборе модели, как и для всех задач обучения по прецедентам, возможны проблемы недообучения и переобучения. n В случае недообучения, модель недостаточно сложна для описания данных с требуемой точностью. А в случае переобучения, возникающего при избыточной сложности моделей, средняя ошибка на тестовой выборке существенно выше, чем на обучающей выборке. n Таким образом, для каждой задачи существует оптимальная сложность модели. Способы оценки сложности регрессионных моделей Существуют различные способы оценки сложности, используемые при выборе регрессионных моделей. Одним из них является критерий Акаике (AIC) , Байесовский информационный критерий (BIC), размернгсть Вапника-Червоненкиса, которая также является характеристикой сложности семейства алгоритмов. Постановка задачи Рассматривается линейная регрессионная модель n Предполагается, что случайная величина распределена нормально с нулевым матожиданием и фиксированной дисперсией , которая не зависит от переменных. При таких предположениях параметры регрессионной модели вычисляются с помощью метода наименьших квадратов. Будем рассматривать одномерные выборки. Обозначим порождаемые признаки (свободные переменные). Множество порождающих функций ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 16

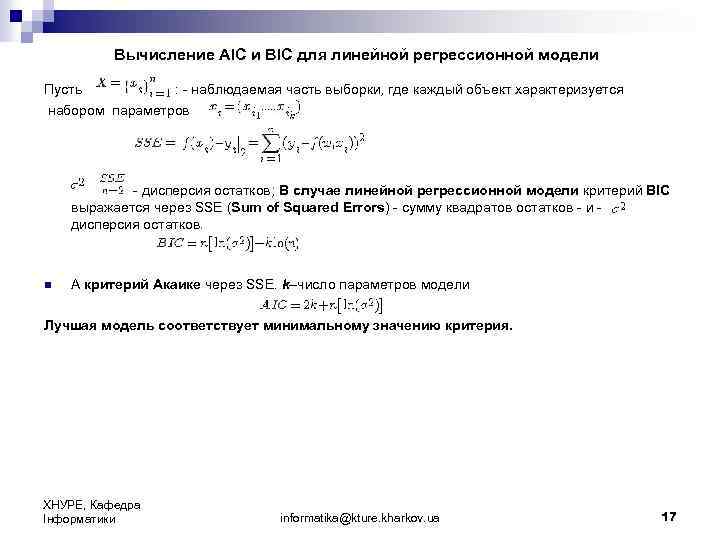

Вычисление AIC и BIC для линейной регрессионной модели Пусть : - наблюдаемая часть выборки, где каждый объект характеризуется набором параметров - дисперсия остатков; В случае линейной регрессионной модели критерий BIC выражается через SSE (Sum of Squared Errors) - сумму квадратов остатков - и дисперсия остатков. n А критерий Акаике через SSE. k–число параметров модели Лучшая модель соответствует минимальному значению критерия. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 17

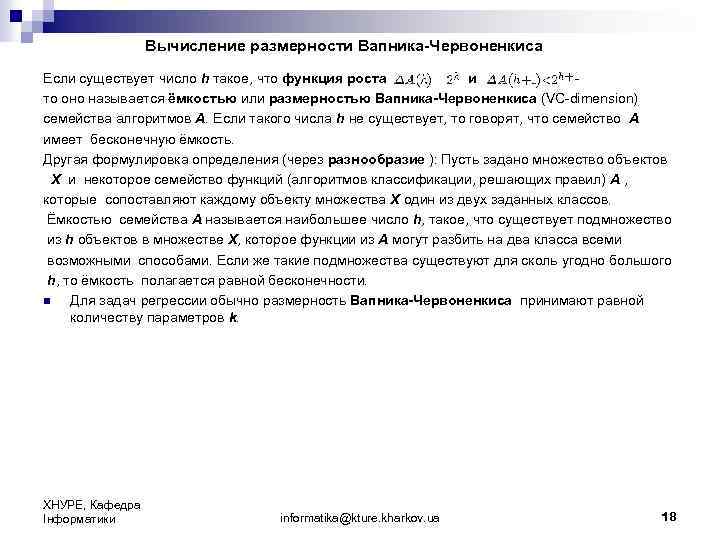

Вычисление размерности Вапника-Червоненкиса Если существует число h такое, что функция роста и то оно называется ёмкостью или размерностью Вапника-Червоненкиса (VC-dimension) семейства алгоритмов A. Если такого числа h не существует, то говорят, что семейство A имеет бесконечную ёмкость. Другая формулировка определения (через разнообразие ): Пусть задано множество объектов X и некоторое семейство функций (алгоритмов классификации, решающих правил) A , которые сопоставляют каждому объекту множества X один из двух заданных классов. Ёмкостью семейства A называется наибольшее число h, такое, что существует подмножество из h объектов в множестве X, которое функции из A могут разбить на два класса всеми возможными способами. Если же такие подмножества существуют для сколь угодно большого h, то ёмкость полагается равной бесконечности. n Для задач регрессии обычно размерность Вапника-Червоненкиса принимают равной количеству параметров k. ХНУРЕ, Кафедра Інформатики informatika@kture. kharkov. ua 18

Lektsia_2_3_OMM (1).ppt