Обзорная лекция по информатике Вопросы 11 -19

Обзорная лекция по информатике Вопросы 11 -19

Вопросы 11. Информация, ее виды и свойства. Измерение информации. 12. Кодирование информации. Условие Фано. Коды Шеннона-Фано и Хаффмана. 13. Достоверность передачи информации. Коды Хемминга. 14. Понятие о конечных автоматах. Эквивалентность и произведение конечных автоматов. 15. Алгоритмы и их свойства. Существование алгоритмически неразрешимых проблем. Машина Поста. 16. Формализация понятия алгоритма. Машина Тьюринга. 17. Формализация понятия алгоритма. Нормальные алгоритмы Маркова. 18. Формализация понятия алгоритма. Рекурсивные функции. 19. Автоматные языки и формальная грамматика. Синтаксические диаграммы. Нотация Бэкуса-Наура.

Литература в библиотеке ИМФИ 518 М 74 Информатика: Учеб. пособие для студ. пед. вузов/ А. В. Могилев, Н. И. Пак, Е. К. Хеннер; Ред. Е. К. Хеннер. - 2 -е изд. , стереотип. - М. : "Академия", 2003. - 816 с.

Вопрос 11 Информация, ее виды и свойства. Измерение информации.

Вопрос «Что такое информация? » является одним из самых сложных вопросов в информатике. Ученые до сих пор не предложили такого ответа на него, который бы устраивал всех исследователей этого феномена.

Наиболее общее (философское) определение информации: Информация — это отраженное разнообразие, заключенное в структуре объекта (1973 г. ). Урсул Аркадий Дмитриевич

Информация и разнообразие Природа информации заключается в разнообразии, а количество информации выражает количество разнообразия. Информация появляется тогда, когда хотя бы два «элемента» в совокупности различаются.

Информация и отражение Отражение - свойство материальных систем в результате процесса взаимодействия воспроизводить и сохранять в своей структуре свойства и структуру другой системы, накапливать их. Воспроизведение в своей структуре структуры и свойств другой системы (т. е. ее разнообразия) и есть передача информации.

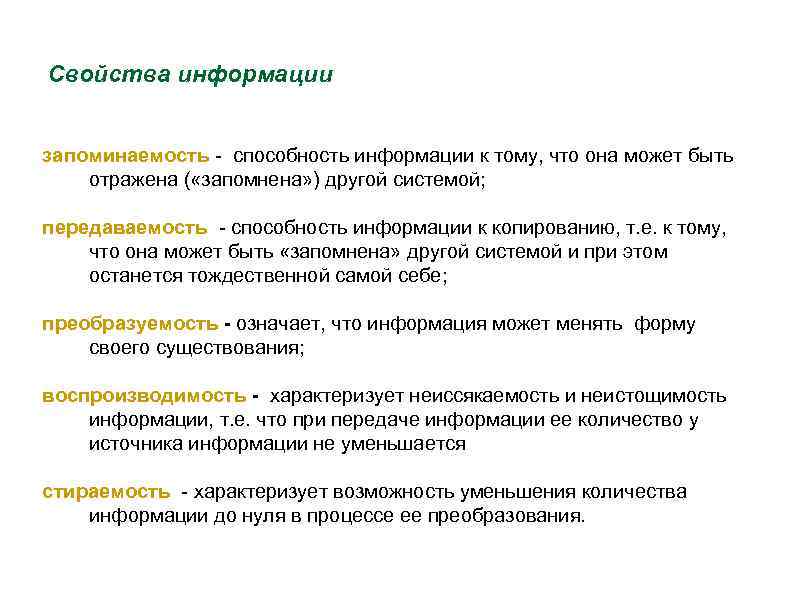

Свойства информации запоминаемость - способность информации к тому, что она может быть отражена ( «запомнена» ) другой системой; передаваемость - способность информации к копированию, т. е. к тому, что она может быть «запомнена» другой системой и при этом останется тождественной самой себе; преобразуемость - означает, что информация может менять форму своего существования; воспроизводимость - характеризует неиссякаемость и неистощимость информации, т. е. что при передаче информации ее количество у источника информации не уменьшается стираемость - характеризует возможность уменьшения количества информации до нуля в процессе ее преобразования.

Виды информации • По органам чувств: зрительная (образная), звуковая и пр. • По представлению: числовая, текстовая, графическая, аудиальная, видео

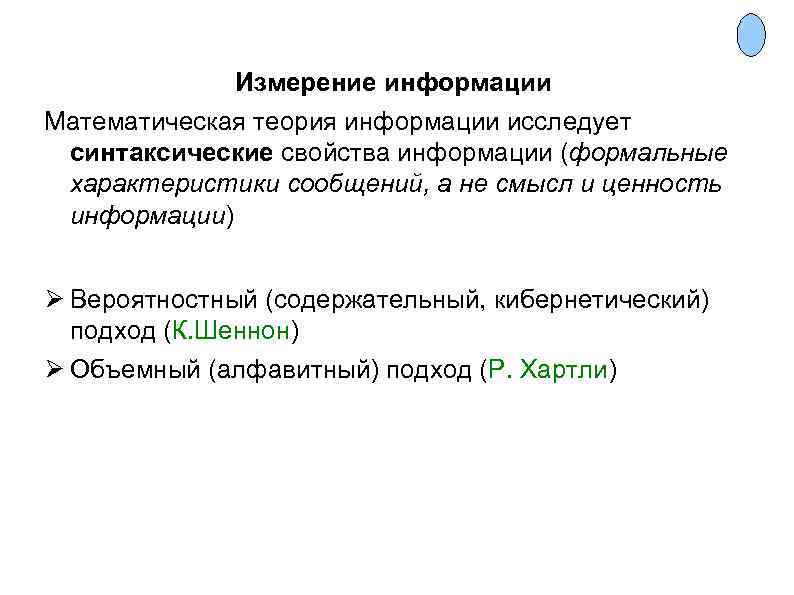

Измерение информации Математическая теория информации исследует синтаксические свойства информации (формальные характеристики сообщений, а не смысл и ценность информации) Вероятностный (содержательный, кибернетический) подход (К. Шеннон) Объемный (алфавитный) подход (Р. Хартли)

В математической теории информации исходят из того, что в некотором сообщении xi количество информации I(xi) зависит не от её конкретного содержания, степени важности и т. д. , а от вероятности получения этого сообщения p(xi)

Чем меньше вероятность получить сообщение, тем больше информации содержится в нем.

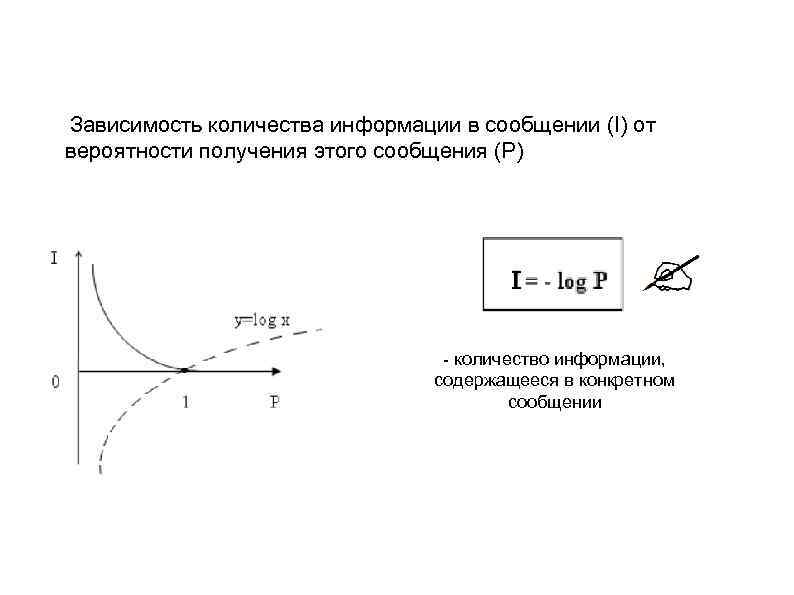

Зависимость количества информации в сообщении (I) от вероятности получения этого сообщения (P) - количество информации, содержащееся в конкретном сообщении

Если все сообщения от данного источника поступают с одинаковой вероятностью, то вероятность одного из N равновероятных сообщения Р = 1/N, а количество информации в этом сообщении определяется по формуле: I = - log (1/N) = log N

Зависимость количества информации в сообщении (I) от количества равновероятных сообщений (N) Ральф Хартли , 1928 г.

Определение бита (вероятностный подход) 1 бит — это количество информации, получаемое при получении одного из двух равновероятных сообщений N=2 log 2 N= log 2 2 =1(бит) 1 бит – это количество информации, уменьшающее неопределенность знаний в 2 раза

Самостоятельно: В коробке лежат кубики: 10 красных, 8 зеленых, 5 желтых, 12 синих. Вычислите вероятность доставания кубика каждого цвета и количество информации, которое при этом будет получено Ответ: Iк=1. 85695 бит Iс=1, 71498 бит Iз=2, 132007 бит Iж=2, 672612 бит На железнодорожной станции имеется 8 подъездных путей. Какое количество информации содержится в сообщении о номере пути, на который прибывает поезд, если поезд может прибыть на любой путь с одинаковой вероятностью? Ответ: I = 3 бита

В теории информации чаще всего необходимо знать не количество информации I(xi), содержащееся в элементарном сообщении, а среднее количество информации приходящееся на элементарное сообщение, генерируемое системой- источником сообщений.

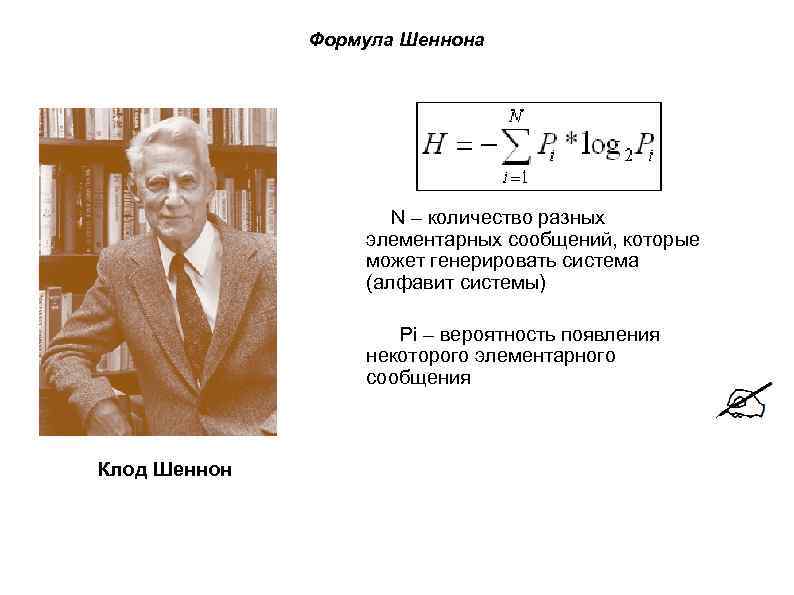

Среднее количество информации, приходящееся на одно сообщение, называется энтропией системы H(x) и определяется по формуле Шеннона

Формула Шеннона N – количество разных элементарных сообщений, которые может генерировать система (алфавит системы) Pi – вероятность появления некоторого элементарного сообщения Клод Шеннон

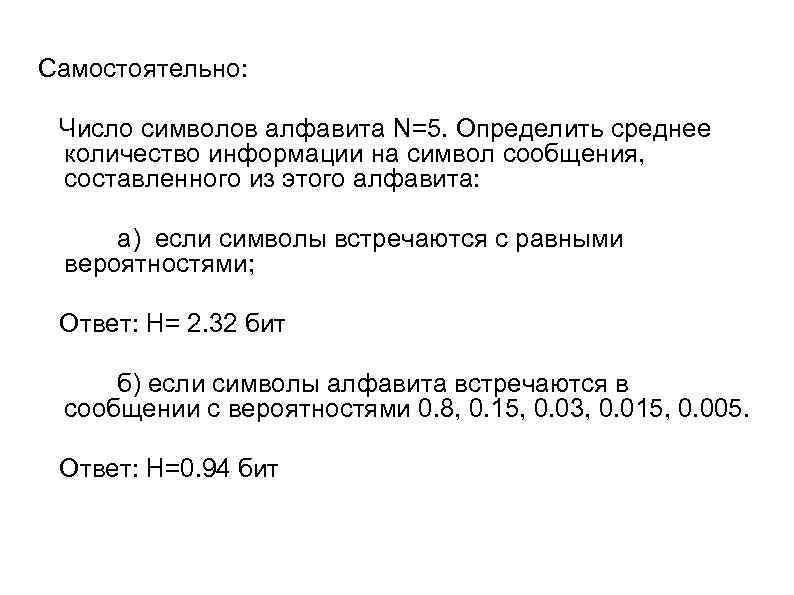

Самостоятельно: Число символов алфавита N=5. Определить среднее количество информации на символ сообщения, составленного из этого алфавита: а) если символы встречаются с равными вероятностями; Ответ: Н= 2. 32 бит б) если символы алфавита встречаются в сообщении с вероятностями 0. 8, 0. 15, 0. 03, 0. 015, 0. 005. Ответ: H=0. 94 бит

Термин “энтропия” заимствован К. Шенноном из термодинамики. В математической теории информации энтропия характеризует источник сообщений с точки зрения неопределённости выбора того или другого сообщения.

Энтропия - численная мера неопределенности наших знаний о состоянии некоторой системы (источника сообщений)

Информация и энтропия Информация — это содержание сообщения, понижающего неопределенность наших знаний о некоторой системе

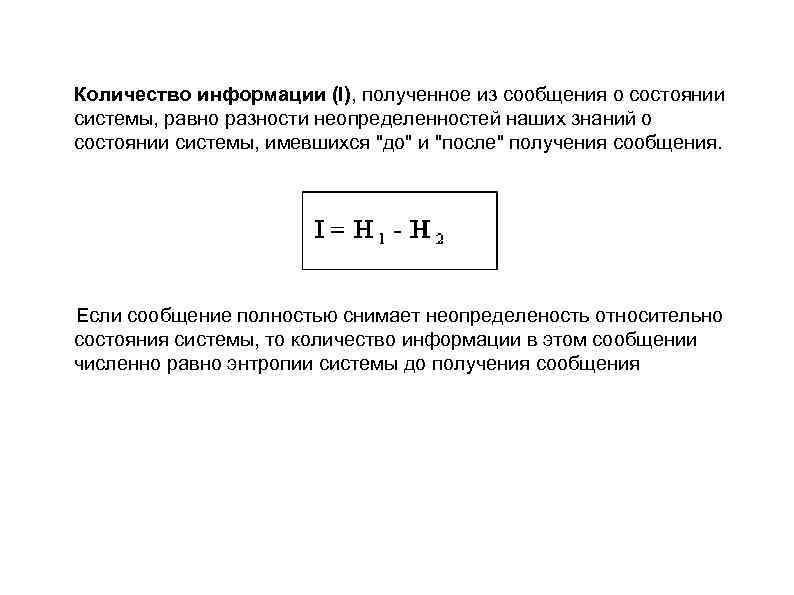

Количество информации (I), полученное из сообщения о состоянии системы, равно разности неопределенностей наших знаний о состоянии системы, имевшихся "до" и "после" получения сообщения. Если сообщение полностью снимает неопределеность относительно состояния системы, то количество информации в этом сообщении численно равно энтропии системы до получения сообщения

Самостоятельно: Сколько информации содержится в сообщении о том, что на игральной кости выпало четное число очков? I = 1 бит

Объемный (алфавитный) подход к измерению информации Объемный подход используется для измерения количества информации в тексте, представленном в виде последовательности символов некоторого алфавита. Количество символов в алфавите называется мощностью алфавита. Предполагается, что все символы в тексте встречаются с равной вероятностью

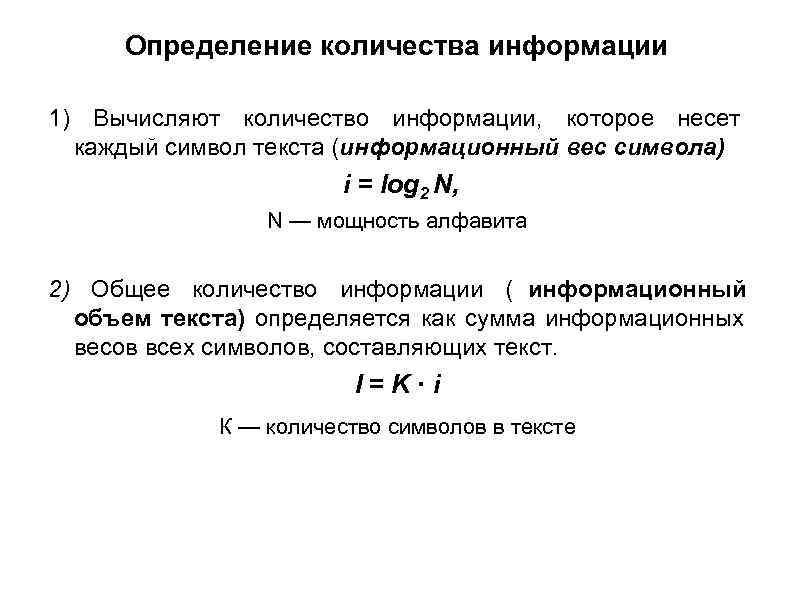

Определение количества информации 1) Вычисляют количество информации, которое несет каждый символ текста (информационный вес символа) i = log 2 N, N — мощность алфавита 2) Общее количество информации ( информационный объем текста) определяется как сумма информационных весов всех символов, составляющих текст. I=K·i К — количество символов в тексте

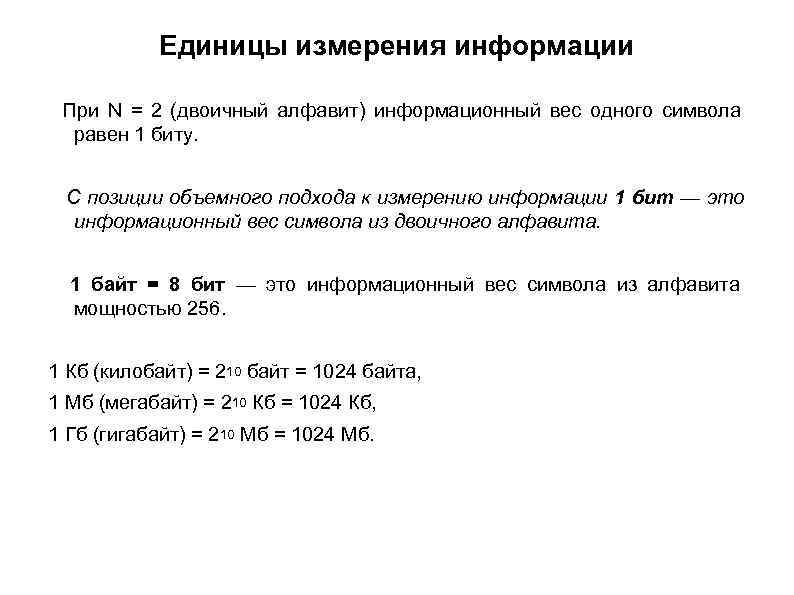

Единицы измерения информации При N = 2 (двоичный алфавит) информационный вес одного символа равен 1 биту. С позиции объемного подхода к измерению информации 1 бит — это информационный вес символа из двоичного алфавита. 1 байт = 8 бит — это информационный вес символа из алфавита мощностью 256. 1 Кб (килобайт) = 210 байт = 1024 байта, 1 Мб (мегабайт) = 210 Кб = 1024 Кб, 1 Гб (гигабайт) = 210 Мб = 1024 Мб.

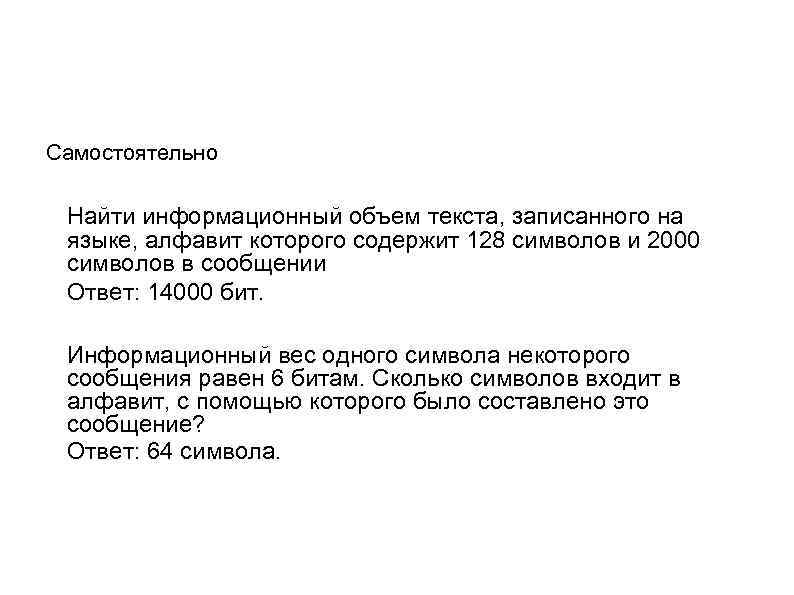

Самостоятельно Найти информационный объем текста, записанного на языке, алфавит которого содержит 128 символов и 2000 символов в сообщении Ответ: 14000 бит. Информационный вес одного символа некоторого сообщения равен 6 битам. Сколько символов входит в алфавит, с помощью которого было составлено это сообщение? Ответ: 64 символа.

Вопрос 12 Кодирование информации. Условие Фано. Коды Шеннона-Фано и Хаффмана

Алфавит - набор знаков, в котором установлен порядок их следования

Первичный алфавит - алфавит, с помощью которого представляется информация до преобразования Вторичный алфавит - алфавит, с помощью которого представляется информация после преобразования

Код - правило, описывающее соответствие знаков или их сочетаний одного алфавита знакам или их сочетаниям другого алфавита.

Кодирование - перевод информации, представленной посредством первичного алфавита, в последовательность кодов Декодирование - восстановление информации в первичном алфавите по полученной последовательности кодов.

Обратимость кодирования Операции кодирования и декодирования называются обратимыми, если их последовательное применение обеспечивает возврат к исходной информации без каких-либо ее потерь

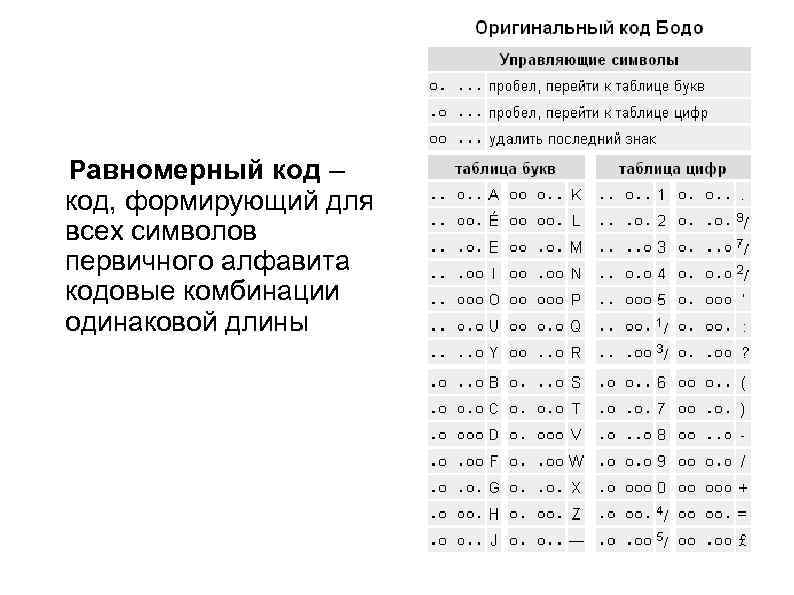

Равномерный код – код, формирующий для всех символов первичного алфавита кодовые комбинации одинаковой длины

Код Морзе Неравномерный код – код, формирующий кодовые комбинации разной длины

Основные задачи, решаемые теорией кодирования: Обеспечение экономичности передачи информации посредством устранения избыточности Обеспечение надежности (помехоустойчивости) передачи информации

Избыточность — использование для кодирования сообщения большего количества символов, чем это минимально необходимо для его однозначного декодирования

Идея экономичного кода При экономичном кодировании для кодирования символов исходного алфавита используют неравномерные коды, учитывающие частоту появления символов: «» - 0 О – 01 …. Ф - 111111 чем больше частота символа, тем короче его код

Существуют два классических метода префиксного кодирования: методы Шеннона - Фано и Хаффмана. Входными данными для обоих методов являются множество символов первичного алфавита с частотами их появления в сообщениях. Результат – экономичные коды.

Метод эффективного кодирования Шеннона – Фано (таблица) 1) Кодируемые символы сортируются по убыванию вероятности появления. 2) Все символы разделяются на 2 группы так, чтобы сумма вероятностей в 1 й группе равнялась сумме вероятностей во 2 й 3) Первому разряду кода символов 1 й группы присваивается значение 0, первому разряду кода символов 2 й группы - 1.

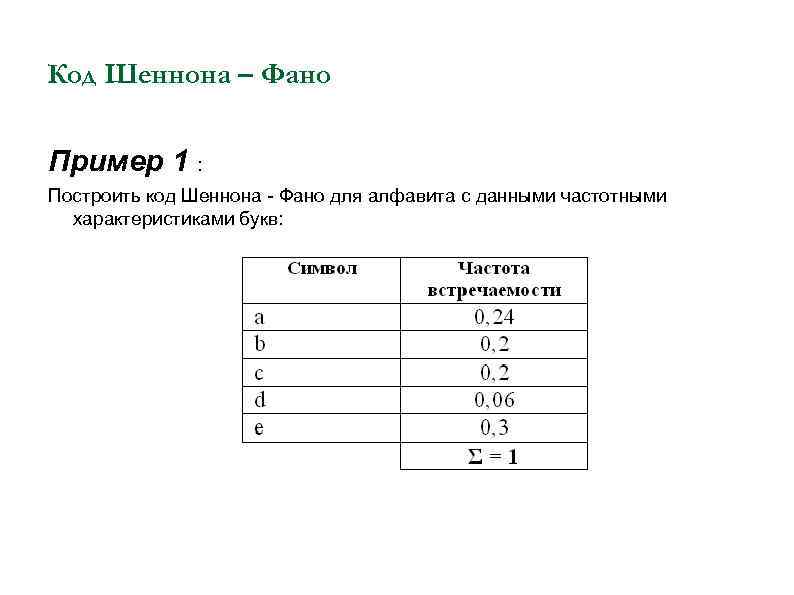

Код Шеннона – Фано Пример 1 : Построить код Шеннона - Фано для алфавита с данными частотными характеристиками букв:

Метод эффективного кодирования Хаффмана (дерево) Строится кодовое дерево 1. Вероятности символов выписывают слева направо в порядке

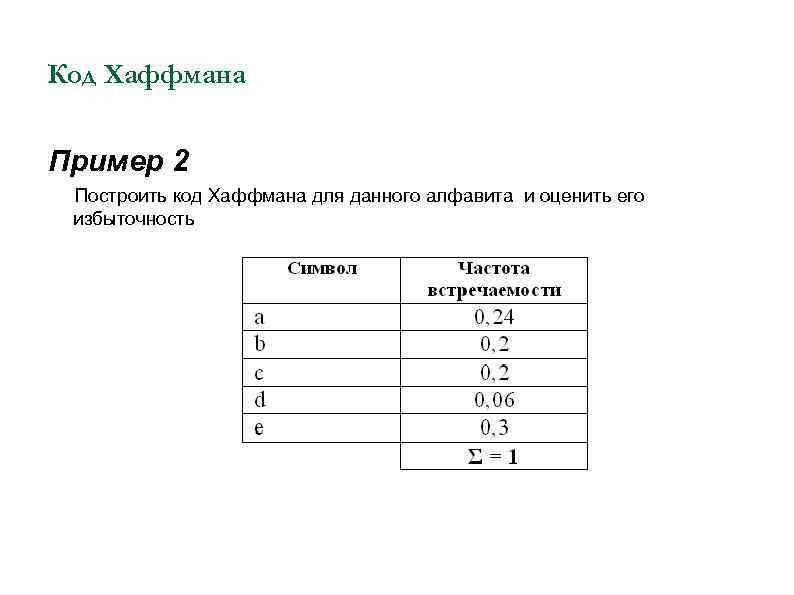

Код Хаффмана Пример 2 Построить код Хаффмана для данного алфавита и оценить его избыточность

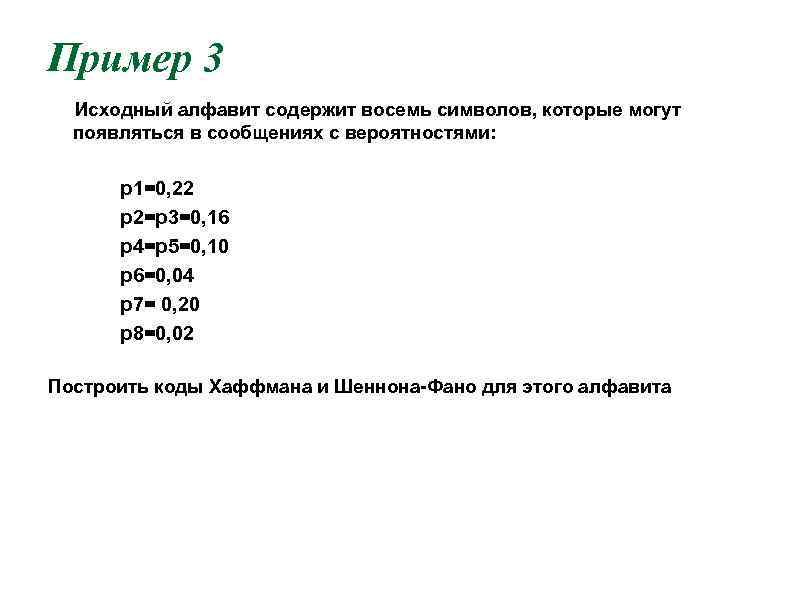

Пример 3 Исходный алфавит содержит восемь символов, которые могут появляться в сообщениях с вероятностями: р1=0, 22 р2=р3=0, 16 р4=р5=0, 10 р6=0, 04 р7= 0, 20 р8=0, 02 Построить коды Хаффмана и Шеннона-Фано для этого алфавита

Декодирование неравномерных кодов

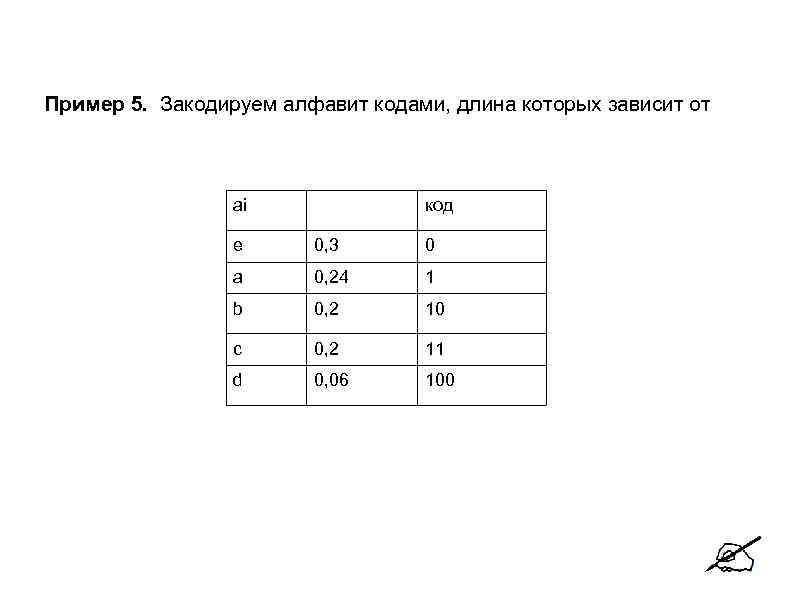

Пример 5. Закодируем алфавит кодами, длина которых зависит от ai код e 0, 3 0 a 0, 24 1 b 0, 2 10 c 0, 2 11 d 0, 06 100

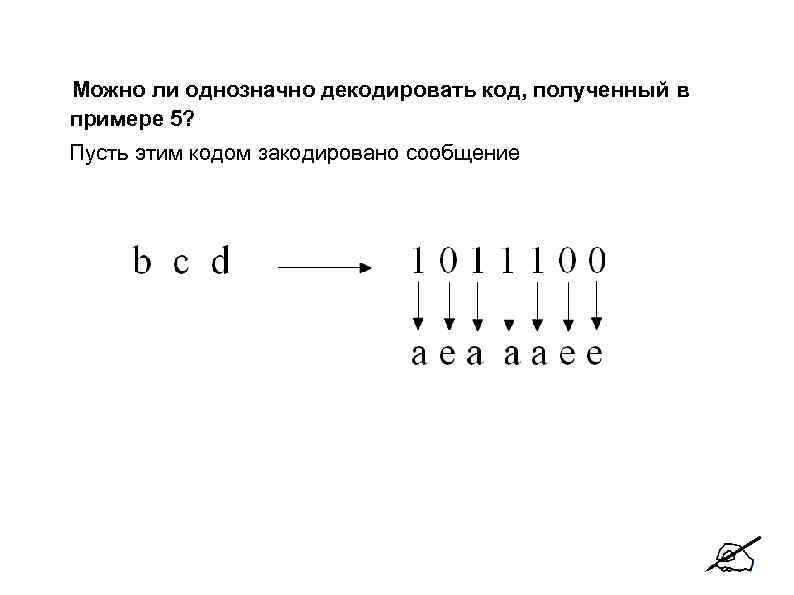

Можно ли однозначно декодировать код, полученный в примере 5? Пусть этим кодом закодировано сообщение

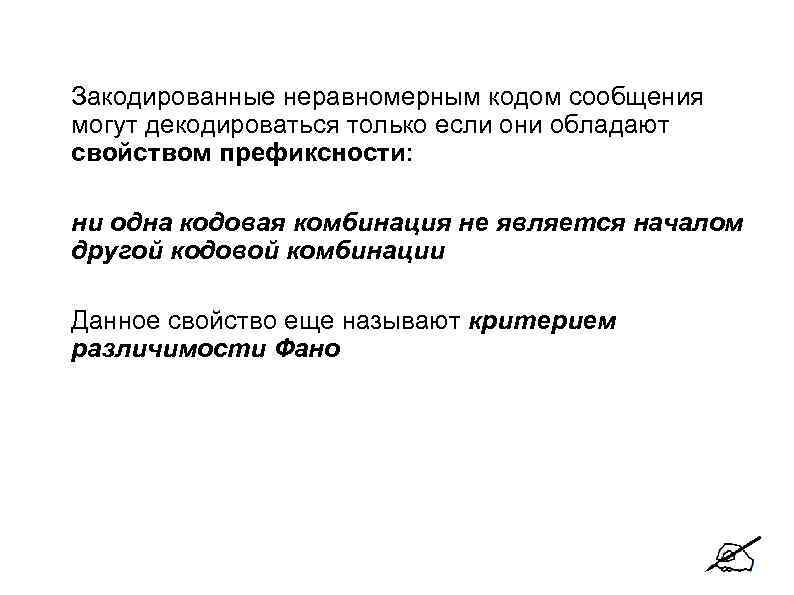

Закодированные неравномерным кодом сообщения могут декодироваться только если они обладают свойством префиксности: ни одна кодовая комбинация не является началом другой кодовой комбинации Данное свойство еще называют критерием различимости Фано

Вопрос При использовании префиксного кодирования, если имеется код 1010, какой код нельзя использовать? 00 01 10 11

Вопрос 13 Достоверность передачи информации. Коды Хемминга.

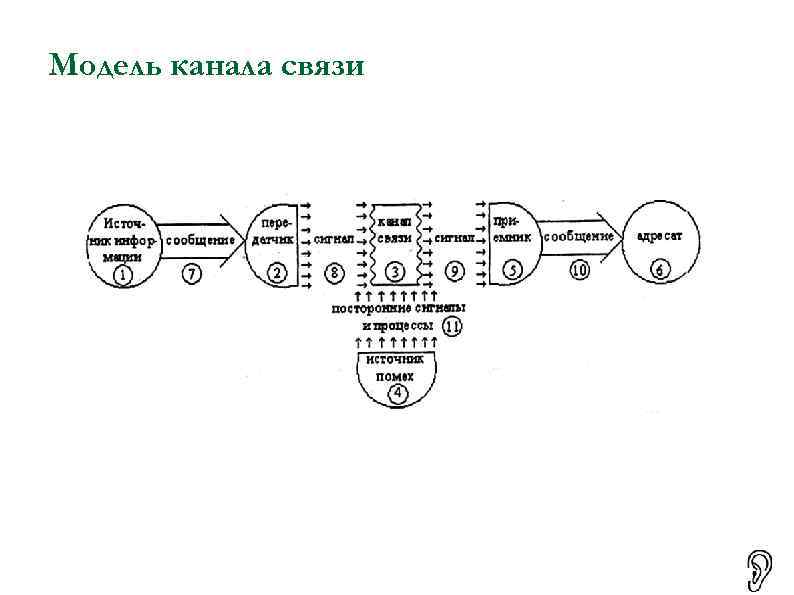

Модель канала связи

Вторая теорема Шеннона Пусть имеется источник информации X с производительностью Н(Х) и канал с пропускной способностью С max. Тогда, если Н(Х) > С max, то при любом способе кодирования передача сообщения без задержек и искажений невозможна. Если же Н(Х) <= С max, то всегда можно достаточно длинное сообщение закодировать так, чтобы оно было передано без задержек и искажений с вероятностью, сколь угодно близкой к единице.

Значение второй теоремы Шеннона Шеннон доказал теоретическую возможность помехоустойчивого кодирования (конкретные способы

Помехоустойчивость сообщения достигается за счет повышения избыточности кода: к информационным разрядам добавляются контрольные, которые позволяют выявить искажение информации, возникшее из-за действия помех

Повтор сообщений Предполагается, что в одном из посланных одинаковых сообщений символы будут не искажены. Сопоставляя сообщения, можно будет исправить ошибки. Такой код выявляет ошибку, но не исправляет Вместо «гора» передавать «ггоорраа» Если получено «гготрраа» , то легко обнаружить ошибку Неоднозначность: что передавалось? «гпоорраа» , «ггоорреа» , «кгоорраа» Важно не исправить ошибку, а обнаружить Высокая избыточность!!!

Код с проверкой на четность К n информационным битам + 1 контрольный бит, так чтобы кодовая цепочка из n+1 бит содержала четное число единиц Для блока 01010100 контрольный бит четности будет

Алгоритм построения кода с проверкой на четность • Разбиваем сообщение на m слов, длиной n 1. Считаем контрольную сумму по модулю 2 каждого слова 2. Если контрольная сумма = 0, в дополнительный разряд ставим 0, иначе 1. 3. Передаем закодированное сообщение 4. Принимаем сообщение 5. Считаем контрольные суммы каждого полученного слова. Если сумма совпадает с значением в дополнительном разряде – ошибки нет, иначе есть ошибка. При условии, что в слове сделано нечетное количество ошибок. 6. Приказываем передатчику повторить слово, в котором есть ошибка.

Пример 1 Закодируйте сообщение 01101101 кодом с проверкой на четность (деля на блоки из 4 х символов)

Что, если слово пришло на приемник с двумя ошибками вместо 1010→ 0011 µ = 0. 00005 µ 2 = 0, 000025

Кодирование с исправлением ошибок Самокорректирующиеся коды позволяют не только обнаруживать ошибки, но и определять номера разрядов с ошибками. Коррекция сводится к инвертированию значения разряда с ошибкой (если в данном разряде записан 0, то он изменяется на 1, и наоборот)

Код Хемминга Самый простой из самокорректирующих ся кодов Рассмотрим код Хемминга, выявляющий только одну ошибку в слове. Ричард Хемминг

Код Хемминга Кодирование происходит также по блокам. Приведем пример кодирования для одного блока, остальные - аналогично. Пример 2 Для блока сообщения 01101101 построить код Хемминга. Определить избыточность кодирования.

Информационные — разряды, непосредственно

Количество информационных разрядов

Строим таблицу В первом столбце располагаем номера разрядов Выделяем среди разрядов проверочные и информационные. Проверочные разряды будут располагаться в разрядах, номера которых равны степеням числа 2: 1=20, 2=21, 4=22, 8=23, … Во втором столбце записываем обозначения разрядов Проверочные разряды обозначим y 1, y 2, y 3, y 4, информационные - x 1, x 2, x 3, x 4, x 5, x 6, x 7, x 8. В третьем столбце записываем значения информационных разрядов. В остальных столбцах записываем двоичные представления номеров разрядов

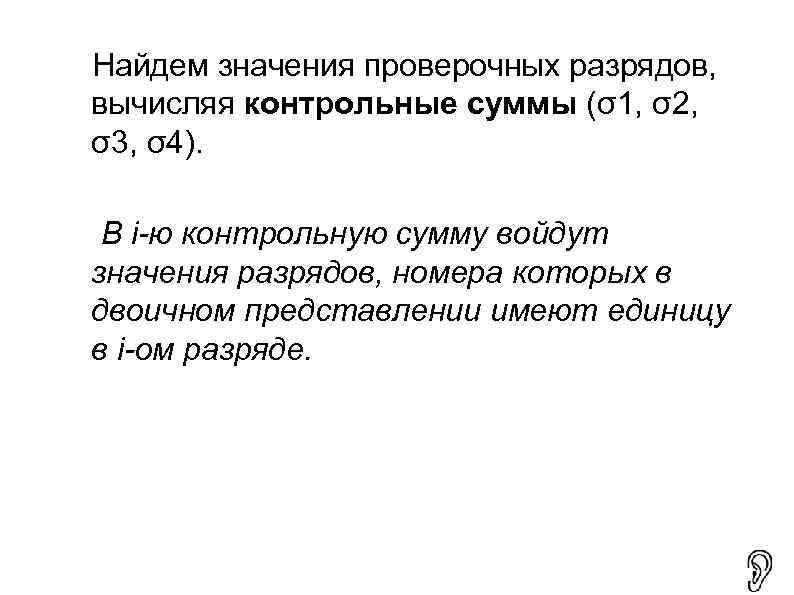

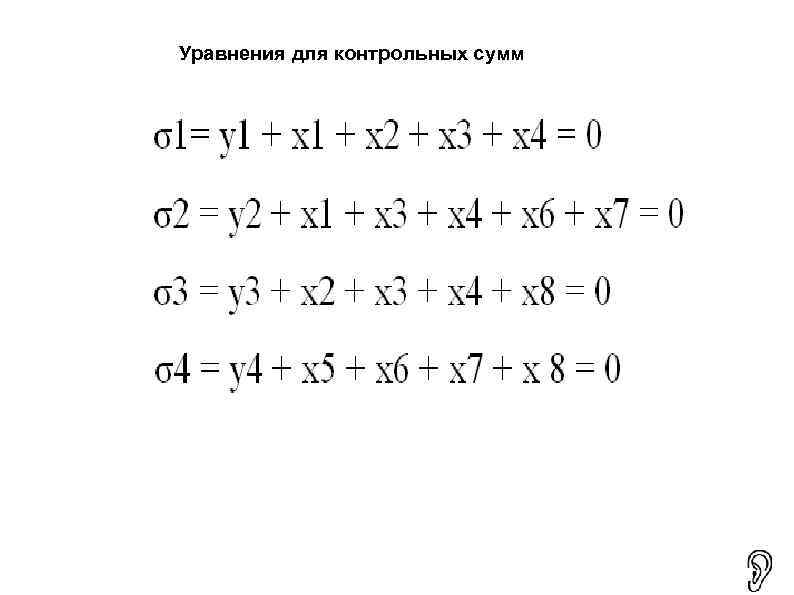

Найдем значения проверочных разрядов, вычисляя контрольные суммы (σ1, σ2, σ3, σ4). В i-ю контрольную сумму войдут значения разрядов, номера которых в двоичном представлении имеют единицу в i-ом разряде.

Уравнения для контрольных сумм

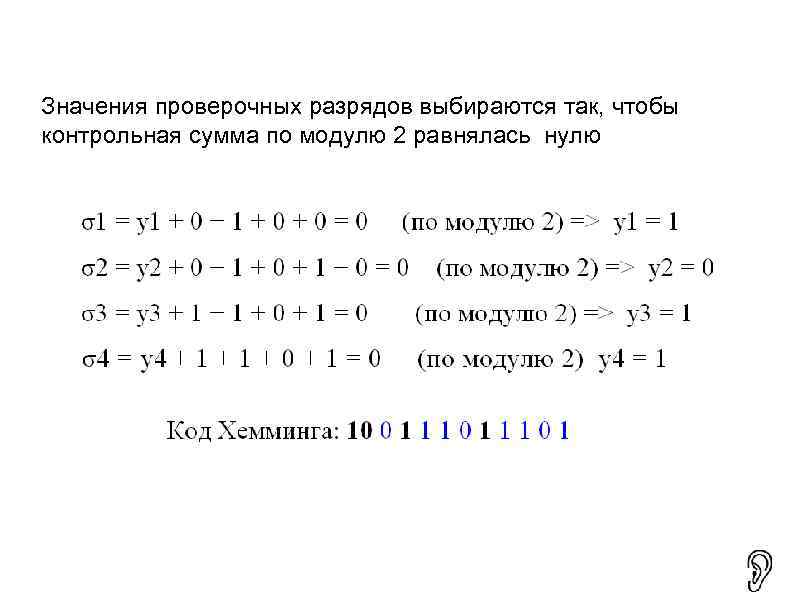

Значения проверочных разрядов выбираются так, чтобы контрольная сумма по модулю 2 равнялась нулю

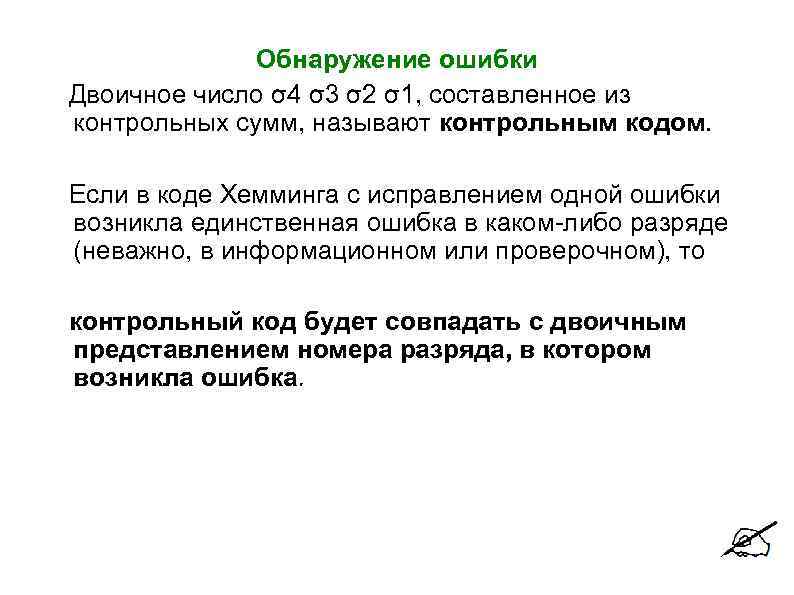

Обнаружение ошибки Двоичное число σ4 σ3 σ2 σ1, составленное из контрольных сумм, называют контрольным кодом. Если в коде Хемминга с исправлением одной ошибки возникла единственная ошибка в каком-либо разряде (неважно, в информационном или проверочном), то контрольный код будет совпадать с двоичным представлением номера разряда, в котором возникла ошибка.

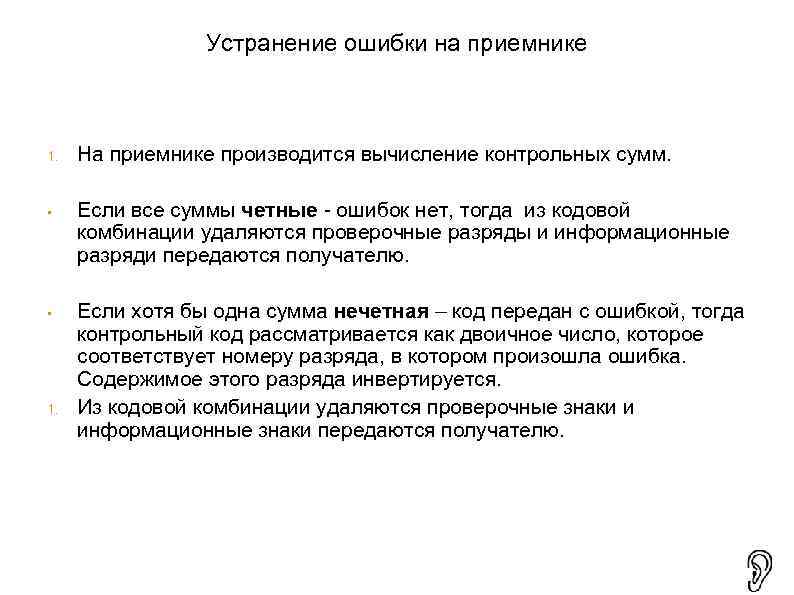

Устранение ошибки на приемнике 1. На приемнике производится вычисление контрольных сумм. • Если все суммы четные - ошибок нет, тогда из кодовой комбинации удаляются проверочные разряды и информационные разряди передаются получателю. • Если хотя бы одна сумма нечетная – код передан с ошибкой, тогда контрольный код рассматривается как двоичное число, которое соответствует номеру разряда, в котором произошла ошибка. Содержимое этого разряда инвертируется. 1. Из кодовой комбинации удаляются проверочные знаки и информационные знаки передаются получателю.

Пусть в предыдущем примере произошло искажение сообщения при передаче (например, в 5 -ом разряде ошибочно принят

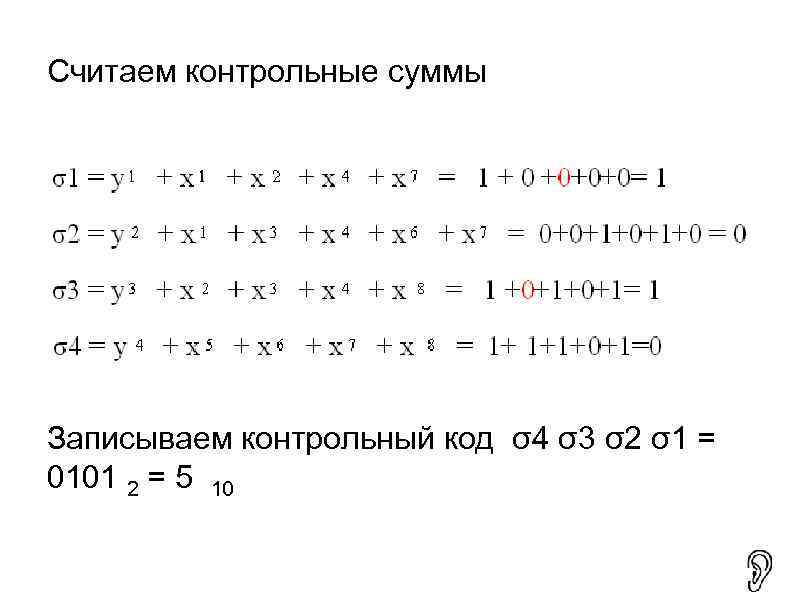

Считаем контрольные суммы Записываем контрольный код σ4 σ3 σ2 σ1 = 0101 2 = 5 10

Вопрос 14 Понятие о конечных автоматах. Эквивалентность и произведение конечных автоматов.

Автоматом называют устройство, которое без непосредственного участия человека выполняет определенную последовательность операций, в результате которой происходит преобразование материальных объектов, энергии, информации.

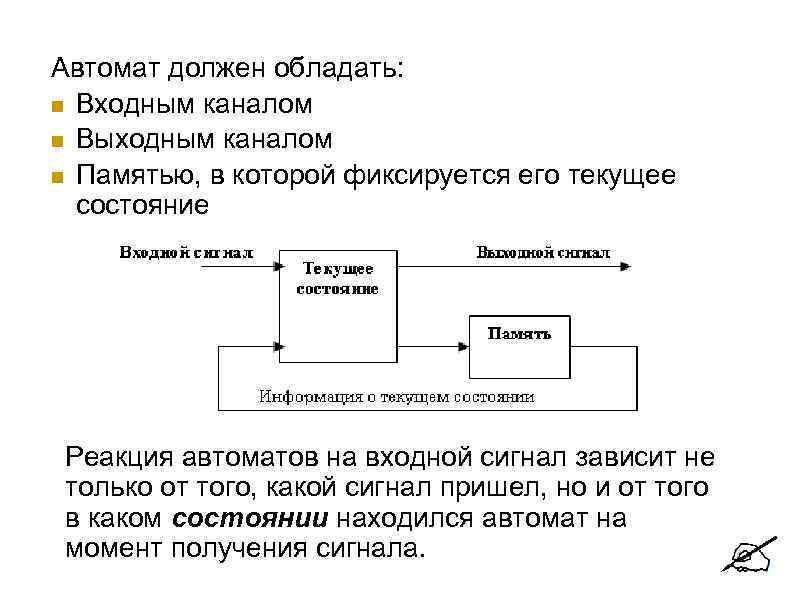

Автомат должен обладать: Входным каналом Выходным каналом Памятью, в которой фиксируется его текущее состояние Реакция автоматов на входной сигнал зависит не только от того, какой сигнал пришел, но и от того в каком состоянии находился автомат на момент получения сигнала.

Если множества входных сигналов, состояний и выходных сигналов — конечные множества, то такой автомат называют конечным автоматом

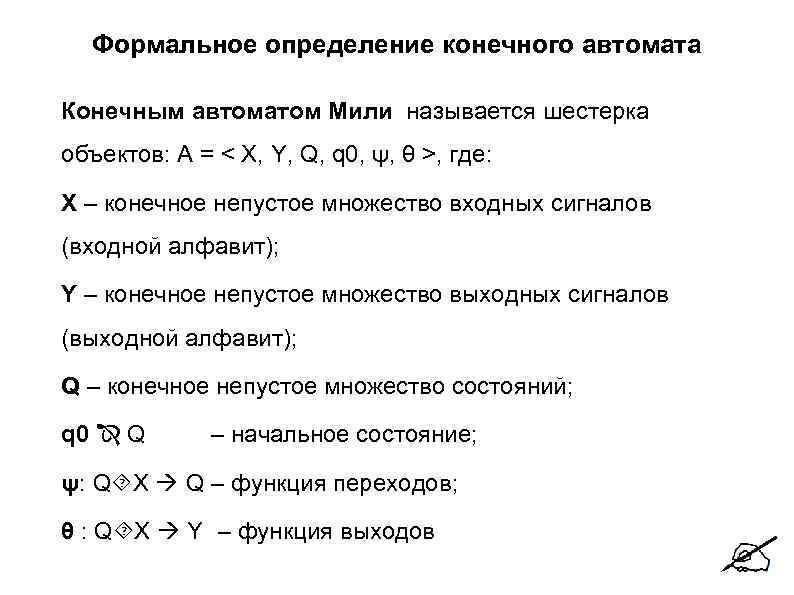

Формальное определение конечного автомата Конечным автоматом Мили называется шестерка объектов: А = < X, Y, Q, q 0, ψ, θ >, где: X – конечное непустое множество входных сигналов (входной алфавит); Y – конечное непустое множество выходных сигналов (выходной алфавит); Q – конечное непустое множество состояний; q 0 Q – начальное состояние; ψ: Q X Q – функция переходов; θ : Q X Y – функция выходов

Проектирование конечного автомата

Пример конечного автомата – автомат «Умный родитель» . В качестве примера конечного автомата рассмотрим модель поведения умного родителя, когда сын приносит двойки и пятерки

1. Неформальное описание работы автомата Если родитель находится в нейтральном состоянии и сын приносит « 2» , то родитель в гневе, и ругает сына Если родитель находится в нейтральном состоянии и сын приносит « 5» , то родитель переходит в радостное состояние и радуется. Если родитель в гневе и сын приносит « 2» , то родитель остается в гневе и берет ремень Если родитель в гневе и сын приносит « 5» , то родитель возвращается в нейтральное состояние и начинает надеятся на лучшее Если родитель в радостном состоянии и сын приносит « 2» , то родитель переходит в нейтральное состояние и успокаивает сына Если родитель в радостном состоянии и сын приносит « 5» , то родитель остается в радостном настроении и даже начинает ликовать

2. Формальное описание работы автомата 2. 1. Определение множеств X, Q, Y Полученные сыном оценки составляют множество входных сигналов Х: x 0, x 1 х0 = 2 х1 = 5 Состояния родителя составляют множество Q: q 0, q 1, q 2 q 0 – нейтральное состояние; q 1 – гневное состояние; q 2 – радостное состояние Возможные действия родителя составляют множество выходных сигналов Y: y 0, y 1, y 2, y 3, y 4, y 5. y 0 – ругает сына y 1 – радуется y 2 – берет ремень y 3 – надеется на лучшее y 4 – успокаивает сына y 5 – ликует

2. 2. Представление работы автомата в некоторой форме Есть несколько способов описать функционирование автомата: Описать все возможные реакции автомата на входящие сигналы с помощью табличных функций переходов и выходов (удобнее при

2. 2. 1 Описание работы автомата с помощью автоматных функций

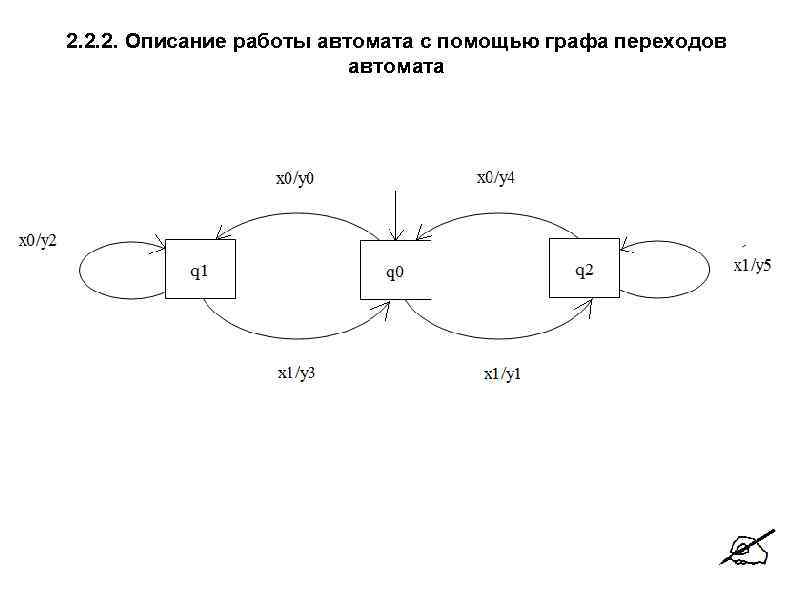

2. 2. 2. Описание работы автомата с помощью графа переходов автомата

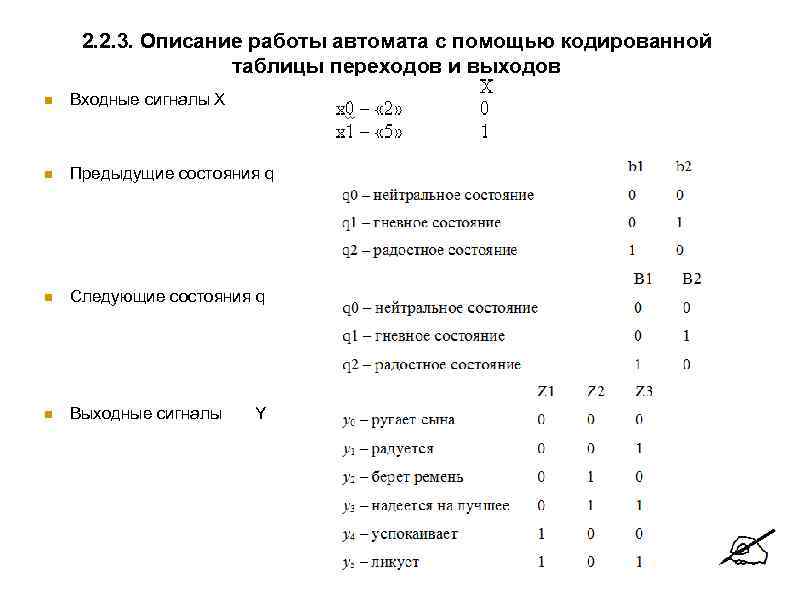

2. 2. 3. Описание работы автомата с помощью кодированной таблицы переходов и выходов Входные сигналы X Предыдущие состояния q Следующие состояния q Выходные сигналы Y

Кодированная таблица переходов и выходов

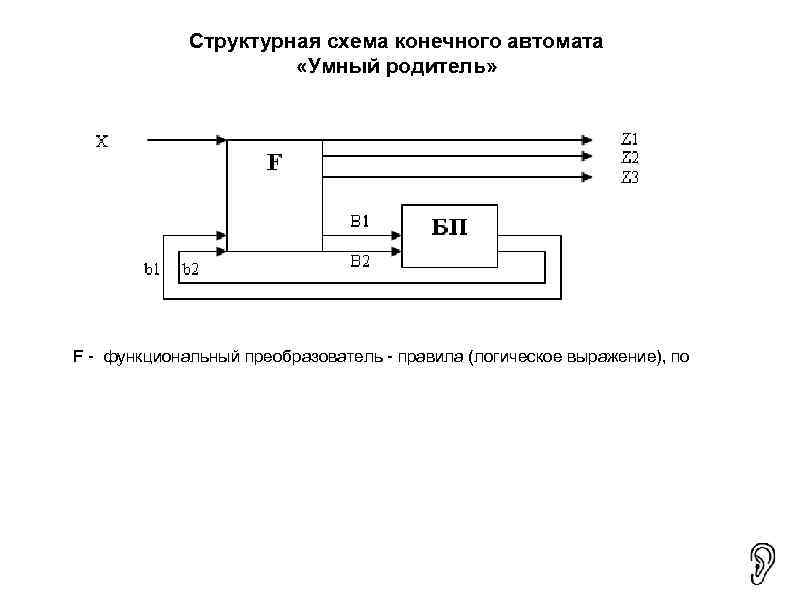

Структурная схема конечного автомата «Умный родитель» F - функциональный преобразователь - правила (логическое выражение), по

Эквивалентные автоматы

Изучение автоматов, реализующих одинаковые преобразования, но имеющих при этом различное число внутренних состояний — одна из важных задач теории автоматов

Входным словом называется совокупность сигналов, поступающих на вход. Выходным словом называются совокупность сигналов на выходе. Два автомата называются эквивалентными, если они 1) имеют одинаковые входной и выходной алфавиты 2) на одинаковые входные слова выдают одинаковые выходные слова. При этом внутренняя структура и количество состояний эквивалентных автоматов может различаться.

Обзорная лекция (информатики).ppt

- Количество слайдов: 94