Теория информации.pptx

- Количество слайдов: 52

НОВОСИБИРСКИЙ ГОСУДАРСТВЕННЫЙ УНИВЕРСИТЕТ ЭКОНОМИКИ И УПРАВЛЕНИЯ КАФЕДРА ИНФОРМАЦИОННОЙ БЕЗОПАСНОСТИ Теория информации Лекция 2. Измерение информации Т. М. Пестунова, к. т. н. , доцент

10 Информация, ее формы и свойства Информация – результаты отражения движения объектов материального мира в системах живой природы. Формы существования информации: Сведения – запечатленные в организме результаты отражения объектов материального мира Сообщения – набор знаков (сигналов), с помощью которого сведения могут быть переданы другому организму и восприняты им

10 В чем разница между сведениями и сообщениями Сведения: v Духовность - невозможность восприятия органами чувств v Субъективность – зависимость количества и ценности сведений от получающего объекта v Неуничтожаемость – невозможность уничтожения без нанесения физического вреда организму v v Динамичность - возможность изменения отношений между объектами материального мира, запечатленными в организме, и их характеристиками. Накапливаемость – возможность практически неограниченного накопления сведений в информационной модели человека

11 В чем разница между сведениями и сообщениями Сообщения: v Материальность - способность воздействовать на органы чувств v Объективность – независимость от получающего их субъекта v Уничтожаемость – возможность физического уничтожения v Статичность - независимость набора знаков от времени, прошедшего с момента создания v Ограниченная воспроизводимость - невозможность точного воспроизведения без закрепления на некотором носителе v Копируемость – возможность создания сколь угодно большого числе копий

ИНФОРМАЦИЯ ПЕРЕДАЁТСЯ ПОСРЕДСТВОМ СООБЩЕНИЯ Источник информации Канал связи Получатель информации

Непрерывная форма представления информации Говорят, что информация задана в непрерывной форме, если она выражается величиной, которая может принимать любое значение на некотором интервале числовой оси. Сведения о температуре сообщать, демонстрируя высоту столба окрашенной жидкости Вес тела можно представить посредством отклонения стрелки весов от нейтрального состояния Аналоговые сигналы (видео-, аудио – и т. п. )

Дискретная форма представления информации характеризуется тем, что соответствующая величина имеет конечное или счетное множество значений. Сведения о температуре, весе, длине и т. п. можно сообщать, отградуировав соответствующий прибор термометр и фиксируя значения с точностью до цены деления. В большинстве современных приборов – телевизор, фотокамеры, музыкальные центры и т. д. – информация представлена в оцифрованном виде. Слово "цифровой" указывает на дискретный характер обрабатываемой информации. Современные методы преобразования позволяют с высокой точностью переходить от аналоговой формы представления информации к цифровой и наоборот

Алфавитный способ представления информации Алфавитный способ является одним из наиболее распространённых способов представления информации Алфавит – конечное или бесконечное множество символов, используемых для представления информации. Под символом понимается некий знак с учётом приписанного ему смыслового значения. Слово – конечная последовательность символов алфавита Примеры алфавитного представления информации: Тексты на естественных языках, Азбука Морзе, числа, программы для ЭВМ и т. п.

Как измерить информацию? ? ? Это сообщение не дает мне никакой информации (распространённая в быту фраза) Часто по своим свойствам информацию сравнивают с энергией. То же многообразие видов и возможность субъективного оценивания. Однако любые виды энергии измеряются в джоулях, что позволяет делать сравнения и количественные оценки. Подобный подход к измерению информации был предложен Клодом Шенноном. В 1948 г. Клод Шеннон опубликовал фундаментальную работу "Математическая теория связи", в которой обобщил имевшиеся к тому времени научные результаты и заложил основы новой науки – теории информации. Важнейшие свойства информации были отражены в формальной модели, разработанной Шенноном. Он предложил метод, позволяющий измерять информацию в математическом смысле, независимо от смыслового значения сообщений, ввел единицу ее измерения – 1 бит.

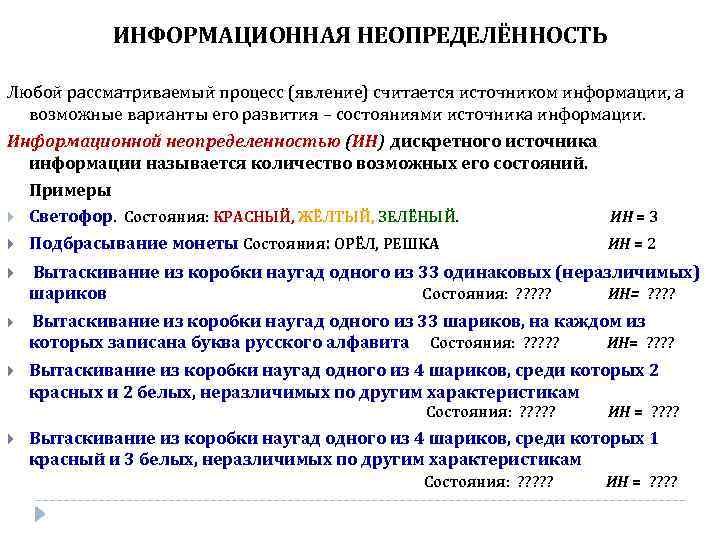

ИНФОРМАЦИОННАЯ НЕОПРЕДЕЛЁННОСТЬ Любой рассматриваемый процесс (явление) считается источником информации, а возможные варианты его развития – состояниями источника информации. Информационной неопределенностью (ИН) дискретного источника информации называется количество возможных его состояний. Примеры Светофор. Состояния: КРАСНЫЙ, ЖЁЛТЫЙ, ЗЕЛЁНЫЙ. ИН = 3 Подбрасывание монеты Состояния: ОРЁЛ, РЕШКА ИН = 2 Вытаскивание из коробки наугад одного из 33 одинаковых (неразличимых) шариков Состояния: ? ? ? ИН= ? ? Вытаскивание из коробки наугад одного из 33 шариков, на каждом из которых записана буква русского алфавита Состояния: ? ? ? ИН= ? ? Вытаскивание из коробки наугад одного из 4 шариков, среди которых 2 красных и 2 белых, неразличимых по другим характеристикам Состояния: ? ? ? ИН = ? ? Вытаскивание из коробки наугад одного из 4 шариков, среди которых 1 красный и 3 белых, неразличимых по другим характеристикам Состояния: ? ? ? ИН = ? ?

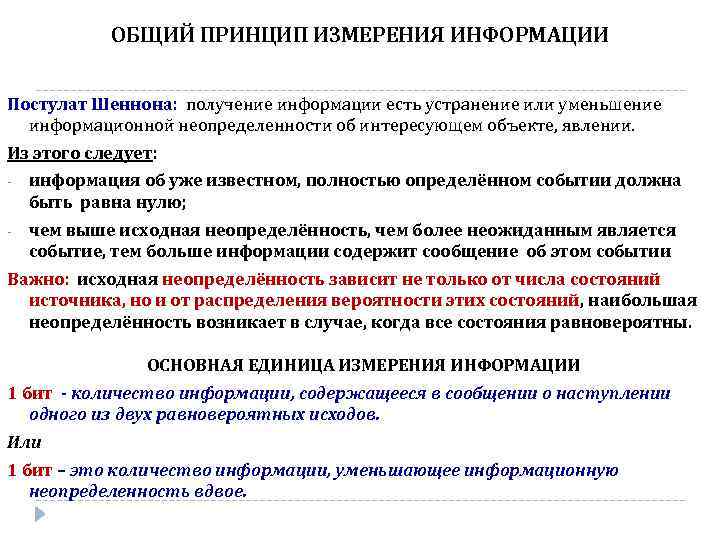

ОБЩИЙ ПРИНЦИП ИЗМЕРЕНИЯ ИНФОРМАЦИИ Постулат Шеннона: получение информации есть устранение или уменьшение информационной неопределенности об интересующем объекте, явлении. Из этого следует: - информация об уже известном, полностью определённом событии должна быть равна нулю; - чем выше исходная неопределённость, чем более неожиданным является событие, тем больше информации содержит сообщение об этом событии Важно: исходная неопределённость зависит не только от числа состояний источника, но и от распределения вероятности этих состояний, наибольшая неопределённость возникает в случае, когда все состояния равновероятны. ОСНОВНАЯ ЕДИНИЦА ИЗМЕРЕНИЯ ИНФОРМАЦИИ 1 бит - количество информации, содержащееся в сообщении о наступлении одного из двух равновероятных исходов. Или 1 бит – это количество информации, уменьшающее информационную неопределенность вдвое.

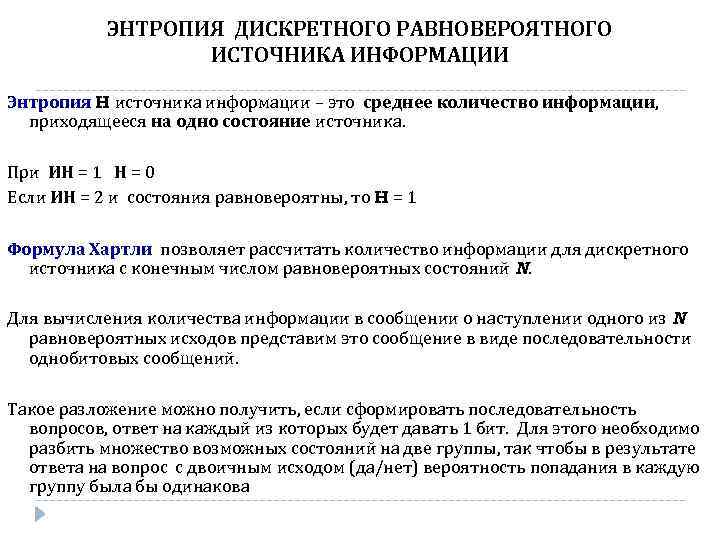

ЭНТРОПИЯ ДИСКРЕТНОГО РАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Энтропия H источника информации – это среднее количество информации, приходящееся на одно состояние источника. При ИН = 1 Н = 0 Если ИН = 2 и состояния равновероятны, то Н = 1 Формула Хартли позволяет рассчитать количество информации для дискретного источника с конечным числом равновероятных состояний N. Для вычисления количества информации в сообщении о наступлении одного из N равновероятных исходов представим это сообщение в виде последовательности однобитовых сообщений. Такое разложение можно получить, если сформировать последовательность вопросов, ответ на каждый из которых будет давать 1 бит. Для этого необходимо разбить множество возможных состояний на две группы, так чтобы в результате ответа на вопрос с двоичным исходом (да/нет) вероятность попадания в каждую группу была бы одинакова

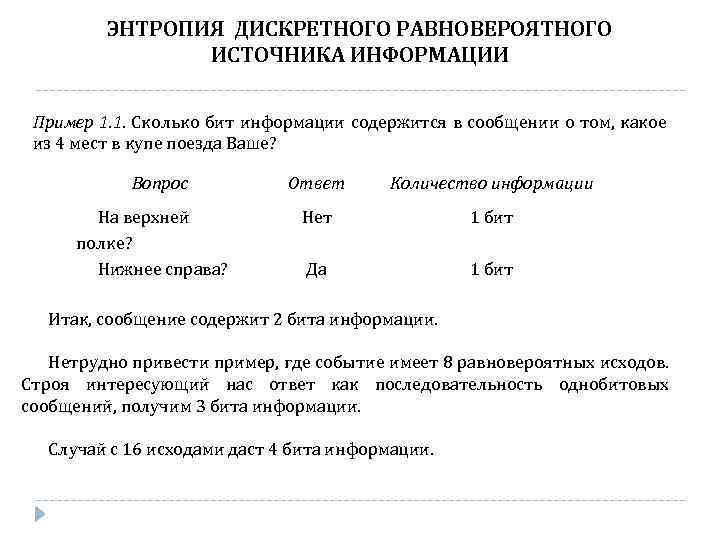

ЭНТРОПИЯ ДИСКРЕТНОГО РАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Пример 1. 1. Сколько бит информации содержится в сообщении о том, какое из 4 мест в купе поезда Ваше? Вопрос На верхней полке? Нижнее справа? Ответ Количество информации Нет 1 бит Да 1 бит Итак, сообщение содержит 2 бита информации. Нетрудно привести пример, где событие имеет 8 равновероятных исходов. Строя интересующий нас ответ как последовательность однобитовых сообщений, получим 3 бита информации. Случай с 16 исходами даст 4 бита информации.

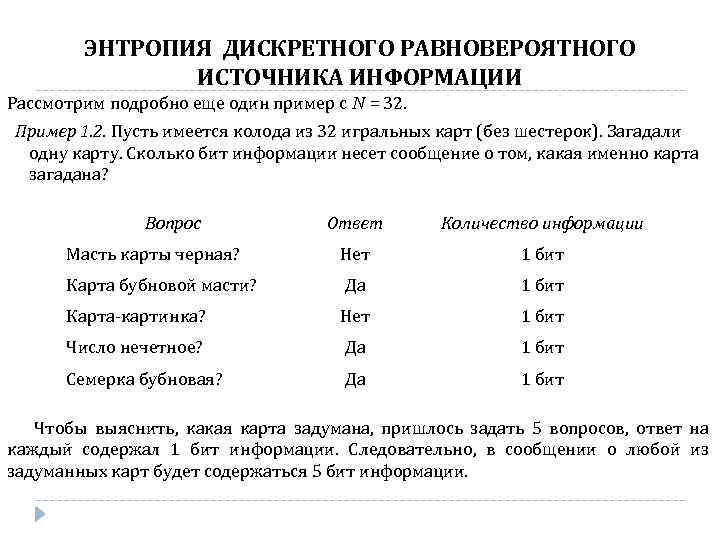

ЭНТРОПИЯ ДИСКРЕТНОГО РАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Рассмотрим подробно еще один пример с N = 32. Пример 1. 2. Пусть имеется колода из 32 игральных карт (без шестерок). Загадали одну карту. Сколько бит информации несет сообщение о том, какая именно карта загадана? Вопрос Ответ Количество информации Масть карты черная? Нет 1 бит Карта бубновой масти? Да 1 бит Карта-картинка? Нет 1 бит Число нечетное? Да 1 бит Семерка бубновая? Да 1 бит Чтобы выяснить, какая карта задумана, пришлось задать 5 вопросов, ответ на каждый содержал 1 бит информации. Следовательно, в сообщении о любой из задуманных карт будет содержаться 5 бит информации.

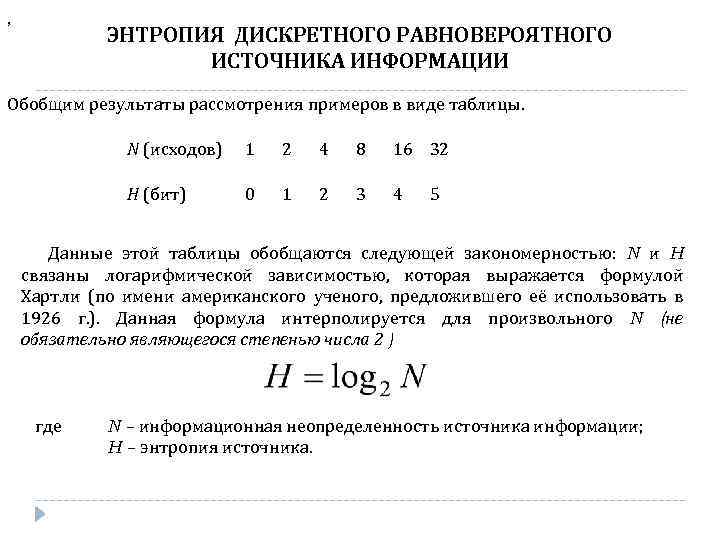

, ЭНТРОПИЯ ДИСКРЕТНОГО РАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Обобщим результаты рассмотрения примеров в виде таблицы. N (исходов) 1 2 4 8 16 32 Н (бит) 0 1 2 3 4 5 Данные этой таблицы обобщаются следующей закономерностью: N и H связаны логарифмической зависимостью, которая выражается формулой Хартли (по имени американского ученого, предложившего её использовать в 1926 г. ). Данная формула интерполируется для произвольного N (не обязательно являющегося степенью числа 2 ) где N – информационная неопределенность источника информации; H – энтропия источника.

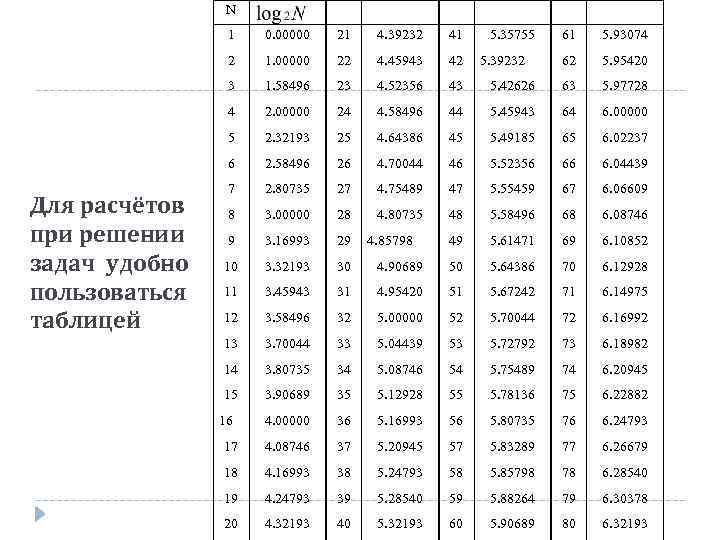

N 1 21 4. 39232 41 2 1. 00000 22 4. 45943 42 3 1. 58496 23 4. 52356 43 4 2. 00000 24 4. 58496 5 2. 32193 25 6 Для расчётов при решении задач удобно пользоваться таблицей 0. 00000 2. 58496 7 61 5. 93074 62 5. 95420 5. 42626 63 5. 97728 44 5. 45943 64 6. 00000 4. 64386 45 5. 49185 65 6. 02237 26 4. 70044 46 5. 52356 66 6. 04439 2. 80735 27 4. 75489 47 5. 55459 67 6. 06609 8 3. 00000 28 4. 80735 48 5. 58496 68 6. 08746 9 3. 16993 29 49 5. 61471 69 6. 10852 10 3. 32193 30 4. 90689 50 5. 64386 70 6. 12928 11 3. 45943 31 4. 95420 51 5. 67242 71 6. 14975 12 3. 58496 32 5. 00000 52 5. 70044 72 6. 16992 13 3. 70044 33 5. 04439 53 5. 72792 73 6. 18982 14 3. 80735 34 5. 08746 54 5. 75489 74 6. 20945 15 3. 90689 35 5. 12928 55 5. 78136 75 6. 22882 4. 00000 36 5. 16993 56 5. 80735 76 6. 24793 17 4. 08746 37 5. 20945 57 5. 83289 77 6. 26679 18 4. 16993 38 5. 24793 58 5. 85798 78 6. 28540 19 4. 24793 39 5. 28540 59 5. 88264 79 6. 30378 20 4. 32193 40 5. 32193 60 5. 90689 80 6. 32193 16 4. 85798 5. 35755 5. 39232

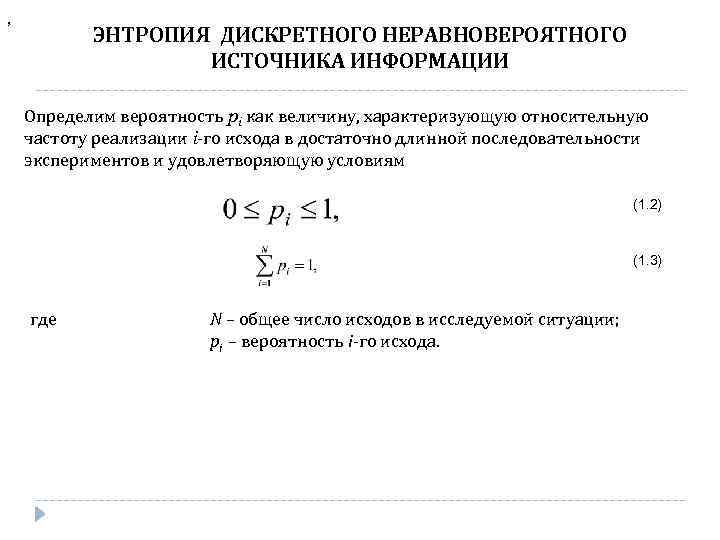

, ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Определим вероятность pi как величину, характеризующую относительную частоту реализации i-го исхода в достаточно длинной последовательности экспериментов и удовлетворяющую условиям (1. 2) (1. 3) где N – общее число исходов в исследуемой ситуации; pi – вероятность i-го исхода.

, ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Пример 1. 3. В коробке находятся два шарика – черный и белый. Достаем наугад один из них. Исходов два – "вынут черный" или "вынут белый". Если шарики неотличимы на ощупь, исход будет являться случайным. В такой ситуации вероятность каждого исхода считается равной 1/2. Следует отметить, что при повторении этого испытания небольшое число раз (после каждого испытания мы возвращаем вынутый шарик в коробку) не исключено, что в большинстве случаев будет вынут шарик одного цвета. Но в достаточно большой серии испытаний (порядка тысячи) процент вынутых белых и черных шариков будет примерно одинаков. Пример 1. 4. В коробке находятся 2 белых и 1 черный шарик. Ясно, что белый шарик будет в среднем попадается в 2 раза чаще, чем черный. Поэтому исходам ставят в соответствие вероятности 2/3 и 1/3.

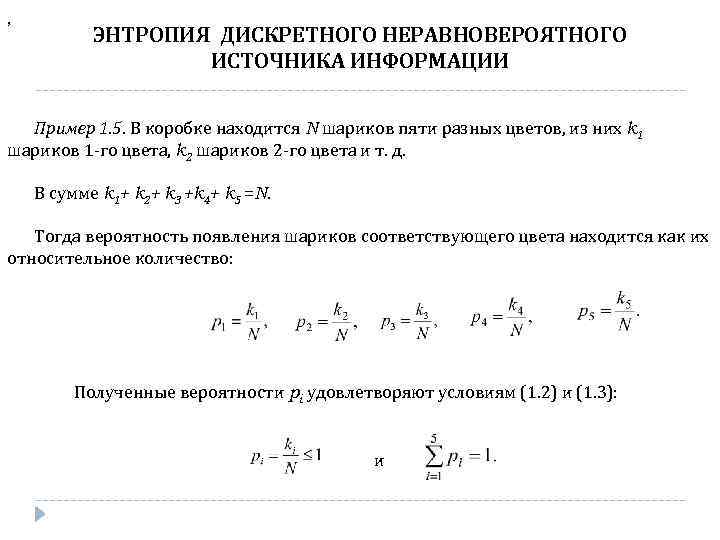

, ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Пример 1. 5. В коробке находится N шариков пяти разных цветов, из них k 1 шариков 1 -го цвета, k 2 шариков 2 -го цвета и т. д. В сумме k 1+ k 2+ k 3 +k 4+ k 5 =N. Тогда вероятность появления шариков соответствующего цвета находится как их относительное количество: Полученные вероятности pi удовлетворяют условиям (1. 2) и (1. 3): и

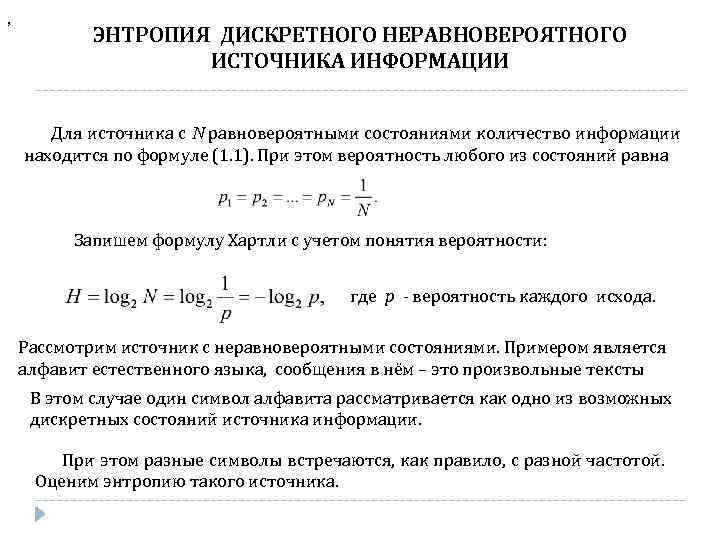

, ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Для источника с N равновероятными состояниями количество информации находится по формуле (1. 1). При этом вероятность любого из состояний равна Запишем формулу Хартли с учетом понятия вероятности: где p - вероятность каждого исхода. Рассмотрим источник с неравновероятными состояниями. Примером является алфавит естественного языка, сообщения в нём – это произвольные тексты В этом случае один символ алфавита рассматривается как одно из возможных дискретных состояний источника информации. При этом разные символы встречаются, как правило, с разной частотой. Оценим энтропию такого источника.

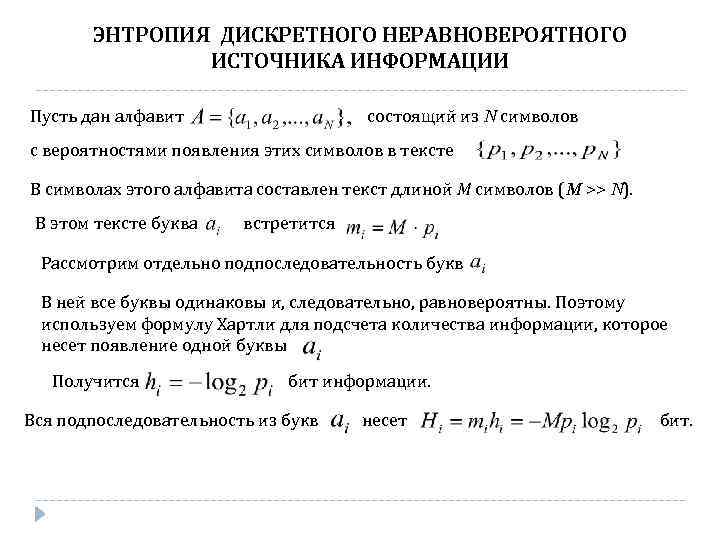

ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ состоящий из N символов Пусть дан алфавит с вероятностями появления этих символов в тексте В символах этого алфавита составлен текст длиной М символов (M >> N). В этом тексте буква встретится Рассмотрим отдельно подпоследовательность букв В ней все буквы одинаковы и, следовательно, равновероятны. Поэтому используем формулу Хартли для подсчета количества информации, которое несет появление одной буквы Получится бит информации. Вся подпоследовательность из букв несет бит.

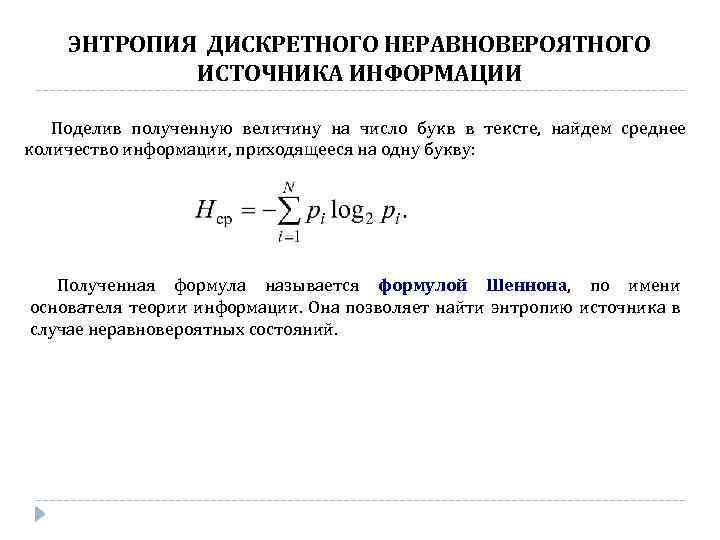

ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Поделив полученную величину на число букв в тексте, найдем среднее количество информации, приходящееся на одну букву: Полученная формула называется формулой Шеннона, по имени основателя теории информации. Она позволяет найти энтропию источника в случае неравновероятных состояний.

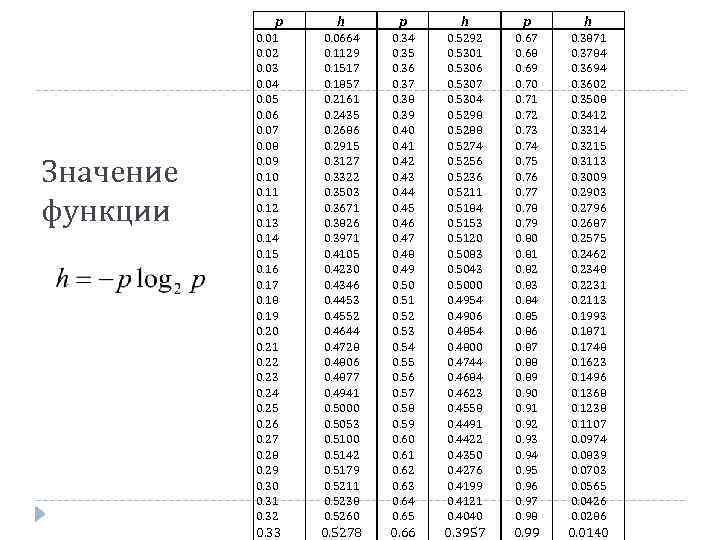

p Значение функции h p h 0. 01 0. 02 0. 03 0. 04 0. 05 0. 06 0. 07 0. 08 0. 09 0. 10 0. 11 0. 12 0. 13 0. 14 0. 15 0. 16 0. 17 0. 18 0. 19 0. 20 0. 21 0. 22 0. 23 0. 24 0. 25 0. 26 0. 27 0. 28 0. 29 0. 30 0. 31 0. 32 0. 0664 0. 1129 0. 1517 0. 1857 0. 2161 0. 2435 0. 2686 0. 2915 0. 3127 0. 3322 0. 3503 0. 3671 0. 3826 0. 3971 0. 4105 0. 4230 0. 4346 0. 4453 0. 4552 0. 4644 0. 4728 0. 4806 0. 4877 0. 4941 0. 5000 0. 5053 0. 5100 0. 5142 0. 5179 0. 5211 0. 5238 0. 5260 0. 34 0. 35 0. 36 0. 37 0. 38 0. 39 0. 40 0. 41 0. 42 0. 43 0. 44 0. 45 0. 46 0. 47 0. 48 0. 49 0. 50 0. 51 0. 52 0. 53 0. 54 0. 55 0. 56 0. 57 0. 58 0. 59 0. 60 0. 61 0. 62 0. 63 0. 64 0. 65 0. 5292 0. 5301 0. 5306 0. 5307 0. 5304 0. 5298 0. 5288 0. 5274 0. 5256 0. 5236 0. 5211 0. 5184 0. 5153 0. 5120 0. 5083 0. 5043 0. 5000 0. 4954 0. 4906 0. 4854 0. 4800 0. 4744 0. 4684 0. 4623 0. 4558 0. 4491 0. 4422 0. 4350 0. 4276 0. 4199 0. 4121 0. 4040 0. 67 0. 68 0. 69 0. 70 0. 71 0. 72 0. 73 0. 74 0. 75 0. 76 0. 77 0. 78 0. 79 0. 80 0. 81 0. 82 0. 83 0. 84 0. 85 0. 86 0. 87 0. 88 0. 89 0. 90 0. 91 0. 92 0. 93 0. 94 0. 95 0. 96 0. 97 0. 98 0. 3871 0. 3784 0. 3694 0. 3602 0. 3508 0. 3412 0. 3314 0. 3215 0. 3113 0. 3009 0. 2903 0. 2796 0. 2687 0. 2575 0. 2462 0. 2348 0. 2231 0. 2113 0. 1993 0. 1871 0. 1748 0. 1623 0. 1496 0. 1368 0. 1238 0. 1107 0. 0974 0. 0839 0. 0703 0. 0565 0. 0426 0. 0286 0. 33 0. 5278 0. 66 0. 3957 0. 99 0. 0140

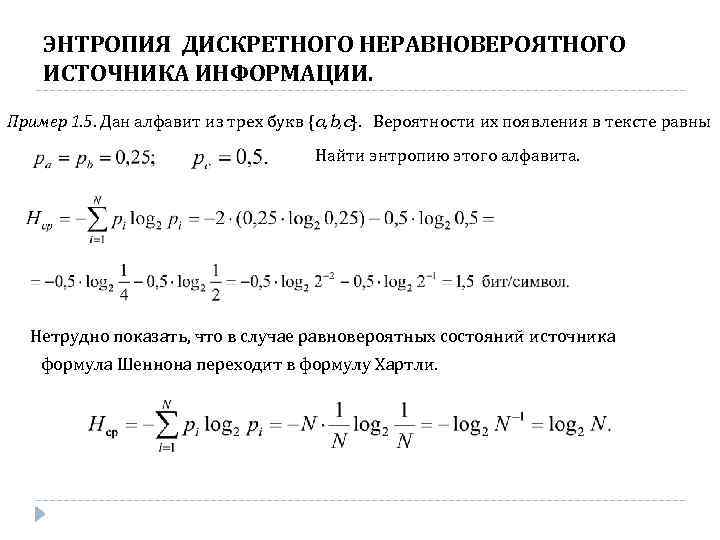

ЭНТРОПИЯ ДИСКРЕТНОГО НЕРАВНОВЕРОЯТНОГО ИСТОЧНИКА ИНФОРМАЦИИ. Пример 1. 5. Дан алфавит из трех букв {a, b, c}. Вероятности их появления в тексте равны Найти энтропию этого алфавита. Нетрудно показать, что в случае равновероятных состояний источника формула Шеннона переходит в формулу Хартли.

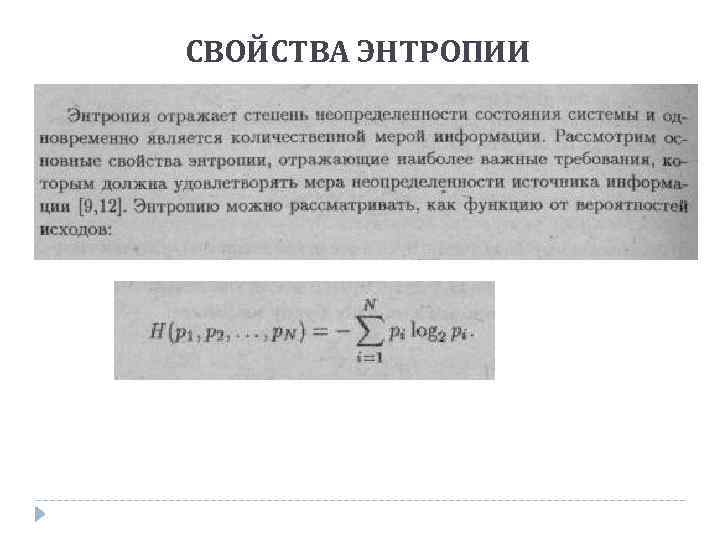

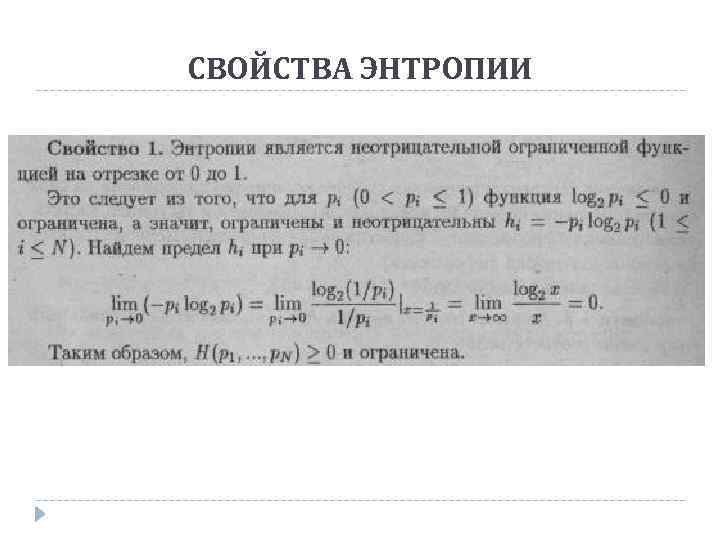

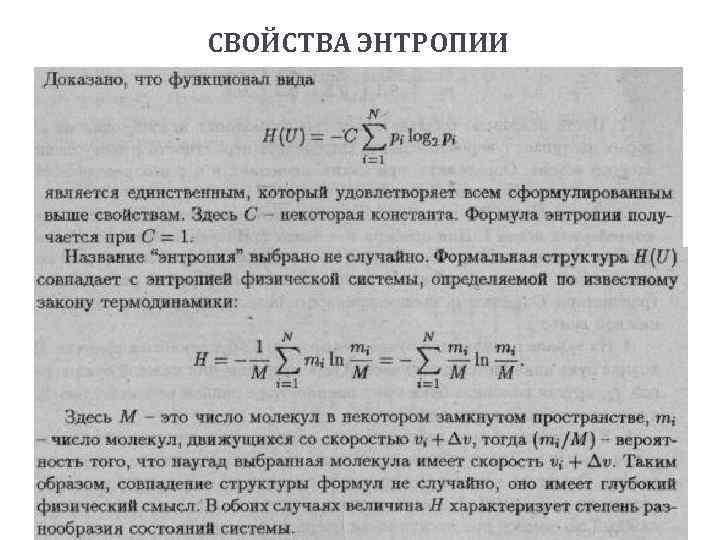

СВОЙСТВА ЭНТРОПИИ

СВОЙСТВА ЭНТРОПИИ

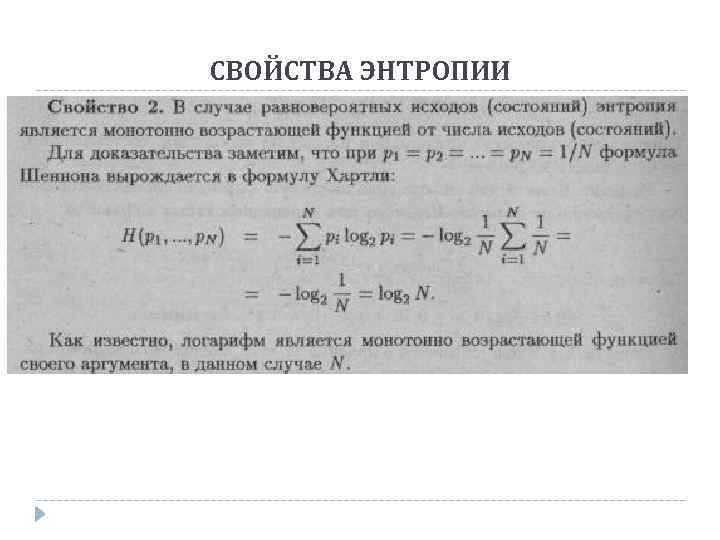

СВОЙСТВА ЭНТРОПИИ

СВОЙСТВА ЭНТРОПИИ

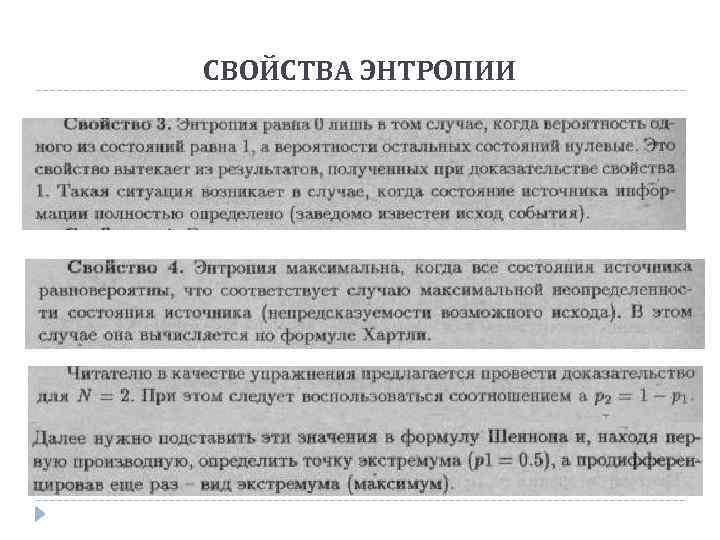

СВОЙСТВА ЭНТРОПИИ

СВОЙСТВА ЭНТРОПИИ

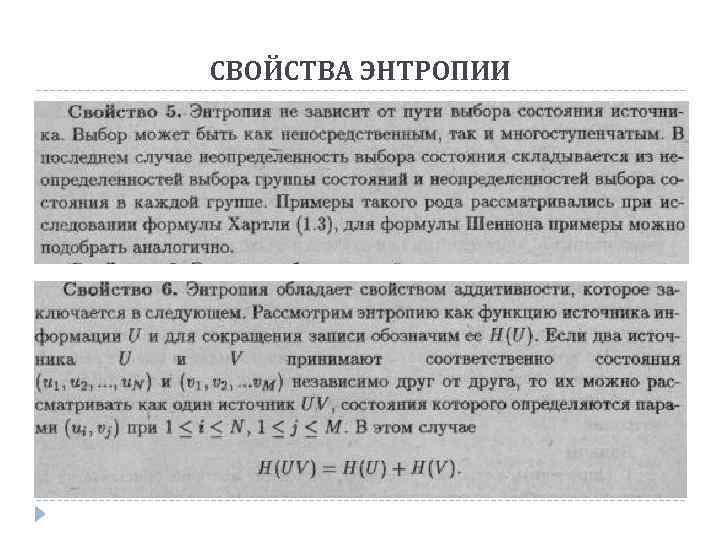

СВОЙСТВА ЭНТРОПИИ

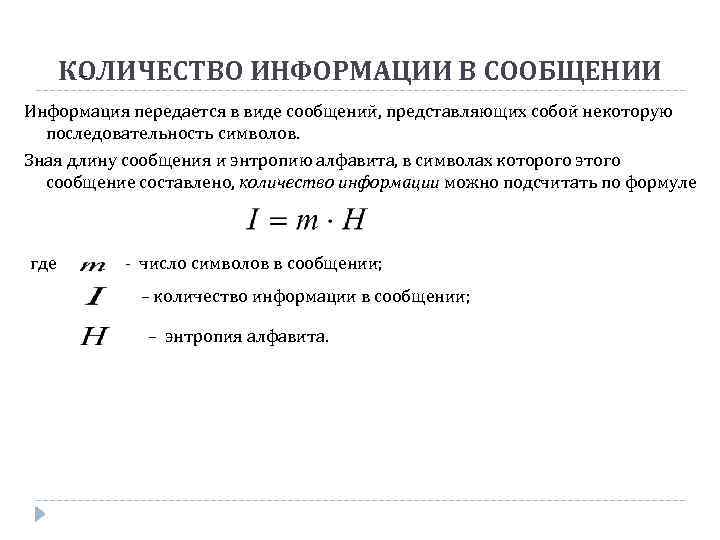

КОЛИЧЕСТВО ИНФОРМАЦИИ В СООБЩЕНИИ – Информация передается в виде сообщений, представляющих собой некоторую последовательность символов. Зная длину сообщения и энтропию алфавита, в символах которого этого сообщение составлено, количество информации можно подсчитать по формуле где - число символов в сообщении; – количество информации в сообщении; – энтропия алфавита.

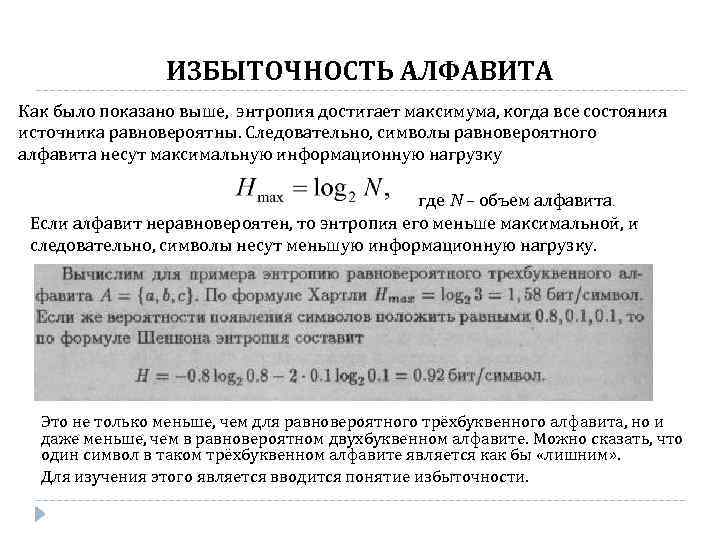

ИЗБЫТОЧНОСТЬ АЛФАВИТА Как было показано выше, энтропия достигает максимума, когда все состояния источника равновероятны. Следовательно, символы равновероятного алфавита несут максимальную информационную нагрузку где N – объем алфавита. Если алфавит неравновероятен, то энтропия его меньше максимальной, и следовательно, символы несут меньшую информационную нагрузку. Это не только меньше, чем для равновероятного трёхбуквенного алфавита, но и даже меньше, чем в равновероятном двухбуквенном алфавите. Можно сказать, что один символ в таком трёхбуквенном алфавите является как бы «лишним» . Для изучения этого является вводится понятие избыточности.

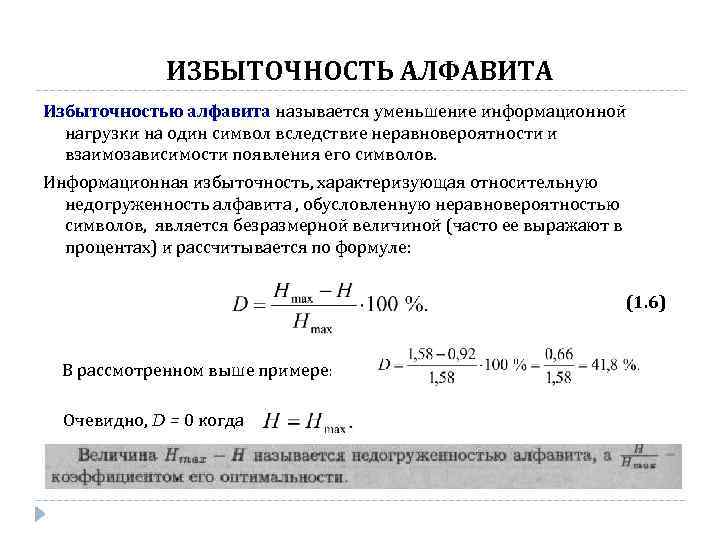

ИЗБЫТОЧНОСТЬ АЛФАВИТА Избыточностью алфавита называется уменьшение информационной нагрузки на один символ вследствие неравновероятности и взаимозависимости появления его символов. Информационная избыточность, характеризующая относительную недогруженность алфавита , обусловленную неравновероятностью символов, является безразмерной величиной (часто ее выражают в процентах) и рассчитывается по формуле: (1. 6) В рассмотренном выше примере: Очевидно, D = 0 когда

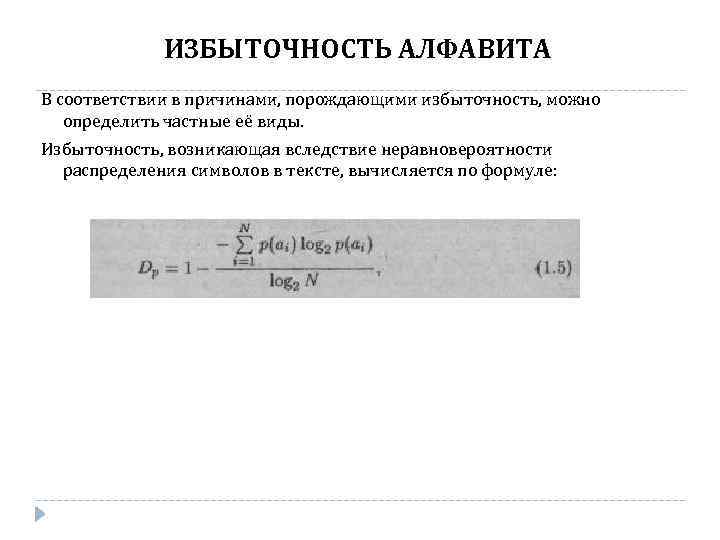

ИЗБЫТОЧНОСТЬ АЛФАВИТА В соответствии в причинами, порождающими избыточность, можно определить частные её виды. Избыточность, возникающая вследствие неравновероятности распределения символов в тексте, вычисляется по формуле:

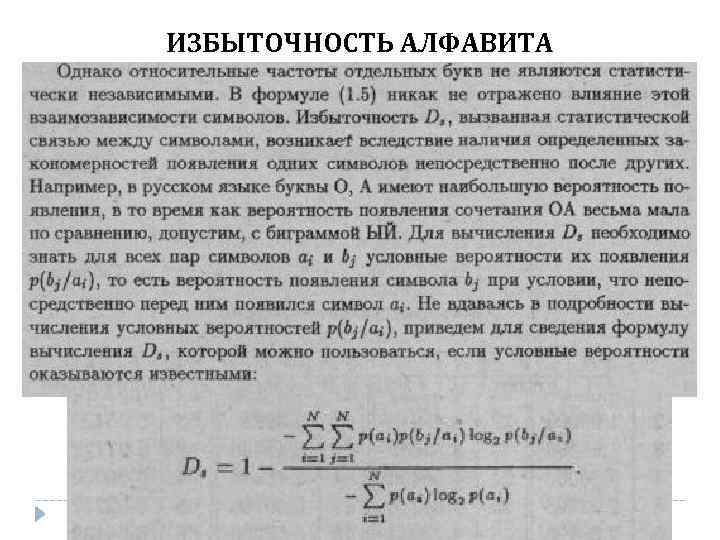

ИЗБЫТОЧНОСТЬ АЛФАВИТА

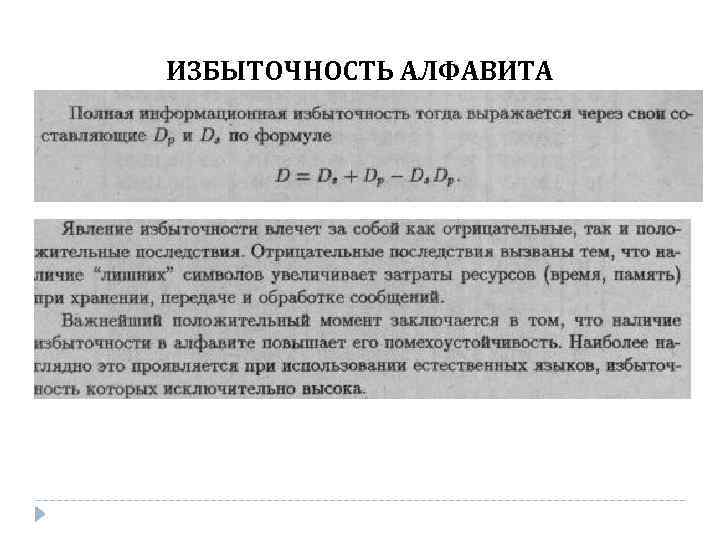

ИЗБЫТОЧНОСТЬ АЛФАВИТА

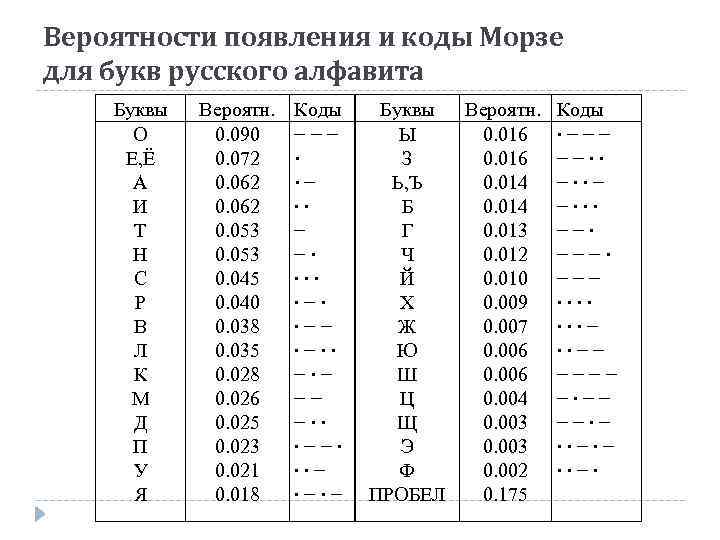

Вероятности появления и коды Морзе для букв русского алфавита Буквы О Е, Ё А И Т Н С Р В Л К М Д П У Я Вероятн. 0. 090 0. 072 0. 062 0. 053 0. 045 0. 040 0. 038 0. 035 0. 028 0. 026 0. 025 0. 023 0. 021 0. 018 Коды −−− ∙ ∙− ∙∙ − −∙ ∙∙∙ ∙−− ∙−∙∙ −∙− −− −∙∙ ∙−−∙ ∙∙− ∙−∙− Буквы Вероятн. Коды Ы 0. 016 ∙ − − − З 0. 016 − − ∙ ∙ Ь, Ъ 0. 014 − ∙ ∙ − Б 0. 014 − ∙ ∙ ∙ Г 0. 013 − − ∙ Ч 0. 012 − − − ∙ Й 0. 010 − − − Х 0. 009 ∙ ∙ Ж 0. 007 ∙ ∙ ∙ − Ю 0. 006 ∙ ∙ − − Ш 0. 006 − − Ц 0. 004 − ∙ − − Щ 0. 003 − − ∙ − Э 0. 003 ∙ ∙ − Ф 0. 002 ∙ ∙ − ∙ ПРОБЕЛ 0. 175

ИЗБЫТОЧНОСТЬ ЕСТЕСТВЕННЫХ ЯЗЫКОВ Если для упрощения расчётов считать русский алфавит состоящим из 32 букв, то максимальная информационная нагрузка составит 5 бит/символ. Если учесть частоты появления отдельных букв, то получим Н~4, 35 бит/символ Учёт относительной частоты встречаемости двух- и трёхбуквенных сочетаний снижает величину энтропии до 3, 01 бит/символ. Если рассчитать энтропию с учётом встречаемости до восьмибуквенных сочетаний, то получим 1, 19 бит/символ – меньше, чем равновероятный трёхбуквенный алфавит и немногим более равновероятного двухбуквенного алфавита! Подобная ситуация характерна и для других естественных языков. Но именно вследствие столь высокой избыточности речь остаётся понимаемой при огромном многообразии диалектов, дефектах произношения, ошибках и сокращениях слов, а также в других случаях искажений исходного сообщения. Именно поэтому в криптографии одно из ключевых требований к алгоритмам шифрования – обеспечить на выходе шифровального устройства равномерную случайную последовательность символов шифрограммы.

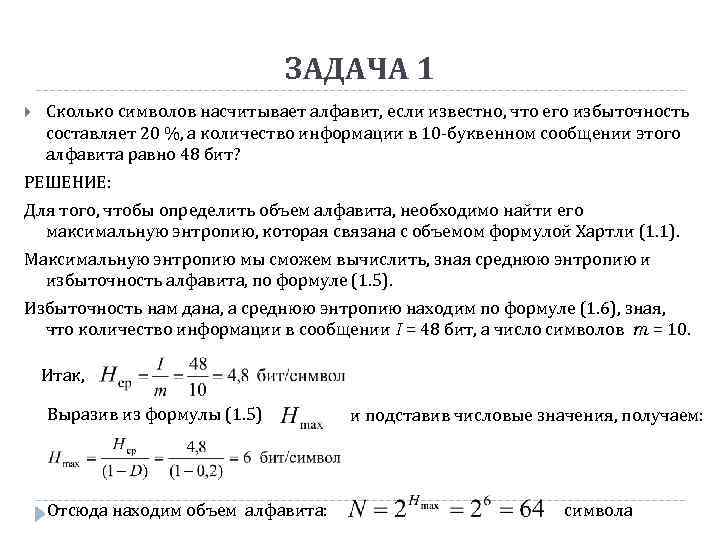

ЗАДАЧА 1 Сколько символов насчитывает алфавит, если известно, что его избыточность составляет 20 %, а количество информации в 10 -буквенном сообщении этого алфавита равно 48 бит? РЕШЕНИЕ: Для того, чтобы определить объем алфавита, необходимо найти его максимальную энтропию, которая связана с объемом формулой Хартли (1. 1). Максимальную энтропию мы сможем вычислить, зная среднюю энтропию и избыточность алфавита, по формуле (1. 5). Избыточность нам дана, а среднюю энтропию находим по формуле (1. 6), зная, что количество информации в сообщении I = 48 бит, а число символов m = 10. Итак, Выразив из формулы (1. 5) Отсюда находим объем алфавита: и подставив числовые значения, получаем: символа

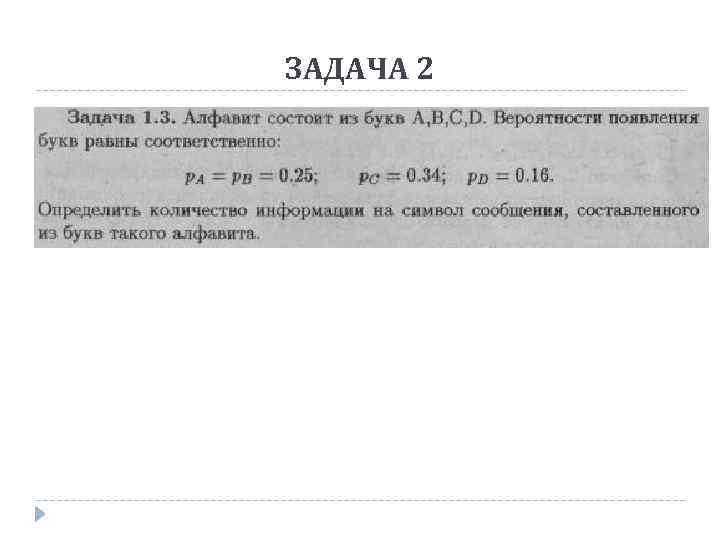

ЗАДАЧА 2

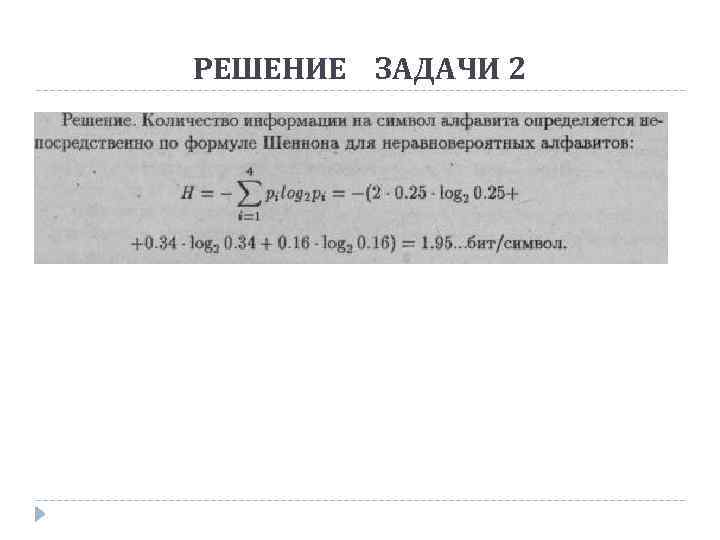

РЕШЕНИЕ ЗАДАЧИ 2

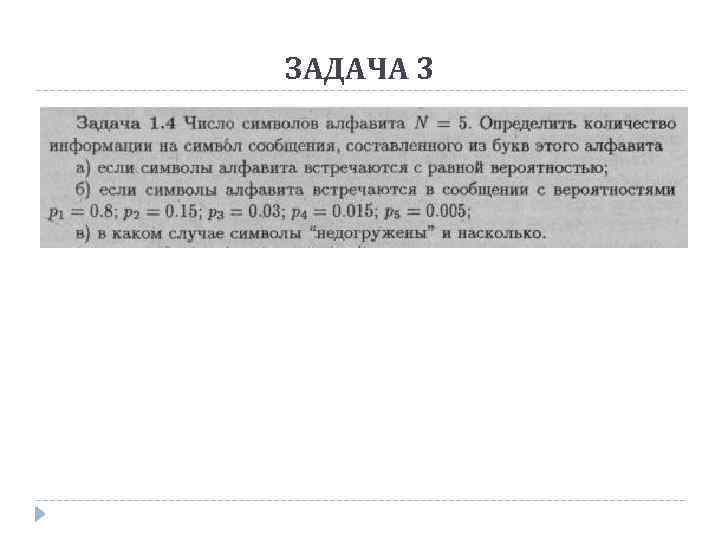

ЗАДАЧА 3

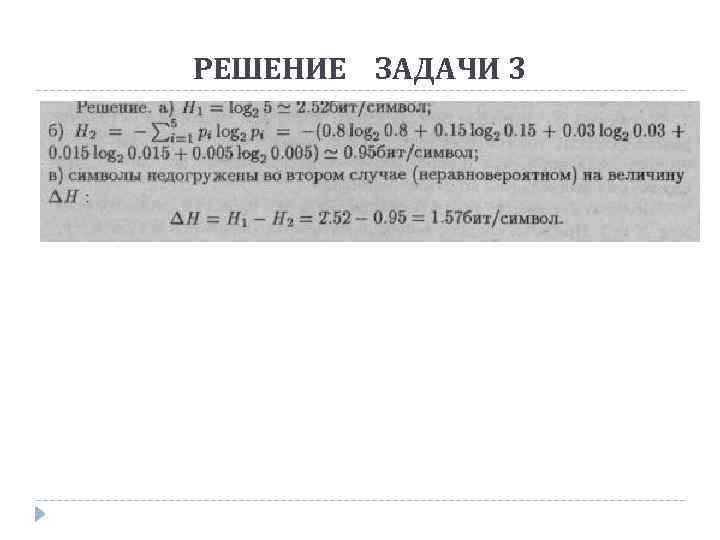

РЕШЕНИЕ ЗАДАЧИ 3

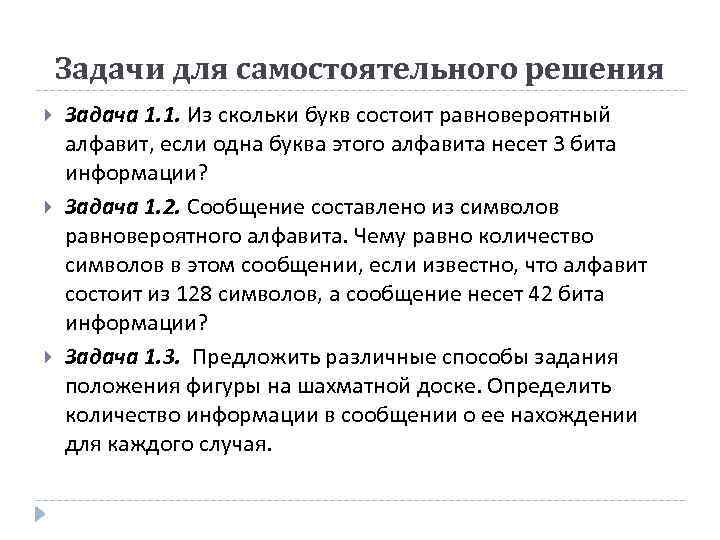

Задачи для самостоятельного решения Задача 1. 1. Из скольки букв состоит равновероятный алфавит, если одна буква этого алфавита несет 3 бита информации? Задача 1. 2. Сообщение составлено из символов равновероятного алфавита. Чему равно количество символов в этом сообщении, если известно, что алфавит состоит из 128 символов, а сообщение несет 42 бита информации? Задача 1. 3. Предложить различные способы задания положения фигуры на шахматной доске. Определить количество информации в сообщении о ее нахождении для каждого случая.

Задачи для самостоятельного решения Задача 1. 4. Алфавит состоит из трех равновероятных букв {A, B, С}. Составить максимальное число сообщений, комбинируя по две буквы. Чему равно количество информации на один символ сообщения? Чему равно количество информации в одном сообщении? Задача 1. 5. В коробке находятся шарики пяти цветов: 2 белых, 4 черных, 2 красных, 1 синий и 1 зеленый. Найти среднее количество информации в сообщении о том, какой шарик вынут из коробки.

Задачи для самостоятельного решения Задача 1. 6. Символы алфавита из 32 букв появляются на экране монитора. Половина букв алфавита появляется с одинаковой вероятностью, равной 1/64, а другая половина букв – тоже с равной вероятностью. Найти энтропию этого алфавита. Задача 1. 7. Если взять в качестве единицы измерения информации такое ее количество, которое уменьшает исходную информационную неопределенность в 10 раз, то формула для ее подсчета будет иметь вид а сама единица измерения будет называться 1 дит. Можно в качестве единицы измерения взять 1 нат и тогда в формуле количества информации используется натуральный логарифм. Найти коэффициенты перехода, позволяющие выразить в битах информацию, измеренную в натах или дитах.

Задачи для самостоятельного решения Задача 1. 9. Число символов алфавита N = 5. Определить количество информации на символ сообщения, составленного из букв этого алфавита, если: а) символы алфавита встречаются с равной вероятность; б) если p 1 = 0, 8; p 2 = 0, 15; p 3 = 0, 03; p 4 = 0, 015; p 5 = 0, 005. Насколько недогружены символы алфавита во втором случае? Задача 1. 10. Определить избыточность 8 -буквенного алфавита, если его энтропия равна 2, 7 бит/символ. Задача 1. 11. Определить количество символов в алфавите, если его энтропия 3, 2 бит/символ, а избыточность составляет 20 %.

Задача 1. 12. Сколько символов содержится в равновероятном алфавите, если в 6 -буквенном слове этого алфавита содержится 24 бита информации? Задача 1. 13. Какое количество информации содержится в черно -белом телеизображении, если экран содержит 256 линий, каждая линия содержит 512 экранных точек, а каждая точка имеет 8 градаций яркости? Задача 1. 14. Алфавит состоит из четырех букв: {а, б, в, г}. Известно, что буква "а" встречается реже всех остальных, каждая из букв "б" и "в" встречаются в два раза чаще, чем "а", буква "г" встречается так же часто, как "а" и "б", если их не отличать друг от друга. Найти энтропию данного алфавита. Задача 1. 15. Определить максимальную энтропию системы, состоящей из 6 элементов, каждый из которых может находиться в одном из 4 состояний.

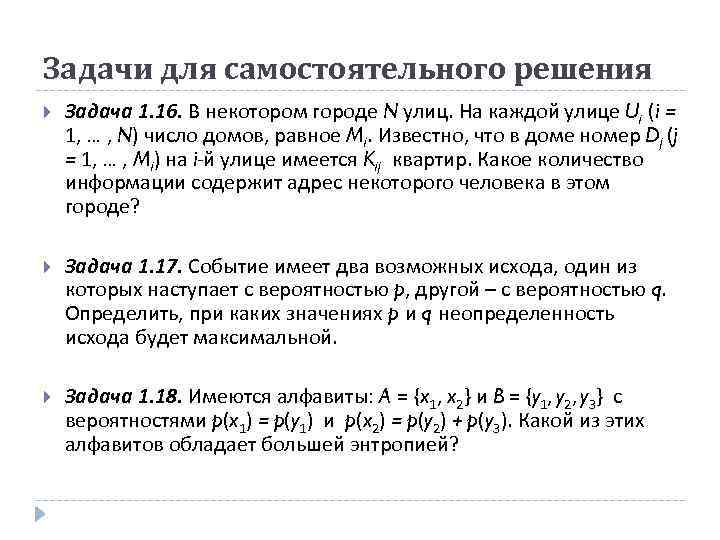

Задачи для самостоятельного решения Задача 1. 16. В некотором городе N улиц. На каждой улице Ui (i = 1, … , N) число домов, равное Mi. Известно, что в доме номер Dj (j = 1, … , Mi) на i-й улице имеется Kij квартир. Какое количество информации содержит адрес некоторого человека в этом городе? Задача 1. 17. Событие имеет два возможных исхода, один из которых наступает с вероятностью p, другой – с вероятностью q. Определить, при каких значениях p и q неопределенность исхода будет максимальной. Задача 1. 18. Имеются алфавиты: A = {x 1, x 2} и B = {y 1, y 2, y 3} с вероятностями p(x 1) = p(y 1) и p(x 2) = p(y 2) + p(y 3). Какой из этих алфавитов обладает большей энтропией?

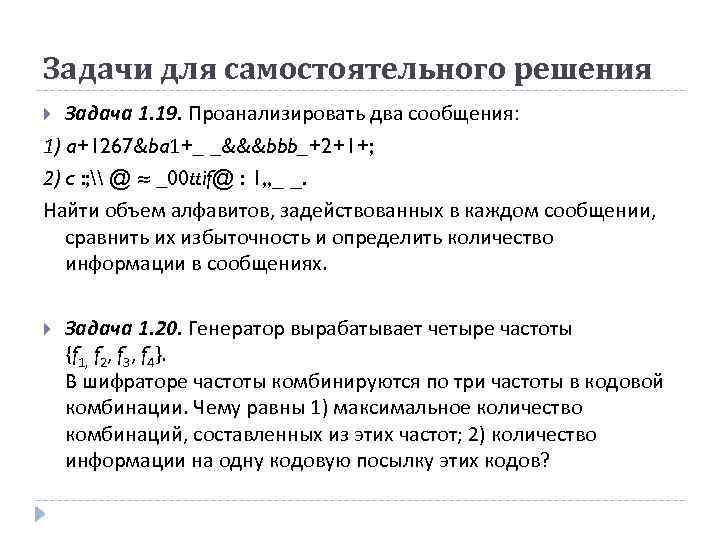

Задачи для самостоятельного решения Задача 1. 19. Проанализировать два сообщения: 1) a+1267&ba 1+_ _&&&bbb_+2+1+; 2) c : ; \ @ ≈ _00 ttif@ : 1, , _ _. Найти объем алфавитов, задействованных в каждом сообщении, сравнить их избыточность и определить количество информации в сообщениях. Задача 1. 20. Генератор вырабатывает четыре частоты {f 1, f 2, f 3, f 4}. В шифраторе частоты комбинируются по три частоты в кодовой комбинации. Чему равны 1) максимальное количество комбинаций, составленных из этих частот; 2) количество информации на одну кодовую посылку этих кодов?

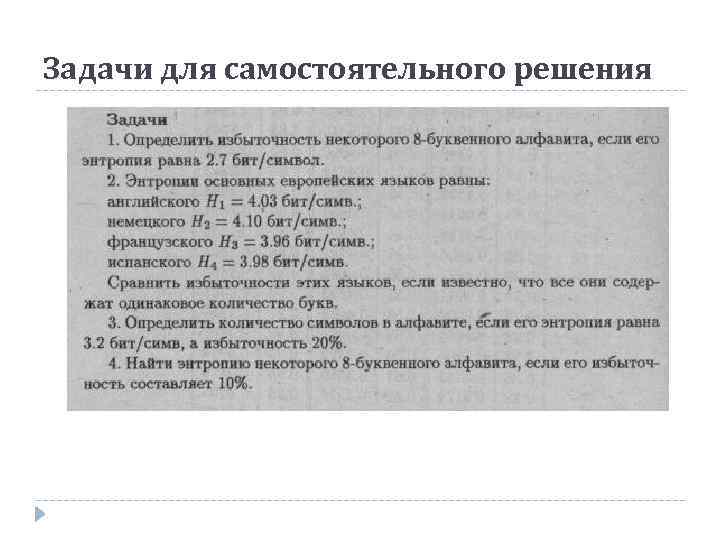

Задачи для самостоятельного решения

Теория информации.pptx