Корреляционный и регрессионный анализ.ppt

- Количество слайдов: 76

Направлены на изучение закономерностей массовых общественных явлений. Исходными являются положения о том, что: эти явления складываются под влиянием множества причин, эти причины действуют одновременно и взаимосвязано.

1. Функциональная 2. Корреляционная

Каждому значению одной переменной всегда соответствует одно определенное значение другой переменной. Например, X – длина уложенного ж/д пути; Y – количество рельсового проката, необходимого для строительства. x 0 1 2 3 4 5 y 0 100 200 300 400 500 Ее аналитическим выражением является уравнение y=kx, где k – коэффициент пропорциональности (в нашем случае k=100).

частный случай линейной зависимости, которая характеризуется уравнением: y=kx+b, которая также имеет вид прямой линии k характеризует наклон линии и показывает, насколько изменяется значение зависимой переменной y при изменении независимой переменной x на единицу; b - координата точки пересечения линии с осью Y; она показывает каково значение зависимой переменной, когда независимая равняется нулю.

Линейная зависимость является наиболее простой формой связи многих явлений. Однако в общественных явлениях такая зависимость встречается довольно редко. Здесь связи носят более сложный характер. Описать всю эту сложность на языке статистики бывает довольно сложно, поэтому там, где это возможно, ограничиваются простейшей линейной зависимостью, в том числе в корреляционном и регрессионном анализе. Если имеются веские основания против линейной связи, используют более сложные функциональные зависимости (некоторые из них: парабола, гипербола, логарифмические и экспоненциальные зависимости).

одному и тому же значению одного признака могут соответствовать различные значения другого. Это происходит в силу того, что при корреляционной зависимости связь устанавливается между признаками (двумя, тремя и т. д. ), которые изменяются не только в силу взаимодействия между собой (как в функциональной зависимости), но и под воздействием множества различных неучтенных факторов (т. е. корреляционная зависимость носит вероятностный характер). При этом связь между признаками в корреляционном анализе существует и проявляется не в каждом отдельном случае, как при функциональной связи, а только в тенденции, «в среднем» . Поэтому установить наличие взаимосвязи в такой ситуации можно лишь применительно к совокупности объектов.

1. 2. 3. существует ли взаимосвязь между признаками; какова форма этой связи (регрессионный анализ); какова сила (теснота) этой связи (корреляционный анализ)?

Степень сопряженности между двумя явлениями. Связь считается более тесной в том случае, если каждому значению одного признака соответствуют близкие другу (тесно расположенные около своей условно средней) величины значений другого признака. Основной Основной Основной Связь считается менее тесной, если наблюдается большой разброс значений вокруг условных средних величин зависимого признака. Основной Основной

При прямой связи (знак +) с увеличением (уменьшением) значений одного признака значения другого признака также возрастают (или убывают); При обратной связи (знак -) увеличение или уменьшение одного признака сопровождается противоположным по направлению изменением другого признака.

связь между двумя признаками При этом предполагается, что взаимосвязь двух переменных носит, как правило, причинный характер т. е. одна из них зависит от другой. Первая (зависимая) называется в регрессионном анализе результирующей, вторая (независимая) - факторной. Не всегда можно однозначно определить, какая из двух переменных является независимой, а какая - зависимой. Для определения этого необходимо провести содержательный анализ.

Рассмотрим данные по материалам Всероссийских промышленных переписей 1900 и 1908 гг. Дано: объем производства в денежном исчислении, тыс. руб. число занятых на предприятии рабочих, чел. суммарная мощность установленных двигателей, в л. с. Можно поставить вопрос: зависел ли доход предприятия от числа рабочих и мощности двигателей и если зависел (что понятно и без статистического анализа), то от какого из двух признаков он зависел больше (т. е. экстенсивный или интенсивный характер носило производство)? Далее можно выяснить, как отличались эти зависимости в разных отраслях промышленности, т. е. в каких отраслях промышленности труд рабочих и использование машин давало больший экономический эффект (больший доход).

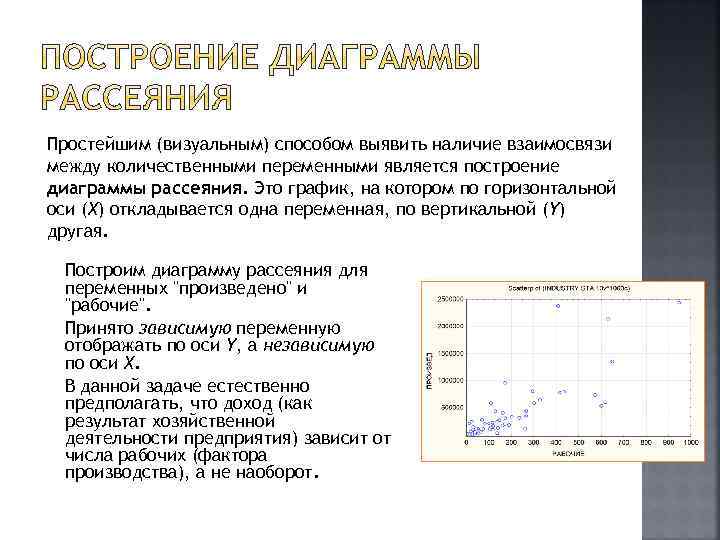

Простейшим (визуальным) способом выявить наличие взаимосвязи между количественными переменными является построение диаграммы рассеяния. Это график, на котором по горизонтальной оси (X) откладывается одна переменная, по вертикальной (Y) другая. Построим диаграмму рассеяния для переменных "произведено" и "рабочие". Принято зависимую переменную отображать по оси Y, а независимую по оси X. В данной задаче естественно предполагать, что доход (как результат хозяйственной деятельности предприятия) зависит от числа рабочих (фактора производства), а не наоборот.

мы видим "облако" точек, о котором можно сказать, что оно вытянуто по диагонали от левого нижнего угла к правому верхнему, т. е. в среднем доход растет с увеличением числа рабочих. По своему направлению такая связь называется положительной. В более сложных случаях заранее ничего нельзя сказать о характере зависимости, и диаграмма рассеяния может дать необходимую информацию. Если точки оказываются хаотически рассеянными на диаграмме, т. е. их координаты представляют собой случайные пары чисел, то зависимости между переменными, видимо, не существует.

Попробуем провести прямую линию через каждое облако точек на рисунке. Таких линий можно нарисовать множество, причем на глаз невозможно определить, какая из них лучше подходит для описания диаграммы рассеяния точек. Существует, однако, метод, который позволяет совершенно точно вычислить положение прямой линии, наилучшим образом проходящее через облако точек. Это - метод наименьших квадратов. Вычисляемая с его помощью линия называется линией регрессии. Она характеризуется тем, что сумма квадратов расстояний от точек на диаграмме до этой линии минимальна (по сравнению со всеми возможными линиями).

Пусть имеются данные о сборе хлеба на душу населения. От каких факторов зависит величина этого сбора? Видимо, определяющее значение здесь должны иметь величина посева и уровень урожайности.

Рассмотрим сначала зависимость сбора хлеба на душу населения и размера посева на душу. Y-величина сбора хлеба на душу (результативный). X- величина посева на душу (факторный). Попытаемся представить эту зависимость в виде линии регрессии. Основной Основной

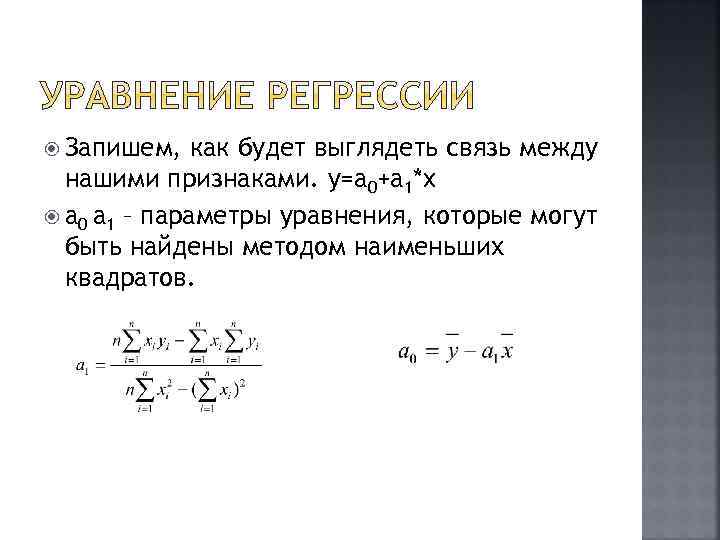

Запишем, как будет выглядеть связь между нашими признаками. y=a 0+a 1*x a 0 a 1 – параметры уравнения, которые могут быть найдены методом наименьших квадратов.

Y= 17, 76+24, 50 x Коэффициент при x называется коэффициентом регрессии. Он показывает, на какую величину в среднем изменяется результативный признак y при изменении факторного признака x на единицу. В нашем примере коэффициент регрессии получился равным 24, 50, следовательно, с увеличением посева, приходящегося на душу, на одну десятину сбор хлеба на душу населения в среднем увеличивается на 24, 50 пуда.

Коэффициент корреляции (=коэффициент Пирсона=коэффициент произведения моментов r) есть мера тесноты связи двух признаков в случае линейной зависимости между ними. Коэффициент регрессии и коэффициент корреляции целесообразно вычислять лишь в том случае, когда зависимость между переменными может хотя бы приближенно считаться линейной. В противном случае результаты могут быть совершенно неверными, в частности коэффициент корреляции может оказаться близким к нулю при наличии сильной взаимосвязи.

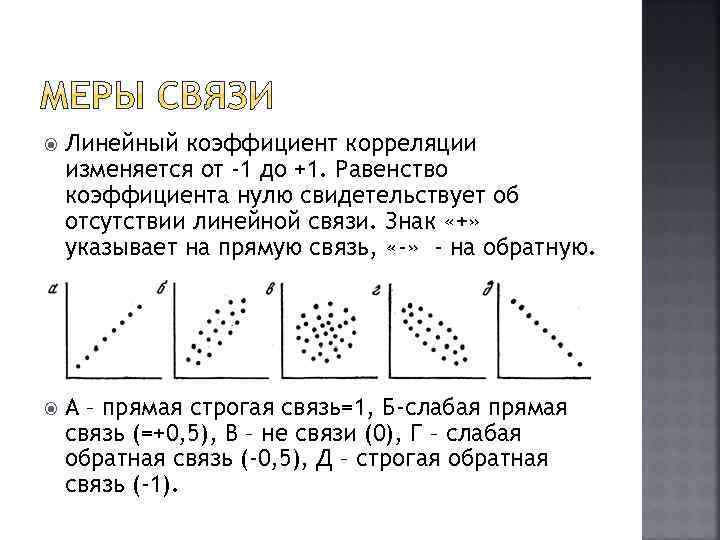

Линейный коэффициент корреляции изменяется от -1 до +1. Равенство коэффициента нулю свидетельствует об отсутствии линейной связи. Знак «+» указывает на прямую связь, «-» - на обратную. А – прямая строгая связь=1, Б-слабая прямая связь (=+0, 5), В – не связи (0), Г – слабая обратная связь (-0, 5), Д – строгая обратная связь (-1).

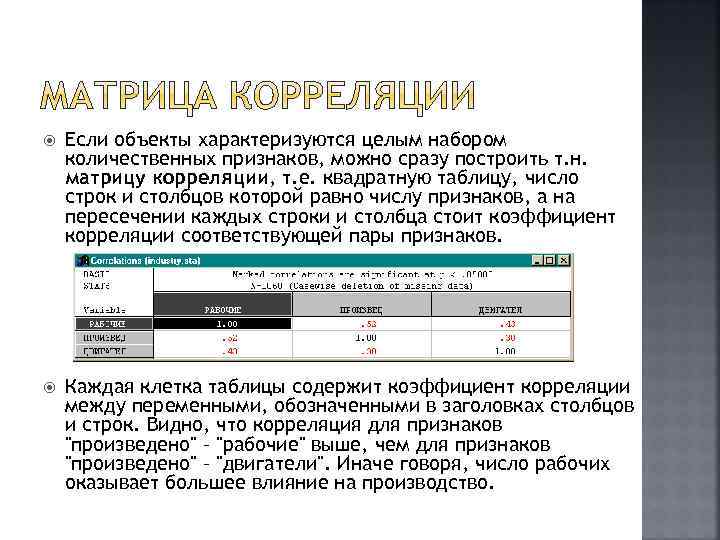

Если объекты характеризуются целым набором количественных признаков, можно сразу построить т. н. матрицу корреляции, т. е. квадратную таблицу, число строк и столбцов которой равно числу признаков, а на пересечении каждых строки и столбца стоит коэффициент корреляции соответствующей пары признаков. Каждая клетка таблицы содержит коэффициент корреляции между переменными, обозначенными в заголовках столбцов и строк. Видно, что корреляция для признаков "произведено" – "рабочие" выше, чем для признаков "произведено" – "двигатели". Иначе говоря, число рабочих оказывает большее влияние на производство.

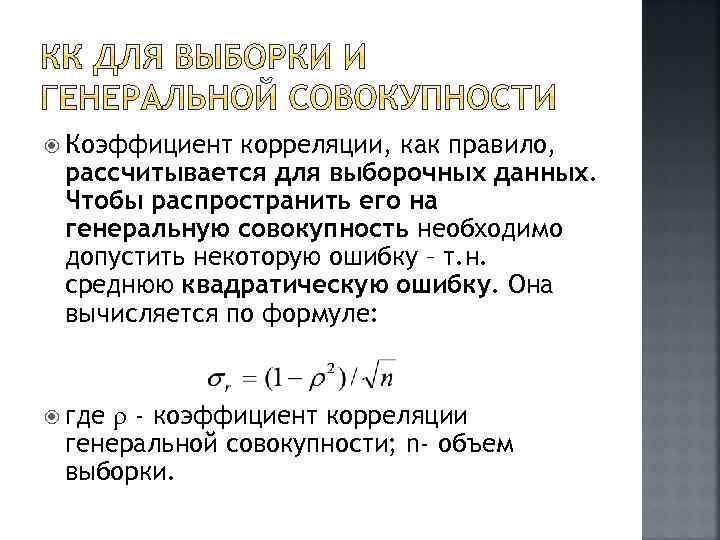

Коэффициент корреляции, как правило, рассчитывается для выборочных данных. Чтобы распространить его на генеральную совокупность необходимо допустить некоторую ошибку – т. н. среднюю квадратическую ошибку. Она вычисляется по формуле: - коэффициент корреляции генеральной совокупности; n- объем выборки. где

Как оценить полученное значение коэффициента корреляции? О наличии или об отсутствии связи свидетельствует? Коэффициент ничего не говорит о причинноследственных связях. Он показывает только тесноту связи. Если между x и y установлена связь, то здесь возможны три взаимоотношения: 1. x - причина y; 2. y – причина x; 3. xy – следствия причины z. Велико оно (значение коэффициента) или мало? Для ответа на этот вопрос проводят проверку значимости коэффициента.

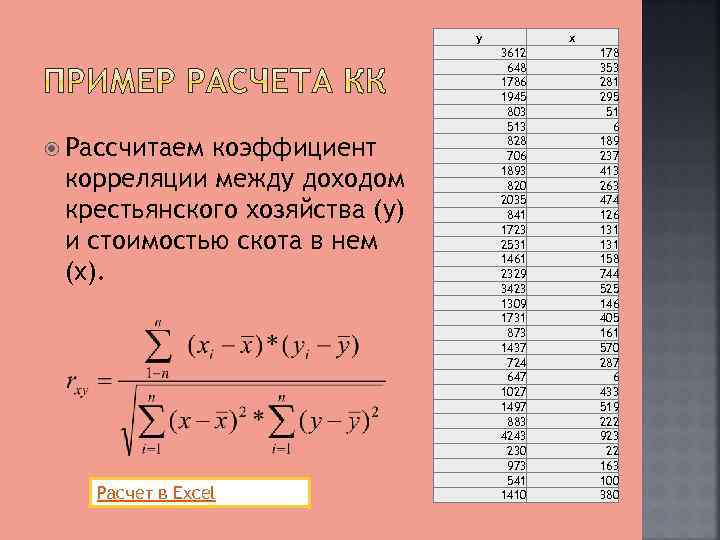

y Рассчитаем коэффициент корреляции между доходом крестьянского хозяйства (y) и стоимостью скота в нем (x). Расчет в Excel x 3612 648 1786 1945 803 513 828 706 1893 820 2035 841 1723 2531 1461 2329 3423 1309 1731 873 1437 724 647 1027 1497 883 4243 230 973 541 1410 178 353 281 295 51 6 189 237 413 263 474 126 131 158 744 525 146 405 161 570 287 6 433 519 222 923 22 163 100 380

Если признаки x и y распределены по нормальному закону, то в достаточно больших выборках коэффициенты корреляции можно считать распределенными нормально. Этот факт используется для проверки значимости выборочных коэффициентов корреляции: т. е. могло ли данное значение КК получиться в выборке из некоррелированной генеральной совокупности в силу простой случайности.

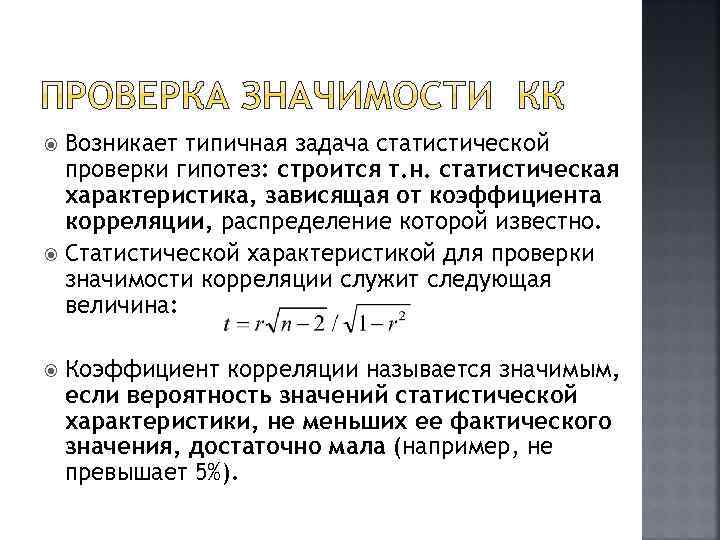

Возникает типичная задача статистической проверки гипотез: строится т. н. статистическая характеристика, зависящая от коэффициента корреляции, распределение которой известно. Статистической характеристикой для проверки значимости корреляции служит следующая величина: Коэффициент корреляции называется значимым, если вероятность значений статистической характеристики, не меньших ее фактического значения, достаточно мала (например, не превышает 5%).

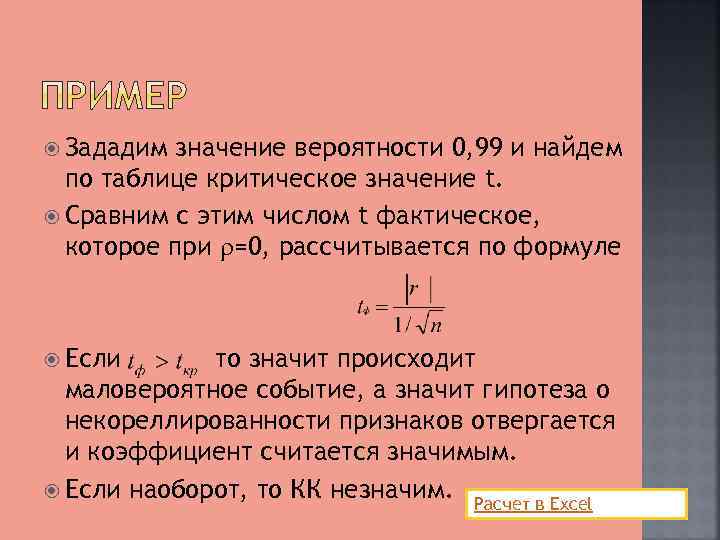

Зададим значение вероятности 0, 99 и найдем по таблице критическое значение t. Сравним с этим числом t фактическое, которое при =0, рассчитывается по формуле Если то значит происходит маловероятное событие, а значит гипотеза о некореллированности признаков отвергается и коэффициент считается значимым. Если наоборот, то КК незначим. Расчет в Excel

Итак, коэффициент корреляции не является сам по себе "большим" или "маленьким"; Стоит его принимать во внимание или нет – зависит от не только от его величины, но и от уровня значимости. Относительно большой коэффициент может оказаться незначимым при малом объеме данных, а малый коэффициент может указывать хотя и на слабую, но достоверную связь, пренебрегать которой не следует.

Линейный коэффициент корреляции дает ответ на этот вопрос, но только в том случае, если коэффициент вычислен для генеральной совокупности. Для выборочной совокупности необходимо выявить те границы, в пределах которых находится значение коэффициента корреляции генеральной совокупности, т. е. определить для него доверительный интервал.

Шаг. 1 Определяется уровень вероятности. Шаг 2. По таблице находят коэффициент t Шаг 3. Находят верхнюю границу интервала путем прибавления к выборочному коэффициенту корреляции величины tσr Шаг 4. Находят нижнюю границу интервала путем вычитания от выборочного коэффициента корреляции величины tσr В формуле по вычислению средней квадратической ошибки генеральный коэффициент корреляции заменяют на выборочный.

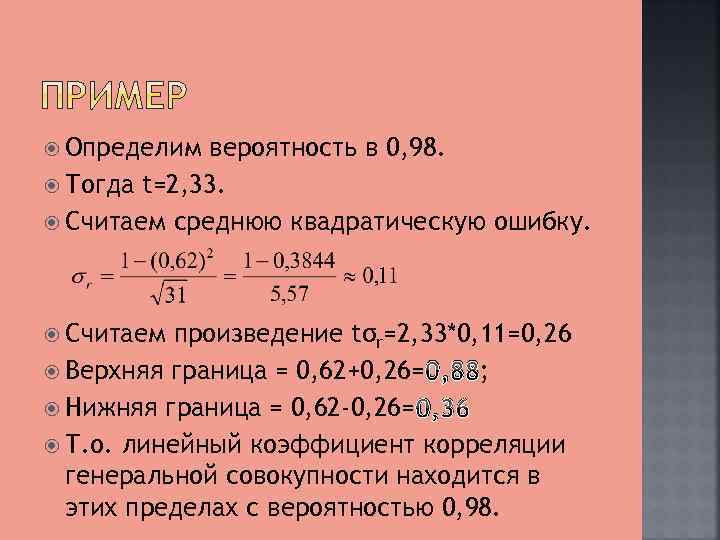

Определим вероятность в 0, 98. Тогда t=2, 33. Считаем среднюю квадратическую ошибку. Считаем произведение tσr=2, 33*0, 11=0, 26 Верхняя граница = 0, 62+0, 26= 0, 88; Нижняя граница = 0, 62 -0, 26= 0, 36 Т. о. линейный коэффициент корреляции генеральной совокупности находится в этих пределах с вероятностью 0, 98.

это показатель того, насколько изменения зависимого признака объясняются изменениями независимого. Более точно, это доля дисперсии независимого признака, объясняемая влиянием зависимого.

Если две переменные функционально линейно зависимы (точки на диаграмме рассеяния лежат на одной прямой), то можно сказать, что изменение переменной y полностью объясняется изменением переменной x, а это как раз тот случай, когда коэффициент детерминации равен единице (при этом коэффициент корреляции может быть равен как 1, так и -1). Если две переменные линейно независимы, то переменная y своими вариациями никоим образом "не обязана" переменной x – в этом случае коэффициент детерминации равен нулю. В промежуточных случаях коэффициент детерминации указывает, какая часть изменений переменной y объясняется изменением переменной x (в %).

Коэффициент корреляции между объемом производства и числом рабочих r 1 = 0. 52, а между объемом производства и мощностью двигателей r 2 = 0. 30. Возведя r 1 и r 2 в квадрат, мы получим R 12 = 0. 27 и R 22 = 0. 09. Таким образом, в целом по предприятиям доход предприятий почти на треть (0, 27) определяется числом рабочих и лишь на девять процентов (0, 09) – энерговооруженностью.

С помощью парного линейного коэффициента корреляции выявляется связь между двумя признаками. Но в действительности на результат воздействуют несколько факторов. Возникают два типа задач: 1. задачи измерения комплексного влияния на результативную переменную нескольких переменных (МКК); 2. задачи определения тесноты связи между двумя переменными при фиксированных значениях других переменных (ЧКК).

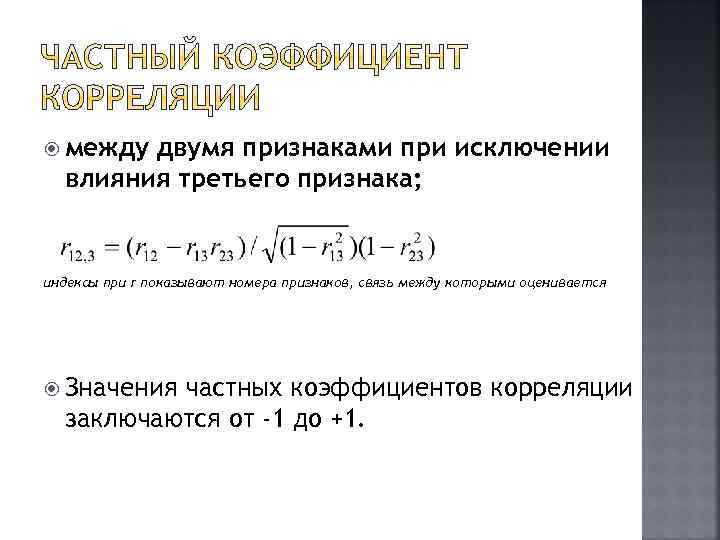

между двумя признаками при исключении влияния третьего признака; индексы при r показывают номера признаков, связь между которыми оценивается Значения частных коэффициентов корреляции заключаются от -1 до +1.

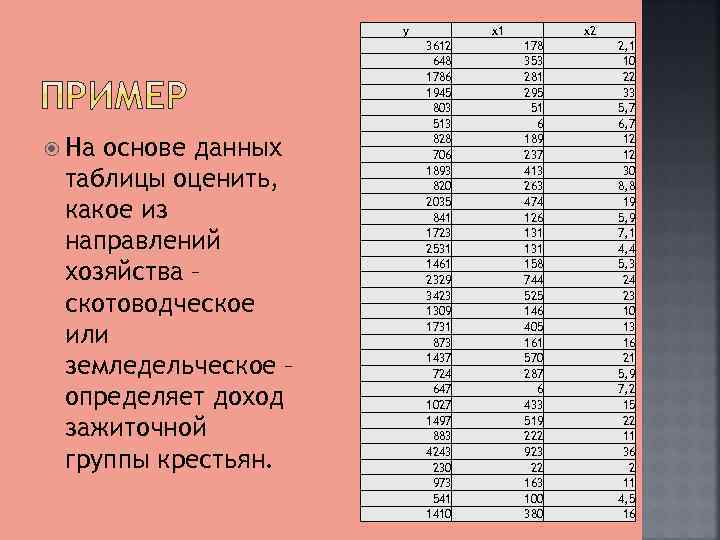

y На основе данных таблицы оценить, какое из направлений хозяйства – скотоводческое или земледельческое – определяет доход зажиточной группы крестьян. x 1 3612 648 1786 1945 803 513 828 706 1893 820 2035 841 1723 2531 1461 2329 3423 1309 1731 873 1437 724 647 1027 1497 883 4243 230 973 541 1410 x 2 178 353 281 295 51 6 189 237 413 263 474 126 131 158 744 525 146 405 161 570 287 6 433 519 222 923 22 163 100 380 2, 1 10 22 33 5, 7 6, 7 12 12 30 8, 8 19 5, 9 7, 1 4, 4 5, 3 24 23 10 13 16 21 5, 9 7, 2 15 22 11 36 2 11 4, 5 16

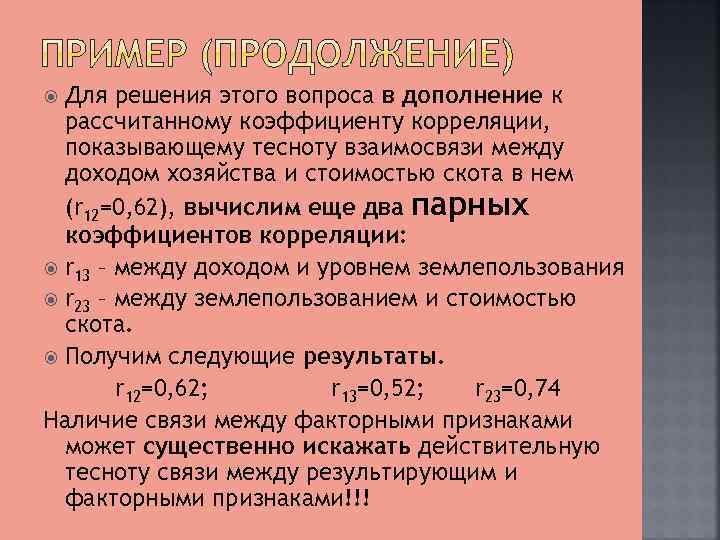

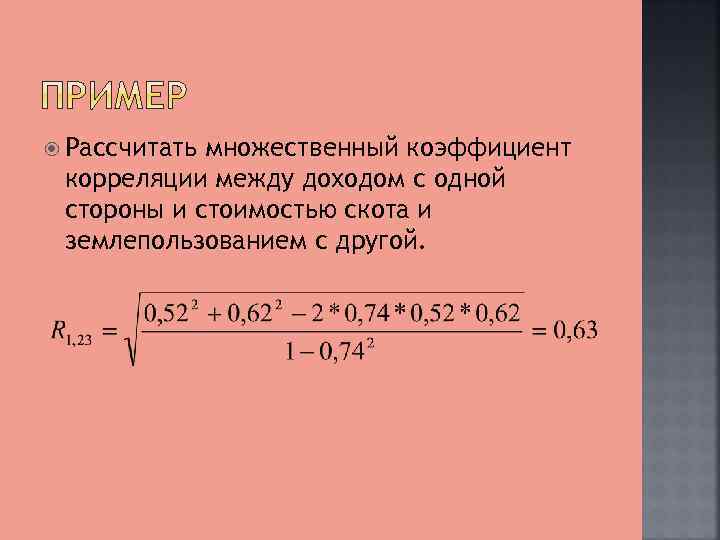

Для решения этого вопроса в дополнение к рассчитанному коэффициенту корреляции, показывающему тесноту взаимосвязи между доходом хозяйства и стоимостью скота в нем (r 12=0, 62), вычислим еще два парных коэффициентов корреляции: r 13 – между доходом и уровнем землепользования r 23 – между землепользованием и стоимостью скота. Получим следующие результаты. r 12=0, 62; r 13=0, 52; r 23=0, 74 Наличие связи между факторными признаками может существенно искажать действительную тесноту связи между результирующим и факторными признаками!!!

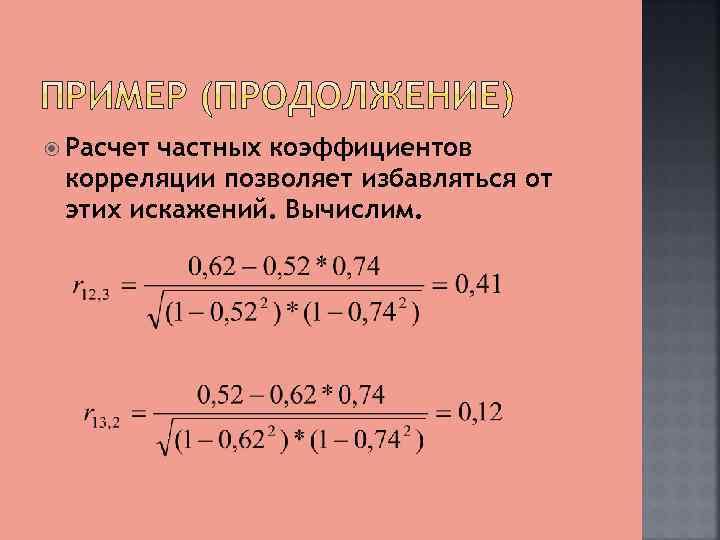

Расчет частных коэффициентов корреляции позволяет избавляться от этих искажений. Вычислим.

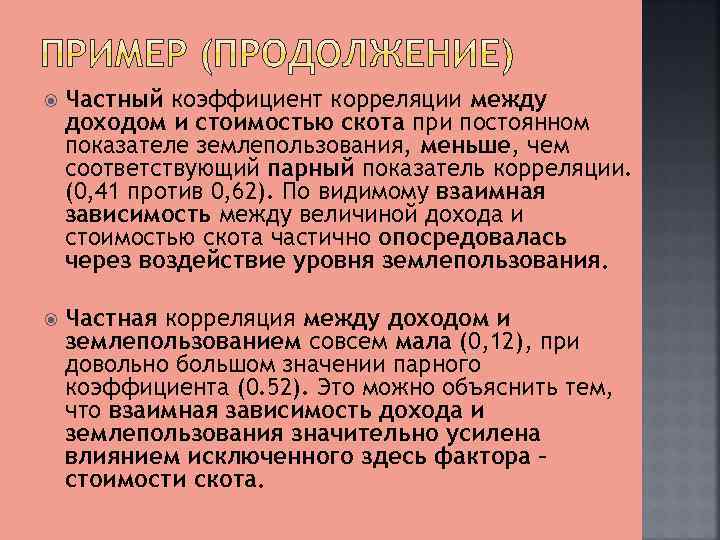

Частный коэффициент корреляции между доходом и стоимостью скота при постоянном показателе землепользования, меньше, чем соответствующий парный показатель корреляции. (0, 41 против 0, 62). По видимому взаимная зависимость между величиной дохода и стоимостью скота частично опосредовалась через воздействие уровня землепользования. Частная корреляция между доходом и землепользованием совсем мала (0, 12), при довольно большом значении парного коэффициента (0. 52). Это можно объяснить тем, что взаимная зависимость дохода и землепользования значительно усилена влиянием исключенного здесь фактора – стоимости скота.

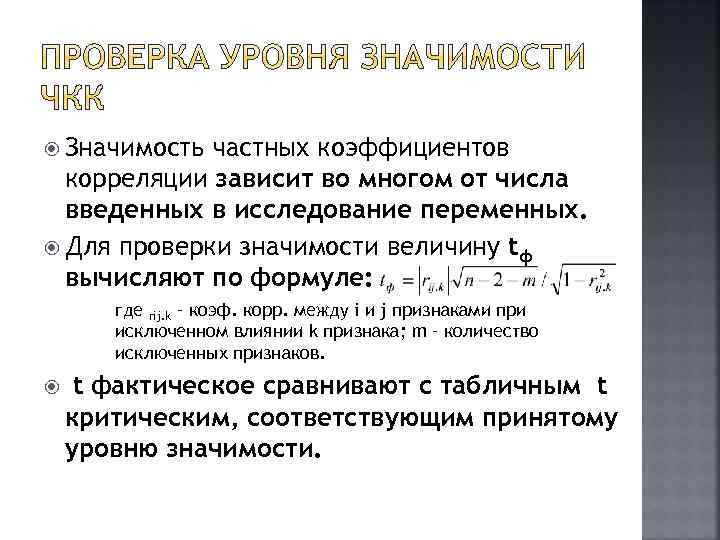

Значимость частных коэффициентов корреляции зависит во многом от числа введенных в исследование переменных. Для проверки значимости величину tф вычисляют по формуле: где rij. k – коэф. корр. между i и j признаками при исключенном влиянии k признака; m – количество исключенных признаков. t фактическое сравнивают с табличным t критическим, соответствующим принятому уровню значимости.

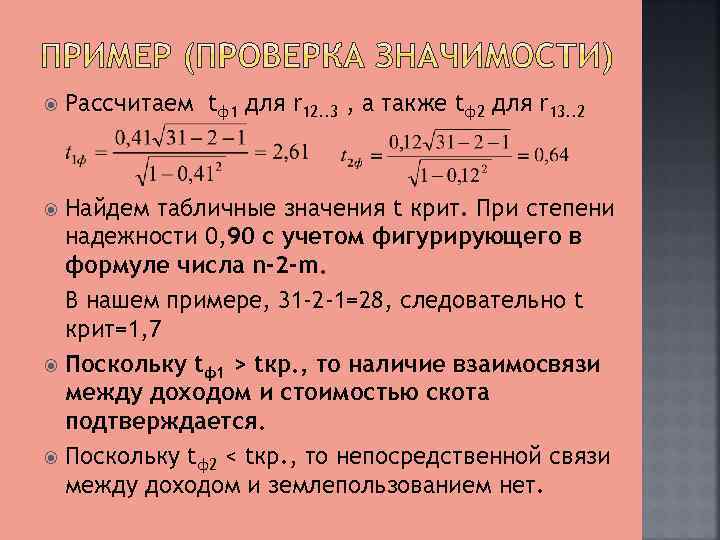

Рассчитаем tф1 для r 12. . 3 , а также tф2 для r 13. . 2 Найдем табличные значения t крит. При степени надежности 0, 90 с учетом фигурирующего в формуле числа n-2 -m. В нашем примере, 31 -2 -1=28, следовательно t крит=1, 7 Поскольку tф1 > tкр. , то наличие взаимосвязи между доходом и стоимостью скота подтверждается. Поскольку tф2 < tкр. , то непосредственной связи между доходом и землепользованием нет.

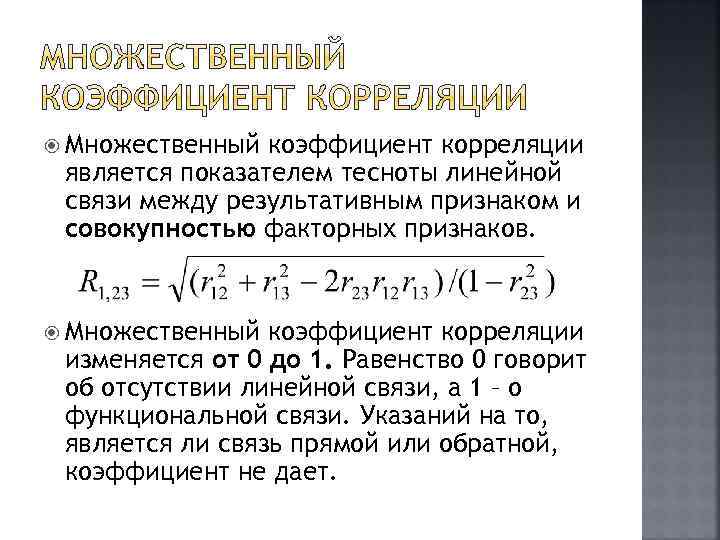

Множественный коэффициент корреляции является показателем тесноты линейной связи между результативным признаком и совокупностью факторных признаков. Множественный коэффициент корреляции изменяется от 0 до 1. Равенство 0 говорит об отсутствии линейной связи, а 1 – о функциональной связи. Указаний на то, является ли связь прямой или обратной, коэффициент не дает.

Рассчитать множественный коэффициент корреляции между доходом с одной стороны и стоимостью скота и землепользованием с другой.

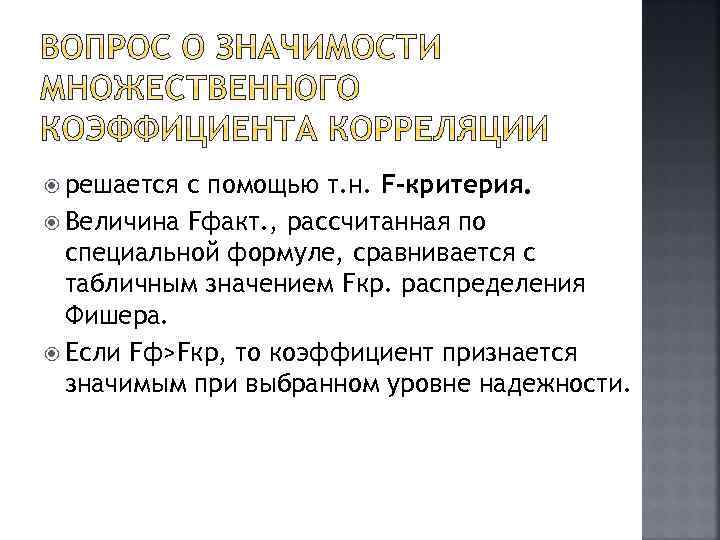

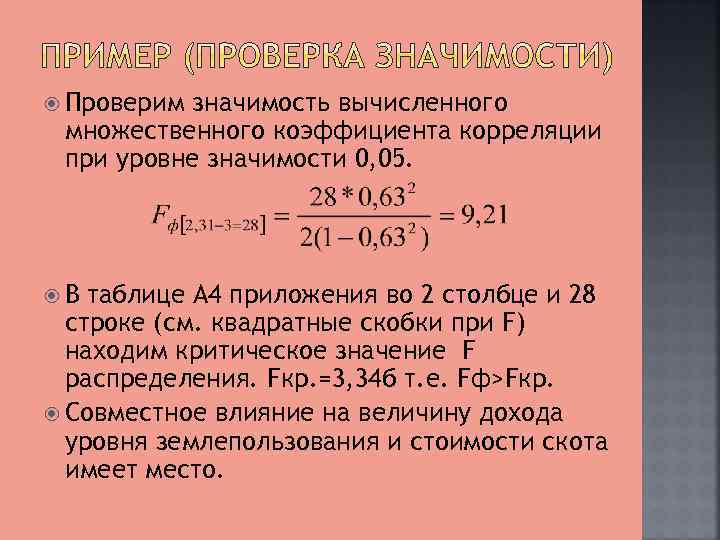

решается с помощью т. н. F-критерия. Величина Fфакт. , рассчитанная по специальной формуле, сравнивается с табличным значением Fкр. распределения Фишера. Если Fф>Fкр, то коэффициент признается значимым при выбранном уровне надежности.

Проверим значимость вычисленного множественного коэффициента корреляции при уровне значимости 0, 05. В таблице А 4 приложения во 2 столбце и 28 строке (см. квадратные скобки при F) находим критическое значение F распределения. Fкр. =3, 34 б т. е. Fф>Fкр. Совместное влияние на величину дохода уровня землепользования и стоимости скота имеет место.

http: //hist. ctl. cc. rsu. ru/KM/

мера, отражающая степень влияния факторного признака на результативный. Пример: Оценить степень зависимости благосостояния дворян (количество крепостных) и срока дворянской службы (возраст ухода в отставку). Возраст ухода в отставку Середина интервала Количество крепостных крестьян (x) от 0 до 29 30 -99 свыше 800 100 -799 25 -34 30 5 1 4 2 12 35 -44 40 6 10 3 1 20 45 -54 50 5 0 2 0 7 55 -65 60 2 1 0 0 3 18 12 9 3 42 На 54

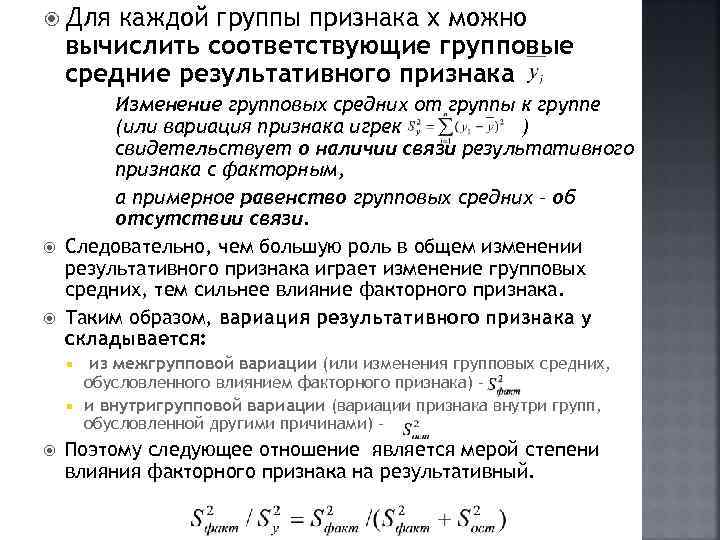

Для каждой группы признака x можно вычислить соответствующие групповые средние результативного признака Изменение групповых средних от группы к группе (или вариация признака игрек ) свидетельствует о наличии связи результативного признака с факторным, а примерное равенство групповых средних – об отсутствии связи. Следовательно, чем большую роль в общем изменении результативного признака играет изменение групповых средних, тем сильнее влияние факторного признака. Таким образом, вариация результативного признака у складывается: из межгрупповой вариации (или изменения групповых средних, обусловленного влиянием факторного признака) и внутригрупповой вариации (вариации признака внутри групп, обусловленной другими причинами) Поэтому следующее отношение является мерой степени влияния факторного признака на результативный.

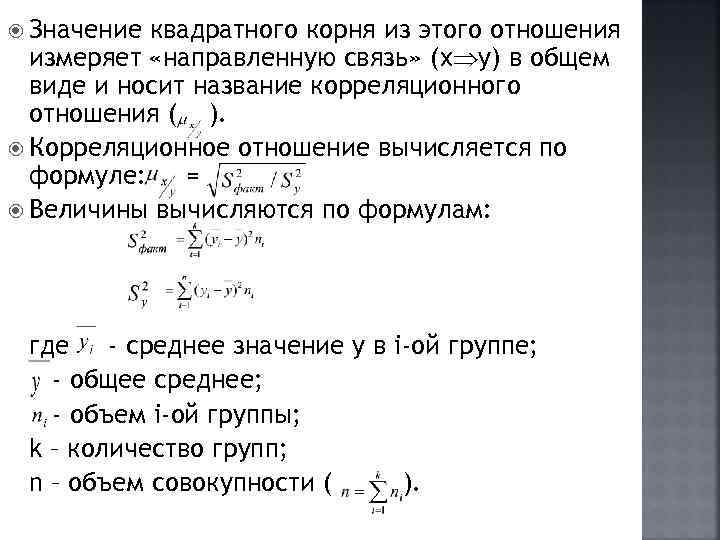

Значение квадратного корня из этого отношения измеряет «направленную связь» (x y) в общем виде и носит название корреляционного отношения ( ). Корреляционное отношение вычисляется по формуле: = Величины вычисляются по формулам: где - среднее значение y в i-ой группе; - общее среднее; - объем i-ой группы; k – количество групп; n – объем совокупности ( ).

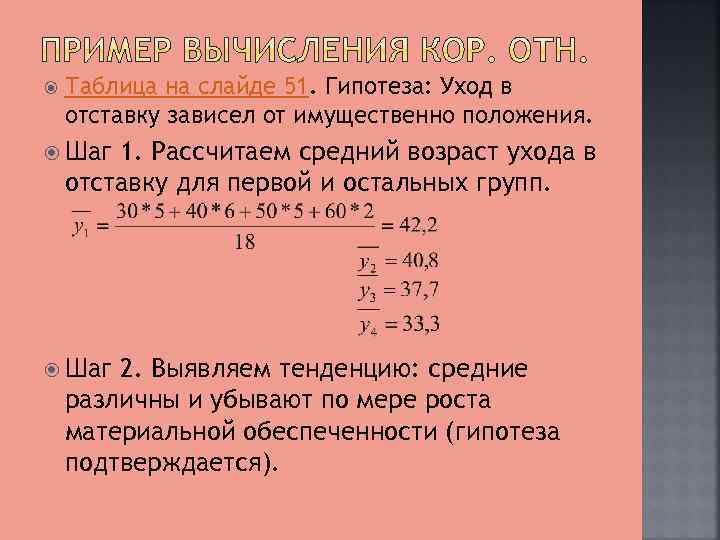

Таблица на слайде 51. Гипотеза: Уход в отставку зависел от имущественно положения. Шаг 1. Рассчитаем средний возраст ухода в отставку для первой и остальных групп. Шаг 2. Выявляем тенденцию: средние различны и убывают по мере роста материальной обеспеченности (гипотеза подтверждается).

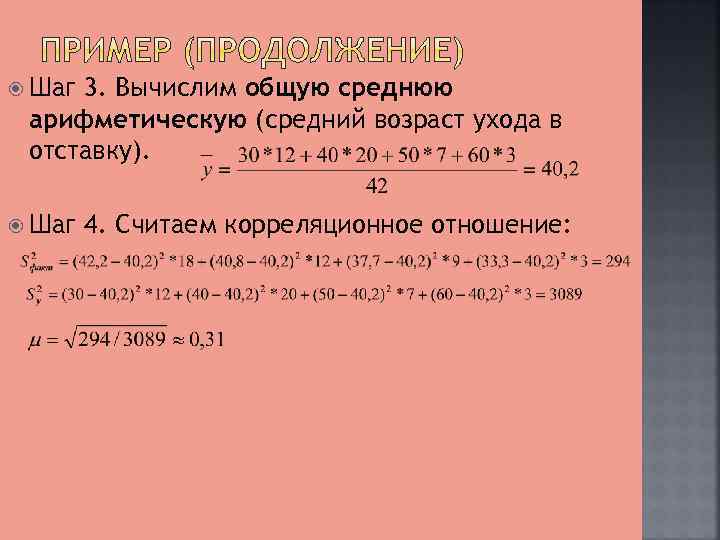

Шаг 3. Вычислим общую среднюю арифметическую (средний возраст ухода в отставку). Шаг 4. Считаем корреляционное отношение:

Величина корреляционного отношения изменяется от 0 до 1. Близость к 0 говорит об отсутствии связи, к 1 – о тесной связи. Корреляционное отношение в отличие от линейного коэффициента корреляции не указывает, является ли связь прямой или обратной. Но уже по виду исходной таблицы и другим промежуточным расчетам, можно решить этот вопрос: если с ростом факторного группировочного признака растут групповые средние результативного признака, то связь прямая, если с увеличением факторного признака значения групповых средних уменьшаются, то связь обратная. Квадрат корреляционного отношения, выраженный в процентах – это тоже самое, что и коэффициент детерминации.

Шаг 5. Получим коэффициент детерминации. Он равен 9, 9% Вывод: Возраст ухода в отставку зависит от имущественного положения, но в небольшой степени: колебания имущественного положения только на 9, 9% объясняют колебания возраста ухода в отставку. Причем, поскольку с увеличением количества крестьян у владельцев средний возраст ухода в отставку уменьшается, то связь между этими признаками обратная.

Множественная регрессия позволяет анализировать влияние на результативный признак нескольких факторных. Пример: доход предприятия зависит одновременно от двух факторов производства - числа рабочих и мощности двигателей. Причем оба этих фактора сами не являются независимыми друг от друга: для обслуживания большего числа машин требуется больше рабочих (даже если машины работают вхолостую). Поэтому совокупная зависимость дохода от рабочих и мощности двигателей не есть простая сумма двух парных зависимостей; она находится более сложным методом, который носит название множественной регрессии.

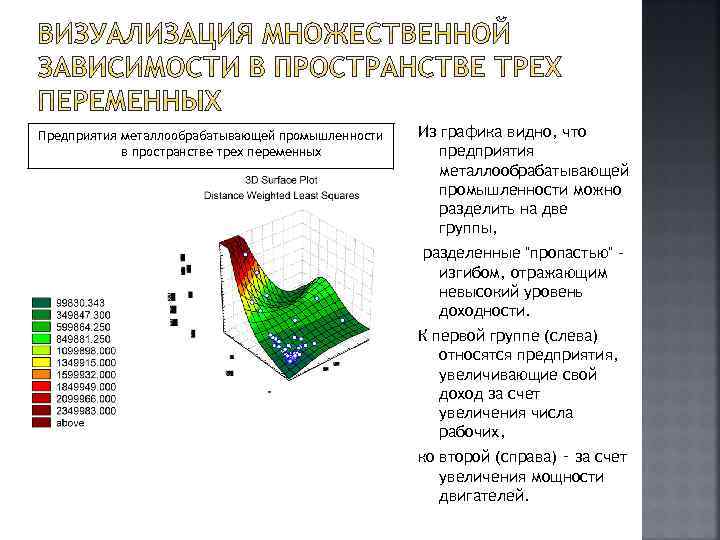

Предприятия металлообрабатывающей промышленности в пространстве трех переменных Из графика видно, что предприятия металлообрабатывающей промышленности можно разделить на две группы, разделенные "пропастью" – изгибом, отражающим невысокий уровень доходности. К первой группе (слева) относятся предприятия, увеличивающие свой доход за счет увеличения числа рабочих, ко второй (справа) ‑ за счет увеличения мощности двигателей.

Определим связи между посевом и сбором хлеба на душу населения. Добавим третий фактор – уровень урожайности. Какая из переменных – посев или урожайность оказывает большее влияние на сбор хлеба на душу? Построим уравнение множественной регрессии. где y – сбор хлеба на душу; - размер посева на душу; - урожай с десятины (в пудах); - параметры, подлежащие определению (функция ЛИНЕЙН).

Коэффициент при в полученном уравнении отличается от аналогичного коэффициента в уравнении обычной линейной регрессии (=24, 4). Это происходит потому, что в уравнении множественной регрессии устранено влияние всех других учтенных в данном уравнении признаков. Поэтому коэффициенты уравнения множественной регрессии называются чистыми коэффициентами регрессии. Чистый коэффициент множественной регрессии показывает, что с увеличением посева на душу на 1 дес. и при фиксированной урожайности сбор хлеба на душу населения вырастает в среднем на 28, 8 пуда. Коэффициент при показывает, что при фиксированном посеве на душу увеличение урожая на единицу, т. е. на один пуд с десятины вызывает в среднем увеличение сбора хлеба на душу на 0, 33 пуда. Вывод: увеличение сбора хлеба в черноземных губерниях России идет, в основном, за счет расширения посева и в значительной меньшей степени – за счет повышения урожайности.

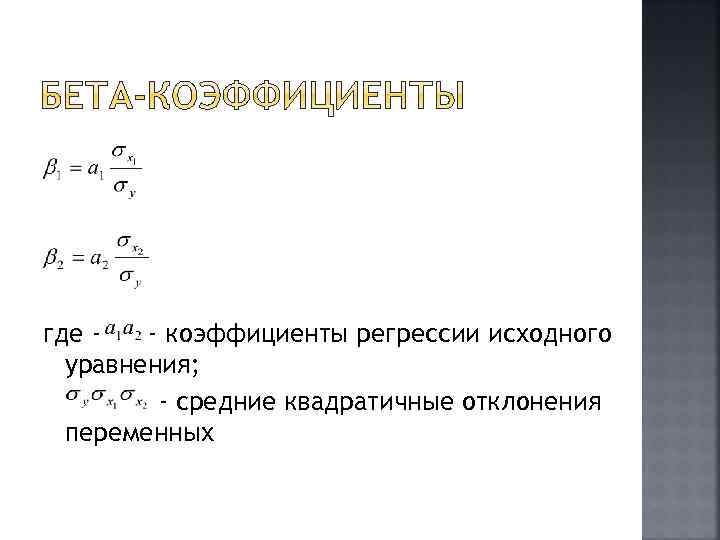

Величина коэффициентов регрессии изменяется в зависимости от единиц измерения, в которых представлены переменные. Если переменные используют разный масштаб, то они становятся несравнимыми. Для достижения сопоставимости коэффициенты регрессии исходного уравнения стандартизируют. Вместо исходных переменных берут их отношения к средним квадратичным отклонениям. Тогда уравнение множественной регрессии приобретает вид:

где - коэффициенты регрессии исходного уравнения; - средние квадратичные отклонения переменных

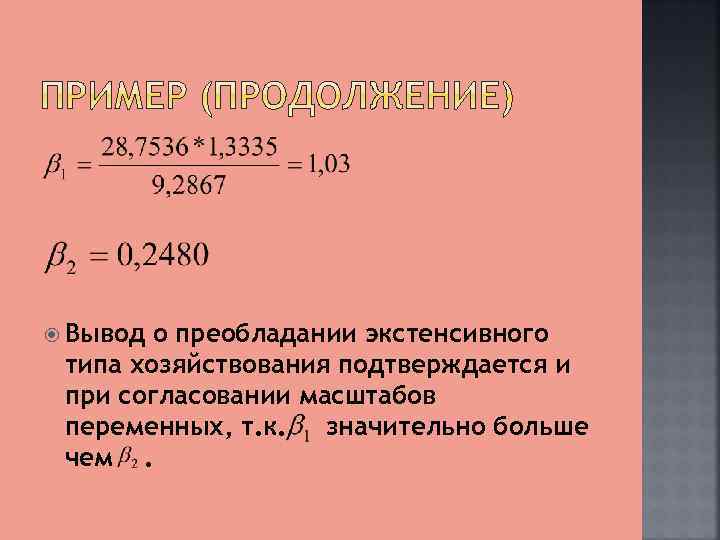

Вывод о преобладании экстенсивного типа хозяйствования подтверждается и при согласовании масштабов переменных, т. к. значительно больше чем.

Строится на проверке гипотезы о линейной связи результативного и факторных признаков, отвечающей на вопросы: существует ли связь? ; значимо ли уравнение регрессии, используемое для отображения предполагаемой связи? В основе критерия значимости лежит идея разложения дисперсии результативного признака на две составляющие: факторную (т. е. объясненную регрессией часть дисперсии) и остаточную дисперсии (оставшуюся необъясненной в рамках регрессионной модели). Чем лучше объясняет поведение результативного признака регрессионная модель, тем выше доля факторной составляющей и ниже доля остаточной в общей дисперсии этого признака. Поэтому мерой значимости регрессии служит отношение F факторной дисперсии к остаточной.

Эта величина распределена по т. н. закону Фишера F с m и n-(m+1) степенями свободы. Величина m – это число факторов, а n – число объектов. Распределение Фишера так же, как и нормальное распределение, хорошо изучено и табулировано, и для каждого значения F можно найти соответствующую вероятность. Если значение этой вероятности (p) окажется меньше принятого уровня значимости, гипотеза об отсутствии линейной связи между результативным признаком и факторными отклоняется и регрессия признается значимой.

Важным условием применения в обработке данных метода множественной регрессии является отсутствие сколько-нибудь значительной взаимосвязи между факторными переменными. Если зависимость все же существует, то система линейных уравнений не разрешима. Получается, что при линейной связи между двумя факторными признаками, их действие сливается воедино и их влияние на изменение разделить невозможно. Это явление называется мультиколлинеарностью. Для проверки взаимосвязи факторных признаков используют коэффициент корреляции. Если он превышает, 0, 8, то признаки считаются мультиколлинеарными. Избавиться от мультиколлинеарности можно путем удаления одной из линейно связанных переменных.

Важным свойством регрессионного уравнения является статистический прогноз – возможность вычислять значения зависимой переменной для любых комбинаций значений факторных переменных (в частности, это хороший способ восстановления отсутствующих данных). Например, если подставить в уравнение регрессии число рабочих, равное 200 и мощность двигателей, равную 20, программа вычислит теоретическое значение дохода на таком предприятии: 640864 руб. К прогнозу с использованием уравнения регрессии нужно относиться осторожно: его нельзя использовать вне диапазона значений признаков, по которому построена регрессионная модель (в другом диапазоне могут действовать другие зависимости).

Метод построения таблиц сопряженности. Таблицей сопряженности называется прямоугольная таблица, по строкам которой указываются категории одного признака (например, разные социальные группы), а по столбцам - категории другого (например, партийная принадлежность). Т. о. в клетках таблицы стоят числа, представляющие собой частоты совместной встречаемости категорий двух признаков (число людей, принадлежащих конкретной социальной группе и входящих в определенную партию).

В зависимости от характера распределения этих частот внутри таблицы можно судить о том, существует ли связь между признаками. Что означает связь между социальным статусом и партийной принадлежностью? О наличии связи свидетельствовало бы наличии определенных политических пристрастий у членов разных социальных групп. Формально говоря, эта связь понимается как более частая (или наоборот, редкая) совместная встречаемость отдельных комбинаций категорий по сравнению с ожидаемой встречаемостью - ситуацией чисто случайного попадания объектов туда (например, более высокая доля крестьян в партии трудовиков, а дворян - в партии кадетов, чем доли этих социальных групп во всей совокупности депутатов Думы). Т. о. определение связи между двумя номинальными признаками основано на проверке предположения о статистической независимости рассматриваемых признаков.

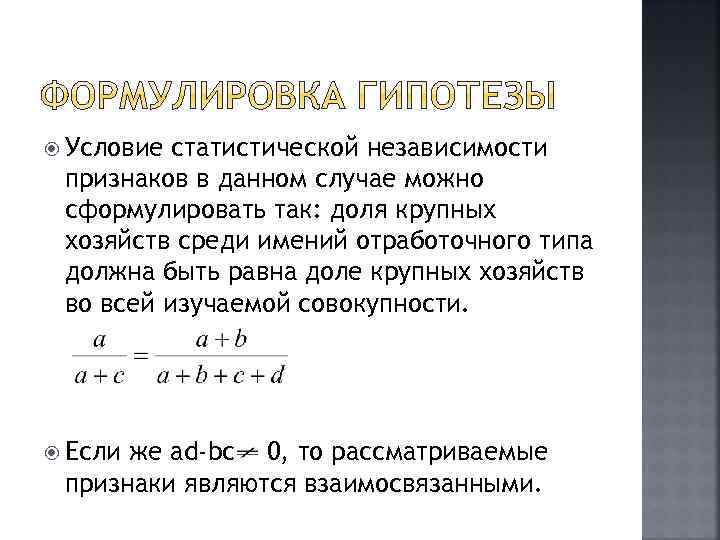

A a c a+c B Размер имений b d b+d a+b с+d Тип хозяйства Отработочное (A) Капиталистическое ( ) Сумма Крупные(B) 40 (a) 10 (b) 50 Мелкие ( 25 (c) 45 (d) 70 65 55 120 Сумма )

Условие статистической независимости признаков в данном случае можно сформулировать так: доля крупных хозяйств среди имений отработочного типа должна быть равна доле крупных хозяйств во всей изучаемой совокупности. Если же ad-bc 0, то рассматриваемые признаки являются взаимосвязанными.

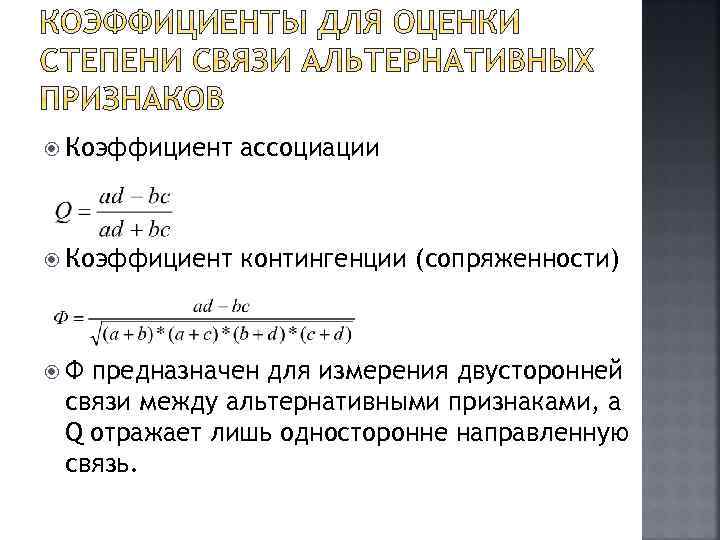

Коэффициент ассоциации Коэффициент контингенции (сопряженности) Ф предназначен для измерения двусторонней связи между альтернативными признаками, а Q отражает лишь односторонне направленную связь.

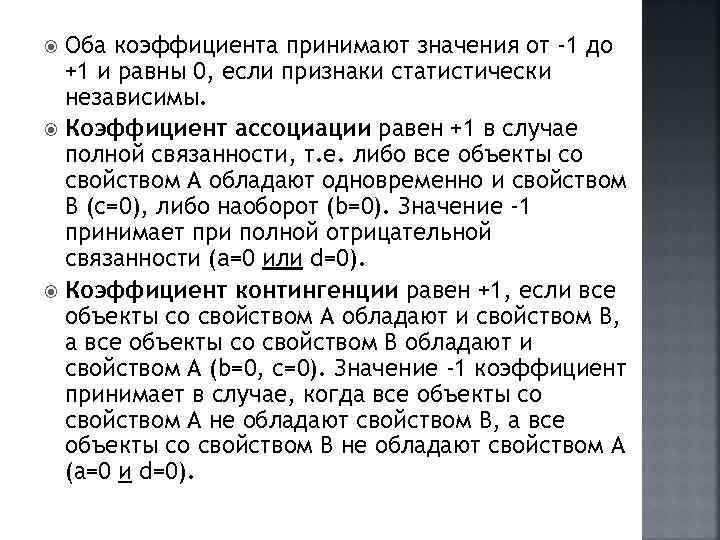

Оба коэффициента принимают значения от -1 до +1 и равны 0, если признаки статистически независимы. Коэффициент ассоциации равен +1 в случае полной связанности, т. е. либо все объекты со свойством A обладают одновременно и свойством В (с=0), либо наоборот (b=0). Значение -1 принимает при полной отрицательной связанности (a=0 или d=0). Коэффициент контингенции равен +1, если все объекты со свойством A обладают и свойством B, а все объекты со свойством B обладают и свойством A (b=0, c=0). Значение -1 коэффициент принимает в случае, когда все объекты со свойством А не обладают свойством В, а все объекты со свойством В не обладают свойством A (а=0 и d=0).

Корреляционный и регрессионный анализ.ppt