Множественный регрессионный анализ Модель с двумя независимыми

9-1 Множественный регрессионный анализ.ppt

- Количество слайдов: 34

Множественный регрессионный анализ

Множественный регрессионный анализ

Модель с двумя независимыми переменными n Множественный регрессионный анализ является развитием парного регрессионного анализа применительно к случаям, когда зависимая переменная связана с более чем одной независимой переменной. n Большая часть анализа будет непосредственным расширением парной регрессионной модели.

Модель с двумя независимыми переменными n Множественный регрессионный анализ является развитием парного регрессионного анализа применительно к случаям, когда зависимая переменная связана с более чем одной независимой переменной. n Большая часть анализа будет непосредственным расширением парной регрессионной модели.

n Появляются две новые проблемы n Во-первых, при оценке влияния данной независимой переменной на зависимую переменную придется решать проблему разграничения ее воздействия и воздействий других независимых переменных.

n Появляются две новые проблемы n Во-первых, при оценке влияния данной независимой переменной на зависимую переменную придется решать проблему разграничения ее воздействия и воздействий других независимых переменных.

n Во-вторых, следует решить проблему спецификации модели, т. е. определить количество включаемых в модель переменных. n В большинстве ситуаций ограничиваются основным случаем, где используются только две независимые переменные.

n Во-вторых, следует решить проблему спецификации модели, т. е. определить количество включаемых в модель переменных. n В большинстве ситуаций ограничиваются основным случаем, где используются только две независимые переменные.

n Рассмотрим пример, в котором определяются факторы совокупного спроса на продукты питания. n Расширим первоначальную модель, включив учет влияния цен на спрос, и допустим, что истинную зависимость можно выразить следующим образом: n Y=α+β 1 x+β 2 p+u где у – общая величина расходов на питание, х — располагаемый личный доход, р – цена продуктов питания.

n Рассмотрим пример, в котором определяются факторы совокупного спроса на продукты питания. n Расширим первоначальную модель, включив учет влияния цен на спрос, и допустим, что истинную зависимость можно выразить следующим образом: n Y=α+β 1 x+β 2 p+u где у – общая величина расходов на питание, х — располагаемый личный доход, р – цена продуктов питания.

n Это, является значительным упрощением как с точки зрения состава независимых переменных, включенных в зависимость, так и с точки зрения математической формулы связи. n Кроме того, неявно предполагаем наличие лишь прямой связи за счет допущения о том, что расходы на питание не влияют на доход и цену. n Это могло бы быть в том случае, если бы цены определялись на мировом рынке, но в большинстве ситуаций более реально допустить, что расходы на продукты и их цены определяются совместно в результате взаимодействия предложения и спроса.

n Это, является значительным упрощением как с точки зрения состава независимых переменных, включенных в зависимость, так и с точки зрения математической формулы связи. n Кроме того, неявно предполагаем наличие лишь прямой связи за счет допущения о том, что расходы на питание не влияют на доход и цену. n Это могло бы быть в том случае, если бы цены определялись на мировом рынке, но в большинстве ситуаций более реально допустить, что расходы на продукты и их цены определяются совместно в результате взаимодействия предложения и спроса.

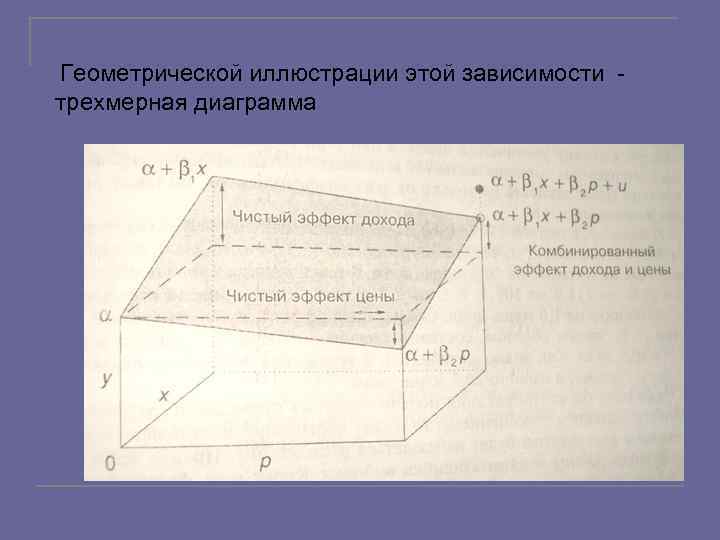

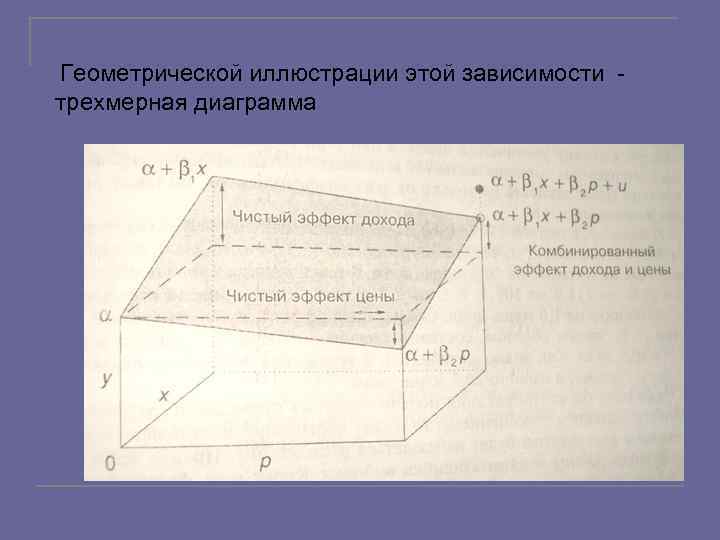

Геометрической иллюстрации этой зависимости - трехмерная диаграмма

Геометрической иллюстрации этой зависимости - трехмерная диаграмма

n Если случайный член отсутствует в уравнении, то значения у в выборке будут находиться точно на наклонной плоскости. n Учет случайного члена приводит к тому, что фактические значения у будут лежать несколько выше или несколько ниже значений, соответствующих наклонной плоскости.

n Если случайный член отсутствует в уравнении, то значения у в выборке будут находиться точно на наклонной плоскости. n Учет случайного члена приводит к тому, что фактические значения у будут лежать несколько выше или несколько ниже значений, соответствующих наклонной плоскости.

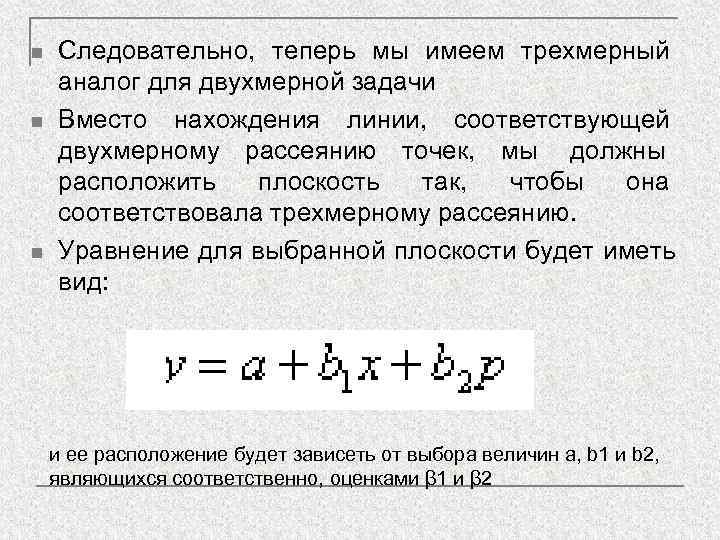

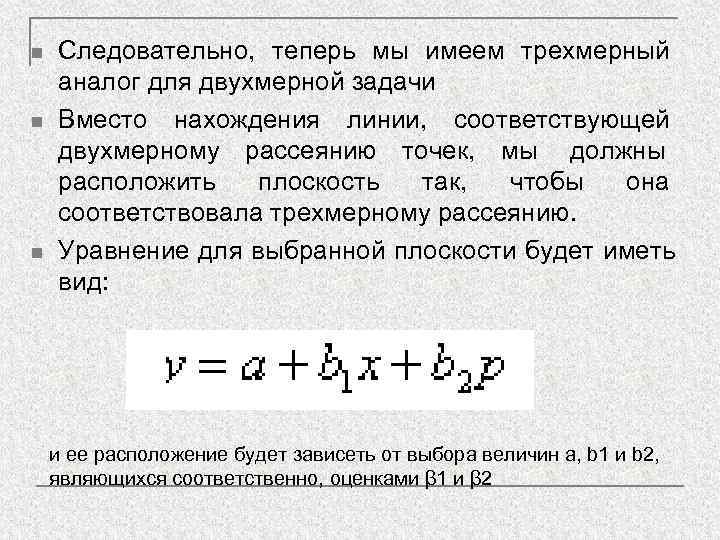

n Следовательно, теперь мы имеем трехмерный аналог для двухмерной задачи n Вместо нахождения линии, соответствующей двухмерному рассеянию точек, мы должны расположить плоскость так, чтобы она соответствовала трехмерному рассеянию. n Уравнение для выбранной плоскости будет иметь вид: и ее расположение будет зависеть от выбора величин а, b 1 и b 2, являющихся соответственно, оценками β 1 и β 2

n Следовательно, теперь мы имеем трехмерный аналог для двухмерной задачи n Вместо нахождения линии, соответствующей двухмерному рассеянию точек, мы должны расположить плоскость так, чтобы она соответствовала трехмерному рассеянию. n Уравнение для выбранной плоскости будет иметь вид: и ее расположение будет зависеть от выбора величин а, b 1 и b 2, являющихся соответственно, оценками β 1 и β 2

n Модель парной регрессии – частный случай модели множественной регрессии. n Определения таких понятий, как объясненная дисперсия зависимой переменной, необъясненная дисперсия зависимой переменной, общая сумма квадратов отклонений (TSS), объясненная сумма квадратов отклонений (ESS), необъясненная (остаточная) сумма квадратов отклонений (RSS), коэффициент детерминации R 2 =ESS/TSS , метод наименьших квадратов для модели множественной регрессии повторяют определения тех же понятий для парной регрессии.

n Модель парной регрессии – частный случай модели множественной регрессии. n Определения таких понятий, как объясненная дисперсия зависимой переменной, необъясненная дисперсия зависимой переменной, общая сумма квадратов отклонений (TSS), объясненная сумма квадратов отклонений (ESS), необъясненная (остаточная) сумма квадратов отклонений (RSS), коэффициент детерминации R 2 =ESS/TSS , метод наименьших квадратов для модели множественной регрессии повторяют определения тех же понятий для парной регрессии.

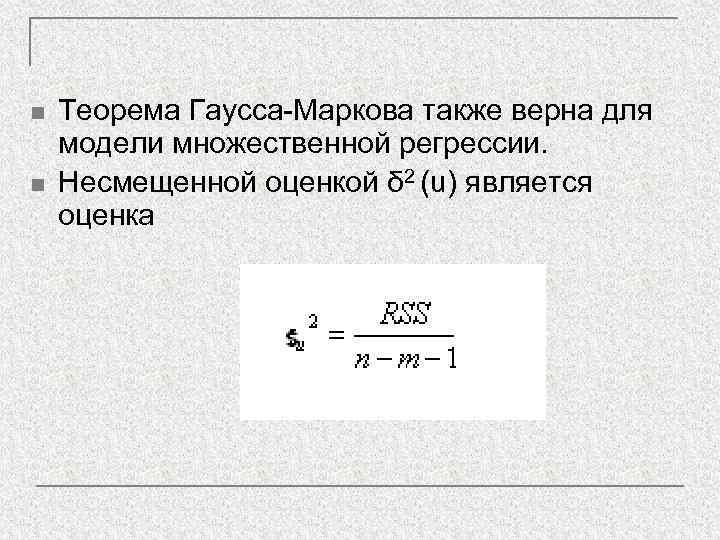

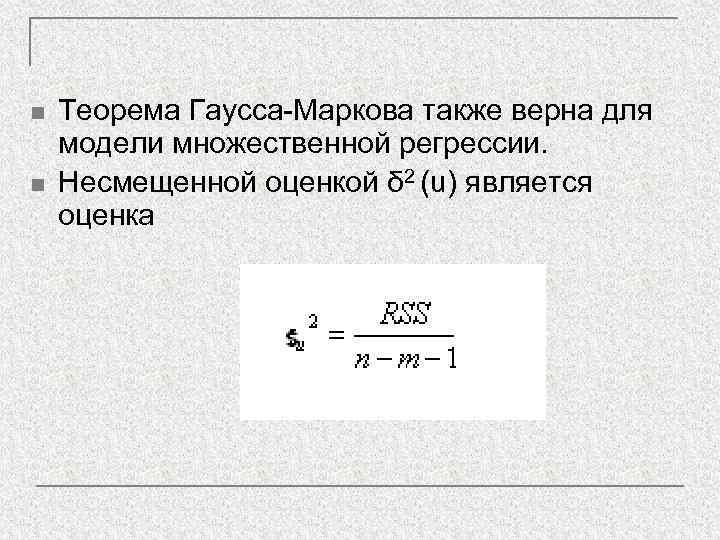

n Теорема Гаусса-Маркова также верна для модели множественной регрессии. n Несмещенной оценкой δ 2 (u) является оценка

n Теорема Гаусса-Маркова также верна для модели множественной регрессии. n Несмещенной оценкой δ 2 (u) является оценка

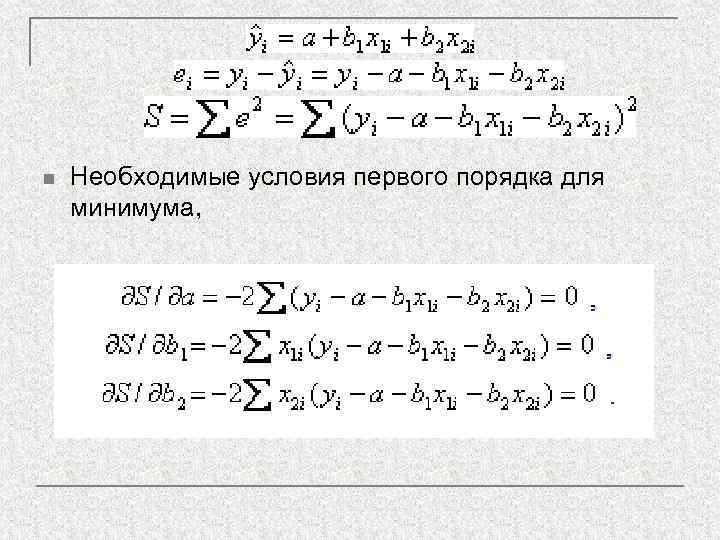

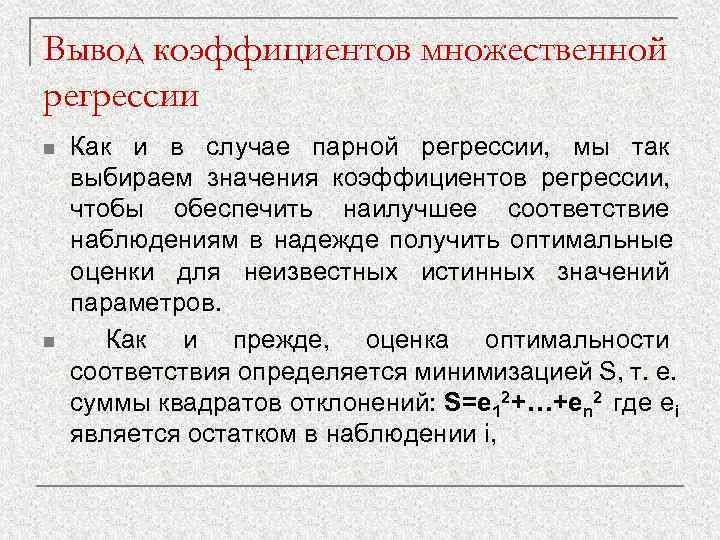

Вывод коэффициентов множественной регрессии n Как и в случае парной регрессии, мы так выбираем значения коэффициентов регрессии, чтобы обеспечить наилучшее соответствие наблюдениям в надежде получить оптимальные оценки для неизвестных истинных значений параметров. n Как и прежде, оценка оптимальности соответствия определяется минимизацией S, т. е. суммы квадратов отклонений: S=e 12+…+en 2 где ei является остатком в наблюдении i,

Вывод коэффициентов множественной регрессии n Как и в случае парной регрессии, мы так выбираем значения коэффициентов регрессии, чтобы обеспечить наилучшее соответствие наблюдениям в надежде получить оптимальные оценки для неизвестных истинных значений параметров. n Как и прежде, оценка оптимальности соответствия определяется минимизацией S, т. е. суммы квадратов отклонений: S=e 12+…+en 2 где ei является остатком в наблюдении i,

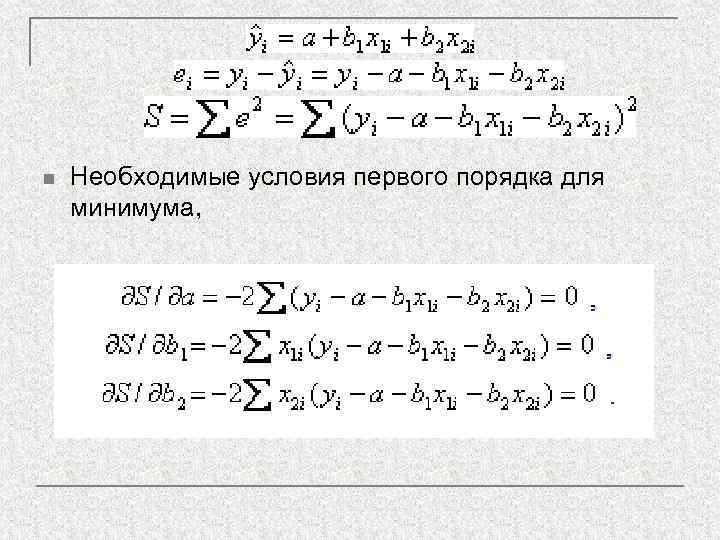

n Необходимые условия первого порядка для минимума,

n Необходимые условия первого порядка для минимума,

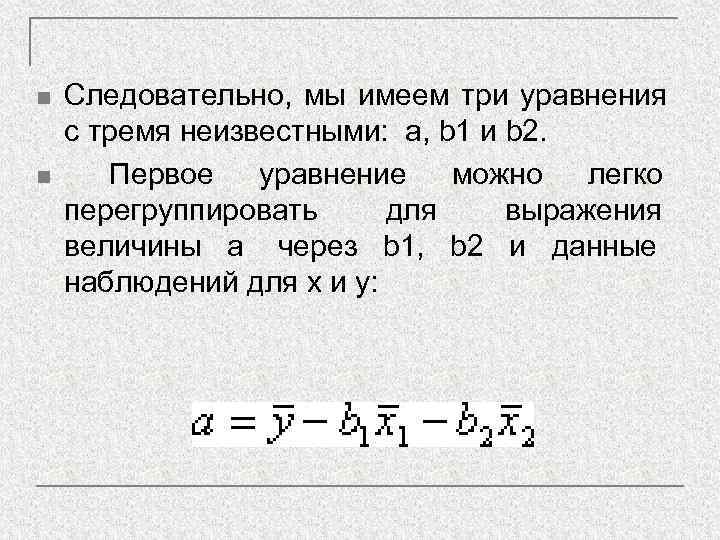

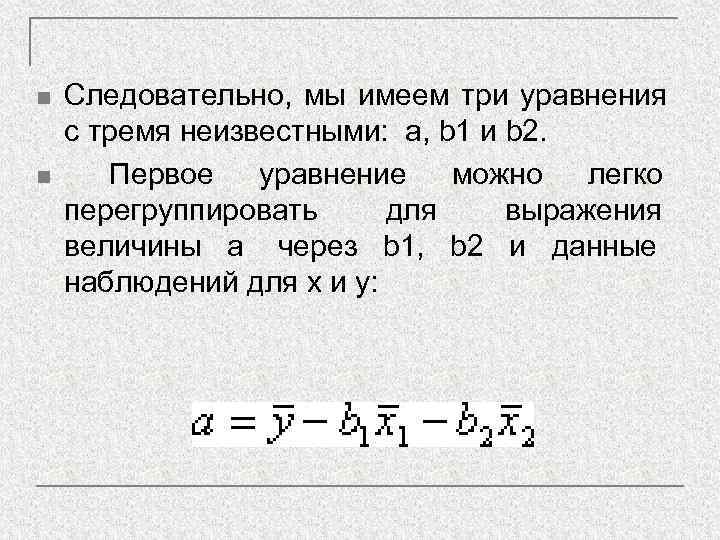

n Следовательно, мы имеем три уравнения с тремя неизвестными: a, b 1 и b 2. n Первое уравнение можно легко перегруппировать для выражения величины a через b 1, b 2 и данные наблюдений для х и у:

n Следовательно, мы имеем три уравнения с тремя неизвестными: a, b 1 и b 2. n Первое уравнение можно легко перегруппировать для выражения величины a через b 1, b 2 и данные наблюдений для х и у:

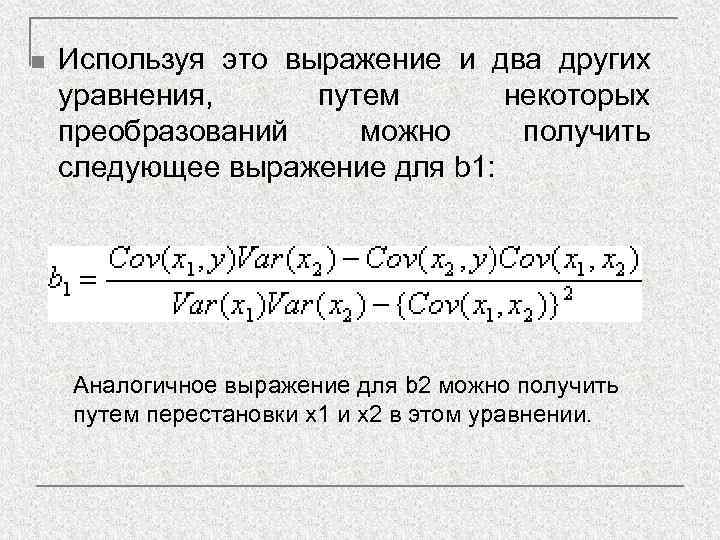

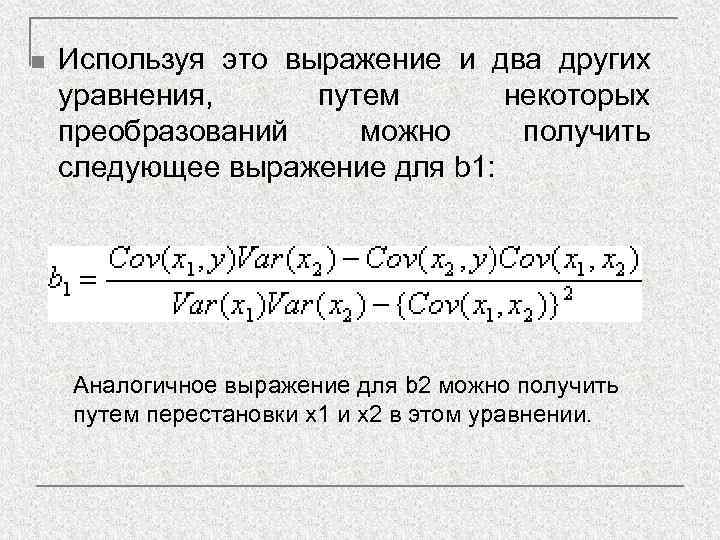

n Используя это выражение и два других уравнения, путем некоторых преобразований можно получить следующее выражение для b 1: Аналогичное выражение для b 2 можно получить путем перестановки х1 и х2 в этом уравнении.

n Используя это выражение и два других уравнения, путем некоторых преобразований можно получить следующее выражение для b 1: Аналогичное выражение для b 2 можно получить путем перестановки х1 и х2 в этом уравнении.

n Итак, n во-первых, принципы, лежащие в основе вычисления коэффициентов регрессии, в случаях множественной и парной регрессии не различаются. n Во-вторых, используемые при этом формулы будут разными, поэтому не следует использовать выражения, выведенные для парной регрессии, в случае множественной регрессии. n Вычисление формул регрессии при двух независимых переменных является более трудоемкой задачей, чем при одной переменной.

n Итак, n во-первых, принципы, лежащие в основе вычисления коэффициентов регрессии, в случаях множественной и парной регрессии не различаются. n Во-вторых, используемые при этом формулы будут разными, поэтому не следует использовать выражения, выведенные для парной регрессии, в случае множественной регрессии. n Вычисление формул регрессии при двух независимых переменных является более трудоемкой задачей, чем при одной переменной.

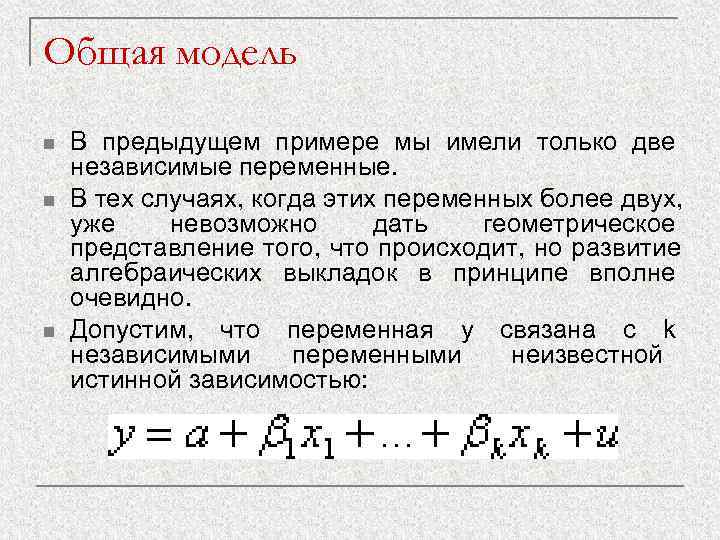

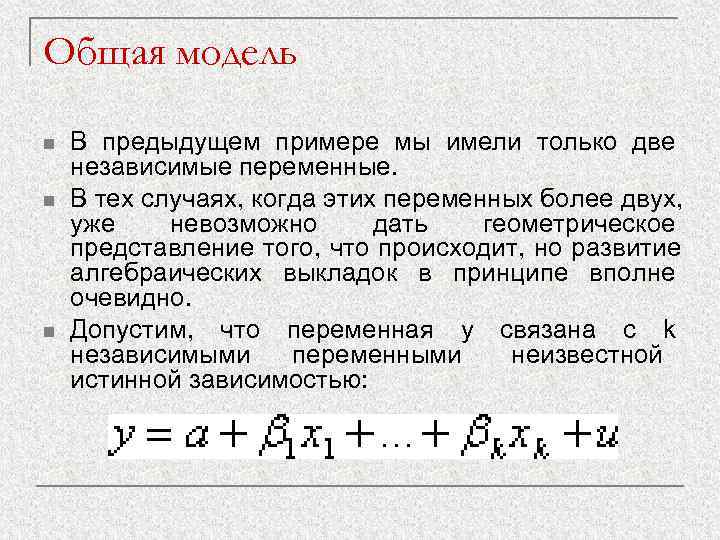

Общая модель n В предыдущем примере мы имели только две независимые переменные. n В тех случаях, когда этих переменных более двух, уже невозможно дать геометрическое представление того, что происходит, но развитие алгебраических выкладок в принципе вполне очевидно. n Допустим, что переменная у связана с k независимыми переменными неизвестной истинной зависимостью:

Общая модель n В предыдущем примере мы имели только две независимые переменные. n В тех случаях, когда этих переменных более двух, уже невозможно дать геометрическое представление того, что происходит, но развитие алгебраических выкладок в принципе вполне очевидно. n Допустим, что переменная у связана с k независимыми переменными неизвестной истинной зависимостью:

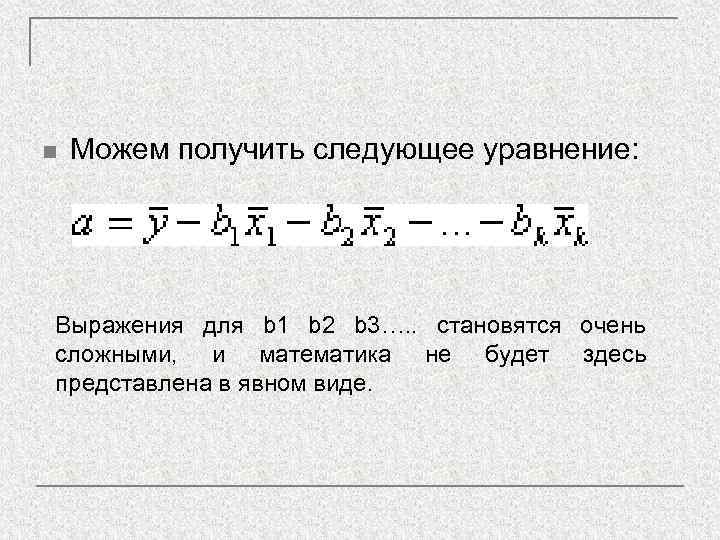

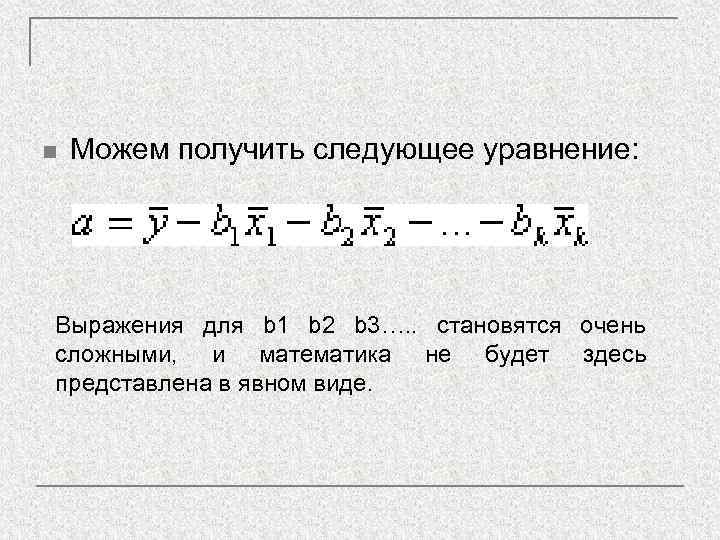

n Можем получить следующее уравнение: Выражения для b 1 b 2 b 3…. . становятся очень сложными, и математика не будет здесь представлена в явном виде.

n Можем получить следующее уравнение: Выражения для b 1 b 2 b 3…. . становятся очень сложными, и математика не будет здесь представлена в явном виде.

Множественная регрессия в нелинейных моделях n Линейные модели регрессии могут быть описаны как линейные в двух отношениях: как линейные по переменным и как линейные по параметрам. n Для линейного регрессионного анализа требуется линейность только по параметрам, поскольку нелинейность по переменным может быть устранена с помощью изменения определений.

Множественная регрессия в нелинейных моделях n Линейные модели регрессии могут быть описаны как линейные в двух отношениях: как линейные по переменным и как линейные по параметрам. n Для линейного регрессионного анализа требуется линейность только по параметрам, поскольку нелинейность по переменным может быть устранена с помощью изменения определений.

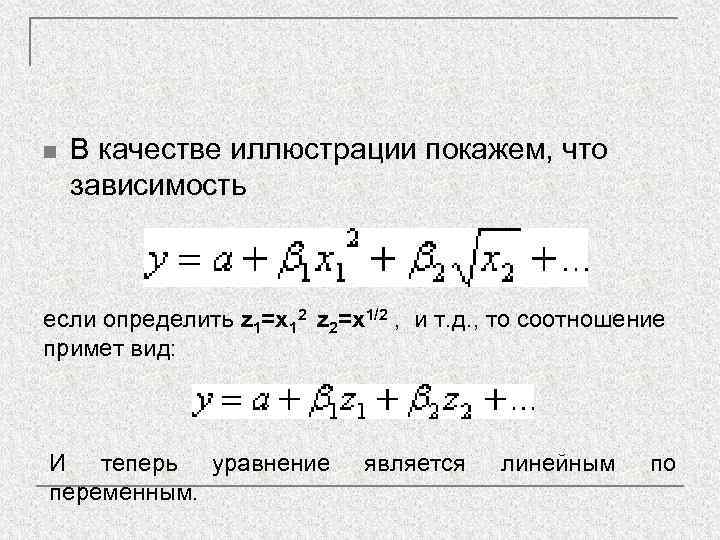

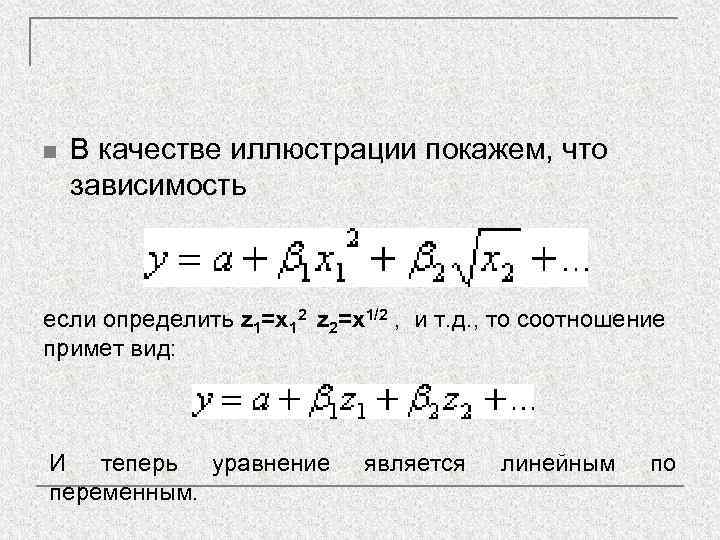

n В качестве иллюстрации покажем, что зависимость если определить z 1=x 12 z 2=x 1/2 , и т. д. , то соотношение примет вид: И теперь уравнение является линейным по переменным.

n В качестве иллюстрации покажем, что зависимость если определить z 1=x 12 z 2=x 1/2 , и т. д. , то соотношение примет вид: И теперь уравнение является линейным по переменным.

n Нелинейность по параметрам является более серьезной проблемой. n Если, однако, случайный член является мультипликативным, то модель может быть линеаризована посредством логарифмирования ее обеих частей.

n Нелинейность по параметрам является более серьезной проблемой. n Если, однако, случайный член является мультипликативным, то модель может быть линеаризована посредством логарифмирования ее обеих частей.

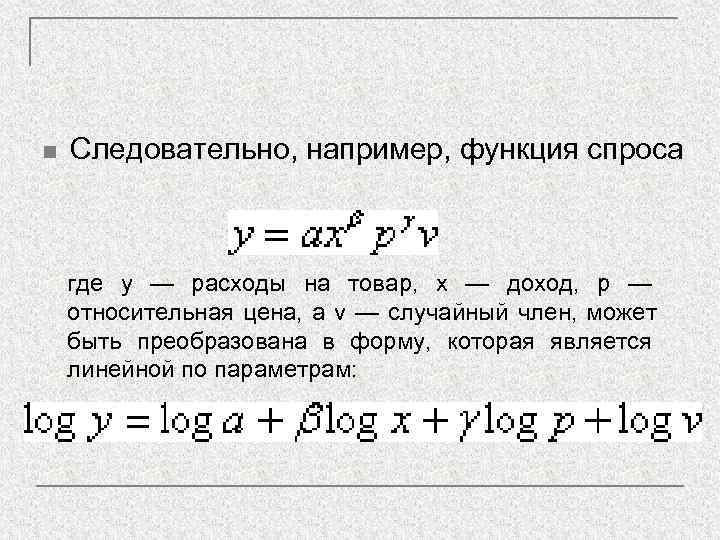

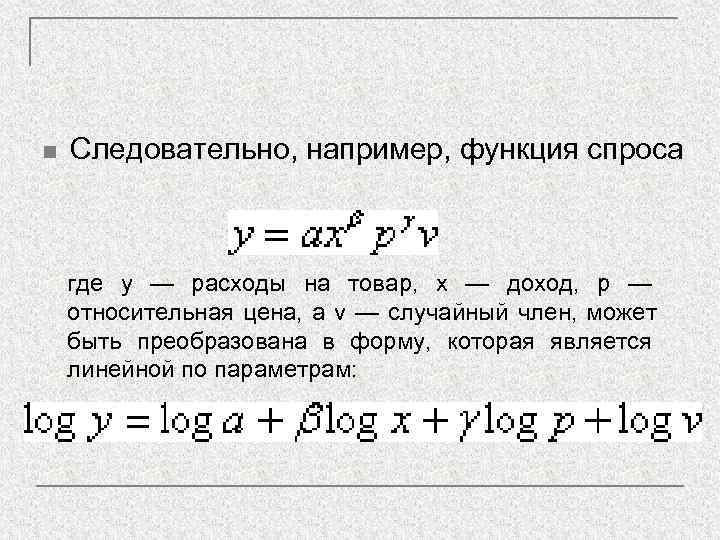

n Следовательно, например, функция спроса где у — расходы на товар, х — доход, р — относительная цена, a v — случайный член, может быть преобразована в форму, которая является линейной по параметрам:

n Следовательно, например, функция спроса где у — расходы на товар, х — доход, р — относительная цена, a v — случайный член, может быть преобразована в форму, которая является линейной по параметрам:

n Если оценивть регрессию между данными для log у, log x и log p, то коэффициент при log x будет непосредственной оценкой β - эластичности проса по доходу, а коэффициент при log p будет оценкой γ - эластичности проса по цене.

n Если оценивть регрессию между данными для log у, log x и log p, то коэффициент при log x будет непосредственной оценкой β - эластичности проса по доходу, а коэффициент при log p будет оценкой γ - эластичности проса по цене.

Пример: Производственная функция Кобба-Дугласа n В 1927 г. Пол Дуглас, экономист по образованию, обнаружил, что если нанести на одну и ту же диаграмму графики логарифмов показателей реального объема выпуска (Y), капитальных затрат (К) и затрат труда (L), то расстояния от точек графика показателей выпуска до точек графиков показателей затрат труда и капитала будут составлять постоянную пропорцию.

Пример: Производственная функция Кобба-Дугласа n В 1927 г. Пол Дуглас, экономист по образованию, обнаружил, что если нанести на одну и ту же диаграмму графики логарифмов показателей реального объема выпуска (Y), капитальных затрат (К) и затрат труда (L), то расстояния от точек графика показателей выпуска до точек графиков показателей затрат труда и капитала будут составлять постоянную пропорцию.

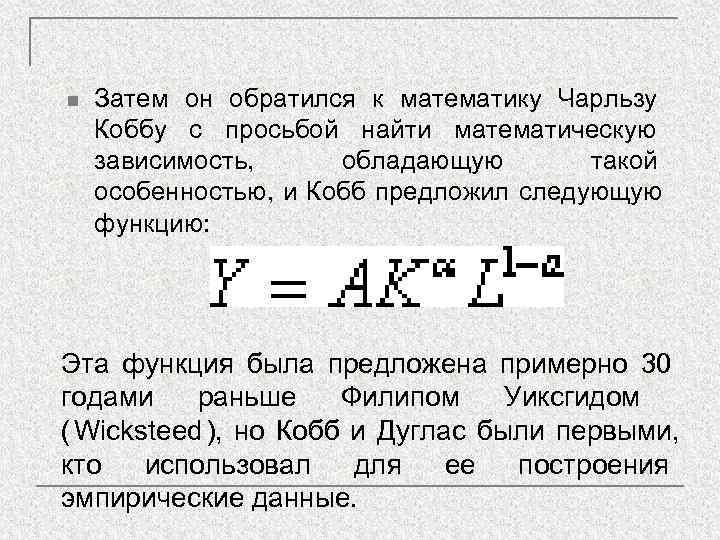

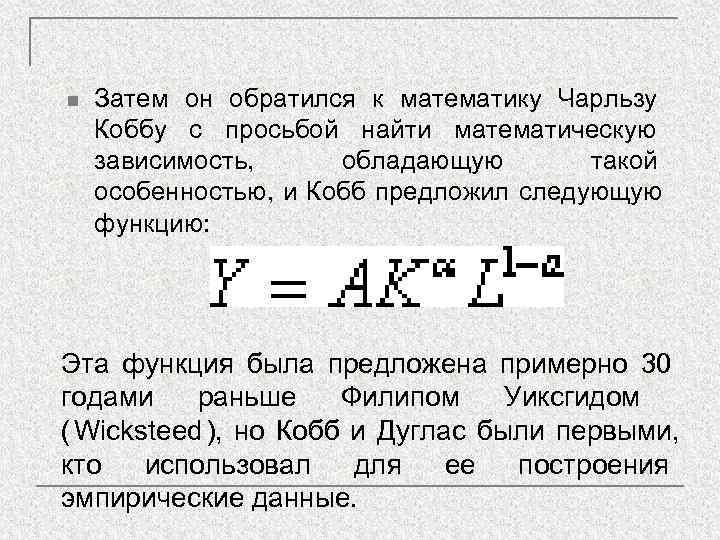

n Затем он обратился к математику Чарльзу Коббу с просьбой найти математическую зависимость, обладающую такой особенностью, и Кобб предложил следующую функцию: Эта функция была предложена примерно 30 годами раньше Филипом Уиксгидом ( Wicksteed ), но Кобб и Дуглас были первыми, кто использовал для ее построения эмпирические данные.

n Затем он обратился к математику Чарльзу Коббу с просьбой найти математическую зависимость, обладающую такой особенностью, и Кобб предложил следующую функцию: Эта функция была предложена примерно 30 годами раньше Филипом Уиксгидом ( Wicksteed ), но Кобб и Дуглас были первыми, кто использовал для ее построения эмпирические данные.

n в таблице представлены эти данные :

n в таблице представлены эти данные :

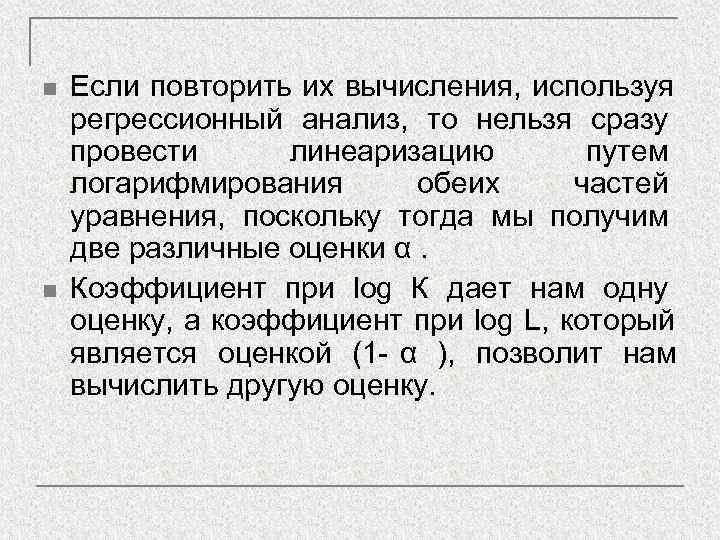

n Если повторить их вычисления, используя регрессионный анализ, то нельзя сразу провести линеаризацию путем логарифмирования обеих частей уравнения, поскольку тогда мы получим две различные оценки α. n Коэффициент при log К дает нам одну оценку, а коэффициент при log L, который является оценкой (1 - α ), позволит нам вычислить другую оценку.

n Если повторить их вычисления, используя регрессионный анализ, то нельзя сразу провести линеаризацию путем логарифмирования обеих частей уравнения, поскольку тогда мы получим две различные оценки α. n Коэффициент при log К дает нам одну оценку, а коэффициент при log L, который является оценкой (1 - α ), позволит нам вычислить другую оценку.

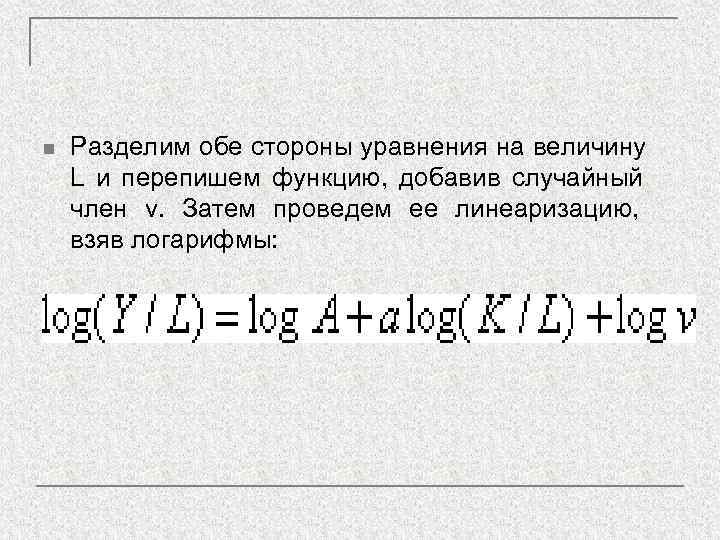

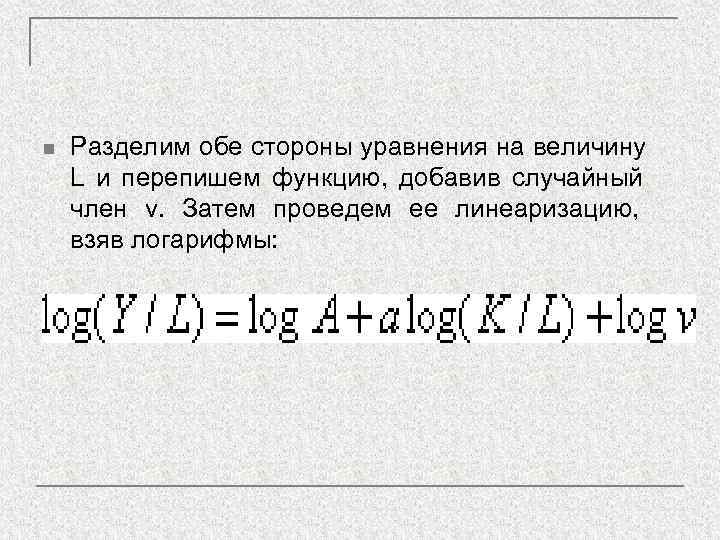

n Разделим обе стороны уравнения на величину L и перепишем функцию, добавив случайный член v. Затем проведем ее линеаризацию, взяв логарифмы:

n Разделим обе стороны уравнения на величину L и перепишем функцию, добавив случайный член v. Затем проведем ее линеаризацию, взяв логарифмы:

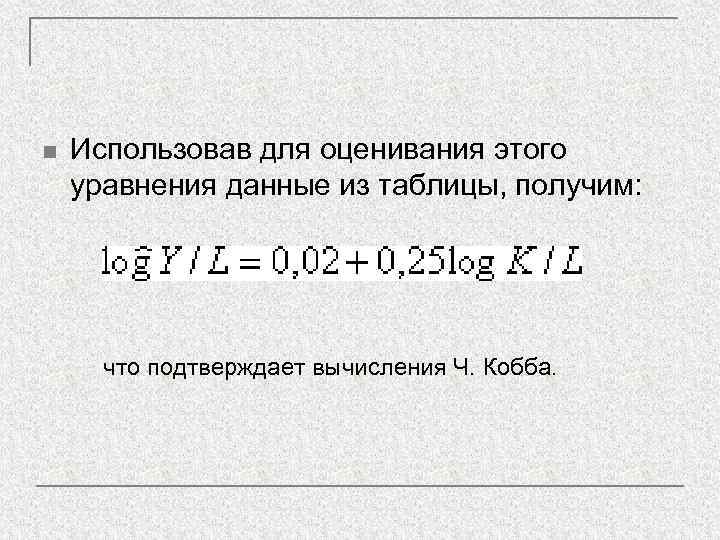

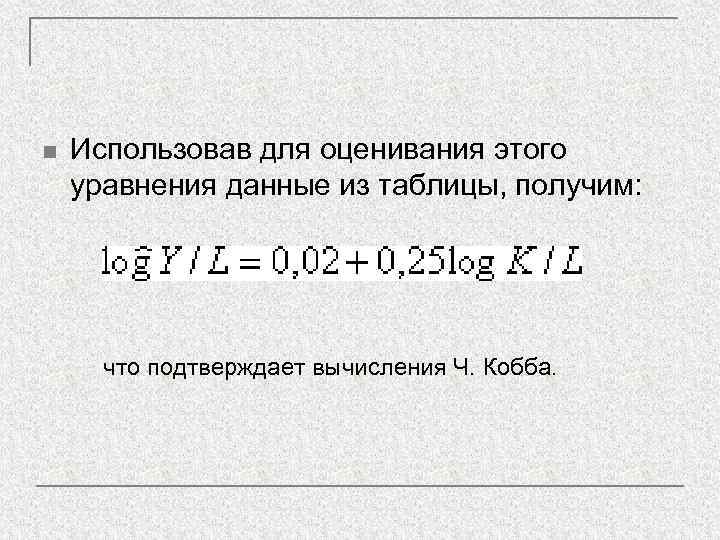

n Использовав для оценивания этого уравнения данные из таблицы, получим: что подтверждает вычисления Ч. Кобба.

n Использовав для оценивания этого уравнения данные из таблицы, получим: что подтверждает вычисления Ч. Кобба.

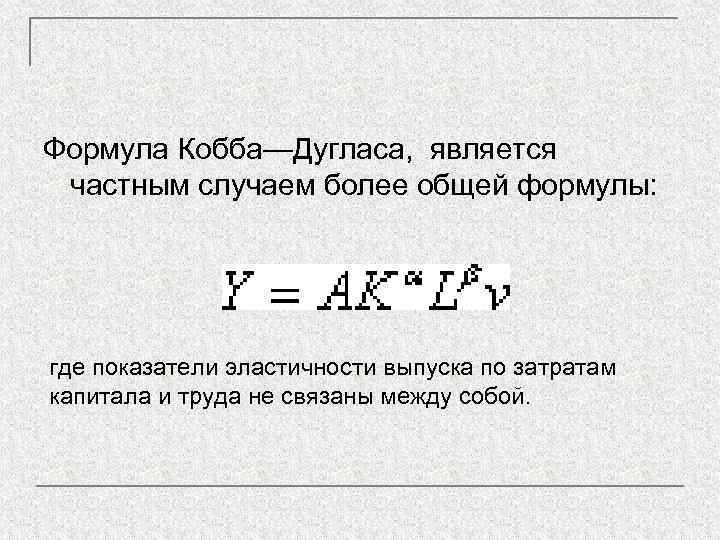

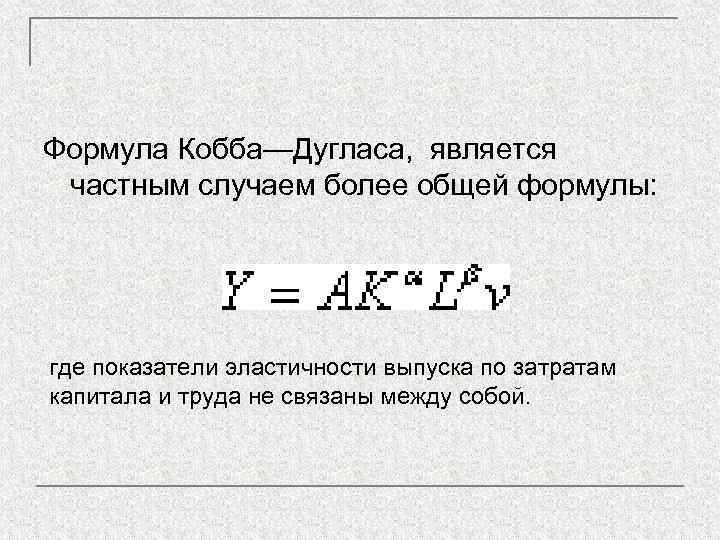

Формула Кобба—Дугласа, является частным случаем более общей формулы: где показатели эластичности выпуска по затратам капитала и труда не связаны между собой.

Формула Кобба—Дугласа, является частным случаем более общей формулы: где показатели эластичности выпуска по затратам капитала и труда не связаны между собой.

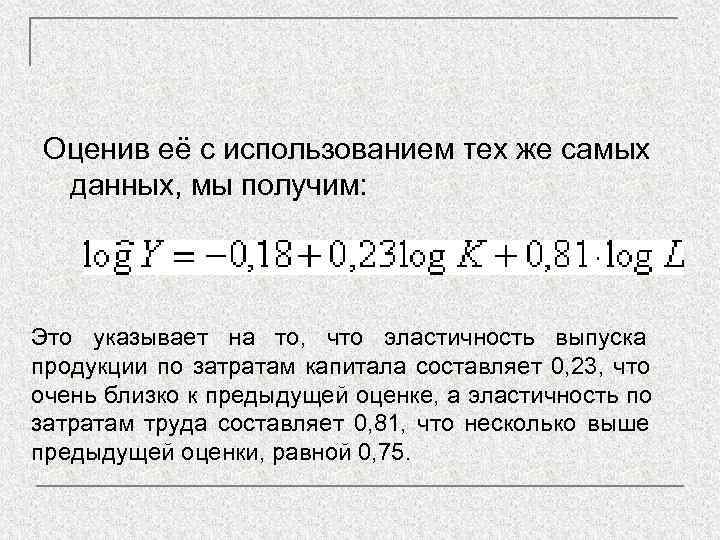

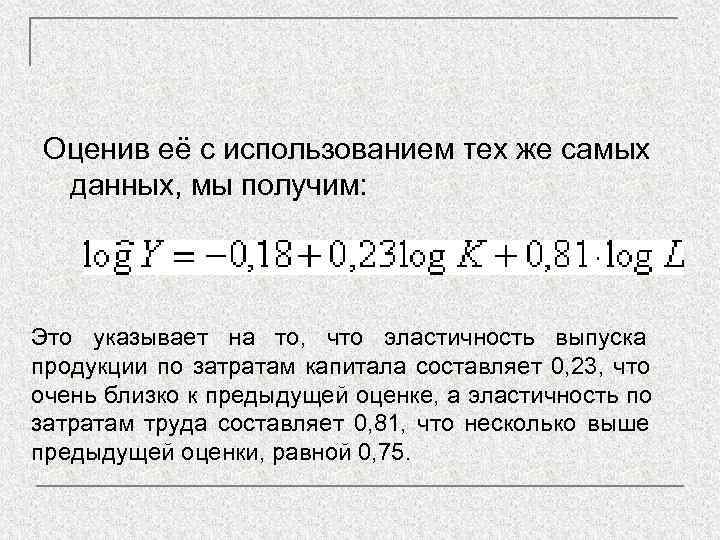

Оценив её с использованием тех же самых данных, мы получим: Это указывает на то, что эластичность выпуска продукции по затратам капитала составляет 0, 23, что очень близко к предыдущей оценке, а эластичность по затратам труда составляет 0, 81, что несколько выше предыдущей оценки, равной 0, 75.

Оценив её с использованием тех же самых данных, мы получим: Это указывает на то, что эластичность выпуска продукции по затратам капитала составляет 0, 23, что очень близко к предыдущей оценке, а эластичность по затратам труда составляет 0, 81, что несколько выше предыдущей оценки, равной 0, 75.

Мультиколлинеарность n Мультиколлинеарность — это понятие, которое используется для описания проблемы, когда нестрогая линейная зависимость между объясняющими переменными приводит к получению ненадежных оценок регрессии.

Мультиколлинеарность n Мультиколлинеарность — это понятие, которое используется для описания проблемы, когда нестрогая линейная зависимость между объясняющими переменными приводит к получению ненадежных оценок регрессии.

n Разумеется, такая зависимость совсем необязательно дает неудовлетворительные оценки. n Если все другие условия благоприятствуют, т. е. если число наблюдений и выборочные дисперсии объясняющих переменных велики, а дисперсия случайного члена - мала, то в итоге можно получить вполне хорошие оценки.

n Разумеется, такая зависимость совсем необязательно дает неудовлетворительные оценки. n Если все другие условия благоприятствуют, т. е. если число наблюдений и выборочные дисперсии объясняющих переменных велики, а дисперсия случайного члена - мала, то в итоге можно получить вполне хорошие оценки.

n Мультиколлинеарность должна вызываться сочетанием нестрогой зависимости и одного (или более) неблагоприятного условия. n Оценка любой регрессии будет страдать от нее в определенной степени, если только все независимые переменные не окажутся абсолютно некоррелированными. n Рассмотрение данной проблемы начинается только тогда, когда это серьезно влияет на результат оценки регрессии.

n Мультиколлинеарность должна вызываться сочетанием нестрогой зависимости и одного (или более) неблагоприятного условия. n Оценка любой регрессии будет страдать от нее в определенной степени, если только все независимые переменные не окажутся абсолютно некоррелированными. n Рассмотрение данной проблемы начинается только тогда, когда это серьезно влияет на результат оценки регрессии.