Lecture 12.ppt

- Количество слайдов: 130

МГЛУ им. М. Тореза Автоматическая обработка естественного языка Харламов А. А. © 2011 МГЛУ им. М. Тореза

Автоматическое распознавание речи 2

Автоматическое распознавание речи Общая блок-схема ориентированной на задачу системы распознавания речи 3

Автоматическое распознавание речи 1. Коммуникационный акт 2. Процесс порождения и восприятия речи у человека 3. Автоматическое распознавание речи 4. Первичная обработка 5. Принятие решения 6. Верхние уровни 7. Нейросетевой подход 8. Реализация и использование систем распознавания речи 4

Коммуникационный акт 1. Структура коммуникационного акта 2. Правило Байеса 3. Структура коммуникационной системы человека 5

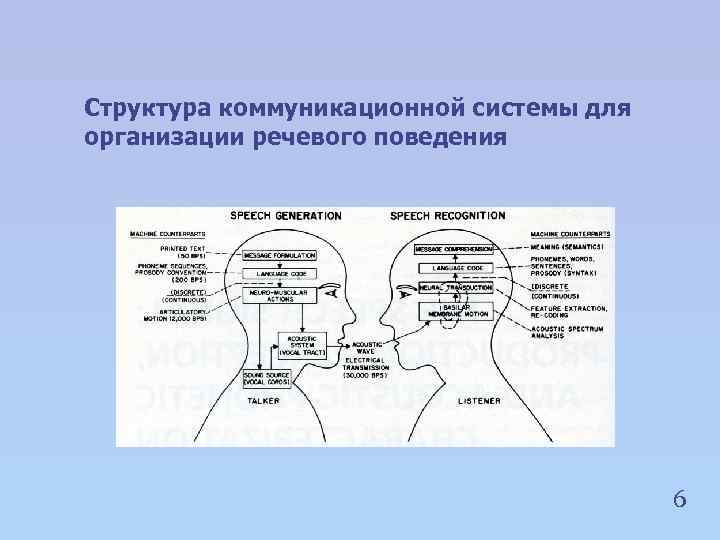

Структура коммуникационной системы для организации речевого поведения 6

Структура коммуникационной системы для организации речевого поведения 7

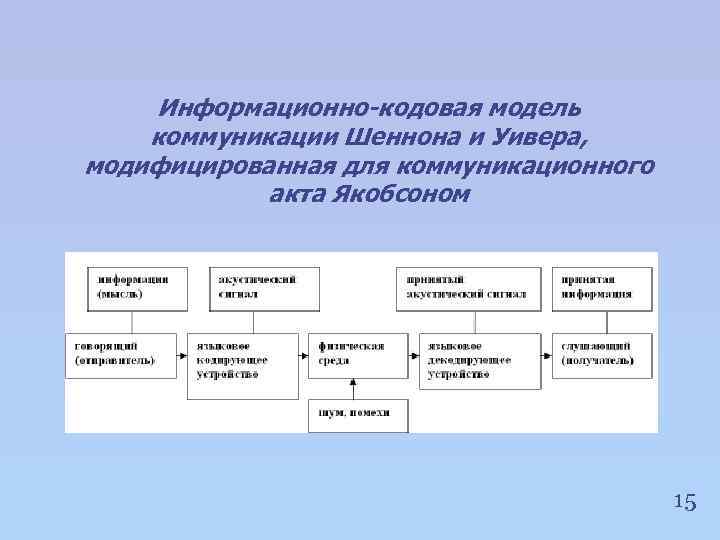

Информационно-кодовая модель коммуникации Шеннона и Уивера 8

Под распознаванием речи понимается выделение информации из преобразованного сигнала, полученного адресатом от адресанта 9

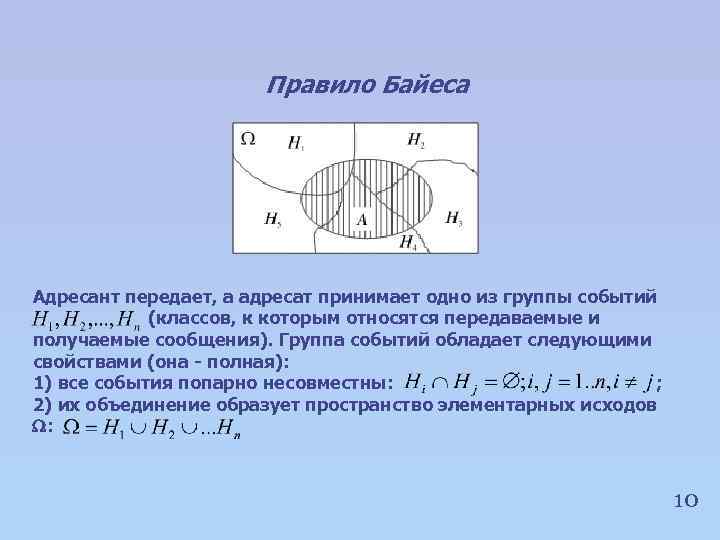

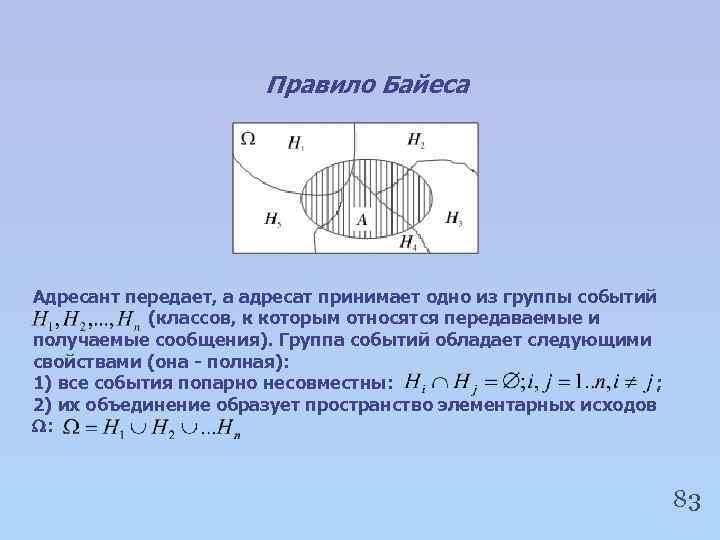

Правило Байеса Адресант передает, а адресат принимает одно из группы событий (классов, к которым относятся передаваемые и получаемые сообщения). Группа событий обладает следующими свойствами (она - полная): 1) все события попарно несовместны: ; 2) их объединение образует пространство элементарных исходов : 10

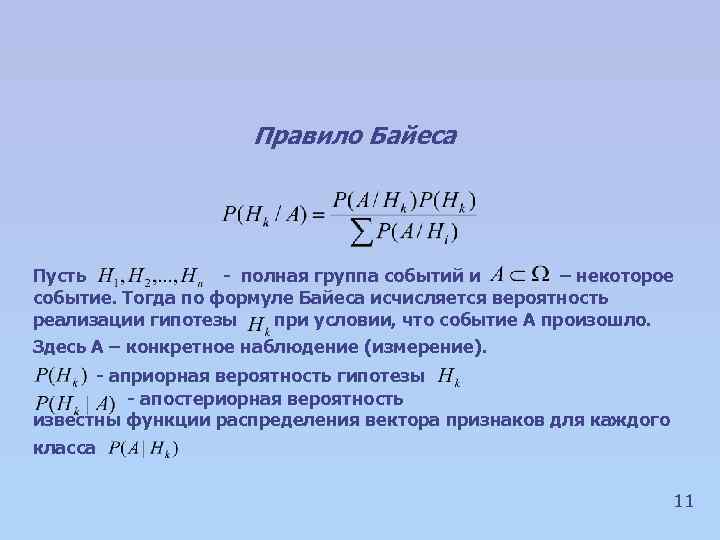

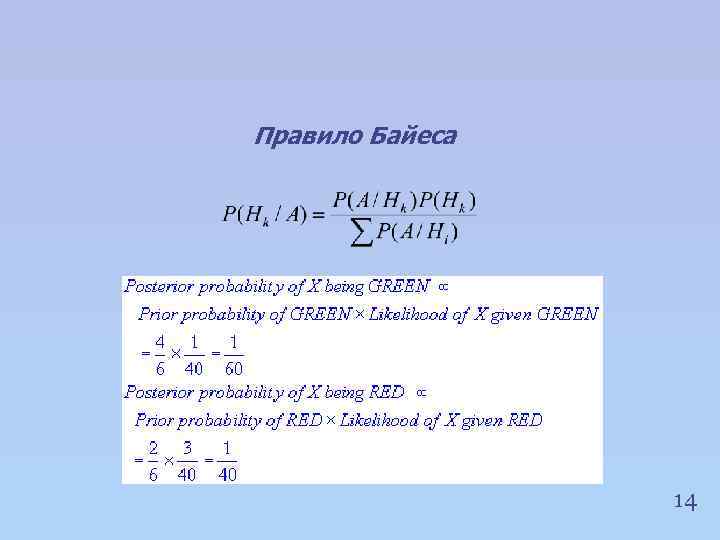

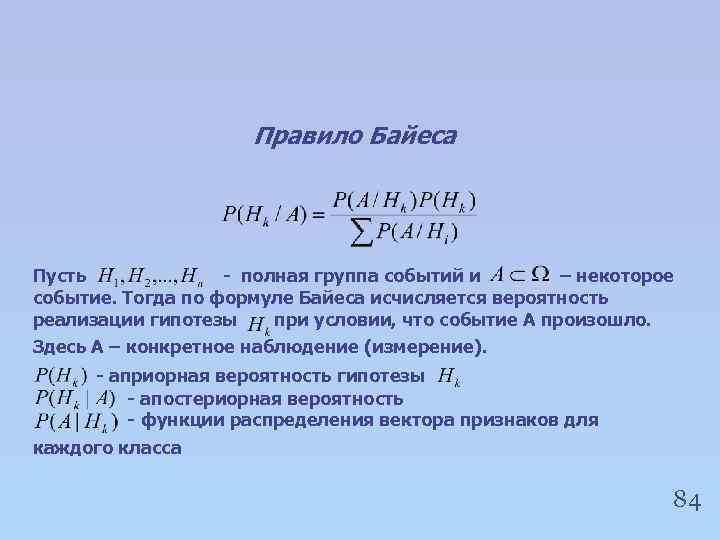

Правило Байеса Пусть - полная группа событий и – некоторое событие. Тогда по формуле Байеса исчисляется вероятность реализации гипотезы при условии, что событие А произошло. Здесь А – конкретное наблюдение (измерение). - априорная вероятность гипотезы - апостериорная вероятность известны функции распределения вектора признаков для каждого класса 11

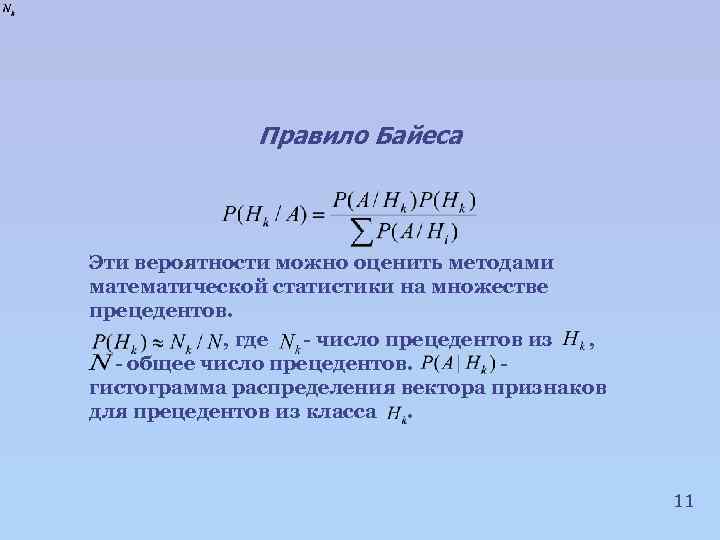

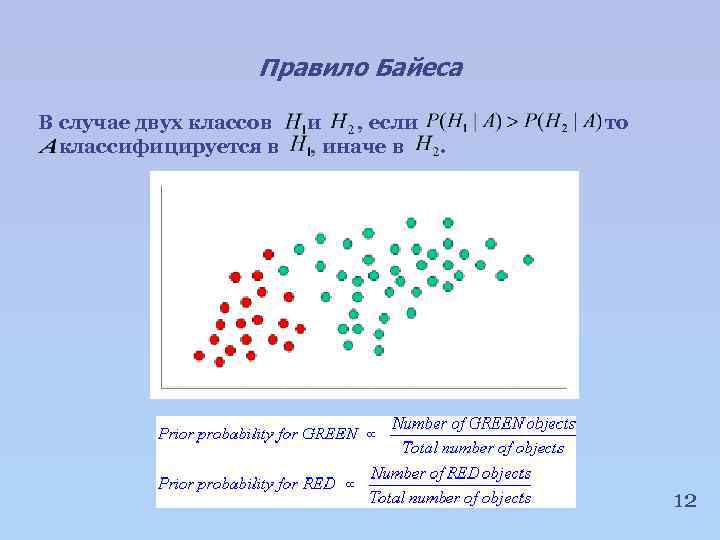

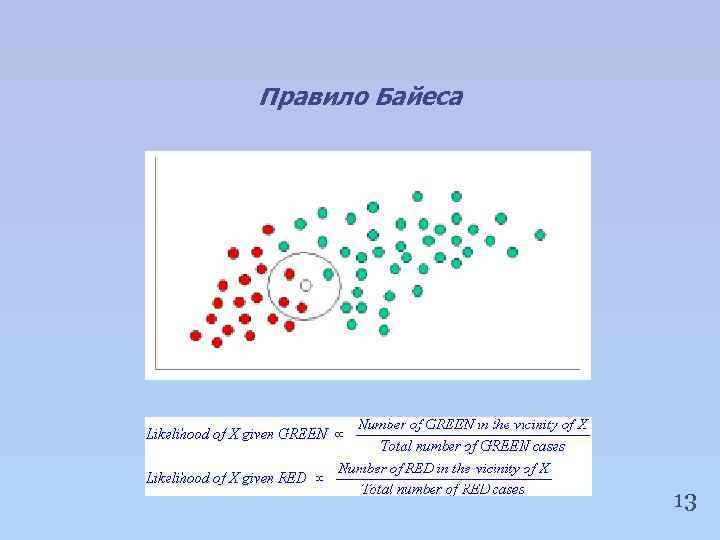

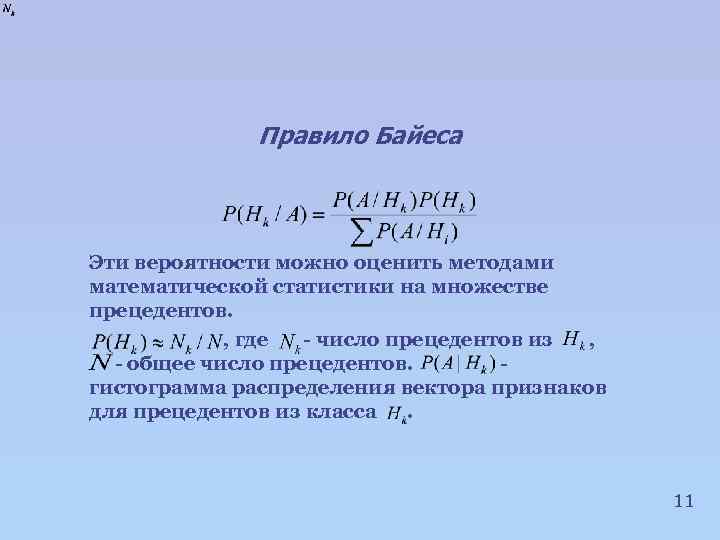

Правило Байеса Эти вероятности можно оценить методами математической статистики на множестве прецедентов. , где - число прецедентов из , - общее число прецедентов. гистограмма распределения вектора признаков для прецедентов из класса. 11

Правило Байеса В случае двух классов классифицируется в и , если , иначе в то. 12

Правило Байеса 13

Правило Байеса 14

Информационно-кодовая модель коммуникации Шеннона и Уивера, модифицированная для коммуникационного акта Якобсоном 15

Структура коммуникационной системы для организации речевого поведения (1) индивидуальная многомодальная модель мира правого полушария (2) социализированная модель мира левого полушария (3) подсистема управления синтезом речи (4) артикуляторные органы (5) периферия слуховой подсистемы (6) подсистема распознавания речи 16

Процесс порождения речи у человека 1. Порождение и восприятие речи 2. Представление речи во временной и частотной областях 17

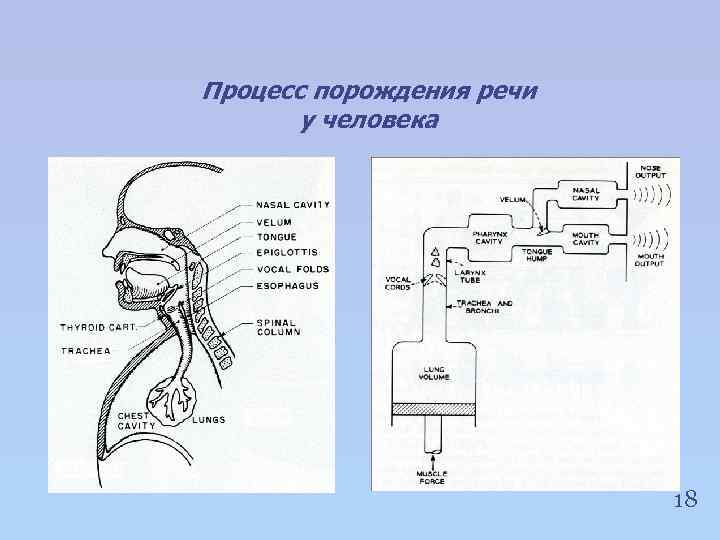

Процесс порождения речи у человека 18

Речевая волна во временной области Речевая волна, соответствующая началу фразы «It’s time» . Каждый отрезок на графике соответствует временному отрезку в 100 мсек. S – пауза, U – невокализованный, и V – вокализованный звуки. 19

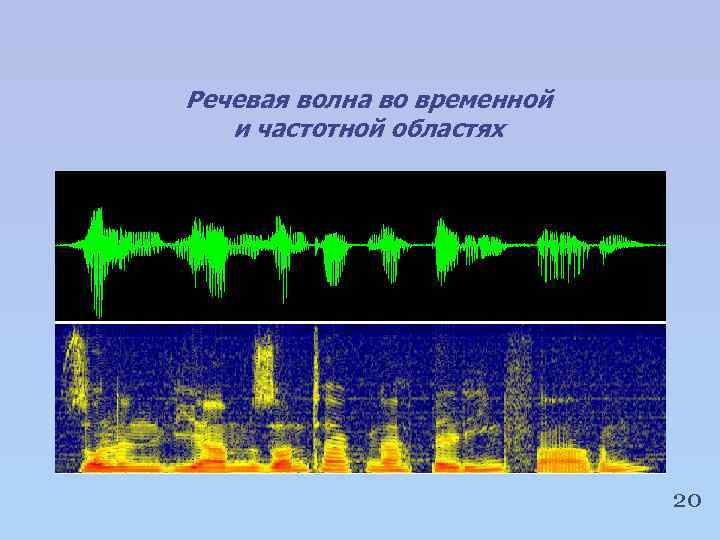

Речевая волна во временной и частотной областях 20

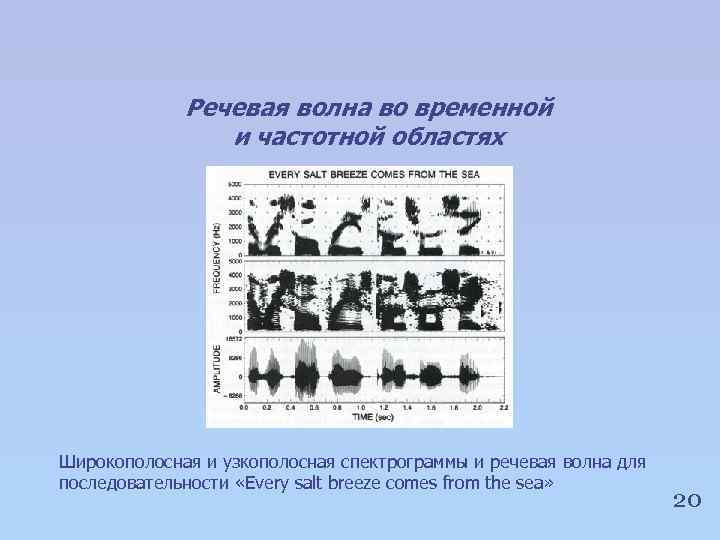

Речевая волна во временной и частотной областях Широкополосная и узкополосная спектрограммы и речевая волна для последовательности «Every salt breeze comes from the sea» 20

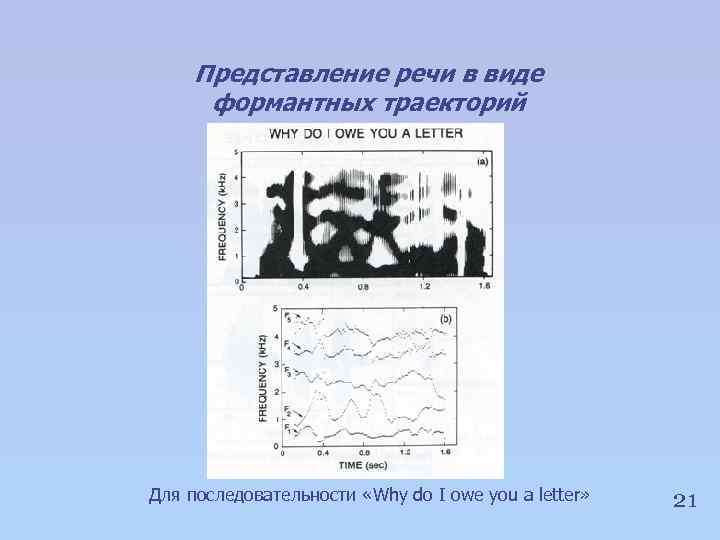

Представление речи в виде формантных траекторий Для последовательности «Why do I owe you a letter» 21

Перекрытие областей формантных частот Для разных звуков и дикторов в пространстве F 1 F 2 22

Положение центроидов основных гласных 23

Процесс восприятия речи человеком Структура речевой информации уровень семантических представлений (словарь попарной сочетаемости слов) синтаксический уровень (словарь синтаксем) лексикон (словарь корневых основ) морфологический уровень (словарь окончаний) акустико-фонетический уровень 31

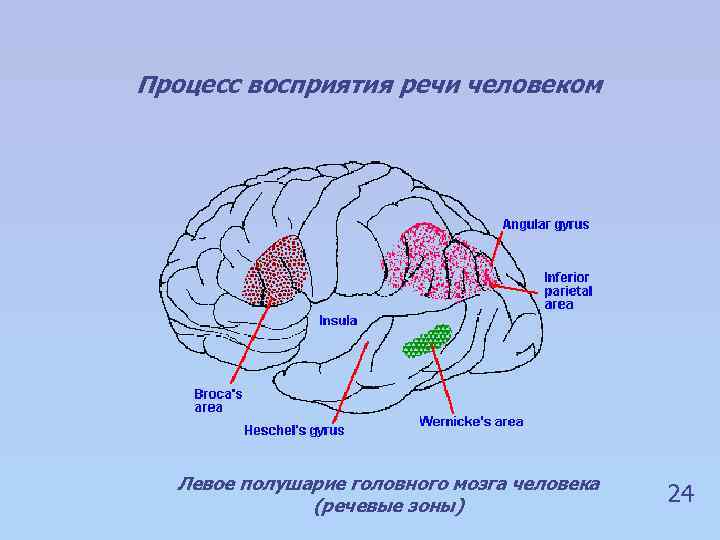

Процесс восприятия речи человеком Левое полушарие головного мозга человека (речевые зоны) 24

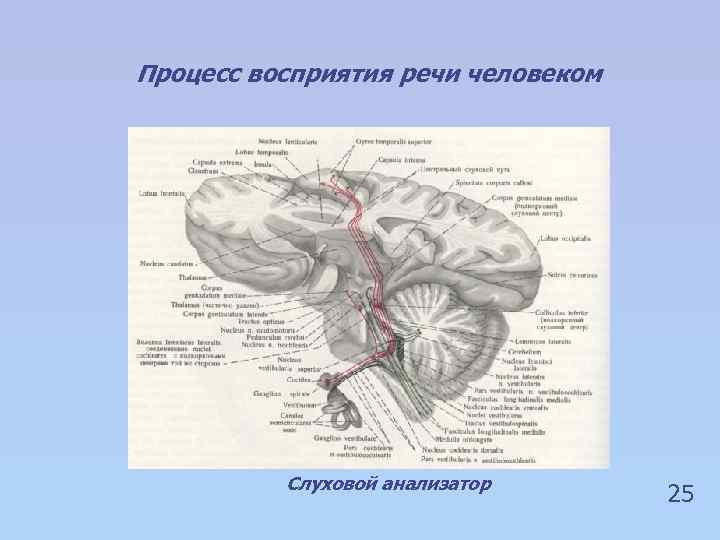

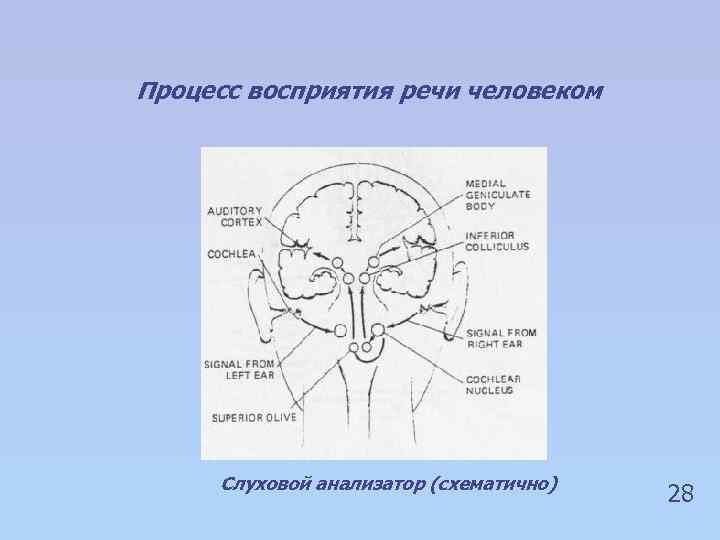

Процесс восприятия речи человеком Слуховой анализатор 25

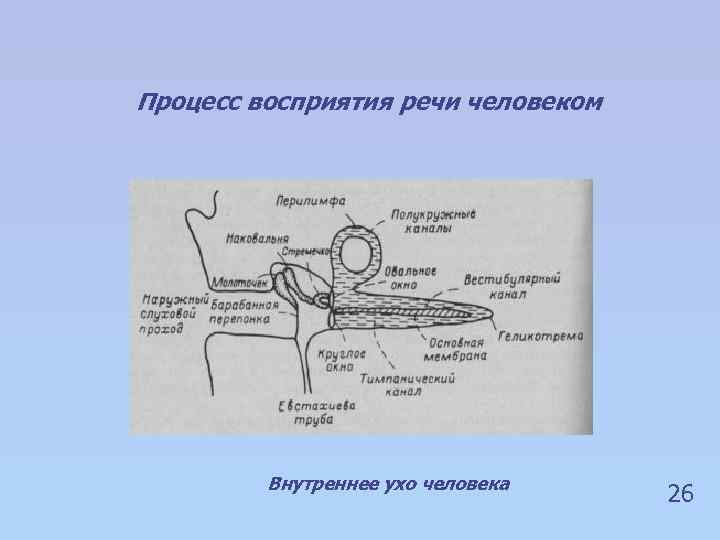

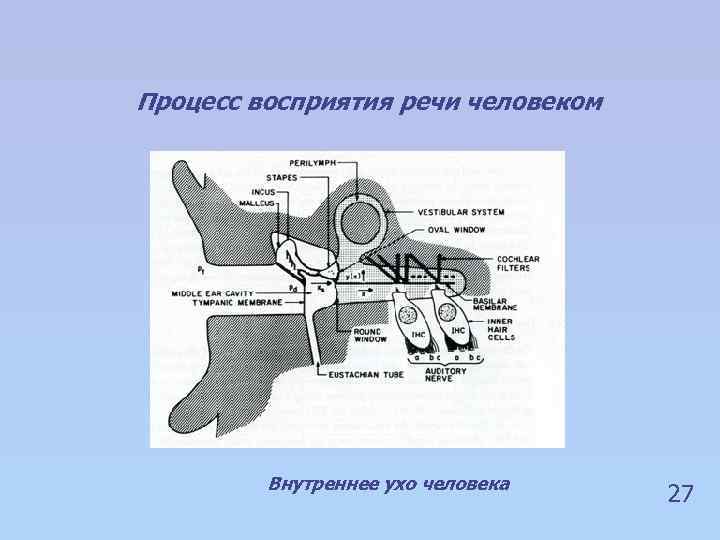

Процесс восприятия речи человеком Внутреннее ухо человека 26

Процесс восприятия речи человеком Внутреннее ухо человека 27

Процесс восприятия речи человеком Структура многослойной модели нейронной сети слуховой системы и изображение областей возбужденных нейронов на разных уровнях для двух последовательных звуковых сигналов разной частоты и интенсивности. Степень активности нейронов изображается зачернением. А. П. Молчанов и В. К. Лабутин 1967 29

Процесс восприятия речи человеком Обработка информации в слуховом анализаторе (по Лабутину) 30

Процесс восприятия речи человеком Слуховой анализатор (схематично) 28

Колонка коры (по Батуеву А. С. ) I. Пирамидные нейроны II. Дендриты III. Возвратные коллатерали IV. Боковые связи V. Аксоны VI-VII. Связи из других областей VIII. Вставочные нейроны 4

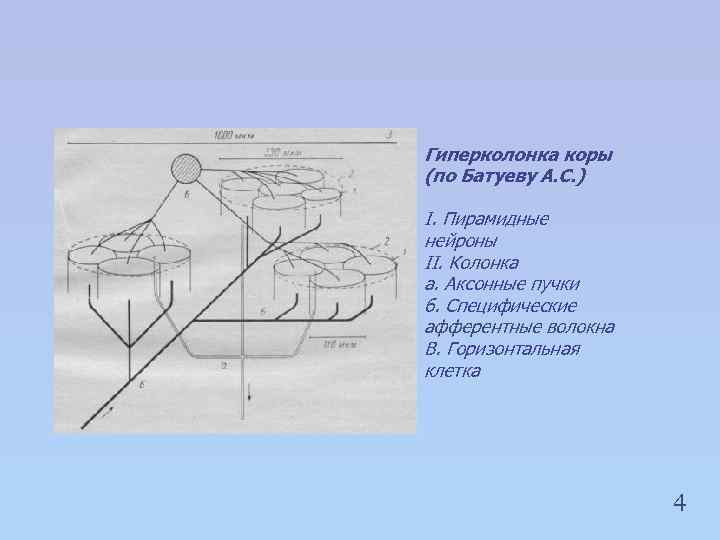

Гиперколонка коры (по Батуеву А. С. ) I. Пирамидные нейроны II. Колонка а. Аксонные пучки б. Специфические афферентные волокна В. Горизонтальная клетка 4

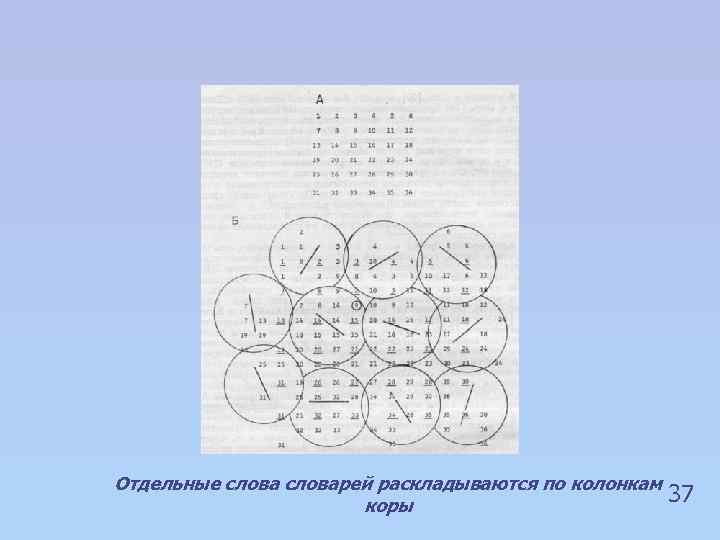

Отдельные словарей раскладываются по колонкам коры 37

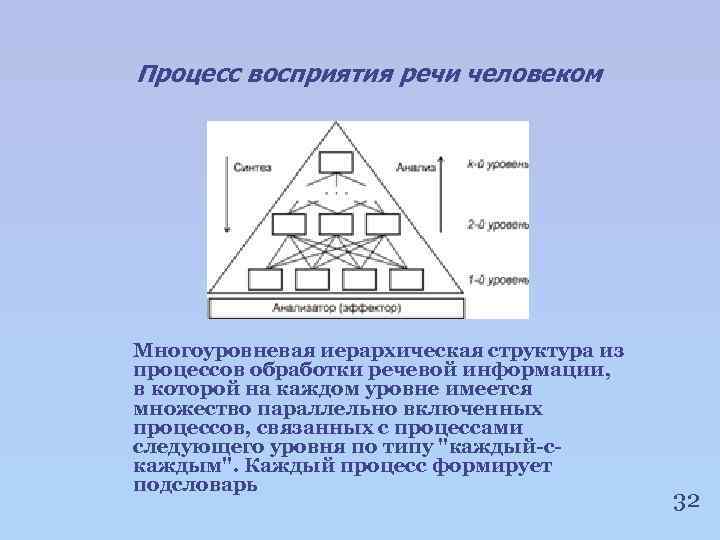

Процесс восприятия речи человеком Многоуровневая иерархическая структура из процессов обработки речевой информации, в которой на каждом уровне имеется множество параллельно включенных процессов, связанных с процессами следующего уровня по типу "каждый-скаждым". Каждый процесс формирует подсловарь 32

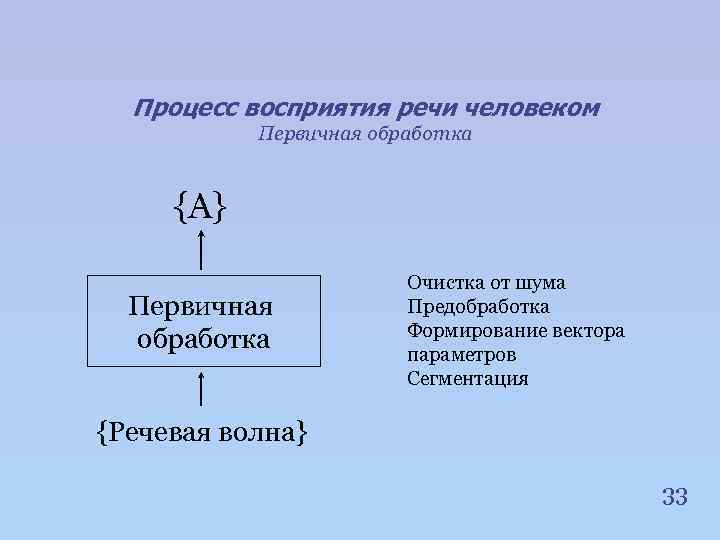

Процесс восприятия речи человеком Первичная обработка {A} Первичная обработка Очистка от шума Предобработка Формирование вектора параметров Сегментация {Речевая волна} 33

Процесс восприятия речи человеком Морфологический и лексический уровни Морфологическая обработка Формирование лексикона ^ {D} ^ {B} {A} - Словарь флективных морфем (окончаний) -Последовательность векторов параметров {C} ^ - Словарь корневых основ (корень+суффикс) - Множество текстов с купюрами вместо флективных морфем {B} - Словарь флективных морфем {A} - Множество произнесенных текстов 34

Процесс восприятия речи человеком Синтаксический и семантический уровни Синтаксическая обработка ^ {F} {E} ^ {D} {A} Семантическая обработка ^ - Словарь графов-синтаксем (синтаксических групп) {H} - Словарь попарной сочетаемости корневых основ - Произнесенный текст с купюрами вместо корневых основ {G} - Текст с купюрами вместо флективных морфем - Словарь корневых основ (корень+суффикс) ^ {F} - Словарь синтаксем (синтаксических групп) - Последовательность векторов параметров {A} - Произнесенный текст 35

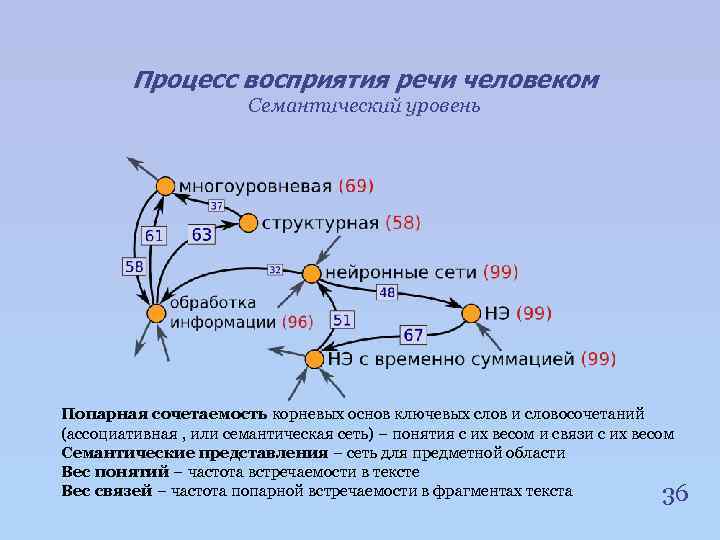

Процесс восприятия речи человеком Семантический уровень Попарная сочетаемость корневых основ ключевых слов и словосочетаний (ассоциативная , или семантическая сеть) – понятия с их весом и связи с их весом Семантические представления – сеть для предметной области Вес понятий – частота встречаемости в тексте Вес связей – частота попарной встречаемости в фрагментах текста 36

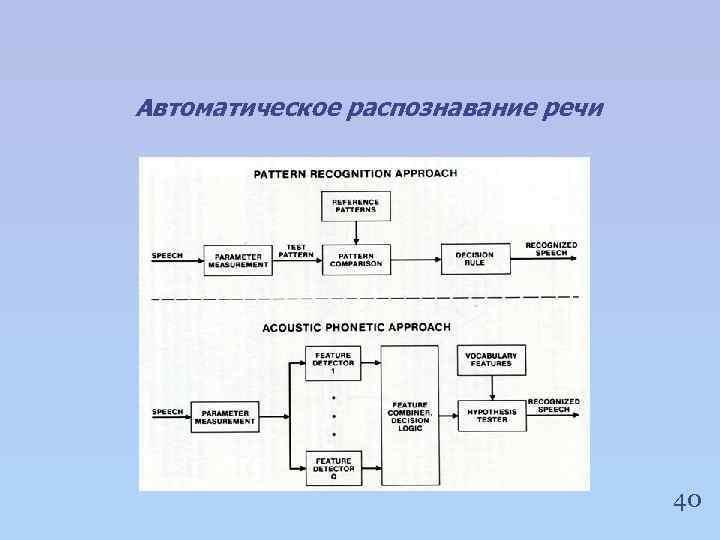

Автоматическое распознавание речи 1. Акустико-фонетический подход 2. Подход, основанный на распознавании образов 3. Подход на основе искусственного интеллекта 4. Подход, основанный на применении искусственных нейронных сетей 37

Автоматическое распознавание речи Базовый алгоритм распознавания речи 1) Формирование вектора признаков 2) Сегментация 3) Сравнение входного и эталонных образов 4) Принятие решения 38

Автоматическое распознавание речи Имеется три основных подхода к распознаванию речи 1. Акустико-фонетический подход 2. Подход, основанный на распознавании образов 3. Искусственно-интеллектуальный подход 4. Подход, основанный на использовании искусственных нейронных сетей 39

Автоматическое распознавание речи 40

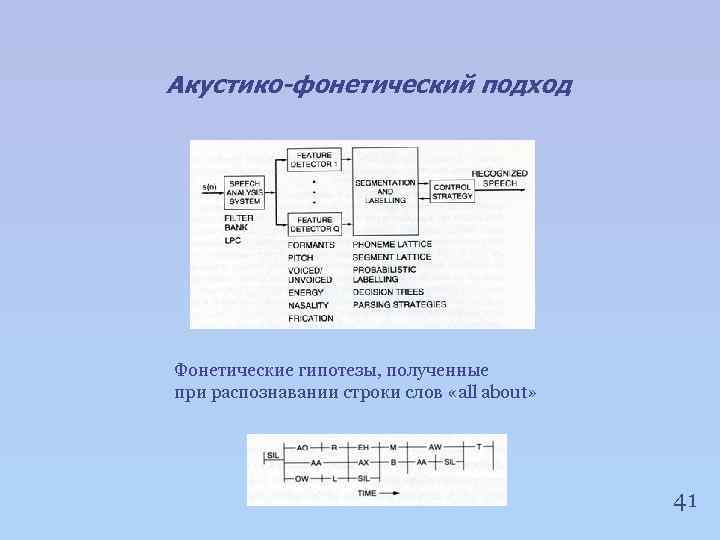

Акустико-фонетический подход Фонетические гипотезы, полученные при распознавании строки слов «all about» 41

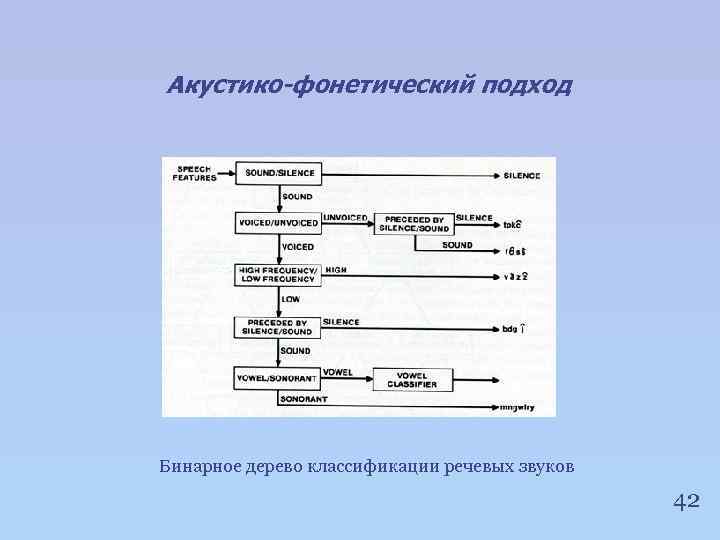

Акустико-фонетический подход Бинарное дерево классификации речевых звуков 42

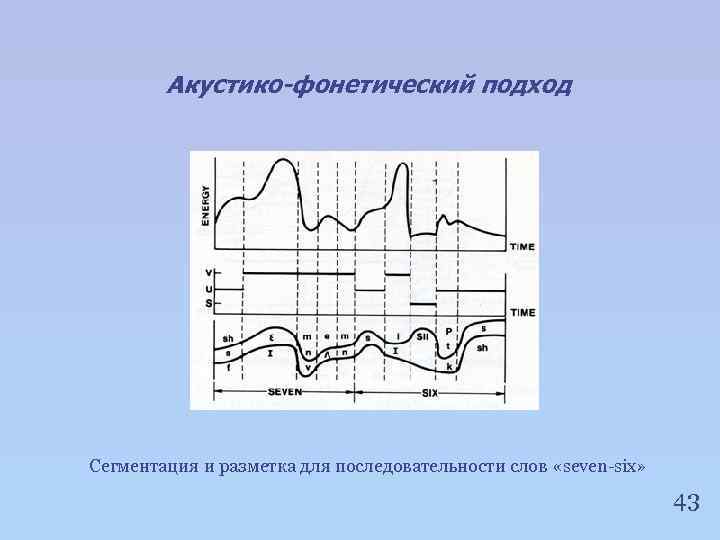

Акустико-фонетический подход Сегментация и разметка для последовательности слов «seven-six» 43

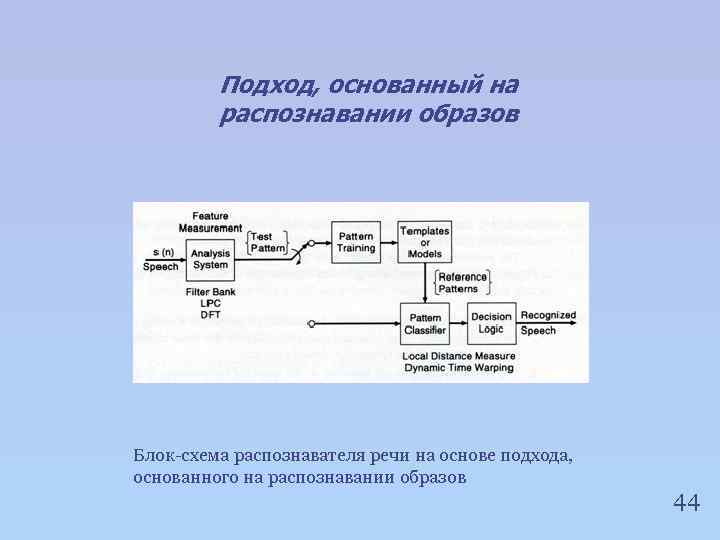

Подход, основанный на распознавании образов Блок-схема распознавателя речи на основе подхода, основанного на распознавании образов 44

Подход, основанный на распознавании образов Достоинства подхода: 1. Простота. Он легко интерпретируется 2. Имеется хорошо развитый математический аппарат для всех процедур подхода 3. Устойчивость и инвариантность к различным словарям, пользователям, выбору признаков, использования алгоритмов сравнения образов и принятия решения, а также групп дикторов, используемого оборудования, канала 4. Не зависит от выбора речевой единицы: от фонемы до фразы. Дает хорошие результаты в широком круге задач 45

Подход, основанный на распознавании образов Недостатки: 1. Чувствительность к объему обучающей выборки 2. Подверженность качества распознавания влиянию шума 3. Неиспользование лингвистической информации 4. Большая вычислительная емкость 46

Подход, основанный на распознавании образов Алгоритм включает четыре основных шага: 1) Измерение первичных признаков речевого сигнала. Вычисляются спектральные признаки, либо с помощью гребенки фильтров, либо с помощью линейного предсказывающего кодирования, либо с помощью дискретного преобразования Фурье. 2) Формирование эталонов (обучение). Эталоны формируются с помощью некоторых усредняющих процедур. Это может быть модель, характеризующая статистику признаков эталона. 3) Классификация, во время которой входной образ сравнивается с эталонами. Сравнение образов, которые есть последовательность векторов признаков, осуществляется с использованием как локального расстояния между двумя синхронными векторами, так и глобальной выравнивающей во времени процедуры (чаще всего, это процедура динамического программирования), которая компенсирует различные скорости Произнесения входного и эталонного образов. 4) Принятие решения 47

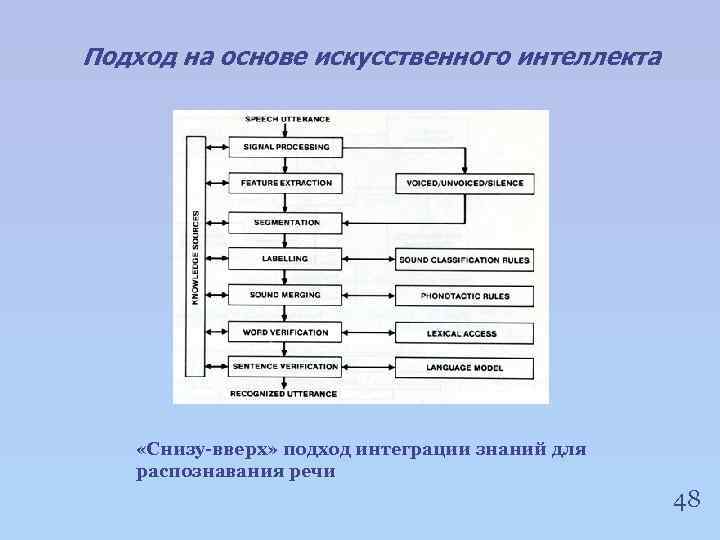

Подход на основе искусственного интеллекта «Снизу-вверх» подход интеграции знаний для распознавания речи 48

Подход на основе искусственного интеллекта «Сверху-вниз» подход к интеграции знаний для распознавания речи 49

Подход на основе искусственного интеллекта Подход, основанный на концепции классной доски для интеграции знаний 50

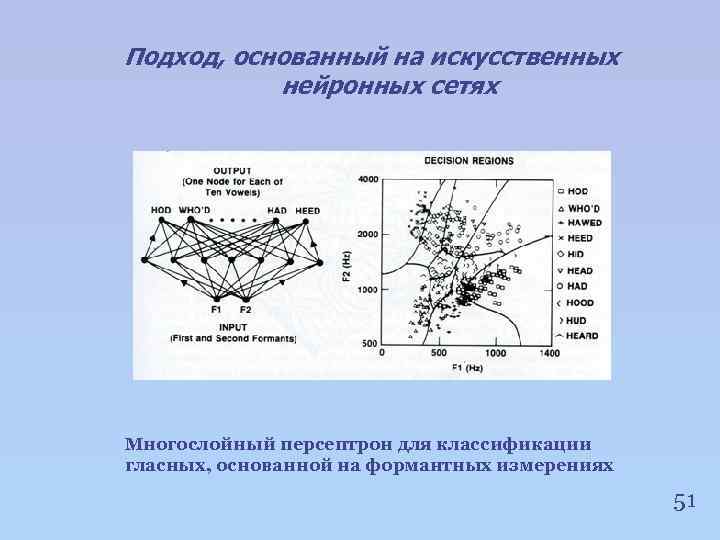

Подход, основанный на искусственных нейронных сетях Многослойный персептрон для классификации гласных, основанной на формантных измерениях 51

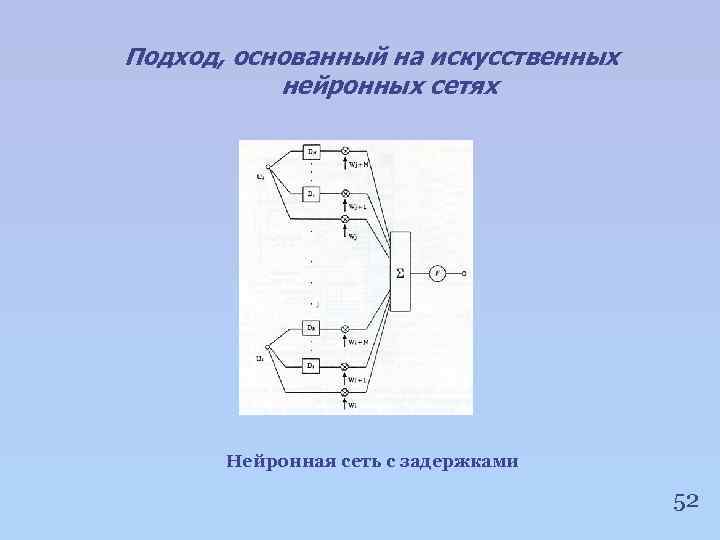

Подход, основанный на искусственных нейронных сетях Нейронная сеть с задержками 52

Первичная обработка Наиболее характерные подходы: 1. Спектральный анализ - с помощью гребенки фильтров - линейное предсказывающее кодирование 2. Антропоморфная модель 53

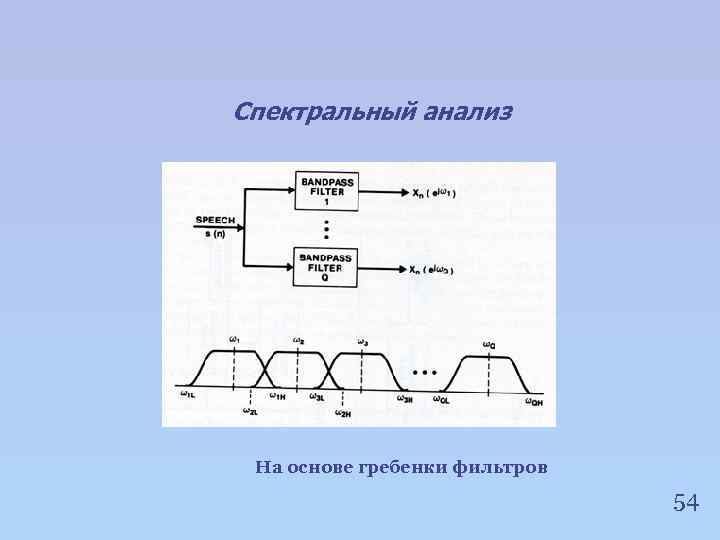

Спектральный анализ На основе гребенки фильтров 54

Спектральный анализ На основе полной гребенки фильтров 55

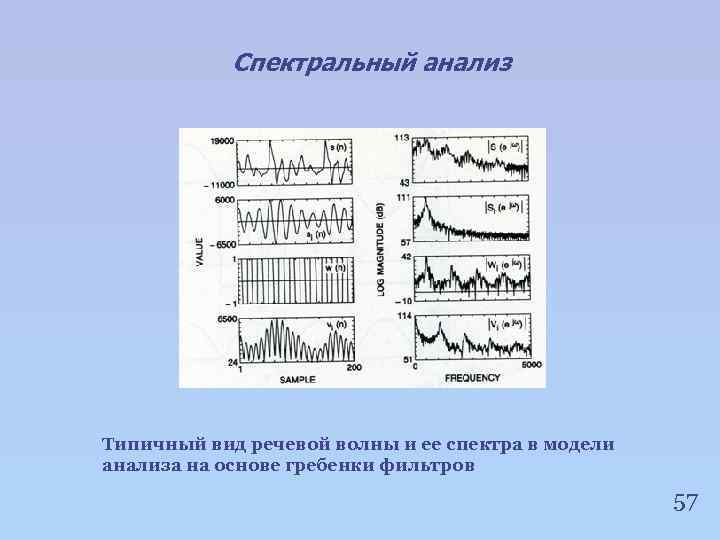

Спектральный анализ Типичный вид речевой волны и ее спектра в модели анализа на основе гребенки фильтров 57

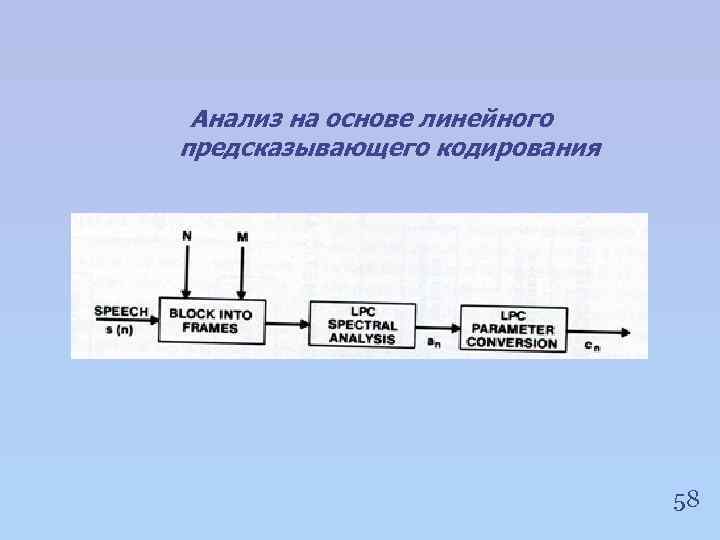

Анализ на основе линейного предсказывающего кодирования 58

Анализ на основе линейного предсказывающего кодирования Достоинства подхода: 1. ЛПК представляет собой очень хорошую модель речевого сигнала. Особенно для квази-стационарных гласных, где ЛПК дает хорошую аппроксимацию спектральной огибающей 2. Способ, которым применяется ЛПК, приводит к разделению моделей источника речевого сигнала и речевого тракта. Становится возможным получить характеристики речевого тракта из речевого сигнала 3. ЛПК метод хорошо интерпретируется математически. Вычислительная сложность ЛПК алгоритмов меньше таковой для гребенки фильтров при равном качестве представления сигнала 4. ЛПК модель хорошо работает в речевых приложениях. Решения на основе ЛПК дают нехудший результат по сравнению с гребенкой фильтров 59

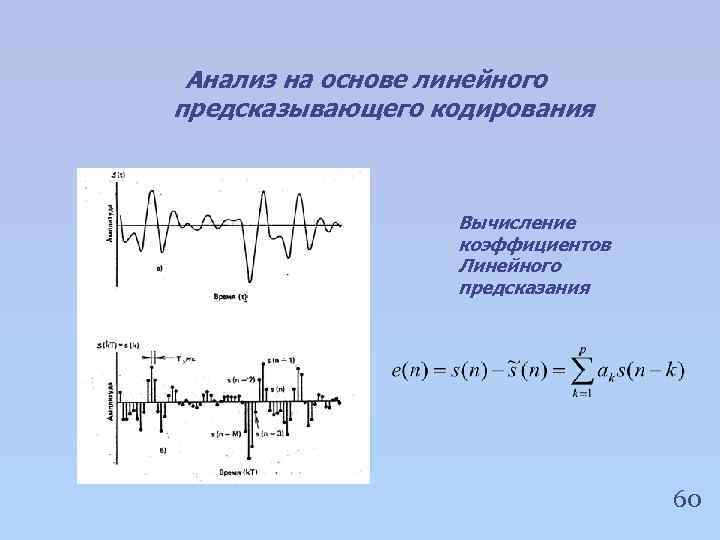

Анализ на основе линейного предсказывающего кодирования Вычисление коэффициентов Линейного предсказания 60

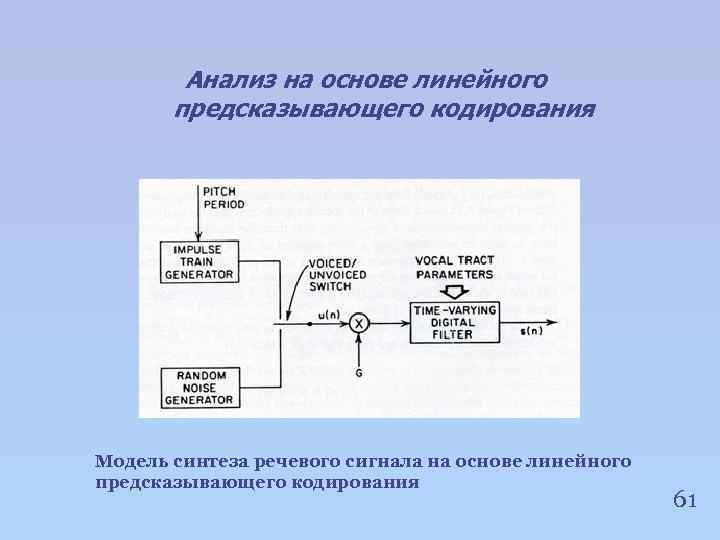

Анализ на основе линейного предсказывающего кодирования Модель синтеза речевого сигнала на основе линейного предсказывающего кодирования 61

Векторное квантование Достоинства векторного квантования: 1. ВК уменьшает скорость передачи информации. 2. Уменьшает объем вычислений, поскольку векторы из кодовой книги меняются реже, чем из континуального множества. 3. Приводит к дискретизации представления речевой волны, так как позволяет пометить вектора кодовой книги метками соответствующих фонем. 4. Увеличивает ошибку квантования. 5. Требуется большой объем памяти для хранения кодовой книги. 62

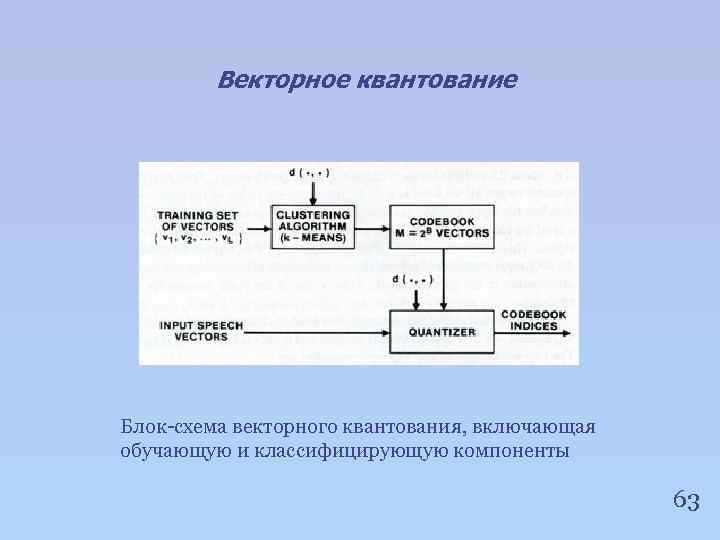

Векторное квантование Блок-схема векторного квантования, включающая обучающую и классифицирующую компоненты 63

Векторное квантование ВК формирует из обучающего множества векторов признаков , которые предполагаются хорошо аппроксимирующими все возможное множество векторов признаков, формируемых на входе ВК при произнесении всех возможных вариантов словаря системы всеми дикторами. Обучающий ВК алгоритм определяет оптимальное множество кодовых книг векторов признаков, такое, что средняя дисперсия, получаемая при замене любого вектора обучающего множества на его кодовую книгу , является минимальной. 64

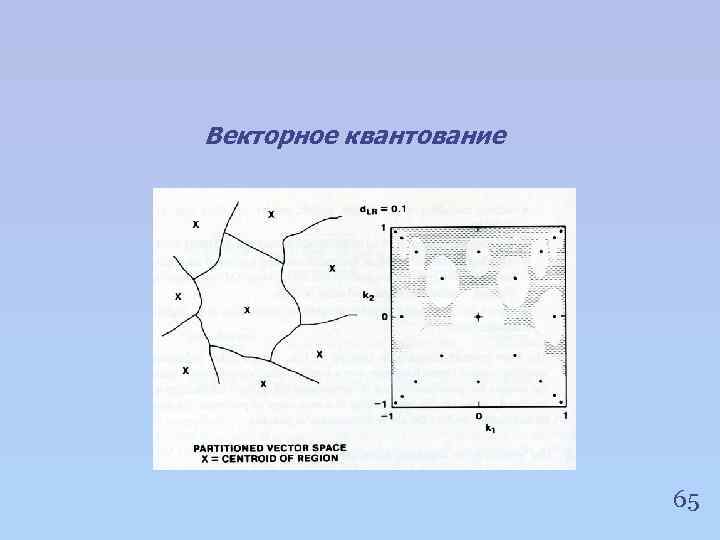

Векторное квантование 65

Антропоморфная модель анализа Психоакустическое сглаживание спектра К основным свойствам психоакустического восприятия человека относятся следующие два. Во-первых, нелинейная деформация физических шкал частоты и интенсивности в перцептивные шкалы барков и громкости. Спектр исходного сигнала преобразуется в значения выходов гребенки фильтров, каждый из которых интегрирует значения спектра во всем диапазоне, взвешенные некоторой функцией с максимумом на центральной частоте фильтра и убывающей к краям. Центральные частоты фильтров распределены неравномерно по шкале частот и расстояния между ними увеличиваются с увеличением частоты. Это преобразование шкалы частот в шкалу барков, являющуюся линейной для восприятия речи. 66

Психоакустическое сглаживание спектра Во-вторых, разделение непрерывного спектра на небольшое число полос с интеграцией значений спектра в этих полосах. Выходы фильтров умножаются на коэффициенты, получаемые на основе так называемой кривой равной громкости и подвергаются извлечению кубического корня, что учитывает различия в восприятии амплитуды сигнала на различных частотах и преобразует шкалу интенсивности в шкалу громкости. Перцептивно сглаженный спектр мощности сигнала восстанавливается затем при помощи линейной интерполяции между выходами фильтров. Метод перцептивного линейного предсказания 5 -го порядка, позволяет получить формантные кривые такие же гладкие, как и стандартный ЛП-кодер 13 порядка. 67

Психоакустическое сглаживание спектра 68

![Психоакустическое сглаживание спектра Частотные отклики базилярной мембраны кошки (по Ghitza [7]) 69 Психоакустическое сглаживание спектра Частотные отклики базилярной мембраны кошки (по Ghitza [7]) 69](https://present5.com/presentation/43752474_72501942/image-73.jpg)

Психоакустическое сглаживание спектра Частотные отклики базилярной мембраны кошки (по Ghitza [7]) 69

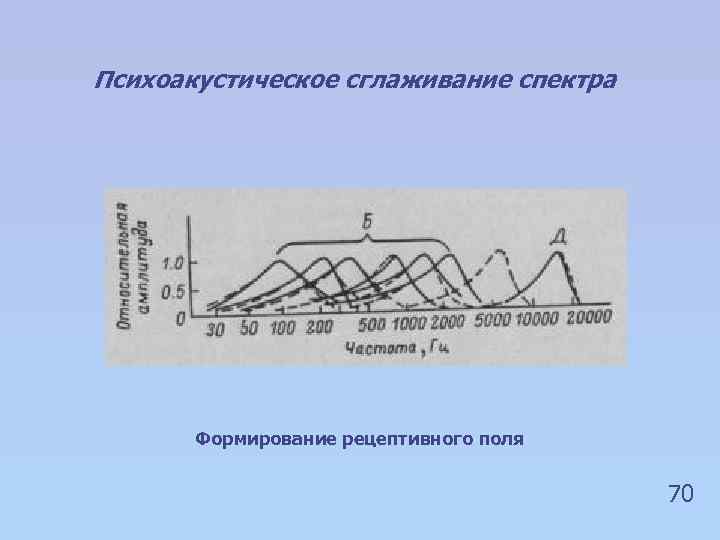

Психоакустическое сглаживание спектра Формирование рецептивного поля 70

Психоакустическое сглаживание спектра Рецептивное поле. Центр, в данном случае off-центр, образует небольшая группа рецепторов, имеющих мощные возбуждающие синапсы с одиночной биполярной клеткой. Одна или несколько таких клеток соединены с ганглиозной клеткой, формируя ее центр. Периферию рецептивного поля биполярной клетки создает значительно большее число рецепторов), соединенных с горизонтальной клеткой возбуждающими синапсами. 75

![Психоакустическое сглаживание спектра Амплитуды откликов модели внутреннего уха (по Ghitza [7]) 72 Психоакустическое сглаживание спектра Амплитуды откликов модели внутреннего уха (по Ghitza [7]) 72](https://present5.com/presentation/43752474_72501942/image-76.jpg)

Психоакустическое сглаживание спектра Амплитуды откликов модели внутреннего уха (по Ghitza [7]) 72

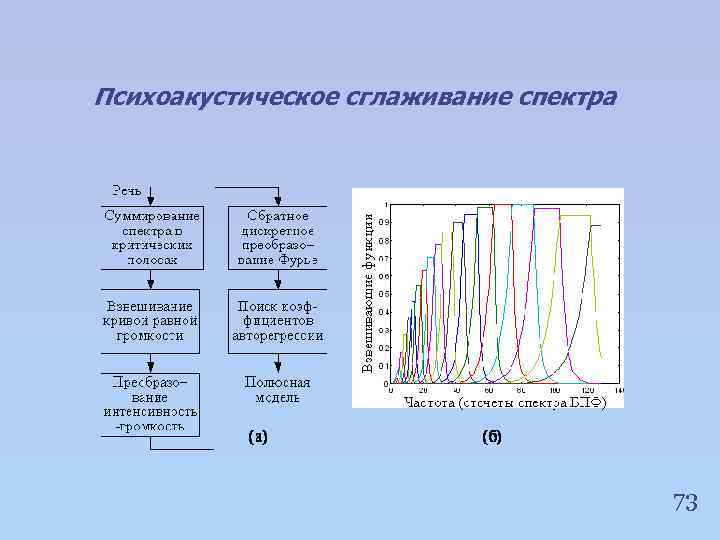

Психоакустическое сглаживание спектра 73

Психоакустическое сглаживание спектра Сравнение обычного и перцептивного ЛП Метод перцептивного линейного предсказания 5 -го порядка, позволяет получить формантные кривые такие же гладкие, как и стандартный ЛПкодер 13 порядка 74

Принятие решения 1. 2. 3. Динамическое программирование Байесовское правило Скрытые Марковские модели 75

Принятие решения Ключевым вопросом в распознавании речи является вопрос сравнения входного образа с эталонными образами с целью выяснения степени их подобия Обычно входной и эталонный образы имеют разную длину Сравниваемые образы не могут быть нормализованы по длительности, поскольку различные типы звуков имеет различные возможности по удлинению произнесения Необходимо найти способ сравнения спектральных векторов такой, чтобы можно было вычислять глобальную меру совпадения образов. 75

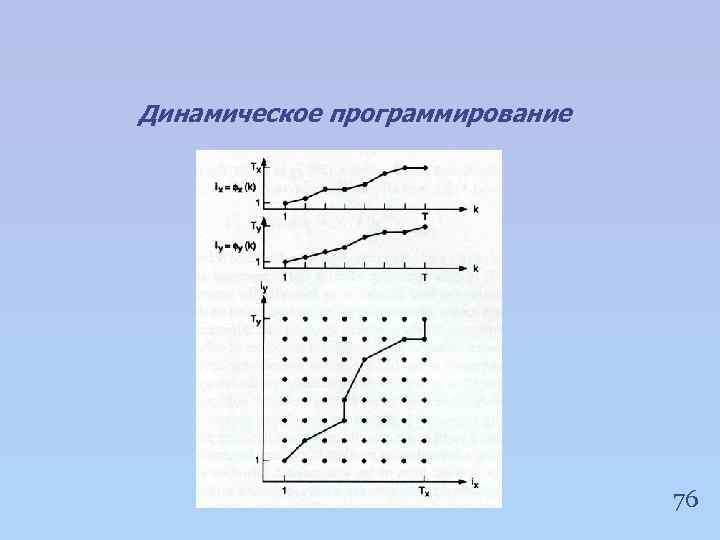

Динамическое программирование 76

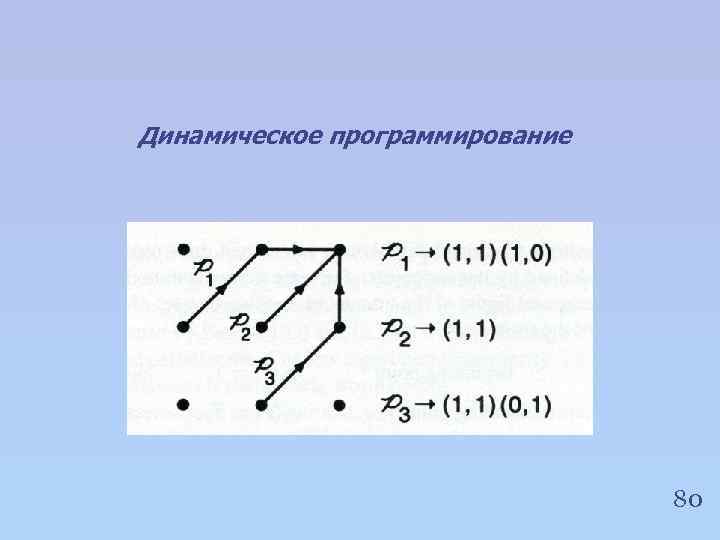

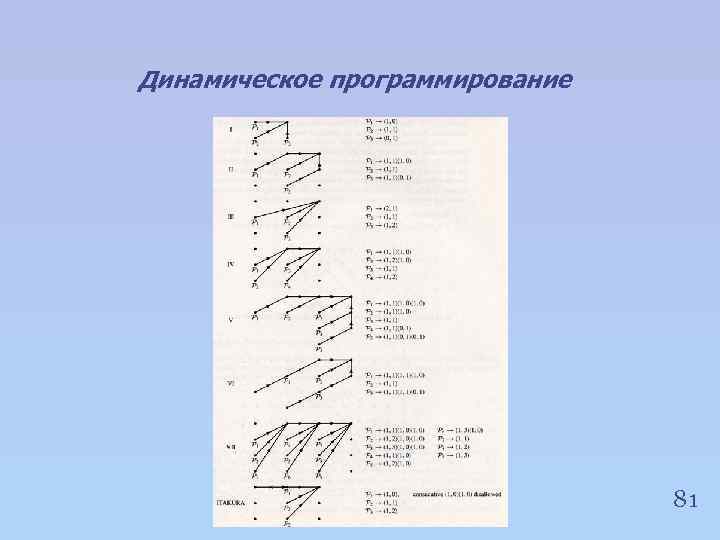

Динамическое программирование Процедура динамического программирования сводится к нелинейному нормированию во времени двух развертывающихся во времени речевых процессов - входного и эталонного речевых событий. При обучении некоторым образом формируются эталонные образы слов в виде последовательности векторов параметров речевого сигнала. Каждый вектор описывает речевой сигнал на интервале наблюдения, длительность которого обычно выбирается равной среднему периоду основного тона, равному 15 мсек. 77

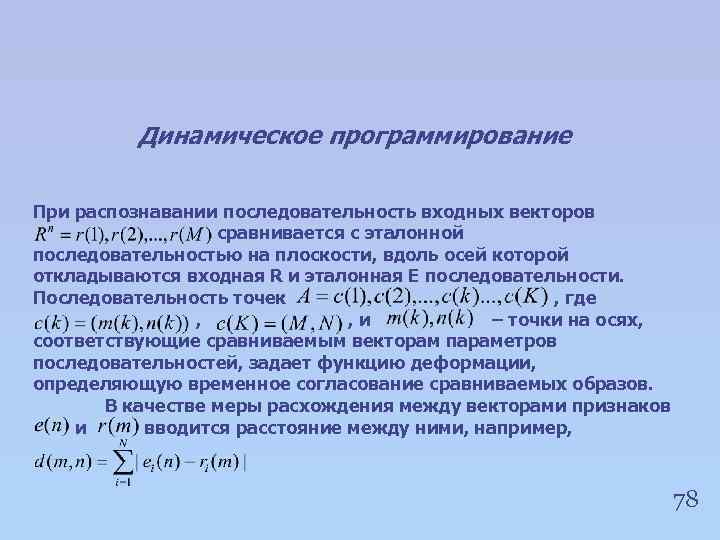

Динамическое программирование При распознавании последовательность входных векторов сравнивается с эталонной последовательностью на плоскости, вдоль осей которой откладываются входная R и эталонная E последовательности. Последовательность точек , где , , и – точки на осях, соответствующие сравниваемым векторам параметров последовательностей, задает функцию деформации, определяющую временное согласование сравниваемых образов. В качестве меры расхождения между векторами признаков и вводится расстояние между ними, например, 78

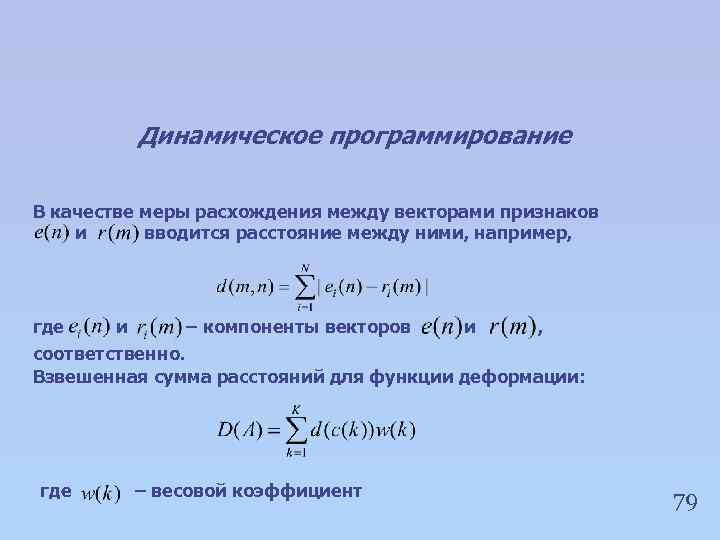

Динамическое программирование В качестве меры расхождения между векторами признаков и вводится расстояние между ними, например, где и – компоненты векторов и , соответственно. Взвешенная сумма расстояний для функции деформации: где – весовой коэффициент 79

Динамическое программирование 80

Динамическое программирование 81

Динамическое программирование Допустимый коридор сравнения 82

Динамическое программирование Допустимый коридор сравнения 82

Правило Байеса Адресант передает, а адресат принимает одно из группы событий (классов, к которым относятся передаваемые и получаемые сообщения). Группа событий обладает следующими свойствами (она - полная): 1) все события попарно несовместны: ; 2) их объединение образует пространство элементарных исходов : 83

Правило Байеса Пусть - полная группа событий и – некоторое событие. Тогда по формуле Байеса исчисляется вероятность реализации гипотезы при условии, что событие А произошло. Здесь А – конкретное наблюдение (измерение). - априорная вероятность гипотезы - апостериорная вероятность - функции распределения вектора признаков для каждого класса 84

Правило Байеса Эти вероятности можно оценить методами математической статистики на множестве прецедентов. , где - число прецедентов из , - общее число прецедентов. гистограмма распределения вектора признаков для прецедентов из класса. 11

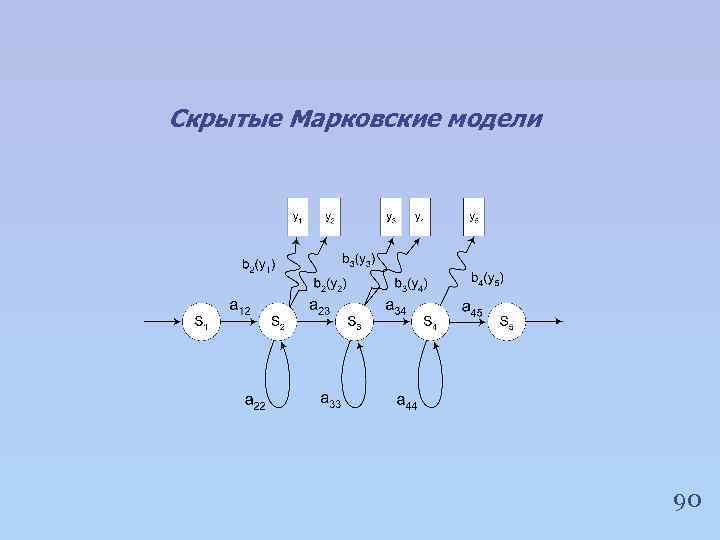

Скрытые Марковские модели • Последовательность состояний модели, моделирующих временную структуру речи, является функцией некоторого случайного процесса; наблюдаемый процесс, определяемый локально-стационарными свойствами речевого сигнала, также является случайным процессом • Модель является скрытой, так как основной процесс (последовательность состояний) непосредственно не наблюдается • Основной процесс перехода между стационарными состояниями является Марковским, так как статистические данные текущего состояния зависят только от его собственных характеристик и характеристик предыдущего состояния 87

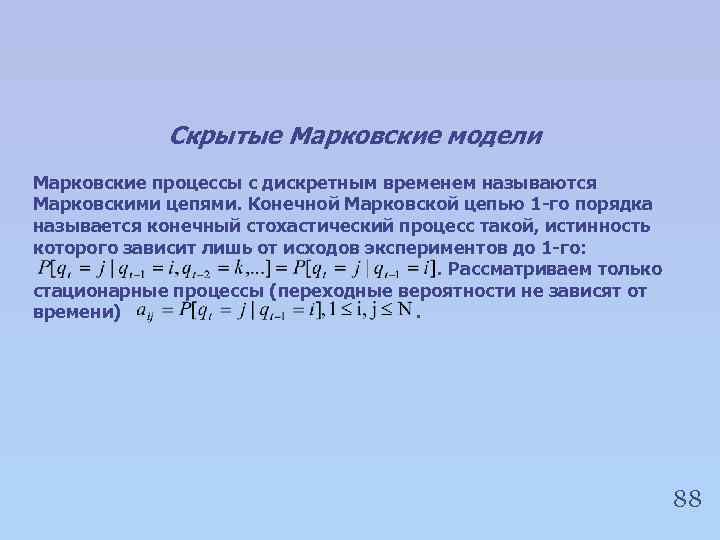

Скрытые Марковские модели Марковские процессы с дискретным временем называются Марковскими цепями. Конечной Марковской цепью 1 -го порядка называется конечный стохастический процесс такой, истинность которого зависит лишь от исходов экспериментов до 1 -го: . Рассматриваем только стационарные процессы (переходные вероятности не зависят от времени). 88

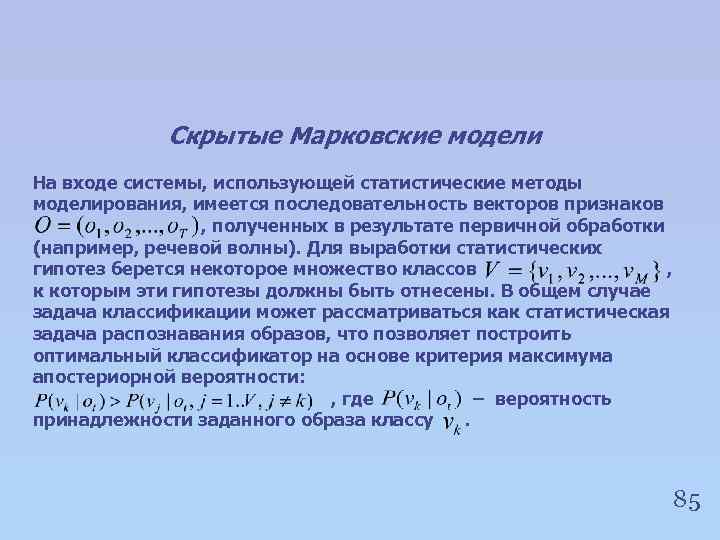

Скрытые Марковские модели На входе системы, использующей статистические методы моделирования, имеется последовательность векторов признаков , полученных в результате первичной обработки (например, речевой волны). Для выработки статистических гипотез берется некоторое множество классов , к которым эти гипотезы должны быть отнесены. В общем случае задача классификации может рассматриваться как статистическая задача распознавания образов, что позволяет построить оптимальный классификатор на основе критерия максимума апостериорной вероятности: , где – вероятность принадлежности заданного образа классу. 85

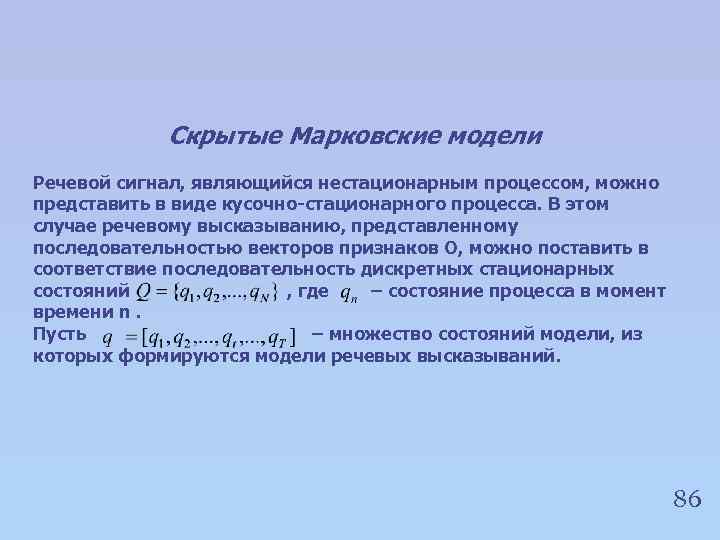

Скрытые Марковские модели Речевой сигнал, являющийся нестационарным процессом, можно представить в виде кусочно-стационарного процесса. В этом случае речевому высказыванию, представленному последовательностью векторов признаков O, можно поставить в соответствие последовательность дискретных стационарных состояний , где – состояние процесса в момент времени n. Пусть – множество состояний модели, из которых формируются модели речевых высказываний. 86

Скрытые Марковские модели 90

Скрытые Марковские модели Практические применения аппарата СММ основано на методах решения трех следующих проблем: 1. Распознавание речевого высказывания, моделируемого СММ 2. Сегментация (Алгоритм Витерби) 3. Обучение (оценка параметров) СММ по выборке данных 91

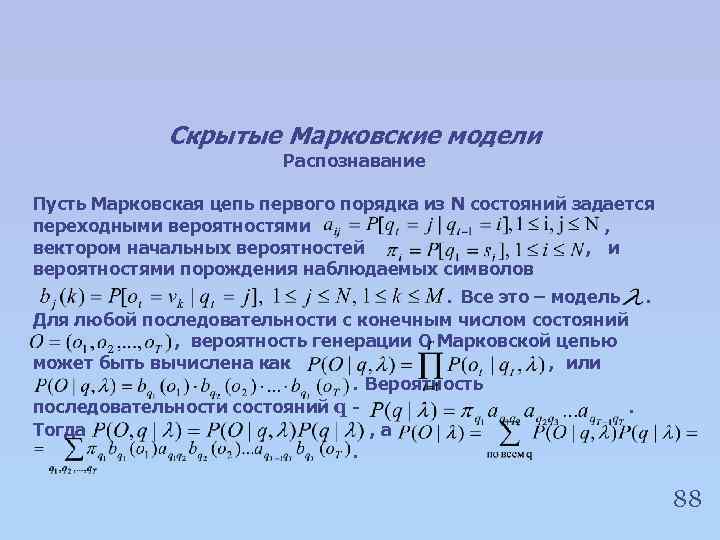

Скрытые Марковские модели Распознавание Пусть Марковская цепь первого порядка из N состояний задается переходными вероятностями , вектором начальных вероятностей , и вероятностями порождения наблюдаемых символов . Все это – модель. Для любой последовательности с конечным числом состояний , вероятность генерации O Марковской цепью может быть вычислена как , или. Вероятность последовательности состояний q. Тогда , а. 88

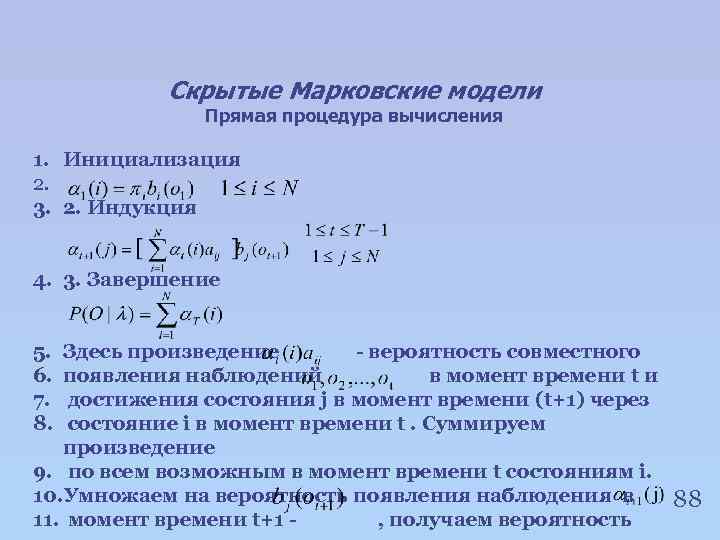

Скрытые Марковские модели Прямая процедура вычисления 1. Инициализация 2. 3. 2. Индукция 4. 3. Завершение 5. 6. 7. 8. Здесь произведение - вероятность совместного появления наблюдений в момент времени t и достижения состояния j в момент времени (t+1) через состояние i в момент времени t. Суммируем произведение 9. по всем возможным в момент времени t состояниям i. 10. Умножаем на вероятность появления наблюдения в 11. момент времени t+1 , получаем вероятность 88

Скрытые Марковские модели Прямая процедура вычисления 88

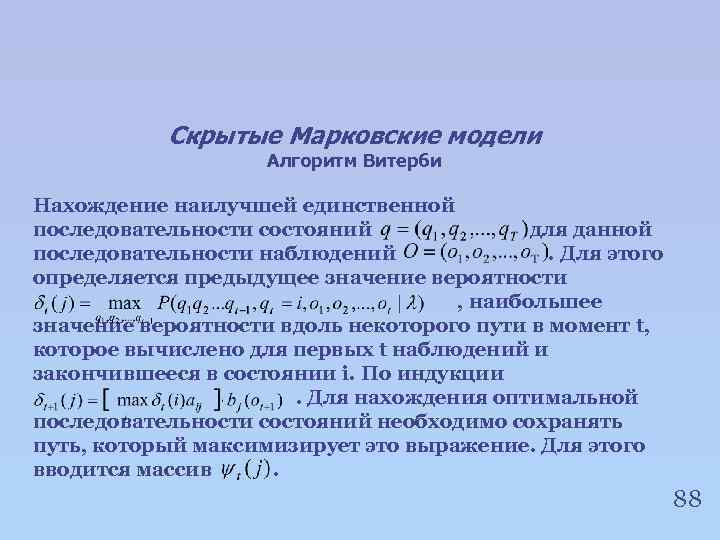

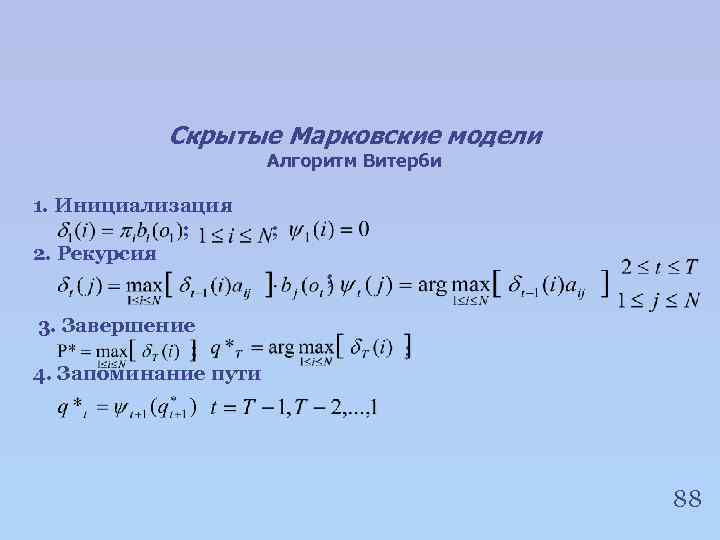

Скрытые Марковские модели Алгоритм Витерби Нахождение наилучшей единственной последовательности состояний для данной последовательности наблюдений. Для этого определяется предыдущее значение вероятности , наибольшее значение вероятности вдоль некоторого пути в момент t, которое вычислено для первых t наблюдений и закончившееся в состоянии i. По индукции. Для нахождения оптимальной последовательности состояний необходимо сохранять путь, который максимизирует это выражение. Для этого вводится массив. 88

Скрытые Марковские модели Алгоритм Витерби 1. Инициализация ; 2. Рекурсия ; ; 3. Завершение ; 4. Запоминание пути ; 88

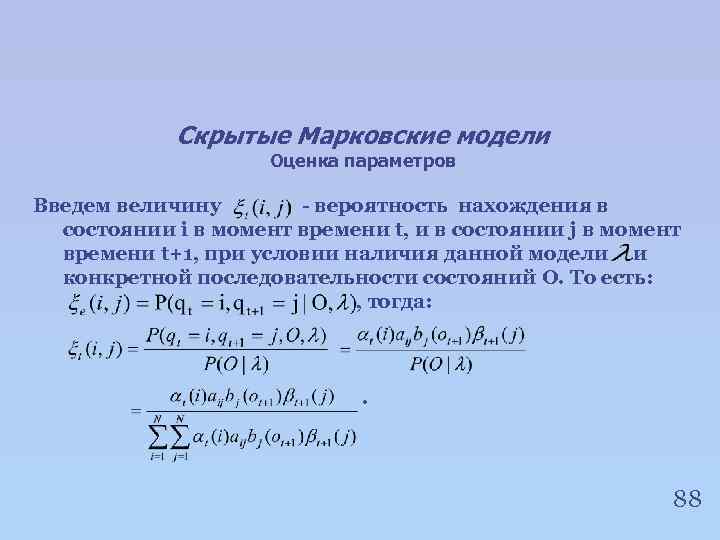

Скрытые Марковские модели Оценка параметров Введем величину - вероятность нахождения в состоянии i в момент времени t, и в состоянии j в момент времени t+1, при условии наличия данной модели и конкретной последовательности состояний O. То есть: , тогда: . 88

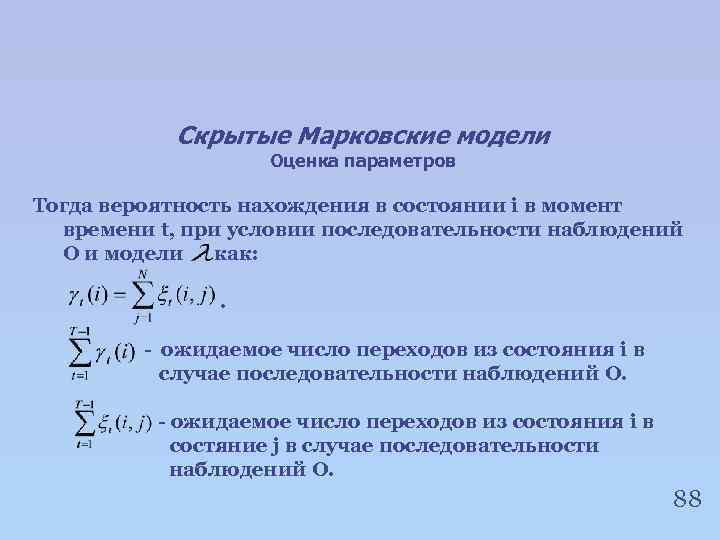

Скрытые Марковские модели Оценка параметров Тогда вероятность нахождения в состоянии i в момент времени t, при условии последовательности наблюдений O и модели как: . - ожидаемое число переходов из состояния i в случае последовательности наблюдений O. - ожидаемое число переходов из состояния i в состяние j в случае последовательности наблюдений O. 88

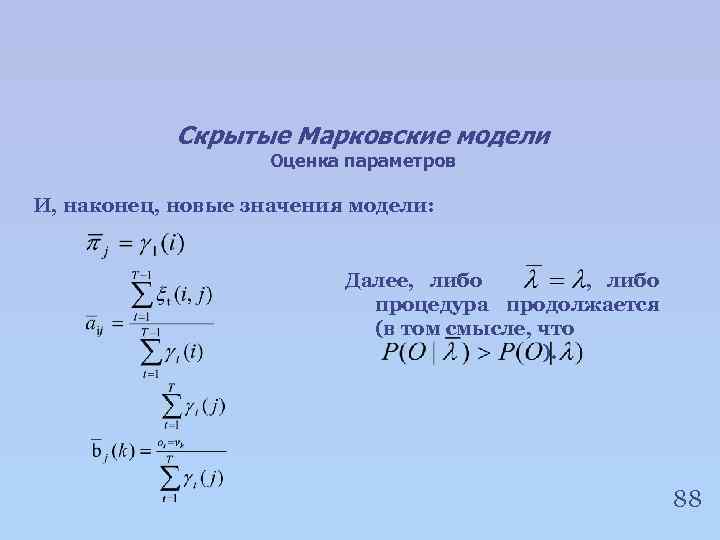

Скрытые Марковские модели Оценка параметров И, наконец, новые значения модели: Далее, либо процедура продолжается (в том смысле, что ). 88

Стандартный СММ распознаватель • Включает предобработку, сегментацию, ЛПКанализ и векторное квантование • Тестовая последовательность уменьшается до наблюдаемой последовательности {O}, состоящей из кодов векторов кодовой книги, которые наилучшим образом соответствуют ЛПКвекторам последовательности • Алгоритм Витерби определяет для каждого индивидуального слова СММ, вероятность того, что наблюдаемая последовательность была сгенерирована данным словом СММ • Решающее правило или выбирает слово, чья модель имеет наибольшую вероятность, как распознанное слово, или выдает перечень кандидатов слов, упорядоченный по их вычисленной вероятности 92

Скрытые Марковские модели Выбор инвентаря СММ и числа состояний СММ осуществляется на основании данных о фонетическом составе языка, словаре и размере обучающей выборки. Лучшим выбором инвентаря будет такой, при котором выбранные СММ будут соответствовать акустическим реализациям фонем в реальной речи, а имеющаяся обучающая выборка будет обеспечивать корректную оценку параметров моделей. Обычно это аллофоны – контекстно-зависимые акустические реализации фонем. Поскольку мужские и женские голоса существенно отличаются по параметрам, в большинстве приложений раздельно формируются семейства СММ для мужского и женского голосов. 92

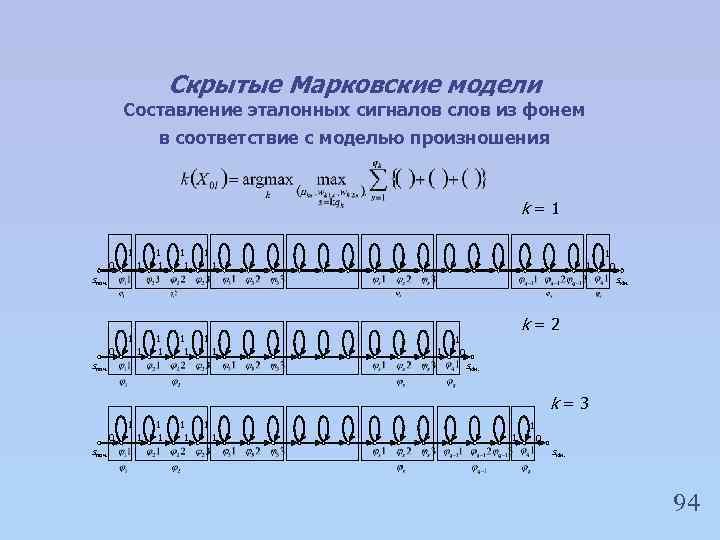

Скрытые Марковские модели Составление эталонных сигналов слов из фонем в соответствие с моделью произношения k=1 1 0 1 1 1 1 1 sпоч. 0 sкін. k=2 1 0 1 1 1 1 sпоч. 1 0 sкін. k=3 1 0 sпоч. 1 1 1 1 1 0 sкін. 94

Скрытые Марковские модели Пофонемное распознавание слитной речи, состоящей из слов выбранного словаря, в случае свободного порядка следования слов 95

Скрытые Марковские модели Модель слова с произвольным порядком следования моделей фонем в слове 96

Скрытые Марковские модели Модель предложения с произвольным порядком следования моделей слов и моделей фонем в предложении 97

Нейронные сети Многослойный персептрон для классификации гласных, основанной на формантных измерениях 51

Нейронные сети Нейронная сеть с задержками 52

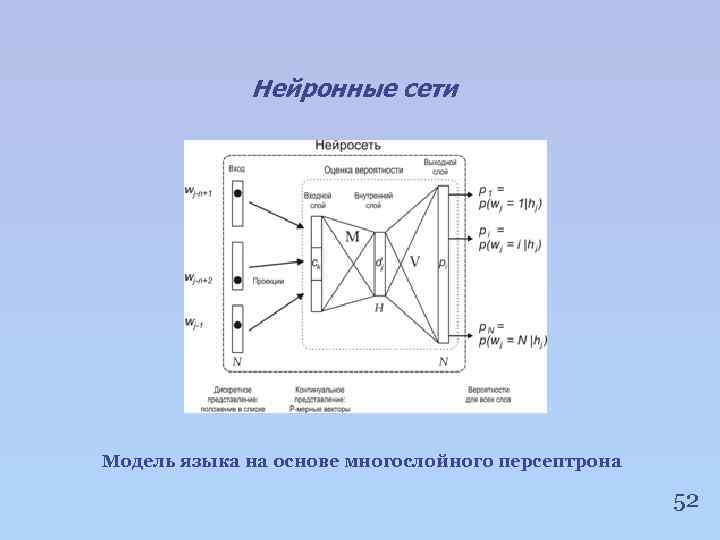

Нейронные сети Модель языка на основе многослойного персептрона 52

Реализация и использование систем распознавания речи В настоящее время под системой распознавания речи понимается программно-аппаратный комплекс, решающий одну из ниже перечисленных задач. • Распознавание изолированных устно произносимых команд ограниченного словаря. • Распознавание слитной речи. • Понимание речи. 4

Реализация и использование систем распознавания речи Дополнительные различия. • Система распознавания может обучаться • на индивидуальные особенности речи • конкретного диктора. • Система может быть рассчитана на конкретный • стиль произнесения. • Система может быть предназначена для работы • в разных акустических условиях. 4

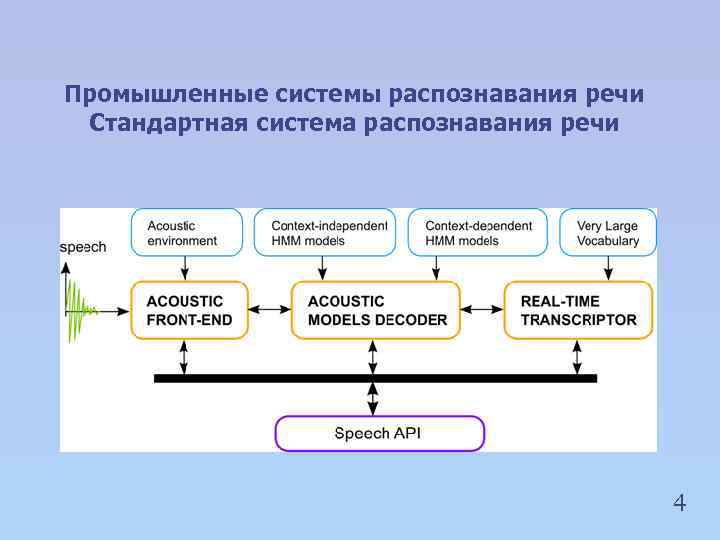

Промышленные системы распознавания речи Стандартная система распознавания речи 4

Промышленные системы распознавания речи Система распознавания речи фирмы Speereo Software United Kingdom Ltd. • • • • До 150000 слов английского языка. В темпе с процессом. Статистические языковые модели. 600 командных фраз. В любую среду: MS Windows 95, 98, Millenium, NT 4. 0, 2000, XP. Спец. словарь: радиология и модели языков. PCMCIA для мобильных работ. изолированно произносимые команды; без подстройки под диктора; 99, 9% в офисном помещении; 97% в автомобиле, идущем со скоростью 120 км/час; подстраивается к языковой модели; управление оборудованием и меню; английский UK. 4

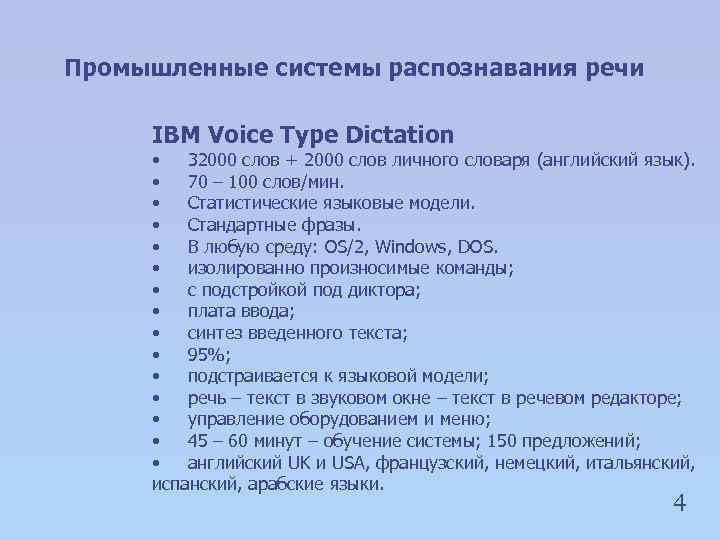

Промышленные системы распознавания речи IBM Voice Type Dictation • 32000 слов + 2000 слов личного словаря (английский язык). • 70 – 100 слов/мин. • Статистические языковые модели. • Стандартные фразы. • В любую среду: OS/2, Windows, DOS. • изолированно произносимые команды; • с подстройкой под диктора; • плата ввода; • синтез введенного текста; • 95%; • подстраивается к языковой модели; • речь – текст в звуковом окне – текст в речевом редакторе; • управление оборудованием и меню; • 45 – 60 минут – обучение системы; 150 предложений; • английский UK и USA, французский, немецкий, итальянский, испанский, арабские языки. 4

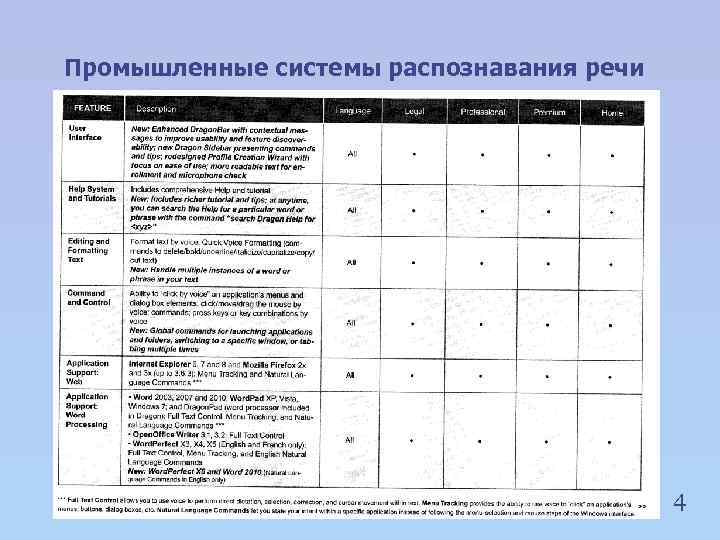

Промышленные системы распознавания речи 4

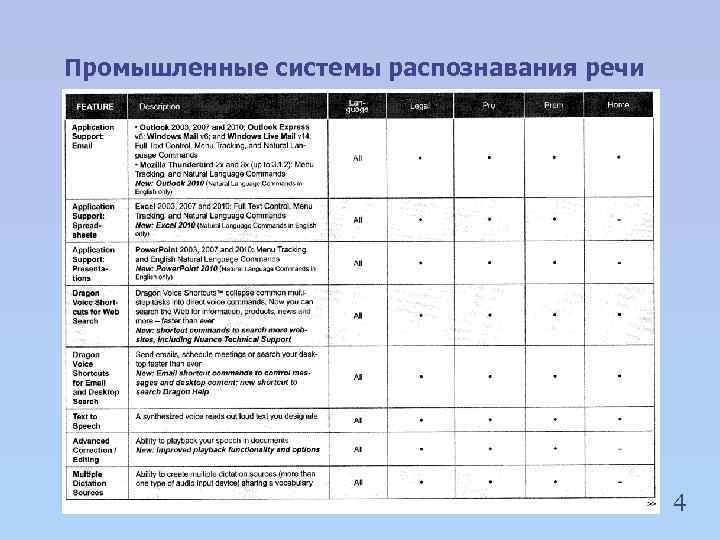

Промышленные системы распознавания речи 4

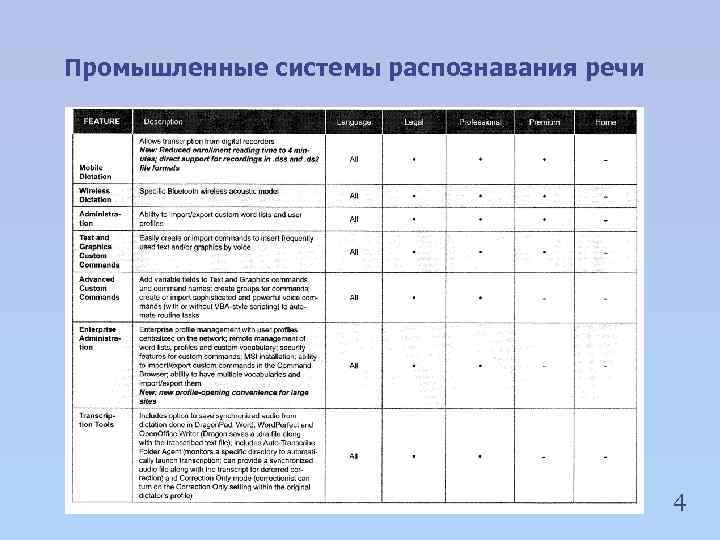

Промышленные системы распознавания речи 4

Промышленные системы распознавания речи 4

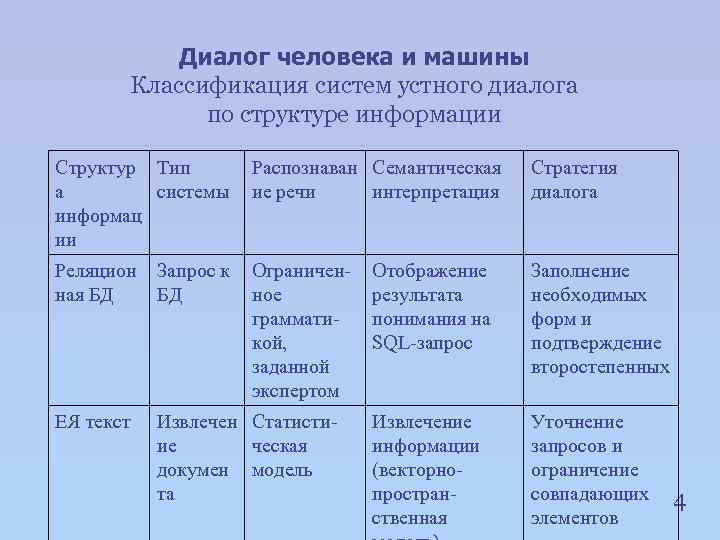

Диалог человека и машины Существует два типа таких систем Системы первого типа ведут человека, следуя четкому порядку заполнения определенных форм. Примером такой системы может стать заказ билетов. В каждом из состояний система настраивается на распознавание заранее приготовленных атрибутов, допуская варианты возврата к предыдущему шагу или выходу из системы В системах второго типа человеку отводится роль собеседника, который может сам проявлять интерес к разным аспектам информации, задавая любые вопросы. 4

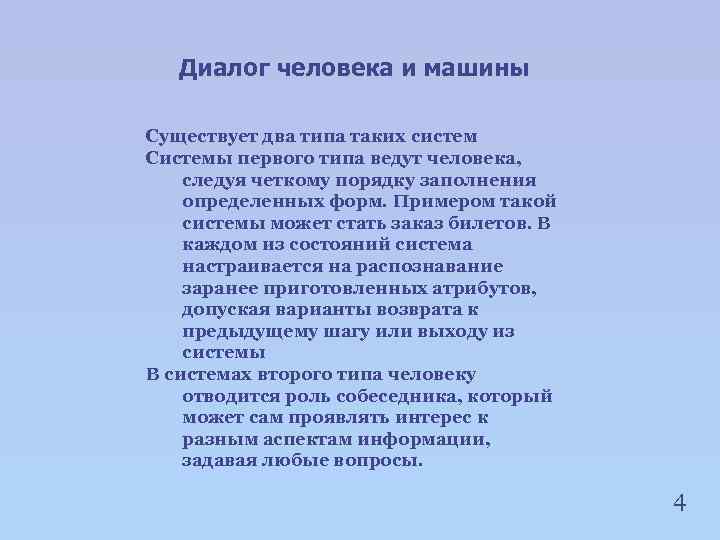

Диалог человека и машины Общая блок-схема ориентированной на задачу системы речевого диалога 3

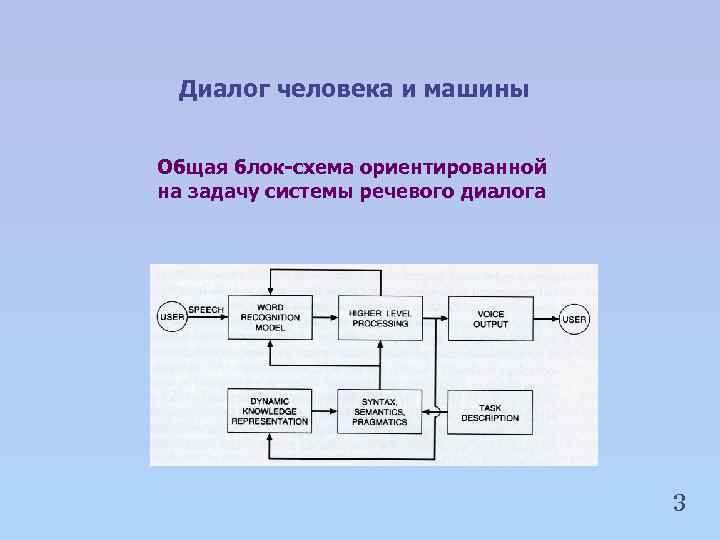

Диалог человека и машины Классификация систем устного диалога по направлению потока информации Тип системы Поток информации Примеры Объяснение Система Пользователь Прокладка маршрута, обучение Заполнение форм Пользователь Система Покупки по телефону, перенаправление абонента Получение информации Пользователь Система Резервирование гостиницы, поиск литературы 4

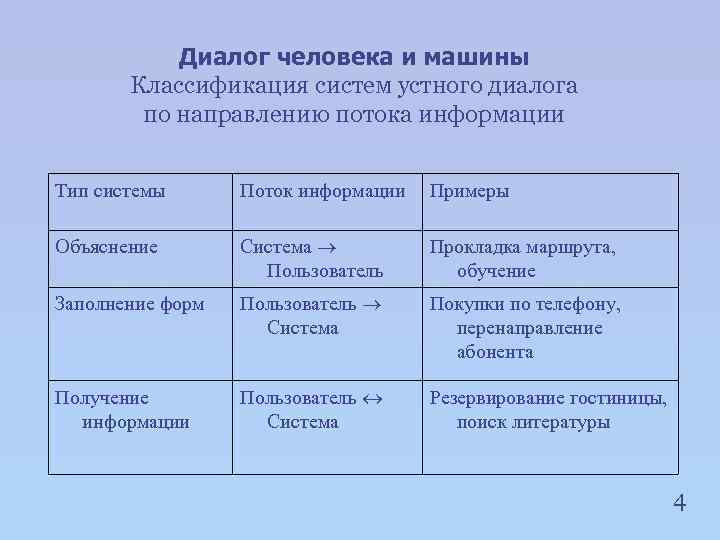

Диалог человека и машины Классификация систем устного диалога по структуре информации Структур Тип а системы информац ии Распознаван Семантическая ие речи интерпретация Стратегия диалога Реляцион ная БД Запрос к БД Ограниченное грамматикой, заданной экспертом Отображение результата понимания на SQL-запрос Заполнение необходимых форм и подтверждение второстепенных ЕЯ текст Извлечен Статистиие ческая докумен модель та Извлечение информации (векторнопространственная Уточнение запросов и ограничение совпадающих элементов 4

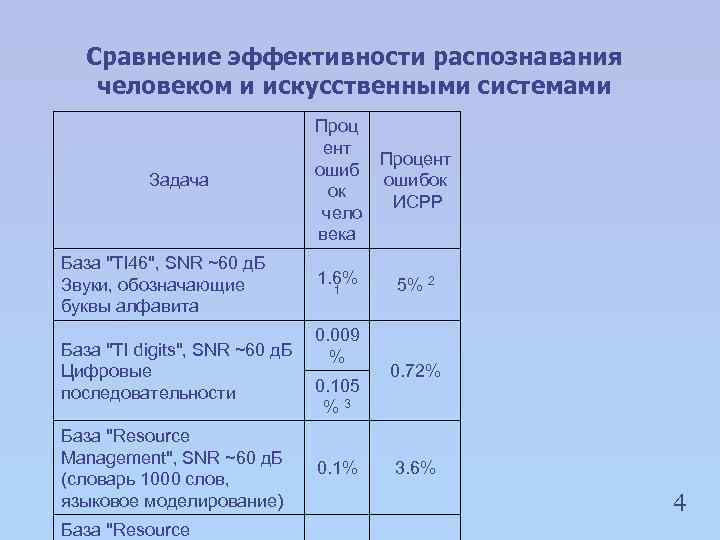

Сравнение эффективности распознавания человеком и искусственными системами Задача База "TI 46", SNR ~60 д. Б Звуки, обозначающие буквы алфавита База "TI digits", SNR ~60 д. Б Цифровые последовательности База "Resource Management", SNR ~60 д. Б (словарь 1000 слов, языковое моделирование) База "Resource Проц ент Процент ошибок ок ИСРР чело века 1. 6% 1 0. 009 % 0. 105 %3 0. 1% 5% 2 0. 72% 3. 6% 4

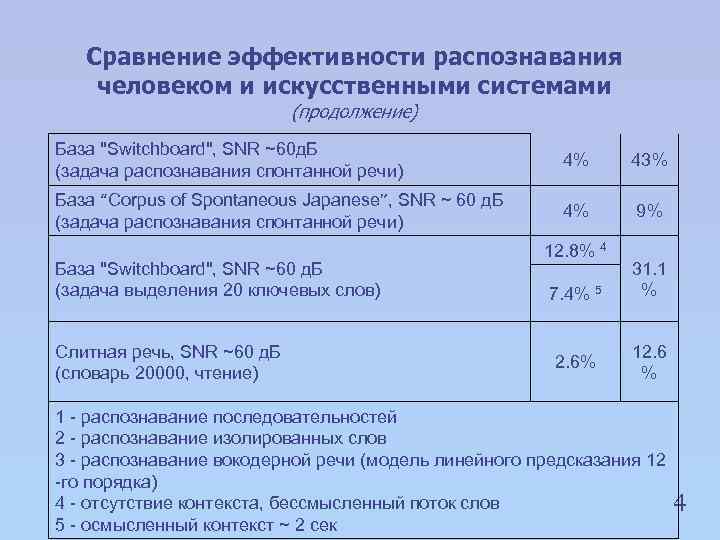

Сравнение эффективности распознавания человеком и искусственными системами (продолжение) База "Switchboard", SNR ~60 д. Б (задача распознавания спонтанной речи) 4% 43% База “Corpus of Spontaneous Japanese”, SNR ~ 60 д. Б (задача распознавания спонтанной речи) 4% 9% База "Switchboard", SNR ~60 д. Б (задача выделения 20 ключевых слов) Слитная речь, SNR ~60 д. Б (словарь 20000, чтение) 12. 8% 4 7. 4% 5 2. 6% 31. 1 % 12. 6 % 1 - распознавание последовательностей 2 - распознавание изолированных слов 3 - распознавание вокодерной речи (модель линейного предсказания 12 -го порядка) 4 - отсутствие контекста, бессмысленный поток слов 5 - осмысленный контекст ~ 2 сек 4

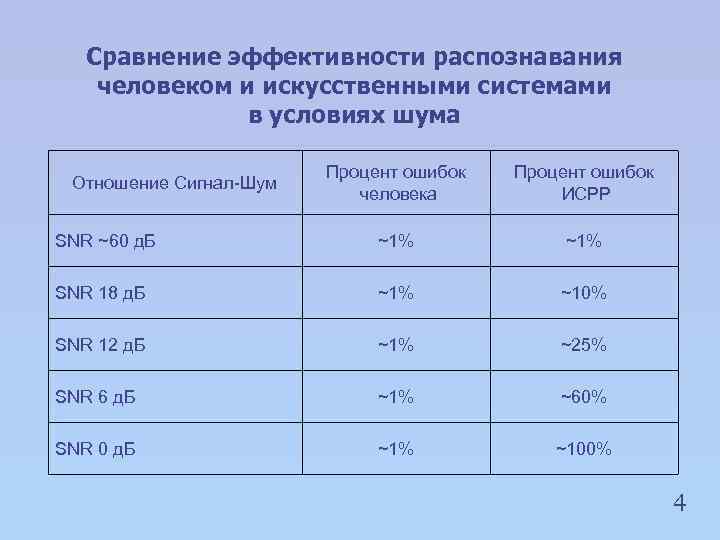

Сравнение эффективности распознавания человеком и искусственными системами в условиях шума Процент ошибок человека Процент ошибок ИСРР SNR ~60 д. Б ~1% SNR 18 д. Б ~1% ~10% SNR 12 д. Б ~1% ~25% SNR 6 д. Б ~1% ~60% SNR 0 д. Б ~1% ~100% Отношение Сигнал-Шум 4

Lecture 12.ppt