Методы Стат Ан лек1.pptx

- Количество слайдов: 31

Методы статистического анализа (повторение+доп. главы) Солдатов Е. Ю Лекция 1

Методы статистического анализа (повторение+доп. главы) Солдатов Е. Ю Лекция 1

Статистический анализ базируется на весьма большом многообразии различных приемов и методов исследования статистических показателей (на методах математической статистики) Математическая статистика — наука, разрабатывающая математические методы систематизации и использования статистических данных для научных и практических выводов. Математическая статистика — раздел математики, разрабатывающий методы регистрации, описания и анализа данных наблюдений и экспериментов с целью построения вероятностных моделей массовых случайных явлений Во многих своих разделах математическая статистика опирается на теорию вероятностей, позволяющую оценить надёжность и точность выводов, делаемых на основании ограниченного статистического материала (напр. , оценить необходимый объём выборки для получения результатов требуемой точности при выборочном обследовании). Лекция 1 № 2

Статистический анализ базируется на весьма большом многообразии различных приемов и методов исследования статистических показателей (на методах математической статистики) Математическая статистика — наука, разрабатывающая математические методы систематизации и использования статистических данных для научных и практических выводов. Математическая статистика — раздел математики, разрабатывающий методы регистрации, описания и анализа данных наблюдений и экспериментов с целью построения вероятностных моделей массовых случайных явлений Во многих своих разделах математическая статистика опирается на теорию вероятностей, позволяющую оценить надёжность и точность выводов, делаемых на основании ограниченного статистического материала (напр. , оценить необходимый объём выборки для получения результатов требуемой точности при выборочном обследовании). Лекция 1 № 2

Частотная вероятность (Frequentist probability) - является стандартной интерпретацией вероятности, она определяет вероятность события как предел его относительной частоты в большом количестве исследований. Случайным экспериментом (испытанием) называется осуществление какого-либо комплекса условий, которое можно практически или мысленно воспроизвести сколь угодно большое число раз. Примеры случайного эксперимента: подбрасывание монеты или игральной кости (кубика), извлечение одной карты из перетасованной колоды. Лекция 1 № 3

Частотная вероятность (Frequentist probability) - является стандартной интерпретацией вероятности, она определяет вероятность события как предел его относительной частоты в большом количестве исследований. Случайным экспериментом (испытанием) называется осуществление какого-либо комплекса условий, которое можно практически или мысленно воспроизвести сколь угодно большое число раз. Примеры случайного эксперимента: подбрасывание монеты или игральной кости (кубика), извлечение одной карты из перетасованной колоды. Лекция 1 № 3

Вероятности Явления, происходящие в результате случайного эксперимента, называются элементарными исходами. Считается, что при проведении случайного эксперимента реализуется только один из возможных элементарных исходов. Если монету подбросить один раз, то элементарными исходами можно считать выпадение орла (О) или решки (Р). Если случайным экспериментом считать троекратное подбрасывание монеты, то элементарными исходами можно считать следующие: ООО, ООР, ОРО, РОО, ОРР, РОР, РРО, РРР. Лекция 1 № 4

Вероятности Явления, происходящие в результате случайного эксперимента, называются элементарными исходами. Считается, что при проведении случайного эксперимента реализуется только один из возможных элементарных исходов. Если монету подбросить один раз, то элементарными исходами можно считать выпадение орла (О) или решки (Р). Если случайным экспериментом считать троекратное подбрасывание монеты, то элементарными исходами можно считать следующие: ООО, ООР, ОРО, РОО, ОРР, РОР, РРО, РРР. Лекция 1 № 4

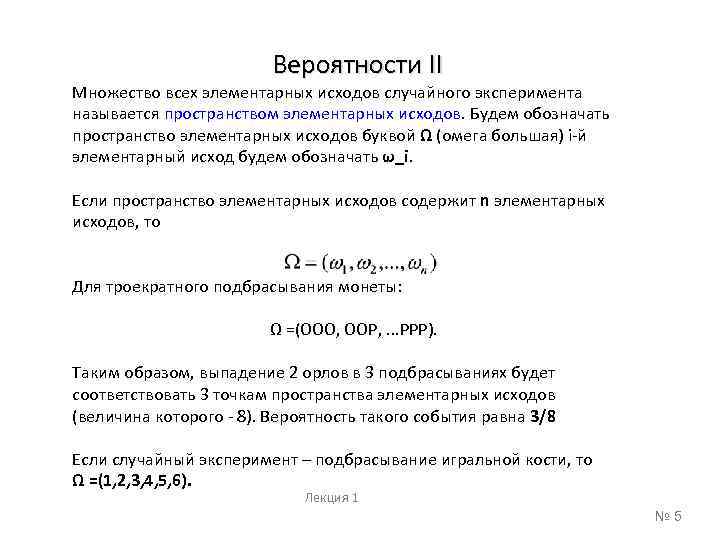

Вероятности II Множество всех элементарных исходов случайного эксперимента называется пространством элементарных исходов. Будем обозначать пространство элементарных исходов буквой Ω (омега большая) i-й элементарный исход будем обозначать ω_i. Если пространство элементарных исходов содержит n элементарных исходов, то Для троекратного подбрасывания монеты: Ω =(ООО, ООР, . . . РРР). Таким образом, выпадение 2 орлов в 3 подбрасываниях будет соответствовать 3 точкам пространства элементарных исходов (величина которого - 8). Вероятность такого события равна 3/8 Если случайный эксперимент – подбрасывание игральной кости, то Ω =(1, 2, 3, 4, 5, 6). Лекция 1 № 5

Вероятности II Множество всех элементарных исходов случайного эксперимента называется пространством элементарных исходов. Будем обозначать пространство элементарных исходов буквой Ω (омега большая) i-й элементарный исход будем обозначать ω_i. Если пространство элементарных исходов содержит n элементарных исходов, то Для троекратного подбрасывания монеты: Ω =(ООО, ООР, . . . РРР). Таким образом, выпадение 2 орлов в 3 подбрасываниях будет соответствовать 3 точкам пространства элементарных исходов (величина которого - 8). Вероятность такого события равна 3/8 Если случайный эксперимент – подбрасывание игральной кости, то Ω =(1, 2, 3, 4, 5, 6). Лекция 1 № 5

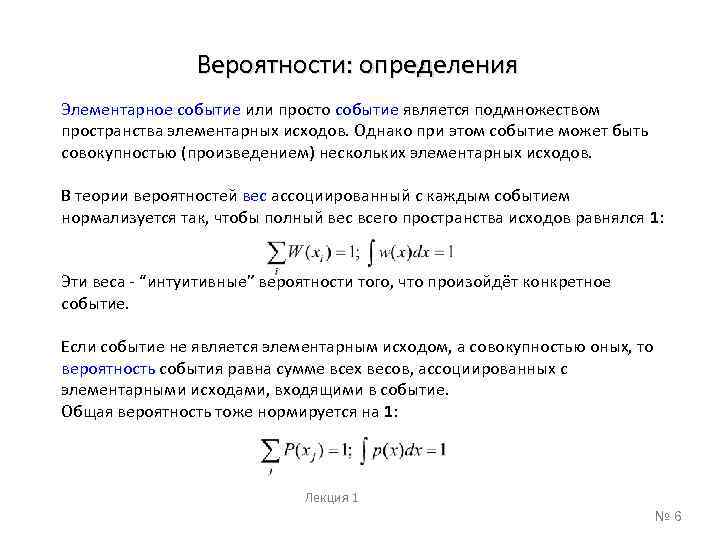

Вероятности: определения Элементарное событие или просто событие является подмножеством пространства элементарных исходов. Однако при этом событие может быть совокупностью (произведением) нескольких элементарных исходов. В теории вероятностей вес ассоциированный с каждым событием нормализуется так, чтобы полный вес всего пространства исходов равнялся 1: Эти веса - “интуитивные” вероятности того, что произойдёт конкретное событие. Если событие не является элементарным исходом, а совокупностью оных, то вероятность события равна сумме всех весов, ассоциированных с элементарными исходами, входящими в событие. Общая вероятность тоже нормируется на 1: Лекция 1 № 6

Вероятности: определения Элементарное событие или просто событие является подмножеством пространства элементарных исходов. Однако при этом событие может быть совокупностью (произведением) нескольких элементарных исходов. В теории вероятностей вес ассоциированный с каждым событием нормализуется так, чтобы полный вес всего пространства исходов равнялся 1: Эти веса - “интуитивные” вероятности того, что произойдёт конкретное событие. Если событие не является элементарным исходом, а совокупностью оных, то вероятность события равна сумме всех весов, ассоциированных с элементарными исходами, входящими в событие. Общая вероятность тоже нормируется на 1: Лекция 1 № 6

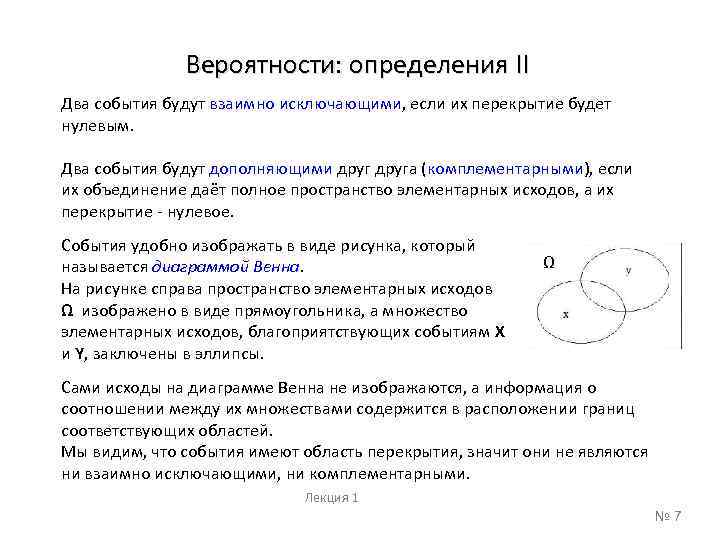

Вероятности: определения II Два события будут взаимно исключающими, если их перекрытие будет нулевым. Два события будут дополняющими друга (комплементарными), если их объединение даёт полное пространство элементарных исходов, а их перекрытие - нулевое. События удобно изображать в виде рисунка, который называется диаграммой Венна. На рисунке справа пространство элементарных исходов Ω изображено в виде прямоугольника, а множество элементарных исходов, благоприятствующих событиям X и Y, заключены в эллипсы. Ω Сами исходы на диаграмме Венна не изображаются, а информация о соотношении между их множествами содержится в расположении границ соответствующих областей. Мы видим, что события имеют область перекрытия, значит они не являются ни взаимно исключающими, ни комплементарными. Лекция 1 № 7

Вероятности: определения II Два события будут взаимно исключающими, если их перекрытие будет нулевым. Два события будут дополняющими друга (комплементарными), если их объединение даёт полное пространство элементарных исходов, а их перекрытие - нулевое. События удобно изображать в виде рисунка, который называется диаграммой Венна. На рисунке справа пространство элементарных исходов Ω изображено в виде прямоугольника, а множество элементарных исходов, благоприятствующих событиям X и Y, заключены в эллипсы. Ω Сами исходы на диаграмме Венна не изображаются, а информация о соотношении между их множествами содержится в расположении границ соответствующих областей. Мы видим, что события имеют область перекрытия, значит они не являются ни взаимно исключающими, ни комплементарными. Лекция 1 № 7

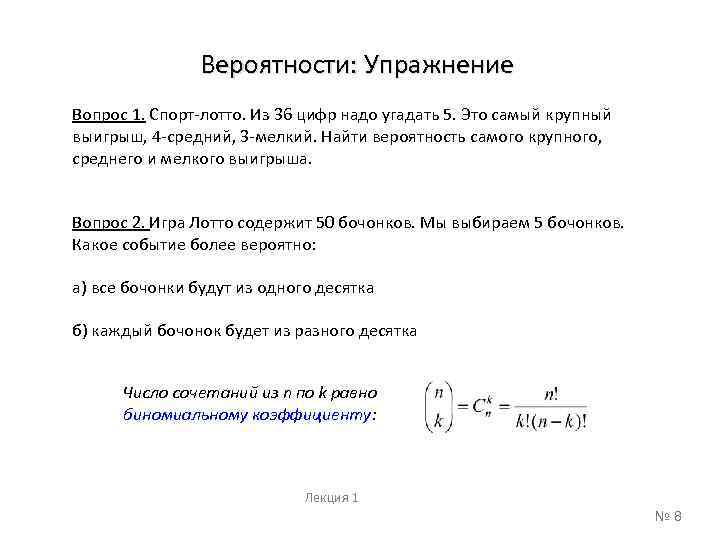

Вероятности: Упражнение Вопрос 1. Спорт-лотто. Из 36 цифр надо угадать 5. Это самый крупный выигрыш, 4 -средний, 3 -мелкий. Найти вероятность самого крупного, среднего и мелкого выигрыша. Вопрос 2. Игра Лотто содержит 50 бочонков. Мы выбираем 5 бочонков. Какое событие более вероятно: а) все бочонки будут из одного десятка б) каждый бочонок будет из разного десятка Число сочетаний из n по k равно биномиальному коэффициенту: Лекция 1 № 8

Вероятности: Упражнение Вопрос 1. Спорт-лотто. Из 36 цифр надо угадать 5. Это самый крупный выигрыш, 4 -средний, 3 -мелкий. Найти вероятность самого крупного, среднего и мелкого выигрыша. Вопрос 2. Игра Лотто содержит 50 бочонков. Мы выбираем 5 бочонков. Какое событие более вероятно: а) все бочонки будут из одного десятка б) каждый бочонок будет из разного десятка Число сочетаний из n по k равно биномиальному коэффициенту: Лекция 1 № 8

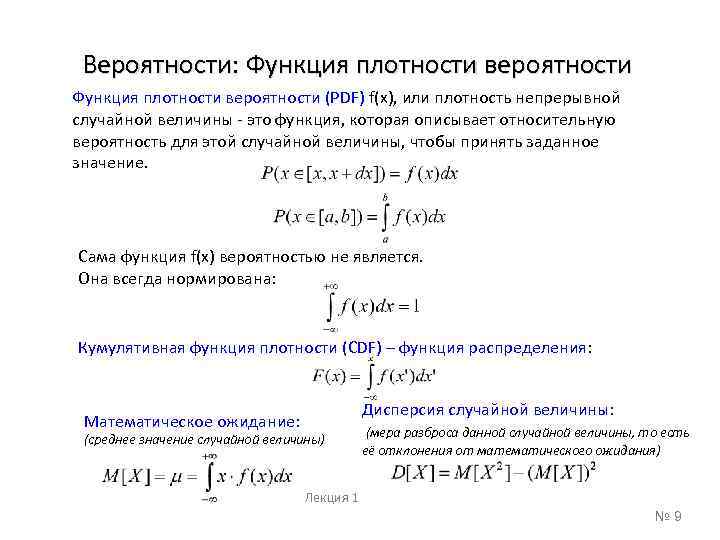

Вероятности: Функция плотности вероятности (PDF) f(x), или плотность непрерывной случайной величины - это функция, которая описывает относительную вероятность для этой случайной величины, чтобы принять заданное значение. Сама функция f(x) вероятностью не является. Она всегда нормирована: Кумулятивная функция плотности (CDF) – функция распределения: Математическое ожидание: (среднее значение случайной величины) Дисперсия случайной величины: (мера разброса данной случайной величины, то есть её отклонения от математического ожидания) Лекция 1 № 9

Вероятности: Функция плотности вероятности (PDF) f(x), или плотность непрерывной случайной величины - это функция, которая описывает относительную вероятность для этой случайной величины, чтобы принять заданное значение. Сама функция f(x) вероятностью не является. Она всегда нормирована: Кумулятивная функция плотности (CDF) – функция распределения: Математическое ожидание: (среднее значение случайной величины) Дисперсия случайной величины: (мера разброса данной случайной величины, то есть её отклонения от математического ожидания) Лекция 1 № 9

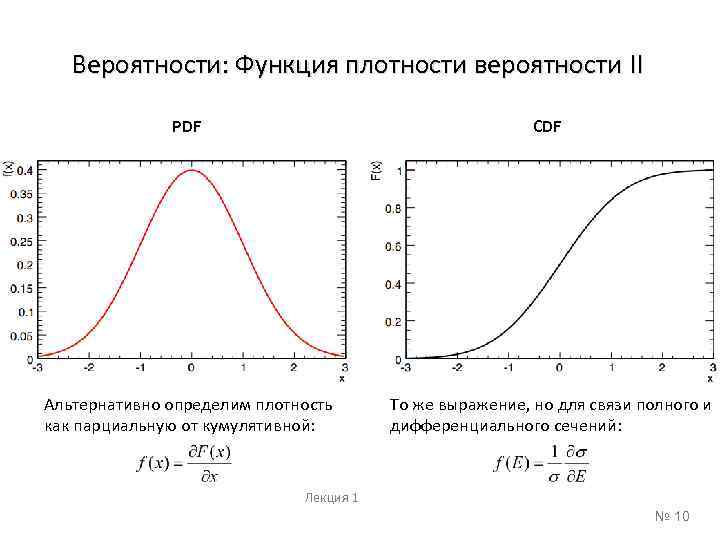

Вероятности: Функция плотности вероятности II PDF CDF Альтернативно определим плотность как парциальную от кумулятивной: То же выражение, но для связи полного и дифференциального сечений: Лекция 1 № 10

Вероятности: Функция плотности вероятности II PDF CDF Альтернативно определим плотность как парциальную от кумулятивной: То же выражение, но для связи полного и дифференциального сечений: Лекция 1 № 10

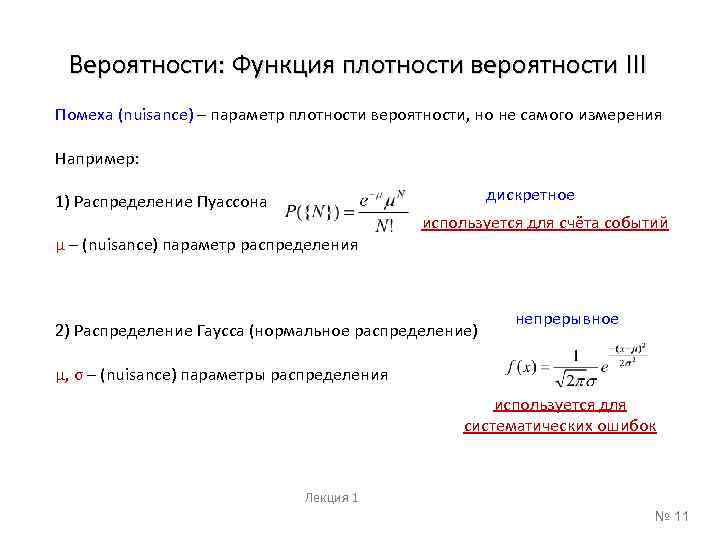

Вероятности: Функция плотности вероятности III Помеха (nuisance) – параметр плотности вероятности, но не самого измерения Например: дискретное 1) Распределение Пуассона используется для счёта событий μ – (nuisance) параметр распределения 2) Распределение Гаусса (нормальное распределение) непрерывное μ, σ – (nuisance) параметры распределения используется для систематических ошибок Лекция 1 № 11

Вероятности: Функция плотности вероятности III Помеха (nuisance) – параметр плотности вероятности, но не самого измерения Например: дискретное 1) Распределение Пуассона используется для счёта событий μ – (nuisance) параметр распределения 2) Распределение Гаусса (нормальное распределение) непрерывное μ, σ – (nuisance) параметры распределения используется для систематических ошибок Лекция 1 № 11

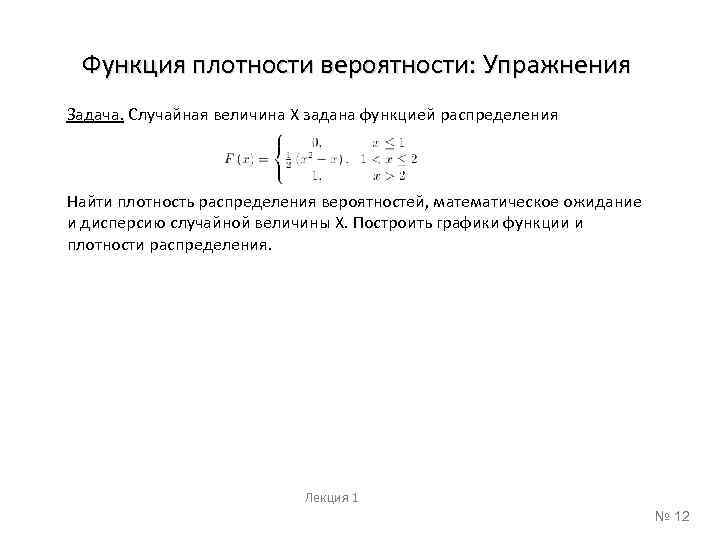

Функция плотности вероятности: Упражнения Задача. Случайная величина X задана функцией распределения Найти плотность распределения вероятностей, математическое ожидание и дисперсию случайной величины X. Построить графики функции и плотности распределения. Лекция 1 № 12

Функция плотности вероятности: Упражнения Задача. Случайная величина X задана функцией распределения Найти плотность распределения вероятностей, математическое ожидание и дисперсию случайной величины X. Построить графики функции и плотности распределения. Лекция 1 № 12

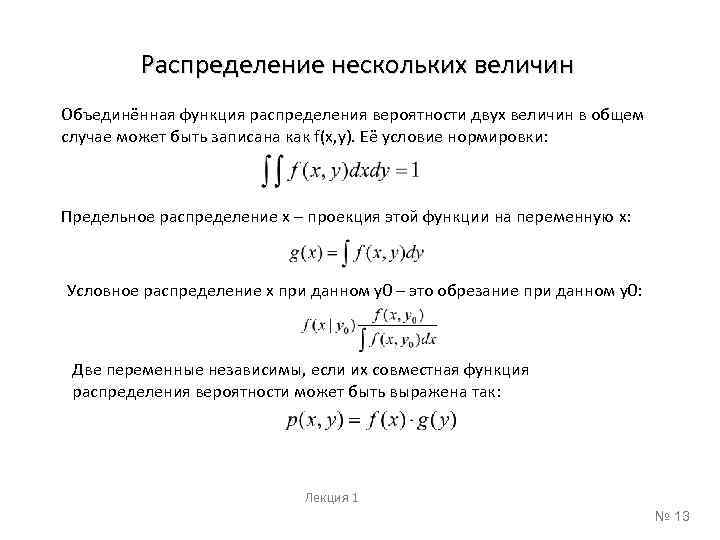

Распределение нескольких величин Объединённая функция распределения вероятности двух величин в общем случае может быть записана как f(x, y). Её условие нормировки: Предельное распределение x – проекция этой функции на переменную x: Условное распределение x при данном y 0 – это обрезание при данном y 0: Две переменные независимы, если их совместная функция распределения вероятности может быть выражена так: Лекция 1 № 13

Распределение нескольких величин Объединённая функция распределения вероятности двух величин в общем случае может быть записана как f(x, y). Её условие нормировки: Предельное распределение x – проекция этой функции на переменную x: Условное распределение x при данном y 0 – это обрезание при данном y 0: Две переменные независимы, если их совместная функция распределения вероятности может быть выражена так: Лекция 1 № 13

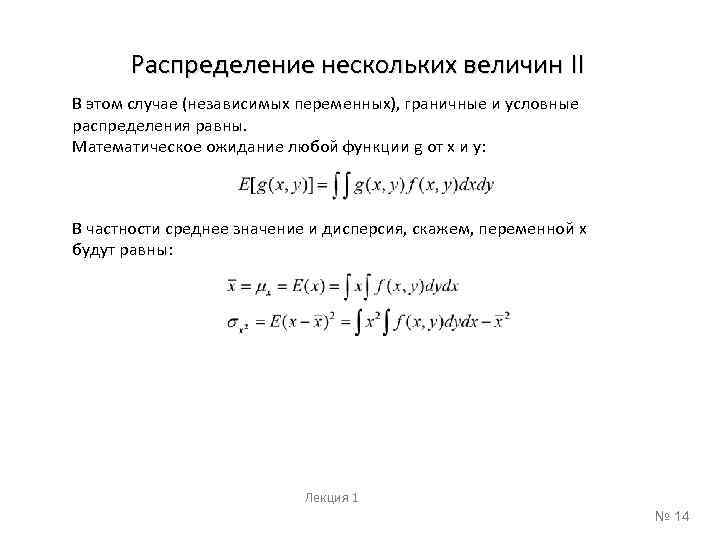

Распределение нескольких величин II В этом случае (независимых переменных), граничные и условные распределения равны. Математическое ожидание любой функции g от x и y: В частности среднее значение и дисперсия, скажем, переменной x будут равны: Лекция 1 № 14

Распределение нескольких величин II В этом случае (независимых переменных), граничные и условные распределения равны. Математическое ожидание любой функции g от x и y: В частности среднее значение и дисперсия, скажем, переменной x будут равны: Лекция 1 № 14

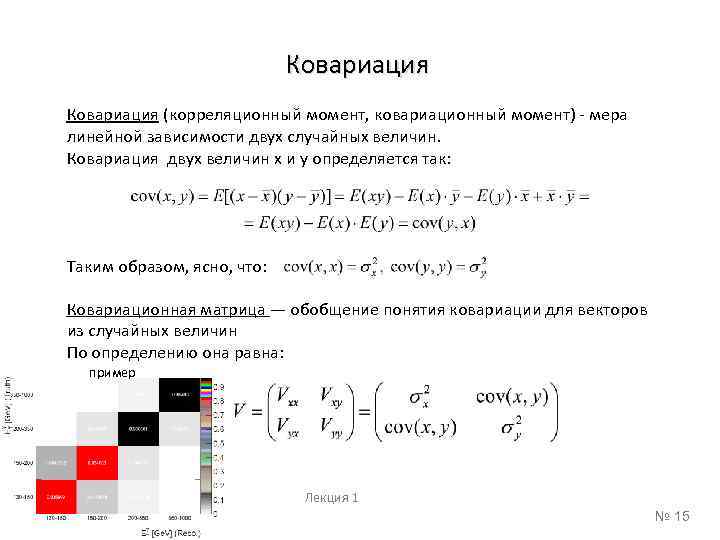

Ковариация (корреляционный момент, ковариационный момент) - мера линейной зависимости двух случайных величин. Ковариация двух величин x и y определяется так: Таким образом, ясно, что: Ковариационная матрица — обобщение понятия ковариации для векторов из случайных величин По определению она равна: пример Лекция 1 № 15

Ковариация (корреляционный момент, ковариационный момент) - мера линейной зависимости двух случайных величин. Ковариация двух величин x и y определяется так: Таким образом, ясно, что: Ковариационная матрица — обобщение понятия ковариации для векторов из случайных величин По определению она равна: пример Лекция 1 № 15

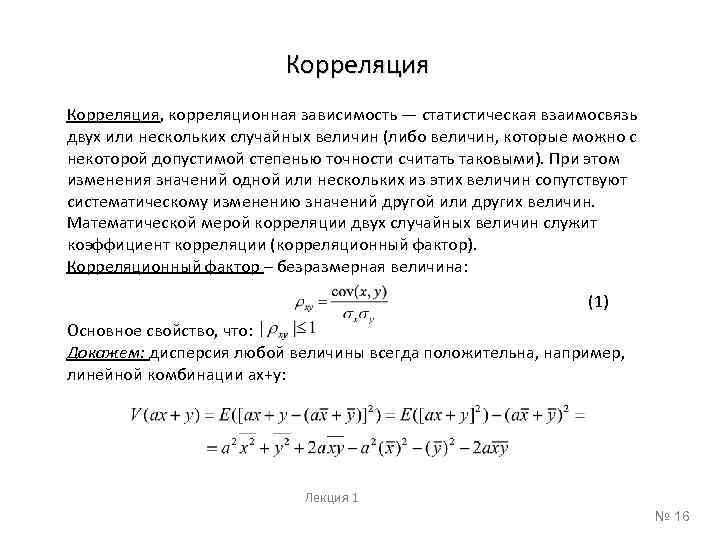

Корреляция, корреляционная зависимость — статистическая взаимосвязь двух или нескольких случайных величин (либо величин, которые можно с некоторой допустимой степенью точности считать таковыми). При этом изменения значений одной или нескольких из этих величин сопутствуют систематическому изменению значений другой или других величин. Математической мерой корреляции двух случайных величин служит коэффициент корреляции (корреляционный фактор). Корреляционный фактор – безразмерная величина: (1) Основное свойство, что: Докажем: дисперсия любой величины всегда положительна, например, линейной комбинации ax+y: Лекция 1 № 16

Корреляция, корреляционная зависимость — статистическая взаимосвязь двух или нескольких случайных величин (либо величин, которые можно с некоторой допустимой степенью точности считать таковыми). При этом изменения значений одной или нескольких из этих величин сопутствуют систематическому изменению значений другой или других величин. Математической мерой корреляции двух случайных величин служит коэффициент корреляции (корреляционный фактор). Корреляционный фактор – безразмерная величина: (1) Основное свойство, что: Докажем: дисперсия любой величины всегда положительна, например, линейной комбинации ax+y: Лекция 1 № 16

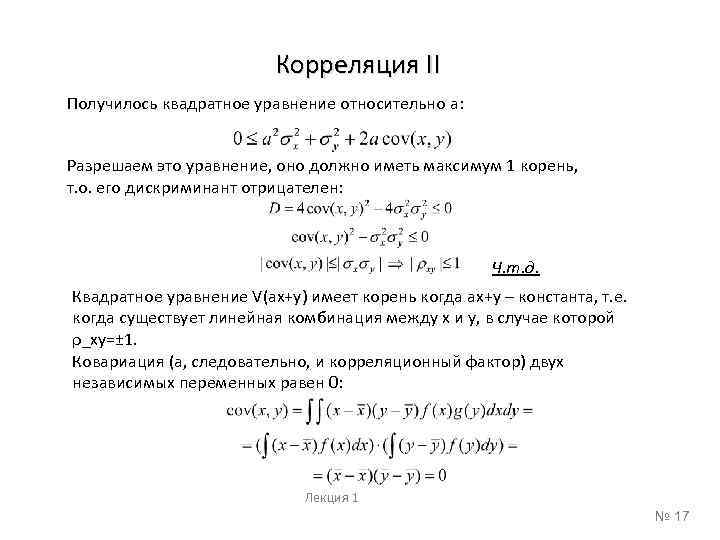

Корреляция II Получилось квадратное уравнение относительно a: Разрешаем это уравнение, оно должно иметь максимум 1 корень, т. о. его дискриминант отрицателен: Ч. т. д. Квадратное уравнение V(ax+y) имеет корень когда ax+y – константа, т. е. когда существует линейная комбинация между x и y, в случае которой ρ_xy=± 1. Ковариация (а, следовательно, и корреляционный фактор) двух независимых переменных равен 0: Лекция 1 № 17

Корреляция II Получилось квадратное уравнение относительно a: Разрешаем это уравнение, оно должно иметь максимум 1 корень, т. о. его дискриминант отрицателен: Ч. т. д. Квадратное уравнение V(ax+y) имеет корень когда ax+y – константа, т. е. когда существует линейная комбинация между x и y, в случае которой ρ_xy=± 1. Ковариация (а, следовательно, и корреляционный фактор) двух независимых переменных равен 0: Лекция 1 № 17

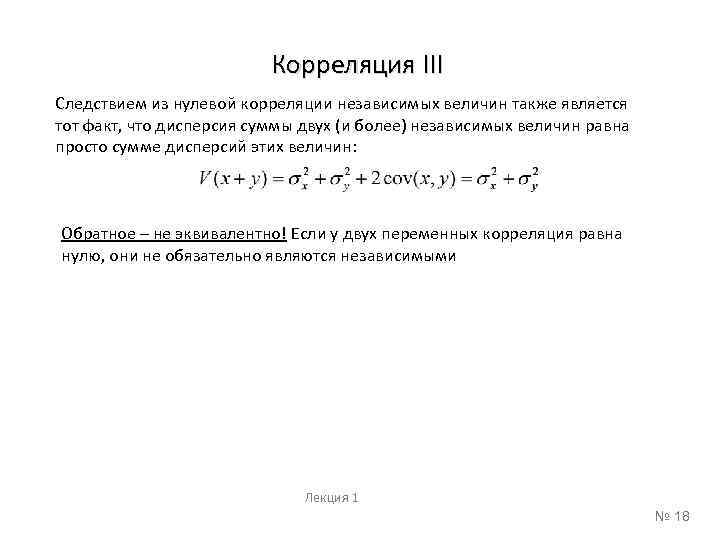

Корреляция III Следствием из нулевой корреляции независимых величин также является тот факт, что дисперсия суммы двух (и более) независимых величин равна просто сумме дисперсий этих величин: Обратное – не эквивалентно! Если у двух переменных корреляция равна нулю, они не обязательно являются независимыми Лекция 1 № 18

Корреляция III Следствием из нулевой корреляции независимых величин также является тот факт, что дисперсия суммы двух (и более) независимых величин равна просто сумме дисперсий этих величин: Обратное – не эквивалентно! Если у двух переменных корреляция равна нулю, они не обязательно являются независимыми Лекция 1 № 18

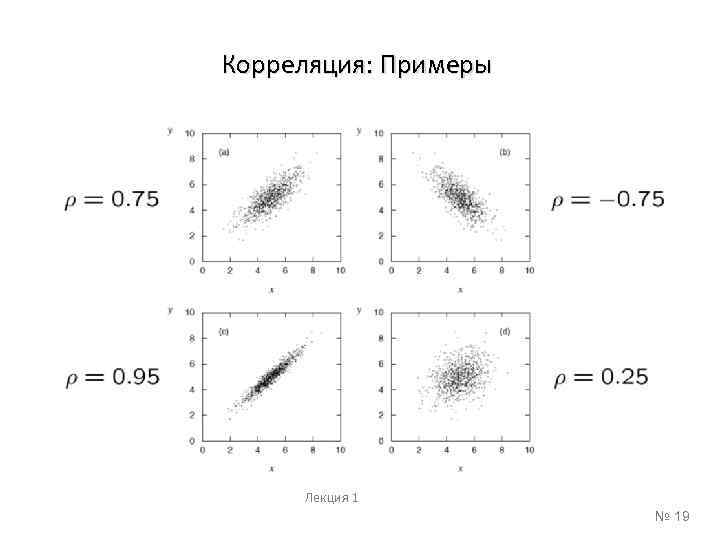

Корреляция: Примеры Лекция 1 № 19

Корреляция: Примеры Лекция 1 № 19

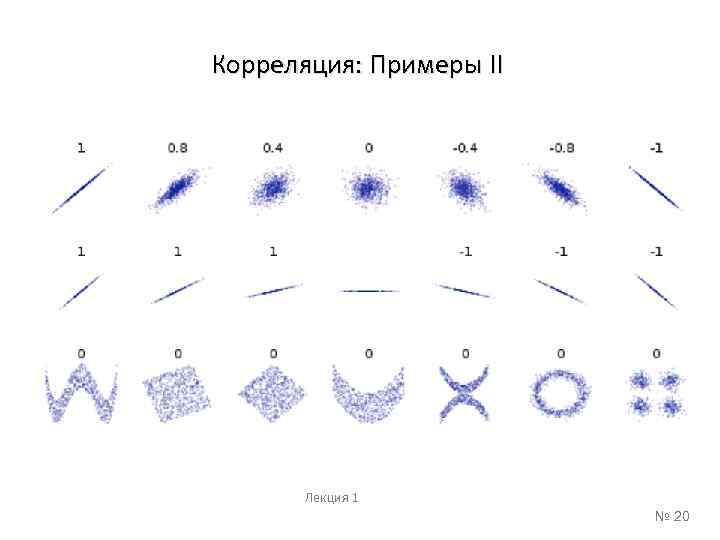

Корреляция: Примеры II Лекция 1 № 20

Корреляция: Примеры II Лекция 1 № 20

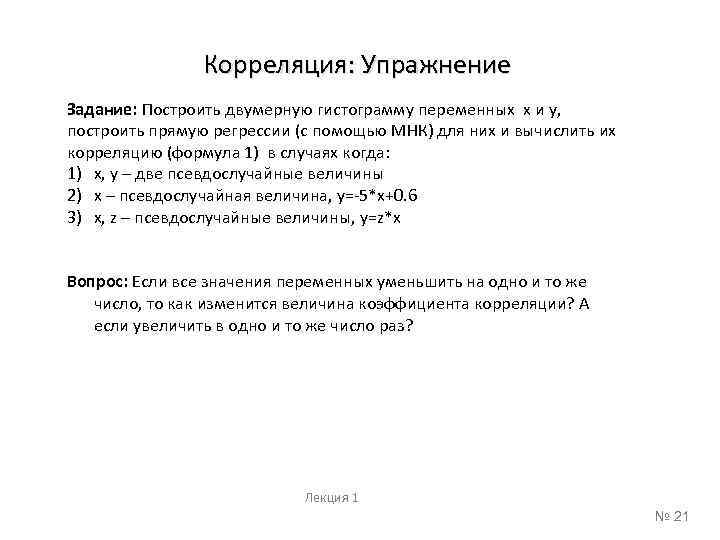

Корреляция: Упражнение Задание: Построить двумерную гистограмму переменных x и y, построить прямую регрессии (с помощью МНК) для них и вычислить их корреляцию (формула 1) в случаях когда: 1) x, y – две псевдослучайные величины 2) x – псевдослучайная величина, y=-5*x+0. 6 3) x, z – псевдослучайные величины, y=z*x Вопрос: Если все значения переменных уменьшить на одно и то же число, то как изменится величина коэффициента корреляции? А если увеличить в одно и то же число раз? Лекция 1 № 21

Корреляция: Упражнение Задание: Построить двумерную гистограмму переменных x и y, построить прямую регрессии (с помощью МНК) для них и вычислить их корреляцию (формула 1) в случаях когда: 1) x, y – две псевдослучайные величины 2) x – псевдослучайная величина, y=-5*x+0. 6 3) x, z – псевдослучайные величины, y=z*x Вопрос: Если все значения переменных уменьшить на одно и то же число, то как изменится величина коэффициента корреляции? А если увеличить в одно и то же число раз? Лекция 1 № 21

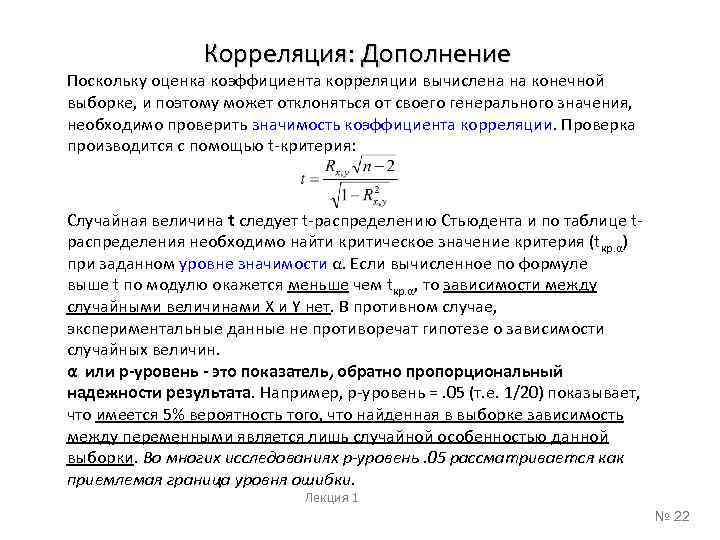

Корреляция: Дополнение Поскольку оценка коэффициента корреляции вычислена на конечной выборке, и поэтому может отклоняться от своего генерального значения, необходимо проверить значимость коэффициента корреляции. Проверка производится с помощью t-критерия: Случайная величина t следует t-распределению Стьюдента и по таблице tраспределения необходимо найти критическое значение критерия (tкр. α) при заданном уровне значимости α. Если вычисленное по формуле выше t по модулю окажется меньше чем tкр. α, то зависимости между случайными величинами X и Y нет. В противном случае, экспериментальные данные не противоречат гипотезе о зависимости случайных величин. α или p-уровень - это показатель, обратно пропорциональный надежности результата. Например, p-уровень =. 05 (т. е. 1/20) показывает, что имеется 5% вероятность того, что найденная в выборке зависимость между переменными является лишь случайной особенностью данной выборки. Во многих исследованиях p-уровень. 05 рассматривается как приемлемая граница уровня ошибки. Лекция 1 № 22

Корреляция: Дополнение Поскольку оценка коэффициента корреляции вычислена на конечной выборке, и поэтому может отклоняться от своего генерального значения, необходимо проверить значимость коэффициента корреляции. Проверка производится с помощью t-критерия: Случайная величина t следует t-распределению Стьюдента и по таблице tраспределения необходимо найти критическое значение критерия (tкр. α) при заданном уровне значимости α. Если вычисленное по формуле выше t по модулю окажется меньше чем tкр. α, то зависимости между случайными величинами X и Y нет. В противном случае, экспериментальные данные не противоречат гипотезе о зависимости случайных величин. α или p-уровень - это показатель, обратно пропорциональный надежности результата. Например, p-уровень =. 05 (т. е. 1/20) показывает, что имеется 5% вероятность того, что найденная в выборке зависимость между переменными является лишь случайной особенностью данной выборки. Во многих исследованиях p-уровень. 05 рассматривается как приемлемая граница уровня ошибки. Лекция 1 № 22

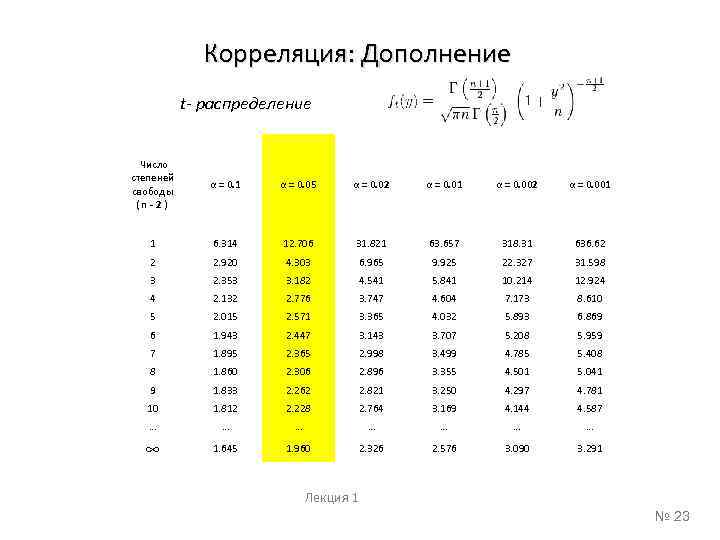

Корреляция: Дополнение t- распределение Число степеней свободы ( n - 2 ) α = 0. 1 α = 0. 05 α = 0. 02 α = 0. 01 α = 0. 002 α = 0. 001 1 6. 314 12. 706 31. 821 63. 657 318. 31 636. 62 2 2. 920 4. 303 6. 965 9. 925 22. 327 31. 598 3 2. 353 3. 182 4. 541 5. 841 10. 214 12. 924 4 2. 132 2. 776 3. 747 4. 604 7. 173 8. 610 5 2. 015 2. 571 3. 365 4. 032 5. 893 6. 869 6 1. 943 2. 447 3. 143 3. 707 5. 208 5. 959 7 1. 895 2. 365 2. 998 3. 499 4. 785 5. 408 8 1. 860 2. 306 2. 896 3. 355 4. 501 5. 041 9 1. 833 2. 262 2. 821 3. 250 4. 297 4. 781 10 1. 812 2. 228 2. 764 3. 169 4. 144 4. 587 … … … … ∞ 1. 645 1. 960 2. 326 2. 576 3. 090 3. 291 Лекция 1 № 23

Корреляция: Дополнение t- распределение Число степеней свободы ( n - 2 ) α = 0. 1 α = 0. 05 α = 0. 02 α = 0. 01 α = 0. 002 α = 0. 001 1 6. 314 12. 706 31. 821 63. 657 318. 31 636. 62 2 2. 920 4. 303 6. 965 9. 925 22. 327 31. 598 3 2. 353 3. 182 4. 541 5. 841 10. 214 12. 924 4 2. 132 2. 776 3. 747 4. 604 7. 173 8. 610 5 2. 015 2. 571 3. 365 4. 032 5. 893 6. 869 6 1. 943 2. 447 3. 143 3. 707 5. 208 5. 959 7 1. 895 2. 365 2. 998 3. 499 4. 785 5. 408 8 1. 860 2. 306 2. 896 3. 355 4. 501 5. 041 9 1. 833 2. 262 2. 821 3. 250 4. 297 4. 781 10 1. 812 2. 228 2. 764 3. 169 4. 144 4. 587 … … … … ∞ 1. 645 1. 960 2. 326 2. 576 3. 090 3. 291 Лекция 1 № 23

Метод наименьших квадратов Если некоторая физическая величина зависит от другой величины , то эту зависимость можно исследовать, измеряя y при различных значениях x. В результате измерений получается ряд значений: x 1, x 2, . . . , xi, . . . , xn; y 1, y 2, . . . , yi, . . . , yn. По данным такого эксперимента можно построить график зависимости y = ƒ(x). Полученная кривая дает возможность судить о виде функции ƒ(x). Однако постоянные коэффициенты, которые входят в эту функцию, остаются неизвестными. Определить их позволяет метод наименьших квадратов. Экспериментальные точки, как правило, не ложатся точно на кривую. Метод наименьших квадратов требует, чтобы сумма квадратов отклонений экспериментальных точек от кривой, т. е. [yi – ƒ(xi)]2 была наименьшей. На практике этот метод наиболее часто (и наиболее просто) используется в случае линейной зависимости, т. е. когда: y = kx или y = a + bx. Лекция 1 № 24

Метод наименьших квадратов Если некоторая физическая величина зависит от другой величины , то эту зависимость можно исследовать, измеряя y при различных значениях x. В результате измерений получается ряд значений: x 1, x 2, . . . , xi, . . . , xn; y 1, y 2, . . . , yi, . . . , yn. По данным такого эксперимента можно построить график зависимости y = ƒ(x). Полученная кривая дает возможность судить о виде функции ƒ(x). Однако постоянные коэффициенты, которые входят в эту функцию, остаются неизвестными. Определить их позволяет метод наименьших квадратов. Экспериментальные точки, как правило, не ложатся точно на кривую. Метод наименьших квадратов требует, чтобы сумма квадратов отклонений экспериментальных точек от кривой, т. е. [yi – ƒ(xi)]2 была наименьшей. На практике этот метод наиболее часто (и наиболее просто) используется в случае линейной зависимости, т. е. когда: y = kx или y = a + bx. Лекция 1 № 24

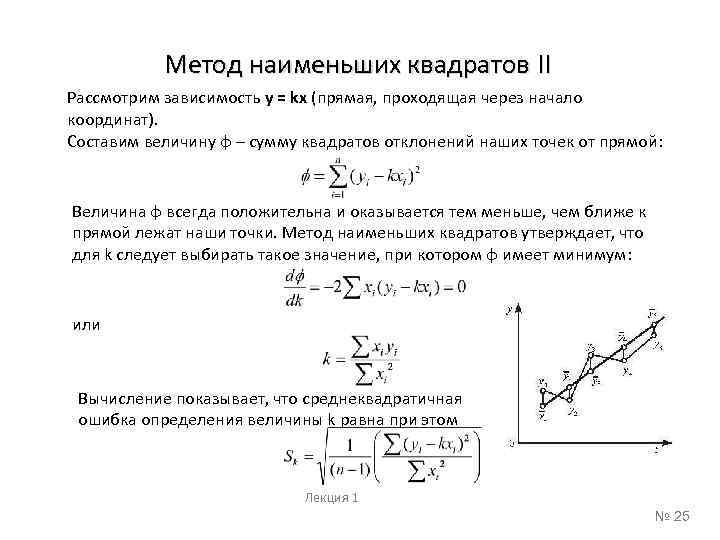

Метод наименьших квадратов II Рассмотрим зависимость y = kx (прямая, проходящая через начало координат). Составим величину φ – сумму квадратов отклонений наших точек от прямой: Величина φ всегда положительна и оказывается тем меньше, чем ближе к прямой лежат наши точки. Метод наименьших квадратов утверждает, что для k следует выбирать такое значение, при котором φ имеет минимум: или Вычисление показывает, что среднеквадратичная ошибка определения величины k равна при этом Лекция 1 № 25

Метод наименьших квадратов II Рассмотрим зависимость y = kx (прямая, проходящая через начало координат). Составим величину φ – сумму квадратов отклонений наших точек от прямой: Величина φ всегда положительна и оказывается тем меньше, чем ближе к прямой лежат наши точки. Метод наименьших квадратов утверждает, что для k следует выбирать такое значение, при котором φ имеет минимум: или Вычисление показывает, что среднеквадратичная ошибка определения величины k равна при этом Лекция 1 № 25

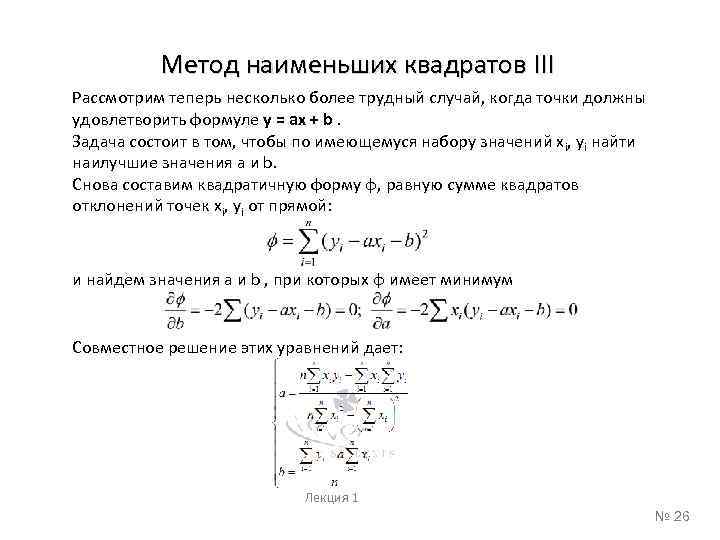

Метод наименьших квадратов III Рассмотрим теперь несколько более трудный случай, когда точки должны удовлетворить формуле y = ax + b. Задача состоит в том, чтобы по имеющемуся набору значений xi, yi найти наилучшие значения a и b. Снова составим квадратичную форму φ, равную сумме квадратов отклонений точек xi, yi от прямой: и найдем значения a и b , при которых φ имеет минимум Совместное решение этих уравнений дает: Лекция 1 № 26

Метод наименьших квадратов III Рассмотрим теперь несколько более трудный случай, когда точки должны удовлетворить формуле y = ax + b. Задача состоит в том, чтобы по имеющемуся набору значений xi, yi найти наилучшие значения a и b. Снова составим квадратичную форму φ, равную сумме квадратов отклонений точек xi, yi от прямой: и найдем значения a и b , при которых φ имеет минимум Совместное решение этих уравнений дает: Лекция 1 № 26

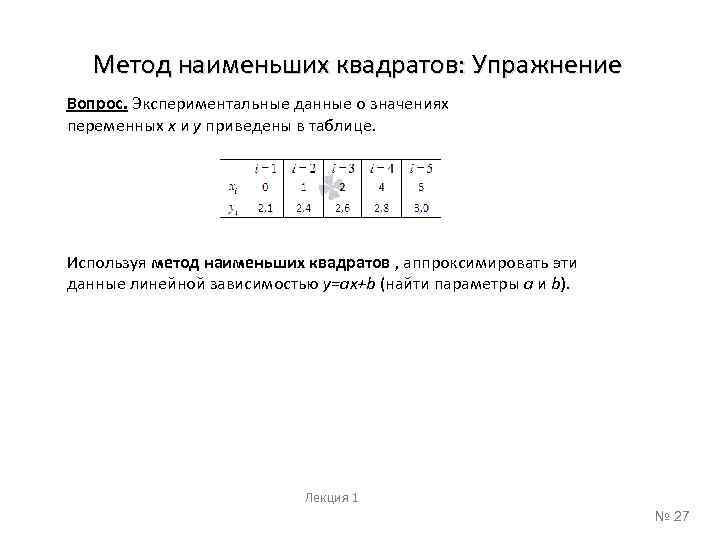

Метод наименьших квадратов: Упражнение Вопрос. Экспериментальные данные о значениях переменных х и у приведены в таблице. Используя метод наименьших квадратов , аппроксимировать эти данные линейной зависимостью y=ax+b (найти параметры а и b). Лекция 1 № 27

Метод наименьших квадратов: Упражнение Вопрос. Экспериментальные данные о значениях переменных х и у приведены в таблице. Используя метод наименьших квадратов , аппроксимировать эти данные линейной зависимостью y=ax+b (найти параметры а и b). Лекция 1 № 27

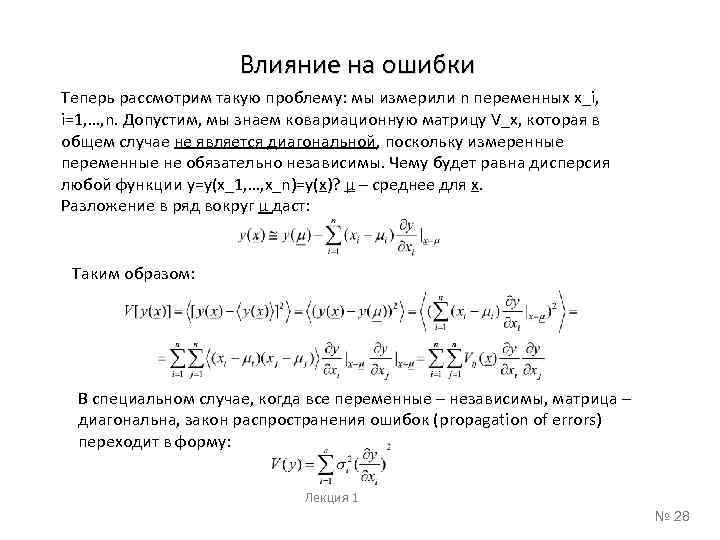

Влияние на ошибки Теперь рассмотрим такую проблему: мы измерили n переменных x_i, i=1, …, n. Допустим, мы знаем ковариационную матрицу V_x, которая в общем случае не является диагональной, поскольку измеренные переменные не обязательно независимы. Чему будет равна дисперсия любой функции y=y(x_1, …, x_n)=y(x)? μ – среднее для x. Разложение в ряд вокруг μ даст: Таким образом: В специальном случае, когда все переменные – независимы, матрица – диагональна, закон распространения ошибок (propagation of errors) переходит в форму: Лекция 1 № 28

Влияние на ошибки Теперь рассмотрим такую проблему: мы измерили n переменных x_i, i=1, …, n. Допустим, мы знаем ковариационную матрицу V_x, которая в общем случае не является диагональной, поскольку измеренные переменные не обязательно независимы. Чему будет равна дисперсия любой функции y=y(x_1, …, x_n)=y(x)? μ – среднее для x. Разложение в ряд вокруг μ даст: Таким образом: В специальном случае, когда все переменные – независимы, матрица – диагональна, закон распространения ошибок (propagation of errors) переходит в форму: Лекция 1 № 28

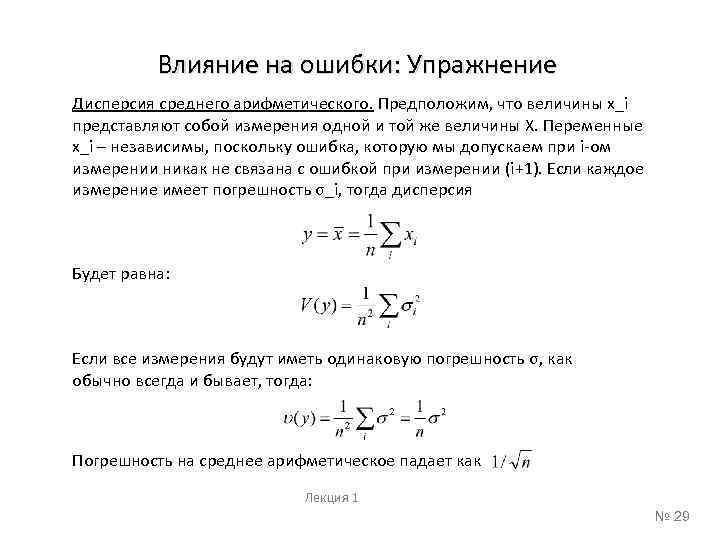

Влияние на ошибки: Упражнение Дисперсия среднего арифметического. Предположим, что величины x_i представляют собой измерения одной и той же величины X. Переменные x_i – независимы, поскольку ошибка, которую мы допускаем при i-ом измерении никак не связана с ошибкой при измерении (i+1). Если каждое измерение имеет погрешность σ_i, тогда дисперсия Будет равна: Если все измерения будут иметь одинаковую погрешность σ, как обычно всегда и бывает, тогда: Погрешность на среднее арифметическое падает как Лекция 1 № 29

Влияние на ошибки: Упражнение Дисперсия среднего арифметического. Предположим, что величины x_i представляют собой измерения одной и той же величины X. Переменные x_i – независимы, поскольку ошибка, которую мы допускаем при i-ом измерении никак не связана с ошибкой при измерении (i+1). Если каждое измерение имеет погрешность σ_i, тогда дисперсия Будет равна: Если все измерения будут иметь одинаковую погрешность σ, как обычно всегда и бывает, тогда: Погрешность на среднее арифметическое падает как Лекция 1 № 29

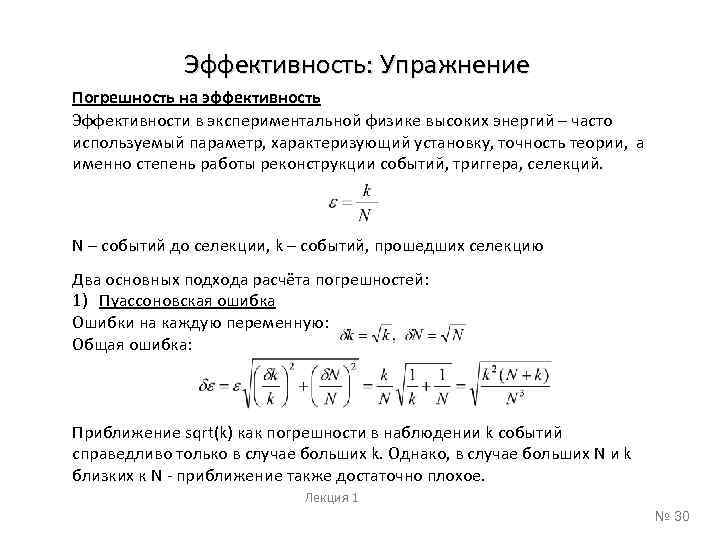

Эффективность: Упражнение Погрешность на эффективность Эффективности в экспериментальной физике высоких энергий – часто используемый параметр, характеризующий установку, точность теории, а именно степень работы реконструкции событий, триггера, селекций. N – событий до селекции, k – событий, прошедших селекцию Два основных подхода расчёта погрешностей: 1) Пуассоновская ошибка Ошибки на каждую переменную: Общая ошибка: Приближение sqrt(k) как погрешности в наблюдении k событий справедливо только в случае больших k. Однако, в случае больших N и k близких к N - приближение также достаточно плохое. Лекция 1 № 30

Эффективность: Упражнение Погрешность на эффективность Эффективности в экспериментальной физике высоких энергий – часто используемый параметр, характеризующий установку, точность теории, а именно степень работы реконструкции событий, триггера, селекций. N – событий до селекции, k – событий, прошедших селекцию Два основных подхода расчёта погрешностей: 1) Пуассоновская ошибка Ошибки на каждую переменную: Общая ошибка: Приближение sqrt(k) как погрешности в наблюдении k событий справедливо только в случае больших k. Однако, в случае больших N и k близких к N - приближение также достаточно плохое. Лекция 1 № 30

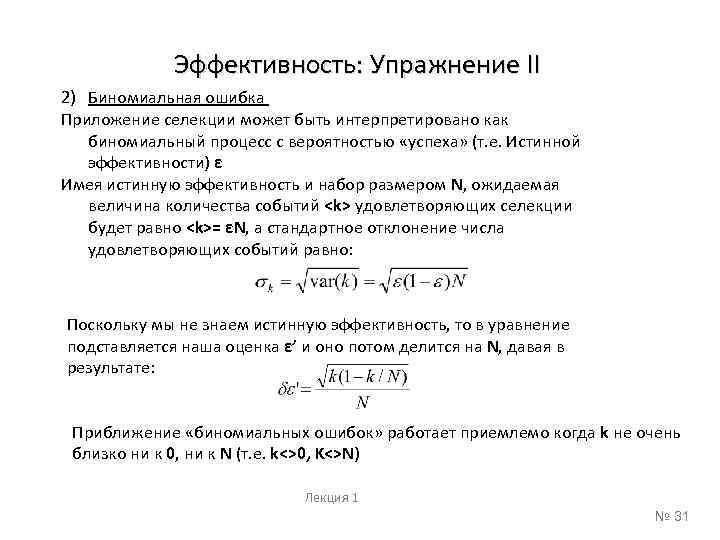

Эффективность: Упражнение II 2) Биномиальная ошибка Приложение селекции может быть интерпретировано как биномиальный процесс с вероятностью «успеха» (т. е. Истинной эффективности) ε Имея истинную эффективность и набор размером N, ожидаемая величина количества событий

Эффективность: Упражнение II 2) Биномиальная ошибка Приложение селекции может быть интерпретировано как биномиальный процесс с вероятностью «успеха» (т. е. Истинной эффективности) ε Имея истинную эффективность и набор размером N, ожидаемая величина количества событий