b25dc26009c321bc05831ba5950022d9.ppt

- Количество слайдов: 69

Методы одномерной минимизации нулевого порядка Группы методов одномерной безусловной минимизации первого порядка: • методы сокращения промежутка неопределенности (методы исключения интервалов); • методы, основанные на аппроксимации (интерполяции). Обе группы требуют нахождения начального промежутка неопределенности для точного решения задачи минимизации. Однако методы исключения интервалов при запуске их на отрезке , не содержащем точку минимума, оказываются работоспособными и позволяют найти точку с наименьшим значением. Методы аппроксимации в этом случае либо вообще не найдут приближенного решения, либо оно будет крайне неточным. 74

Методы одномерной минимизации нулевого порядка Группы методов одномерной безусловной минимизации первого порядка: • методы сокращения промежутка неопределенности (методы исключения интервалов); • методы, основанные на аппроксимации (интерполяции). Обе группы требуют нахождения начального промежутка неопределенности для точного решения задачи минимизации. Однако методы исключения интервалов при запуске их на отрезке , не содержащем точку минимума, оказываются работоспособными и позволяют найти точку с наименьшим значением. Методы аппроксимации в этом случае либо вообще не найдут приближенного решения, либо оно будет крайне неточным. 74

Поиск начального промежутка неопределенности Если , то на отрезке имеется минимум в силу свойства унимодальности . При : Равномерный поиск: Вычисляется координата . Если теперь , то отрезок локализует положение минимума . В противном случае следует положить , и продолжить работу алгоритма с анализа неравенства . Неравномерный поиск: к - номер итерации поиска. 75

Поиск начального промежутка неопределенности Если , то на отрезке имеется минимум в силу свойства унимодальности . При : Равномерный поиск: Вычисляется координата . Если теперь , то отрезок локализует положение минимума . В противном случае следует положить , и продолжить работу алгоритма с анализа неравенства . Неравномерный поиск: к - номер итерации поиска. 75

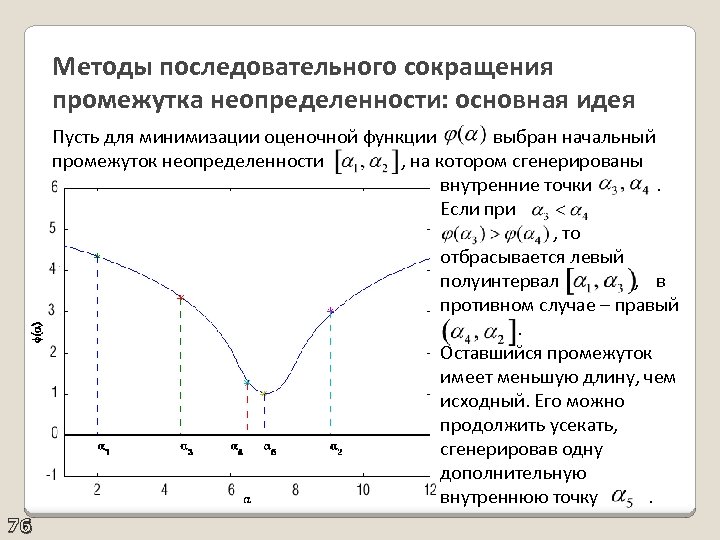

Методы последовательного сокращения промежутка неопределенности: основная идея Пусть для минимизации оценочной функции выбран начальный промежуток неопределенности , на котором сгенерированы внутренние точки. Если при , то отбрасывается левый полуинтервал , в противном случае – правый . Оставшийся промежуток имеет меньшую длину, чем исходный. Его можно продолжить усекать, сгенерировав одну дополнительную внутреннюю точку . 76

Методы последовательного сокращения промежутка неопределенности: основная идея Пусть для минимизации оценочной функции выбран начальный промежуток неопределенности , на котором сгенерированы внутренние точки. Если при , то отбрасывается левый полуинтервал , в противном случае – правый . Оставшийся промежуток имеет меньшую длину, чем исходный. Его можно продолжить усекать, сгенерировав одну дополнительную внутреннюю точку . 76

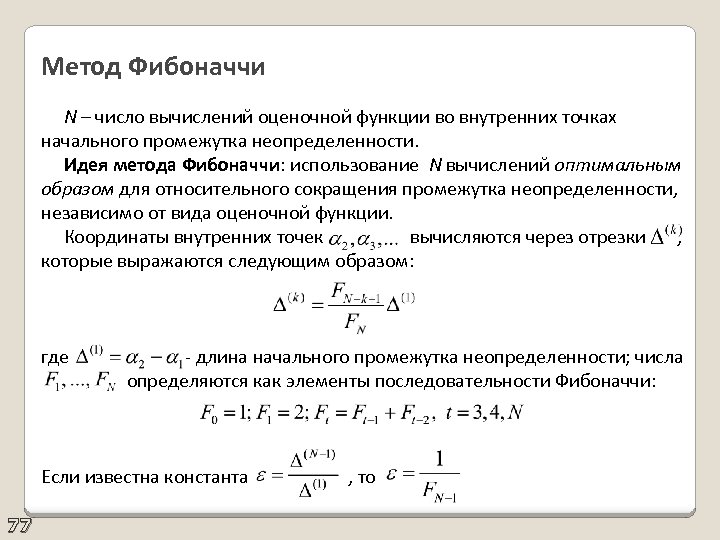

Метод Фибоначчи N – число вычислений оценочной функции во внутренних точках начального промежутка неопределенности. Идея метода Фибоначчи: использование N вычислений оптимальным образом для относительного сокращения промежутка неопределенности, независимо от вида оценочной функции. Координаты внутренних точек вычисляются через отрезки , которые выражаются следующим образом: где - длина начального промежутка неопределенности; числа определяются как элементы последовательности Фибоначчи: Если известна константа , то 77

Метод Фибоначчи N – число вычислений оценочной функции во внутренних точках начального промежутка неопределенности. Идея метода Фибоначчи: использование N вычислений оптимальным образом для относительного сокращения промежутка неопределенности, независимо от вида оценочной функции. Координаты внутренних точек вычисляются через отрезки , которые выражаются следующим образом: где - длина начального промежутка неопределенности; числа определяются как элементы последовательности Фибоначчи: Если известна константа , то 77

Метод золотого сечения Как и метод Фибоначчи, основан на генерации внутренних точек, симметричных относительно середины промежутка неопределенности. Однако длины последовательных интервалов неопределенности берутся в фиксированном отношении: , На к-том этапе исключения интервалов исходная длина промежутка неопределенности будет , а внутренние точки будут располагаться на следующих расстояниях от левого конца этого промежутка: , Метод золотого сечения имеет линейную скорость сходимости с асимптотическим параметром ошибки . 78

Метод золотого сечения Как и метод Фибоначчи, основан на генерации внутренних точек, симметричных относительно середины промежутка неопределенности. Однако длины последовательных интервалов неопределенности берутся в фиксированном отношении: , На к-том этапе исключения интервалов исходная длина промежутка неопределенности будет , а внутренние точки будут располагаться на следующих расстояниях от левого конца этого промежутка: , Метод золотого сечения имеет линейную скорость сходимости с асимптотическим параметром ошибки . 78

Метод дихотомии (нулевого порядка) Метод дихотомии (деления пополам) : Предполагает наличие на к-том этапе исключения интервалов сразу трех внутренних точек, которые делят промежуток неопределенности длиной на четыре равные части. С учетом унимодальности оценочной функции исключению подлежат два из четырех образовавшихся интервалов. На каждой итерации требуется дополнительная генерация двух внутренних точек. Скорость сходимости метода линейна. Асимптотический параметр ошибки равен 79 .

Метод дихотомии (нулевого порядка) Метод дихотомии (деления пополам) : Предполагает наличие на к-том этапе исключения интервалов сразу трех внутренних точек, которые делят промежуток неопределенности длиной на четыре равные части. С учетом унимодальности оценочной функции исключению подлежат два из четырех образовавшихся интервалов. На каждой итерации требуется дополнительная генерация двух внутренних точек. Скорость сходимости метода линейна. Асимптотический параметр ошибки равен 79 .

Сравнение эффективности методов сокращения промежутка неопределенности при заданной величине N При заданном количестве вычислений N оценочной функции во внутренних точках, относительное уменьшение промежутка неопределенности для методов рассматриваемой группы будет выражаться следующими зависимостями: а) метод Фибоначчи: ; б) метод золотого сечения: в) метод дихотомии (нулевого порядка): число 80 ; , N –нечетное

Сравнение эффективности методов сокращения промежутка неопределенности при заданной величине N При заданном количестве вычислений N оценочной функции во внутренних точках, относительное уменьшение промежутка неопределенности для методов рассматриваемой группы будет выражаться следующими зависимостями: а) метод Фибоначчи: ; б) метод золотого сечения: в) метод дихотомии (нулевого порядка): число 80 ; , N –нечетное

Сравнение эффективности методов сокращения промежутка неопределенности при заданной величине N (продолжение) N Метод Фибоначчи Метод золотого сечения Метод дихотомии 3 0. 500 0. 333 0. 382 0. 500 5 0. 333 0. 125 0. 146 0. 250 7 0. 250 0. 048 0. 056 0. 125 9 0. 200 0. 0182 0. 00213 0. 0625 11 0. 167 0. 00694 0. 00813 0. 0312 13 0. 143 0. 00265 0. 00311 0. 0156 15 0. 125 0. 00101 0. 00119 0. 00781 17 0. 111 0. 000387 0. 000453 0. 00391 19 81 Равномерный поиск 0. 100 0. 000148 0. 000173 0. 00195

Сравнение эффективности методов сокращения промежутка неопределенности при заданной величине N (продолжение) N Метод Фибоначчи Метод золотого сечения Метод дихотомии 3 0. 500 0. 333 0. 382 0. 500 5 0. 333 0. 125 0. 146 0. 250 7 0. 250 0. 048 0. 056 0. 125 9 0. 200 0. 0182 0. 00213 0. 0625 11 0. 167 0. 00694 0. 00813 0. 0312 13 0. 143 0. 00265 0. 00311 0. 0156 15 0. 125 0. 00101 0. 00119 0. 00781 17 0. 111 0. 000387 0. 000453 0. 00391 19 81 Равномерный поиск 0. 100 0. 000148 0. 000173 0. 00195

Методы, основанные на аппроксимации: основная идея Методы основаны на аппроксимации на отрезке оценочной функции гладкой функцией известного вида с тем, чтобы в качестве хорошего приближения к точке локального минимума взять точку локального минимума . Такую операцию можно осуществлять многократно, на каждом шаге уточняя за счет уменьшения отрезка с использованием полученной точки . Вид функции можно подобрать, исследуя характер зависимости для ряда прикладных задач оптимизации, подлежащих решению. 82

Методы, основанные на аппроксимации: основная идея Методы основаны на аппроксимации на отрезке оценочной функции гладкой функцией известного вида с тем, чтобы в качестве хорошего приближения к точке локального минимума взять точку локального минимума . Такую операцию можно осуществлять многократно, на каждом шаге уточняя за счет уменьшения отрезка с использованием полученной точки . Вид функции можно подобрать, исследуя характер зависимости для ряда прикладных задач оптимизации, подлежащих решению. 82

Задача интерполяции. Выбор узлов Чтобы была достаточно близка к , у аппроксимирующей функции вычисляются свободные (неопределенные) коэффициенты. В методах оптимизации, не использующих производных, обычно используют критерий приближения, состоящий в точном совпадении значений и в ряде точек, называемых узлами интерполяции, при этом саму аппроксимацию именуют интерполяцией. Для обеспечения точности интерполяции нельзя располагать все узлы интерполяции по одну сторону от (в этом случае интерполяция превращается в экстраполяцию, состоящую в предсказании поведения функции за пределами исследованного интервала). Кроме того, для возможности нахождения неопределенных коэффициентов никакие два узла не должны быть близки друг к другу. 83

Задача интерполяции. Выбор узлов Чтобы была достаточно близка к , у аппроксимирующей функции вычисляются свободные (неопределенные) коэффициенты. В методах оптимизации, не использующих производных, обычно используют критерий приближения, состоящий в точном совпадении значений и в ряде точек, называемых узлами интерполяции, при этом саму аппроксимацию именуют интерполяцией. Для обеспечения точности интерполяции нельзя располагать все узлы интерполяции по одну сторону от (в этом случае интерполяция превращается в экстраполяцию, состоящую в предсказании поведения функции за пределами исследованного интервала). Кроме того, для возможности нахождения неопределенных коэффициентов никакие два узла не должны быть близки друг к другу. 83

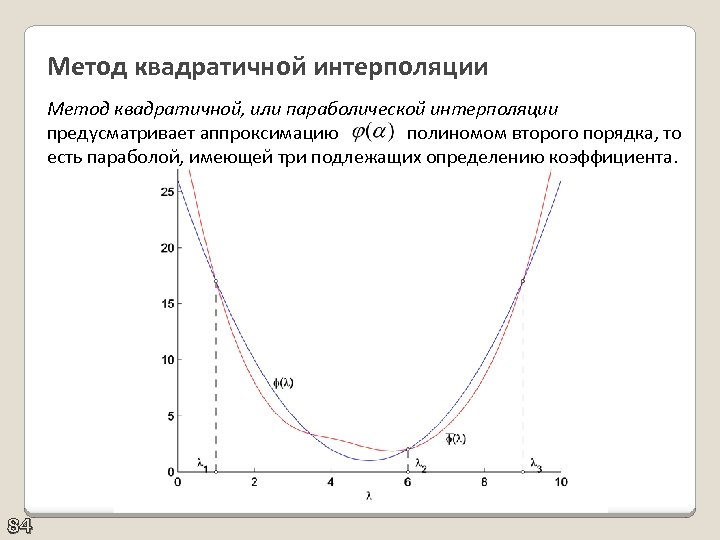

Метод квадратичной интерполяции Метод квадратичной, или параболической интерполяции предусматривает аппроксимацию полиномом второго порядка, то есть параболой, имеющей три подлежащих определению коэффициента. 84

Метод квадратичной интерполяции Метод квадратичной, или параболической интерполяции предусматривает аппроксимацию полиномом второго порядка, то есть параболой, имеющей три подлежащих определению коэффициента. 84

Поиск улов интерполяции Для нахождения узлов интерполяции можно воспользоваться пассивным поиском начального промежутка неопределенности. Если на первой итерации данного поиска , то полученные в результате работы алгоритма последние значения могут быть использованы в качестве узлов интерполяции. Если же начальный промежуток неопределенности находится уже на первой итерации ввиду соблюдения условия , то необходимо определить еще координату среднего узла. Для этого сначала с целью единообразия расположения узлов положим , а затем вычислим Если , то поиск узлов можно прекратить. В противном случае следует урезать промежуток неопределенности до для сокращения интервала, на котором производится интерполяция, и вернуться к началу алгоритма нахождения среднего узла. 85

Поиск улов интерполяции Для нахождения узлов интерполяции можно воспользоваться пассивным поиском начального промежутка неопределенности. Если на первой итерации данного поиска , то полученные в результате работы алгоритма последние значения могут быть использованы в качестве узлов интерполяции. Если же начальный промежуток неопределенности находится уже на первой итерации ввиду соблюдения условия , то необходимо определить еще координату среднего узла. Для этого сначала с целью единообразия расположения узлов положим , а затем вычислим Если , то поиск узлов можно прекратить. В противном случае следует урезать промежуток неопределенности до для сокращения интервала, на котором производится интерполяция, и вернуться к началу алгоритма нахождения среднего узла. 85

Нахождение коэффициентов интерполирующей функции 86

Нахождение коэффициентов интерполирующей функции 86

Нахождение первого и последующих приближений В грубом приближении одну из точек и , в которой принимает наименьшее значение, можно принять за решение задачи. При необходимости, процесс итераций можно продолжить. В этом случае точка принимается за узел интерполяции на следующем этапе минимизации, а один из прежних узлов отбрасывается. При отбрасывании узла в оставшихся узлах должно соблюдаться правило: значение функции в среднем узле должно быть меньше значений в крайних узлах. 87 Метод параболической интерполяции достигает сверхлинейной скорости сходимости, поскольку вблизи точки минимума квадратичная аппроксимация достаточно хорошо описывает реальную оценочную функцию.

Нахождение первого и последующих приближений В грубом приближении одну из точек и , в которой принимает наименьшее значение, можно принять за решение задачи. При необходимости, процесс итераций можно продолжить. В этом случае точка принимается за узел интерполяции на следующем этапе минимизации, а один из прежних узлов отбрасывается. При отбрасывании узла в оставшихся узлах должно соблюдаться правило: значение функции в среднем узле должно быть меньше значений в крайних узлах. 87 Метод параболической интерполяции достигает сверхлинейной скорости сходимости, поскольку вблизи точки минимума квадратичная аппроксимация достаточно хорошо описывает реальную оценочную функцию.

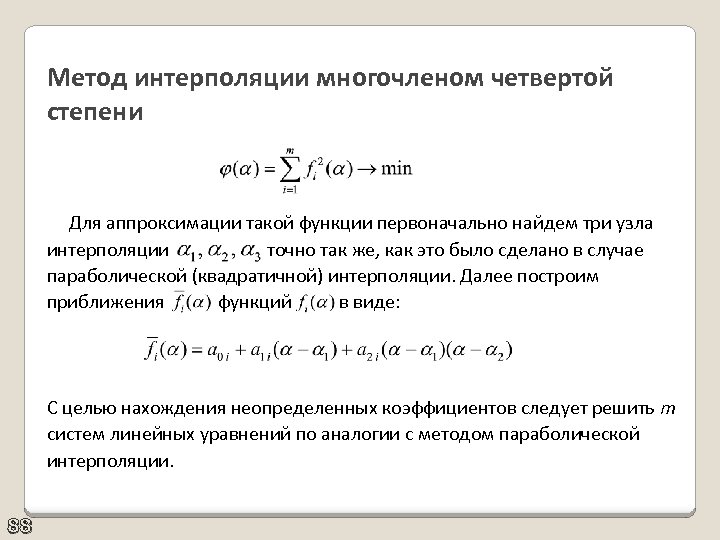

Метод интерполяции многочленом четвертой степени Для аппроксимации такой функции первоначально найдем три узла интерполяции точно так же, как это было сделано в случае параболической (квадратичной) интерполяции. Далее построим приближения функций в виде: С целью нахождения неопределенных коэффициентов следует решить m систем линейных уравнений по аналогии с методом параболической интерполяции. 88

Метод интерполяции многочленом четвертой степени Для аппроксимации такой функции первоначально найдем три узла интерполяции точно так же, как это было сделано в случае параболической (квадратичной) интерполяции. Далее построим приближения функций в виде: С целью нахождения неопределенных коэффициентов следует решить m систем линейных уравнений по аналогии с методом параболической интерполяции. 88

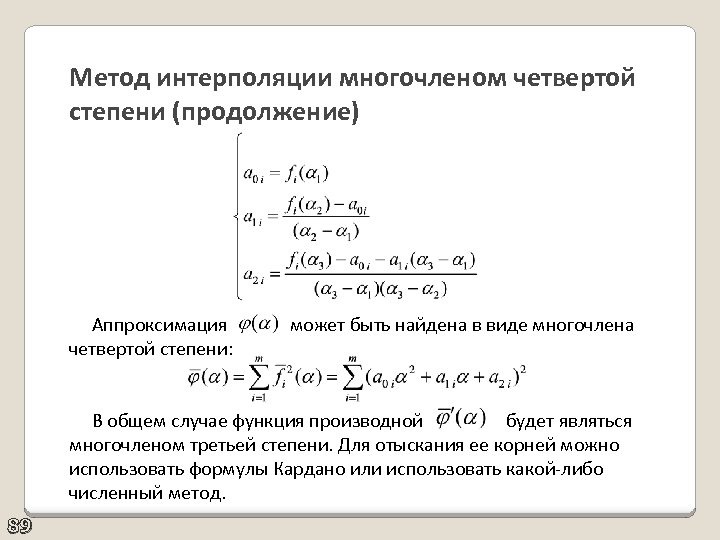

Метод интерполяции многочленом четвертой степени (продолжение) Аппроксимация четвертой степени: может быть найдена в виде многочлена В общем случае функция производной будет являться многочленом третьей степени. Для отыскания ее корней можно использовать формулы Кардано или использовать какой-либо численный метод. 89

Метод интерполяции многочленом четвертой степени (продолжение) Аппроксимация четвертой степени: может быть найдена в виде многочлена В общем случае функция производной будет являться многочленом третьей степени. Для отыскания ее корней можно использовать формулы Кардано или использовать какой-либо численный метод. 89

Методы одномерной безусловной минимизации первого порядка В методах используются значения оценочной функции и ее производной. Методы одномерной минимизации первого порядка разделяют на: • методы, сводящиеся к решению уравнения; • методы, основанные на аппроксимации (интерполяции). 90

Методы одномерной безусловной минимизации первого порядка В методах используются значения оценочной функции и ее производной. Методы одномерной минимизации первого порядка разделяют на: • методы, сводящиеся к решению уравнения; • методы, основанные на аппроксимации (интерполяции). 90

Методы, сводящиеся к решению уравнения Идея методов данной группы заключается в том, что при условии унимодальности задача ее минимизации эквивалентна нахождению корня производной оценочной функции: Данное уравнение обычно является нелинейным, и для его решения можно использовать известные численные методы 91

Методы, сводящиеся к решению уравнения Идея методов данной группы заключается в том, что при условии унимодальности задача ее минимизации эквивалентна нахождению корня производной оценочной функции: Данное уравнение обычно является нелинейным, и для его решения можно использовать известные численные методы 91

Сокращение промежутка неопределенности в методах первого порядка Основано на использовании свойства непрерывной функции: если непрерывная функция на концах отрезка имеет разные знаки, то на этом отрезке она имеет по меньшей мере один корень (теорема Больцано-Коши). Применительно к задачам одномерной минимизации это означает, что единственная точка минимума унимодальной оценочной функции , если: 92 необходимо принадлежит отрезку ,

Сокращение промежутка неопределенности в методах первого порядка Основано на использовании свойства непрерывной функции: если непрерывная функция на концах отрезка имеет разные знаки, то на этом отрезке она имеет по меньшей мере один корень (теорема Больцано-Коши). Применительно к задачам одномерной минимизации это означает, что единственная точка минимума унимодальной оценочной функции , если: 92 необходимо принадлежит отрезку ,

Сокращение промежутка неопределенности в методах первого порядка (продолжение) Пусть найден начальный промежуток неопределенности , на концах которого оценочная функция имеет разные знаки. Возьмем в нем некоторую точку . Тогда, если то полуинтервал минимума не содержит и, следовательно, может быть исключен из дальнейшего рассмотрения. Если же то исключению подлежит уже полуинтервал . 93

Сокращение промежутка неопределенности в методах первого порядка (продолжение) Пусть найден начальный промежуток неопределенности , на концах которого оценочная функция имеет разные знаки. Возьмем в нем некоторую точку . Тогда, если то полуинтервал минимума не содержит и, следовательно, может быть исключен из дальнейшего рассмотрения. Если же то исключению подлежит уже полуинтервал . 93

Метод дихотомии первого порядка В методе дихотомии (деления пополам) первого порядка, называемом еще методом средней точки, внутренняя точка всегда выбирается в середине текущего промежутка неопределенности: Реализация метода осуществляется в два этапа. Первый носит название отделения, или изоляции корня, а второй именуют уточнением корня производной. 94

Метод дихотомии первого порядка В методе дихотомии (деления пополам) первого порядка, называемом еще методом средней точки, внутренняя точка всегда выбирается в середине текущего промежутка неопределенности: Реализация метода осуществляется в два этапа. Первый носит название отделения, или изоляции корня, а второй именуют уточнением корня производной. 94

Метод дихотомии первого порядка (продолжение) – отделение корня • пассивный поиск по значениям унимодальной функции ; • пассивный поиск по значениям производной Пусть ; и задана величина . Вычислим и проверим, соблюдается ли условие: Если указанное условие выполняется, то. В противном случае можно положить 95 , вновь найти

Метод дихотомии первого порядка (продолжение) – отделение корня • пассивный поиск по значениям унимодальной функции ; • пассивный поиск по значениям производной Пусть ; и задана величина . Вычислим и проверим, соблюдается ли условие: Если указанное условие выполняется, то. В противном случае можно положить 95 , вновь найти

Метод дихотомии первого порядка (продолжение) – уточнение корня 96

Метод дихотомии первого порядка (продолжение) – уточнение корня 96

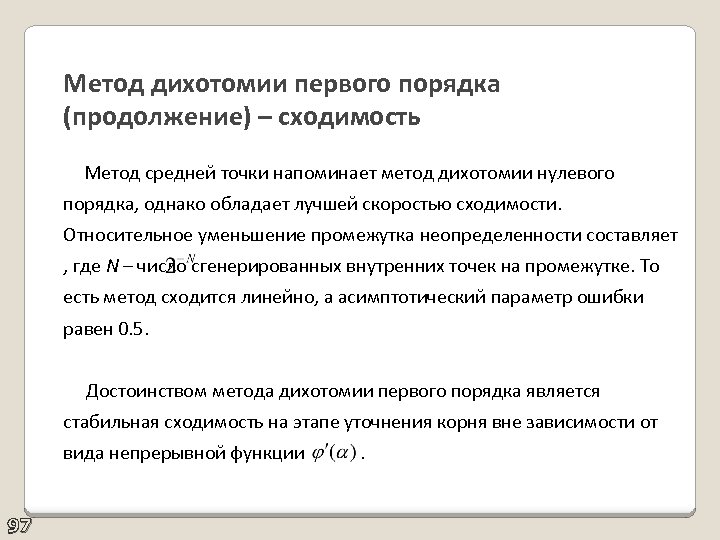

Метод дихотомии первого порядка (продолжение) – сходимость Метод средней точки напоминает метод дихотомии нулевого порядка, однако обладает лучшей скоростью сходимости. Относительное уменьшение промежутка неопределенности составляет , где N – число сгенерированных внутренних точек на промежутке. То есть метод сходится линейно, а асимптотический параметр ошибки равен 0. 5. Достоинством метода дихотомии первого порядка является стабильная сходимость на этапе уточнения корня вне зависимости от вида непрерывной функции 97 .

Метод дихотомии первого порядка (продолжение) – сходимость Метод средней точки напоминает метод дихотомии нулевого порядка, однако обладает лучшей скоростью сходимости. Относительное уменьшение промежутка неопределенности составляет , где N – число сгенерированных внутренних точек на промежутке. То есть метод сходится линейно, а асимптотический параметр ошибки равен 0. 5. Достоинством метода дихотомии первого порядка является стабильная сходимость на этапе уточнения корня вне зависимости от вида непрерывной функции 97 .

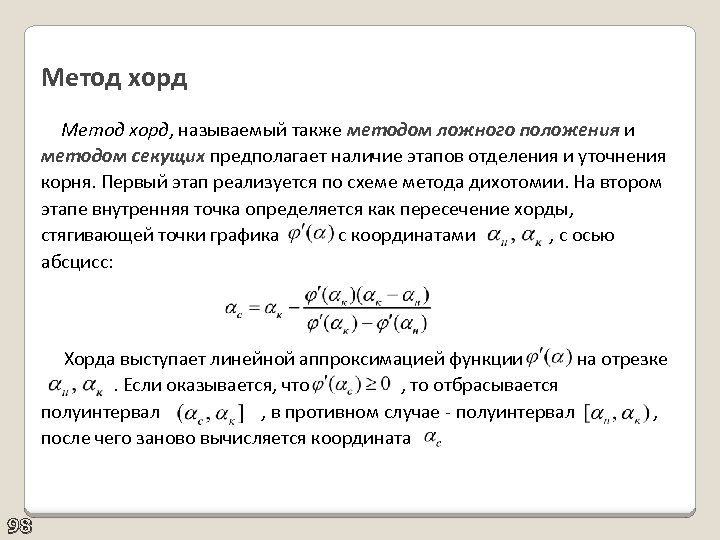

Метод хорд, называемый также методом ложного положения и методом секущих предполагает наличие этапов отделения и уточнения корня. Первый этап реализуется по схеме метода дихотомии. На втором этапе внутренняя точка определяется как пересечение хорды, стягивающей точки графика с координатами , с осью абсцисс: Хорда выступает линейной аппроксимацией функции на отрезке . Если оказывается, что , то отбрасывается полуинтервал , в противном случае - полуинтервал , после чего заново вычисляется координата 98

Метод хорд, называемый также методом ложного положения и методом секущих предполагает наличие этапов отделения и уточнения корня. Первый этап реализуется по схеме метода дихотомии. На втором этапе внутренняя точка определяется как пересечение хорды, стягивающей точки графика с координатами , с осью абсцисс: Хорда выступает линейной аппроксимацией функции на отрезке . Если оказывается, что , то отбрасывается полуинтервал , в противном случае - полуинтервал , после чего заново вычисляется координата 98

Метод хорд (продолжение) – уточнение корня 99

Метод хорд (продолжение) – уточнение корня 99

Метод хорд (продолжение) – проблемы сходимости 100

Метод хорд (продолжение) – проблемы сходимости 100

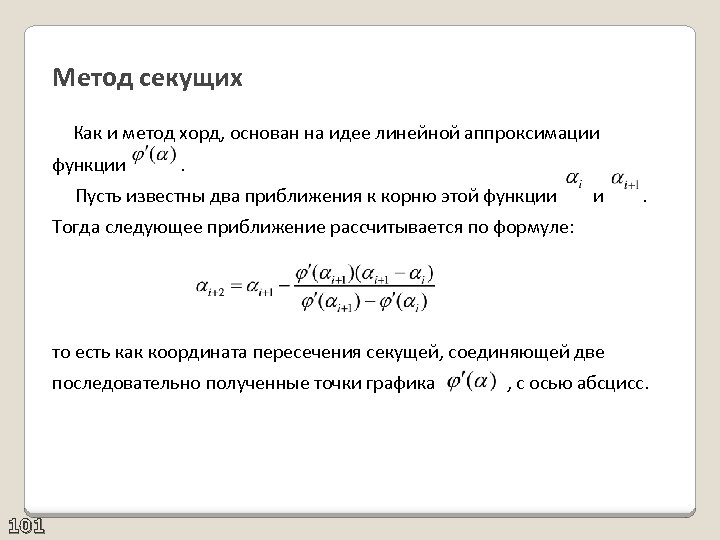

Метод секущих Как и метод хорд, основан на идее линейной аппроксимации функции . Пусть известны два приближения к корню этой функции и . Тогда следующее приближение рассчитывается по формуле: то есть как координата пересечения секущей, соединяющей две последовательно полученные точки графика 101 , с осью абсцисс.

Метод секущих Как и метод хорд, основан на идее линейной аппроксимации функции . Пусть известны два приближения к корню этой функции и . Тогда следующее приближение рассчитывается по формуле: то есть как координата пересечения секущей, соединяющей две последовательно полученные точки графика 101 , с осью абсцисс.

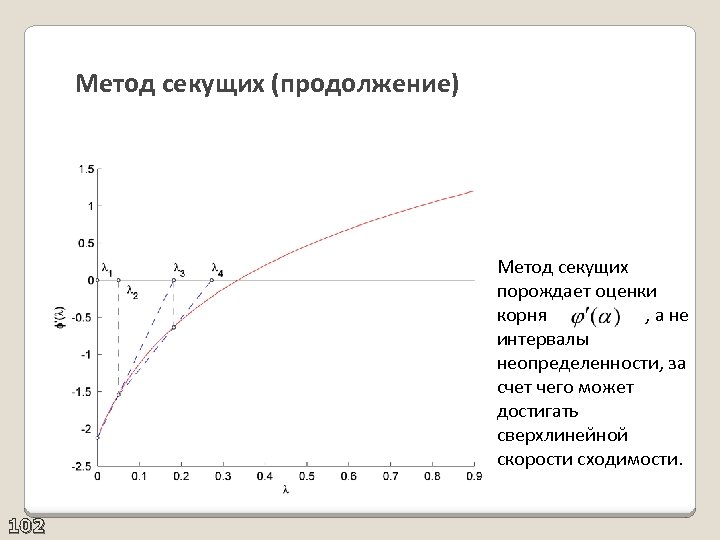

Метод секущих (продолжение) Метод секущих порождает оценки корня , а не интервалы неопределенности, за счет чего может достигать сверхлинейной скорости сходимости. 102

Метод секущих (продолжение) Метод секущих порождает оценки корня , а не интервалы неопределенности, за счет чего может достигать сверхлинейной скорости сходимости. 102

Метод секущих (продолжение) – проблемы сходимости 103

Метод секущих (продолжение) – проблемы сходимости 103

Регуляризованные методы Комбинация теоретически «быстрого» , но ненадежного метода с теоретически «медленным» , но надежным. Комбинация метода секущих и метода дихотомии: • поиск начального промежутка неопределенности; • определение очередного приближения: по методу секущих - в случае его «разумности» или по методу дихотомии; • нахождение нового промежутка неопределенности и продолжение алгоритма 104

Регуляризованные методы Комбинация теоретически «быстрого» , но ненадежного метода с теоретически «медленным» , но надежным. Комбинация метода секущих и метода дихотомии: • поиск начального промежутка неопределенности; • определение очередного приближения: по методу секущих - в случае его «разумности» или по методу дихотомии; • нахождение нового промежутка неопределенности и продолжение алгоритма 104

Принципы отбора «разумных» приближений • принадлежит текущему промежутку неопределенности ; • величина расстояния от до «лучшей» из точек не превышает половины длины (в противном случае деление промежутка неопределенности пополам вероятнее всего даст большее его сокращение); • координата точки численно существенно отличается от координаты (или другой «лучшей» точки, по которой будет строиться секущая на следующем шаге) – в противном случае линейная аппроксимация на следующей итерации может оказаться бессмысленной из-за ошибок округления. 105

Принципы отбора «разумных» приближений • принадлежит текущему промежутку неопределенности ; • величина расстояния от до «лучшей» из точек не превышает половины длины (в противном случае деление промежутка неопределенности пополам вероятнее всего даст большее его сокращение); • координата точки численно существенно отличается от координаты (или другой «лучшей» точки, по которой будет строиться секущая на следующем шаге) – в противном случае линейная аппроксимация на следующей итерации может оказаться бессмысленной из-за ошибок округления. 105

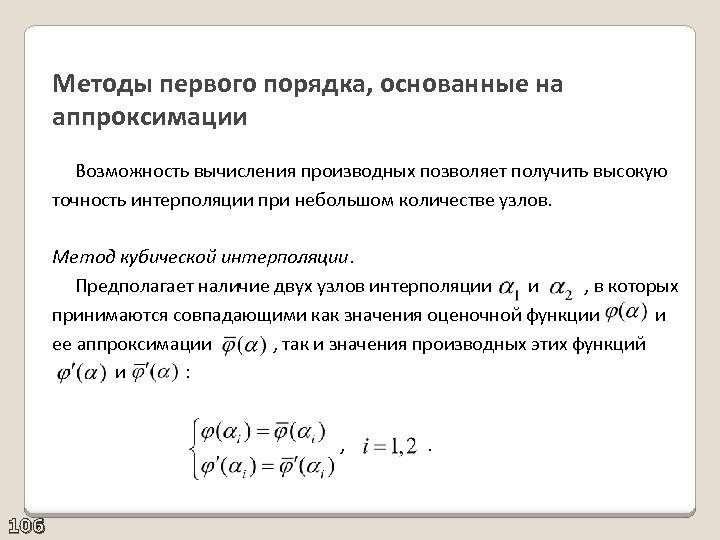

Методы первого порядка, основанные на аппроксимации Возможность вычисления производных позволяет получить высокую точность интерполяции при небольшом количестве узлов. Метод кубической интерполяции. Предполагает наличие двух узлов интерполяции и , в которых принимаются совпадающими как значения оценочной функции и ее аппроксимации , так и значения производных этих функций и : , . 106

Методы первого порядка, основанные на аппроксимации Возможность вычисления производных позволяет получить высокую точность интерполяции при небольшом количестве узлов. Метод кубической интерполяции. Предполагает наличие двух узлов интерполяции и , в которых принимаются совпадающими как значения оценочной функции и ее аппроксимации , так и значения производных этих функций и : , . 106

Метод кубической интерполяции 107

Метод кубической интерполяции 107

Метод кубической интерполяции (продолжение) Аппроксимирующую функцию удобно выбрать в виде интерполяционного многочлена Эрмита: При таком выборе коэффициенты находятся рекурсивно: Для отыскания точки минимума аппроксимирующей функции следует решить квадратное уравнение и выбрать единственный корень, принадлежащий отрезку 108

Метод кубической интерполяции (продолжение) Аппроксимирующую функцию удобно выбрать в виде интерполяционного многочлена Эрмита: При таком выборе коэффициенты находятся рекурсивно: Для отыскания точки минимума аппроксимирующей функции следует решить квадратное уравнение и выбрать единственный корень, принадлежащий отрезку 108

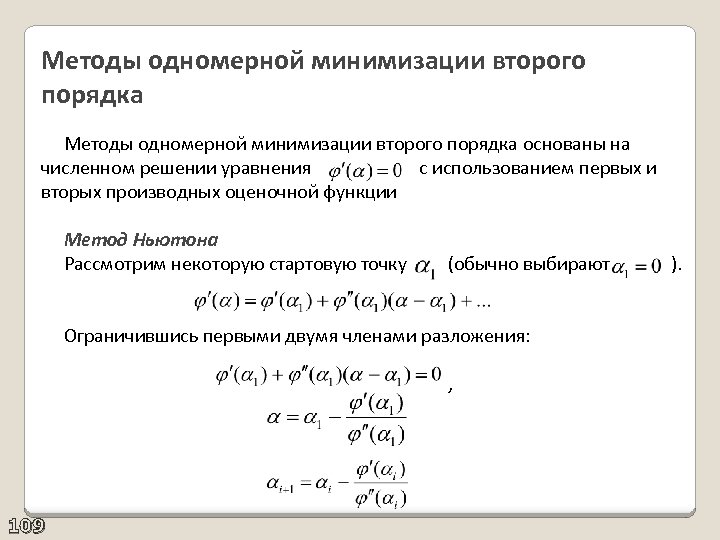

Методы одномерной минимизации второго порядка основаны на численном решении уравнения с использованием первых и вторых производных оценочной функции Метод Ньютона Рассмотрим некоторую стартовую точку (обычно выбирают ). Ограничившись первыми двумя членами разложения: , 109

Методы одномерной минимизации второго порядка основаны на численном решении уравнения с использованием первых и вторых производных оценочной функции Метод Ньютона Рассмотрим некоторую стартовую точку (обычно выбирают ). Ограничившись первыми двумя членами разложения: , 109

Метод Ньютона 110

Метод Ньютона 110

Сходимость метода Ньютона. Регуляризованные методы Метод Ньютона достигает квадратичной скорости сходимости, когда стартовая точка достаточно близка к корню производной. Но на практике скорость сходимости существенным образом зависит от выбора стартовой точки. В частности, при неудачном выборе исходной позиции метод может расходиться. Для обеспечения надежности работы алгоритма второго порядка используют регуляризацию - по аналогии с тем, как это практикуется в методах первого порядка. Обычно применяется комбинация метода Ньютона и одного из стабильных методов первого порядка (дихотомии или хорд). 111

Сходимость метода Ньютона. Регуляризованные методы Метод Ньютона достигает квадратичной скорости сходимости, когда стартовая точка достаточно близка к корню производной. Но на практике скорость сходимости существенным образом зависит от выбора стартовой точки. В частности, при неудачном выборе исходной позиции метод может расходиться. Для обеспечения надежности работы алгоритма второго порядка используют регуляризацию - по аналогии с тем, как это практикуется в методах первого порядка. Обычно применяется комбинация метода Ньютона и одного из стабильных методов первого порядка (дихотомии или хорд). 111

Методы оценки длины шага Оценки длины шага исходят из двух принципов: • величина длины шага не должна быть слишком большой (иначе алгоритм локального спуска начинает осциллировать); • величина длины шага не должна быть слишком маленькой (иначе алгоритм локального спуска может сходиться очень медленно). Правила оценки длины шага часто именуют «экономичным» или «наилучшим» поиском. 112

Методы оценки длины шага Оценки длины шага исходят из двух принципов: • величина длины шага не должна быть слишком большой (иначе алгоритм локального спуска начинает осциллировать); • величина длины шага не должна быть слишком маленькой (иначе алгоритм локального спуска может сходиться очень медленно). Правила оценки длины шага часто именуют «экономичным» или «наилучшим» поиском. 112

Методы оценки длины шага Правило Гольдстейна состоит в соблюдении условий: где (обычно ); Правило Армийо Правило Вольфе-Пауэлла: где 113 (обычно ) .

Методы оценки длины шага Правило Гольдстейна состоит в соблюдении условий: где (обычно ); Правило Армийо Правило Вольфе-Пауэлла: где 113 (обычно ) .

Алгоритм поиска на примере правила Гольдстейна Положим , - константа, выражающая бесконечность. Выберем из промежутка . Если первое условие по правилу не соблюдается, то нужно положить и вернуться к выбору . В противном случае следует проверить второе условие. Если оно не соблюдается, то нужно положить и вернуться к выбору __. В итоге получим точку , удовлетворяющую правилу Гольдстейна. Начальный выбор на втором и последующих шагах локального спуска можно осуществлять с учетом информации, полученной на предыдущих итерациях. 114

Алгоритм поиска на примере правила Гольдстейна Положим , - константа, выражающая бесконечность. Выберем из промежутка . Если первое условие по правилу не соблюдается, то нужно положить и вернуться к выбору . В противном случае следует проверить второе условие. Если оно не соблюдается, то нужно положить и вернуться к выбору __. В итоге получим точку , удовлетворяющую правилу Гольдстейна. Начальный выбор на втором и последующих шагах локального спуска можно осуществлять с учетом информации, полученной на предыдущих итерациях. 114

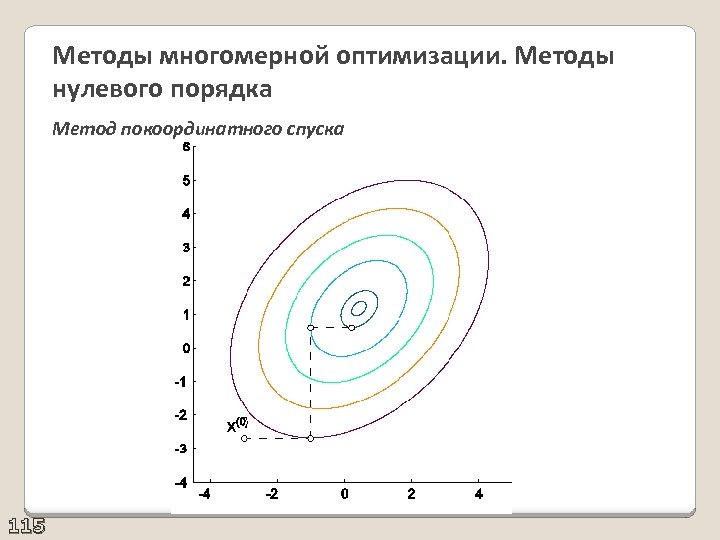

Методы многомерной оптимизации. Методы нулевого порядка Метод покоординатного спуска 115

Методы многомерной оптимизации. Методы нулевого порядка Метод покоординатного спуска 115

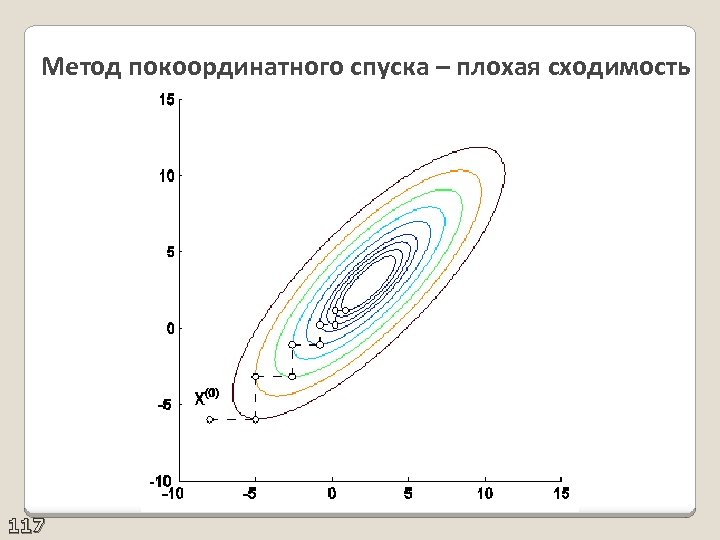

Метод покоординатного спуска - сходимость Можно доказать, что метод покоординатного спуска сходится при условии непрерывной дифференцируемости . Высокая скорость сходимости наблюдается при решении задач с сепарабельной оценочной функцией или когда переменные слабо связаны между собой. В иных случаях скорость сходимости может оказаться весьма медленной. Хотя общих оценок сходимости метода покоординатного спуска не получено, исследование квадратичного случая показывает, что если линии уровня оценочной функции вытягиваются вдоль направления, непараллельного координатным осям, то скорость сходимости резко снижается 116

Метод покоординатного спуска - сходимость Можно доказать, что метод покоординатного спуска сходится при условии непрерывной дифференцируемости . Высокая скорость сходимости наблюдается при решении задач с сепарабельной оценочной функцией или когда переменные слабо связаны между собой. В иных случаях скорость сходимости может оказаться весьма медленной. Хотя общих оценок сходимости метода покоординатного спуска не получено, исследование квадратичного случая показывает, что если линии уровня оценочной функции вытягиваются вдоль направления, непараллельного координатным осям, то скорость сходимости резко снижается 116

Метод покоординатного спуска – плохая сходимость 117

Метод покоординатного спуска – плохая сходимость 117

Метод Хука и Дживса Поиск состоит из последовательности шагов исследующего поиска вдоль координатных осей, за которым в случае успеха следует поиск по образцу. Исследующий поиск Переменные вокруг базовой точки последовательно изменяются на величину . Если при изменении на не происходит уменьшения оценочной функции, то эта переменная возмущается на величину - . Когда и такое возмущение оказывается неудачным, переменную фиксируют на исходной величине и приступают к вариации . Получаем точку 118

Метод Хука и Дживса Поиск состоит из последовательности шагов исследующего поиска вдоль координатных осей, за которым в случае успеха следует поиск по образцу. Исследующий поиск Переменные вокруг базовой точки последовательно изменяются на величину . Если при изменении на не происходит уменьшения оценочной функции, то эта переменная возмущается на величину - . Когда и такое возмущение оказывается неудачным, переменную фиксируют на исходной величине и приступают к вариации . Получаем точку 118

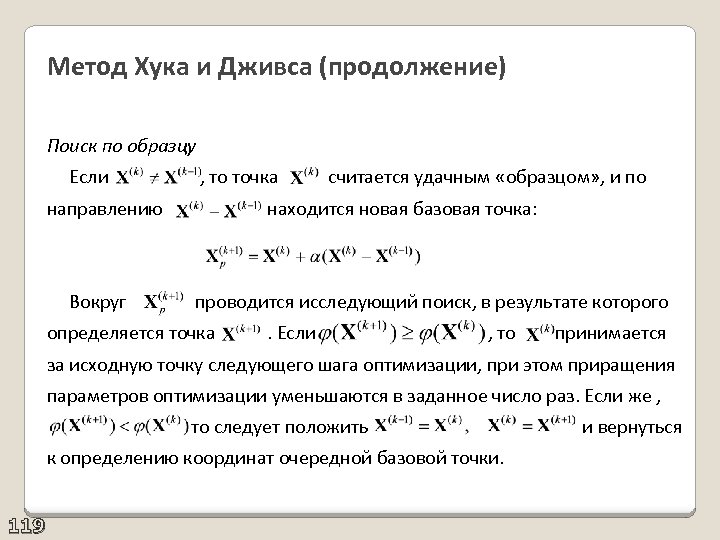

Метод Хука и Дживса (продолжение) Поиск по образцу Если , то точка считается удачным «образцом» , и по направлению Вокруг находится новая базовая точка: проводится исследующий поиск, в результате которого определяется точка . Если , то принимается за исходную точку следующего шага оптимизации, при этом приращения параметров оптимизации уменьшаются в заданное число раз. Если же , то следует положить к определению координат очередной базовой точки. 119 и вернуться

Метод Хука и Дживса (продолжение) Поиск по образцу Если , то точка считается удачным «образцом» , и по направлению Вокруг находится новая базовая точка: проводится исследующий поиск, в результате которого определяется точка . Если , то принимается за исходную точку следующего шага оптимизации, при этом приращения параметров оптимизации уменьшаются в заданное число раз. Если же , то следует положить к определению координат очередной базовой точки. 119 и вернуться

Метод деформируемого многогранника В окрестности стартовой точки оптимизации строится правильный многогранник (регулярный симплекс) с вершиной. Координаты вершин : где i – номер вершины, j – номер элемента в соответствующем векторе, l – длина ребра многогранника. - вершины, которым соответствуют наибольшее, следующее за ним по величине и наименьшее значение оценочной функции Находится центр масс системы n материальных точек одинаковой массы, размещенных в вершинах симплекса, за исключением вершины : 120

Метод деформируемого многогранника В окрестности стартовой точки оптимизации строится правильный многогранник (регулярный симплекс) с вершиной. Координаты вершин : где i – номер вершины, j – номер элемента в соответствующем векторе, l – длина ребра многогранника. - вершины, которым соответствуют наибольшее, следующее за ним по величине и наименьшее значение оценочной функции Находится центр масс системы n материальных точек одинаковой массы, размещенных в вершинах симплекса, за исключением вершины : 120

Метод деформируемого многогранника (продолжение) Типовые операции: • Отражение • Растяжение (при (обычно , • Сжатие 1) , 121 ): )

Метод деформируемого многогранника (продолжение) Типовые операции: • Отражение • Растяжение (при (обычно , • Сжатие 1) , 121 ): )

Метод деформируемого многогранника (продолжение) 2) Здесь первоначально заменим в симплексе точку на , введя соответствующее переобозначение на , а затем выполним сжатие • Редукция Если , то заменим в симплексе на и продолжим оптимизацию на следующем шаге. В противном случае необходимо уменьшить размерность симплекса, задав вершины относительно точки _____следующим образом: 122

Метод деформируемого многогранника (продолжение) 2) Здесь первоначально заменим в симплексе точку на , введя соответствующее переобозначение на , а затем выполним сжатие • Редукция Если , то заменим в симплексе на и продолжим оптимизацию на следующем шаге. В противном случае необходимо уменьшить размерность симплекса, задав вершины относительно точки _____следующим образом: 122

Метод сопряженных направлений Идея метода в том, что если квадратичная функция переменных приведена к виду суммы полных квадратов, то ее оптимум может быть найден в результате одномерных поисков вдоль преобразованных координатных осей. 123

Метод сопряженных направлений Идея метода в том, что если квадратичная функция переменных приведена к виду суммы полных квадратов, то ее оптимум может быть найден в результате одномерных поисков вдоль преобразованных координатных осей. 123

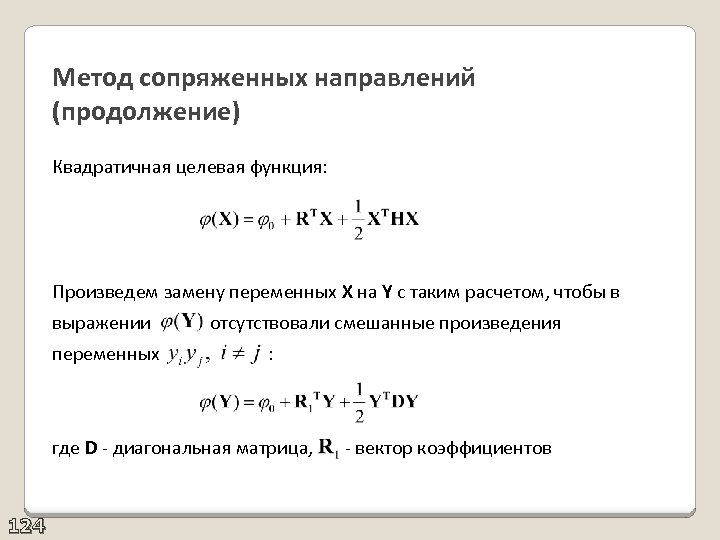

Метод сопряженных направлений (продолжение) Квадратичная целевая функция: Произведем замену переменных X на Y с таким расчетом, чтобы в выражении переменных отсутствовали смешанные произведения : где D - диагональная матрица, - вектор коэффициентов 124

Метод сопряженных направлений (продолжение) Квадратичная целевая функция: Произведем замену переменных X на Y с таким расчетом, чтобы в выражении переменных отсутствовали смешанные произведения : где D - диагональная матрица, - вектор коэффициентов 124

Метод сопряженных направлений (продолжение) Замена переменных: , где S – квадратная невырожденная матрица преобразования. Тогда , . Обозначая столбцы матрицы S через : Векторы называются сопряженными направлениями 125

Метод сопряженных направлений (продолжение) Замена переменных: , где S – квадратная невырожденная матрица преобразования. Тогда , . Обозначая столбцы матрицы S через : Векторы называются сопряженными направлениями 125

Метод сопряженных направлений (продолжение) Векторы задают новую систему координат исходной системы . В системе вместо каждая точка X определяется как линейная комбинация ортов направленных вдоль координатных осей , , , …, : Ту же точку X можно определить как линейную комбинацию новых линейно независимых базисных векторов : . В новой системе координат в качестве координатных осей выступают векторы . Координатный поиск вдоль , позволяет достигнуть минимума квадратичной функции 126 за n шагов.

Метод сопряженных направлений (продолжение) Векторы задают новую систему координат исходной системы . В системе вместо каждая точка X определяется как линейная комбинация ортов направленных вдоль координатных осей , , , …, : Ту же точку X можно определить как линейную комбинацию новых линейно независимых базисных векторов : . В новой системе координат в качестве координатных осей выступают векторы . Координатный поиск вдоль , позволяет достигнуть минимума квадратичной функции 126 за n шагов.

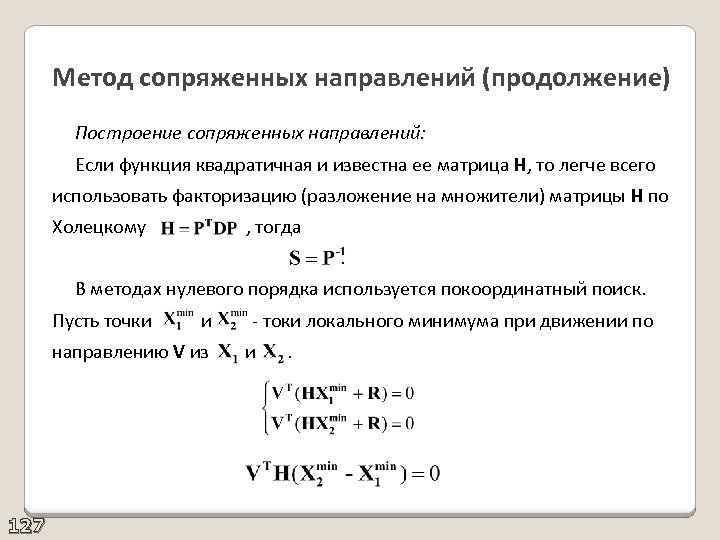

Метод сопряженных направлений (продолжение) Построение сопряженных направлений: Если функция квадратичная и известна ее матрица H, то легче всего использовать факторизацию (разложение на множители) матрицы H по Холецкому , тогда. В методах нулевого порядка используется покоординатный поиск. Пусть точки и - токи локального минимума при движении по направлению V из и . 127

Метод сопряженных направлений (продолжение) Построение сопряженных направлений: Если функция квадратичная и известна ее матрица H, то легче всего использовать факторизацию (разложение на множители) матрицы H по Холецкому , тогда. В методах нулевого порядка используется покоординатный поиск. Пусть точки и - токи локального минимума при движении по направлению V из и . 127

Метод сопряженных направлений (продолжение) 128

Метод сопряженных направлений (продолжение) 128

Методы безусловной минимизации второго порядка Метод Ньютона откуда Если система линейных уравнений имеет единственное решение, то оно может быть записано в виде: 129

Методы безусловной минимизации второго порядка Метод Ньютона откуда Если система линейных уравнений имеет единственное решение, то оно может быть записано в виде: 129

Методы безусловной минимизации второго порядка – проблемы сходимости Метод Ньютона достигает квадратичной скорости сходимости. Но он может оказаться неработоспособным: • тупой угол между направлением движения и градиентов обеспечивается только при условии: , • если точка стационарная точка, то 130 ;

Методы безусловной минимизации второго порядка – проблемы сходимости Метод Ньютона достигает квадратичной скорости сходимости. Но он может оказаться неработоспособным: • тупой угол между направлением движения и градиентов обеспечивается только при условии: , • если точка стационарная точка, то 130 ;

Методы безусловной минимизации второго порядка – модифицированные методы Ньютона Основная идея методов: Сходимость обеспечивается, когда: Если в некоторой стартовой точке не соблюдается условие , то нужно матрицу Гессе Н временно заменить на . При этом желательно, чтобы не сильно отличалась от матрицы Н , поскольку в благоприятной ситуации Н обеспечивает квадратичную скорость сходимости. 131

Методы безусловной минимизации второго порядка – модифицированные методы Ньютона Основная идея методов: Сходимость обеспечивается, когда: Если в некоторой стартовой точке не соблюдается условие , то нужно матрицу Гессе Н временно заменить на . При этом желательно, чтобы не сильно отличалась от матрицы Н , поскольку в благоприятной ситуации Н обеспечивает квадратичную скорость сходимости. 131

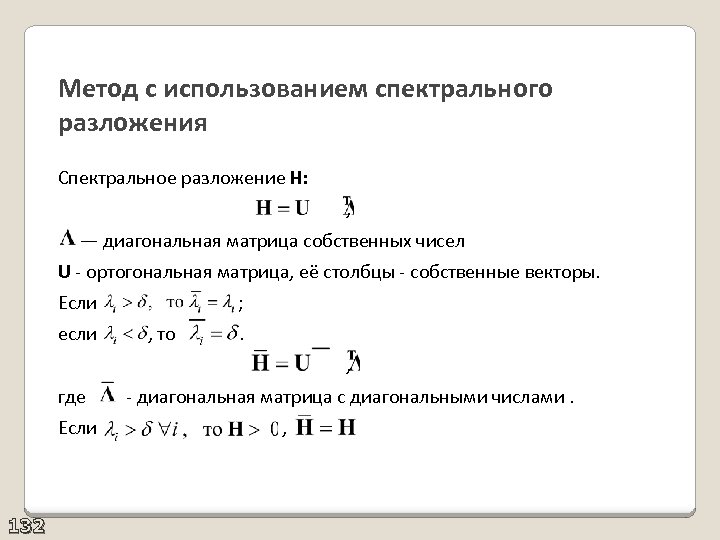

Метод с использованием спектрального разложения Спектральное разложение H: , — диагональная матрица собственных чисел U - ортогональная матрица, её столбцы - собственные векторы. Если ; если , то . , где - диагональная матрица с диагональными числами. Если , 132

Метод с использованием спектрального разложения Спектральное разложение H: , — диагональная матрица собственных чисел U - ортогональная матрица, её столбцы - собственные векторы. Если ; если , то . , где - диагональная матрица с диагональными числами. Если , 132

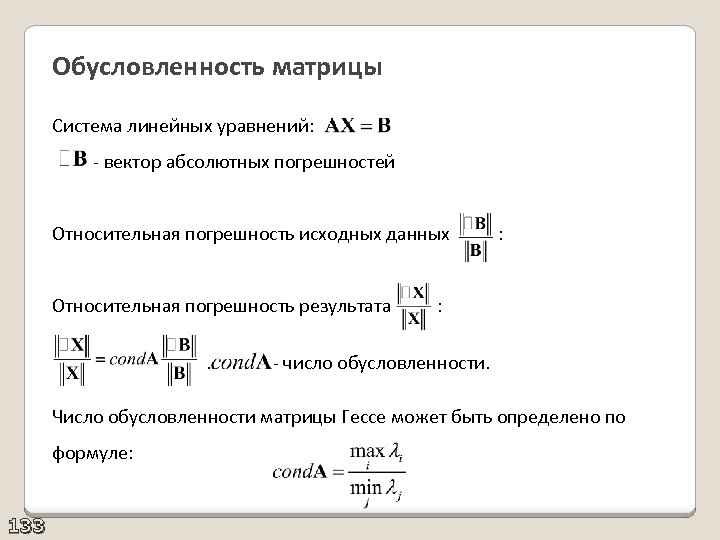

Обусловленность матрицы Система линейных уравнений: - вектор абсолютных погрешностей Относительная погрешность исходных данных : Относительная погрешность результата : . - число обусловленности. Число обусловленности матрицы Гессе может быть определено по формуле: 133

Обусловленность матрицы Система линейных уравнений: - вектор абсолютных погрешностей Относительная погрешность исходных данных : Относительная погрешность результата : . - число обусловленности. Число обусловленности матрицы Гессе может быть определено по формуле: 133

Метод с использованием разложения Холесского L - нижняя треугольная единичная матрица; D — диагональная матрица. Если столбцы матрицы L с номерами от 1 до ( ) известны, то j - й столбец вычисляется по формуле: , Свойство разложения: если , то . Если при разложении на j – том этапе , то , иначе . Далее Где - матрица содержит элементы , рассчитанные с учетом модификации элементов D. 134

Метод с использованием разложения Холесского L - нижняя треугольная единичная матрица; D — диагональная матрица. Если столбцы матрицы L с номерами от 1 до ( ) известны, то j - й столбец вычисляется по формуле: , Свойство разложения: если , то . Если при разложении на j – том этапе , то , иначе . Далее Где - матрица содержит элементы , рассчитанные с учетом модификации элементов D. 134

Метод Марквардта В стартовой точке - большое число (существенно большее максимального диагонального элемента Если , то положим к следующему шагу; иначе При 135 ). , и перейдем и повторим текущий шаг. направление поиска стремится к

Метод Марквардта В стартовой точке - большое число (существенно большее максимального диагонального элемента Если , то положим к следующему шагу; иначе При 135 ). , и перейдем и повторим текущий шаг. направление поиска стремится к

Решение проблемы стартовой стационарной точки Используется спектральное разложение: Если и точка - локальный минимум. В противном случае выбираем - максимальное по модулю отрицательное собственное число. 136

Решение проблемы стартовой стационарной точки Используется спектральное разложение: Если и точка - локальный минимум. В противном случае выбираем - максимальное по модулю отрицательное собственное число. 136

Решение проблемы стартовой стационарной точки 137

Решение проблемы стартовой стационарной точки 137

Методы безусловной минимизации первого порядка Методы общего применения Метод градиентного спуска: - антиградиент. Если выбирается с помощью одномерной минимизации, то метод называется методом наискорейшего спуска. 138

Методы безусловной минимизации первого порядка Методы общего применения Метод градиентного спуска: - антиградиент. Если выбирается с помощью одномерной минимизации, то метод называется методом наискорейшего спуска. 138

Исследование сходимости градиентного спуска Метод обладает линейной скоростью сходимости 139

Исследование сходимости градиентного спуска Метод обладает линейной скоростью сходимости 139

Исследование сходимости градиентного спуска (продолжение) 140

Исследование сходимости градиентного спуска (продолжение) 140

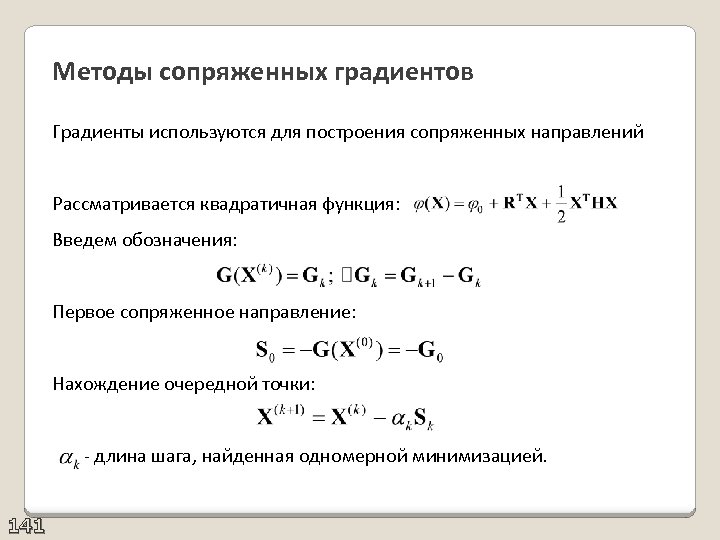

Методы сопряженных градиентов Градиенты используются для построения сопряженных направлений Рассматривается квадратичная функция: Введем обозначения: Первое сопряженное направление: Нахождение очередной точки: - длина шага, найденная одномерной минимизацией. 141

Методы сопряженных градиентов Градиенты используются для построения сопряженных направлений Рассматривается квадратичная функция: Введем обозначения: Первое сопряженное направление: Нахождение очередной точки: - длина шага, найденная одномерной минимизацией. 141

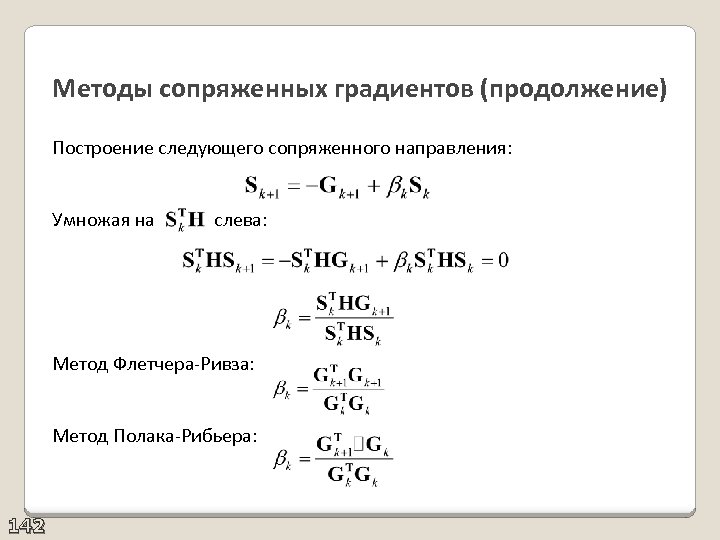

Методы сопряженных градиентов (продолжение) Построение следующего сопряженного направления: Умножая на слева: Метод Флетчера-Ривза: Метод Полака-Рибьера: 142

Методы сопряженных градиентов (продолжение) Построение следующего сопряженного направления: Умножая на слева: Метод Флетчера-Ривза: Метод Полака-Рибьера: 142