Метод k-nearest.pptx

- Количество слайдов: 14

Метод k-nearest

Метод k-nearest

Алгоритм Для классификации каждого из объектов тестовой выборки необходимо последовательно выполнить следующие операции: Вычислить расстояние до каждого из объектов обучающей выборки, Отобрать k объектов обучающей выборки, расстояние до которых минимально, Класс классифицируемого объекта — это класс, наиболее часто встречающийся среди k ближайших соседей.

Алгоритм Для классификации каждого из объектов тестовой выборки необходимо последовательно выполнить следующие операции: Вычислить расстояние до каждого из объектов обучающей выборки, Отобрать k объектов обучающей выборки, расстояние до которых минимально, Класс классифицируемого объекта — это класс, наиболее часто встречающийся среди k ближайших соседей.

Основным принцпом k-nearest является объект присваивается тому классу, который является наиболее распространённым среди соседей данного элемента. Соседи берутся исходя из множества объектов, классы которых уже известны, и, исходя из ключевого для данного метода значения k высчитывается, какой класс наиболее многочислен среди них. Предполагается, что существует определенный набор объектов с уже имеющейся классификацией.

Основным принцпом k-nearest является объект присваивается тому классу, который является наиболее распространённым среди соседей данного элемента. Соседи берутся исходя из множества объектов, классы которых уже известны, и, исходя из ключевого для данного метода значения k высчитывается, какой класс наиболее многочислен среди них. Предполагается, что существует определенный набор объектов с уже имеющейся классификацией.

Преимущества метода Простота использования полученных результатов. Решения не уникальны для конкретной ситуации, возможно их использование для других случаев. Целью поиска является не гарантированно верное решение, а лучшее из возможных.

Преимущества метода Простота использования полученных результатов. Решения не уникальны для конкретной ситуации, возможно их использование для других случаев. Целью поиска является не гарантированно верное решение, а лучшее из возможных.

Недостатки метода Неэффективный расходу памяти и чрезмерное усложнение решающего правила вследствии необходимости хранения обучающей выборки целиком. Поиск ближайшего соседа предполагает сравнение классифицируемого объекта со всеми объектами выборки, что требует линейного по длине выборки числа операций.

Недостатки метода Неэффективный расходу памяти и чрезмерное усложнение решающего правила вследствии необходимости хранения обучающей выборки целиком. Поиск ближайшего соседа предполагает сравнение классифицируемого объекта со всеми объектами выборки, что требует линейного по длине выборки числа операций.

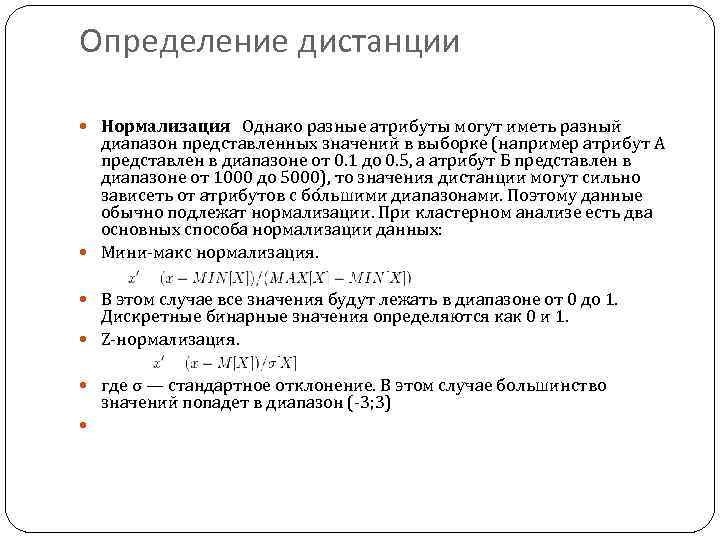

Определение дистанции Нормализация Однако разные атрибуты могут иметь разный диапазон представленных значений в выборке (например атрибут А представлен в диапазоне от 0. 1 до 0. 5, а атрибут Б представлен в диапазоне от 1000 до 5000), то значения дистанции могут сильно зависеть от атрибутов с бо льшими диапазонами. Поэтому данные обычно подлежат нормализации. При кластерном анализе есть два основных способа нормализации данных: Мини-макс нормализация. В этом случае все значения будут лежать в диапазоне от 0 до 1. Дискретные бинарные значения определяются как 0 и 1. Z-нормализация. где σ — стандартное отклонение. В этом случае большинство значений попадет в диапазон (-3; 3)

Определение дистанции Нормализация Однако разные атрибуты могут иметь разный диапазон представленных значений в выборке (например атрибут А представлен в диапазоне от 0. 1 до 0. 5, а атрибут Б представлен в диапазоне от 1000 до 5000), то значения дистанции могут сильно зависеть от атрибутов с бо льшими диапазонами. Поэтому данные обычно подлежат нормализации. При кластерном анализе есть два основных способа нормализации данных: Мини-макс нормализация. В этом случае все значения будут лежать в диапазоне от 0 до 1. Дискретные бинарные значения определяются как 0 и 1. Z-нормализация. где σ — стандартное отклонение. В этом случае большинство значений попадет в диапазон (-3; 3)

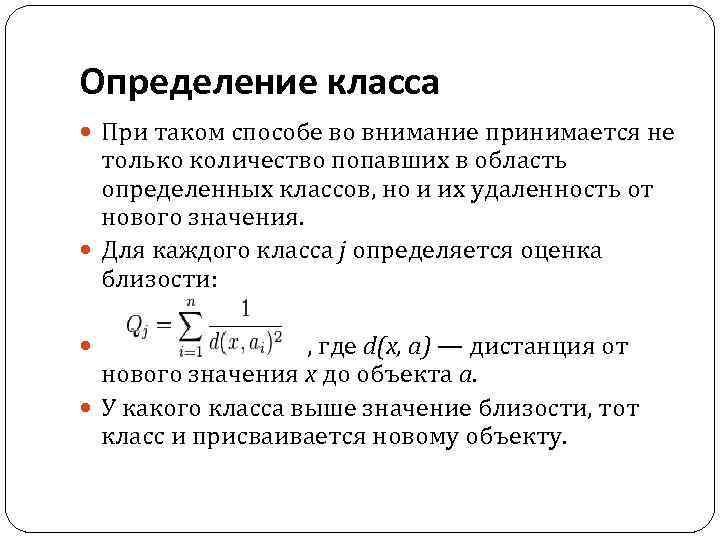

Определение класса При таком способе во внимание принимается не только количество попавших в область определенных классов, но и их удаленность от нового значения. Для каждого класса j определяется оценка близости: , где d(x, a) — дистанция от нового значения x до объекта а. У какого класса выше значение близости, тот класс и присваивается новому объекту.

Определение класса При таком способе во внимание принимается не только количество попавших в область определенных классов, но и их удаленность от нового значения. Для каждого класса j определяется оценка близости: , где d(x, a) — дистанция от нового значения x до объекта а. У какого класса выше значение близости, тот класс и присваивается новому объекту.

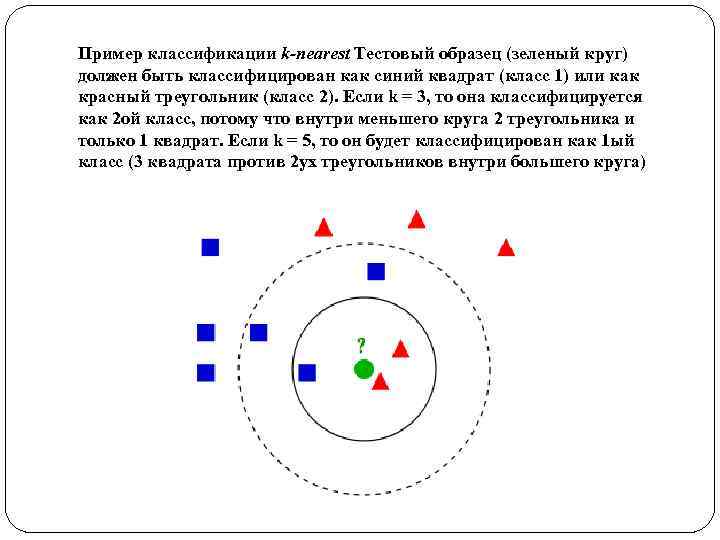

Пример классификации k-nearest Тестовый образец (зеленый круг) должен быть классифицирован как синий квадрат (класс 1) или как красный треугольник (класс 2). Если k = 3, то она классифицируется как 2 ой класс, потому что внутри меньшего круга 2 треугольника и только 1 квадрат. Если k = 5, то он будет классифицирован как 1 ый класс (3 квадрата против 2 ух треугольников внутри большего круга)

Пример классификации k-nearest Тестовый образец (зеленый круг) должен быть классифицирован как синий квадрат (класс 1) или как красный треугольник (класс 2). Если k = 3, то она классифицируется как 2 ой класс, потому что внутри меньшего круга 2 треугольника и только 1 квадрат. Если k = 5, то он будет классифицирован как 1 ый класс (3 квадрата против 2 ух треугольников внутри большего круга)

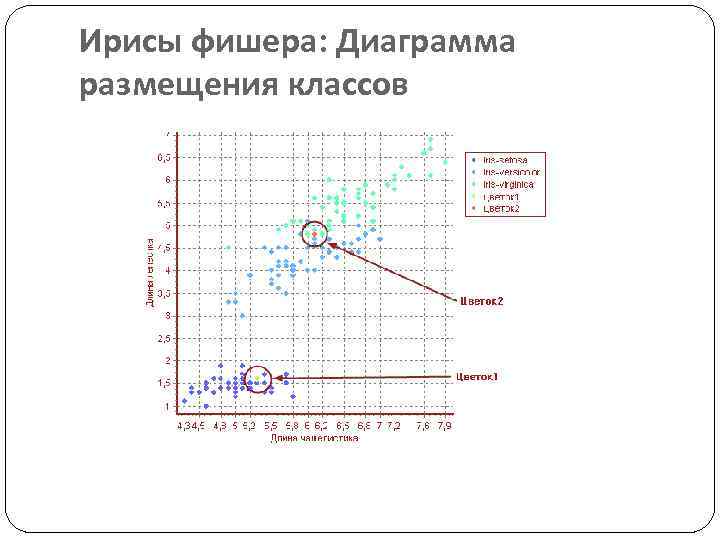

Пример: Ирисы фишера 150 цветков трех классов: Iris Setosa Iris Versicolour Iris Virginica Два параметра: длина чашелистика и длина лепестка. Необходимо определить класс двух цветков со следующими значениями длины чашелистика и лепестка в сантиметрах: 5, 3 и 1, 6 (первый), 6, 1 и 4, 8 (второй). На рисунке 2 показано размещение новых (светло-зеленая точка – цветок 1, красная – цветок 2) записей среди уже известных.

Пример: Ирисы фишера 150 цветков трех классов: Iris Setosa Iris Versicolour Iris Virginica Два параметра: длина чашелистика и длина лепестка. Необходимо определить класс двух цветков со следующими значениями длины чашелистика и лепестка в сантиметрах: 5, 3 и 1, 6 (первый), 6, 1 и 4, 8 (второй). На рисунке 2 показано размещение новых (светло-зеленая точка – цветок 1, красная – цветок 2) записей среди уже известных.

Ирисы фишера: Диаграмма размещения классов

Ирисы фишера: Диаграмма размещения классов

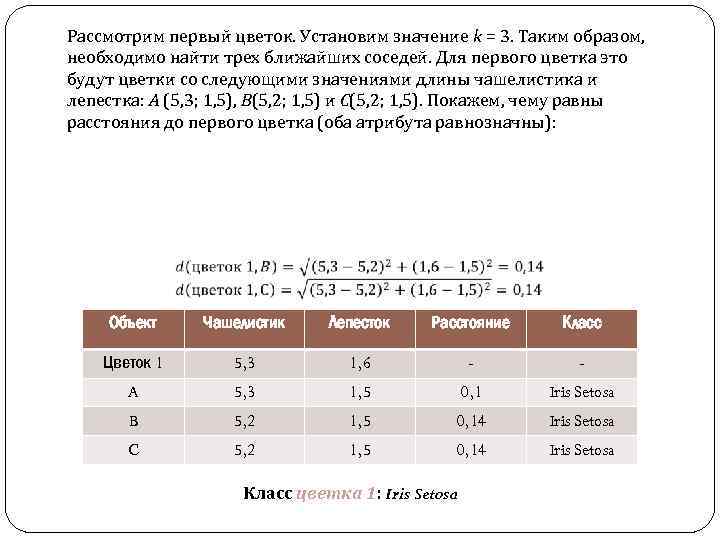

Рассмотрим первый цветок. Установим значение k = 3. Таким образом, необходимо найти трех ближайших соседей. Для первого цветка это будут цветки со следующими значениями длины чашелистика и лепестка: A (5, 3; 1, 5), В(5, 2; 1, 5) и С(5, 2; 1, 5). Покажем, чему равны расстояния до первого цветка (оба атрибута равнозначны): Объект Чашелистик Лепесток Расстояние Класс Цветок 1 5, 3 1, 6 - - A 5, 3 1, 5 0, 1 Iris Setosa B 5, 2 1, 5 0, 14 Iris Setosa C 5, 2 1, 5 0, 14 Iris Setosa Класс цветка 1: Iris Setosa

Рассмотрим первый цветок. Установим значение k = 3. Таким образом, необходимо найти трех ближайших соседей. Для первого цветка это будут цветки со следующими значениями длины чашелистика и лепестка: A (5, 3; 1, 5), В(5, 2; 1, 5) и С(5, 2; 1, 5). Покажем, чему равны расстояния до первого цветка (оба атрибута равнозначны): Объект Чашелистик Лепесток Расстояние Класс Цветок 1 5, 3 1, 6 - - A 5, 3 1, 5 0, 1 Iris Setosa B 5, 2 1, 5 0, 14 Iris Setosa C 5, 2 1, 5 0, 14 Iris Setosa Класс цветка 1: Iris Setosa

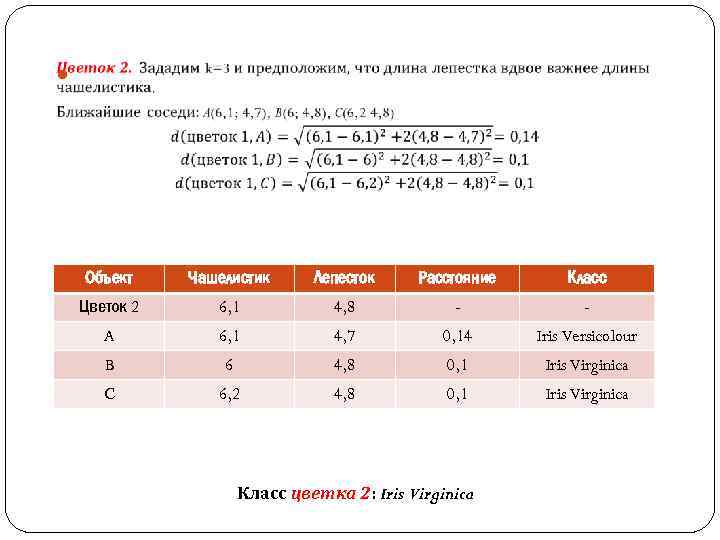

Объект Чашелистик Лепесток Расстояние Класс Цветок 2 6, 1 4, 8 - - A 6, 1 4, 7 0, 14 Iris Versicolour B 6 4, 8 0, 1 Iris Virginica C 6, 2 4, 8 0, 1 Iris Virginica Класс цветка 2: Iris Virginica

Объект Чашелистик Лепесток Расстояние Класс Цветок 2 6, 1 4, 8 - - A 6, 1 4, 7 0, 14 Iris Versicolour B 6 4, 8 0, 1 Iris Virginica C 6, 2 4, 8 0, 1 Iris Virginica Класс цветка 2: Iris Virginica

Области применения алгоритма KNN Алгоритм k-ближайших соседей имеет широкое применение. Например: Обнаружение мошенничества. Новые случаи мошенничества могут быть похожи на те, которые происходили когда-то в прошлом. Алгоритм KNN может распознать их для дальнейшего рассмотрения. Предсказание отклика клиентов. Можно определить отклик новых клиентов по данным из прошлого. Медицина. Алгоритм может классифицировать пациентов по разным показателям, основываясь на данных прошедших периодов. Прочие задачи, требующие классификацию.

Области применения алгоритма KNN Алгоритм k-ближайших соседей имеет широкое применение. Например: Обнаружение мошенничества. Новые случаи мошенничества могут быть похожи на те, которые происходили когда-то в прошлом. Алгоритм KNN может распознать их для дальнейшего рассмотрения. Предсказание отклика клиентов. Можно определить отклик новых клиентов по данным из прошлого. Медицина. Алгоритм может классифицировать пациентов по разным показателям, основываясь на данных прошедших периодов. Прочие задачи, требующие классификацию.

Заключение k. NN — один из простейших алгоритмов классификации, поэтому на реальных задачах он зачастую оказывается неэффективным. Помимо точности классификации, проблемой этого классификатора является скорость классификации: если в обучающей выборке N объектов, в тестовой выборе M объектов, а размерность пространства — K, то количество операций для классификации тестовой выборки может быть оценено как O(K*M*N). И тем не менее, алгоритм работы k. NN является хорошим примером для начала знакомства с Machine Learning.

Заключение k. NN — один из простейших алгоритмов классификации, поэтому на реальных задачах он зачастую оказывается неэффективным. Помимо точности классификации, проблемой этого классификатора является скорость классификации: если в обучающей выборке N объектов, в тестовой выборе M объектов, а размерность пространства — K, то количество операций для классификации тестовой выборки может быть оценено как O(K*M*N). И тем не менее, алгоритм работы k. NN является хорошим примером для начала знакомства с Machine Learning.