Метод ближайшего соседа.ppt

- Количество слайдов: 36

Метод ближайшего соседа Лекция 13

План лекции Введение n Меры сходства n Алгоритм n Проблемы и решения n Достоинства и недостатки n Применение n

Введение Метод «ближайшего соседа» ( «nearest neighbor» ) – основан на хранении известных данных для сравнения с новыми элементами n При классификации неизвестного объекта находятся отклонения между ним и известными объектами, и идентифицируется ближайший сосед n

Введение Метод «k-ближайших соседей» ( «k-nearest neighbor» ) – для повышения надежности объект относится к тому классу, которому принадлежит большинство из k его соседей n В задачах с двумя классами число соседей k берут нечётным, чтобы не возникало ситуаций неоднозначности n

Введение n n n Метод взвешенных ближайших соседей – в задачах с числом классов 3 и более нечётность уже не помогает и ситуации неоднозначности всё равно могут возникать. Тогда i-му соседу приписывается вес wi, убывающий с ростом ранга соседа Объект относится к тому классу, который набирает больший суммарный вес среди k ближайших соседей

Введение Метод ближайшего соседа неявно опирается на предположение, называемое гипотезой компактности n Гипотеза компактности – если мера сходства объектов введена достаточно удачно, то схожие объекты гораздо чаще лежат в одном классе, чем в разных n

Введение Другими словами, гипотеза компактности означает, что классы образуют компактно локализованные подмножества в пространстве объектов n Это также означает, что граница между классами имеет достаточно простую форму n

Введение Не всегда удобно хранить все данные, иногда хранится только множество «типичных» объектов n В этом случае метод называют рассуждением по аналогии (Case Based Reasoning, CBR), или рассуждением на основе прецедентов n

Меры сходства n В качестве меры сходства используется понятие расстояния между объектами

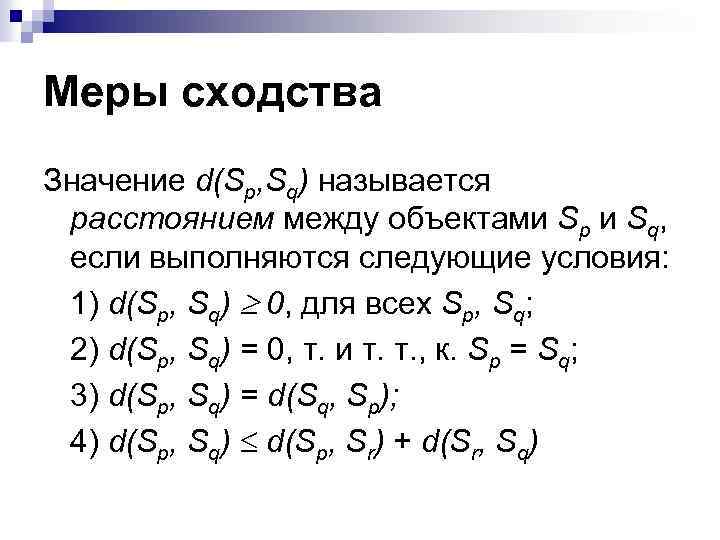

Меры сходства Значение d(Sp, Sq) называется расстоянием между объектами Sp и Sq, если выполняются следующие условия: 1) d(Sp, Sq) 0, для всех Sp, Sq; 2) d(Sp, Sq) = 0, т. и т. т. , к. Sp = Sq; 3) d(Sp, Sq) = d(Sq, Sp); 4) d(Sp, Sq) d(Sp, Sr) + d(Sr, Sq)

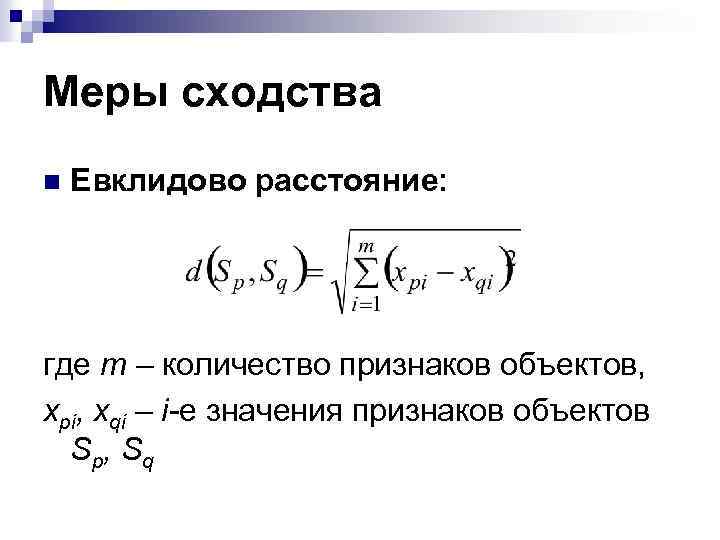

Меры сходства n Евклидово расстояние: где m – количество признаков объектов, xpi, xqi – i-е значения признаков объектов S p, S q

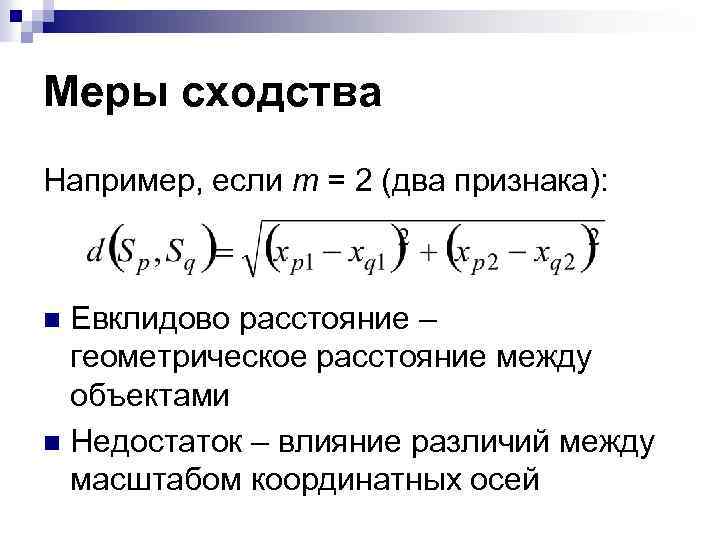

Меры сходства Например, если m = 2 (два признака): Евклидово расстояние – геометрическое расстояние между объектами n Недостаток – влияние различий между масштабом координатных осей n

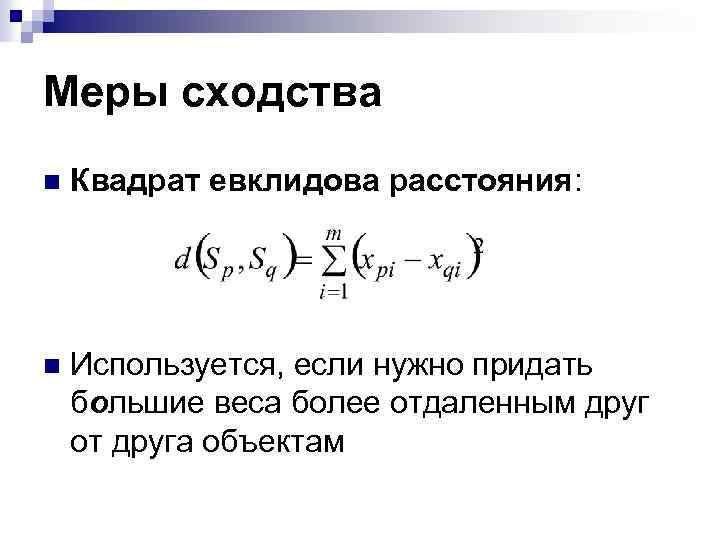

Меры сходства n Квадрат евклидова расстояния: n Используется, если нужно придать большие веса более отдаленным друг от друга объектам

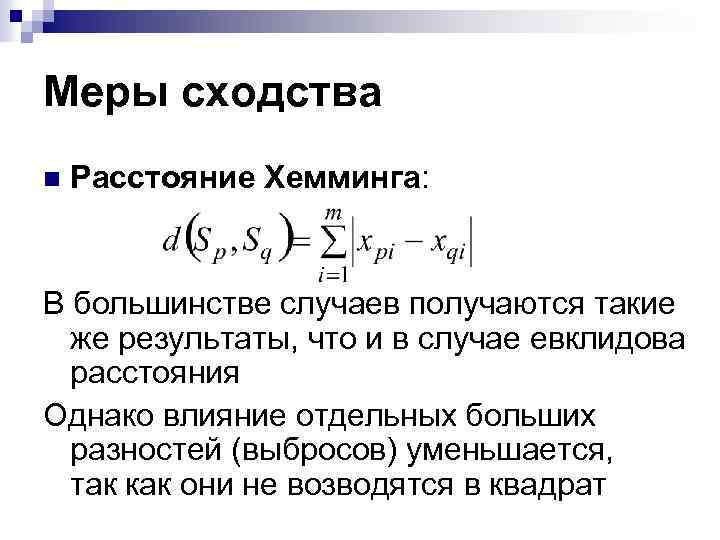

Меры сходства n Расстояние Хемминга: В большинстве случаев получаются такие же результаты, что и в случае евклидова расстояния Однако влияние отдельных больших разностей (выбросов) уменьшается, так как они не возводятся в квадрат

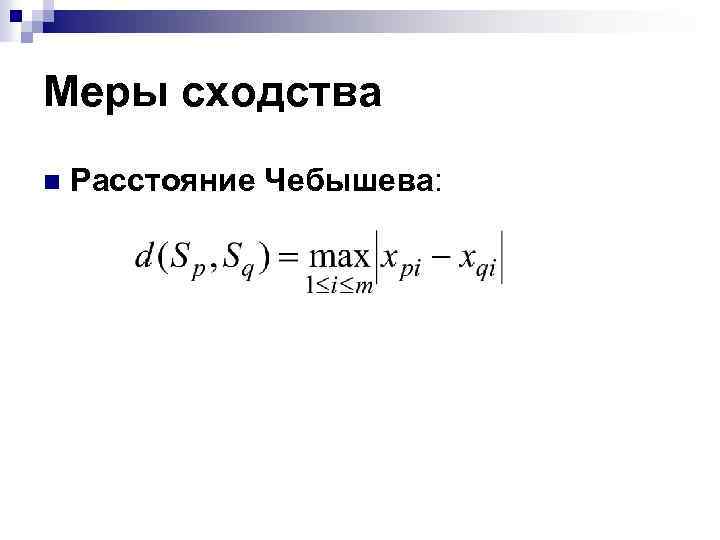

Меры сходства n Расстояние Чебышева:

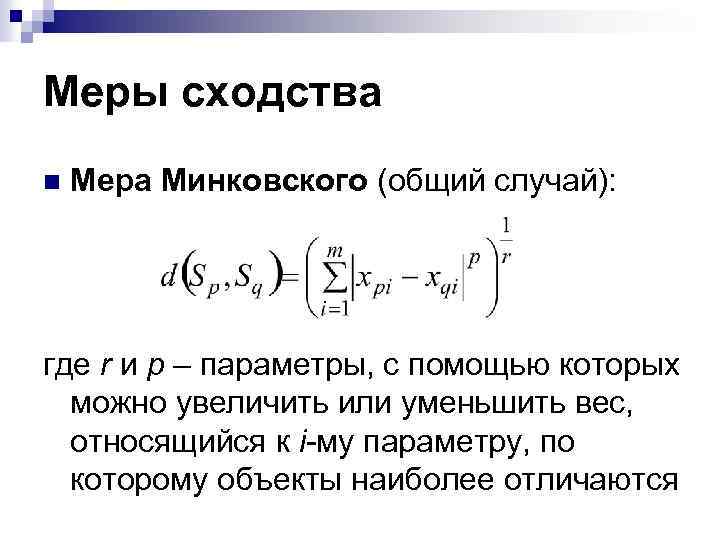

Меры сходства n Мера Минковского (общий случай): где r и p – параметры, с помощью которых можно увеличить или уменьшить вес, относящийся к i-му параметру, по которому объекты наиболее отличаются

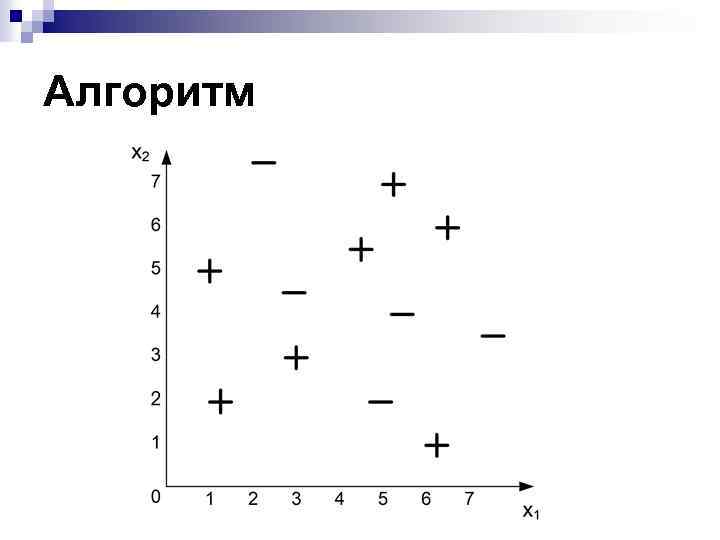

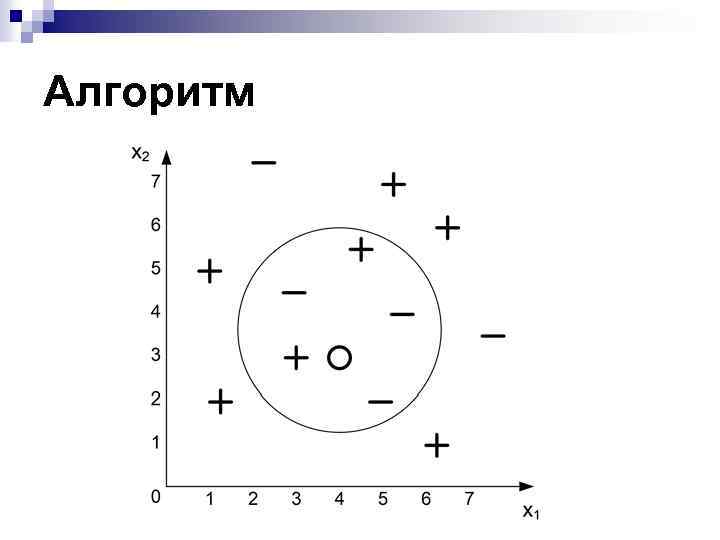

Алгоритм

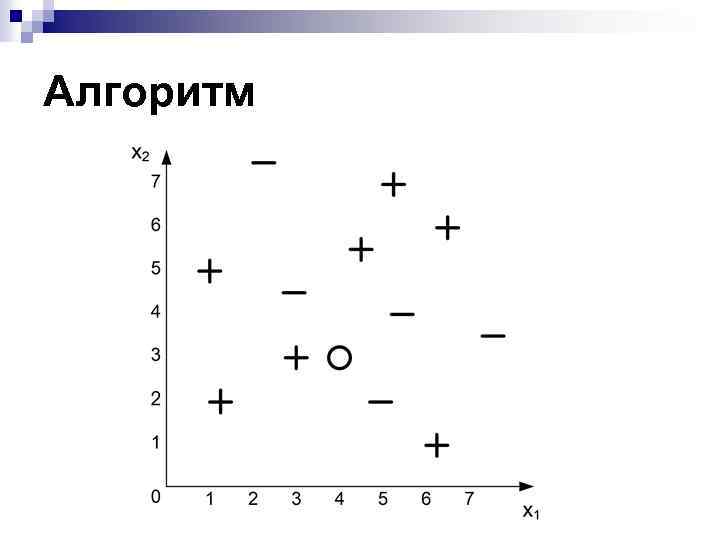

Алгоритм

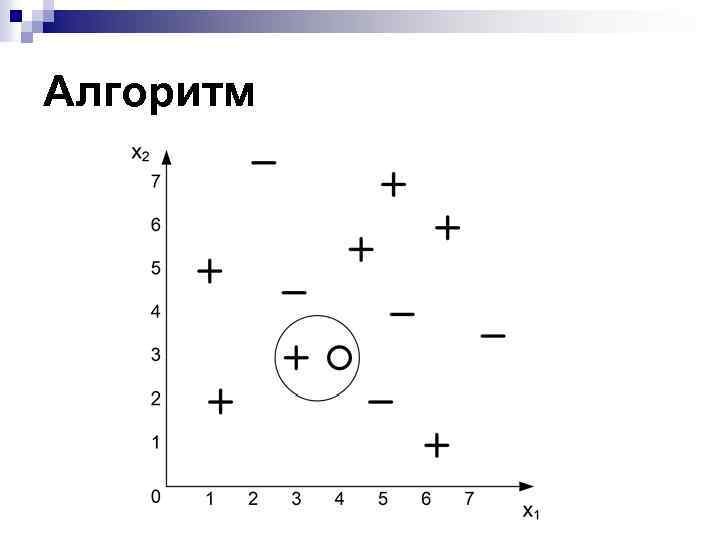

Алгоритм

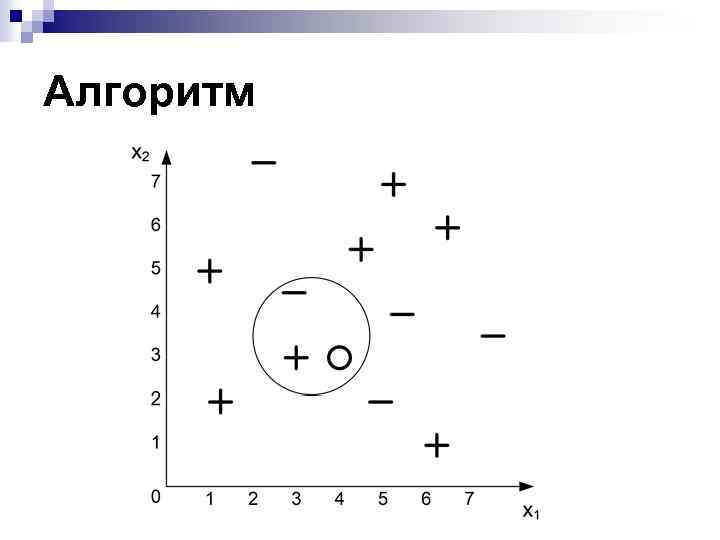

Алгоритм

Алгоритм

Проблемы и решения 1. Выбор числа соседей k n При k=1 метод неустойчив к шумовым выбросам: он даёт ошибочные классификации не только на самих объектах-выбросах, но и на ближайших к ним объектах других классов n При k=m, наоборот, метод чрезмерно устойчив (вырождается в константу)

Проблемы и решения На практике оптимальное значение параметра определяют при помощи метода leave-one-out cross-validation (исключение объектов по одному) При этом находится минимальное значение k, при котором все объекты правильно классифицируются n

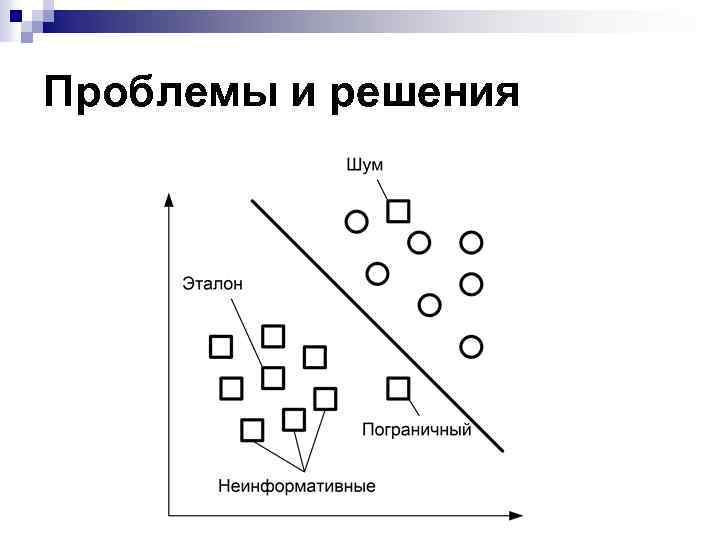

Проблемы и решения 2. Отсев шума (выбросов) Объекты обучающей выборки обычно относятся к одному из трех видов: n Эталоны – типичные представители классов – объекты, окруженные большим количеством объектов своего класса n Шумовые объекты – окружены большим количеством объектов чужого класса

Проблемы и решения Пограничные объекты – близкие к разделяющей поверхности n Неинформативные объекты – правильно классифицируются по эталонам и не несут полезной информации n

Проблемы и решения

Проблемы и решения Введем понятие отступа (margin) – это расстояние от объекта до поверхности, отделяющей свой класс от всех остальных n Если отступ > 0, то объект классифицируется правильно n Если отступ < 0, то классификация объекта ошибочна n

Проблемы и решения Исключение из выборки шумовых и неинформативных объектов даёт несколько преимуществ: n повышается качество классификации n сокращается объём хранимых данных n уменьшается время классификации, затрачиваемое на поиск ближайших эталонов

Проблемы и решения 3. Сверхбольшие выборки n Метод ближайших соседей основан на явном хранении всех обучающих объектов n Сверхбольшие выборки (>105): ¨ большой объем данных ¨ поиск ближайших соседей (сложность O(n))

Проблемы и решения Решения: n исключение неинформативных объектов n эффективные структуры данных для быстрого поиска (сложность O(ln n))

Проблемы и решения 4. Выбор метрики n Проблема сложная, однозначного решения нет n Если используется евклидово расстояние, признаки должны быть нормированы, иначе признаки с наибольшими числовыми значениями будут доминировать

Проблемы и решения n n Если признаков слишком много, а расстояние вычисляется как сумма отклонений по отдельным признакам, то возникает проблема проклятия размерности Суммы большого числа отклонений с большой вероятностью имеют очень близкие значения (согласно закону больших чисел) → в пространстве высокой размерности все объекты примерно одинаково далеки друг от друга

Проблемы и решения n Проблема решается путём отбора относительно небольшого числа информативных признаков

Достоинства и недостатки Достоинства: n простота реализации и возможность введения различных модификаций n прецедентная логика работы алгоритма хорошо понятна экспертам в таких предметных областях, как медицина, биометрия, юриспруденция и др.

Достоинства и недостатки Недостатки: n хранение всей обучающей выборки n неэффективный поиск n всего один параметр k → мало возможностей по настройке алгоритма

Применение n Пример. Центр технической поддержки компании Dell – система CBR помогает сотрудникам центра отвечать на большее число запросов, сразу предлагая ответы на распространенные вопросы

Метод ближайшего соседа.ppt