Mery_inf.pptx

- Количество слайдов: 14

МЕРЫ ИНФОРМАЦИИ. Выполняли работу: Алексеева Катя Борисенкова Света Васильева Аня Киселева Алена

Сообщение – форма представления информации в виде совокупности знаков (символов), используемая для передачи. Семиотика – наука, занимающаяся исследованием свойств знаков и знаковых систем. Может изучаться на трех уровнях: 1. синтаксическом 2. семантическом 3. прагматическом

ПРОБЛЕМЫ НА РАЗНЫХ УР НЯХ: ОВ Проблемы синтаксического уровня касаются создания теоретических основ построения информационных систем. Проблемы семантического уровня связаны с формализацией и учетом смысла передаваемой информации, определения степени соответствия образа объекта и самого объекта. Проблемы прагматического уровня интересуют последствия от получения и использования данной информации потребителем

УРОВНИ МЕРЫ ИНФОРМАЦИИ: 1) Синтаксический уровень 2) Семантический уровень 3) Прагматический уровень

СИНТАКСИЧЕСКИЙ УРОВЕНЬ Эта мера оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

Для измерения информации на этом уровне Объем данных Vд в сообщении вводятся два параметра: символов измеряется количеством (разрядов) в этом сообщении. 1. Vд – Объем информации данных (объемный подход) 2. I – количество информации (энтропийный подход) определяется с помощью понятия неопределенности состояния (энтропии) системы. Энтропия системы - это степень (мера) неопределенности о состоянии системы.

1 Кбайт = 1024 байт 10 = 2 байт 1 Мбайт = 1024 Кбайт = 20 2 байт 1 048 576 байт 1 Гбайт = 1024 Мбайт = 30 2 байта = 1 073 741 824 байт 1 Тбайт = 1024 Гбайт = 2 байт = 1 099 511 627 776 байт 40

Введем в рассмотрение численную величину, измеряющую неопределенность энтропию (обозначим ее Н). Величины N и Н связаны между собой некоторой функциональной зависимостью: H = f (N) Информацио нна я энтропи я — непредсказуемост и информации I = H 1 - H 2

ТРЕБОВАНИЕ АДДИТИВНОСТИ Если два независимых источника с числом равновероятных состояний N и M рассматривать как один источник, одновременно реализующий пары состояний ni mj , то естественно предположить, что неопределенность объединенного источника должна равняться сумме неопределенностей исходных источников.

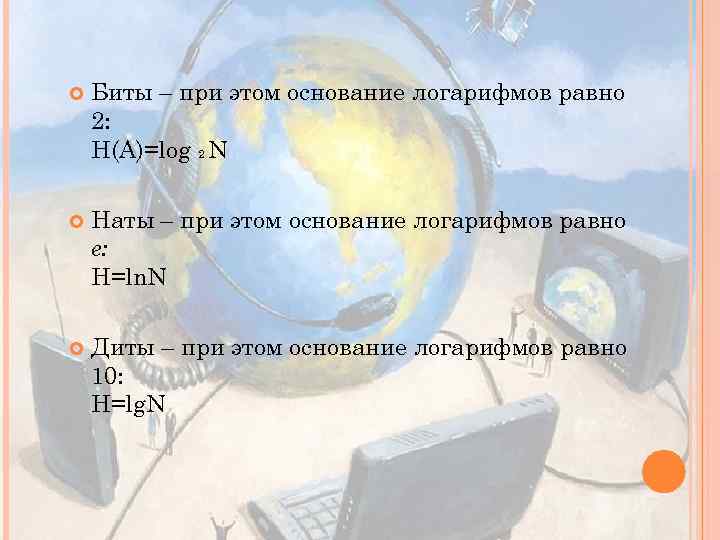

Биты – при этом основание логарифмов равно 2: H(A)=log 2 N Наты – при этом основание логарифмов равно е: Н=ln. N Диты – при этом основание логарифмов равно 10: Н=lg. N

ЭНТРОПИЯ ДИСКРЕТНОГО ИСТОЧНИКА ИНФОРМАЦИИ Мера, представляющая собой неопределенность, приходящуюся в среднем на одно состояние. Избыточность алфавита D. Суть данной меры заключается в том, что при равновероятном выборе ту же информационную нагрузку на знак можно обеспечить, используя алфавит меньшего объема, чем в случае с неравномерным выбором.

МЕРЫ ИНФОРМАЦИИ СЕМАНТИЧЕСКОГО УРОВНЯ Тезаурус – в широком смысле – совокупность сведений, которыми распологает пользователь (система), в более узком – запас знаний в виде словаря, отражающего сематические связи между словами и другими смысловыми элементами данного языка.

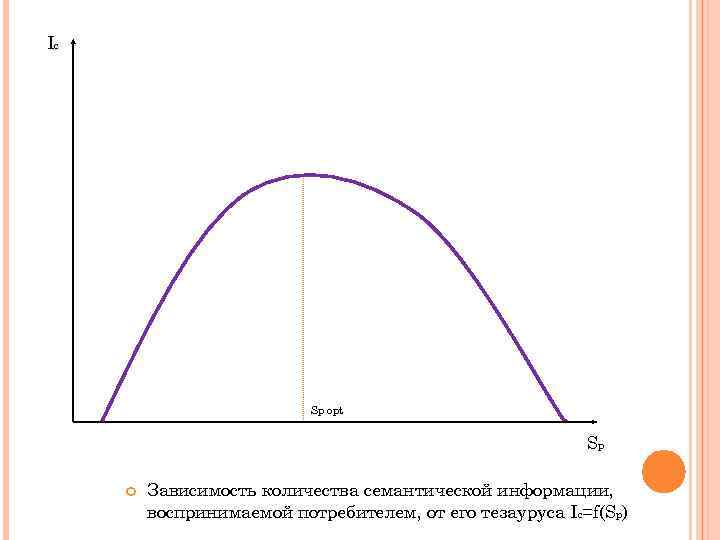

Ic Sp opt Sp Зависимость количества семантической информации, воспринимаемой потребителем, от его тезауруса Ic=f(Sp)

МЕРЫ ИНФОРМАЦИИ ПРАГМАТИЧЕСКОГО УРОВНЯ Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели.

Mery_inf.pptx