Математическая обработка полученных данных.ppt

- Количество слайдов: 30

Математическая обработка полученных данных

Генеральная и выборочная совокупность. • При применении любой психодиагностической методики обследуется некоторая достаточно большая категория индивидуумов. Это множество потенциальных испытуемых называется генеральной совокупностью. • Для того, чтобы сделать достоверное предположение об изучаемом явлении, прибегают к извлечению из генеральной совокупности некоторой его части – выборки, так как всю генеральную совокупность обследовать практически невозможно (тысячи, сотни тысяч, миллионы испытуемых).

Выборка должна отражать все свойства генеральной совокупности, т. е. она должна быть репрезентативной. • Основные способы достижения этого условия (приближения к идеалу, абсолютной точности здесь достичь нельзя): • Случайная выборка; • Моделирование выборки по свойствам генеральной совокупности.

Гипотезы • предположения, имеющее вероятностный характер и обладающие неопределенностью в отношении своей истинности-ложности, которые являются путеводной нитью исследования.

Статистические гипотезы • Н 0 – нулевые (в самом общем виде это гипотезы об отсутствии отличий в выборках, условиях экспериментов; о равенстве нулю мер связи; о сходстве распределений и т. д. ) • Н 1 – альтернативные (противоположные Н 0). • Эти гипотезы (Н 0 и Н 1) не совместимы, т. е. если принимается одна, то отклоняется другая.

Кроме того, выделяют: • направленные (наличие-отсутствие различий, изменение мер связи в определенном направлении) гипотезы. • Пример: Экспериментальная группа превышает (Н 1) или не превышает (Н 0) контрольную по некоторому показателю. • ненаправленные (без указания направления). • Пример: Экспериментальная группа отличается (Н 1) или не отличается (Н 0) от контрольной.

Статистические критерии • Статистический критерий – это правило, которое позволяет принимать истинную и отклонять ложную гипотезу с высокой вероятностью или другими словами на определенном уровне значимости - (т. е. с указанием ошибки 1 -ого рода, которая возникает в результате отклонения по результатам выборочного исследования истинной нулевой гипотезы; принятие истинной гипотезы Н 0 характеризуется доверительной вероятностью 1 - ; ошибка 2 -ого рода возникает в результате принятия по результатам выборочного исследования ложной Н 0; отклонение ложной Н 0 характеризуется вероятностью 1 - и называется мощностью критерия. )

• Обычно принимает следующие значения: 0, 10; 0, 05; 0, 01; 0, 001. Начинают с наименьшего значения. • Пример: если мы указываем, что сходстваразличия достоверны (статистически значимы) на 5% уровне значимости, то это означает, что вероятность того, что они недостоверны, составляет 0, 05 (а доверительная вероятность 0, 95=1 -0, 05). Естественно, вероятности могут указываться как в десятичном, так и процентном измерении.

Критерии делятся на: • Параметрические, включающие в формулу расчета параметры распределения, рассчитанные по выборке; например, средние арифметические (общепринятые обозначения М, х‾ с чертой вверху), дисперсии (соответственно S 2, 2)). Применяются при условии нормального распределения и производных из него: распределения Стьюдента, Фишера, 2 Пирсона. • непараметрические, оперирующие с частотами, рангами и т. д. , не учитывающие форму распределения выборочных данных и поэтому имеющие более широкую область применения

Критерии делятся на: • односторонние (для направленных гипотез). • двухсторонние (для ненаправленных, проверяются различия в обе стороны). • многофункциональные – эти критерии могут использоваться по отношению к самым разнообразным данным (независимо от шкалы), выборкам (зависимым и независимым) и задачам.

Примеры параметрических критериев: • t-критерий Стьюдента: применяется для сравнения (установления сходства – различий) средних в выборках, установления отличий от 0 некоторых мер связи: коэффициента линейной корреляции Пирсона, ранговой корреляции Пирсона, точечно-бисериального и рангово-бисериального и коэффициента линейной регрессии (см. ниже). • F-критерий Фишера: для сравнения дисперсий в выборках, установления отличий от 0 коэффициента детерминации, установления наличия-отсутствия влияния фактора в дисперсионном анализе. • 2 (хи-квадрат) Пирсона: для установления сходства-различия (сравнения) между эмпирическими и теоретическими частотными распределениями и проверка отличия от 0 коэффициентов сопряженности ( , Кч, С). Похожие задачи решает и критерий (лямда) –Колмогорова-Смирнова.

Примеры непараметрических критериев: • Q-критерий Розенбаума: выявление различий в уровне исследуемого признака на двух выборках испытуемых. • Н-критерий Крускала-Уоллиса и S-критерий Джонхира (аналогично, но в случае 3 -х и более выборок испытуемых) • G-критерий знаков, Т-критерий Вилкоксона: оценка сдвига значений исследуемого признака в двух независимых выборках) • Критерий Х 2 r Фридмана и L-критерий тенденции Пейджа (для 3 -х и более независимых выборок).

Пример многофункциональных критериев: • * Фишера – угловое преобразование Фишера, биномиальный критерий т и др.

Для большинства критериев порядок проверки следующий: 1)выбор критерия в соответствии с пунктами а), b), c). а) Подготовка данных (определение и преобразование измерительной шкалы (номинативная, порядковая, интервальная, отношений и стандартизированные: Z-оценки, процентили, шкалы JQ, стэнов и т. д. ); определение частот встречаемости, ранжирование и т. п. ; нахождение числовых характеристик распределения (параметров); проверка нормальности распределения и т. д. ) б) Определение зависимости или независимости выборок

Независимые выборки • Независимыми называются выборки, в которых одни и те же признаки измерены (несвязанные измерения) на разных испытуемых, а зависимыми – выборки, образованные парными (связанными) результатами (с одним испытуемым в разных условиях, например, «до» и «после» или испытуемыми, связанными в определенном отношениях: близнецы, брат-сестра, мужжена и т. д. ).

Для большинства критериев порядок проверки следующий: с) Количество выборок (1, 2, 3 и т. д. ) 2)Определение числа степеней свободы для используемого критерия (в общем виде: df=n-1, где n – число испытуемых, интервалов квантования(групп) или в случае двух выборок: df=n+m-2, где n, m– число испытуемых соответственно в первой и второй выборках) и фиксирование уровня значимости (для коэффициентов корреляции допустим =0, 10. Более точные уровни значимости могут быть рассчитаны на компьютере). 3)В соответствии с п. 2 определение критического значения по таблице [которые приводятся обычно в конце разнообразных учебных пособий] и сравнение с ним эмпирического (под словом сравнение обычно понимают следующие операции: Rэмп. >=Rкрит. или Rэмп. <=Rкрит. в зависимости от критерия и вида гипотезы (Н 0, Н 1)).

• Формулировка общего вывода проверки гипотезы может быть такой (на примере критерия Стьюдента): «Проверка различных средних арифметических в двух группах показала, что средние различаются статистически значительно (достоверно) на уровне 0, 05 (0, 01; 0, 001) или (р<= 0, 05)» .

При проверке гипотез используется два способа оценивания их числовых характеристик: • 1. Точечное оценивание (см. параметрические критерии). В данном случае используются числовые характеристики изучаемой случайной величины, которые являются точкой на числовой оси, например: среднее арифметическое М и стандартное отклонение (корень квадратный из дисперсии). Напомним, что эти числовые характеристики, рассчитанные по выборке, называются статистиками или оценками, а соответствующие характеристики генеральной совокупности – параметрами, точные значения которых остаются для нас неизвестными из -за объемов генеральной совокупности (но их можно оценить

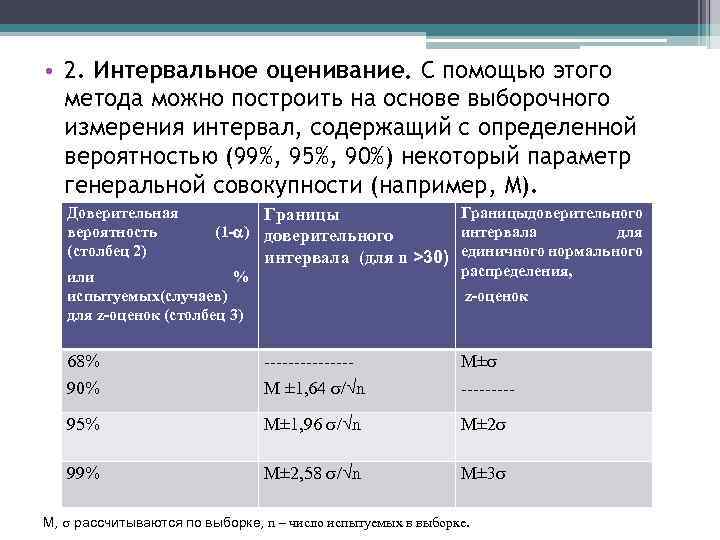

• 2. Интервальное оценивание. С помощью этого метода можно построить на основе выборочного измерения интервал, содержащий с определенной вероятностью (99%, 95%, 90%) некоторый параметр генеральной совокупности (например, М). Доверительная вероятность (столбец 2) Границыдоверительного Границы (1 - ) доверительного интервала для интервала (для n >30) единичного нормального распределения, или % испытуемых(случаев) для z-оценок (столбец 3) z-оценок 68% -------- М± 90% М ± 1, 64 /√n ----- 95% М± 1, 96 /√n М± 2 99% М± 2, 58 /√n М± 3 М, рассчитываются по выборке, n – число испытуемых в выборке.

• Границы интервалов определяются указанным способом при больших n (в статистике принято, что это n >30) на основании предельных теорем ТВ (теории вероятностей), которые утверждают, что при многократном извлечении выборок распределение статистик тоже будет нормальным со средним, равным генеральному среднему и дисперсией 2/n.

• Построенный таким образом итервал, называемый доверительным, будет с разной вероятностью (называемой доверительной) содержать генеральное среднее 1). Для меньшего числа n границы интервалов рассчитываются по следующей формуле: М±t /√n, где t-квантиль Т-распределения Стьюдента для соответствующей доверительной вероятности (или вероятности ошибки ) и числа степеней свободы

Коэффициент корреляции • Существует много разновидностей коэффициентов корреляции в зависимости от специфики данных (шкалы измерения). • Для явлений, измеренных в интервальной шкале используется коэффициент корреляции Пирсона; для порядковых (ранжированных) – коэффициент ранговой корреляции Спирмена или (тау)Кендалла; для данных, представленных в номинативных дихотомических шкалах – коэффициент четырехклеточной сопряженности Ки – Чупрова или С – Пирсона (в случае большого числа градаций).

Корреляционный анализ • Корреляционный анализ начинается с подготовки матрицы данных, далее – расчет коэффициента корреляции по выбранной формуле, проверка значимости отличия от 0 и заканчивается построением корреляционных графов или корреляционных плеяд (часть графа) для различных уровней значимости (т. е. включает в себя собственные методы представления данных и графического оформления результатов, впрочем, как и другие виды анализа: регрессионный, дисперсионный, факторный, кластерный и т. д. )

Регрессионный анализ • Регрессионный анализ является продолжением изучения взаимосвязи между двумя или более переменными, измеренными в шкале интервалов. Задача регрессионного анализа, например, в его простейшем двумерном варианте, описать зависимость (в отличие от корреляционного, который просто указывает на отсутствие или наличие связи) одной переменной от другой или дать прогноз с помощью уравнения прямой линии y=b 1 x+b 0 или x=b 1 y+b 0, где x, yизмеренные переменные, a b 1 , b 0 рассчитываемые по методу наименьших квадратов по формулам.

Дисперсионный анализ • Дисперсионный анализ ДА (в англоязычной литературе ANOVA/MANOVA) развивает идеи регрессивного анализа. • Основная задача ДА – выявить воздействия одной или нескольких независимых переменных (контролируемых исследователем, рассматриваемых как причины), т. е. факторов на зависимую переменную - результативный признак (понимаемый как следствие). Проверка гипотезы осуществляется на основе анализа вариативностей (изменчивости, некоего аналога дисперсии), которые обусловлены различными факторами, их сочетаниями и случайными воздействиями.

• Логически внутри себя ДА содержит общую логику проверки гипотез с помощью критериев, но как и корреляционный имеет свою форму представления данных (дисперсионные комплексы) и графическое (наглядное) изображение результатов, которое кроме прочего указывает на направление изменений признака под влиянием фактора и его градаций.

• Пример текста задачи для ДА: Изучался уровень знаний учащихся в зависимости от пола и уровня активности. Оценки ставились по 20 -бальной шкале (зависимая переменная). Уровень активности (фактор А) имел 3 градации: 1 – слушание лекций; 2 – лекции и семинары; 3 – лекции, семинары и практические занятия; пол учащихся (фактор В) имел две градации: 1 -Н (юноши), 2 -Ж (девушки).

Факторный анализ • Для анализа многомерных данных часто используется факторный анализ. Примеры: результаты заполнения опросника САН, MMPI и других многошкальных методик. • Факторным анализом называется любая процедура переработки многомерных данных, на «вход» которой «подается» матрица корреляции между исходными переменными (показателями, шкалами и пр. ), а с «входа» считывается система переменных, именуемых факторами (не путать с ДА).

Факторный анализ При этом: 1. факторы определены через исходные переменные (т. е. включают в себя высоко коррелируемые шкалы); 2. в свою очередь, система факторов образует пространство, в котором (через факторные нагрузки) определены исходные переменные; 3. факторы ранжированы в порядке убывания их важности для объяснения эмпирических результатов; 4. количество факторов существенно меньше, чем исходных переменных; 5. факторам придается смысл глубинных, скрытых источников, порождающих получаемые в исследовании эмпирические результаты; 6. все факторы взаимно ортогональны (независимы, перпендикулярны).

Заключение • Лучше всего заранее, еще на стадии планирования, подбирать математическую модель, которая в дальнейшем будет использоваться или принимать оптимальное решение о выборе адекватной модели (что не просто) с учетом условий проведения исследования и разнообразия существующих математических методов.

Математическая обработка полученных данных.ppt