Обзор конфигураций НС.ppt

- Количество слайдов: 17

Лекция по дисциплине «Искусственный интеллект и нейросетевое управление» тема: «Виды нейронных сетей»

Лекция по дисциплине «Искусственный интеллект и нейросетевое управление» тема: «Виды нейронных сетей»

Вероятностные нейронные сети (PNN) n n n Вид нейронных сетей для задач классификации, где плотность вероятности принадлежности классам оценивается посредством ядерной аппроксимации. Один из видов байесовых сетей. Байесова статистика правильность модели оценивается по имеющимся достоверным данным.

Вероятностные нейронные сети (PNN) n n n Вид нейронных сетей для задач классификации, где плотность вероятности принадлежности классам оценивается посредством ядерной аппроксимации. Один из видов байесовых сетей. Байесова статистика правильность модели оценивается по имеющимся достоверным данным.

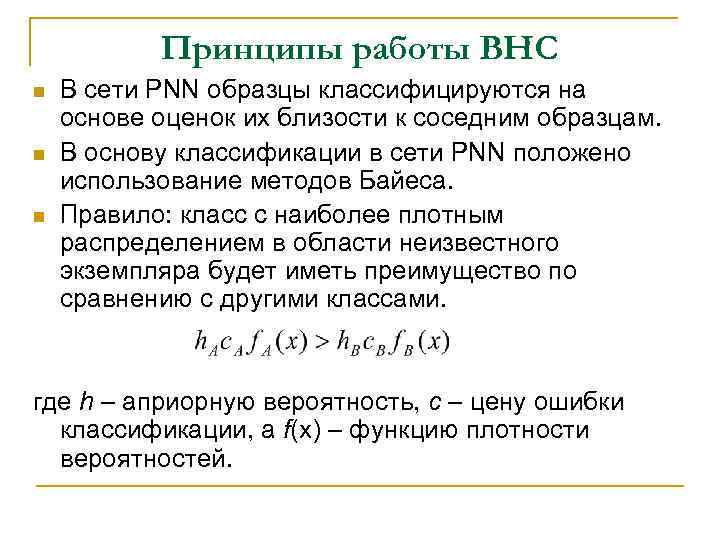

Принципы работы ВНС n n n В сети PNN образцы классифицируются на основе оценок их близости к соседним образцам. В основу классификации в сети PNN положено использование методов Байеса. Правило: класс с наиболее плотным распределением в области неизвестного экземпляра будет иметь преимущество по сравнению с другими классами. где h – априорную вероятность, с – цену ошибки классификации, a f(x) – функцию плотности вероятностей.

Принципы работы ВНС n n n В сети PNN образцы классифицируются на основе оценок их близости к соседним образцам. В основу классификации в сети PNN положено использование методов Байеса. Правило: класс с наиболее плотным распределением в области неизвестного экземпляра будет иметь преимущество по сравнению с другими классами. где h – априорную вероятность, с – цену ошибки классификации, a f(x) – функцию плотности вероятностей.

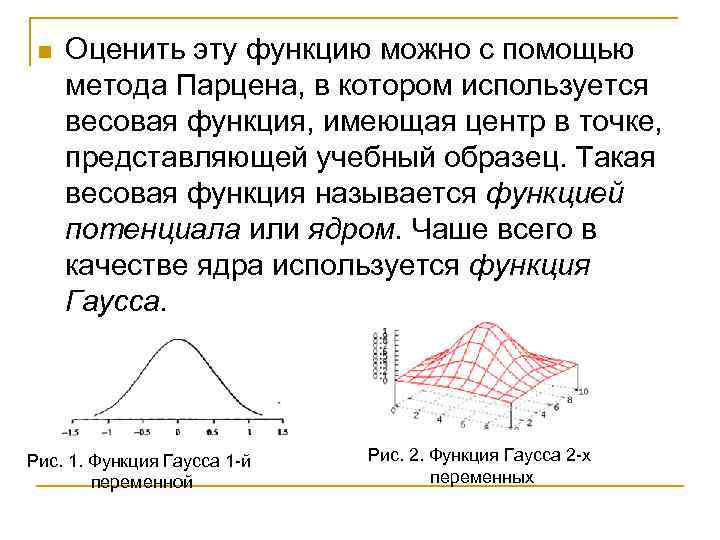

n Оценить эту функцию можно с помощью метода Парцена, в котором используется весовая функция, имеющая центр в точке, представляющей учебный образец. Такая весовая функция называется функцией потенциала или ядром. Чаше всего в качестве ядра используется функция Гаусса. Рис. 1. Функция Гаусса 1 -й переменной Рис. 2. Функция Гаусса 2 -х переменных

n Оценить эту функцию можно с помощью метода Парцена, в котором используется весовая функция, имеющая центр в точке, представляющей учебный образец. Такая весовая функция называется функцией потенциала или ядром. Чаше всего в качестве ядра используется функция Гаусса. Рис. 1. Функция Гаусса 1 -й переменной Рис. 2. Функция Гаусса 2 -х переменных

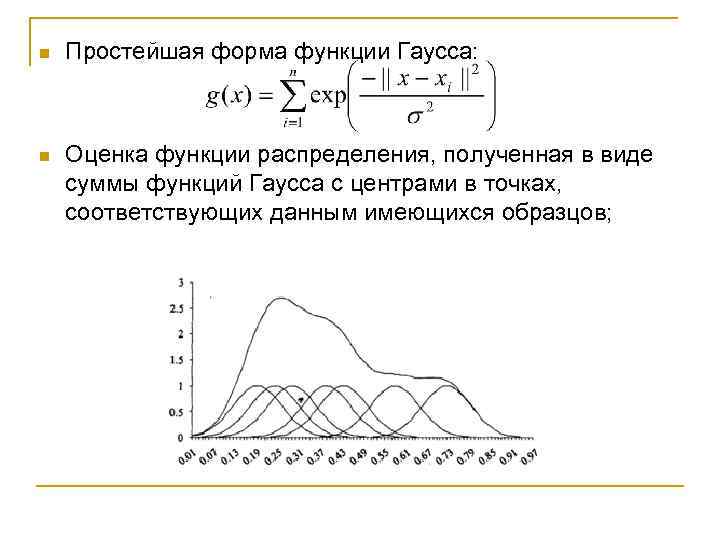

n Простейшая форма функции Гаусса: n Оценка функции распределения, полученная в виде суммы функций Гаусса с центрами в точках, соответствующих данным имеющихся образцов;

n Простейшая форма функции Гаусса: n Оценка функции распределения, полученная в виде суммы функций Гаусса с центрами в точках, соответствующих данным имеющихся образцов;

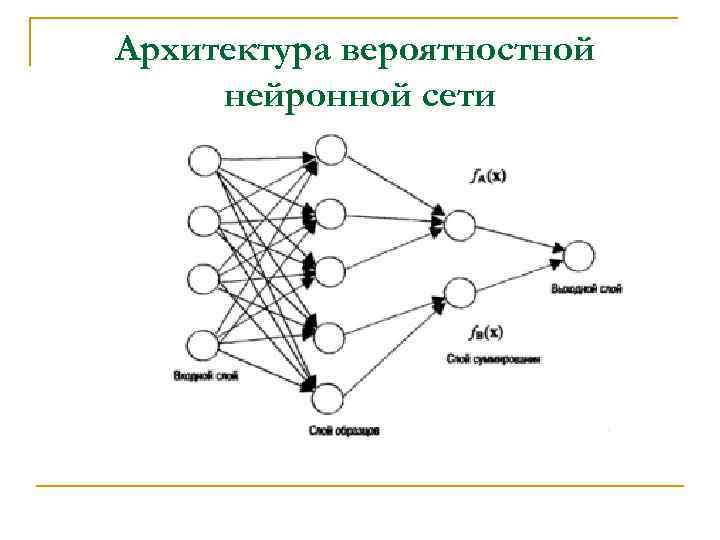

Архитектура вероятностной нейронной сети

Архитектура вероятностной нейронной сети

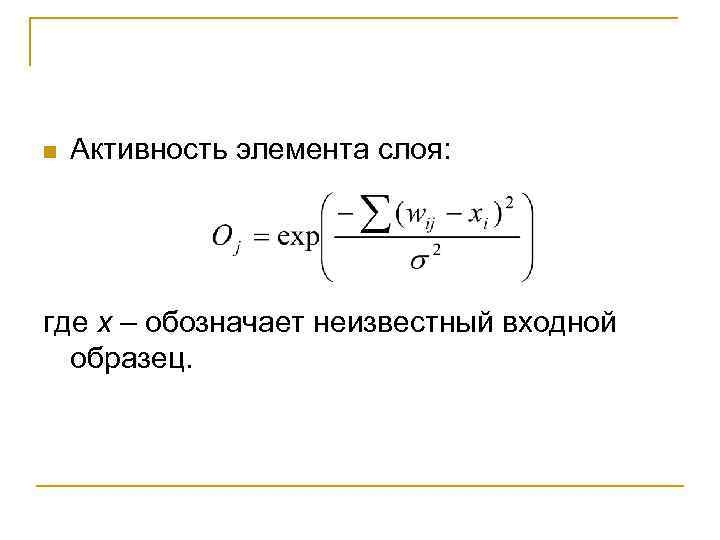

n Активность элемента слоя: где х – обозначает неизвестный входной образец.

n Активность элемента слоя: где х – обозначает неизвестный входной образец.

Обобщенно-регрессионная нейронная сеть (GRNN) n n Обобщенно-регрессионная нейронная сеть (GRNN) устроена аналогично вероятностной нейронной сети (PNN), но она предназначена для решения задач регрессии, а не классификации. в точку расположения каждого обучающего наблюдения помещается гауссова ядерная функция

Обобщенно-регрессионная нейронная сеть (GRNN) n n Обобщенно-регрессионная нейронная сеть (GRNN) устроена аналогично вероятностной нейронной сети (PNN), но она предназначена для решения задач регрессии, а не классификации. в точку расположения каждого обучающего наблюдения помещается гауссова ядерная функция

n n GRNN-сеть копирует внутрь себя все обучающие наблюдения и использует их для оценки отклика в произвольной точке. Окончательная выходная оценка сети получается как взвешенное среднее выходов по всем обучающим наблюдениям, где величины весов отражают расстояние от этих наблюдений до той точки, в которой производится оценивание (и, таким образом, более близкие точки вносят больший вклад в оценку).

n n GRNN-сеть копирует внутрь себя все обучающие наблюдения и использует их для оценки отклика в произвольной точке. Окончательная выходная оценка сети получается как взвешенное среднее выходов по всем обучающим наблюдениям, где величины весов отражают расстояние от этих наблюдений до той точки, в которой производится оценивание (и, таким образом, более близкие точки вносят больший вклад в оценку).

Линейная сеть n n n В задаче классификации гиперплоскость размещается таким образом, чтобы она разделяла собой два класса (линейная дискриминантная функция); в задаче регрессии гиперплоскость должна проходить через заданные точки. Линейная модель обычно записывается с помощью матрицы Nx. N и вектора смещения размера N.

Линейная сеть n n n В задаче классификации гиперплоскость размещается таким образом, чтобы она разделяла собой два класса (линейная дискриминантная функция); в задаче регрессии гиперплоскость должна проходить через заданные точки. Линейная модель обычно записывается с помощью матрицы Nx. N и вектора смещения размера N.

n n n линейная модель представляется сетью без промежуточных слоев, которая в выходном слое содержит только линейные элементы (то есть элементы с линейной функцией активации). Веса соответствуют элементам матрицы, а пороги – компонентам вектора смещения. Во время работы сеть фактически умножает вектор входов на матрицу весов, а затем к полученному вектору прибавляет вектор смещения.

n n n линейная модель представляется сетью без промежуточных слоев, которая в выходном слое содержит только линейные элементы (то есть элементы с линейной функцией активации). Веса соответствуют элементам матрицы, а пороги – компонентам вектора смещения. Во время работы сеть фактически умножает вектор входов на матрицу весов, а затем к полученному вектору прибавляет вектор смещения.

Сеть Кохонена n n n В то время как все остальные сети предназначены для задач с управляемым обучением, сети Кохонена главным образом рассчитана на неуправляемое обучение. Сеть Кохонена учится понимать саму структуру данных. Одно из возможных применений таких сетей – разведочный анализ данных.

Сеть Кохонена n n n В то время как все остальные сети предназначены для задач с управляемым обучением, сети Кохонена главным образом рассчитана на неуправляемое обучение. Сеть Кохонена учится понимать саму структуру данных. Одно из возможных применений таких сетей – разведочный анализ данных.

n n Сети Кохонена можно использовать и в тех задачах классификации, где классы уже заданы, - тогда преимущество будет в том, что сеть сможет выявить сходство между различными классами. Другая возможная область применения – обнаружение новых явлений.

n n Сети Кохонена можно использовать и в тех задачах классификации, где классы уже заданы, - тогда преимущество будет в том, что сеть сможет выявить сходство между различными классами. Другая возможная область применения – обнаружение новых явлений.

Архитектура сети Кохонена n n Сеть Кохонена имеет всего два слоя: входной и выходной, составленный из радиальных элементов (выходной слой называют также слоем топологической карты). Элементы топологической карты располагаются в некотором пространстве как правило двумерном

Архитектура сети Кохонена n n Сеть Кохонена имеет всего два слоя: входной и выходной, составленный из радиальных элементов (выходной слой называют также слоем топологической карты). Элементы топологической карты располагаются в некотором пространстве как правило двумерном

Обучение сети Кохонена Обучается сеть Кохонена методом последовательных приближений: начиная со случайным образом выбранного исходного расположения центров, алгоритм постепенно улучшает его так, чтобы улавливать кластеризацию обучающих данных. n

Обучение сети Кохонена Обучается сеть Кохонена методом последовательных приближений: начиная со случайным образом выбранного исходного расположения центров, алгоритм постепенно улучшает его так, чтобы улавливать кластеризацию обучающих данных. n

n n Основной итерационный алгоритм Кохонена последовательно проходит одну за другой ряд эпох, при этом на каждой эпохе он обрабатывает каждый из обучающих примеров, и затем применяет следующий алгоритм: Выбрать выигравший нейрон (то есть тот, который расположен ближе всего к входному примеру); Скорректировать выигравший нейрон так, чтобы он стал более похож на этот входной пример (взяв взвешенную сумму прежнего центра нейрона и обучающего примера). После того, как сеть обучена распознаванию структуры данных, ее можно использовать как средство визуализации при анализе данных.

n n Основной итерационный алгоритм Кохонена последовательно проходит одну за другой ряд эпох, при этом на каждой эпохе он обрабатывает каждый из обучающих примеров, и затем применяет следующий алгоритм: Выбрать выигравший нейрон (то есть тот, который расположен ближе всего к входному примеру); Скорректировать выигравший нейрон так, чтобы он стал более похож на этот входной пример (взяв взвешенную сумму прежнего центра нейрона и обучающего примера). После того, как сеть обучена распознаванию структуры данных, ее можно использовать как средство визуализации при анализе данных.

Занятие окончено! Спасибо за внимание!

Занятие окончено! Спасибо за внимание!