inf_7_8_12.ppt

- Количество слайдов: 77

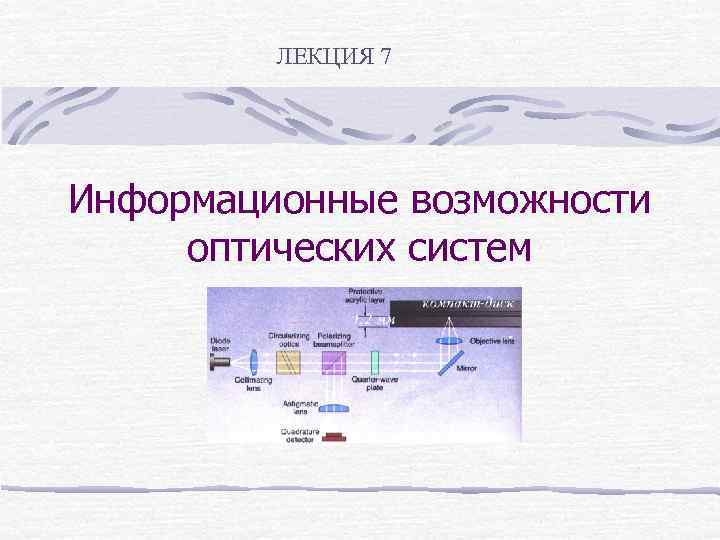

ЛЕКЦИЯ 7 Информационные возможности оптических систем

ЛЕКЦИЯ 7 Информационные возможности оптических систем

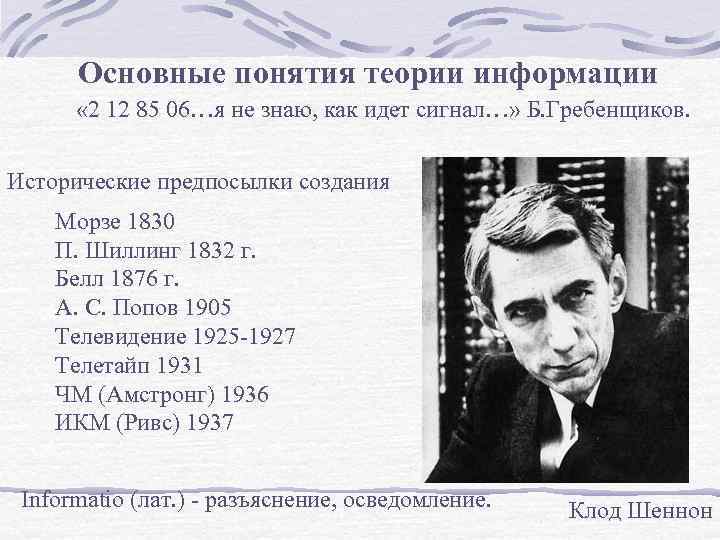

Основные понятия теории информации « 2 12 85 06…я не знаю, как идет сигнал…» Б. Гребенщиков. Исторические предпосылки создания Морзе 1830 П. Шиллинг 1832 г. Белл 1876 г. А. С. Попов 1905 Телевидение 1925 1927 Телетайп 1931 ЧМ (Амстронг) 1936 ИКМ (Ривс) 1937 Informatio (лат. ) разъяснение, осведомление. Клод Шеннон

Основные понятия теории информации « 2 12 85 06…я не знаю, как идет сигнал…» Б. Гребенщиков. Исторические предпосылки создания Морзе 1830 П. Шиллинг 1832 г. Белл 1876 г. А. С. Попов 1905 Телевидение 1925 1927 Телетайп 1931 ЧМ (Амстронг) 1936 ИКМ (Ривс) 1937 Informatio (лат. ) разъяснение, осведомление. Клод Шеннон

«ИНФОРМАЦИЯ любые сведения и данные, отражающие свойства объектов в природных (биологических, физических и др. ), социальных и технических системах и передаваемые звуковым, графическим (в том числе письменным) или иным способом без применения или с применением технических средств» . БСЭ В словаре Вебстера следующее определение термина: «Сообщение, или получение знаний или сведений. Факты, приготовленные для сообщения, в отличие от тех, которые воплощены в мысли или знании. Данные, новости, сведения, знания, полученные путем изучения или наблюдения. . . » . С точки зрения философии, информация — нематериальная сущность, при помощи которой с любой точностью можно описывать реальные (материальные), виртуальные (возможные) и понятийные сущности. Информация противоположность неопределенности. Информация как физическая величина – количественная мера упорядоченности исследуемой системы.

«ИНФОРМАЦИЯ любые сведения и данные, отражающие свойства объектов в природных (биологических, физических и др. ), социальных и технических системах и передаваемые звуковым, графическим (в том числе письменным) или иным способом без применения или с применением технических средств» . БСЭ В словаре Вебстера следующее определение термина: «Сообщение, или получение знаний или сведений. Факты, приготовленные для сообщения, в отличие от тех, которые воплощены в мысли или знании. Данные, новости, сведения, знания, полученные путем изучения или наблюдения. . . » . С точки зрения философии, информация — нематериальная сущность, при помощи которой с любой точностью можно описывать реальные (материальные), виртуальные (возможные) и понятийные сущности. Информация противоположность неопределенности. Информация как физическая величина – количественная мера упорядоченности исследуемой системы.

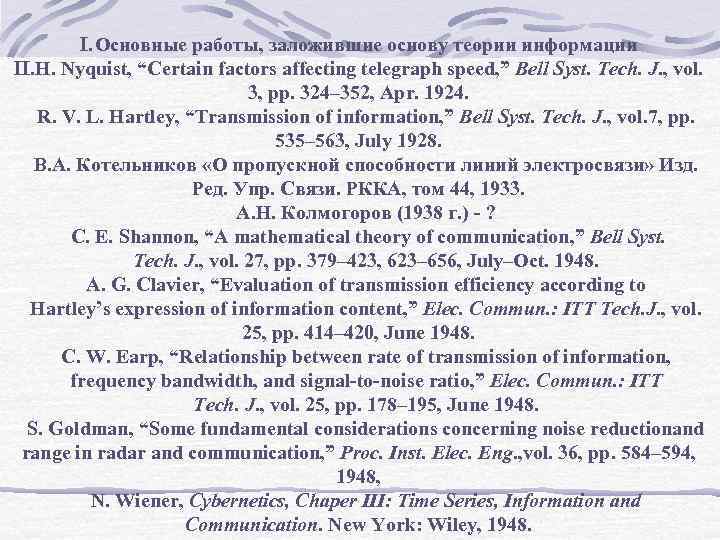

I. Основные работы, заложившие основу теории информации II. H. Nyquist, “Certain factors affecting telegraph speed, ” Bell Syst. Tech. J. , vol. 3, pp. 324– 352, Apr. 1924. R. V. L. Hartley, “Transmission of information, ” Bell Syst. Tech. J. , vol. 7, pp. 535– 563, July 1928. В. А. Котельников «О пропускной способности линий электросвязи» Изд. Ред. Упр. Связи. РККА, том 44, 1933. А. Н. Колмогоров (1938 г. ) - ? C. E. Shannon, “A mathematical theory of communication, ” Bell Syst. Tech. J. , vol. 27, pp. 379– 423, 623– 656, July–Oct. 1948. A. G. Clavier, “Evaluation of transmission efficiency according to Hartley’s expression of information content, ” Elec. Commun. : ITT Tech. J. , vol. 25, pp. 414– 420, June 1948. C. W. Earp, “Relationship between rate of transmission of information, frequency bandwidth, and signal-to-noise ratio, ” Elec. Commun. : ITT Tech. J. , vol. 25, pp. 178– 195, June 1948. S. Goldman, “Some fundamental considerations concerning noise reductionand range in radar and communication, ” Proc. Inst. Elec. Eng. , vol. 36, pp. 584– 594, 1948, N. Wiener, Cybernetics, Chaper III: Time Series, Information and Communication. New York: Wiley, 1948.

I. Основные работы, заложившие основу теории информации II. H. Nyquist, “Certain factors affecting telegraph speed, ” Bell Syst. Tech. J. , vol. 3, pp. 324– 352, Apr. 1924. R. V. L. Hartley, “Transmission of information, ” Bell Syst. Tech. J. , vol. 7, pp. 535– 563, July 1928. В. А. Котельников «О пропускной способности линий электросвязи» Изд. Ред. Упр. Связи. РККА, том 44, 1933. А. Н. Колмогоров (1938 г. ) - ? C. E. Shannon, “A mathematical theory of communication, ” Bell Syst. Tech. J. , vol. 27, pp. 379– 423, 623– 656, July–Oct. 1948. A. G. Clavier, “Evaluation of transmission efficiency according to Hartley’s expression of information content, ” Elec. Commun. : ITT Tech. J. , vol. 25, pp. 414– 420, June 1948. C. W. Earp, “Relationship between rate of transmission of information, frequency bandwidth, and signal-to-noise ratio, ” Elec. Commun. : ITT Tech. J. , vol. 25, pp. 178– 195, June 1948. S. Goldman, “Some fundamental considerations concerning noise reductionand range in radar and communication, ” Proc. Inst. Elec. Eng. , vol. 36, pp. 584– 594, 1948, N. Wiener, Cybernetics, Chaper III: Time Series, Information and Communication. New York: Wiley, 1948.

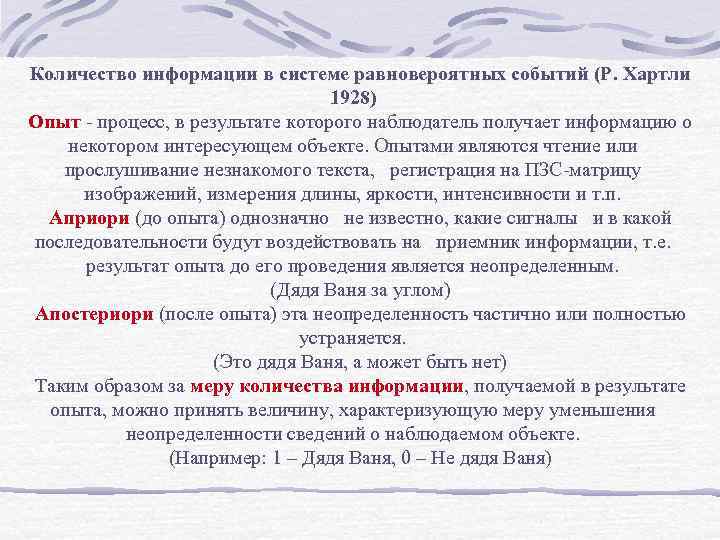

Количество информации в системе равновероятных событий (Р. Хартли 1928) Опыт процесс, в результате которого наблюдатель получает информацию о некотором интересующем объекте. Опытами являются чтение или прослушивание незнакомого текста, регистрация на ПЗС матрицу изображений, измерения длины, яркости, интенсивности и т. п. Априори (до опыта) однозначно не известно, какие сигналы и в какой последовательности будут воздействовать на приемник информации, т. е. результат опыта до его проведения является неопределенным. (Дядя Ваня за углом) Апостериори (после опыта) эта неопределенность частично или полностью устраняется. (Это дядя Ваня, а может быть нет) Таким образом за меру количества информации, получаемой в результате опыта, можно принять величину, характеризующую меру уменьшения неопределенности сведений о наблюдаемом объекте. (Например: 1 – Дядя Ваня, 0 – Не дядя Ваня)

Количество информации в системе равновероятных событий (Р. Хартли 1928) Опыт процесс, в результате которого наблюдатель получает информацию о некотором интересующем объекте. Опытами являются чтение или прослушивание незнакомого текста, регистрация на ПЗС матрицу изображений, измерения длины, яркости, интенсивности и т. п. Априори (до опыта) однозначно не известно, какие сигналы и в какой последовательности будут воздействовать на приемник информации, т. е. результат опыта до его проведения является неопределенным. (Дядя Ваня за углом) Апостериори (после опыта) эта неопределенность частично или полностью устраняется. (Это дядя Ваня, а может быть нет) Таким образом за меру количества информации, получаемой в результате опыта, можно принять величину, характеризующую меру уменьшения неопределенности сведений о наблюдаемом объекте. (Например: 1 – Дядя Ваня, 0 – Не дядя Ваня)

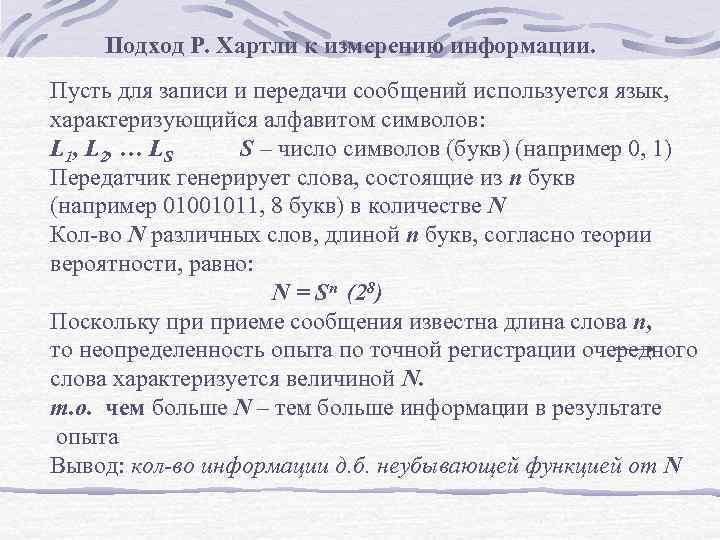

Подход Р. Хартли к измерению информации. Пусть для записи и передачи сообщений используется язык, характеризующийся алфавитом символов: L 1, L 2, … LS S – число символов (букв) (например 0, 1) Передатчик генерирует слова, состоящие из n букв (например 01001011, 8 букв) в количестве N Кол во N различных слов, длиной n букв, согласно теории вероятности, равно: N = Sn (28) Поскольку приеме сообщения известна длина слова n, то неопределенность опыта по точной регистрации очередного слова характеризуется величиной N. т. о. чем больше N – тем больше информации в результате опыта Вывод: кол-во информации д. б. неубывающей функцией от N

Подход Р. Хартли к измерению информации. Пусть для записи и передачи сообщений используется язык, характеризующийся алфавитом символов: L 1, L 2, … LS S – число символов (букв) (например 0, 1) Передатчик генерирует слова, состоящие из n букв (например 01001011, 8 букв) в количестве N Кол во N различных слов, длиной n букв, согласно теории вероятности, равно: N = Sn (28) Поскольку приеме сообщения известна длина слова n, то неопределенность опыта по точной регистрации очередного слова характеризуется величиной N. т. о. чем больше N – тем больше информации в результате опыта Вывод: кол-во информации д. б. неубывающей функцией от N

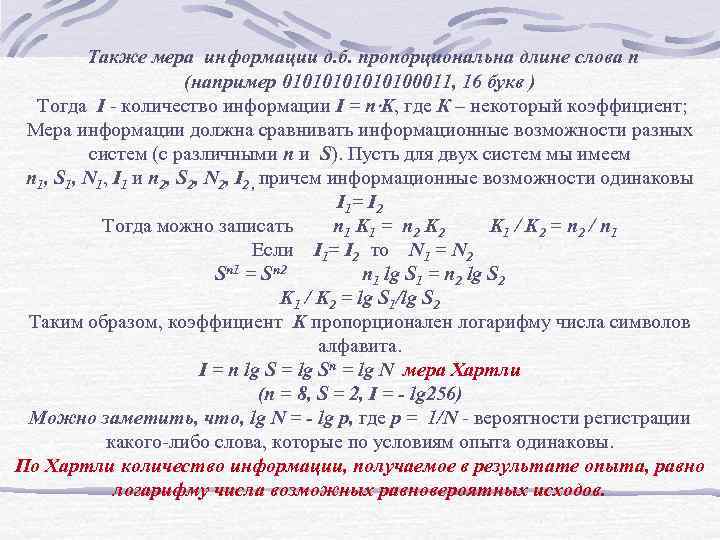

Также мера информации д. б. пропорциональна длине слова n (например 01010100011, 16 букв ) Тогда I количество информации I = n K, где К – некоторый коэффициент; Мера информации должна сравнивать информационные возможности разных систем (с различными n и S). Пусть для двух систем мы имеем n 1, S 1, N 1, I 1 и n 2, S 2, N 2, I 2 , причем информационные возможности одинаковы I 1 = I 2 Тогда можно записать n 1 K 1 = n 2 K 2 K 1 / K 2 = n 2 / n 1 Если I 1= I 2 то N 1 = N 2 Sn 1 = Sn 2 n 1 lg S 1 = n 2 lg S 2 K 1 / K 2 = lg S 1/lg S 2 Таким образом, коэффициент K пропорционален логарифму числа символов алфавита. I = n lg S = lg Sn = lg N мера Хартли (n = 8, S = 2, I = - lg 256) Можно заметить, что, lg N = - lg p, где р = 1/N вероятности регистрации какого либо слова, которые по условиям опыта одинаковы. По Хартли количество информации, получаемое в результате опыта, равно логарифму числа возможных равновероятных исходов.

Также мера информации д. б. пропорциональна длине слова n (например 01010100011, 16 букв ) Тогда I количество информации I = n K, где К – некоторый коэффициент; Мера информации должна сравнивать информационные возможности разных систем (с различными n и S). Пусть для двух систем мы имеем n 1, S 1, N 1, I 1 и n 2, S 2, N 2, I 2 , причем информационные возможности одинаковы I 1 = I 2 Тогда можно записать n 1 K 1 = n 2 K 2 K 1 / K 2 = n 2 / n 1 Если I 1= I 2 то N 1 = N 2 Sn 1 = Sn 2 n 1 lg S 1 = n 2 lg S 2 K 1 / K 2 = lg S 1/lg S 2 Таким образом, коэффициент K пропорционален логарифму числа символов алфавита. I = n lg S = lg Sn = lg N мера Хартли (n = 8, S = 2, I = - lg 256) Можно заметить, что, lg N = - lg p, где р = 1/N вероятности регистрации какого либо слова, которые по условиям опыта одинаковы. По Хартли количество информации, получаемое в результате опыта, равно логарифму числа возможных равновероятных исходов.

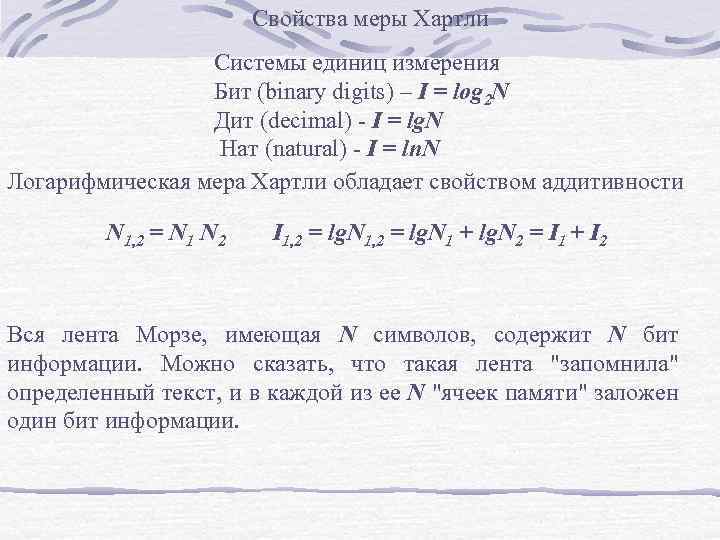

Свойства меры Хартли Системы единиц измерения Бит (binary digits) – I = log 2 N Дит (decimal) I = lg. N Нат (natural) I = ln. N Логарифмическая мера Хартли обладает свойством аддитивности N 1, 2 = N 1 N 2 I 1, 2 = lg. N 1 + lg. N 2 = I 1 + I 2 Вся лента Морзе, имеющая N символов, содержит N бит информации. Можно сказать, что такая лента "запомнила" определенный текст, и в каждой из ее N "ячеек памяти" заложен один бит информации.

Свойства меры Хартли Системы единиц измерения Бит (binary digits) – I = log 2 N Дит (decimal) I = lg. N Нат (natural) I = ln. N Логарифмическая мера Хартли обладает свойством аддитивности N 1, 2 = N 1 N 2 I 1, 2 = lg. N 1 + lg. N 2 = I 1 + I 2 Вся лента Морзе, имеющая N символов, содержит N бит информации. Можно сказать, что такая лента "запомнила" определенный текст, и в каждой из ее N "ячеек памяти" заложен один бит информации.

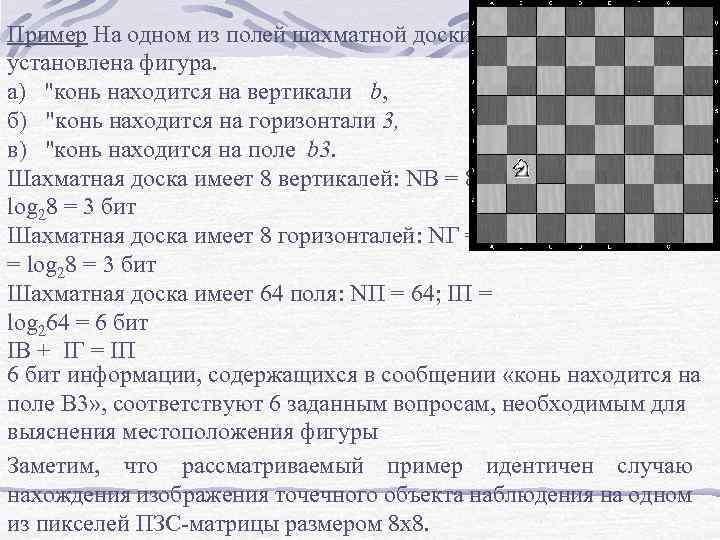

Пример На одном из полей шахматной доски установлена фигура. а) "конь находится на вертикали b, б) "конь находится на горизонтали 3, в) "конь находится на поле b 3. Шахматная доска имеет 8 вертикалей: NB = 8; IB = log 28 = 3 бит Шахматная доска имеет 8 горизонталей: NГ = 8; IГ = log 28 = 3 бит Шахматная доска имеет 64 поля: NП = 64; IП = log 264 = 6 бит IB + IГ = IП 6 бит информации, содержащихся в сообщении «конь находится на поле B 3» , соответствуют 6 заданным вопросам, необходимым для выяснения местоположения фигуры Заметим, что рассматриваемый пример идентичен случаю нахождения изображения точечного объекта наблюдения на одном из пикселей ПЗС матрицы размером 8 x 8.

Пример На одном из полей шахматной доски установлена фигура. а) "конь находится на вертикали b, б) "конь находится на горизонтали 3, в) "конь находится на поле b 3. Шахматная доска имеет 8 вертикалей: NB = 8; IB = log 28 = 3 бит Шахматная доска имеет 8 горизонталей: NГ = 8; IГ = log 28 = 3 бит Шахматная доска имеет 64 поля: NП = 64; IП = log 264 = 6 бит IB + IГ = IП 6 бит информации, содержащихся в сообщении «конь находится на поле B 3» , соответствуют 6 заданным вопросам, необходимым для выяснения местоположения фигуры Заметим, что рассматриваемый пример идентичен случаю нахождения изображения точечного объекта наблюдения на одном из пикселей ПЗС матрицы размером 8 x 8.

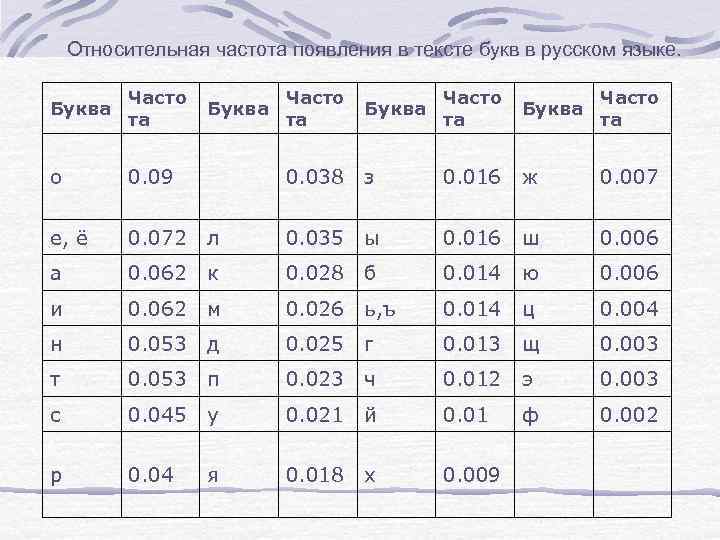

Относительная частота появления в тексте букв в русском языке. Буква Часто та о 0. 09 0. 038 з 0. 016 ж 0. 007 е, ё 0. 072 л 0. 035 ы 0. 016 ш 0. 006 а 0. 062 к 0. 028 б 0. 014 ю 0. 006 и 0. 062 м 0. 026 ь, ъ 0. 014 ц 0. 004 н 0. 053 д 0. 025 г 0. 013 щ 0. 003 т 0. 053 п 0. 023 ч 0. 012 э 0. 003 с 0. 045 у 0. 021 й 0. 01 ф 0. 002 р 0. 04 я 0. 018 х 0. 009 Буква

Относительная частота появления в тексте букв в русском языке. Буква Часто та о 0. 09 0. 038 з 0. 016 ж 0. 007 е, ё 0. 072 л 0. 035 ы 0. 016 ш 0. 006 а 0. 062 к 0. 028 б 0. 014 ю 0. 006 и 0. 062 м 0. 026 ь, ъ 0. 014 ц 0. 004 н 0. 053 д 0. 025 г 0. 013 щ 0. 003 т 0. 053 п 0. 023 ч 0. 012 э 0. 003 с 0. 045 у 0. 021 й 0. 01 ф 0. 002 р 0. 04 я 0. 018 х 0. 009 Буква

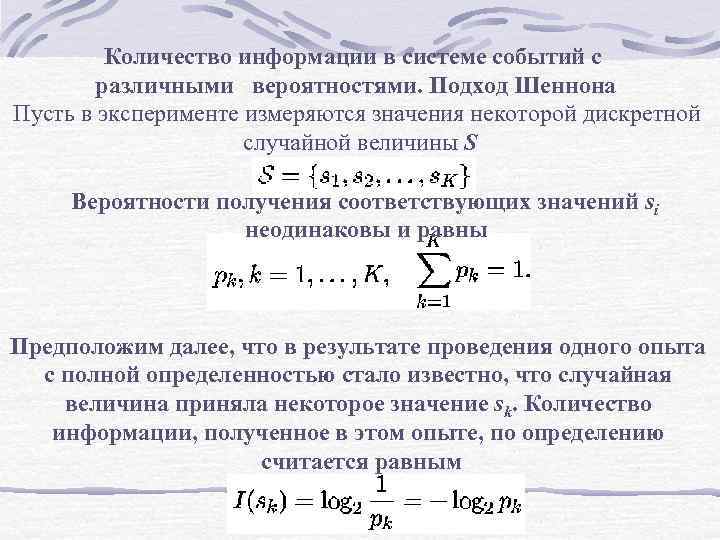

Количество информации в системе событий с различными вероятностями. Подход Шеннона Пусть в эксперименте измеряются значения некоторой дискретной случайной величины S Вероятности получения соответствующих значений si неодинаковы и равны Предположим далее, что в результате проведения одного опыта с полной определенностью стало известно, что случайная величина приняла некоторое значение sk. Количество информации, полученное в этом опыте, по определению считается равным

Количество информации в системе событий с различными вероятностями. Подход Шеннона Пусть в эксперименте измеряются значения некоторой дискретной случайной величины S Вероятности получения соответствующих значений si неодинаковы и равны Предположим далее, что в результате проведения одного опыта с полной определенностью стало известно, что случайная величина приняла некоторое значение sk. Количество информации, полученное в этом опыте, по определению считается равным

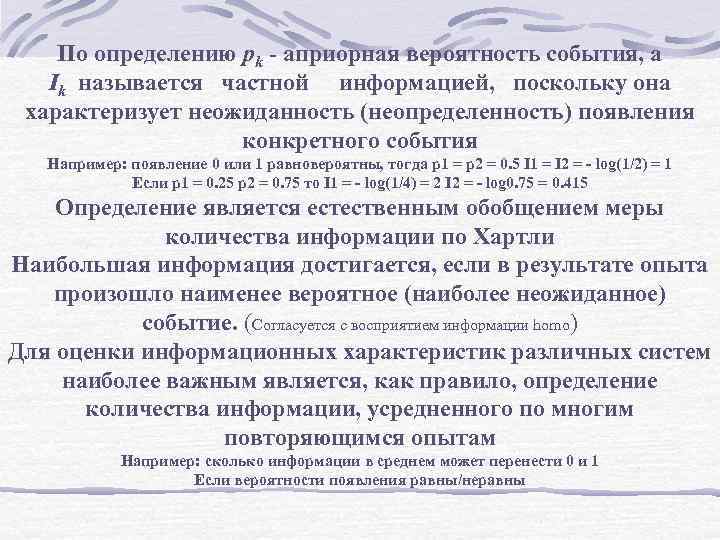

По определению pk - априорная вероятность события, а Ik называется частной информацией, поскольку она характеризует неожиданность (неопределенность) появления конкретного события Например: появление 0 или 1 равновероятны, тогда p 1 = p 2 = 0. 5 I 1 = I 2 = - log(1/2) = 1 Если p 1 = 0. 25 p 2 = 0. 75 то I 1 = - log(1/4) = 2 I 2 = - log 0. 75 = 0. 415 Определение является естественным обобщением меры количества информации по Хартли Наибольшая информация достигается, если в результате опыта произошло наименее вероятное (наиболее неожиданное) событие. (Согласуется с восприятием информации homo) Для оценки информационных характеристик различных систем наиболее важным является, как правило, определение количества информации, усредненного по многим повторяющимся опытам Например: сколько информации в среднем может перенести 0 и 1 Если вероятности появления равны/неравны

По определению pk - априорная вероятность события, а Ik называется частной информацией, поскольку она характеризует неожиданность (неопределенность) появления конкретного события Например: появление 0 или 1 равновероятны, тогда p 1 = p 2 = 0. 5 I 1 = I 2 = - log(1/2) = 1 Если p 1 = 0. 25 p 2 = 0. 75 то I 1 = - log(1/4) = 2 I 2 = - log 0. 75 = 0. 415 Определение является естественным обобщением меры количества информации по Хартли Наибольшая информация достигается, если в результате опыта произошло наименее вероятное (наиболее неожиданное) событие. (Согласуется с восприятием информации homo) Для оценки информационных характеристик различных систем наиболее важным является, как правило, определение количества информации, усредненного по многим повторяющимся опытам Например: сколько информации в среднем может перенести 0 и 1 Если вероятности появления равны/неравны

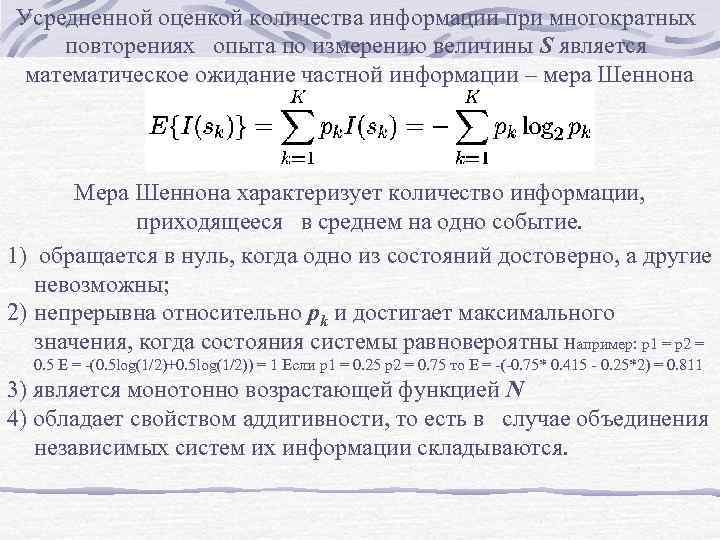

Усредненной оценкой количества информации при многократных повторениях опыта по измерению величины S является математическое ожидание частной информации – мера Шеннона Мера Шеннона характеризует количество информации, приходящееся в среднем на одно событие. 1) обращается в нуль, когда одно из состояний достоверно, а другие невозможны; 2) непрерывна относительно pk и достигает максимального значения, когда состояния системы равновероятны Например: p 1 = p 2 = 0. 5 E = (0. 5 log(1/2)+0. 5 log(1/2)) = 1 Если p 1 = 0. 25 p 2 = 0. 75 то E = ( 0. 75* 0. 415 0. 25*2) = 0. 811 3) является монотонно возрастающей функцией N 4) обладает свойством аддитивности, то есть в случае объединения независимых систем их информации складываются.

Усредненной оценкой количества информации при многократных повторениях опыта по измерению величины S является математическое ожидание частной информации – мера Шеннона Мера Шеннона характеризует количество информации, приходящееся в среднем на одно событие. 1) обращается в нуль, когда одно из состояний достоверно, а другие невозможны; 2) непрерывна относительно pk и достигает максимального значения, когда состояния системы равновероятны Например: p 1 = p 2 = 0. 5 E = (0. 5 log(1/2)+0. 5 log(1/2)) = 1 Если p 1 = 0. 25 p 2 = 0. 75 то E = ( 0. 75* 0. 415 0. 25*2) = 0. 811 3) является монотонно возрастающей функцией N 4) обладает свойством аддитивности, то есть в случае объединения независимых систем их информации складываются.

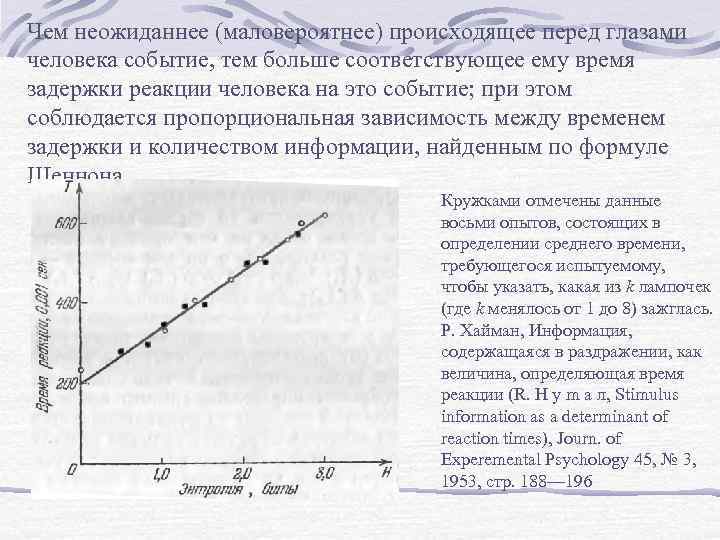

Чем неожиданнее (маловероятнее) происходящее перед глазами человека событие, тем больше соответствующее ему время задержки реакции человека на это событие; при этом соблюдается пропорциональная зависимость между временем задержки и количеством информации, найденным по формуле Шеннона. Кружками отмечены данные восьми опытов, состоящих в определении среднего времени, требующегося испытуемому, чтобы указать, какая из k лампочек (где k менялось от 1 до 8) зажглась. Р. Хайман, Информация, содержащаяся в раздражении, как величина, определяющая время реакции (R. Н у m а л, Stimulus information as a determinant of reaction times), Journ. of Experemental Psychology 45, № 3, 1953, стр. 188— 196

Чем неожиданнее (маловероятнее) происходящее перед глазами человека событие, тем больше соответствующее ему время задержки реакции человека на это событие; при этом соблюдается пропорциональная зависимость между временем задержки и количеством информации, найденным по формуле Шеннона. Кружками отмечены данные восьми опытов, состоящих в определении среднего времени, требующегося испытуемому, чтобы указать, какая из k лампочек (где k менялось от 1 до 8) зажглась. Р. Хайман, Информация, содержащаяся в раздражении, как величина, определяющая время реакции (R. Н у m а л, Stimulus information as a determinant of reaction times), Journ. of Experemental Psychology 45, № 3, 1953, стр. 188— 196

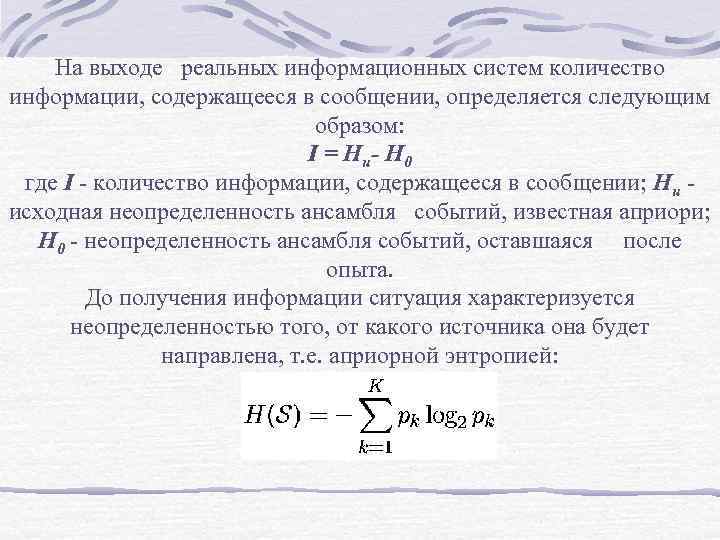

На выходе реальных информационных систем количество информации, содержащееся в сообщении, определяется следующим образом: I = Ни- Н 0 где I количество информации, содержащееся в сообщении; Ни исходная неопределенность ансамбля событий, известная априори; Н 0 неопределенность ансамбля событий, оставшаяся после опыта. До получения информации ситуация характеризуется неопределенностью того, от какого источника она будет направлена, т. е. априорной энтропией:

На выходе реальных информационных систем количество информации, содержащееся в сообщении, определяется следующим образом: I = Ни- Н 0 где I количество информации, содержащееся в сообщении; Ни исходная неопределенность ансамбля событий, известная априори; Н 0 неопределенность ансамбля событий, оставшаяся после опыта. До получения информации ситуация характеризуется неопределенностью того, от какого источника она будет направлена, т. е. априорной энтропией:

Энтропия дискретной случайной величины — это минимум среднего количества бит, которое нужно передавать по каналу связи о текущем значении данной случайной величины. В термодинамике энтропия означает вероятность теплового состояния вещества, в математике – степень неопределенности ситуации или задачи, в информатике она характеризует способность источника отдавать информацию. Энтропия источника бинарных (двоичных) сообщений изменяется от нуля до единицы в зависимости от вероятности сообщений и имеет максимум при p 1 = p 2 = 0, 5. В этом случае мера Шеннона совпадает с мерой Хартли. Источник с энтропией в 1 бит полностью согласован с каналом, например, реле, имеющим информационную емкость в 1 бит. При неравновероятности сообщений канал будет недогружен. Зависимость энтропии от вероятности для бинарного источника иногда называют функцией Шеннона.

Энтропия дискретной случайной величины — это минимум среднего количества бит, которое нужно передавать по каналу связи о текущем значении данной случайной величины. В термодинамике энтропия означает вероятность теплового состояния вещества, в математике – степень неопределенности ситуации или задачи, в информатике она характеризует способность источника отдавать информацию. Энтропия источника бинарных (двоичных) сообщений изменяется от нуля до единицы в зависимости от вероятности сообщений и имеет максимум при p 1 = p 2 = 0, 5. В этом случае мера Шеннона совпадает с мерой Хартли. Источник с энтропией в 1 бит полностью согласован с каналом, например, реле, имеющим информационную емкость в 1 бит. При неравновероятности сообщений канал будет недогружен. Зависимость энтропии от вероятности для бинарного источника иногда называют функцией Шеннона.

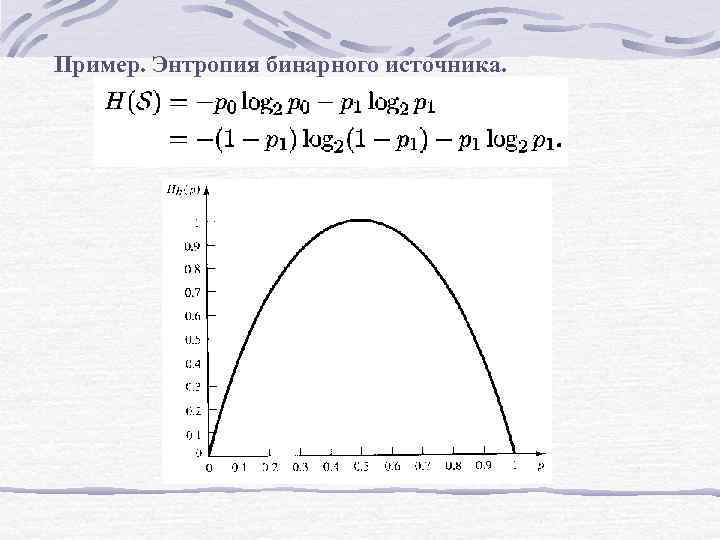

Пример. Энтропия бинарного источника.

Пример. Энтропия бинарного источника.

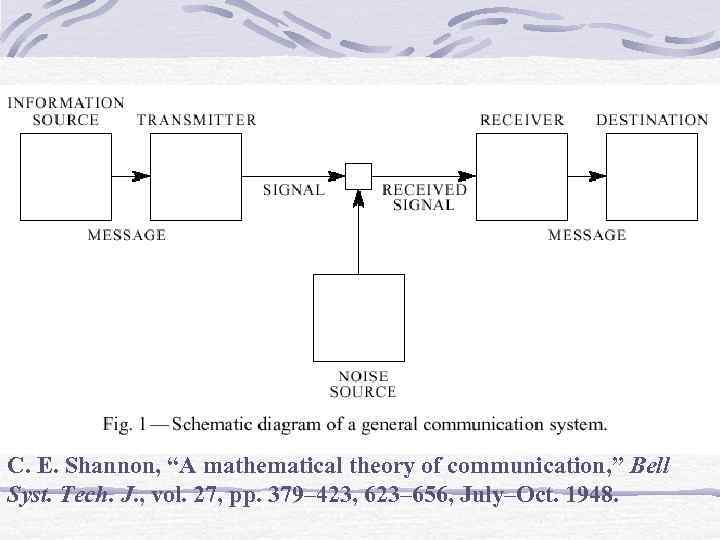

C. E. Shannon, “A mathematical theory of communication, ” Bell Syst. Tech. J. , vol. 27, pp. 379– 423, 623– 656, July–Oct. 1948.

C. E. Shannon, “A mathematical theory of communication, ” Bell Syst. Tech. J. , vol. 27, pp. 379– 423, 623– 656, July–Oct. 1948.

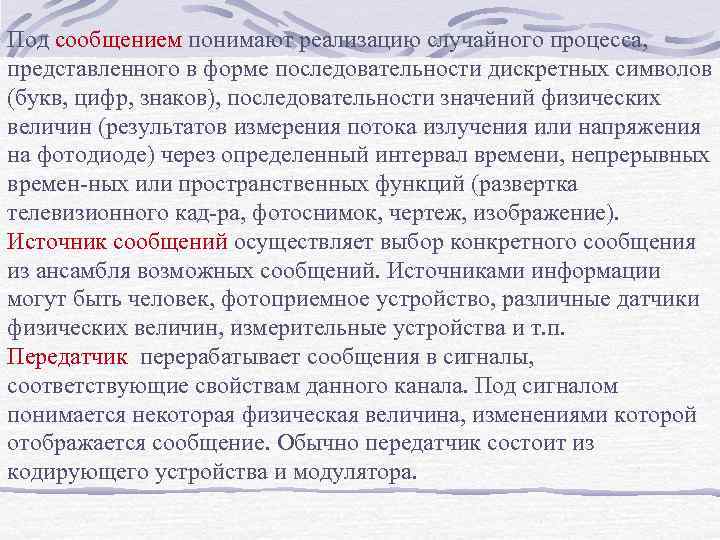

Под сообщением понимают реализацию случайного процесса, представленного в форме последовательности дискретных символов (букв, цифр, знаков), последовательности значений физических величин (результатов измерения потока излучения или напряжения на фотодиоде) через определенный интервал времени, непрерывных времен ных или пространственных функций (развертка телевизионного кад ра, фотоснимок, чертеж, изображение). Источник сообщений осуществляет выбор конкретного сообщения из ансамбля возможных сообщений. Источниками информации могут быть человек, фотоприемное устройство, различные датчики физических величин, измерительные устройства и т. п. Передатчик перерабатывает сообщения в сигналы, соответствующие свойствам данного канала. Под сигналом понимается некоторая физическая величина, изменениями которой отображается сообщение. Обычно передатчик состоит из кодирующего устройства и модулятора.

Под сообщением понимают реализацию случайного процесса, представленного в форме последовательности дискретных символов (букв, цифр, знаков), последовательности значений физических величин (результатов измерения потока излучения или напряжения на фотодиоде) через определенный интервал времени, непрерывных времен ных или пространственных функций (развертка телевизионного кад ра, фотоснимок, чертеж, изображение). Источник сообщений осуществляет выбор конкретного сообщения из ансамбля возможных сообщений. Источниками информации могут быть человек, фотоприемное устройство, различные датчики физических величин, измерительные устройства и т. п. Передатчик перерабатывает сообщения в сигналы, соответствующие свойствам данного канала. Под сигналом понимается некоторая физическая величина, изменениями которой отображается сообщение. Обычно передатчик состоит из кодирующего устройства и модулятора.

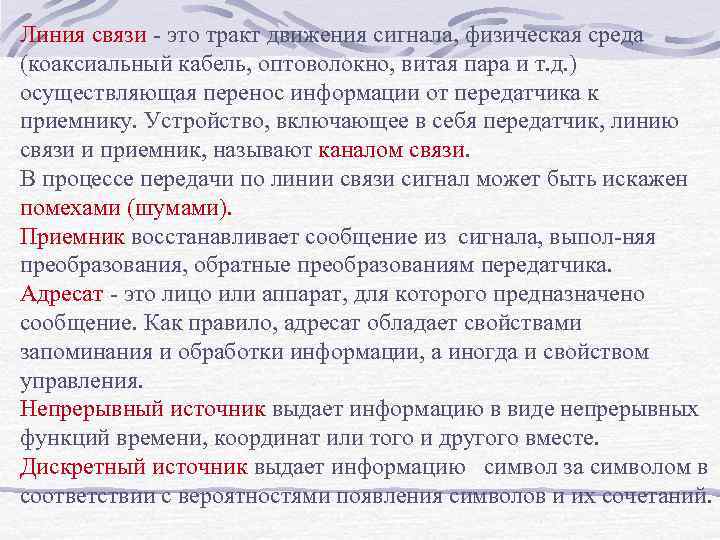

Линия связи это тракт движения сигнала, физическая среда (коаксиальный кабель, оптоволокно, витая пара и т. д. ) осуществляющая перенос информации от передатчика к приемнику. Устройство, включающее в себя передатчик, линию связи и приемник, называют каналом связи. В процессе передачи по линии связи сигнал может быть искажен помехами (шумами). Приемник восстанавливает сообщение из сигнала, выпол няя преобразования, обратные преобразованиям передатчика. Адресат это лицо или аппарат, для которого предназначено сообщение. Как правило, адресат обладает свойствами запоминания и обработки информации, а иногда и свойством управления. Непрерывный источник выдает информацию в виде непрерывных функций времени, координат или того и другого вместе. Дискретный источник выдает информацию символ за символом в соответствии с вероятностями появления символов и их сочетаний.

Линия связи это тракт движения сигнала, физическая среда (коаксиальный кабель, оптоволокно, витая пара и т. д. ) осуществляющая перенос информации от передатчика к приемнику. Устройство, включающее в себя передатчик, линию связи и приемник, называют каналом связи. В процессе передачи по линии связи сигнал может быть искажен помехами (шумами). Приемник восстанавливает сообщение из сигнала, выпол няя преобразования, обратные преобразованиям передатчика. Адресат это лицо или аппарат, для которого предназначено сообщение. Как правило, адресат обладает свойствами запоминания и обработки информации, а иногда и свойством управления. Непрерывный источник выдает информацию в виде непрерывных функций времени, координат или того и другого вместе. Дискретный источник выдает информацию символ за символом в соответствии с вероятностями появления символов и их сочетаний.

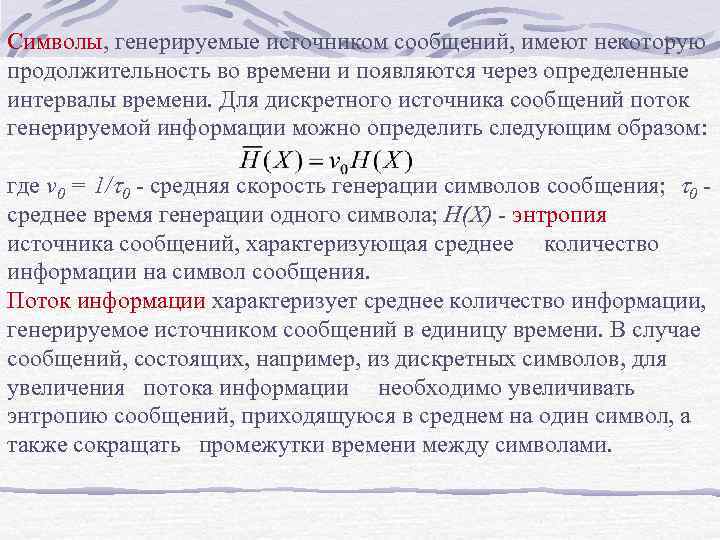

Символы, генерируемые источником сообщений, имеют некоторую продолжительность во времени и появляются через определенные интервалы времени. Для дискретного источника сообщений поток генерируемой информации можно определить следующим образом: где v 0 = 1/ 0 средняя скорость генерации символов сообщения; 0 среднее время генерации одного символа; Н(X) энтропия источника сообщений, характеризующая среднее количество информации на символ сообщения. Поток информации характеризует среднее количество информации, генерируемое источником сообщений в единицу времени. В случае сообщений, состоящих, например, из дискретных символов, для увеличения потока информации необходимо увеличивать энтропию сообщений, приходящуюся в среднем на один символ, а также сокращать промежутки времени между символами.

Символы, генерируемые источником сообщений, имеют некоторую продолжительность во времени и появляются через определенные интервалы времени. Для дискретного источника сообщений поток генерируемой информации можно определить следующим образом: где v 0 = 1/ 0 средняя скорость генерации символов сообщения; 0 среднее время генерации одного символа; Н(X) энтропия источника сообщений, характеризующая среднее количество информации на символ сообщения. Поток информации характеризует среднее количество информации, генерируемое источником сообщений в единицу времени. В случае сообщений, состоящих, например, из дискретных символов, для увеличения потока информации необходимо увеличивать энтропию сообщений, приходящуюся в среднем на один символ, а также сокращать промежутки времени между символами.

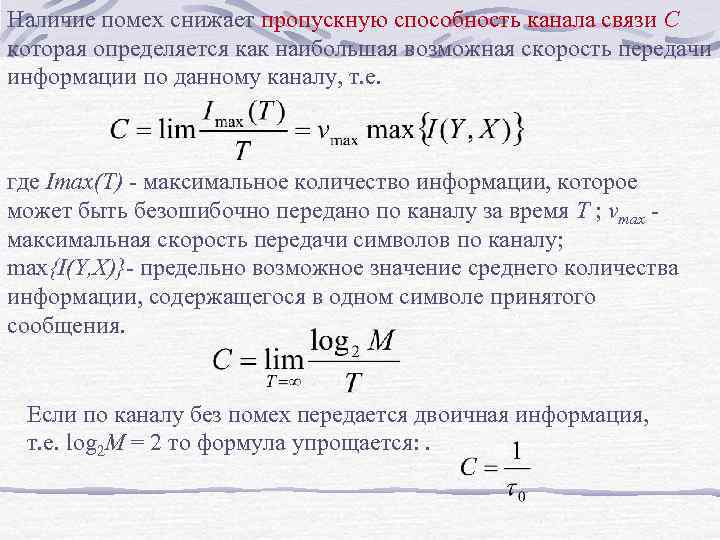

Наличие помех снижает пропускную способность канала связи С которая определяется как наибольшая возможная скорость передачи информации по данному каналу, т. е. где Imax(T) максимальное количество информации, которое может быть безошибочно передано по каналу за время Т ; vmax максимальная скорость передачи символов по каналу; max{I(Y, X)} предельно возможное значение среднего количества информации, содержащегося в одном символе принятого сообщения. Если по каналу без помех передается двоичная информация, т. е. log 2 M = 2 то формула упрощается: .

Наличие помех снижает пропускную способность канала связи С которая определяется как наибольшая возможная скорость передачи информации по данному каналу, т. е. где Imax(T) максимальное количество информации, которое может быть безошибочно передано по каналу за время Т ; vmax максимальная скорость передачи символов по каналу; max{I(Y, X)} предельно возможное значение среднего количества информации, содержащегося в одном символе принятого сообщения. Если по каналу без помех передается двоичная информация, т. е. log 2 M = 2 то формула упрощается: .

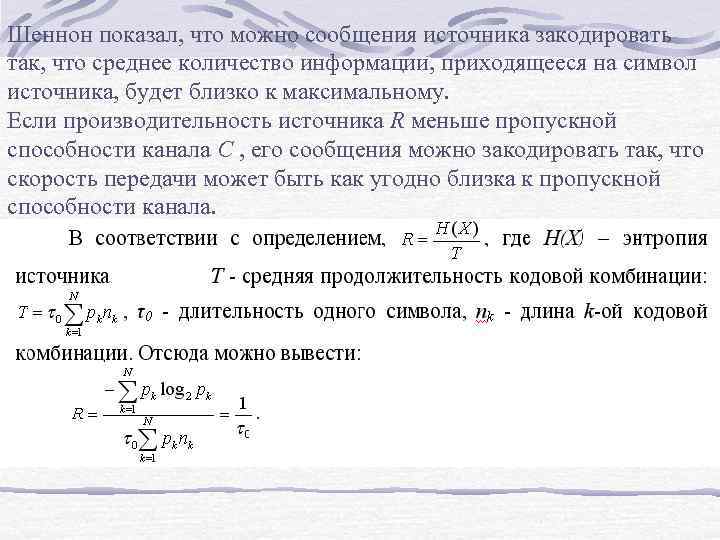

Шеннон показал, что можно сообщения источника закодировать так, что среднее количество информации, приходящееся на символ источника, будет близко к максимальному. Если производительность источника R меньше пропускной способности канала C , его сообщения можно закодировать так, что скорость передачи может быть как угодно близка к пропускной способности канала.

Шеннон показал, что можно сообщения источника закодировать так, что среднее количество информации, приходящееся на символ источника, будет близко к максимальному. Если производительность источника R меньше пропускной способности канала C , его сообщения можно закодировать так, что скорость передачи может быть как угодно близка к пропускной способности канала.

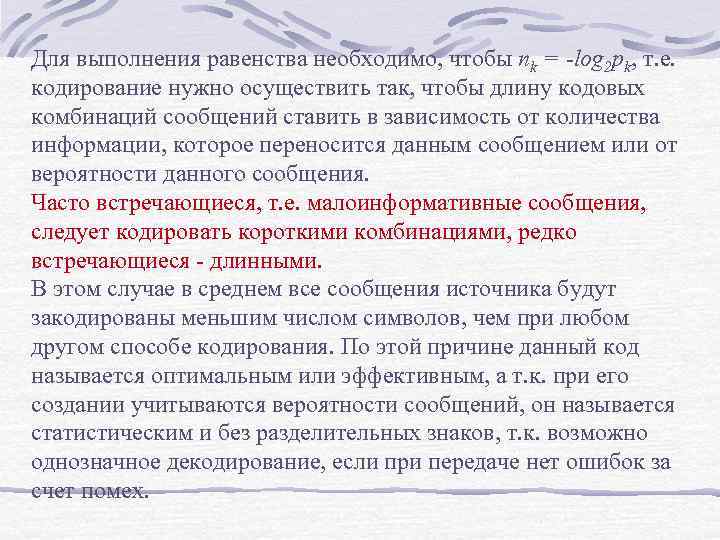

Для выполнения равенства необходимо, чтобы nk = -log 2 pk, т. е. кодирование нужно осуществить так, чтобы длину кодовых комбинаций сообщений ставить в зависимость от количества информации, которое переносится данным сообщением или от вероятности данного сообщения. Часто встречающиеся, т. е. малоинформативные сообщения, следует кодировать короткими комбинациями, редко встречающиеся длинными. В этом случае в среднем все сообщения источника будут закодированы меньшим числом символов, чем при любом другом способе кодирования. По этой причине данный код называется оптимальным или эффективным, а т. к. при его создании учитываются вероятности сообщений, он называется статистическим и без разделительных знаков, т. к. возможно однозначное декодирование, если при передаче нет ошибок за счет помех.

Для выполнения равенства необходимо, чтобы nk = -log 2 pk, т. е. кодирование нужно осуществить так, чтобы длину кодовых комбинаций сообщений ставить в зависимость от количества информации, которое переносится данным сообщением или от вероятности данного сообщения. Часто встречающиеся, т. е. малоинформативные сообщения, следует кодировать короткими комбинациями, редко встречающиеся длинными. В этом случае в среднем все сообщения источника будут закодированы меньшим числом символов, чем при любом другом способе кодирования. По этой причине данный код называется оптимальным или эффективным, а т. к. при его создании учитываются вероятности сообщений, он называется статистическим и без разделительных знаков, т. к. возможно однозначное декодирование, если при передаче нет ошибок за счет помех.

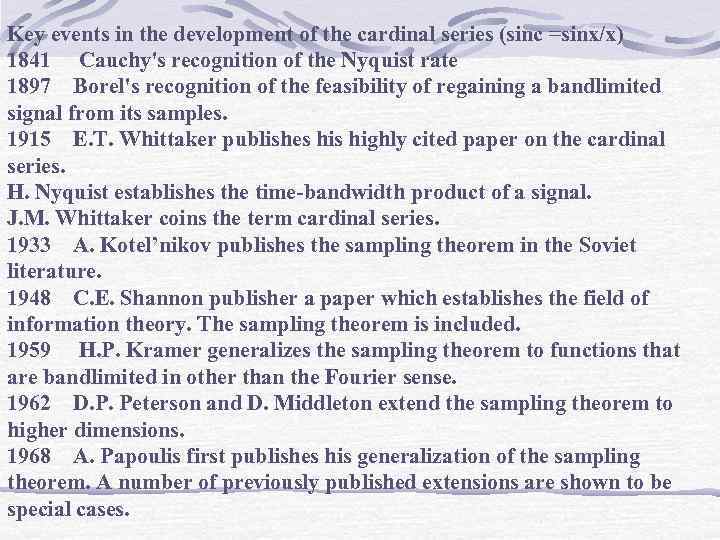

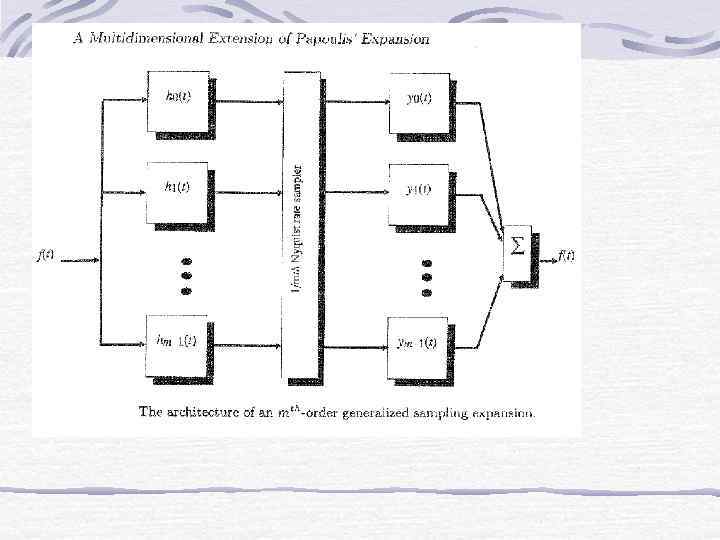

Key events in the development of the cardinal series (sinc =sinx/x) 1841 Cauchy's recognition of the Nyquist rate 1897 Borel's recognition of the feasibility of regaining a bandlimited signal from its samples. 1915 E. T. Whittaker publishes highly cited paper on the cardinal series. H. Nyquist establishes the time-bandwidth product of a signal. J. M. Whittaker coins the term cardinal series. 1933 A. Kotel’nikov publishes the sampling theorem in the Soviet literature. 1948 C. E. Shannon publisher a paper which establishes the field of information theory. The sampling theorem is included. 1959 H. P. Kramer generalizes the sampling theorem to functions that are bandlimited in other than the Fourier sense. 1962 D. P. Peterson and D. Middleton extend the sampling theorem to higher dimensions. 1968 A. Papoulis first publishes his generalization of the sampling theorem. A number of previously published extensions are shown to be special cases.

Key events in the development of the cardinal series (sinc =sinx/x) 1841 Cauchy's recognition of the Nyquist rate 1897 Borel's recognition of the feasibility of regaining a bandlimited signal from its samples. 1915 E. T. Whittaker publishes highly cited paper on the cardinal series. H. Nyquist establishes the time-bandwidth product of a signal. J. M. Whittaker coins the term cardinal series. 1933 A. Kotel’nikov publishes the sampling theorem in the Soviet literature. 1948 C. E. Shannon publisher a paper which establishes the field of information theory. The sampling theorem is included. 1959 H. P. Kramer generalizes the sampling theorem to functions that are bandlimited in other than the Fourier sense. 1962 D. P. Peterson and D. Middleton extend the sampling theorem to higher dimensions. 1968 A. Papoulis first publishes his generalization of the sampling theorem. A number of previously published extensions are shown to be special cases.

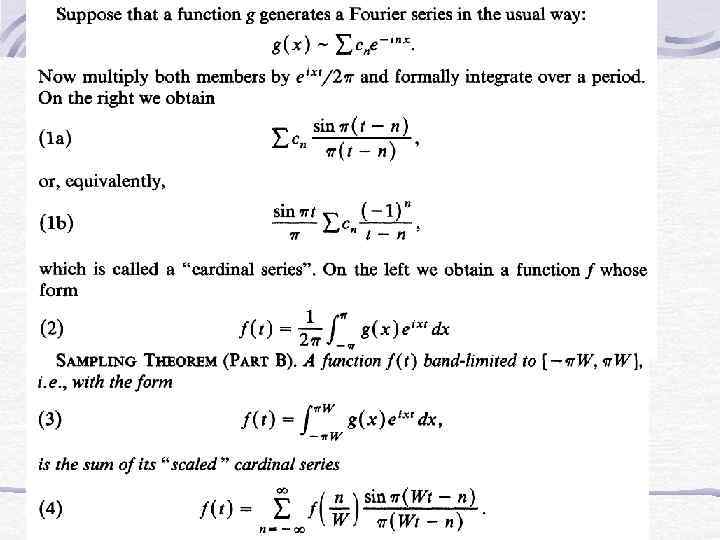

Для дискретизации аналогового сигнала без потери информации частота отсчетов должна быть в два раза выше верхней граничной частоты спектра сигнала.

Для дискретизации аналогового сигнала без потери информации частота отсчетов должна быть в два раза выше верхней граничной частоты спектра сигнала.

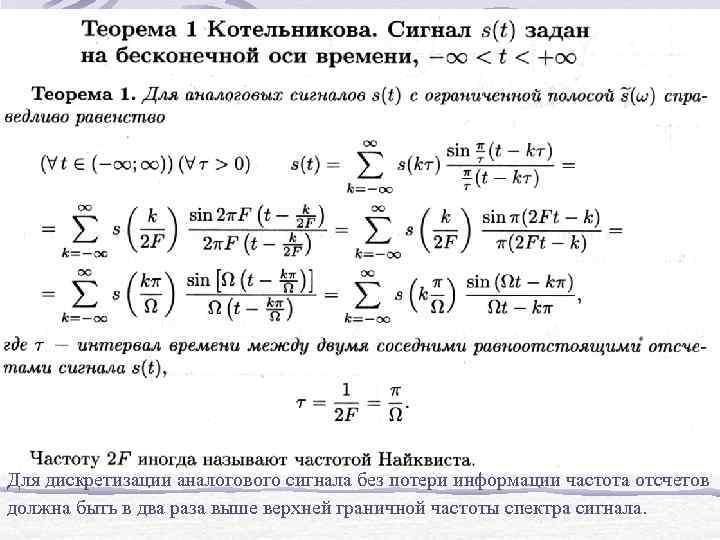

Представление сигнала с ограниченным спектром рядом Котельникова

Представление сигнала с ограниченным спектром рядом Котельникова

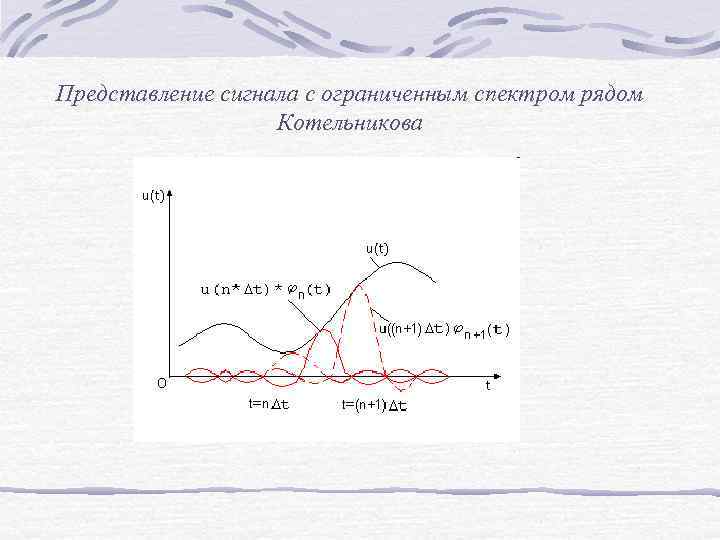

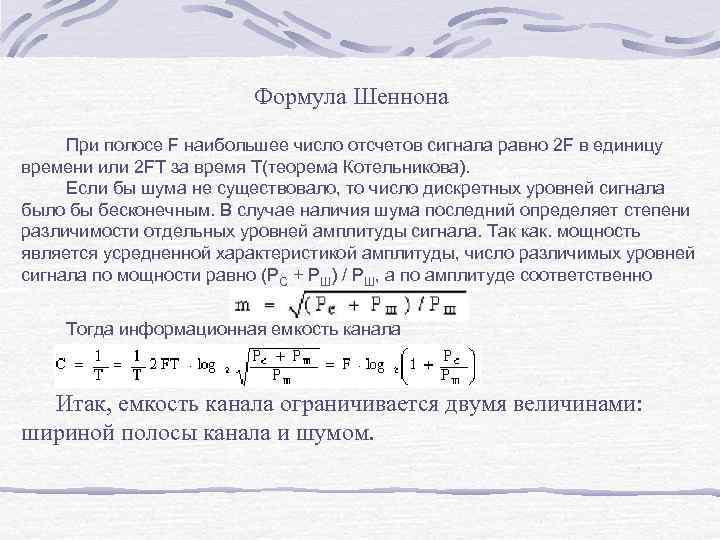

Формула Шеннона При полосе F наибольшее число отсчетов сигнала равно 2 F в единицу времени или 2 FT за время T(теорема Котельникова). Если бы шума не существовало, то число дискретных уровней сигнала было бы бесконечным. В случае наличия шума последний определяет степени различимости отдельных уровней амплитуды сигнала. Так как. мощность является усредненной характеристикой амплитуды, число различимых уровней сигнала по мощности равно (PС + PШ) / PШ, а по амплитуде соответственно Тогда информационная емкость канала Итак, емкость канала ограничивается двумя величинами: шириной полосы канала и шумом.

Формула Шеннона При полосе F наибольшее число отсчетов сигнала равно 2 F в единицу времени или 2 FT за время T(теорема Котельникова). Если бы шума не существовало, то число дискретных уровней сигнала было бы бесконечным. В случае наличия шума последний определяет степени различимости отдельных уровней амплитуды сигнала. Так как. мощность является усредненной характеристикой амплитуды, число различимых уровней сигнала по мощности равно (PС + PШ) / PШ, а по амплитуде соответственно Тогда информационная емкость канала Итак, емкость канала ограничивается двумя величинами: шириной полосы канала и шумом.

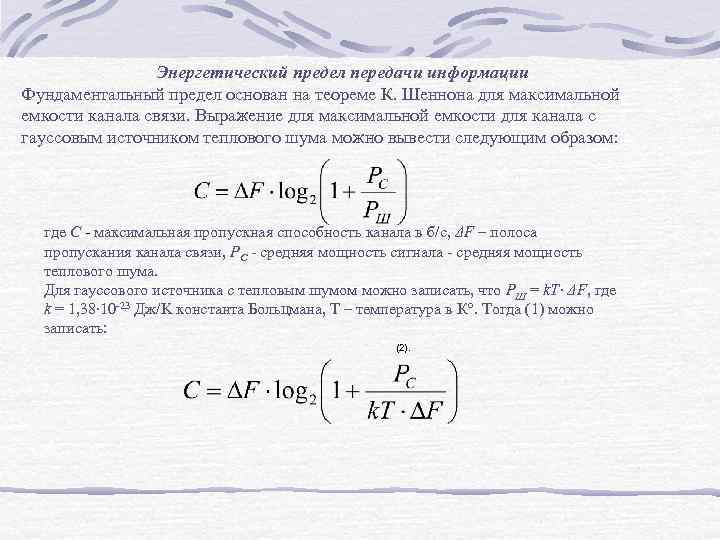

Энергетический предел передачи информации Фундаментальный предел основан на теореме К. Шеннона для максимальной емкости канала связи. Выражение для максимальной емкости для канала с гауссовым источником теплового шума можно вывести следующим образом: где С максимальная пропускная способность канала в б/c, ΔF – полоса пропускания канала связи, PC средняя мощность сигнала средняя мощность теплового шума. Для гауссового источника с тепловым шумом можно записать, что PШ = k. T∙ ΔF, где k = 1, 38∙ 10 23 Дж/K константа Больцмана, T – температура в К. Тогда (1) можно записать: (2).

Энергетический предел передачи информации Фундаментальный предел основан на теореме К. Шеннона для максимальной емкости канала связи. Выражение для максимальной емкости для канала с гауссовым источником теплового шума можно вывести следующим образом: где С максимальная пропускная способность канала в б/c, ΔF – полоса пропускания канала связи, PC средняя мощность сигнала средняя мощность теплового шума. Для гауссового источника с тепловым шумом можно записать, что PШ = k. T∙ ΔF, где k = 1, 38∙ 10 23 Дж/K константа Больцмана, T – температура в К. Тогда (1) можно записать: (2).

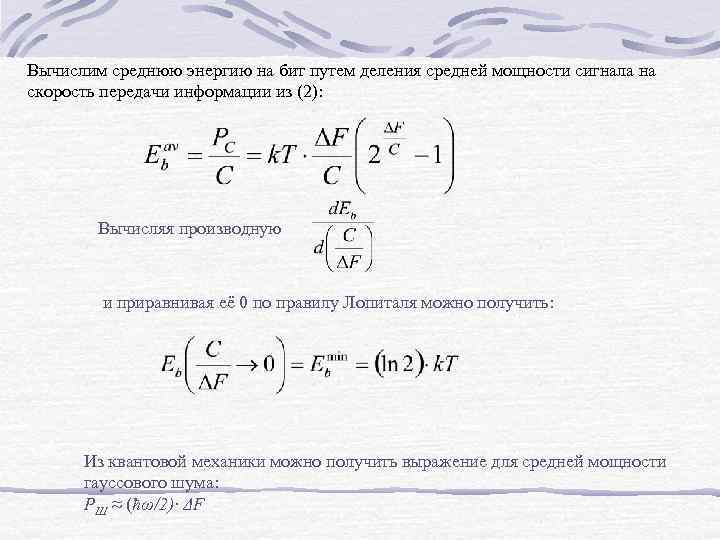

Вычислим среднюю энергию на бит путем деления средней мощности сигнала на скорость передачи информации из (2): Вычисляя производную и приравнивая её 0 по правилу Лопиталя можно получить: Из квантовой механики можно получить выражение для средней мощности гаусcового шума: PШ ≈ (ħω/2)∙ ΔF

Вычислим среднюю энергию на бит путем деления средней мощности сигнала на скорость передачи информации из (2): Вычисляя производную и приравнивая её 0 по правилу Лопиталя можно получить: Из квантовой механики можно получить выражение для средней мощности гаусcового шума: PШ ≈ (ħω/2)∙ ΔF

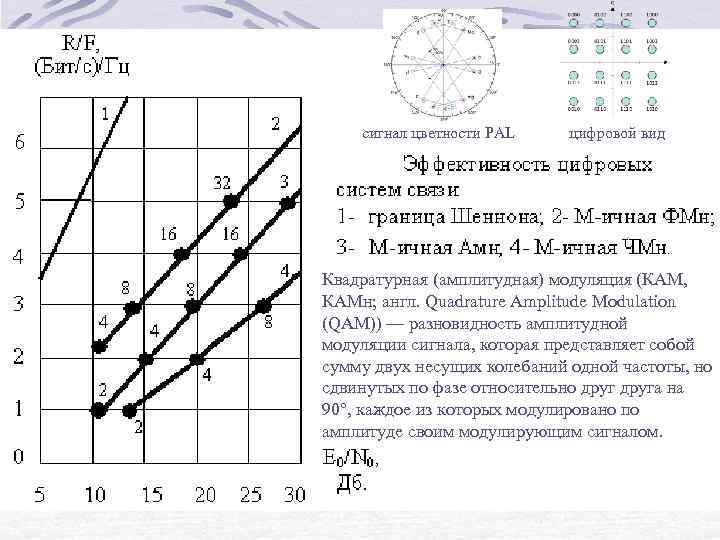

сигнал цветности PAL цифровой вид Квадратурная (амплитудная) модуляция (КАМ, КАМн; англ. Quadrature Amplitude Modulation (QAM)) — разновидность амплитудной модуляции сигнала, которая представляет собой сумму двух несущих колебаний одной частоты, но сдвинутых по фазе относительно друга на 90°, каждое из которых модулировано по амплитуде своим модулирующим сигналом.

сигнал цветности PAL цифровой вид Квадратурная (амплитудная) модуляция (КАМ, КАМн; англ. Quadrature Amplitude Modulation (QAM)) — разновидность амплитудной модуляции сигнала, которая представляет собой сумму двух несущих колебаний одной частоты, но сдвинутых по фазе относительно друга на 90°, каждое из которых модулировано по амплитуде своим модулирующим сигналом.

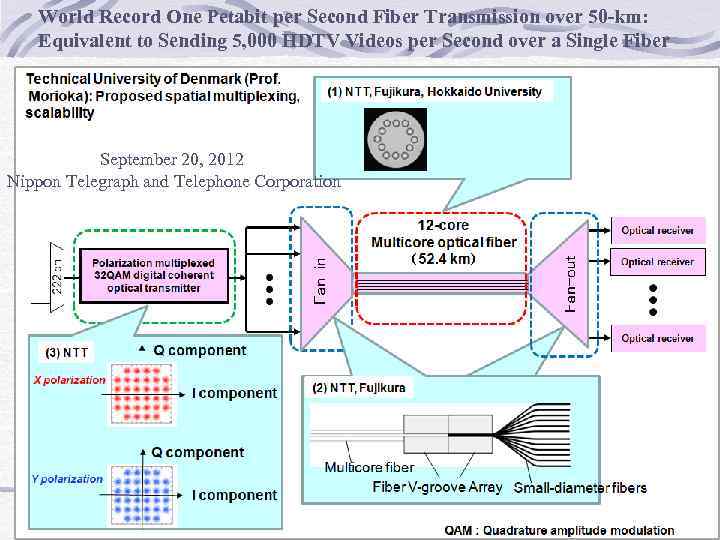

World Record One Petabit per Second Fiber Transmission over 50 -km: Equivalent to Sending 5, 000 HDTV Videos per Second over a Single Fiber September 20, 2012 Nippon Telegraph and Telephone Corporation

World Record One Petabit per Second Fiber Transmission over 50 -km: Equivalent to Sending 5, 000 HDTV Videos per Second over a Single Fiber September 20, 2012 Nippon Telegraph and Telephone Corporation

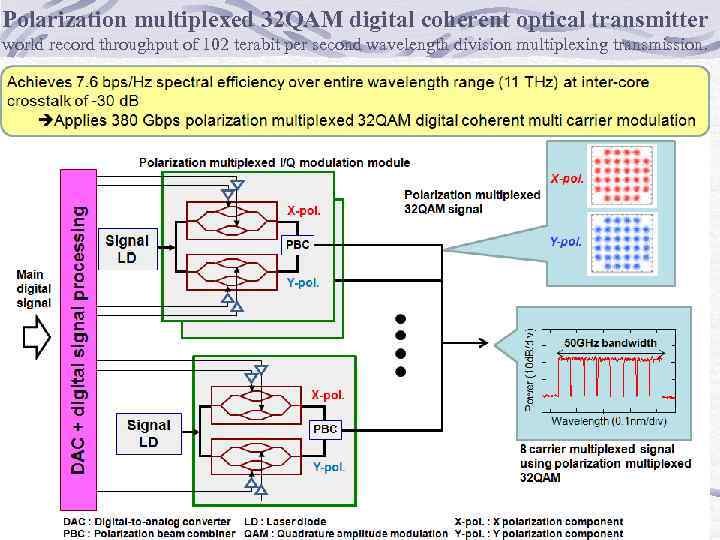

Polarization multiplexed 32 QAM digital coherent optical transmitter world record throughput of 102 terabit per second wavelength division multiplexing transmission.

Polarization multiplexed 32 QAM digital coherent optical transmitter world record throughput of 102 terabit per second wavelength division multiplexing transmission.

ЛЕКЦИЯ 8 ТЕОРИЯ ИНФОРМАЦИИ В ОПТИКЕ Во всем мне хочется дойти До самой сути… До их причины, До оснований, до корней, До сердцевины. Борис Пастернак

ЛЕКЦИЯ 8 ТЕОРИЯ ИНФОРМАЦИИ В ОПТИКЕ Во всем мне хочется дойти До самой сути… До их причины, До оснований, до корней, До сердцевины. Борис Пастернак

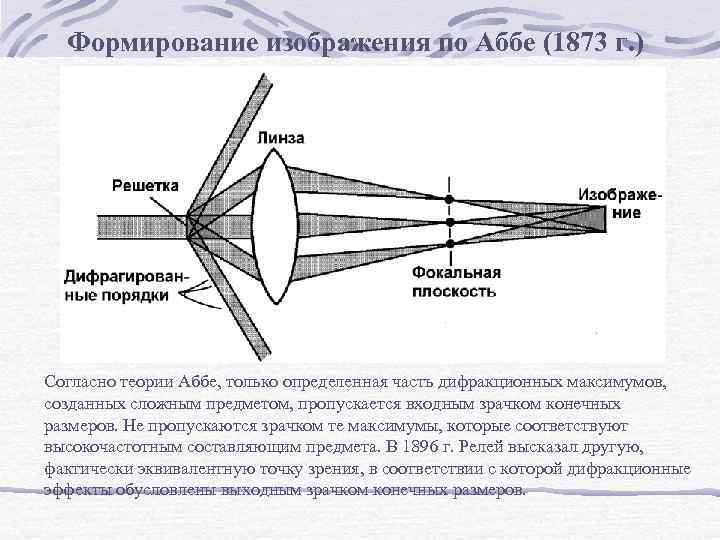

Формирование изображения по Аббе (1873 г. ) Согласно теории Аббе, только определенная часть дифракционных максимумов, созданных сложным предметом, пропускается входным зрачком конечных размеров. Не пропускаются зрачком те максимумы, которые соответствуют высокочастотным составляющим предмета. В 1896 г. Релей высказал другую, фактически эквивалентную точку зрения, в соответствии с которой дифракционные эффекты обусловлены выходным зрачком конечных размеров.

Формирование изображения по Аббе (1873 г. ) Согласно теории Аббе, только определенная часть дифракционных максимумов, созданных сложным предметом, пропускается входным зрачком конечных размеров. Не пропускаются зрачком те максимумы, которые соответствуют высокочастотным составляющим предмета. В 1896 г. Релей высказал другую, фактически эквивалентную точку зрения, в соответствии с которой дифракционные эффекты обусловлены выходным зрачком конечных размеров.

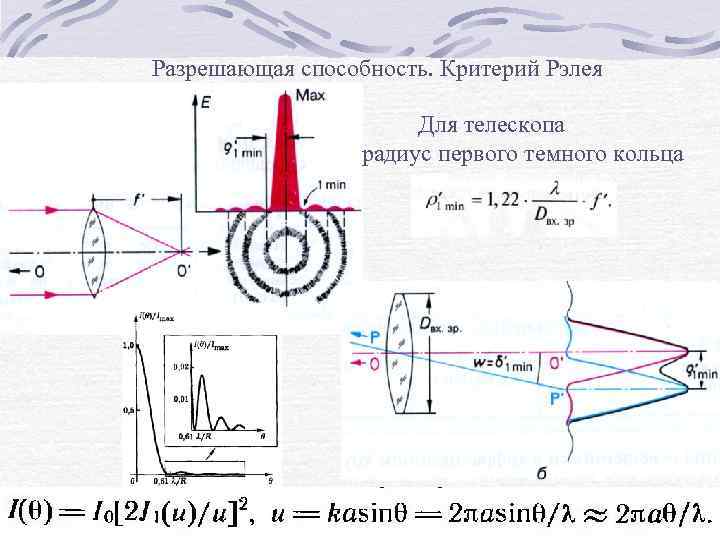

Разрешающая способность. Критерий Рэлея Для телескопа радиус первого темного кольца

Разрешающая способность. Критерий Рэлея Для телескопа радиус первого темного кольца

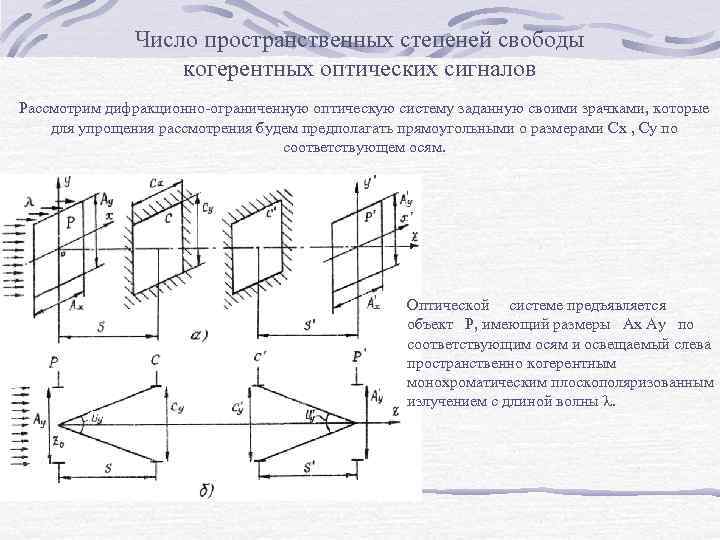

Число пространственных степеней свободы когерентных оптических сигналов Рассмотрим дифракционно ограниченную оптическую систему заданную своими зрачками, которые для упрощения рассмотрения будем предполагать прямоугольными о размерами Сх , Су по соответствующем осям. Оптической системе предъявляется объект Р, имеющий размеры Аx Ay по соответствующим осям и освещаемый слева пространственно когерентным монохроматическим плоскополяризованным излучением с длиной волны .

Число пространственных степеней свободы когерентных оптических сигналов Рассмотрим дифракционно ограниченную оптическую систему заданную своими зрачками, которые для упрощения рассмотрения будем предполагать прямоугольными о размерами Сх , Су по соответствующем осям. Оптической системе предъявляется объект Р, имеющий размеры Аx Ay по соответствующим осям и освещаемый слева пространственно когерентным монохроматическим плоскополяризованным излучением с длиной волны .

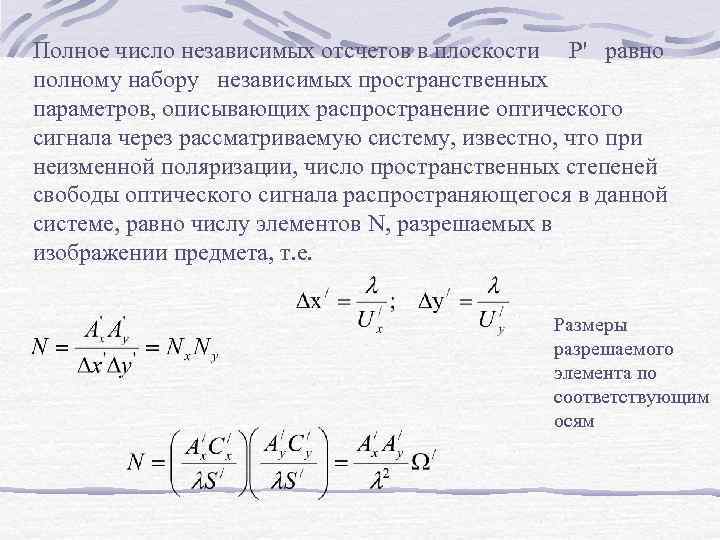

Полное число независимых отсчетов в плоскости Р' равно полному набору независимых пространственных параметров, описывающих распространение оптического сигнала через рассматриваемую систему, известно, что при неизменной поляризации, число пространственных степеней свободы оптического сигнала распространяющегося в данной системе, равно числу элементов N, разрешаемых в изображении предмета, т. е. Размеры разрешаемого элемента по соответствующим осям

Полное число независимых отсчетов в плоскости Р' равно полному набору независимых пространственных параметров, описывающих распространение оптического сигнала через рассматриваемую систему, известно, что при неизменной поляризации, число пространственных степеней свободы оптического сигнала распространяющегося в данной системе, равно числу элементов N, разрешаемых в изображении предмета, т. е. Размеры разрешаемого элемента по соответствующим осям

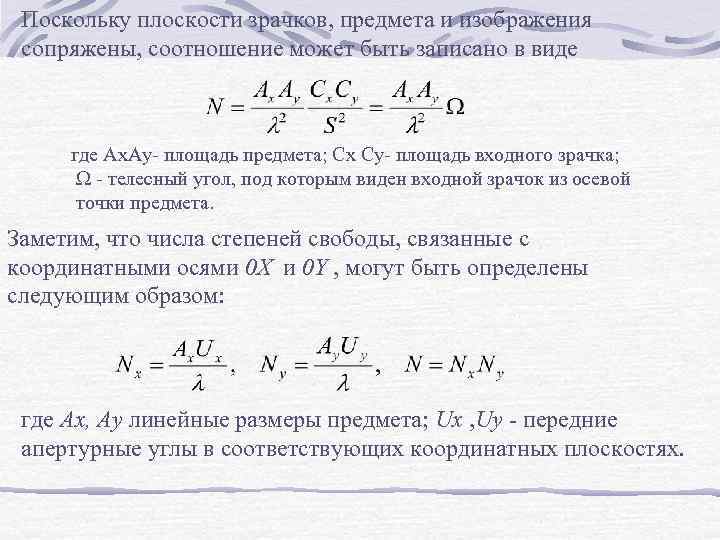

Поскольку плоскости зрачков, предмета и изображения сопряжены, соотношение может быть записано в виде где Аx. Ау площадь предмета; Сx Су площадь входного зрачка; W телесный угол, под которым виден входной зрачок из осевой точки предмета. Заметим, что числа степеней свободы, связанные c координатными осями 0 Х и 0 Y , могут быть определены следующим образом: где Ах, Ay линейные размеры предмета; Ux , Uу передние апертурные углы в соответствующих координатных плоскостях.

Поскольку плоскости зрачков, предмета и изображения сопряжены, соотношение может быть записано в виде где Аx. Ау площадь предмета; Сx Су площадь входного зрачка; W телесный угол, под которым виден входной зрачок из осевой точки предмета. Заметим, что числа степеней свободы, связанные c координатными осями 0 Х и 0 Y , могут быть определены следующим образом: где Ах, Ay линейные размеры предмета; Ux , Uу передние апертурные углы в соответствующих координатных плоскостях.

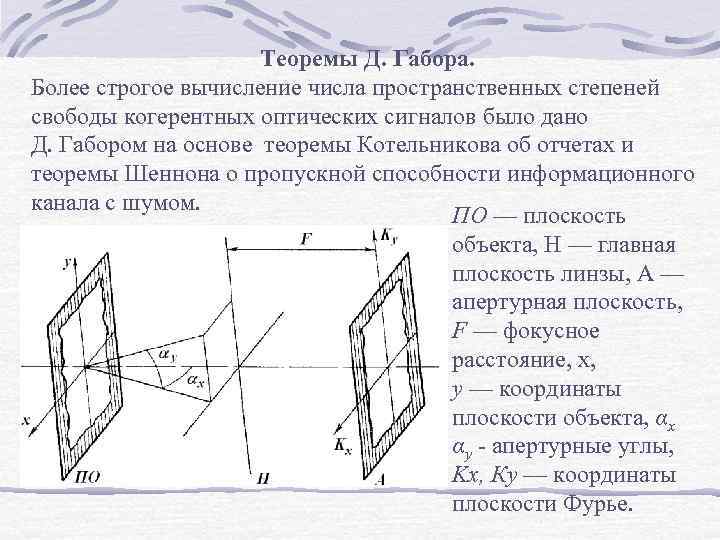

Теоремы Д. Габора. Более строгое вычисление числа пространственных степеней свободы когерентных оптических сигналов было дано Д. Габором на основе теоремы Котельникова об отчетах и теоремы Шеннона о пропускной способности информационного канала с шумом. ПО — плоскость объекта, H — главная плоскость линзы, A — апертурная плоскость, F — фокусное расстояние, х, у — координаты плоскости объекта, αx αy апертурные углы, Κx, Кy — координаты плоскости Фурье.

Теоремы Д. Габора. Более строгое вычисление числа пространственных степеней свободы когерентных оптических сигналов было дано Д. Габором на основе теоремы Котельникова об отчетах и теоремы Шеннона о пропускной способности информационного канала с шумом. ПО — плоскость объекта, H — главная плоскость линзы, A — апертурная плоскость, F — фокусное расстояние, х, у — координаты плоскости объекта, αx αy апертурные углы, Κx, Кy — координаты плоскости Фурье.

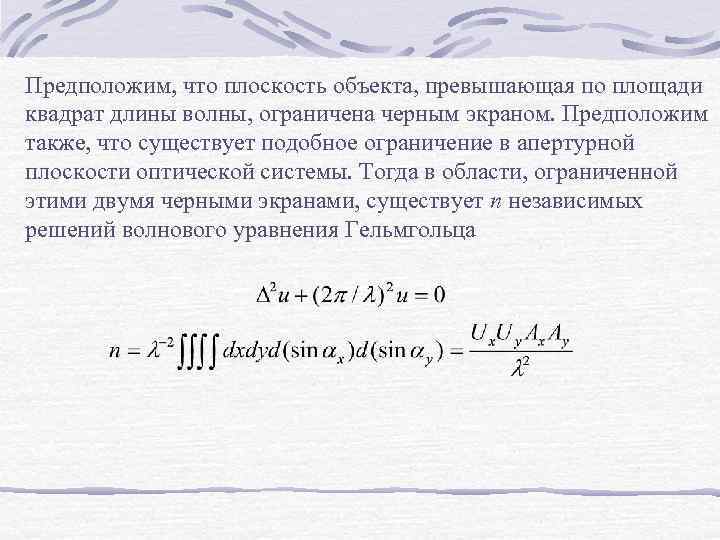

Предположим, что плоскость объекта, превышающая по площади квадрат длины волны, ограничена черным экраном. Предположим также, что существует подобное ограничение в апертурной плоскости оптической системы. Тогда в области, ограниченной этими двумя черными экранами, существует n независимых решений волнового уравнения Гельмгольца

Предположим, что плоскость объекта, превышающая по площади квадрат длины волны, ограничена черным экраном. Предположим также, что существует подобное ограничение в апертурной плоскости оптической системы. Тогда в области, ограниченной этими двумя черными экранами, существует n независимых решений волнового уравнения Гельмгольца

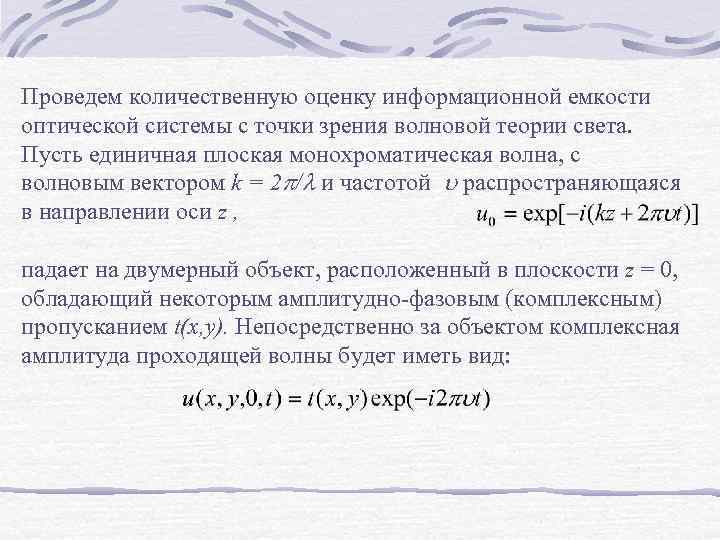

Проведем количественную оценку информационной емкости оптической системы с точки зрения волновой теории света. Пусть единичная плоская монохроматическая волна, с волновым вектором k = 2 / и частотой распространяющаяся в направлении оси z , падает на двумерный объект, расположенный в плоскости z = 0, обладающий некоторым амплитудно фазовым (комплексным) пропусканием t(x, у). Непосредственно за объектом комплексная амплитуда проходящей волны будет иметь вид:

Проведем количественную оценку информационной емкости оптической системы с точки зрения волновой теории света. Пусть единичная плоская монохроматическая волна, с волновым вектором k = 2 / и частотой распространяющаяся в направлении оси z , падает на двумерный объект, расположенный в плоскости z = 0, обладающий некоторым амплитудно фазовым (комплексным) пропусканием t(x, у). Непосредственно за объектом комплексная амплитуда проходящей волны будет иметь вид:

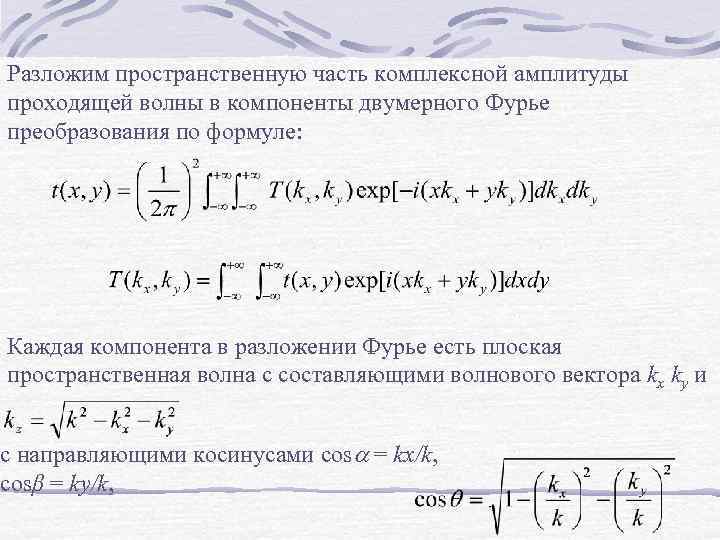

Разложим пространственную часть комплексной амплитуды проходящей волны в компоненты двумерного Фурье преобразования по формуле: Каждая компонента в разложении Фурье есть плоская пространственная волна с составляющими волнового вектора kx ky и с направляющими косинусами cos = kx/k, cosβ = ky/k,

Разложим пространственную часть комплексной амплитуды проходящей волны в компоненты двумерного Фурье преобразования по формуле: Каждая компонента в разложении Фурье есть плоская пространственная волна с составляющими волнового вектора kx ky и с направляющими косинусами cos = kx/k, cosβ = ky/k,

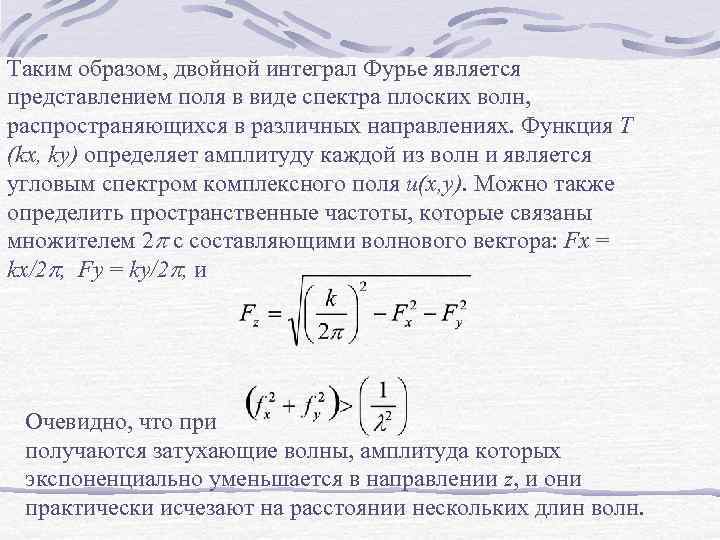

Таким образом, двойной интеграл Фурье является представлением поля в виде спектра плоских волн, распространяющихся в различных направлениях. Функция Τ (kx, ky) определяет амплитуду каждой из волн и является угловым спектром комплексного поля u(x, y). Можно также определить пространственные частоты, которые связаны множителем с составляющими волнового вектора: Fx = kx/2 , Fy = ky/2 , и Очевидно, что при получаются затухающие волны, амплитуда которых экспоненциально уменьшается в направлении z, и они практически исчезают на расстоянии нескольких длин волн.

Таким образом, двойной интеграл Фурье является представлением поля в виде спектра плоских волн, распространяющихся в различных направлениях. Функция Τ (kx, ky) определяет амплитуду каждой из волн и является угловым спектром комплексного поля u(x, y). Можно также определить пространственные частоты, которые связаны множителем с составляющими волнового вектора: Fx = kx/2 , Fy = ky/2 , и Очевидно, что при получаются затухающие волны, амплитуда которых экспоненциально уменьшается в направлении z, и они практически исчезают на расстоянии нескольких длин волн.

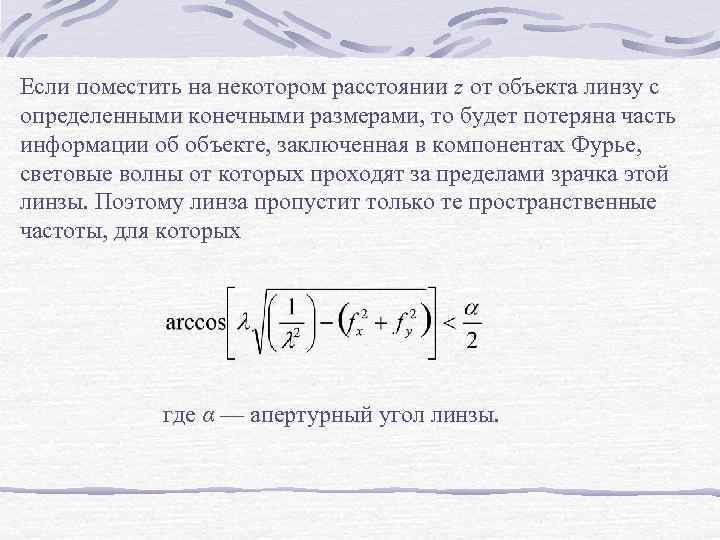

Если поместить на некотором расстоянии z от объекта линзу с определенными конечными размерами, то будет потеряна часть информации об объекте, заключенная в компонентах Фурье, световые волны от которых проходят за пределами зрачка этой линзы. Поэтому линза пропустит только те пространственные частоты, для которых где α — апертурный угол линзы.

Если поместить на некотором расстоянии z от объекта линзу с определенными конечными размерами, то будет потеряна часть информации об объекте, заключенная в компонентах Фурье, световые волны от которых проходят за пределами зрачка этой линзы. Поэтому линза пропустит только те пространственные частоты, для которых где α — апертурный угол линзы.

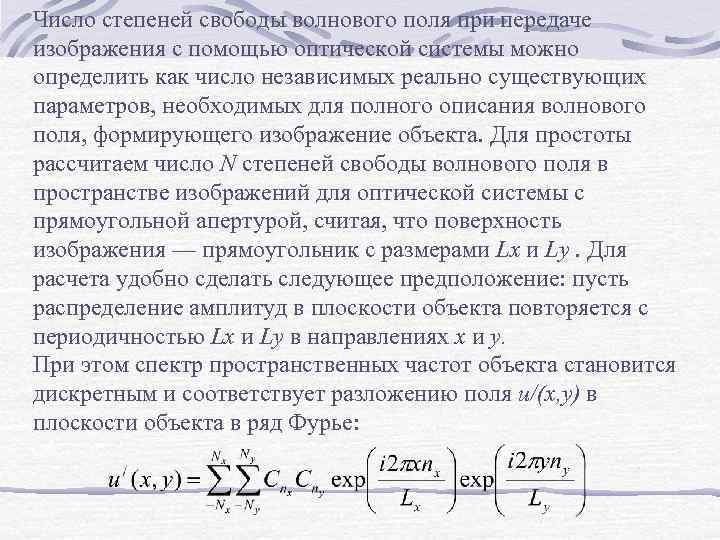

Число степеней свободы волнового поля при передаче изображения с помощью оптической системы можно определить как число независимых реально существующих параметров, необходимых для полного описания волнового поля, формирующего изображение объекта. Для простоты рассчитаем число N степеней свободы волнового поля в пространстве изображений для оптической системы с прямоугольной апертурой, считая, что поверхность изображения — прямоугольник с размерами Lx и Ly. Для расчета удобно сделать следующее предположение: пусть распределение амплитуд в плоскости объекта повторяется с периодичностью Lx и Ly в направлениях x и у. При этом спектр пространственных частот объекта становится дискретным и соответствует разложению поля u/(x, y) в плоскости объекта в ряд Фурье:

Число степеней свободы волнового поля при передаче изображения с помощью оптической системы можно определить как число независимых реально существующих параметров, необходимых для полного описания волнового поля, формирующего изображение объекта. Для простоты рассчитаем число N степеней свободы волнового поля в пространстве изображений для оптической системы с прямоугольной апертурой, считая, что поверхность изображения — прямоугольник с размерами Lx и Ly. Для расчета удобно сделать следующее предположение: пусть распределение амплитуд в плоскости объекта повторяется с периодичностью Lx и Ly в направлениях x и у. При этом спектр пространственных частот объекта становится дискретным и соответствует разложению поля u/(x, y) в плоскости объекта в ряд Фурье:

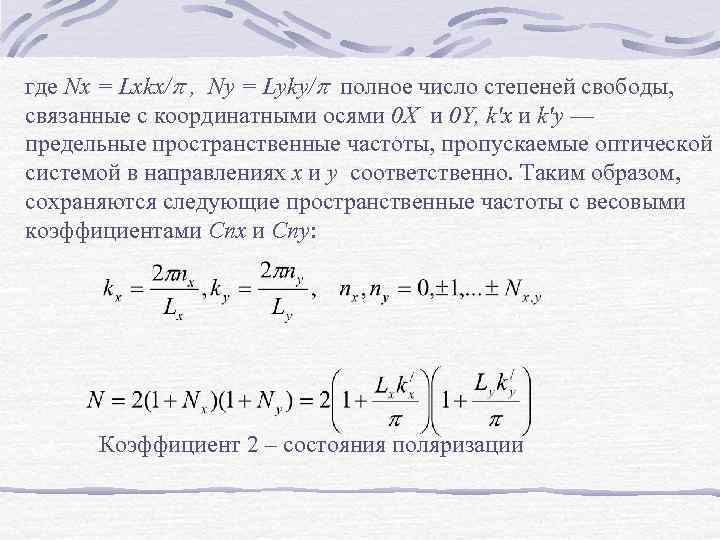

где Nx = Lxkx/ , Ny = Lyky/ полное число степеней свободы, связанные c координатными осями 0 Х и 0 Y, k'х и k'у — предельные пространственные частоты, пропускаемые оптической системой в направлениях x и y соответственно. Таким образом, сохраняются следующие пространственные частоты с весовыми коэффициентами Cnx и Cny: Коэффициент 2 – состояния поляризации

где Nx = Lxkx/ , Ny = Lyky/ полное число степеней свободы, связанные c координатными осями 0 Х и 0 Y, k'х и k'у — предельные пространственные частоты, пропускаемые оптической системой в направлениях x и y соответственно. Таким образом, сохраняются следующие пространственные частоты с весовыми коэффициентами Cnx и Cny: Коэффициент 2 – состояния поляризации

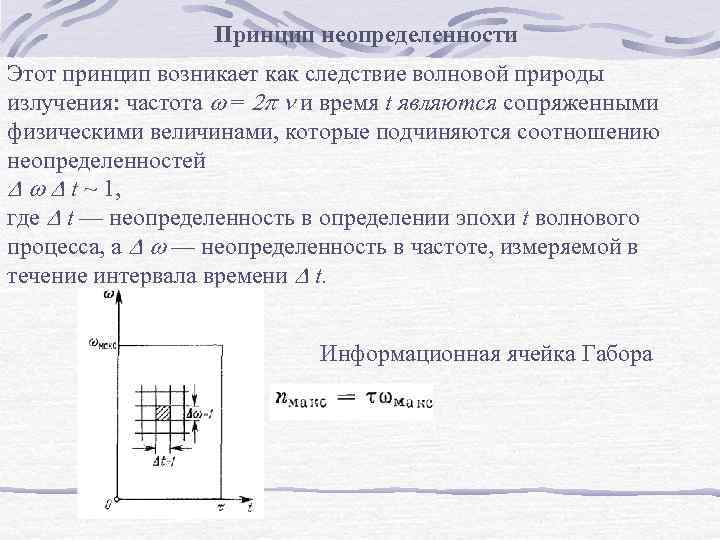

Принцип неопределенности Этот принцип возникает как следствие волновой природы излучения: частота w = 2 n и время t являются сопряженными физическими величинами, которые подчиняются соотношению неопределенностей D w D t ~ 1, где D t — неопределенность в определении эпохи t волнового процесса, а D w — неопределенность в частоте, измеряемой в течение интервала времени D t. Информационная ячейка Габора

Принцип неопределенности Этот принцип возникает как следствие волновой природы излучения: частота w = 2 n и время t являются сопряженными физическими величинами, которые подчиняются соотношению неопределенностей D w D t ~ 1, где D t — неопределенность в определении эпохи t волнового процесса, а D w — неопределенность в частоте, измеряемой в течение интервала времени D t. Информационная ячейка Габора

Если объект является нестационарным, т. е. изменяющимся во времени или перемещающимся, то необходимо рассмотреть также временные параметры оптической системы, связанные со свойствами света. Идеально монохроматические сигналы в природе не реализуются, поскольку энергия, связанная c монохроматической волной равна нулю. Конечная величина электромагнитной энергии переносится только квазимонохроматическими волнами с ∆w/ w 1, где ∆ w ширина спектра, w - центральная частота. Согласно теореме Котельникова такой сигнал имеет Nt = 2(1 + Δ w Δτ) степеней свободы в интервале частот Δ w за время наблюдения ∆τ. Для монохроматического Nt = 2 – фаза и амплитуда сигнала

Если объект является нестационарным, т. е. изменяющимся во времени или перемещающимся, то необходимо рассмотреть также временные параметры оптической системы, связанные со свойствами света. Идеально монохроматические сигналы в природе не реализуются, поскольку энергия, связанная c монохроматической волной равна нулю. Конечная величина электромагнитной энергии переносится только квазимонохроматическими волнами с ∆w/ w 1, где ∆ w ширина спектра, w - центральная частота. Согласно теореме Котельникова такой сигнал имеет Nt = 2(1 + Δ w Δτ) степеней свободы в интервале частот Δ w за время наблюдения ∆τ. Для монохроматического Nt = 2 – фаза и амплитуда сигнала

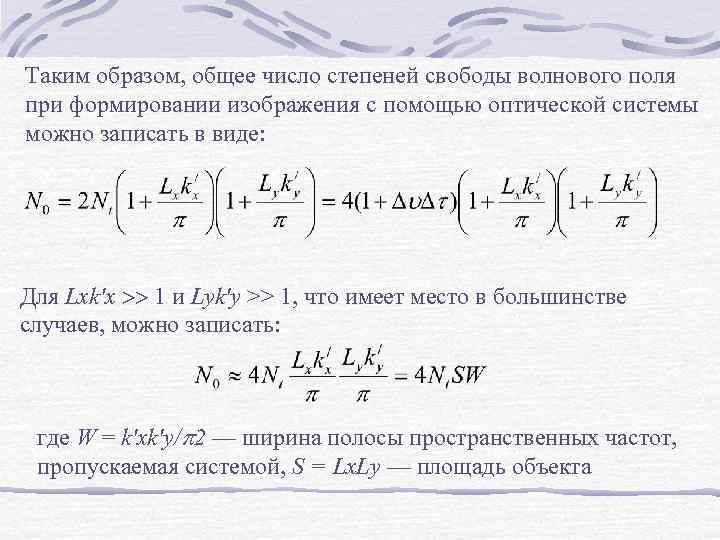

Таким образом, общее число степеней свободы волнового поля при формировании изображения с помощью оптической системы можно записать в виде: Для Lxk'x 1 и Lyk'y >> 1, что имеет место в большинстве случаев, можно записать: где W = k'хk'у/ 2 — ширина полосы пространственных частот, пропускаемая системой, S = Lx. Ly — площадь объекта

Таким образом, общее число степеней свободы волнового поля при формировании изображения с помощью оптической системы можно записать в виде: Для Lxk'x 1 и Lyk'y >> 1, что имеет место в большинстве случаев, можно записать: где W = k'хk'у/ 2 — ширина полосы пространственных частот, пропускаемая системой, S = Lx. Ly — площадь объекта

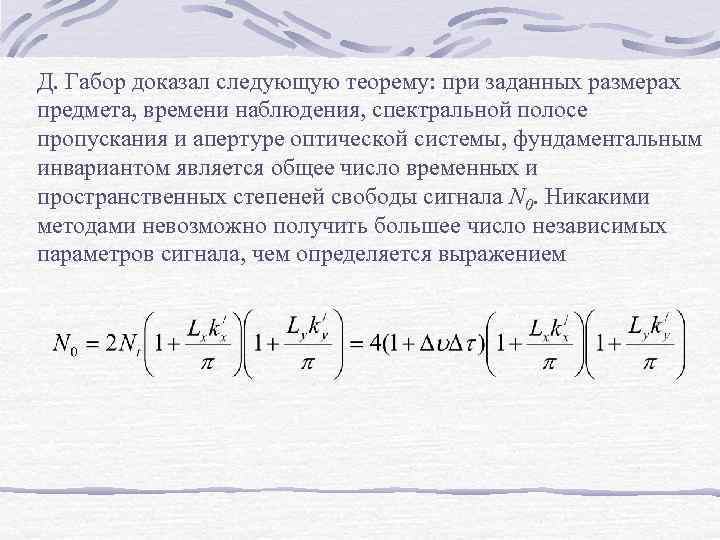

Д. Габор доказал следующую теорему: при заданных размерах предмета, времени наблюдения, спектральной полосе пропускания и апертуре оптической системы, фундаментальным инвариантом является общее число временных и пространственных степеней свободы сигнала N 0. Никакими методами невозможно получить большее число независимых параметров сигнала, чем определяется выражением

Д. Габор доказал следующую теорему: при заданных размерах предмета, времени наблюдения, спектральной полосе пропускания и апертуре оптической системы, фундаментальным инвариантом является общее число временных и пространственных степеней свободы сигнала N 0. Никакими методами невозможно получить большее число независимых параметров сигнала, чем определяется выражением

Теорема 1. Фундаментальным инвариантом информационной емкости оптической системы является число N полных степеней свободы оптического поля — пространственных, временных и поляризационных. Никакими методами невозможно получить большую информацию, чем та, которая определяется полным числом информационных степеней свободы. Теорема 2. В пределах полного числа информационных степеней свободы можно взаимно менять соотношения между пространственными, временными и поляризационными степенями свободы, сохраняя при этом полное число N. Как следствие теоремы 2 можно: — увеличивать число пространственных степеней свободы и таким образом повышать пространственную разрешающую способность за счет уменьшения числа временных степеней свободы; — увеличивать разрешающую способность по предмету при одновременном пропорциональном уменьшении поля предмета; — получать пространственное разрешение, используя только временные степени свободы; — увеличивать разрешение в направлении х при соответствующем пропорциональном ухудшении разрешения в направлении у; — повышать разрешение вдвое путем передачи информации только в одном состоянии поляризации. Эти методы целенаправленного перераспределения информационных степеней свободы еще не получили широкого распространения, но имеют большое значение для когерентных оптических систем и голографических устройств.

Теорема 1. Фундаментальным инвариантом информационной емкости оптической системы является число N полных степеней свободы оптического поля — пространственных, временных и поляризационных. Никакими методами невозможно получить большую информацию, чем та, которая определяется полным числом информационных степеней свободы. Теорема 2. В пределах полного числа информационных степеней свободы можно взаимно менять соотношения между пространственными, временными и поляризационными степенями свободы, сохраняя при этом полное число N. Как следствие теоремы 2 можно: — увеличивать число пространственных степеней свободы и таким образом повышать пространственную разрешающую способность за счет уменьшения числа временных степеней свободы; — увеличивать разрешающую способность по предмету при одновременном пропорциональном уменьшении поля предмета; — получать пространственное разрешение, используя только временные степени свободы; — увеличивать разрешение в направлении х при соответствующем пропорциональном ухудшении разрешения в направлении у; — повышать разрешение вдвое путем передачи информации только в одном состоянии поляризации. Эти методы целенаправленного перераспределения информационных степеней свободы еще не получили широкого распространения, но имеют большое значение для когерентных оптических систем и голографических устройств.

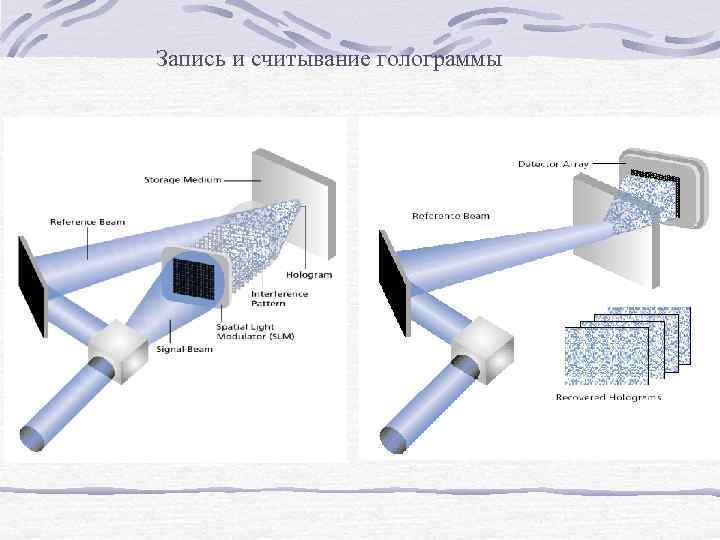

Запись и считывание голограммы

Запись и считывание голограммы

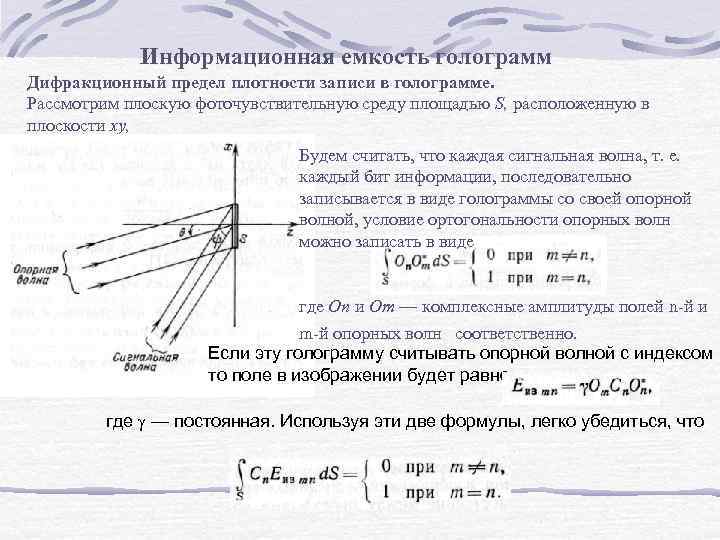

Информационная емкость голограмм Дифракционный предел плотности записи в голограмме. Рассмотрим плоскую фоточувствительную среду площадью S, расположенную в плоскости ху, Будем считать, что каждая сигнальная волна, т. е. каждый бит информации, последовательно записывается в виде голограммы со своей опорной волной, условие ортогональности опорных волн можно записать в виде где On и От — комплексные амплитуды полей n й и m й опорных волн соответственно. Если эту голограмму считывать опорной волной с индексом т то поле в изображении будет равно где g — постоянная. Используя эти две формулы, легко убедиться, что

Информационная емкость голограмм Дифракционный предел плотности записи в голограмме. Рассмотрим плоскую фоточувствительную среду площадью S, расположенную в плоскости ху, Будем считать, что каждая сигнальная волна, т. е. каждый бит информации, последовательно записывается в виде голограммы со своей опорной волной, условие ортогональности опорных волн можно записать в виде где On и От — комплексные амплитуды полей n й и m й опорных волн соответственно. Если эту голограмму считывать опорной волной с индексом т то поле в изображении будет равно где g — постоянная. Используя эти две формулы, легко убедиться, что

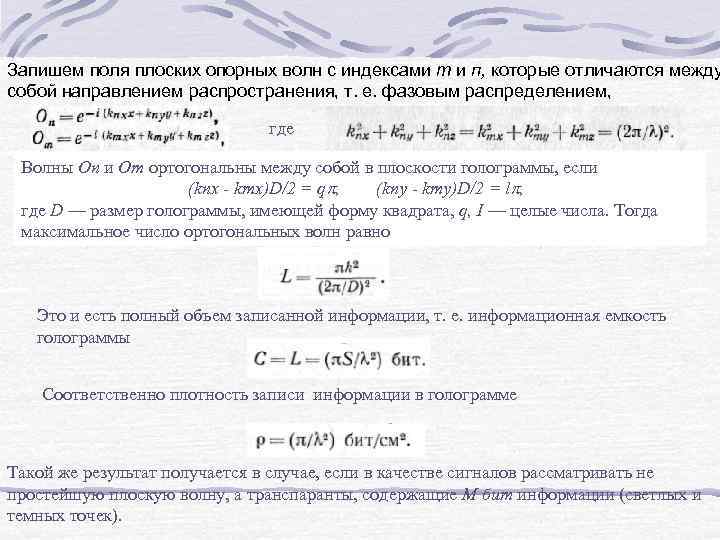

Запишем поля плоских опорных волн с индексами т и п, которые отличаются между собой направлением распространения, т. е. фазовым распределением, где Волны On и От ортогональны между собой в плоскости голограммы, если (knx - kmx)D/2 = q , (kny - kmy)D/2 = l , где D — размер голограммы, имеющей форму квадрата, q, I — целые числа. Тогда максимальное число ортогональных волн равно Это и есть полный объем записанной информации, т. е. информационная емкость голограммы Соответственно плотность записи информации в голограмме Такой же результат получается в случае, если в качестве сигналов рассматривать не простейшую плоскую волну, а транспаранты, содержащие М бит информации (светлых и темных точек).

Запишем поля плоских опорных волн с индексами т и п, которые отличаются между собой направлением распространения, т. е. фазовым распределением, где Волны On и От ортогональны между собой в плоскости голограммы, если (knx - kmx)D/2 = q , (kny - kmy)D/2 = l , где D — размер голограммы, имеющей форму квадрата, q, I — целые числа. Тогда максимальное число ортогональных волн равно Это и есть полный объем записанной информации, т. е. информационная емкость голограммы Соответственно плотность записи информации в голограмме Такой же результат получается в случае, если в качестве сигналов рассматривать не простейшую плоскую волну, а транспаранты, содержащие М бит информации (светлых и темных точек).

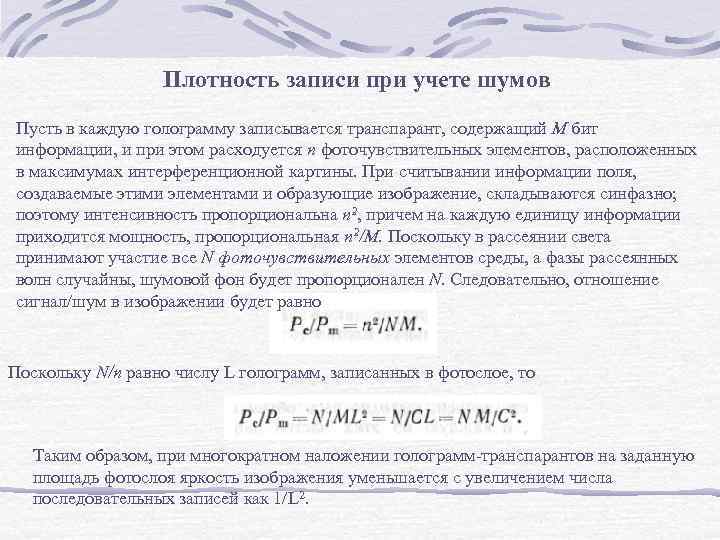

Плотность записи при учете шумов Пусть в каждую голограмму записывается транспарант, содержащий М бит информации, и при этом расходуется п фоточувствительных элементов, расположенных в максимумах интерференционной картины. При считывании информации поля, создаваемые этими элементами и образующие изображение, складываются синфазно; поэтому интенсивность пропорциональна п 2, причем на каждую единицу информации приходится мощность, пропорциональная п 2/М. Поскольку в рассеянии света принимают участие все N фоточувствительных элементов среды, а фазы рассеянных волн случайны, шумовой фон будет пропорционален N. Следовательно, отношение сигнал/шум в изображении будет равно Поскольку N/n равно числу L голограмм, записанных в фотослое, то Таким образом, при многократном наложении голограмм транспарантов на заданную площадь фотослоя яркость изображения уменьшается с увеличением числа последовательных записей как 1/L 2.

Плотность записи при учете шумов Пусть в каждую голограмму записывается транспарант, содержащий М бит информации, и при этом расходуется п фоточувствительных элементов, расположенных в максимумах интерференционной картины. При считывании информации поля, создаваемые этими элементами и образующие изображение, складываются синфазно; поэтому интенсивность пропорциональна п 2, причем на каждую единицу информации приходится мощность, пропорциональная п 2/М. Поскольку в рассеянии света принимают участие все N фоточувствительных элементов среды, а фазы рассеянных волн случайны, шумовой фон будет пропорционален N. Следовательно, отношение сигнал/шум в изображении будет равно Поскольку N/n равно числу L голограмм, записанных в фотослое, то Таким образом, при многократном наложении голограмм транспарантов на заданную площадь фотослоя яркость изображения уменьшается с увеличением числа последовательных записей как 1/L 2.

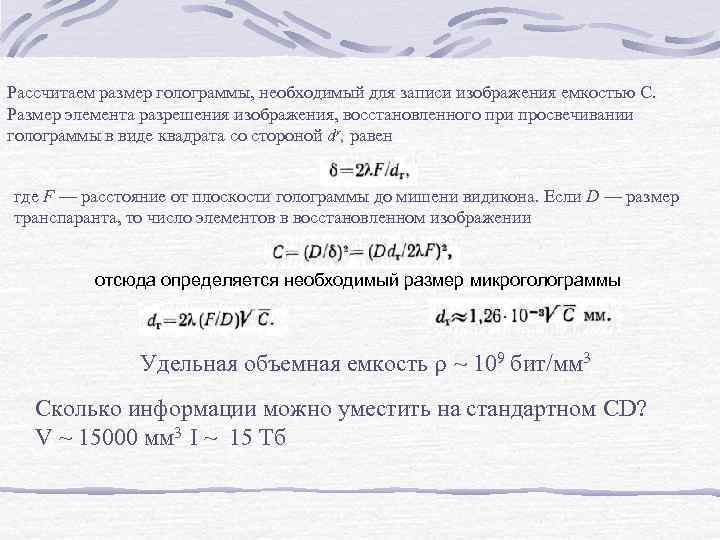

Рассчитаем размер голограммы, необходимый для записи изображения емкостью С. Размер элемента разрешения изображения, восстановленного при просвечивании голограммы в виде квадрата со стороной dr, равен где F — расстояние от плоскости голограммы до мишени видикона. Если D — размер транспаранта, то число элементов в восстановленном изображении отсюда определяется необходимый размер микроголограммы Удельная объемная емкость r ~ 109 бит/мм 3 Сколько информации можно уместить на стандартном CD? V ~ 15000 мм 3 I ~ 15 Тб

Рассчитаем размер голограммы, необходимый для записи изображения емкостью С. Размер элемента разрешения изображения, восстановленного при просвечивании голограммы в виде квадрата со стороной dr, равен где F — расстояние от плоскости голограммы до мишени видикона. Если D — размер транспаранта, то число элементов в восстановленном изображении отсюда определяется необходимый размер микроголограммы Удельная объемная емкость r ~ 109 бит/мм 3 Сколько информации можно уместить на стандартном CD? V ~ 15000 мм 3 I ~ 15 Тб

Голографическое устройство записи и считывания информации In. Phase Technologies

Голографическое устройство записи и считывания информации In. Phase Technologies

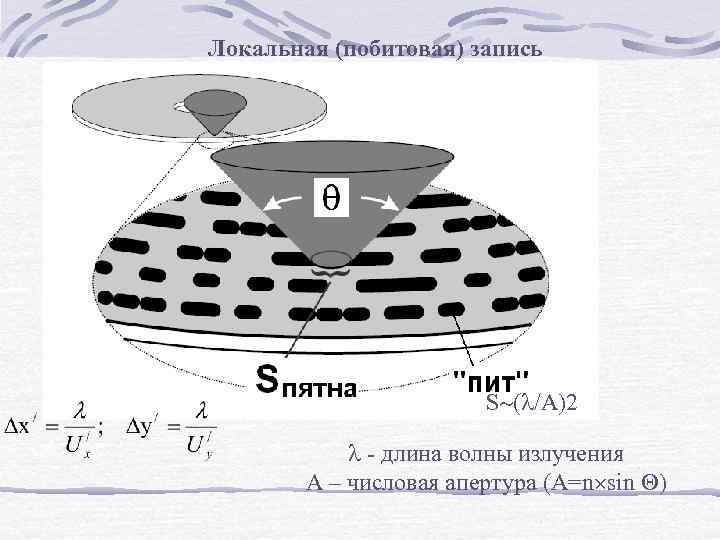

Локальная (побитовая) запись S ( /А)2 длина волны излучения А – числовая апертура (A=n sin )

Локальная (побитовая) запись S ( /А)2 длина волны излучения А – числовая апертура (A=n sin )

Лазерный видеодиск и CD диск

Лазерный видеодиск и CD диск

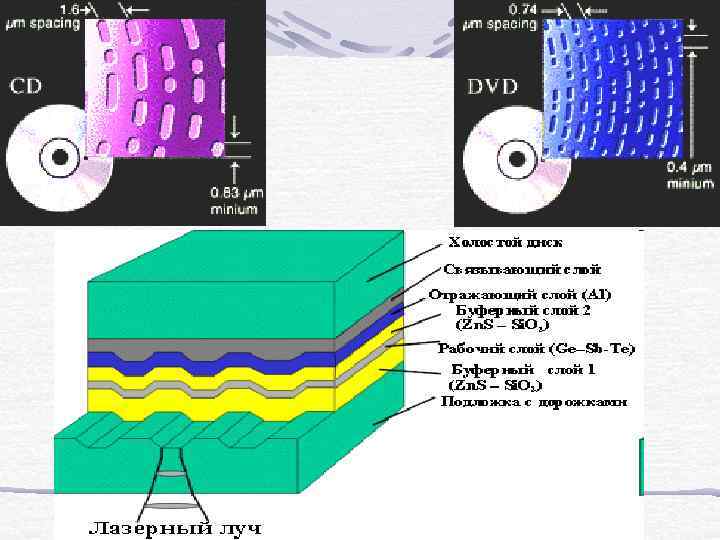

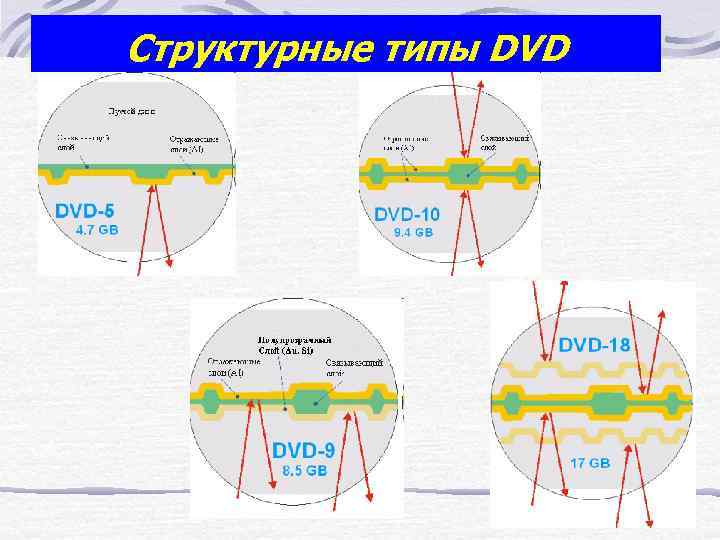

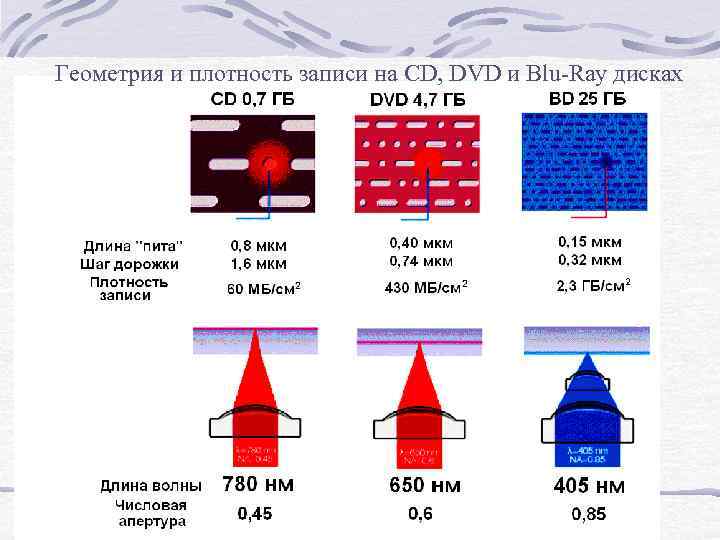

Сравнительный анализ CD и DVD Параметр CD DVD Комментарии Диаметр, см 12 12 Иногда используют диски диаметром 8 см Физическая толщина диска, мм 1, 2 Число информационных сторон 1 1 или 2 1, 2 0, 6 1 1 или 2 Пока распространены только однослойные диски Емкость диска, Гбайт 0, 68 4, 7 -17 1 гигабайт = 109 байт Минимальная длина пита, мкм Ширина пита, мкм 0, 83 0, 5 0, 4 / 0, 44 0, 5 Для однослойного - 0, 4, для двухслойного - 0. 44 Шаг спирали (питов), мкм 1, 6 0, 74 Длина волны лазера, нм 780 635/650 Апертура линзы 0, 45 0, 6 Схема модуляции данных EFM 8 в 16 Схема коррекции ошибок CIRC RS-PC Толщина стороны, мм Число информационных слоев на одной стороне 635 - для коммерческих DVD-Video (for Authoring) EFM - Eight to Fourteen Modulation CIRC - Cross Interleaved Reed-Solomon Code, RSPC - Reed Solomon Product Code

Сравнительный анализ CD и DVD Параметр CD DVD Комментарии Диаметр, см 12 12 Иногда используют диски диаметром 8 см Физическая толщина диска, мм 1, 2 Число информационных сторон 1 1 или 2 1, 2 0, 6 1 1 или 2 Пока распространены только однослойные диски Емкость диска, Гбайт 0, 68 4, 7 -17 1 гигабайт = 109 байт Минимальная длина пита, мкм Ширина пита, мкм 0, 83 0, 5 0, 4 / 0, 44 0, 5 Для однослойного - 0, 4, для двухслойного - 0. 44 Шаг спирали (питов), мкм 1, 6 0, 74 Длина волны лазера, нм 780 635/650 Апертура линзы 0, 45 0, 6 Схема модуляции данных EFM 8 в 16 Схема коррекции ошибок CIRC RS-PC Толщина стороны, мм Число информационных слоев на одной стороне 635 - для коммерческих DVD-Video (for Authoring) EFM - Eight to Fourteen Modulation CIRC - Cross Interleaved Reed-Solomon Code, RSPC - Reed Solomon Product Code

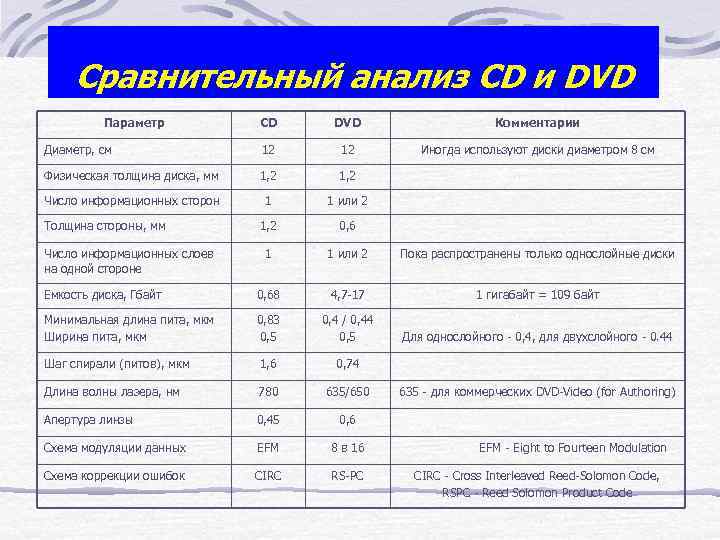

Структура DVD-дисков

Структура DVD-дисков

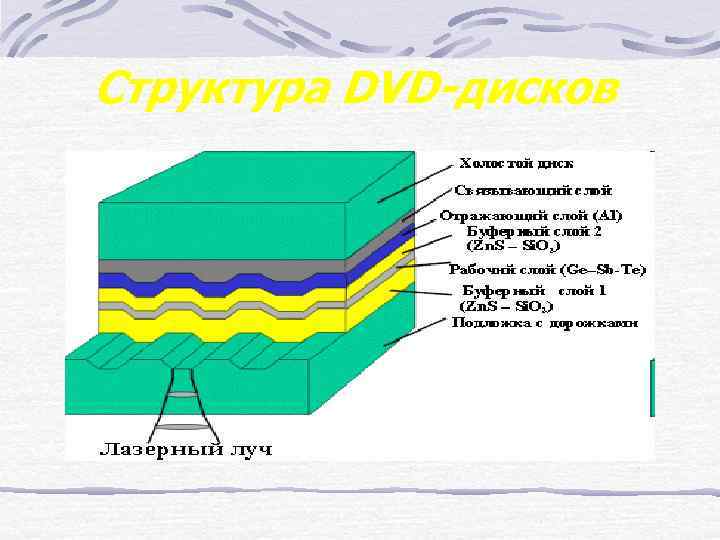

Структурные типы DVD

Структурные типы DVD

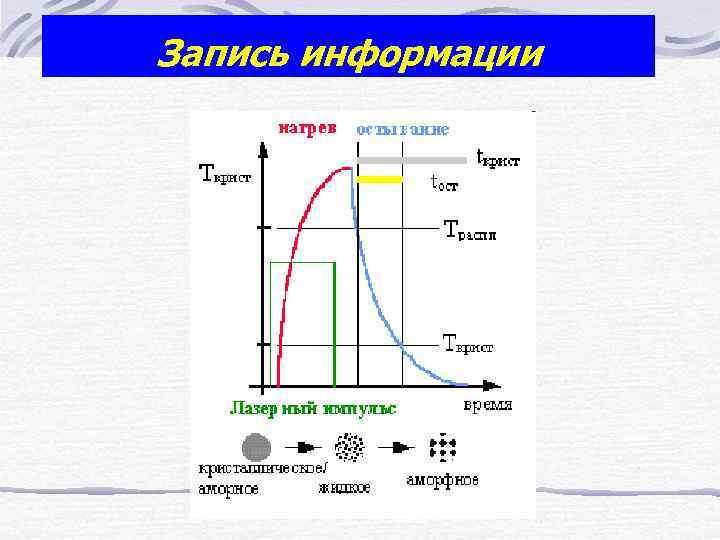

Запись информации

Запись информации

Стирание данных

Стирание данных

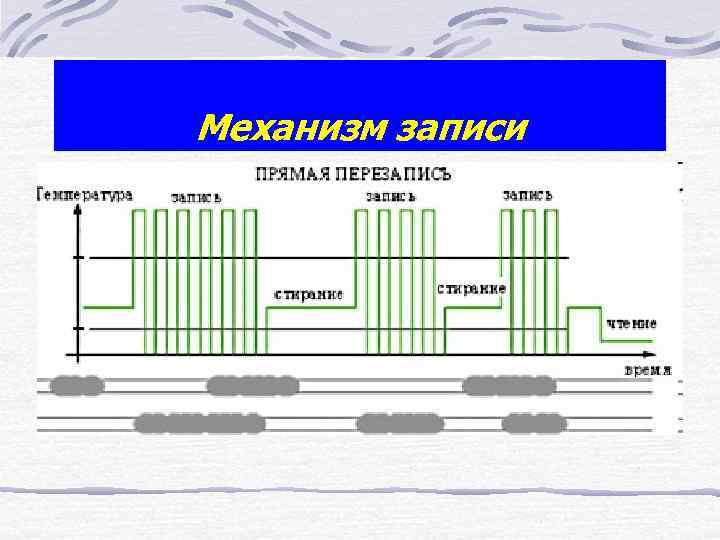

Механизм записи

Механизм записи

Геометрия и плотность записи на CD, DVD и Blu Ray дисках

Геометрия и плотность записи на CD, DVD и Blu Ray дисках

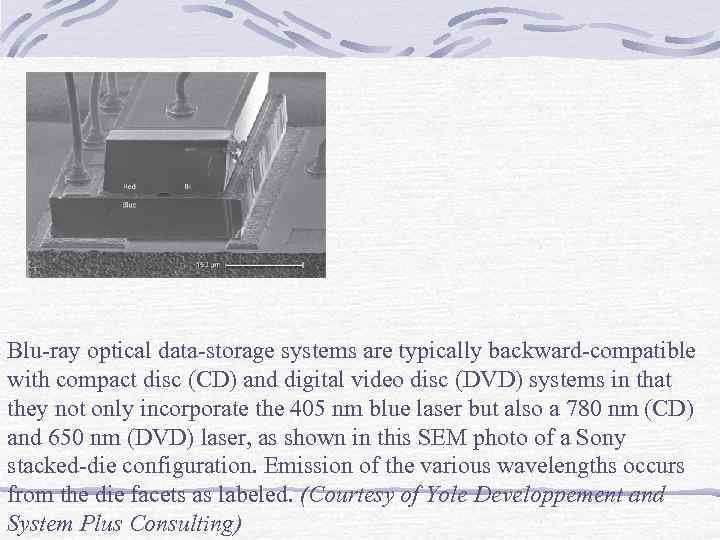

Blu ray optical data storage systems are typically backward compatible with compact disc (CD) and digital video disc (DVD) systems in that they not only incorporate the 405 nm blue laser but also a 780 nm (CD) and 650 nm (DVD) laser, as shown in this SEM photo of a Sony stacked die configuration. Emission of the various wavelengths occurs from the die facets as labeled. (Courtesy of Yole Developpement and System Plus Consulting)

Blu ray optical data storage systems are typically backward compatible with compact disc (CD) and digital video disc (DVD) systems in that they not only incorporate the 405 nm blue laser but also a 780 nm (CD) and 650 nm (DVD) laser, as shown in this SEM photo of a Sony stacked die configuration. Emission of the various wavelengths occurs from the die facets as labeled. (Courtesy of Yole Developpement and System Plus Consulting)

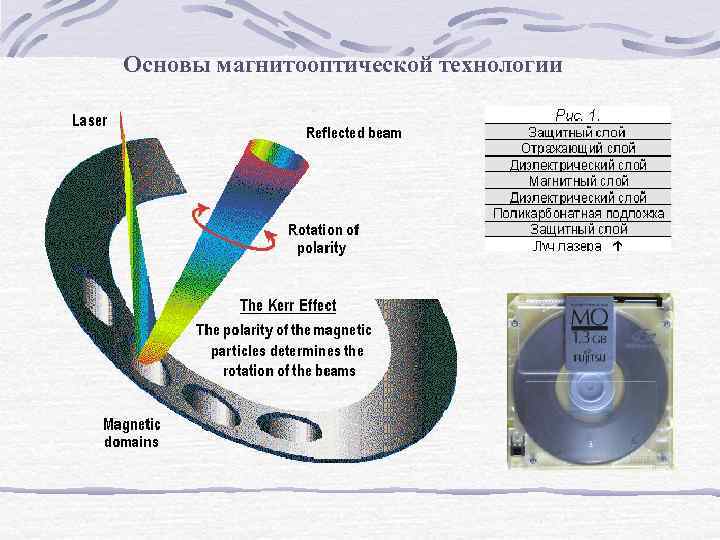

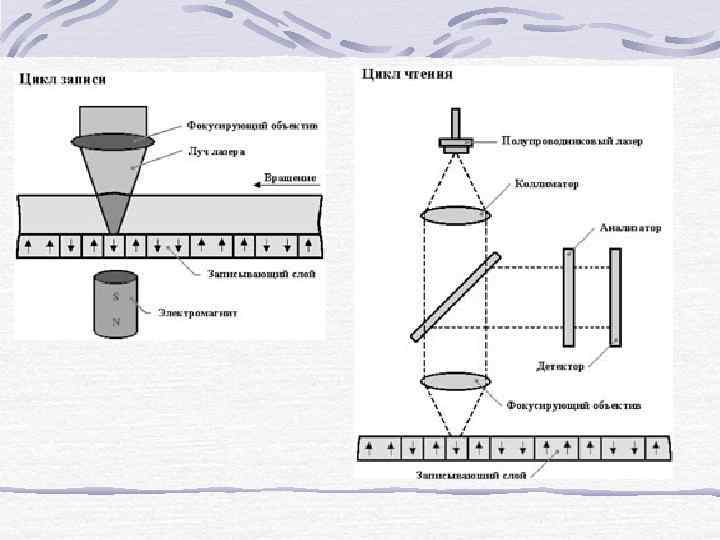

Основы магнитооптической технологии

Основы магнитооптической технологии

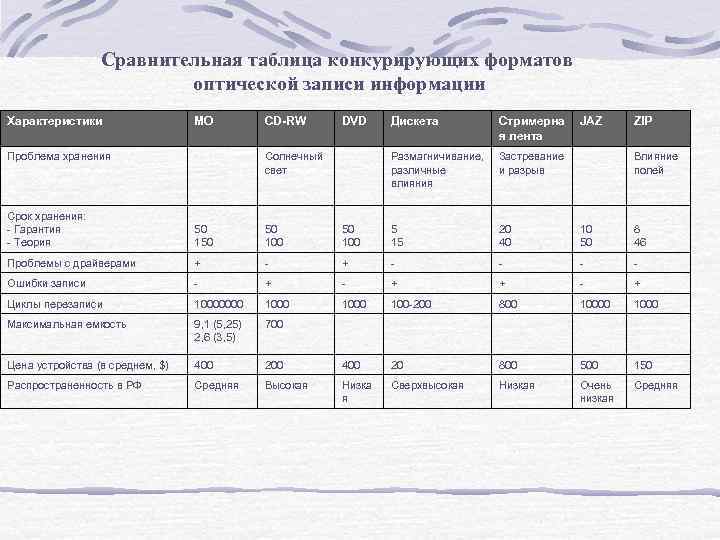

Сравнительная таблица конкурирующих форматов оптической записи информации Характеристики МО Проблема хранения CD-RW DVD Стримерна я лента Размагничивание, различные влияния Солнечный свет Дискета JAZ Застревание и разрыв ZIP Влияние полей Срок хранения: - Гарантия - Теория 50 150 50 100 5 15 20 40 10 50 8 46 Проблемы с драйверами + - - - - Ошибки записи - + + - + Циклы перезаписи 10000000 1000 100 -200 800 1000 Максимальная емкость 9, 1 (5, 25) 2, 6 (3, 5) 700 Цена устройства (в среднем, $) 400 200 400 20 800 500 150 Распространенность в РФ Средняя Высокая Низка я Сверхвысокая Низкая Очень низкая Средняя

Сравнительная таблица конкурирующих форматов оптической записи информации Характеристики МО Проблема хранения CD-RW DVD Стримерна я лента Размагничивание, различные влияния Солнечный свет Дискета JAZ Застревание и разрыв ZIP Влияние полей Срок хранения: - Гарантия - Теория 50 150 50 100 5 15 20 40 10 50 8 46 Проблемы с драйверами + - - - - Ошибки записи - + + - + Циклы перезаписи 10000000 1000 100 -200 800 1000 Максимальная емкость 9, 1 (5, 25) 2, 6 (3, 5) 700 Цена устройства (в среднем, $) 400 200 400 20 800 500 150 Распространенность в РФ Средняя Высокая Низка я Сверхвысокая Низкая Очень низкая Средняя

Литература Шеннон К. Э. Работы по теории информации и кибернетике. М. : Ил. , 1963 – 829 с. Хартли Р. Передача информации// Теория информации и ее приложения. М. : Физматгиз. 1959. – С. 5 -35. Винер Н. Кибернетика или управление и связь в животном мире и машине. М. : Наука, 1983 – 340 с. Брюллюэн Л. Наука и теория информации. М. : Физматгиз, 1960 – 392 с. Яглом А. М. , Яглом И. М. Вероятность и информация. М. : Наука, 1973 – 512 с.

Литература Шеннон К. Э. Работы по теории информации и кибернетике. М. : Ил. , 1963 – 829 с. Хартли Р. Передача информации// Теория информации и ее приложения. М. : Физматгиз. 1959. – С. 5 -35. Винер Н. Кибернетика или управление и связь в животном мире и машине. М. : Наука, 1983 – 340 с. Брюллюэн Л. Наука и теория информации. М. : Физматгиз, 1960 – 392 с. Яглом А. М. , Яглом И. М. Вероятность и информация. М. : Наука, 1973 – 512 с.

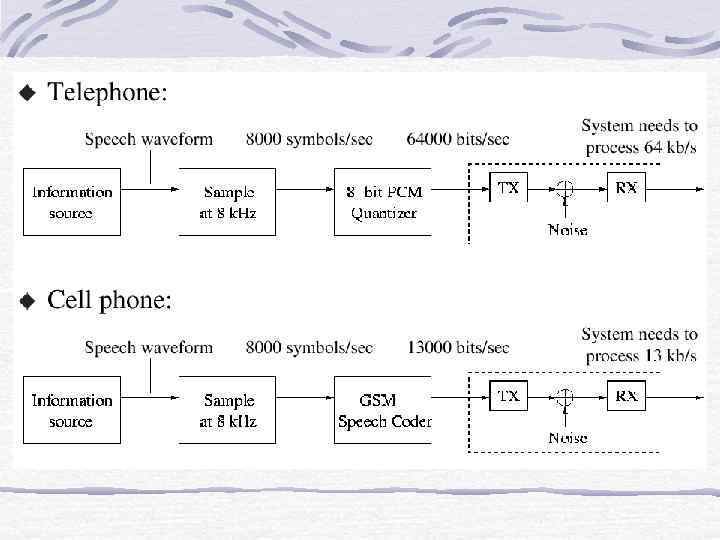

Контрольные вопросы. 1. Обобщенная схема информационной системы. 2. Количество информации в системе равновероятных событий. Подход Р. Хартли к измерению информации. 3. Свойства меры Хартли, единицы измерений. 4. Количество информации в системе событий с различными вероятностями. Подход Шеннона. 5. Количество информации на выходе реальных информационных систем. Понятие об энтропии. 6. Задача оптимального кодирования. Как в четырехсимвольном алфавите организовать передачу с минимальной энтропией. 7. Разница между обычным телефоном и телефоном GSM. 8. Принципы кодирования. 9. Емкость информационного канала при наличии шума.

Контрольные вопросы. 1. Обобщенная схема информационной системы. 2. Количество информации в системе равновероятных событий. Подход Р. Хартли к измерению информации. 3. Свойства меры Хартли, единицы измерений. 4. Количество информации в системе событий с различными вероятностями. Подход Шеннона. 5. Количество информации на выходе реальных информационных систем. Понятие об энтропии. 6. Задача оптимального кодирования. Как в четырехсимвольном алфавите организовать передачу с минимальной энтропией. 7. Разница между обычным телефоном и телефоном GSM. 8. Принципы кодирования. 9. Емкость информационного канала при наличии шума.