ЯиМП_Лекция 23_Паралл_вычисл_Введение.ppt

- Количество слайдов: 52

Лекция 23 Параллельное программирование. Введение. Языки и методы программирования доцент М. А. Сокольская

Лекция 23 Параллельное программирование. Введение. Языки и методы программирования доцент М. А. Сокольская

План. 1. 2. 3. 4. 5. 6. Что такое суперкомпьютер? Понятие параллельных вычислений (ПВ) Необходимость параллельных вычислений Сдерживающие факторы развития ПВ Пути достижения параллелизма Примеры параллельных вычислительных систем – – 7. Классификация многопроцессорных вычислительных систем – 2 Суперкомпьютеры Кластеры – Мультипроцессоры Мультикомпьютеры

План. 1. 2. 3. 4. 5. 6. Что такое суперкомпьютер? Понятие параллельных вычислений (ПВ) Необходимость параллельных вычислений Сдерживающие факторы развития ПВ Пути достижения параллелизма Примеры параллельных вычислительных систем – – 7. Классификация многопроцессорных вычислительных систем – 2 Суперкомпьютеры Кластеры – Мультипроцессоры Мультикомпьютеры

Литература 1. 2. 3. 4. 3 Гергель В. П. Теория и практика параллельных вычислений. - М. : Интернет-Университет, БИНОМ. Лаборатория знаний, 2007. Богачев К. Ю. Основы параллельного программирования. - М. : БИНОМ. Лаборатория знаний, 2003. Воеводин В. В. , Воеводин Вл. В. Параллельные вычисления. - СПб. : БХВ-Петербург, 2002. Немнюгин С. , Стесик О. Параллельное программирование для многопроцессорных вычислительных систем — СПб. : БХВ-Петербург, 2002.

Литература 1. 2. 3. 4. 3 Гергель В. П. Теория и практика параллельных вычислений. - М. : Интернет-Университет, БИНОМ. Лаборатория знаний, 2007. Богачев К. Ю. Основы параллельного программирования. - М. : БИНОМ. Лаборатория знаний, 2003. Воеводин В. В. , Воеводин Вл. В. Параллельные вычисления. - СПб. : БХВ-Петербург, 2002. Немнюгин С. , Стесик О. Параллельное программирование для многопроцессорных вычислительных систем — СПб. : БХВ-Петербург, 2002.

Что такое суперкомпьютер? Изначально: суперкомпьютер - это "сверхмашина", намного более производительная, чем любая из доступных рядовому пользователю. Самый большой, самый дорогой, самый быстрый, самый мощный, производительность его на настоящий момент максимальна. 4

Что такое суперкомпьютер? Изначально: суперкомпьютер - это "сверхмашина", намного более производительная, чем любая из доступных рядовому пользователю. Самый большой, самый дорогой, самый быстрый, самый мощный, производительность его на настоящий момент максимальна. 4

Что такое суперкомпьютер? 5 В настоящее время: Суперкомпьютер – это вычислительная система, обладающая предельными характеристиками по производительности среди имеющихся в каждый конкретный момент времени компьютерных систем. Предельные характеристики имеют разброс от 50 Tflops до 11 Pflops (данные последнего исследования).

Что такое суперкомпьютер? 5 В настоящее время: Суперкомпьютер – это вычислительная система, обладающая предельными характеристиками по производительности среди имеющихся в каждый конкретный момент времени компьютерных систем. Предельные характеристики имеют разброс от 50 Tflops до 11 Pflops (данные последнего исследования).

Суперкомпьютер Ломоносов, МГУ 6

Суперкомпьютер Ломоносов, МГУ 6

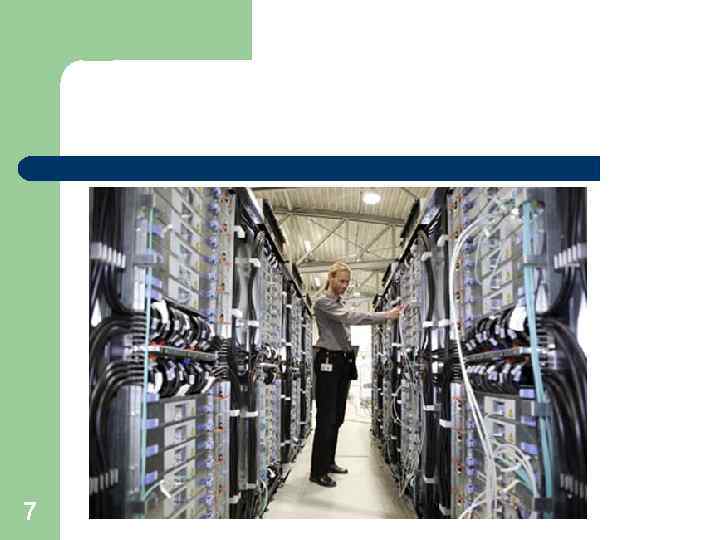

7

7

MVS – 100 МГУ 8 Скиф, МГУ

MVS – 100 МГУ 8 Скиф, МГУ

Суперкомпьютер внутри Блок процессоров Стойки СКИФа изнутри 9 Процессорный элемент

Суперкомпьютер внутри Блок процессоров Стойки СКИФа изнутри 9 Процессорный элемент

Для чего нужны суперкомпьютеры? 10 Суперкомпьютеры применяются в: - стратегических исследованиях (управляемый термоядерный синтез, моделирование взрывов и ядерных испытаний, разработка военной и авиакосмической техники, системы ПВО) - Биологии (моделирование микроструктур), медицине (использование суперкомпьютера и мед. аппаратуры) - Нанотехнологиях - Астрономии (моделирование поведения звезд, рождения звезд) - авиастроении - Космологии (моделирование структуры галактики)

Для чего нужны суперкомпьютеры? 10 Суперкомпьютеры применяются в: - стратегических исследованиях (управляемый термоядерный синтез, моделирование взрывов и ядерных испытаний, разработка военной и авиакосмической техники, системы ПВО) - Биологии (моделирование микроструктур), медицине (использование суперкомпьютера и мед. аппаратуры) - Нанотехнологиях - Астрономии (моделирование поведения звезд, рождения звезд) - авиастроении - Космологии (моделирование структуры галактики)

Биология Рибосома Мембранные рецепторы клетки 11

Биология Рибосома Мембранные рецепторы клетки 11

Медицина Диагностика остеопороза на ранней стадии 12

Медицина Диагностика остеопороза на ранней стадии 12

Нанотехнологии Ткань, отталкивающая любую жидкость 13

Нанотехнологии Ткань, отталкивающая любую жидкость 13

Астрономия Сверхновая перед взрывом Модель солнечного пятна 14 Рождение двойной звезды

Астрономия Сверхновая перед взрывом Модель солнечного пятна 14 Рождение двойной звезды

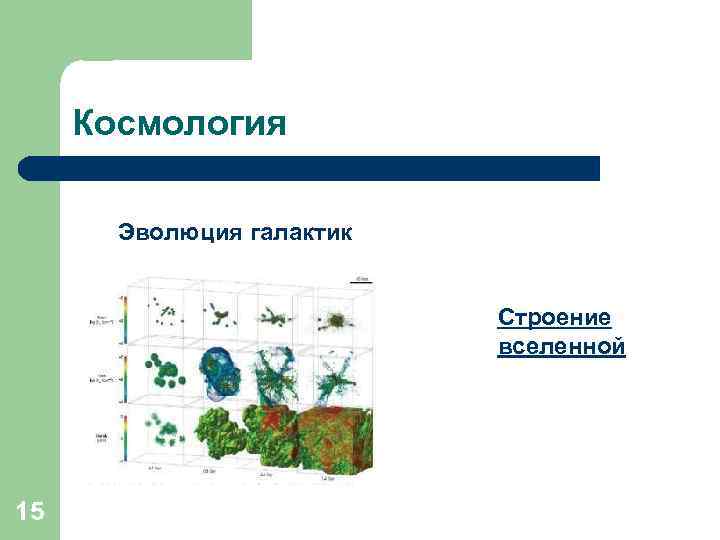

Космология Эволюция галактик Строение вселенной 15

Космология Эволюция галактик Строение вселенной 15

Математическое моделирование 16

Математическое моделирование 16

Для решения перечисленных задач суперкомпьютеры используют параллельные вычисления. 17

Для решения перечисленных задач суперкомпьютеры используют параллельные вычисления. 17

Понятие параллельных вычислений Под параллельными вычислениями понимаются процессы обработки данных, в которых одновременно могут выполняться несколько операций компьютерной системы 18

Понятие параллельных вычислений Под параллельными вычислениями понимаются процессы обработки данных, в которых одновременно могут выполняться несколько операций компьютерной системы 18

Понятие параллельных вычислений l l l 19 Параллельные вычисления не сводятся к использованию только многопроцессорных вычислительных систем Одновременные выполняемые операции должны быть направлены на решение общей задачи Параллельные вычисления следует отличать от многозадачных (многопрограммных) режимов работы последовательных ЭВМ

Понятие параллельных вычислений l l l 19 Параллельные вычисления не сводятся к использованию только многопроцессорных вычислительных систем Одновременные выполняемые операции должны быть направлены на решение общей задачи Параллельные вычисления следует отличать от многозадачных (многопрограммных) режимов работы последовательных ЭВМ

Почему нужны параллельные вычисления… l Опережение потребности в вычислениях быстродействия существующих компьютерных систем Оценка необходимой производительности – 1018 операций над вещественными числами в секунду (1 Eflops) – 1 квинтиллион операций в секунду. Возможно, экзафлоп будет достигнут к 2018 -2020 гг. l 20

Почему нужны параллельные вычисления… l Опережение потребности в вычислениях быстродействия существующих компьютерных систем Оценка необходимой производительности – 1018 операций над вещественными числами в секунду (1 Eflops) – 1 квинтиллион операций в секунду. Возможно, экзафлоп будет достигнут к 2018 -2020 гг. l 20

Почему нужны параллельные вычисления… l l Теоретическая ограниченность роста производительности последовательных компьютеров Резкое снижение стоимости многопроцессорных (параллельных) вычислительных систем – – l 21 1 Cray T 90 processor – 1. 8 GFlops ($2 500 000), 8 Node IBM SP 2 using R 6000 - 2. 1 GFlops ($500 000) Смена парадигмы высокопроизводительных многоядерность построения процессоров -

Почему нужны параллельные вычисления… l l Теоретическая ограниченность роста производительности последовательных компьютеров Резкое снижение стоимости многопроцессорных (параллельных) вычислительных систем – – l 21 1 Cray T 90 processor – 1. 8 GFlops ($2 500 000), 8 Node IBM SP 2 using R 6000 - 2. 1 GFlops ($500 000) Смена парадигмы высокопроизводительных многоядерность построения процессоров -

Сдерживающие факторы… l l 22 высокая стоимость параллельных систем – в соответствии с законом Гроша (Grosch), производительность компьютера возрастает пропорционально квадрату его стоимости ? ! потери производительности для организации параллелизма – согласно гипотезе Минского (Minsky), ускорение, достигаемое при использовании параллельной системы, пропорционально двоичному логарифму от числа процессоров

Сдерживающие факторы… l l 22 высокая стоимость параллельных систем – в соответствии с законом Гроша (Grosch), производительность компьютера возрастает пропорционально квадрату его стоимости ? ! потери производительности для организации параллелизма – согласно гипотезе Минского (Minsky), ускорение, достигаемое при использовании параллельной системы, пропорционально двоичному логарифму от числа процессоров

Сдерживающие факторы… l l 23 постоянное совершенствование последовательных компьютеров – в соответствии с законом Мура (Moore) мощность последовательных процессоров возрастает практически в два раза каждые 18 месяцев ? ! существование последовательных вычислений – в соответствии с законом Амдаля (Amdahl) ускорение процесса вычислений при использовании p процессоров ограничивается величиной S 1/(f+(1–f)/p) 1/f, где f есть доля последовательных вычислений в применяемом алгоритме обработки данных ? !

Сдерживающие факторы… l l 23 постоянное совершенствование последовательных компьютеров – в соответствии с законом Мура (Moore) мощность последовательных процессоров возрастает практически в два раза каждые 18 месяцев ? ! существование последовательных вычислений – в соответствии с законом Амдаля (Amdahl) ускорение процесса вычислений при использовании p процессоров ограничивается величиной S 1/(f+(1–f)/p) 1/f, где f есть доля последовательных вычислений в применяемом алгоритме обработки данных ? !

Сдерживающие факторы… • • 24 зависимость эффективности параллелизма от учета характерных свойств параллельных систем (отсутствие мобильности для параллельных программ) ? ! существующее программное обеспечение ориентировано в основном на последовательные ЭВМ ? !

Сдерживающие факторы… • • 24 зависимость эффективности параллелизма от учета характерных свойств параллельных систем (отсутствие мобильности для параллельных программ) ? ! существующее программное обеспечение ориентировано в основном на последовательные ЭВМ ? !

Пути достижения параллелизма… l Достижение параллелизма возможно только при выполнимости следующих требований: – независимость функционирования отдельных устройств ЭВМ (устройства ввода-вывода, обрабатывающие процессоры и устройства памяти), – избыточность элементов вычислительной системы l l – 25 использование специализированных устройств (например, отдельные процессоры для целочисленной и вещественной арифметики, устройства многоуровневой памяти), дублирование устройств ЭВМ (например, использование нескольких однотипных обрабатывающих процессоров или нескольких устройств оперативной памяти), Дополнительная форма обеспечения параллелизма - конвейерная реализация обрабатывающих устройств

Пути достижения параллелизма… l Достижение параллелизма возможно только при выполнимости следующих требований: – независимость функционирования отдельных устройств ЭВМ (устройства ввода-вывода, обрабатывающие процессоры и устройства памяти), – избыточность элементов вычислительной системы l l – 25 использование специализированных устройств (например, отдельные процессоры для целочисленной и вещественной арифметики, устройства многоуровневой памяти), дублирование устройств ЭВМ (например, использование нескольких однотипных обрабатывающих процессоров или нескольких устройств оперативной памяти), Дополнительная форма обеспечения параллелизма - конвейерная реализация обрабатывающих устройств

Пути достижения параллелизма… l Возможные режимы выполнения независимых частей программы: – – – 26 многозадачный режим (режим разделения времени), при котором для выполнения нескольких процессов используется единственный процессор, параллельное выполнение, когда в один и тот же момент времени может выполняться несколько команд обработки данных (обеспечивается при наличии нескольких процессоров или при помощи конвейерных и векторных обрабатывающих устройств), распределенные вычисления, при которых для параллельной обработки данных используется несколько обрабатывающих устройств, достаточно удаленных друг от друга, а передача данных по линиям связи приводит к существенным временным задержкам.

Пути достижения параллелизма… l Возможные режимы выполнения независимых частей программы: – – – 26 многозадачный режим (режим разделения времени), при котором для выполнения нескольких процессов используется единственный процессор, параллельное выполнение, когда в один и тот же момент времени может выполняться несколько команд обработки данных (обеспечивается при наличии нескольких процессоров или при помощи конвейерных и векторных обрабатывающих устройств), распределенные вычисления, при которых для параллельной обработки данных используется несколько обрабатывающих устройств, достаточно удаленных друг от друга, а передача данных по линиям связи приводит к существенным временным задержкам.

Основное внимание будем уделять второму типу организации параллелизма, реализуемому на многопроцессорных вычислительных системах 27

Основное внимание будем уделять второму типу организации параллелизма, реализуемому на многопроцессорных вычислительных системах 27

Примеры параллельных вычислительных систем… l 28 Суперкомпьютеры Существует мировой рейтинг суперкомпьютерных систем: ТОП 500. http: //www. top 500. org Рейтинг содержит 500 лучших машин мира, приводит множество их характеристик, позволяет оценить тенденции. Производительность машин оценивается стандартным тестом LINPACK.

Примеры параллельных вычислительных систем… l 28 Суперкомпьютеры Существует мировой рейтинг суперкомпьютерных систем: ТОП 500. http: //www. top 500. org Рейтинг содержит 500 лучших машин мира, приводит множество их характеристик, позволяет оценить тенденции. Производительность машин оценивается стандартным тестом LINPACK.

Исторические примеры l 29 Суперкомпьютеры. Программа ASCI (США) (Accelerated Strategic Computing Initiative) – 1996, система ASCI Red, построенная Intel, производительность 1 TFlops, – 1999, ASCI Blue Pacific от IBM и ASCI Blue Mountain от SGI, производительность 3 TFlops, – 2000, ASCI White с пиковой производительностью свыше 12 TFlops (реально показанная производительность на тесте LINPACK составила на тот момент 4938 GFlops)

Исторические примеры l 29 Суперкомпьютеры. Программа ASCI (США) (Accelerated Strategic Computing Initiative) – 1996, система ASCI Red, построенная Intel, производительность 1 TFlops, – 1999, ASCI Blue Pacific от IBM и ASCI Blue Mountain от SGI, производительность 3 TFlops, – 2000, ASCI White с пиковой производительностью свыше 12 TFlops (реально показанная производительность на тесте LINPACK составила на тот момент 4938 GFlops)

Примеры параллельных вычислительных систем… l Суперкомпьютеры. Система Blue. Gene – – – Первый вариант системы представлен в 2004 г. и сразу занял 1 позицию в списке Top 500 Расширенный вариант суперкомпьютера (ноябрь 2007 г. ) по прежнему на 1 месте в перечне наиболее быстродействующих вычислительных систем Сейчас – 22 место в рейтинге 212992 двухядерных 32 -битных процессоров Power. PC 440 0. 7 GHz, l пиковая производительность около 600 Tflops, производительность на тесте LINPACK – 478 Tflops l 30

Примеры параллельных вычислительных систем… l Суперкомпьютеры. Система Blue. Gene – – – Первый вариант системы представлен в 2004 г. и сразу занял 1 позицию в списке Top 500 Расширенный вариант суперкомпьютера (ноябрь 2007 г. ) по прежнему на 1 месте в перечне наиболее быстродействующих вычислительных систем Сейчас – 22 место в рейтинге 212992 двухядерных 32 -битных процессоров Power. PC 440 0. 7 GHz, l пиковая производительность около 600 Tflops, производительность на тесте LINPACK – 478 Tflops l 30

Примеры параллельных вычислительных систем… l Кластеры Кластер – группа компьютеров, объединенных в локальную вычислительную сеть (ЛВС) и способных работать в качестве единого вычислительного ресурса. 31 Предполагает более высокую надежность и эффективность, нежели ЛВС, и существенно более низкую стоимость в сравнении с другими типами параллельных вычислительных систем (за счет использования типовых аппаратных и программных решений).

Примеры параллельных вычислительных систем… l Кластеры Кластер – группа компьютеров, объединенных в локальную вычислительную сеть (ЛВС) и способных работать в качестве единого вычислительного ресурса. 31 Предполагает более высокую надежность и эффективность, нежели ЛВС, и существенно более низкую стоимость в сравнении с другими типами параллельных вычислительных систем (за счет использования типовых аппаратных и программных решений).

Примеры параллельных вычислительных систем… l Кластеры. Beowulf – 32 В настоящее время под кластером типа “Beowulf” понимается вычислительная система, состоящая из одного серверного узла и одного или более клиентских узлов, соединенных при помощи сети Ethernet или некоторой другой сети передачи данных. Это система, построенная из готовых серийно выпускающихся промышленных компонент, на которых может работать ОС Linux/Windows, стандартных адаптеров Ethernet и коммутаторов.

Примеры параллельных вычислительных систем… l Кластеры. Beowulf – 32 В настоящее время под кластером типа “Beowulf” понимается вычислительная система, состоящая из одного серверного узла и одного или более клиентских узлов, соединенных при помощи сети Ethernet или некоторой другой сети передачи данных. Это система, построенная из готовых серийно выпускающихся промышленных компонент, на которых может работать ОС Linux/Windows, стандартных адаптеров Ethernet и коммутаторов.

Примеры параллельных вычислительных систем… Кластеры. Beowulf… – 1994, научно-космический центр NASA Goddard Space Flight Center, руководители проекта - Томас Стерлинг и Дон Бекер: 16 компьютеров на базе процессоров 486 DX 4, тактовая частота 100 MHz, l 16 Mb оперативной памяти на каждом узле, l Три параллельно работающих 10 Mbit/s сетевых адаптера, l Операционная система Linux, компилятор GNU, поддержка параллельных программ на основе MPI. l 33

Примеры параллельных вычислительных систем… Кластеры. Beowulf… – 1994, научно-космический центр NASA Goddard Space Flight Center, руководители проекта - Томас Стерлинг и Дон Бекер: 16 компьютеров на базе процессоров 486 DX 4, тактовая частота 100 MHz, l 16 Mb оперативной памяти на каждом узле, l Три параллельно работающих 10 Mbit/s сетевых адаптера, l Операционная система Linux, компилятор GNU, поддержка параллельных программ на основе MPI. l 33

Примеры параллельных вычислительных систем… l Кластеры. AC 3 Velocity Cluster – 2000, Корнельский университет (США), результат совместной работы университета и Advanced Cluster Computing Consortium, образованного компаниями Dell, Intel, Microsoft, Giganet: l l l 34 l 64 четырехпроцессорных сервера Dell Power. Edge 6350 на базе Intel Pentium III Xeon 500 MHz, 4 GB RAM, 54 GB HDD, 100 Mbit Ethernet card, 1 восьмипроцессорный сервер Dell Power. Edge 6350 на базе Intel Pentium III Xeon 550 MHz, 8 GB RAM, 36 GB HDD, 100 Mbit Ethernet card, Операционная система Microsoft Windows NT 4. 0 Server Enterprise Edition, Пиковая производительность AC 3 Velocity 122 GFlops, производительность на тесте LINPACK 47 GFlops.

Примеры параллельных вычислительных систем… l Кластеры. AC 3 Velocity Cluster – 2000, Корнельский университет (США), результат совместной работы университета и Advanced Cluster Computing Consortium, образованного компаниями Dell, Intel, Microsoft, Giganet: l l l 34 l 64 четырехпроцессорных сервера Dell Power. Edge 6350 на базе Intel Pentium III Xeon 500 MHz, 4 GB RAM, 54 GB HDD, 100 Mbit Ethernet card, 1 восьмипроцессорный сервер Dell Power. Edge 6350 на базе Intel Pentium III Xeon 550 MHz, 8 GB RAM, 36 GB HDD, 100 Mbit Ethernet card, Операционная система Microsoft Windows NT 4. 0 Server Enterprise Edition, Пиковая производительность AC 3 Velocity 122 GFlops, производительность на тесте LINPACK 47 GFlops.

l Кластеры. Thunder – 2004, Ливерморская Национальная Лаборатория (США): 1024 сервера, в каждом по 4 процессора Intel Itanium 1. 4 GHz, l 8 Gb оперативной памяти на сервер, l общая емкость дисковой системы 150 Tb, l операционная система CHAOS 2. 0, l пиковая производительность 22938 GFlops и максимально показанная на тесте LINPACK 19940 GFlops (5 -ая позиция списка Top 500 ). l 35

l Кластеры. Thunder – 2004, Ливерморская Национальная Лаборатория (США): 1024 сервера, в каждом по 4 процессора Intel Itanium 1. 4 GHz, l 8 Gb оперативной памяти на сервер, l общая емкость дисковой системы 150 Tb, l операционная система CHAOS 2. 0, l пиковая производительность 22938 GFlops и максимально показанная на тесте LINPACK 19940 GFlops (5 -ая позиция списка Top 500 ). l 35

Примеры параллельных вычислительных систем… l Кластер. Ломоносов (МГУ им. М. В. Ломоносова) 2012, 26 место в рейтинге на ноябрь, 22 - на июнь - 36 Пиковая производительность — 1, 7 Pфлопс Производительность на тесте LINPACK – 900 Tflops – Число процессорных ядер – 78660, из них 29820 на ускорителях – Оперативная память — 99489 ГБ – Объем системы хранения данных около 2000 ТБ – операционная система — Clustrx T-Platforms Edition – Занимаемая площадь — 252 кв. м

Примеры параллельных вычислительных систем… l Кластер. Ломоносов (МГУ им. М. В. Ломоносова) 2012, 26 место в рейтинге на ноябрь, 22 - на июнь - 36 Пиковая производительность — 1, 7 Pфлопс Производительность на тесте LINPACK – 900 Tflops – Число процессорных ядер – 78660, из них 29820 на ускорителях – Оперативная память — 99489 ГБ – Объем системы хранения данных около 2000 ТБ – операционная система — Clustrx T-Platforms Edition – Занимаемая площадь — 252 кв. м

Классификация вычислительных систем… l Систематика Флинна (Flynn) – классификация по способам взаимодействия последовательностей (потоков) выполняемых команд и обрабатываемых данных: l l 37 SISD (Single Instruction, Single Data) SIMD (Single Instruction, Multiple Data) MISD (Multiple Instruction, Single Data) MIMD (Multiple Instruction, Multiple Data) Практически все виды параллельных систем, несмотря на их существенную разнородность, относятся к одной группе MIMD

Классификация вычислительных систем… l Систематика Флинна (Flynn) – классификация по способам взаимодействия последовательностей (потоков) выполняемых команд и обрабатываемых данных: l l 37 SISD (Single Instruction, Single Data) SIMD (Single Instruction, Multiple Data) MISD (Multiple Instruction, Single Data) MIMD (Multiple Instruction, Multiple Data) Практически все виды параллельных систем, несмотря на их существенную разнородность, относятся к одной группе MIMD

Классификация вычислительных систем… Детализация систематики Флинна… – – дальнейшее разделение типов многопроцессорных систем основывается на используемых способах организации оперативной памяти, позволяет различать два важных типа многопроцессорных систем: multiprocessors (мультипроцессоры или системы с общей разделяемой памятью), l multicomputers (мультикомпьютеры или системы с распределенной памятью). l 38

Классификация вычислительных систем… Детализация систематики Флинна… – – дальнейшее разделение типов многопроцессорных систем основывается на используемых способах организации оперативной памяти, позволяет различать два важных типа многопроцессорных систем: multiprocessors (мультипроцессоры или системы с общей разделяемой памятью), l multicomputers (мультикомпьютеры или системы с распределенной памятью). l 38

Классификация ПВС Детализация систематики Флинна… 39

Классификация ПВС Детализация систематики Флинна… 39

Классификация ПВС l Мультипроцессоры с использованием единой общей памяти (shared memory)… – обеспечивается однородный доступ к памяти (uniform memory access or UMA), – являются основой для построения: l l 40 векторных параллельных процессоров (parallel vector processor or PVP). Примеры: Cray T 90, симметричных мультипроцессоров (symmetric multiprocessor or SMP). Примеры: IBM e. Server, Sun Star. Fire, HP Superdome, SGI Origin.

Классификация ПВС l Мультипроцессоры с использованием единой общей памяти (shared memory)… – обеспечивается однородный доступ к памяти (uniform memory access or UMA), – являются основой для построения: l l 40 векторных параллельных процессоров (parallel vector processor or PVP). Примеры: Cray T 90, симметричных мультипроцессоров (symmetric multiprocessor or SMP). Примеры: IBM e. Server, Sun Star. Fire, HP Superdome, SGI Origin.

Классификация ПВС l 41 Мультипроцессоры с использованием единой общей памяти…

Классификация ПВС l 41 Мультипроцессоры с использованием единой общей памяти…

Классификация ПВС Мультипроцессоры с использованием единой общей памяти Проблемы: Доступ с разных процессоров к общим данным и обеспечение, в этой связи, однозначности (когерентности) содержимого разных кэшей (cache coherence problem), l Необходимость синхронизации взаимодействия одновременно выполняемых потоков команд l 42

Классификация ПВС Мультипроцессоры с использованием единой общей памяти Проблемы: Доступ с разных процессоров к общим данным и обеспечение, в этой связи, однозначности (когерентности) содержимого разных кэшей (cache coherence problem), l Необходимость синхронизации взаимодействия одновременно выполняемых потоков команд l 42

Классификация ПВС Мультипроцессоры с использованием физически распределенной памяти (distributed shared memory or DSM): – неоднородный доступ к памяти (non-uniform memory access or NUMA), – Среди систем такого типа выделяют: l Сache-only memory architecture or COMA (системы KSR-1 и DDM), l cache-coherent NUMA or CC-NUMA (системы SGI Origin 2000, Sun HPC 10000, IBM/Sequent NUMA-Q 2000), l non-cache coherent NUMA or NCC-NUMA (система Cray T 3 E). 43

Классификация ПВС Мультипроцессоры с использованием физически распределенной памяти (distributed shared memory or DSM): – неоднородный доступ к памяти (non-uniform memory access or NUMA), – Среди систем такого типа выделяют: l Сache-only memory architecture or COMA (системы KSR-1 и DDM), l cache-coherent NUMA or CC-NUMA (системы SGI Origin 2000, Sun HPC 10000, IBM/Sequent NUMA-Q 2000), l non-cache coherent NUMA or NCC-NUMA (система Cray T 3 E). 43

Классификация ПВС Мультипроцессоры с использованием физически распределенной памяти… 44

Классификация ПВС Мультипроцессоры с использованием физически распределенной памяти… 44

Классификация ПВС l 45 Мультипроцессоры с использованием физически распределенной памяти: – упрощаются проблемы создания мультипроцессоров (известны примеры систем с несколькими тысячами процессоров), – возникают проблемы эффективного использования распределенной памяти (время доступа к локальной и удаленной памяти может различаться на несколько порядков).

Классификация ПВС l 45 Мультипроцессоры с использованием физически распределенной памяти: – упрощаются проблемы создания мультипроцессоров (известны примеры систем с несколькими тысячами процессоров), – возникают проблемы эффективного использования распределенной памяти (время доступа к локальной и удаленной памяти может различаться на несколько порядков).

Классификация ПВС l Мультикомпьютеры… – – – 46 не обеспечивают общий доступ ко всей имеющейся в системах памяти (no-remote memory access or NORMA), каждый процессор системы может использовать только свою локальную память, для доступа к данным, располагаемых на других процессорах, необходимо явно выполнить операции передачи сообщений (message passing operations).

Классификация ПВС l Мультикомпьютеры… – – – 46 не обеспечивают общий доступ ко всей имеющейся в системах памяти (no-remote memory access or NORMA), каждый процессор системы может использовать только свою локальную память, для доступа к данным, располагаемых на других процессорах, необходимо явно выполнить операции передачи сообщений (message passing operations).

Классификация ПВС Мультикомпьютеры 47

Классификация ПВС Мультикомпьютеры 47

l 48 Мультикомпьютеры Данный подход используется при построении двух важных типов многопроцессорных вычислительных систем: – массивно-параллельных систем (massively parallel processor or MPP), например: IBM RS/6000 SP 2, Intel PARAGON, ASCI Red, транспьютерные системы Parsytec, – кластеров (clusters), например: AC 3 Velocity и NCSA NT Supercluster.

l 48 Мультикомпьютеры Данный подход используется при построении двух важных типов многопроцессорных вычислительных систем: – массивно-параллельных систем (massively parallel processor or MPP), например: IBM RS/6000 SP 2, Intel PARAGON, ASCI Red, транспьютерные системы Parsytec, – кластеров (clusters), например: AC 3 Velocity и NCSA NT Supercluster.

l 49 Мультикомпьютеры. Кластеры… Кластер - множество отдельных компьютеров, объединенных в сеть, для которых при помощи специальных аппаратнопрограммных средств обеспечивается возможность унифицированного управления (single system image), надежного функционирования (availability) и эффективного использования (performance)

l 49 Мультикомпьютеры. Кластеры… Кластер - множество отдельных компьютеров, объединенных в сеть, для которых при помощи специальных аппаратнопрограммных средств обеспечивается возможность унифицированного управления (single system image), надежного функционирования (availability) и эффективного использования (performance)

l Мультикомпьютеры. Кластеры… Преимущества: – – – 50 Могут быть образованы на базе уже существующих у потребителей отдельных компьютеров, либо же сконструированы из типовых компьютерных элементов; Повышение вычислительной мощности отдельных процессоров позволяет строить кластеры из сравнительно небольшого количества отдельных компьютеров (lowly parallel processing), Для параллельного выполнения в алгоритмах достаточно выделять только крупные независимые части расчетов (coarse granularity).

l Мультикомпьютеры. Кластеры… Преимущества: – – – 50 Могут быть образованы на базе уже существующих у потребителей отдельных компьютеров, либо же сконструированы из типовых компьютерных элементов; Повышение вычислительной мощности отдельных процессоров позволяет строить кластеры из сравнительно небольшого количества отдельных компьютеров (lowly parallel processing), Для параллельного выполнения в алгоритмах достаточно выделять только крупные независимые части расчетов (coarse granularity).

l Мультикомпьютеры. Кластеры Недостатки: – – 51 Организация взаимодействия вычислительных узлов кластера при помощи передачи сообщений обычно приводит к значительным временным задержкам, Дополнительные ограничения на тип разрабатываемых параллельных алгоритмов и программ (низкая интенсивность потоков передачи данных)

l Мультикомпьютеры. Кластеры Недостатки: – – 51 Организация взаимодействия вычислительных узлов кластера при помощи передачи сообщений обычно приводит к значительным временным задержкам, Дополнительные ограничения на тип разрабатываемых параллельных алгоритмов и программ (низкая интенсивность потоков передачи данных)

Вопросы к семинару Обзор рейтинга TOP 500 (преобладающий тип вычислительных систем, место российских ПВС в рейтинге, преобладающая ОС и т. д. top 500. org) 2. Топологии сети передачи данных (организация физических связей между процессорами системы). Виды топологий, характеристики. 3. Системные платформы для построения кластеров (семейство Windows, семейства UNIX и Linux) 4. Обзор систем программирования для параллельных вычислительных систем (MPI, Open. MP, PVM, CUDA) Задание: подготовить доклад по вопросу и презентацию к нему (можно в паре). 1. 52

Вопросы к семинару Обзор рейтинга TOP 500 (преобладающий тип вычислительных систем, место российских ПВС в рейтинге, преобладающая ОС и т. д. top 500. org) 2. Топологии сети передачи данных (организация физических связей между процессорами системы). Виды топологий, характеристики. 3. Системные платформы для построения кластеров (семейство Windows, семейства UNIX и Linux) 4. Обзор систем программирования для параллельных вычислительных систем (MPI, Open. MP, PVM, CUDA) Задание: подготовить доклад по вопросу и презентацию к нему (можно в паре). 1. 52