лекции первая-вторая.ppt

- Количество слайдов: 68

Лекция № 1 Основные понятия и определения

Лекция № 1 Основные понятия и определения

Информатика • - наука о совокупности процессов получения, передачи, обработки, хранения и представления информации • - основанная на использовании компьютерной техники дисциплина, изучающая структуру и общие свойства информации, а также закономерности и методы её создания, хранения, поиска, преобразования, передачи и применения в различных сферах человеческой деятельности • Informatique (фр. ) Informacion (информация), Automatique (автоматика) • Computer Science

Информатика • - наука о совокупности процессов получения, передачи, обработки, хранения и представления информации • - основанная на использовании компьютерной техники дисциплина, изучающая структуру и общие свойства информации, а также закономерности и методы её создания, хранения, поиска, преобразования, передачи и применения в различных сферах человеческой деятельности • Informatique (фр. ) Informacion (информация), Automatique (автоматика) • Computer Science

Приоритетные направления: • теоpия инфоpмации; • pазpаботка вычислительных систем и пpогpаммного обеспечения; • математическое моделирование; • методы искусственного интеллекта; • методы машинной графики, анимации, средства мультимедиа; • телекоммуникационные системы и сети

Приоритетные направления: • теоpия инфоpмации; • pазpаботка вычислительных систем и пpогpаммного обеспечения; • математическое моделирование; • методы искусственного интеллекта; • методы машинной графики, анимации, средства мультимедиа; • телекоммуникационные системы и сети

Предмет информатики составляют следующие понятия: - аппаратное обеспечение - программное обеспечение - средства взаимодействия аппаратного и программного обеспечения - средства взаимодействия человека с аппаратными и программными средствами

Предмет информатики составляют следующие понятия: - аппаратное обеспечение - программное обеспечение - средства взаимодействия аппаратного и программного обеспечения - средства взаимодействия человека с аппаратными и программными средствами

Основные составляющие информатики • Технические средства - аппаратура компьютера (Hardware) • Программные средства - совокупность всех программ, используемых компьютерами, и область деятельности по их созданию и применению (Software) • Алгоритмические средства - разработка способа решения задачи в виде последовательности действий, ведущих от исходных данных к искомому результату (Brainware)

Основные составляющие информатики • Технические средства - аппаратура компьютера (Hardware) • Программные средства - совокупность всех программ, используемых компьютерами, и область деятельности по их созданию и применению (Software) • Алгоритмические средства - разработка способа решения задачи в виде последовательности действий, ведущих от исходных данных к искомому результату (Brainware)

Теоретическая информатика Фундаментальная основа информатики - математика (математическая логика, реляционная алгебра) ü Информация, знания. Методы представления знаний ü Теория кодирования ü Математическая логика ü Математические и информационные модели ü Теория алгоритмов ü Искусственный интеллект ü Экспертные системы ü Базы данных и знаний лингвистика (язык общения с пользователем) философия, социология (информационная культура, информационная безопасность)

Теоретическая информатика Фундаментальная основа информатики - математика (математическая логика, реляционная алгебра) ü Информация, знания. Методы представления знаний ü Теория кодирования ü Математическая логика ü Математические и информационные модели ü Теория алгоритмов ü Искусственный интеллект ü Экспертные системы ü Базы данных и знаний лингвистика (язык общения с пользователем) философия, социология (информационная культура, информационная безопасность)

Информация Informatio (лат) - сведения, разъяснения • - отражение реального мира с помощью знаков или сигналов • - общенаучное понятие, включающее обмен сведениями между людьми, обмен сигналами между живой и неживой природой, людьми и устройствами • - обозначение содержания, полученного из внешнего мира в процессе нашего приспособления к нему и приспособления к нему наших чувств

Информация Informatio (лат) - сведения, разъяснения • - отражение реального мира с помощью знаков или сигналов • - общенаучное понятие, включающее обмен сведениями между людьми, обмен сигналами между живой и неживой природой, людьми и устройствами • - обозначение содержания, полученного из внешнего мира в процессе нашего приспособления к нему и приспособления к нему наших чувств

Теория информации С точки зрения теории познания • Информация - знания Клод Шеннон (основоположник теории информации): «информация - снятая неопределенность наших знаний о чем-либо» • Информация — это сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний декларативные знания - «я знаю, что…» процедурные знания – «я знаю, как…»

Теория информации С точки зрения теории познания • Информация - знания Клод Шеннон (основоположник теории информации): «информация - снятая неопределенность наших знаний о чем-либо» • Информация — это сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний декларативные знания - «я знаю, что…» процедурные знания – «я знаю, как…»

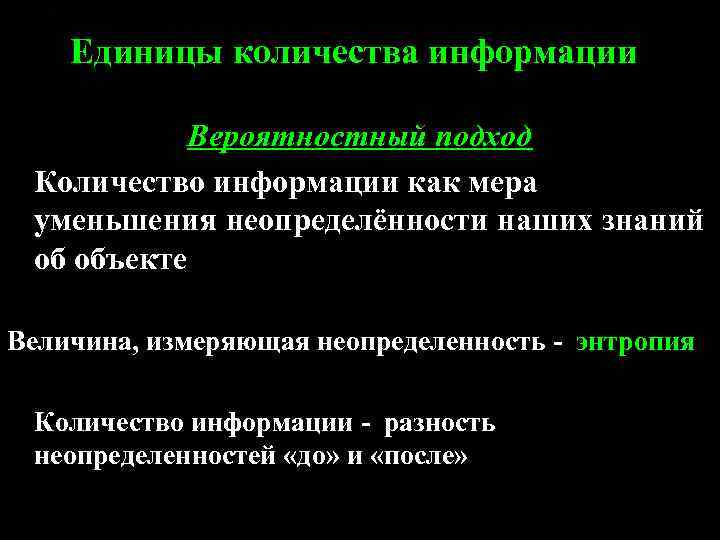

Единицы количества информации Вероятностный подход Количество информации как мера уменьшения неопределённости наших знаний об объекте Величина, измеряющая неопределенность - энтропия Количество информации - разность неопределенностей «до» и «после»

Единицы количества информации Вероятностный подход Количество информации как мера уменьшения неопределённости наших знаний об объекте Величина, измеряющая неопределенность - энтропия Количество информации - разность неопределенностей «до» и «после»

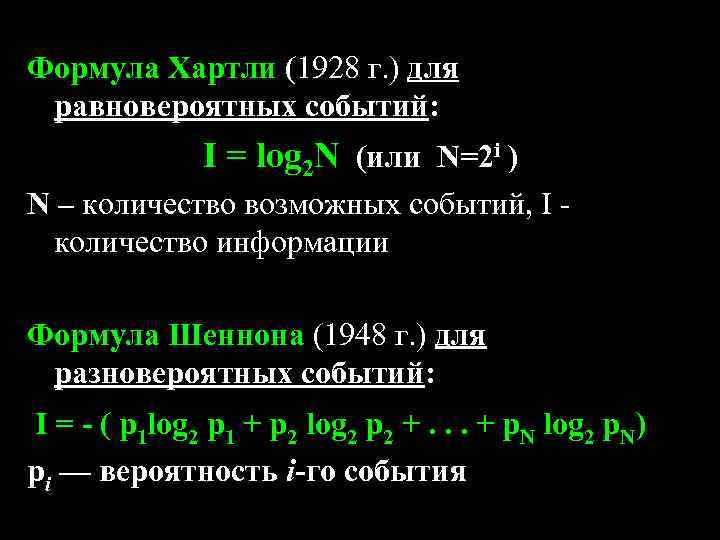

Формула Хартли (1928 г. ) для равновероятных событий: I = log 2 N (или N=2 i ) N – количество возможных событий, I - количество информации Формула Шеннона (1948 г. ) для разновероятных событий: I = - ( p 1 log 2 p 1 + p 2 log 2 p 2 +. . . + p. N log 2 p. N) pi — вероятность i-го события

Формула Хартли (1928 г. ) для равновероятных событий: I = log 2 N (или N=2 i ) N – количество возможных событий, I - количество информации Формула Шеннона (1948 г. ) для разновероятных событий: I = - ( p 1 log 2 p 1 + p 2 log 2 p 2 +. . . + p. N log 2 p. N) pi — вероятность i-го события

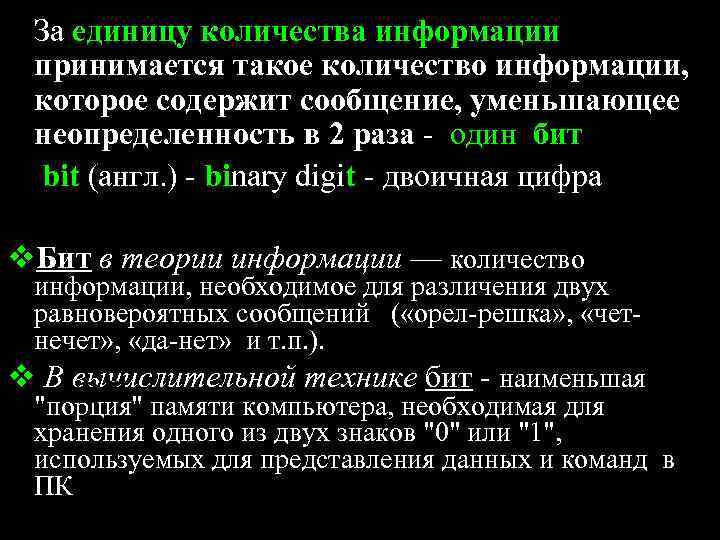

За единицу количества информации принимается такое количество информации, которое содержит сообщение, уменьшающее неопределенность в 2 раза - один бит bit (англ. ) - binary digit - двоичная цифра v. Бит в теории информации — количество информации, необходимое для различения двух равновероятных сообщений ( «орел-решка» , «четнечет» , «да-нет» и т. п. ). v В вычислительной технике бит - наименьшая "порция" памяти компьютера, необходимая для хранения одного из двух знаков "0" или "1", используемых для представления данных и команд в ПК

За единицу количества информации принимается такое количество информации, которое содержит сообщение, уменьшающее неопределенность в 2 раза - один бит bit (англ. ) - binary digit - двоичная цифра v. Бит в теории информации — количество информации, необходимое для различения двух равновероятных сообщений ( «орел-решка» , «четнечет» , «да-нет» и т. п. ). v В вычислительной технике бит - наименьшая "порция" памяти компьютера, необходимая для хранения одного из двух знаков "0" или "1", используемых для представления данных и команд в ПК

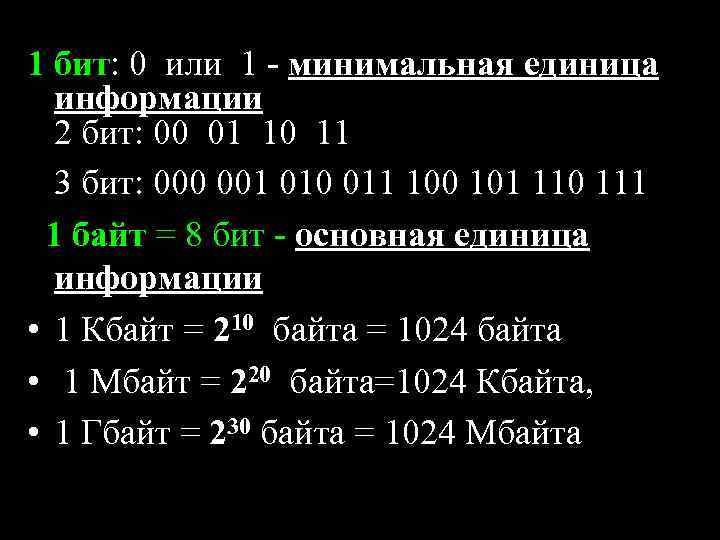

1 бит: 0 или 1 - минимальная единица информации 2 бит: 00 01 10 11 3 бит: 000 001 010 011 100 101 110 111 1 байт = 8 бит - основная единица информации • 1 Кбайт = 210 байта = 1024 байта • 1 Мбайт = 220 байта=1024 Кбайта, • 1 Гбайт = 230 байта = 1024 Мбайта

1 бит: 0 или 1 - минимальная единица информации 2 бит: 00 01 10 11 3 бит: 000 001 010 011 100 101 110 111 1 байт = 8 бит - основная единица информации • 1 Кбайт = 210 байта = 1024 байта • 1 Мбайт = 220 байта=1024 Кбайта, • 1 Гбайт = 230 байта = 1024 Мбайта

Алфавитный подход • Набор символов знаковой системы (алфавит) рассматривают как различные возможные события • Расчет количества информации, которое несет каждый символ: количество информации в сообщении = количества информации, которое несет каждый символ × количество символов Пример: 32 буквы (события) , тогда каждый символ несет I = log 232 = 5 битов информации Традиционно: 1 символ = 1 байт (для 256 символьного алфавита)

Алфавитный подход • Набор символов знаковой системы (алфавит) рассматривают как различные возможные события • Расчет количества информации, которое несет каждый символ: количество информации в сообщении = количества информации, которое несет каждый символ × количество символов Пример: 32 буквы (события) , тогда каждый символ несет I = log 232 = 5 битов информации Традиционно: 1 символ = 1 байт (для 256 символьного алфавита)

• Информация есть характеристика не сообщения, а соотношения между сообщением и его потребителем Без наличия потребителя говорить об информации бессмысленно • Применительно к компьютерной обработке данных информация - некоторая последовательность символических обозначений (букв, цифр, закодированных графических образов и звуков и т. п. ), несущая смысловую нагрузку и представленная в понятном компьютеру виде

• Информация есть характеристика не сообщения, а соотношения между сообщением и его потребителем Без наличия потребителя говорить об информации бессмысленно • Применительно к компьютерной обработке данных информация - некоторая последовательность символических обозначений (букв, цифр, закодированных графических образов и звуков и т. п. ), несущая смысловую нагрузку и представленная в понятном компьютеру виде

Информация может существовать в виде: • текстов, рисунков, чертежей, фотографий; • световых или звуковых сигналов; • радиоволн; • электрических и нервных импульсов; • магнитных записей; • жестов и мимики; • запахов и вкусовых ощущений; • хромосом, посредством которых передаются по наследству признаки и свойства организмов и т. д.

Информация может существовать в виде: • текстов, рисунков, чертежей, фотографий; • световых или звуковых сигналов; • радиоволн; • электрических и нервных импульсов; • магнитных записей; • жестов и мимики; • запахов и вкусовых ощущений; • хромосом, посредством которых передаются по наследству признаки и свойства организмов и т. д.

Свойства информации • • Понятность Полнота Достоверность Актуальность Ценность Ясность Защищенность Объективность

Свойства информации • • Понятность Полнота Достоверность Актуальность Ценность Ясность Защищенность Объективность

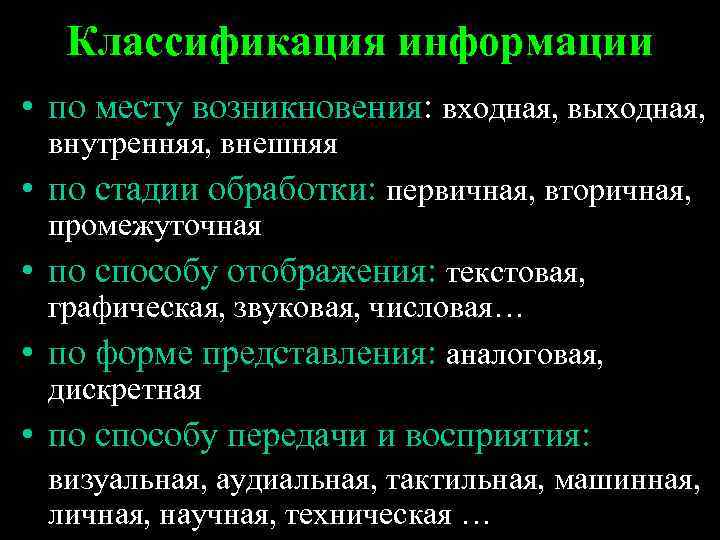

Классификация информации • по месту возникновения: входная, выходная, внутренняя, внешняя • по стадии обработки: первичная, вторичная, промежуточная • по способу отображения: текстовая, графическая, звуковая, числовая… • по форме представления: аналоговая, дискретная • по способу передачи и восприятия: визуальная, аудиальная, тактильная, машинная, личная, научная, техническая …

Классификация информации • по месту возникновения: входная, выходная, внутренняя, внешняя • по стадии обработки: первичная, вторичная, промежуточная • по способу отображения: текстовая, графическая, звуковая, числовая… • по форме представления: аналоговая, дискретная • по способу передачи и восприятия: визуальная, аудиальная, тактильная, машинная, личная, научная, техническая …

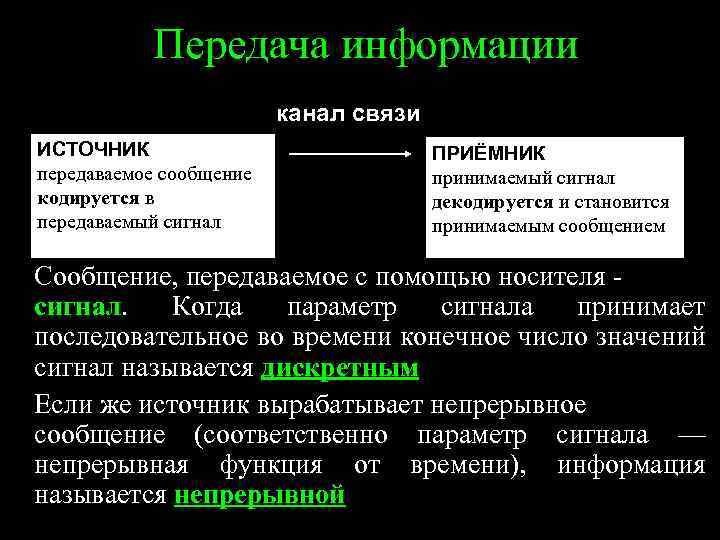

Передача информации канал связи ИСТОЧНИК передаваемое сообщение кодируется в передаваемый сигнал ПРИЁМНИК принимаемый сигнал декодируется и становится принимаемым сообщением Сообщение, передаваемое с помощью носителя - сигнал. Когда параметр сигнала принимает последовательное во времени конечное число значений сигнал называется дискретным Если же источник вырабатывает непрерывное сообщение (соответственно параметр сигнала — непрерывная функция от времени), информация называется непрерывной

Передача информации канал связи ИСТОЧНИК передаваемое сообщение кодируется в передаваемый сигнал ПРИЁМНИК принимаемый сигнал декодируется и становится принимаемым сообщением Сообщение, передаваемое с помощью носителя - сигнал. Когда параметр сигнала принимает последовательное во времени конечное число значений сигнал называется дискретным Если же источник вырабатывает непрерывное сообщение (соответственно параметр сигнала — непрерывная функция от времени), информация называется непрерывной

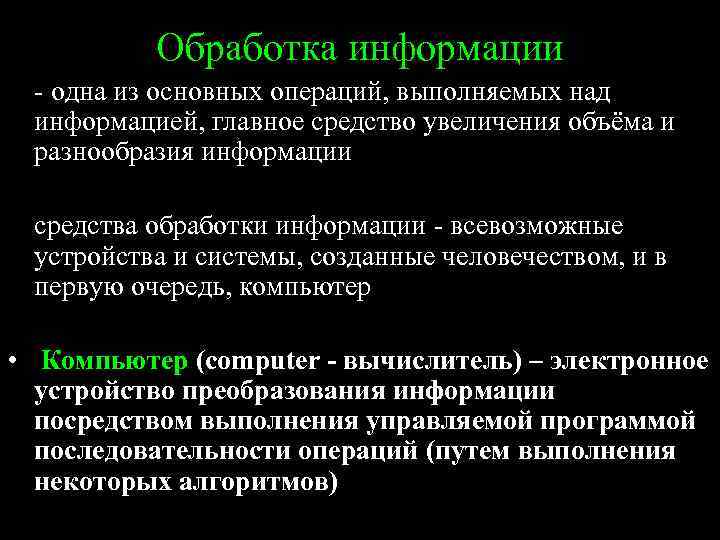

Обработка информации - одна из основных операций, выполняемых над информацией, главное средство увеличения объёма и разнообразия информации средства обработки информации - всевозможные устройства и системы, созданные человечеством, и в первую очередь, компьютер • Компьютер (computer - вычислитель) – электронное устройство преобразования информации посредством выполнения управляемой программой последовательности операций (путем выполнения некоторых алгоритмов)

Обработка информации - одна из основных операций, выполняемых над информацией, главное средство увеличения объёма и разнообразия информации средства обработки информации - всевозможные устройства и системы, созданные человечеством, и в первую очередь, компьютер • Компьютер (computer - вычислитель) – электронное устройство преобразования информации посредством выполнения управляемой программой последовательности операций (путем выполнения некоторых алгоритмов)

• Вычислительная техника – совокупность устройств, предназначенных для автоматической или автоматизированной обработки данных • Поколения вычислительной техники – периоды ее развития, отмеченные относительной стабильностью архитектуры и технических решений поколение годы Элементная база Способ общения Программное обеспечение 1 1946 - электронные лампы 1959 Машинный код Машинные языки 2 1960 - полупроводники 1969 + язык программирования + алгоритмические языки программирования 3 1970 - интегральные схемы 1979 (ИС) + язык управления заданиями + ОС, прикладные программы 4 1980 - БИС, микропроцессоры + пользовательский … интерфейс + БД, сетевое ПО, мультимедиа на самостоятельное изучение!!!: история развития вычислительной техники, поколения ЭВМ

• Вычислительная техника – совокупность устройств, предназначенных для автоматической или автоматизированной обработки данных • Поколения вычислительной техники – периоды ее развития, отмеченные относительной стабильностью архитектуры и технических решений поколение годы Элементная база Способ общения Программное обеспечение 1 1946 - электронные лампы 1959 Машинный код Машинные языки 2 1960 - полупроводники 1969 + язык программирования + алгоритмические языки программирования 3 1970 - интегральные схемы 1979 (ИС) + язык управления заданиями + ОС, прикладные программы 4 1980 - БИС, микропроцессоры + пользовательский … интерфейс + БД, сетевое ПО, мультимедиа на самостоятельное изучение!!!: история развития вычислительной техники, поколения ЭВМ

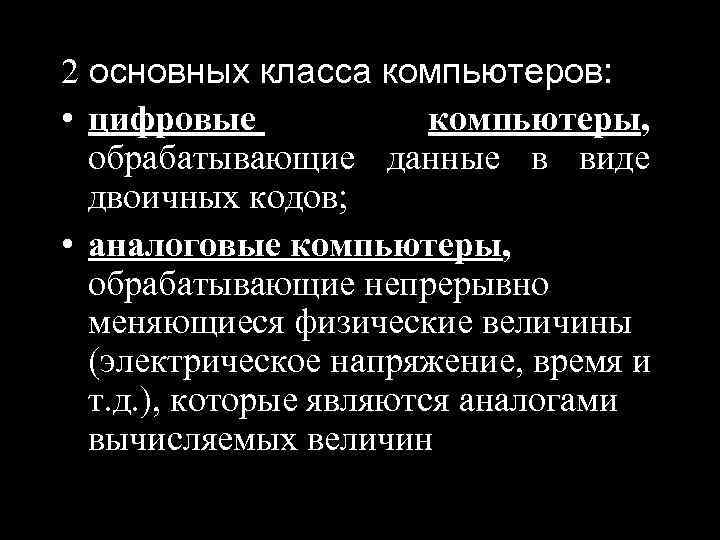

2 основных класса компьютеров: • цифровые компьютеры, обрабатывающие данные в виде двоичных кодов; • аналоговые компьютеры, обрабатывающие непрерывно меняющиеся физические величины (электрическое напряжение, время и т. д. ), которые являются аналогами вычисляемых величин

2 основных класса компьютеров: • цифровые компьютеры, обрабатывающие данные в виде двоичных кодов; • аналоговые компьютеры, обрабатывающие непрерывно меняющиеся физические величины (электрическое напряжение, время и т. д. ), которые являются аналогами вычисляемых величин

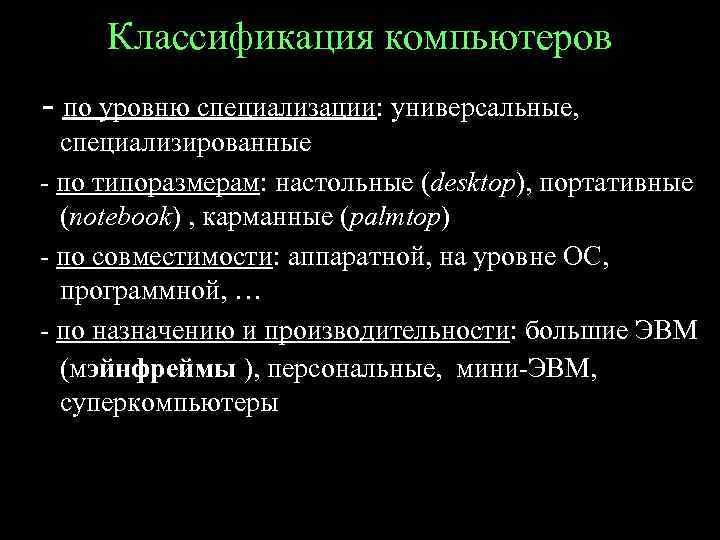

Классификация компьютеров - по уровню специализации: универсальные, специализированные - по типоразмерам: настольные (desktop), портативные (notebook) , карманные (palmtop) - по совместимости: аппаратной, на уровне ОС, программной, … - по назначению и производительности: большие ЭВМ (мэйнфреймы ), персональные, мини-ЭВМ, суперкомпьютеры

Классификация компьютеров - по уровню специализации: универсальные, специализированные - по типоразмерам: настольные (desktop), портативные (notebook) , карманные (palmtop) - по совместимости: аппаратной, на уровне ОС, программной, … - по назначению и производительности: большие ЭВМ (мэйнфреймы ), персональные, мини-ЭВМ, суперкомпьютеры

Общие принципы организации и работы компьютеров

Общие принципы организации и работы компьютеров

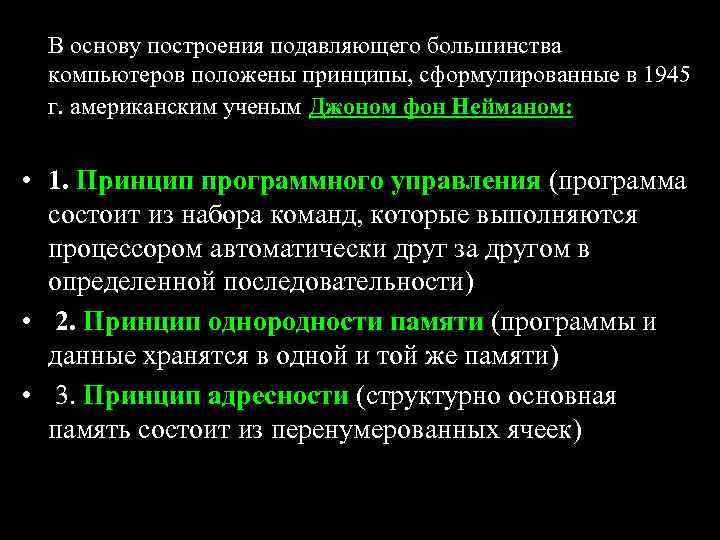

В основу построения подавляющего большинства компьютеров положены принципы, сформулированные в 1945 г. американским ученым Джоном фон Нейманом: • 1. Принцип программного управления (программа состоит из набора команд, которые выполняются процессором автоматически друг за другом в определенной последовательности) • 2. Принцип однородности памяти (программы и данные хранятся в одной и той же памяти) • 3. Принцип адресности (структурно основная память состоит из перенумерованных ячеек)

В основу построения подавляющего большинства компьютеров положены принципы, сформулированные в 1945 г. американским ученым Джоном фон Нейманом: • 1. Принцип программного управления (программа состоит из набора команд, которые выполняются процессором автоматически друг за другом в определенной последовательности) • 2. Принцип однородности памяти (программы и данные хранятся в одной и той же памяти) • 3. Принцип адресности (структурно основная память состоит из перенумерованных ячеек)

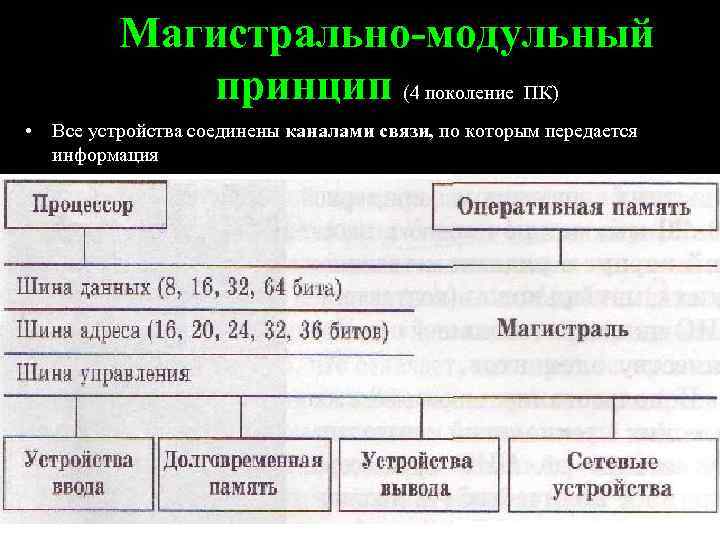

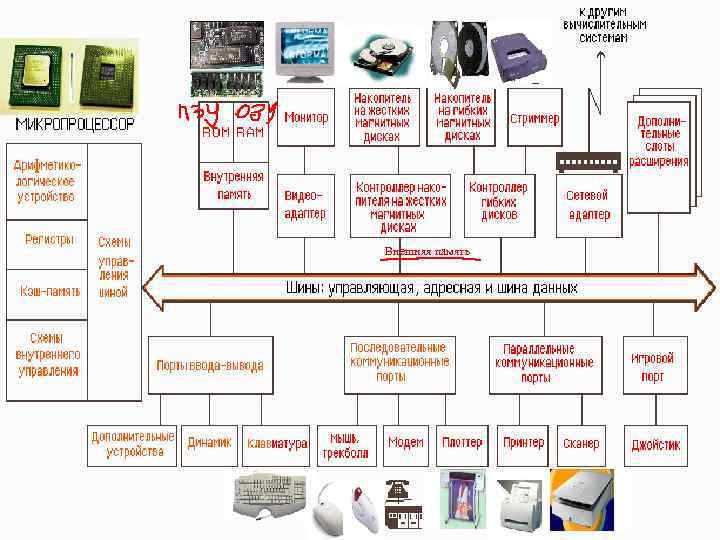

Магистрально-модульный принцип (4 поколение ПК) • Все устройства соединены каналами связи, по которым передается информация

Магистрально-модульный принцип (4 поколение ПК) • Все устройства соединены каналами связи, по которым передается информация

Внешняя память

Внешняя память

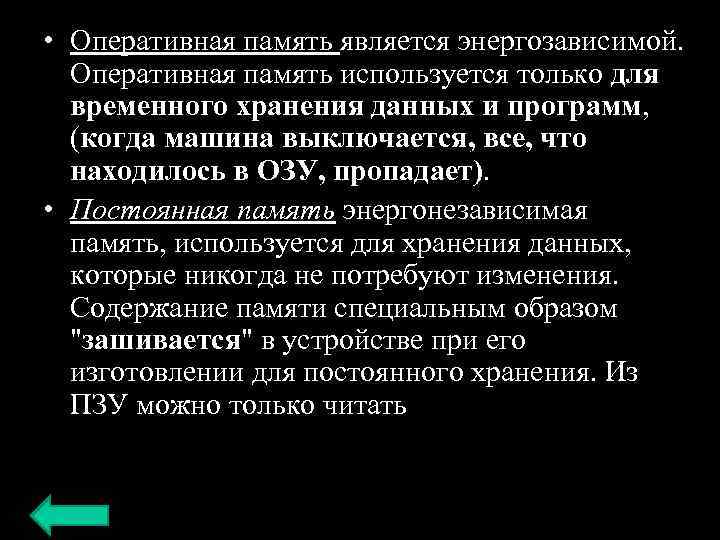

• Оперативная память является энергозависимой. Оперативная память используется только для временного хранения данных и программ, (когда машина выключается, все, что находилось в ОЗУ, пропадает). • Постоянная память энергонезависимая память, используется для хранения данных, которые никогда не потребуют изменения. Содержание памяти специальным образом "зашивается" в устройстве при его изготовлении для постоянного хранения. Из ПЗУ можно только читать

• Оперативная память является энергозависимой. Оперативная память используется только для временного хранения данных и программ, (когда машина выключается, все, что находилось в ОЗУ, пропадает). • Постоянная память энергонезависимая память, используется для хранения данных, которые никогда не потребуют изменения. Содержание памяти специальным образом "зашивается" в устройстве при его изготовлении для постоянного хранения. Из ПЗУ можно только читать

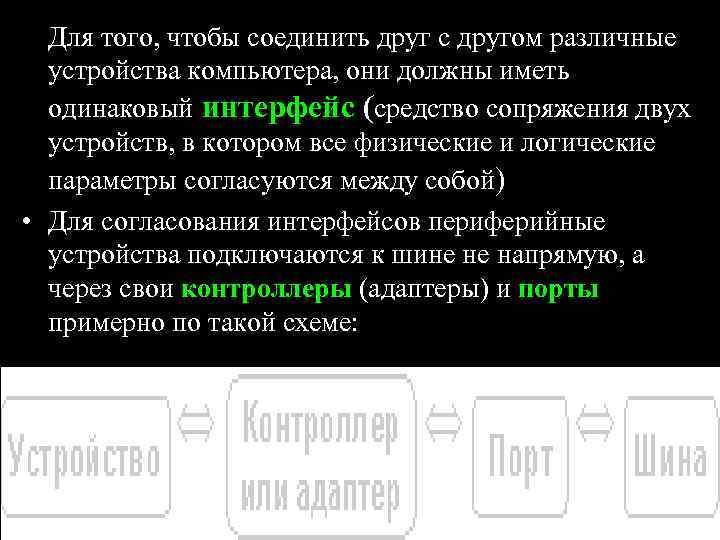

Для того, чтобы соединить друг с другом различные устройства компьютера, они должны иметь одинаковый интерфейс (средство сопряжения двух устройств, в котором все физические и логические параметры согласуются между собой) • Для согласования интерфейсов периферийные устройства подключаются к шине не напрямую, а через свои контроллеры (адаптеры) и порты примерно по такой схеме:

Для того, чтобы соединить друг с другом различные устройства компьютера, они должны иметь одинаковый интерфейс (средство сопряжения двух устройств, в котором все физические и логические параметры согласуются между собой) • Для согласования интерфейсов периферийные устройства подключаются к шине не напрямую, а через свои контроллеры (адаптеры) и порты примерно по такой схеме:

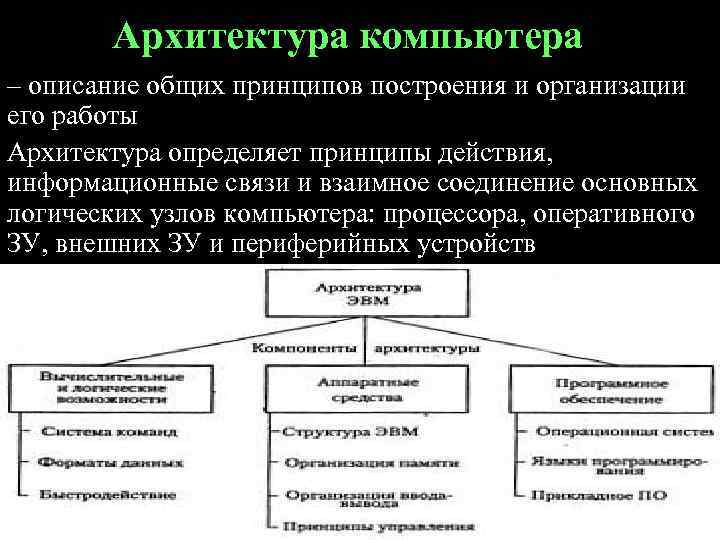

Архитектура компьютера – описание общих принципов построения и организации его работы Архитектура определяет принципы действия, информационные связи и взаимное соединение основных логических узлов компьютера: процессора, оперативного ЗУ, внешних ЗУ и периферийных устройств

Архитектура компьютера – описание общих принципов построения и организации его работы Архитектура определяет принципы действия, информационные связи и взаимное соединение основных логических узлов компьютера: процессора, оперативного ЗУ, внешних ЗУ и периферийных устройств

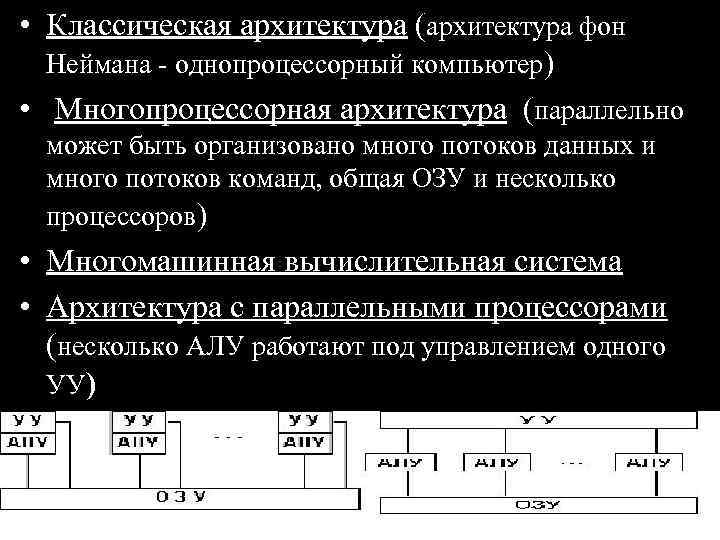

• Классическая архитектура (архитектура фон Неймана - однопроцессорный компьютер) • Многопроцессорная архитектура (параллельно может быть организовано много потоков данных и много потоков команд, общая ОЗУ и несколько процессоров) • Многомашинная вычислительная система • Архитектура с параллельными процессорами (несколько АЛУ работают под управлением одного УУ)

• Классическая архитектура (архитектура фон Неймана - однопроцессорный компьютер) • Многопроцессорная архитектура (параллельно может быть организовано много потоков данных и много потоков команд, общая ОЗУ и несколько процессоров) • Многомашинная вычислительная система • Архитектура с параллельными процессорами (несколько АЛУ работают под управлением одного УУ)

• Конвейерная архитектура – это принцип построения компьютера, состоящий в параллельном выполнении команд множеством процессоров над одним потоком данных. Каждый процессор цепочки использует в качестве входных данных выходные данные предыдущего процессора • CISC (англ. Complex Instruction Set Computing) – архитектура процессора, которая характеризуется следующим набором свойств: - нефиксированное значение длины команды; - кодирование арифметических действий в одной инструкции; - небольшое число регистров, каждый из которых выполняет строго определённую функцию • RISC (англ. restricted (reduced) instruction set computer) — архитектура процессора, в котором быстродействие увеличивается за счёт упрощения инструкций. Это облегчает повышение тактовой частоты и делает более эффективной суперскалярность (распараллеливание инструкций между несколькими исполнительными блоками) • RISC- архитектура процессора, основанная на концепции «более компактные и простые инструкции выполняются быстрее» .

• Конвейерная архитектура – это принцип построения компьютера, состоящий в параллельном выполнении команд множеством процессоров над одним потоком данных. Каждый процессор цепочки использует в качестве входных данных выходные данные предыдущего процессора • CISC (англ. Complex Instruction Set Computing) – архитектура процессора, которая характеризуется следующим набором свойств: - нефиксированное значение длины команды; - кодирование арифметических действий в одной инструкции; - небольшое число регистров, каждый из которых выполняет строго определённую функцию • RISC (англ. restricted (reduced) instruction set computer) — архитектура процессора, в котором быстродействие увеличивается за счёт упрощения инструкций. Это облегчает повышение тактовой частоты и делает более эффективной суперскалярность (распараллеливание инструкций между несколькими исполнительными блоками) • RISC- архитектура процессора, основанная на концепции «более компактные и простые инструкции выполняются быстрее» .

Вопросы на с/р • История развития вычислительной техники • Поколения ЭВМ • Основные устройства компьютера, их назначение и взаимосвязь

Вопросы на с/р • История развития вычислительной техники • Поколения ЭВМ • Основные устройства компьютера, их назначение и взаимосвязь

Теоретические основы информатики

Теоретические основы информатики

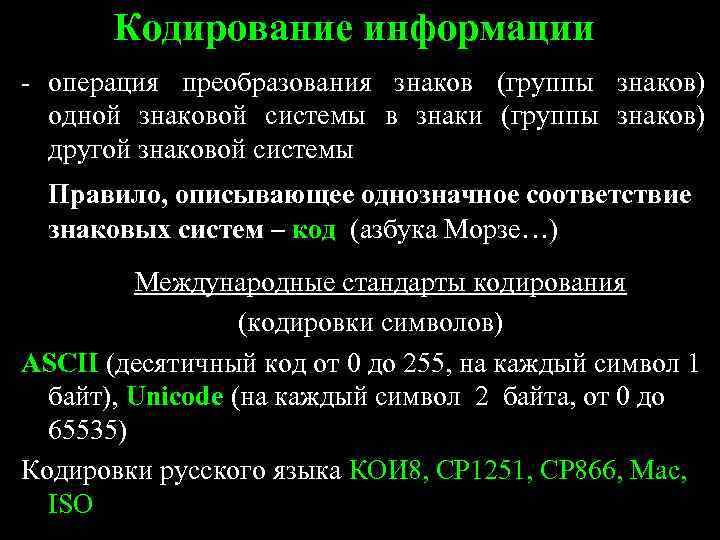

Кодирование информации - операция преобразования знаков (группы знаков) одной знаковой системы в знаки (группы знаков) другой знаковой системы Правило, описывающее однозначное соответствие знаковых систем – код (азбука Морзе…) Международные стандарты кодирования (кодировки символов) ASCII (десятичный код от 0 до 255, на каждый символ 1 байт), Unicode (на каждый символ 2 байта, от 0 до 65535) Кодировки русского языка КОИ 8, СР 1251, СP 866, Мас, ISO

Кодирование информации - операция преобразования знаков (группы знаков) одной знаковой системы в знаки (группы знаков) другой знаковой системы Правило, описывающее однозначное соответствие знаковых систем – код (азбука Морзе…) Международные стандарты кодирования (кодировки символов) ASCII (десятичный код от 0 до 255, на каждый символ 1 байт), Unicode (на каждый символ 2 байта, от 0 до 65535) Кодировки русского языка КОИ 8, СР 1251, СP 866, Мас, ISO

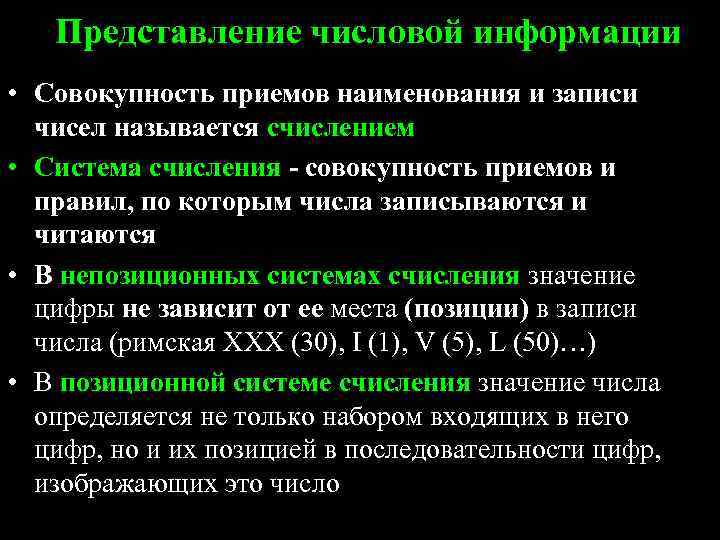

Представление числовой информации • Совокупность приемов наименования и записи чисел называется счислением • Система счисления - совокупность приемов и правил, по которым числа записываются и читаются • В непозиционных системах счисления значение цифры не зависит от ее места (позиции) в записи числа (римская XXX (30), I (1), V (5), L (50)…) • В позиционной системе счисления значение числа определяется не только набором входящих в него цифр, но и их позицией в последовательности цифр, изображающих это число

Представление числовой информации • Совокупность приемов наименования и записи чисел называется счислением • Система счисления - совокупность приемов и правил, по которым числа записываются и читаются • В непозиционных системах счисления значение цифры не зависит от ее места (позиции) в записи числа (римская XXX (30), I (1), V (5), L (50)…) • В позиционной системе счисления значение числа определяется не только набором входящих в него цифр, но и их позицией в последовательности цифр, изображающих это число

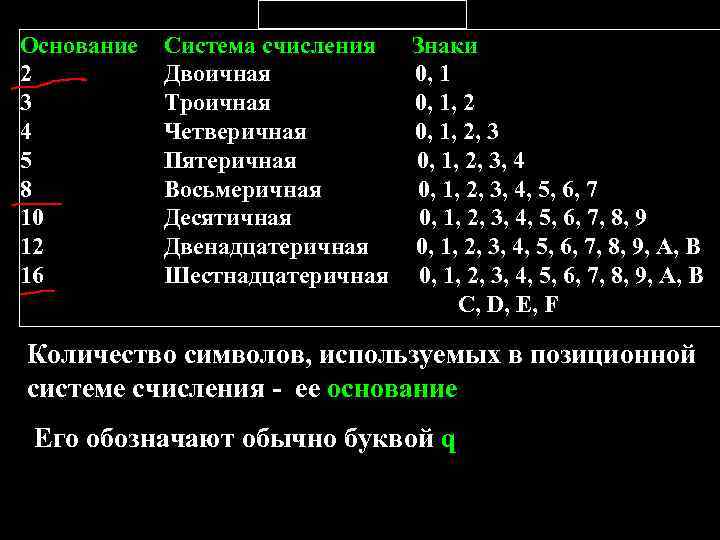

Основание Система счисления Знаки 2 Двоичная 0, 1 3 Троичная 0, 1, 2 4 Четверичная 0, 1, 2, 3 5 Пятеричная 0, 1, 2, 3, 4 8 Восьмеричная 0, 1, 2, 3, 4, 5, 6, 7 10 Десятичная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9 12 Двенадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В 16 Шестнадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В С, D, Е, F Количество символов, используемых в позиционной системе счисления - ее основание Его обозначают обычно буквой q

Основание Система счисления Знаки 2 Двоичная 0, 1 3 Троичная 0, 1, 2 4 Четверичная 0, 1, 2, 3 5 Пятеричная 0, 1, 2, 3, 4 8 Восьмеричная 0, 1, 2, 3, 4, 5, 6, 7 10 Десятичная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9 12 Двенадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В 16 Шестнадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В С, D, Е, F Количество символов, используемых в позиционной системе счисления - ее основание Его обозначают обычно буквой q

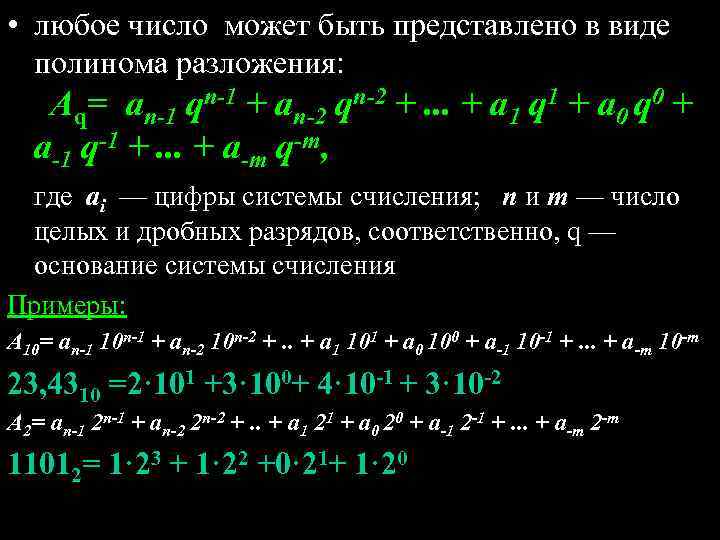

• любое число может быть представлено в виде полинома разложения: Aq= an-1 qn-1 + an-2 qn-2 +. . . + a 1 q 1 + a 0 q 0 + a-1 q-1 +. . . + a-m q-m, где ai — цифры системы счисления; n и m — число целых и дробных разрядов, соответственно, q — основание системы счисления Примеры: A 10= an-1 10 n-1 + an-2 10 n-2 +. . + a 1 101 + a 0 100 + a-1 10 -1 +. . . + a-m 10 -m 23, 4310 =2· 101 +3· 100+ 4· 10 -1 + 3· 10 -2 A 2= an-1 2 n-1 + an-2 2 n-2 +. . + a 1 21 + a 0 20 + a-1 2 -1 +. . . + a-m 2 -m 11012= 1· 23 + 1· 22 +0· 21+ 1· 20

• любое число может быть представлено в виде полинома разложения: Aq= an-1 qn-1 + an-2 qn-2 +. . . + a 1 q 1 + a 0 q 0 + a-1 q-1 +. . . + a-m q-m, где ai — цифры системы счисления; n и m — число целых и дробных разрядов, соответственно, q — основание системы счисления Примеры: A 10= an-1 10 n-1 + an-2 10 n-2 +. . + a 1 101 + a 0 100 + a-1 10 -1 +. . . + a-m 10 -m 23, 4310 =2· 101 +3· 100+ 4· 10 -1 + 3· 10 -2 A 2= an-1 2 n-1 + an-2 2 n-2 +. . + a 1 21 + a 0 20 + a-1 2 -1 +. . . + a-m 2 -m 11012= 1· 23 + 1· 22 +0· 21+ 1· 20

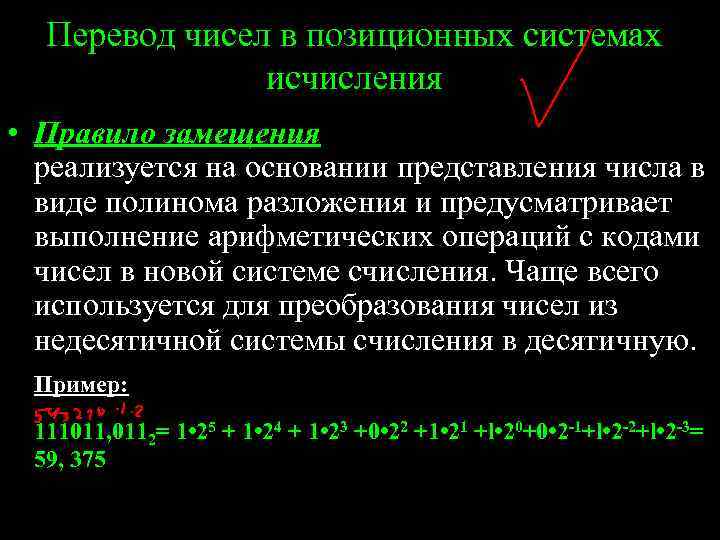

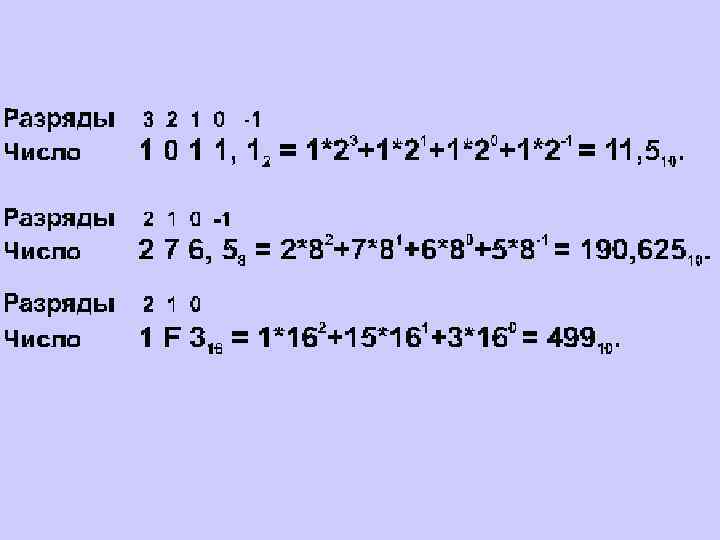

Перевод чисел в позиционных системах исчисления • Правило замещения реализуется на основании представления числа в виде полинома разложения и предусматривает выполнение арифметических операций с кодами чисел в новой системе счисления. Чаще всего используется для преобразования чисел из недесятичной системы счисления в десятичную. Пример: 111011, 0112= 1 • 25 + 1 • 24 + 1 • 23 +0 • 22 +1 • 21 +l • 20+0 • 2 -1+l • 2 -2+l • 2 -3= 59, 375

Перевод чисел в позиционных системах исчисления • Правило замещения реализуется на основании представления числа в виде полинома разложения и предусматривает выполнение арифметических операций с кодами чисел в новой системе счисления. Чаще всего используется для преобразования чисел из недесятичной системы счисления в десятичную. Пример: 111011, 0112= 1 • 25 + 1 • 24 + 1 • 23 +0 • 22 +1 • 21 +l • 20+0 • 2 -1+l • 2 -2+l • 2 -3= 59, 375

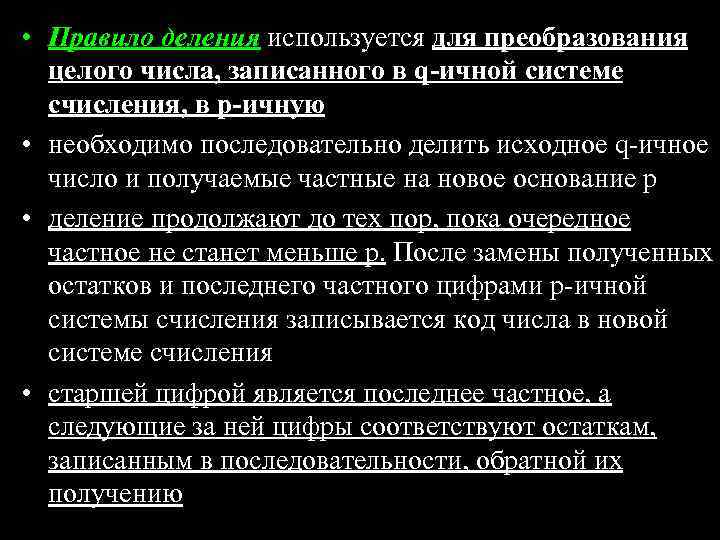

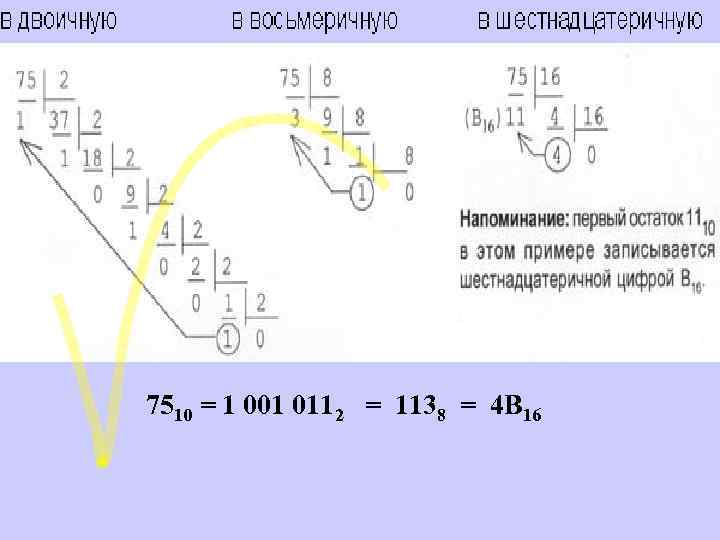

• Правило деления используется для преобразования целого числа, записанного в q-ичной системе счисления, в р-ичную • необходимо последовательно делить исходное q-ичное число и получаемые частные на новое основание р • деление продолжают до тех пор, пока очередное частное не станет меньше р. После замены полученных остатков и последнего частного цифрами р-ичной системы счисления записывается код числа в новой системе счисления • старшей цифрой является последнее частное, а следующие за ней цифры соответствуют остаткам, записанным в последовательности, обратной их получению

• Правило деления используется для преобразования целого числа, записанного в q-ичной системе счисления, в р-ичную • необходимо последовательно делить исходное q-ичное число и получаемые частные на новое основание р • деление продолжают до тех пор, пока очередное частное не станет меньше р. После замены полученных остатков и последнего частного цифрами р-ичной системы счисления записывается код числа в новой системе счисления • старшей цифрой является последнее частное, а следующие за ней цифры соответствуют остаткам, записанным в последовательности, обратной их получению

7510 = 1 001 0112 = 1138 = 4 B 16

7510 = 1 001 0112 = 1138 = 4 B 16

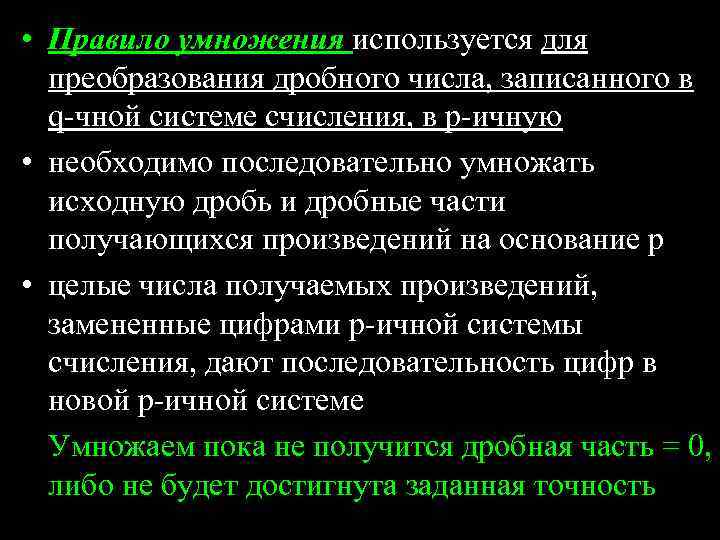

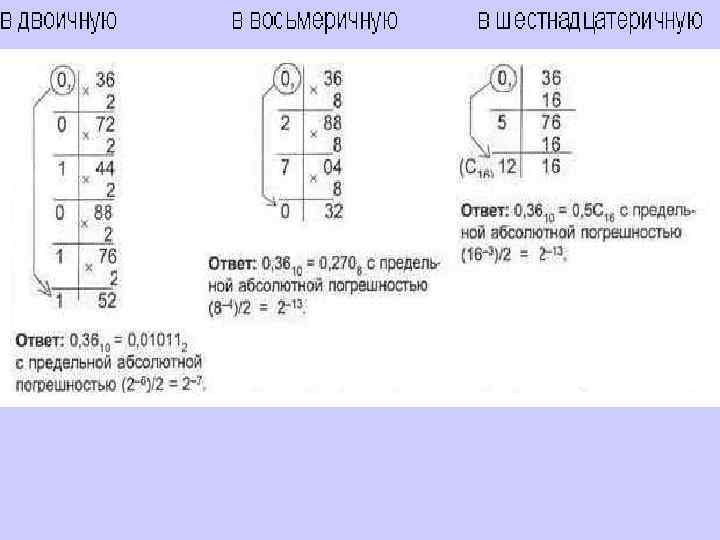

• Правило умножения используется для преобразования дробного числа, записанного в q-чной системе счисления, в р-ичную • необходимо последовательно умножать исходную дробь и дробные части получающихся произведений на основание р • целые числа получаемых произведений, замененные цифрами р-ичной системы счисления, дают последовательность цифр в новой р-ичной системе Умножаем пока не получится дробная часть = 0, либо не будет достигнута заданная точность

• Правило умножения используется для преобразования дробного числа, записанного в q-чной системе счисления, в р-ичную • необходимо последовательно умножать исходную дробь и дробные части получающихся произведений на основание р • целые числа получаемых произведений, замененные цифрами р-ичной системы счисления, дают последовательность цифр в новой р-ичной системе Умножаем пока не получится дробная часть = 0, либо не будет достигнута заданная точность

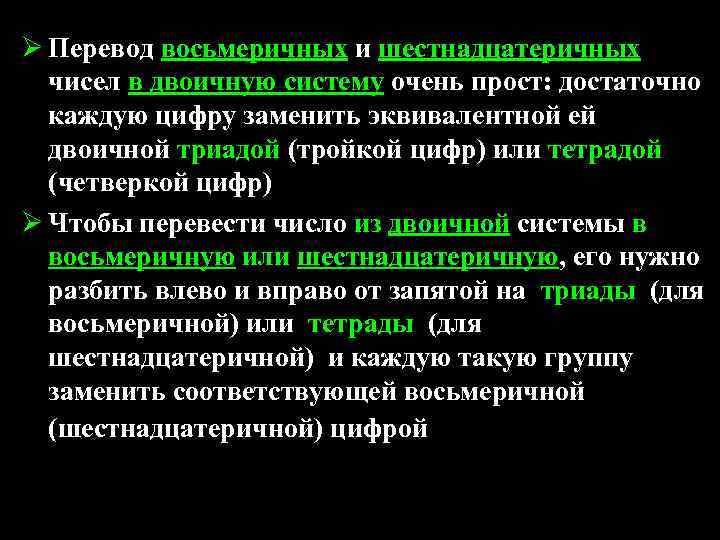

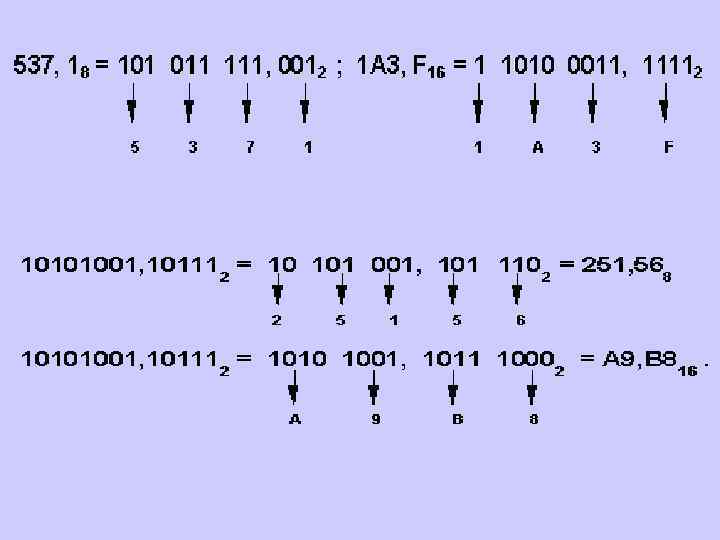

Ø Перевод восьмеричных и шестнадцатеричных чисел в двоичную систему очень прост: достаточно каждую цифру заменить эквивалентной ей двоичной триадой (тройкой цифр) или тетрадой (четверкой цифр) Ø Чтобы перевести число из двоичной системы в восьмеричную или шестнадцатеричную, его нужно разбить влево и вправо от запятой на триады (для восьмеричной) или тетрады (для шестнадцатеричной) и каждую такую группу заменить соответствующей восьмеричной (шестнадцатеричной) цифрой

Ø Перевод восьмеричных и шестнадцатеричных чисел в двоичную систему очень прост: достаточно каждую цифру заменить эквивалентной ей двоичной триадой (тройкой цифр) или тетрадой (четверкой цифр) Ø Чтобы перевести число из двоичной системы в восьмеричную или шестнадцатеричную, его нужно разбить влево и вправо от запятой на триады (для восьмеричной) или тетрады (для шестнадцатеричной) и каждую такую группу заменить соответствующей восьмеричной (шестнадцатеричной) цифрой

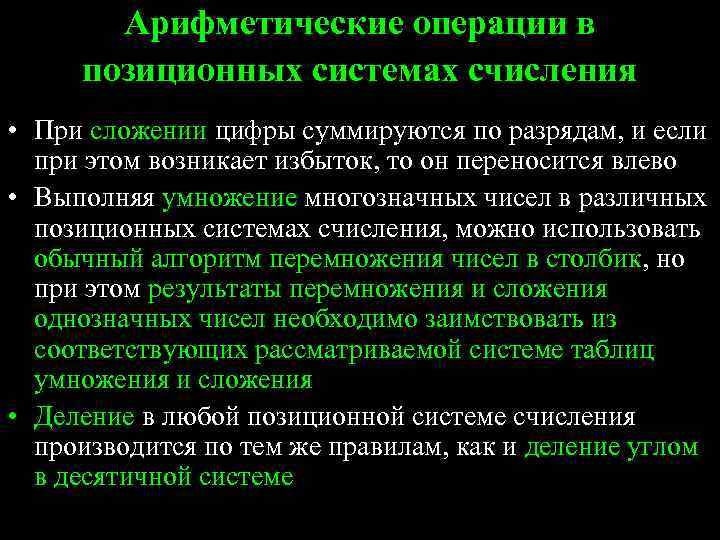

Арифметические операции в позиционных системах счисления • При сложении цифры суммируются по разрядам, и если при этом возникает избыток, то он переносится влево • Выполняя умножение многозначных чисел в различных позиционных системах счисления, можно использовать обычный алгоритм перемножения чисел в столбик, но при этом результаты перемножения и сложения однозначных чисел необходимо заимствовать из соответствующих рассматриваемой системе таблиц умножения и сложения • Деление в любой позиционной системе счисления производится по тем же правилам, как и деление углом в десятичной системе

Арифметические операции в позиционных системах счисления • При сложении цифры суммируются по разрядам, и если при этом возникает избыток, то он переносится влево • Выполняя умножение многозначных чисел в различных позиционных системах счисления, можно использовать обычный алгоритм перемножения чисел в столбик, но при этом результаты перемножения и сложения однозначных чисел необходимо заимствовать из соответствующих рассматриваемой системе таблиц умножения и сложения • Деление в любой позиционной системе счисления производится по тем же правилам, как и деление углом в десятичной системе

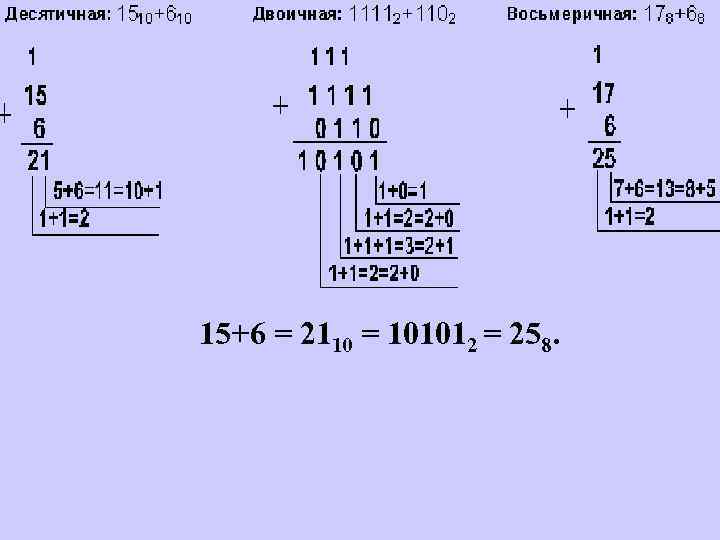

15+6 = 2110 = 101012 = 258.

15+6 = 2110 = 101012 = 258.

таблицы умножения

таблицы умножения

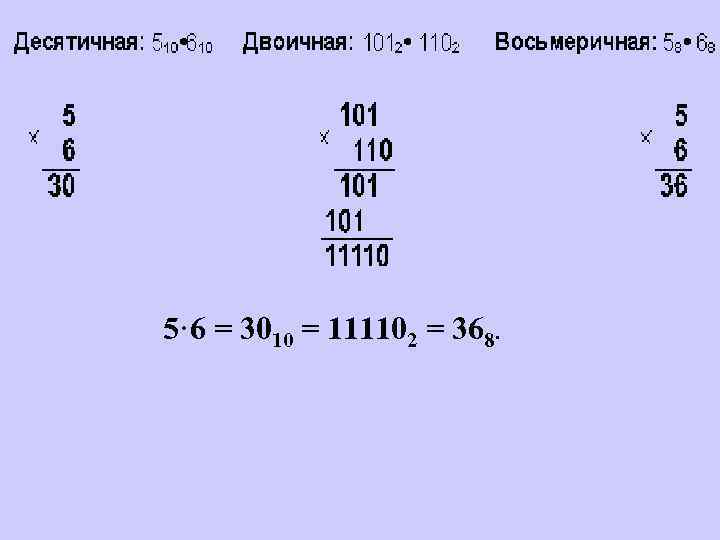

5· 6 = 3010 = 111102 = 368.

5· 6 = 3010 = 111102 = 368.

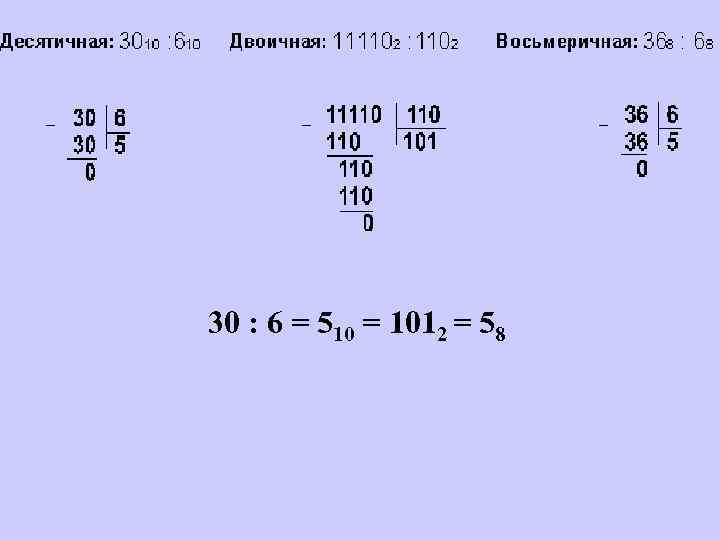

30 : 6 = 510 = 1012 = 58

30 : 6 = 510 = 1012 = 58

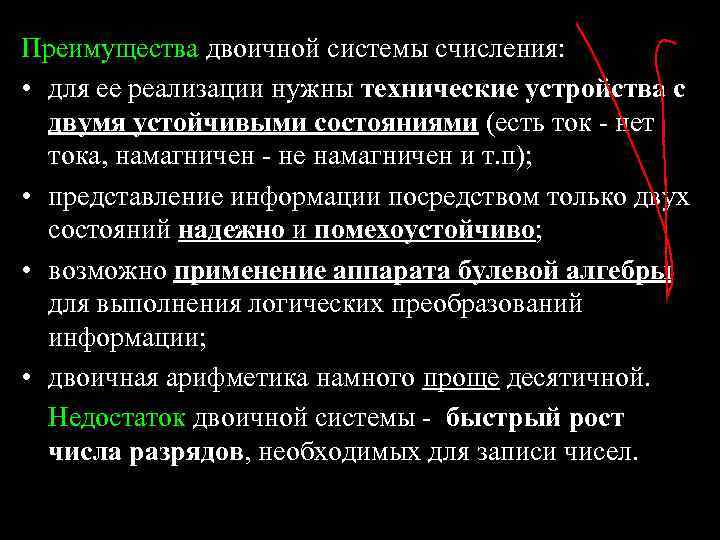

Преимущества двоичной системы счисления: • для ее реализации нужны технические устройства с двумя устойчивыми состояниями (есть ток - нет тока, намагничен - не намагничен и т. п); • представление информации посредством только двух состояний надежно и помехоустойчиво; • возможно применение аппарата булевой алгебры для выполнения логических преобразований информации; • двоичная арифметика намного проще десятичной. Недостаток двоичной системы - быстрый рост числа разрядов, необходимых для записи чисел.

Преимущества двоичной системы счисления: • для ее реализации нужны технические устройства с двумя устойчивыми состояниями (есть ток - нет тока, намагничен - не намагничен и т. п); • представление информации посредством только двух состояний надежно и помехоустойчиво; • возможно применение аппарата булевой алгебры для выполнения логических преобразований информации; • двоичная арифметика намного проще десятичной. Недостаток двоичной системы - быстрый рост числа разрядов, необходимых для записи чисел.

Принципы представления (кодирования) данных -дискретизация -конечность

Принципы представления (кодирования) данных -дискретизация -конечность

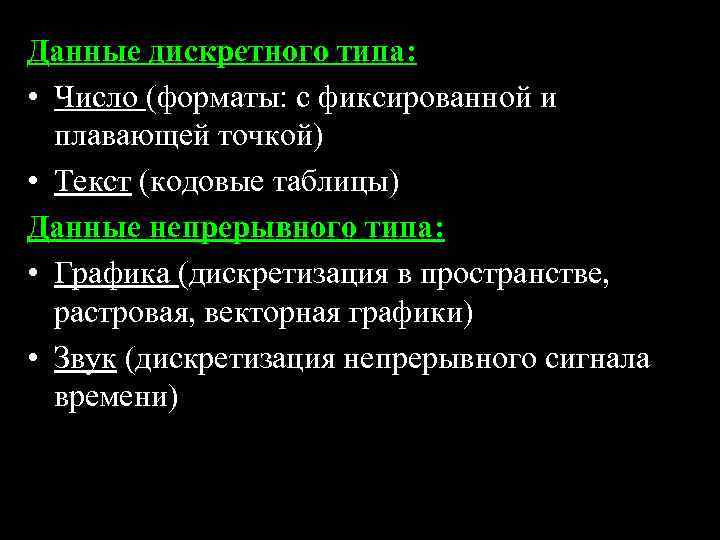

Данные дискретного типа: • Число (форматы: с фиксированной и плавающей точкой) • Текст (кодовые таблицы) Данные непрерывного типа: • Графика (дискретизация в пространстве, растровая, векторная графики) • Звук (дискретизация непрерывного сигнала времени)

Данные дискретного типа: • Число (форматы: с фиксированной и плавающей точкой) • Текст (кодовые таблицы) Данные непрерывного типа: • Графика (дискретизация в пространстве, растровая, векторная графики) • Звук (дискретизация непрерывного сигнала времени)

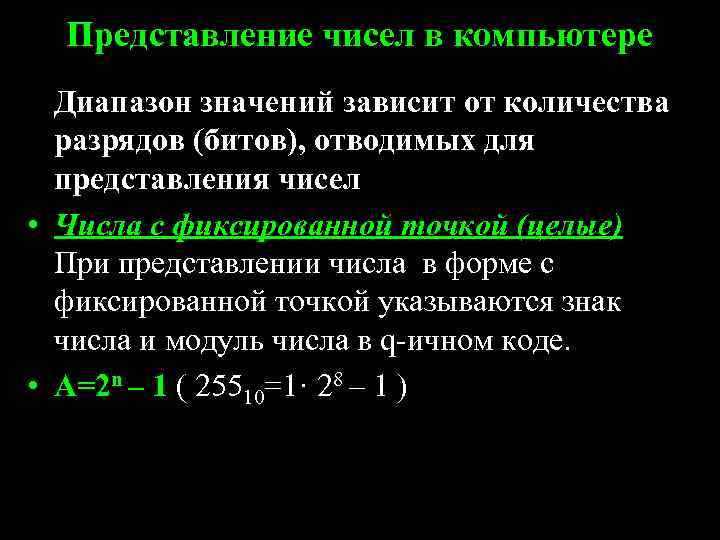

Представление чисел в компьютере Диапазон значений зависит от количества разрядов (битов), отводимых для представления чисел • Числа с фиксированной точкой (целые) При представлении числа в форме с фиксированной точкой указываются знак числа и модуль числа в q-ичном коде. • A=2 n – 1 ( 25510=1· 28 – 1 )

Представление чисел в компьютере Диапазон значений зависит от количества разрядов (битов), отводимых для представления чисел • Числа с фиксированной точкой (целые) При представлении числа в форме с фиксированной точкой указываются знак числа и модуль числа в q-ичном коде. • A=2 n – 1 ( 25510=1· 28 – 1 )

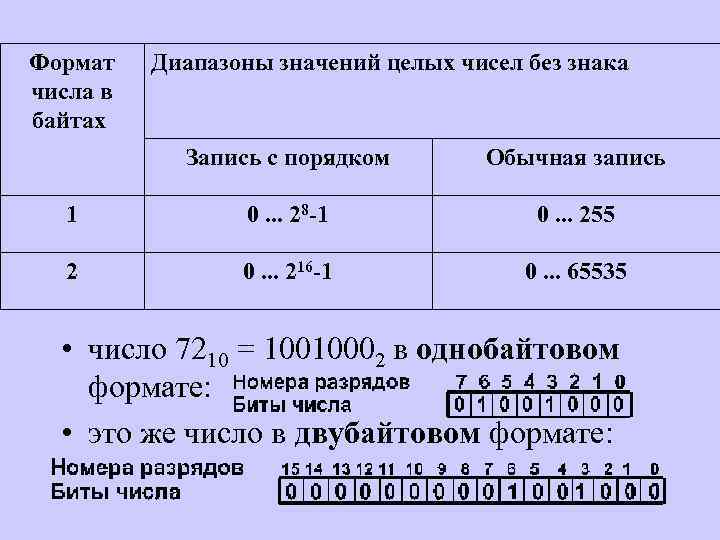

Формат числа в байтах Диапазоны значений целых чисел без знака Запись с порядком Обычная запись 1 0. . . 28 -1 0. . . 255 2 0. . . 216 -1 0. . . 65535 • число 7210 = 10010002 в однобайтовом формате: • это же число в двубайтовом формате:

Формат числа в байтах Диапазоны значений целых чисел без знака Запись с порядком Обычная запись 1 0. . . 28 -1 0. . . 255 2 0. . . 216 -1 0. . . 65535 • число 7210 = 10010002 в однобайтовом формате: • это же число в двубайтовом формате:

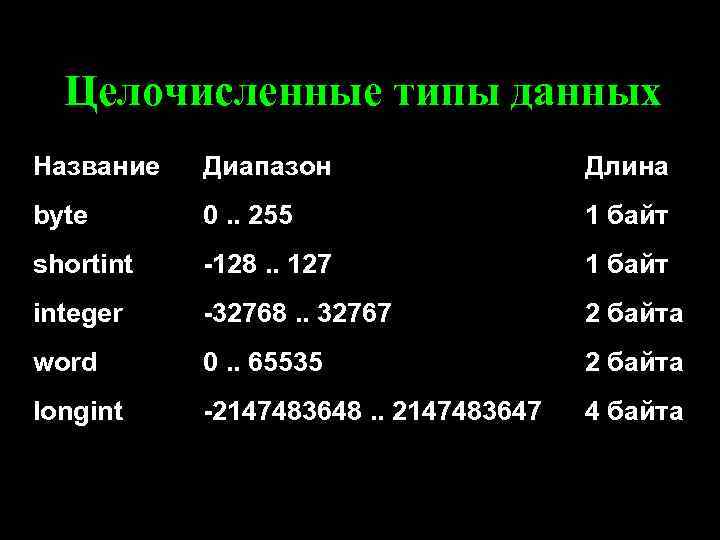

Целочисленные типы данных Название Диапазон Длина byte 0. . 255 1 байт shortint -128. . 127 1 байт integer -32768. . 32767 2 байта word 0. . 65535 2 байта longint -2147483648. . 2147483647 4 байта

Целочисленные типы данных Название Диапазон Длина byte 0. . 255 1 байт shortint -128. . 127 1 байт integer -32768. . 32767 2 байта word 0. . 65535 2 байта longint -2147483648. . 2147483647 4 байта

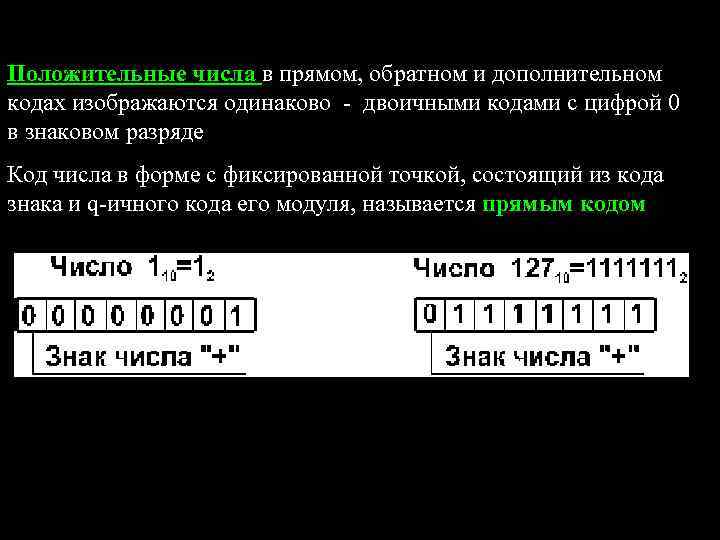

Положительные числа в прямом, обратном и дополнительном кодах изображаются одинаково - двоичными кодами с цифрой 0 в знаковом разряде Код числа в форме с фиксированной точкой, состоящий из кода знака и q-ичного кода его модуля, называется прямым кодом

Положительные числа в прямом, обратном и дополнительном кодах изображаются одинаково - двоичными кодами с цифрой 0 в знаковом разряде Код числа в форме с фиксированной точкой, состоящий из кода знака и q-ичного кода его модуля, называется прямым кодом

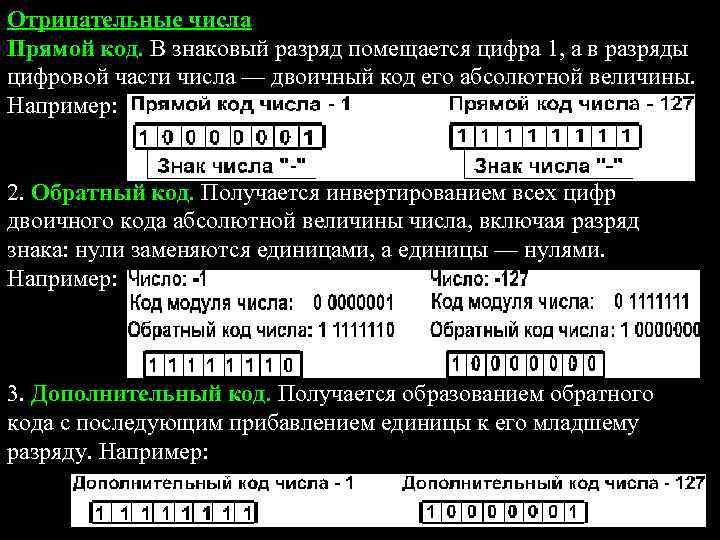

Отрицательные числа Прямой код. В знаковый разряд помещается цифра 1, а в разряды цифровой части числа — двоичный код его абсолютной величины. Например: 2. Обратный код. Получается инвертированием всех цифр двоичного кода абсолютной величины числа, включая разряд знака: нули заменяются единицами, а единицы — нулями. Например: 3. Дополнительный код. Получается образованием обратного кода с последующим прибавлением единицы к его младшему разряду. Например: .

Отрицательные числа Прямой код. В знаковый разряд помещается цифра 1, а в разряды цифровой части числа — двоичный код его абсолютной величины. Например: 2. Обратный код. Получается инвертированием всех цифр двоичного кода абсолютной величины числа, включая разряд знака: нули заменяются единицами, а единицы — нулями. Например: 3. Дополнительный код. Получается образованием обратного кода с последующим прибавлением единицы к его младшему разряду. Например: .

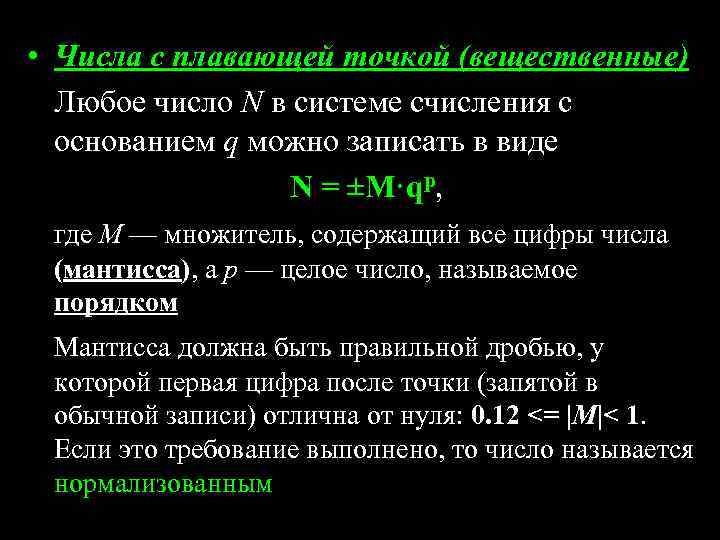

• Числа с плавающей точкой (вещественные) Любое число N в системе счисления с основанием q можно записать в виде N = ±M·qp, где M — множитель, содержащий все цифры числа (мантисса), а p — целое число, называемое порядком Мантисса должна быть правильной дробью, у которой первая цифра после точки (запятой в обычной записи) отлична от нуля: 0. 12 <= |M|< 1. Если это требование выполнено, то число называется нормализованным

• Числа с плавающей точкой (вещественные) Любое число N в системе счисления с основанием q можно записать в виде N = ±M·qp, где M — множитель, содержащий все цифры числа (мантисса), а p — целое число, называемое порядком Мантисса должна быть правильной дробью, у которой первая цифра после точки (запятой в обычной записи) отлична от нуля: 0. 12 <= |M|< 1. Если это требование выполнено, то число называется нормализованным

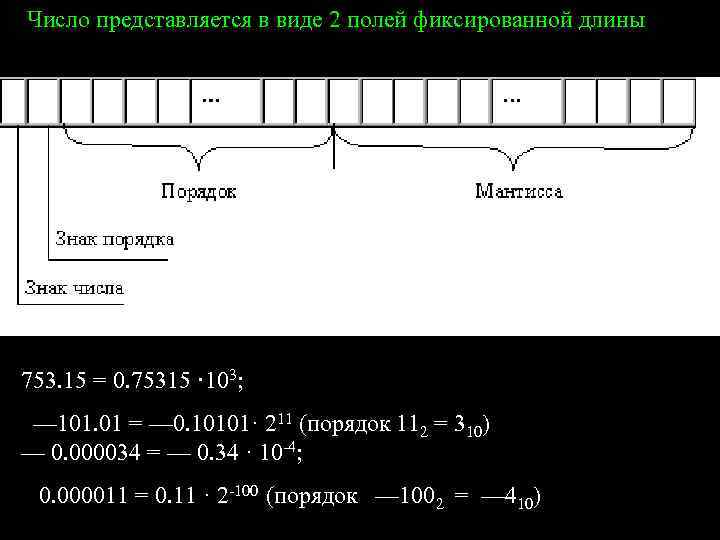

Число представляется в виде 2 полей фиксированной длины 753. 15 = 0. 75315 · 103; — 101. 01 = — 0. 10101· 211 (порядок 112 = 310) — 0. 000034 = — 0. 34 · 10 -4; 0. 000011 = 0. 11 · 2 -100 (порядок — 1002 = — 410)

Число представляется в виде 2 полей фиксированной длины 753. 15 = 0. 75315 · 103; — 101. 01 = — 0. 10101· 211 (порядок 112 = 310) — 0. 000034 = — 0. 34 · 10 -4; 0. 000011 = 0. 11 · 2 -100 (порядок — 1002 = — 410)

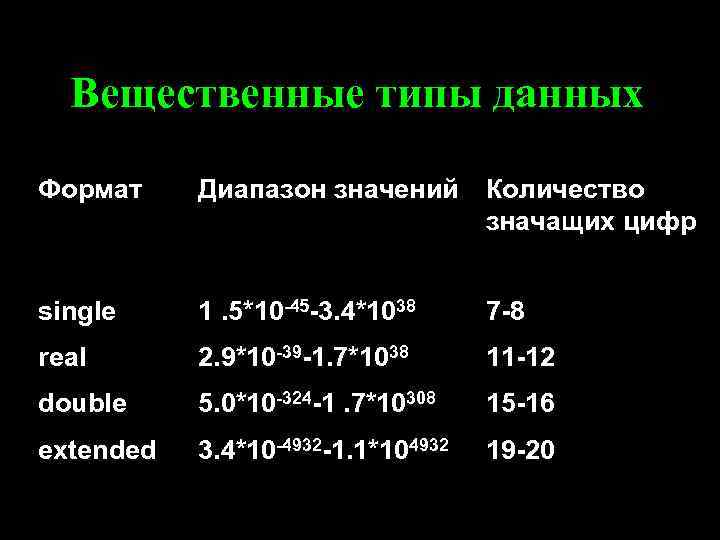

Вещественные типы данных Формат Диапазон значений Количество значащих цифр single 1. 5*10 -45 -3. 4*1038 7 -8 real 2. 9*10 -39 -1. 7*1038 11 -12 double 5. 0*10 -324 -1. 7*10308 15 -16 extended 3. 4*10 -4932 -1. 1*104932 19 -20

Вещественные типы данных Формат Диапазон значений Количество значащих цифр single 1. 5*10 -45 -3. 4*1038 7 -8 real 2. 9*10 -39 -1. 7*1038 11 -12 double 5. 0*10 -324 -1. 7*10308 15 -16 extended 3. 4*10 -4932 -1. 1*104932 19 -20

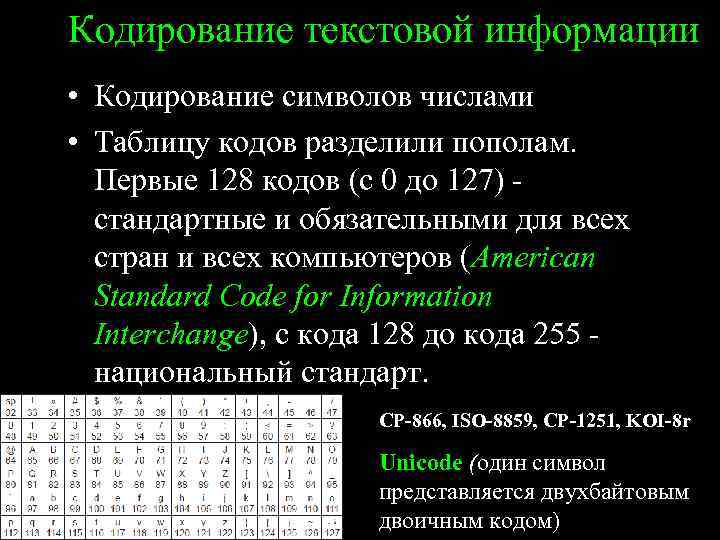

Кодирование текстовой информации • Кодирование символов числами • Таблицу кодов разделили пополам. Первые 128 кодов (с 0 до 127) - стандартные и обязательными для всех стран и всех компьютеров (American Standard Code for Information Interchange), с кода 128 до кода 255 - национальный стандарт. CP-866, ISO-8859, CP-1251, KOI-8 r Unicode (один символ представляется двухбайтовым двоичным кодом)

Кодирование текстовой информации • Кодирование символов числами • Таблицу кодов разделили пополам. Первые 128 кодов (с 0 до 127) - стандартные и обязательными для всех стран и всех компьютеров (American Standard Code for Information Interchange), с кода 128 до кода 255 - национальный стандарт. CP-866, ISO-8859, CP-1251, KOI-8 r Unicode (один символ представляется двухбайтовым двоичным кодом)

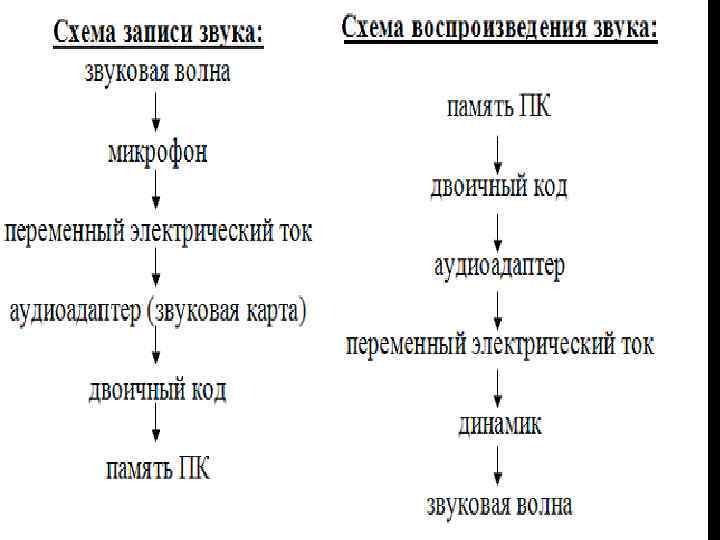

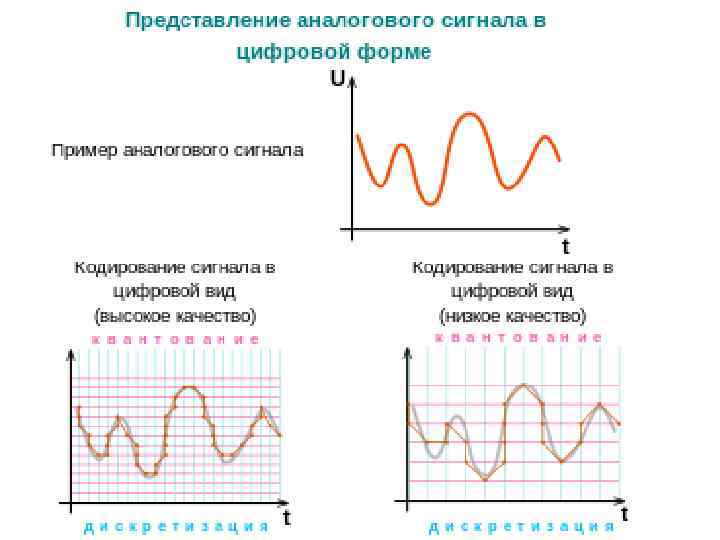

Кодирование звуковой информации В основе кодирования звука с использованием ПК лежит процесс преобразования колебаний воздуха в колебания электрического тока и последующая дискретизация аналогового • б) электрического сигнала.

Кодирование звуковой информации В основе кодирования звука с использованием ПК лежит процесс преобразования колебаний воздуха в колебания электрического тока и последующая дискретизация аналогового • б) электрического сигнала.

• Звукозапись – процесс сохранения информации о параметрах звуковой волны Основные параметры: - частота колебаний (Гц) - амплитуда колебаний

• Звукозапись – процесс сохранения информации о параметрах звуковой волны Основные параметры: - частота колебаний (Гц) - амплитуда колебаний

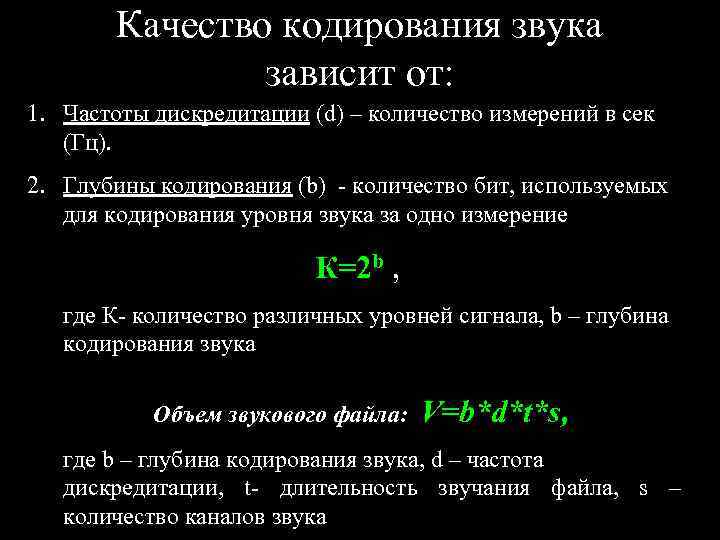

Качество кодирования звука зависит от: 1. Частоты дискредитации (d) – количество измерений в сек (Гц). 2. Глубины кодирования (b) - количество бит, используемых для кодирования уровня звука за одно измерение К=2 b , где К- количество различных уровней сигнала, b – глубина кодирования звука Объем звукового файла: V=b*d*t*s, где b – глубина кодирования звука, d – частота дискредитации, t- длительность звучания файла, s – количество каналов звука

Качество кодирования звука зависит от: 1. Частоты дискредитации (d) – количество измерений в сек (Гц). 2. Глубины кодирования (b) - количество бит, используемых для кодирования уровня звука за одно измерение К=2 b , где К- количество различных уровней сигнала, b – глубина кодирования звука Объем звукового файла: V=b*d*t*s, где b – глубина кодирования звука, d – частота дискредитации, t- длительность звучания файла, s – количество каналов звука

на с/р: • Вычитание, умножение, деление в позиционной системе счисления (общие представления) • кодирование звуковой информации

на с/р: • Вычитание, умножение, деление в позиционной системе счисления (общие представления) • кодирование звуковой информации