Эконометрика(з) 1 часть.ppt

- Количество слайдов: 78

Лекции по эконометрике Тема 1. Введение

Лекции по эконометрике Тема 1. Введение

1 Предмет эконометрики Эконометрика – наука, цель которой состоит в том, чтобы количественно выражать экономические закономерности. Эконометрика находится на стыке экономической теории и математической статистики. Типовая задача эконометрики состоит в том, чтобы на базе экономической теории построить эконометрическую (математическую) модель исследуемого процесса или явления, затем оценить ее качество, адекватность проведенным наблюдениям и в случае положительного результата оценки качества модели применять ее для прогнозирования исследуемого процесса или явления, моделирования, управления и для других целей.

1 Предмет эконометрики Эконометрика – наука, цель которой состоит в том, чтобы количественно выражать экономические закономерности. Эконометрика находится на стыке экономической теории и математической статистики. Типовая задача эконометрики состоит в том, чтобы на базе экономической теории построить эконометрическую (математическую) модель исследуемого процесса или явления, затем оценить ее качество, адекватность проведенным наблюдениям и в случае положительного результата оценки качества модели применять ее для прогнозирования исследуемого процесса или явления, моделирования, управления и для других целей.

Пространственные и временные эконометрические модели 1 Эконометрическую модель можно построить, используя три типа исходных данных: • данные, характеризующие совокупность различных объектов в определенный момент (период) времени; • данные, характеризующие один объект за ряд последовательных моментов (периодов) времени. • данные, характеризующие совокупность объектов за ряд последовательных моментов (периодов) времени. Модели, построенные по данным первого типа, называются пространственными моделями. К их числу относятся модели парной и множественной регрессии. Модели, построенные на основе второго типа данных, называются моделями временных рядов.

Пространственные и временные эконометрические модели 1 Эконометрическую модель можно построить, используя три типа исходных данных: • данные, характеризующие совокупность различных объектов в определенный момент (период) времени; • данные, характеризующие один объект за ряд последовательных моментов (периодов) времени. • данные, характеризующие совокупность объектов за ряд последовательных моментов (периодов) времени. Модели, построенные по данным первого типа, называются пространственными моделями. К их числу относятся модели парной и множественной регрессии. Модели, построенные на основе второго типа данных, называются моделями временных рядов.

Модели парной и множественной регрессии 1 Модели парной или множественной регрессии, описывает связь некоторого результативного показателя (объясняемой переменной) с одним или несколькими факторами (объясняющими переменными). Эта связь носит стохастический характер. Для наиболее распространенной в эконометрических приложениях линейной формы представления рассматриваемой зависимости модели регрессии имеют следующий вид. Парная регрессия: y = a + b * x + Множественная регрессия: y = a + b 1 * x 1 + b 2 * x 2 + … + bm * xm + Детерминированная компонента модели регрессии называется уравнением регрессии.

Модели парной и множественной регрессии 1 Модели парной или множественной регрессии, описывает связь некоторого результативного показателя (объясняемой переменной) с одним или несколькими факторами (объясняющими переменными). Эта связь носит стохастический характер. Для наиболее распространенной в эконометрических приложениях линейной формы представления рассматриваемой зависимости модели регрессии имеют следующий вид. Парная регрессия: y = a + b * x + Множественная регрессия: y = a + b 1 * x 1 + b 2 * x 2 + … + bm * xm + Детерминированная компонента модели регрессии называется уравнением регрессии.

1 Параметры моделей регрессии В рассматриваемых моделях регрессии приняты следующие обозначения: y - величина результативного показателя, x – значение фактора-аргумента в парной регрессии, x 1, x 2, … , xn - значения факторов-аргументов в множественной регрессии. Параметры моделей регрессии: a, b – в парной регрессии; a, b 1, b 2, … , bn – в множественной регрессии определяются методом наименьших квадратов (МНК) по данным наблюдений. Остаточный член является случайной величиной, отражающей действие других, не учтенных в уравнении регрессии, факторов случайной природы. По величине остаточного члена и его свойствам судят о качестве модели регрессии, возможности ее практического применения.

1 Параметры моделей регрессии В рассматриваемых моделях регрессии приняты следующие обозначения: y - величина результативного показателя, x – значение фактора-аргумента в парной регрессии, x 1, x 2, … , xn - значения факторов-аргументов в множественной регрессии. Параметры моделей регрессии: a, b – в парной регрессии; a, b 1, b 2, … , bn – в множественной регрессии определяются методом наименьших квадратов (МНК) по данным наблюдений. Остаточный член является случайной величиной, отражающей действие других, не учтенных в уравнении регрессии, факторов случайной природы. По величине остаточного члена и его свойствам судят о качестве модели регрессии, возможности ее практического применения.

1 Временной ряд – это совокупность значений (уровней) какого-либо показателя за несколько последовательных моментов или периодов. Каждый уровень временного ряда формируется под воздействием факторов, которые можно подразделить на три группы: · факторы, формирующие тенденцию ряда (тренд); · факторы, формирующие циклические колебания ряда; · случайные факторы. Основная задача эконометрического анализа временного ряда – выявление и придание количественного выражения трендовой, циклической и случайной компонентам с тем, чтобы использовать полученную информацию для прогнозирования будущих значений ряда или при построении моделей взаимосвязи двух и более временных рядов.

1 Временной ряд – это совокупность значений (уровней) какого-либо показателя за несколько последовательных моментов или периодов. Каждый уровень временного ряда формируется под воздействием факторов, которые можно подразделить на три группы: · факторы, формирующие тенденцию ряда (тренд); · факторы, формирующие циклические колебания ряда; · случайные факторы. Основная задача эконометрического анализа временного ряда – выявление и придание количественного выражения трендовой, циклической и случайной компонентам с тем, чтобы использовать полученную информацию для прогнозирования будущих значений ряда или при построении моделей взаимосвязи двух и более временных рядов.

1 Система одновременных уравнений Объектом эконометрического анализа в экономике и социологии, особенно на макроуровне, может быть сложная система. Построение изолированных уравнений регрессии недостаточно для описания такого объекта и объяснения механизма его функционирования. Поэтому применяется система так называемых одновременных уравнений, называемых также структурными уравнениями. В ней одни и те же переменные одновременно рассматриваются как зависимые в одних уравнениях и как независимые в других. Простейшая структурная форма модели имеет вид: где y 1, y 2, - зависимые, так называемые эндогенные переменные, число которых равно числу уравнений в системе; x 1, x 2, - экзогенные (предопределенные, “внешние”) переменные, влияющие на эндогенные переменные, но не зависящие от них.

1 Система одновременных уравнений Объектом эконометрического анализа в экономике и социологии, особенно на макроуровне, может быть сложная система. Построение изолированных уравнений регрессии недостаточно для описания такого объекта и объяснения механизма его функционирования. Поэтому применяется система так называемых одновременных уравнений, называемых также структурными уравнениями. В ней одни и те же переменные одновременно рассматриваются как зависимые в одних уравнениях и как независимые в других. Простейшая структурная форма модели имеет вид: где y 1, y 2, - зависимые, так называемые эндогенные переменные, число которых равно числу уравнений в системе; x 1, x 2, - экзогенные (предопределенные, “внешние”) переменные, влияющие на эндогенные переменные, но не зависящие от них.

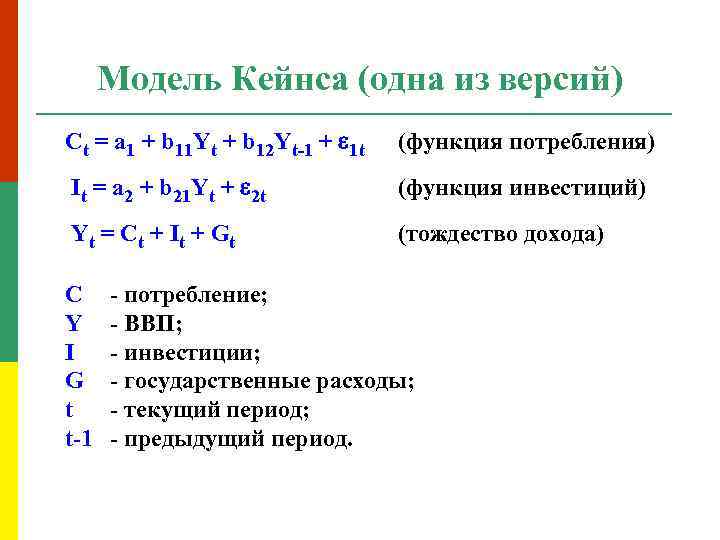

Модель Кейнса (одна из версий) Ct = a 1 + b 11 Yt + b 12 Yt-1 + 1 t (функция потребления) It = a 2 + b 21 Yt + 2 t (функция инвестиций) Yt = Ct + It + Gt (тождество дохода) C Y I G t t-1 - потребление; - ВВП; - инвестиции; - государственные расходы; - текущий период; - предыдущий период.

Модель Кейнса (одна из версий) Ct = a 1 + b 11 Yt + b 12 Yt-1 + 1 t (функция потребления) It = a 2 + b 21 Yt + 2 t (функция инвестиций) Yt = Ct + It + Gt (тождество дохода) C Y I G t t-1 - потребление; - ВВП; - инвестиции; - государственные расходы; - текущий период; - предыдущий период.

Методы и области применения эконометрики Методы: регрессионный анализ; анализ временных рядов; системы одновременных уравнений; статистические методы классификации Приложения: макроуровень (модели национальной экономики); мезоуровень (модели региональной экономики, отраслей, секторов); микроуровень (модели поведения потребителей, фирм, предприятий, домашних хозяйств). 1

Методы и области применения эконометрики Методы: регрессионный анализ; анализ временных рядов; системы одновременных уравнений; статистические методы классификации Приложения: макроуровень (модели национальной экономики); мезоуровень (модели региональной экономики, отраслей, секторов); микроуровень (модели поведения потребителей, фирм, предприятий, домашних хозяйств). 1

Методическое обеспечение Список литературы 1. Эконометрика: Учебник / Под ред. И. И. Елисеевой. – М. : Финансы и статистика, 2001. – 344 с. : ил. 2. Эконометрика: Учебник / И. И. Елисеева, С. В. Курышева, Т. В. Костеева и др. ; Под ред. И. И. Елисеевой. – 2 -е изд. , перераб. и доп. - М. : Финансы и статистика, 2005. – 576 с. : ил. 3. Практикум по эконометрике: Учеб. пособие / И. И. Елисеева, С. В. Курышева, Н. М. Гордеенко и др. ; Под ред. И. И. Елисеевой. – М. : Финансы и статистика, 2002. – 192 с. : ил. Электронные документы (в сетевой папке Server) Эконометрика(з). xls, Эконометрика – методические указания. doc, Вопросы экзаменационных билетов. doc, Эконометрика(з). ppt

Методическое обеспечение Список литературы 1. Эконометрика: Учебник / Под ред. И. И. Елисеевой. – М. : Финансы и статистика, 2001. – 344 с. : ил. 2. Эконометрика: Учебник / И. И. Елисеева, С. В. Курышева, Т. В. Костеева и др. ; Под ред. И. И. Елисеевой. – 2 -е изд. , перераб. и доп. - М. : Финансы и статистика, 2005. – 576 с. : ил. 3. Практикум по эконометрике: Учеб. пособие / И. И. Елисеева, С. В. Курышева, Н. М. Гордеенко и др. ; Под ред. И. И. Елисеевой. – М. : Финансы и статистика, 2002. – 192 с. : ил. Электронные документы (в сетевой папке Server) Эконометрика(з). xls, Эконометрика – методические указания. doc, Вопросы экзаменационных билетов. doc, Эконометрика(з). ppt

Тема 2. Парная регрессия и корреляция

Тема 2. Парная регрессия и корреляция

2. 1. Спецификация модели парной регрессии Спецификация модели – обоснованный с позиций экономической теории выбор вида и структуры модели, отбор факторов и математическое описание характера их влияния на результирующий признак

2. 1. Спецификация модели парной регрессии Спецификация модели – обоснованный с позиций экономической теории выбор вида и структуры модели, отбор факторов и математическое описание характера их влияния на результирующий признак

Модель парной регрессии в общем виде 2 Парная регрессия – это уравнение связи двух переменных y и x: y = f (x) + , где y – зависимая переменная (результативный признак, объясняемая переменная); x – независимая переменная (фактор-аргумент, объясняющая переменная); f(x) – функция регрессии (или просто регрессия); - остаточный член (регрессионный остаток), отражающий действие не учтенных в уравнении регрессии факторов случайной природы. Расчетное значении зависимой переменной, вычисляемое с помощью функции регрессии для заданной величины аргумента, будем обозначать как - уравнение регрессии.

Модель парной регрессии в общем виде 2 Парная регрессия – это уравнение связи двух переменных y и x: y = f (x) + , где y – зависимая переменная (результативный признак, объясняемая переменная); x – независимая переменная (фактор-аргумент, объясняющая переменная); f(x) – функция регрессии (или просто регрессия); - остаточный член (регрессионный остаток), отражающий действие не учтенных в уравнении регрессии факторов случайной природы. Расчетное значении зависимой переменной, вычисляемое с помощью функции регрессии для заданной величины аргумента, будем обозначать как - уравнение регрессии.

2 Линейные и нелинейные регрессии Различают линейные и нелинейные регрессии. Модель линейной регрессии записывается в следующем виде: y = a + b * x + Нелинейные регрессии: · полином y = a + b 1 * x + b 2 * x 2 + b 3 * x 3 + ; · гипербола · степенная · показательная y = a * xb * ; y = a * bx * ; · экспоненциальная y = e a + b * x * . a – свободный член уравнения регрессии; b – коэффициент регрессии.

2 Линейные и нелинейные регрессии Различают линейные и нелинейные регрессии. Модель линейной регрессии записывается в следующем виде: y = a + b * x + Нелинейные регрессии: · полином y = a + b 1 * x + b 2 * x 2 + b 3 * x 3 + ; · гипербола · степенная · показательная y = a * xb * ; y = a * bx * ; · экспоненциальная y = e a + b * x * . a – свободный член уравнения регрессии; b – коэффициент регрессии.

Примеры использования нелинейных 2 регрессий в эконометрике Равносторонняя гипербола получившая в экономической литературе название кривой Филлипса характеризует соотношение между уровнем безработицы x и заработной платой y. Она отражает тот факт, что с ростом уровня безработицы темп прироста заработной платы падает и в пределе стремится к нулю. Гипербола с отрицательным значением коэффициента b известна как кривая Энгеля – по имени немецкого статистика, впервые показавшего зависимость семейных расходов на товары длительного пользования y от величины семейного дохода x

Примеры использования нелинейных 2 регрессий в эконометрике Равносторонняя гипербола получившая в экономической литературе название кривой Филлипса характеризует соотношение между уровнем безработицы x и заработной платой y. Она отражает тот факт, что с ростом уровня безработицы темп прироста заработной платы падает и в пределе стремится к нулю. Гипербола с отрицательным значением коэффициента b известна как кривая Энгеля – по имени немецкого статистика, впервые показавшего зависимость семейных расходов на товары длительного пользования y от величины семейного дохода x

Функция спроса и коэффициент эластичности 3 Коэффициент эластичности характеризует относительный прирост значения функции y ( в процентах) при увеличении x на один процент и вычисляется по формуле: При изучении зависимости величины спроса y от цены товара x используется степенная функция y = a * xb * (b < 0) Для степенной функции коэффициент эластичности равен b и не меняется при изменении x. В функции спроса величина b отрицательна, ее абсолютное значение характеризует уменьшение спроса в процентах на каждый процент возрастания цены товара.

Функция спроса и коэффициент эластичности 3 Коэффициент эластичности характеризует относительный прирост значения функции y ( в процентах) при увеличении x на один процент и вычисляется по формуле: При изучении зависимости величины спроса y от цены товара x используется степенная функция y = a * xb * (b < 0) Для степенной функции коэффициент эластичности равен b и не меняется при изменении x. В функции спроса величина b отрицательна, ее абсолютное значение характеризует уменьшение спроса в процентах на каждый процент возрастания цены товара.

Коэффициенты эластичности некоторых функций Вид функции Линейная y = a + b * x Первая производная Коэффициент эластичности b Гипербола Показательная y = a * bx lnb* a * bx x * lnb Степенная a*b * xb-1 b b * e a + b * x xb y = a * Логарифмическая y = a + b * lnx Экспоненциальная y = e a + b * x 3

Коэффициенты эластичности некоторых функций Вид функции Линейная y = a + b * x Первая производная Коэффициент эластичности b Гипербола Показательная y = a * bx lnb* a * bx x * lnb Степенная a*b * xb-1 b b * e a + b * x xb y = a * Логарифмическая y = a + b * lnx Экспоненциальная y = e a + b * x 3

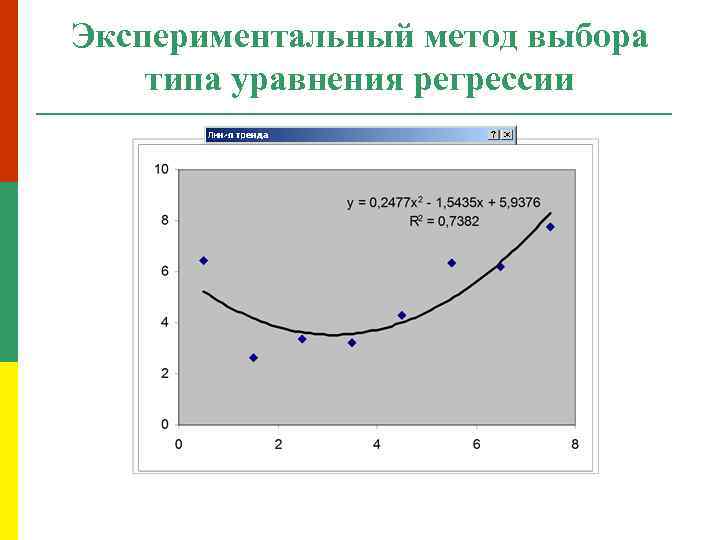

Экспериментальный метод выбора типа уравнения регрессии

Экспериментальный метод выбора типа уравнения регрессии

2. 2. Оценка параметров парной регрессии и корреляции Идентификация модели – статистическое оценивание параметров модели по выборочным данным

2. 2. Оценка параметров парной регрессии и корреляции Идентификация модели – статистическое оценивание параметров модели по выборочным данным

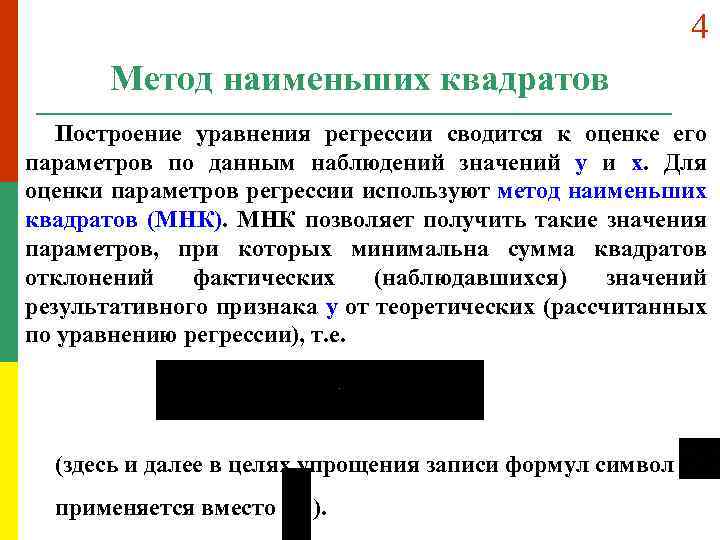

4 Метод наименьших квадратов Построение уравнения регрессии сводится к оценке его параметров по данным наблюдений значений y и x. Для оценки параметров регрессии используют метод наименьших квадратов (МНК). МНК позволяет получить такие значения параметров, при которых минимальна сумма квадратов отклонений фактических (наблюдавшихся) значений результативного признака y от теоретических (рассчитанных по уравнению регрессии), т. е. (здесь и далее в целях упрощения записи формул символ применяется вместо ).

4 Метод наименьших квадратов Построение уравнения регрессии сводится к оценке его параметров по данным наблюдений значений y и x. Для оценки параметров регрессии используют метод наименьших квадратов (МНК). МНК позволяет получить такие значения параметров, при которых минимальна сумма квадратов отклонений фактических (наблюдавшихся) значений результативного признака y от теоретических (рассчитанных по уравнению регрессии), т. е. (здесь и далее в целях упрощения записи формул символ применяется вместо ).

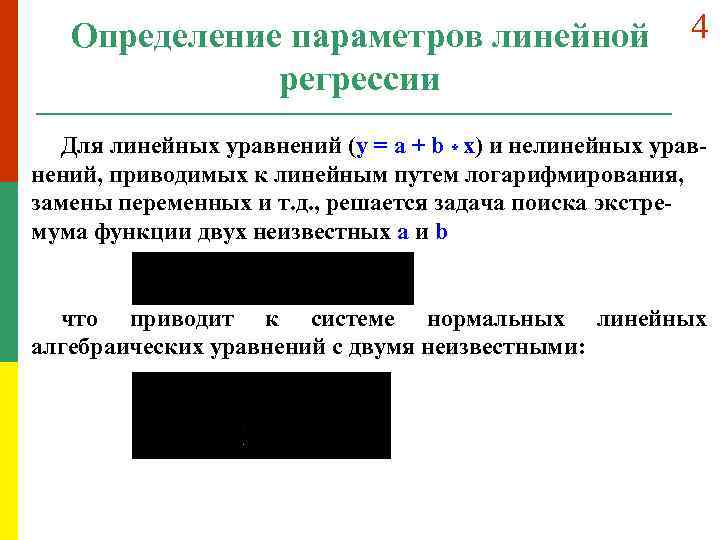

Определение параметров линейной 4 регрессии Для линейных уравнений (y = a + b * x) и нелинейных уравнений, приводимых к линейным путем логарифмирования, замены переменных и т. д. , решается задача поиска экстремума функции двух неизвестных a и b что приводит к системе нормальных линейных алгебраических уравнений с двумя неизвестными:

Определение параметров линейной 4 регрессии Для линейных уравнений (y = a + b * x) и нелинейных уравнений, приводимых к линейным путем логарифмирования, замены переменных и т. д. , решается задача поиска экстремума функции двух неизвестных a и b что приводит к системе нормальных линейных алгебраических уравнений с двумя неизвестными:

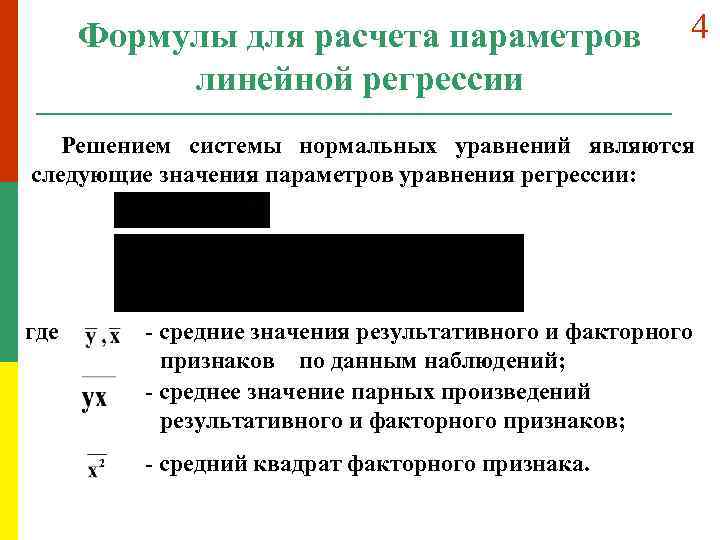

Формулы для расчета параметров линейной регрессии 4 Решением системы нормальных уравнений являются следующие значения параметров уравнения регрессии: где - средние значения результативного и факторного признаков по данным наблюдений; - среднее значение парных произведений результативного и факторного признаков; - средний квадрат факторного признака.

Формулы для расчета параметров линейной регрессии 4 Решением системы нормальных уравнений являются следующие значения параметров уравнения регрессии: где - средние значения результативного и факторного признаков по данным наблюдений; - среднее значение парных произведений результативного и факторного признаков; - средний квадрат факторного признака.

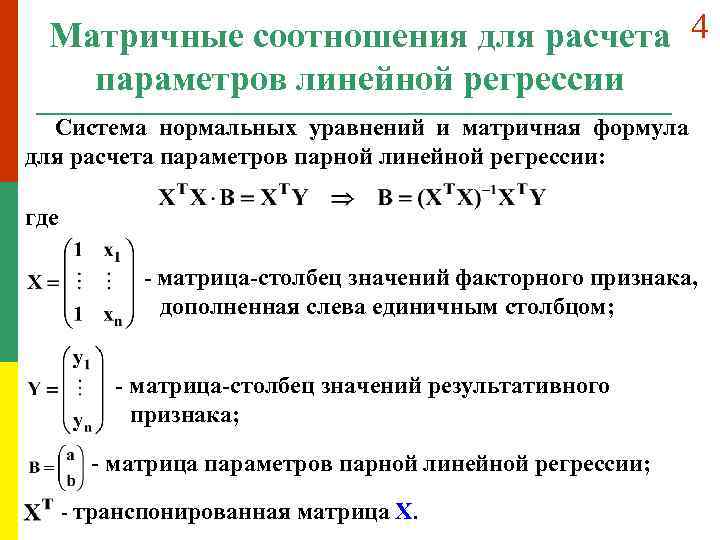

Матричные соотношения для расчета 4 параметров линейной регрессии Система нормальных уравнений и матричная формула для расчета параметров парной линейной регрессии: где - матрица-столбец значений факторного признака, дополненная слева единичным столбцом; - матрица-столбец значений результативного признака; - матрица параметров парной линейной регрессии; - транспонированная матрица X.

Матричные соотношения для расчета 4 параметров линейной регрессии Система нормальных уравнений и матричная формула для расчета параметров парной линейной регрессии: где - матрица-столбец значений факторного признака, дополненная слева единичным столбцом; - матрица-столбец значений результативного признака; - матрица параметров парной линейной регрессии; - транспонированная матрица X.

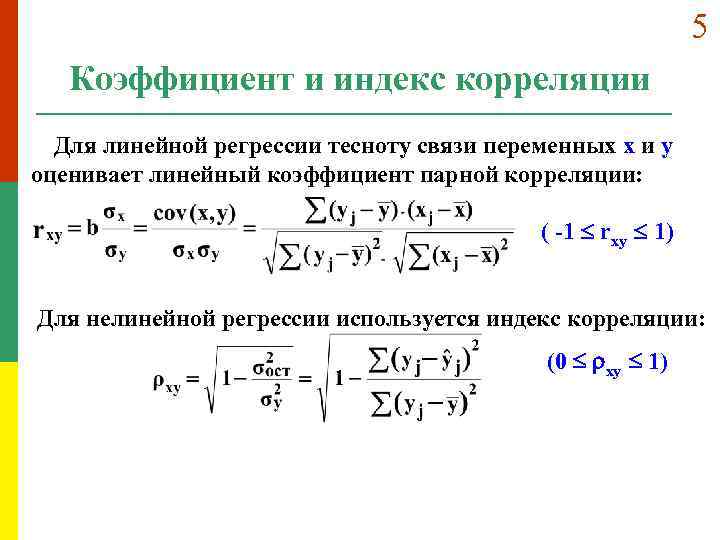

5 Коэффициент и индекс корреляции Для линейной регрессии тесноту связи переменных x и y оценивает линейный коэффициент парной корреляции: ( -1 £ rxy £ 1) Для нелинейной регрессии используется индекс корреляции: (0 £ xy £ 1)

5 Коэффициент и индекс корреляции Для линейной регрессии тесноту связи переменных x и y оценивает линейный коэффициент парной корреляции: ( -1 £ rxy £ 1) Для нелинейной регрессии используется индекс корреляции: (0 £ xy £ 1)

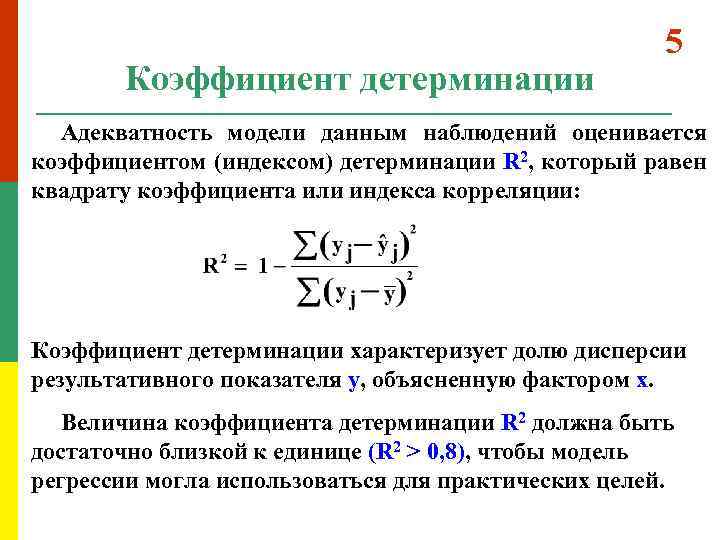

Коэффициент детерминации 5 Адекватность модели данным наблюдений оценивается коэффициентом (индексом) детерминации R 2, который равен квадрату коэффициента или индекса корреляции: Коэффициент детерминации характеризует долю дисперсии результативного показателя y, объясненную фактором x. Величина коэффициента детерминации R 2 должна быть достаточно близкой к единице (R 2 > 0, 8), чтобы модель регрессии могла использоваться для практических целей.

Коэффициент детерминации 5 Адекватность модели данным наблюдений оценивается коэффициентом (индексом) детерминации R 2, который равен квадрату коэффициента или индекса корреляции: Коэффициент детерминации характеризует долю дисперсии результативного показателя y, объясненную фактором x. Величина коэффициента детерминации R 2 должна быть достаточно близкой к единице (R 2 > 0, 8), чтобы модель регрессии могла использоваться для практических целей.

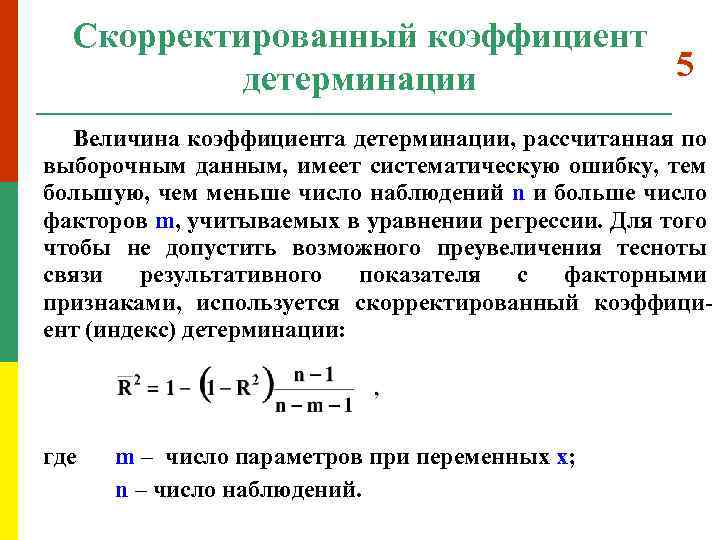

Скорректированный коэффициент 5 детерминации Величина коэффициента детерминации, рассчитанная по выборочным данным, имеет систематическую ошибку, тем большую, чем меньше число наблюдений n и больше число факторов m, учитываемых в уравнении регрессии. Для того чтобы не допустить возможного преувеличения тесноты связи результативного показателя с факторными признаками, используется скорректированный коэффициент (индекс) детерминации: где m – число параметров при переменных x; n – число наблюдений.

Скорректированный коэффициент 5 детерминации Величина коэффициента детерминации, рассчитанная по выборочным данным, имеет систематическую ошибку, тем большую, чем меньше число наблюдений n и больше число факторов m, учитываемых в уравнении регрессии. Для того чтобы не допустить возможного преувеличения тесноты связи результативного показателя с факторными признаками, используется скорректированный коэффициент (индекс) детерминации: где m – число параметров при переменных x; n – число наблюдений.

2. 3. Оценка качества эконометрической модели парной регрессии Верификация модели – статистическая проверка адекватности модели данным наблюдений

2. 3. Оценка качества эконометрической модели парной регрессии Верификация модели – статистическая проверка адекватности модели данным наблюдений

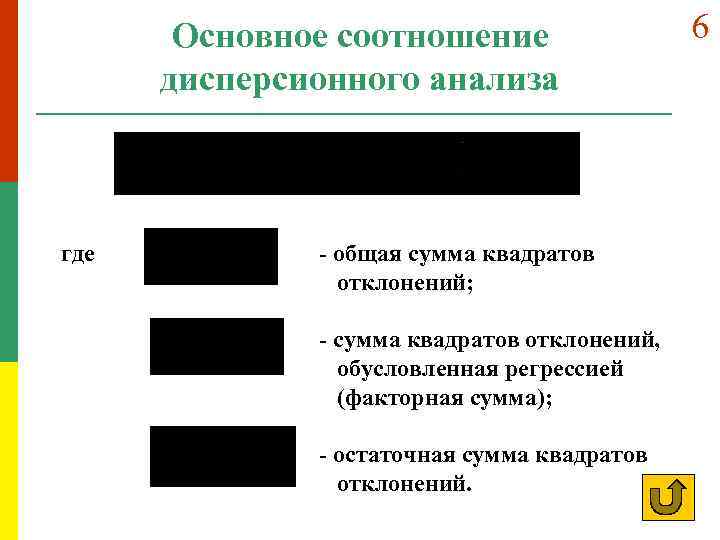

Основное соотношение дисперсионного анализа где - общая сумма квадратов отклонений; - сумма квадратов отклонений, обусловленная регрессией (факторная сумма); - остаточная сумма квадратов отклонений. 6

Основное соотношение дисперсионного анализа где - общая сумма квадратов отклонений; - сумма квадратов отклонений, обусловленная регрессией (факторная сумма); - остаточная сумма квадратов отклонений. 6

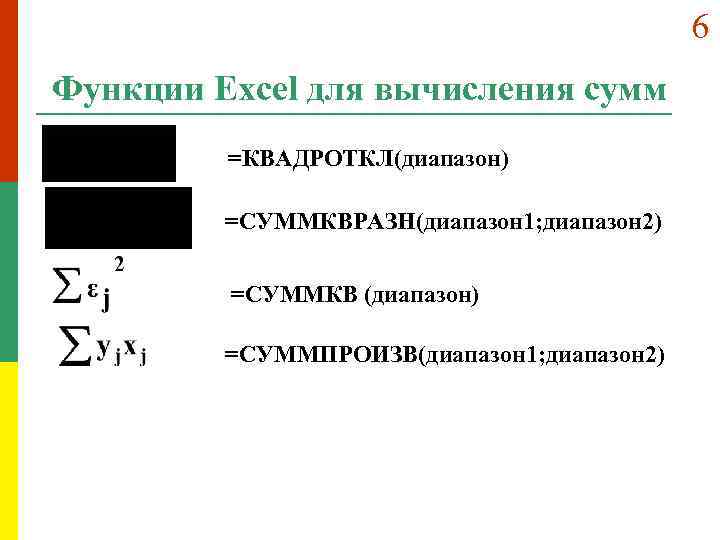

6 Функции Excel для вычисления сумм =КВАДРОТКЛ(диапазон) =СУММКВРАЗН(диапазон 1; диапазон 2) =СУММКВ (диапазон) =СУММПРОИЗВ(диапазон 1; диапазон 2)

6 Функции Excel для вычисления сумм =КВАДРОТКЛ(диапазон) =СУММКВРАЗН(диапазон 1; диапазон 2) =СУММКВ (диапазон) =СУММПРОИЗВ(диапазон 1; диапазон 2)

6 Число степеней свободы В статистике любая сумма квадратов отклонений связана с числом степеней свободы df (degress of freedom), которое показывает, сколько независимых отклонений из n возможных участвует в образовании данной суммы квадратов. Для парной регрессии основному соотношению дисперсионного анализа сопоставляется соотношение степеней свободы в виде: n – 1 = 1 + (n – 2) Для множественной регрессии соотношение степеней свободы записывается в виде: n – 1 = m + (n – m – 1), где n – число наблюдений, m – число факторов в модели регрессии.

6 Число степеней свободы В статистике любая сумма квадратов отклонений связана с числом степеней свободы df (degress of freedom), которое показывает, сколько независимых отклонений из n возможных участвует в образовании данной суммы квадратов. Для парной регрессии основному соотношению дисперсионного анализа сопоставляется соотношение степеней свободы в виде: n – 1 = 1 + (n – 2) Для множественной регрессии соотношение степеней свободы записывается в виде: n – 1 = m + (n – m – 1), где n – число наблюдений, m – число факторов в модели регрессии.

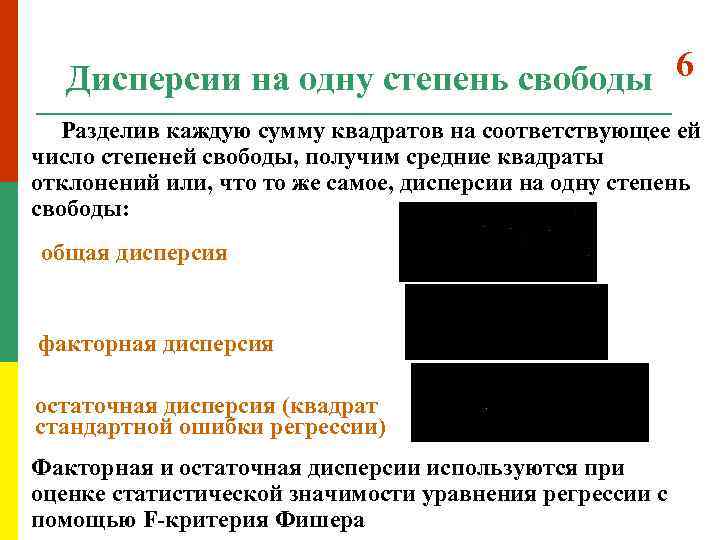

6 Дисперсии на одну степень свободы Разделив каждую сумму квадратов на соответствующее ей число степеней свободы, получим средние квадраты отклонений или, что то же самое, дисперсии на одну степень свободы: общая дисперсия факторная дисперсия остаточная дисперсия (квадрат стандартной ошибки регрессии) Факторная и остаточная дисперсии используются при оценке статистической значимости уравнения регрессии с помощью F-критерия Фишера

6 Дисперсии на одну степень свободы Разделив каждую сумму квадратов на соответствующее ей число степеней свободы, получим средние квадраты отклонений или, что то же самое, дисперсии на одну степень свободы: общая дисперсия факторная дисперсия остаточная дисперсия (квадрат стандартной ошибки регрессии) Факторная и остаточная дисперсии используются при оценке статистической значимости уравнения регрессии с помощью F-критерия Фишера

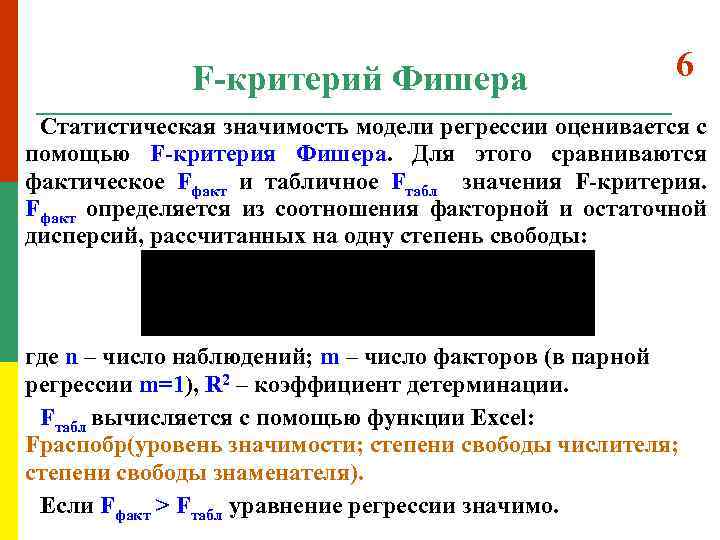

F-критерий Фишера 6 Статистическая значимость модели регрессии оценивается с помощью F-критерия Фишера. Для этого сравниваются фактическое Fфакт и табличное Fтабл значения F-критерия. Fфакт определяется из соотношения факторной и остаточной дисперсий, рассчитанных на одну степень свободы: где n – число наблюдений; m – число факторов (в парной регрессии m=1), R 2 – коэффициент детерминации. Fтабл вычисляется с помощью функции Excel: Fраспобр(уровень значимости; степени свободы числителя; степени свободы знаменателя). Если Fфакт > Fтабл уравнение регрессии значимо.

F-критерий Фишера 6 Статистическая значимость модели регрессии оценивается с помощью F-критерия Фишера. Для этого сравниваются фактическое Fфакт и табличное Fтабл значения F-критерия. Fфакт определяется из соотношения факторной и остаточной дисперсий, рассчитанных на одну степень свободы: где n – число наблюдений; m – число факторов (в парной регрессии m=1), R 2 – коэффициент детерминации. Fтабл вычисляется с помощью функции Excel: Fраспобр(уровень значимости; степени свободы числителя; степени свободы знаменателя). Если Fфакт > Fтабл уравнение регрессии значимо.

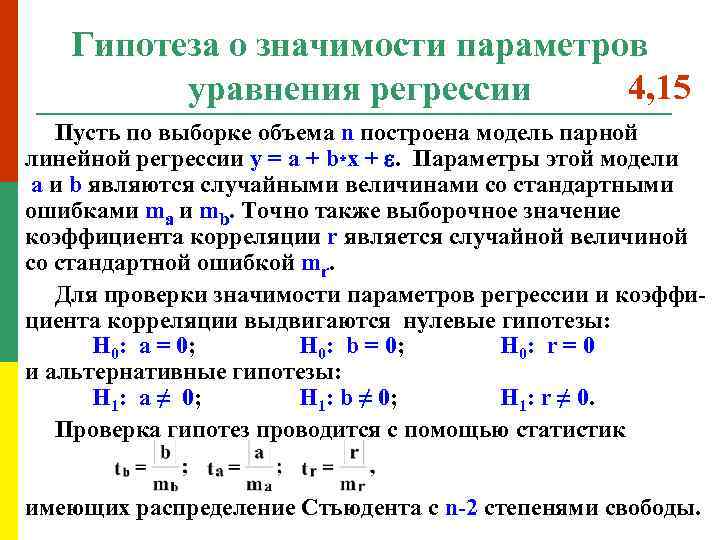

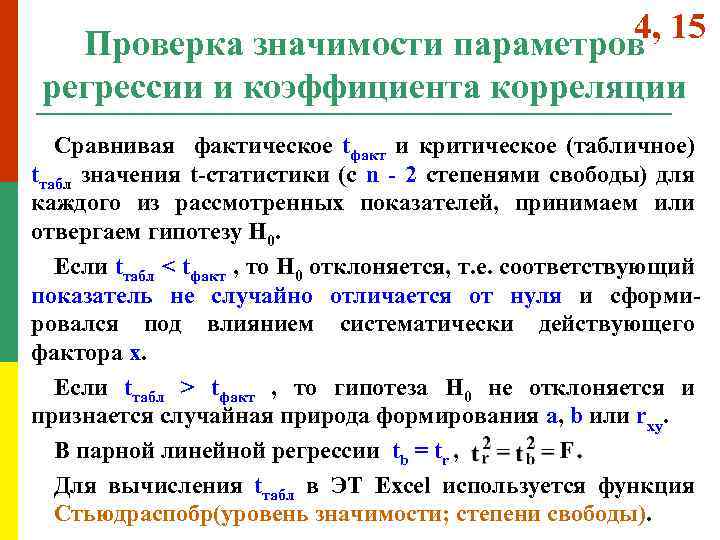

Гипотеза о значимости параметров 4, 15 уравнения регрессии Пусть по выборке объема n построена модель парной линейной регрессии y = a + b*x + . Параметры этой модели a и b являются случайными величинами со стандартными ошибками ma и mb. Точно также выборочное значение коэффициента корреляции r является случайной величиной со стандартной ошибкой mr. Для проверки значимости параметров регрессии и коэффициента корреляции выдвигаются нулевые гипотезы: H 0: a = 0; H 0: b = 0; H 0: r = 0 и альтернативные гипотезы: H 1: a ≠ 0; H 1: b ≠ 0; H 1: r ≠ 0. Проверка гипотез проводится с помощью статистик имеющих распределение Стьюдента с n-2 степенями свободы.

Гипотеза о значимости параметров 4, 15 уравнения регрессии Пусть по выборке объема n построена модель парной линейной регрессии y = a + b*x + . Параметры этой модели a и b являются случайными величинами со стандартными ошибками ma и mb. Точно также выборочное значение коэффициента корреляции r является случайной величиной со стандартной ошибкой mr. Для проверки значимости параметров регрессии и коэффициента корреляции выдвигаются нулевые гипотезы: H 0: a = 0; H 0: b = 0; H 0: r = 0 и альтернативные гипотезы: H 1: a ≠ 0; H 1: b ≠ 0; H 1: r ≠ 0. Проверка гипотез проводится с помощью статистик имеющих распределение Стьюдента с n-2 степенями свободы.

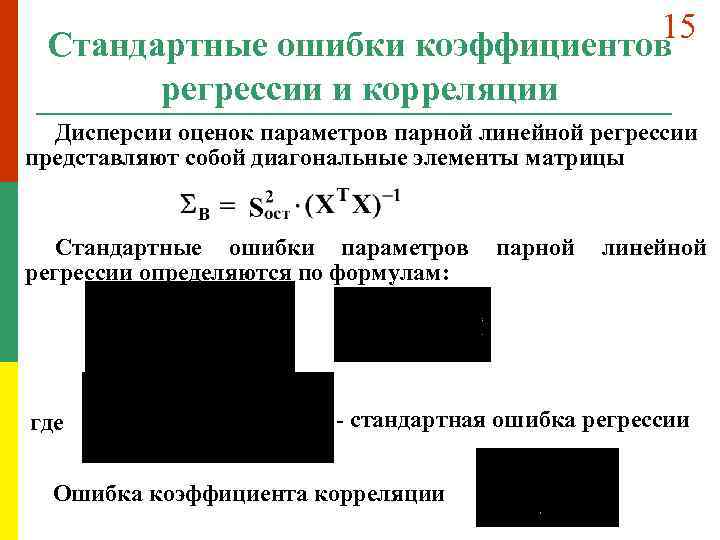

15 Стандартные ошибки коэффициентов регрессии и корреляции Дисперсии оценок параметров парной линейной регрессии представляют собой диагональные элементы матрицы Стандартные ошибки параметров парной линейной регрессии определяются по формулам: где - стандартная ошибка регрессии Ошибка коэффициента корреляции

15 Стандартные ошибки коэффициентов регрессии и корреляции Дисперсии оценок параметров парной линейной регрессии представляют собой диагональные элементы матрицы Стандартные ошибки параметров парной линейной регрессии определяются по формулам: где - стандартная ошибка регрессии Ошибка коэффициента корреляции

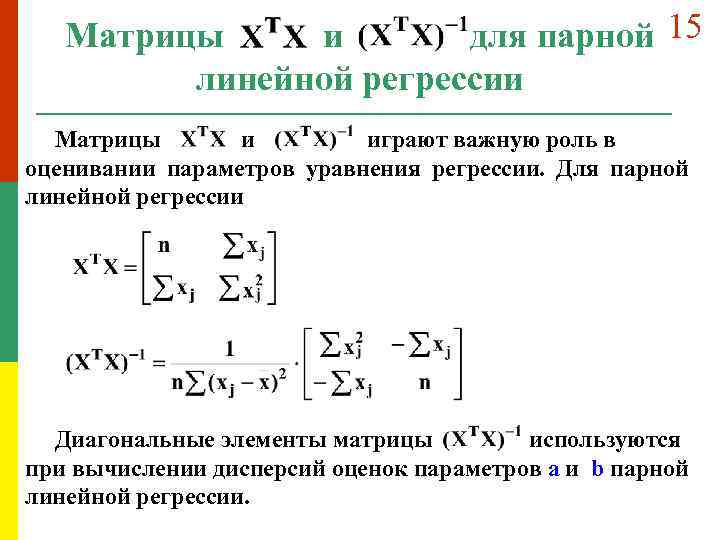

Матрицы и для парной 15 линейной регрессии Матрицы и играют важную роль в оценивании параметров уравнения регрессии. Для парной линейной регрессии Диагональные элементы матрицы используются при вычислении дисперсий оценок параметров a и b парной линейной регрессии.

Матрицы и для парной 15 линейной регрессии Матрицы и играют важную роль в оценивании параметров уравнения регрессии. Для парной линейной регрессии Диагональные элементы матрицы используются при вычислении дисперсий оценок параметров a и b парной линейной регрессии.

4, 15 Проверка значимости параметров регрессии и коэффициента корреляции Сравнивая фактическое tфакт и критическое (табличное) tтабл значения t-статистики (с n - 2 степенями свободы) для каждого из рассмотренных показателей, принимаем или отвергаем гипотезу H 0. Если tтабл < tфакт , то H 0 отклоняется, т. е. соответствующий показатель не случайно отличается от нуля и сформировался под влиянием систематически действующего фактора x. Если tтабл > tфакт , то гипотеза H 0 не отклоняется и признается случайная природа формирования a, b или rxy. В парной линейной регрессии tb = tr , Для вычисления tтабл в ЭТ Excel используется функция Стьюдраспобр(уровень значимости; степени свободы).

4, 15 Проверка значимости параметров регрессии и коэффициента корреляции Сравнивая фактическое tфакт и критическое (табличное) tтабл значения t-статистики (с n - 2 степенями свободы) для каждого из рассмотренных показателей, принимаем или отвергаем гипотезу H 0. Если tтабл < tфакт , то H 0 отклоняется, т. е. соответствующий показатель не случайно отличается от нуля и сформировался под влиянием систематически действующего фактора x. Если tтабл > tфакт , то гипотеза H 0 не отклоняется и признается случайная природа формирования a, b или rxy. В парной линейной регрессии tb = tr , Для вычисления tтабл в ЭТ Excel используется функция Стьюдраспобр(уровень значимости; степени свободы).

Средняя ошибка аппроксимации Одним из показателей качества уравнения регрессии является средняя ошибка аппроксимации: Допустимая величина : < 5% - высокая точность модели; 5 – 10% - хорошая точность модели; 10 – 15% - удовлетворительная точность модели; > 15% - неудовлетворительная точность модели.

Средняя ошибка аппроксимации Одним из показателей качества уравнения регрессии является средняя ошибка аппроксимации: Допустимая величина : < 5% - высокая точность модели; 5 – 10% - хорошая точность модели; 10 – 15% - удовлетворительная точность модели; > 15% - неудовлетворительная точность модели.

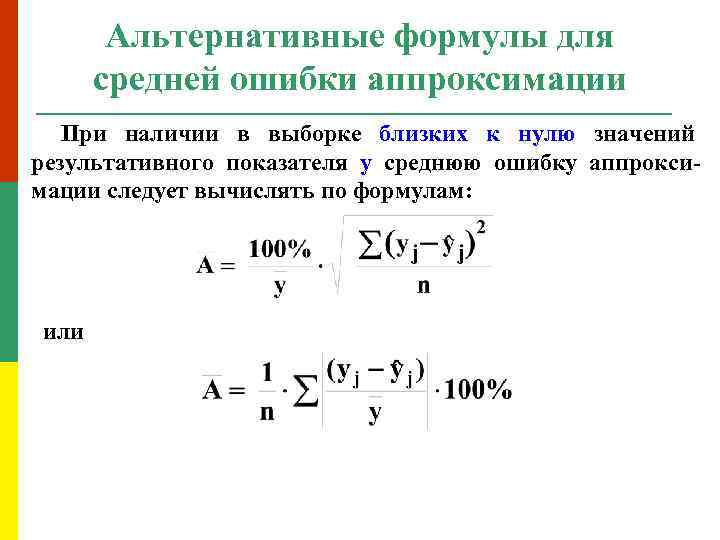

Альтернативные формулы для средней ошибки аппроксимации При наличии в выборке близких к нулю значений результативного показателя y среднюю ошибку аппроксимации следует вычислять по формулам: или

Альтернативные формулы для средней ошибки аппроксимации При наличии в выборке близких к нулю значений результативного показателя y среднюю ошибку аппроксимации следует вычислять по формулам: или

2. 4. Интервалы прогноза по линейному уравнению регрессии Если качество уравнения регрессии признается достаточным, то вычисляются прогнозные значения результативного признака и строятся доверительные интервалы прогноза

2. 4. Интервалы прогноза по линейному уравнению регрессии Если качество уравнения регрессии признается достаточным, то вычисляются прогнозные значения результативного признака и строятся доверительные интервалы прогноза

7 Стандартная ошибка прогноза Прогнозное значение результативного признака yp (точечный прогноз) определяется путем подстановки прогнозного значения xp в уравнение регрессии Вычисляется стандартная ошибка прогноза: Первое слагаемое подкоренного выражения отражает индивидуальное рассеивание результативного признака y вокруг линии регрессии, второе слагаемое учитывает ошибку определения его среднего значения , третье слагаемое характеризует дисперсию за счет ошибки определения коэффициента регрессии b.

7 Стандартная ошибка прогноза Прогнозное значение результативного признака yp (точечный прогноз) определяется путем подстановки прогнозного значения xp в уравнение регрессии Вычисляется стандартная ошибка прогноза: Первое слагаемое подкоренного выражения отражает индивидуальное рассеивание результативного признака y вокруг линии регрессии, второе слагаемое учитывает ошибку определения его среднего значения , третье слагаемое характеризует дисперсию за счет ошибки определения коэффициента регрессии b.

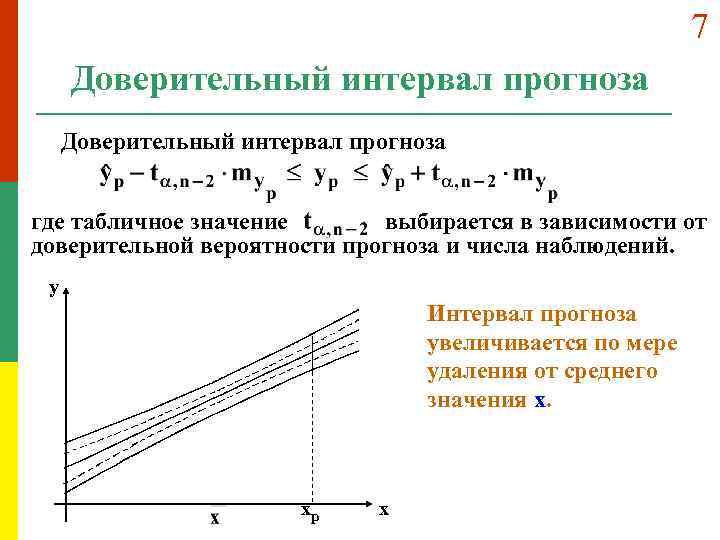

7 Доверительный интервал прогноза где табличное значение выбирается в зависимости от доверительной вероятности прогноза и числа наблюдений. y Интервал прогноза увеличивается по мере удаления от среднего значения x. xp x

7 Доверительный интервал прогноза где табличное значение выбирается в зависимости от доверительной вероятности прогноза и числа наблюдений. y Интервал прогноза увеличивается по мере удаления от среднего значения x. xp x

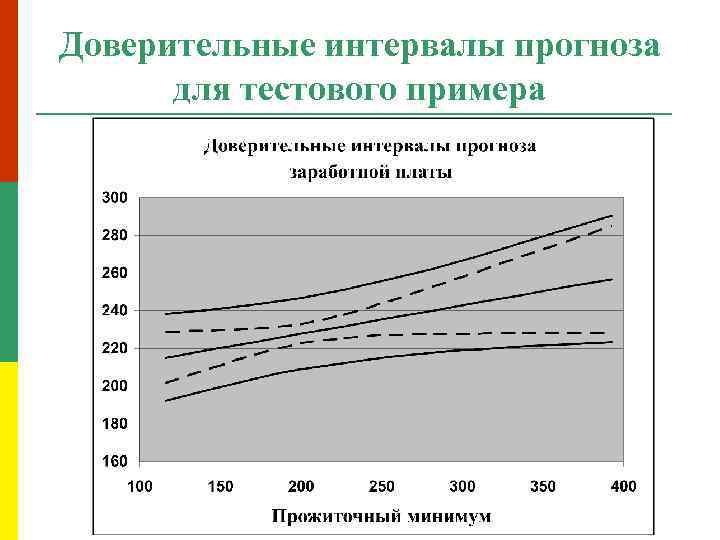

Доверительные интервалы прогноза для тестового примера

Доверительные интервалы прогноза для тестового примера

Тема 3. Множественная регрессия и корреляция

Тема 3. Множественная регрессия и корреляция

3. 1. Спецификация модели множественной регрессии Спецификация модели – обоснованный с позиций экономической теории выбор вида и структуры модели, отбор факторов и математическое описание характера их влияния на результирующий признак

3. 1. Спецификация модели множественной регрессии Спецификация модели – обоснованный с позиций экономической теории выбор вида и структуры модели, отбор факторов и математическое описание характера их влияния на результирующий признак

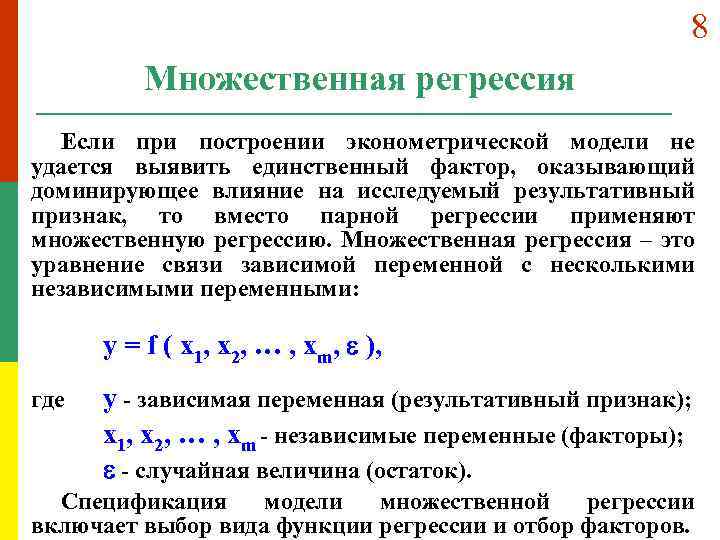

8 Множественная регрессия Если при построении эконометрической модели не удается выявить единственный фактор, оказывающий доминирующее влияние на исследуемый результативный признак, то вместо парной регрессии применяют множественную регрессию. Множественная регрессия – это уравнение связи зависимой переменной с несколькими независимыми переменными: y = f ( x 1, x 2, … , xm, ), где y - зависимая переменная (результативный признак); x 1, x 2, … , xm - независимые переменные (факторы); - случайная величина (остаток). Спецификация модели множественной регрессии включает выбор вида функции регрессии и отбор факторов.

8 Множественная регрессия Если при построении эконометрической модели не удается выявить единственный фактор, оказывающий доминирующее влияние на исследуемый результативный признак, то вместо парной регрессии применяют множественную регрессию. Множественная регрессия – это уравнение связи зависимой переменной с несколькими независимыми переменными: y = f ( x 1, x 2, … , xm, ), где y - зависимая переменная (результативный признак); x 1, x 2, … , xm - независимые переменные (факторы); - случайная величина (остаток). Спецификация модели множественной регрессии включает выбор вида функции регрессии и отбор факторов.

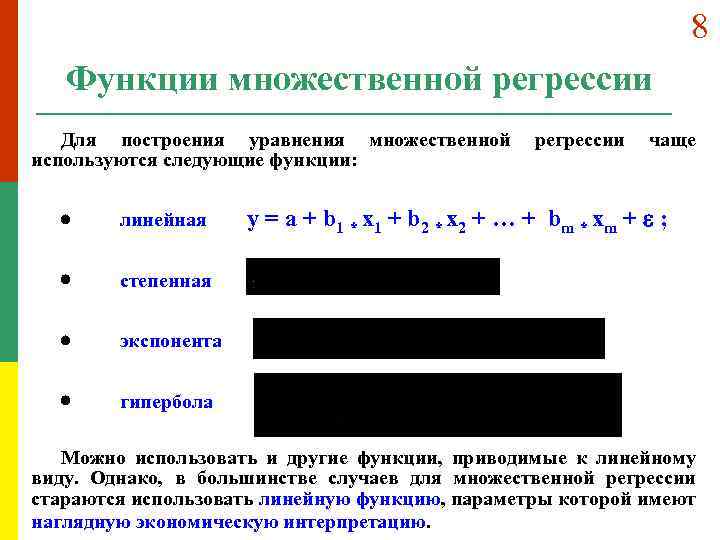

8 Функции множественной регрессии Для построения уравнения множественной регрессии чаще используются следующие функции: · линейная · степенная · экспонента · гипербола y = a + b 1 * x 1 + b 2 * x 2 + … + bm * xm + ; Можно использовать и другие функции, приводимые к линейному виду. Однако, в большинстве случаев для множественной регрессии стараются использовать линейную функцию, параметры которой имеют наглядную экономическую интерпретацию.

8 Функции множественной регрессии Для построения уравнения множественной регрессии чаще используются следующие функции: · линейная · степенная · экспонента · гипербола y = a + b 1 * x 1 + b 2 * x 2 + … + bm * xm + ; Можно использовать и другие функции, приводимые к линейному виду. Однако, в большинстве случаев для множественной регрессии стараются использовать линейную функцию, параметры которой имеют наглядную экономическую интерпретацию.

Стандартизованное уравнение регрессии 11 В ряде случаев применяют уравнение регрессии в стандартизованном масштабе: , где - стандартизованные переменные; i – стандартизованные коэффициенты регрессии. Коэффициенты i позволяют ранжировать факторы по силе их влияния на результативный признак. Связь коэффициентов множественной регрессии bi со стандартизованными коэффициентами i описывается соотношением Параметр a определяется как

Стандартизованное уравнение регрессии 11 В ряде случаев применяют уравнение регрессии в стандартизованном масштабе: , где - стандартизованные переменные; i – стандартизованные коэффициенты регрессии. Коэффициенты i позволяют ранжировать факторы по силе их влияния на результативный признак. Связь коэффициентов множественной регрессии bi со стандартизованными коэффициентами i описывается соотношением Параметр a определяется как

Фиктивные переменные для качественных факторов 8 Факторы должны быть количественно измеримы. Если необходимо включить в модель качественный фактор, то каждому его уровню следует тем или иным способом придать количественную определенность. С этой целью применяются фиктивные переменные. Если качественный фактор имеет два различимых уровня, то вводится одна фиктивная переменная Z, значения которой устанавливаются равными: Если качественный фактор имеет три уровня, то вводятся две фиктивные переменные Z 1 и Z 2, значения которых устанавливаются равными:

Фиктивные переменные для качественных факторов 8 Факторы должны быть количественно измеримы. Если необходимо включить в модель качественный фактор, то каждому его уровню следует тем или иным способом придать количественную определенность. С этой целью применяются фиктивные переменные. Если качественный фактор имеет два различимых уровня, то вводится одна фиктивная переменная Z, значения которой устанавливаются равными: Если качественный фактор имеет три уровня, то вводятся две фиктивные переменные Z 1 и Z 2, значения которых устанавливаются равными:

Отбор факторов множественной регрессии 9 Наиболее сложной проблемой спецификации модели множественной регрессии является отбор факторов, включаемых в модель. Первоначальный отбор факторов производится на основе качественного теоретико-экономического анализа. Затем проверяются требования, которым должны отвечать включаемые в модель факторы. Включаемые во множественную регрессию факторы должны объяснять вариацию независимой переменной. Иными словами, каждый дополнительно включаемый в регрессию фактор должен приводить к статистически значимому возрастанию коэффициента детерминации R 2 и сокращению остаточной дисперсии S 2 ост. Насыщение модели лишними факторами приводит к статистической незначимости параметров регрессии. Информативные факторы, подлежащие включению в модель, определяются на основе частных коэффициентов корреляции, которые характеризуют тесноту связи между результатом и соответствующим фактором при устранении влияния (элиминировании) других факторов, включенных в уравнение регрессии.

Отбор факторов множественной регрессии 9 Наиболее сложной проблемой спецификации модели множественной регрессии является отбор факторов, включаемых в модель. Первоначальный отбор факторов производится на основе качественного теоретико-экономического анализа. Затем проверяются требования, которым должны отвечать включаемые в модель факторы. Включаемые во множественную регрессию факторы должны объяснять вариацию независимой переменной. Иными словами, каждый дополнительно включаемый в регрессию фактор должен приводить к статистически значимому возрастанию коэффициента детерминации R 2 и сокращению остаточной дисперсии S 2 ост. Насыщение модели лишними факторами приводит к статистической незначимости параметров регрессии. Информативные факторы, подлежащие включению в модель, определяются на основе частных коэффициентов корреляции, которые характеризуют тесноту связи между результатом и соответствующим фактором при устранении влияния (элиминировании) других факторов, включенных в уравнение регрессии.

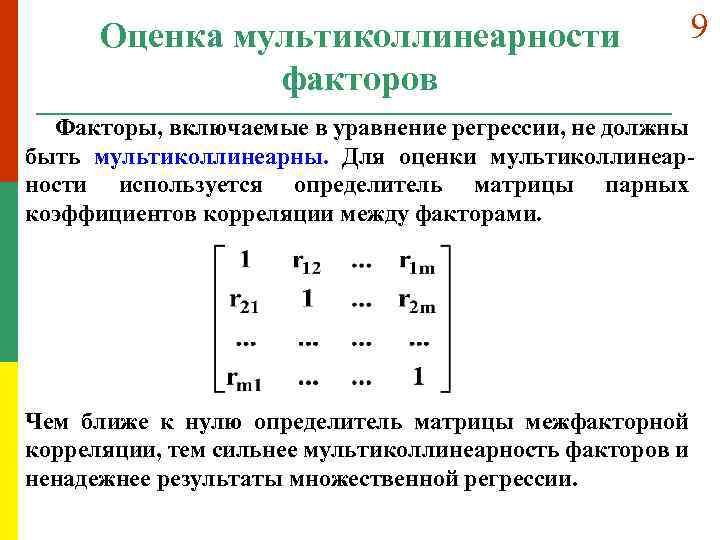

Оценка мультиколлинеарности факторов 9 Факторы, включаемые в уравнение регрессии, не должны быть мультиколлинеарны. Для оценки мультиколлинеарности используется определитель матрицы парных коэффициентов корреляции между факторами. Чем ближе к нулю определитель матрицы межфакторной корреляции, тем сильнее мультиколлинеарность факторов и ненадежнее результаты множественной регрессии.

Оценка мультиколлинеарности факторов 9 Факторы, включаемые в уравнение регрессии, не должны быть мультиколлинеарны. Для оценки мультиколлинеарности используется определитель матрицы парных коэффициентов корреляции между факторами. Чем ближе к нулю определитель матрицы межфакторной корреляции, тем сильнее мультиколлинеарность факторов и ненадежнее результаты множественной регрессии.

Коэффициенты множественной детерминации 9 Через коэффициенты множественной детерминации можно найти переменные, ответственные за мультиколлинеарность факторов. Для этого в качестве зависимой переменной рассматривается каждый из факторов. Чем ближе значение коэффициента множественной детерминации к единице, тем сильнее проявляется мультиколлинеарность факторов. Сравнивая между собой коэффициенты множественной детерминации факторов можно выделить и удалить из уравнения регрессии переменные, ответственные за мультиколлинеарность.

Коэффициенты множественной детерминации 9 Через коэффициенты множественной детерминации можно найти переменные, ответственные за мультиколлинеарность факторов. Для этого в качестве зависимой переменной рассматривается каждый из факторов. Чем ближе значение коэффициента множественной детерминации к единице, тем сильнее проявляется мультиколлинеарность факторов. Сравнивая между собой коэффициенты множественной детерминации факторов можно выделить и удалить из уравнения регрессии переменные, ответственные за мультиколлинеарность.

Способы преодоления мультиколлинеарности 9 Наличие мультиколлинеарности между факторами приводит к слабой обусловленности матрицы Xт. X (к близости к нулю ее определителя) и, как следствие, к высоким значениям стандартных ошибок параметров регрессии. В методе “ридж-регрессии” (“гребневой регрессии”) к диагональным элементам матрицы Xт. X добавляют некоторое небольшое положительное число l, что устраняет слабую обусловленность матрицы Xт. X, приводит к смещенным, но более точным оценкам параметров регрессии. В методе главных компонент, используя собственные числа матрицы Xт. X, переходят от исходных факторов к их линейным комбинациям - главным компонентам, не коррелированным друг с другом. C помощью собственных чисел матрицы Xт. X можно выделить главные компоненты, объясняющие большую часть дисперсии зависимой переменной и построить по ним уравнение регрессии.

Способы преодоления мультиколлинеарности 9 Наличие мультиколлинеарности между факторами приводит к слабой обусловленности матрицы Xт. X (к близости к нулю ее определителя) и, как следствие, к высоким значениям стандартных ошибок параметров регрессии. В методе “ридж-регрессии” (“гребневой регрессии”) к диагональным элементам матрицы Xт. X добавляют некоторое небольшое положительное число l, что устраняет слабую обусловленность матрицы Xт. X, приводит к смещенным, но более точным оценкам параметров регрессии. В методе главных компонент, используя собственные числа матрицы Xт. X, переходят от исходных факторов к их линейным комбинациям - главным компонентам, не коррелированным друг с другом. C помощью собственных чисел матрицы Xт. X можно выделить главные компоненты, объясняющие большую часть дисперсии зависимой переменной и построить по ним уравнение регрессии.

3. 2. Оценка параметров уравнения множественной регрессии Параметры уравнения множественной регрессии оцениваются, как и в парной регрессии, методом наименьших квадратов (МНК)

3. 2. Оценка параметров уравнения множественной регрессии Параметры уравнения множественной регрессии оцениваются, как и в парной регрессии, методом наименьших квадратов (МНК)

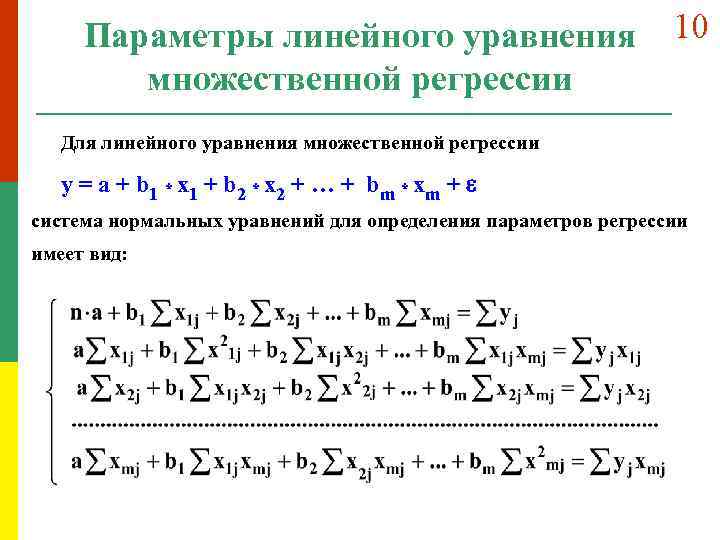

Параметры линейного уравнения 10 множественной регрессии Для линейного уравнения множественной регрессии y = a + b 1 * x 1 + b 2 * x 2 + … + bm * xm + система нормальных уравнений для определения параметров регрессии имеет вид:

Параметры линейного уравнения 10 множественной регрессии Для линейного уравнения множественной регрессии y = a + b 1 * x 1 + b 2 * x 2 + … + bm * xm + система нормальных уравнений для определения параметров регрессии имеет вид:

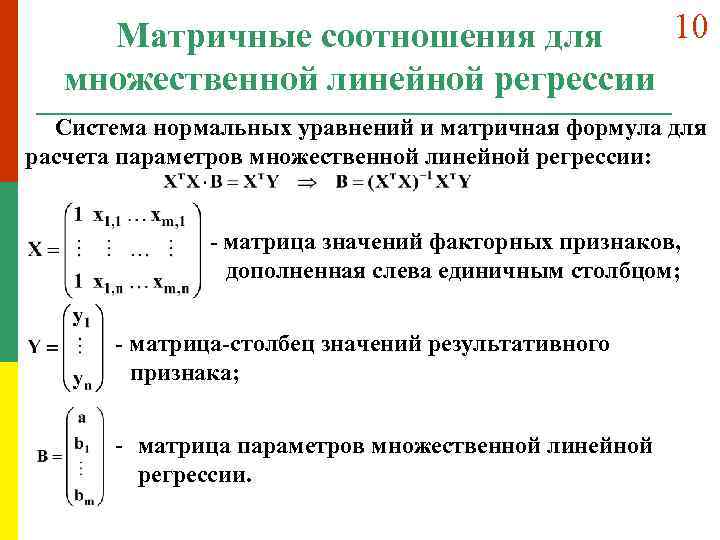

10 Матричные соотношения для множественной линейной регрессии Система нормальных уравнений и матричная формула для расчета параметров множественной линейной регрессии: - матрица значений факторных признаков, дополненная слева единичным столбцом; - матрица-столбец значений результативного признака; - матрица параметров множественной линейной регрессии.

10 Матричные соотношения для множественной линейной регрессии Система нормальных уравнений и матричная формула для расчета параметров множественной линейной регрессии: - матрица значений факторных признаков, дополненная слева единичным столбцом; - матрица-столбец значений результативного признака; - матрица параметров множественной линейной регрессии.

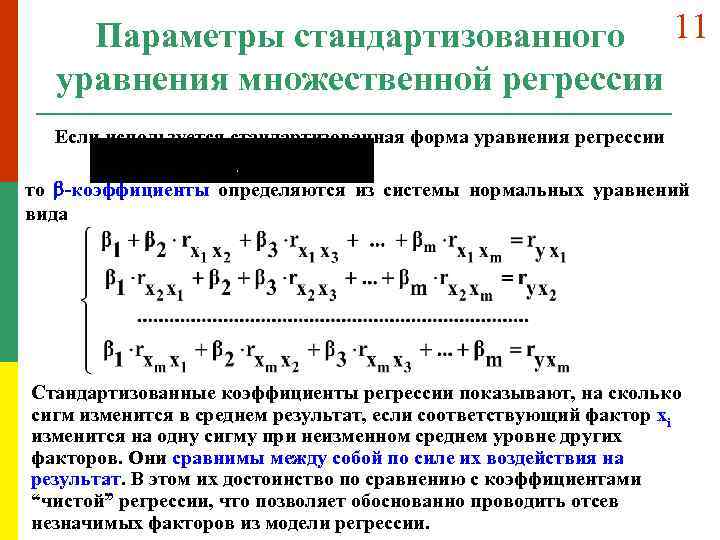

Параметры стандартизованного 11 уравнения множественной регрессии Если используется стандартизованная форма уравнения регрессии то -коэффициенты определяются из системы нормальных уравнений вида Стандартизованные коэффициенты регрессии показывают, на сколько сигм изменится в среднем результат, если соответствующий фактор xi изменится на одну сигму при неизменном среднем уровне других факторов. Они сравнимы между собой по силе их воздействия на результат. В этом их достоинство по сравнению с коэффициентами “чистой” регрессии, что позволяет обоснованно проводить отсев незначимых факторов из модели регрессии.

Параметры стандартизованного 11 уравнения множественной регрессии Если используется стандартизованная форма уравнения регрессии то -коэффициенты определяются из системы нормальных уравнений вида Стандартизованные коэффициенты регрессии показывают, на сколько сигм изменится в среднем результат, если соответствующий фактор xi изменится на одну сигму при неизменном среднем уровне других факторов. Они сравнимы между собой по силе их воздействия на результат. В этом их достоинство по сравнению с коэффициентами “чистой” регрессии, что позволяет обоснованно проводить отсев незначимых факторов из модели регрессии.

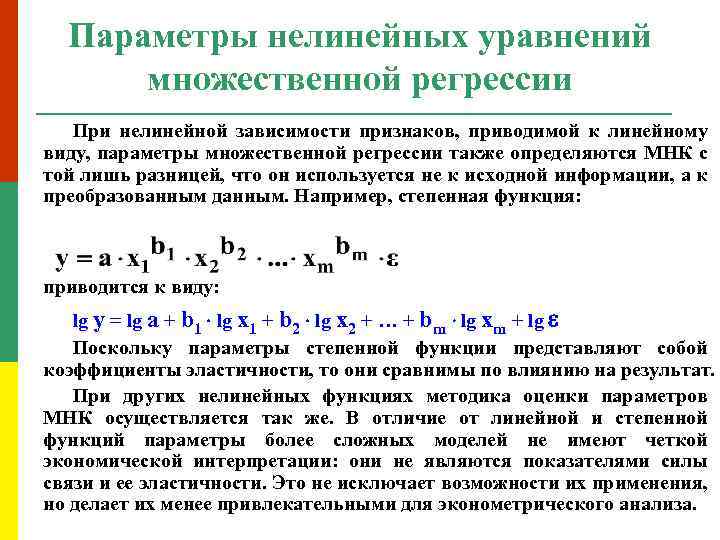

Параметры нелинейных уравнений множественной регрессии При нелинейной зависимости признаков, приводимой к линейному виду, параметры множественной регрессии также определяются МНК с той лишь разницей, что он используется не к исходной информации, а к преобразованным данным. Например, степенная функция: приводится к виду: lg y = lg a + b 1 lg x 1 + b 2 lg x 2 + … + bm lg xm + lg Поскольку параметры степенной функции представляют собой коэффициенты эластичности, то они сравнимы по влиянию на результат. При других нелинейных функциях методика оценки параметров МНК осуществляется так же. В отличие от линейной и степенной функций параметры более сложных моделей не имеют четкой экономической интерпретации: они не являются показателями силы связи и ее эластичности. Это не исключает возможности их применения, но делает их менее привлекательными для эконометрического анализа.

Параметры нелинейных уравнений множественной регрессии При нелинейной зависимости признаков, приводимой к линейному виду, параметры множественной регрессии также определяются МНК с той лишь разницей, что он используется не к исходной информации, а к преобразованным данным. Например, степенная функция: приводится к виду: lg y = lg a + b 1 lg x 1 + b 2 lg x 2 + … + bm lg xm + lg Поскольку параметры степенной функции представляют собой коэффициенты эластичности, то они сравнимы по влиянию на результат. При других нелинейных функциях методика оценки параметров МНК осуществляется так же. В отличие от линейной и степенной функций параметры более сложных моделей не имеют четкой экономической интерпретации: они не являются показателями силы связи и ее эластичности. Это не исключает возможности их применения, но делает их менее привлекательными для эконометрического анализа.

3. 3. Множественная корреляция Практическая значимость уравнения множественной регрессии оценивается с помощью показателя множественной корреляции и его квадрата коэффициента детерминации

3. 3. Множественная корреляция Практическая значимость уравнения множественной регрессии оценивается с помощью показателя множественной корреляции и его квадрата коэффициента детерминации

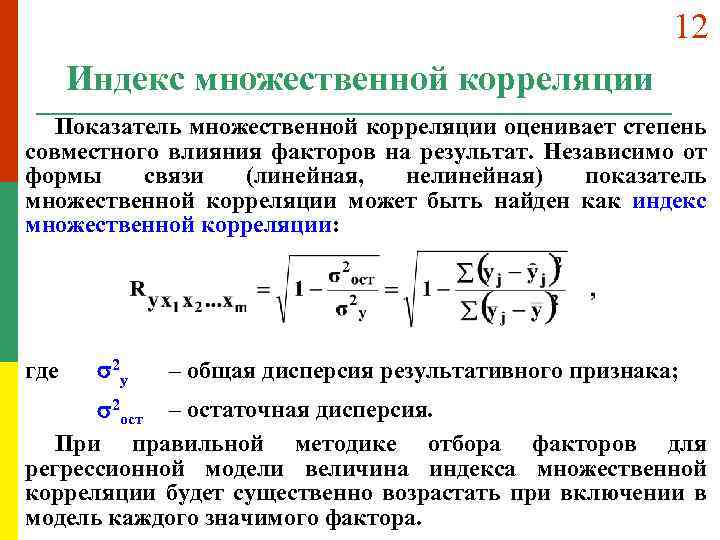

12 Индекс множественной корреляции Показатель множественной корреляции оценивает степень совместного влияния факторов на результат. Независимо от формы связи (линейная, нелинейная) показатель множественной корреляции может быть найден как индекс множественной корреляции: где 2 y – общая дисперсия результативного признака; 2 ост – остаточная дисперсия. При правильной методике отбора факторов для регрессионной модели величина индекса множественной корреляции будет существенно возрастать при включении в модель каждого значимого фактора.

12 Индекс множественной корреляции Показатель множественной корреляции оценивает степень совместного влияния факторов на результат. Независимо от формы связи (линейная, нелинейная) показатель множественной корреляции может быть найден как индекс множественной корреляции: где 2 y – общая дисперсия результативного признака; 2 ост – остаточная дисперсия. При правильной методике отбора факторов для регрессионной модели величина индекса множественной корреляции будет существенно возрастать при включении в модель каждого значимого фактора.

Линейный коэффициент множественной корреляции 12 Для линейной регрессии индекс корреляции называется линейным коэффициентом множественной корреляции и вычисляется по формуле: где i – стандартизованный коэффициент регрессии для фактора xi; ryx – парный коэффициент корреляции результата y с фактором xi. i Его можно рассчитать, не обращаясь к уравнению множественной регрессии, а используя матрицу парных коэффициентов корреляции: где Dr – определитель матрицы парных коэффициентов корреляции; Dr 11– определитель матрицы межфакторной корреляции (образованной вычеркиванием первой строки и первого столбца из матрицы парных коэффициентов корреляции).

Линейный коэффициент множественной корреляции 12 Для линейной регрессии индекс корреляции называется линейным коэффициентом множественной корреляции и вычисляется по формуле: где i – стандартизованный коэффициент регрессии для фактора xi; ryx – парный коэффициент корреляции результата y с фактором xi. i Его можно рассчитать, не обращаясь к уравнению множественной регрессии, а используя матрицу парных коэффициентов корреляции: где Dr – определитель матрицы парных коэффициентов корреляции; Dr 11– определитель матрицы межфакторной корреляции (образованной вычеркиванием первой строки и первого столбца из матрицы парных коэффициентов корреляции).

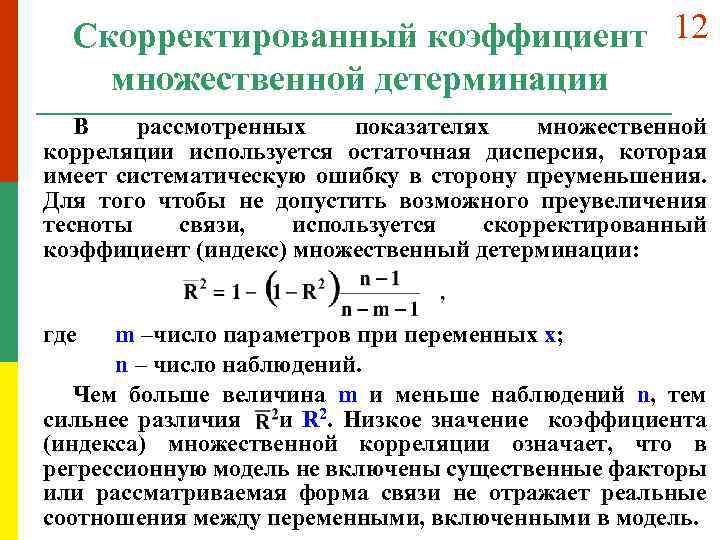

Скорректированный коэффициент 12 множественной детерминации В рассмотренных показателях множественной корреляции используется остаточная дисперсия, которая имеет систематическую ошибку в сторону преуменьшения. Для того чтобы не допустить возможного преувеличения тесноты связи, используется скорректированный коэффициент (индекс) множественный детерминации: где m –число параметров при переменных x; n – число наблюдений. Чем больше величина m и меньше наблюдений n, тем сильнее различия и R 2. Низкое значение коэффициента (индекса) множественной корреляции означает, что в регрессионную модель не включены существенные факторы или рассматриваемая форма связи не отражает реальные соотношения между переменными, включенными в модель.

Скорректированный коэффициент 12 множественной детерминации В рассмотренных показателях множественной корреляции используется остаточная дисперсия, которая имеет систематическую ошибку в сторону преуменьшения. Для того чтобы не допустить возможного преувеличения тесноты связи, используется скорректированный коэффициент (индекс) множественный детерминации: где m –число параметров при переменных x; n – число наблюдений. Чем больше величина m и меньше наблюдений n, тем сильнее различия и R 2. Низкое значение коэффициента (индекса) множественной корреляции означает, что в регрессионную модель не включены существенные факторы или рассматриваемая форма связи не отражает реальные соотношения между переменными, включенными в модель.

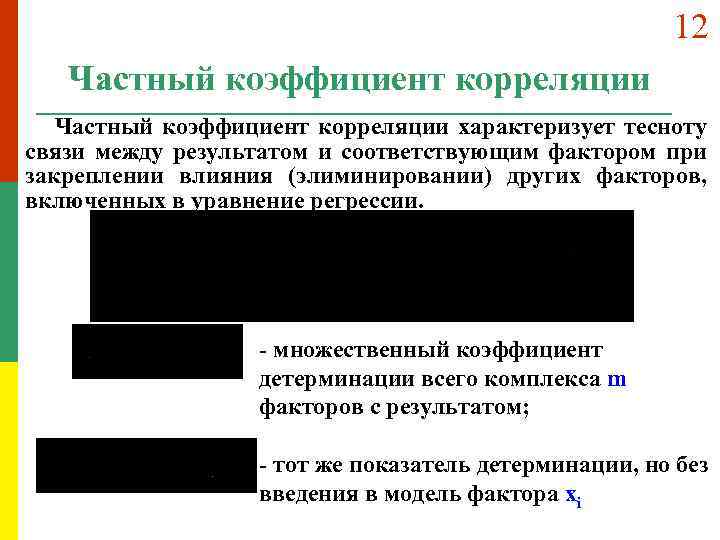

12 Частный коэффициент корреляции характеризует тесноту связи между результатом и соответствующим фактором при закреплении влияния (элиминировании) других факторов, включенных в уравнение регрессии. - множественный коэффициент детерминации всего комплекса m факторов с результатом; - тот же показатель детерминации, но без введения в модель фактора xi

12 Частный коэффициент корреляции характеризует тесноту связи между результатом и соответствующим фактором при закреплении влияния (элиминировании) других факторов, включенных в уравнение регрессии. - множественный коэффициент детерминации всего комплекса m факторов с результатом; - тот же показатель детерминации, но без введения в модель фактора xi

3. 4. Оценка надежности результатов множественной регрессии и корреляции Верификация уравнения множественной регрессии проводится с помощью общего и частных F-критериев

3. 4. Оценка надежности результатов множественной регрессии и корреляции Верификация уравнения множественной регрессии проводится с помощью общего и частных F-критериев

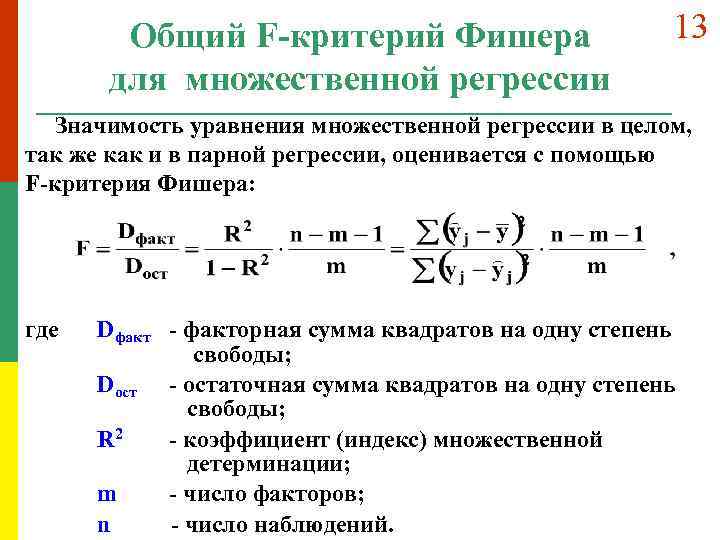

Общий F-критерий Фишера для множественной регрессии 13 Значимость уравнения множественной регрессии в целом, так же как и в парной регрессии, оценивается с помощью F-критерия Фишера: где Dфакт - факторная сумма квадратов на одну степень свободы; Dост - остаточная сумма квадратов на одну степень свободы; R 2 - коэффициент (индекс) множественной детерминации; m - число факторов; n - число наблюдений.

Общий F-критерий Фишера для множественной регрессии 13 Значимость уравнения множественной регрессии в целом, так же как и в парной регрессии, оценивается с помощью F-критерия Фишера: где Dфакт - факторная сумма квадратов на одну степень свободы; Dост - остаточная сумма квадратов на одну степень свободы; R 2 - коэффициент (индекс) множественной детерминации; m - число факторов; n - число наблюдений.

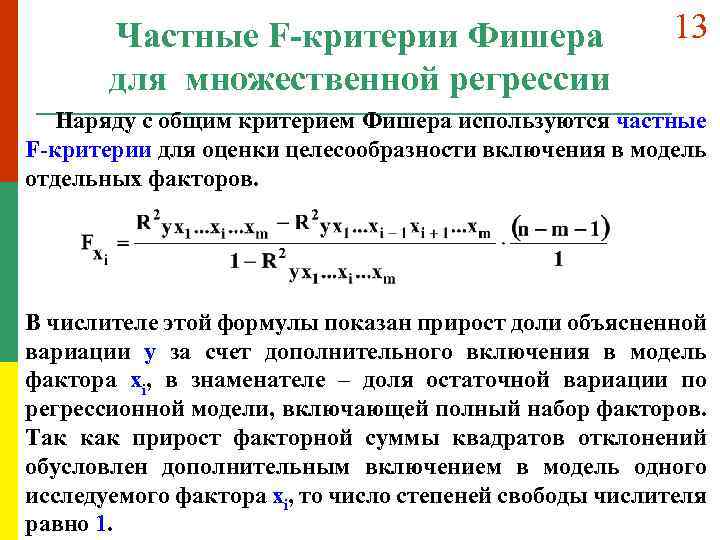

Частные F-критерии Фишера для множественной регрессии 13 Наряду с общим критерием Фишера используются частные F-критерии для оценки целесообразности включения в модель отдельных факторов. В числителе этой формулы показан прирост доли объясненной вариации y за счет дополнительного включения в модель фактора xi, в знаменателе – доля остаточной вариации по регрессионной модели, включающей полный набор факторов. Так как прирост факторной суммы квадратов отклонений обусловлен дополнительным включением в модель одного исследуемого фактора xi, то число степеней свободы числителя равно 1.

Частные F-критерии Фишера для множественной регрессии 13 Наряду с общим критерием Фишера используются частные F-критерии для оценки целесообразности включения в модель отдельных факторов. В числителе этой формулы показан прирост доли объясненной вариации y за счет дополнительного включения в модель фактора xi, в знаменателе – доля остаточной вариации по регрессионной модели, включающей полный набор факторов. Так как прирост факторной суммы квадратов отклонений обусловлен дополнительным включением в модель одного исследуемого фактора xi, то число степеней свободы числителя равно 1.

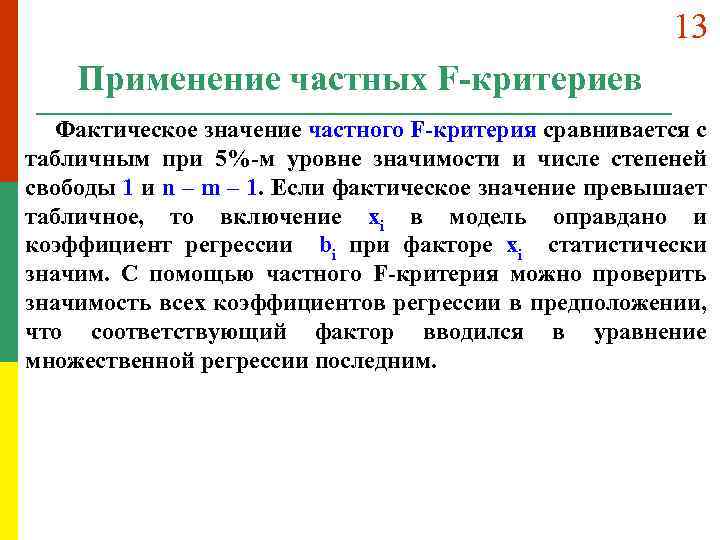

13 Применение частных F-критериев Фактическое значение частного F-критерия сравнивается с табличным при 5%-м уровне значимости и числе степеней свободы 1 и n – m – 1. Если фактическое значение превышает табличное, то включение xi в модель оправдано и коэффициент регрессии bi при факторе xi статистически значим. С помощью частного F-критерия можно проверить значимость всех коэффициентов регрессии в предположении, что соответствующий фактор вводился в уравнение множественной регрессии последним.

13 Применение частных F-критериев Фактическое значение частного F-критерия сравнивается с табличным при 5%-м уровне значимости и числе степеней свободы 1 и n – m – 1. Если фактическое значение превышает табличное, то включение xi в модель оправдано и коэффициент регрессии bi при факторе xi статистически значим. С помощью частного F-критерия можно проверить значимость всех коэффициентов регрессии в предположении, что соответствующий фактор вводился в уравнение множественной регрессии последним.

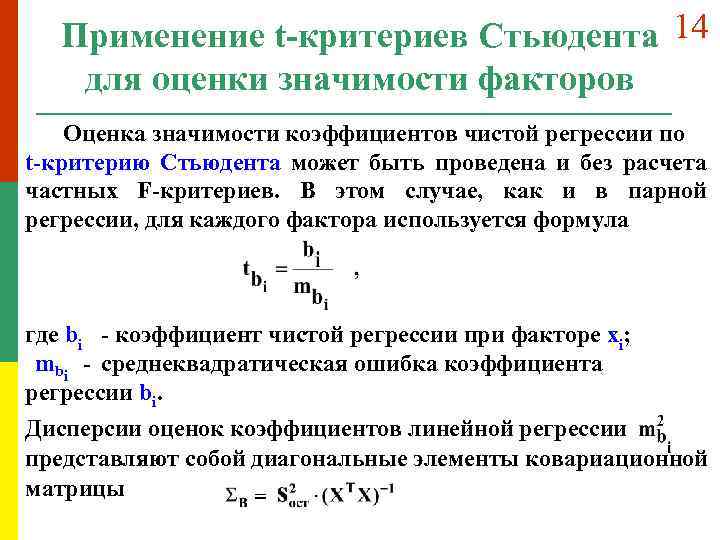

Применение t-критериев Стьюдента 14 для оценки значимости факторов Оценка значимости коэффициентов чистой регрессии по t-критерию Стьюдента может быть проведена и без расчета частных F-критериев. В этом случае, как и в парной регрессии, для каждого фактора используется формула где bi - коэффициент чистой регрессии при факторе xi; mbi - среднеквадратическая ошибка коэффициента регрессии bi. Дисперсии оценок коэффициентов линейной регрессии представляют собой диагональные элементы ковариационной матрицы

Применение t-критериев Стьюдента 14 для оценки значимости факторов Оценка значимости коэффициентов чистой регрессии по t-критерию Стьюдента может быть проведена и без расчета частных F-критериев. В этом случае, как и в парной регрессии, для каждого фактора используется формула где bi - коэффициент чистой регрессии при факторе xi; mbi - среднеквадратическая ошибка коэффициента регрессии bi. Дисперсии оценок коэффициентов линейной регрессии представляют собой диагональные элементы ковариационной матрицы

3. 5. Предпосылки метода наименьших квадратов и обобщенный МНК

3. 5. Предпосылки метода наименьших квадратов и обобщенный МНК

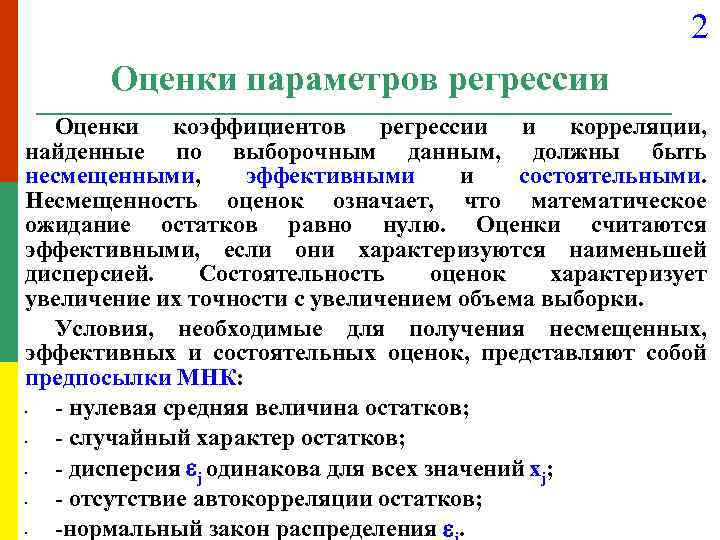

2 Оценки параметров регрессии Оценки коэффициентов регрессии и корреляции, найденные по выборочным данным, должны быть несмещенными, эффективными и состоятельными. Несмещенность оценок означает, что математическое ожидание остатков равно нулю. Оценки считаются эффективными, если они характеризуются наименьшей дисперсией. Состоятельность оценок характеризует увеличение их точности с увеличением объема выборки. Условия, необходимые для получения несмещенных, эффективных и состоятельных оценок, представляют собой предпосылки МНК: - нулевая средняя величина остатков; - случайный характер остатков; - дисперсия j одинакова для всех значений xj; - отсутствие автокорреляции остатков; -нормальный закон распределения . • • •

2 Оценки параметров регрессии Оценки коэффициентов регрессии и корреляции, найденные по выборочным данным, должны быть несмещенными, эффективными и состоятельными. Несмещенность оценок означает, что математическое ожидание остатков равно нулю. Оценки считаются эффективными, если они характеризуются наименьшей дисперсией. Состоятельность оценок характеризует увеличение их точности с увеличением объема выборки. Условия, необходимые для получения несмещенных, эффективных и состоятельных оценок, представляют собой предпосылки МНК: - нулевая средняя величина остатков; - случайный характер остатков; - дисперсия j одинакова для всех значений xj; - отсутствие автокорреляции остатков; -нормальный закон распределения . • • •

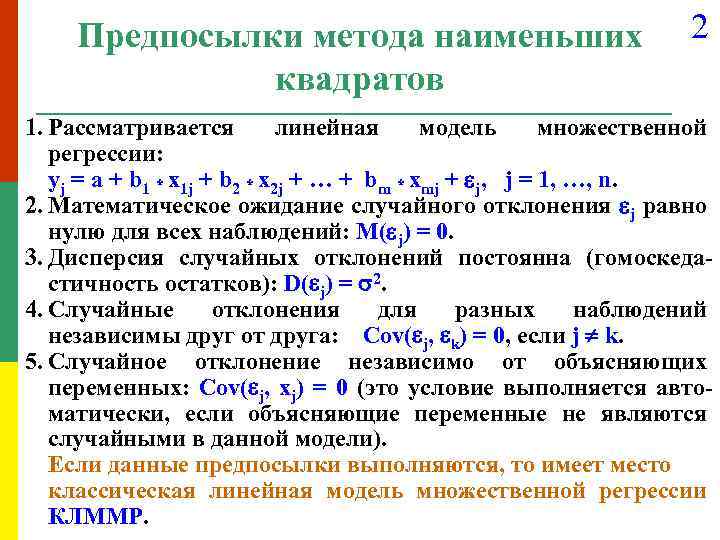

Предпосылки метода наименьших квадратов 2 1. Рассматривается линейная модель множественной регрессии: yj = a + b 1 * x 1 j + b 2 * x 2 j + … + bm * xmj + j, j = 1, …, n. 2. Математическое ожидание случайного отклонения j равно нулю для всех наблюдений: M( j) = 0. 3. Дисперсия случайных отклонений постоянна (гомоскедастичность остатков): D( j) = 2. 4. Случайные отклонения для разных наблюдений независимы друг от друга: Cov( j, k) = 0, если j k. 5. Случайное отклонение независимо от объясняющих переменных: Cov( j, xj) = 0 (это условие выполняется автоматически, если объясняющие переменные не являются случайными в данной модели). Если данные предпосылки выполняются, то имеет место классическая линейная модель множественной регрессии КЛММР.

Предпосылки метода наименьших квадратов 2 1. Рассматривается линейная модель множественной регрессии: yj = a + b 1 * x 1 j + b 2 * x 2 j + … + bm * xmj + j, j = 1, …, n. 2. Математическое ожидание случайного отклонения j равно нулю для всех наблюдений: M( j) = 0. 3. Дисперсия случайных отклонений постоянна (гомоскедастичность остатков): D( j) = 2. 4. Случайные отклонения для разных наблюдений независимы друг от друга: Cov( j, k) = 0, если j k. 5. Случайное отклонение независимо от объясняющих переменных: Cov( j, xj) = 0 (это условие выполняется автоматически, если объясняющие переменные не являются случайными в данной модели). Если данные предпосылки выполняются, то имеет место классическая линейная модель множественной регрессии КЛММР.

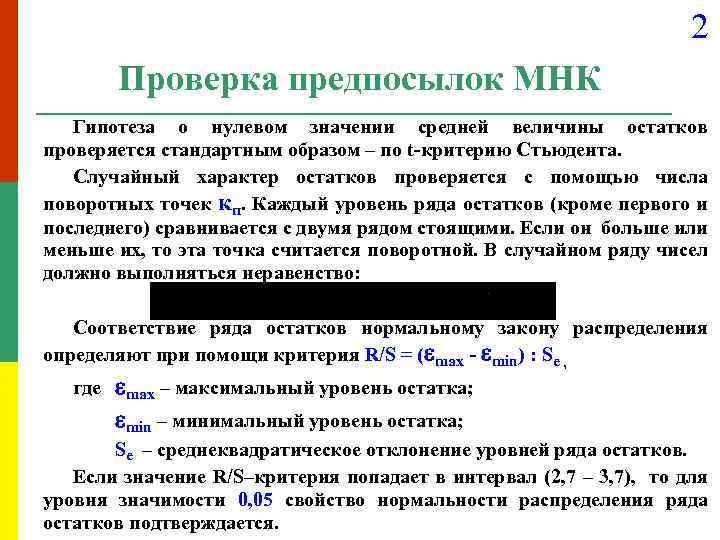

2 Проверка предпосылок МНК Гипотеза о нулевом значении средней величины остатков проверяется стандартным образом – по t-критерию Стьюдента. Случайный характер остатков проверяется с помощью числа поворотных точек кп. Каждый уровень ряда остатков (кроме первого и последнего) сравнивается с двумя рядом стоящими. Если он больше или меньше их, то эта точка считается поворотной. В случайном ряду чисел должно выполняться неравенство: Соответствие ряда остатков нормальному закону распределения определяют при помощи критерия R/S = ( max - min) : Se , где max – максимальный уровень остатка; min – минимальный уровень остатка; Se – среднеквадратическое отклонение уровней ряда остатков. Если значение R/S–критерия попадает в интервал (2, 7 – 3, 7), то для уровня значимости 0, 05 свойство нормальности распределения ряда остатков подтверждается.

2 Проверка предпосылок МНК Гипотеза о нулевом значении средней величины остатков проверяется стандартным образом – по t-критерию Стьюдента. Случайный характер остатков проверяется с помощью числа поворотных точек кп. Каждый уровень ряда остатков (кроме первого и последнего) сравнивается с двумя рядом стоящими. Если он больше или меньше их, то эта точка считается поворотной. В случайном ряду чисел должно выполняться неравенство: Соответствие ряда остатков нормальному закону распределения определяют при помощи критерия R/S = ( max - min) : Se , где max – максимальный уровень остатка; min – минимальный уровень остатка; Se – среднеквадратическое отклонение уровней ряда остатков. Если значение R/S–критерия попадает в интервал (2, 7 – 3, 7), то для уровня значимости 0, 05 свойство нормальности распределения ряда остатков подтверждается.

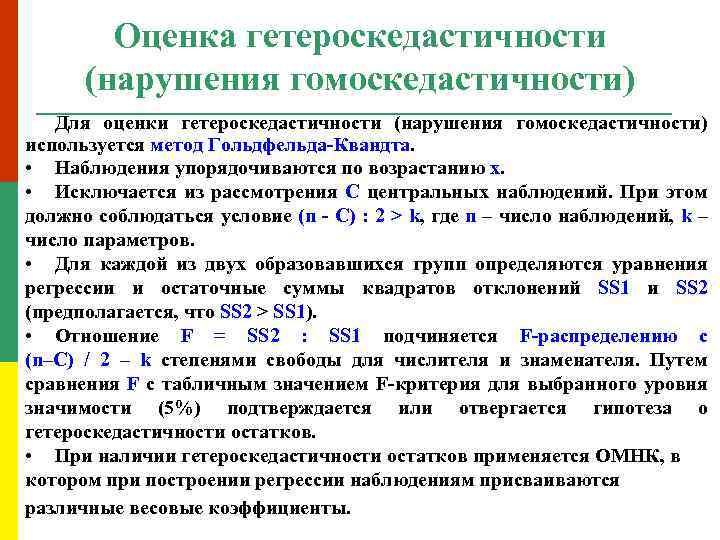

Оценка гетероскедастичности (нарушения гомоскедастичности) Для оценки гетероскедастичности (нарушения гомоскедастичности) используется метод Гольдфельда-Квандта. • Наблюдения упорядочиваются по возрастанию x. • Исключается из рассмотрения С центральных наблюдений. При этом должно соблюдаться условие (n - C) : 2 > k, где n – число наблюдений, k – число параметров. • Для каждой из двух образовавшихся групп определяются уравнения регрессии и остаточные суммы квадратов отклонений SS 1 и SS 2 (предполагается, что SS 2 > SS 1). • Отношение F = SS 2 : SS 1 подчиняется F-распределению с (n–C) / 2 – k степенями свободы для числителя и знаменателя. Путем сравнения F с табличным значением F-критерия для выбранного уровня значимости (5%) подтверждается или отвергается гипотеза о гетероскедастичности остатков. • При наличии гетероскедастичности остатков применяется ОМНК, в котором при построении регрессии наблюдениям присваиваются различные весовые коэффициенты.

Оценка гетероскедастичности (нарушения гомоскедастичности) Для оценки гетероскедастичности (нарушения гомоскедастичности) используется метод Гольдфельда-Квандта. • Наблюдения упорядочиваются по возрастанию x. • Исключается из рассмотрения С центральных наблюдений. При этом должно соблюдаться условие (n - C) : 2 > k, где n – число наблюдений, k – число параметров. • Для каждой из двух образовавшихся групп определяются уравнения регрессии и остаточные суммы квадратов отклонений SS 1 и SS 2 (предполагается, что SS 2 > SS 1). • Отношение F = SS 2 : SS 1 подчиняется F-распределению с (n–C) / 2 – k степенями свободы для числителя и знаменателя. Путем сравнения F с табличным значением F-критерия для выбранного уровня значимости (5%) подтверждается или отвергается гипотеза о гетероскедастичности остатков. • При наличии гетероскедастичности остатков применяется ОМНК, в котором при построении регрессии наблюдениям присваиваются различные весовые коэффициенты.

1 Анализ автокорреляции остатков 2 При проверке независимости уровней ряда остатков (отсутствия автокорреляции) проверяется гипотеза об отсутствии в нем систематической составляющей с помощью d-критерия Дарбина – Уотсона. Его величина вычисляется по формуле: Если значение d превышает 2, то оно заменяется на 4 – d. Вычисленная величина критерия сравнивается с двумя табличными уровнями: нижним d 1 и верхним d 2. Если d находится в интервале от нуля до d 1, то уровни остатков сильно автокоррелированы и модель неадекватна. Если значение d попадает в интервал от d 2 до 2, то уровни ряда являются независимыми. Если значение d находится в интервале от d 1 до d 2, то необходимо применение другого критерия, например, первого коэффициента автокорреляции r 1, который вычисляется как выборочный коэффициент корреляции ряда остатков без последнего значения с рядом остатков без первого значения. При выполнении условия | r 1 | > rтабл присутствие в остаточном ряду существенной автокорреляции подтверждается.

1 Анализ автокорреляции остатков 2 При проверке независимости уровней ряда остатков (отсутствия автокорреляции) проверяется гипотеза об отсутствии в нем систематической составляющей с помощью d-критерия Дарбина – Уотсона. Его величина вычисляется по формуле: Если значение d превышает 2, то оно заменяется на 4 – d. Вычисленная величина критерия сравнивается с двумя табличными уровнями: нижним d 1 и верхним d 2. Если d находится в интервале от нуля до d 1, то уровни остатков сильно автокоррелированы и модель неадекватна. Если значение d попадает в интервал от d 2 до 2, то уровни ряда являются независимыми. Если значение d находится в интервале от d 1 до d 2, то необходимо применение другого критерия, например, первого коэффициента автокорреляции r 1, который вычисляется как выборочный коэффициент корреляции ряда остатков без последнего значения с рядом остатков без первого значения. При выполнении условия | r 1 | > rтабл присутствие в остаточном ряду существенной автокорреляции подтверждается.

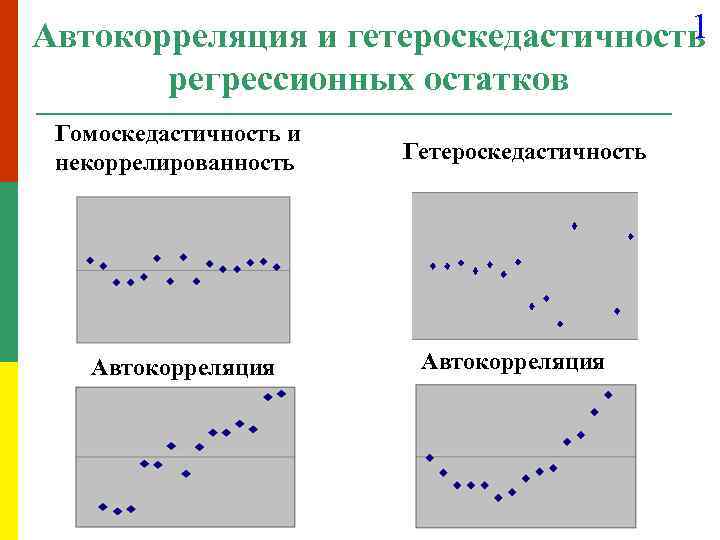

1 Автокорреляция и гетероскедастичность регрессионных остатков Гомоскедастичность и некоррелированность Автокорреляция Гетероскедастичность Автокорреляция

1 Автокорреляция и гетероскедастичность регрессионных остатков Гомоскедастичность и некоррелированность Автокорреляция Гетероскедастичность Автокорреляция

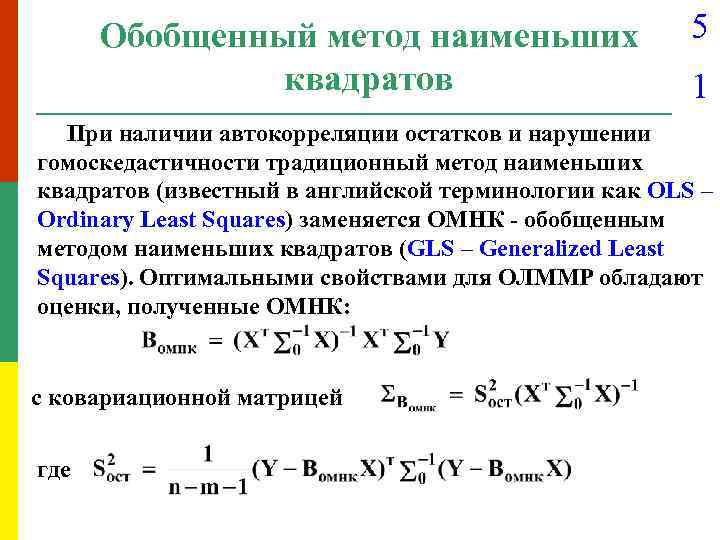

Обобщенный метод наименьших квадратов 5 1 При наличии автокорреляции остатков и нарушении гомоскедастичности традиционный метод наименьших квадратов (известный в английской терминологии как OLS – Ordinary Least Squares) заменяется ОМНК - обобщенным методом наименьших квадратов (GLS – Generalized Least Squares). Оптимальными свойствами для ОЛММР обладают оценки, полученные ОМНК: с ковариационной матрицей где

Обобщенный метод наименьших квадратов 5 1 При наличии автокорреляции остатков и нарушении гомоскедастичности традиционный метод наименьших квадратов (известный в английской терминологии как OLS – Ordinary Least Squares) заменяется ОМНК - обобщенным методом наименьших квадратов (GLS – Generalized Least Squares). Оптимальными свойствами для ОЛММР обладают оценки, полученные ОМНК: с ковариационной матрицей где

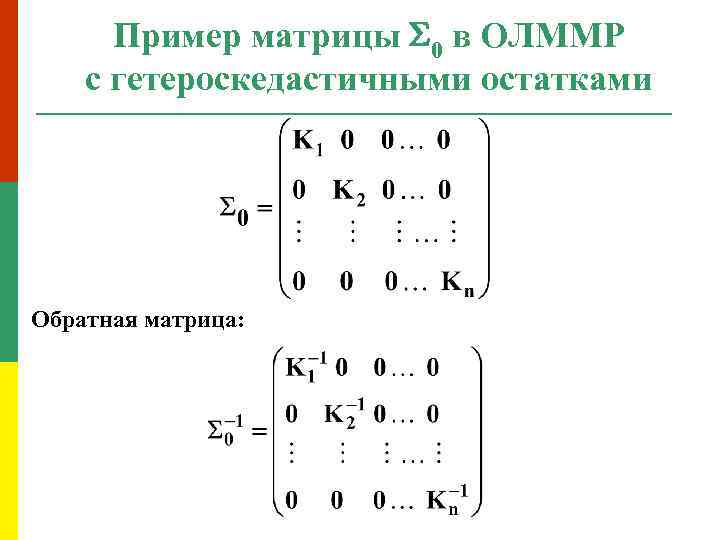

Пример матрицы 0 в ОЛММР с гетероскедастичными остатками Обратная матрица:

Пример матрицы 0 в ОЛММР с гетероскедастичными остатками Обратная матрица:

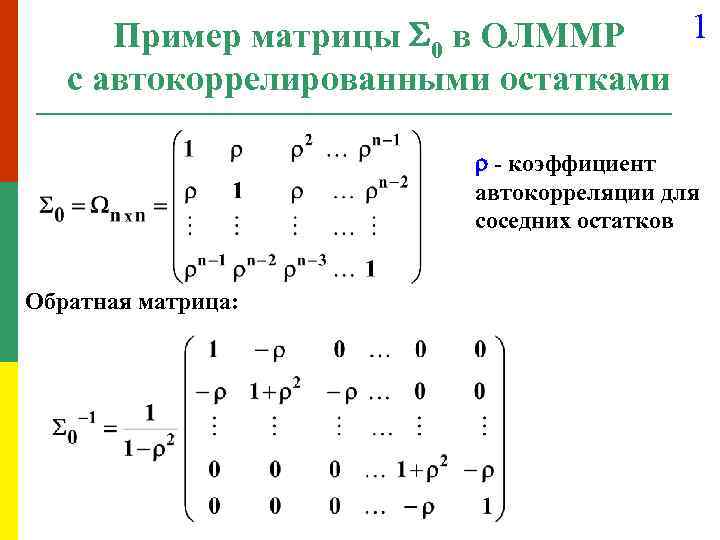

1 Пример матрицы 0 в ОЛММР с автокоррелированными остатками - коэффициент автокорреляции для соседних остатков Обратная матрица:

1 Пример матрицы 0 в ОЛММР с автокоррелированными остатками - коэффициент автокорреляции для соседних остатков Обратная матрица:

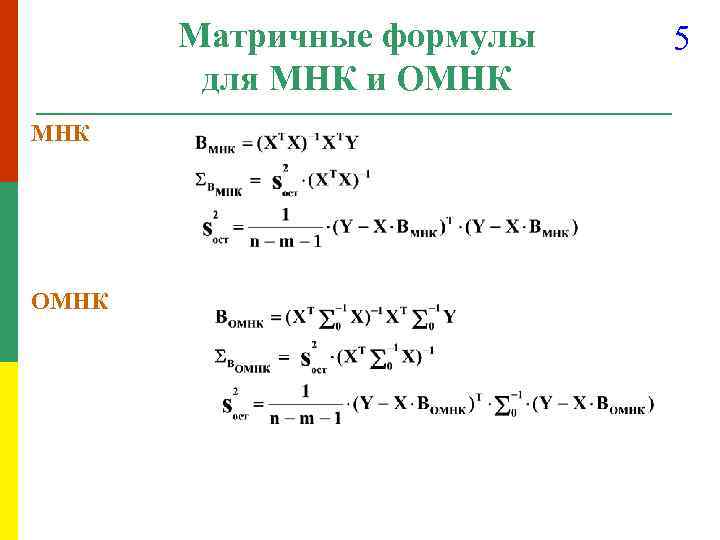

Матричные формулы для МНК и ОМНК 5

Матричные формулы для МНК и ОМНК 5