09 Статистические алгоритмы классификации.pptx

- Количество слайдов: 60

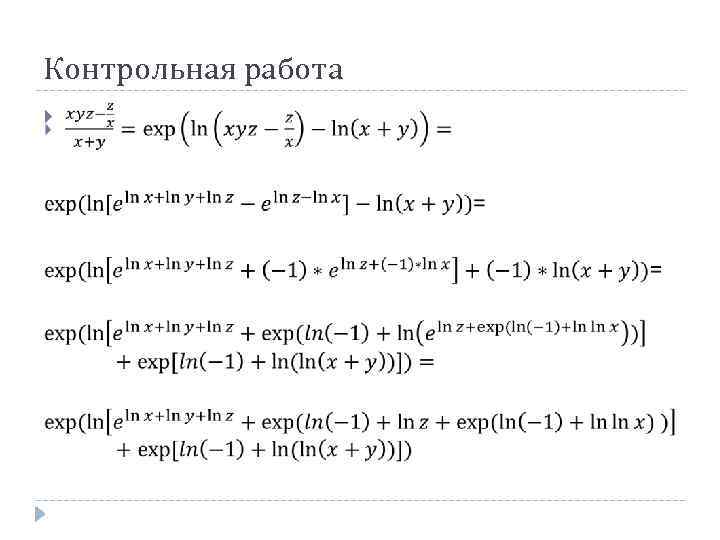

Контрольная работа

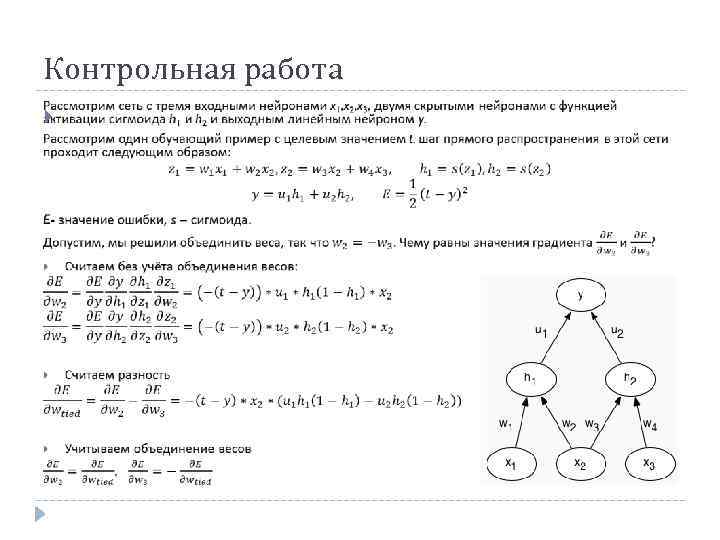

Контрольная работа

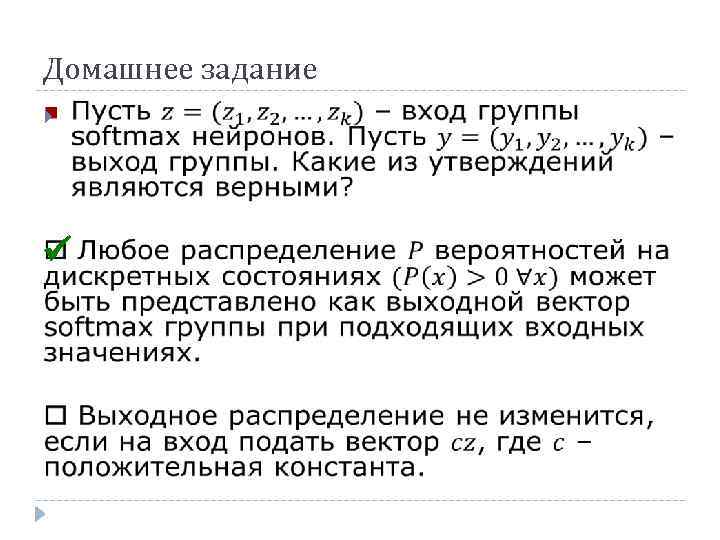

Домашнее задание

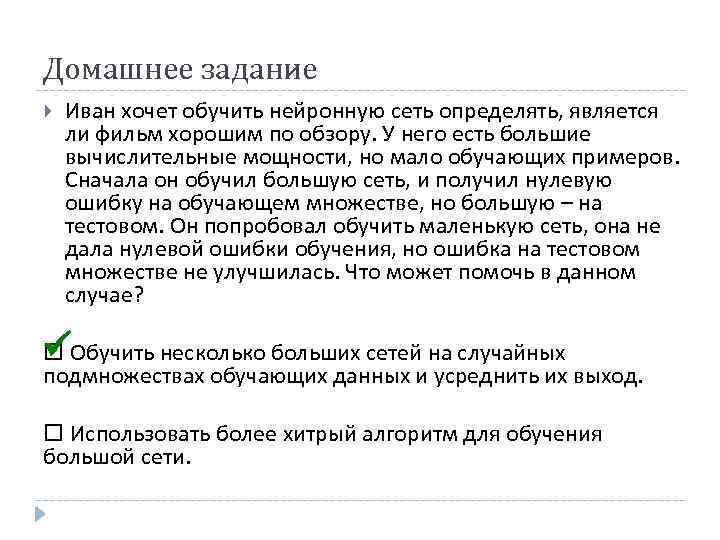

Домашнее задание Иван хочет обучить нейронную сеть определять, является ли фильм хорошим по обзору. У него есть большие вычислительные мощности, но мало обучающих примеров. Сначала он обучил большую сеть, и получил нулевую ошибку на обучающем множестве, но большую – на тестовом. Он попробовал обучить маленькую сеть, она не дала нулевой ошибки обучения, но ошибка на тестовом множестве не улучшилась. Что может помочь в данном случае? Обучить несколько больших сетей на случайных подмножествах обучающих данных и усреднить их выход. Использовать более хитрый алгоритм для обучения большой сети.

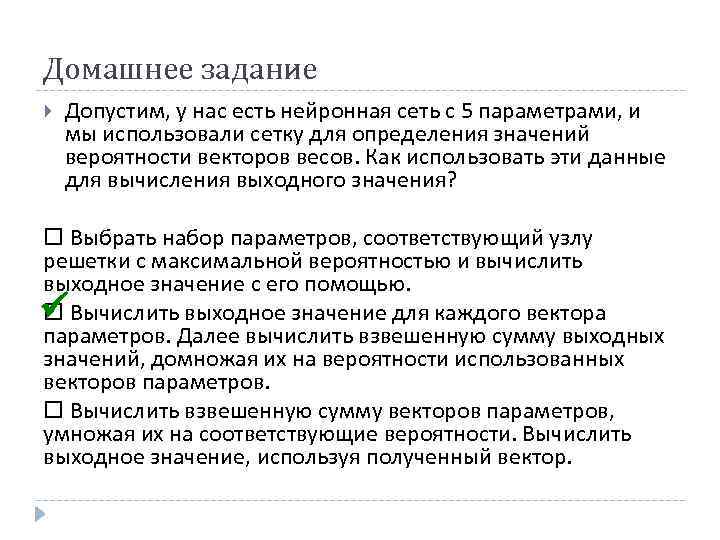

Домашнее задание Допустим, у нас есть нейронная сеть с 5 параметрами, и мы использовали сетку для определения значений вероятности векторов весов. Как использовать эти данные для вычисления выходного значения? Выбрать набор параметров, соответствующий узлу решетки с максимальной вероятностью и вычислить выходное значение с его помощью. Вычислить выходное значение для каждого вектора параметров. Далее вычислить взвешенную сумму выходных значений, домножая их на вероятности использованных векторов параметров. Вычислить взвешенную сумму векторов параметров, умножая их на соответствующие вероятности. Вычислить выходное значение, используя полученный вектор.

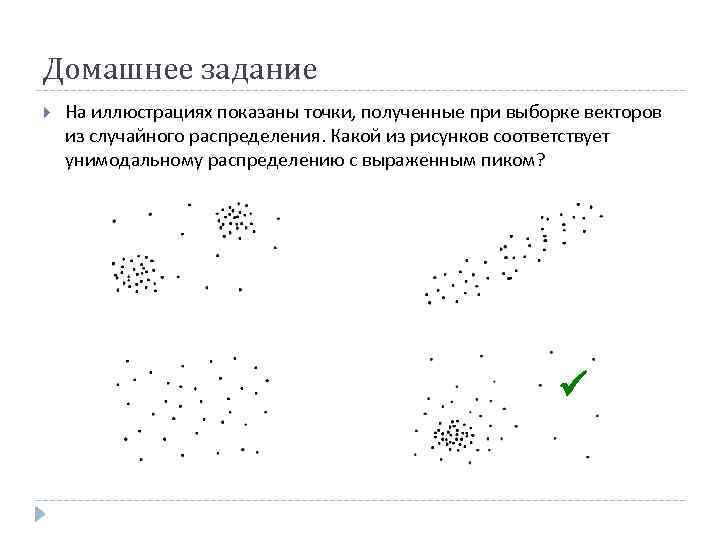

Домашнее задание На иллюстрациях показаны точки, полученные при выборке векторов из случайного распределения. Какой из рисунков соответствует унимодальному распределению с выраженным пиком?

Статистические методы классификации

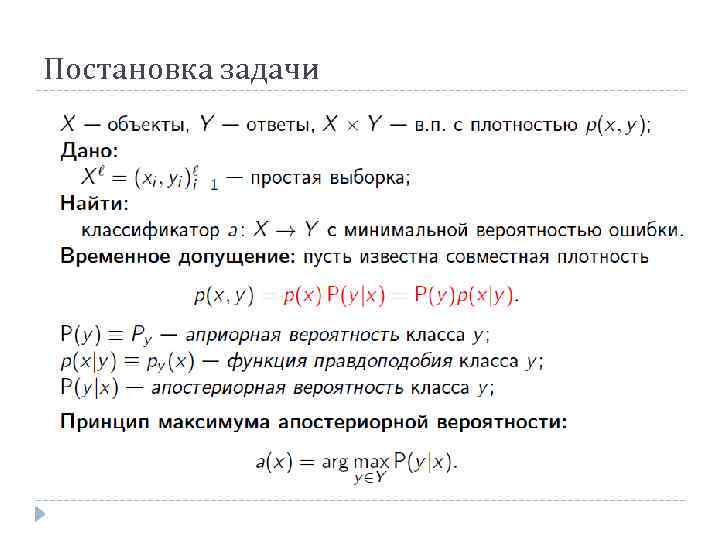

Постановка задачи

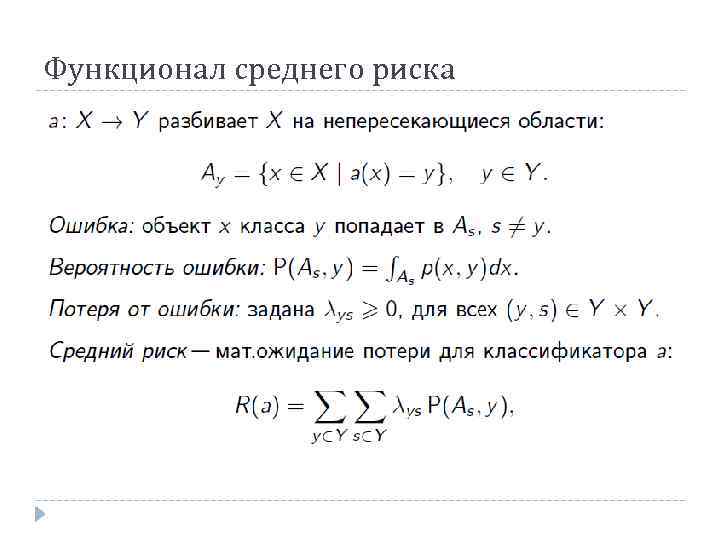

Функционал среднего риска

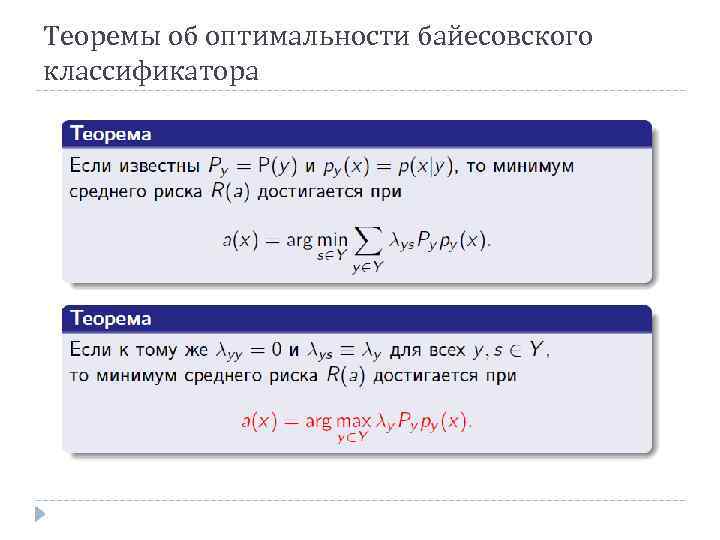

Теоремы об оптимальности байесовского классификатора

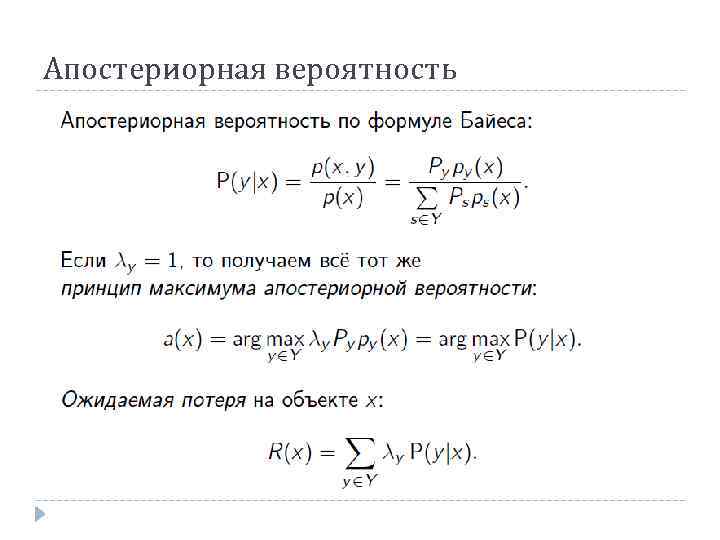

Апостериорная вероятность

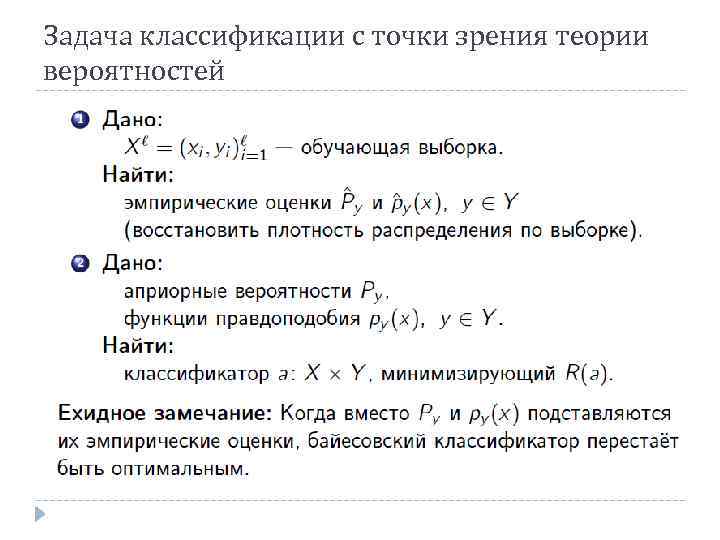

Задача классификации с точки зрения теории вероятностей

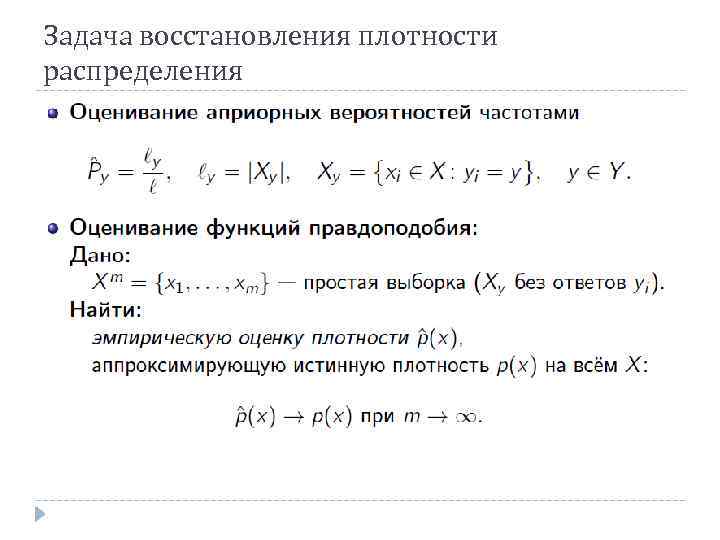

Задача восстановления плотности распределения

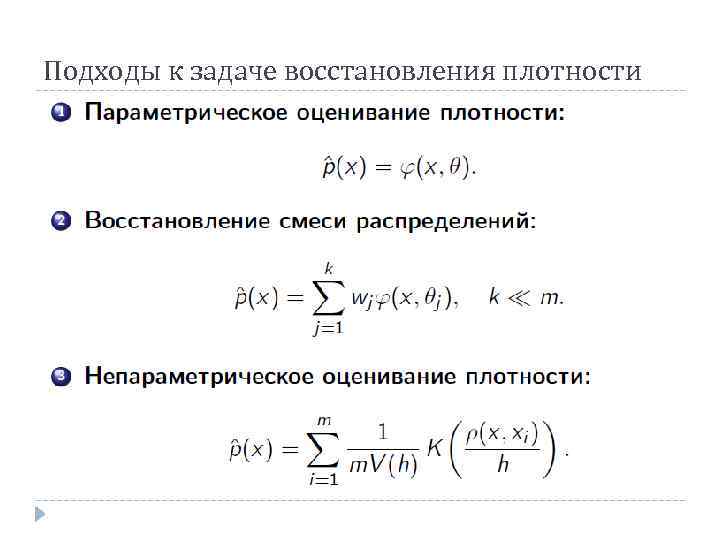

Подходы к задаче восстановления плотности

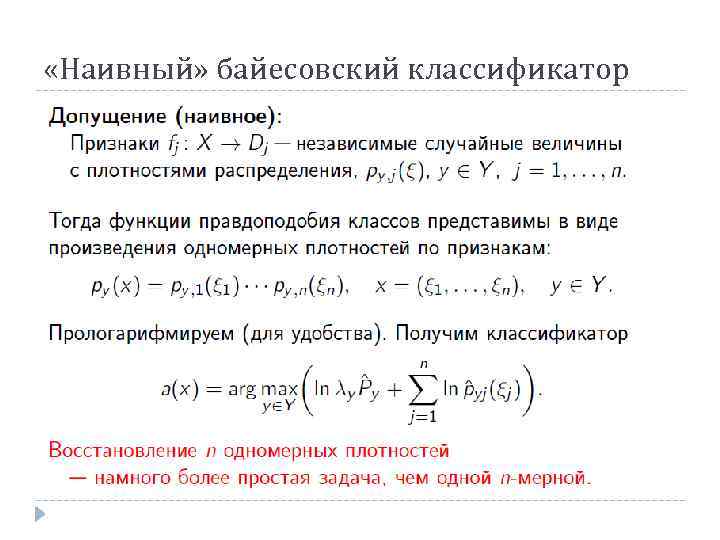

«Наивный» байесовский классификатор

Непараметрическая классификация

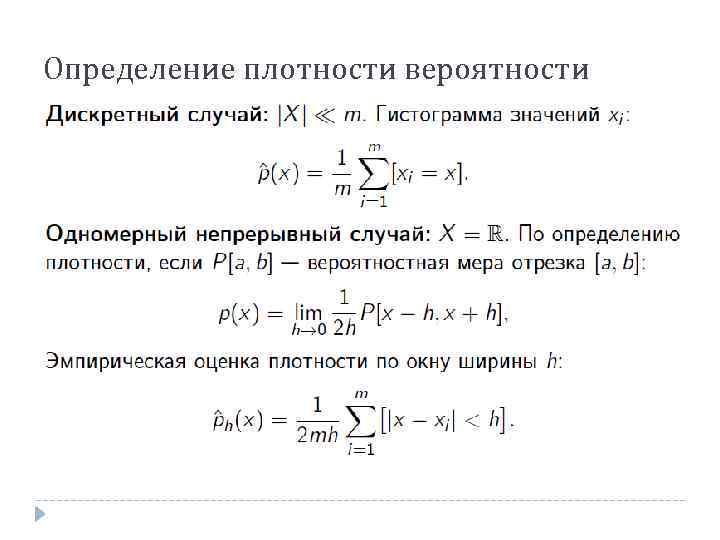

Определение плотности вероятности

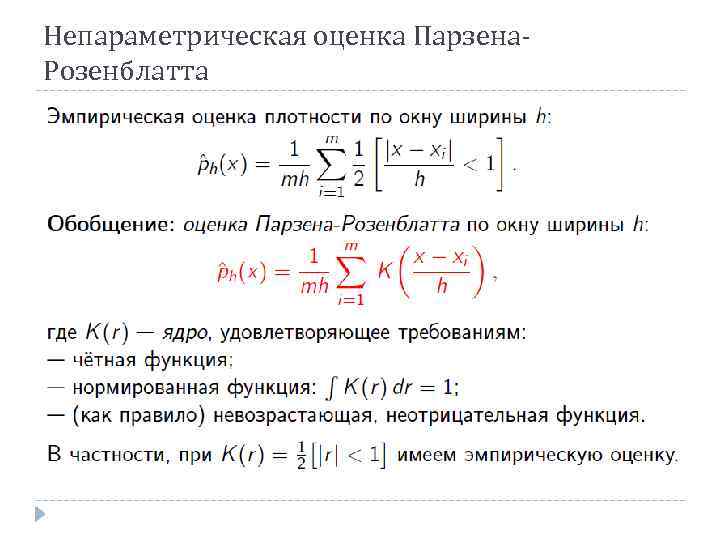

Непараметрическая оценка Парзена. Розенблатта

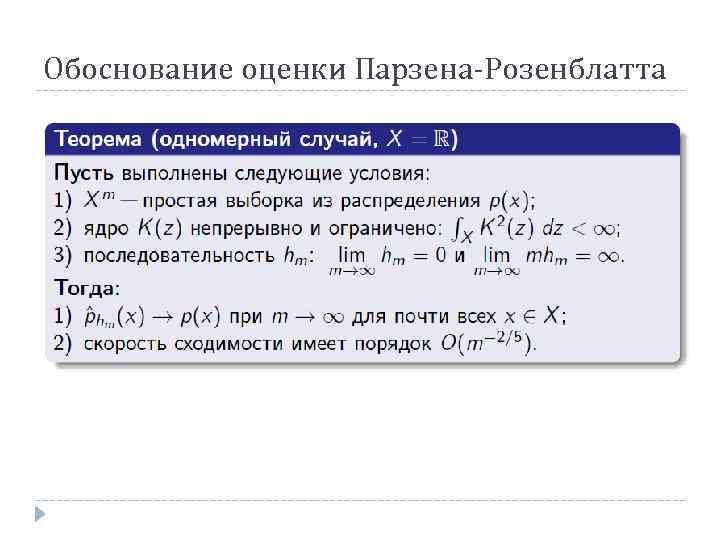

Обоснование оценки Парзена-Розенблатта

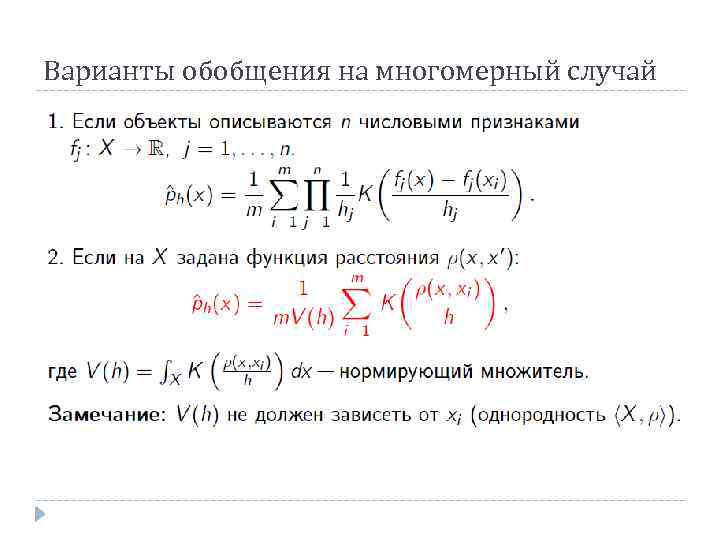

Варианты обобщения на многомерный случай

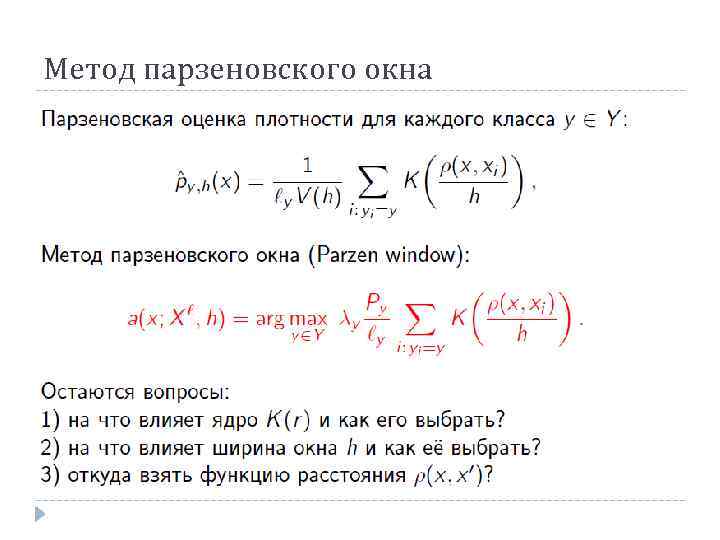

Метод парзеновского окна

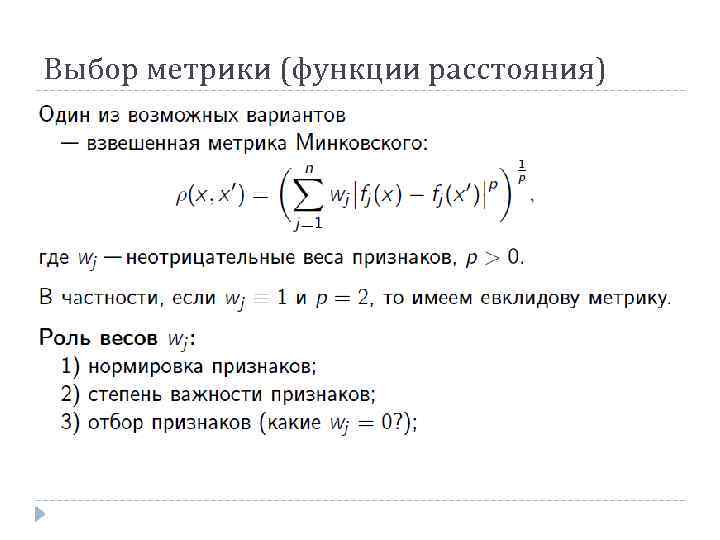

Выбор метрики (функции расстояния)

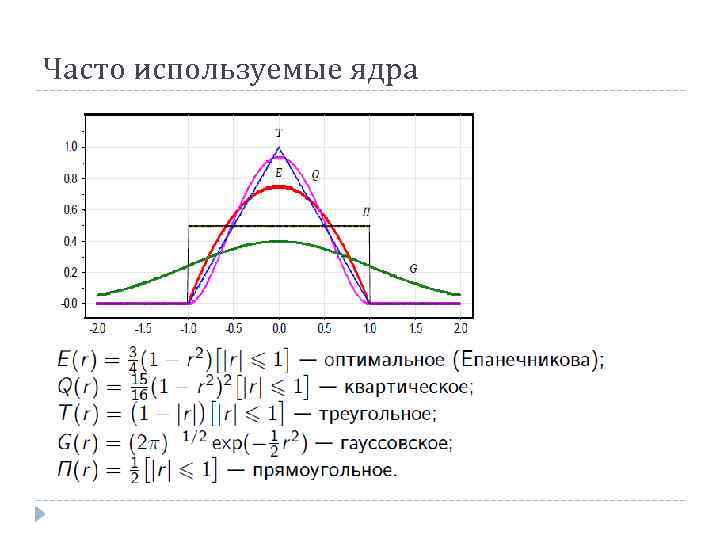

Часто используемые ядра

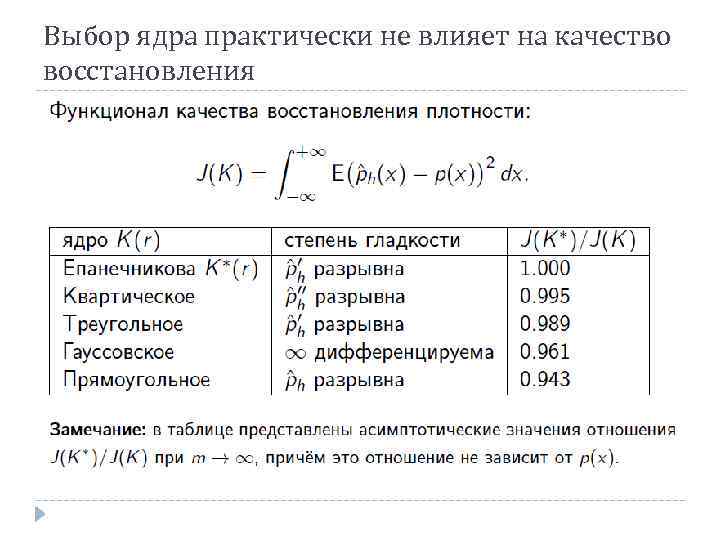

Выбор ядра практически не влияет на качество восстановления

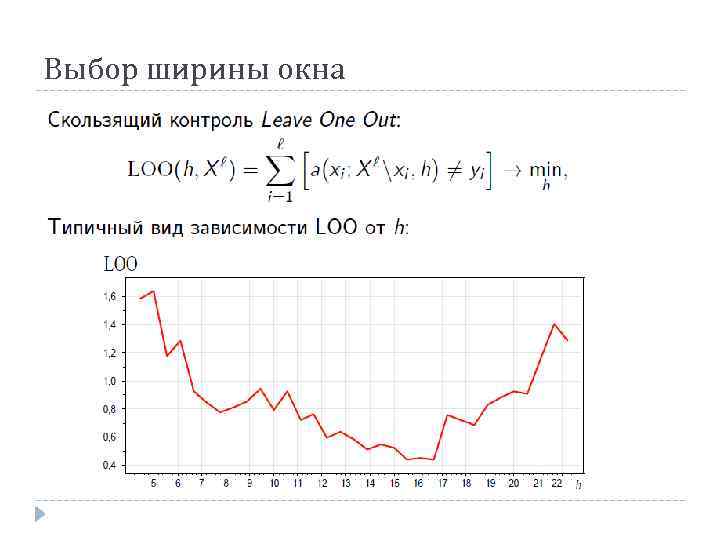

Выбор ширины окна

Окна переменной ширины

Резюме

Параметрическое восстановление плотности

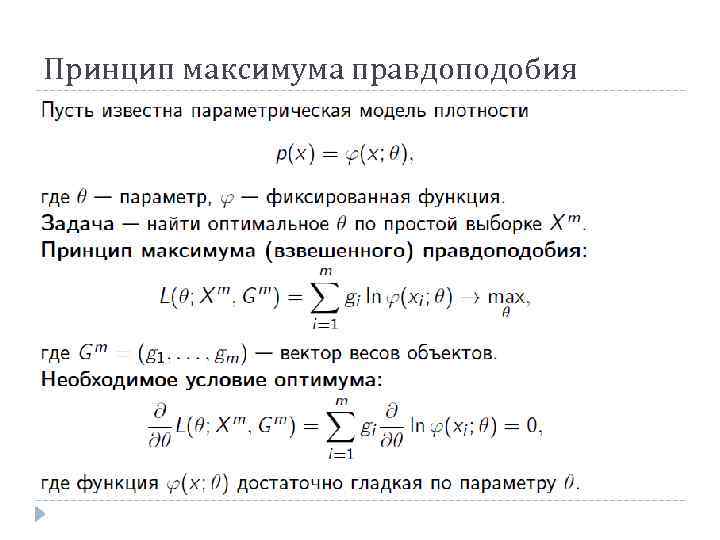

Принцип максимума правдоподобия

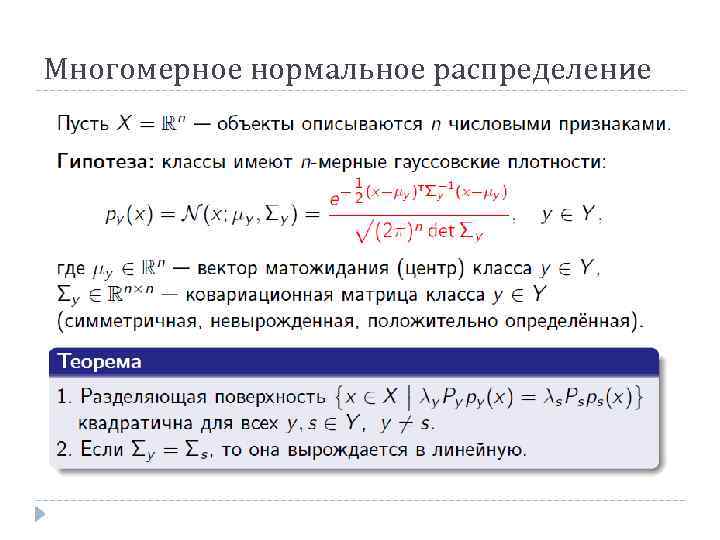

Многомерное нормальное распределение

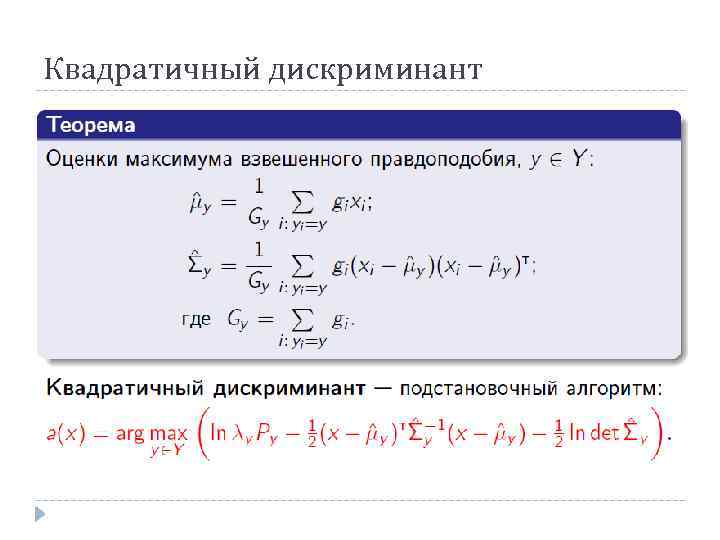

Квадратичный дискриминант

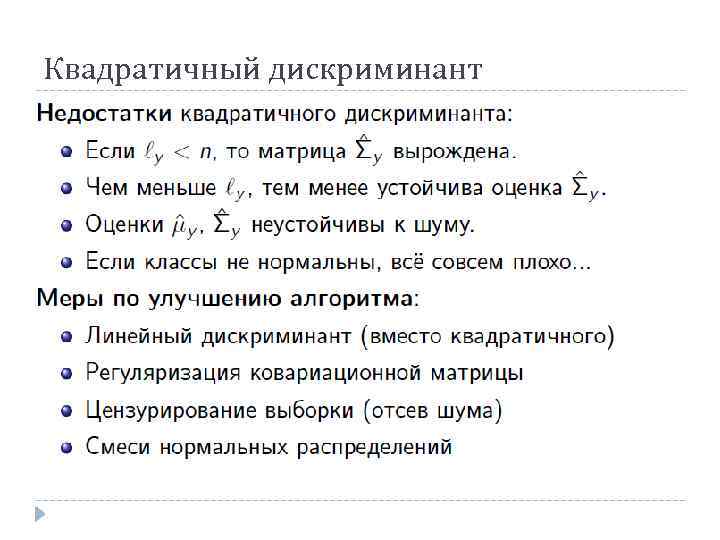

Квадратичный дискриминант

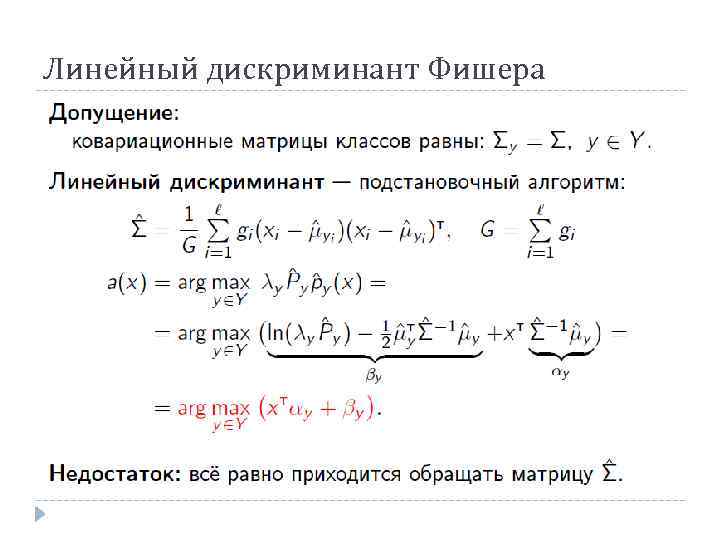

Линейный дискриминант Фишера

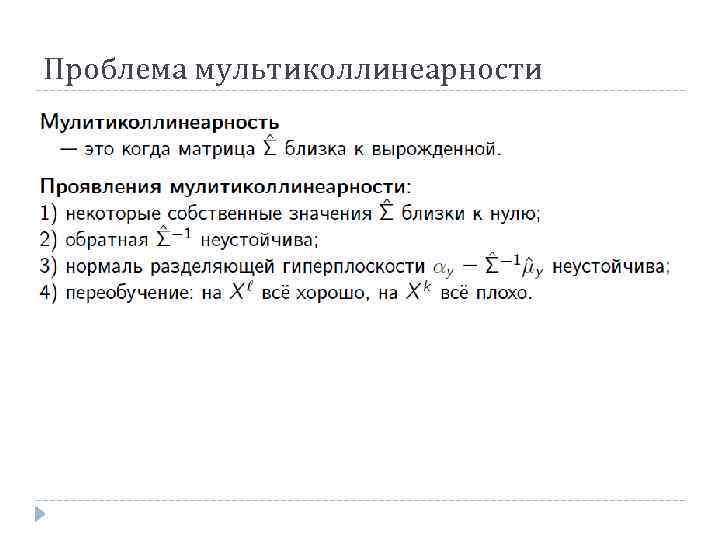

Проблема мультиколлинеарности

Пути повышения качества классификации

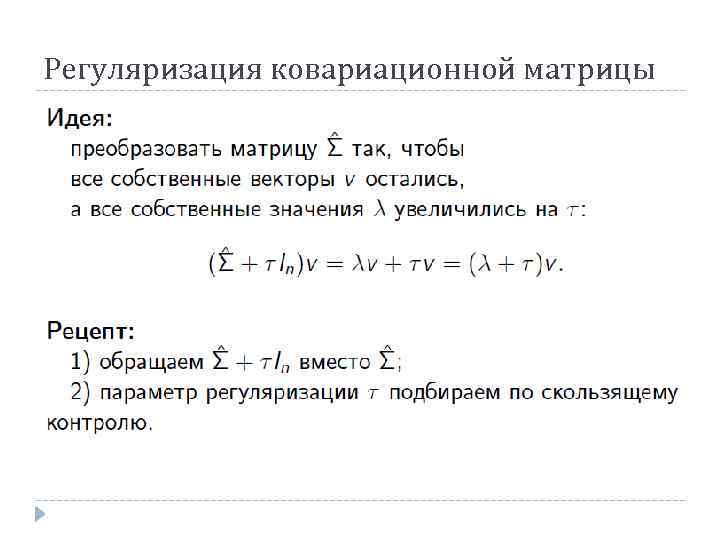

Регуляризация ковариационной матрицы

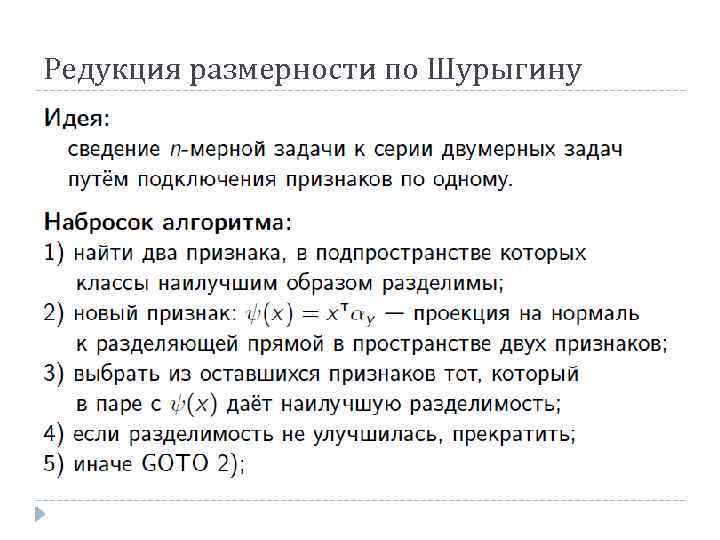

Редукция размерности по Шурыгину

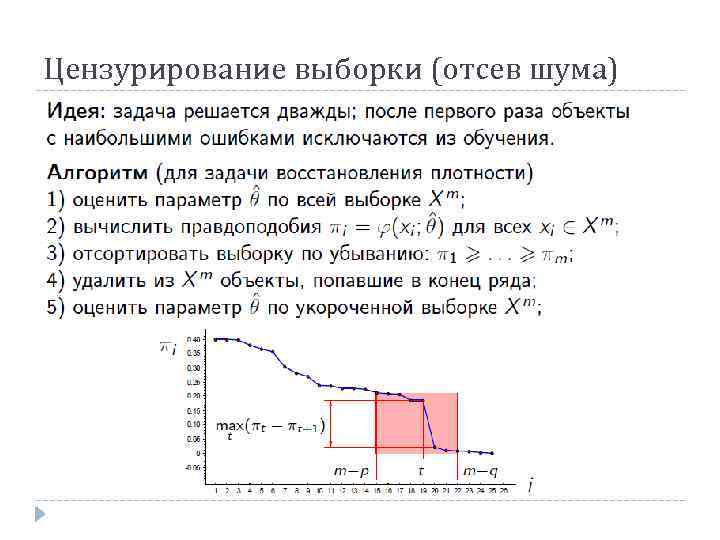

Цензурирование выборки (отсев шума)

Резюме

Восстановление смеси распределений

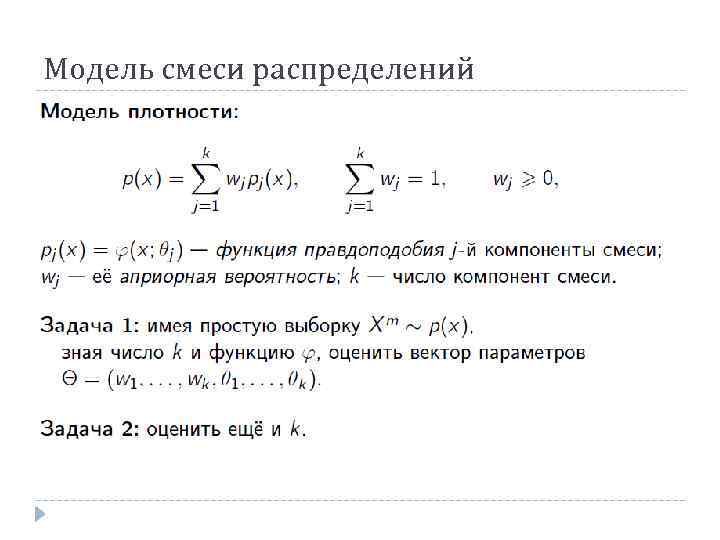

Модель смеси распределений

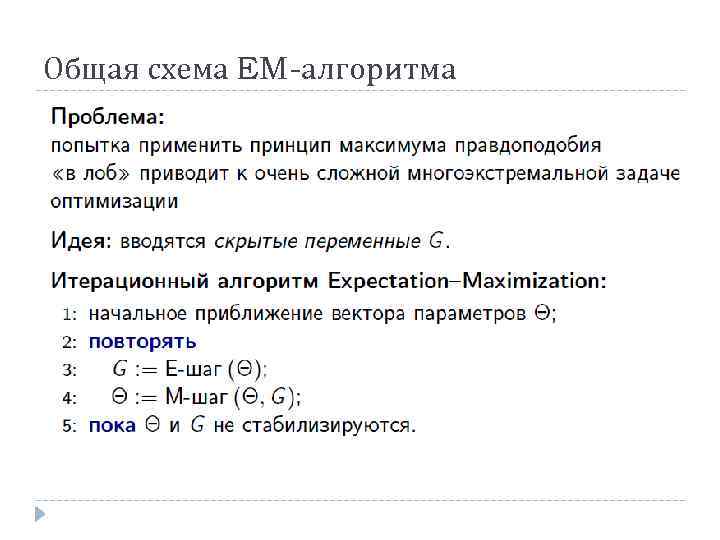

Общая схема EM-алгоритма

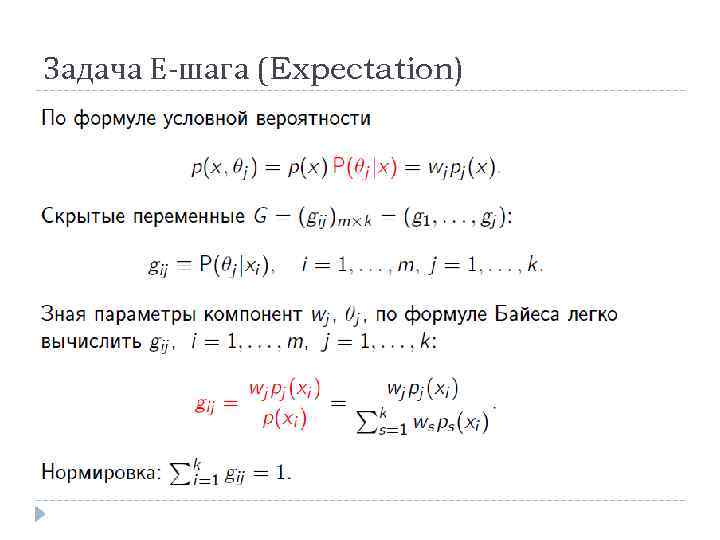

Задача Е-шага (Expectation)

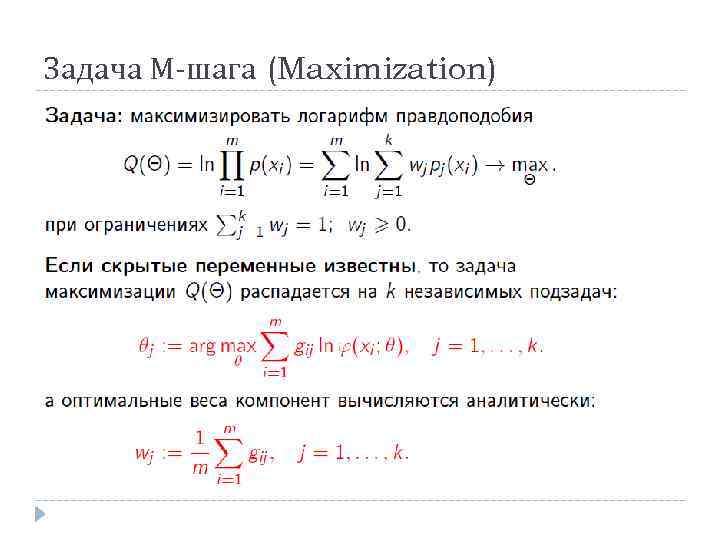

Задача М-шага (Maximization)

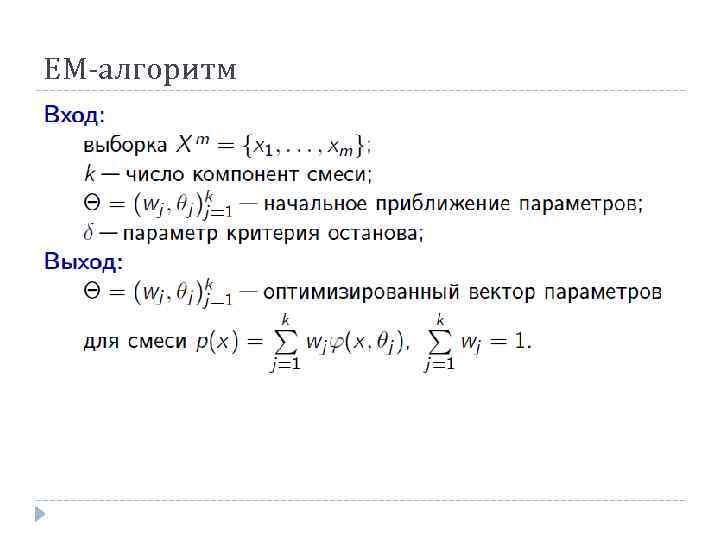

ЕМ-алгоритм

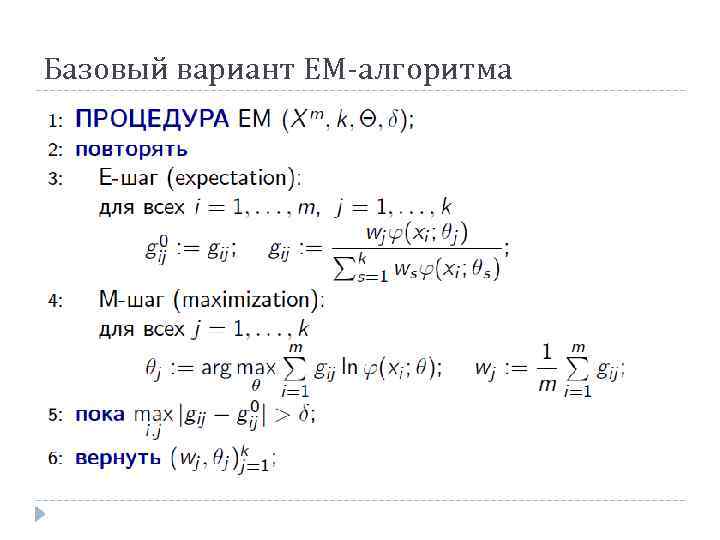

Базовый вариант ЕМ-алгоритма

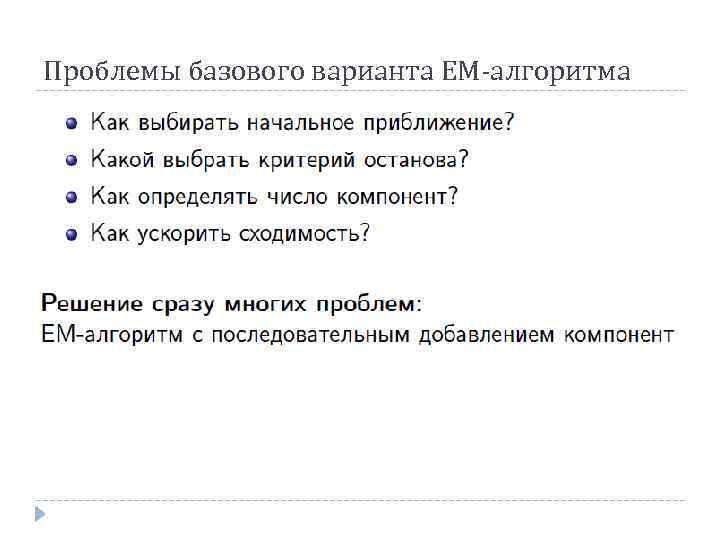

Проблемы базового варианта ЕМ-алгоритма

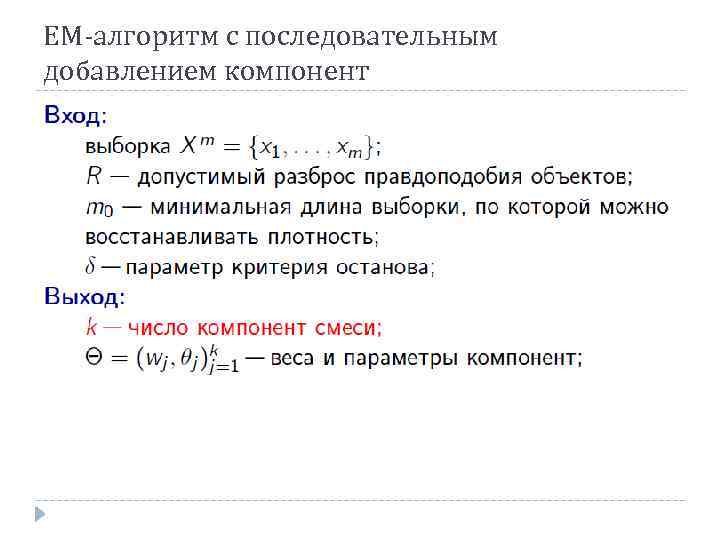

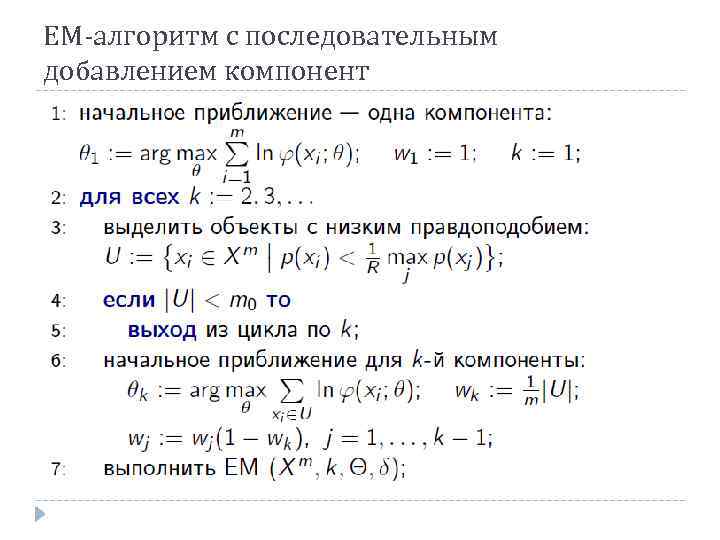

ЕМ-алгоритм с последовательным добавлением компонент

ЕМ-алгоритм с последовательным добавлением компонент

Обобщенный EM-алгоритм

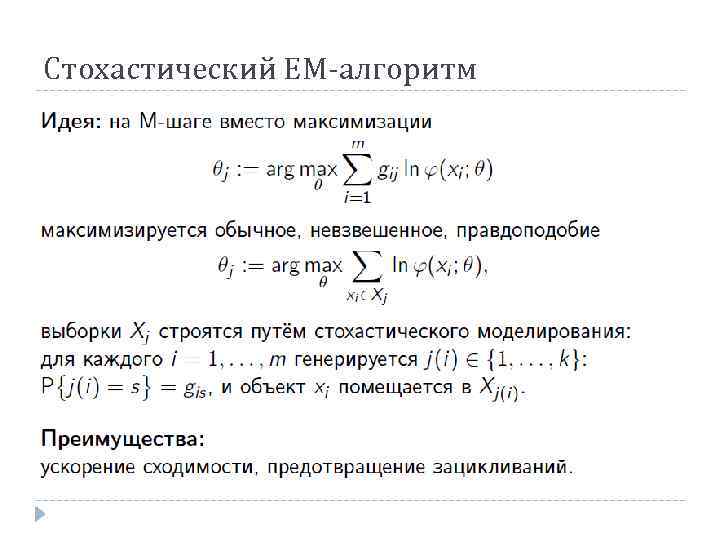

Стохастический ЕМ-алгоритм

Иерархический ЕМ-алгоритм

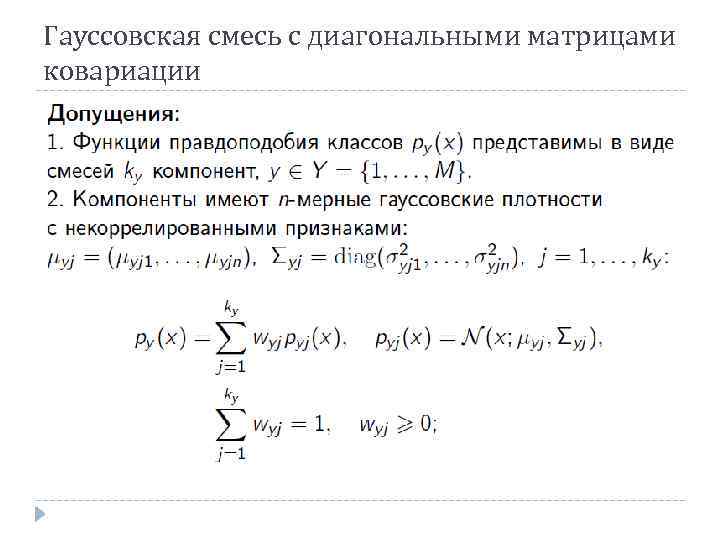

Гауссовская смесь с диагональными матрицами ковариации

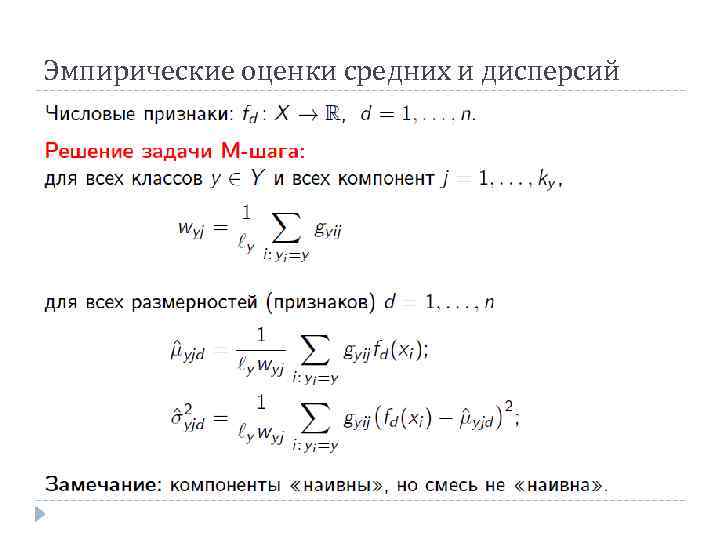

Эмпирические оценки средних и дисперсий

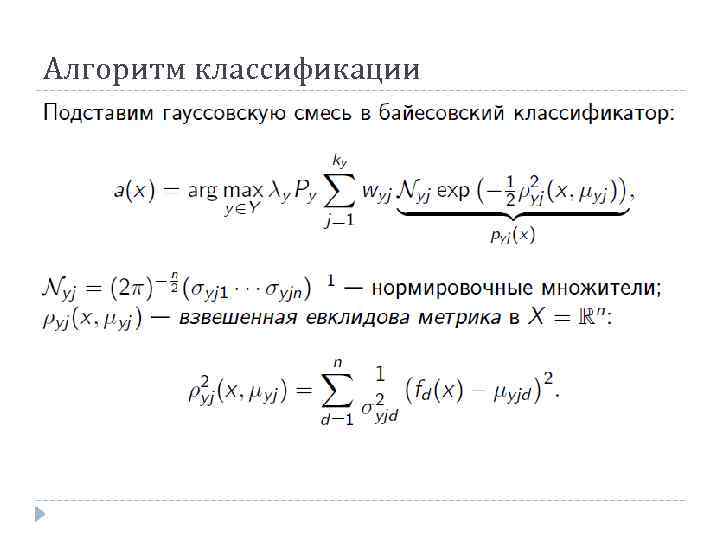

Алгоритм классификации

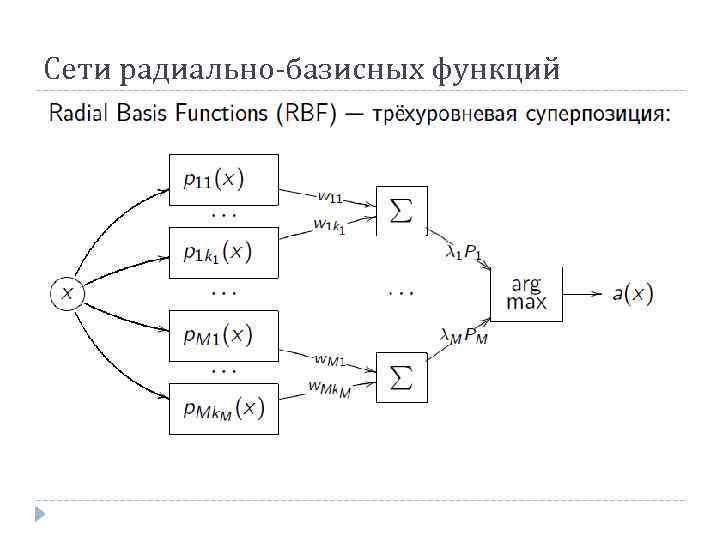

Сети радиально-базисных функций

Свойства алгоритма ЕМ-RBF

Резюме

Резюме

Домашнее задание В чём состоит наивность наивного Байесовского метода? Метод опирается на предположение о том, что признаки являются независимыми случайными величинами. Элементы обучающей выборки выбираются независимо друг от друга. В чём сильнее всего проявляется влияние формы ядра в методе Парзеновского окна? Гладкость получаемой функции распределения Точность восстановления плотности распределения

09 Статистические алгоритмы классификации.pptx