Класстерный анализ л.ppt

- Количество слайдов: 41

Кластерный анализ Многомерные статистики

Кластерный анализ Многомерные статистики

Методы • • Агломеративные (объединяющие) Дивизимные (разъединяющие) Итеративные (пошаговые) Поиска сгущений

Методы • • Агломеративные (объединяющие) Дивизимные (разъединяющие) Итеративные (пошаговые) Поиска сгущений

условные обозначения: X 1, X 2, . . , Хn — совокупность объектов наблюдения; Xi = (Xi 1, Xi 2, …, Xim) - i-е многомерное наблюдение в m-мерном пространстве признаков (i = 1, 2, . . . , n); dil — расстояние между i-м и l-м объектами; Zij — нормированные значения исходных переменных; D — матрица расстояний между объектами.

условные обозначения: X 1, X 2, . . , Хn — совокупность объектов наблюдения; Xi = (Xi 1, Xi 2, …, Xim) - i-е многомерное наблюдение в m-мерном пространстве признаков (i = 1, 2, . . . , n); dil — расстояние между i-м и l-м объектами; Zij — нормированные значения исходных переменных; D — матрица расстояний между объектами.

Меры сходства • Для проведения классификации необходимо ввести понятие сходства объектов по наблюдаемым переменным. В каждый кластер (класс, таксон) должны попасть объекты, имеющие сходные характеристики. • В кластерном анализе для количественной оценки сходства вводится понятие метрики. Сходство или различие между классифицируемыми объектами устанавливается в зависимости от метрического расстояния между ними.

Меры сходства • Для проведения классификации необходимо ввести понятие сходства объектов по наблюдаемым переменным. В каждый кластер (класс, таксон) должны попасть объекты, имеющие сходные характеристики. • В кластерном анализе для количественной оценки сходства вводится понятие метрики. Сходство или различие между классифицируемыми объектами устанавливается в зависимости от метрического расстояния между ними.

• Если каждый объект описывается k признаками, то он может быть представлен как точка в k-мерном пространстве, и сходство с другими объектами будет определяться как соответствующее расстояние.

• Если каждый объект описывается k признаками, то он может быть представлен как точка в k-мерном пространстве, и сходство с другими объектами будет определяться как соответствующее расстояние.

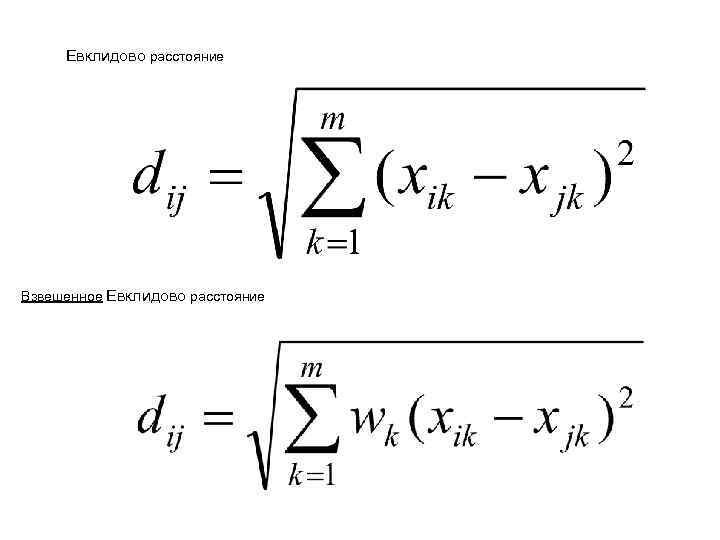

Евклидово расстояние Взвешенное Евклидово расстояние

Евклидово расстояние Взвешенное Евклидово расстояние

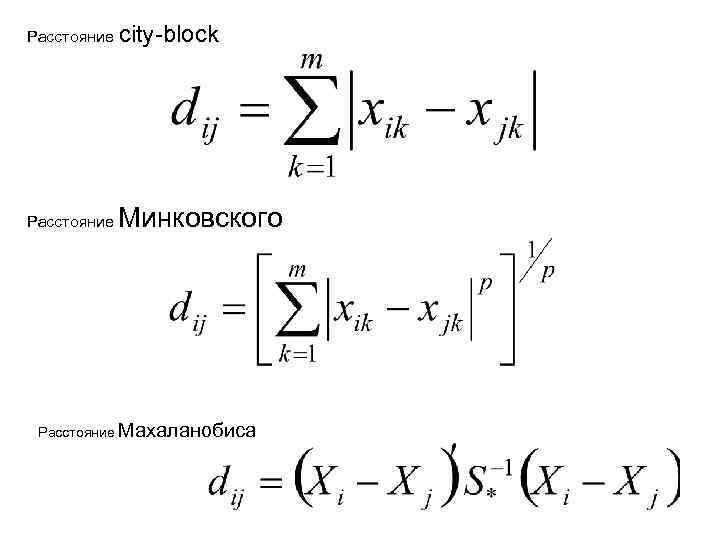

Расстояние city-block Расстояние Минковского Расстояние Махаланобиса

Расстояние city-block Расстояние Минковского Расстояние Махаланобиса

где • dij — расстояние между i-м j-м объектами; • xil, xjl — значения l-й переменной соответственно у i-го и j-го объектов; • Xi, Xj — векторы значений переменных у i-го и j-го объектов; • S* — общая ковариационная матрица; • wk — вес, приписываемый k-й переменной.

где • dij — расстояние между i-м j-м объектами; • xil, xjl — значения l-й переменной соответственно у i-го и j-го объектов; • Xi, Xj — векторы значений переменных у i-го и j-го объектов; • S* — общая ковариационная матрица; • wk — вес, приписываемый k-й переменной.

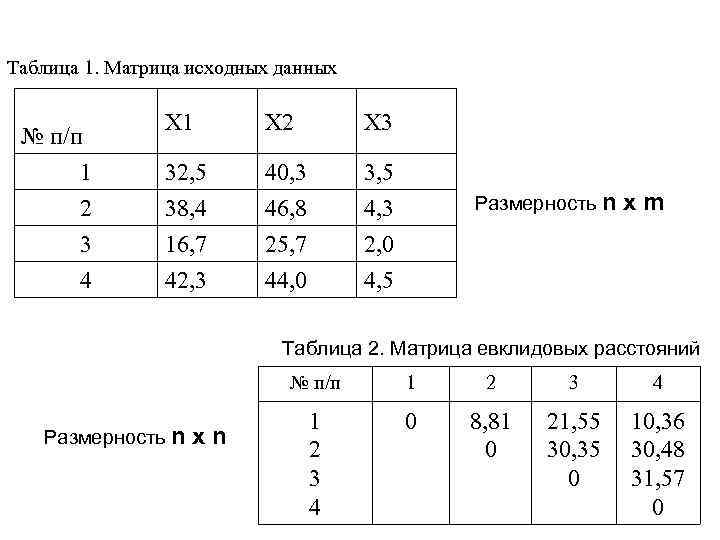

Таблица 1. Матрица исходных данных № п/п 1 2 3 4 X 1 Х 2 X 3 32, 5 38, 4 16, 7 42, 3 40, 3 46, 8 25, 7 44, 0 3, 5 4, 3 2, 0 4, 5 Размерность n xm Таблица 2. Матрица евклидовых расстояний № п/п Размерность n xn 1 2 3 4 0 8, 81 0 21, 55 30, 35 0 10, 36 30, 48 31, 57 0

Таблица 1. Матрица исходных данных № п/п 1 2 3 4 X 1 Х 2 X 3 32, 5 38, 4 16, 7 42, 3 40, 3 46, 8 25, 7 44, 0 3, 5 4, 3 2, 0 4, 5 Размерность n xm Таблица 2. Матрица евклидовых расстояний № п/п Размерность n xn 1 2 3 4 0 8, 81 0 21, 55 30, 35 0 10, 36 30, 48 31, 57 0

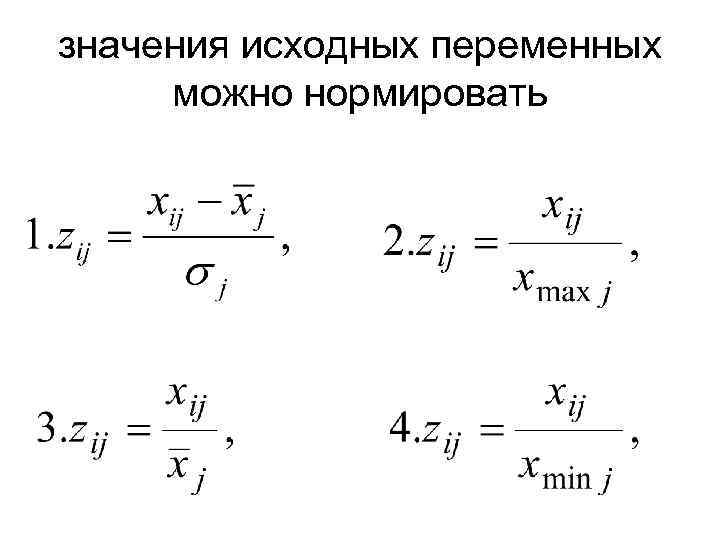

значения исходных переменных можно нормировать

значения исходных переменных можно нормировать

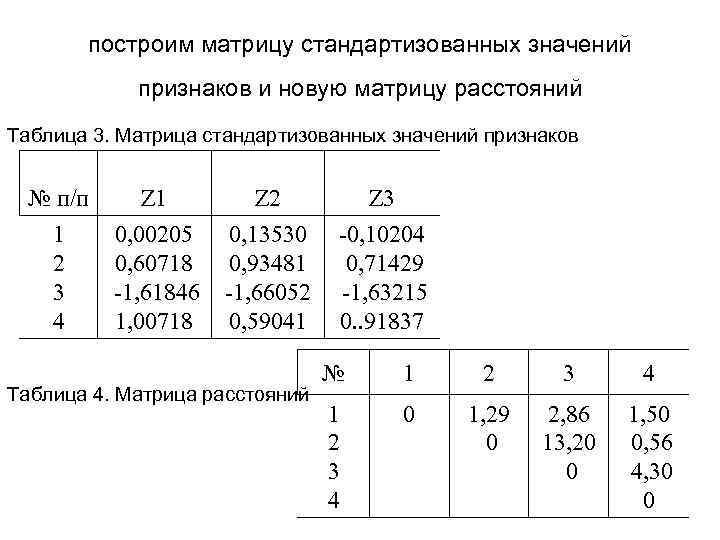

построим матрицу стандартизованных значений признаков и новую матрицу расстояний Таблица 3. Матрица стандартизованных значений признаков № п/п Z 1 Z 2 Z 3 1 2 3 4 0, 00205 0, 60718 -1, 61846 1, 00718 0, 13530 0, 93481 -1, 66052 0, 59041 -0, 10204 0, 71429 -1, 63215 0. . 91837 Таблица 4. Матрица расстояний № 1 2 3 4 0 1, 29 0 2, 86 13, 20 0 1, 50 0, 56 4, 30 0

построим матрицу стандартизованных значений признаков и новую матрицу расстояний Таблица 3. Матрица стандартизованных значений признаков № п/п Z 1 Z 2 Z 3 1 2 3 4 0, 00205 0, 60718 -1, 61846 1, 00718 0, 13530 0, 93481 -1, 66052 0, 59041 -0, 10204 0, 71429 -1, 63215 0. . 91837 Таблица 4. Матрица расстояний № 1 2 3 4 0 1, 29 0 2, 86 13, 20 0 1, 50 0, 56 4, 30 0

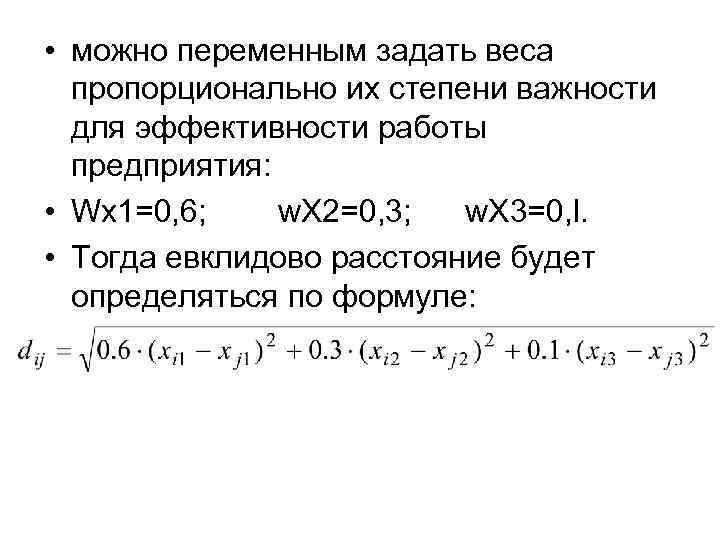

• можно переменным задать веса пропорционально их степени важности для эффективности работы предприятия: • Wx 1=0, 6; w. X 2=0, 3; w. X 3=0, l. • Тогда евклидово расстояние будет определяться по формуле:

• можно переменным задать веса пропорционально их степени важности для эффективности работы предприятия: • Wx 1=0, 6; w. X 2=0, 3; w. X 3=0, l. • Тогда евклидово расстояние будет определяться по формуле:

Если алгоритм кластеризации основан на измерении сходства между переменными, то в качестве мер сходства могут быть использованы: • • линейные коэффициенты корреляции; • • коэффициенты ранговой корреляции; • • коэффициенты контингенции и т. д. В зависимости от типов исходных переменных выбирается один из видов показателей, характеризующих близость между ними.

Если алгоритм кластеризации основан на измерении сходства между переменными, то в качестве мер сходства могут быть использованы: • • линейные коэффициенты корреляции; • • коэффициенты ранговой корреляции; • • коэффициенты контингенции и т. д. В зависимости от типов исходных переменных выбирается один из видов показателей, характеризующих близость между ними.

Иерархический кластерный анализ

Иерархический кластерный анализ

• первом шаге каждый объект выборки рассматривается как отдельный кластер. • Процесс объединения кластеров происходит последовательно: на основании матрицы расстояний или матрицы сходства объединяются наиболее близкие объекты. • Если матрица сходства первоначально имеет размерность m х m, то полностью процесс кластеризации завершается за m-1 шагов, в итоге все объекты будут объединены в один кластер. • Последовательность объединения легко поддается геометрической интерпретации и может быть представлена в виде графа-дерева (дендрограммы).

• первом шаге каждый объект выборки рассматривается как отдельный кластер. • Процесс объединения кластеров происходит последовательно: на основании матрицы расстояний или матрицы сходства объединяются наиболее близкие объекты. • Если матрица сходства первоначально имеет размерность m х m, то полностью процесс кластеризации завершается за m-1 шагов, в итоге все объекты будут объединены в один кластер. • Последовательность объединения легко поддается геометрической интерпретации и может быть представлена в виде графа-дерева (дендрограммы).

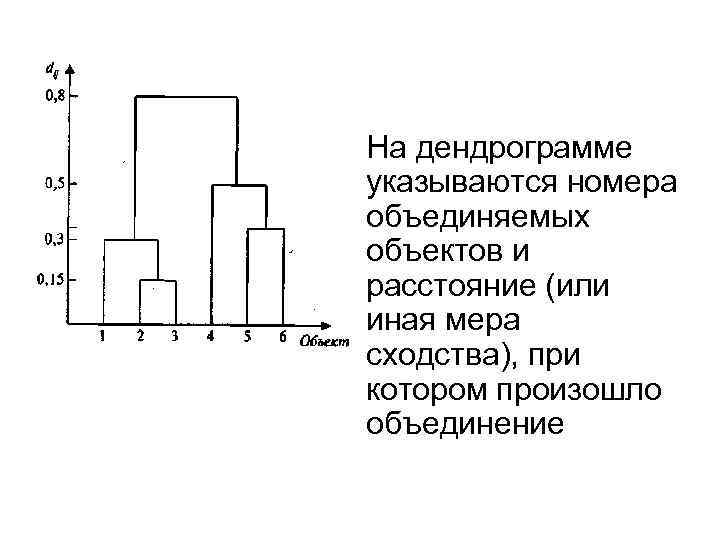

• На дендрограмме указываются номера объединяемых объектов и расстояние (или иная мера сходства), при котором произошло объединение

• На дендрограмме указываются номера объединяемых объектов и расстояние (или иная мера сходства), при котором произошло объединение

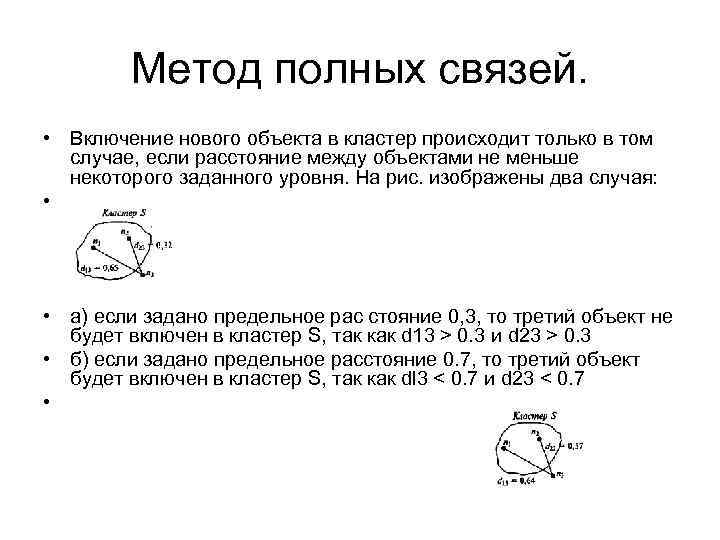

Метод полных связей. • Включение нового объекта в кластер происходит только в том случае, если расстояние между объектами не меньше некоторого заданного уровня. На рис. изображены два случая: • • а) если задано предельное рас стояние 0, 3, то третий объект не будет включен в кластер S, так как d 13 > 0. 3 и d 23 > 0. 3 • б) если задано предельное расстояние 0. 7, то третий объект будет включен в кластер S, так как dl 3 < 0. 7 и d 23 < 0. 7 •

Метод полных связей. • Включение нового объекта в кластер происходит только в том случае, если расстояние между объектами не меньше некоторого заданного уровня. На рис. изображены два случая: • • а) если задано предельное рас стояние 0, 3, то третий объект не будет включен в кластер S, так как d 13 > 0. 3 и d 23 > 0. 3 • б) если задано предельное расстояние 0. 7, то третий объект будет включен в кластер S, так как dl 3 < 0. 7 и d 23 < 0. 7 •

Объединение двух кластеров по методу средней связи

Объединение двух кластеров по методу средней связи

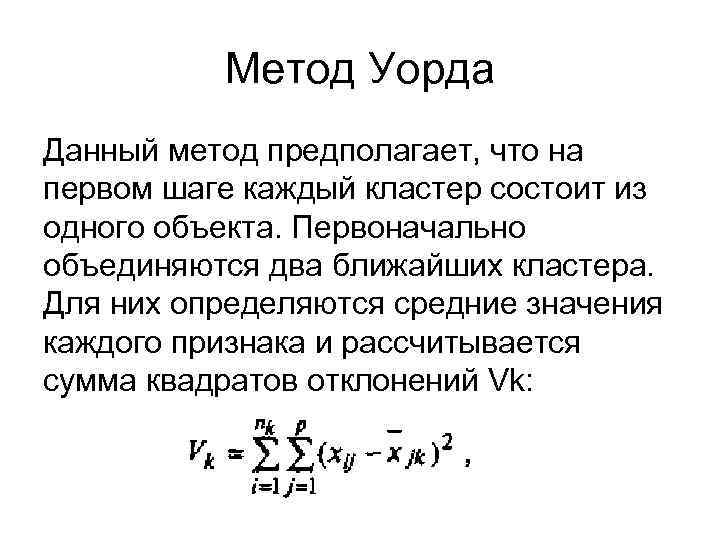

Метод Уорда Данный метод предполагает, что на первом шаге каждый кластер состоит из одного объекта. Первоначально объединяются два ближайших кластера. Для них определяются средние значения каждого признака и рассчитывается сумма квадратов отклонений Vk:

Метод Уорда Данный метод предполагает, что на первом шаге каждый кластер состоит из одного объекта. Первоначально объединяются два ближайших кластера. Для них определяются средние значения каждого признака и рассчитывается сумма квадратов отклонений Vk:

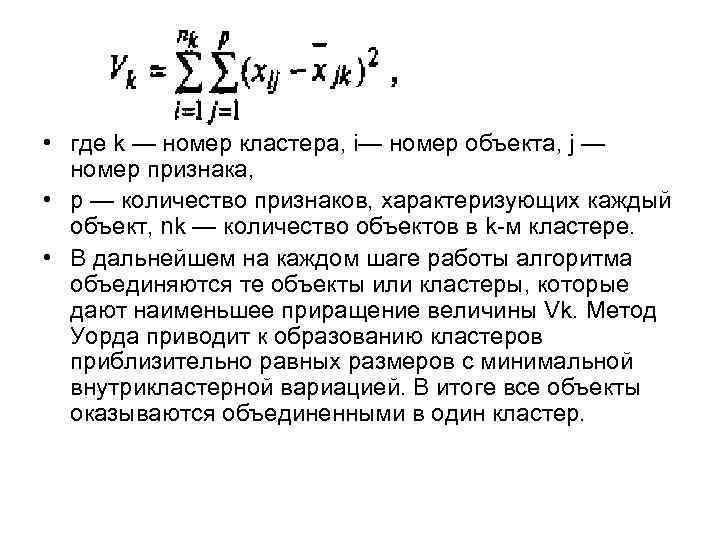

• где k — номер кластера, i— номер объекта, j — номер признака, • р — количество признаков, характеризующих каждый объект, nk — количество объектов в k-м кластере. • В дальнейшем на каждом шаге работы алгоритма объединяются те объекты или кластеры, которые дают наименьшее приращение величины Vk. Метод Уорда приводит к образованию кластеров приблизительно равных размеров с минимальной внутрикластерной вариацией. В итоге все объекты оказываются объединенными в один кластер.

• где k — номер кластера, i— номер объекта, j — номер признака, • р — количество признаков, характеризующих каждый объект, nk — количество объектов в k-м кластере. • В дальнейшем на каждом шаге работы алгоритма объединяются те объекты или кластеры, которые дают наименьшее приращение величины Vk. Метод Уорда приводит к образованию кластеров приблизительно равных размеров с минимальной внутрикластерной вариацией. В итоге все объекты оказываются объединенными в один кластер.

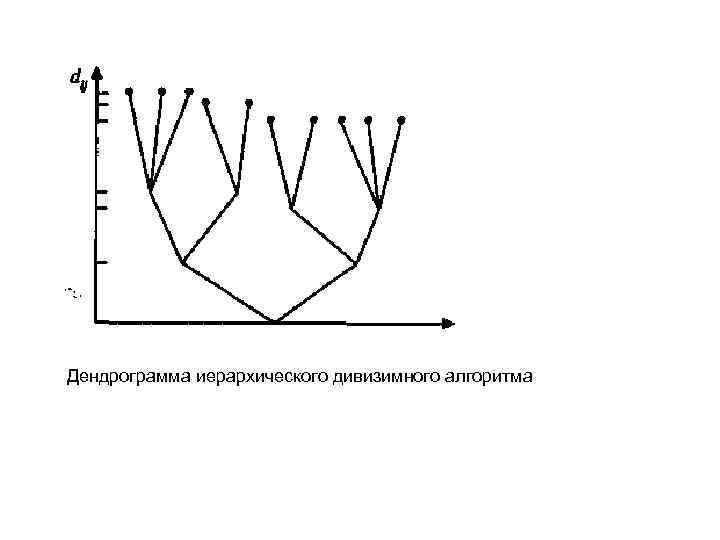

Дендрограмма иерархического дивизимного алгоритма

Дендрограмма иерархического дивизимного алгоритма

Метод k-средних • Метод k-средних принадлежит к группе итеративных методов эталонного типа. Само название метода было предложено Дж. Мак-Куином в 1967 г.

Метод k-средних • Метод k-средних принадлежит к группе итеративных методов эталонного типа. Само название метода было предложено Дж. Мак-Куином в 1967 г.

• Пусть имеется n наблюдений, каждое из которых характеризуется р признаками X 1, X 2, …, Хр. Эти наблюдения необходимо разбить на k кластеров. Для начала из n точек исследуемой совокупности отбираются случайным образом или задаются исследователем исходя из каких-либо априорных соображений k точек (объектов). Эти точки принимаются за эталоны. Каждому эталону присваивается порядковый номер, который одновременно является и номером кластера. На первом шаге из оставшихся (n - k) объектов извлекается точка Хi с координатами (xi 1; хi 2, . . . , хiр) и проверяется, к какому из эталонов (центров) она находится ближе всего. Для этого используется одна из метрик, например, евклидово расстояние

• Пусть имеется n наблюдений, каждое из которых характеризуется р признаками X 1, X 2, …, Хр. Эти наблюдения необходимо разбить на k кластеров. Для начала из n точек исследуемой совокупности отбираются случайным образом или задаются исследователем исходя из каких-либо априорных соображений k точек (объектов). Эти точки принимаются за эталоны. Каждому эталону присваивается порядковый номер, который одновременно является и номером кластера. На первом шаге из оставшихся (n - k) объектов извлекается точка Хi с координатами (xi 1; хi 2, . . . , хiр) и проверяется, к какому из эталонов (центров) она находится ближе всего. Для этого используется одна из метрик, например, евклидово расстояние

• Проверяемый объект присоединяется к тому центру (эталону), которому соответствует min dil (l = 1, . . . , k). Эталон заменяется новым, пересчитанным с учетом присоединенной точки, и вес его (количество объектов, входящих в данный кластер) увеличивается на единицу. Если встречаются два или более минимальных расстояния, то i-и объект присоединяют к центру с наименьшим порядковым номером.

• Проверяемый объект присоединяется к тому центру (эталону), которому соответствует min dil (l = 1, . . . , k). Эталон заменяется новым, пересчитанным с учетом присоединенной точки, и вес его (количество объектов, входящих в данный кластер) увеличивается на единицу. Если встречаются два или более минимальных расстояния, то i-и объект присоединяют к центру с наименьшим порядковым номером.

• Вычислительные процедуры большинства итеративных методов классификации сводятся к выполнению следующих шагов: • Шаг 1. Выбор числа кластеров, на которые должна быть разбита совокупность, задание первоначального разбиения объектов и определение центров тяжести кластеров. • Шаг 2. В соответствии с выбранными мерами сходства определение нового состава каждого кластера. • Шаг 3. После полного просмотра всех объектов и распределения их по кластерам осуществляется пересчет центров тяжести кластеров. • Шаг 4. Процедуры 2 и 3 повторяются до тех пор, пока следующая итерация не даст такой же состав кластеров, что и предыдущая

• Вычислительные процедуры большинства итеративных методов классификации сводятся к выполнению следующих шагов: • Шаг 1. Выбор числа кластеров, на которые должна быть разбита совокупность, задание первоначального разбиения объектов и определение центров тяжести кластеров. • Шаг 2. В соответствии с выбранными мерами сходства определение нового состава каждого кластера. • Шаг 3. После полного просмотра всех объектов и распределения их по кластерам осуществляется пересчет центров тяжести кластеров. • Шаг 4. Процедуры 2 и 3 повторяются до тех пор, пока следующая итерация не даст такой же состав кластеров, что и предыдущая

КРИТЕРИИ КАЧЕСТВА КЛАССИФИКАЦИИ • При использовании различных методов кластерного анализа для одной и той же совокупности могут быть получены различные варианты разбиения. • Существенное влияние на характеристики кластерной структуры оказывают: • во-первых, набор признаков, по которым осуществляется классификация, • во-вторых, тип выбранного алгоритма.

КРИТЕРИИ КАЧЕСТВА КЛАССИФИКАЦИИ • При использовании различных методов кластерного анализа для одной и той же совокупности могут быть получены различные варианты разбиения. • Существенное влияние на характеристики кластерной структуры оказывают: • во-первых, набор признаков, по которым осуществляется классификация, • во-вторых, тип выбранного алгоритма.

Например • иерархические и итеративные методы приводят к образованию различного числа кластеров. • кластеры различаются и по составу, и по степени близости объектов. • Выбор меры сходства также влияет на результат разбиения. • Если используются методы с эталонными алгоритмами, например, метод k-средних, то задаваемые начальные условия разбиения в значительной степени определяют конечный результат разбиения.

Например • иерархические и итеративные методы приводят к образованию различного числа кластеров. • кластеры различаются и по составу, и по степени близости объектов. • Выбор меры сходства также влияет на результат разбиения. • Если используются методы с эталонными алгоритмами, например, метод k-средних, то задаваемые начальные условия разбиения в значительной степени определяют конечный результат разбиения.

оценить полученные результаты • мера качества классификации функционал или критерий качества. • Наилучшим следует считать такое разбиение, при котором достигается экстремальное (минимальное или максимальное) значение целевой функции — функционала качества.

оценить полученные результаты • мера качества классификации функционал или критерий качества. • Наилучшим следует считать такое разбиение, при котором достигается экстремальное (минимальное или максимальное) значение целевой функции — функционала качества.

наиболее распространенные функционалы качества

наиболее распространенные функционалы качества

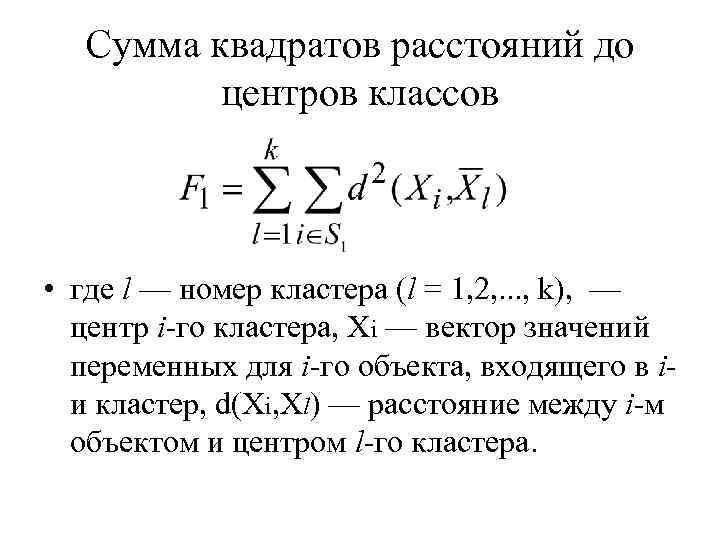

Сумма квадратов расстояний до центров классов • где l — номер кластера (l = 1, 2, . . . , k), — центр i-го кластера, Хi — вектор значений переменных для i-го объекта, входящего в iи кластер, d(Xi, Xl) — расстояние между i-м объектом и центром l-го кластера.

Сумма квадратов расстояний до центров классов • где l — номер кластера (l = 1, 2, . . . , k), — центр i-го кластера, Хi — вектор значений переменных для i-го объекта, входящего в iи кластер, d(Xi, Xl) — расстояние между i-м объектом и центром l-го кластера.

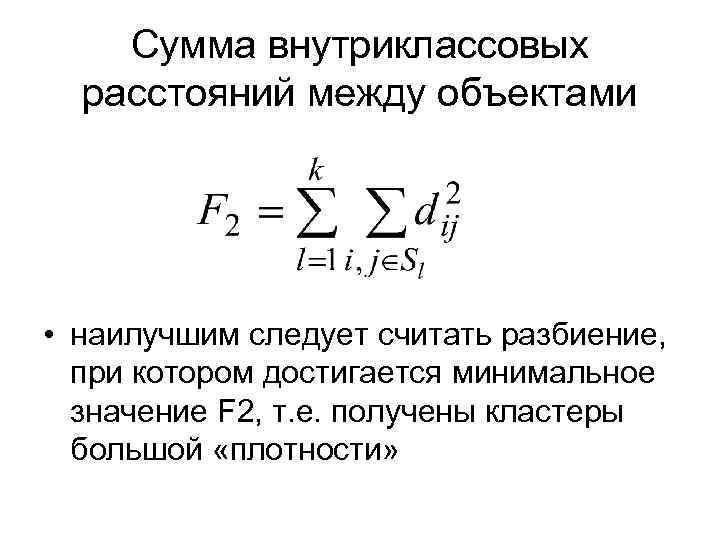

Сумма внутриклассовых расстояний между объектами • наилучшим следует считать разбиение, при котором достигается минимальное значение F 2, т. е. получены кластеры большой «плотности»

Сумма внутриклассовых расстояний между объектами • наилучшим следует считать разбиение, при котором достигается минимальное значение F 2, т. е. получены кластеры большой «плотности»

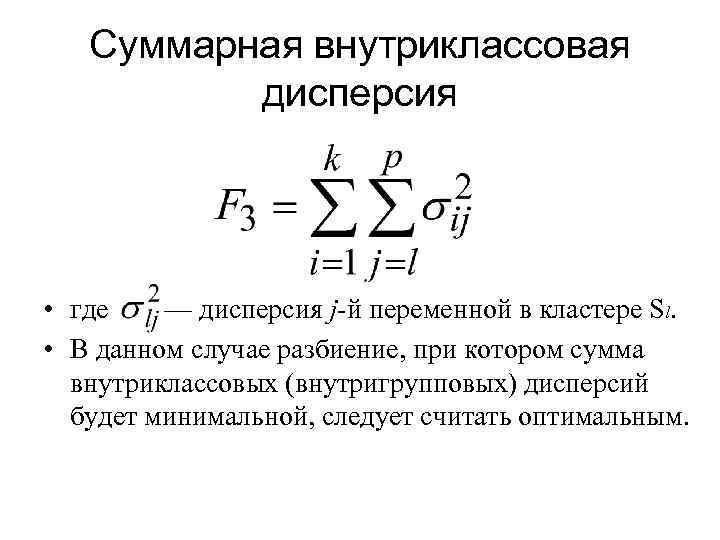

Суммарная внутриклассовая дисперсия • где — дисперсия j-й переменной в кластере Sl. • В данном случае разбиение, при котором сумма внутриклассовых (внутригрупповых) дисперсий будет минимальной, следует считать оптимальным.

Суммарная внутриклассовая дисперсия • где — дисперсия j-й переменной в кластере Sl. • В данном случае разбиение, при котором сумма внутриклассовых (внутригрупповых) дисперсий будет минимальной, следует считать оптимальным.

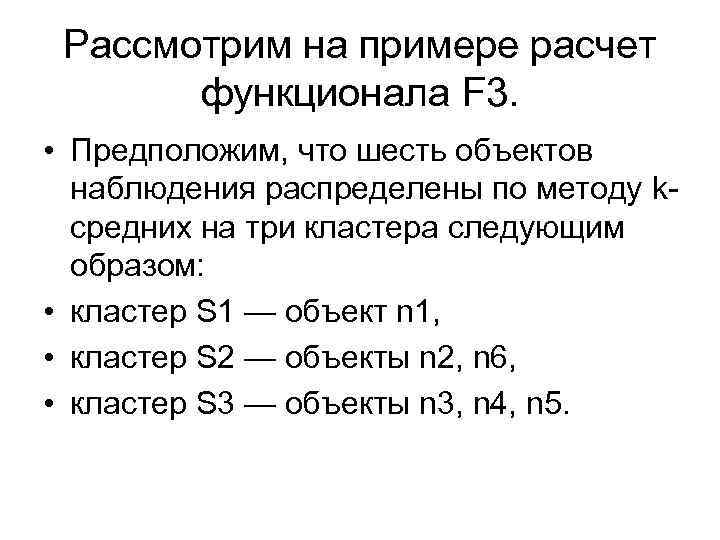

Рассмотрим на примере расчет функционала F 3. • Предположим, что шесть объектов наблюдения распределены по методу kсредних на три кластера следующим образом: • кластер S 1 — объект n 1, • кластер S 2 — объекты n 2, n 6, • кластер S 3 — объекты n 3, n 4, n 5.

Рассмотрим на примере расчет функционала F 3. • Предположим, что шесть объектов наблюдения распределены по методу kсредних на три кластера следующим образом: • кластер S 1 — объект n 1, • кластер S 2 — объекты n 2, n 6, • кластер S 3 — объекты n 3, n 4, n 5.

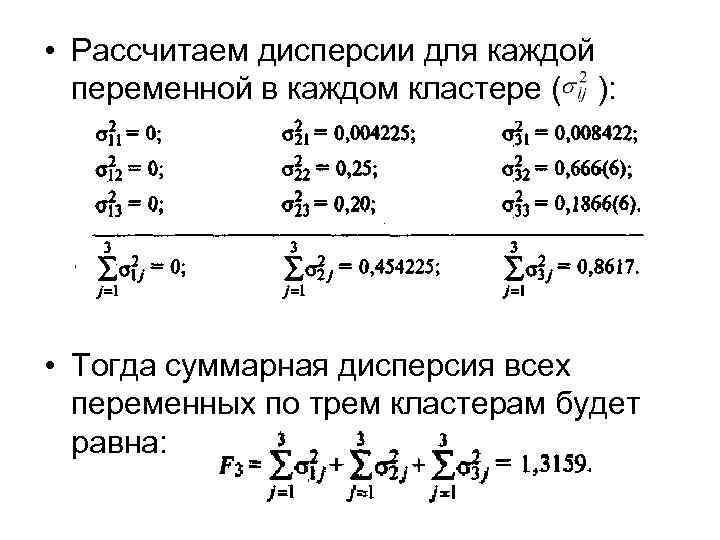

• Рассчитаем дисперсии для каждой переменной в каждом кластере ( ): • Тогда суммарная дисперсия всех переменных по трем кластерам будет равна:

• Рассчитаем дисперсии для каждой переменной в каждом кластере ( ): • Тогда суммарная дисперсия всех переменных по трем кластерам будет равна:

• Проведем классификацию тех же шести объектов по методу иерархического кластерного анализа, используя алгоритм «дальнего соседа» . Получим разбиение на три кластера: • кластер S 1— объекты n 1, n 4, • кластер S 2 — объекты n 2, n 6, • кластер S 3 — объекты n 3, n 5.

• Проведем классификацию тех же шести объектов по методу иерархического кластерного анализа, используя алгоритм «дальнего соседа» . Получим разбиение на три кластера: • кластер S 1— объекты n 1, n 4, • кластер S 2 — объекты n 2, n 6, • кластер S 3 — объекты n 3, n 5.

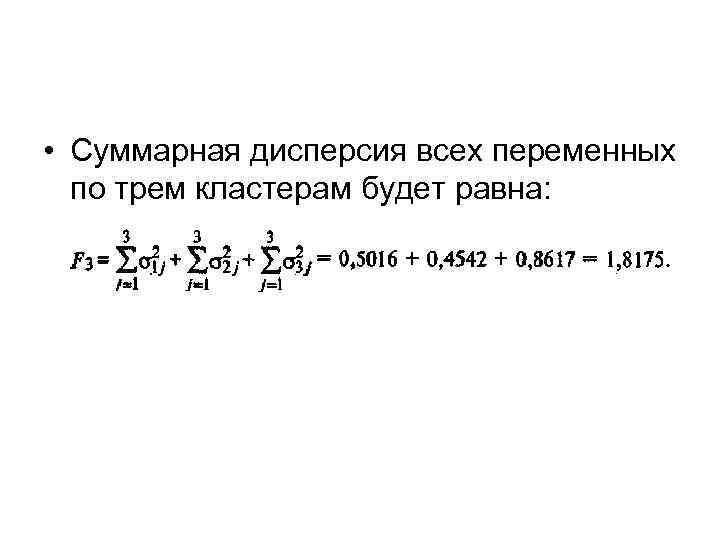

• Суммарная дисперсия всех переменных по трем кластерам будет равна:

• Суммарная дисперсия всех переменных по трем кластерам будет равна:

• Если судить по суммарной дисперсии трех переменных, то разбиение по методу k-средних оказалось лучше, чем по иерархическому методу. • функционал качества F 3 выступает мерой однородности всех кластеров в целом. • Аналогичны по смыслу критерии F 1 и F 2.

• Если судить по суммарной дисперсии трех переменных, то разбиение по методу k-средних оказалось лучше, чем по иерархическому методу. • функционал качества F 3 выступает мерой однородности всех кластеров в целом. • Аналогичны по смыслу критерии F 1 и F 2.

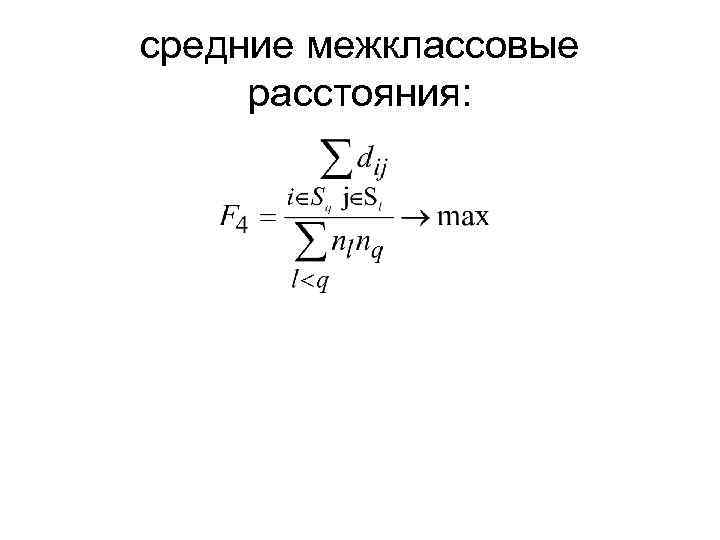

средние межклассовые расстояния:

средние межклассовые расстояния:

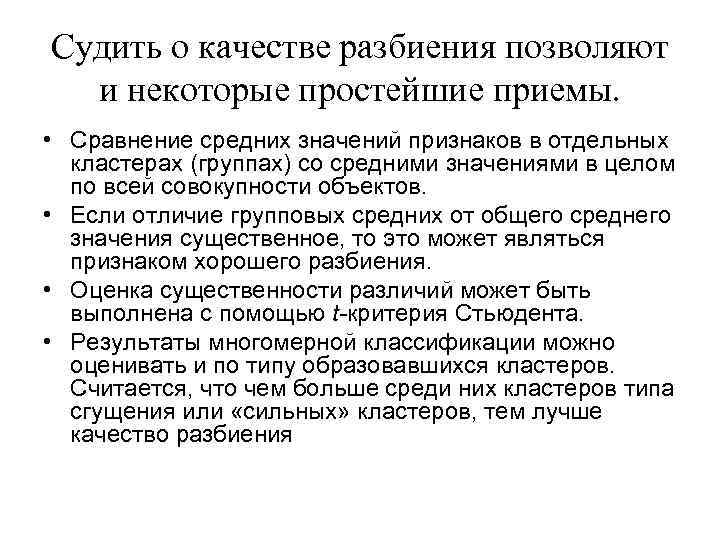

Судить о качестве разбиения позволяют и некоторые простейшие приемы. • Сравнение средних значений признаков в отдельных кластерах (группах) со средними значениями в целом по всей совокупности объектов. • Если отличие групповых средних от общего среднего значения существенное, то это может являться признаком хорошего разбиения. • Оценка существенности различий может быть выполнена с помощью t-критерия Стьюдента. • Результаты многомерной классификации можно оценивать и по типу образовавшихся кластеров. Считается, что чем больше среди них кластеров типа сгущения или «сильных» кластеров, тем лучше качество разбиения

Судить о качестве разбиения позволяют и некоторые простейшие приемы. • Сравнение средних значений признаков в отдельных кластерах (группах) со средними значениями в целом по всей совокупности объектов. • Если отличие групповых средних от общего среднего значения существенное, то это может являться признаком хорошего разбиения. • Оценка существенности различий может быть выполнена с помощью t-критерия Стьюдента. • Результаты многомерной классификации можно оценивать и по типу образовавшихся кластеров. Считается, что чем больше среди них кластеров типа сгущения или «сильных» кластеров, тем лучше качество разбиения

• Перечисленные выше способы оценки качества разбиения предполагают чисто формальный подход и являются для исследователя только вспомогательными средствами. • Основная роль принадлежит содержательному анализу результатов классификации. • Выбор лучшего варианта разбиения облегчается в значительной мере серьезной подготовительной работой, в частности, выбором признаков, характеризующих классифицируемые объекты. • В зависимости от количества признаков, их взаимосвязи, выбранного масштаба измерения подбирается наиболее подходящий алгоритм классификации, задаются начальные параметры разбиения. • Все это облегчает интерпретацию результатов разбиения и позволяет судить о его качестве с точки зрения поставленной задачи.

• Перечисленные выше способы оценки качества разбиения предполагают чисто формальный подход и являются для исследователя только вспомогательными средствами. • Основная роль принадлежит содержательному анализу результатов классификации. • Выбор лучшего варианта разбиения облегчается в значительной мере серьезной подготовительной работой, в частности, выбором признаков, характеризующих классифицируемые объекты. • В зависимости от количества признаков, их взаимосвязи, выбранного масштаба измерения подбирается наиболее подходящий алгоритм классификации, задаются начальные параметры разбиения. • Все это облегчает интерпретацию результатов разбиения и позволяет судить о его качестве с точки зрения поставленной задачи.

Методы кластерного анализа представляют собой очень эффективное средство статистической обработки данных, позволяющее решать следующие задачи: • изучение структуры совокупности с целью выделения групп объектов, схожих между собой по нескольким признакам; • проверка выдвигаемых предположений о наличии структуры в изучаемой совокупности, а также построение новых классификаций; • снижение размерности признакового пространства перед проведением корреляционно-регрессионого анализа без потери информации о взаимосвязи между переменными.

Методы кластерного анализа представляют собой очень эффективное средство статистической обработки данных, позволяющее решать следующие задачи: • изучение структуры совокупности с целью выделения групп объектов, схожих между собой по нескольким признакам; • проверка выдвигаемых предположений о наличии структуры в изучаемой совокупности, а также построение новых классификаций; • снижение размерности признакового пространства перед проведением корреляционно-регрессионого анализа без потери информации о взаимосвязи между переменными.