Измерение и представление информации.pptx

- Количество слайдов: 24

Информатика Оленчикова Татьяна Юрьевна 36 ч. Лекций (2 семестра) 72 ч. Практика (лаб. работы) в семестр - 36 Зачет / Экзамен Литература: Шапорев С. Д. Информатика. Теоретический курс и практические занятия- СПб: БХВ, 2008 Соболь Б. В. И др. Информатика-Ростов н/Д, 2007 Симонович С. В. И др. Информатика. Базовый курс-СПб: ПИТЕР, 2006 Безручко В. Т. Информатика, курс лекций, М: ИД ФОРУМ, 2008

Информатика Оленчикова Татьяна Юрьевна 36 ч. Лекций (2 семестра) 72 ч. Практика (лаб. работы) в семестр - 36 Зачет / Экзамен Литература: Шапорев С. Д. Информатика. Теоретический курс и практические занятия- СПб: БХВ, 2008 Соболь Б. В. И др. Информатика-Ростов н/Д, 2007 Симонович С. В. И др. Информатика. Базовый курс-СПб: ПИТЕР, 2006 Безручко В. Т. Информатика, курс лекций, М: ИД ФОРУМ, 2008

Предмет и задачи информатики, ее место в процессах управления

Предмет и задачи информатики, ее место в процессах управления

Предмет и задачи информатики, ее место в процессах управления • История становления информатики как науки, ее связь с другими науками. • Предмет и основные разделы информатики. Роль информатики в развитии современного общества. Информационные ресурсы. • Понятия: информационный процесс, информационная технология, информационная система • Понятие об информации. Виды и свойства информации. Данные и знания.

Предмет и задачи информатики, ее место в процессах управления • История становления информатики как науки, ее связь с другими науками. • Предмет и основные разделы информатики. Роль информатики в развитии современного общества. Информационные ресурсы. • Понятия: информационный процесс, информационная технология, информационная система • Понятие об информации. Виды и свойства информации. Данные и знания.

История становления информатики 60 -е годы XX века - «informatique» , Франция, «Computer science» - США 1983 – принято решение об организации нового отделения Академии наук СССР «Информатика, вычислительная техника и автоматизация» .

История становления информатики 60 -е годы XX века - «informatique» , Франция, «Computer science» - США 1983 – принято решение об организации нового отделения Академии наук СССР «Информатика, вычислительная техника и автоматизация» .

Черты информационного общества Большая часть работающих занимается не производством материальных благ, а производством и обработкой информации; Все большая часть потребностей населения связана с получением информации; Уровень жизни во многом определяется доступом к информационным ресурсам; Резко увеличивается объем обрабатываемой информации; Увеличивается информационная емкость выпускаемой продукции, т. е. для производства продукции требуется все больше информации. Информация становится существенным фактором ускорения научно-технического прогресса

Черты информационного общества Большая часть работающих занимается не производством материальных благ, а производством и обработкой информации; Все большая часть потребностей населения связана с получением информации; Уровень жизни во многом определяется доступом к информационным ресурсам; Резко увеличивается объем обрабатываемой информации; Увеличивается информационная емкость выпускаемой продукции, т. е. для производства продукции требуется все больше информации. Информация становится существенным фактором ускорения научно-технического прогресса

• Информатика – это область человеческой деятельности, связанная с процессами преобразования информации средствами вычислительной техники и взаимодействия этих средств со средой применения.

• Информатика – это область человеческой деятельности, связанная с процессами преобразования информации средствами вычислительной техники и взаимодействия этих средств со средой применения.

Структура информатики

Структура информатики

Задачи информатики Исследование информационных процессов любой природы; Разработка информационной техники и создание новейшей технологии переработки информации на базе полученных результатов исследования информационных процессов; Решение научных и инженерных проблем создания, внедрения и обеспечения эффективного использования компьютерной техники и технологии во всех сферах общественной жизни.

Задачи информатики Исследование информационных процессов любой природы; Разработка информационной техники и создание новейшей технологии переработки информации на базе полученных результатов исследования информационных процессов; Решение научных и инженерных проблем создания, внедрения и обеспечения эффективного использования компьютерной техники и технологии во всех сферах общественной жизни.

• Информатизация – процесс перехода от индустриального общества к информационному.

• Информатизация – процесс перехода от индустриального общества к информационному.

Главный ресурс информационного общества – информация, на основе ее владения можно успешно строить любую деятельность. Информационные ресурсы — совокупность данных, организованных для эффективного получения достоверной информации.

Главный ресурс информационного общества – информация, на основе ее владения можно успешно строить любую деятельность. Информационные ресурсы — совокупность данных, организованных для эффективного получения достоверной информации.

Измерение и представление информации

Измерение и представление информации

Термин информация происходит от латинского слова informatio, что означает осведомление, разъяснение, изложение. Существуют три наиболее распространенные концепции информации: 1) концепция К. Шеннона определяет информацию как меру неопределенности (энтропию) события. 2) Вторая концепция (Глушков) рассматривает информацию как свойство материи. 3) логико-семантический подход, при котором информация трактуется как знание, причем не любое знание, а та его часть, которая используется для ориентировки, для активного действия, для управления и самоуправления. Информация - это сведения, снимающие неопределенность об окружающем мире, которые являются объектом хранения, преобразования, передачи и использования. Сведения - это знания выраженные в сигналах, сообщениях, известиях, уведомлениях и т. д. Сигналы Данные Методы Информация Знания

Термин информация происходит от латинского слова informatio, что означает осведомление, разъяснение, изложение. Существуют три наиболее распространенные концепции информации: 1) концепция К. Шеннона определяет информацию как меру неопределенности (энтропию) события. 2) Вторая концепция (Глушков) рассматривает информацию как свойство материи. 3) логико-семантический подход, при котором информация трактуется как знание, причем не любое знание, а та его часть, которая используется для ориентировки, для активного действия, для управления и самоуправления. Информация - это сведения, снимающие неопределенность об окружающем мире, которые являются объектом хранения, преобразования, передачи и использования. Сведения - это знания выраженные в сигналах, сообщениях, известиях, уведомлениях и т. д. Сигналы Данные Методы Информация Знания

Методы воспроизведения и обработки данных • Естественные методы - методы, основанные на органах чувств. • Аппаратные методы – это всегда устройства (приборы). • Программные методы – автоматизация обработки данных с помощью компьютера

Методы воспроизведения и обработки данных • Естественные методы - методы, основанные на органах чувств. • Аппаратные методы – это всегда устройства (приборы). • Программные методы – автоматизация обработки данных с помощью компьютера

Информация – это динамический объект, не существующий в природе сам по себе, а образующийся в ходе взаимодействия данных и методов, и существующий столько, сколько длится это взаимодействие, а все остальное время пребывающий в виде данных, то: Информация - это продукт взаимодействия данных и методов, рассмотренный в контексте этого взаимодействия. Информация динамична, она существуют непродолжительное время – столько, сколько продолжается взаимодействие данных и методов во время ее создания, потребления или преобразования. Как только взаимодействие завершается, опять в наличии данные, но уже представленные в другой форме. Информационный процесс – это всегда цикл образования информации из данных и немедленного их сохранения в виде новых данных. Информация существует непродолжительное время, но информационный процесс длится столько, сколько существуют носители данных, представляющие информацию.

Информация – это динамический объект, не существующий в природе сам по себе, а образующийся в ходе взаимодействия данных и методов, и существующий столько, сколько длится это взаимодействие, а все остальное время пребывающий в виде данных, то: Информация - это продукт взаимодействия данных и методов, рассмотренный в контексте этого взаимодействия. Информация динамична, она существуют непродолжительное время – столько, сколько продолжается взаимодействие данных и методов во время ее создания, потребления или преобразования. Как только взаимодействие завершается, опять в наличии данные, но уже представленные в другой форме. Информационный процесс – это всегда цикл образования информации из данных и немедленного их сохранения в виде новых данных. Информация существует непродолжительное время, но информационный процесс длится столько, сколько существуют носители данных, представляющие информацию.

Меры информации Для измерения информации вводятся два параметра: количество информации I объем данных Vд. Синтаксическая мера информации. Эта мера оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. Объем данных Vд в сообщении измеряется количеством символов (разрядов) в этом сообщении. • в двоичной системе счисления единица измерения – бит (bit – binary digit) или более укрупненная единица байт, равная 8 бит. Сообщение, записанное двоичным кодом 1011, имеет объем данных 8 бит или 1 байт. • в десятичной системе счисления единица измерения – дит (десятичный разряд). Сообщение, записанное числом 275903 имеет объем данных 6 дит.

Меры информации Для измерения информации вводятся два параметра: количество информации I объем данных Vд. Синтаксическая мера информации. Эта мера оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту. Объем данных Vд в сообщении измеряется количеством символов (разрядов) в этом сообщении. • в двоичной системе счисления единица измерения – бит (bit – binary digit) или более укрупненная единица байт, равная 8 бит. Сообщение, записанное двоичным кодом 1011, имеет объем данных 8 бит или 1 байт. • в десятичной системе счисления единица измерения – дит (десятичный разряд). Сообщение, записанное числом 275903 имеет объем данных 6 дит.

Количество информации I на синтаксическом уровне определяется с помощью понятия неопределенности состояния (энтропии) системы. Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы. После получения некоторого сообщения β получатель приобрел некоторую дополнительную информацию Iβ(α), уменьшившую его априорную неосведомленность так, что апостериорная (после получения сообщения β) неопределенность состояния системы стала Hβ(α). Тогда количество информации Iβ(α) о системе, полученной в сообщении β, определится как Iβ(α) = H(α) - Hβ(α), т. е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Количество информации I на синтаксическом уровне определяется с помощью понятия неопределенности состояния (энтропии) системы. Пусть до получения информации потребитель имеет некоторые предварительные (априорные) сведения о системе α. Мерой его неосведомленности о системе является функция H(α), которая в то же время служит и мерой неопределенности состояния системы. После получения некоторого сообщения β получатель приобрел некоторую дополнительную информацию Iβ(α), уменьшившую его априорную неосведомленность так, что апостериорная (после получения сообщения β) неопределенность состояния системы стала Hβ(α). Тогда количество информации Iβ(α) о системе, полученной в сообщении β, определится как Iβ(α) = H(α) - Hβ(α), т. е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

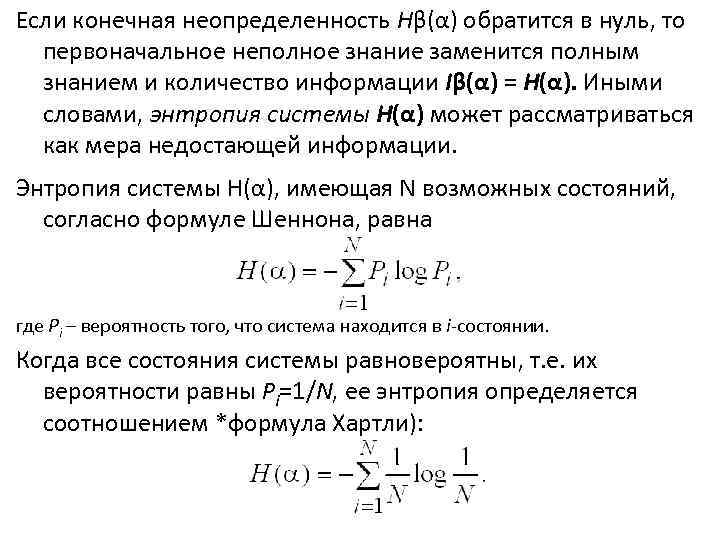

Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(α) = H(α). Иными словами, энтропия системы H(α) может рассматриваться как мера недостающей информации. Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна где Pi – вероятность того, что система находится в i-состоянии. Когда все состояния системы равновероятны, т. е. их вероятности равны Pi=1/N, ее энтропия определяется соотношением *формула Хартли):

Если конечная неопределенность Hβ(α) обратится в нуль, то первоначальное неполное знание заменится полным знанием и количество информации Iβ(α) = H(α). Иными словами, энтропия системы H(α) может рассматриваться как мера недостающей информации. Энтропия системы H(α), имеющая N возможных состояний, согласно формуле Шеннона, равна где Pi – вероятность того, что система находится в i-состоянии. Когда все состояния системы равновероятны, т. е. их вероятности равны Pi=1/N, ее энтропия определяется соотношением *формула Хартли):

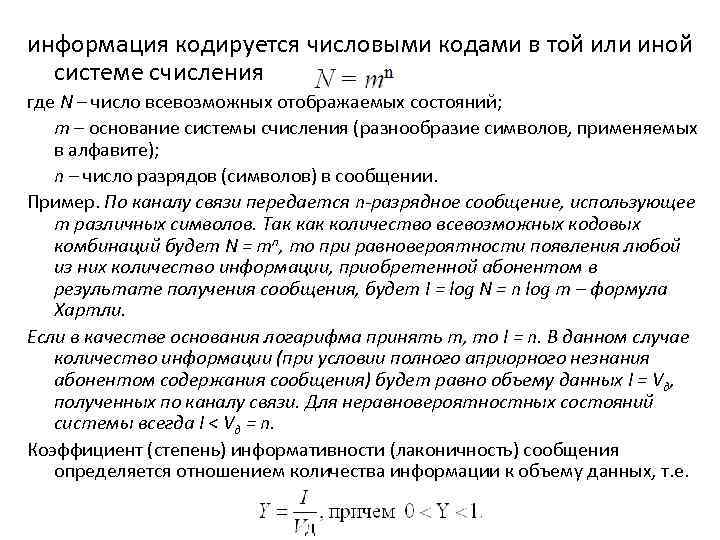

информация кодируется числовыми кодами в той или иной системе счисления где N – число всевозможных отображаемых состояний; m – основание системы счисления (разнообразие символов, применяемых в алфавите); n – число разрядов (символов) в сообщении. Пример. По каналу связи передается n-разрядное сообщение, использующее m различных символов. Так количество всевозможных кодовых комбинаций будет N = mn, то при равновероятности появления любой из них количество информации, приобретенной абонентом в результате получения сообщения, будет I = log N = n log m – формула Хартли. Если в качестве основания логарифма принять m, то I = n. В данном случае количество информации (при условии полного априорного незнания абонентом содержания сообщения) будет равно объему данных I = Vд, полученных по каналу связи. Для неравновероятностных состояний системы всегда I < Vд = n. Коэффициент (степень) информативности (лаконичность) сообщения определяется отношением количества информации к объему данных, т. е.

информация кодируется числовыми кодами в той или иной системе счисления где N – число всевозможных отображаемых состояний; m – основание системы счисления (разнообразие символов, применяемых в алфавите); n – число разрядов (символов) в сообщении. Пример. По каналу связи передается n-разрядное сообщение, использующее m различных символов. Так количество всевозможных кодовых комбинаций будет N = mn, то при равновероятности появления любой из них количество информации, приобретенной абонентом в результате получения сообщения, будет I = log N = n log m – формула Хартли. Если в качестве основания логарифма принять m, то I = n. В данном случае количество информации (при условии полного априорного незнания абонентом содержания сообщения) будет равно объему данных I = Vд, полученных по каналу связи. Для неравновероятностных состояний системы всегда I < Vд = n. Коэффициент (степень) информативности (лаконичность) сообщения определяется отношением количества информации к объему данных, т. е.

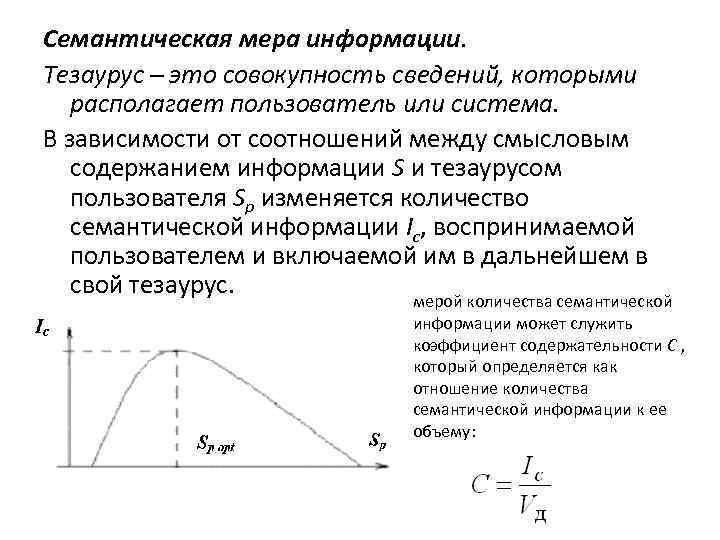

Семантическая мера информации. Тезаурус – это совокупность сведений, которыми располагает пользователь или система. В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Ic, воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. мерой количества семантической информации может служить коэффициент содержательности C , который определяется как отношение количества семантической информации к ее объему:

Семантическая мера информации. Тезаурус – это совокупность сведений, которыми располагает пользователь или система. В зависимости от соотношений между смысловым содержанием информации S и тезаурусом пользователя Sp изменяется количество семантической информации Ic, воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. мерой количества семантической информации может служить коэффициент содержательности C , который определяется как отношение количества семантической информации к ее объему:

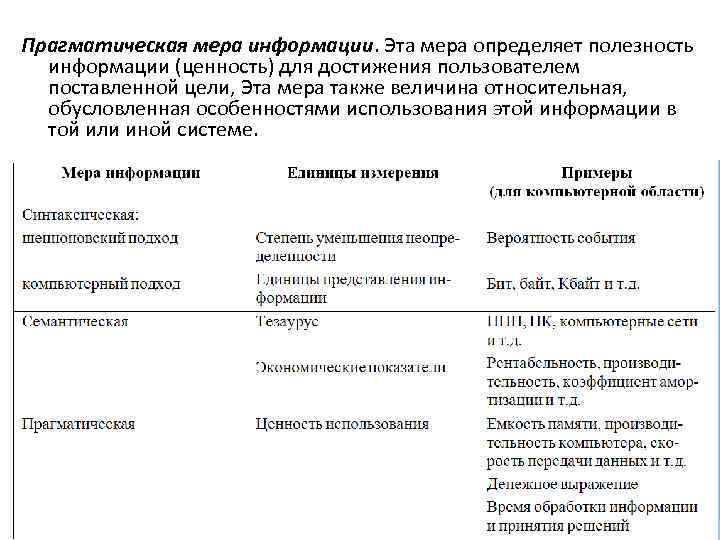

Прагматическая мера информации. Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели, Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе.

Прагматическая мера информации. Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели, Эта мера также величина относительная, обусловленная особенностями использования этой информации в той или иной системе.

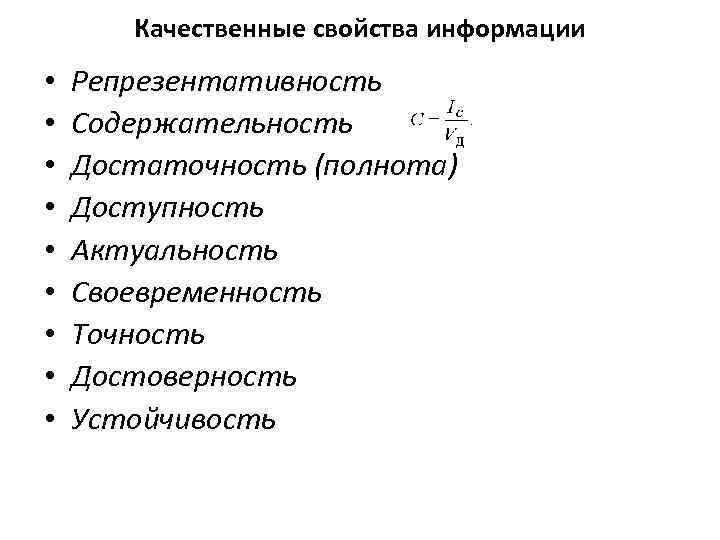

Качественные свойства информации • • • Репрезентативность Содержательность Достаточность (полнота) Доступность Актуальность Своевременность Точность Достоверность Устойчивость

Качественные свойства информации • • • Репрезентативность Содержательность Достаточность (полнота) Доступность Актуальность Своевременность Точность Достоверность Устойчивость

Классификация информации

Классификация информации

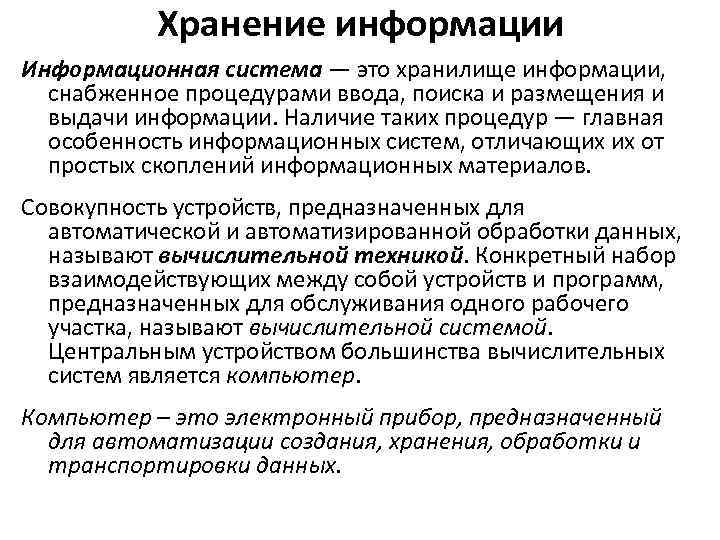

Хранение информации Информационная система — это хранилище информации, снабженное процедурами ввода, поиска и размещения и выдачи информации. Наличие таких процедур — главная особенность информационных систем, отличающих их от простых скоплений информационных материалов. Совокупность устройств, предназначенных для автоматической и автоматизированной обработки данных, называют вычислительной техникой. Конкретный набор взаимодействующих между собой устройств и программ, предназначенных для обслуживания одного рабочего участка, называют вычислительной системой. Центральным устройством большинства вычислительных систем является компьютер. Компьютер – это электронный прибор, предназначенный для автоматизации создания, хранения, обработки и транспортировки данных.

Хранение информации Информационная система — это хранилище информации, снабженное процедурами ввода, поиска и размещения и выдачи информации. Наличие таких процедур — главная особенность информационных систем, отличающих их от простых скоплений информационных материалов. Совокупность устройств, предназначенных для автоматической и автоматизированной обработки данных, называют вычислительной техникой. Конкретный набор взаимодействующих между собой устройств и программ, предназначенных для обслуживания одного рабочего участка, называют вычислительной системой. Центральным устройством большинства вычислительных систем является компьютер. Компьютер – это электронный прибор, предназначенный для автоматизации создания, хранения, обработки и транспортировки данных.

• Следующая тема: «Кодирование информации»

• Следующая тема: «Кодирование информации»