Информатика.ppt

- Количество слайдов: 48

Информатика

Информатика

Лекция 1 Информация, информатика, мехатроника…

Лекция 1 Информация, информатика, мехатроника…

Понятия информации Информация (от лат. informatio, разъяснение, изложение, осведомленность) — сведения о чем либо независимо от формы их представления. Согласно концепции К. Шеннона, информация — это снятая неопределенность, т. е. сведения, которые должны снять в той или иной степени существующую у потребителя до их получения неопределенность, расширить его понимание объекта полезными сведениями. Н. Винер: «Информация — это не материя и не энергия, информация — это информация» . Но основное определение информации, которое он дал в нескольких своих книгах, следующее: информация — это обозначение содержания, полученное нами из внешнего мира в процессе приспосабливания к нему нас и наших чувств. В теории управления (кибернетике), предметом исследования которой являются основные законы управления, то есть развития систем управления, информацией называются сообщения, получаемые системой из внешнего мира при адаптивном управлении (приспособлении, самосохранении системы управления).

Понятия информации Информация (от лат. informatio, разъяснение, изложение, осведомленность) — сведения о чем либо независимо от формы их представления. Согласно концепции К. Шеннона, информация — это снятая неопределенность, т. е. сведения, которые должны снять в той или иной степени существующую у потребителя до их получения неопределенность, расширить его понимание объекта полезными сведениями. Н. Винер: «Информация — это не материя и не энергия, информация — это информация» . Но основное определение информации, которое он дал в нескольких своих книгах, следующее: информация — это обозначение содержания, полученное нами из внешнего мира в процессе приспосабливания к нему нас и наших чувств. В теории управления (кибернетике), предметом исследования которой являются основные законы управления, то есть развития систем управления, информацией называются сообщения, получаемые системой из внешнего мира при адаптивном управлении (приспособлении, самосохранении системы управления).

Понятия информации С математической точки зрения информация — это последовательность целых чисел, которые записаны в вектор. Числа — это номер объекта в базисе информации. Вектор называется инвариантом информации, так как он не зависит от физической природы объектов базиса. Одно и тоже информационное сообщение может быть выражено буквами, словами, предложениями, файлами, картинками, нотами, песнями, видеоклипами, любой комбинацией всех ранее названных. Чем бы мы не выражали информацию — изменяется только базис, а не инвариант. В информатике Предметом изучения науки информатика являются именно данные: методы их создания, хранения, обработки и передачи. А сама информация, зафиксированная в данных, ее содержательный смысл интересны пользователям информационных систем, являющимся специалистами различных наук и областей деятельности: медика интересует медицинская информация, геолога — геологическая, предпринимателя — коммерческая и т. п. (в том числе специалиста по информатике интересует информация по вопросам работы с данными).

Понятия информации С математической точки зрения информация — это последовательность целых чисел, которые записаны в вектор. Числа — это номер объекта в базисе информации. Вектор называется инвариантом информации, так как он не зависит от физической природы объектов базиса. Одно и тоже информационное сообщение может быть выражено буквами, словами, предложениями, файлами, картинками, нотами, песнями, видеоклипами, любой комбинацией всех ранее названных. Чем бы мы не выражали информацию — изменяется только базис, а не инвариант. В информатике Предметом изучения науки информатика являются именно данные: методы их создания, хранения, обработки и передачи. А сама информация, зафиксированная в данных, ее содержательный смысл интересны пользователям информационных систем, являющимся специалистами различных наук и областей деятельности: медика интересует медицинская информация, геолога — геологическая, предпринимателя — коммерческая и т. п. (в том числе специалиста по информатике интересует информация по вопросам работы с данными).

Понятия информации Формы отражения Информации: n Сознание n Психика n Раздражимость n Запечатление взаимодействия Основные функции в обществе: n Познавательная n Коммуникативная n Управленческая

Понятия информации Формы отражения Информации: n Сознание n Психика n Раздражимость n Запечатление взаимодействия Основные функции в обществе: n Познавательная n Коммуникативная n Управленческая

Компоненты информации Среда распространения Источник Приемник Сообщение(сигнал) Сигнал (от лат. Signum знак) — физический процесс(явление), несущий сообщение (информацию) о событии.

Компоненты информации Среда распространения Источник Приемник Сообщение(сигнал) Сигнал (от лат. Signum знак) — физический процесс(явление), несущий сообщение (информацию) о событии.

Информационные процессы и системы Информационный процесс- последовательность действий, выполняемых информацией. Системы, реализующие информационные процессы, называют информационными системами. Основные этапы обращения информации в системах: • Сбор информации; • Подготовка (преобразование); • Передача; • Обработка; • Хранение; • Отображение (воспроизведение, интерпретация). Данные- факты, сведения, представленные в формальном виде (закодированные), занесенные на те или иные носители и допускающие обработку с помощью специальных технических средств.

Информационные процессы и системы Информационный процесс- последовательность действий, выполняемых информацией. Системы, реализующие информационные процессы, называют информационными системами. Основные этапы обращения информации в системах: • Сбор информации; • Подготовка (преобразование); • Передача; • Обработка; • Хранение; • Отображение (воспроизведение, интерпретация). Данные- факты, сведения, представленные в формальном виде (закодированные), занесенные на те или иные носители и допускающие обработку с помощью специальных технических средств.

Информационные ресурсы и технологии Информационные ресурсы- отдельные документы и отдельные массивы документов в информационных системах. Информационная система организационно упорядоченная совокупность документов, информационных технологий, в том числе с использованием средств вычислительной техники и связи, реализующих информационные процессы. Информационная технология – совокупность методов сбора, обработки и передачи информации Процесс информатизации общества проникновение информационных технологий во все сферы деятельности.

Информационные ресурсы и технологии Информационные ресурсы- отдельные документы и отдельные массивы документов в информационных системах. Информационная система организационно упорядоченная совокупность документов, информационных технологий, в том числе с использованием средств вычислительной техники и связи, реализующих информационные процессы. Информационная технология – совокупность методов сбора, обработки и передачи информации Процесс информатизации общества проникновение информационных технологий во все сферы деятельности.

История развития информатики Середина XV века – книгопечатание Конец XIXвека – изобретение электричества (телеграф, телефон, радио) Середина XX века – изобретение ЭВМ Информа тика (ср. нем. Informatik, англ. Information science, фр. Informatique, англ. computer science — компьютерная наука — в США, англ. computing science — вычислительная наука — в Великобритании) — наука о способах получения, накопления, хранения, преобразования, передачи, защиты и использования информации. Она включает дисциплины, относящиеся к обработке информации в вычислительных машинах и вычислительных сетях: как абстрактные, вроде анализа алгоритмов, так и довольно конкретные, например, разработка языков программирования. Термин информатика возник в 60 х годах во Франции для названия области, занимающейся автоматизированной переработкой информации, как слияние французских слов information и automatique (F. Dreyfus, 1972). Темами исследований в информатике являются вопросы: что можно, а что нельзя реализовать в программах и базах данных (теория вычислимости и искусственный интеллект), каким образом можно решать специфические вычислительные и информационные задачи с максимальной эффективностью (теория сложности вычислений), в каком виде следует хранить и восстанавливать информацию специфического вида (структуры и базы данных), как программы и люди должны взаимодействовать друг с другом (пользовательский интерфейс и языки программирования и представление знаний) и т. п.

История развития информатики Середина XV века – книгопечатание Конец XIXвека – изобретение электричества (телеграф, телефон, радио) Середина XX века – изобретение ЭВМ Информа тика (ср. нем. Informatik, англ. Information science, фр. Informatique, англ. computer science — компьютерная наука — в США, англ. computing science — вычислительная наука — в Великобритании) — наука о способах получения, накопления, хранения, преобразования, передачи, защиты и использования информации. Она включает дисциплины, относящиеся к обработке информации в вычислительных машинах и вычислительных сетях: как абстрактные, вроде анализа алгоритмов, так и довольно конкретные, например, разработка языков программирования. Термин информатика возник в 60 х годах во Франции для названия области, занимающейся автоматизированной переработкой информации, как слияние французских слов information и automatique (F. Dreyfus, 1972). Темами исследований в информатике являются вопросы: что можно, а что нельзя реализовать в программах и базах данных (теория вычислимости и искусственный интеллект), каким образом можно решать специфические вычислительные и информационные задачи с максимальной эффективностью (теория сложности вычислений), в каком виде следует хранить и восстанавливать информацию специфического вида (структуры и базы данных), как программы и люди должны взаимодействовать друг с другом (пользовательский интерфейс и языки программирования и представление знаний) и т. п.

Информация и кибернетика Управление – функция организованных систем различной природы, направленная на реализацию их целевых установок и поддержание внутренне присущей им структуры. Управление и информация – основные понятия кибернетики. Понятие введено Анри Ампером в 19 в, как искусство управления людьми и обществом. Н. Винер «Кибернетика или управление и связь в животном и машине» 1948 г. Кибернетика – наука, изучающая с единых позиций связь и управление в организованных системах любой физической природы. Основные законы управления: • Всякое управление есть целенаправленный процесс; • Всякое управление есть информационный процесс; • Всякое управление осуществляется в замкнутом контуре.

Информация и кибернетика Управление – функция организованных систем различной природы, направленная на реализацию их целевых установок и поддержание внутренне присущей им структуры. Управление и информация – основные понятия кибернетики. Понятие введено Анри Ампером в 19 в, как искусство управления людьми и обществом. Н. Винер «Кибернетика или управление и связь в животном и машине» 1948 г. Кибернетика – наука, изучающая с единых позиций связь и управление в организованных системах любой физической природы. Основные законы управления: • Всякое управление есть целенаправленный процесс; • Всякое управление есть информационный процесс; • Всякое управление осуществляется в замкнутом контуре.

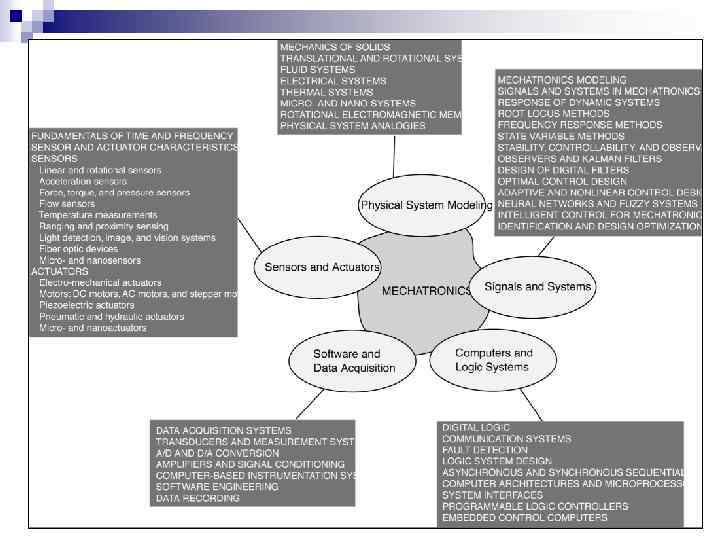

Механика Электромеха ника Системный анализ Датчики Схемотехни CAD ческое проектиров Мехатроника проектиров ание Модели рование Компьютеры Микроконт роллеры цифровые системы управления Управление

Механика Электромеха ника Системный анализ Датчики Схемотехни CAD ческое проектиров Мехатроника проектиров ание Модели рование Компьютеры Микроконт роллеры цифровые системы управления Управление

Определение мехатроника Современный термин "Мехатроника" ("Mechatronics"), согласно японским источникам [5], был введен фирмой Yaskawa Electric в 1969 году и зарегистрирован как торговая марка в 1972 году. Это название получено комбинацией слов "МЕХАника" и "Элек. ТРОНИКА". Объединение этих понятий в едином словосочетании означает интеграцию знаний всоответствующих областях науки и техники, которая позволила совершить качественный скачок в создании техники новых поколений и производстве новейших видов систем и оборудования. Аналогичным образом шло развитие электромеханики как науки, использующей достижения электротехники и механики при создании приводных исполнительных систем широкого назначения. Интеграция электромеханики и микроэлектроники привела к появлению комплектных интегрированных мехатронных модулей движения рабочих органов и узлов машин а также создаваемого на их основе оборудования. Именно в этом направлении наиболее активно развивалась мехатроника в нашей стране. По определению ГОС: "Мехатpоника - это новая область науки и техники, посвященная созданию и эксплуатации машин и систем с компьютеpным упpавлением движением, котоpая базиpуется на знаниях в области механики, электpоники и микpопpоцессоpной техники, инфоpматики и компьютеpного упpавления движением машин и агpегатов".

Определение мехатроника Современный термин "Мехатроника" ("Mechatronics"), согласно японским источникам [5], был введен фирмой Yaskawa Electric в 1969 году и зарегистрирован как торговая марка в 1972 году. Это название получено комбинацией слов "МЕХАника" и "Элек. ТРОНИКА". Объединение этих понятий в едином словосочетании означает интеграцию знаний всоответствующих областях науки и техники, которая позволила совершить качественный скачок в создании техники новых поколений и производстве новейших видов систем и оборудования. Аналогичным образом шло развитие электромеханики как науки, использующей достижения электротехники и механики при создании приводных исполнительных систем широкого назначения. Интеграция электромеханики и микроэлектроники привела к появлению комплектных интегрированных мехатронных модулей движения рабочих органов и узлов машин а также создаваемого на их основе оборудования. Именно в этом направлении наиболее активно развивалась мехатроника в нашей стране. По определению ГОС: "Мехатpоника - это новая область науки и техники, посвященная созданию и эксплуатации машин и систем с компьютеpным упpавлением движением, котоpая базиpуется на знаниях в области механики, электpоники и микpопpоцессоpной техники, инфоpматики и компьютеpного упpавления движением машин и агpегатов".

Состав мехатронного обекта

Состав мехатронного обекта

Информационные технологии в робототехнике и мехатронике Средства создания электронных документов: Open. Office Microsoft. Office Системы автоматизированного проектирования САПР: Auto. CAD Brics. CAD CATIA NX Solid Edge Solid. Works Turbo. CAD Rhinoceros 3 D Pro/ENGINEER Компас Математическое и техническое моделирование Matlab Math. Cad Ansys Lab. View

Информационные технологии в робототехнике и мехатронике Средства создания электронных документов: Open. Office Microsoft. Office Системы автоматизированного проектирования САПР: Auto. CAD Brics. CAD CATIA NX Solid Edge Solid. Works Turbo. CAD Rhinoceros 3 D Pro/ENGINEER Компас Математическое и техническое моделирование Matlab Math. Cad Ansys Lab. View

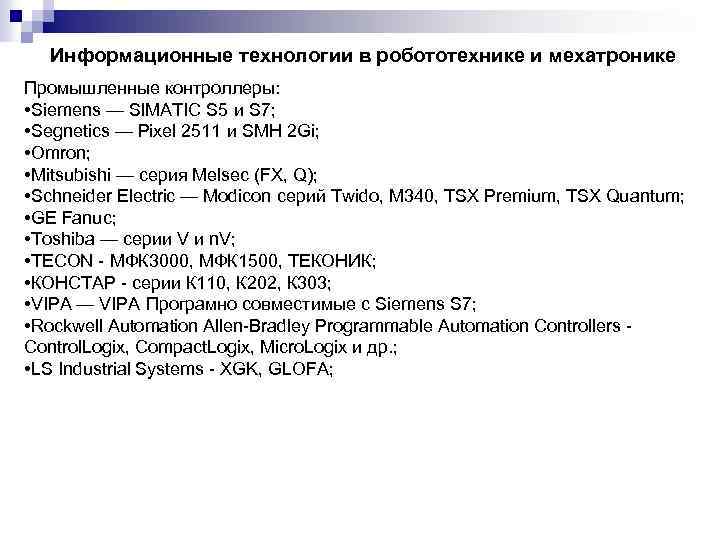

Информационные технологии в робототехнике и мехатронике Промышленные контроллеры: • Siemens — SIMATIC S 5 и S 7; • Segnetics — Pixel 2511 и SMH 2 Gi; • Omron; • Mitsubishi — серия Melsec (FX, Q); • Schneider Electric — Modicon серий Twido, M 340, TSX Premium, TSX Quantum; • GE Fanuc; • Toshiba — серии V и n. V; • TECON МФК 3000, МФК 1500, ТЕКОНИК; • КОНСТАР серии К 110, К 202, К 303; • VIPA — VIPA Програмно совместимые с Siemens S 7; • Rockwell Automation Allen Bradley Programmable Automation Controllers Control. Logix, Compact. Logix, Micro. Logix и др. ; • LS Industrial Systems XGK, GLOFA;

Информационные технологии в робототехнике и мехатронике Промышленные контроллеры: • Siemens — SIMATIC S 5 и S 7; • Segnetics — Pixel 2511 и SMH 2 Gi; • Omron; • Mitsubishi — серия Melsec (FX, Q); • Schneider Electric — Modicon серий Twido, M 340, TSX Premium, TSX Quantum; • GE Fanuc; • Toshiba — серии V и n. V; • TECON МФК 3000, МФК 1500, ТЕКОНИК; • КОНСТАР серии К 110, К 202, К 303; • VIPA — VIPA Програмно совместимые с Siemens S 7; • Rockwell Automation Allen Bradley Programmable Automation Controllers Control. Logix, Compact. Logix, Micro. Logix и др. ; • LS Industrial Systems XGK, GLOFA;

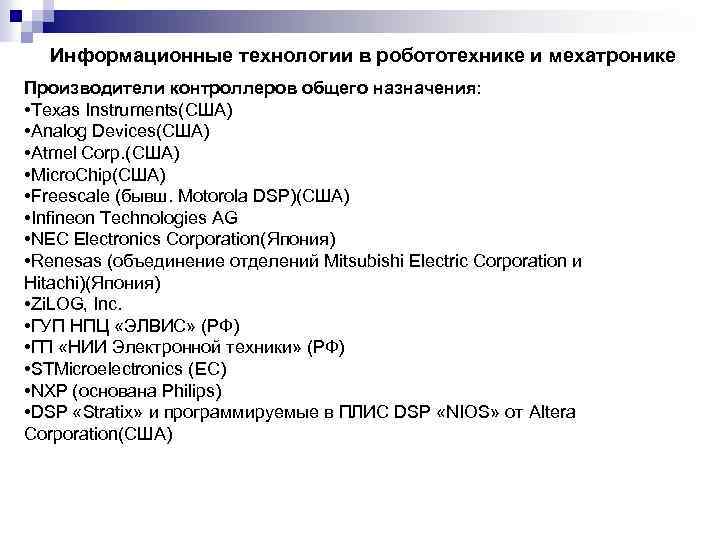

Информационные технологии в робототехнике и мехатронике Производители контроллеров общего назначения: • Texas Instruments(США) • Analog Devices(США) • Atmel Corp. (США) • Micro. Chip(США) • Freescale (бывш. Motorola DSP)(США) • Infineon Technologies AG • NEC Electronics Corporation(Япония) • Renesas (объединение отделений Mitsubishi Electric Corporation и Hitachi)(Япония) • Zi. LOG, Inc. • ГУП НПЦ «ЭЛВИС» (РФ) • ГП «НИИ Электронной техники» (РФ) • STMicroelectronics (ЕС) • NXP (основана Philips) • DSP «Stratix» и программируемые в ПЛИС DSP «NIOS» от Altera Corporation(США)

Информационные технологии в робототехнике и мехатронике Производители контроллеров общего назначения: • Texas Instruments(США) • Analog Devices(США) • Atmel Corp. (США) • Micro. Chip(США) • Freescale (бывш. Motorola DSP)(США) • Infineon Technologies AG • NEC Electronics Corporation(Япония) • Renesas (объединение отделений Mitsubishi Electric Corporation и Hitachi)(Япония) • Zi. LOG, Inc. • ГУП НПЦ «ЭЛВИС» (РФ) • ГП «НИИ Электронной техники» (РФ) • STMicroelectronics (ЕС) • NXP (основана Philips) • DSP «Stratix» и программируемые в ПЛИС DSP «NIOS» от Altera Corporation(США)

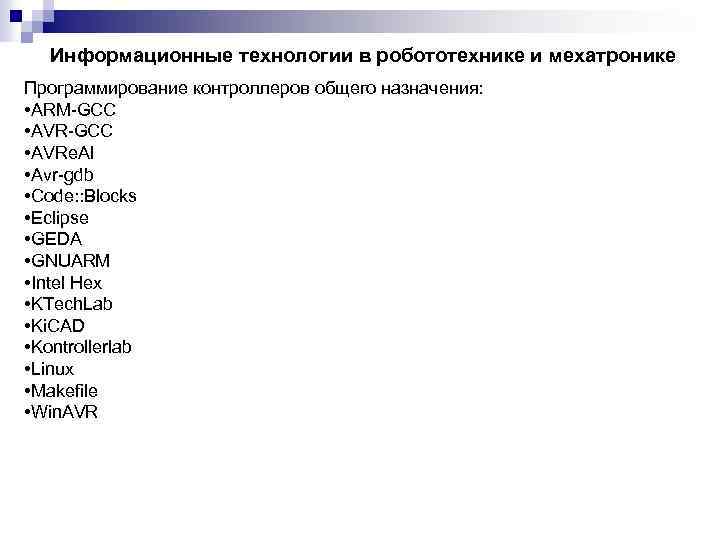

Информационные технологии в робототехнике и мехатронике Программирование контроллеров общего назначения: • ARM GCC • AVRe. Al • Avr gdb • Code: : Blocks • Eclipse • GEDA • GNUARM • Intel Hex • KTech. Lab • Ki. CAD • Kontrollerlab • Linux • Makefile • Win. AVR

Информационные технологии в робототехнике и мехатронике Программирование контроллеров общего назначения: • ARM GCC • AVRe. Al • Avr gdb • Code: : Blocks • Eclipse • GEDA • GNUARM • Intel Hex • KTech. Lab • Ki. CAD • Kontrollerlab • Linux • Makefile • Win. AVR

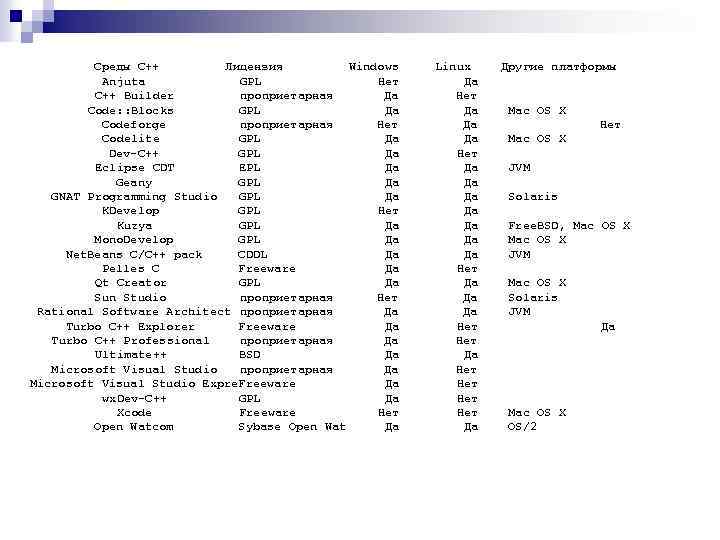

Среды С++ Лицензия Windows Anjuta GPL Нет C++ Builder проприетарная Да Code: : Blocks GPL Да Codeforge проприетарная Нет Codelite GPL Да Dev-C++ GPL Да Eclipse CDT EPL Да Geany GPL Да GNAT Programming Studio GPL Да KDevelop GPL Нет Kuzya GPL Да Mono. Develop GPL Да Net. Beans C/C++ pack CDDL Да Pelles C Freeware Да Qt Creator GPL Да Sun Studio проприетарная Нет Rational Software Architect проприетарная Да Turbo C++ Explorer Freeware Да Turbo C++ Professional проприетарная Да Ultimate++ BSD Да Microsoft Visual Studio проприетарная Да Microsoft Visual Studio Expre. Freeware Да wx. Dev-C++ GPL Да Xcode Freeware Нет Open Watcom Sybase Open Wat Да Linux Да Нет Да Да Да Нет Да Да Да Нет Нет Нет Да Другие платформы Mac OS X Нет Mac OS X JVM Solaris Free. BSD, Mac OS X JVM Mac OS X Solaris JVM Да Mac OS X OS/2

Среды С++ Лицензия Windows Anjuta GPL Нет C++ Builder проприетарная Да Code: : Blocks GPL Да Codeforge проприетарная Нет Codelite GPL Да Dev-C++ GPL Да Eclipse CDT EPL Да Geany GPL Да GNAT Programming Studio GPL Да KDevelop GPL Нет Kuzya GPL Да Mono. Develop GPL Да Net. Beans C/C++ pack CDDL Да Pelles C Freeware Да Qt Creator GPL Да Sun Studio проприетарная Нет Rational Software Architect проприетарная Да Turbo C++ Explorer Freeware Да Turbo C++ Professional проприетарная Да Ultimate++ BSD Да Microsoft Visual Studio проприетарная Да Microsoft Visual Studio Expre. Freeware Да wx. Dev-C++ GPL Да Xcode Freeware Нет Open Watcom Sybase Open Wat Да Linux Да Нет Да Да Да Нет Да Да Да Нет Нет Нет Да Другие платформы Mac OS X Нет Mac OS X JVM Solaris Free. BSD, Mac OS X JVM Mac OS X Solaris JVM Да Mac OS X OS/2

Лекция 2 Количество и качество информации

Лекция 2 Количество и качество информации

Уровни изучения сообщений При реализации информационных процессов всегда происходит перенос информации в пространстве и времени от источника информации к приемнику (получателю). При этом для передачи информации используют различные знаки или символы, например естественного или искусственного (формального) языка, позволяющие выразить ее в некоторой форме, называемой сообщением: Сообщение — форма представления информации в виде совокупности знаков (символов), используемая для передачи. Сообщение как совокупность знаков с точки зрения семиотики (от греч. semeion — знак, признак) — науки, занимающейся исследованием свойств знаков и знаковых систем, — может изучаться на трех уровнях: 1. синтаксическом, где рассматриваются внутренние свойства сообщений, т. е. отношения между знаками, отражающие структуру данной знаковой системы. Внешние свойства изучают на семантическом и прагматическом уровнях; 2. семантическом, где анализируются отношения между знака ми и обозначаемыми ими предметами, действиями, качествами, т. е. смысловое содержание сообщения, его отношение к источнику информации; 3. прагматическом, где рассматриваются отношения между сообщением и получателем, т. е. потребительское содержание сообщения, его отношение к получателю.

Уровни изучения сообщений При реализации информационных процессов всегда происходит перенос информации в пространстве и времени от источника информации к приемнику (получателю). При этом для передачи информации используют различные знаки или символы, например естественного или искусственного (формального) языка, позволяющие выразить ее в некоторой форме, называемой сообщением: Сообщение — форма представления информации в виде совокупности знаков (символов), используемая для передачи. Сообщение как совокупность знаков с точки зрения семиотики (от греч. semeion — знак, признак) — науки, занимающейся исследованием свойств знаков и знаковых систем, — может изучаться на трех уровнях: 1. синтаксическом, где рассматриваются внутренние свойства сообщений, т. е. отношения между знаками, отражающие структуру данной знаковой системы. Внешние свойства изучают на семантическом и прагматическом уровнях; 2. семантическом, где анализируются отношения между знака ми и обозначаемыми ими предметами, действиями, качествами, т. е. смысловое содержание сообщения, его отношение к источнику информации; 3. прагматическом, где рассматриваются отношения между сообщением и получателем, т. е. потребительское содержание сообщения, его отношение к получателю.

Меры информации 1. Меры информации синтаксического уровня Объем информации Va (объемный подход). При реализации информационных процессов информация передается в виде сообщения, представляющего собой совокупность символов какого либо алфавита. При этом каждый новый символ в сообщении увеличивает количество информации, представленной последовательно стью символов данного алфавита. В двоичной системе счисления один разряд имеет вес, равный 2, и соответственно единицей измерения информации будет бит (bit - binary digit - двоичный разряд). В этом случае сообщение в виде n разрядного числа имеет объем данных Va = n бит. Например, восьмиразрядный двоичный код 11001011 имеет объем данных Va = 8 бит. 1 кбайт = 1024 байт = 210 байт; 1 Мбайт = 1024 кбайт = 220 байт = 1 048 576 байт; 1 Гбайт = 1024 Мбайт = 230 байт = 1 073 741 824 байт; 1 Тбайт = 1024 Гбайт = 240 байт = 1 099 511 627 776 байт.

Меры информации 1. Меры информации синтаксического уровня Объем информации Va (объемный подход). При реализации информационных процессов информация передается в виде сообщения, представляющего собой совокупность символов какого либо алфавита. При этом каждый новый символ в сообщении увеличивает количество информации, представленной последовательно стью символов данного алфавита. В двоичной системе счисления один разряд имеет вес, равный 2, и соответственно единицей измерения информации будет бит (bit - binary digit - двоичный разряд). В этом случае сообщение в виде n разрядного числа имеет объем данных Va = n бит. Например, восьмиразрядный двоичный код 11001011 имеет объем данных Va = 8 бит. 1 кбайт = 1024 байт = 210 байт; 1 Мбайт = 1024 кбайт = 220 байт = 1 048 576 байт; 1 Гбайт = 1024 Мбайт = 230 байт = 1 073 741 824 байт; 1 Тбайт = 1024 Гбайт = 240 байт = 1 099 511 627 776 байт.

Меры информации 1. Меры информации синтаксического уровня Количество информации I (энтропийный подход). В теории информации и кодирования принят энтропийный подход к измерению информации. Под информацией понимается количественная величина исчезнувшей в ходе какого либо процесса (испытания, измерения и т. д. ) неопределенности. При этом в качестве меры неопределенности вводится энтропия H, а количество информации равно: I = Hapr – Haps, где Hapr- априорная энтропия о состоянии исследуемой системы или про цесса; Haps- апостериорная энтропия. Апостериори (от лат. a posteriori — из последующего) — проис ходящее из опыта (испытания, измерения). Априори (от лат. a priori — из предшествующего) — понятие, ха рактеризующее знание, предшествующее опыту (испытанию), и независимое от него. Мера энтропии H(A) = log N, где N- число возможных состояний источника. Мера была предложена американским ученым Р. Хартли в 1928 г. Основание логарифма в формуле не имеет принципиального значения и определяет только масштаб или единицу измерения. В зависимости от основания логарифма применяют следующие единицы измерения: 1. Биты — при этом основание логарифма равно 2: Н(А) = log 2 N. 2. Наты — при этом основание логарифма равно e: Н(А) = ln N. 3. Диты — при этом основание логарифма равно 10: Н(А) = lg N.

Меры информации 1. Меры информации синтаксического уровня Количество информации I (энтропийный подход). В теории информации и кодирования принят энтропийный подход к измерению информации. Под информацией понимается количественная величина исчезнувшей в ходе какого либо процесса (испытания, измерения и т. д. ) неопределенности. При этом в качестве меры неопределенности вводится энтропия H, а количество информации равно: I = Hapr – Haps, где Hapr- априорная энтропия о состоянии исследуемой системы или про цесса; Haps- апостериорная энтропия. Апостериори (от лат. a posteriori — из последующего) — проис ходящее из опыта (испытания, измерения). Априори (от лат. a priori — из предшествующего) — понятие, ха рактеризующее знание, предшествующее опыту (испытанию), и независимое от него. Мера энтропии H(A) = log N, где N- число возможных состояний источника. Мера была предложена американским ученым Р. Хартли в 1928 г. Основание логарифма в формуле не имеет принципиального значения и определяет только масштаб или единицу измерения. В зависимости от основания логарифма применяют следующие единицы измерения: 1. Биты — при этом основание логарифма равно 2: Н(А) = log 2 N. 2. Наты — при этом основание логарифма равно e: Н(А) = ln N. 3. Диты — при этом основание логарифма равно 10: Н(А) = lg N.

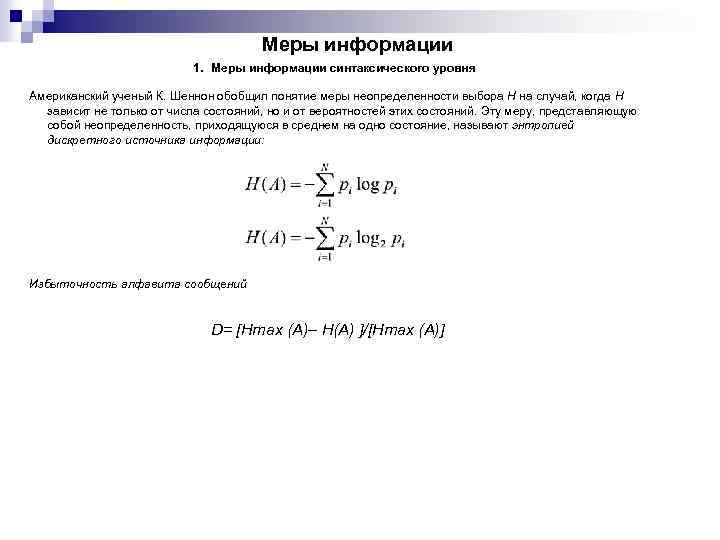

Меры информации 1. Меры информации синтаксического уровня Американский ученый К. Шеннон обобщил понятие меры неопределенности выбора Н на случай, когда Н зависит не только от числа состояний, но и от вероятностей этих состояний. Эту меру, представляющую собой неопределенность, приходящуюся в среднем на одно состояние, называют энтропией дискретного источника информации: Избыточность алфавита сообщений D= [Hmax (A)– H(A) ]/[Hmax (A)]

Меры информации 1. Меры информации синтаксического уровня Американский ученый К. Шеннон обобщил понятие меры неопределенности выбора Н на случай, когда Н зависит не только от числа состояний, но и от вероятностей этих состояний. Эту меру, представляющую собой неопределенность, приходящуюся в среднем на одно состояние, называют энтропией дискретного источника информации: Избыточность алфавита сообщений D= [Hmax (A)– H(A) ]/[Hmax (A)]

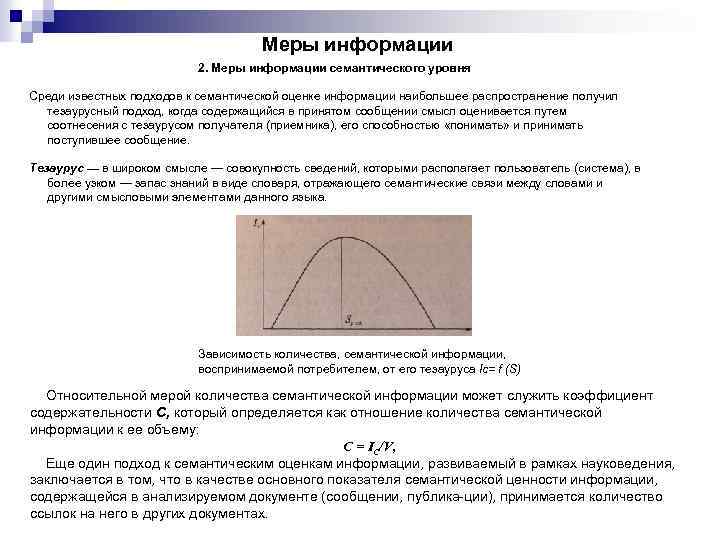

Меры информации 2. Меры информации семантического уровня Среди известных подходов к семантической оценке информации наибольшее распространение получил тезаурусный подход, когда содержащийся в принятом сообщении смысл оценивается путем соотнесения с тезаурусом получателя (приемника), его способностью «понимать» и принимать поступившее сообщение. Тезаурус — в широком смысле — совокупность сведений, которыми располагает пользователь (система), в более узком — запас знаний в виде словаря, отражающего семантические связи между словами и другими смысловыми элементами данного языка. Зависимость количества, семантической информации, воспринимаемой потребителем, от его тезауруса Ic= f (S) Относительной мерой количества семантической информации может служить коэффициент содержательности С, который определяется как отношение количества семантической информации к ее объему: C = IC/V, Еще один подход к семантическим оценкам информации, развиваемый в рамках науковедения, заключается в том, что в качестве основного показателя семантической ценности информации, содержащейся в анализируемом документе (сообщении, публика ции), принимается количество ссылок на него в других документах.

Меры информации 2. Меры информации семантического уровня Среди известных подходов к семантической оценке информации наибольшее распространение получил тезаурусный подход, когда содержащийся в принятом сообщении смысл оценивается путем соотнесения с тезаурусом получателя (приемника), его способностью «понимать» и принимать поступившее сообщение. Тезаурус — в широком смысле — совокупность сведений, которыми располагает пользователь (система), в более узком — запас знаний в виде словаря, отражающего семантические связи между словами и другими смысловыми элементами данного языка. Зависимость количества, семантической информации, воспринимаемой потребителем, от его тезауруса Ic= f (S) Относительной мерой количества семантической информации может служить коэффициент содержательности С, который определяется как отношение количества семантической информации к ее объему: C = IC/V, Еще один подход к семантическим оценкам информации, развиваемый в рамках науковедения, заключается в том, что в качестве основного показателя семантической ценности информации, содержащейся в анализируемом документе (сообщении, публика ции), принимается количество ссылок на него в других документах.

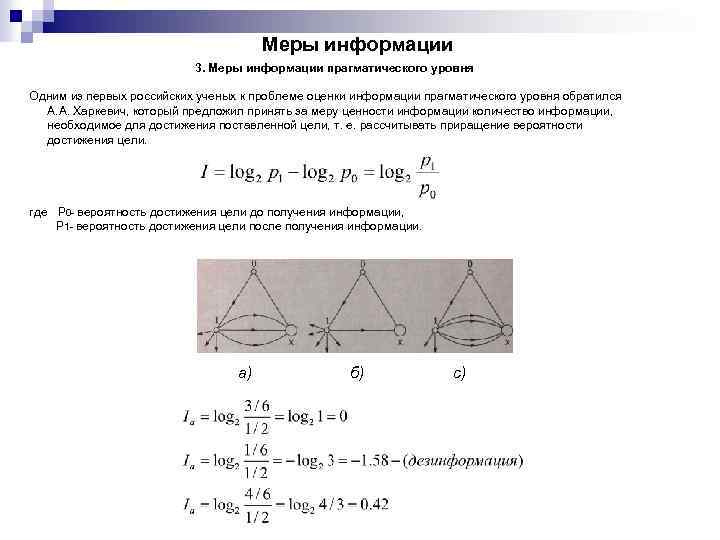

Меры информации 3. Меры информации прагматического уровня Одним из первых российских ученых к проблеме оценки информации прагматического уровня обратился А. А. Харкевич, который предложил принять за меру ценности информации количество информации, необходимое для достижения поставленной цели, т. е. рассчитывать приращение вероятности достижения цели. где P 0 вероятность достижения цели до получения информации, P 1 вероятность достижения цели после получения информации. а) б) с)

Меры информации 3. Меры информации прагматического уровня Одним из первых российских ученых к проблеме оценки информации прагматического уровня обратился А. А. Харкевич, который предложил принять за меру ценности информации количество информации, необходимое для достижения поставленной цели, т. е. рассчитывать приращение вероятности достижения цели. где P 0 вероятность достижения цели до получения информации, P 1 вероятность достижения цели после получения информации. а) б) с)

Качество информации совокупность свойств информации характеризующих степень ее соответствия потребностям (целям, ценностям) пользователей (средств автоматизации, персонала и др. ). Качество информации Содержательность (внутреннее) Защищенность (внешнее) Значимость Кумулятивность Сохраннность Полнота Избирательность Достоверность Идентичность Гомоморфизм Конфиденциальность

Качество информации совокупность свойств информации характеризующих степень ее соответствия потребностям (целям, ценностям) пользователей (средств автоматизации, персонала и др. ). Качество информации Содержательность (внутреннее) Защищенность (внешнее) Значимость Кумулятивность Сохраннность Полнота Избирательность Достоверность Идентичность Гомоморфизм Конфиденциальность

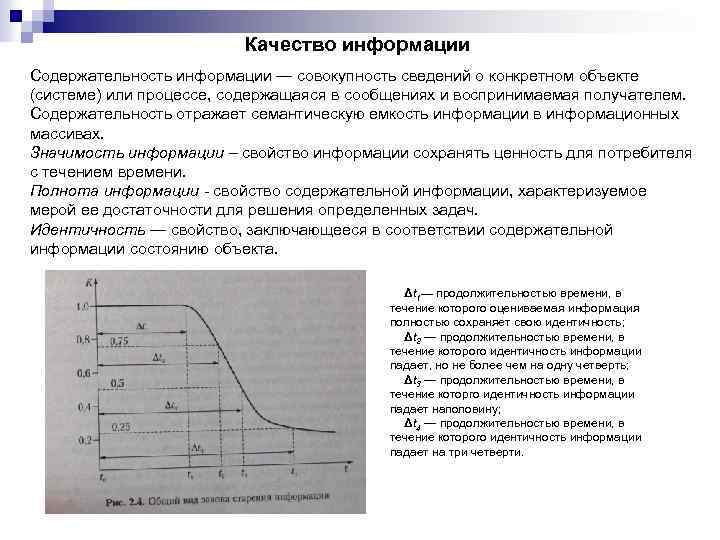

Качество информации Содержательность информации — совокупность сведений о конкретном объекте (системе) или процессе, содержащаяся в сообщениях и воспринимаемая получателем. Содержательность отражает семантическую емкость информации в информационных массивах. Значимость информации – свойство информации сохранять ценность для потребителя с течением времени. Полнота информации свойство содержательной информации, характеризуемое мерой ее достаточности для решения определенных задач. Идентичность — свойство, заключающееся в соответствии содержательной информации состоянию объекта. Δt 1— продолжительностью времени, в течение которого оцениваемая информация полностью сохраняет свою идентичность; Δt 2 — продолжительностью времени, в течение которого идентичность информации падает, но не более чем на одну четверть; Δt 3 — продолжительностью времени, в течение которго идентичность информации падает наполовину; Δt 4 — продолжительностью времени, в течение которого идентичность информации падает на три четверти.

Качество информации Содержательность информации — совокупность сведений о конкретном объекте (системе) или процессе, содержащаяся в сообщениях и воспринимаемая получателем. Содержательность отражает семантическую емкость информации в информационных массивах. Значимость информации – свойство информации сохранять ценность для потребителя с течением времени. Полнота информации свойство содержательной информации, характеризуемое мерой ее достаточности для решения определенных задач. Идентичность — свойство, заключающееся в соответствии содержательной информации состоянию объекта. Δt 1— продолжительностью времени, в течение которого оцениваемая информация полностью сохраняет свою идентичность; Δt 2 — продолжительностью времени, в течение которого идентичность информации падает, но не более чем на одну четверть; Δt 3 — продолжительностью времени, в течение которго идентичность информации падает наполовину; Δt 4 — продолжительностью времени, в течение которого идентичность информации падает на три четверти.

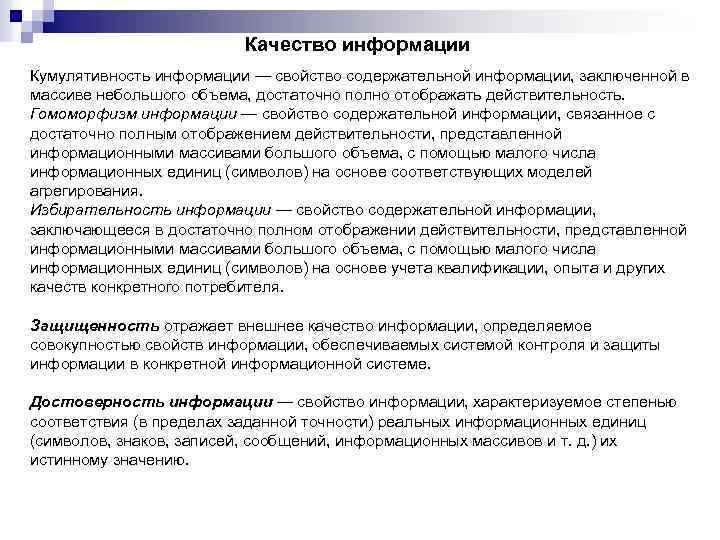

Качество информации Кумулятивность информации — свойство содержательной информации, заключенной в массиве небольшого объема, достаточно полно отображать действительность. Гомоморфизм информации — свойство содержательной информации, связанное с достаточно полным отображением действительности, представленной информационными массивами большого объема, с помощью малого числа информационных единиц (символов) на основе соответствующих моделей агрегирования. Избирательность информации — свойство содержательной информации, заключающееся в достаточно полном отображении действительности, представленной информационными массивами большого объема, с помощью малого числа информационных единиц (символов) на основе учета квалификации, опыта и других качеств конкретного потребителя. Защищенность отражает внешнее качество информации, определяемое совокупностью свойств информации, обеспечиваемых системой контроля и защиты информации в конкретной информационной системе. Достоверность информации — свойство информации, характеризуемое степенью соответствия (в пределах заданной точности) реальных информационных единиц (символов, знаков, записей, сообщений, информационных массивов и т. д. ) их истинному значению.

Качество информации Кумулятивность информации — свойство содержательной информации, заключенной в массиве небольшого объема, достаточно полно отображать действительность. Гомоморфизм информации — свойство содержательной информации, связанное с достаточно полным отображением действительности, представленной информационными массивами большого объема, с помощью малого числа информационных единиц (символов) на основе соответствующих моделей агрегирования. Избирательность информации — свойство содержательной информации, заключающееся в достаточно полном отображении действительности, представленной информационными массивами большого объема, с помощью малого числа информационных единиц (символов) на основе учета квалификации, опыта и других качеств конкретного потребителя. Защищенность отражает внешнее качество информации, определяемое совокупностью свойств информации, обеспечиваемых системой контроля и защиты информации в конкретной информационной системе. Достоверность информации — свойство информации, характеризуемое степенью соответствия (в пределах заданной точности) реальных информационных единиц (символов, знаков, записей, сообщений, информационных массивов и т. д. ) их истинному значению.

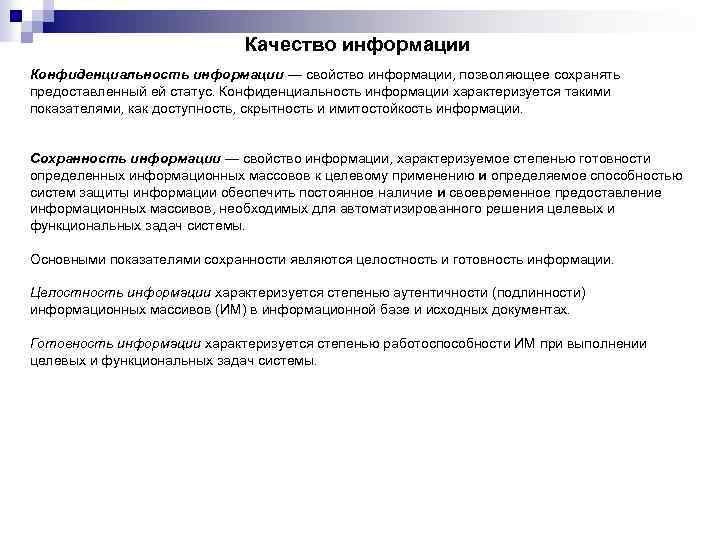

Качество информации Конфиденциальность информации — свойство информации, позволяющее сохранять предоставленный ей статус. Конфиденциальность информации характеризуется такими показателями, как доступность, скрытность и имитостойкость информации. Сохранность информации — свойство информации, характеризуемое степенью готовности определенных информационных массовов к целевому применению и определяемое способностью систем защиты информации обеспечить постоянное наличие и своевременное предоставление информационных массивов, необходимых для автоматизированного решения целевых и функциональных задач системы. Основными показателями сохранности являются целостность и готовность информации. Целостность информации характеризуется степенью аутентичности (подлинности) информационных массивов (ИМ) в информационной базе и исходных документах. Готовность информации характеризуется степенью работоспособности ИМ при выполнении целевых и функциональных задач системы.

Качество информации Конфиденциальность информации — свойство информации, позволяющее сохранять предоставленный ей статус. Конфиденциальность информации характеризуется такими показателями, как доступность, скрытность и имитостойкость информации. Сохранность информации — свойство информации, характеризуемое степенью готовности определенных информационных массовов к целевому применению и определяемое способностью систем защиты информации обеспечить постоянное наличие и своевременное предоставление информационных массивов, необходимых для автоматизированного решения целевых и функциональных задач системы. Основными показателями сохранности являются целостность и готовность информации. Целостность информации характеризуется степенью аутентичности (подлинности) информационных массивов (ИМ) в информационной базе и исходных документах. Готовность информации характеризуется степенью работоспособности ИМ при выполнении целевых и функциональных задач системы.

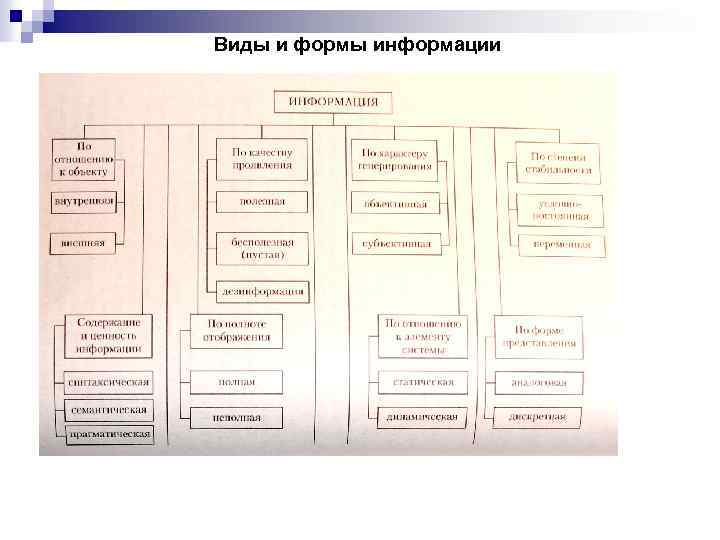

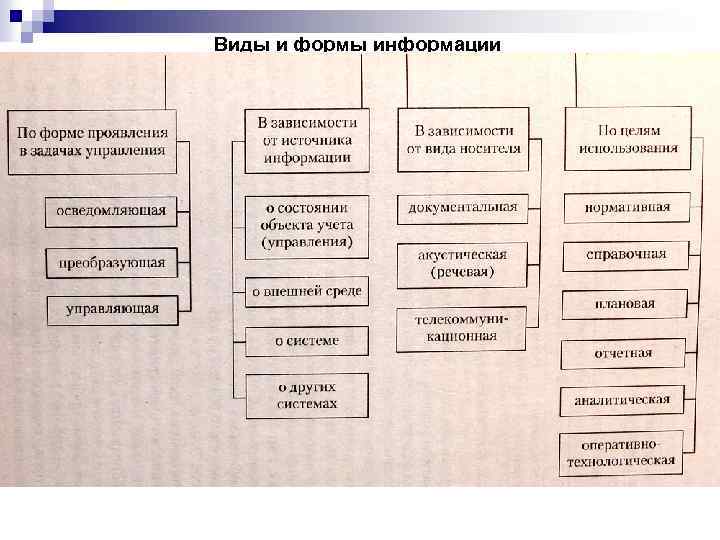

Виды и формы информации

Виды и формы информации

Виды и формы информации

Виды и формы информации

Виды и формы информации

Виды и формы информации

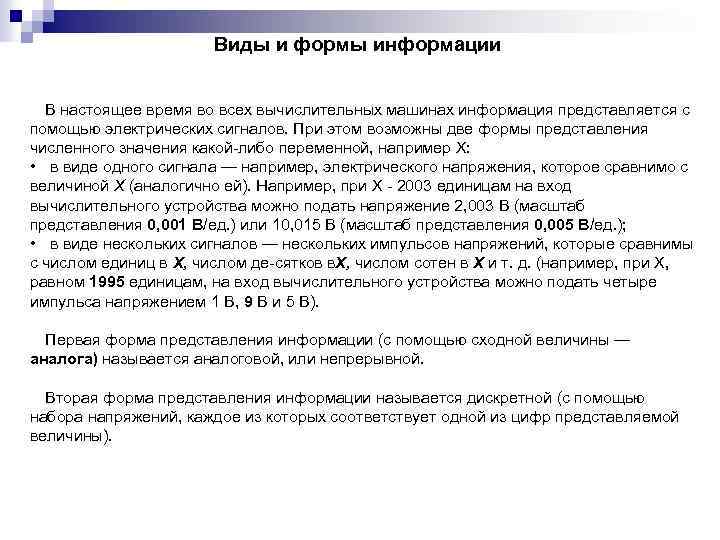

Виды и формы информации В настоящее время во всех вычислительных машинах информация представляется с помощью электрических сигналов. При этом возможны две формы представления численного значения какой либо переменной, например X: • в виде одного сигнала — например, электрического напряжения, которое сравнимо с величиной X (аналогично ей). Например, при X 2003 единицам на вход вычислительного устройства можно подать напряжение 2, 003 В (масштаб представления 0, 001 В/ед. ) или 10, 015 В (масштаб представления 0, 005 В/ед. ); • в виде нескольких сигналов — нескольких импульсов напряжений, которые сравнимы с числом единиц в X, числом де сятков в , числом сотен в X и т. д. (например, при X, X равном 1995 единицам, на вход вычислительного устройства можно подать четыре импульса напряжением 1 В, 9 В и 5 В). Первая форма представления информации (с помощью сходной величины — аналога) называется аналоговой, или непрерывной. Вторая форма представления информации называется дискретной (с помощью набора напряжений, каждое из которых соответствует одной из цифр представляемой величины).

Виды и формы информации В настоящее время во всех вычислительных машинах информация представляется с помощью электрических сигналов. При этом возможны две формы представления численного значения какой либо переменной, например X: • в виде одного сигнала — например, электрического напряжения, которое сравнимо с величиной X (аналогично ей). Например, при X 2003 единицам на вход вычислительного устройства можно подать напряжение 2, 003 В (масштаб представления 0, 001 В/ед. ) или 10, 015 В (масштаб представления 0, 005 В/ед. ); • в виде нескольких сигналов — нескольких импульсов напряжений, которые сравнимы с числом единиц в X, числом де сятков в , числом сотен в X и т. д. (например, при X, X равном 1995 единицам, на вход вычислительного устройства можно подать четыре импульса напряжением 1 В, 9 В и 5 В). Первая форма представления информации (с помощью сходной величины — аналога) называется аналоговой, или непрерывной. Вторая форма представления информации называется дискретной (с помощью набора напряжений, каждое из которых соответствует одной из цифр представляемой величины).

Лекция 3 Представление информации в цифровых автоматах

Лекция 3 Представление информации в цифровых автоматах

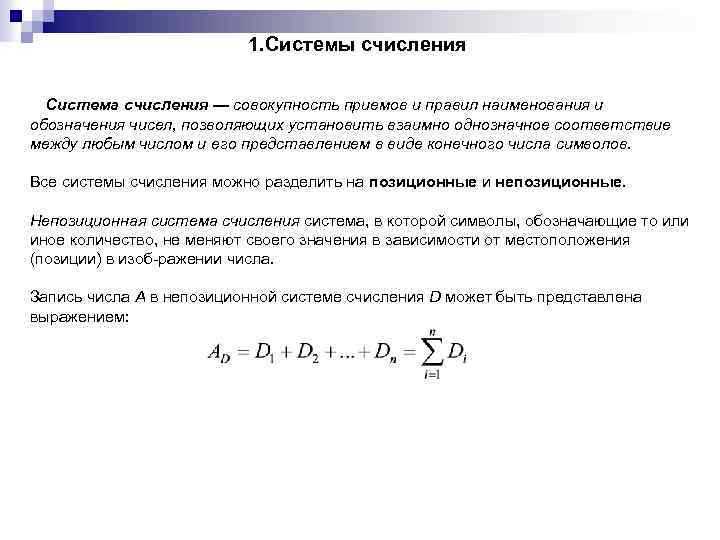

1. Системы счисления Система счисления — совокупность приемов и правил наименования и обозначения чисел, позволяющих установить взаимно однозначное соответствие между любым числом и его представлением в виде конечного числа символов. Все системы счисления можно разделить на позиционные и непозиционные. Непозиционная система счисления система, в которой символы, обозначающие то или иное количество, не меняют своего значения в зависимости от местоположения (позиции) в изоб ражении числа. Запись числа А в непозиционной системе счисления D может быть представлена выражением:

1. Системы счисления Система счисления — совокупность приемов и правил наименования и обозначения чисел, позволяющих установить взаимно однозначное соответствие между любым числом и его представлением в виде конечного числа символов. Все системы счисления можно разделить на позиционные и непозиционные. Непозиционная система счисления система, в которой символы, обозначающие то или иное количество, не меняют своего значения в зависимости от местоположения (позиции) в изоб ражении числа. Запись числа А в непозиционной системе счисления D может быть представлена выражением:

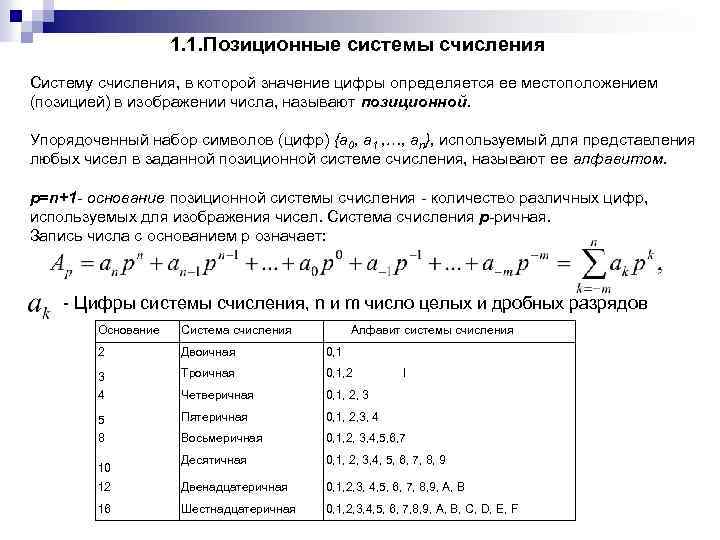

1. 1. Позиционные системы счисления Систему счисления, в которой значение цифры определяется ее местоположением (позицией) в изображении числа, называют позиционной. Упорядоченный набор символов (цифр) {a 0, a 1 , …, аn}, используемый для представления любых чисел в заданной позиционной системе счисления, называют ее алфавитом. p=n+1 - основание позиционной системы счисления количество различных цифр, используемых для изображения чисел. Система счисления p ричная. Запись числа с основанием p означает: Цифры системы счисления, n и m число целых и дробных разрядов Основание Система счисления 2 Двоичная 0, 1 3 4 Троичная 0, 1, 2 I Четверичная 0, 1, 2, 3 5 Пятеричная 0, 1, 2, 3, 4 8 Восьмеричная 0, 1, 2, 3, 4, 5, 6, 7 Десятичная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9 12 Двенадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В 16 Шестнадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В, С, D, Е, F 10 Алфавит системы счисления

1. 1. Позиционные системы счисления Систему счисления, в которой значение цифры определяется ее местоположением (позицией) в изображении числа, называют позиционной. Упорядоченный набор символов (цифр) {a 0, a 1 , …, аn}, используемый для представления любых чисел в заданной позиционной системе счисления, называют ее алфавитом. p=n+1 - основание позиционной системы счисления количество различных цифр, используемых для изображения чисел. Система счисления p ричная. Запись числа с основанием p означает: Цифры системы счисления, n и m число целых и дробных разрядов Основание Система счисления 2 Двоичная 0, 1 3 4 Троичная 0, 1, 2 I Четверичная 0, 1, 2, 3 5 Пятеричная 0, 1, 2, 3, 4 8 Восьмеричная 0, 1, 2, 3, 4, 5, 6, 7 Десятичная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9 12 Двенадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В 16 Шестнадцатеричная 0, 1, 2, 3, 4, 5, 6, 7, 8, 9, А, В, С, D, Е, F 10 Алфавит системы счисления

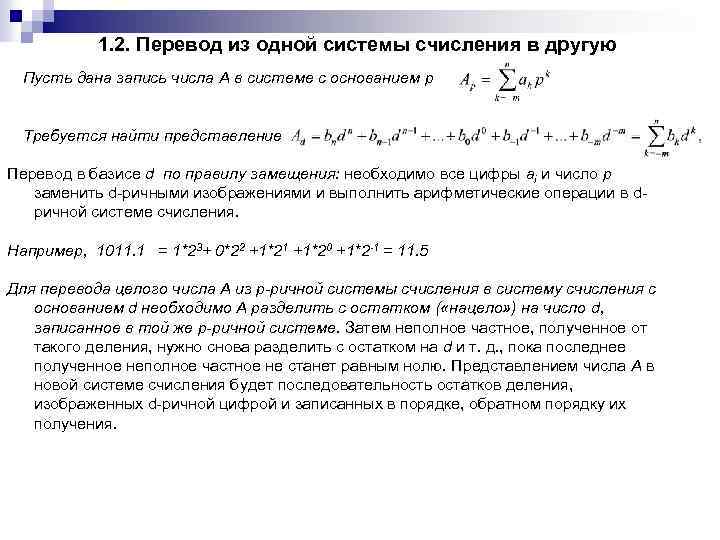

1. 2. Перевод из одной системы счисления в другую Пусть дана запись числа А в системе с основанием p Требуется найти представление Перевод в базисе d по правилу замещения: необходимо все цифры ai и число р заменить d ричными изображениями и выполнить арифметические операции в d ричной системе счисления. Например, 1011. 1 = 1*23+ 0*22 +1*21 +1*20 +1*2 -1 = 11. 5 Для перевода целого числа А из р-ричной системы счисления в систему счисления с основанием d необходимо А разделить с остатком ( «нацело» ) на число d, записанное в той же р-ричной системе. Затем неполное частное, полученное от такого деления, нужно снова разделить с остатком на d и т. д. , пока последнее полученное неполное частное не станет равным нолю. Представлением числа А в новой системе счисления будет последовательность остатков деления, изображенных d ричной цифрой и записанных в порядке, обратном порядку их получения.

1. 2. Перевод из одной системы счисления в другую Пусть дана запись числа А в системе с основанием p Требуется найти представление Перевод в базисе d по правилу замещения: необходимо все цифры ai и число р заменить d ричными изображениями и выполнить арифметические операции в d ричной системе счисления. Например, 1011. 1 = 1*23+ 0*22 +1*21 +1*20 +1*2 -1 = 11. 5 Для перевода целого числа А из р-ричной системы счисления в систему счисления с основанием d необходимо А разделить с остатком ( «нацело» ) на число d, записанное в той же р-ричной системе. Затем неполное частное, полученное от такого деления, нужно снова разделить с остатком на d и т. д. , пока последнее полученное неполное частное не станет равным нолю. Представлением числа А в новой системе счисления будет последовательность остатков деления, изображенных d ричной цифрой и записанных в порядке, обратном порядку их получения.

1. 3. Двоичная, Восьмеричная и Шестнадцатеричная Системы Десятичная Двоичная Восьмеричная Десятичная 0 0000 0 0 1 0001 1 1 2 0010 2 2 3 0011 3 3 4 0100 4 4 5 0101 5 5 6 0110 6 6 7 0111 7 7 8 1000 10 8 9 1001 11 9 10 1010 12 A 11 1011 13 B 12 1100 14 C 13 1101 15 D 14 1110 16 E 15 1111 17 F Перевод из двоичной в восьмеричной осуществляется триадами, в шестнадцатеричную- тетрадами

1. 3. Двоичная, Восьмеричная и Шестнадцатеричная Системы Десятичная Двоичная Восьмеричная Десятичная 0 0000 0 0 1 0001 1 1 2 0010 2 2 3 0011 3 3 4 0100 4 4 5 0101 5 5 6 0110 6 6 7 0111 7 7 8 1000 10 8 9 1001 11 9 10 1010 12 A 11 1011 13 B 12 1100 14 C 13 1101 15 D 14 1110 16 E 15 1111 17 F Перевод из двоичной в восьмеричной осуществляется триадами, в шестнадцатеричную- тетрадами

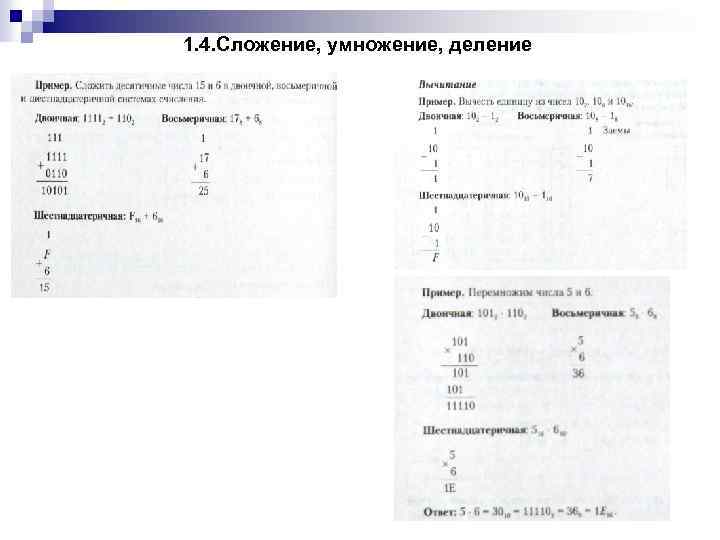

1. 4. Сложение, умножение, деление

1. 4. Сложение, умножение, деление

1. 5. Двоично-десятичная система В двоично десятичной системе десятичные цифры от 0 до 9 представляют 4 разрядными двоичными комбинациями от 0000 до 1001, т. е. двоичными эквивалентами десяти первых шестнадцатеричных цифр Две двоично десятичные цифры составляют 1 байт. Таким образом, с помощью 1 байта можно представлять значения от 0 до 99, а не от 0 до 255, как при использовании 8 разрядного двоичного числа. (1001 0101 0011 1000)2 = (38200)10

1. 5. Двоично-десятичная система В двоично десятичной системе десятичные цифры от 0 до 9 представляют 4 разрядными двоичными комбинациями от 0000 до 1001, т. е. двоичными эквивалентами десяти первых шестнадцатеричных цифр Две двоично десятичные цифры составляют 1 байт. Таким образом, с помощью 1 байта можно представлять значения от 0 до 99, а не от 0 до 255, как при использовании 8 разрядного двоичного числа. (1001 0101 0011 1000)2 = (38200)10

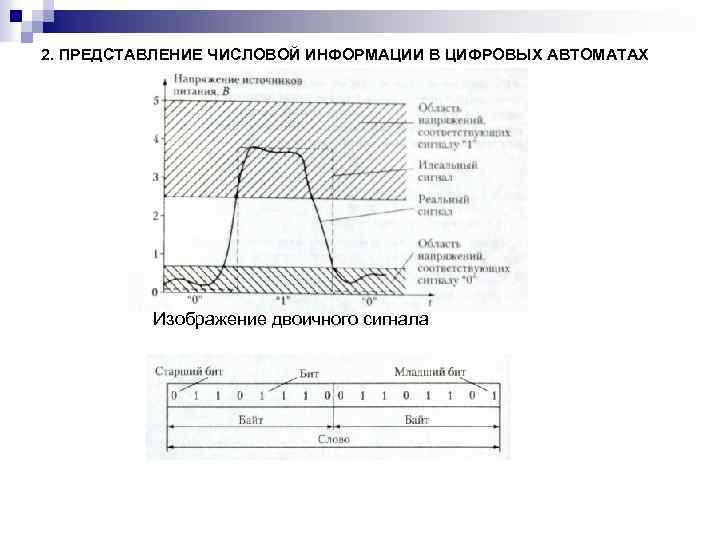

2. ПРЕДСТАВЛЕНИЕ ЧИСЛОВОЙ ИНФОРМАЦИИ В ЦИФРОВЫХ АВТОМАТАХ Изображение двоичного сигнала

2. ПРЕДСТАВЛЕНИЕ ЧИСЛОВОЙ ИНФОРМАЦИИ В ЦИФРОВЫХ АВТОМАТАХ Изображение двоичного сигнала

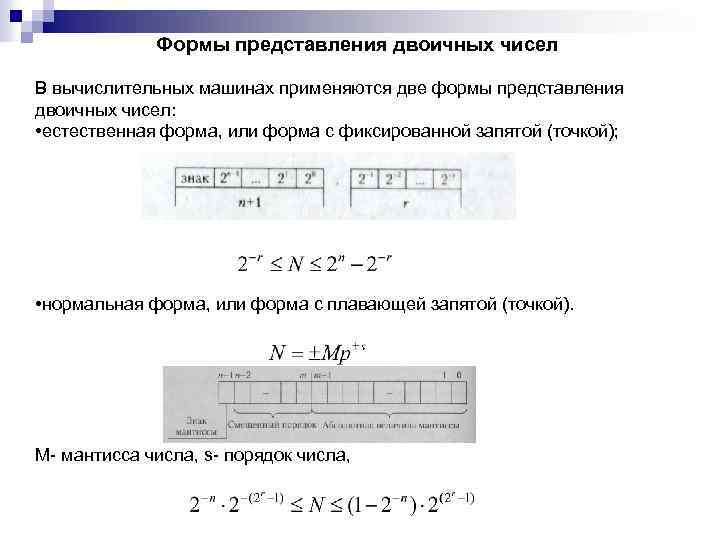

Формы представления двоичных чисел В вычислительных машинах применяются две формы представления двоичных чисел: • естественная форма, или форма с фиксированной запятой (точкой); • нормальная форма, или форма с плавающей запятой (точкой). M мантисса числа, s порядок числа,

Формы представления двоичных чисел В вычислительных машинах применяются две формы представления двоичных чисел: • естественная форма, или форма с фиксированной запятой (точкой); • нормальная форма, или форма с плавающей запятой (точкой). M мантисса числа, s порядок числа,

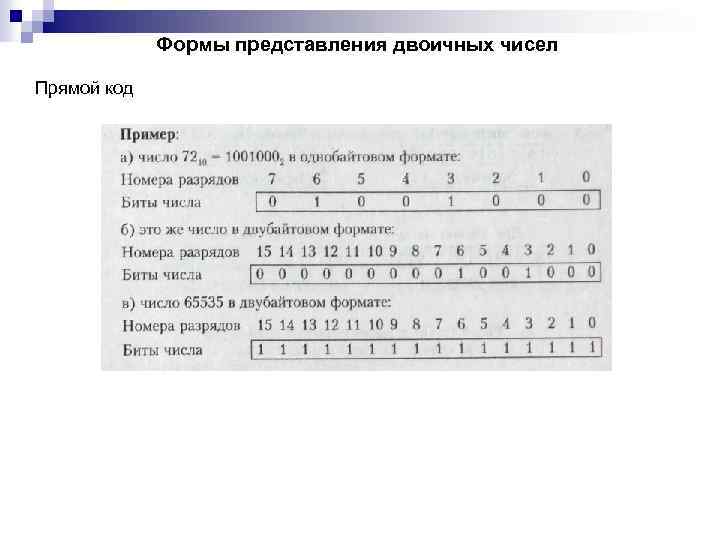

Формы представления двоичных чисел Прямой код

Формы представления двоичных чисел Прямой код

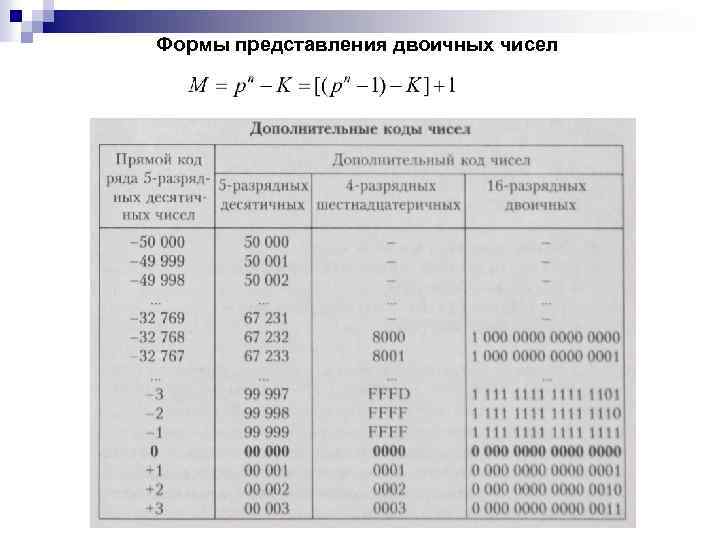

Формы представления двоичных чисел

Формы представления двоичных чисел

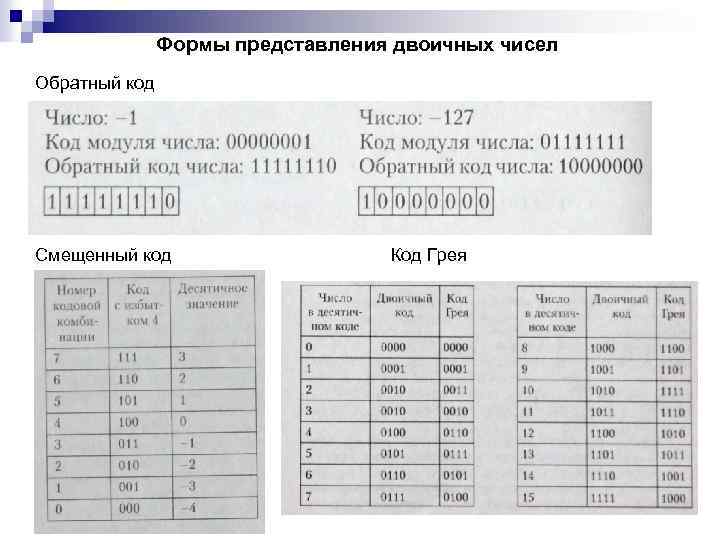

Формы представления двоичных чисел Обратный код Смещенный код Код Грея

Формы представления двоичных чисел Обратный код Смещенный код Код Грея

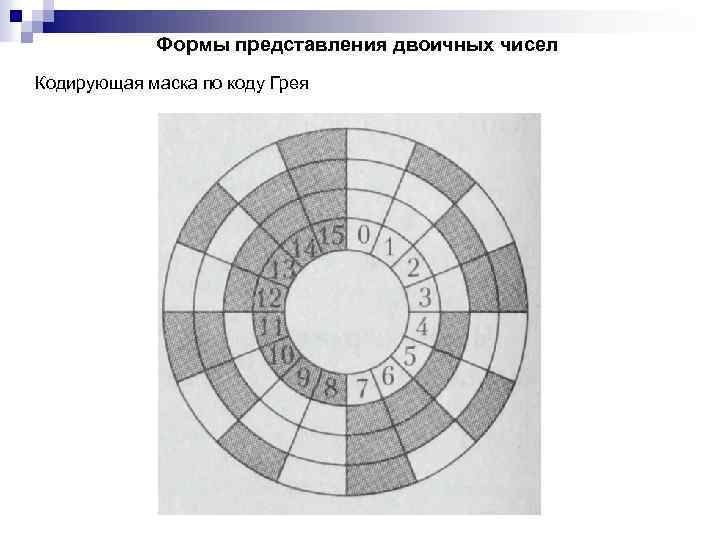

Формы представления двоичных чисел Кодирующая маска по коду Грея

Формы представления двоичных чисел Кодирующая маска по коду Грея

3. ПРЕДСТАВЛЕНИЕ СИМВОЛЬНОЙ ИНФОРМАЦИИ В ЭВМ Символьная (алфавитно цифровая) информация хранится и обрабатывается в ЭВМ в форме цифрового кода, т. е. каждому символу ставится в соответствие отдельное бинарное слово код. Получили распространение: • кодировка ASCII (ASCII — American Standard Code for Information Interchange) — американский стандартный код обмена информацией и кода EBCDIC (Extended Binary Coded Decimal Interchange Code) расширенный двоично десятичный код обмена информацией; • В связи с массовым распространением операционных систем и других продуктов компании Microsoft в нашей стране нашла применение кодировка символов русского языка, известная как кодировка Windows-1251 (cp 1251); • Другая распространенная кодировка носит название КОИ 8 (код обмена информацией восьмизначный) — ее происхождение относится ко временам действия Совета Экономической Взаимопомощи государств Восточной Европы; • В последнее время все большее распространение получает универсальная система кодирования текстовых данных UNICODE. В данной системе символы кодируются не 8 -разрядными двоичными числами, а 16 -разрядными числами. Шестнадцать разрядов позволяют обеспечить уникальные коды для 65536 различных символов — этого достаточно для размещения в одной таблице всех широкоупотребляемых языков.

3. ПРЕДСТАВЛЕНИЕ СИМВОЛЬНОЙ ИНФОРМАЦИИ В ЭВМ Символьная (алфавитно цифровая) информация хранится и обрабатывается в ЭВМ в форме цифрового кода, т. е. каждому символу ставится в соответствие отдельное бинарное слово код. Получили распространение: • кодировка ASCII (ASCII — American Standard Code for Information Interchange) — американский стандартный код обмена информацией и кода EBCDIC (Extended Binary Coded Decimal Interchange Code) расширенный двоично десятичный код обмена информацией; • В связи с массовым распространением операционных систем и других продуктов компании Microsoft в нашей стране нашла применение кодировка символов русского языка, известная как кодировка Windows-1251 (cp 1251); • Другая распространенная кодировка носит название КОИ 8 (код обмена информацией восьмизначный) — ее происхождение относится ко временам действия Совета Экономической Взаимопомощи государств Восточной Европы; • В последнее время все большее распространение получает универсальная система кодирования текстовых данных UNICODE. В данной системе символы кодируются не 8 -разрядными двоичными числами, а 16 -разрядными числами. Шестнадцать разрядов позволяют обеспечить уникальные коды для 65536 различных символов — этого достаточно для размещения в одной таблице всех широкоупотребляемых языков.