Введение в информатику1.ppt

- Количество слайдов: 28

Информатика и программирование Доцент кафедры ИАНИ факультета ВМК Фомина Ирина Александровна

Информатика и программирование Доцент кафедры ИАНИ факультета ВМК Фомина Ирина Александровна

Определения: ¡ Термин "информатика" (франц. informatique) происходит от французских слов information (информация) и automatique (автоматика) и дословно означает "информационная автоматика". Широко распространен также англоязычный вариант этого термина - "Сomputer science", что означает буквально "компьютерная наука". ¡ В 1978 году международный научный конгресс официально закрепил за понятием "информатика" области, связанные с разработкой, созданием, использованием и материально-техническим обслуживанием систем обработки информации, включая компьютеры и их программное обеспечение, а также организационные, коммерческие, административные и социально-политические аспекты компьютеризации массового внедрения компьютерной техники во все области жизни людей.

Определения: ¡ Термин "информатика" (франц. informatique) происходит от французских слов information (информация) и automatique (автоматика) и дословно означает "информационная автоматика". Широко распространен также англоязычный вариант этого термина - "Сomputer science", что означает буквально "компьютерная наука". ¡ В 1978 году международный научный конгресс официально закрепил за понятием "информатика" области, связанные с разработкой, созданием, использованием и материально-техническим обслуживанием систем обработки информации, включая компьютеры и их программное обеспечение, а также организационные, коммерческие, административные и социально-политические аспекты компьютеризации массового внедрения компьютерной техники во все области жизни людей.

Что такое информатика и кибернетика? Информатика - это основанная на использовании компьютерной техники дисциплина, изучающая структуру и общие свойства информации, а также закономерности и методы ее создания, хранения, поиска, преобразования, передачи и применения в различных сферах человеческой деятельности. Кибернетика (основатель Норберт Винер, 1948 г. ) – наука об общих принципах управления в различных системах: технических, биологических, социальных и др. Кибернетику определяют как науку о восприятии, переработке, передаче, хранении и использовании информации.

Что такое информатика и кибернетика? Информатика - это основанная на использовании компьютерной техники дисциплина, изучающая структуру и общие свойства информации, а также закономерности и методы ее создания, хранения, поиска, преобразования, передачи и применения в различных сферах человеческой деятельности. Кибернетика (основатель Норберт Винер, 1948 г. ) – наука об общих принципах управления в различных системах: технических, биологических, социальных и др. Кибернетику определяют как науку о восприятии, переработке, передаче, хранении и использовании информации.

Различие между понятиями «информатика» и «кибернетика» Кибернетика и информатика внешне похожие дисциплины, различаются, скорее всего, в расстановке акцентов: • в кибернетике – на разработке концепций и построении моделей объектов с использованием, в частности, информационного подхода (МОИ); • кибернетика существует независимо от наличия или отсутствия компьютеров. • в информатике – на свойствах информации и аппаратно- программных средствах ее обработки; • информатика появилась благодаря развитию компьютерной техники и немыслима без нее; занимается изучением процессов преобразования и создания новой информации.

Различие между понятиями «информатика» и «кибернетика» Кибернетика и информатика внешне похожие дисциплины, различаются, скорее всего, в расстановке акцентов: • в кибернетике – на разработке концепций и построении моделей объектов с использованием, в частности, информационного подхода (МОИ); • кибернетика существует независимо от наличия или отсутствия компьютеров. • в информатике – на свойствах информации и аппаратно- программных средствах ее обработки; • информатика появилась благодаря развитию компьютерной техники и немыслима без нее; занимается изучением процессов преобразования и создания новой информации.

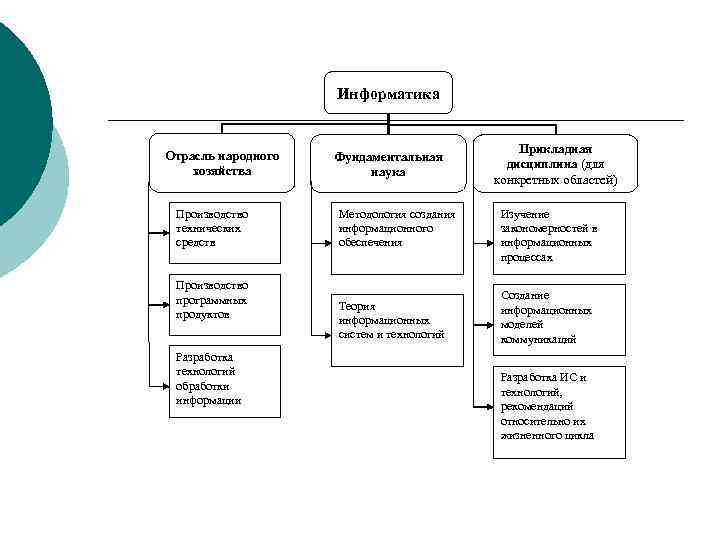

Информатика Отрасль народного хозяйства Производство технических средств Производство программных продуктов Разработка технологий обработки информации Фундаментальная наука Методология создания информационного обеспечения Теория информационных систем и технологий Прикладная дисциплина (для конкретных областей) Изучение закономерностей в информационных процессах Создание информационных моделей коммуникаций Разработка ИС и технологий, рекомендаций относительно их жизненного цикла

Информатика Отрасль народного хозяйства Производство технических средств Производство программных продуктов Разработка технологий обработки информации Фундаментальная наука Методология создания информационного обеспечения Теория информационных систем и технологий Прикладная дисциплина (для конкретных областей) Изучение закономерностей в информационных процессах Создание информационных моделей коммуникаций Разработка ИС и технологий, рекомендаций относительно их жизненного цикла

Главная функция информатики – разработка методов и средств преобразования информации и их использование в организации технологического процесса переработки информации. Задачи информатики: • исследование информационных процессов любой природы; • разработка информационной техники и создание новейших технологий переработки информации на базе полученных результатов исследования информационных процессов; • решение научных и инженерных проблем создания, внедрения и обеспечения эффективного использования компьютерной техники и технологии во всех сферах общественной жизни.

Главная функция информатики – разработка методов и средств преобразования информации и их использование в организации технологического процесса переработки информации. Задачи информатики: • исследование информационных процессов любой природы; • разработка информационной техники и создание новейших технологий переработки информации на базе полученных результатов исследования информационных процессов; • решение научных и инженерных проблем создания, внедрения и обеспечения эффективного использования компьютерной техники и технологии во всех сферах общественной жизни.

ИНФОРМАТИКА Технические cредства Программные cредства Алгоритмические cредства (Hard. Ware) (Soft. Ware) (Brain. Ware)

ИНФОРМАТИКА Технические cредства Программные cредства Алгоритмические cредства (Hard. Ware) (Soft. Ware) (Brain. Ware)

Информационные революции 1 революция связана с изобретением письменности, что привело к гигантскому качественному и количественному скачку. Появилась возможность передачи знаний от поколения к поколению. 2 (середина 16 века) вызвана изобретением книгопечатания, которое коренным образом изменило индустриальное общество, его культуру и организацию деятельности. 3 (конец 19 века) связана с изобретением электричества, благодаря которому появились телеграф, телефон, радио; что позволило оперативно передавать и накапливать информацию в любом объеме. 4 (70 -е гг. 20 века) – изобретение микропроцессорной технологии. На микропроцессорах и интегральных схемах создаются ПК, компьютерные сети (КС), системы передачи данных (телекоммуникации – дистанционная передача данных на базе КС и современных технических средств связи).

Информационные революции 1 революция связана с изобретением письменности, что привело к гигантскому качественному и количественному скачку. Появилась возможность передачи знаний от поколения к поколению. 2 (середина 16 века) вызвана изобретением книгопечатания, которое коренным образом изменило индустриальное общество, его культуру и организацию деятельности. 3 (конец 19 века) связана с изобретением электричества, благодаря которому появились телеграф, телефон, радио; что позволило оперативно передавать и накапливать информацию в любом объеме. 4 (70 -е гг. 20 века) – изобретение микропроцессорной технологии. На микропроцессорах и интегральных схемах создаются ПК, компьютерные сети (КС), системы передачи данных (телекоммуникации – дистанционная передача данных на базе КС и современных технических средств связи).

Что такое информация? Информация это обозначение содержания, полученного из внешнего мира в процессе нашего приспособления к нему и приспособления к нему наших чувств (Н. Виннер). Информация сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые воспринимают информационные системы (живые организмы, управляющие машины и др. ) в процессе жизнедеятельности и работы и которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний. Данные признаки или записанные наблюдения, которые по каким- либо причинам не используются, а только хранятся. В том случае, если появляется возможность использовать эти данные для уменьшения неопределенности о чём- либо, данные превращаются в информацию. Информация есть характеристика не сообщения, а соотношения между сообщением и его потребителем. Без наличия потребителя, хотя бы потенциального, говорить об информации бессмысленно.

Что такое информация? Информация это обозначение содержания, полученного из внешнего мира в процессе нашего приспособления к нему и приспособления к нему наших чувств (Н. Виннер). Информация сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые воспринимают информационные системы (живые организмы, управляющие машины и др. ) в процессе жизнедеятельности и работы и которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний. Данные признаки или записанные наблюдения, которые по каким- либо причинам не используются, а только хранятся. В том случае, если появляется возможность использовать эти данные для уменьшения неопределенности о чём- либо, данные превращаются в информацию. Информация есть характеристика не сообщения, а соотношения между сообщением и его потребителем. Без наличия потребителя, хотя бы потенциального, говорить об информации бессмысленно.

Информационные ресурсы – это идеи человечества и указания по их реализации, накопленные в форме, позволяющей их воспроизводство. Это книги, статьи, патенты, диссертации, научноисследовательская и опытно-конструкторская документация, технические переводы, данные о передовом производственном опыте и др. Информатизация общества - организованный социально-экономический и научнотехнический процесс создания оптимальных условий для удовлетворения информационных потребностей и реализации прав граждан, органов государственной власти, органов местного самоуправления организаций, общественных объединений на основе формирования и использования информационных ресурсов.

Информационные ресурсы – это идеи человечества и указания по их реализации, накопленные в форме, позволяющей их воспроизводство. Это книги, статьи, патенты, диссертации, научноисследовательская и опытно-конструкторская документация, технические переводы, данные о передовом производственном опыте и др. Информатизация общества - организованный социально-экономический и научнотехнический процесс создания оптимальных условий для удовлетворения информационных потребностей и реализации прав граждан, органов государственной власти, органов местного самоуправления организаций, общественных объединений на основе формирования и использования информационных ресурсов.

В каком виде существует информация? ¡в виде текстов, рисунков, чертежей, фотографий; ¡в виде световых или звуковых сигналов; ¡в виде радиоволн; ¡в виде электрических и нервных импульсов; ¡в виде магнитных записей; ¡в виде жестов и мимики; ¡в виде запахов и вкусовых ощущений; ¡в виде хромосом, посредством которых передаются по наследству признаки и свойства организмов и т. д. Информационные объекты предметы, процессы, явления материального или нематериального свойства, рассматриваемые с точки зрения их информационных свойств.

В каком виде существует информация? ¡в виде текстов, рисунков, чертежей, фотографий; ¡в виде световых или звуковых сигналов; ¡в виде радиоволн; ¡в виде электрических и нервных импульсов; ¡в виде магнитных записей; ¡в виде жестов и мимики; ¡в виде запахов и вкусовых ощущений; ¡в виде хромосом, посредством которых передаются по наследству признаки и свойства организмов и т. д. Информационные объекты предметы, процессы, явления материального или нематериального свойства, рассматриваемые с точки зрения их информационных свойств.

Свойства информации: Достоверность ¡ Полнота ¡ Ценность ¡ Своевременность ¡ Понятность ¡ Доступность ¡ Краткость ¡ и др. ¡

Свойства информации: Достоверность ¡ Полнота ¡ Ценность ¡ Своевременность ¡ Понятность ¡ Доступность ¡ Краткость ¡ и др. ¡

Что можно делать с информацией? ¡Создавать ¡Передавать ¡Воспринимать ¡Иcпользовать ¡Запоминать ¡Принимать ¡Копировать ¡Формализовать ¡Распространять ¡Обрабатывать ¡Преобразовывать ¡Комбинировать ¡Делить на части ¡Упрощать ¡Собирать ¡Хранить ¡Искать ¡Измерят ¡Разрушать-и др.

Что можно делать с информацией? ¡Создавать ¡Передавать ¡Воспринимать ¡Иcпользовать ¡Запоминать ¡Принимать ¡Копировать ¡Формализовать ¡Распространять ¡Обрабатывать ¡Преобразовывать ¡Комбинировать ¡Делить на части ¡Упрощать ¡Собирать ¡Хранить ¡Искать ¡Измерят ¡Разрушать-и др.

Что такое обработка информации? Обработка информации – получение одних информационных объектов из других информационных объектов путем выполнения некоторых алгоритмов. Обработка является одной из основных операций, выполняемых над информацией, и главным средством увеличения объема и разнообразия информации. Средства обработки информации - это всевозможные устройства и системы, созданные человечеством, и в первую очередь, компьютер - универсальная машина для обработки информации. Все процессы, связанные с определенными операциями над информацией, называются информационными процессами.

Что такое обработка информации? Обработка информации – получение одних информационных объектов из других информационных объектов путем выполнения некоторых алгоритмов. Обработка является одной из основных операций, выполняемых над информацией, и главным средством увеличения объема и разнообразия информации. Средства обработки информации - это всевозможные устройства и системы, созданные человечеством, и в первую очередь, компьютер - универсальная машина для обработки информации. Все процессы, связанные с определенными операциями над информацией, называются информационными процессами.

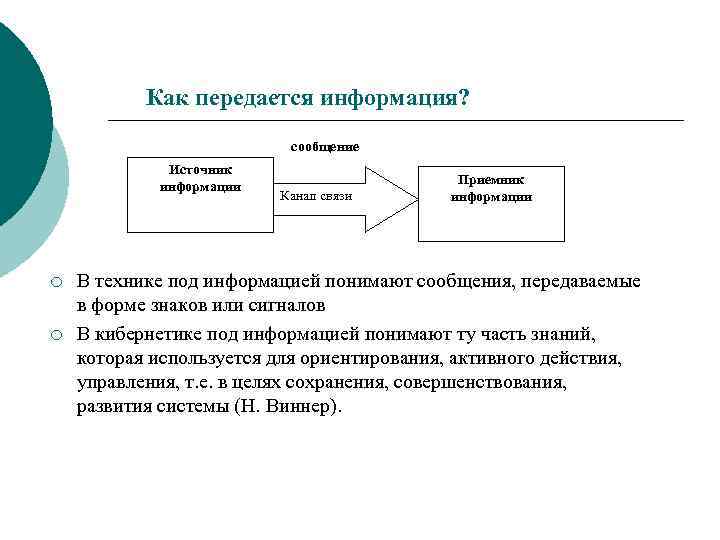

Как передается информация? сообщение Источник информации ¡ ¡ Канал связи Приемник информации В технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов В кибернетике под информацией понимают ту часть знаний, которая используется для ориентирования, активного действия, управления, т. е. в целях сохранения, совершенствования, развития системы (Н. Виннер).

Как передается информация? сообщение Источник информации ¡ ¡ Канал связи Приемник информации В технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов В кибернетике под информацией понимают ту часть знаний, которая используется для ориентирования, активного действия, управления, т. е. в целях сохранения, совершенствования, развития системы (Н. Виннер).

Как измеряется количество информации? • В определенных, весьма широких условиях можно пренебречь качественными особенностями информации, выразить ее количество числом, а также сравнить количество информации, содержащейся в различных группах данных. • В случаях, когда говорят об автоматизированной работе с информацией посредством каких-либо технических устройств, обычно в первую очередь интересуются не содержанием сообщения, а тем, сколько символов это сообщение содержит. • Применительно к компьютерной обработке данных под информацией понимают некоторую последовательность символических обозначений (букв, цифр, закодированных графических образов и звуков и т. п. ), несущую смысловую нагрузку и представленную в понятном компьютеру виде. • Каждый новый символ в такой последовательности символов увеличивает информационный объем сообщения.

Как измеряется количество информации? • В определенных, весьма широких условиях можно пренебречь качественными особенностями информации, выразить ее количество числом, а также сравнить количество информации, содержащейся в различных группах данных. • В случаях, когда говорят об автоматизированной работе с информацией посредством каких-либо технических устройств, обычно в первую очередь интересуются не содержанием сообщения, а тем, сколько символов это сообщение содержит. • Применительно к компьютерной обработке данных под информацией понимают некоторую последовательность символических обозначений (букв, цифр, закодированных графических образов и звуков и т. п. ), несущую смысловую нагрузку и представленную в понятном компьютеру виде. • Каждый новый символ в такой последовательности символов увеличивает информационный объем сообщения.

Как измеряется количество информации? ¡ ¡ В настоящее время получили распространение подходы к определению понятия "количество информации", основанные на том, что информацию, содержащуюся в сообщении, можно нестрого трактовать в смысле ее новизны или, иначе, уменьшения неопределенности наших знаний об объекте. Количество информации – это мера уменьшения неопределённости наших знаний о некоторой ситуации (Клод Шеннон).

Как измеряется количество информации? ¡ ¡ В настоящее время получили распространение подходы к определению понятия "количество информации", основанные на том, что информацию, содержащуюся в сообщении, можно нестрого трактовать в смысле ее новизны или, иначе, уменьшения неопределенности наших знаний об объекте. Количество информации – это мера уменьшения неопределённости наших знаний о некоторой ситуации (Клод Шеннон).

Оценка количества информации Существует два подхода к измерению количества информации. 1. Вероятностный подход. Основан на том, что информацию, содержащуюся в сообщении, можно нестрого трактовать в смысле ее новизны или, иначе, уменьшения неопределенности наших знаний об объекте. Определение. Количество информации можно рассматривать как меру уменьшения неопределённости знания при получении информационных сообщений. За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза. Такая единица названа битом.

Оценка количества информации Существует два подхода к измерению количества информации. 1. Вероятностный подход. Основан на том, что информацию, содержащуюся в сообщении, можно нестрого трактовать в смысле ее новизны или, иначе, уменьшения неопределенности наших знаний об объекте. Определение. Количество информации можно рассматривать как меру уменьшения неопределённости знания при получении информационных сообщений. За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза. Такая единица названа битом.

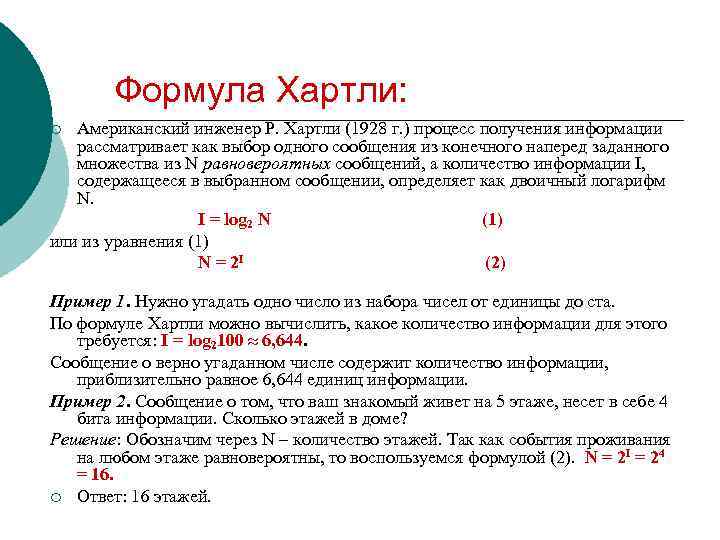

Формула Хартли: Американский инженер Р. Хартли (1928 г. ) процесс получения информации рассматривает как выбор одного сообщения из конечного наперед заданного множества из N равновероятных сообщений, а количество информации I, содержащееся в выбранном сообщении, определяет как двоичный логарифм N. I = log 2 N (1) или из уравнения (1) N = 2 I (2) Пример 1. Нужно угадать одно число из набора чисел от единицы до ста. По формуле Хартли можно вычислить, какое количество информации для этого требуется: I = log 2100 6, 644. Сообщение о верно угаданном числе содержит количество информации, приблизительно равное 6, 644 единиц информации. Пример 2. Сообщение о том, что ваш знакомый живет на 5 этаже, несет в себе 4 бита информации. Сколько этажей в доме? Решение: Обозначим через N – количество этажей. Так как события проживания на любом этаже равновероятны, то воспользуемся формулой (2). N = 2 I = 24 = 16. ¡ Ответ: 16 этажей. ¡

Формула Хартли: Американский инженер Р. Хартли (1928 г. ) процесс получения информации рассматривает как выбор одного сообщения из конечного наперед заданного множества из N равновероятных сообщений, а количество информации I, содержащееся в выбранном сообщении, определяет как двоичный логарифм N. I = log 2 N (1) или из уравнения (1) N = 2 I (2) Пример 1. Нужно угадать одно число из набора чисел от единицы до ста. По формуле Хартли можно вычислить, какое количество информации для этого требуется: I = log 2100 6, 644. Сообщение о верно угаданном числе содержит количество информации, приблизительно равное 6, 644 единиц информации. Пример 2. Сообщение о том, что ваш знакомый живет на 5 этаже, несет в себе 4 бита информации. Сколько этажей в доме? Решение: Обозначим через N – количество этажей. Так как события проживания на любом этаже равновероятны, то воспользуемся формулой (2). N = 2 I = 24 = 16. ¡ Ответ: 16 этажей. ¡

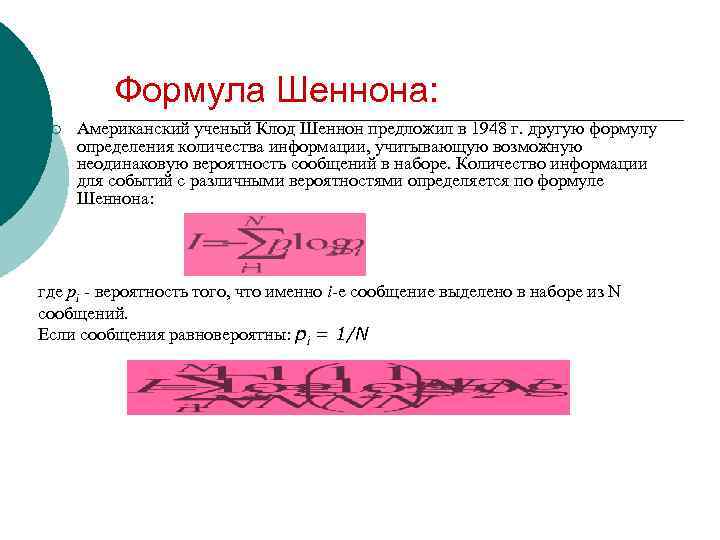

Формула Шеннона: ¡ Американский ученый Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе. Количество информации для событий с различными вероятностями определяется по формуле Шеннона: где pi - вероятность того, что именно i-е сообщение выделено в наборе из N сообщений. Если сообщения равновероятны: pi = 1/N

Формула Шеннона: ¡ Американский ученый Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе. Количество информации для событий с различными вероятностями определяется по формуле Шеннона: где pi - вероятность того, что именно i-е сообщение выделено в наборе из N сообщений. Если сообщения равновероятны: pi = 1/N

Примеры ¡ ¡ ¡ Пример 1. В корзине лежат 8 мячей разного цвета (черный, белый, синий, красный, желтый, зеленый, фиолетовый, коричневый). Какое количество информации несет в себе сообщение о том, что из корзины будет вынут мяч белого цвета? Решение: Так как возможность вынуть мяч любого цвета равновероятна, то для определения количества информации, содержащегося в сообщении о том, что вынут мяч белого цвета, воспользуемся формулой (2): I = log 2 N = log 2 8 = 3 бита. Ответ: 3 бита. Пример 2. В корзине лежат 16 мячей разного цвета: 4 белых, 8 синих, 4 красных. Какое количество информации несет в себе сообщение о том, что из корзины извлечен один мяч? Решение: Так количество мячей различного цвета неодинаково, то вероятности о цвете вынутого мяча различны. Для определения вероятностей разделим количество мячей одного цвета на общее количество мячей. Вероятность вынуть мяч белого цвета рб = 4/16 = 0, 25, синего цвета рс = 8/16 = 0, 5, красного цвета рк = 4/16 = 0, 25. Так как события не являются равновероятными, то для определения количества информации, содержащегося в сообщении о том, что из корзины вынут мяч, воспользуемся формулой (4): ¡ I = – (рб * log 2 рб + рс log 2 рс + рк * log 2 рк) = – (0, 25* log 2 0, 25 + 0, 5 log 2 0, 5 + 0, 25 * log 2 0, 25) = 1, 5 бита. ¡ Ответ: 1, 5 бита.

Примеры ¡ ¡ ¡ Пример 1. В корзине лежат 8 мячей разного цвета (черный, белый, синий, красный, желтый, зеленый, фиолетовый, коричневый). Какое количество информации несет в себе сообщение о том, что из корзины будет вынут мяч белого цвета? Решение: Так как возможность вынуть мяч любого цвета равновероятна, то для определения количества информации, содержащегося в сообщении о том, что вынут мяч белого цвета, воспользуемся формулой (2): I = log 2 N = log 2 8 = 3 бита. Ответ: 3 бита. Пример 2. В корзине лежат 16 мячей разного цвета: 4 белых, 8 синих, 4 красных. Какое количество информации несет в себе сообщение о том, что из корзины извлечен один мяч? Решение: Так количество мячей различного цвета неодинаково, то вероятности о цвете вынутого мяча различны. Для определения вероятностей разделим количество мячей одного цвета на общее количество мячей. Вероятность вынуть мяч белого цвета рб = 4/16 = 0, 25, синего цвета рс = 8/16 = 0, 5, красного цвета рк = 4/16 = 0, 25. Так как события не являются равновероятными, то для определения количества информации, содержащегося в сообщении о том, что из корзины вынут мяч, воспользуемся формулой (4): ¡ I = – (рб * log 2 рб + рс log 2 рс + рк * log 2 рк) = – (0, 25* log 2 0, 25 + 0, 5 log 2 0, 5 + 0, 25 * log 2 0, 25) = 1, 5 бита. ¡ Ответ: 1, 5 бита.

2. Алфавитный (технический) подход ¡ ¡ ¡ В технике под информацией, как правило, любая последовательность символов и знаков. Для определения количества информации в сообщении определяют длину данной последовательности без учёта её смыслового содержания. Определение. Информационный объём сообщения – это количество символов, которое необходимо для кодирования этого сообщения. В качестве единицы информации условились принять один бит (англ. bit - binary digit – двоичная цифра). Бит в теории информации – минимальная единица количества информации, равная одному двоичному разряду и необходимая для различения двух равновероятных сообщений.

2. Алфавитный (технический) подход ¡ ¡ ¡ В технике под информацией, как правило, любая последовательность символов и знаков. Для определения количества информации в сообщении определяют длину данной последовательности без учёта её смыслового содержания. Определение. Информационный объём сообщения – это количество символов, которое необходимо для кодирования этого сообщения. В качестве единицы информации условились принять один бит (англ. bit - binary digit – двоичная цифра). Бит в теории информации – минимальная единица количества информации, равная одному двоичному разряду и необходимая для различения двух равновероятных сообщений.

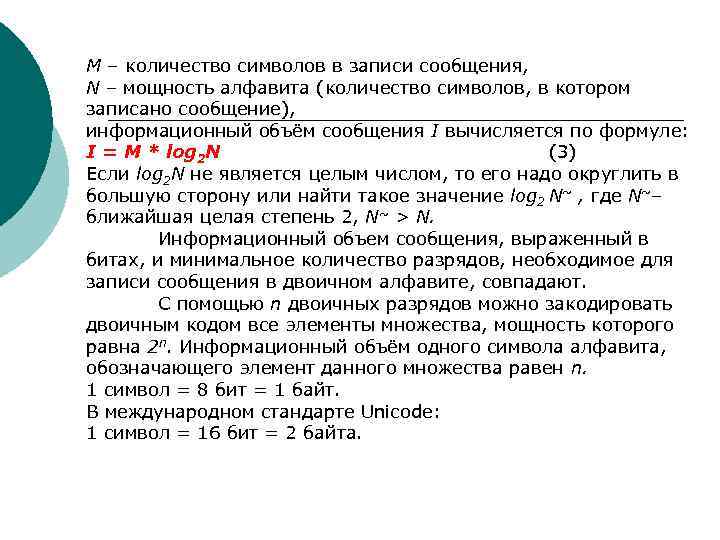

M – количество символов в записи сообщения, N – мощность алфавита (количество символов, в котором записано сообщение), информационный объём сообщения I вычисляется по формуле: I = M * log 2 N (3) Если log 2 N не является целым числом, то его надо округлить в большую сторону или найти такое значение log 2 N~ , где N~– ближайшая целая степень 2, N~ > N. Информационный объем сообщения, выраженный в битах, и минимальное количество разрядов, необходимое для записи сообщения в двоичном алфавите, совпадают. С помощью n двоичных разрядов можно закодировать двоичным кодом все элементы множества, мощность которого равна 2 n. Информационный объём одного символа алфавита, обозначающего элемент данного множества равен n. 1 символ = 8 бит = 1 байт. В международном стандарте Unicode: 1 символ = 16 бит = 2 байта.

M – количество символов в записи сообщения, N – мощность алфавита (количество символов, в котором записано сообщение), информационный объём сообщения I вычисляется по формуле: I = M * log 2 N (3) Если log 2 N не является целым числом, то его надо округлить в большую сторону или найти такое значение log 2 N~ , где N~– ближайшая целая степень 2, N~ > N. Информационный объем сообщения, выраженный в битах, и минимальное количество разрядов, необходимое для записи сообщения в двоичном алфавите, совпадают. С помощью n двоичных разрядов можно закодировать двоичным кодом все элементы множества, мощность которого равна 2 n. Информационный объём одного символа алфавита, обозначающего элемент данного множества равен n. 1 символ = 8 бит = 1 байт. В международном стандарте Unicode: 1 символ = 16 бит = 2 байта.

Пример 1. Слово «информатика» содержит 11 символов, и в кодировке ASCII будет иметь информационный объём, равный 88 бит, т. е. 11 байт, а в кодировке Unicode – 176 бит, т. е. 22 байта. Пример 2. Табло состоит из светодиодов, каждый из которых может находиться в двух состояниях (горит, не горит). Какое наименьшее количество светодиодов необходимо, чтобы табло смогло отобразить 130 различных сигналов? Решение. Мощность алфавита равна 130. Количество символов в сообщении равно 1. По формуле (1) находим I = log 2130. Так как число 130 не является целой степенью числа 2, то значение log 2130 необходимо округлить в большую сторону, то есть найти значение log 2 N~ , где N~ – ближайшая целая степень 2, N~ > 130. Следовательно, = 256 = 28 (27 = 128 < 130). Ответ: 8 светодиодов.

Пример 1. Слово «информатика» содержит 11 символов, и в кодировке ASCII будет иметь информационный объём, равный 88 бит, т. е. 11 байт, а в кодировке Unicode – 176 бит, т. е. 22 байта. Пример 2. Табло состоит из светодиодов, каждый из которых может находиться в двух состояниях (горит, не горит). Какое наименьшее количество светодиодов необходимо, чтобы табло смогло отобразить 130 различных сигналов? Решение. Мощность алфавита равна 130. Количество символов в сообщении равно 1. По формуле (1) находим I = log 2130. Так как число 130 не является целой степенью числа 2, то значение log 2130 необходимо округлить в большую сторону, то есть найти значение log 2 N~ , где N~ – ближайшая целая степень 2, N~ > 130. Следовательно, = 256 = 28 (27 = 128 < 130). Ответ: 8 светодиодов.

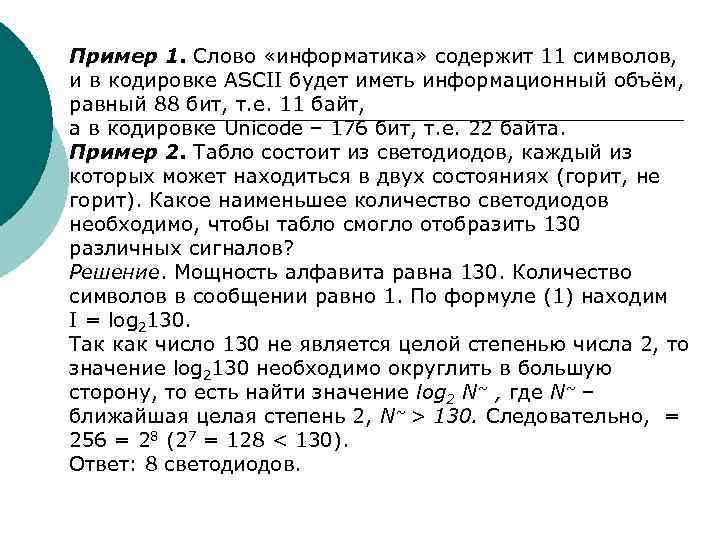

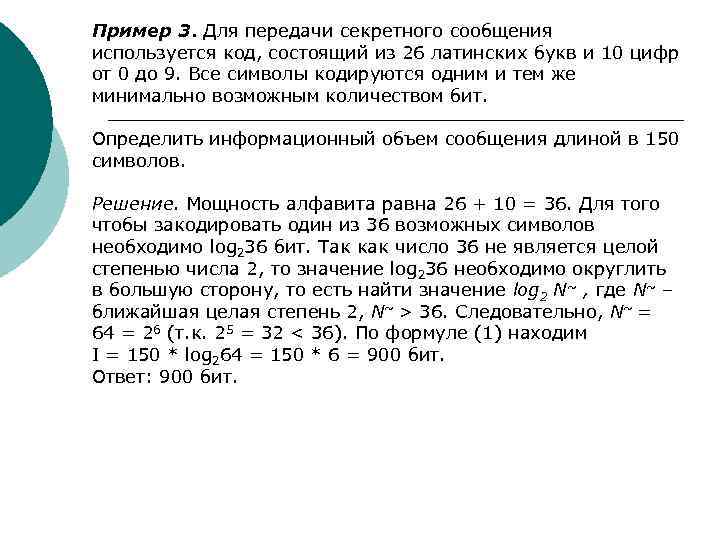

Пример 3. Для передачи секретного сообщения используется код, состоящий из 26 латинских букв и 10 цифр от 0 до 9. Все символы кодируются одним и тем же минимально возможным количеством бит. Определить информационный объем сообщения длиной в 150 символов. Решение. Мощность алфавита равна 26 + 10 = 36. Для того чтобы закодировать один из 36 возможных символов необходимо log 236 бит. Так как число 36 не является целой степенью числа 2, то значение log 236 необходимо округлить в большую сторону, то есть найти значение log 2 N~ , где N~ – ближайшая целая степень 2, N~ > 36. Следовательно, N~ = 64 = 26 (т. к. 25 = 32 < 36). По формуле (1) находим I = 150 * log 264 = 150 * 6 = 900 бит. Ответ: 900 бит.

Пример 3. Для передачи секретного сообщения используется код, состоящий из 26 латинских букв и 10 цифр от 0 до 9. Все символы кодируются одним и тем же минимально возможным количеством бит. Определить информационный объем сообщения длиной в 150 символов. Решение. Мощность алфавита равна 26 + 10 = 36. Для того чтобы закодировать один из 36 возможных символов необходимо log 236 бит. Так как число 36 не является целой степенью числа 2, то значение log 236 необходимо округлить в большую сторону, то есть найти значение log 2 N~ , где N~ – ближайшая целая степень 2, N~ > 36. Следовательно, N~ = 64 = 26 (т. к. 25 = 32 < 36). По формуле (1) находим I = 150 * log 264 = 150 * 6 = 900 бит. Ответ: 900 бит.

Единицы измерения информации ¡ ¡ ¡ ¡ 1 Килобайт (Кбайт) = 1024 байт = 210 байт 1 Мегабайт (Мбайт) = 1024 Кбайт = 210 Кбайт = 220 байт 1 Гигабайт (Гбайт) = 1024 Мбайт = 210 Мбайт 230 байт 1 Терабайт (Тбайт) = 1024 Гбайт = 210 Гбайт = 240 байт 1 Петабайт (Пбайт) = 1024 Тбайт = 210 Тбайт = 250 байт 1 Экзабайт (Эбайт) = 1024 Тбайт = 210 Пбайт = 260 байт 1 Зеттабайт (Збайт) = 1024 Эбайт = 210 Эбайт = 270 байт 1 Йоттабайт (Йбайт) = 1024 Збайт = 210 Збайт = 280 байт

Единицы измерения информации ¡ ¡ ¡ ¡ 1 Килобайт (Кбайт) = 1024 байт = 210 байт 1 Мегабайт (Мбайт) = 1024 Кбайт = 210 Кбайт = 220 байт 1 Гигабайт (Гбайт) = 1024 Мбайт = 210 Мбайт 230 байт 1 Терабайт (Тбайт) = 1024 Гбайт = 210 Гбайт = 240 байт 1 Петабайт (Пбайт) = 1024 Тбайт = 210 Тбайт = 250 байт 1 Экзабайт (Эбайт) = 1024 Тбайт = 210 Пбайт = 260 байт 1 Зеттабайт (Збайт) = 1024 Эбайт = 210 Эбайт = 270 байт 1 Йоттабайт (Йбайт) = 1024 Збайт = 210 Збайт = 280 байт

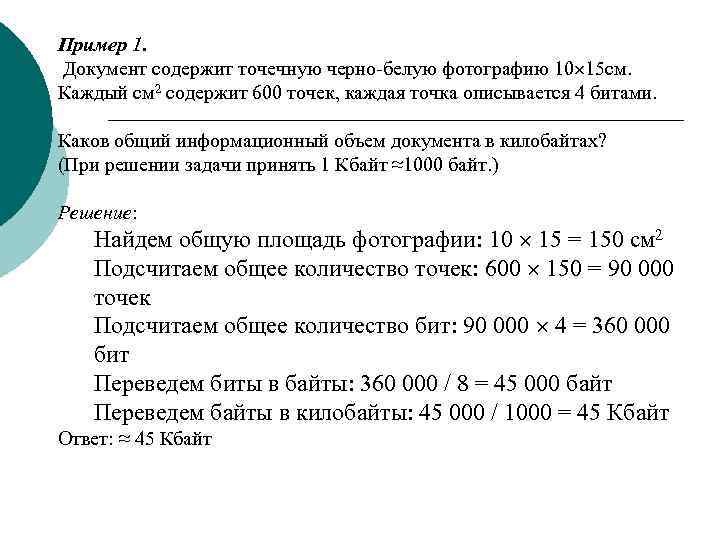

Пример 1. Документ содержит точечную черно-белую фотографию 10 15 см. Каждый см 2 содержит 600 точек, каждая точка описывается 4 битами. Каков общий информационный объем документа в килобайтах? (При решении задачи принять 1 Кбайт ≈1000 байт. ) Решение: Найдем общую площадь фотографии: 10 15 = 150 см 2 Подсчитаем общее количество точек: 600 150 = 90 000 точек Подсчитаем общее количество бит: 90 000 4 = 360 000 бит Переведем биты в байты: 360 000 / 8 = 45 000 байт Переведем байты в килобайты: 45 000 / 1000 = 45 Кбайт Ответ: ≈ 45 Кбайт

Пример 1. Документ содержит точечную черно-белую фотографию 10 15 см. Каждый см 2 содержит 600 точек, каждая точка описывается 4 битами. Каков общий информационный объем документа в килобайтах? (При решении задачи принять 1 Кбайт ≈1000 байт. ) Решение: Найдем общую площадь фотографии: 10 15 = 150 см 2 Подсчитаем общее количество точек: 600 150 = 90 000 точек Подсчитаем общее количество бит: 90 000 4 = 360 000 бит Переведем биты в байты: 360 000 / 8 = 45 000 байт Переведем байты в килобайты: 45 000 / 1000 = 45 Кбайт Ответ: ≈ 45 Кбайт

Пример 2. Для установки на жесткий диск игры требуется 4 Гбайта свободного места. На жестком диске свободно 800 Мбайт. Какое целое количество флэш-карт по 512 Мбайт понадобиться, чтобы освободить недостающее пространство? Решение: Сначала приведем все единицы измерения к одной, например, к гигабайтам. Свободное место на диске: 800 / 1024 ≈ 0, 78 Гбайт Объём флэш-карты: 512 / 1024 = 0, 5 Гбайт Рассчитаем необходимое пространство на диске: 4 Гбайт – 0, 78 Гбайта = 3, 22 Гбайт Подсчитаем необходимое количество флэш-карт: 3, 22 Гбайт / 0, 5 Гбайт = 6, 44 флэш-карты Так как 0, 44 флэш-карты не существует, то целое количество требуемых флэш-карт = 7. Ответ: 7 флэш-карт.

Пример 2. Для установки на жесткий диск игры требуется 4 Гбайта свободного места. На жестком диске свободно 800 Мбайт. Какое целое количество флэш-карт по 512 Мбайт понадобиться, чтобы освободить недостающее пространство? Решение: Сначала приведем все единицы измерения к одной, например, к гигабайтам. Свободное место на диске: 800 / 1024 ≈ 0, 78 Гбайт Объём флэш-карты: 512 / 1024 = 0, 5 Гбайт Рассчитаем необходимое пространство на диске: 4 Гбайт – 0, 78 Гбайта = 3, 22 Гбайт Подсчитаем необходимое количество флэш-карт: 3, 22 Гбайт / 0, 5 Гбайт = 6, 44 флэш-карты Так как 0, 44 флэш-карты не существует, то целое количество требуемых флэш-карт = 7. Ответ: 7 флэш-карт.