3 Лекция_Энтропия объединения.ppt

- Количество слайдов: 13

Энтропия объединения (взаимная энтропия)

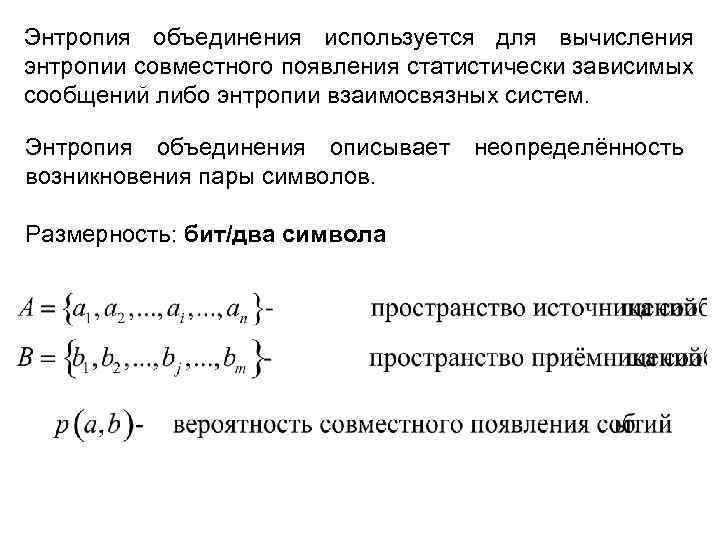

Энтропия объединения используется для вычисления энтропии совместного появления статистически зависимых сообщений либо энтропии взаимосвязных систем. Энтропия объединения описывает возникновения пары символов. Размерность: бит/два символа неопределённость

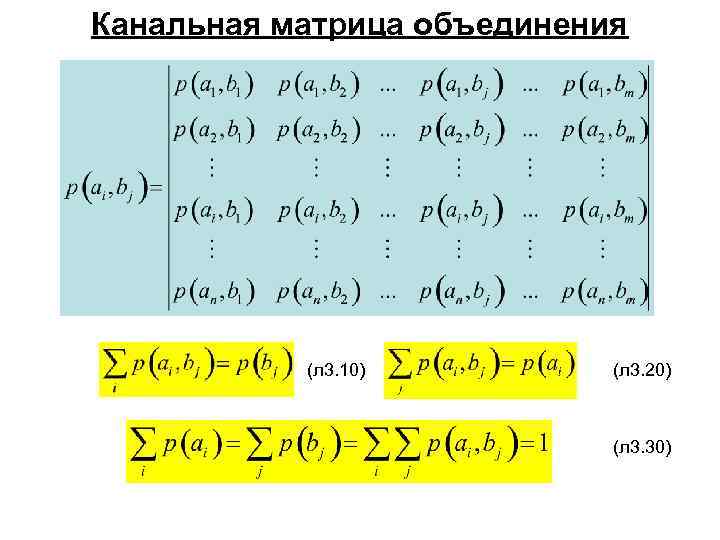

Канальная матрица объединения (л 3. 10) (л 3. 20) (л 3. 30)

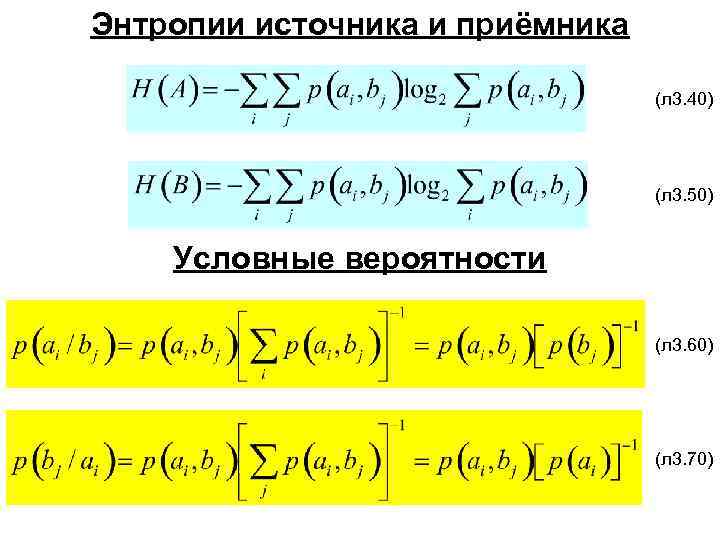

Энтропии источника и приёмника (л 3. 40) (л 3. 50) Условные вероятности (л 3. 60) (л 3. 70)

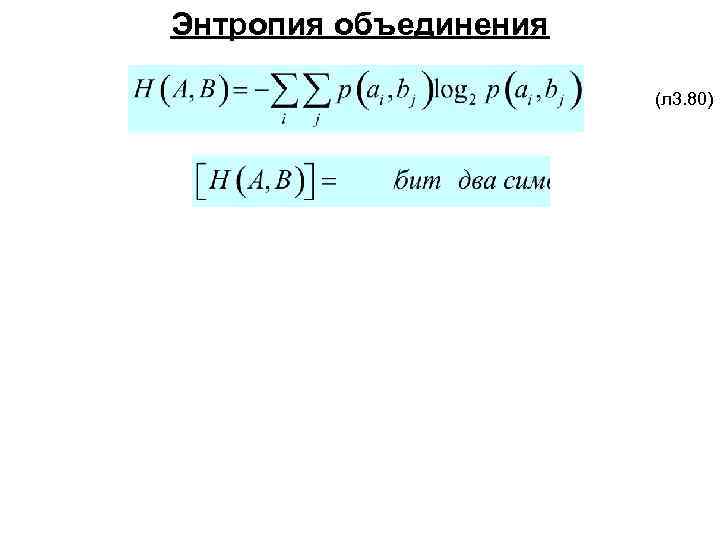

Энтропия объединения (л 3. 80)

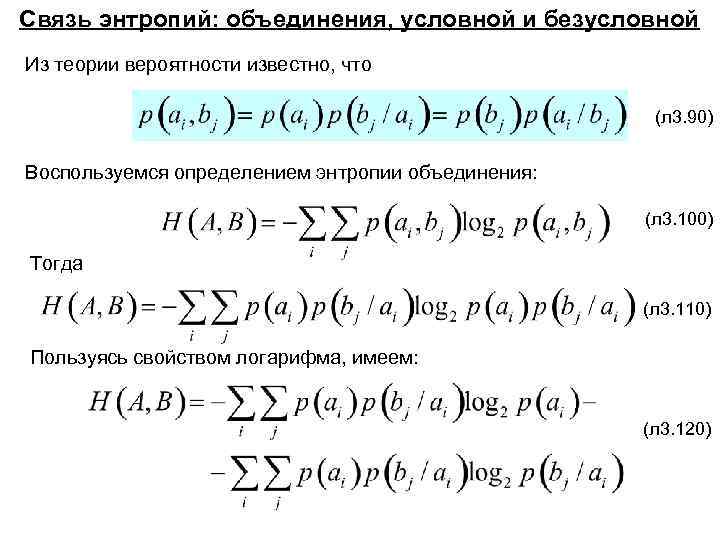

Связь энтропий: объединения, условной и безусловной Из теории вероятности известно, что (л 3. 90) Воспользуемся определением энтропии объединения: (л 3. 100) Тогда (л 3. 110) Пользуясь свойством логарифма, имеем: (л 3. 120)

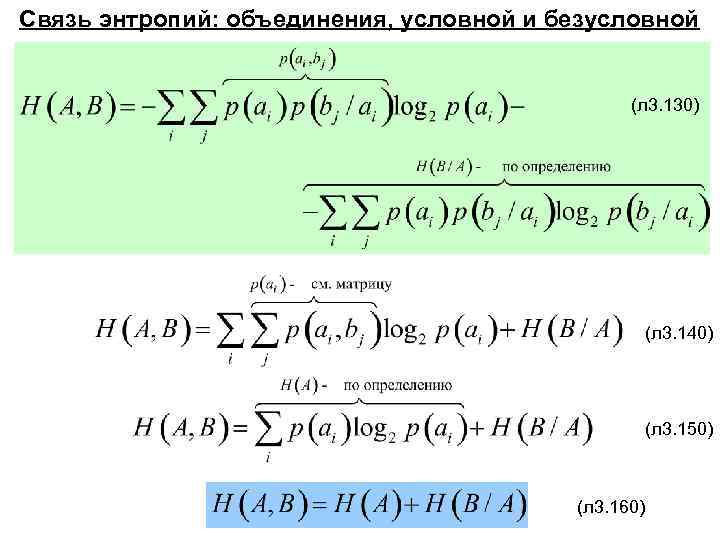

Связь энтропий: объединения, условной и безусловной (л 3. 130) (л 3. 140) (л 3. 150) (л 3. 160)

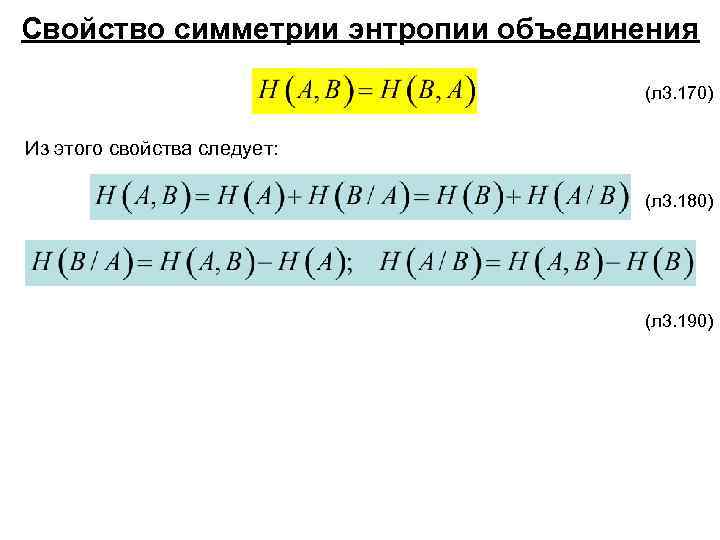

Свойство симметрии энтропии объединения (л 3. 170) Из этого свойства следует: (л 3. 180) (л 3. 190)

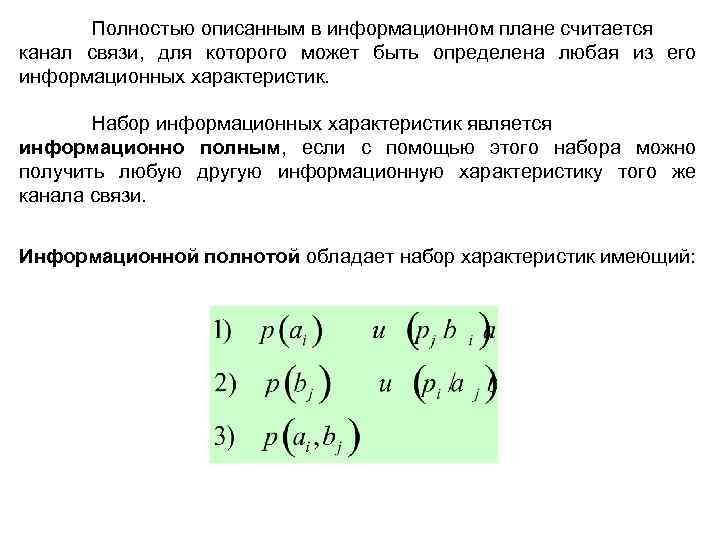

Полностью описанным в информационном плане считается канал связи, для которого может быть определена любая из его информационных характеристик. Набор информационных характеристик является информационно полным, если с помощью этого набора можно получить любую другую информационную характеристику того же канала связи. Информационной полнотой обладает набор характеристик имеющий:

Пример Задана матрица вероятности системы, состоящей из двух систем Необходимо найти: 1) Безусловную энтропию системы A. 2) Безусловную энтропию системы B. 3) Полные условные энтропии H(B/A), H(A/B). 4) Взаимную энтропию.

1)

3)

4)

3 Лекция_Энтропия объединения.ppt