Элементы линейного регрессионного анализа.ppt

- Количество слайдов: 27

Элементы линейного регрессионного и корреляционного анализа

Элементы линейного регрессионного и корреляционного анализа

План лекции: 1. Функциональная, статистическая и корреляционная зависимость. 2. Система случайных величин. Её функция распределения и плотность распределения вероятности. 3. Коэффициент корреляции. 4. Парная линейная регрессия.

План лекции: 1. Функциональная, статистическая и корреляционная зависимость. 2. Система случайных величин. Её функция распределения и плотность распределения вероятности. 3. Коэффициент корреляции. 4. Парная линейная регрессия.

Функциональная, статистическая и корреляционная зависимость Одной из основных задач математической статистики является исследование зависимости между двумя или несколькими переменными. Две переменные X и У могут быть независимыми или связанными функциональной или статистической зависимостью. Строгая функциональная зависимость реализуется редко, так как хотя бы одна из них подвержена случайным факторам. Пример: Зависимость между переменными задана таблицей: Х 1 4 У 5 8 На основе линейного интерполирования записать функцию Y=F(x). Статистической зависимостью называется взаимосвязь двух признаков или величин; зависимость, при которой изменение одной из величин влечет за собой изменение распределения другой. Статистическая связь существует в том случае, когда с изменением значения одной из переменных вторая может в определенных пределах принимать любые значения, но ее статистические характеристики изменяются по определенному закону.

Функциональная, статистическая и корреляционная зависимость Одной из основных задач математической статистики является исследование зависимости между двумя или несколькими переменными. Две переменные X и У могут быть независимыми или связанными функциональной или статистической зависимостью. Строгая функциональная зависимость реализуется редко, так как хотя бы одна из них подвержена случайным факторам. Пример: Зависимость между переменными задана таблицей: Х 1 4 У 5 8 На основе линейного интерполирования записать функцию Y=F(x). Статистической зависимостью называется взаимосвязь двух признаков или величин; зависимость, при которой изменение одной из величин влечет за собой изменение распределения другой. Статистическая связь существует в том случае, когда с изменением значения одной из переменных вторая может в определенных пределах принимать любые значения, но ее статистические характеристики изменяются по определенному закону.

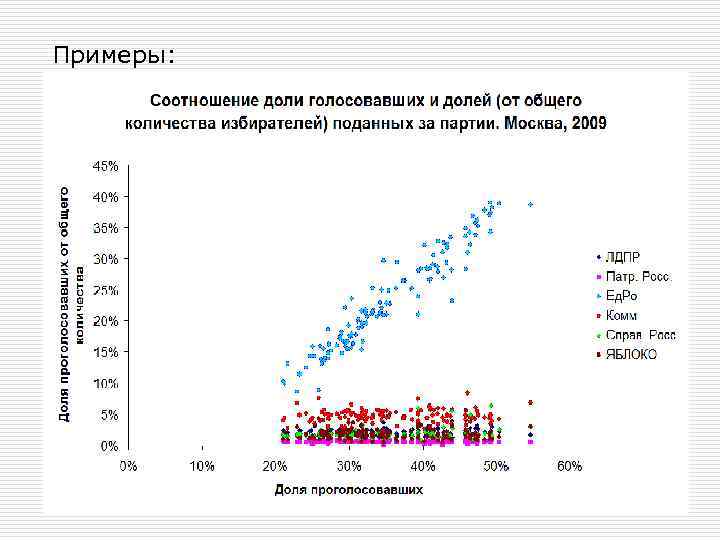

Примеры: o кн

Примеры: o кн

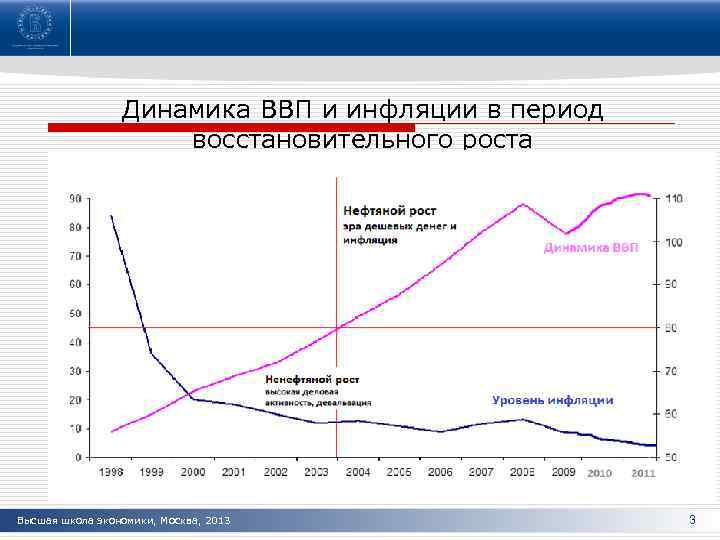

Динамика ВВП и инфляции в период восстановительного роста 1999 -2011 гг. Высшая школа экономики, Москва, 2013 3

Динамика ВВП и инфляции в период восстановительного роста 1999 -2011 гг. Высшая школа экономики, Москва, 2013 3

Важнейший частный случай статистической связи – корреляционная связь. Если при изменении одной из величин изменяется среднее значение другой, то в этом случае статистическую зависимость называют корреляционной. Пример: при увеличении высоты сосен в среднем растет и диаметр их стволов; однако сосны заданной высоты (например, 23 м) имеют распределение диаметров с довольно большим рассеянием. Если в среднем 23 -метровые сосны толще 22 -метровых, то для отдельных сосен это соотношение может заметным образом нарушаться.

Важнейший частный случай статистической связи – корреляционная связь. Если при изменении одной из величин изменяется среднее значение другой, то в этом случае статистическую зависимость называют корреляционной. Пример: при увеличении высоты сосен в среднем растет и диаметр их стволов; однако сосны заданной высоты (например, 23 м) имеют распределение диаметров с довольно большим рассеянием. Если в среднем 23 -метровые сосны толще 22 -метровых, то для отдельных сосен это соотношение может заметным образом нарушаться.

o Впервые в научный оборот термин «корреляция» ввёл французский палеонтолог Жорж Кювье в XVIII веке. Он разработал «закон корреляции» частей и органов живых существ, с помощью которого можно восстановить облик ископаемого животного, имея в распоряжении лишь часть его останков. o В статистике слово «корреляция» первым стал использовать английский биолог и статистик Фрэнсис Гальтон в конце XIX века.

o Впервые в научный оборот термин «корреляция» ввёл французский палеонтолог Жорж Кювье в XVIII веке. Он разработал «закон корреляции» частей и органов живых существ, с помощью которого можно восстановить облик ископаемого животного, имея в распоряжении лишь часть его останков. o В статистике слово «корреляция» первым стал использовать английский биолог и статистик Фрэнсис Гальтон в конце XIX века.

Цель изучения зависимостей между случайными величинами: прогнозирование с данной вероятностью области значений одной случайной величины на основании наблюдаемых значений другой случайной величины. Связь между переменными рассматривают регрессия и корреляция. Они изучают, связана ли одна переменная с одной или несколькими другими. Регрессия – это метод определения математической зависимости между связанными переменными, корреляция – метод измерения силы этой взаимосвязи. Или иначе, регрессия показывает, имеется ли связь, корреляция показывает, насколько это связь сильна и заслуживает ли эта связь того, чтобы ее использовать.

Цель изучения зависимостей между случайными величинами: прогнозирование с данной вероятностью области значений одной случайной величины на основании наблюдаемых значений другой случайной величины. Связь между переменными рассматривают регрессия и корреляция. Они изучают, связана ли одна переменная с одной или несколькими другими. Регрессия – это метод определения математической зависимости между связанными переменными, корреляция – метод измерения силы этой взаимосвязи. Или иначе, регрессия показывает, имеется ли связь, корреляция показывает, насколько это связь сильна и заслуживает ли эта связь того, чтобы ее использовать.

Пример: Рассмотрим компанию, которая исследуют связь между объемами продаж одного из ее продуктов и количеством денег, потраченных на рекламу этого продукта. o Цель – либо это предсказание объемов будущих продаж, либо это оценивание эффективности рекламной компании. o Регрессия и корреляция основывается на данных, которые уже были когда-то получены, и поэтому первый наш шаг – это сбор этих данных из каких-то записей, источников (квартальные объемы продаж и затраты на рекламу).

Пример: Рассмотрим компанию, которая исследуют связь между объемами продаж одного из ее продуктов и количеством денег, потраченных на рекламу этого продукта. o Цель – либо это предсказание объемов будущих продаж, либо это оценивание эффективности рекламной компании. o Регрессия и корреляция основывается на данных, которые уже были когда-то получены, и поэтому первый наш шаг – это сбор этих данных из каких-то записей, источников (квартальные объемы продаж и затраты на рекламу).

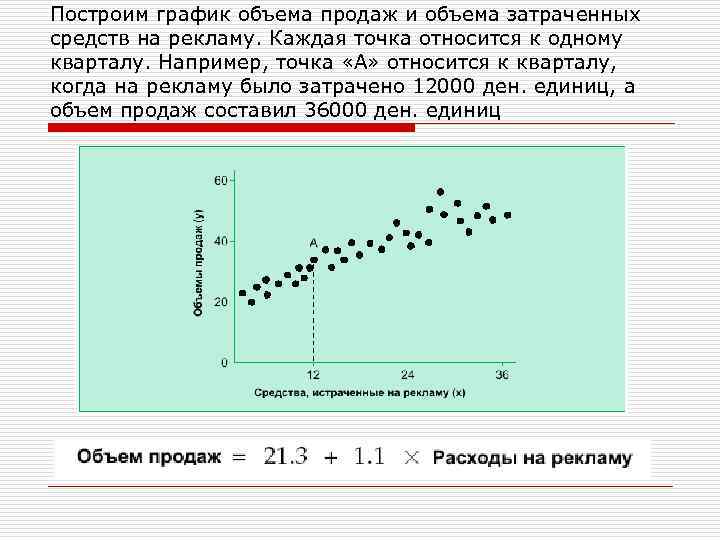

Построим график объема продаж и объема затраченных средств на рекламу. Каждая точка относится к одному кварталу. Например, точка «А» относится к кварталу, когда на рекламу было затрачено 12000 ден. единиц, а объем продаж составил 36000 ден. единиц

Построим график объема продаж и объема затраченных средств на рекламу. Каждая точка относится к одному кварталу. Например, точка «А» относится к кварталу, когда на рекламу было затрачено 12000 ден. единиц, а объем продаж составил 36000 ден. единиц

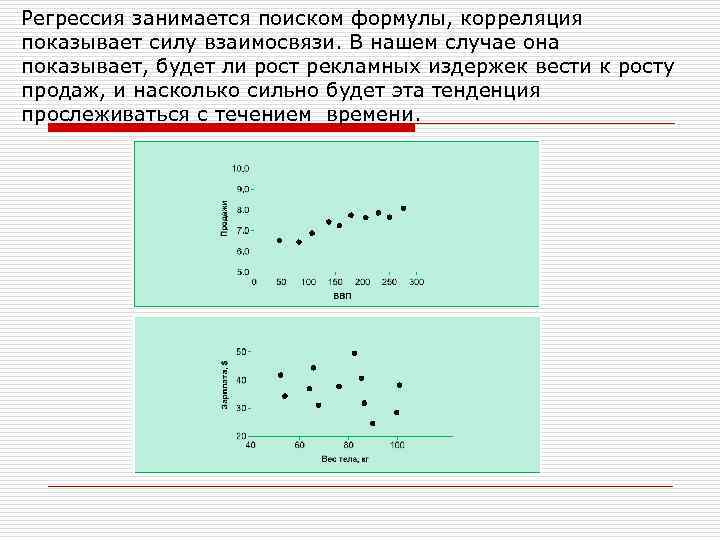

Регрессия занимается поиском формулы, корреляция показывает силу взаимосвязи. В нашем случае она показывает, будет ли рост рекламных издержек вести к росту продаж, и насколько сильно будет эта тенденция прослеживаться с течением времени.

Регрессия занимается поиском формулы, корреляция показывает силу взаимосвязи. В нашем случае она показывает, будет ли рост рекламных издержек вести к росту продаж, и насколько сильно будет эта тенденция прослеживаться с течением времени.

В статистике принято различать следующие виды зависимости: 1. 2. 3. o Парная корреляция – связь между 2 мя признаками результативным и факторным, либо между двумя факторными. Частная корреляция – зависимость между результативным и одним факторным признаком при фиксированном значении другого факторного признака. Множественная корреляция – зависимость результативного признака от двух и более факторных признаков включенных в исследование. Задачей корреляционного анализа является количественная оценка тесноты связи между признаками. В конце 19 века Гальтон и Пирсон исследовали зависимость между ростом отцов и детей.

В статистике принято различать следующие виды зависимости: 1. 2. 3. o Парная корреляция – связь между 2 мя признаками результативным и факторным, либо между двумя факторными. Частная корреляция – зависимость между результативным и одним факторным признаком при фиксированном значении другого факторного признака. Множественная корреляция – зависимость результативного признака от двух и более факторных признаков включенных в исследование. Задачей корреляционного анализа является количественная оценка тесноты связи между признаками. В конце 19 века Гальтон и Пирсон исследовали зависимость между ростом отцов и детей.

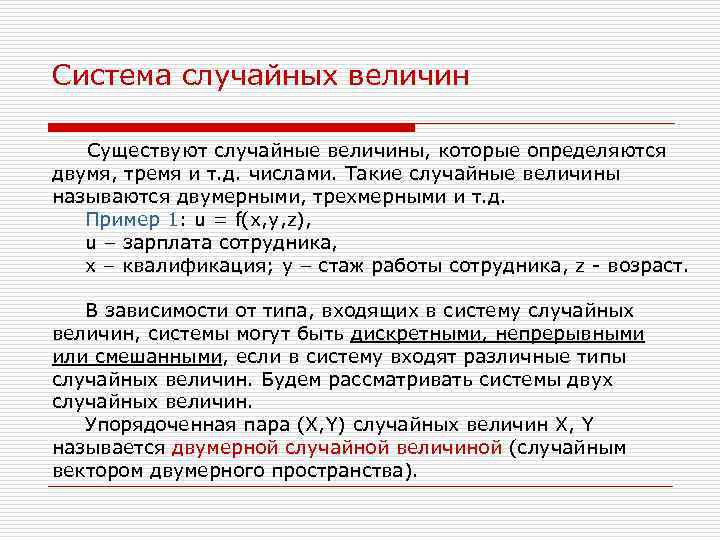

Система случайных величин Существуют случайные величины, которые определяются двумя, тремя и т. д. числами. Такие случайные величины называются двумерными, трехмерными и т. д. Пример 1: u = f(x, y, z), u – зарплата сотрудника, x – квалификация; y – стаж работы сотрудника, z - возраст. В зависимости от типа, входящих в систему случайных величин, системы могут быть дискретными, непрерывными или смешанными, если в систему входят различные типы случайных величин. Будем рассматривать системы двух случайных величин. Упорядоченная пара (Х, Y) случайных величин Х, Y называется двумерной случайной величиной (случайным вектором двумерного пространства).

Система случайных величин Существуют случайные величины, которые определяются двумя, тремя и т. д. числами. Такие случайные величины называются двумерными, трехмерными и т. д. Пример 1: u = f(x, y, z), u – зарплата сотрудника, x – квалификация; y – стаж работы сотрудника, z - возраст. В зависимости от типа, входящих в систему случайных величин, системы могут быть дискретными, непрерывными или смешанными, если в систему входят различные типы случайных величин. Будем рассматривать системы двух случайных величин. Упорядоченная пара (Х, Y) случайных величин Х, Y называется двумерной случайной величиной (случайным вектором двумерного пространства).

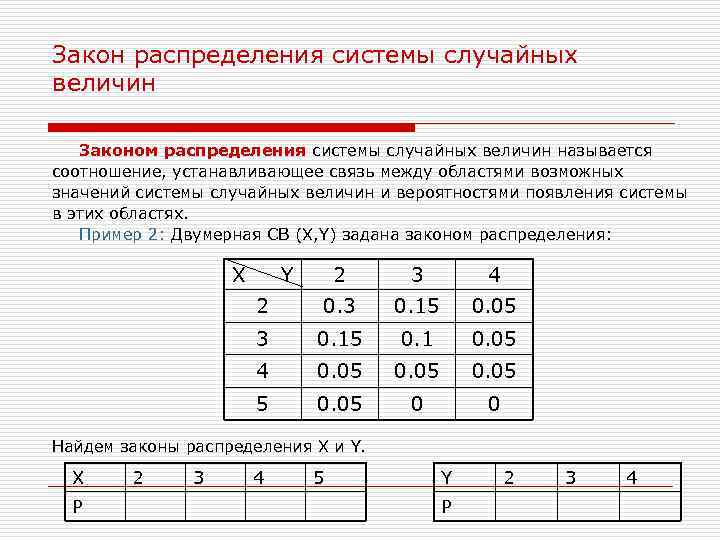

Закон распределения системы случайных величин Законом распределения системы случайных величин называется соотношение, устанавливающее связь между областями возможных значений системы случайных величин и вероятностями появления системы в этих областях. Пример 2: Двумерная СВ (Х, Y) задана законом распределения: Х Y 2 3 4 2 0. 3 0. 15 0. 05 3 0. 15 0. 1 0. 05 4 0. 05 5 0. 05 0 0 Найдем законы распределения Х и Y. Х Р 2 3 4 5 Y Р 2 3 4

Закон распределения системы случайных величин Законом распределения системы случайных величин называется соотношение, устанавливающее связь между областями возможных значений системы случайных величин и вероятностями появления системы в этих областях. Пример 2: Двумерная СВ (Х, Y) задана законом распределения: Х Y 2 3 4 2 0. 3 0. 15 0. 05 3 0. 15 0. 1 0. 05 4 0. 05 5 0. 05 0 0 Найдем законы распределения Х и Y. Х Р 2 3 4 5 Y Р 2 3 4

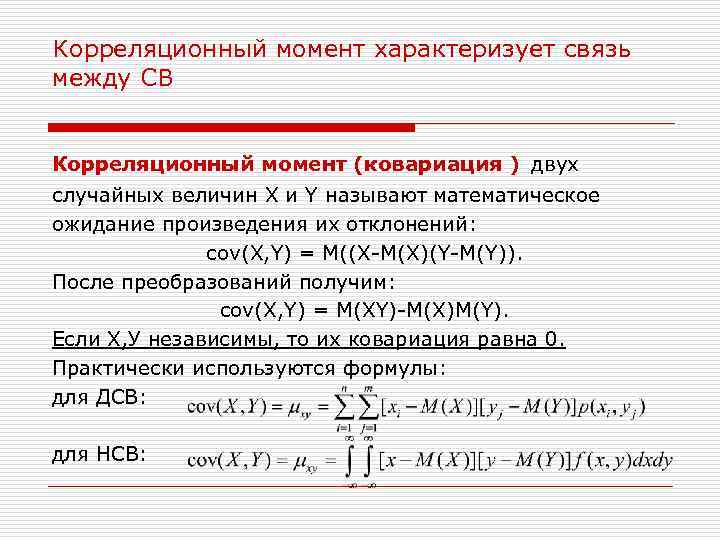

Корреляционный момент характеризует связь между СВ Корреляционный момент (ковариация ) двух случайных величин Х и Y называют математическое ожидание произведения их отклонений: cov(X, Y) = M((X-M(X)(Y-M(Y)). После преобразований получим: cov(X, Y) = M(XY)-M(X)M(Y). Если Х, У независимы, то их ковариация равна 0. Практически используются формулы: для ДСВ: для НСВ:

Корреляционный момент характеризует связь между СВ Корреляционный момент (ковариация ) двух случайных величин Х и Y называют математическое ожидание произведения их отклонений: cov(X, Y) = M((X-M(X)(Y-M(Y)). После преобразований получим: cov(X, Y) = M(XY)-M(X)M(Y). Если Х, У независимы, то их ковариация равна 0. Практически используются формулы: для ДСВ: для НСВ:

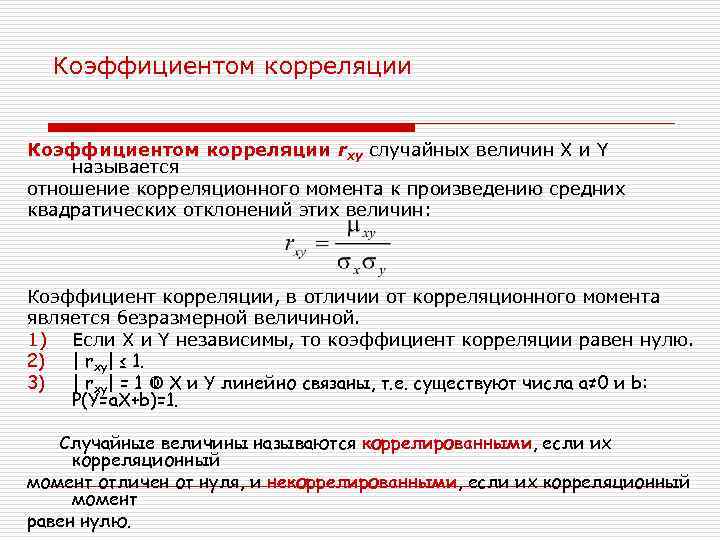

Коэффициентом корреляции rxy случайных величин Х и Y называется отношение корреляционного момента к произведению средних квадратических отклонений этих величин: Коэффициент корреляции, в отличии от корреляционного момента является безразмерной величиной. 1) Если Х и Y независимы, то коэффициент корреляции равен нулю. 2) | rxy| ≤ 1. 3) | rxy| = 1 Х и Y линейно связаны, т. е. существуют числа a≠ 0 и b: Р(Y=a. X+b)=1. Случайные величины называются коррелированными, если их корреляционный момент отличен от нуля, и некоррелированными, если их корреляционный момент равен нулю.

Коэффициентом корреляции rxy случайных величин Х и Y называется отношение корреляционного момента к произведению средних квадратических отклонений этих величин: Коэффициент корреляции, в отличии от корреляционного момента является безразмерной величиной. 1) Если Х и Y независимы, то коэффициент корреляции равен нулю. 2) | rxy| ≤ 1. 3) | rxy| = 1 Х и Y линейно связаны, т. е. существуют числа a≠ 0 и b: Р(Y=a. X+b)=1. Случайные величины называются коррелированными, если их корреляционный момент отличен от нуля, и некоррелированными, если их корреляционный момент равен нулю.

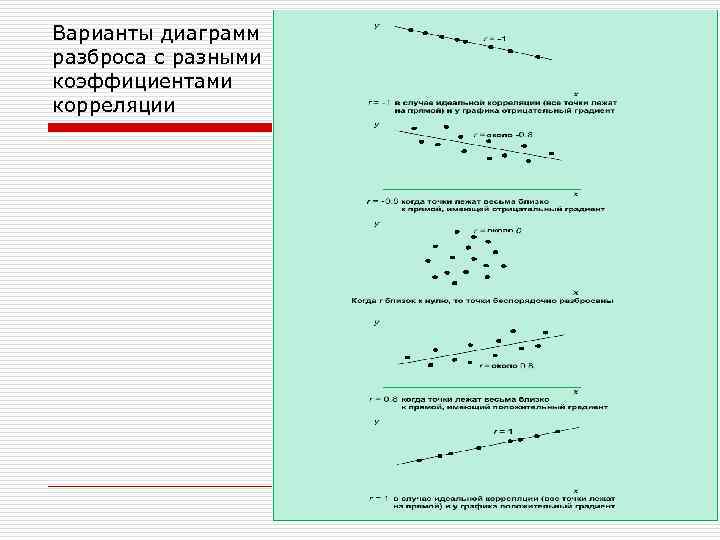

Варианты диаграмм разброса с разными коэффициентами корреляции

Варианты диаграмм разброса с разными коэффициентами корреляции

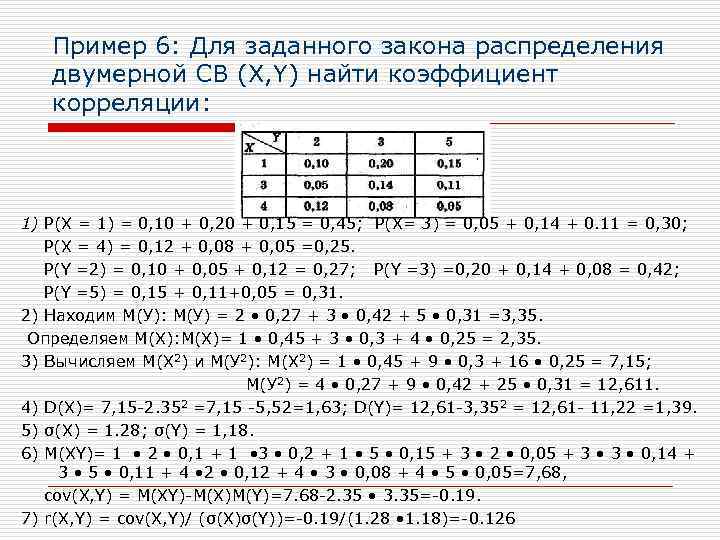

Пример 6: Для заданного закона распределения двумерной СВ (X, Y) найти коэффициент корреляции: 1) Р(Х = 1) = 0, 10 + 0, 20 + 0, 15 = 0, 45; Р(Х= 3) = 0, 05 + 0, 14 + 0. 11 = 0, 30; Р(Х = 4) = 0, 12 + 0, 08 + 0, 05 =0, 25. P(Y =2) = 0, 10 + 0, 05 + 0, 12 = 0, 27; P(Y =3) =0, 20 + 0, 14 + 0, 08 = 0, 42; P(Y =5) = 0, 15 + 0, 11+0, 05 = 0, 31. 2) Находим М(У): М(У) = 2 • 0, 27 + 3 • 0, 42 + 5 • 0, 31 =3, 35. Определяем М(Х): М(Х)= 1 • 0, 45 + 3 • 0, 3 + 4 • 0, 25 = 2, 35. 3) Вычисляем М(Х 2) и М(У 2): М(Х 2) = 1 • 0, 45 + 9 • 0, 3 + 16 • 0, 25 = 7, 15; М(У 2) = 4 • 0, 27 + 9 • 0, 42 + 25 • 0, 31 = 12, 611. 4) D(Х)= 7, 15 -2. 352 =7, 15 -5, 52=1, 63; D(Y)= 12, 61 -3, 352 = 12, 61 - 11, 22 =1, 39. 5) σ(X) = 1. 28; σ(Y) = 1, 18. 6) M(XY)= 1 • 2 • 0, 1 + 1 • 3 • 0, 2 + 1 • 5 • 0, 15 + 3 • 2 • 0, 05 + 3 • 0, 14 + 3 • 5 • 0, 11 + 4 • 2 • 0, 12 + 4 • 3 • 0, 08 + 4 • 5 • 0, 05=7, 68, cov(X, Y) = M(XY)-M(X)M(Y)=7. 68 -2. 35 • 3. 35=-0. 19. 7) r(X, Y) = cov(X, Y)/ (σ(X)σ(Y))=-0. 19/(1. 28 • 1. 18)=-0. 126

Пример 6: Для заданного закона распределения двумерной СВ (X, Y) найти коэффициент корреляции: 1) Р(Х = 1) = 0, 10 + 0, 20 + 0, 15 = 0, 45; Р(Х= 3) = 0, 05 + 0, 14 + 0. 11 = 0, 30; Р(Х = 4) = 0, 12 + 0, 08 + 0, 05 =0, 25. P(Y =2) = 0, 10 + 0, 05 + 0, 12 = 0, 27; P(Y =3) =0, 20 + 0, 14 + 0, 08 = 0, 42; P(Y =5) = 0, 15 + 0, 11+0, 05 = 0, 31. 2) Находим М(У): М(У) = 2 • 0, 27 + 3 • 0, 42 + 5 • 0, 31 =3, 35. Определяем М(Х): М(Х)= 1 • 0, 45 + 3 • 0, 3 + 4 • 0, 25 = 2, 35. 3) Вычисляем М(Х 2) и М(У 2): М(Х 2) = 1 • 0, 45 + 9 • 0, 3 + 16 • 0, 25 = 7, 15; М(У 2) = 4 • 0, 27 + 9 • 0, 42 + 25 • 0, 31 = 12, 611. 4) D(Х)= 7, 15 -2. 352 =7, 15 -5, 52=1, 63; D(Y)= 12, 61 -3, 352 = 12, 61 - 11, 22 =1, 39. 5) σ(X) = 1. 28; σ(Y) = 1, 18. 6) M(XY)= 1 • 2 • 0, 1 + 1 • 3 • 0, 2 + 1 • 5 • 0, 15 + 3 • 2 • 0, 05 + 3 • 0, 14 + 3 • 5 • 0, 11 + 4 • 2 • 0, 12 + 4 • 3 • 0, 08 + 4 • 5 • 0, 05=7, 68, cov(X, Y) = M(XY)-M(X)M(Y)=7. 68 -2. 35 • 3. 35=-0. 19. 7) r(X, Y) = cov(X, Y)/ (σ(X)σ(Y))=-0. 19/(1. 28 • 1. 18)=-0. 126

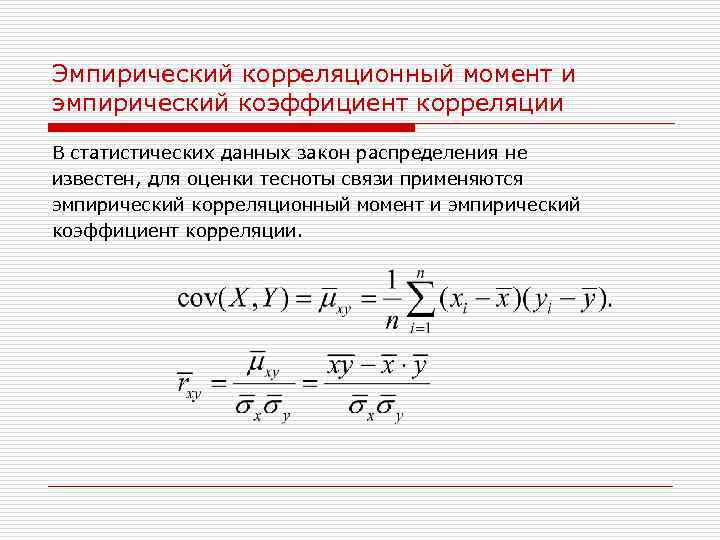

Эмпирический корреляционный момент и эмпирический коэффициент корреляции В статистических данных закон распределения не известен, для оценки тесноты связи применяются эмпирический корреляционный момент и эмпирический коэффициент корреляции.

Эмпирический корреляционный момент и эмпирический коэффициент корреляции В статистических данных закон распределения не известен, для оценки тесноты связи применяются эмпирический корреляционный момент и эмпирический коэффициент корреляции.

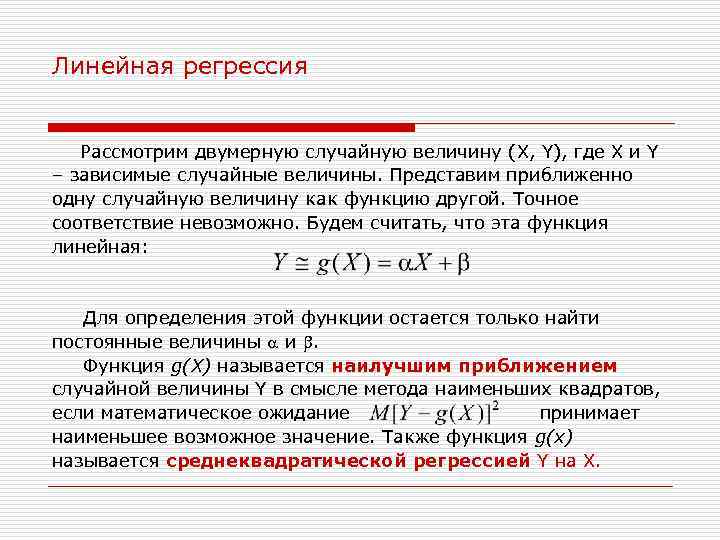

Линейная регрессия Рассмотрим двумерную случайную величину (X, Y), где X и Y – зависимые случайные величины. Представим приближенно одну случайную величину как функцию другой. Точное соответствие невозможно. Будем считать, что эта функция линейная: Для определения этой функции остается только найти постоянные величины и . Функция g(X) называется наилучшим приближением случайной величины Y в смысле метода наименьших квадратов, если математическое ожидание принимает наименьшее возможное значение. Также функция g(x) называется среднеквадратической регрессией Y на X.

Линейная регрессия Рассмотрим двумерную случайную величину (X, Y), где X и Y – зависимые случайные величины. Представим приближенно одну случайную величину как функцию другой. Точное соответствие невозможно. Будем считать, что эта функция линейная: Для определения этой функции остается только найти постоянные величины и . Функция g(X) называется наилучшим приближением случайной величины Y в смысле метода наименьших квадратов, если математическое ожидание принимает наименьшее возможное значение. Также функция g(x) называется среднеквадратической регрессией Y на X.

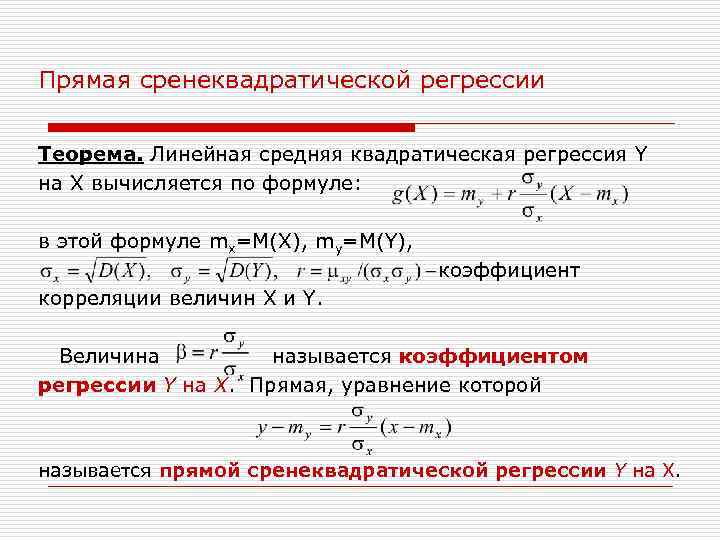

Прямая сренеквадратической регрессии Теорема. Линейная средняя квадратическая регрессия Y на Х вычисляется по формуле: в этой формуле mx=M(X), my=M(Y), коэффициент корреляции величин Х и Y. Величина называется коэффициентом регрессии Y на Х. Прямая, уравнение которой называется прямой сренеквадратической регрессии Y на Х.

Прямая сренеквадратической регрессии Теорема. Линейная средняя квадратическая регрессия Y на Х вычисляется по формуле: в этой формуле mx=M(X), my=M(Y), коэффициент корреляции величин Х и Y. Величина называется коэффициентом регрессии Y на Х. Прямая, уравнение которой называется прямой сренеквадратической регрессии Y на Х.

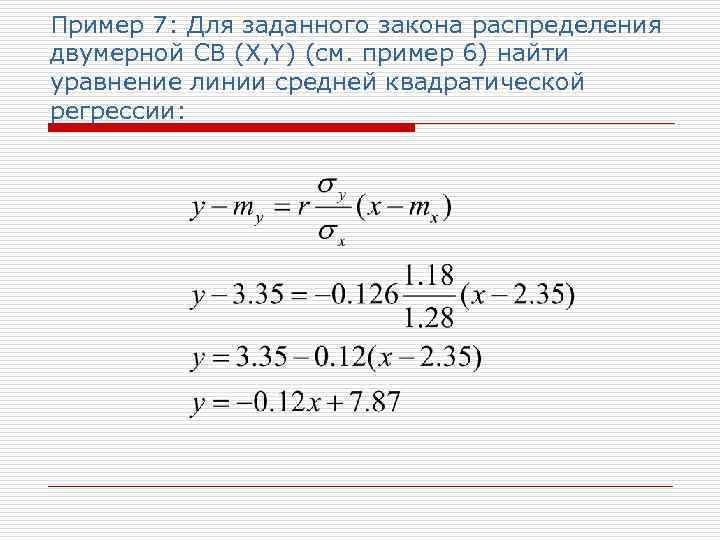

Пример 7: Для заданного закона распределения двумерной СВ (X, Y) (см. пример 6) найти уравнение линии средней квадратической регрессии:

Пример 7: Для заданного закона распределения двумерной СВ (X, Y) (см. пример 6) найти уравнение линии средней квадратической регрессии:

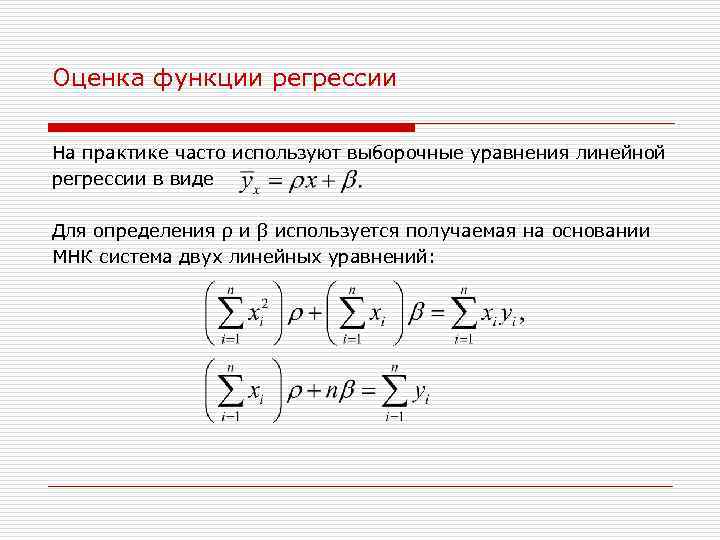

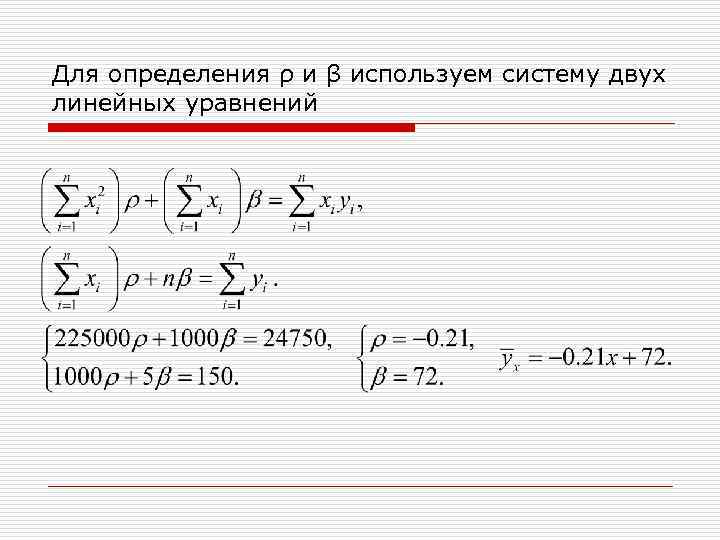

Оценка функции регрессии На практике часто используют выборочные уравнения линейной регрессии в виде Для определения ρ и β используется получаемая на основании МНК система двух линейных уравнений:

Оценка функции регрессии На практике часто используют выборочные уравнения линейной регрессии в виде Для определения ρ и β используется получаемая на основании МНК система двух линейных уравнений:

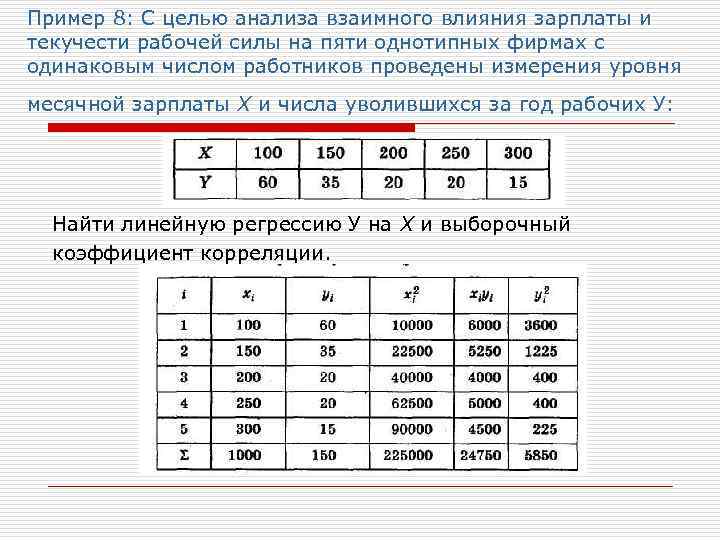

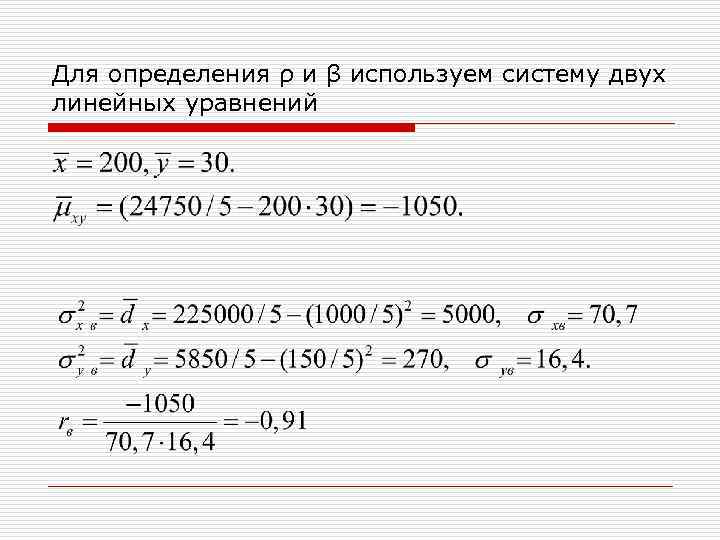

Пример 8: С целью анализа взаимного влияния зарплаты и текучести рабочей силы на пяти однотипных фирмах с одинаковым числом работников проведены измерения уровня месячной зарплаты X и числа уволившихся за год рабочих У: Найти линейную регрессию У на X и выборочный коэффициент корреляции.

Пример 8: С целью анализа взаимного влияния зарплаты и текучести рабочей силы на пяти однотипных фирмах с одинаковым числом работников проведены измерения уровня месячной зарплаты X и числа уволившихся за год рабочих У: Найти линейную регрессию У на X и выборочный коэффициент корреляции.

Для определения ρ и β используем систему двух линейных уравнений

Для определения ρ и β используем систему двух линейных уравнений

Для определения ρ и β используем систему двух линейных уравнений

Для определения ρ и β используем систему двух линейных уравнений

Прогнозный расчет последствий роста экспорта Китая и Индии для мировой торговли (2020 г. к 2005 г. , изменение доли в %; вторая строчка – с учетом повышения качества) Цивилизации и страны Группа товаров Лес Минерал ы Химическа я продукция Металлы Машины и оборудован ие Электроник а 0, 0 -0, 4 -1, 8 -0, 7 -2, 4 -2, 5 +0, 8 -0, 5 -3, 0 -1, 3 -5, 0 -11, 7 -0, 2 +0, 1 +0, 9 -0, 7 -2, 5 -3, 5 +0, 3 +0, 2 +1, 4 -0, 1 -4, 2 -11, 0 +41, 6 +36, 8 +42, 9 +38, 5 +37, 6 +35, 8 +34, 7 +36, 3 +39, 2 +34, 8 +40, 2 +58, 2 -1, 1 -1, 0 -2, 3 -2, 7 -6, 6 -4, 8 -1, 0 0, 6 -1, 4 -1, 9 -9, 0 -10, 7 +39, 8 +30, 7 +30, 6 +33, 9 +29, 2 +30, 7 +32, 1 +33, 9 +33, 1 +34, 0 +41, 5 +36, 5 Бразилия и Аргентина -1, 0 -2, 0 -3, 2 -4, 5 -3, 1 -0, 9 0, 0 -2, 8 -4, 5 -7, 4 -8, 0 Ближний Восток и Северная Африка -0, 7 -0, 5 -5, 8 -6, 6 -8, 3 -7, 2 -0, 7 +0, 3 -5, 9 -6, 5 -12, 9 -15, 9 Бывший СССР -0, 5 -1, 9 +1, 0 -3, 3 -4, 4 -3, 1 +0, 8 -2, 2 -1, 6 -2, 9 -7, 0 ЕС-25+Ассоциация свободной торговли США Китай Япония Индия 27

Прогнозный расчет последствий роста экспорта Китая и Индии для мировой торговли (2020 г. к 2005 г. , изменение доли в %; вторая строчка – с учетом повышения качества) Цивилизации и страны Группа товаров Лес Минерал ы Химическа я продукция Металлы Машины и оборудован ие Электроник а 0, 0 -0, 4 -1, 8 -0, 7 -2, 4 -2, 5 +0, 8 -0, 5 -3, 0 -1, 3 -5, 0 -11, 7 -0, 2 +0, 1 +0, 9 -0, 7 -2, 5 -3, 5 +0, 3 +0, 2 +1, 4 -0, 1 -4, 2 -11, 0 +41, 6 +36, 8 +42, 9 +38, 5 +37, 6 +35, 8 +34, 7 +36, 3 +39, 2 +34, 8 +40, 2 +58, 2 -1, 1 -1, 0 -2, 3 -2, 7 -6, 6 -4, 8 -1, 0 0, 6 -1, 4 -1, 9 -9, 0 -10, 7 +39, 8 +30, 7 +30, 6 +33, 9 +29, 2 +30, 7 +32, 1 +33, 9 +33, 1 +34, 0 +41, 5 +36, 5 Бразилия и Аргентина -1, 0 -2, 0 -3, 2 -4, 5 -3, 1 -0, 9 0, 0 -2, 8 -4, 5 -7, 4 -8, 0 Ближний Восток и Северная Африка -0, 7 -0, 5 -5, 8 -6, 6 -8, 3 -7, 2 -0, 7 +0, 3 -5, 9 -6, 5 -12, 9 -15, 9 Бывший СССР -0, 5 -1, 9 +1, 0 -3, 3 -4, 4 -3, 1 +0, 8 -2, 2 -1, 6 -2, 9 -7, 0 ЕС-25+Ассоциация свободной торговли США Китай Япония Индия 27