Day 1.pptx

- Количество слайдов: 68

Deep learning Caffe Alex Honchar 2015

Бакалавр прикладной математики НТУУ «КПИ» Студент магистратуры Università degli Studi di Verona Customer behavior prediction Анализ данных с мобильных сенсоров Распознавание еды на изображении

DAY 1 • Что такое машинное обучение • Запоминаем пиксели. Алгоритм Nearest Neighbours • Копируем мозги. Искусственный нейрон • Нейронные сети, алгоритм обратного распространения ошибки • Фишки для улучшения обучения нейронных сетей • Домашнее задание

DAY 2 • Как работает человеческий глаз. Рецептивное поле нейрона • Сверточные нейронные сети • Deep learning без программирования. Фреймворк Caffe • Домашнее задание

Машинное обучение

• Основная идея: учим компьютер как ребенка • Сначала учим его на тренировочной выборке • Потом проверяем его знания на тестовой выборке • Стараемся добиться не запоминания, а обобщения

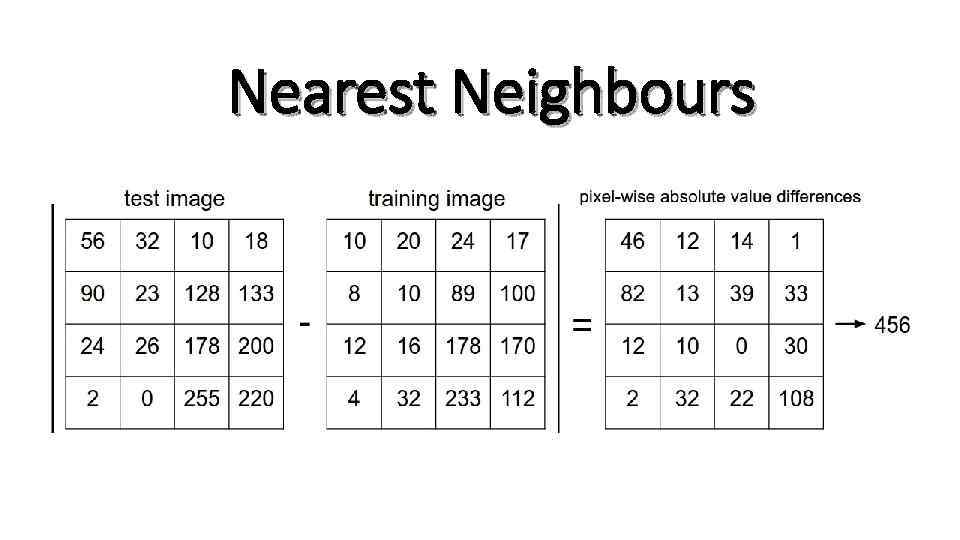

Nearest Neighbours

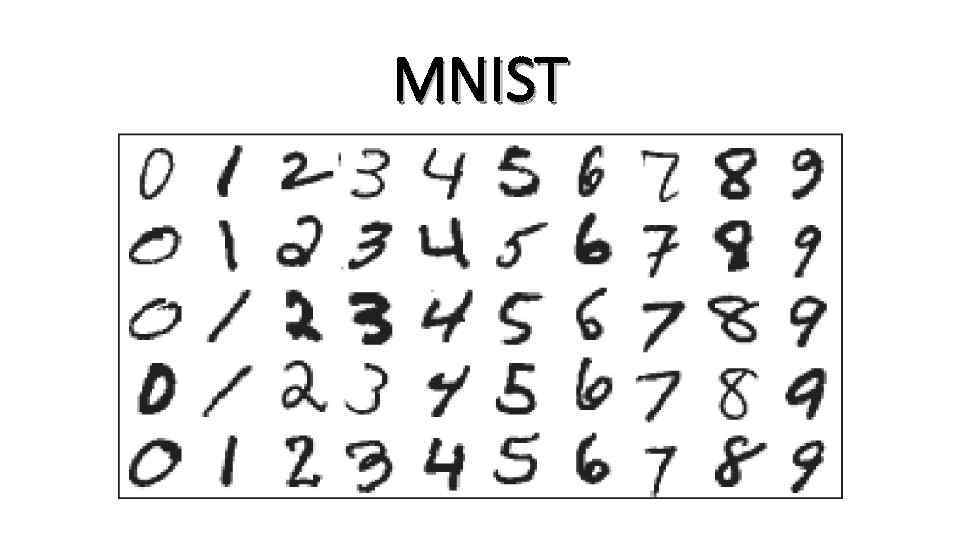

MNIST

![ЧБ: [0, 255] RGB: [0… 255, 0… 255] ЧБ: [0, 255] RGB: [0… 255, 0… 255]](https://present5.com/presentation/20143288_415358496/image-9.jpg)

ЧБ: [0, 255] RGB: [0… 255, 0… 255]

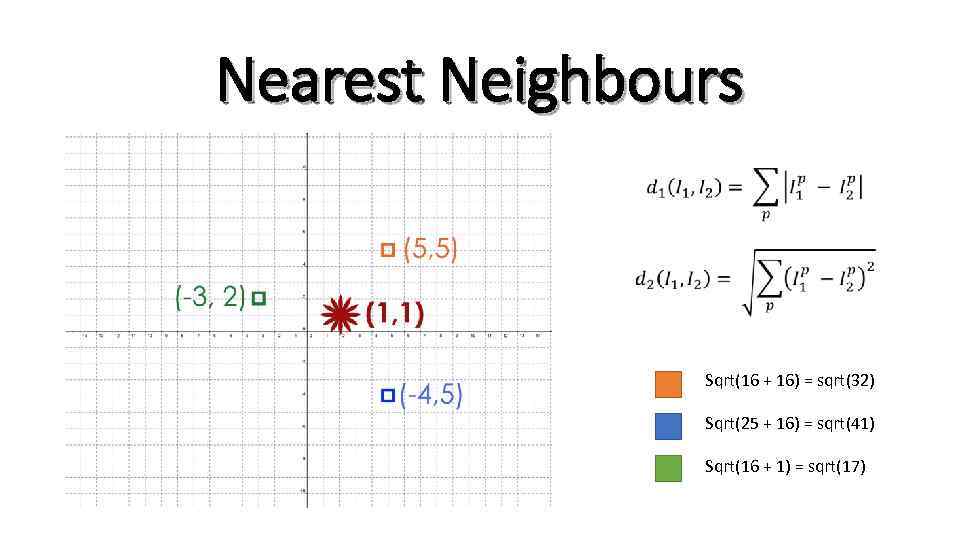

Nearest Neighbours Sqrt(16 + 16) = sqrt(32) Sqrt(25 + 16) = sqrt(41) Sqrt(16 + 1) = sqrt(17)

Nearest Neighbours

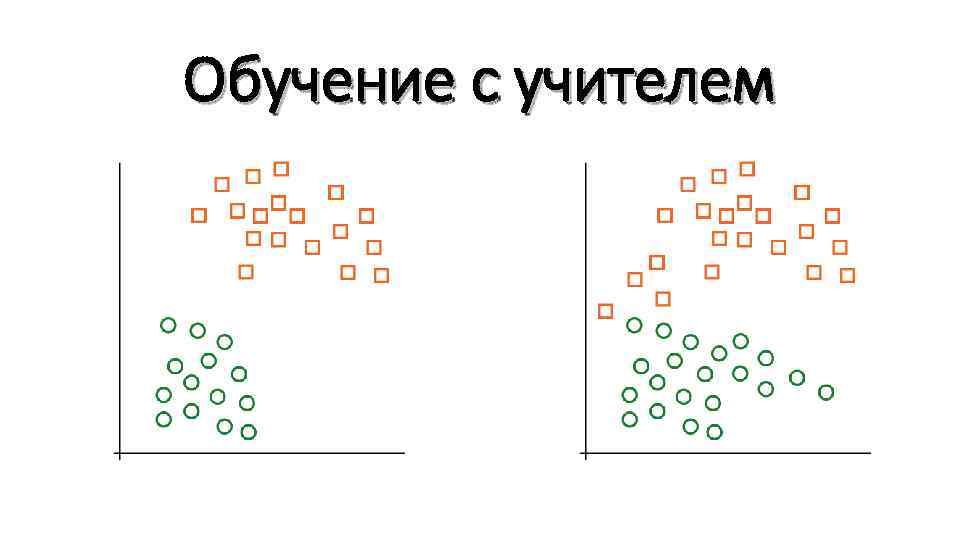

Обучение с учителем

Обучение с учителем

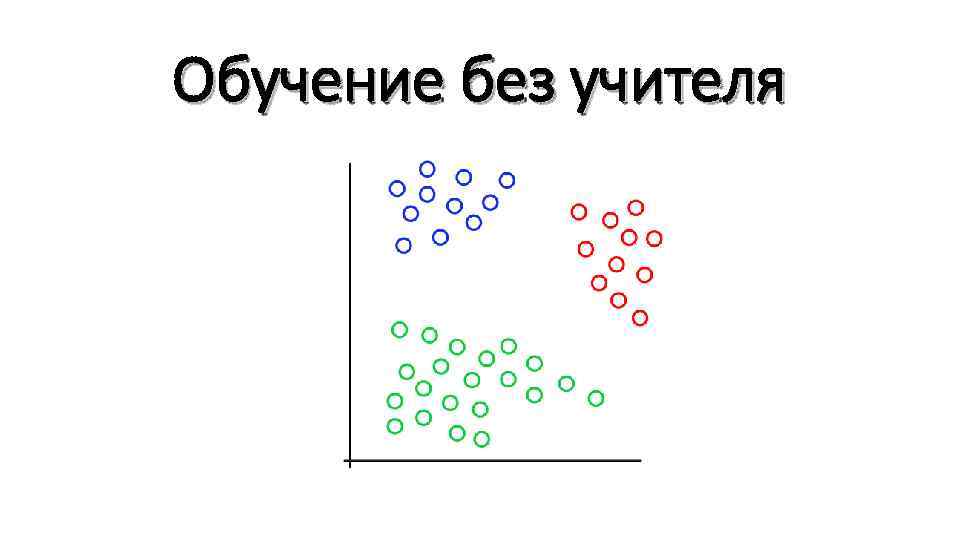

Обучение без учителя

Почему сейчас? • Есть достаточно материала для обучения • Компьютеры достаточно мощны для тяжелых алгоритмов • Традиционные программные парадигмы устаревают • Senior Data Scientist, $128’ 000

3. Artificial neuron

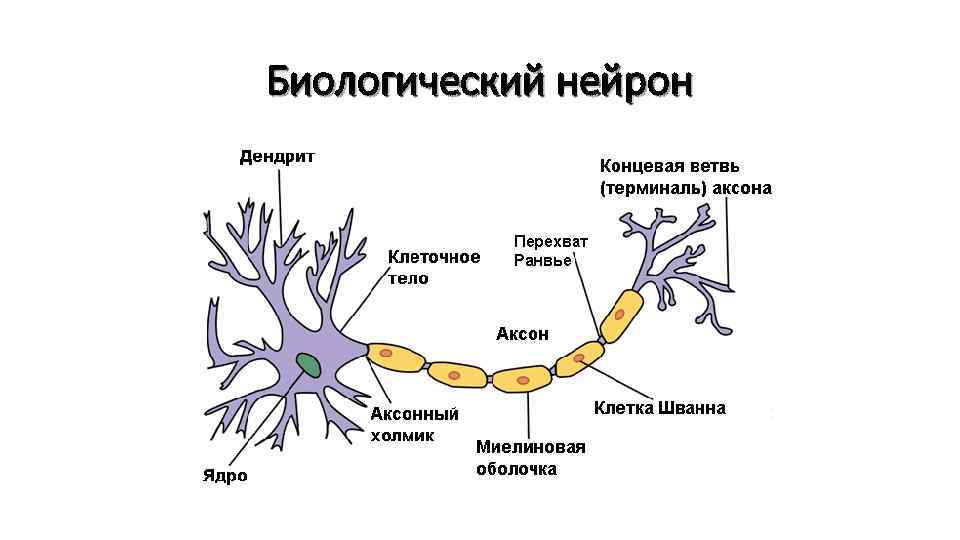

Биологический нейрон

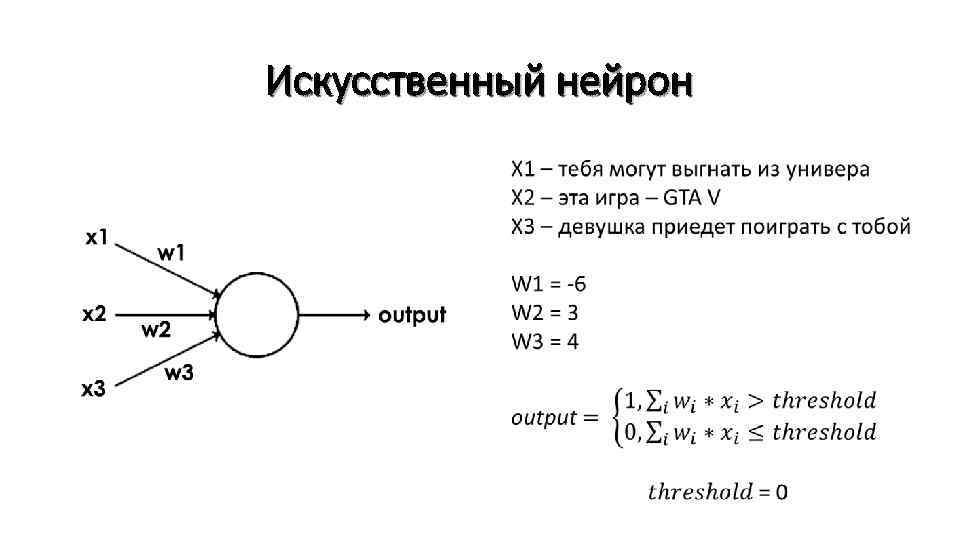

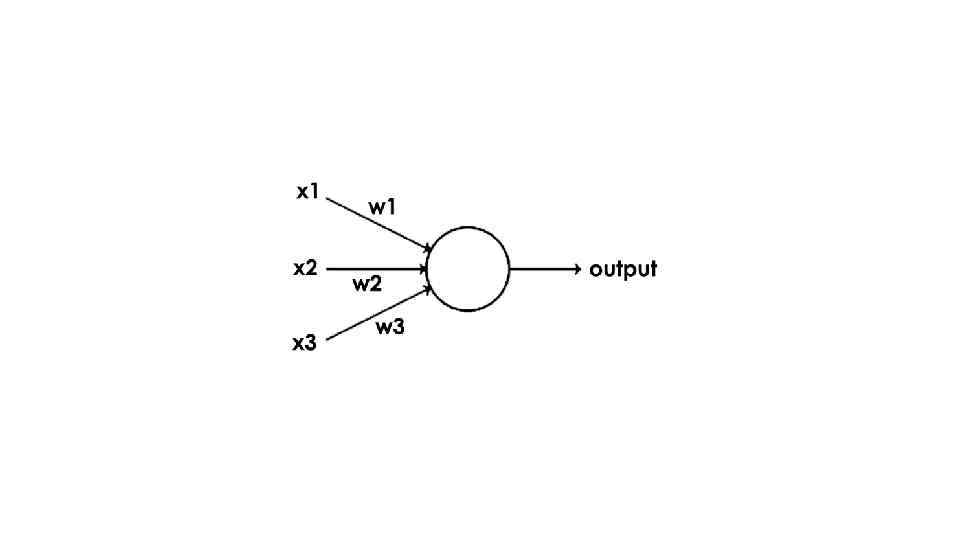

Искусственный нейрон

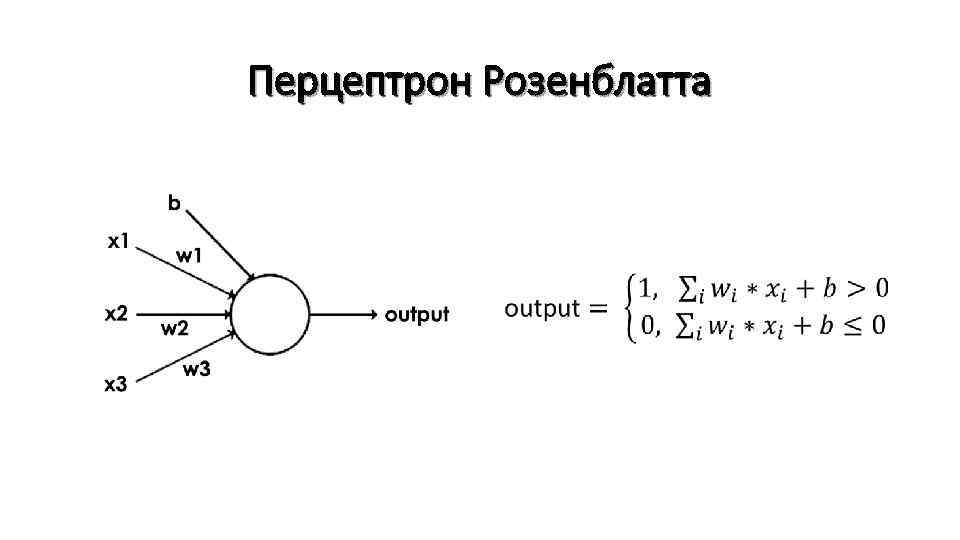

Перцептрон Розенблатта •

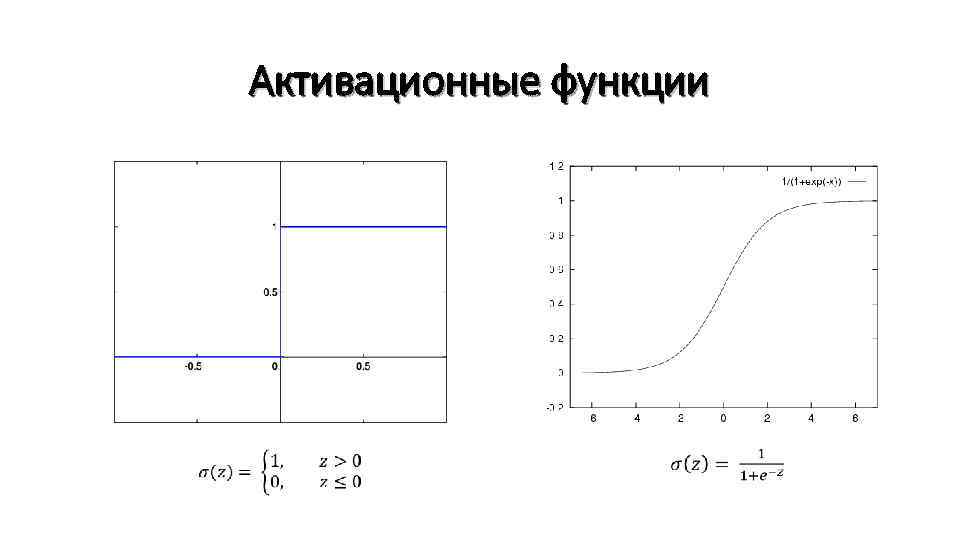

Активационные функции

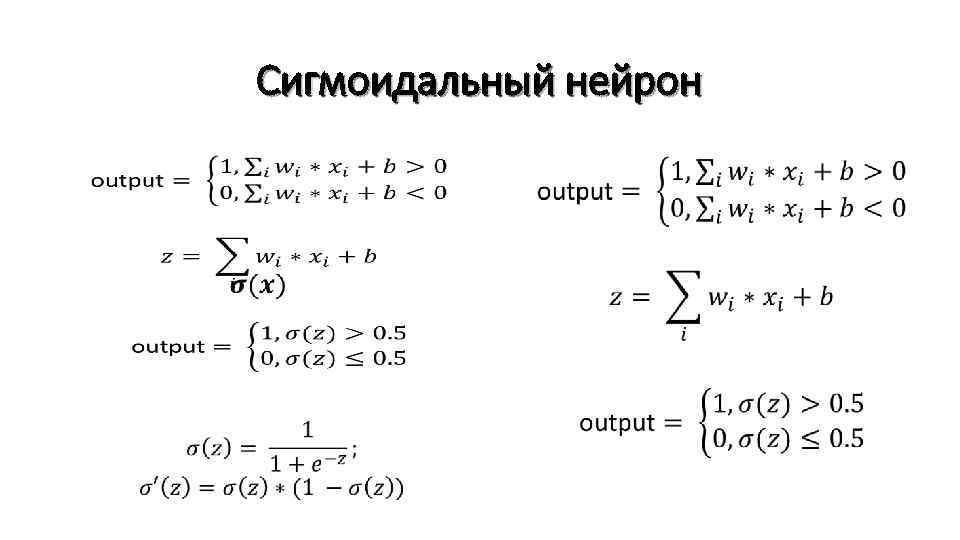

Сигмоидальный нейрон •

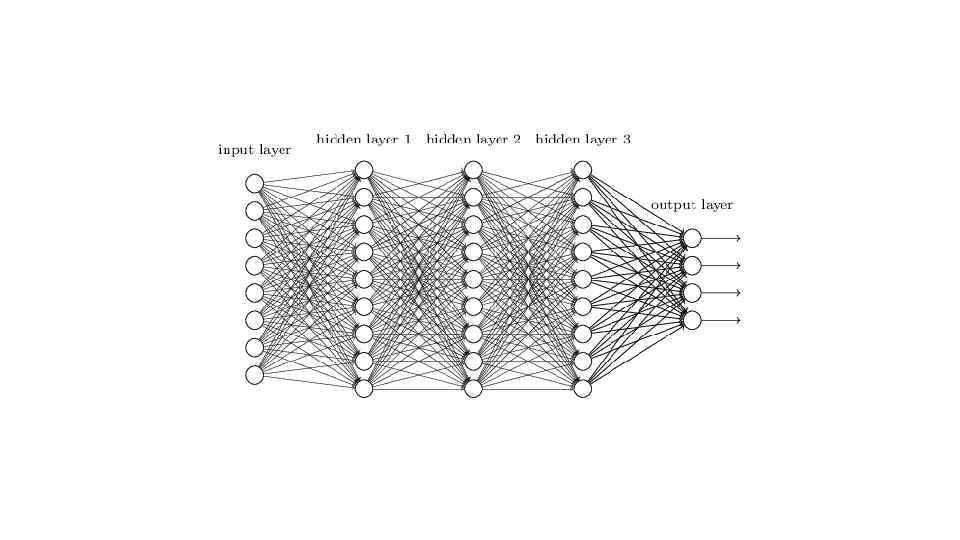

4. Neural Networks

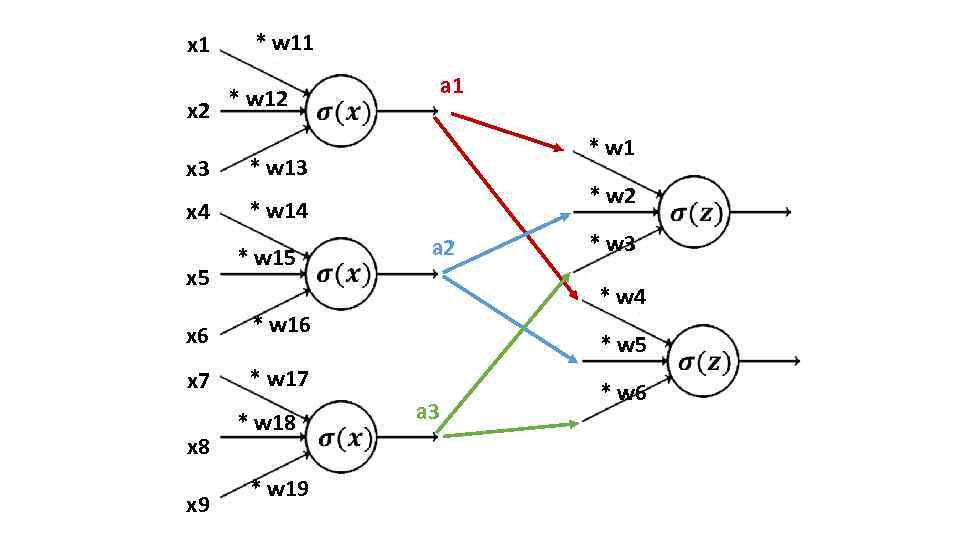

x 1 x 2 * w 11 * w 12 x 3 * w 13 x 4 a 1 * w 14 x 5 * w 15 x 6 a 2 * w 17 x 8 x 9 * w 18 * w 19 * w 3 * w 4 * w 16 x 7 * w 2 * w 5 a 3 * w 6

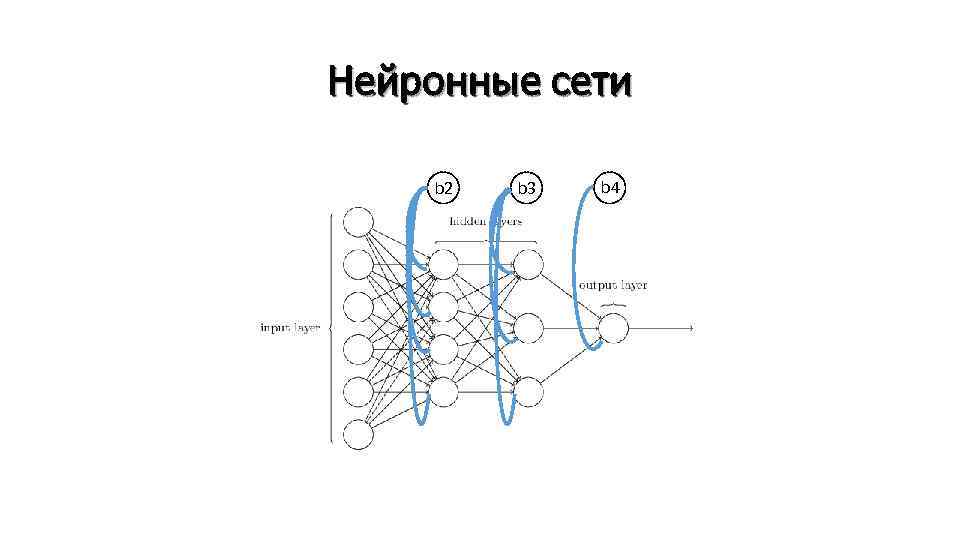

Нейронные сети b 2 b 3 b 4

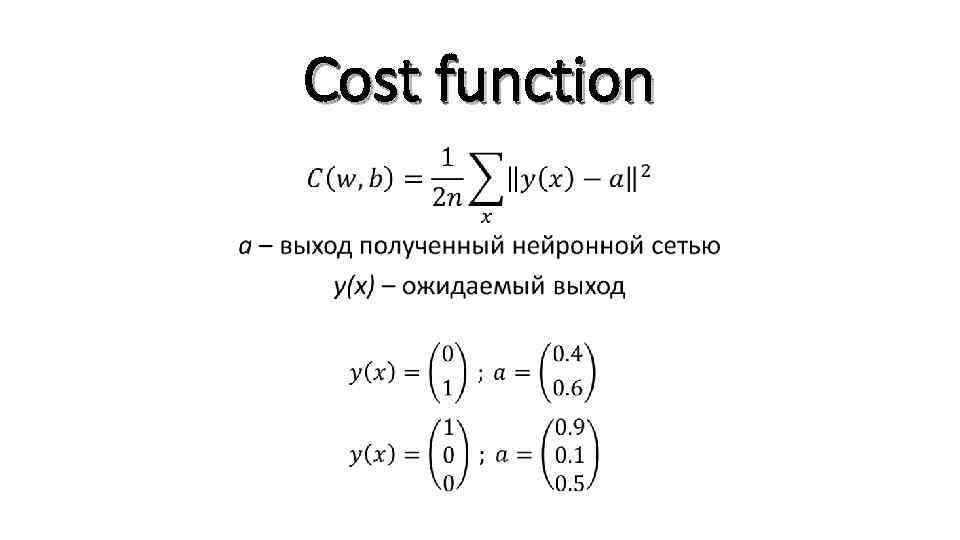

Cost function •

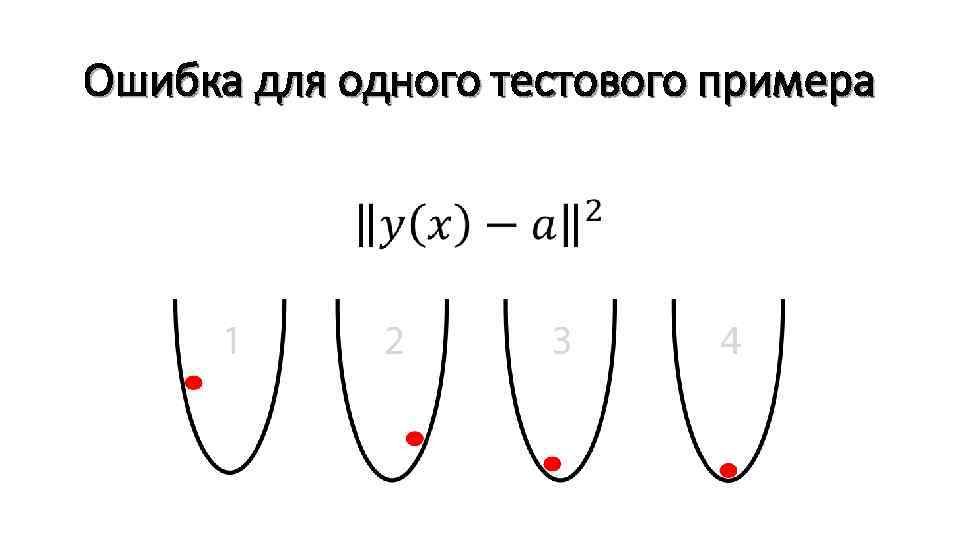

Ошибка для одного тестового примера •

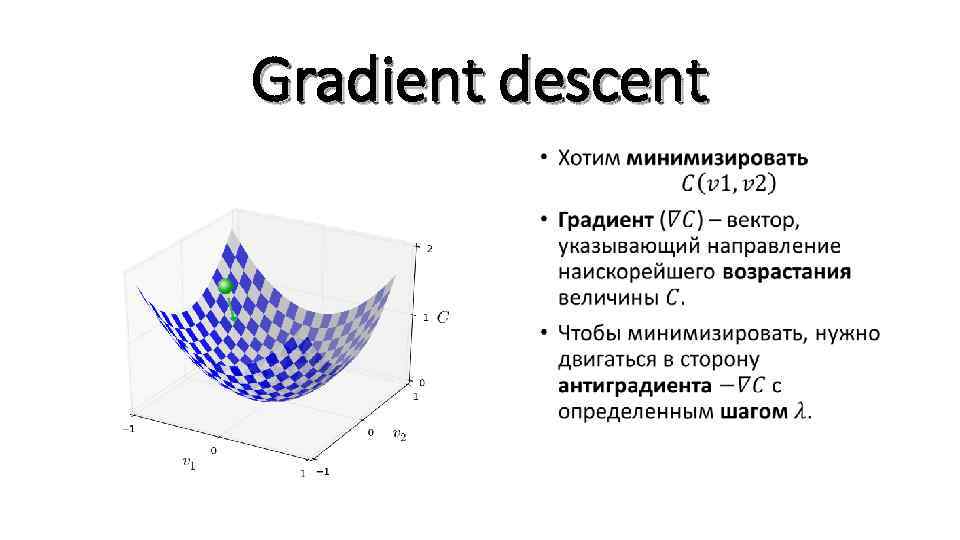

Gradient descent •

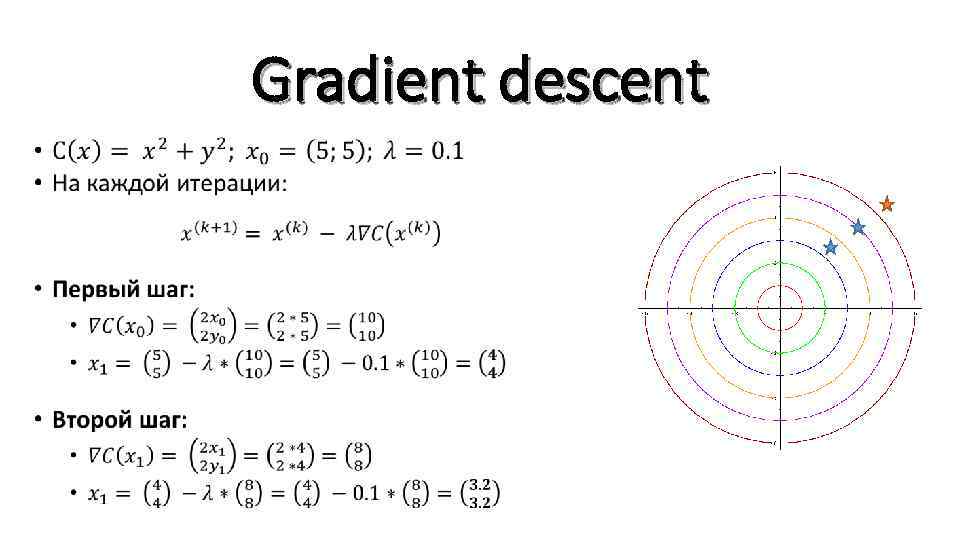

Gradient descent •

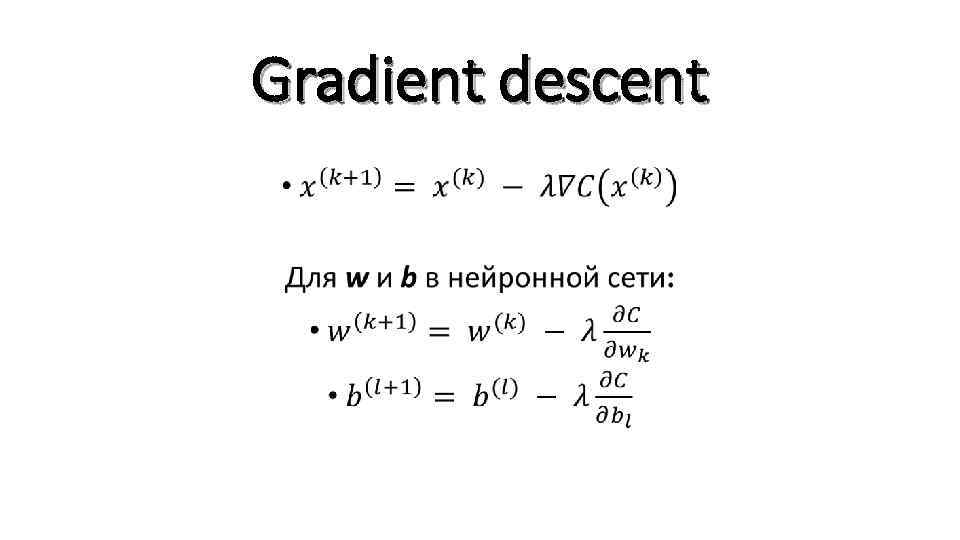

Gradient descent •

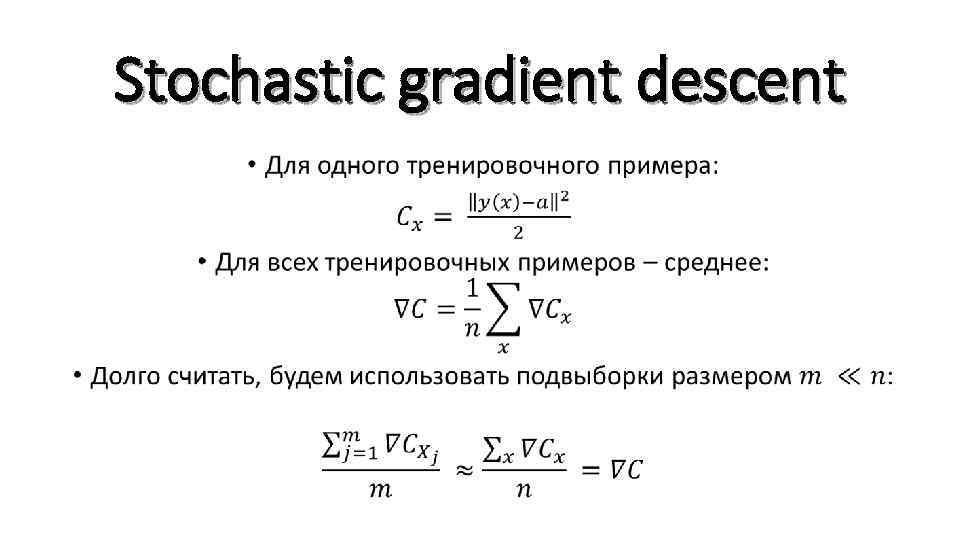

Stochastic gradient descent •

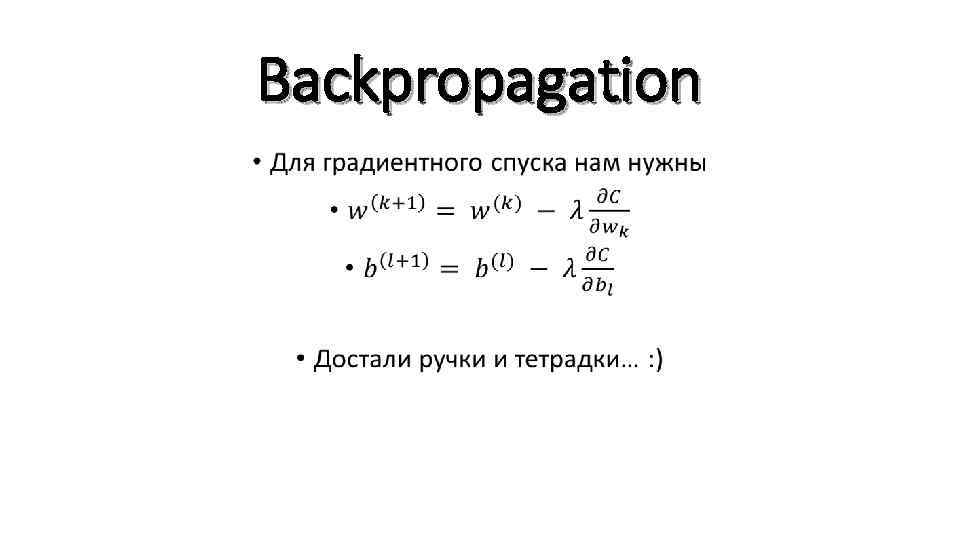

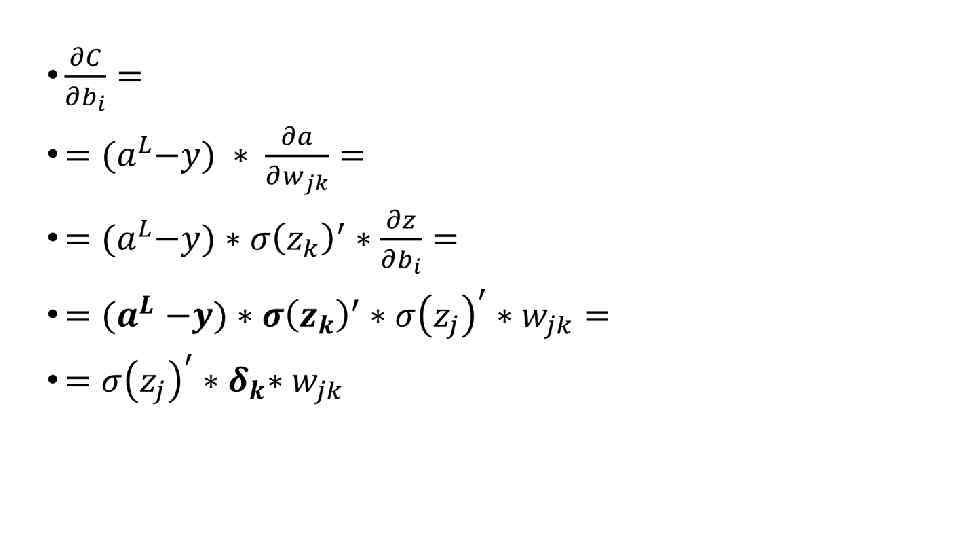

Backpropagation •

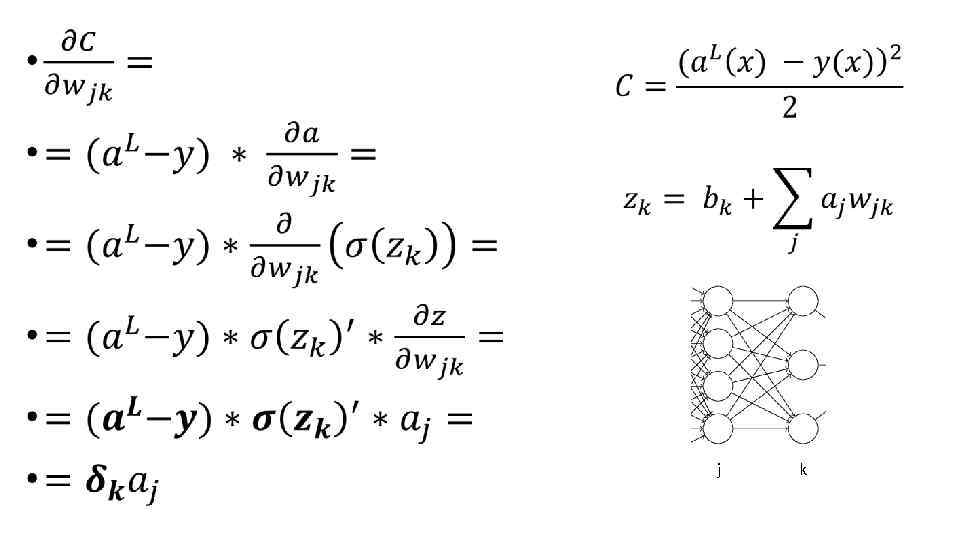

• j k

•

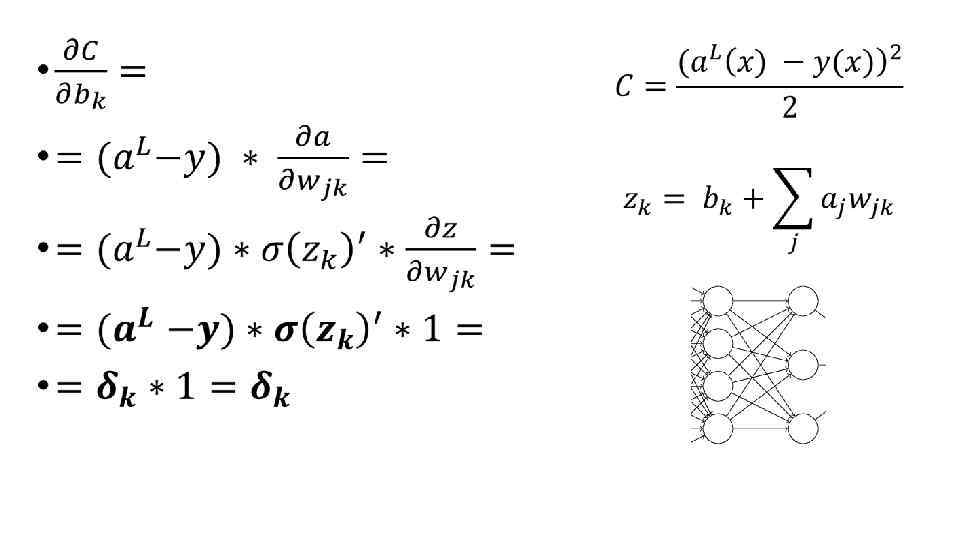

•

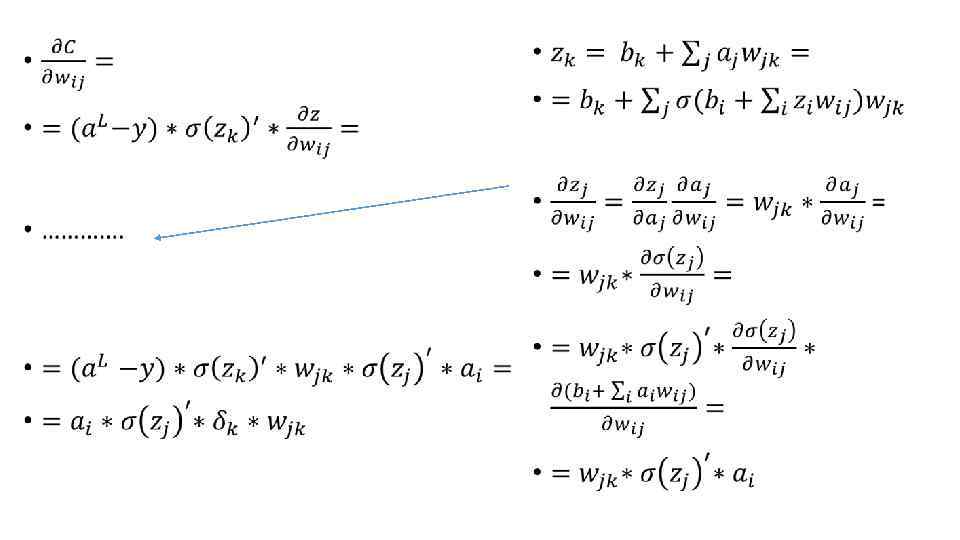

•

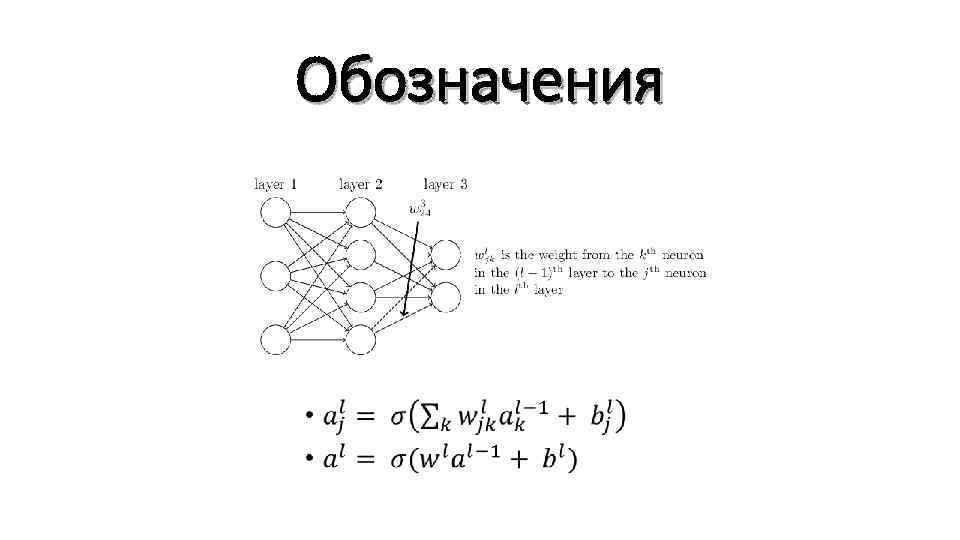

Обозначения •

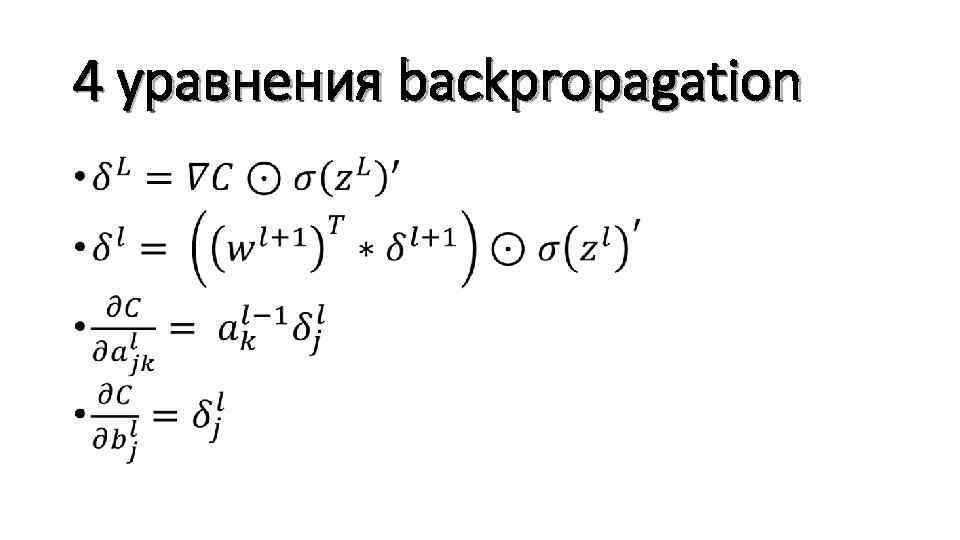

4 уравнения backpropagation •

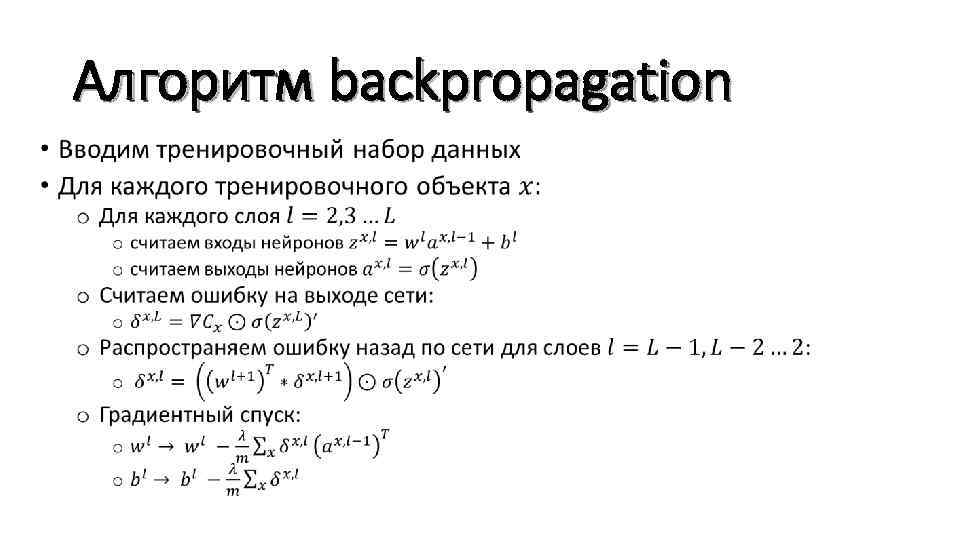

Алгоритм backpropagation •

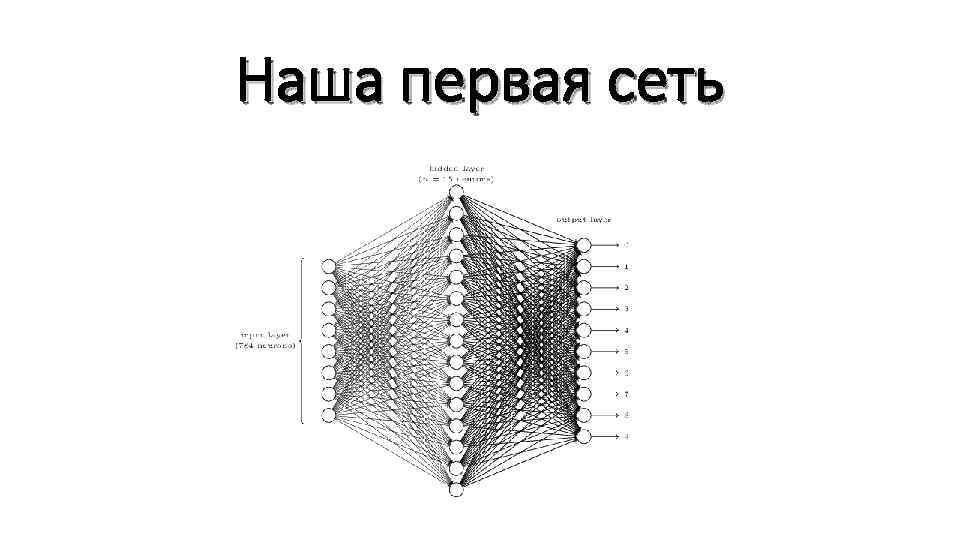

Наша первая сеть

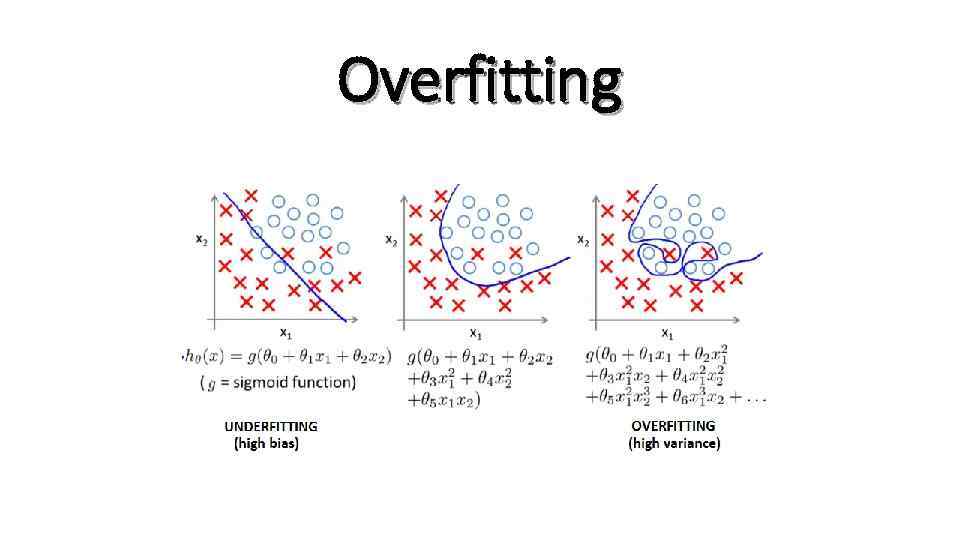

Overfitting

Фишки для обучении сетей • Regularization • Dropout • Инициализация весов • Замедление обучения • Вариации градиентного спуска • Другие функции активации • Data augmentation • Подбор параметров обучения

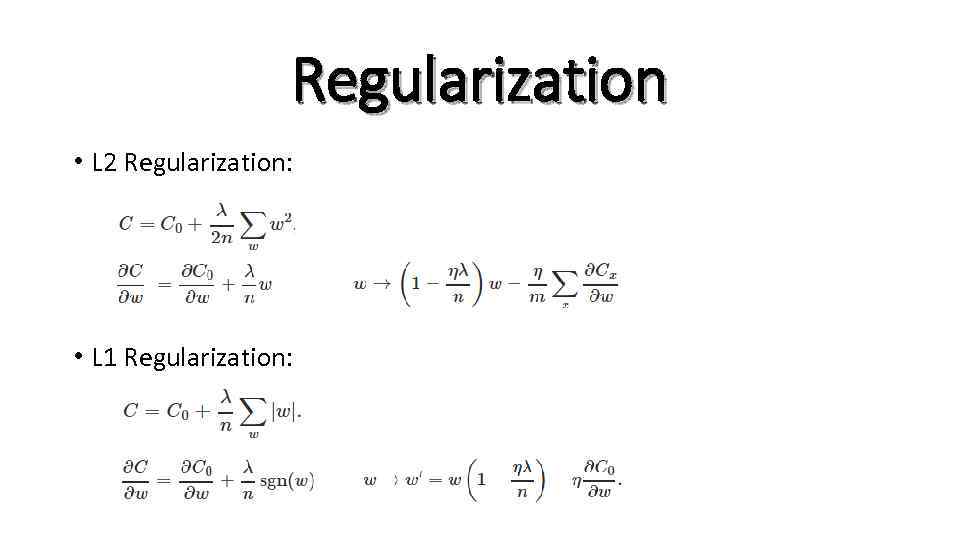

Regularization • L 2 Regularization: • L 1 Regularization:

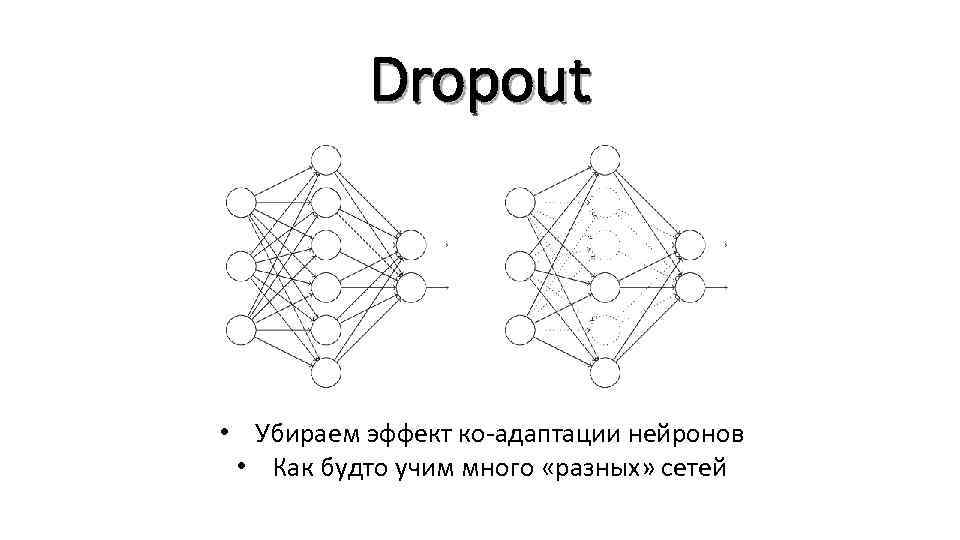

Dropout • Убираем эффект ко-адаптации нейронов • Как будто учим много «разных» сетей

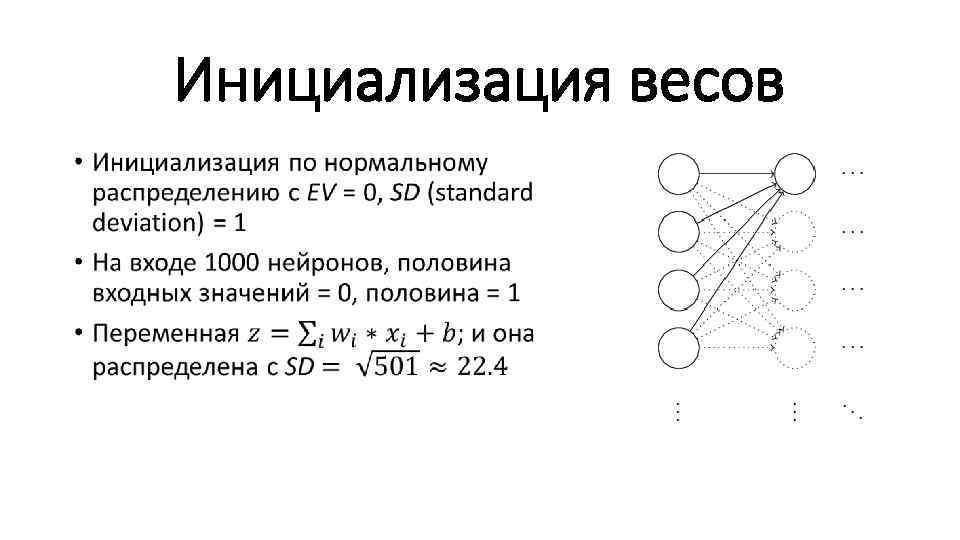

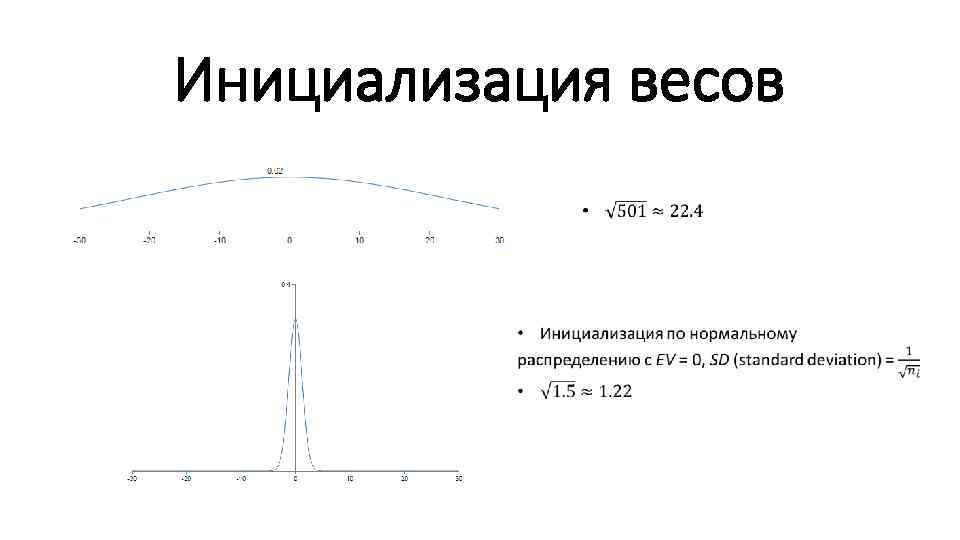

Инициализация весов •

Инициализация весов

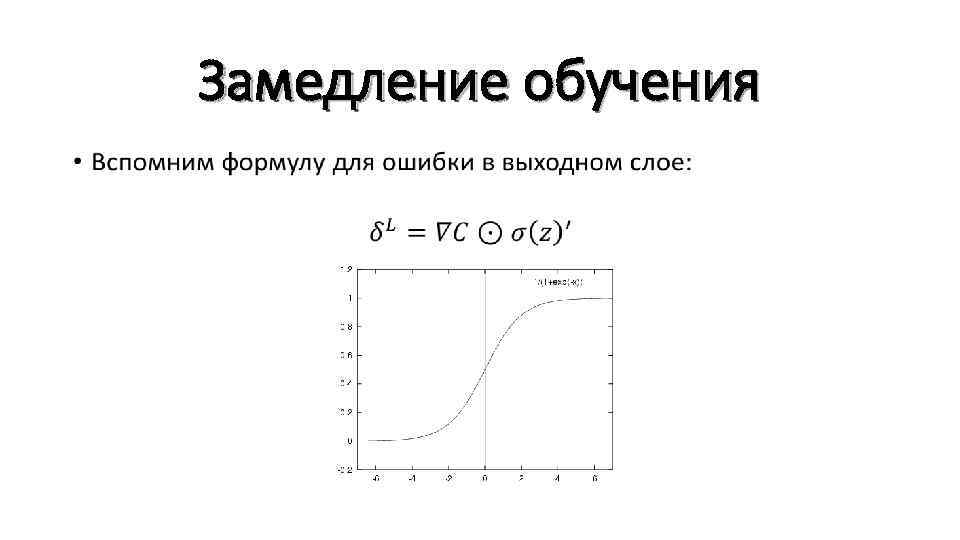

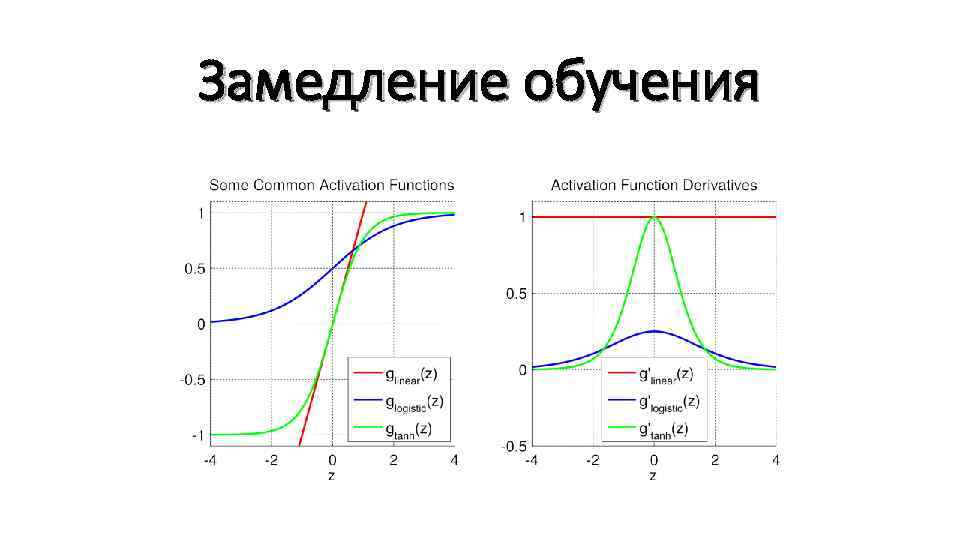

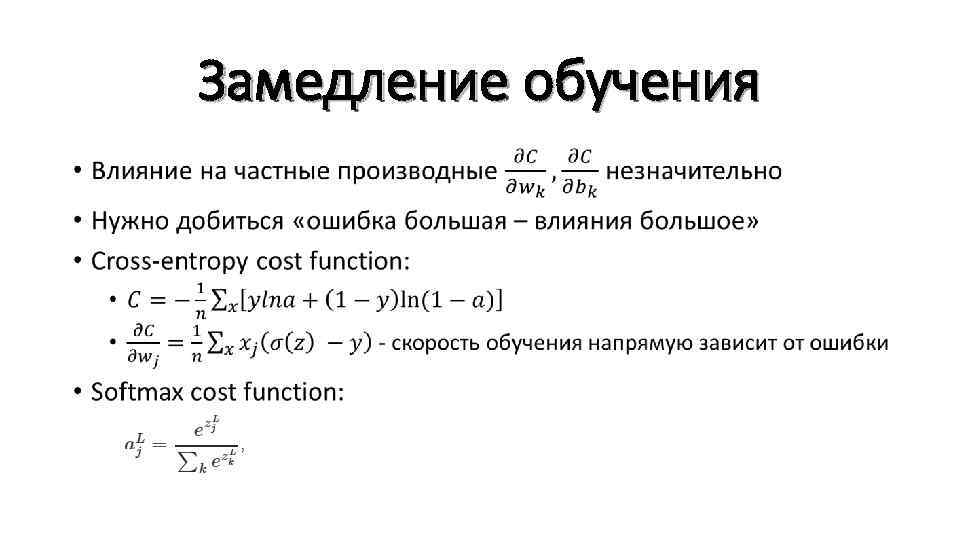

Замедление обучения •

Замедление обучения

Замедление обучения •

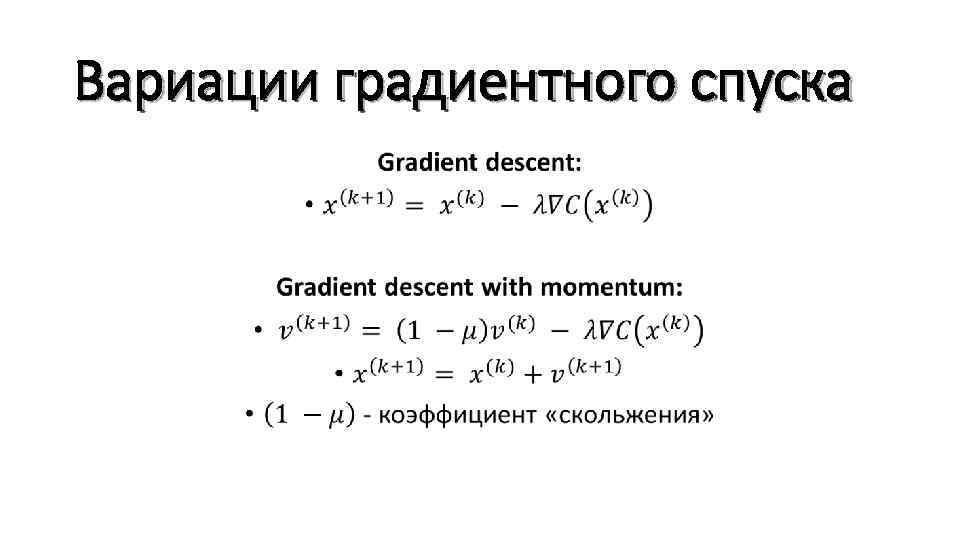

Вариации градиентного спуска •

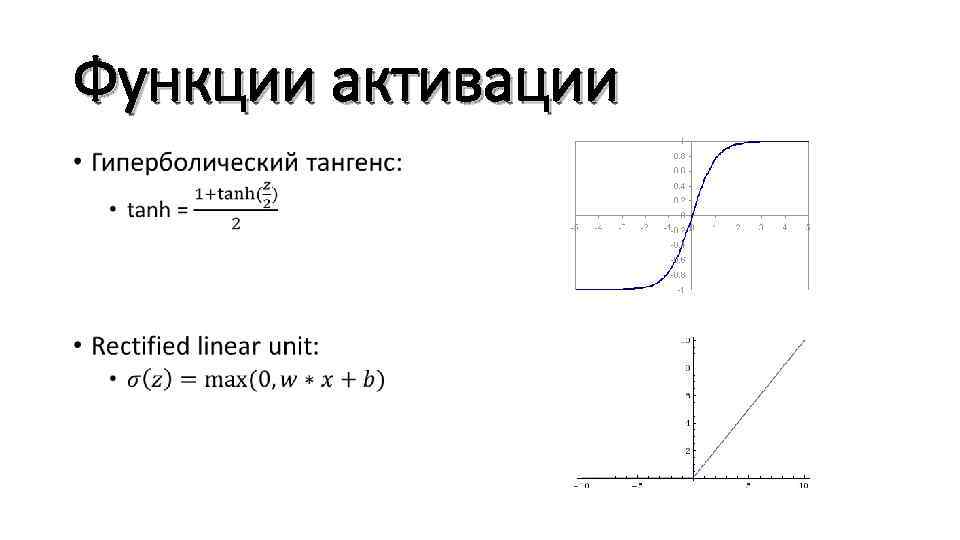

Функции активации •

Искусственная подстройка данных • Вычитание среднего цвета • Зеркальные отображения • Повороты на N градусов • Обрезки изображений • Zoom-in / zoom-out • Работа с яркостью/контрастностью • Перевод в другие цветовые схемы (HSV) • Whitening images (PCA etc)

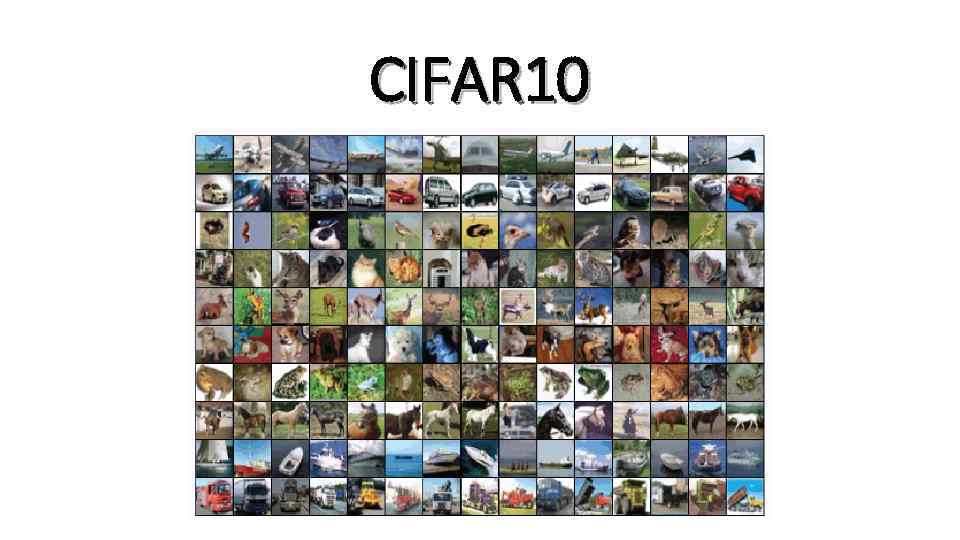

CIFAR 10

Домашнее задание • https: //www. coursera. org/learn/machine-learning • http: //neuralnetworksanddeeplearning. com/ • http: //cs 231 n. github. io • Почитать про SIFT, HOG, Color histogram. Взять реализацию в какой-то из библиотек (Open. CV, scikit-image, mahotas) и «покормить» нейронную сеть как в 6_nn_homework. py. • Постараться улучшить текущие результаты с «сырыми» пикселями.

5. Deep learning

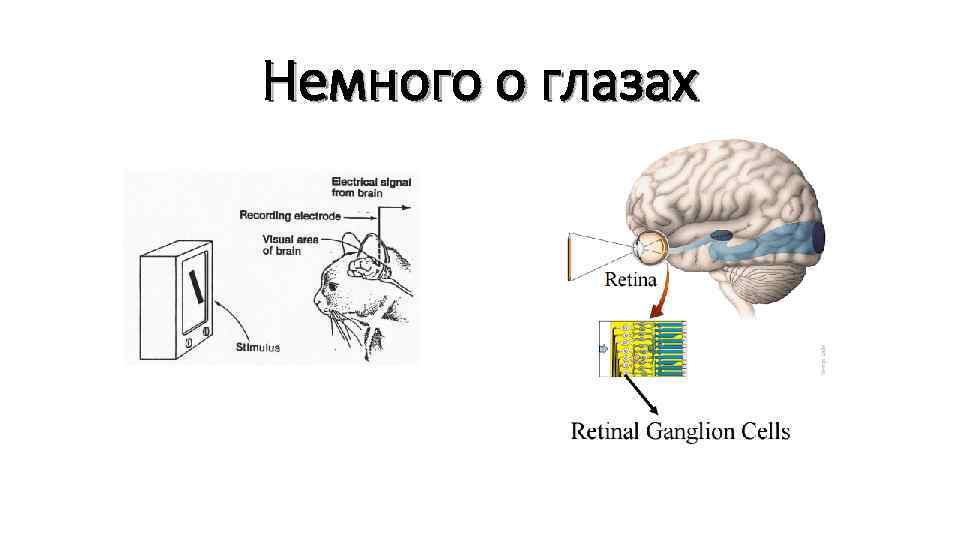

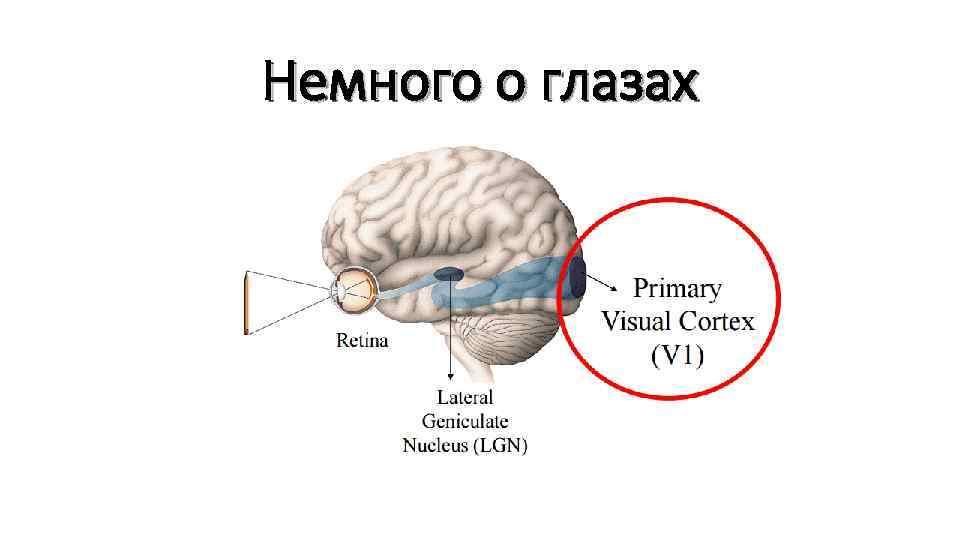

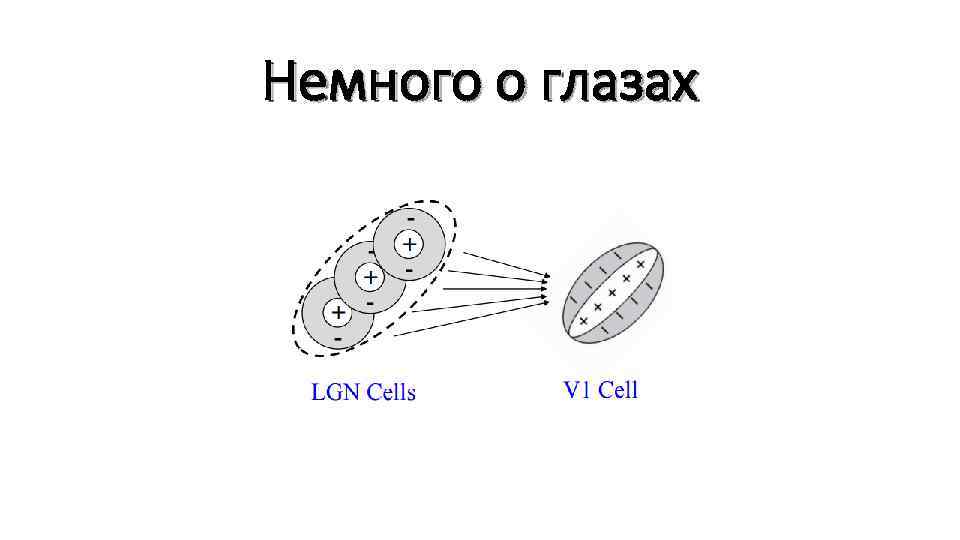

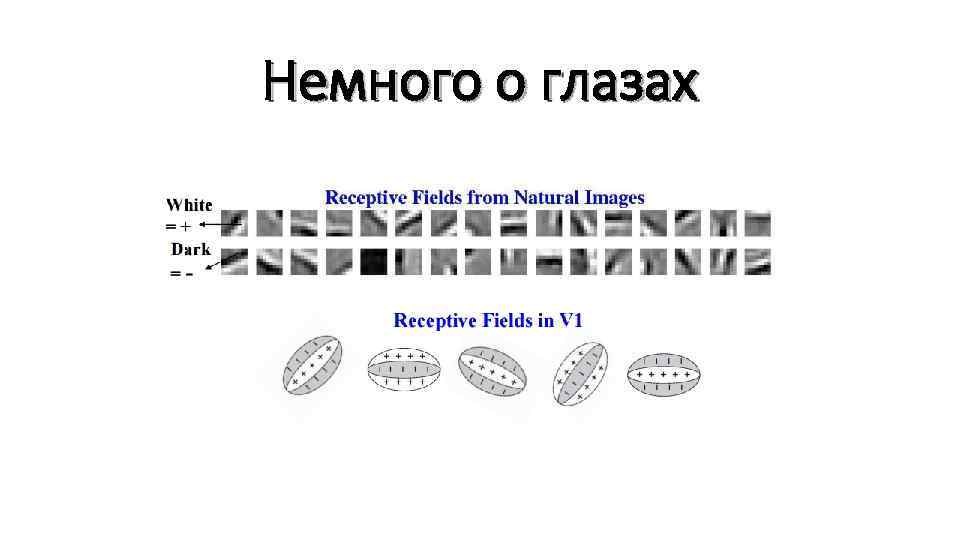

Немного о глазах

Немного о глазах

Немного о глазах

Немного о глазах

Немного о глазах

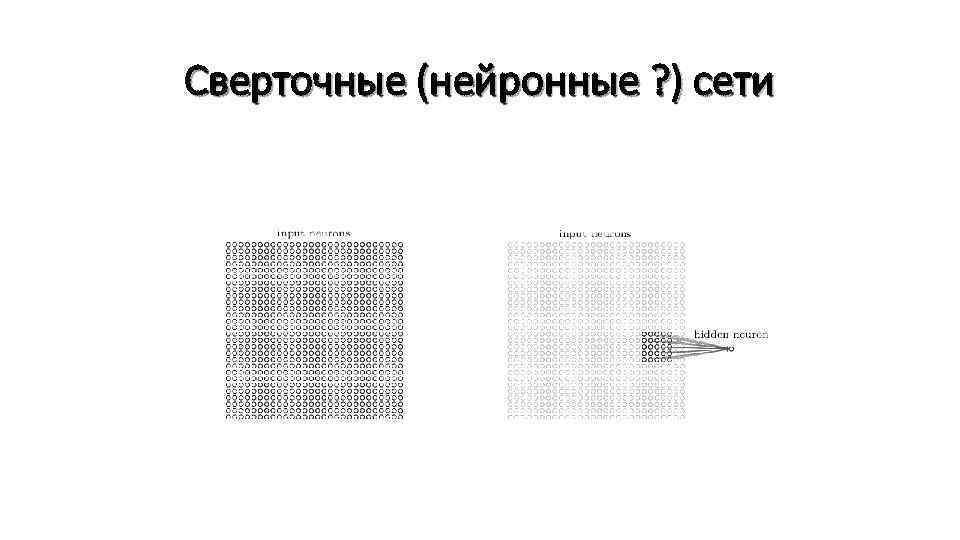

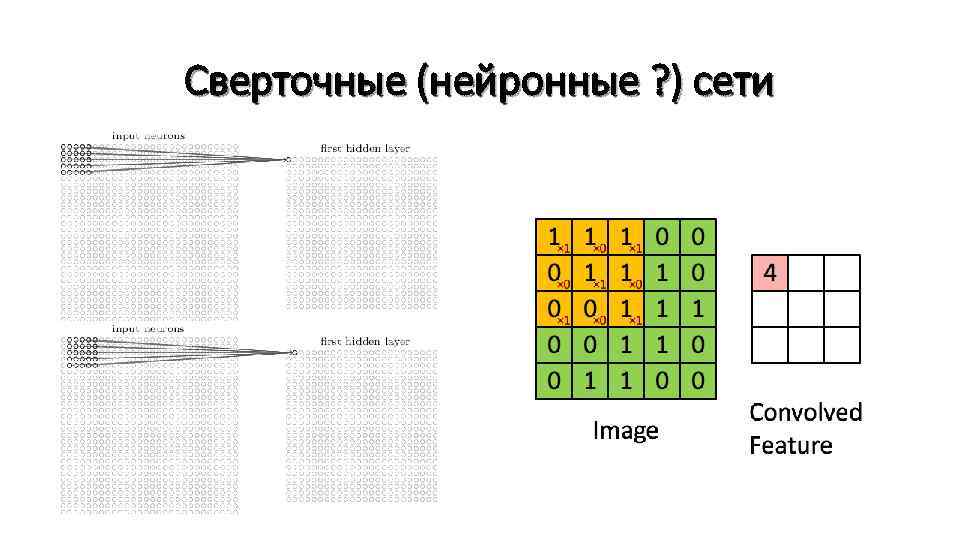

Сверточные (нейронные ? ) сети

Сверточные (нейронные ? ) сети

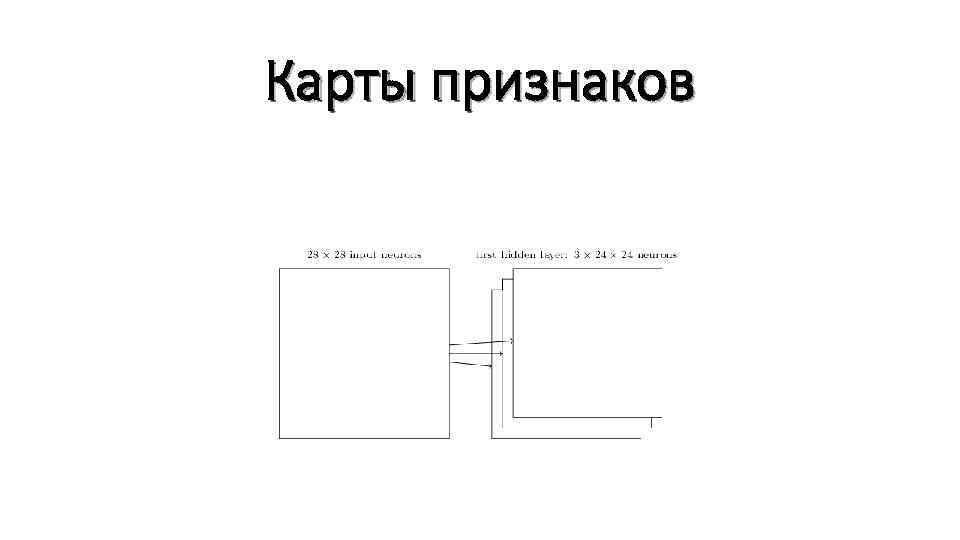

Карты признаков

Карты признаков

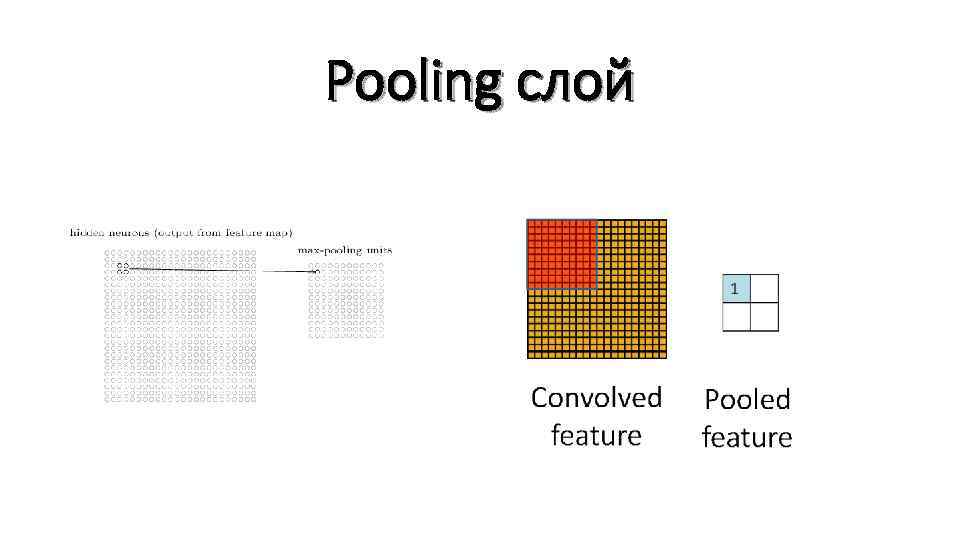

Pooling слой

Общая структура

6. Caffe

Day 1.pptx