a6b29bf768186d00f78f0b4e2a638e2e.ppt

- Количество слайдов: 37

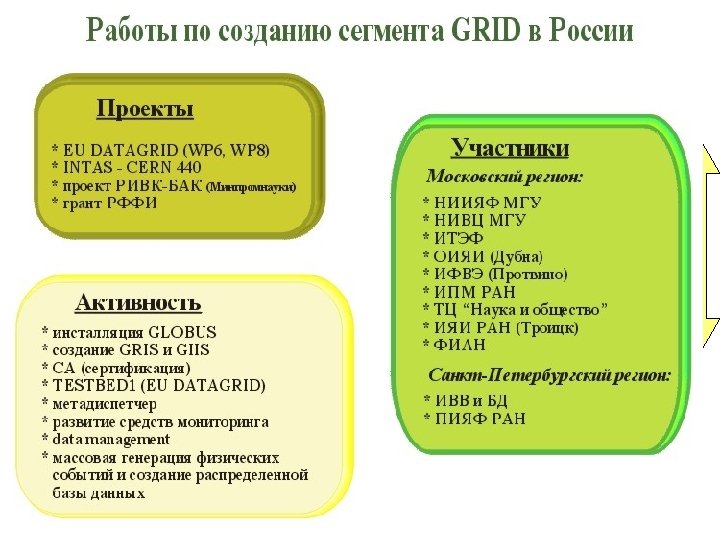

Cоздание российского сегмента глобальной инфраструктуры LCG (LHC Computing GRID) Ильин В. А. (НИИЯФ МГУ), Кореньков В. В. (Дубна, ОИЯИ) RELARN-2003 16 -20 июня 2003 года Санкт-Петербург

Five Emerging Models of Networked Computing From The Grid • Distributed Computing – || synchronous processing • High-Throughput Computing – || asynchronous processing • On-Demand Computing – || dynamic resources • Data-Intensive Computing – || databases • Collaborative Computing – || scientists Ian Foster and Carl Kesselman, editors, “The Grid: Blueprint for a New Computing Infrastructure, ” Morgan Kaufmann, 1999, http: //www. mkp. com/grids

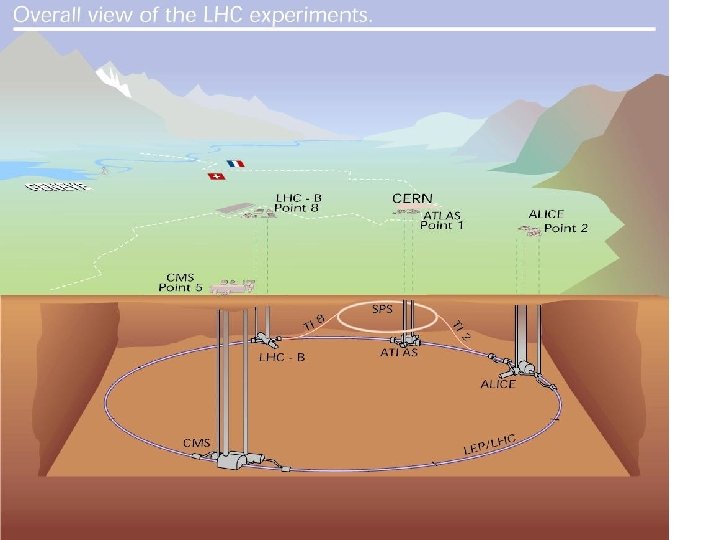

CERN

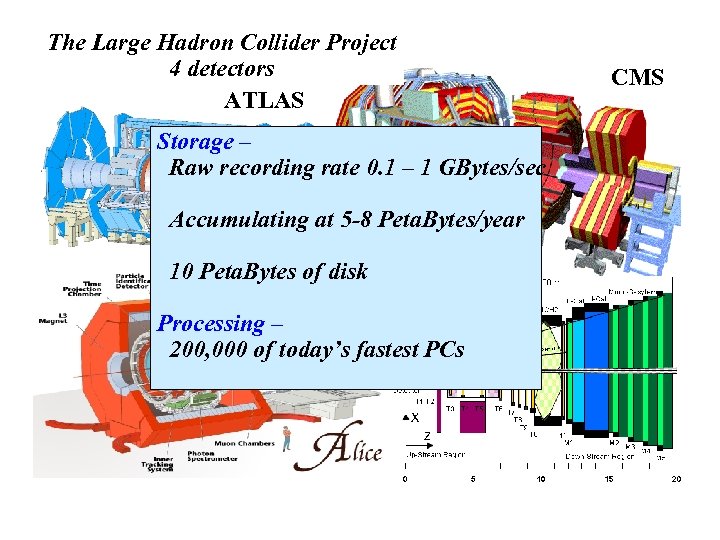

The Large Hadron Collider Project 4 detectors ATLAS Storage – Raw recording rate 0. 1 – 1 GBytes/sec Accumulating at 5 -8 Peta. Bytes/year 10 Peta. Bytes of disk LHCb Processing – 200, 000 of today’s fastest PCs CMS

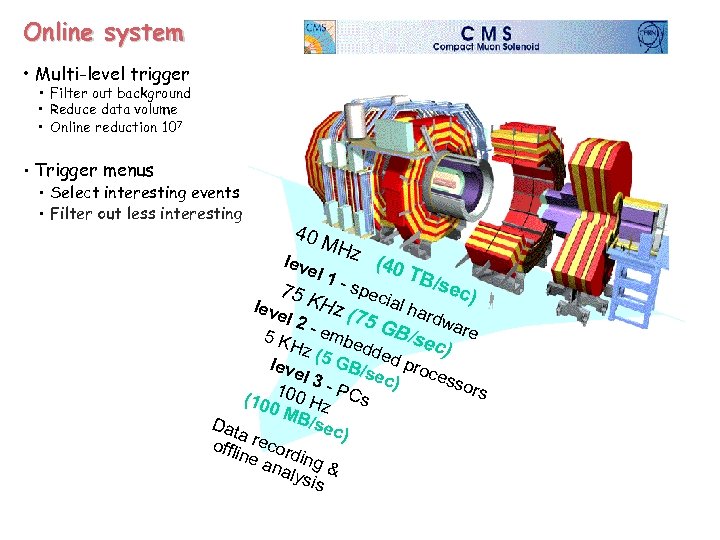

Online system • Multi-level trigger • Filter out background • Reduce data volume • Online reduction 107 • Trigger menus • Select interesting events • Filter out less interesting 40 M leve Hz l 1 - 75 K (40 spe c TB/ sec ) ial h ar (75 l 2 GB dware emb 5 K /sec edd Hz ) (5 G ed p leve B/s ec) rocess l 3 ors PCs 100 (100 H MB z /sec Dat a re ) cord offli ne a i naly ng & sis leve Hz

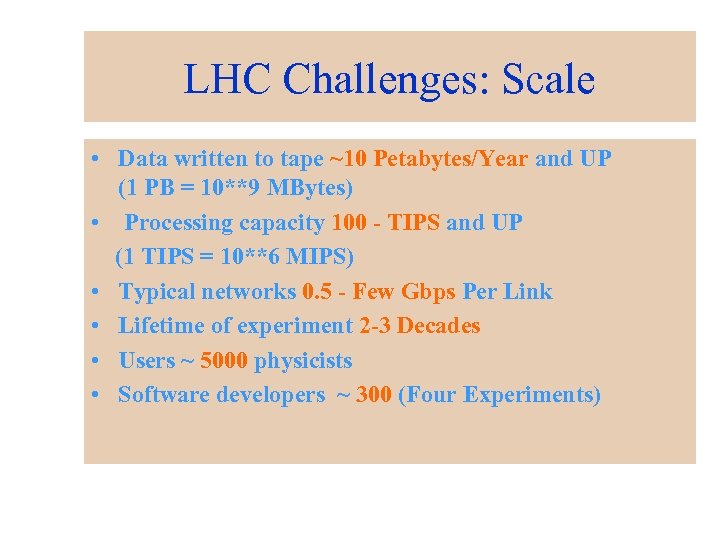

LHC Challenges: Scale • Data written to tape ~10 Petabytes/Year and UP (1 PB = 10**9 MBytes) • Processing capacity 100 - TIPS and UP (1 TIPS = 10**6 MIPS) • Typical networks 0. 5 - Few Gbps Per Link • Lifetime of experiment 2 -3 Decades • Users ~ 5000 physicists • Software developers ~ 300 (Four Experiments)

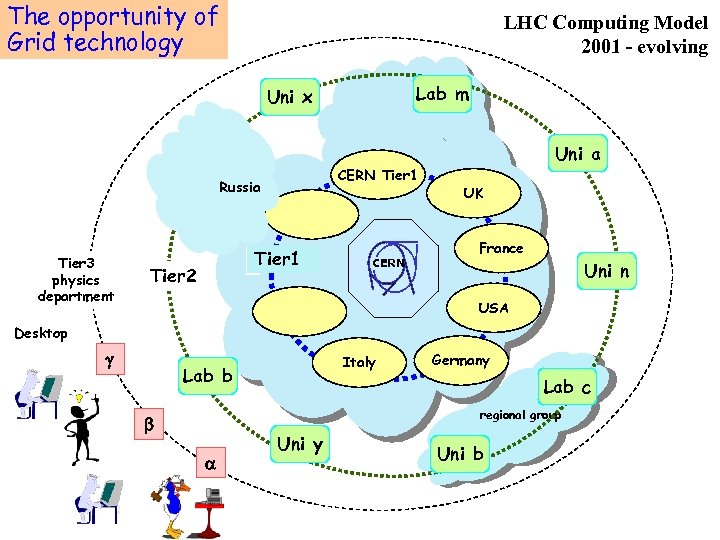

The opportunity of MONARC project Grid technology LHC Computing Model 2001 - evolving Lab m Uni x CERN Tier 1 Russia Tier 3 physics department Tier 1 Tier 2 CERN Uni a UK France Uni n USA Desktop Italy Lab b Germany Lab c regional group Uni y Uni b

Большой адронный коллайдер (БАК) потоки данных, этапы обработки и анализа 1 -100 ГБ/сек Отбор событий и первичная реконструкция детектор 0. 1 -1 ГБ/сек 200 MБ/сек 1 -6 ПБ/год сырые данные 0. 5 -1 ПБ/год Реконструкция события ~100 MБ/сек Архивное хранение Суммарные данные по событию Подготовка данных для анализа 200 TБ/год Данные для анализа (выделенные по физ. каналам) Моделирование событий РИВК БАК 5 -10% Интерактивный физический анализ тысячи ученых

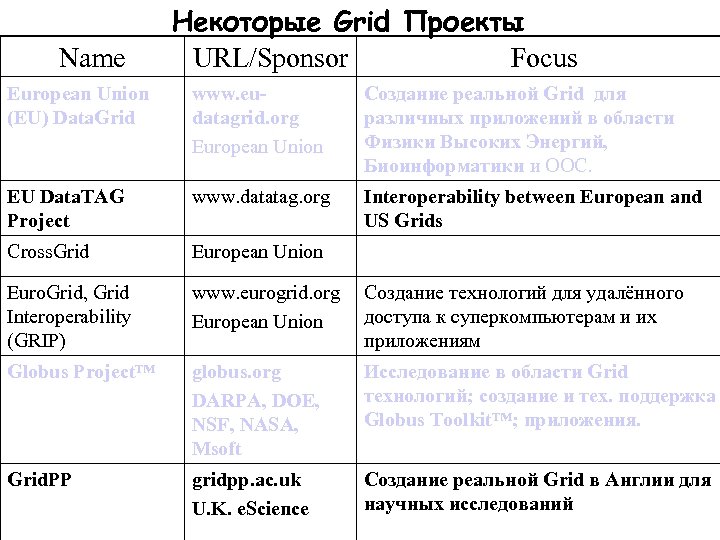

Name Некоторые Grid Проекты URL/Sponsor Focus European Union (EU) Data. Grid www. eudatagrid. org European Union Создание реальной Grid для различных приложений в области Физики Высоких Энергий, Биоинформатики и ООС. EU Data. TAG Project www. datatag. org Interoperability between European and US Grids Cross. Grid European Union Euro. Grid, Grid Interoperability (GRIP) www. eurogrid. org European Union Создание технологий для удалённого доступа к суперкомпьютерам и их приложениям Globus Project™ globus. org DARPA, DOE, NSF, NASA, Msoft Исследование в области Grid технологий; создание и тех. поддержка Globus Toolkit™; приложения. Grid. PP gridpp. ac. uk U. K. e. Science Создание реальной Grid в Англии для научных исследований

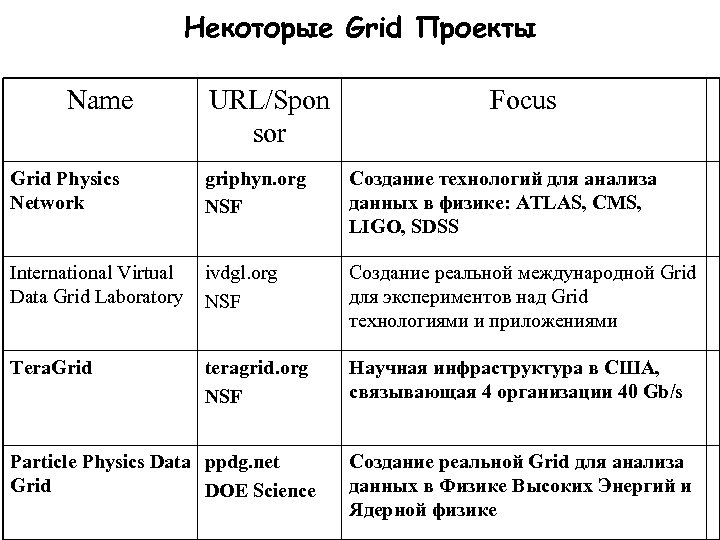

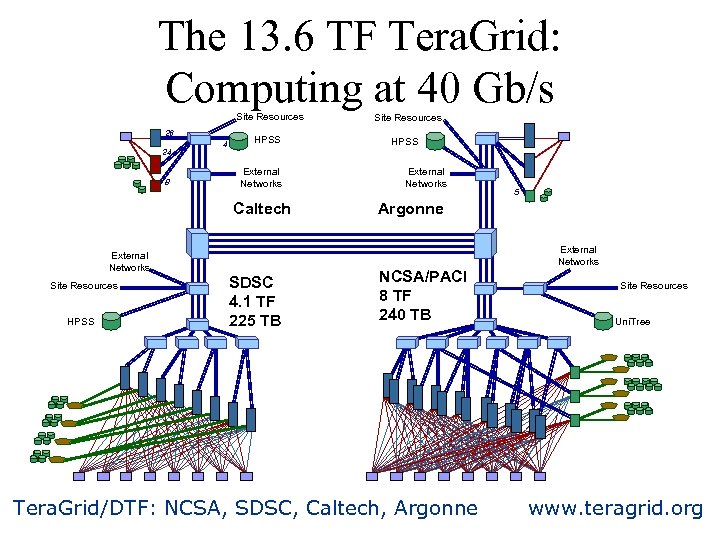

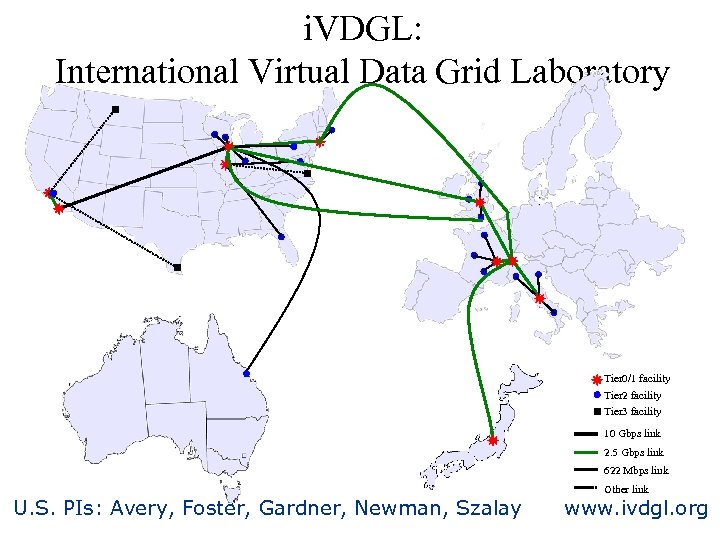

Некоторые Grid Проекты Name URL/Spon sor Focus Grid Physics Network griphyn. org NSF Cоздание технологий для анализа данных в физике: ATLAS, CMS, LIGO, SDSS International Virtual Data Grid Laboratory ivdgl. org NSF Создание реальной международной Grid для экспериментов над Grid технологиями и приложениями Tera. Grid teragrid. org NSF Научная инфраструктура в США, связывающая 4 организации 40 Gb/s Particle Physics Data ppdg. net Grid DOE Science Создание реальной Grid для анализа данных в Физике Высоких Энергий и Ядерной физике

The 13. 6 TF Tera. Grid: Computing at 40 Gb/s Site Resources 26 24 8 4 HPSS External Networks Caltech External Networks Site Resources HPSS SDSC 4. 1 TF 225 TB Site Resources HPSS External Networks 5 Argonne NCSA/PACI 8 TF 240 TB Tera. Grid/DTF: NCSA, SDSC, Caltech, Argonne External Networks Site Resources Uni. Tree www. teragrid. org

i. VDGL: International Virtual Data Grid Laboratory Tier 0/1 facility Tier 2 facility Tier 3 facility 10 Gbps link 2. 5 Gbps link 622 Mbps link Other link U. S. PIs: Avery, Foster, Gardner, Newman, Szalay www. ivdgl. org

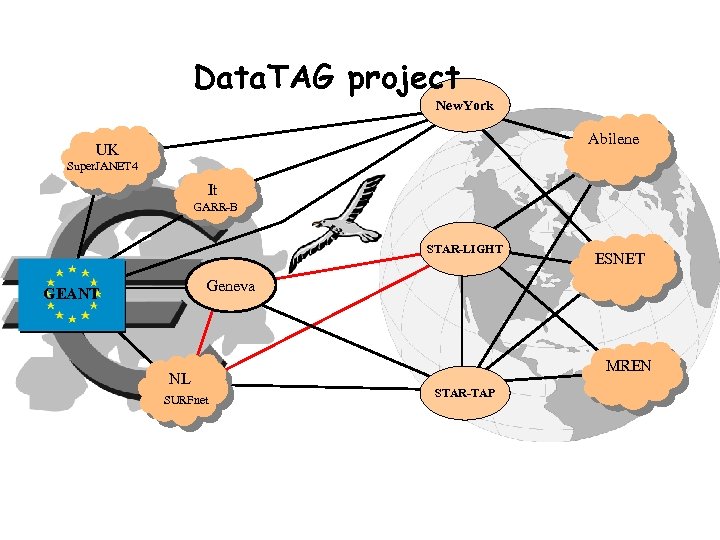

Data. TAG project New. York Abilene UK Super. JANET 4 It GARR-B STAR-LIGHT ESNET Geneva GEANT NL SURFnet MREN STAR-TAP

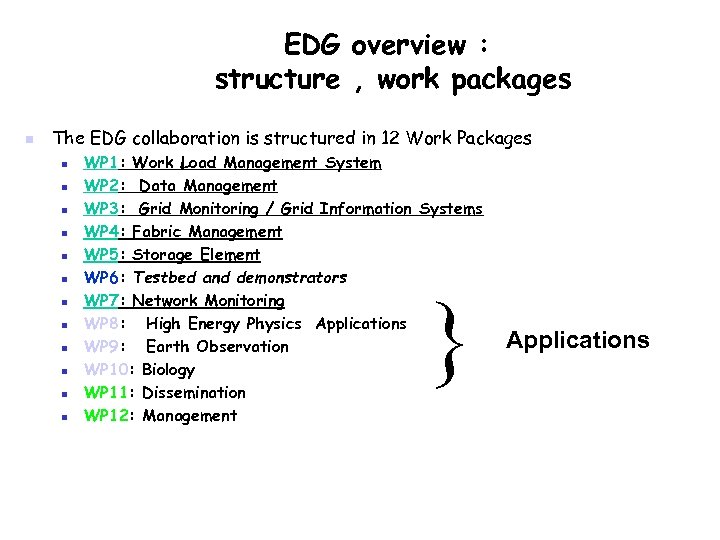

EDG overview : structure , work packages n The EDG collaboration is structured in 12 Work Packages n n n WP 1: Work Load Management System WP 2: Data Management WP 3: Grid Monitoring / Grid Information Systems WP 4: Fabric Management WP 5: Storage Element WP 6: Testbed and demonstrators WP 7: Network Monitoring WP 8: High Energy Physics Applications WP 9: Earth Observation WP 10: Biology WP 11: Dissemination WP 12: Management } Applications

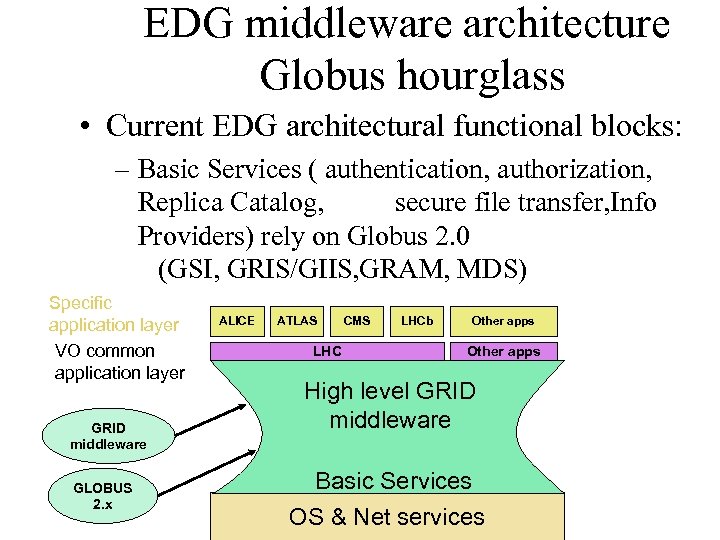

EDG middleware architecture Globus hourglass • Current EDG architectural functional blocks: – Basic Services ( authentication, authorization, Replica Catalog, secure file transfer, Info Providers) rely on Globus 2. 0 (GSI, GRIS/GIIS, GRAM, MDS) Specific application layer VO common application layer GRID middleware GLOBUS 2. х ALICE ATLAS LHC CMS LHCb Other apps High level GRID middleware Basic Services OS & Net services

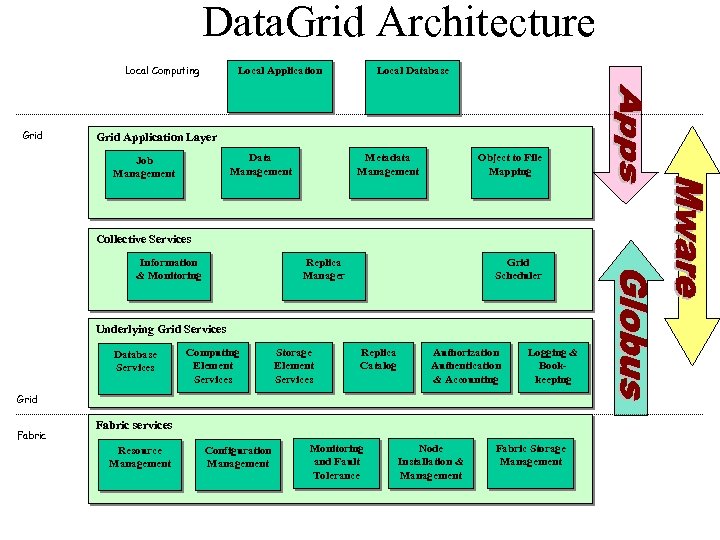

Data. Grid Architecture Local Computing Grid Local Application Local Database Grid Application Layer Data Management Job Management Metadata Management Object to File Mapping Collective Services Information & Monitoring Replica Manager Grid Scheduler Underlying Grid Services Database Services Computing Element Services Storage Element Services Replica Catalog Authorization Authentication & Accounting Logging & Bookkeeping Grid Fabric services Resource Management Configuration Management Monitoring and Fault Tolerance Node Installation & Management Fabric Storage Management

LHC Computing Grid Project

Fundamental Goal of the LCG To help the experiments’ computing projects get the best, most reliable and accurate physics results from the data coming from the detectors Phase 1 – 2002 -05 prepare and deploy the environment for LHC computing Phase 2 – 2006 -08 acquire, build and operate the LHC computing service

Структура программного обеспечения LCG 1) В качестве основы промежуточного программного обеспечения выбран набор инструментальных средств Globus 2) Пакет VDT (Virtual Data Toolkit), разработанный в американских GRID проектах: PPDG – The Particle Physics Data Grid , Gri. Phy. N – Grid Physics Network, и i. VDGL – the International Virtual Data Grid Laboratory. Этот пакет представляет собой набор надстроек над библиотекой инструментальных средств GLOBUS, позволяющих реализовывать распределенную вычислительную систему, но практически без каких либо GRID сервисов. Он также включает в себя пакет Condor/Condor-G, который используется в качестве распределенной системы запуска заданий в пакетном режиме. 3) Набор сервисов и служб, разработанных в проекте EU Data. GRID: ресурс-брокер (обеспечивающий сервис по распределению заданий), информационная служба, replica catalog и др.

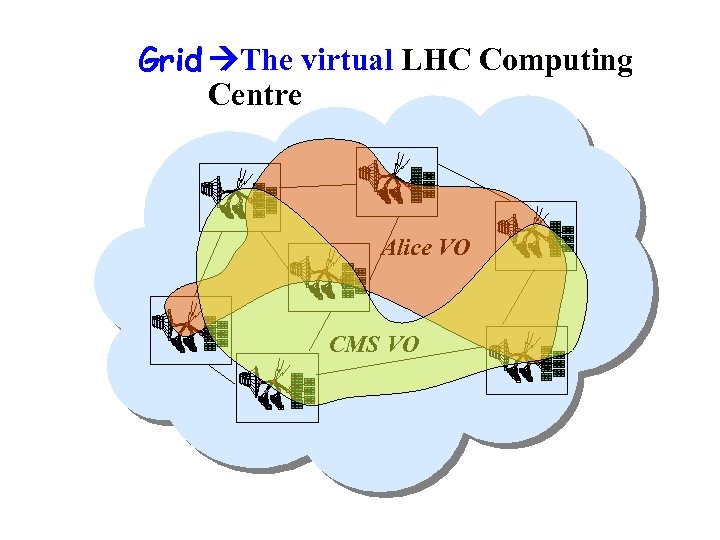

Grid The virtual LHC Computing Building a Grid Centre Collaborating Computer Centres Alice VO CMS VO

Data. Grid Architecture Local Computing Grid Local Application Local Database Grid Application Layer Data Management Job Management Metadata Management Object to File Mapping Collective Services Information & Monitoring Replica Manager Grid Scheduler Underlying Grid Services Database Services Computing Element Services Storage Element Services Replica Catalog Authorization Authentication & Accounting Logging & Bookkeeping Grid Fabric services Resource Management Configuration Management Monitoring and Fault Tolerance Node Installation & Management Fabric Storage Management

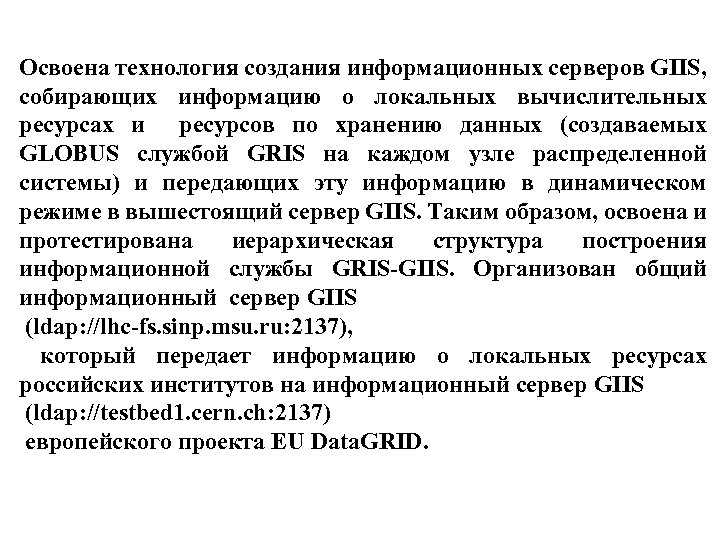

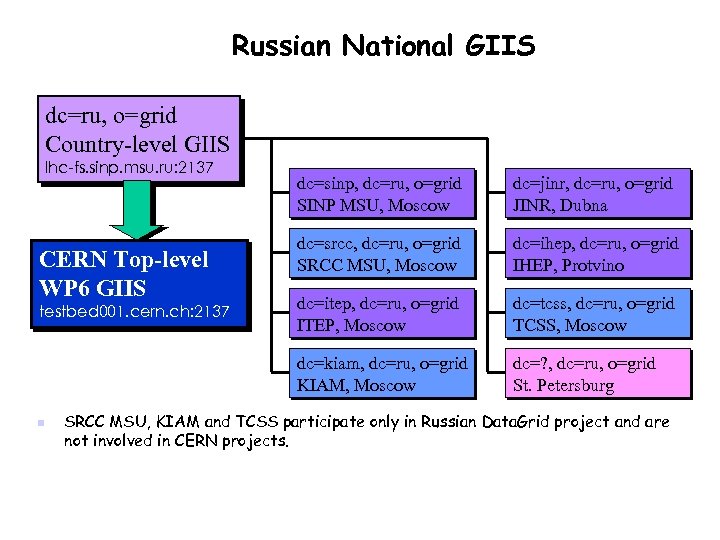

Освоена технология создания информационных серверов GIIS, собирающих информацию о локальных вычислительных ресурсах и ресурсов по хранению данных (создаваемых GLOBUS службой GRIS на каждом узле распределенной системы) и передающих эту информацию в динамическом режиме в вышестоящий сервер GIIS. Таким образом, освоена и протестирована иерархическая структура построения информационной службы GRIS-GIIS. Организован общий информационный сервер GIIS (ldap: //lhc-fs. sinp. msu. ru: 2137), который передает информацию о локальных ресурсах российских институтов на информационный сервер GIIS (ldap: //testbed 1. cern. ch: 2137) европейского проекта EU Data. GRID.

Russian National GIIS dc=ru, o=grid Country-level GIIS lhc-fs. sinp. msu. ru: 2137 testbed 001. cern. ch: 2137 n dc=jinr, dc=ru, o=grid JINR, Dubna dc=srcc, dc=ru, o=grid SRCC MSU, Moscow dc=ihep, dc=ru, o=grid IHEP, Protvino dc=itep, dc=ru, o=grid ITEP, Moscow dc=tcss, dc=ru, o=grid TCSS, Moscow dc=kiam, dc=ru, o=grid KIAM, Moscow CERN Top-level WP 6 GIIS dc=sinp, dc=ru, o=grid SINP MSU, Moscow dc=? , dc=ru, o=grid St. Petersburg SRCC MSU, KIAM and TCSS participate only in Russian Data. Grid project and are not involved in CERN projects.

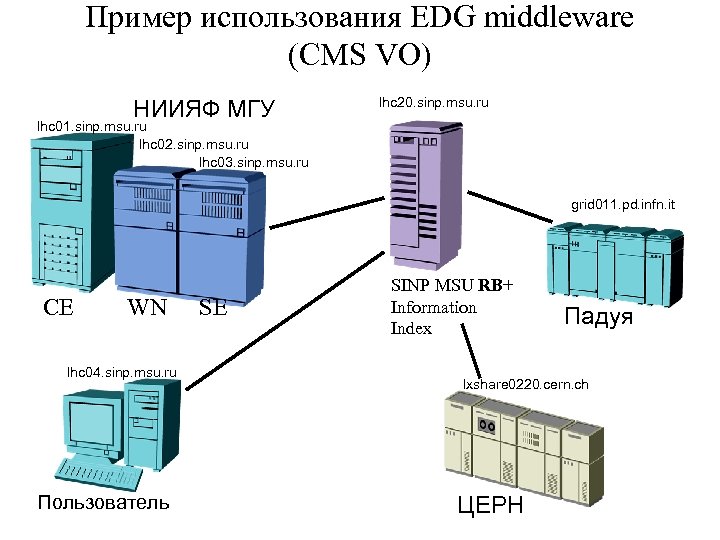

Пример использования EDG middleware (CMS VO) НИИЯФ МГУ lhc 20. sinp. msu. ru lhc 01. sinp. msu. ru lhc 02. sinp. msu. ru lhc 03. sinp. msu. ru grid 011. pd. infn. it CE WN lhc 04. sinp. msu. ru Пользователь SE SINP MSU RB+ Information Index Падуя lxshare 0220. cern. ch ЦЕРН

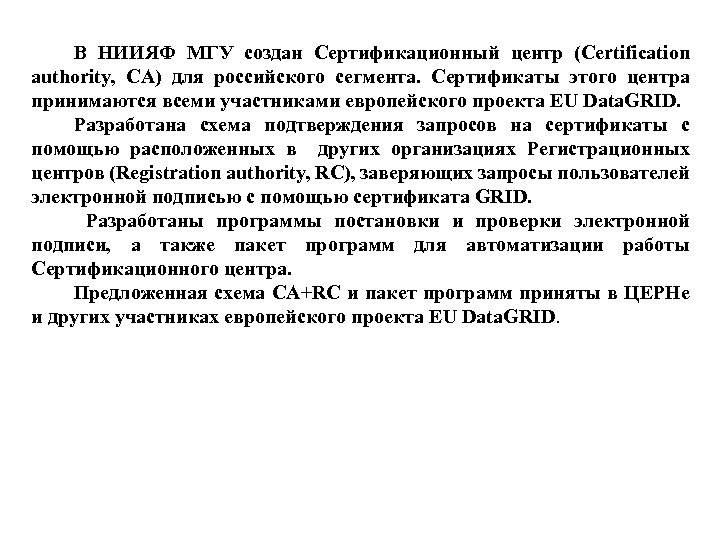

В НИИЯФ МГУ создан Сертификационный центр (Certification authority, СА) для российского сегмента. Сертификаты этого центра принимаются всеми участниками европейского проекта EU Data. GRID. Разработана схема подтверждения запросов на сертификаты с помощью расположенных в других организациях Регистрационных центров (Registration authority, RC), заверяющих запросы пользователей электронной подписью с помощью сертификата GRID. Разработаны программы постановки и проверки электронной подписи, а также пакет программ для автоматизации работы Сертификационного центра. Предложенная схема CA+RC и пакет программ приняты в ЦЕРНе и других участниках европейского проекта EU Data. GRID.

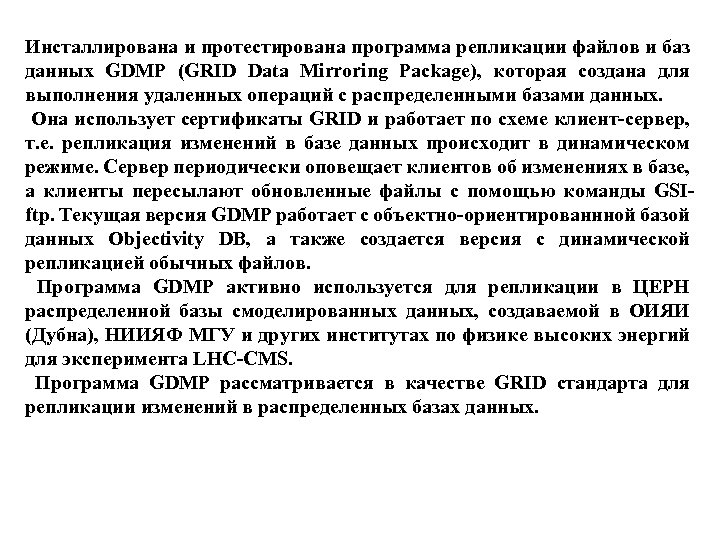

Инсталлирована и протестирована программа репликации файлов и баз данных GDMP (GRID Data Mirroring Package), которая создана для выполнения удаленных операций с распределенными базами данных. Она использует сертификаты GRID и работает по схеме клиент-сервер, т. е. репликация изменений в базе данных происходит в динамическом режиме. Сервер периодически оповещает клиентов об изменениях в базе, а клиенты пересылают обновленные файлы с помощью команды GSIftp. Текущая версия GDMP работает с объектно-ориентированнной базой данных Objectivity DB, а также создается версия с динамической репликацией обычных файлов. Программа GDMP активно используется для репликации в ЦЕРН распределенной базы смоделированных данных, создаваемой в ОИЯИ (Дубна), НИИЯФ МГУ и других институтах по физике высоких энергий для эксперимента LHC-CMS. Программа GDMP рассматривается в качестве GRID стандарта для репликации изменений в распределенных базах данных.

В ОИЯИ выполнен комплекс работ по мониторингу сетевых ресурсов, узлов, сервисов и приложений. Сотрудники ОИЯИ принимают участие в развитии средств мониторинга для вычислительных кластеров с очень большим количеством узлов (10. 000 и более), используемых в создаваемой инфраструктуре EU Data. GRID. В рамках задачи Monitoring and Fault Tolerance (Мониторинг и устойчивость при сбоях) они участвуют в создании системы корреляции событий (Correlation Engine). Задача этой системы - своевременное обнаружение аномальных состояний на узлах кластера и принятие мер по предупреждению сбоев. С помощью созданного прототипа Системы корреляции событий (Correlation Engine) ведется сбор статистики аномальных состояний узлов на базе вычислительных кластеров ЦЕРН. Производится анализ полученных данных для выявления причин сбоев узлов. На втором этапе предусмотрено расширение прототипа Correlation Engine с учетом полученных результатов и испытание системы автоматизированного предупреждения сбоев на практике. Этот прототип установлен на вычислительных кластерах в ЦЕРН и ОИЯИ, где производится сбор статистики аномальных состояний узлов.

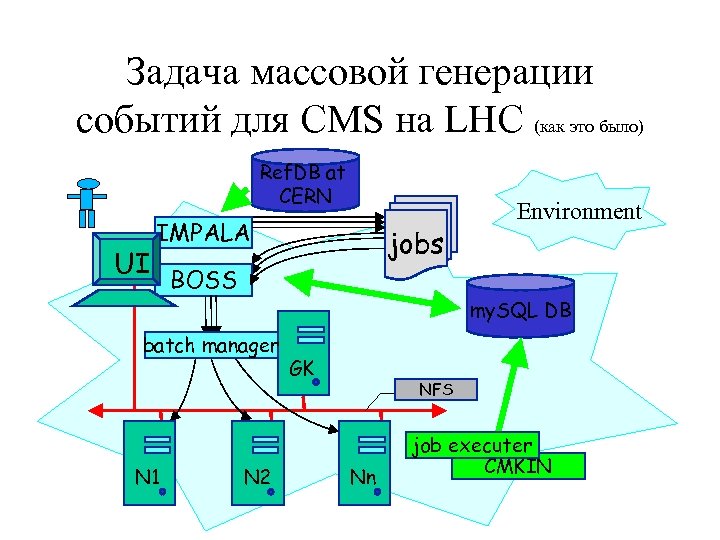

Задача массовой генерации событий для CMS на LHC (как это было) Ref. DB at CERN IMPALA jobs U UI I BOSS my. SQL DB batch manager N 1 Environment N 2 GK NFS Nn job executer CMKIN

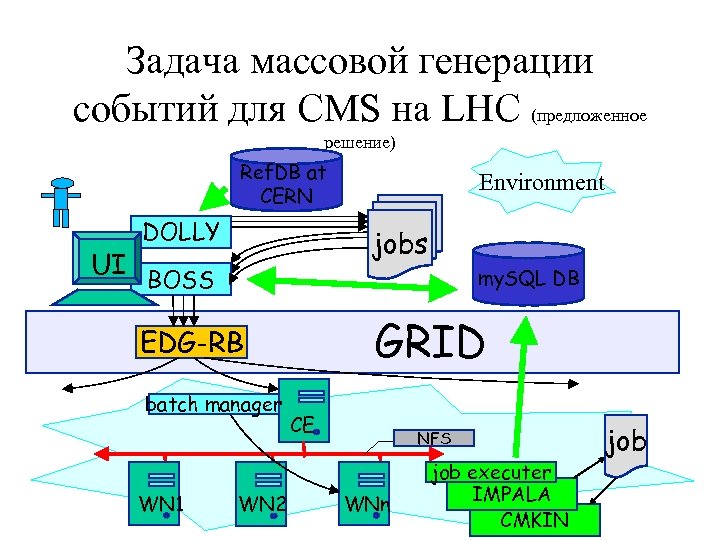

Задача массовой генерации событий для CMS на LHC (предложенное решение) Ref. DB at CERN DOLLY jobs UI UI BOSS my. SQL DB GRID EDG-RB batch manager WN 1 Environment WN 2 CE NFS WNn job executer IMPALA CMKIN job

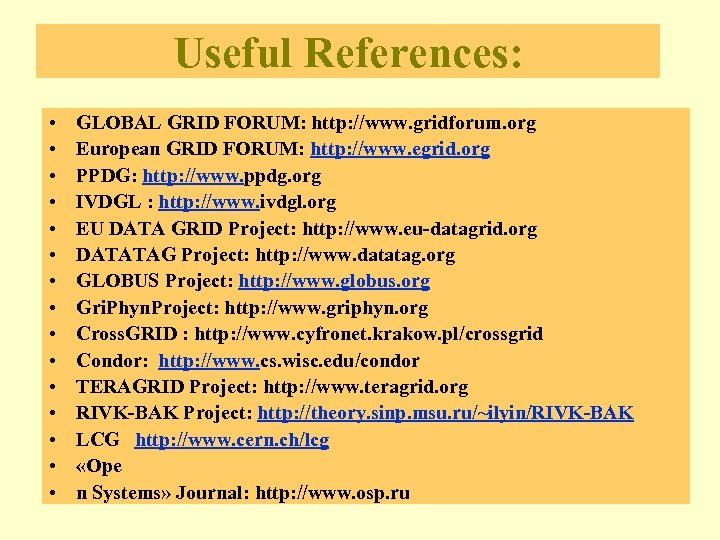

Useful References: • • • • GLOBAL GRID FORUM: http: //www. gridforum. org European GRID FORUM: http: //www. egrid. org PPDG: http: //www. ppdg. org IVDGL : http: //www. ivdgl. org EU DATA GRID Project: http: //www. eu-datagrid. org DATATAG Project: http: //www. datatag. org GLOBUS Project: http: //www. globus. org Gri. Phyn. Project: http: //www. griphyn. org Cross. GRID : http: //www. cyfronet. krakow. pl/crossgrid Condor: http: //www. cs. wisc. edu/condor TERAGRID Project: http: //www. teragrid. org RIVK-BAK Project: http: //theory. sinp. msu. ru/~ilyin/RIVK-BAK LCG http: //www. cern. ch/lcg «Ope n Systems» Journal: http: //www. osp. ru

a6b29bf768186d00f78f0b4e2a638e2e.ppt