b0c8ce7220ba9bb451a99fca250fa8eb.ppt

- Количество слайдов: 141

Часть I. Структурная геномика: выравнивание последовательностей

Часть I. Структурная геномика: выравнивание последовательностей

Ссылки ♦ Учебники: – – ♦ D. W. Mount. Bioinformatics. Sequence and Genome Analysis. NY, Cold Spring Harbor, 2001. A. D. Baxevanis, B. F. F. Ouellette (eds. ). Bioinformatics. A Practical Guide to the Analysis of Genes and Proteins. NJ, Wiley, 2005. Обзоры и статьи

Ссылки ♦ Учебники: – – ♦ D. W. Mount. Bioinformatics. Sequence and Genome Analysis. NY, Cold Spring Harbor, 2001. A. D. Baxevanis, B. F. F. Ouellette (eds. ). Bioinformatics. A Practical Guide to the Analysis of Genes and Proteins. NJ, Wiley, 2005. Обзоры и статьи

Выравнивание последовательностей: классификация Выравнивание последовательностей Парное Локальное Глобальное Множественное

Выравнивание последовательностей: классификация Выравнивание последовательностей Парное Локальное Глобальное Множественное

Множественное выравнивание (multiple alignment)

Множественное выравнивание (multiple alignment)

Множественное выравнивание: содержание ♦ Определение, разновидности, решаемые задачи, общие проблемы ♦ Глобальное выравнивание ♦ Оценка качества выравнивания ♦ Структурное выравнивание ♦ Прогрессивное выравнивание ♦ Итерационные методы ♦ Локальные множественные выравнивания ♦ Вероятностно-статистические методы множественного выравнивания

Множественное выравнивание: содержание ♦ Определение, разновидности, решаемые задачи, общие проблемы ♦ Глобальное выравнивание ♦ Оценка качества выравнивания ♦ Структурное выравнивание ♦ Прогрессивное выравнивание ♦ Итерационные методы ♦ Локальные множественные выравнивания ♦ Вероятностно-статистические методы множественного выравнивания

Множественное выравнивание: введение

Множественное выравнивание: введение

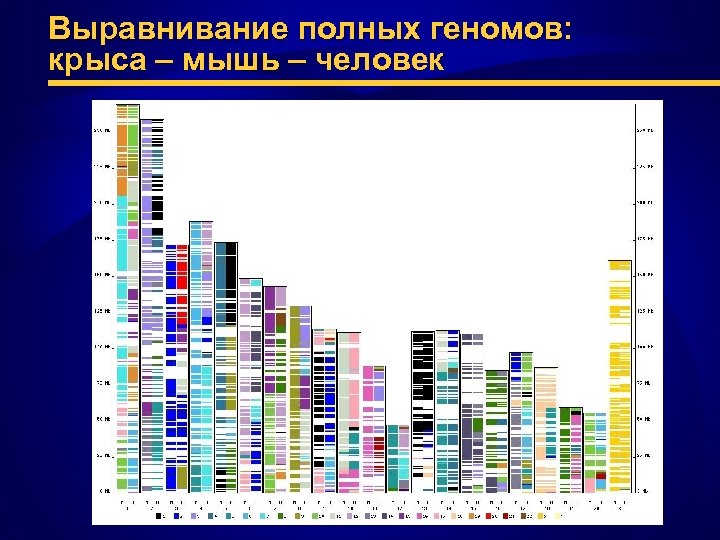

Выравнивание полных геномов: крыса – мышь – человек

Выравнивание полных геномов: крыса – мышь – человек

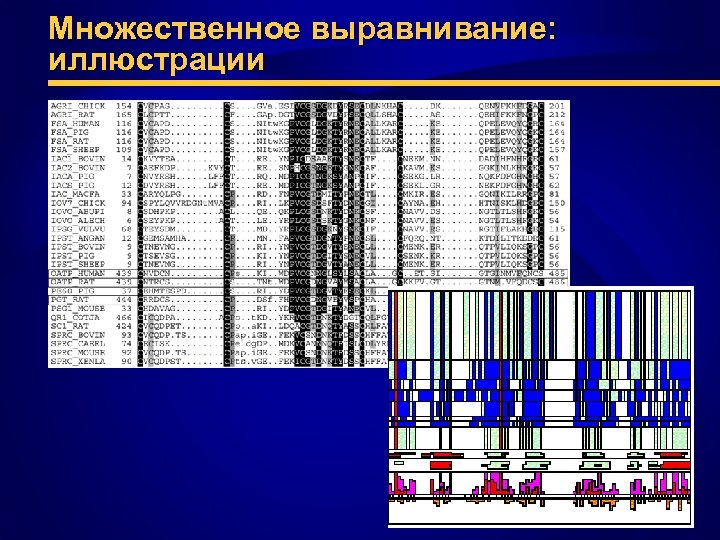

Множественное выравнивание: иллюстрации

Множественное выравнивание: иллюстрации

Множественное выравнивание: определение и проблемы ♦ Определение: найти оптимальное соответствие между несколькими последовательностями, если заданы – – – Матрица соответствия Штраф за делецию Функция веса выравнивания ♦ Проблемы: – Множество делеций, замен, … – Ограниченное обобщение метода динамического программирования – Подсчет суммарного веса замен в колонке – Размещение делеций в разных пос-стях и штрафы за них

Множественное выравнивание: определение и проблемы ♦ Определение: найти оптимальное соответствие между несколькими последовательностями, если заданы – – – Матрица соответствия Штраф за делецию Функция веса выравнивания ♦ Проблемы: – Множество делеций, замен, … – Ограниченное обобщение метода динамического программирования – Подсчет суммарного веса замен в колонке – Размещение делеций в разных пос-стях и штрафы за них

Множественное выравнивание: проблемы (прод. ) ♦ Проблемы: – Локальные минимумы • накопление первоначальных ошибок в иерархических алгоритмах • лучшее дерево соответствует лучшему выравниванию – Выбор параметров • один набор параметров не может быть пригодным на все случаи жизни ♦ Сложности выравнивания нарастают с ростом различий между последовательностями

Множественное выравнивание: проблемы (прод. ) ♦ Проблемы: – Локальные минимумы • накопление первоначальных ошибок в иерархических алгоритмах • лучшее дерево соответствует лучшему выравниванию – Выбор параметров • один набор параметров не может быть пригодным на все случаи жизни ♦ Сложности выравнивания нарастают с ростом различий между последовательностями

Множественное выравнивание: три решаемые задачи ♦ Поиск мотивов (блоков) – коротких сигнатур, идентифицируемых в консервативных участках множественного выравнивания – отсутствие вставок и делеций ♦ Построение профилей (матриц весов): оценка частоты встречаемости каждой АК в каждой позиции ♦ Построение скрытых марковских моделей (HMM) – обобщенных профилей, описываемых строго математически

Множественное выравнивание: три решаемые задачи ♦ Поиск мотивов (блоков) – коротких сигнатур, идентифицируемых в консервативных участках множественного выравнивания – отсутствие вставок и делеций ♦ Построение профилей (матриц весов): оценка частоты встречаемости каждой АК в каждой позиции ♦ Построение скрытых марковских моделей (HMM) – обобщенных профилей, описываемых строго математически

Множественное выравнивание: области применения (1/2) ♦ Один из ключевых методов в современной молекулярной биологии ♦ Сферы применения – – – Филогенетический анализ, «эволюция» пос-сти Предсказание вторичной/третичной структуры белков Выявление АК-остатков (консервативных участков) • экспонированных на поверхности белка • формирующих активный центр • обеспечивающих субстратную специфичность • критичных для стабилизации втор. /трет. структуры Выявление характерных фрагментов для описания белковых семейств Выявление неизвестных ранее гомологий между генами и последовательностями Длинные пос-сти из случайных коротких фрагментов

Множественное выравнивание: области применения (1/2) ♦ Один из ключевых методов в современной молекулярной биологии ♦ Сферы применения – – – Филогенетический анализ, «эволюция» пос-сти Предсказание вторичной/третичной структуры белков Выявление АК-остатков (консервативных участков) • экспонированных на поверхности белка • формирующих активный центр • обеспечивающих субстратную специфичность • критичных для стабилизации втор. /трет. структуры Выявление характерных фрагментов для описания белковых семейств Выявление неизвестных ранее гомологий между генами и последовательностями Длинные пос-сти из случайных коротких фрагментов

Множественное выравнивание и филогенетический анализ ♦ Идея – минимизация числа мутаций ♦ Что сначала: выравнивание или дерево? ♦ Решение не единственно !

Множественное выравнивание и филогенетический анализ ♦ Идея – минимизация числа мутаций ♦ Что сначала: выравнивание или дерево? ♦ Решение не единственно !

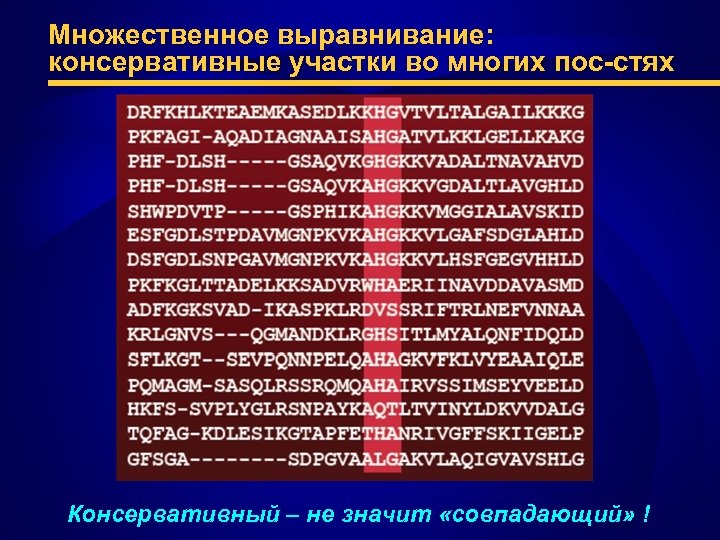

Множественное выравнивание: консервативные участки во многих пос-стях Консервативный – не значит «совпадающий» !

Множественное выравнивание: консервативные участки во многих пос-стях Консервативный – не значит «совпадающий» !

Множественное выравнивание: белки vs. ДНК ♦ Выравнивание белковых семейств – В алфавите много «букв» – Эволюционная близость белковых молекул, основа для филогенетических деревьев • какие события привели к возникновению данного семейства? – Идентификация функционально важных областей – Данные для предсказания структуры – Очевидный «золотой стандарт» ♦ Выравнивание некодирующих участков ДНК – Консервативные участки, отвечающие за регуляцию экспрессии – Установление эволюционной близости – Идентификация функционально важных областей – Трудно определяемый «золотой стандарт»

Множественное выравнивание: белки vs. ДНК ♦ Выравнивание белковых семейств – В алфавите много «букв» – Эволюционная близость белковых молекул, основа для филогенетических деревьев • какие события привели к возникновению данного семейства? – Идентификация функционально важных областей – Данные для предсказания структуры – Очевидный «золотой стандарт» ♦ Выравнивание некодирующих участков ДНК – Консервативные участки, отвечающие за регуляцию экспрессии – Установление эволюционной близости – Идентификация функционально важных областей – Трудно определяемый «золотой стандарт»

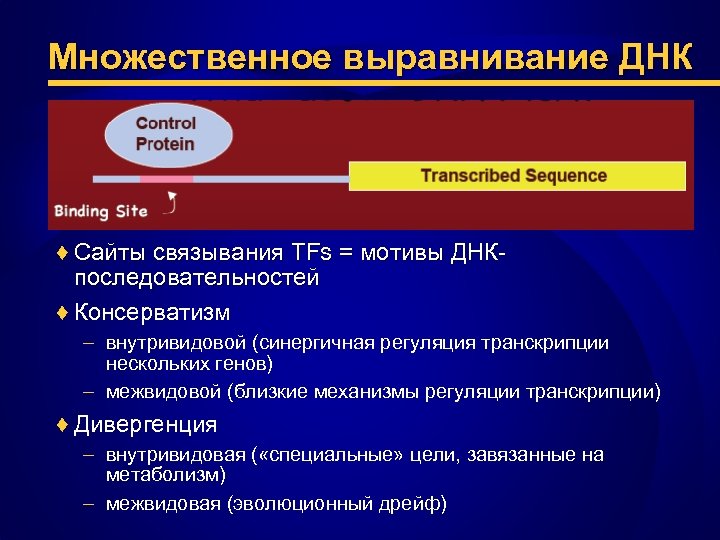

Множественное выравнивание ДНК ♦ Сайты связывания TFs = мотивы ДНКпоследовательностей ♦ Консерватизм – внутривидовой (синергичная регуляция транскрипции нескольких генов) – межвидовой (близкие механизмы регуляции транскрипции) ♦ Дивергенция – внутривидовая ( «специальные» цели, завязанные на метаболизм) – межвидовая (эволюционный дрейф)

Множественное выравнивание ДНК ♦ Сайты связывания TFs = мотивы ДНКпоследовательностей ♦ Консерватизм – внутривидовой (синергичная регуляция транскрипции нескольких генов) – межвидовой (близкие механизмы регуляции транскрипции) ♦ Дивергенция – внутривидовая ( «специальные» цели, завязанные на метаболизм) – межвидовая (эволюционный дрейф)

Множественное выравнивание ДНК: проблемы и варианты решения ♦ Гораздо сложнее выравнивания белков – всего 4 «буквы» ♦ Отсутствие «золотого стандарта» ♦ Необходимость оценить – способность связывать белки – влияние на функцию ♦ Смысл – тестирование гипотез – об общем предке – об общих механизмах связывания белков – о близости функций ♦ Эффективны вероятностно-статистические методы – выборки Гиббса – максимизация энтропии

Множественное выравнивание ДНК: проблемы и варианты решения ♦ Гораздо сложнее выравнивания белков – всего 4 «буквы» ♦ Отсутствие «золотого стандарта» ♦ Необходимость оценить – способность связывать белки – влияние на функцию ♦ Смысл – тестирование гипотез – об общем предке – об общих механизмах связывания белков – о близости функций ♦ Эффективны вероятностно-статистические методы – выборки Гиббса – максимизация энтропии

Множественное выравнивание: четыре группы методов ♦ Прогрессивное глобальное выравнивание – начать с наиболее близких пос-стей ♦ Итерационные процедуры – выравнивание групп пос-стей с последующей оптимизацией ♦ Выравнивание по локальным консервативным участкам – построение профилей (разновидности матрицы весов) – поиск блоков в пос-стях (выравниваний без делеций) ♦ Статистические методы и вероятностные модели – поиск шаблонов (patterns) – скрытые марковские модели

Множественное выравнивание: четыре группы методов ♦ Прогрессивное глобальное выравнивание – начать с наиболее близких пос-стей ♦ Итерационные процедуры – выравнивание групп пос-стей с последующей оптимизацией ♦ Выравнивание по локальным консервативным участкам – построение профилей (разновидности матрицы весов) – поиск блоков в пос-стях (выравниваний без делеций) ♦ Статистические методы и вероятностные модели – поиск шаблонов (patterns) – скрытые марковские модели

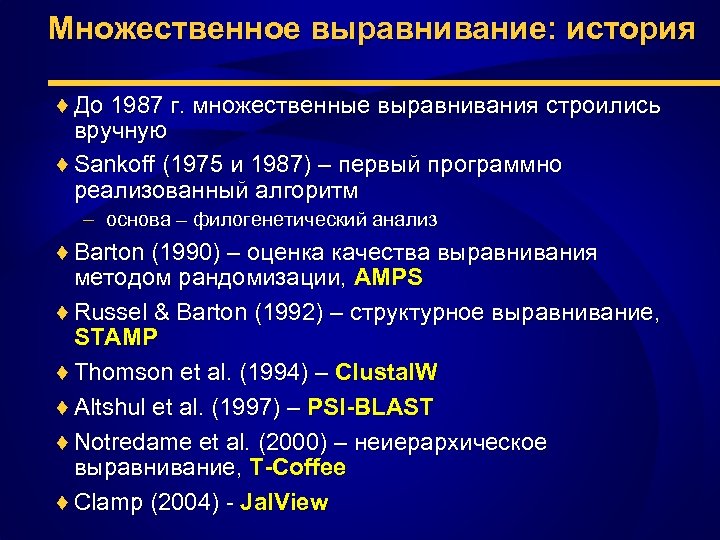

Множественное выравнивание: история ♦ До 1987 г. множественные выравнивания строились вручную ♦ Sankoff (1975 и 1987) – первый программно реализованный алгоритм – основа – филогенетический анализ ♦ Barton (1990) – оценка качества выравнивания методом рандомизации, AMPS ♦ Russel & Barton (1992) – структурное выравнивание, STAMP ♦ Thomson et al. (1994) – Clustal. W ♦ Altshul et al. (1997) – PSI-BLAST ♦ Notredame et al. (2000) – неиерархическое выравнивание, T-Coffee ♦ Clamp (2004) - Jal. View

Множественное выравнивание: история ♦ До 1987 г. множественные выравнивания строились вручную ♦ Sankoff (1975 и 1987) – первый программно реализованный алгоритм – основа – филогенетический анализ ♦ Barton (1990) – оценка качества выравнивания методом рандомизации, AMPS ♦ Russel & Barton (1992) – структурное выравнивание, STAMP ♦ Thomson et al. (1994) – Clustal. W ♦ Altshul et al. (1997) – PSI-BLAST ♦ Notredame et al. (2000) – неиерархическое выравнивание, T-Coffee ♦ Clamp (2004) - Jal. View

Глобальное выравнивание (обобщение ДП)

Глобальное выравнивание (обобщение ДП)

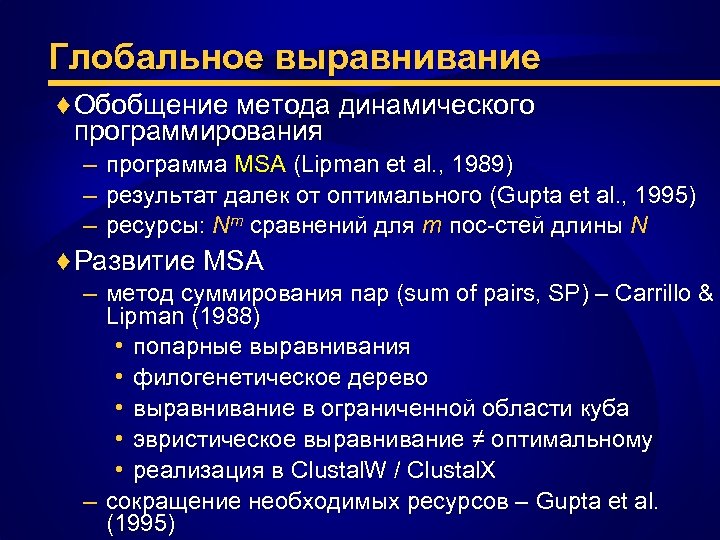

Глобальное выравнивание ♦ Обобщение метода динамического программирования – – – программа MSA (Lipman et al. , 1989) результат далек от оптимального (Gupta et al. , 1995) ресурсы: Nm сравнений для m пос-стей длины N ♦ Развитие MSA – метод суммирования пар (sum of pairs, SP) – Carrillo & Lipman (1988) • попарные выравнивания • филогенетическое дерево • выравнивание в ограниченной области куба • эвристическое выравнивание ≠ оптимальному • реализация в Clustal. W / Clustal. X – сокращение необходимых ресурсов – Gupta et al. (1995)

Глобальное выравнивание ♦ Обобщение метода динамического программирования – – – программа MSA (Lipman et al. , 1989) результат далек от оптимального (Gupta et al. , 1995) ресурсы: Nm сравнений для m пос-стей длины N ♦ Развитие MSA – метод суммирования пар (sum of pairs, SP) – Carrillo & Lipman (1988) • попарные выравнивания • филогенетическое дерево • выравнивание в ограниченной области куба • эвристическое выравнивание ≠ оптимальному • реализация в Clustal. W / Clustal. X – сокращение необходимых ресурсов – Gupta et al. (1995)

Множественное выравнивание: трехмерное динамическое программирование

Множественное выравнивание: трехмерное динамическое программирование

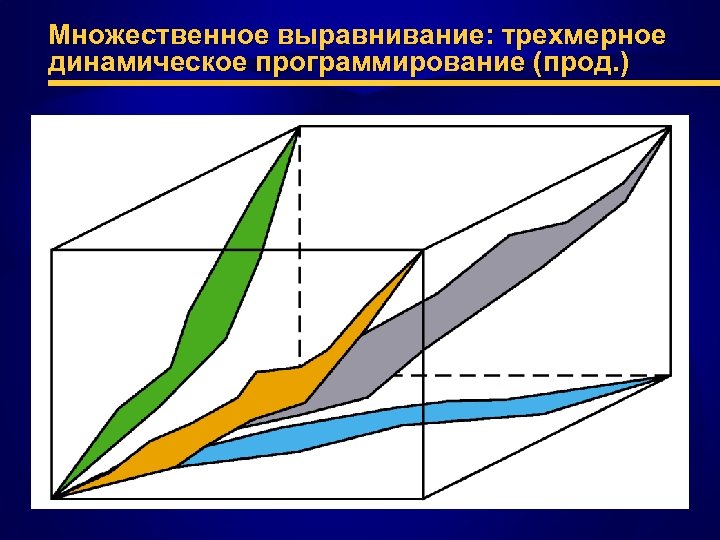

Множественное выравнивание: трехмерное динамическое программирование (прод. )

Множественное выравнивание: трехмерное динамическое программирование (прод. )

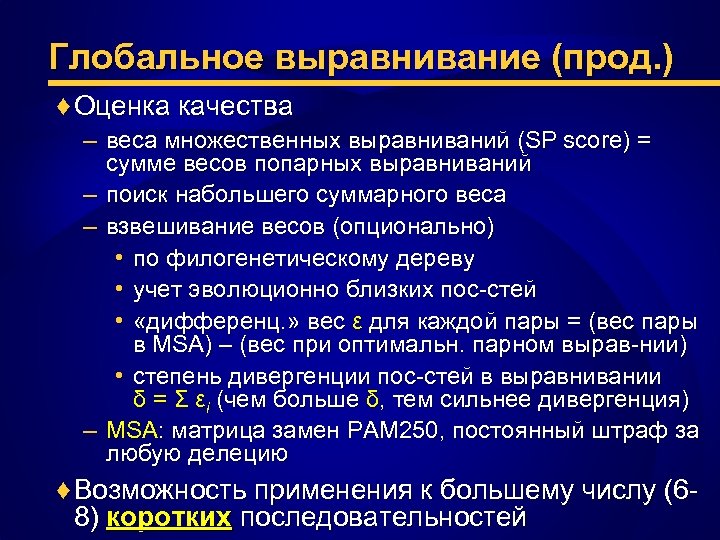

Глобальное выравнивание (прод. ) ♦ Оценка качества – веса множественных выравниваний (SP score) = сумме весов попарных выравниваний – поиск набольшего суммарного веса – взвешивание весов (опционально) • по филогенетическому дереву • учет эволюционно близких пос-стей • «дифференц. » вес ε для каждой пары = (вес пары в MSA) – (вес при оптимальн. парном вырав-нии) • степень дивергенции пос-стей в выравнивании δ = Σ εi (чем больше δ, тем сильнее дивергенция) – MSA: матрица замен PAM 250, постоянный штраф за любую делецию ♦ Возможность применения к большему числу (68) коротких последовательностей

Глобальное выравнивание (прод. ) ♦ Оценка качества – веса множественных выравниваний (SP score) = сумме весов попарных выравниваний – поиск набольшего суммарного веса – взвешивание весов (опционально) • по филогенетическому дереву • учет эволюционно близких пос-стей • «дифференц. » вес ε для каждой пары = (вес пары в MSA) – (вес при оптимальн. парном вырав-нии) • степень дивергенции пос-стей в выравнивании δ = Σ εi (чем больше δ, тем сильнее дивергенция) – MSA: матрица замен PAM 250, постоянный штраф за любую делецию ♦ Возможность применения к большему числу (68) коротких последовательностей

Оценка качества

Оценка качества

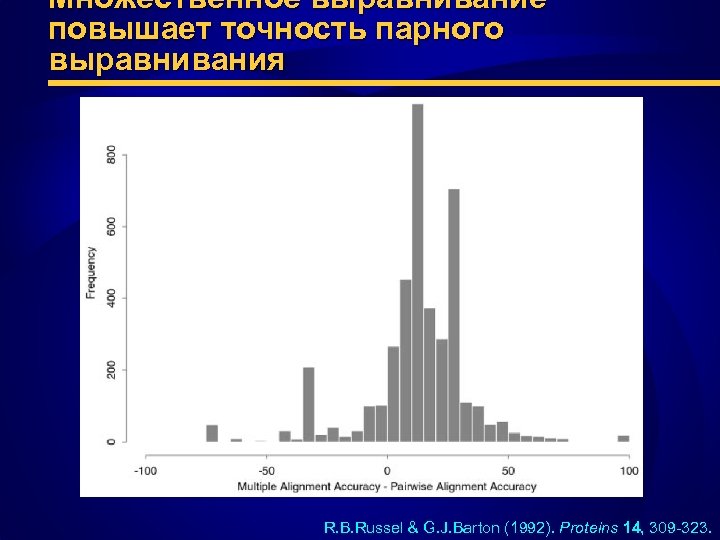

Множественное выравнивание повышает точность парного выравнивания R. B. Russel & G. J. Barton (1992). Proteins 14, 309 -323.

Множественное выравнивание повышает точность парного выравнивания R. B. Russel & G. J. Barton (1992). Proteins 14, 309 -323.

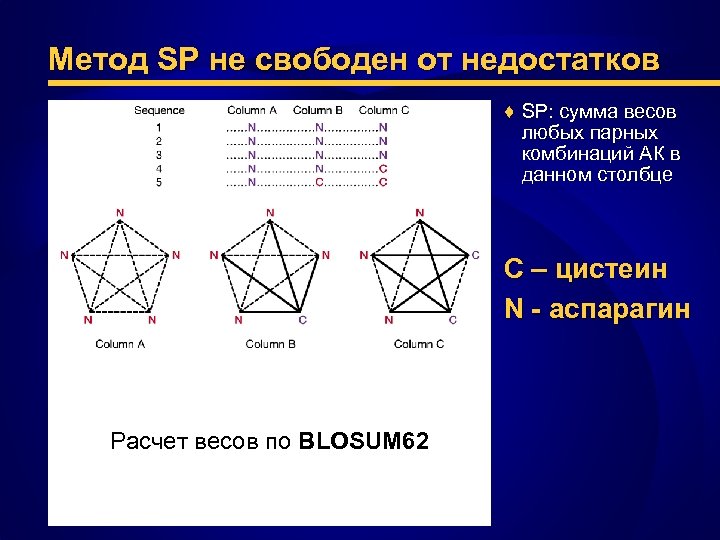

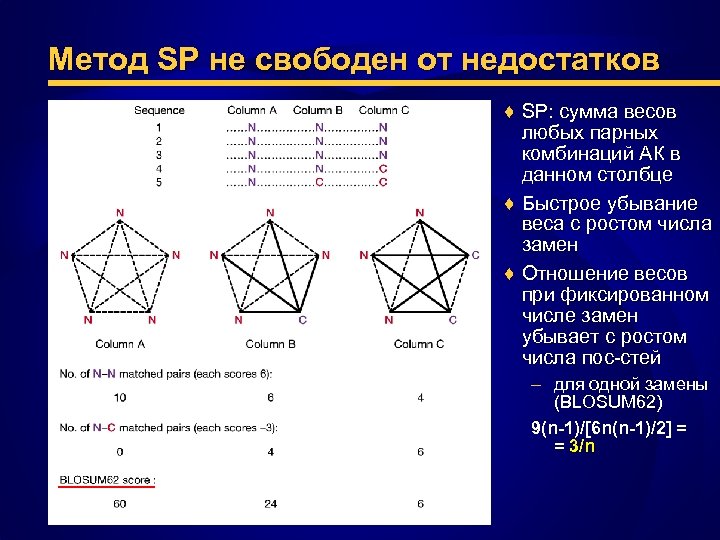

Метод SP не свободен от недостатков ♦ SP: сумма весов любых парных комбинаций АК в данном столбце C – цистеин N - аспарагин Расчет весов по BLOSUM 62

Метод SP не свободен от недостатков ♦ SP: сумма весов любых парных комбинаций АК в данном столбце C – цистеин N - аспарагин Расчет весов по BLOSUM 62

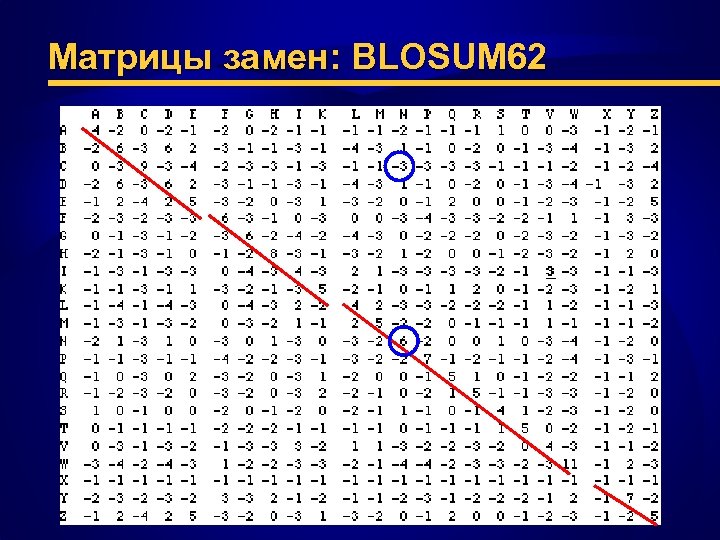

Матрицы замен: BLOSUM 62

Матрицы замен: BLOSUM 62

Метод SP не свободен от недостатков ♦ SP: сумма весов любых парных комбинаций АК в данном столбце ♦ Быстрое убывание веса с ростом числа замен ♦ Отношение весов при фиксированном числе замен убывает с ростом числа пос-стей – для одной замены (BLOSUM 62) 9(n-1)/[6 n(n-1)/2] = = 3/n

Метод SP не свободен от недостатков ♦ SP: сумма весов любых парных комбинаций АК в данном столбце ♦ Быстрое убывание веса с ростом числа замен ♦ Отношение весов при фиксированном числе замен убывает с ростом числа пос-стей – для одной замены (BLOSUM 62) 9(n-1)/[6 n(n-1)/2] = = 3/n

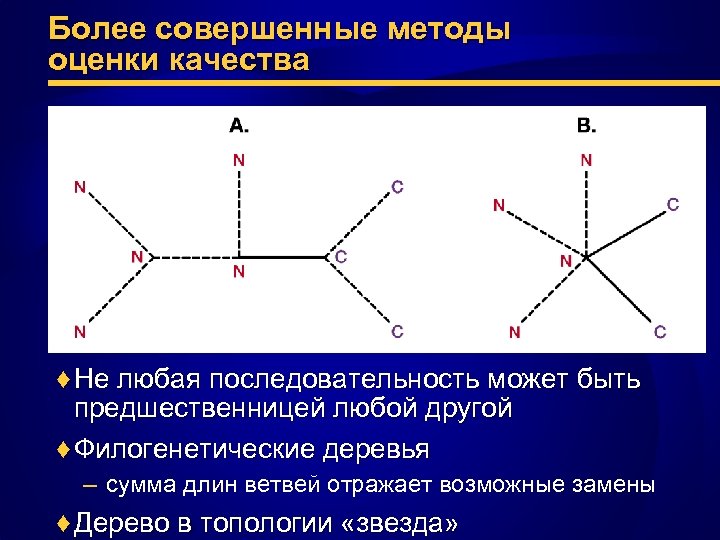

Более совершенные методы оценки качества ♦ Не любая последовательность может быть предшественницей любой другой ♦ Филогенетические деревья – сумма длин ветвей отражает возможные замены ♦ Дерево в топологии «звезда»

Более совершенные методы оценки качества ♦ Не любая последовательность может быть предшественницей любой другой ♦ Филогенетические деревья – сумма длин ветвей отражает возможные замены ♦ Дерево в топологии «звезда»

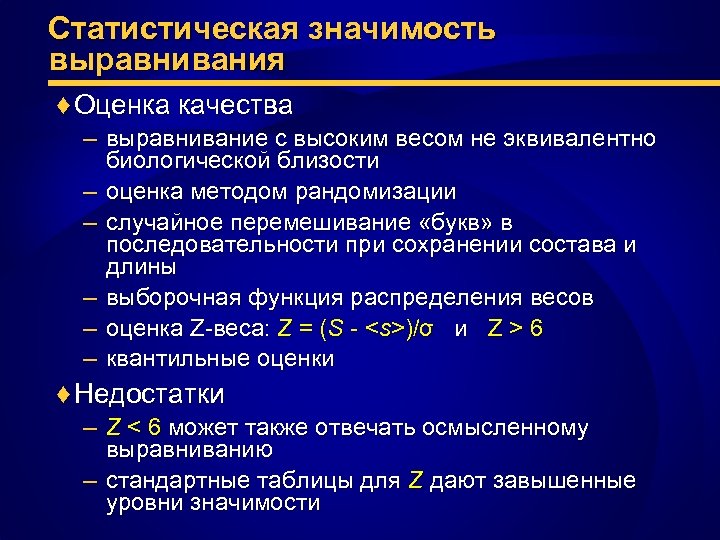

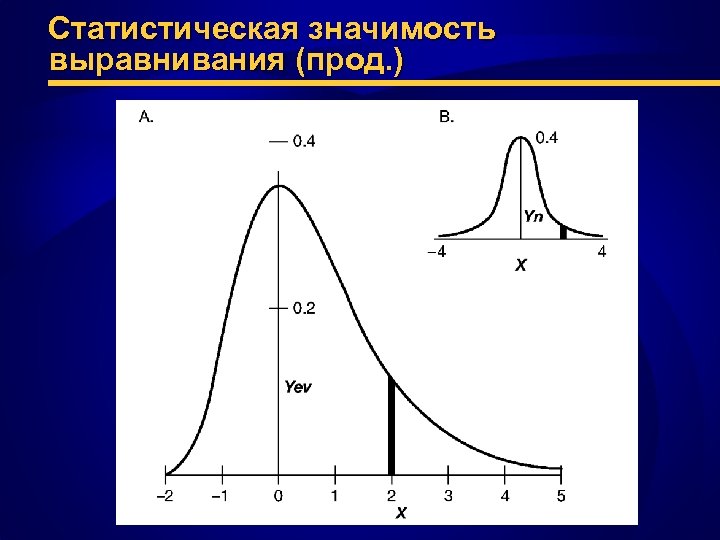

Статистическая значимость выравнивания ♦ Оценка качества – выравнивание с высоким весом не эквивалентно биологической близости – оценка методом рандомизации – случайное перемешивание «букв» в последовательности при сохранении состава и длины – выборочная функция распределения весов – оценка Z-веса: Z = (S -

Статистическая значимость выравнивания ♦ Оценка качества – выравнивание с высоким весом не эквивалентно биологической близости – оценка методом рандомизации – случайное перемешивание «букв» в последовательности при сохранении состава и длины – выборочная функция распределения весов – оценка Z-веса: Z = (S - )/σ и Z > 6 – квантильные оценки ♦ Недостатки – Z < 6 может также отвечать осмысленному выравниванию – стандартные таблицы для Z дают завышенные уровни значимости

Статистическая значимость выравнивания (прод. )

Статистическая значимость выравнивания (прод. )

Структурное выравнивание

Структурное выравнивание

Структурное выравнивание: зачем? ♦ Применения – «золотой стандарт» для выравнивания высоко гомологичных белков – выявление общего предка – идентификация общих значимых элементов структуры для негомологичных белков – кластеризация белков (разбиение на белковые семейства) на основе структурной близости ♦ Выравнивание должно отражать сходство структур – совпадение общих структурных и функциональных элементов ♦ Проблема: оптимум в вычислениях ≠ оптимуму в биологии

Структурное выравнивание: зачем? ♦ Применения – «золотой стандарт» для выравнивания высоко гомологичных белков – выявление общего предка – идентификация общих значимых элементов структуры для негомологичных белков – кластеризация белков (разбиение на белковые семейства) на основе структурной близости ♦ Выравнивание должно отражать сходство структур – совпадение общих структурных и функциональных элементов ♦ Проблема: оптимум в вычислениях ≠ оптимуму в биологии

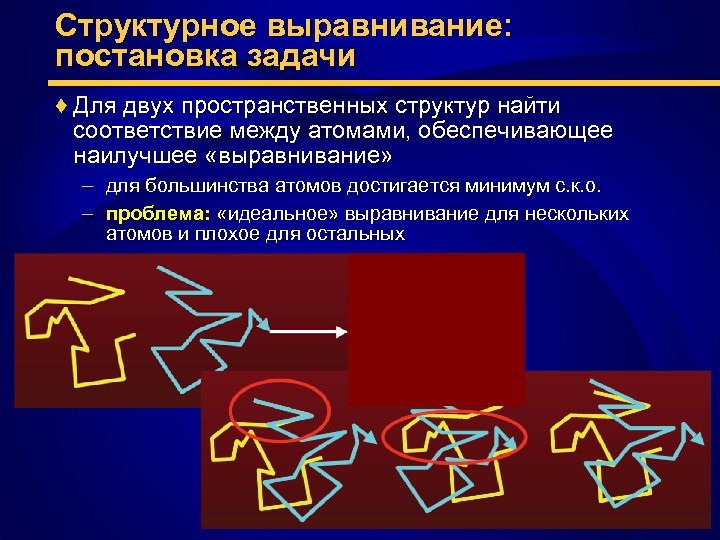

Структурное выравнивание: постановка задачи ♦ Для двух пространственных структур найти соответствие между атомами, обеспечивающее наилучшее «выравнивание» – – для большинства атомов достигается минимум с. к. о. проблема: «идеальное» выравнивание для нескольких атомов и плохое для остальных

Структурное выравнивание: постановка задачи ♦ Для двух пространственных структур найти соответствие между атомами, обеспечивающее наилучшее «выравнивание» – – для большинства атомов достигается минимум с. к. о. проблема: «идеальное» выравнивание для нескольких атомов и плохое для остальных

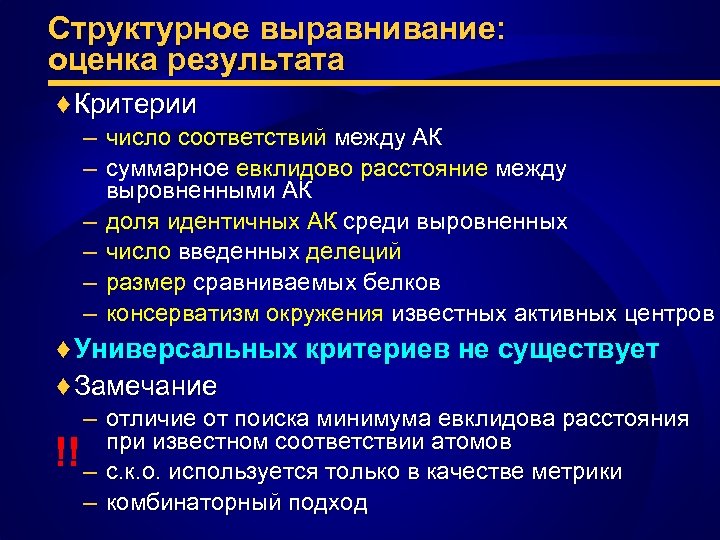

Структурное выравнивание: оценка результата ♦ Критерии – число соответствий между АК – суммарное евклидово расстояние между выровненными АК – доля идентичных АК среди выровненных – число введенных делеций – размер сравниваемых белков – консерватизм окружения известных активных центров ♦ Универсальных критериев не существует ♦ Замечание !! – отличие от поиска минимума евклидова расстояния при известном соответствии атомов – с. к. о. используется только в качестве метрики – комбинаторный подход

Структурное выравнивание: оценка результата ♦ Критерии – число соответствий между АК – суммарное евклидово расстояние между выровненными АК – доля идентичных АК среди выровненных – число введенных делеций – размер сравниваемых белков – консерватизм окружения известных активных центров ♦ Универсальных критериев не существует ♦ Замечание !! – отличие от поиска минимума евклидова расстояния при известном соответствии атомов – с. к. о. используется только в качестве метрики – комбинаторный подход

Структурное выравнивание: наложение пространственных структур Наложение на усредненную структуру

Структурное выравнивание: наложение пространственных структур Наложение на усредненную структуру

Структурное выравнивание: наложение пространственных структур

Структурное выравнивание: наложение пространственных структур

Структурное выравнивание: различные классы белковых структур (1)

Структурное выравнивание: различные классы белковых структур (1)

Структурное выравнивание: различные классы белковых структур (2)

Структурное выравнивание: различные классы белковых структур (2)

Структурное выравнивание: различные классы белковых структур (3) Разные суперсемейства «бочонков»

Структурное выравнивание: различные классы белковых структур (3) Разные суперсемейства «бочонков»

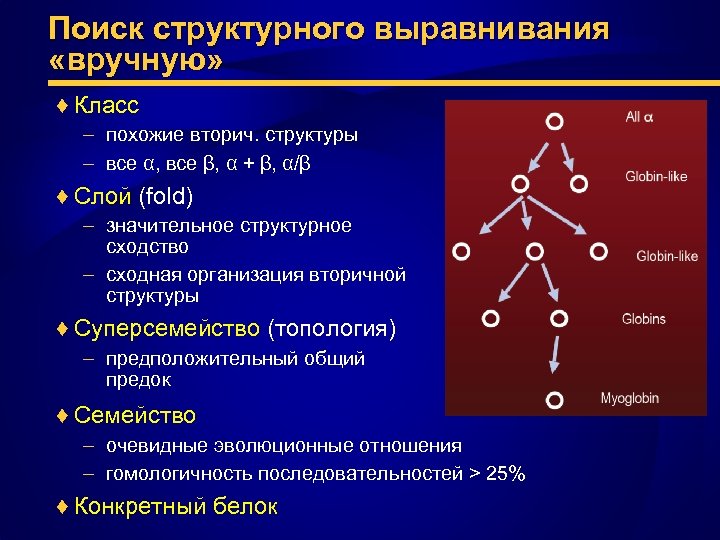

Поиск структурного выравнивания «вручную» ♦ Класс – похожие вторич. структуры – все α, все β, α + β, α/β ♦ Слой (fold) – значительное структурное сходство – сходная организация вторичной структуры ♦ Суперсемейство (топология) – предположительный общий предок ♦ Семейство – очевидные эволюционные отношения – гомологичность последовательностей > 25% ♦ Конкретный белок

Поиск структурного выравнивания «вручную» ♦ Класс – похожие вторич. структуры – все α, все β, α + β, α/β ♦ Слой (fold) – значительное структурное сходство – сходная организация вторичной структуры ♦ Суперсемейство (топология) – предположительный общий предок ♦ Семейство – очевидные эволюционные отношения – гомологичность последовательностей > 25% ♦ Конкретный белок

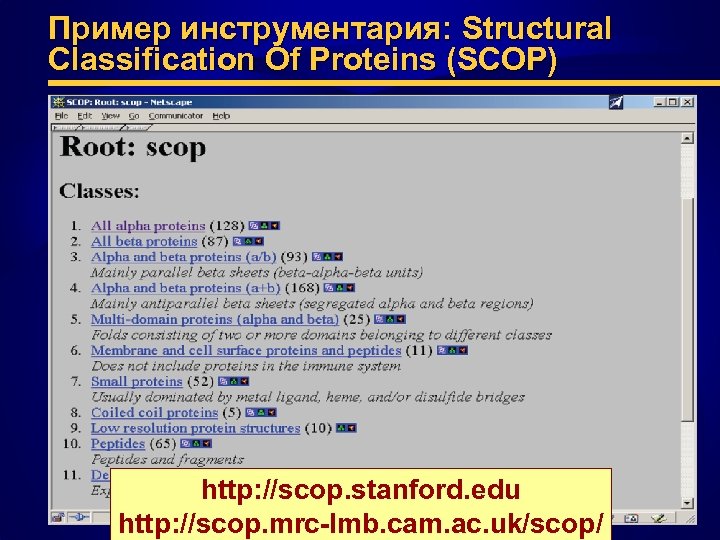

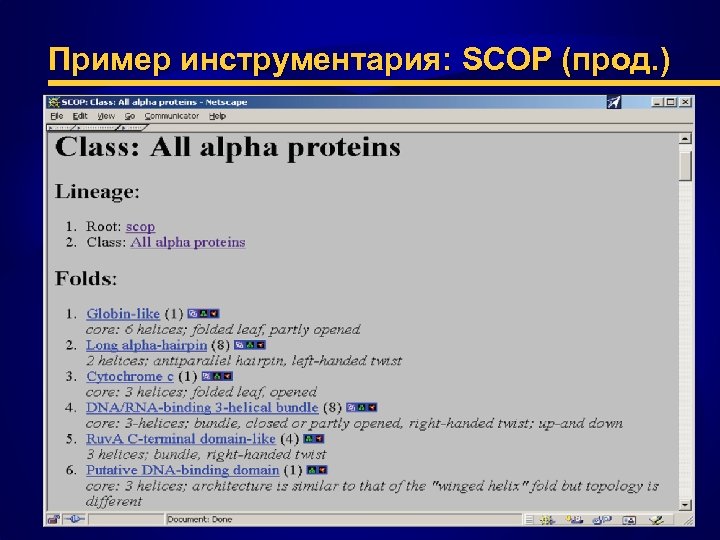

Пример инструментария: Structural Classification Of Proteins (SCOP) http: //scop. stanford. edu http: //scop. mrc-lmb. cam. ac. uk/scop/

Пример инструментария: Structural Classification Of Proteins (SCOP) http: //scop. stanford. edu http: //scop. mrc-lmb. cam. ac. uk/scop/

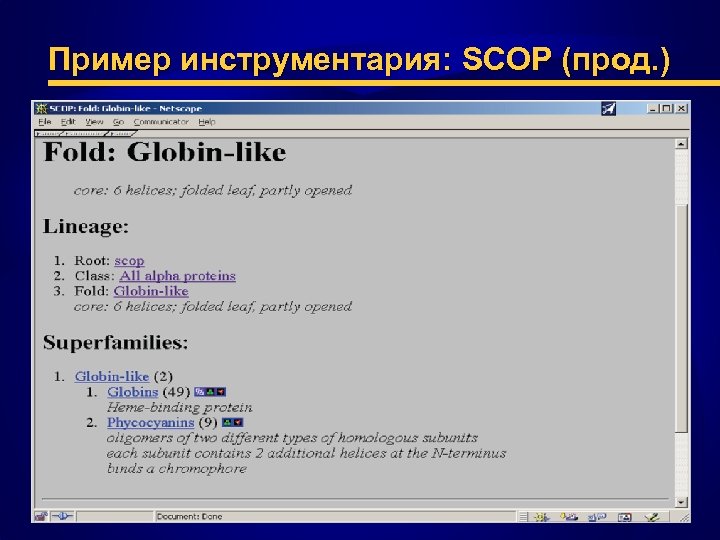

Пример инструментария: SCOP (прод. )

Пример инструментария: SCOP (прод. )

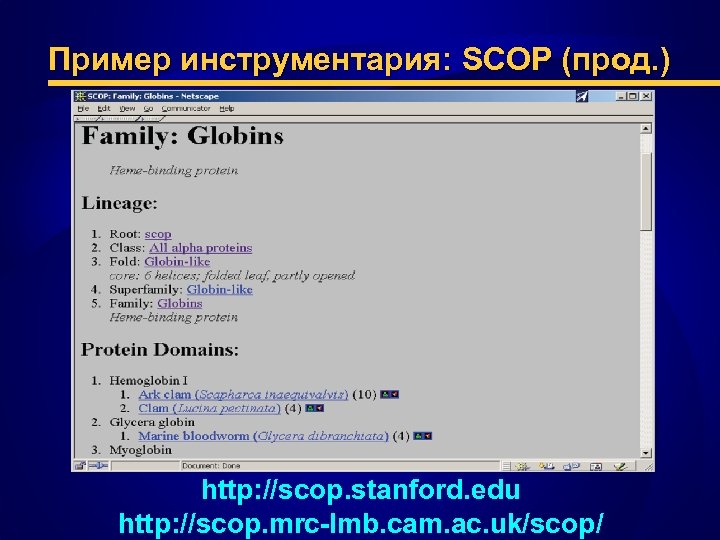

Пример инструментария: SCOP (прод. )

Пример инструментария: SCOP (прод. )

Пример инструментария: SCOP (прод. ) http: //scop. stanford. edu http: //scop. mrc-lmb. cam. ac. uk/scop/

Пример инструментария: SCOP (прод. ) http: //scop. stanford. edu http: //scop. mrc-lmb. cam. ac. uk/scop/

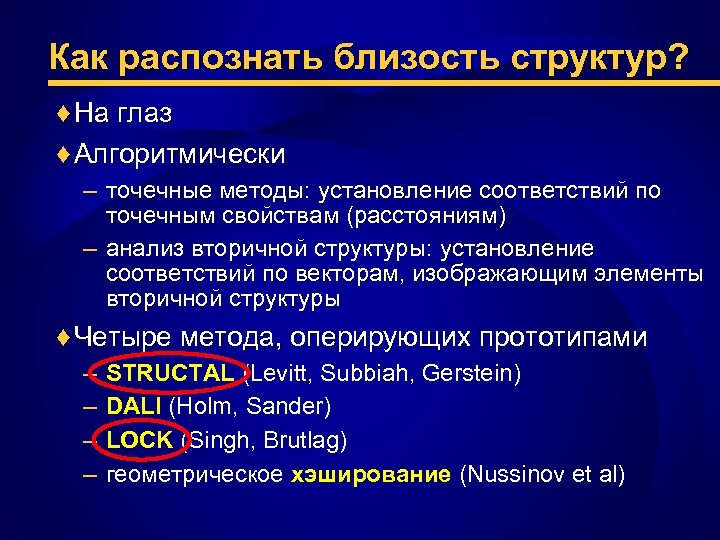

Как распознать близость структур? ♦ На глаз ♦ Алгоритмически – точечные методы: установление соответствий по точечным свойствам (расстояниям) – анализ вторичной структуры: установление соответствий по векторам, изображающим элементы вторичной структуры ♦ Четыре метода, оперирующих прототипами – – STRUCTAL (Levitt, Subbiah, Gerstein) DALI (Holm, Sander) LOCK (Singh, Brutlag) геометрическое хэширование (Nussinov et al)

Как распознать близость структур? ♦ На глаз ♦ Алгоритмически – точечные методы: установление соответствий по точечным свойствам (расстояниям) – анализ вторичной структуры: установление соответствий по векторам, изображающим элементы вторичной структуры ♦ Четыре метода, оперирующих прототипами – – STRUCTAL (Levitt, Subbiah, Gerstein) DALI (Holm, Sander) LOCK (Singh, Brutlag) геометрическое хэширование (Nussinov et al)

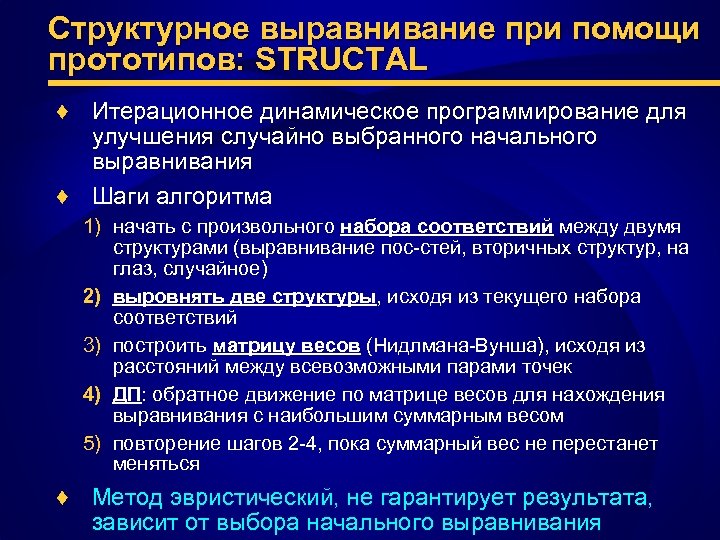

Структурное выравнивание при помощи прототипов: STRUCTAL ♦ Итерационное динамическое программирование для улучшения случайно выбранного начального выравнивания ♦ Шаги алгоритма 1) начать с произвольного набора соответствий между двумя структурами (выравнивание пос-стей, вторичных структур, на глаз, случайное) 2) выровнять две структуры, исходя из текущего набора соответствий 3) построить матрицу весов (Нидлмана-Вунша), исходя из расстояний между всевозможными парами точек 4) ДП: обратное движение по матрице весов для нахождения выравнивания с наибольшим суммарным весом 5) повторение шагов 2 -4, пока суммарный вес не перестанет меняться ♦ Метод эвристический, не гарантирует результата, зависит от выбора начального выравнивания

Структурное выравнивание при помощи прототипов: STRUCTAL ♦ Итерационное динамическое программирование для улучшения случайно выбранного начального выравнивания ♦ Шаги алгоритма 1) начать с произвольного набора соответствий между двумя структурами (выравнивание пос-стей, вторичных структур, на глаз, случайное) 2) выровнять две структуры, исходя из текущего набора соответствий 3) построить матрицу весов (Нидлмана-Вунша), исходя из расстояний между всевозможными парами точек 4) ДП: обратное движение по матрице весов для нахождения выравнивания с наибольшим суммарным весом 5) повторение шагов 2 -4, пока суммарный вес не перестанет меняться ♦ Метод эвристический, не гарантирует результата, зависит от выбора начального выравнивания

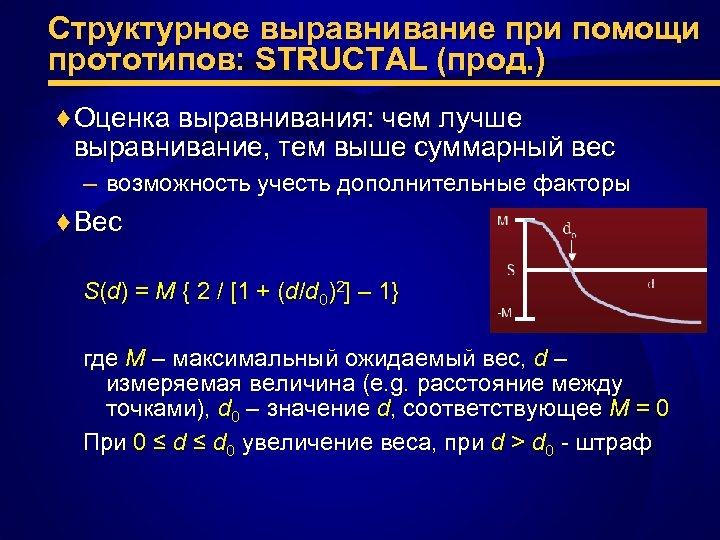

Структурное выравнивание при помощи прототипов: STRUCTAL (прод. ) ♦ Оценка выравнивания: чем лучше выравнивание, тем выше суммарный вес – возможность учесть дополнительные факторы ♦ Вес S(d) = M { 2 / [1 + (d/d 0)2] – 1} где M – максимальный ожидаемый вес, d – измеряемая величина (e. g. расстояние между точками), d 0 – значение d, соответствующее M = 0 При 0 ≤ d 0 увеличение веса, при d > d 0 - штраф

Структурное выравнивание при помощи прототипов: STRUCTAL (прод. ) ♦ Оценка выравнивания: чем лучше выравнивание, тем выше суммарный вес – возможность учесть дополнительные факторы ♦ Вес S(d) = M { 2 / [1 + (d/d 0)2] – 1} где M – максимальный ожидаемый вес, d – измеряемая величина (e. g. расстояние между точками), d 0 – значение d, соответствующее M = 0 При 0 ≤ d 0 увеличение веса, при d > d 0 - штраф

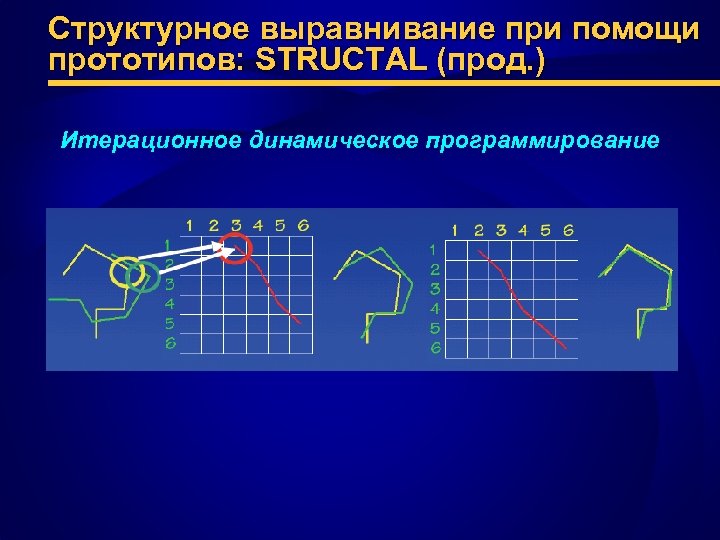

Структурное выравнивание при помощи прототипов: STRUCTAL (прод. ) Итерационное динамическое программирование

Структурное выравнивание при помощи прототипов: STRUCTAL (прод. ) Итерационное динамическое программирование

Структурное выравнивание при помощи прототипов: STRUCTAL (прод. )

Структурное выравнивание при помощи прототипов: STRUCTAL (прод. )

Структурное выравнивание при помощи прототипов: LOCK ♦ Основная идея: – элементы вторичной структуры представляются при помощи векторов – быстрый поиск похожих структур

Структурное выравнивание при помощи прототипов: LOCK ♦ Основная идея: – элементы вторичной структуры представляются при помощи векторов – быстрый поиск похожих структур

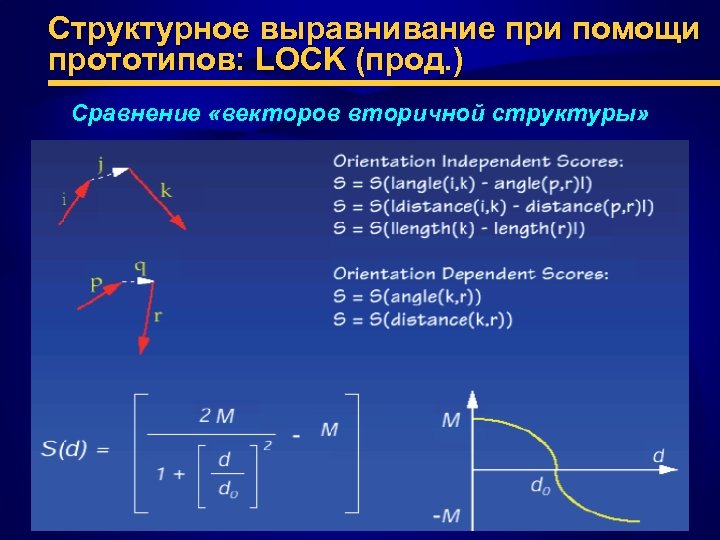

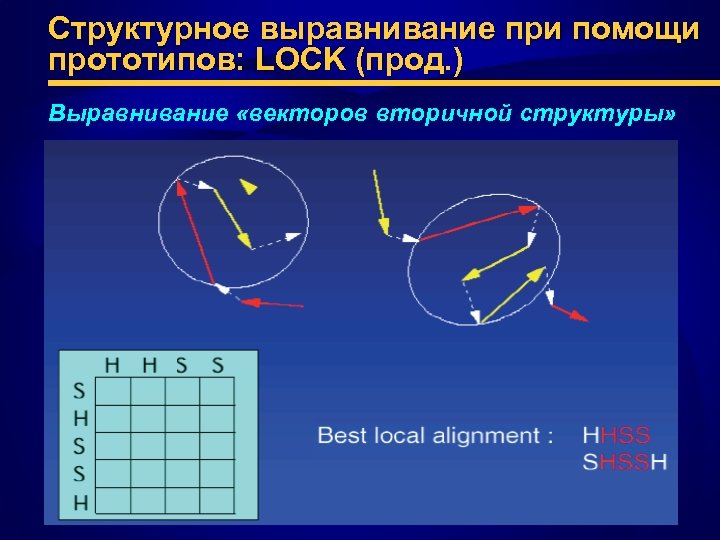

Структурное выравнивание при помощи прототипов: LOCK (прод. ) Сравнение «векторов вторичной структуры»

Структурное выравнивание при помощи прототипов: LOCK (прод. ) Сравнение «векторов вторичной структуры»

Структурное выравнивание при помощи прототипов: LOCK (прод. ) Выравнивание «векторов вторичной структуры»

Структурное выравнивание при помощи прототипов: LOCK (прод. ) Выравнивание «векторов вторичной структуры»

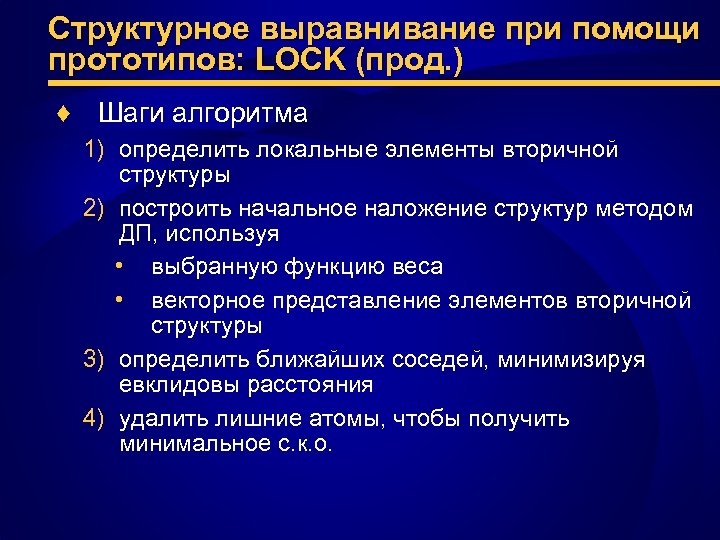

Структурное выравнивание при помощи прототипов: LOCK (прод. ) ♦ Шаги алгоритма 1) определить локальные элементы вторичной структуры 2) построить начальное наложение структур методом ДП, используя • выбранную функцию веса • векторное представление элементов вторичной структуры 3) определить ближайших соседей, минимизируя евклидовы расстояния 4) удалить лишние атомы, чтобы получить минимальное с. к. о.

Структурное выравнивание при помощи прототипов: LOCK (прод. ) ♦ Шаги алгоритма 1) определить локальные элементы вторичной структуры 2) построить начальное наложение структур методом ДП, используя • выбранную функцию веса • векторное представление элементов вторичной структуры 3) определить ближайших соседей, минимизируя евклидовы расстояния 4) удалить лишние атомы, чтобы получить минимальное с. к. о.

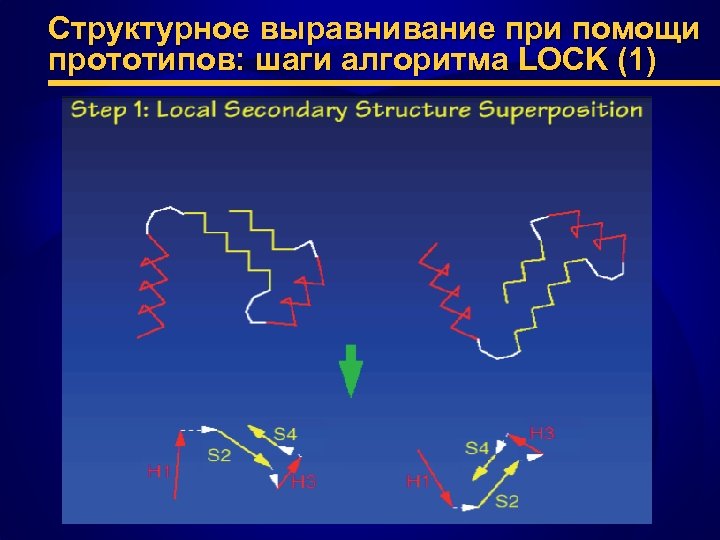

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (1)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (1)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (1 a)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (1 a)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (1 b)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (1 b)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (2)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (2)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (3)

Структурное выравнивание при помощи прототипов: шаги алгоритма LOCK (3)

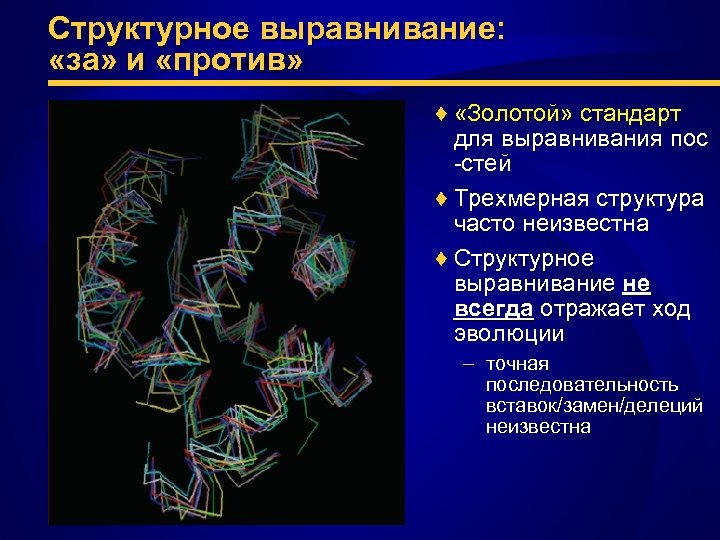

Структурное выравнивание: «за» и «против» ♦ «Золотой» стандарт для выравнивания пос -стей ♦ Трехмерная структура часто неизвестна ♦ Структурное выравнивание не всегда отражает ход эволюции – точная последовательность вставок/замен/делеций неизвестна

Структурное выравнивание: «за» и «против» ♦ «Золотой» стандарт для выравнивания пос -стей ♦ Трехмерная структура часто неизвестна ♦ Структурное выравнивание не всегда отражает ход эволюции – точная последовательность вставок/замен/делеций неизвестна

Прогрессивное выравнивание

Прогрессивное выравнивание

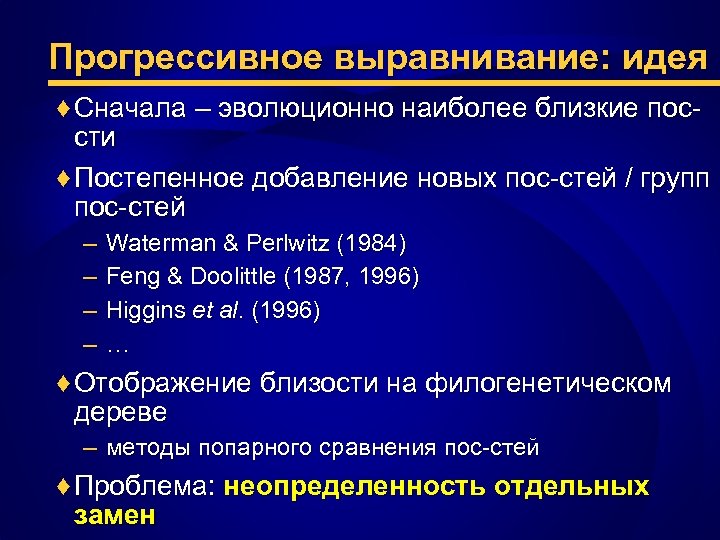

Прогрессивное выравнивание: идея ♦ Сначала – эволюционно наиболее близкие поссти ♦ Постепенное добавление новых пос-стей / групп пос-стей – – Waterman & Perlwitz (1984) Feng & Doolittle (1987, 1996) Higgins et al. (1996) … ♦ Отображение близости на филогенетическом дереве – методы попарного сравнения пос-стей ♦ Проблема: неопределенность отдельных замен

Прогрессивное выравнивание: идея ♦ Сначала – эволюционно наиболее близкие поссти ♦ Постепенное добавление новых пос-стей / групп пос-стей – – Waterman & Perlwitz (1984) Feng & Doolittle (1987, 1996) Higgins et al. (1996) … ♦ Отображение близости на филогенетическом дереве – методы попарного сравнения пос-стей ♦ Проблема: неопределенность отдельных замен

Неопределенность конкретных замен

Неопределенность конкретных замен

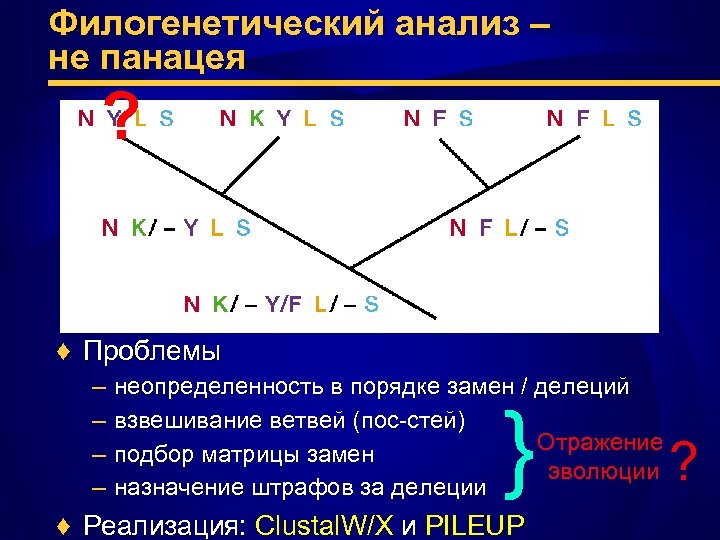

Филогенетический анализ – не панацея ? ♦ Проблемы – – неопределенность в порядке замен / делеций взвешивание ветвей (пос-стей) Отражение подбор матрицы замен эволюции назначение штрафов за делеции } ♦ Реализация: Clustal. W/X и PILEUP ?

Филогенетический анализ – не панацея ? ♦ Проблемы – – неопределенность в порядке замен / делеций взвешивание ветвей (пос-стей) Отражение подбор матрицы замен эволюции назначение штрафов за делеции } ♦ Реализация: Clustal. W/X и PILEUP ?

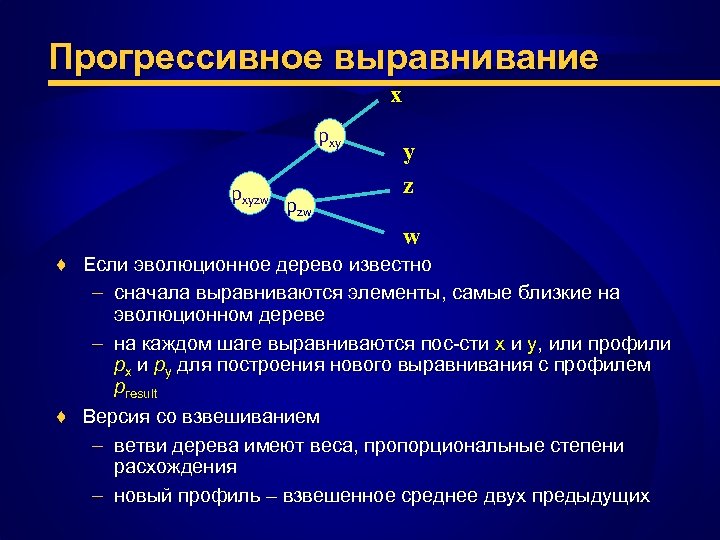

Прогрессивное выравнивание x pxyzw pzw y z w ♦ Если эволюционное дерево известно – сначала выравниваются элементы, самые близкие на эволюционном дереве – на каждом шаге выравниваются пос-сти x и y, или профили px и py для построения нового выравнивания с профилем presult ♦ Версия со взвешиванием – ветви дерева имеют веса, пропорциональные степени расхождения – новый профиль – взвешенное среднее двух предыдущих

Прогрессивное выравнивание x pxyzw pzw y z w ♦ Если эволюционное дерево известно – сначала выравниваются элементы, самые близкие на эволюционном дереве – на каждом шаге выравниваются пос-сти x и y, или профили px и py для построения нового выравнивания с профилем presult ♦ Версия со взвешиванием – ветви дерева имеют веса, пропорциональные степени расхождения – новый профиль – взвешенное среднее двух предыдущих

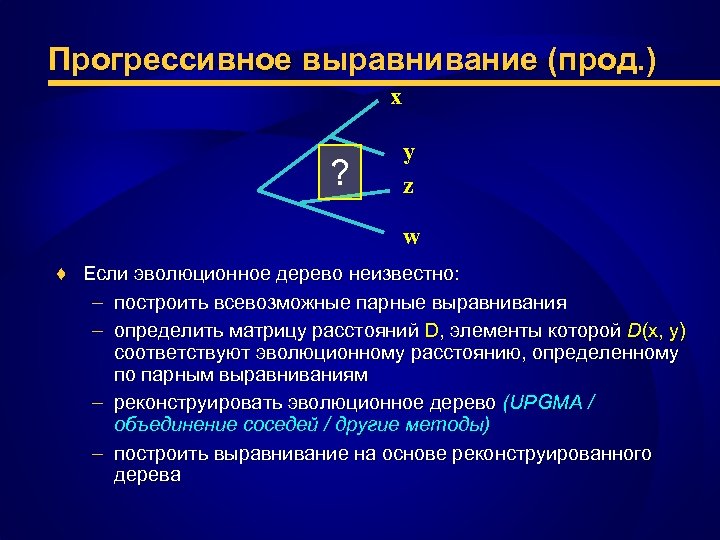

Прогрессивное выравнивание (прод. ) x ? y z w ♦ Если эволюционное дерево неизвестно: – построить всевозможные парные выравнивания – определить матрицу расстояний D, элементы которой D(x, y) соответствуют эволюционному расстоянию, определенному по парным выравниваниям – реконструировать эволюционное дерево (UPGMA / объединение соседей / другие методы) – построить выравнивание на основе реконструированного дерева

Прогрессивное выравнивание (прод. ) x ? y z w ♦ Если эволюционное дерево неизвестно: – построить всевозможные парные выравнивания – определить матрицу расстояний D, элементы которой D(x, y) соответствуют эволюционному расстоянию, определенному по парным выравниваниям – реконструировать эволюционное дерево (UPGMA / объединение соседей / другие методы) – построить выравнивание на основе реконструированного дерева

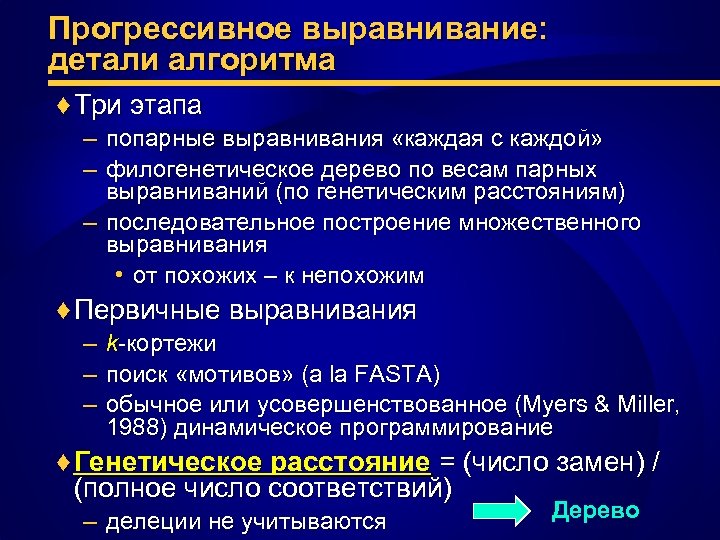

Прогрессивное выравнивание: детали алгоритма ♦ Три этапа – попарные выравнивания «каждая с каждой» – филогенетическое дерево по весам парных выравниваний (по генетическим расстояниям) – последовательное построение множественного выравнивания • от похожих – к непохожим ♦ Первичные выравнивания – k-кортежи – поиск «мотивов» (a la FASTA) – обычное или усовершенствованное (Myers & Miller, 1988) динамическое программирование ♦ Генетическое расстояние = (число замен) / (полное число соответствий) – делеции не учитываются Дерево

Прогрессивное выравнивание: детали алгоритма ♦ Три этапа – попарные выравнивания «каждая с каждой» – филогенетическое дерево по весам парных выравниваний (по генетическим расстояниям) – последовательное построение множественного выравнивания • от похожих – к непохожим ♦ Первичные выравнивания – k-кортежи – поиск «мотивов» (a la FASTA) – обычное или усовершенствованное (Myers & Miller, 1988) динамическое программирование ♦ Генетическое расстояние = (число замен) / (полное число соответствий) – делеции не учитываются Дерево

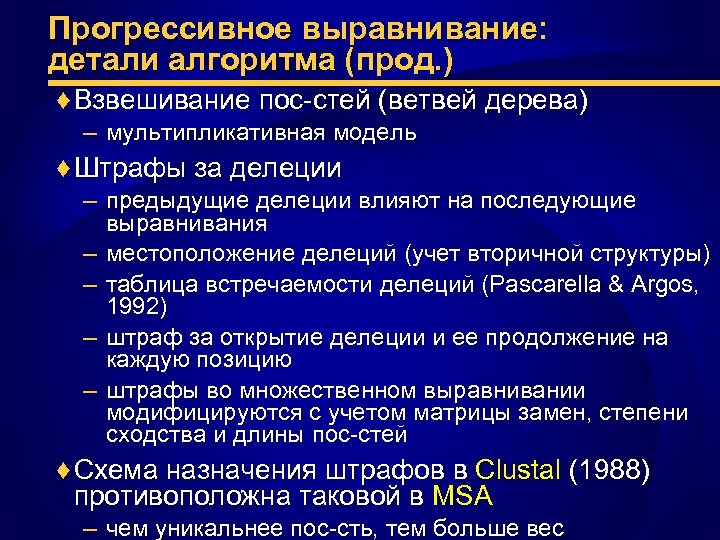

Прогрессивное выравнивание: детали алгоритма (прод. ) ♦ Взвешивание пос-стей (ветвей дерева) – мультипликативная модель ♦ Штрафы за делеции – предыдущие делеции влияют на последующие выравнивания – местоположение делеций (учет вторичной структуры) – таблица встречаемости делеций (Pascarella & Argos, 1992) – штраф за открытие делеции и ее продолжение на каждую позицию – штрафы во множественном выравнивании модифицируются с учетом матрицы замен, степени сходства и длины пос-стей ♦ Схема назначения штрафов в Clustal (1988) противоположна таковой в MSA – чем уникальнее пос-сть, тем больше вес

Прогрессивное выравнивание: детали алгоритма (прод. ) ♦ Взвешивание пос-стей (ветвей дерева) – мультипликативная модель ♦ Штрафы за делеции – предыдущие делеции влияют на последующие выравнивания – местоположение делеций (учет вторичной структуры) – таблица встречаемости делеций (Pascarella & Argos, 1992) – штраф за открытие делеции и ее продолжение на каждую позицию – штрафы во множественном выравнивании модифицируются с учетом матрицы замен, степени сходства и длины пос-стей ♦ Схема назначения штрафов в Clustal (1988) противоположна таковой в MSA – чем уникальнее пос-сть, тем больше вес

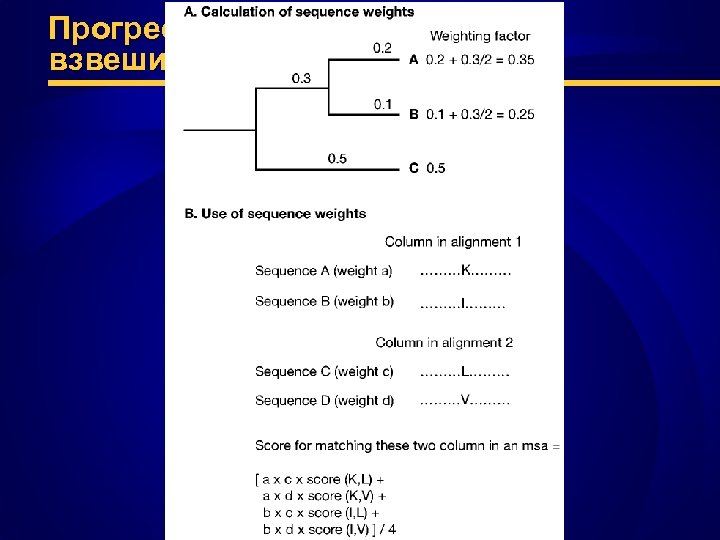

Прогрессивное выравнивание: взвешивание ветвей дерева

Прогрессивное выравнивание: взвешивание ветвей дерева

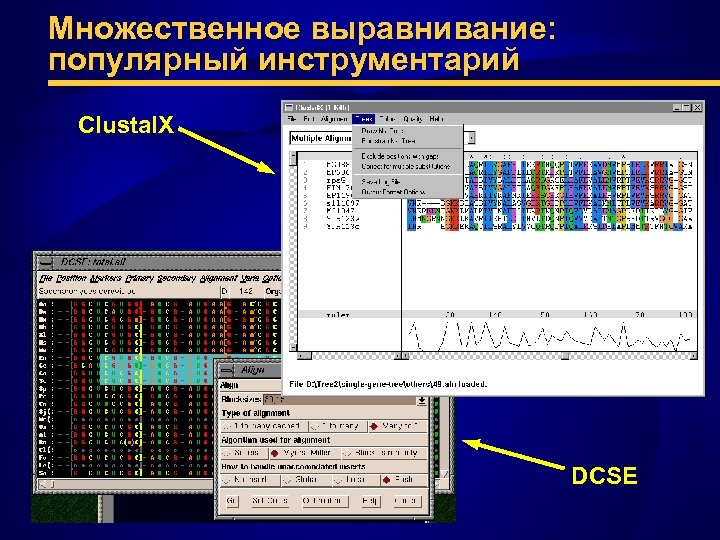

Множественное выравнивание: популярный инструментарий Clustal. X DCSE

Множественное выравнивание: популярный инструментарий Clustal. X DCSE

Прогрессивное выравнивание: штрафы за делеции ♦ Существующие делеции влияют на выравнивание следующих пос-стей – их позиции фиксируются ♦ Clustal. W: размещение делеций между консервативными доменами – Pascarella & Argos (1992): частоты встречаемости делеций после каждой АК в неконсервативных участках структурно близких белков ♦ Штрафы – за открытие делеции – за продолжение делеции – та же схема за делеции внутри существующих делеций

Прогрессивное выравнивание: штрафы за делеции ♦ Существующие делеции влияют на выравнивание следующих пос-стей – их позиции фиксируются ♦ Clustal. W: размещение делеций между консервативными доменами – Pascarella & Argos (1992): частоты встречаемости делеций после каждой АК в неконсервативных участках структурно близких белков ♦ Штрафы – за открытие делеции – за продолжение делеции – та же схема за делеции внутри существующих делеций

Прогрессивное выравнивание: штрафы за делеции (прод. ) ♦ Компенсационная модификация штрафов – – – средний вес соответствий по матрице замен уровень гомологии между пос-стями длины пос-стей ♦ Таблица делеций для каждой группы выравниваемых пос-стей ♦ Другие варианты модификаций – ↓ штрафов для областей с существующими делециями – ↑ штрафов для областей, соседствующих с делециями – ↑ штрафов для областей с гидрофильными АК

Прогрессивное выравнивание: штрафы за делеции (прод. ) ♦ Компенсационная модификация штрафов – – – средний вес соответствий по матрице замен уровень гомологии между пос-стями длины пос-стей ♦ Таблица делеций для каждой группы выравниваемых пос-стей ♦ Другие варианты модификаций – ↓ штрафов для областей с существующими делециями – ↑ штрафов для областей, соседствующих с делециями – ↑ штрафов для областей с гидрофильными АК

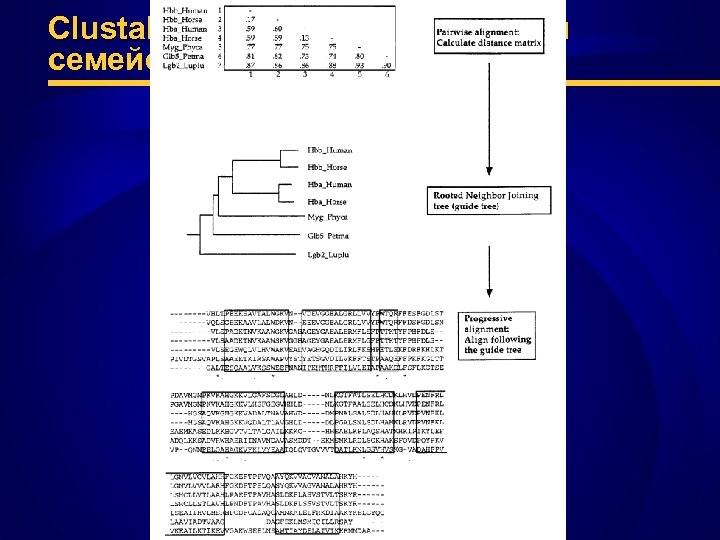

Clustal. W: пример выравнивания семейства глобинов

Clustal. W: пример выравнивания семейства глобинов

Прогрессивное выравнивание: проблемы ♦ Результат зависит от начальных парных выравниваний – ошибки первых выравниваний накапливаются – выравнивание непохожих пос-стей Байесовские методы (e. g. HMM) ♦ Матрица замен и штрафы за делеции должны отражать специфику всего набора пос-стей

Прогрессивное выравнивание: проблемы ♦ Результат зависит от начальных парных выравниваний – ошибки первых выравниваний накапливаются – выравнивание непохожих пос-стей Байесовские методы (e. g. HMM) ♦ Матрица замен и штрафы за делеции должны отражать специфику всего набора пос-стей

Прогрессивное выравнивание: вариант с иерархической кластеризацией

Прогрессивное выравнивание: вариант с иерархической кластеризацией

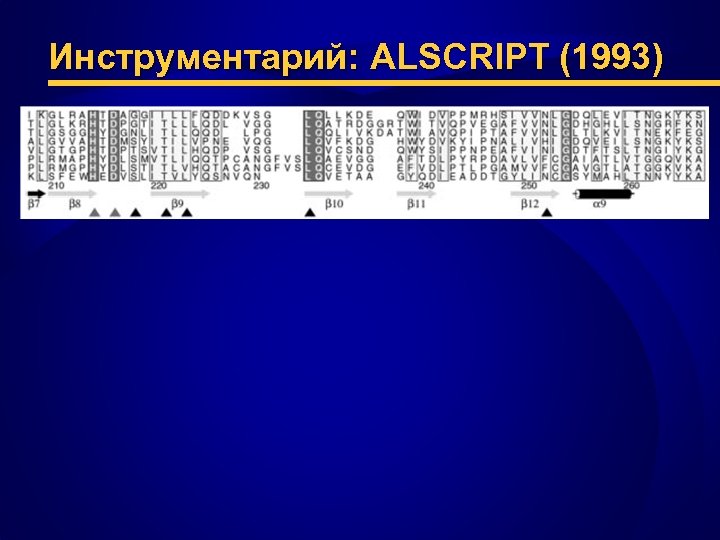

Инструментарий: ALSCRIPT (1993)

Инструментарий: ALSCRIPT (1993)

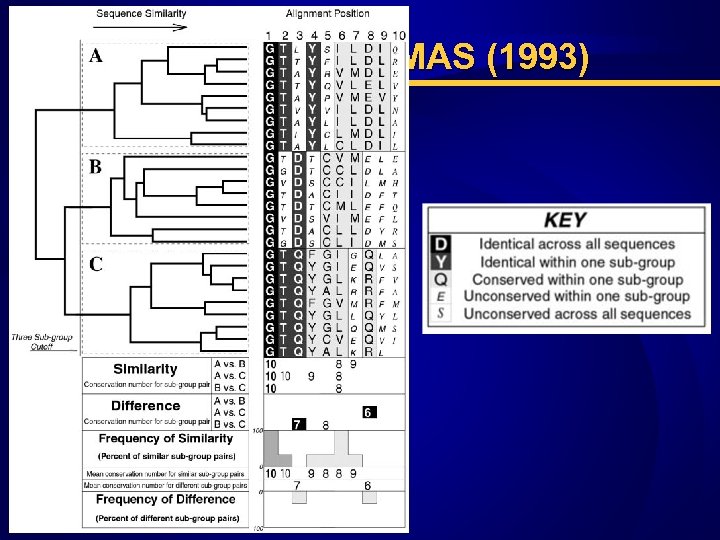

Инструментарий: AMAS (1993)

Инструментарий: AMAS (1993)

Итерационное выравнивание

Итерационное выравнивание

Итерационное выравнивание: идея метода ♦ Задача – избежать накопления ошибок начальных выравниваний, свойственных прогрессивным методам ♦ Вариант решения – многократные итерационные выравнивания подгрупп последовательностей – построение общего глобального выравнивания – оптимизация общего веса выравнивания (суммы парных весов) ♦ Как выделить эти подгруппы? – – – известное / предсказанное филогенетическое дерево K-out cross validation (KOCV) рандомизация

Итерационное выравнивание: идея метода ♦ Задача – избежать накопления ошибок начальных выравниваний, свойственных прогрессивным методам ♦ Вариант решения – многократные итерационные выравнивания подгрупп последовательностей – построение общего глобального выравнивания – оптимизация общего веса выравнивания (суммы парных весов) ♦ Как выделить эти подгруппы? – – – известное / предсказанное филогенетическое дерево K-out cross validation (KOCV) рандомизация

Итерационное выравнивание: варианты реализации ♦ Mult. Alin (Corpet, 1998) – пересчет весов парных выравниваний в прогрессивном алгоритме – использование весов для пересчета дерева – улучшение множественного выравнивания ♦ PRRP (1994) – построение дерева по начальным парным выравниваниям – вычисление весов по дереву и построение выравниваний по аналогии с MSA (но: локальные участки вместо глобального выравнивания + возможны делеции) – итерационный пересчет локально выровненных участков для повышения веса выравнивания – выравнивание с наибольшим весом новое дерево, новые веса и новые выравнивания – повторение, пока суммарный вес не перестанет меняться

Итерационное выравнивание: варианты реализации ♦ Mult. Alin (Corpet, 1998) – пересчет весов парных выравниваний в прогрессивном алгоритме – использование весов для пересчета дерева – улучшение множественного выравнивания ♦ PRRP (1994) – построение дерева по начальным парным выравниваниям – вычисление весов по дереву и построение выравниваний по аналогии с MSA (но: локальные участки вместо глобального выравнивания + возможны делеции) – итерационный пересчет локально выровненных участков для повышения веса выравнивания – выравнивание с наибольшим весом новое дерево, новые веса и новые выравнивания – повторение, пока суммарный вес не перестанет меняться

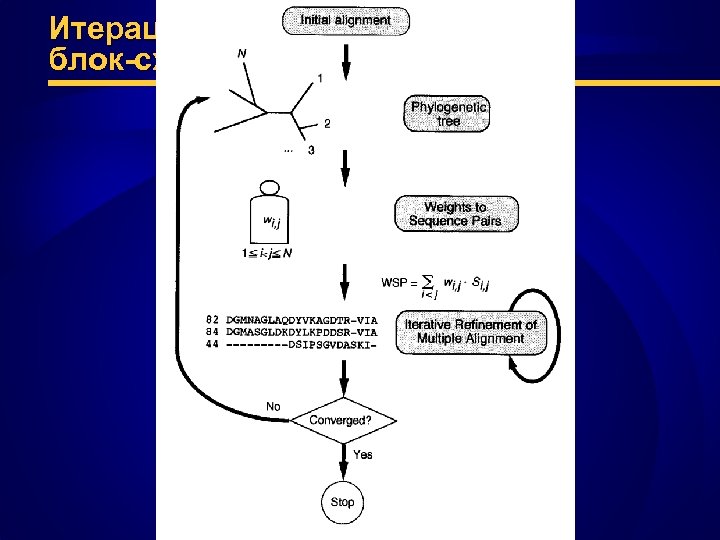

Итерационное выравнивание: блок-схема алгоритма PRRP

Итерационное выравнивание: блок-схема алгоритма PRRP

Итерационное выравнивание: варианты реализации (прод. ) ♦ DIALIGN – участки без делеций в попарных выравниваниях (аналогично точечной матрице) – взвешенная сумма диагоналей ♦ Генетические алгоритмы – SAGA (Notredame, Higgins, 1996) – Zhang, Wang (1997)

Итерационное выравнивание: варианты реализации (прод. ) ♦ DIALIGN – участки без делеций в попарных выравниваниях (аналогично точечной матрице) – взвешенная сумма диагоналей ♦ Генетические алгоритмы – SAGA (Notredame, Higgins, 1996) – Zhang, Wang (1997)

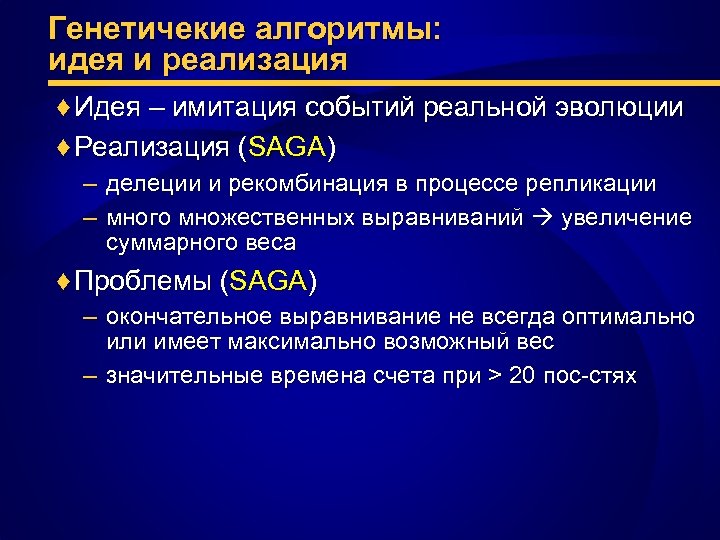

Генетичекие алгоритмы: идея и реализация ♦ Идея – имитация событий реальной эволюции ♦ Реализация (SAGA) – делеции и рекомбинация в процессе репликации – много множественных выравниваний увеличение суммарного веса ♦ Проблемы (SAGA) – окончательное выравнивание не всегда оптимально или имеет максимально возможный вес – значительные времена счета при > 20 пос-стях

Генетичекие алгоритмы: идея и реализация ♦ Идея – имитация событий реальной эволюции ♦ Реализация (SAGA) – делеции и рекомбинация в процессе репликации – много множественных выравниваний увеличение суммарного веса ♦ Проблемы (SAGA) – окончательное выравнивание не всегда оптимально или имеет максимально возможный вес – значительные времена счета при > 20 пос-стях

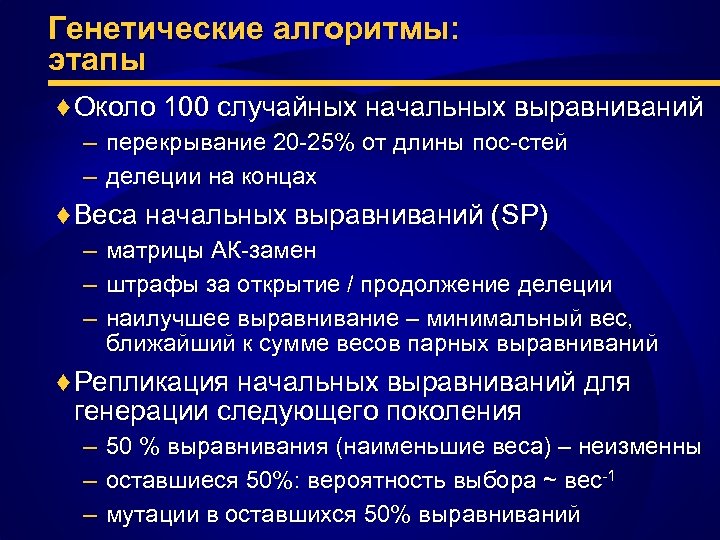

Генетические алгоритмы: этапы ♦ Около 100 случайных начальных выравниваний – перекрывание 20 -25% от длины пос-стей – делеции на концах ♦ Веса начальных выравниваний (SP) – матрицы АК-замен – штрафы за открытие / продолжение делеции – наилучшее выравнивание – минимальный вес, ближайший к сумме весов парных выравниваний ♦ Репликация начальных выравниваний для генерации следующего поколения – 50 % выравнивания (наименьшие веса) – неизменны – оставшиеся 50%: вероятность выбора ~ вес-1 – мутации в оставшихся 50% выравниваний

Генетические алгоритмы: этапы ♦ Около 100 случайных начальных выравниваний – перекрывание 20 -25% от длины пос-стей – делеции на концах ♦ Веса начальных выравниваний (SP) – матрицы АК-замен – штрафы за открытие / продолжение делеции – наилучшее выравнивание – минимальный вес, ближайший к сумме весов парных выравниваний ♦ Репликация начальных выравниваний для генерации следующего поколения – 50 % выравнивания (наименьшие веса) – неизменны – оставшиеся 50%: вероятность выбора ~ вес-1 – мутации в оставшихся 50% выравниваний

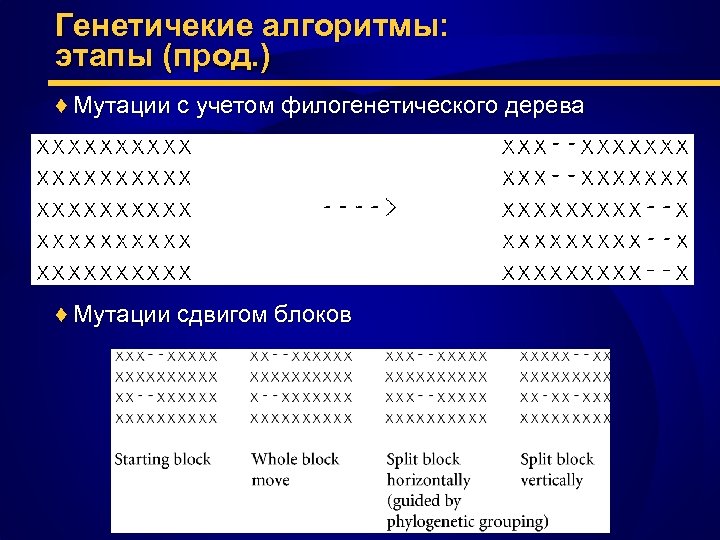

Генетичекие алгоритмы: этапы (прод. ) ♦ Мутации с учетом филогенетического дерева ♦ Мутации сдвигом блоков

Генетичекие алгоритмы: этапы (прод. ) ♦ Мутации с учетом филогенетического дерева ♦ Мутации сдвигом блоков

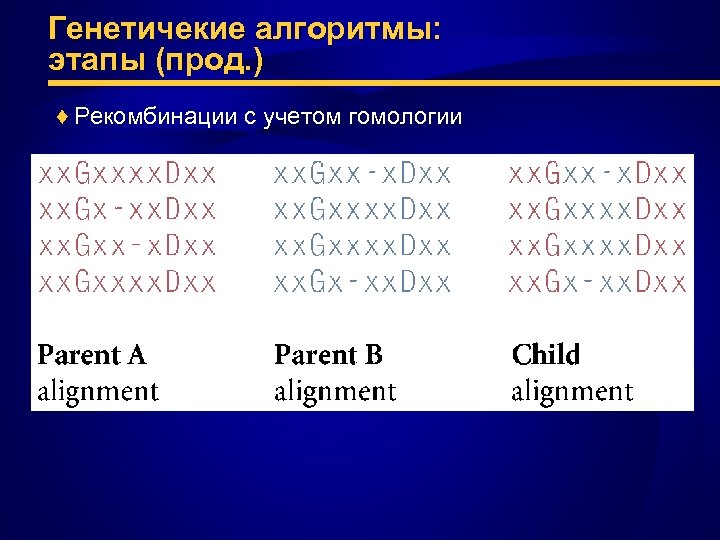

Генетичекие алгоритмы: этапы (прод. ) ♦ Рекомбинации с учетом гомологии

Генетичекие алгоритмы: этапы (прод. ) ♦ Рекомбинации с учетом гомологии

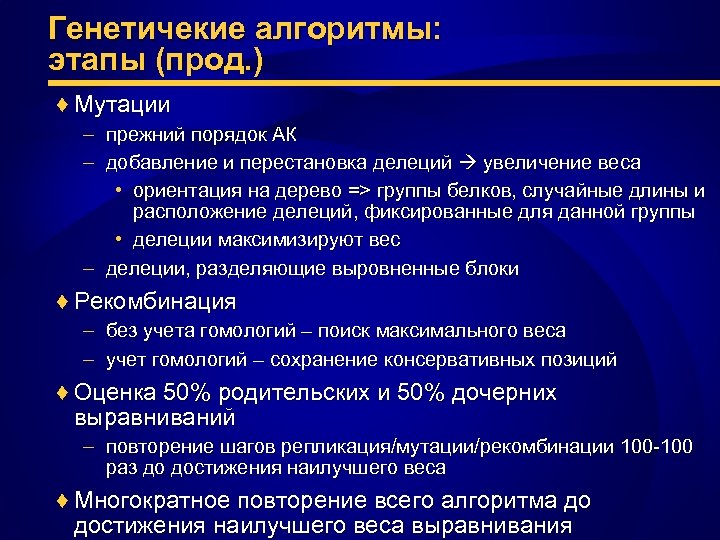

Генетичекие алгоритмы: этапы (прод. ) ♦ Мутации – прежний порядок АК – добавление и перестановка делеций увеличение веса • ориентация на дерево => группы белков, случайные длины и расположение делеций, фиксированные для данной группы • делеции максимизируют вес – делеции, разделяющие выровненные блоки ♦ Рекомбинация – без учета гомологий – поиск максимального веса – учет гомологий – сохранение консервативных позиций ♦ Оценка 50% родительских и 50% дочерних выравниваний – повторение шагов репликация/мутации/рекомбинации 100 -100 раз до достижения наилучшего веса ♦ Многократное повторение всего алгоритма до достижения наилучшего веса выравнивания

Генетичекие алгоритмы: этапы (прод. ) ♦ Мутации – прежний порядок АК – добавление и перестановка делеций увеличение веса • ориентация на дерево => группы белков, случайные длины и расположение делеций, фиксированные для данной группы • делеции максимизируют вес – делеции, разделяющие выровненные блоки ♦ Рекомбинация – без учета гомологий – поиск максимального веса – учет гомологий – сохранение консервативных позиций ♦ Оценка 50% родительских и 50% дочерних выравниваний – повторение шагов репликация/мутации/рекомбинации 100 -100 раз до достижения наилучшего веса ♦ Многократное повторение всего алгоритма до достижения наилучшего веса выравнивания

Локальные множественные выравнивания

Локальные множественные выравнивания

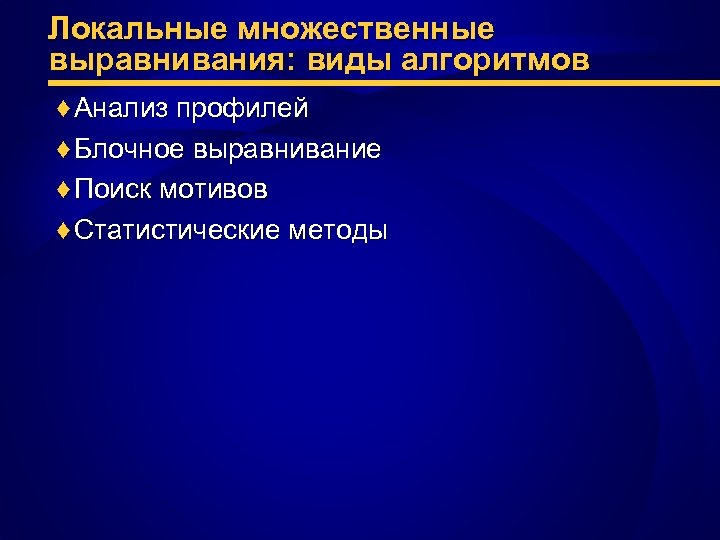

Локальные множественные выравнивания: виды алгоритмов ♦ Анализ профилей ♦ Блочное выравнивание ♦ Поиск мотивов ♦ Статистические методы

Локальные множественные выравнивания: виды алгоритмов ♦ Анализ профилей ♦ Блочное выравнивание ♦ Поиск мотивов ♦ Статистические методы

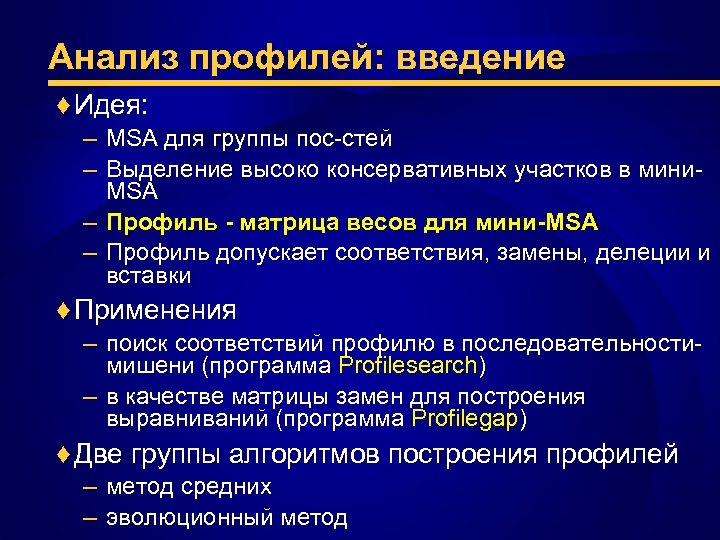

Анализ профилей: введение ♦ Идея: – MSA для группы пос-стей – Выделение высоко консервативных участков в мини. MSA – Профиль - матрица весов для мини-MSA – Профиль допускает соответствия, замены, делеции и вставки ♦ Применения – поиск соответствий профилю в последовательностимишени (программа Profilesearch) – в качестве матрицы замен для построения выравниваний (программа Profilegap) ♦ Две группы алгоритмов построения профилей – метод средних – эволюционный метод

Анализ профилей: введение ♦ Идея: – MSA для группы пос-стей – Выделение высоко консервативных участков в мини. MSA – Профиль - матрица весов для мини-MSA – Профиль допускает соответствия, замены, делеции и вставки ♦ Применения – поиск соответствий профилю в последовательностимишени (программа Profilesearch) – в качестве матрицы замен для построения выравниваний (программа Profilegap) ♦ Две группы алгоритмов построения профилей – метод средних – эволюционный метод

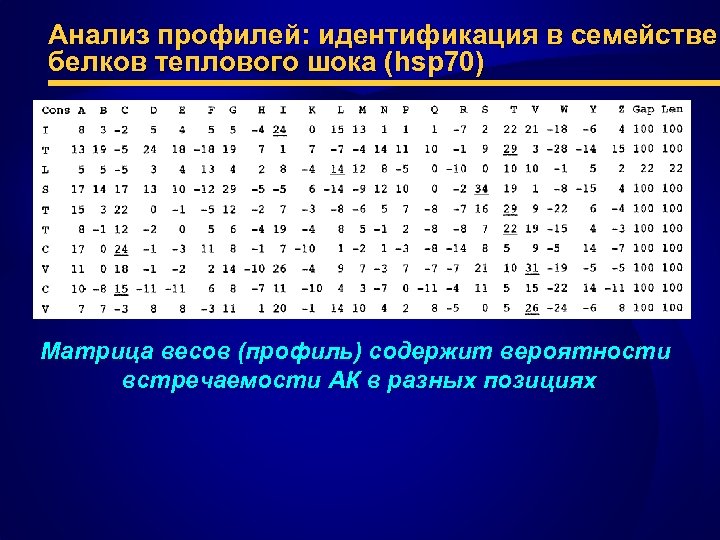

Анализ профилей: идентификация в семействе белков теплового шока (hsp 70) Матрица весов (профиль) содержит вероятности встречаемости АК в разных позициях

Анализ профилей: идентификация в семействе белков теплового шока (hsp 70) Матрица весов (профиль) содержит вероятности встречаемости АК в разных позициях

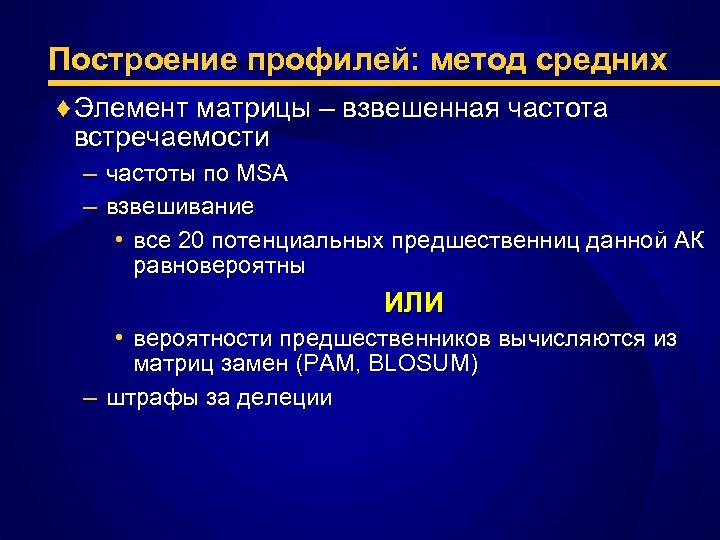

Построение профилей: метод средних ♦ Элемент матрицы – взвешенная частота встречаемости – частоты по MSA – взвешивание • все 20 потенциальных предшественниц данной АК равновероятны ИЛИ • вероятности предшественников вычисляются из матриц замен (PAM, BLOSUM) – штрафы за делеции

Построение профилей: метод средних ♦ Элемент матрицы – взвешенная частота встречаемости – частоты по MSA – взвешивание • все 20 потенциальных предшественниц данной АК равновероятны ИЛИ • вероятности предшественников вычисляются из матриц замен (PAM, BLOSUM) – штрафы за делеции

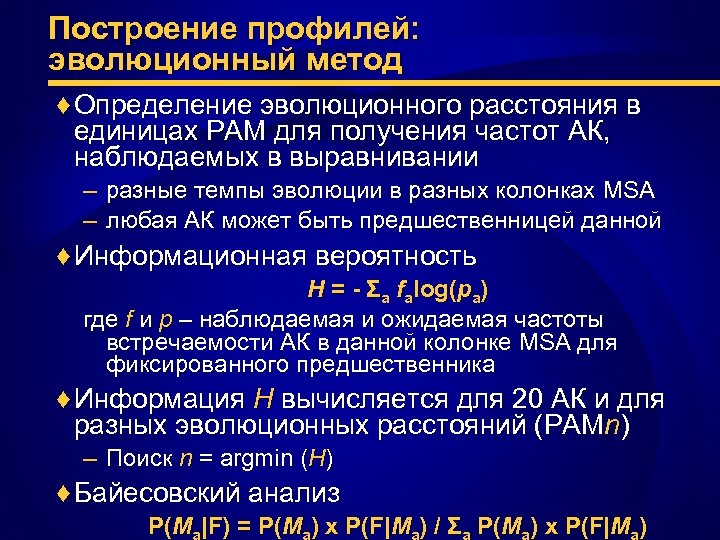

Построение профилей: эволюционный метод ♦ Определение эволюционного расстояния в единицах PAM для получения частот АК, наблюдаемых в выравнивании – разные темпы эволюции в разных колонках MSA – любая АК может быть предшественницей данной ♦ Информационная вероятность H = - Σa falog(pa) где f и p – наблюдаемая и ожидаемая частоты встречаемости АК в данной колонке MSA для фиксированного предшественника ♦ Информация H вычисляется для 20 АК и для разных эволюционных расстояний (PAMn) – Поиск n = argmin (H) ♦ Байесовский анализ P(Ma|F) = P(Ma) x P(F|Ma) / Σa P(Ma) x P(F|Ma)

Построение профилей: эволюционный метод ♦ Определение эволюционного расстояния в единицах PAM для получения частот АК, наблюдаемых в выравнивании – разные темпы эволюции в разных колонках MSA – любая АК может быть предшественницей данной ♦ Информационная вероятность H = - Σa falog(pa) где f и p – наблюдаемая и ожидаемая частоты встречаемости АК в данной колонке MSA для фиксированного предшественника ♦ Информация H вычисляется для 20 АК и для разных эволюционных расстояний (PAMn) – Поиск n = argmin (H) ♦ Байесовский анализ P(Ma|F) = P(Ma) x P(F|Ma) / Σa P(Ma) x P(F|Ma)

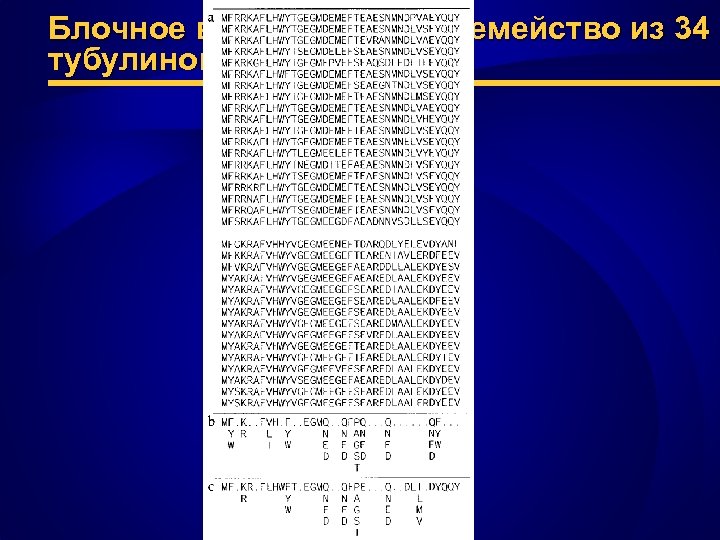

Блочное выравнивание: семейство из 34 тубулиновых белков

Блочное выравнивание: семейство из 34 тубулиновых белков

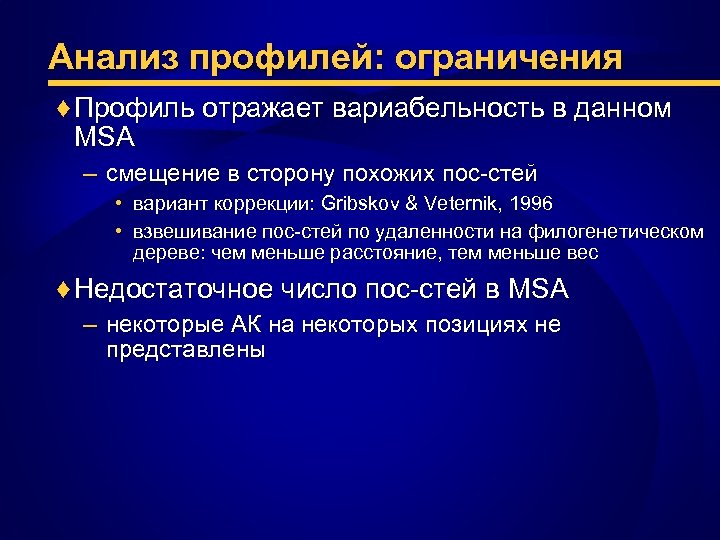

Анализ профилей: ограничения ♦ Профиль отражает вариабельность в данном MSA – смещение в сторону похожих пос-стей • вариант коррекции: Gribskov & Veternik, 1996 • взвешивание пос-стей по удаленности на филогенетическом дереве: чем меньше расстояние, тем меньше вес ♦ Недостаточное число пос-стей в MSA – некоторые АК на некоторых позициях не представлены

Анализ профилей: ограничения ♦ Профиль отражает вариабельность в данном MSA – смещение в сторону похожих пос-стей • вариант коррекции: Gribskov & Veternik, 1996 • взвешивание пос-стей по удаленности на филогенетическом дереве: чем меньше расстояние, тем меньше вес ♦ Недостаточное число пос-стей в MSA – некоторые АК на некоторых позициях не представлены

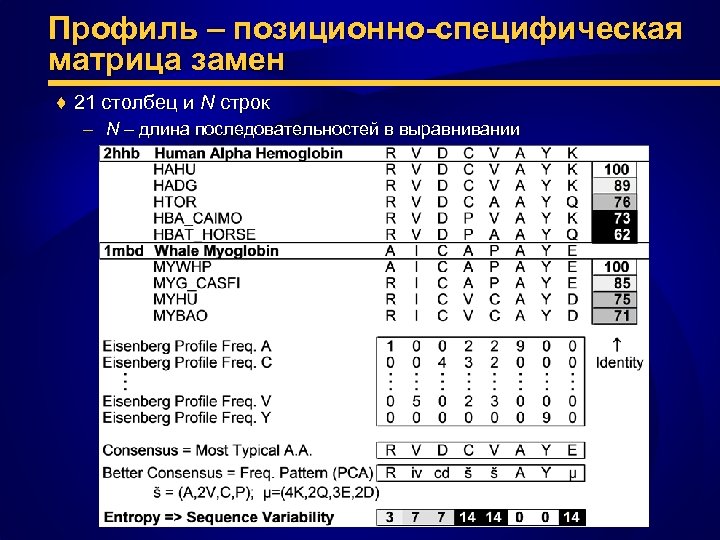

Профиль – позиционно-специфическая матрица замен ♦ 21 столбец и N строк – N – длина последовательностей в выравнивании

Профиль – позиционно-специфическая матрица замен ♦ 21 столбец и N строк – N – длина последовательностей в выравнивании

Статистические методы множественного выравнивания

Статистические методы множественного выравнивания

Множественное выравнивание на базе вероятностно-статистических методов ♦ Максимизация математического ожидания ♦ Сэмплирование Гиббса ♦ Скрытые марковские модели – see Russ Altman, Lecture 4 -27 -06, pp. 8 -20

Множественное выравнивание на базе вероятностно-статистических методов ♦ Максимизация математического ожидания ♦ Сэмплирование Гиббса ♦ Скрытые марковские модели – see Russ Altman, Lecture 4 -27 -06, pp. 8 -20

Максимизация математического ожидания

Максимизация математического ожидания

Максимизация математического ожидания (Expectation Maximization, EM) ♦ Применение – консервативные домены в невыровненных белках – сайты связывания белков в невыровненных ДНКпоследовательностях ♦ Предварительные шаги алгоритма – произвольный выбор начального положения и длины искомого сайта в каждой пос-сти – выравнивание пос-стей по выбранным «искомым» сайтам и вычисление частот встречаемости по столбцам ♦ Два основных этапа алгоритма – Ожидание: оценка вероятности обнаружения сайта в каждой из позиций каждой из пос-стей по частотам – Максимизация: использование новых частот

Максимизация математического ожидания (Expectation Maximization, EM) ♦ Применение – консервативные домены в невыровненных белках – сайты связывания белков в невыровненных ДНКпоследовательностях ♦ Предварительные шаги алгоритма – произвольный выбор начального положения и длины искомого сайта в каждой пос-сти – выравнивание пос-стей по выбранным «искомым» сайтам и вычисление частот встречаемости по столбцам ♦ Два основных этапа алгоритма – Ожидание: оценка вероятности обнаружения сайта в каждой из позиций каждой из пос-стей по частотам – Максимизация: использование новых частот

Максимизация математического ожидания: предварительное выр-ние Таблица частот

Максимизация математического ожидания: предварительное выр-ние Таблица частот

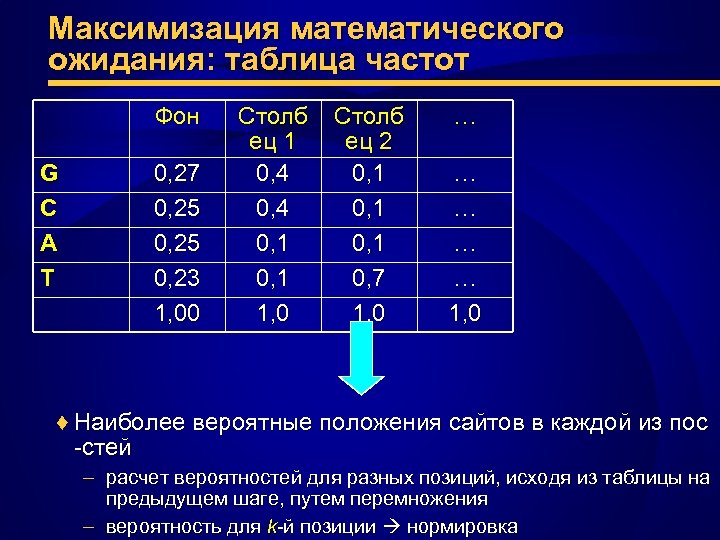

Максимизация математического ожидания: таблица частот Фон G C A T 0, 27 0, 25 0, 23 1, 00 Столб ец 1 0, 4 0, 1 1, 0 Столб ец 2 0, 1 0, 7 1, 0 … … … 1, 0 ♦ Наиболее вероятные положения сайтов в каждой из пос -стей – расчет вероятностей для разных позиций, исходя из таблицы на предыдущем шаге, путем перемножения – вероятность для k-й позиции нормировка

Максимизация математического ожидания: таблица частот Фон G C A T 0, 27 0, 25 0, 23 1, 00 Столб ец 1 0, 4 0, 1 1, 0 Столб ец 2 0, 1 0, 7 1, 0 … … … 1, 0 ♦ Наиболее вероятные положения сайтов в каждой из пос -стей – расчет вероятностей для разных позиций, исходя из таблицы на предыдущем шаге, путем перемножения – вероятность для k-й позиции нормировка

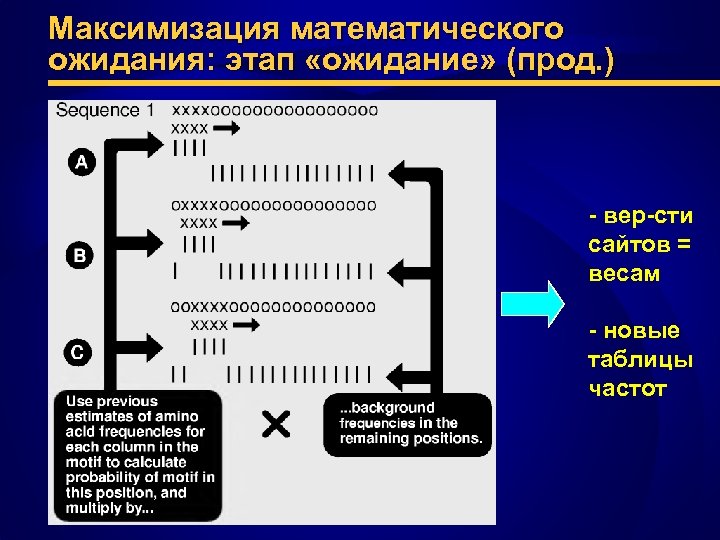

Максимизация математического ожидания: этап «ожидание» (прод. ) - вер-сти сайтов = весам - новые таблицы частот

Максимизация математического ожидания: этап «ожидание» (прод. ) - вер-сти сайтов = весам - новые таблицы частот

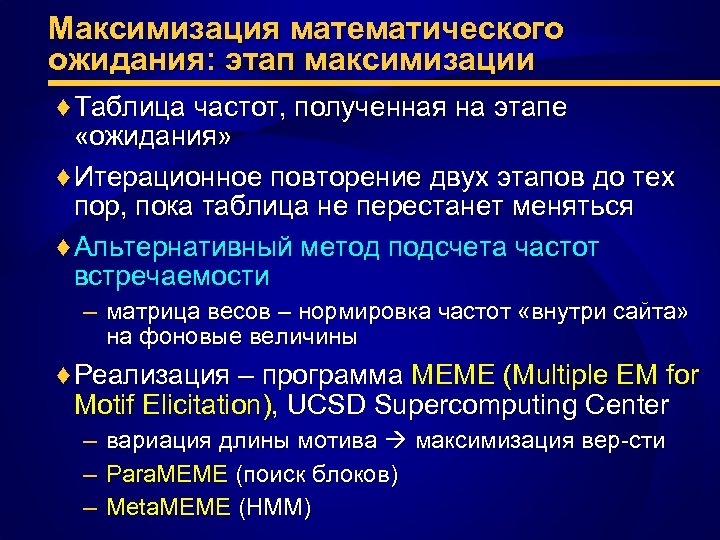

Максимизация математического ожидания: этап максимизации ♦ Таблица частот, полученная на этапе «ожидания» ♦ Итерационное повторение двух этапов до тех пор, пока таблица не перестанет меняться ♦ Альтернативный метод подсчета частот встречаемости – матрица весов – нормировка частот «внутри сайта» на фоновые величины ♦ Реализация – программа MEME (Multiple EM for Motif Elicitation), UCSD Supercomputing Center – – – вариация длины мотива максимизация вер-сти Para. MEME (поиск блоков) Meta. MEME (HMM)

Максимизация математического ожидания: этап максимизации ♦ Таблица частот, полученная на этапе «ожидания» ♦ Итерационное повторение двух этапов до тех пор, пока таблица не перестанет меняться ♦ Альтернативный метод подсчета частот встречаемости – матрица весов – нормировка частот «внутри сайта» на фоновые величины ♦ Реализация – программа MEME (Multiple EM for Motif Elicitation), UCSD Supercomputing Center – – – вариация длины мотива максимизация вер-сти Para. MEME (поиск блоков) Meta. MEME (HMM)

Выборки Гиббса

Выборки Гиббса

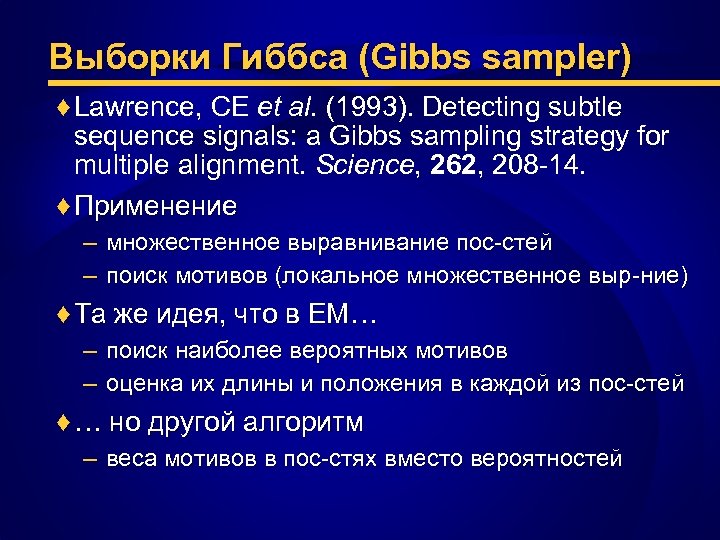

Выборки Гиббса (Gibbs sampler) ♦ Lawrence, CE et al. (1993). Detecting subtle sequence signals: a Gibbs sampling strategy for multiple alignment. Science, 262, 208 -14. ♦ Применение – множественное выравнивание пос-стей – поиск мотивов (локальное множественное выр-ние) ♦ Та же идея, что в EM… – поиск наиболее вероятных мотивов – оценка их длины и положения в каждой из пос-стей ♦ … но другой алгоритм – веса мотивов в пос-стях вместо вероятностей

Выборки Гиббса (Gibbs sampler) ♦ Lawrence, CE et al. (1993). Detecting subtle sequence signals: a Gibbs sampling strategy for multiple alignment. Science, 262, 208 -14. ♦ Применение – множественное выравнивание пос-стей – поиск мотивов (локальное множественное выр-ние) ♦ Та же идея, что в EM… – поиск наиболее вероятных мотивов – оценка их длины и положения в каждой из пос-стей ♦ … но другой алгоритм – веса мотивов в пос-стях вместо вероятностей

Выборки Гиббса: алгоритм (прод. )

Выборки Гиббса: алгоритм (прод. )

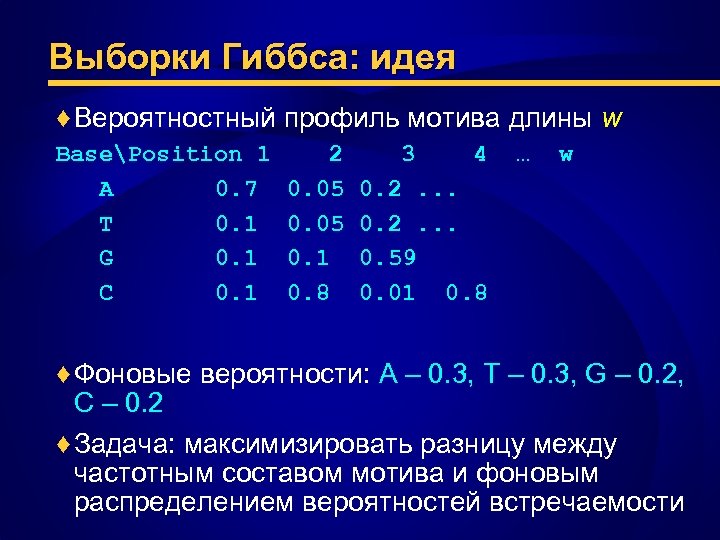

Выборки Гиббса: идея ♦ Вероятностный профиль мотива длины w BasePosition 1 A 0. 7 T 0. 1 G 0. 1 C 0. 1 2 0. 05 0. 1 0. 8 3 4 0. 2. . . 0. 59 0. 01 0. 8 … w ♦ Фоновые вероятности: A – 0. 3, T – 0. 3, G – 0. 2, C – 0. 2 ♦ Задача: максимизировать разницу между частотным составом мотива и фоновым распределением вероятностей встречаемости

Выборки Гиббса: идея ♦ Вероятностный профиль мотива длины w BasePosition 1 A 0. 7 T 0. 1 G 0. 1 C 0. 1 2 0. 05 0. 1 0. 8 3 4 0. 2. . . 0. 59 0. 01 0. 8 … w ♦ Фоновые вероятности: A – 0. 3, T – 0. 3, G – 0. 2, C – 0. 2 ♦ Задача: максимизировать разницу между частотным составом мотива и фоновым распределением вероятностей встречаемости

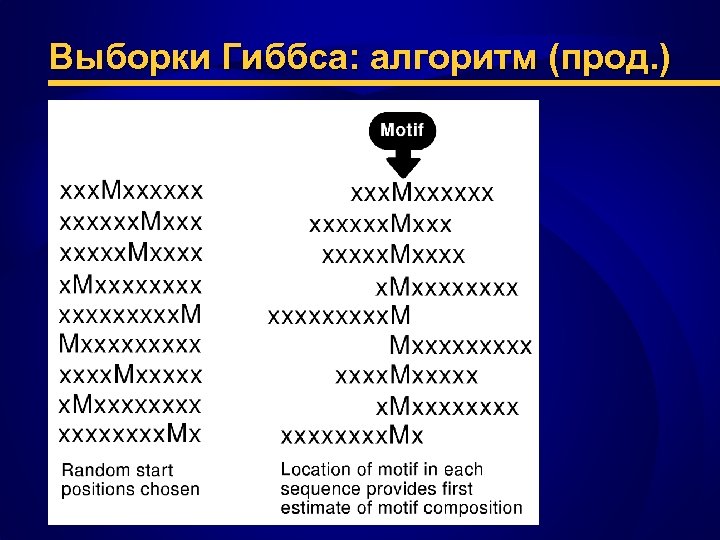

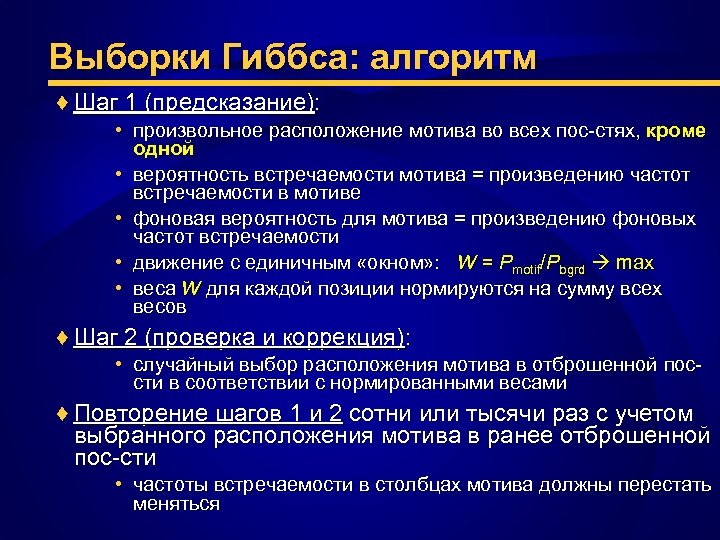

Выборки Гиббса: алгоритм ♦ Шаг 1 (предсказание): • произвольное расположение мотива во всех пос-стях, кроме одной • вероятность встречаемости мотива = произведению частот встречаемости в мотиве • фоновая вероятность для мотива = произведению фоновых частот встречаемости • движение с единичным «окном» : W = Pmotif/Pbgrd max • веса W для каждой позиции нормируются на сумму всех весов ♦ Шаг 2 (проверка и коррекция): • случайный выбор расположения мотива в отброшенной поссти в соответствии с нормированными весами ♦ Повторение шагов 1 и 2 сотни или тысячи раз с учетом выбранного расположения мотива в ранее отброшенной пос-сти • частоты встречаемости в столбцах мотива должны перестать меняться

Выборки Гиббса: алгоритм ♦ Шаг 1 (предсказание): • произвольное расположение мотива во всех пос-стях, кроме одной • вероятность встречаемости мотива = произведению частот встречаемости в мотиве • фоновая вероятность для мотива = произведению фоновых частот встречаемости • движение с единичным «окном» : W = Pmotif/Pbgrd max • веса W для каждой позиции нормируются на сумму всех весов ♦ Шаг 2 (проверка и коррекция): • случайный выбор расположения мотива в отброшенной поссти в соответствии с нормированными весами ♦ Повторение шагов 1 и 2 сотни или тысячи раз с учетом выбранного расположения мотива в ранее отброшенной пос-сти • частоты встречаемости в столбцах мотива должны перестать меняться

Выборки Гиббса: алгоритм – шаг 1 ♦ Случайный выбор расположений мотивов ♦ Вычисление – матрицы мотива – фоновых частот

Выборки Гиббса: алгоритм – шаг 1 ♦ Случайный выбор расположений мотивов ♦ Вычисление – матрицы мотива – фоновых частот

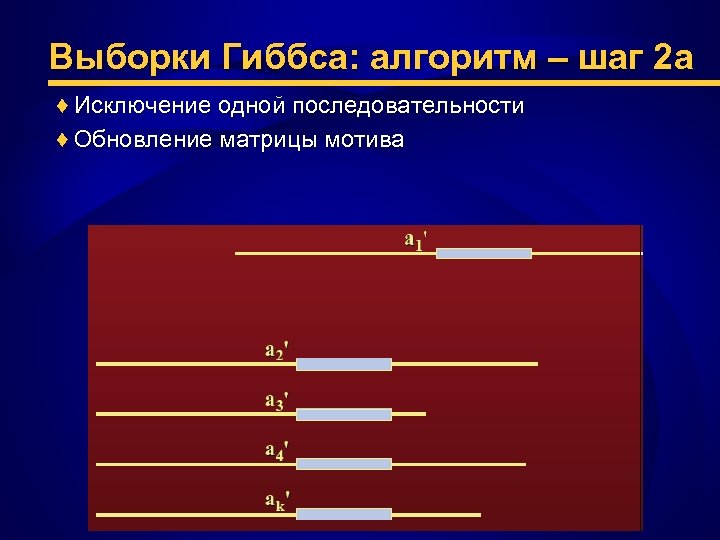

Выборки Гиббса: алгоритм – шаг 2 a ♦ Исключение одной последовательности ♦ Обновление матрицы мотива

Выборки Гиббса: алгоритм – шаг 2 a ♦ Исключение одной последовательности ♦ Обновление матрицы мотива

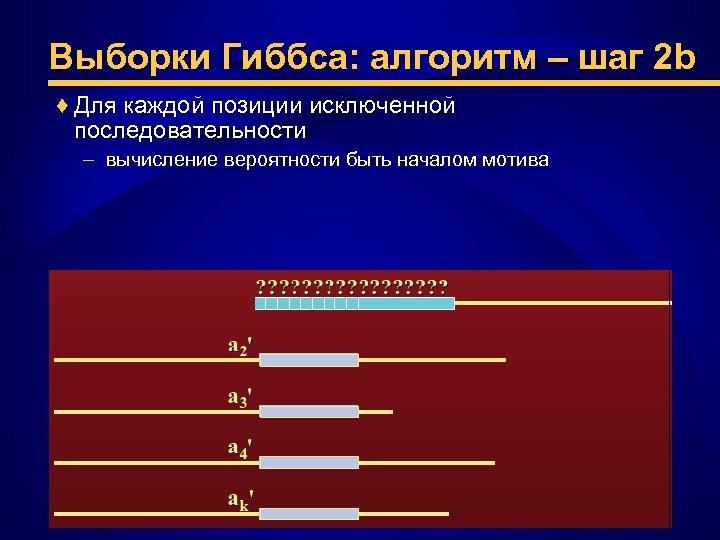

Выборки Гиббса: алгоритм – шаг 2 b ♦ Для каждой позиции исключенной последовательности – вычисление вероятности быть началом мотива

Выборки Гиббса: алгоритм – шаг 2 b ♦ Для каждой позиции исключенной последовательности – вычисление вероятности быть началом мотива

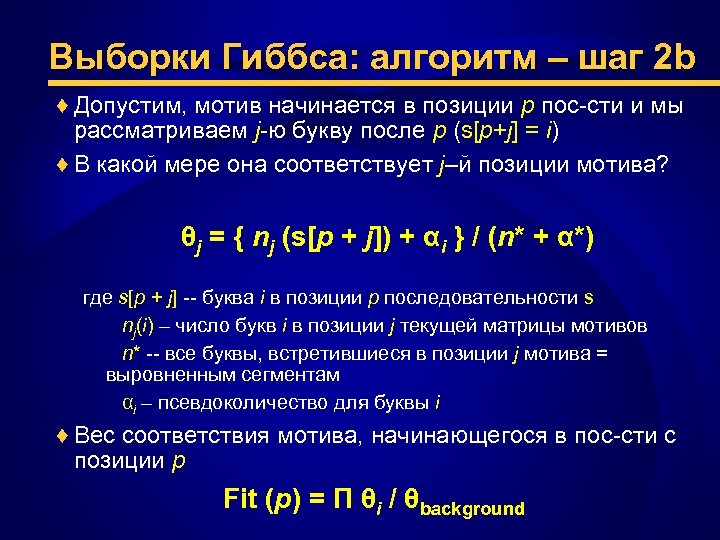

Выборки Гиббса: алгоритм – шаг 2 b ♦ Допустим, мотив начинается в позиции p пос-сти и мы рассматриваем j-ю букву после p (s[p+j] = i) ♦ В какой мере она соответствует j–й позиции мотива? θj = { nj (s[p + j]) + αi } / (n* + α*) где s[p + j] -- буква i в позиции p последовательности s nj(i) – число букв i в позиции j текущей матрицы мотивов n* -- все буквы, встретившиеся в позиции j мотива = выровненным сегментам αi – псевдоколичество для буквы i ♦ Вес соответствия мотива, начинающегося в пос-сти с позиции p Fit (p) = Π θi / θbackground

Выборки Гиббса: алгоритм – шаг 2 b ♦ Допустим, мотив начинается в позиции p пос-сти и мы рассматриваем j-ю букву после p (s[p+j] = i) ♦ В какой мере она соответствует j–й позиции мотива? θj = { nj (s[p + j]) + αi } / (n* + α*) где s[p + j] -- буква i в позиции p последовательности s nj(i) – число букв i в позиции j текущей матрицы мотивов n* -- все буквы, встретившиеся в позиции j мотива = выровненным сегментам αi – псевдоколичество для буквы i ♦ Вес соответствия мотива, начинающегося в пос-сти с позиции p Fit (p) = Π θi / θbackground

Выборки Гиббса: алгоритм – шаг 2 b ♦ Для каждой позиции исключенной последовательности – вычисление вероятности быть началом мотива

Выборки Гиббса: алгоритм – шаг 2 b ♦ Для каждой позиции исключенной последовательности – вычисление вероятности быть началом мотива

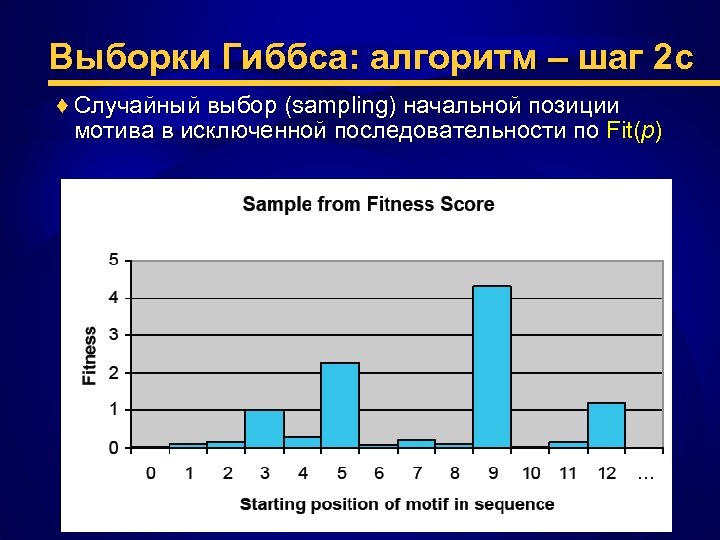

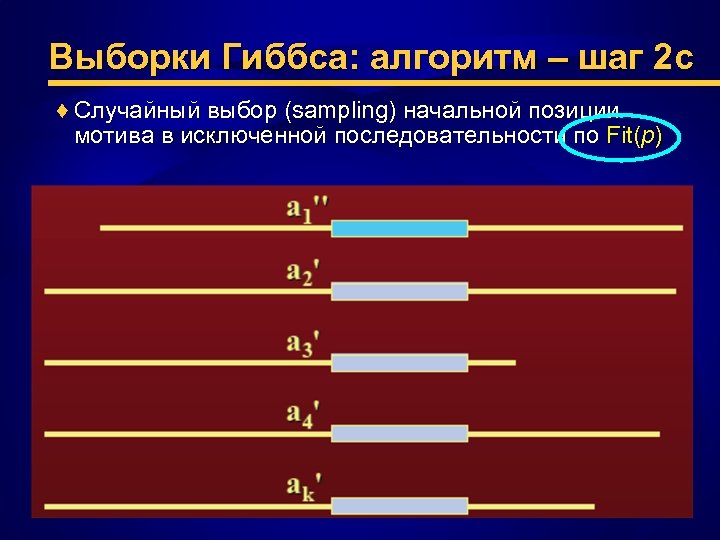

Выборки Гиббса: алгоритм – шаг 2 c ♦ Случайный выбор (sampling) начальной позиции мотива в исключенной последовательности по Fit(p)

Выборки Гиббса: алгоритм – шаг 2 c ♦ Случайный выбор (sampling) начальной позиции мотива в исключенной последовательности по Fit(p)

Выборки Гиббса: алгоритм – шаг 2 c ♦ Случайный выбор (sampling) начальной позиции мотива в исключенной последовательности по Fit(p)

Выборки Гиббса: алгоритм – шаг 2 c ♦ Случайный выбор (sampling) начальной позиции мотива в исключенной последовательности по Fit(p)

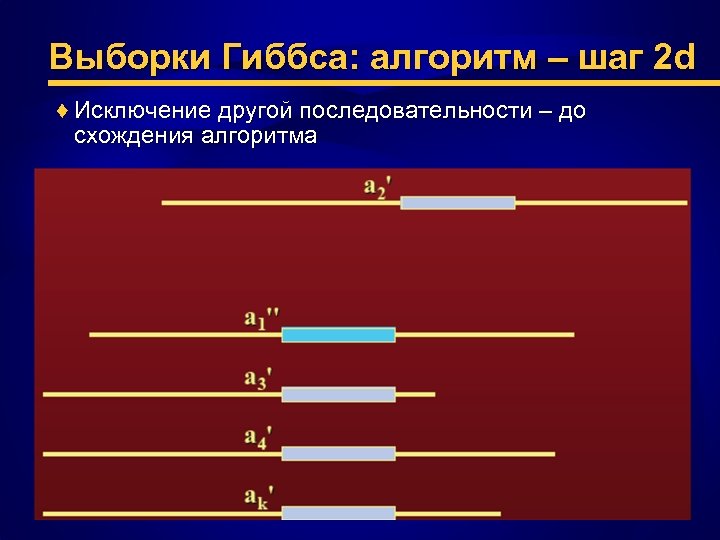

Выборки Гиббса: алгоритм – шаг 2 d ♦ Исключение другой последовательности – до схождения алгоритма

Выборки Гиббса: алгоритм – шаг 2 d ♦ Исключение другой последовательности – до схождения алгоритма

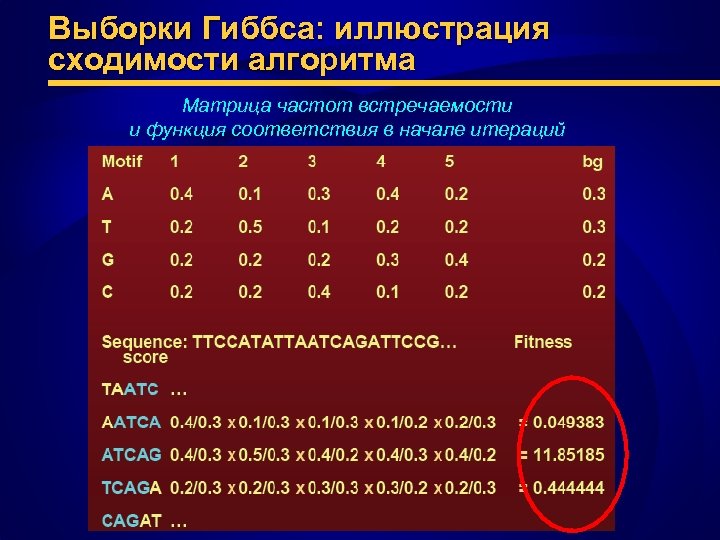

Выборки Гиббса: иллюстрация сходимости алгоритма Матрица частот встречаемости и функция соответствия в начале итераций

Выборки Гиббса: иллюстрация сходимости алгоритма Матрица частот встречаемости и функция соответствия в начале итераций

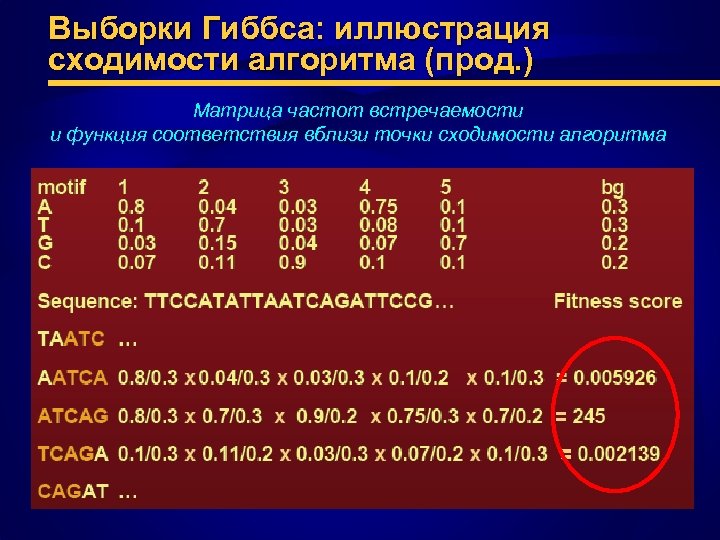

Выборки Гиббса: иллюстрация сходимости алгоритма (прод. ) Матрица частот встречаемости и функция соответствия вблизи точки сходимости алгоритма

Выборки Гиббса: иллюстрация сходимости алгоритма (прод. ) Матрица частот встречаемости и функция соответствия вблизи точки сходимости алгоритма

Выборки Гиббса: алгоритм – шаг 3 ♦ Повторная инициализация алгоритма после n итераций во избежание локальных максимумов – начальные позиции мотивов – распределение начальных позиций по пос-стям ♦ По окончании работы алгоритма: – начальные позиции мотивов в каждой пос-сти, которые встречались чаще других

Выборки Гиббса: алгоритм – шаг 3 ♦ Повторная инициализация алгоритма после n итераций во избежание локальных максимумов – начальные позиции мотивов – распределение начальных позиций по пос-стям ♦ По окончании работы алгоритма: – начальные позиции мотивов в каждой пос-сти, которые встречались чаще других

Выборки Гиббса: куда двигаться дальше? ♦ Алгоритм стоило бы развить для анализа – множественных консервативных мотивов, разделенных делециями – мотивов неизвестной длины – включения в выравнивания последовательностей, не содержащих мотива

Выборки Гиббса: куда двигаться дальше? ♦ Алгоритм стоило бы развить для анализа – множественных консервативных мотивов, разделенных делециями – мотивов неизвестной длины – включения в выравнивания последовательностей, не содержащих мотива

Скрытые марковские модели (HMM)

Скрытые марковские модели (HMM)

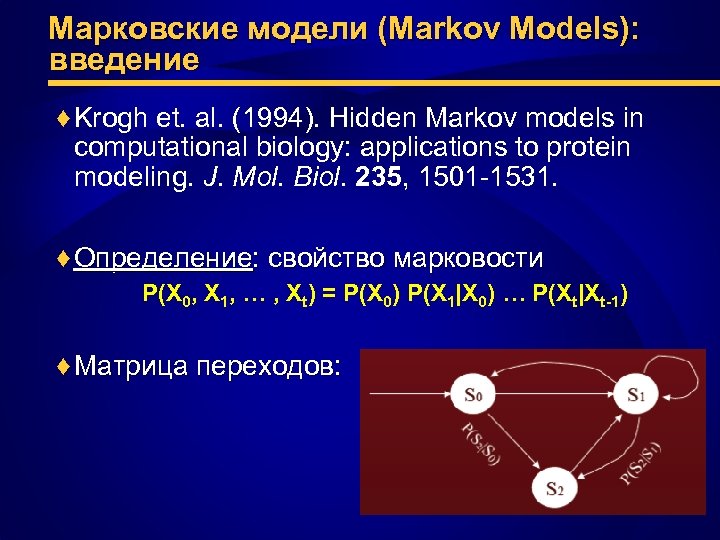

Марковские модели (Markov Models): введение ♦ Krogh et. al. (1994). Hidden Markov models in computational biology: applications to protein modeling. J. Mol. Biol. 235, 1501 -1531. ♦ Определение: свойство марковости P(X 0, X 1, … , Xt) = P(X 0) P(X 1|X 0) … P(Xt|Xt-1) ♦ Матрица переходов:

Марковские модели (Markov Models): введение ♦ Krogh et. al. (1994). Hidden Markov models in computational biology: applications to protein modeling. J. Mol. Biol. 235, 1501 -1531. ♦ Определение: свойство марковости P(X 0, X 1, … , Xt) = P(X 0) P(X 1|X 0) … P(Xt|Xt-1) ♦ Матрица переходов:

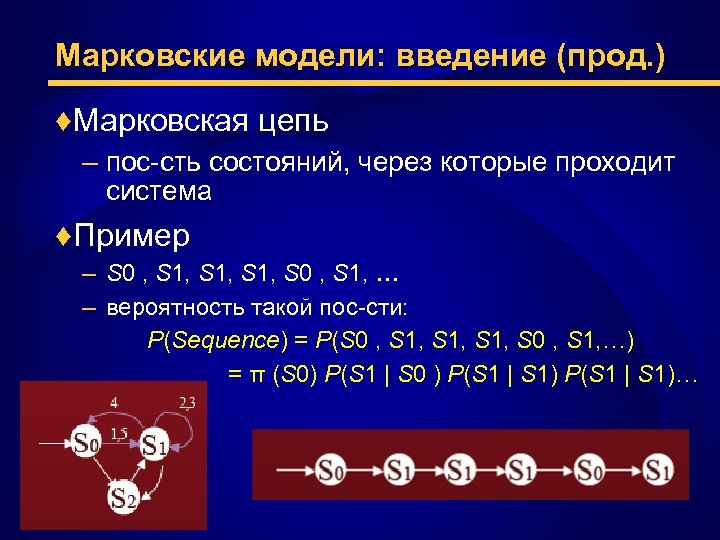

Марковские модели: введение (прод. ) ♦ Марковская цепь – пос-сть состояний, через которые проходит система ♦ Пример – S 0 , S 1, S 0 , S 1, … – вероятность такой пос-сти: P(Sequence) = P(S 0 , S 1, S 0 , S 1, …) = π (S 0) P(S 1 | S 0 ) P(S 1 | S 1)…

Марковские модели: введение (прод. ) ♦ Марковская цепь – пос-сть состояний, через которые проходит система ♦ Пример – S 0 , S 1, S 0 , S 1, … – вероятность такой пос-сти: P(Sequence) = P(S 0 , S 1, S 0 , S 1, …) = π (S 0) P(S 1 | S 0 ) P(S 1 | S 1)…

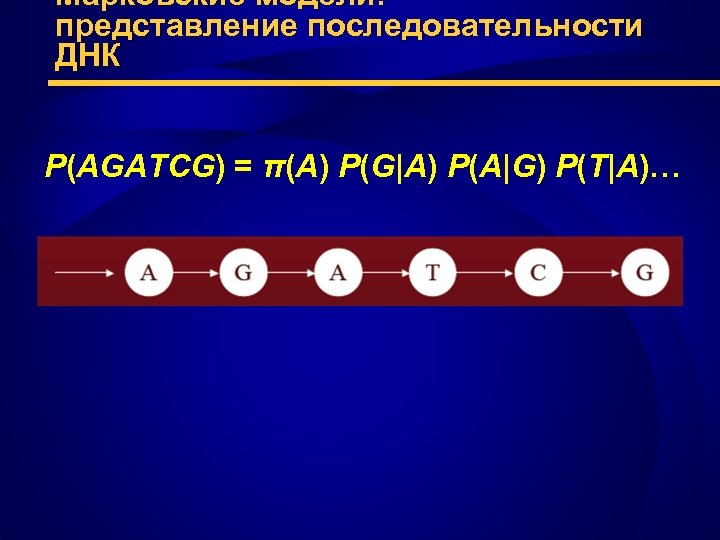

Марковские модели: представление последовательности ДНК P(AGATCG) = π(A) P(G|A) P(A|G) P(T|A)…

Марковские модели: представление последовательности ДНК P(AGATCG) = π(A) P(G|A) P(A|G) P(T|A)…

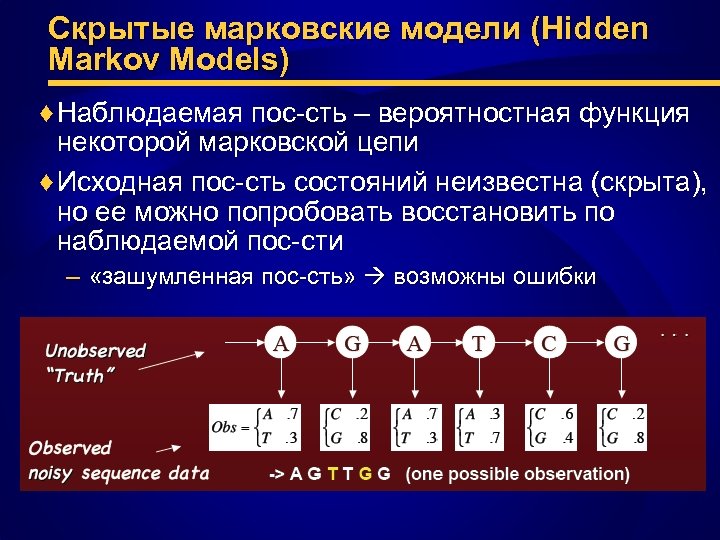

Скрытые марковские модели (Hidden Markov Models) ♦ Наблюдаемая пос-сть – вероятностная функция некоторой марковской цепи ♦ Исходная пос-сть состояний неизвестна (скрыта), но ее можно попробовать восстановить по наблюдаемой пос-сти – «зашумленная пос-сть» возможны ошибки

Скрытые марковские модели (Hidden Markov Models) ♦ Наблюдаемая пос-сть – вероятностная функция некоторой марковской цепи ♦ Исходная пос-сть состояний неизвестна (скрыта), но ее можно попробовать восстановить по наблюдаемой пос-сти – «зашумленная пос-сть» возможны ошибки

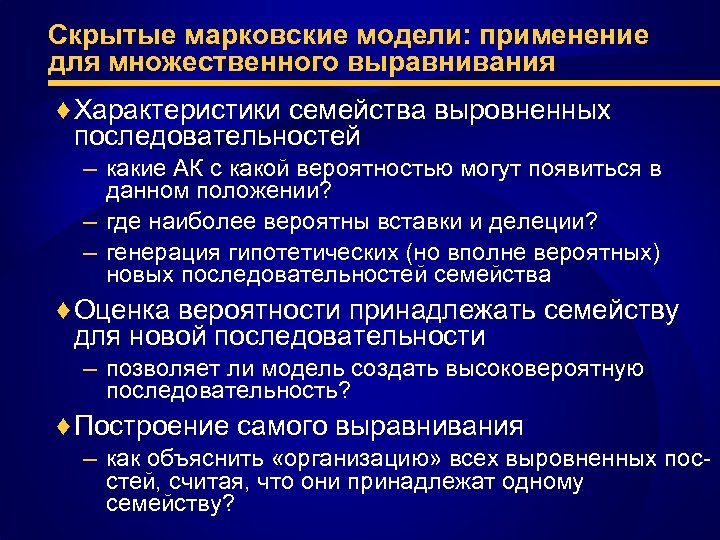

Скрытые марковские модели: применение для множественного выравнивания ♦ Характеристики семейства выровненных последовательностей – какие АК с какой вероятностью могут появиться в данном положении? – где наиболее вероятны вставки и делеции? – генерация гипотетических (но вполне вероятных) новых последовательностей семейства ♦ Оценка вероятности принадлежать семейству для новой последовательности – позволяет ли модель создать высоковероятную последовательность? ♦ Построение самого выравнивания – как объяснить «организацию» всех выровненных посстей, считая, что они принадлежат одному семейству?

Скрытые марковские модели: применение для множественного выравнивания ♦ Характеристики семейства выровненных последовательностей – какие АК с какой вероятностью могут появиться в данном положении? – где наиболее вероятны вставки и делеции? – генерация гипотетических (но вполне вероятных) новых последовательностей семейства ♦ Оценка вероятности принадлежать семейству для новой последовательности – позволяет ли модель создать высоковероятную последовательность? ♦ Построение самого выравнивания – как объяснить «организацию» всех выровненных посстей, считая, что они принадлежат одному семейству?

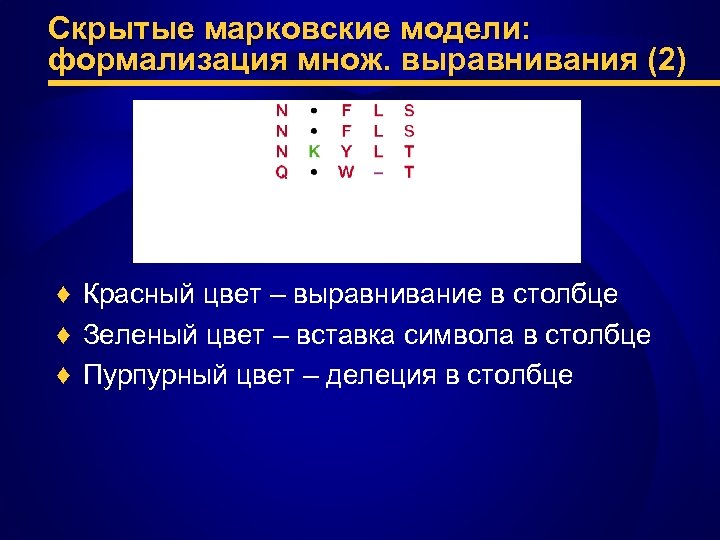

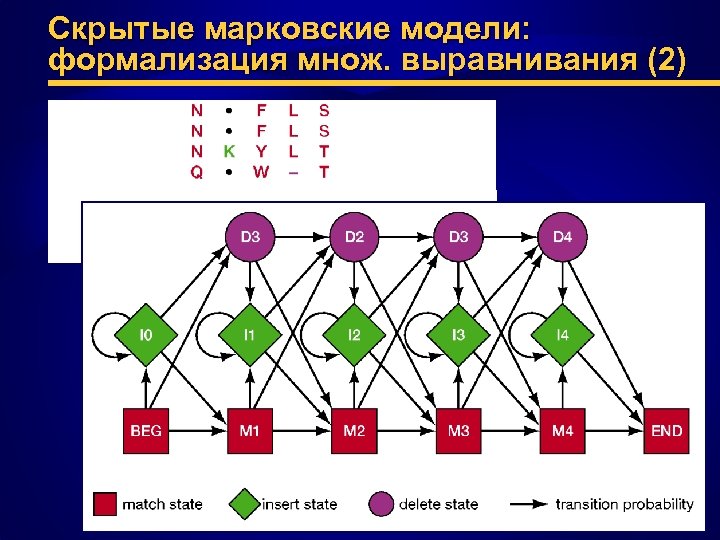

Скрытые марковские модели: формализация множ. выравнивания (2) ♦ Красный цвет – выравнивание в столбце ♦ Зеленый цвет – вставка символа в столбце ♦ Пурпурный цвет – делеция в столбце

Скрытые марковские модели: формализация множ. выравнивания (2) ♦ Красный цвет – выравнивание в столбце ♦ Зеленый цвет – вставка символа в столбце ♦ Пурпурный цвет – делеция в столбце

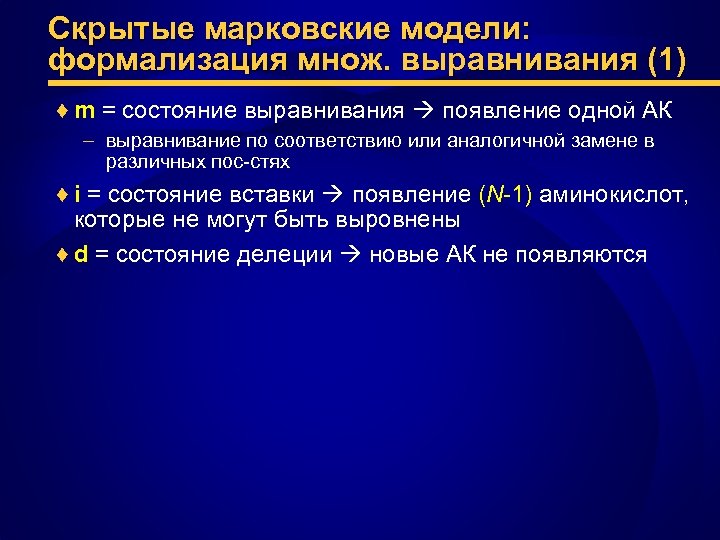

Скрытые марковские модели: формализация множ. выравнивания (1) ♦ m = состояние выравнивания появление одной АК – выравнивание по соответствию или аналогичной замене в различных пос-стях ♦ i = состояние вставки появление (N-1) аминокислот, которые не могут быть выровнены ♦ d = состояние делеции новые АК не появляются

Скрытые марковские модели: формализация множ. выравнивания (1) ♦ m = состояние выравнивания появление одной АК – выравнивание по соответствию или аналогичной замене в различных пос-стях ♦ i = состояние вставки появление (N-1) аминокислот, которые не могут быть выровнены ♦ d = состояние делеции новые АК не появляются

Скрытые марковские модели: формализация множ. выравнивания (2)

Скрытые марковские модели: формализация множ. выравнивания (2)

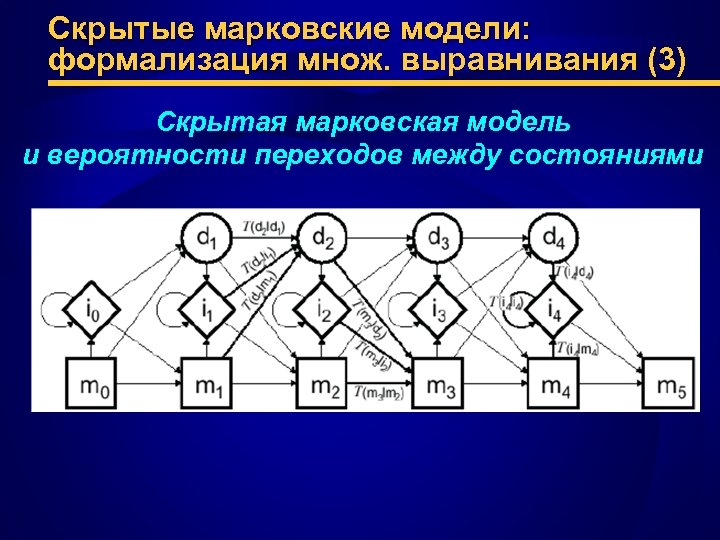

Скрытые марковские модели: формализация множ. выравнивания (3) Скрытая марковская модель и вероятности переходов между состояниями

Скрытые марковские модели: формализация множ. выравнивания (3) Скрытая марковская модель и вероятности переходов между состояниями

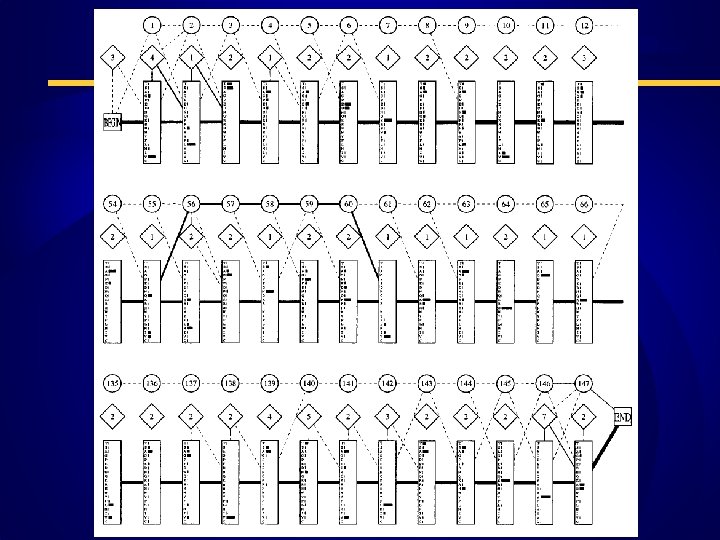

HMM для семейства глобинов ♦ Высоковероятная последовательность V G L H S T A P E A E - K W A N QAK L V C K T A… S… ♦ m-состояния показаны с вер-стями появления каждой из 20 АК ♦ i-состояниям приписаны длины вставок, если они выбраны ♦ d-состояния показывают позицию в выравнивании столбца с данными m, i, d

HMM для семейства глобинов ♦ Высоковероятная последовательность V G L H S T A P E A E - K W A N QAK L V C K T A… S… ♦ m-состояния показаны с вер-стями появления каждой из 20 АК ♦ i-состояниям приписаны длины вставок, если они выбраны ♦ d-состояния показывают позицию в выравнивании столбца с данными m, i, d

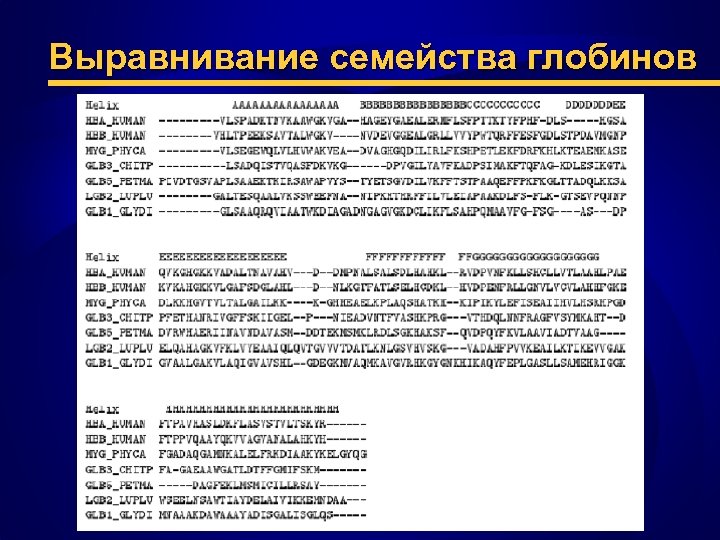

Выравнивание семейства глобинов

Выравнивание семейства глобинов

HMM: выравнивание последовательности по модели ♦ Для семейства белков построена HMM ♦ Для новой последовательности найти наиболее вероятный путь на графе

HMM: выравнивание последовательности по модели ♦ Для семейства белков построена HMM ♦ Для новой последовательности найти наиболее вероятный путь на графе

Скрытые марковские модели: программы для множ. выравнивания ♦ Sequence Alignment and Modeling (SAM) – Krogh et al. (1994), Hughey & Krogh (1996) ♦ HMMER – Eddy (1998) ♦ Pfam – база данных белковых семейств – Sonhammer et al. (1997)

Скрытые марковские модели: программы для множ. выравнивания ♦ Sequence Alignment and Modeling (SAM) – Krogh et al. (1994), Hughey & Krogh (1996) ♦ HMMER – Eddy (1998) ♦ Pfam – база данных белковых семейств – Sonhammer et al. (1997)

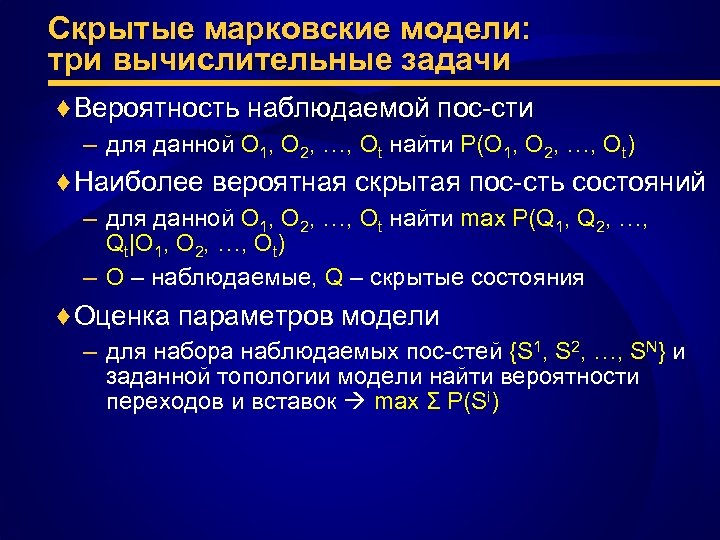

Скрытые марковские модели: три вычислительные задачи ♦ Вероятность наблюдаемой пос-сти – для данной O 1, O 2, …, Ot найти P(O 1, O 2, …, Ot) ♦ Наиболее вероятная скрытая пос-сть состояний – для данной O 1, O 2, …, Ot найти max P(Q 1, Q 2, …, Qt|O 1, O 2, …, Ot) – O – наблюдаемые, Q – скрытые состояния ♦ Оценка параметров модели – для набора наблюдаемых пос-стей {S 1, S 2, …, SN} и заданной топологии модели найти вероятности переходов и вставок max Σ P(Si)

Скрытые марковские модели: три вычислительные задачи ♦ Вероятность наблюдаемой пос-сти – для данной O 1, O 2, …, Ot найти P(O 1, O 2, …, Ot) ♦ Наиболее вероятная скрытая пос-сть состояний – для данной O 1, O 2, …, Ot найти max P(Q 1, Q 2, …, Qt|O 1, O 2, …, Ot) – O – наблюдаемые, Q – скрытые состояния ♦ Оценка параметров модели – для набора наблюдаемых пос-стей {S 1, S 2, …, SN} и заданной топологии модели найти вероятности переходов и вставок max Σ P(Si)

НММ: от обучения к применению ♦ Инициализация модели для данного набора пос-стей – своя HMM для каждого набора ♦ Итерационное обучение модели на 20 -100 пос-стях – представление вариабельности пос-стей из одного семейства – построение наилучшей HMM для данного семейства пос-стей путем оптимизации вер-стей переходов и АК-состава в каждой выровненной позиции – алгоритм forward-backward – алгоритм Baum-Welch ♦ Применения – множественные выравнивания (алгоритм Viterbi, аналог ДП) – анализ пос-стей и представление профилей (HMM профиля пос-сти) – анализ состава пос-стей – предсказание структуры белков – локализация генов путем предсказания ORF

НММ: от обучения к применению ♦ Инициализация модели для данного набора пос-стей – своя HMM для каждого набора ♦ Итерационное обучение модели на 20 -100 пос-стях – представление вариабельности пос-стей из одного семейства – построение наилучшей HMM для данного семейства пос-стей путем оптимизации вер-стей переходов и АК-состава в каждой выровненной позиции – алгоритм forward-backward – алгоритм Baum-Welch ♦ Применения – множественные выравнивания (алгоритм Viterbi, аналог ДП) – анализ пос-стей и представление профилей (HMM профиля пос-сти) – анализ состава пос-стей – предсказание структуры белков – локализация генов путем предсказания ORF

НММ: проблемы ♦ Значительное число пос-стей для обучения ♦ Чувствительность к параметрам инициализации – чем меньше начальное число пос-стей, тем выше чувствительность к начальным параметрам модели – > 50 пос-стей чувствительность минимальна – неравномерное распределение частот встречаемости АК • PAM • BLOSUM • смеси Дирихле (Sjölander, 1996) ♦ Слишком строгая «привязка» к обучающему семейству – сглаживание частот встречаемости АК – сохранение сведений о наиболее консервативных фрагмента – метод регуляризации ♦ Чем больше различий в пос-стях, тем труднее построить выравнивание при помощи HMM ♦ Локальные оптимумы вместо глобальных – подмешивание шума при обучении – имитационный отжиг (simulated annealing)

НММ: проблемы ♦ Значительное число пос-стей для обучения ♦ Чувствительность к параметрам инициализации – чем меньше начальное число пос-стей, тем выше чувствительность к начальным параметрам модели – > 50 пос-стей чувствительность минимальна – неравномерное распределение частот встречаемости АК • PAM • BLOSUM • смеси Дирихле (Sjölander, 1996) ♦ Слишком строгая «привязка» к обучающему семейству – сглаживание частот встречаемости АК – сохранение сведений о наиболее консервативных фрагмента – метод регуляризации ♦ Чем больше различий в пос-стях, тем труднее построить выравнивание при помощи HMM ♦ Локальные оптимумы вместо глобальных – подмешивание шума при обучении – имитационный отжиг (simulated annealing)