d2cc165bb22a8709c1ff61be5f7c0678.ppt

- Количество слайдов: 33

Autor: Dominika Nieszczerzewska kl. IIIB

WYNALAZKI

AKUMULATOR AMBULANS DYSKIETKA BATERIA ALKAICZNA EBONIT ELEKTROCENOGRAF BENZYNA GALWANIZACJA BOMBA BROŃ JĄDROWA FREON BROŃ PALNA BUTELKA LEJDEJSKA GRANAT CIEMNIA OPTYCZNA HIGROMETR

PRĄDNICA INDUKCYJNOŚĆ RADAR KOMÓRKA KALKULATOR LAMPA LASER PIORUNOCHRON SAMOLOT ŻARÓWKA OGNIWO GALWANICZNE PRĄD ELEKTRYCZNY

Pierwsza bateria Volty była ogniwem zużywającym się, a jej cynkowe płytki rozpuszczały się w miarę użytkowania. W rezultacie, można ją było zastosować tylko raz. W 1859 roku Francuz Gaston Planté wykonał pierwsze ogniwo dające się ponownie ładować; użył do tego dwóch kawałków folii ołowianej, które oddzielił kawałkiem flaneli, a następnie zwinął folię i zanurzył w kwasie. Naładował ogniwo przyłączając je do źródła prądu elektrycznego. Planté skoncentrował się na badaniu procesów elektrochemicznych zachodzących pod wpływem przepływającego prądu przez dwie płytki ołowiu zanurzone w roztworze kwasu siarkowego. Wybór okazał się trafny. Tak powstał akumulator ołowiowy. Dzisiaj, po 140 latach, nadal powszechnie korzystamy z tego rozwiązania. Pomimo jednak wprowadzenia ostatnio wielu rozmaitych udoskonaleń: nowych metod produkcji elektrod, nowego typu separatorów, opracowania sposobów regenerowania wody traconej z elektrolitu podczas ładowania (tzw. akumulator bezobsługowy), podstawowe parametry tego akumulatora poprawiono zaledwie nieznacznie w porównaniu do produkowanych przed wojną. Co gorsza, w najbliższym czasie nie zanosi się na żadną bardziej radykalną poprawę. Podobno aż około 50 tys. najrozmaitszych prób przeprowadził genialny Thomas A. Edison, by w końcu, w 1904 roku, stworzyć swój akumulator żelazowo-niklowy. Składał się on z płytki niklowej pokrytej wodorotlenkiem niklu (elektroda dodatnia) oraz płytki z żelaza (elektroda ujemna), zanurzonych w wodnym roztworze wodorotlenku potasu (roztwór zasadowy). Niestety aż do dnia dzisiejszego nie znalazł on szerszego zastosowania.

Już podczas krucjaty w XI wieku, rycerz św. Jan poznał metody udzielania pierwszej pomocy od Arabów i greckich doktorów - wtedy też pojawiło się po raz pierwszy w Europie pojęcie "ambulans". Jego rycerze udzielali po bitwie pomocy wszystkim rannym, przenosząc ich do pobliskich namiotów. Pierwszy ambulans zaprojektował w roku 1792 baron Dominique Jean Larey, osobisty chirurg Napoleona I. Wspólnie z naczelnym chirurgiem armii francuskiej, Pierrem Francois Percym, Larey utworzył korpus ambulansów składający się z noszowych i jednokonnych karetek. Każdy oddział miał 12 resorowanych pojazdów. Po raz pierwszy użyto ich w kampanii włoskiej Napoleona w latach 1796 -1797. Pierwszym ambulansem motorowym był samochód z silnikiem daimlera, wystawiony przez zakłady Panhard et Levassor na Salon du Cycle w paryskim Pałacu Przemysłu, w grudniu 1895 roku. Nie wiadomo, czy kiedykolwiek woził on pacjentów. Pierwszy motorowy ambulans w regularnej służbie pojawił się w 9 korpusie armii francuskiej w lipcu 1900 roku. W tym samym roku pojawił się (również we Francji) ambulans cywilny. Pierwszy raz użyto ich na froncie podczas bitwy pod Zanzur (wojna włosko-turecka) 8 czerwca 1912 roku. Przewiozły 70 rannych do szpitala polowego w Gargareszu i 40 zabitych na cmentarz. W roku 1950 Stany Zjednoczone po raz pierwszy zaczęły używać helikopterów - ambulansów podczas wojny w Korei. W 1968 roku, szpital św. Wincentego w Nowym Jorku, jako pierwszy zaczął używać karetki reanimacyjnej - zwanej dzisiaj potocznie "erką".

Pierwsze ogólnie dostępne na rynku baterie pojawiły się pod koniec XIX wieku. W przeciągu kilkudziesięciu lat dzięki ogniwom węglowo-cynkowym okazało się możliwe wyprodukowanie małych, zasilanych bateriami urządzeń, takich jak radia i latarki. Jednak w roku 1959 baterie węglowo-cynkowe wciąż nie miały wystarczającej żywotności do bardziej zaawansowanych urządzeń. Lew Urey z "Everedy Battery Co" obmyślił swój prototyp baterii alkalicznej i przekonał wszystkich, że jest to najlepsze rozwiązanie.

Z łacińskiego benzoe - nazwa żywicy jednego z drzew egzotycznych. Jest to mieszanina ciekłych węglowodorów parafinowych, naftalenowych, aromatycznych i nienasyconych, występujących w różnych stosunkach. Benzyna naturalna otrzymana przez destylację ropy naftowej stanowi bezbarwną ciecz o charakterystycznym zapachu. Olbrzymie zapotrzebowanie w XX wieku na benzynę jako paliwo do silników spalinowych napędzających rosnącą liczbę samochodów, spowodowało (oprócz produkcji benzyny naturalnej), opracowanie szeregu metod wytwarzania benzyny syntetycznej. Jej produkcję zapoczątkował w 1913 roku Niemiec Friedrich Bergius. Warto tutaj wspomnieć o zastosowaniu w 1922 roku czteroetylku ołowiu jako środka przeciwstukowego (tzw. benzyna ołowiowa) autorem jest Midgley (USA), oraz o otrzymaniu w 1935 roku benzyny syntetycznej o liczbie oktanowej 100 - autorem jest Ipatiew (Rosja) Benzyna stosowana jest nie tylko jako środek pędny do silników spalinowych, ale również jako rozpuszczalnik tłuszczów, kauczuku oraz do ekstrakcji.

Pierwsze wiadomości o chińskich bombach napełnionych prochem czarnym, opuszczanych podobno na łańcuchu z murów, aby wybuchły wśród oblegających, dotyczą obrony Kajfengu przed Mongołami w 1232 roku. Później bombą nazywano kulisty pocisk artyleryjski wypełniony prochem i wystrzeliwany z moździerzy. W odróżnieniu od pierwszych pocisków artyleryjskich, które były po prostu kulami kamiennymi (a później żelaznymi) i raziły cele tylko siłą swego uderzenia, działanie bomb polegało na rażeniu odłamkami swej żelaznej skorupy (a niekiedy również dodatkowo małych kulek wmieszanych w proch) w wyniku eksplozji prochu, już po upadku. Czas wybuchu bomby regulowała długość lontu. Skorupę tak konstruowano, aby upadała lontem ku górze (dzięki grubszej, a więc cięższej ściance po przeciwnej stronie), by uniknąć zgaszenia lontu podczas uderzenia pocisku w cel. Wynalazek tego pocisku przypisuje się Włochom lub Turkom (XV wiek), ale pewne wiadomości dotyczą stosowania bomb artyleryjskich przez Niemców w XVI wieku. Od XVII wieku bombami nazywano również czasem ciężkie bomby artyleryjskie. Obecnie bombą nazywa się potocznie przede wszystkim bomby lotnicze, zastosowane po raz pierwszy w 1912 roku w Trypolitanii podczas wojny włosko-tureckiej (wcześniejszej nieudanej próby nalotu bombowego na Wenecję przy użyciu balonów bez załogi dokonali Austriacy w 1849 roku). Nowoczesne lotnictwo wojskowe używa bomb rozmaitych typów i ciężaru, burzących, zapalających itp. W 1945 roku po raz pierwszy użyto bomby atomowej, a w 1952 roku bomby wodorowej (jądrowej). W wojnie morskiej używa się również bomb głębinowych do zwalczania okrętów podwodnych.

W 1938 roku Niemcy, Otto Hahni i Fritz Strassmann rozszczepili jądro uranu na jądra baru i kryptonu. 11 X 1939 roku grupa wybitnych fizyków atomowych, emigrantów z Europy, z Węgrem Leo Szilardem i Albertem Einsteinem na czele, poinformowała rząd USA o możliwości wyprodukowania broni jądrowej. Władze USA podjęły tę inicjatywę w 1941 roku, a w 1942 zainicjowano tzw. Projekt Manhattan, w ramach którego zbudowano w 1945 roku pod kierownictwem Jacoba Roberta Oppenheimera bombę atomową. Image Po udanej próbnej eksplozji 16 lipca na pustyni Alamogordo w stanie Nowy Meksyk, w dniach 6 i 9 sierpnia 1945 roku lotnictwo amerykańskie zrzuciło bomby atomowe (waga 4100 kg i siła rażenia 12 - 13 kiloton), na japońskie miasta Hiroszimę i Nagasaki, co przyśpieszyło bezwarunkową kapitulację Japonii. Monopol USA na bron jądrową nie trwał długo - w 1949 roku próbnej eksplozji bomby atomowej dokonał ZSRR, a następnie W. Brytania (1952 rok), Francja (1960 rok) i Chiny (1964 rok). Wprawdzie w 1952 zbudowano w USA pod kierownictwem Edwarda Tellera jeszcze potężniejszą bombę wodorową, ale już w 1953 roku tego typu bron jądrową wyprodukował ZSRR, a następnie W. Brytania (1957) i Chiny (1969). W 1963 roku największe mocarstwa dysponujące bronią jądrową - USA, ZSRR i W. Brytania - zawarły w Moskwie porozumienie w sprawie zakazu przeprowadzania eksplozji broni jądrowej w atmosferze, z uwagi na ich szkodliwość dla zdrowia. Obecnie kilkanaście państw dysponuje możliwościami zbudowania własnej broni jądrowej. Według fachowców, wojna światowa z użyciem broni jądrowej może doprowadzić do całkowitego zniszczenia planety na której żyjemy. Człowiek rozszczepiając atom, dokonał wynalazku zagrażającego wręcz dalszemu istnieniu naszego gatunku. W latach 1945 -1998 państwa posiadające bron jądrową przeprowadziły co najmniej 2050 testów nuklearnych. 423 ładunki zdetonowano w atmosferze, resztę stanowiły próby podziemne.

Wczesne działa miały lufy zgrzewane z żelaznych sztabek, od połowy XIV wieku odlewano je z brązu; w końcu XIV wieku wytwarzano już armaty o ciężarze do 15 ton. Stosowano kule kamienne, dość szybko wyparte przez ołowiane, a potem żelazne. W Polsce po raz pierwszy użyto armat przy oblężeniu Pyzdr (1383 rok). Mniejsze z wczesnych dział zwano puszkami ręcznymi, z nich rozwinęła się w końcu XIV wieku broń palna ręczna (petrynał, arkebuz). Około 1530 roku, we Włoszech i w Niemczech pojawiły się pistolety z zamkiem kołowym, jako uzbrojenie kawalerii, a w drugiej połowie XVI wieku rusznice i muszkiety (Włochy, Hiszpania). W XVII wieku powstały we Francji strzelby skałkowe (fuzje, flinty), a w XVIII wieku weszła w użycie broń palna odtylcowa. W 1807 roku szkocki duchowny Alexander J. Forsyth wynalazł zamek kapiszonowy jak również w tym samym roku wynalazł spłonkę naboju. W roku 1835 Amerykanin Samuel Colt opatentował swój rewolwer, w 1861 roku Amerykanin Oliver Winchester skonstruował pierwszy, w pełni udany, karabin powtarzalny, a w roku 1888 Austriak Ferdinand Mannlicher karabin samopowtarzalny (zamek iglicowy powstał w Prusach w 1866 roku). Początki gwintowania lufy miały miejsce w XVII wieku, ale na wielką skalę zaczęto stosować gwintowane karabiny i działa w Europie zachodniej od połowy XIX wieku - gwintowanie stosuje się aby ustabilizować lot pocisku. Pierwszy (wielolufowy) karabin maszynowy skonstruowany w 1862 roku przez Amerykanina Richarda J. Gatlinga znalazł zastosowanie podczas wojny secesyjnej, przy oblężeniu Charlestonu (rok 1864). Karabin odtylcowy - Philo Remington - 1816 -89 (USA), Nowoczesny karabin maszynowy stworzył w 1884 roku Amerykanin Hiram S. Maxim. Karabin wielostrzałowy -1860 rok - Spencer (USA), Karabin maszynowy wielolufowy - 1902 rok - Ishikawa (Japonia).

Tales z Miletu około 550 roku p. n. e. zaobserwował zjawiska elektrostatyczne. Zauważył, że potarty bursztyn nabiera zdolności przyciągania skrawków pewnych materiałów. Jego odkrycia wykorzystał W. Gilbert dopiero w XVI wieku, wykazując, że nie tylko bursztyn (po grecku nazywa się elektron), ale wiele innych substancji można naelektryzować przez tarcie. Jego badania kontynuował Otto von Guericke który około 1663 roku wynalazł prostą maszynę elektrostatyczną, dzięki której zauważył, że stan naelektryzowania można przenosić na inne przedmioty. W 1729 roku Anglik Stephen Gray stwierdził, że fluid elektryczny umie przenieść się ze szklanej rury na jej zatyczkę, oraz zauważył, że istnieją dobre i złe przewodniki prądu elektrycznego. Używając metalowych przewodów odkrył, że osoba połączona drutem z ciałem silnie naelektryzowanym doznawała silnego wstrząsu. Od tego momentu elektryczność stała się "modna". Nieco później dokonano odkrycia, że istnieją dwa rodzaje naelektryzowania ciał, i wprowadzono nazwy: elektryczność żywiczna i elektryczność szklana. Znaczny postęp w badaniach doświadczalnych spowodowało wynalezienie butelki lejdejskiej czyli najstarszej postaci kondensatora elektrycznego (po łacinie "condenso" oznacza: zgęszczam, zbieram) - urządzenia do przechowywania elektryczności. Właściwości butelki odkrył przypadkowo w 1745 roku w Lejdzie (stąd nazwa), Pieter van Musschenbroek, profesor tamtejszego uniwersytetu oraz niezależnie od niego Ewald Jürgen von Kleist. Pierwotnie było to naczynie ze szkła wypełnione wodą i zatkane korkiem, który był przebity na wylot miedzianym drutem. Butelkę można było naładować elektrycznie stykając pręt z naładowanym ciałem. Poprzez drut i wodę prąd dostawał się do środka naczynia i ładował dodatnio lub ujemnie jego wewnętrzne ścianki. Pojemność elektryczną można było znacznie zwiększyć, pokrywając szkło od zewnątrz i wewnątrz folią przewodzącą prąd. Po połączeniu obu folii przewodnikiem można było uzyskać wyraźne efekty rozładowania butelki lejdejskiej. Wkrótce po wynalezieniu tego przyrządu, francuski ksiądz Jean Francois Nollet, zapalony eksperymentator, na dziedzińcu królewskiego pałacu w Wersalu, w obecności króla i całego dworu, rozładował butelkę lejdejską, używszy zamiast przewodnika łańcucha trzymających się za ręce 240 królewskich gwardzistów. Zgromadzona w butelce elektryczność pokazała, jak potężną jest siłą. Ku wielkiemu podziwowi, ale i wielkiej uciesze widzów, porażeni wyładowaniem gwardziści równocześnie podskoczyli do góry. Innym razem ten sam eksperymentator rozładował butelkę łańcuchem niemal trzykilometrowej długości utworzonym z zakonników opactwa w Chartreux, połączonych ze sobą odcinkami drutu. I w tym doświadczeniu jego uczestnicy wyraźnie odczuli wstrząs. Wielkie znaczenie dla rozwoju elektrostatyki miały prace doświadczalne Beniamina Franklina, który w roku 1752 złapał prąd z błyskawicy do butelki lejdejskiej i dowiódł, że w piorunach jest elektryczność.

Pierwsze wieści o tej nowej dziedzinie wynalazczości człowieka pochodzą z roku 900 n. e. , i dotyczą przyrządu, który zbudowali naukowcy islamscy dla prowadzenia obserwacji astronomicznych. Także starożytni Chińczycy używali podobnych instrumentów do obserwacji. Przyrząd był tak prosty, że na dobrą sprawę zbudować go mógłby każdy z nas. Wystarczy pomalowana wewnątrz na czarno skrzyneczka, płytka matowego szkła i jedna dziurka. Jeżeli dziurkę tę umieścimy w jednej ze ścian skrzyneczki, a ściankę przeciwległą zastąpimy matowym szkłem - ujrzymy na nim odwrócony wprawdzie do góry nogami i pomniejszony, ale niezwykle wierny obraz otoczenia. Obraz tak wierny, że ta "ciemna izba" (po łacinie camera obscura) zrobiła istną furorę wśród. . . XVIII wiecznych malarzy portrecistów. Narodzin camera obscura można się doszukiwać już w starożytnej Grecji. Już Euklides w swojej Optyce opisywał prostoliniowe rozchodzenie się światła, a zatem przewidział możliwość powstawania obrazu po przejściu promieni słonecznych przez niewielki otwór. Pierwszą pewną wiadomość o niej, w końcu X wieku podaje Arab Alhazen z Basry, który zaproponował użycie przyrządu do obserwacji zaćmień Słońca. Wzmianki o ciemni optycznej znajdują się również w pismach Rogera Bacona - rok 1292 i Leonarda da Vinci - około roku 1500. W drugiej połowie XVI wieku ciemnię optyczną zaczęto ulepszać - głównie za zasługą Girolamo Cardano, oraz dzięki pracom wenecjanina Daniela Barbaro który wymienił otwór na soczewkę zbierającą. Po nim, w roku 1588, zabrał się za czarne pudełko camera obscura Neapolitańczyk Giovanni Battista della Porta, który dodał do soczewki przysłonę. Zastosowano również wklęsłe zwierciadło, dzięki czemu uzyskiwano obraz większy i wyraźniejszy. Kiedy jeszcze sto lat później Niemiec Johann Zahn skonstruował matówkę i w miejsce pierwotnej dziurki domontował wymienną optykę, udoskonalona ciemnia optyczna wkrótce znalazła zastosowanie w nowej dziedzinie - fotografii. Rozwinął się z niej aparat fotograficzny.

Dyskietkę (z angielskiego: floppy disc, flexy disc, w informatyce - dysk elastyczny), jako pamięć pomocniczą komputera w postaci tarczy obrotowej, pokrytej materiałem magnetycznym do zapisywania i odczytywania danych, wymyślił prawdopodobnie Japończyk Yoshiro Nakamatsa w roku 1950. Jest to plastikowy krążek z naniesioną warstwą ferromagnetyku, służący jako tani nośnik pamięci masowej - do wielokrotnego zapisu. Standardowe wymiary dyskietki wynoszą obecnie 3, 5 cala (dawniej 5, 25 cala), a pojemność najczęściej to 1, 44 MB (inne pojemności w systemie: DOS - 360 KB, 1, 2 MB, 720 KB i 2, 88 MB). Istnieją również dyskietki 8", 3", 2", 1, 8" o innych pojemnościach. Te same dyskietki używane w różnych systemach operacyjnych mogą mieć różne pojemności. Obecnie coraz powszechniej (zamiast dyskietek) stosowane są dyski optyczne (pamięć pomocnicza komputera w postaci obrotowej tarczy z informacją odczytywaną promieniem lasera; rozróżnia się dyski pozwalające tylko na odczyt (ROM - read only memory), dyski pozwalające na jednorazowy zapis (WORM - write once read many), oraz dyski wielokrotnego zapisu. Wśród dysków ROM najprostsze są dyski CD ROM (compact disc ROM), identyczne, co do budowy i sposobu zapisu, z dźwiękowymi płytami kompaktowymi. Dyski optyczne są zwykle bardziej niezawodne od dysków magnetycznych i mają znacznie większą od nich pojemność.

Wulkanizowanie kauczuku naturalnego lub syntetycznego kauczuku z 25 -30% zawartością siarki prowadzi do wytworzenia gumy twardej, zwanej ebonitem. Ten tzw. duroplast modyfikowany po raz pierwszy otrzymał w 1843 roku T. Hancock. Ebonit jest twardym, wytrzymałym na rozciąganie materiałem o barwie ciemnobrązowej lub czarnej. Daje się łatwo obrabiać i polerować, jest bardzo odporny chemicznie i nie przewodzi prądu elektrycznego. Stosuje się go do wyrobu skrzynek akumulatorowych, wykładzin. Dawniej był bardzo ceniony, obecnie zastępują go inne tworzywa sztuczne.

Aparat do rejestrowania (za pomocą dwóch elektrod przyłożonych do czaszki lub mózgu połączonego z urządzeniem wzmacniającym i zapisującym częstotliwość fal) czynnościowych prądów mózgu - zmian jego aktywności. Urządzenie rejestruje sygnały z mózgu w postaci drgań elektrycznych, które informują o rozmieszczeniu źródeł fal elektromagnetycznych wewnątrz mózgu. Interpretacja różnic między wykresami aktywności mózgu normalnego z patologicznym, pozwala wykorzystać je do celów diagnostycznych. Metoda elektroencefalografii (EEG) rozwinęła się w latach powojennych dzięki rozwojowi techniki elektronowej. Pierwsze spostrzeżenia o elektrycznej aktywności mózgu królików i małp pochodzą z roku 1875 od angielskiego fizjologa R. Catona. Przykładając elektrody do obnażonej powierzchni mózgu po trepanacji czaszki udało mu się za pomocą czułego galwanometru zarejestrować występowanie zmiennych potencjałów elektrycznych. Na przełomie XIX i XX wieku liczni badacze, również Polacy (A. Beck i N. Cybulski) prowadzili podobne badania, ograniczone jednak z powodu niedoskonałości aparatury. Historię współczesnej EEG w nowoczesnym zrozumieniu zapoczątkował swoimi pracami niemiecki psychiatra Hans Berger. Badania rozpoczął jeszcze w 1902 roku, a dopiero w 1924 roku zarejestrował precyzyjnie elektryczną aktywność mózgu człowieka po trepanacji, jak i w przypadkach czaszki nie uszkodzonej. Prawdziwy rozwój elektroencefalografii rozpoczął się po II wojnie światowej.

Galwanizacja - zastosowanie zjawiska elektrolizy, czyli osadzanie się na jednej z elektrod cienkiej warstwy metalu pochodzącego z elektrolitu. Stosuje się do ochrony metali przed korozją oraz w celach zdobniczych. Przedmiot który ma być pokryty warstwą innego metalu stanowi katodę, natomiast czysty kawałek metalu, który zostanie użyty do powlekania - anodę. Elektrolit zawiera związek metalu pokrywającego. Przykładowo, kiedy chcemy pokryć stal cienką warstwą cyny, to jako anodę zastosujemy cynę metaliczną, elektrolitem będzie roztwór siarczanu cyny. Po włączeniu prądu, dodatnio naładowane jony cyny zaczną przepływać przez elektrolit w kierunku stalowej katody i osadzać się na niej. Jako pierwszy spróbował pozłocenia srebrnych medali włoski chemik, Luigi V. Brugnatelli w 1805 roku używając w tym celu napięcia z baterii, którą zaledwie pięć lat wcześniej zbudował Aleksander Volta. Jego pomysł został odrzucony przez Napoleona Bonaparte, który sprawił również, że pomysłodawca nie mógł w kraju opublikować efektów swojej pracy. Jednakże Luigi Brugnatelli dokładnie opisał swoje doświadczenie w czasopiśmie belgijskim. W roku 1837 M. H. Jacobi zastosował elektrolizę do pokrywania przedmiotów cienkimi warstwami metalowymi, trwale związanymi z podłożem (tzw. galwanostegia), a w 1839 roku do wykonywania metalowych kopii przedmiotów przez nakładanie na powierzchnię modelu stosunkowo grubej warstwy metalu, łatwej do oddzielenia (tzw. galwanoplastyka). Po odkryciu, przez Johna Wright z Anglii, że podczas złocenia i srebrzenia przedmiotów jako elektrolitu najlepiej jest użyć cyjanku potasu, w roku 1840 George Richard Elkington i H. de Ruolz opatentowali metody elektrolitycznego złocenia i srebrzenia. Prawo do eksploatacji ich wynalazku natychmiast wykupili francuscy jubilerzy za olbrzymią na owe czasy sumę 600 tysięcy franków. W roku 1843 A. Becquerel opracował metodę chromowania, która jednak na szeroką skalę zaczęła być stosowana dopiero po roku 1920. Pierwsze przemysłowe wyroby niklowane pojawiły się w roku 1869, ale lśniące powłoki niklowe wytwarza się dopiero od 1934 roku. Po raz pierwszy powlekanie galwaniczne po to, żeby uszlachetnić biżuterię, zostało zastosowane w roku 1857.

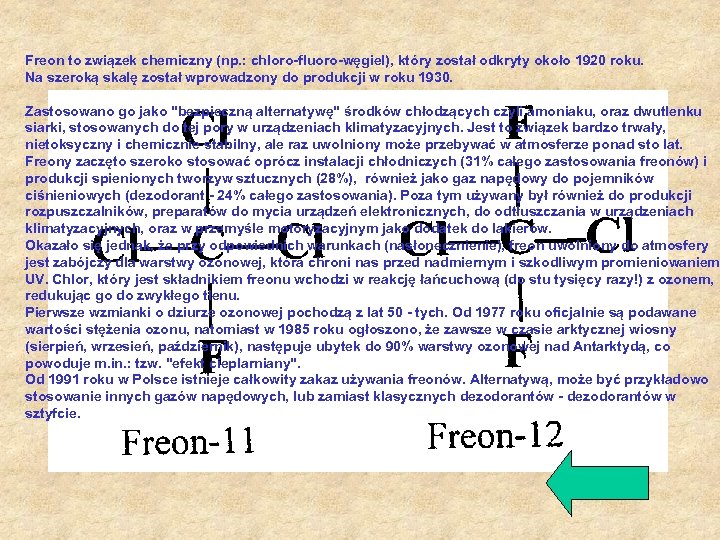

Freon to związek chemiczny (np. : chloro-fluoro-węgiel), który został odkryty około 1920 roku. Na szeroką skalę został wprowadzony do produkcji w roku 1930. Zastosowano go jako "bezpieczną alternatywę" środków chłodzących czyli amoniaku, oraz dwutlenku siarki, stosowanych do tej pory w urządzeniach klimatyzacyjnych. Jest to związek bardzo trwały, nietoksyczny i chemicznie stabilny, ale raz uwolniony może przebywać w atmosferze ponad sto lat. Freony zaczęto szeroko stosować oprócz instalacji chłodniczych (31% całego zastosowania freonów) i produkcji spienionych tworzyw sztucznych (28%), również jako gaz napędowy do pojemników ciśnieniowych (dezodorant - 24% całego zastosowania). Poza tym używany był również do produkcji rozpuszczalników, preparatów do mycia urządzeń elektronicznych, do odtłuszczania w urządzeniach klimatyzacyjnych, oraz w przemyśle motoryzacyjnym jako dodatek do lakierów. Okazało się jednak, że przy odpowiednich warunkach (nasłonecznienie), freon uwolniony do atmosfery jest zabójczy dla warstwy ozonowej, która chroni nas przed nadmiernym i szkodliwym promieniowaniem UV. Chlor, który jest składnikiem freonu wchodzi w reakcję łańcuchową (do stu tysięcy razy!) z ozonem, redukując go do zwykłego tlenu. Pierwsze wzmianki o dziurze ozonowej pochodzą z lat 50 - tych. Od 1977 roku oficjalnie są podawane wartości stężenia ozonu, natomiast w 1985 roku ogłoszono, że zawsze w czasie arktycznej wiosny (sierpień, wrzesień, październik), następuje ubytek do 90% warstwy ozonowej nad Antarktydą, co powoduje m. in. : tzw. "efekt cieplarniany". Od 1991 roku w Polsce istnieje całkowity zakaz używania freonów. Alternatywą, może być przykładowo stosowanie innych gazów napędowych, lub zamiast klasycznych dezodorantów - dezodorantów w sztyfcie.

Pocisk ręczny lub artyleryjski wypełniony materiałem wybuchowym, rażący nieprzyjaciela odłamkami swej skorupy lub siłą wybuchu zawartego w nim materiału kruszącego. Po raz pierwszy opisano wybuchającą glinianą "bombę", która spowodowała szkody w bitwie między armią francuską i hiszpańską w roku 1528. Granatów zarówno ręcznych jak i artyleryjskich na szeroką skalę zaczęto używać w siedemnastym wieku. Granaty ciskane ręcznie miały początkowo kształt kulisty i powłokę zrobioną z gliny lub szkła. Pierwsze granaty artyleryjskie miały skorupę żeliwną i były używane jako pociski rozpryskowe do rażenia żywej siły nieprzyjaciela. Od dziewiętnastego wieku granaty artyleryjskie są stosowane jako pociski burzące. W osiemnastym wieku granaty ręczne zaczęły wychodzić z użycia; w drugiej połowie dziewiętnastego wieku stosowano je już rzadko. Odrodzenie granatów ręcznych, szeroko używanych w wojnach nowoczesnych, nastąpiło podczas wojny rosyjsko-japońskiej (1904 -1905).

Higrometr (z grec. hygros - wilgotny, mokry) - urządzenie wykorzystujące zmiany własności pewnych substancji w wyniku zmiany wilgotności badanego ośrodka. Podobno zagadnieniami wilgotności powietrza zajmował się już w XV wieku n. e. Nicolaus Krebs (Mikołaj z Kuzy), matematyk i filozof, który wykonał również całkiem dokładną mapę Europy Środkowej. Na pewno zagadnienie to zainteresowało Leonarda da Vinci, który pierwsze próby zbadania zawartości pary wodnej przeprowadzał w latach 1480 - 1486, konstruując kilka przyrządów, których głównym elementem była waga szalkowa z podziałką. Jako materiał higroskopijny, zmieniający swoje właściwości pod wpływem wilgotnego powietrza, zastosował kulę z bawełny lub wełny. Kula absorbując wilgoć z otoczenia zwiększała swoją masę - wychylenia wagi wskazywały zmiany wilgotności otoczenia. Zbudował tym samym pierwszy higrometr absorpcyjny, gdzie pomiar wilgotności polega na zważeniu pochłoniętej w materiale higroskopijnym wody. W roku 1775 bogaty szwedzki fizyk i geolog Horacy de Saussure zauważył, że włos ludzki wyciąga się, gdy jest wilgotny. To spostrzeżenie zostało wykorzystane do skonstruowania higrometru czyli wilgotnościomierza. Pod koniec XVIII zbudowano pierwszy higrometr włosowy - włosy ludzkie jako materiał higroskopijny są stosowane do dnia dzisiejszego. Istnieją ponadto: higrometr kondensacyjny gdzie pomiar polega na wyznaczeniu punktu rosy, oraz higrometr elektrolityczny który mierzy zmiany przewodności wywołane wilgotnością.

Jako pierwszy odkrył związek elektryczności z magnetyzmem Duńczyk Hans Oersted - w 1820 roku wykazał, że prąd elektryczny przepływający przez drut może wytworzyć pole magnetyczne - w postawionym obok kompasie W 1821 roku francuski uczony André Ampére uzyskał efekt odwrotny - przepuszczając prąd przez drut znajdujący się w polu magnetycznym silnego magnesu spowodował poruszanie się drutu. Kontynuacją tej myśli były prace które prowadził Michael Faraday w Wielkiej Brytanii od roku 1821. Po dziesięciu latach nieudanych prób przypadek sprawił, że badacz spojrzał na galwanometr w tej samej chwili, kiedy wkładał magnes do zwojnicy. Zauważył ze zdumieniem, że wskazówka miernika wychyla się podczas wkładania magnesu do zwojnicy, a następnie, kiedy już magnes został w niej umieszczony, powraca do położenie zerowego. Stwierdził, że pole magnetyczne może indukować prąd elektryczny - kiedy zamknięty w obwód przewodnik poruszamy w polu magnetycznym lub wewnątrz nieruchomego zwoju przesuwamy magnes, to w przewodniku indukowana jest siła elektromotoryczna wywołująca przepływ elektronów - zaczyna płynąć prąd - jego kierunek zależy od kierunku ruchu magnesu. Natomiast natężenie prądu jest proporcjonalne do szybkości zmian pola magnetycznego. To zjawisko stanowi podstawę działania prądnic wytwarzających energię elektryczną. Miniaturowym generatorem jest np. dynamo rowe, które wytwarza zmienne względem obwodu elektrycznego pole magnetyczne, dzięki czemu w obwodzie indukowany jest prąd - zaczyna świecić żarówka. Podobne badania prowadził Joseph Henry w USA. Wyróżniamy dwa rodzaje indukcji: 1 - własna, która polega na wzbudzaniu siły elektromotorycznej w obwodzie, który sam wytworzył zmienne pole magnetyczne; 2 - wzajemna, gdy zmienne pole magnetyczne powstałe wokół obwodu o zmiennym natężeniu prądu indukuje prąd elektryczny w sąsiednim obwodzie. Jednostką indukcyjności jest henr (H). To o czym tutaj mowa - zjawisko indukcji elektromagnetycznej - stało się bezpośrednią przyczyną skonstruowania prądnicy, a następnie zbudowania silnika elektrycznego. .

5 lutego 1850 roku opatentowano maszynę do dodawania z naciskanymi klawiszami. Urządzenie samo w sobie nie stanowiło żadnej rewelacji: nie było praktyczne, nie zyskało popularności. Do historii przeszła jedynie nazwa: kalkulator. W styczniu 1954 roku - w Nowym Jorku po raz pierwszy zademonstrowano prototyp kalkulatora elektronicznego. Dopiero w marcu 1970 zaprezentowano pierwszy kalkulator z prawdziwego zdarzenia: liczył i drukował na papierze przeprowadzone operacje. W 1972 roku firma Texas Instruments wypuściła na rynek pierwszy kalkulator z mikroprocesorem. Autorami byli Merryman i Tassel. Jego poprzednikiem był kalkulator z 1967 roku, ale było to duże urządzenie. Dopiero miniaturyzacja spowodowała, że kalkulatory stawały się coraz mniejsze, aż stały się cienkie jak blaszka i zasilane bateriami słonecznymi. To właśnie te małe cacka, które pozwolono używać na klasówkach i egzaminach, sprawiają, że chociaż w szkole podstawowej wszyscy uczą się ile jest "2 x 2", to większość nie bardzo potrafi obliczyć w pamięci bardziej skomplikowane działania, jak np. "6 x 8". Ale nie tylko w szkole kalkulator stał się nieodzownym przedmiotem codziennego użytku. Dopóki pełna "fiskalizacja" nie opanowała handlu, był głównym przyrządem do obliczeń należności za zakupy, wypierając królujące ze sklepów liczydła. Dziś kalkulatory w sklepach są wypierane przez kasy fiskalne. Ciągle jednak są powszechnie używane na bazarach. Przez lata obliczenia inżynierskie kojarzyły się z suwakiem logarytmicznym. Ciekawe, czy absolwenci opuszczający dziś mury politechnik wiedzą jeszcze, jak taki suwak wygląda. Zresztą i kalkulatory przestają być dziś w użyciu, gdyż ich funkcje spełniają komputery. Kalkulator - chociaż nadal jest używany - można uznać za urządzenie przejściowe. Mimo że na rynku są kalkulatory wykonujące bardzo skomplikowane funkcje matematyczne, to jednak nie wydają się być urządzeniem przyszłościowym. Kalkulatory i komputery, wykonujące cztery działania matematyczne i wiele innych funkcji, znacznie szybciej niż człowiek, spowodowały, iż dziś nie jest w cenie umiejętność sprawnego liczenia w pamięci czy nawet na papierze. Z jednej strony jest to duże ułatwienie, ale z drugiej warto dodać, iż korzystając z kalkulatora tracimy jeden z elementów ćwiczących naszą pamięć. Bez niej zaś człowiek nie mógłby dokonać tego wszystkiego, co składa się na cywilizację techniczną! Jej składnikiem są też kalkulatory i komputery. Człowiek stworzył sieć opasują ziemię niewidocznymi "nićmi", którą przekazuje i w której pamięciach zbiera informacje od wieków gromadzone przez umysły ludzkie. Czy jednak w jakimś momencie nie używana ludzka pamięć nie zdegraduje swoich funkcji i człowiek nie będzie wiedział, jak skorzystać z nieprzebranych pokładów informacji zgromadzonej w różnych serwerach?

3 kwietnia 1973 roku w Nowym Jorku Martin Cooper z koncernu Motorola po raz pierwszy zadzwonił z telefonu komórkowego - ciężkiego aparatu Dyna Tac (ważącego ponad 1, 5 kilograma), bez wyświetlacza - do swojego największego rywala, Joela Engela, dyrektora Bell Labs (Lucent). Motorola jako pierwsza wprowadziła w Ameryce usługi telefonii komórkowej. Za historyczny model przyjmuje się najczęściej telefon Motorola Dyna TAC 8000 X, który pojawił się na rynku w 1984 roku. Wielkością dorównywał porządnej cegle, ważył blisko kilogram i na dodatek kosztował - bagatela - 3995 dolarów. Dzisiaj telefony ważą czasami niecałe 30 gramów, a jest ich na całym świecie już ponad miliard. W Polsce przez komórki rozmawiamy dopiero od czerwca 1992 roku (początkowo tylko w Warszawie), i aż trudno uwierzyć, że w tej chwili już około 17 milionów osób w naszym kraju korzysta z "komórek". Na całym świecie jest już ponad 1, 5 miliarda (styczeń 2004) telefonów komórkowych. Pewnie to się wyda dziwne, ale przez telefony komórkowe może nam zabraknąć żywności. Telefon emituje promieniowanie, które zakłóca system nawigacyjny pszczół - te nie potrafią wrócić do ula, a poza rojem giną. Jeśli będzie ich mało, nie zdołają zapylić roślin uprawnych. . .

Najdawniejsze stanowiły naturalne wgłębienia w kamieniach i muszlach, od około 3000 roku p. n. e. sporządzano w tym celu specjalne naczynia ceramiczne, a z czasem metalowe. Od II tysiąclecia p. n. e. znano w Egipcie knot tkany lub pleciony z lnu i konopi. Lampa olejna przetrwała prawie bez zmian do końca XVIII wieku, kiedy szwajcarski chemik Aime Argand udoskonalił w latach 1782 - 1784 jej palnik, doprowadzając powietrze do wnętrza knota. W 1792 roku Szkot, Wiliam Murdock wynalazł lampę gazową, stosowaną głównie do oświetlania ulic w Londynie (1809), Paryżu (1819) i innych miastach Europy i Ameryki Płn. (w Warszawie od 1856 roku). Pierwszymi lampami elektrycznymi były lampy łukowe, wykorzystujące zjawisko łuku elektrycznego. Pierwszy publiczny pokaz działania lampy łukowej dał w 1843 roku na placu Zgody w Paryżu Francuz L. Deleuil, a jego rodak Henri Archereau zastosował w 1848 roku lampy łukowe do oświetlania wystaw i opery w Paryżu. Ponieważ w miarę wypalania się elektrod zwiększał się odstęp pomiędzy ich końcami i lampa łukowa gasła, próbowano temu zaradzić stosując mechanizmy zegarowe zbliżające stopniowo do siebie elektrody. W pełni użyteczną lampą łukową była dopiero lampa udoskonalona przez Rosjanina Pawła N. Jabłoczkowa. Od 1853 roku stosowano też lampę naftową wynalezioną przez lwowskiego aptekarza Ignacego Łukasiewicza. W pełni praktyczną lampą elektryczną, nadającą się do oświetlania również niewielkich pomieszczeń, stała się żarówka. Próbowano ją skonstruować od 1840 roku, jednakże dopiero Amerykanin Thomas A. Edison stworzył w 1879 roku jej użyteczną postać. Kalendarium: - lampa elektronowa z siatką ekranującą - Walter Schottky - 1886 -1976 (Szwajcaria), - lampa fluorescencyjna - 1879 - Thomas A. Edison (USA), - lampa górnicza - 1815 - George Stephenson (Anglia), - lampa naftowa - 1853 - Łukasiewicz (Polska), - lampa elektronowa (dioda) - 1904 - Fleming -Wielka Brytania - lampa neonowa (świetlówka) - 1910 - Georges Claude (Francja), - lampa rentgenowska - 1916 - William D. Coolidge (Francja), - lampa rtęciowa - 1912 - Hewitt (USA), - lampa żarowa (gazowa) - 1913 - Langmuir (USA),

Laser jest wzmacniaczem promieniowania świetlnego działającym na zasadzie wymuszonej emisji, a jego nazwa pochodzi od skrótu nazwy angielskiej - Light Amplification by Stimulated Emission of Radiation. Światło, które wpada do cylindrycznego wnętrza lasera, zostaje przechwycone przez dwa zwierciadła. Odbijając się od nich, przekazuje swoją energię wypełniającej cylinder substancji (gazu lub kryształu). Atomy kryształu lub gazu zostają wzbudzone poprzez absorpcję fotonów światła. Kiedy wzbudzone atomy zderzają się z kolejnymi fotonami, emitują energię w postaci światła. Wyemitowane światło ma jednakową częstotliwość fali, stąd nazywa się je światłem spójnym. Długość takiej fali zależna jest od materiału z jakiego laser został wykonany. Zjawisko wymuszonej emisji odkrył w drodze teoretycznych rozważań Albert Einstein, analizując prawa promieniowania świetlnego. Możliwość otrzymania zjawiska wymuszonej emisji promieniowania elektromagnetycznego na drodze eksperymentalnej uzasadnił w 1940 roku radziecki uczony W. A. Fabrikant. W latach 1952 - 53 z koncepcją budowy wzmacniacza mikrofal działającego na zasadzie wymuszonej emisji wystąpili, niezależnie od siebie, Charles H. Townes i jego współpracownicy w Stanach Zjednoczonych. Pierwsze takie urządzenie, noszące nazwę lasera, zostało zbudowane w 1954 roku. Wynalazek lasera polegał na rozszerzeniu wykorzystania zjawiska wymuszonej emisji promieniowania elektromagnetycznego na zakres fal świetlnych. Z pierwszym projektem tego rodzaju urządzenia wystąpił w 1958 roku ponownie Townes wraz z innym fizykiem amerykańskim Arthurem L. Schawlowem. Rok później Townes zbudował model lasera, lecz próby nie wypadły pomyślnie. Pierwszy czynny laser został zbudowany po kilku dalszych miesiącach. W maju 1960 roku młody amerykański badacz Theodor H. Maiman z laboratorium Hughes Aircraft Company zademonstrował laser rubinowy, wytwarzający niezwykle spójną i monochromatyczną wiązkę światła. Wkrótce po laserze rubinowym, w którym akcja laserowa zachodzi w jonach chromu krystalicznego rubinu, został zbudowany laser gazowy (akcja laserowa przebiega w nim w mieszaninie helu i neonu), a następnie w 1962 roku laser półprzewodnikowy i w 1963 roku laser cieczowy. Promień lasera ma bardzo różnorodne zastosowania praktyczne - od medycyny, poprzez elektronikę, nowoczesne uzbrojenie, do np. sprawdzania oświetlenia w nowo budowanym tunelu.

Ogniwo galwaniczne jest to urządzenie zamieniające bezpośrednio energię chemiczną na energię elektryczną prądu stałego. Proces ten następuje w wyniku reakcji elektrochemicznych (tzn. reakcji chemicznych z oddawaniem lub przyłączaniem elektronów). Ogniwo zasadniczo składa się z dwóch różnych elektrod zanurzonych w tym samym roztworze elektrolitu (tzn. substancji, której cząsteczki w roztworze ulegają dysocjacji elektrolitycznej, czyli rozpadowi na pary jonów dodatnich i ujemnych), lub dwóch identycznych elektrod zanurzonych w różnych roztworach. Elektrody są połączone tak, że możliwy jest przepływ prądu elektrycznego po zamknięciu obwodu zewnętrznego przewodnikiem. Właśnie jony powstałe w wyniku dysocjacji warunkują powstawanie na powierzchniach elektrod podwójnych warstw elektrycznych. Wskutek tego elektroda zyskuje pewien potencjał względem roztworu (tzw. napięcie kontaktowe). Pierwsze ogniwa galwaniczne znane były prawdopodobnie już w III wieku p. n. e. Wskazują na to wykopaliska archeologiczne. Wśród wykopalisk znaleziono liczne przedmioty pokryte galwanicznie cienką warstwą złota, pochodzące z czasów starożytnych. Prawdopodobnie rzemieślnicy przejmowali te umiejętności od swych poprzedników od bardzo dawnych czasów. Rozpowszechnienie ogniwa galwanicznego datuje się dopiero od początku XIX wieku dzięki pionierskim odkryciom i pracom Alessandro Volty - wcześniej, już w 1771 roku Luigi Galvani zaczął badania nad zjawiskami elektrycznymi. W roku 1800, Volta zbudował pierwsze ogniwo galwaniczne (nazwane tak na cześć Galvaniego). Jako elektrod używał miedzi, mosiądzu lub srebra (elektroda dodatnia) i cyny lub cynku (elektroda ujemna) w postaci krążków oddzielonych kawałkami papieru (później tkaniny) nasyconych wodą morską (potem roztworem wodnym kwasu siarkowego) jako roztworem elektrolitu. Ogniwo galwaniczne Volty zostało potem znacznie zmodyfikowane i udoskonalone - w roku 1835 J. F. Daniell zbudował ogniwo galwaniczne zwane do dziś ogniwem Daniella. Używał on elektrod: miedzianej (jako dodatniej) i cynkowej (ujemnej), z których pierwsza była zanurzona w roztworze wodnym siarczanu miedzi, druga zaś - siarczanu cynku; obydwa roztwory oddzielone były porowatą przegrodą ceramiczną. Dzisiaj ogniwo Daniella ma już tylko historyczną wartość. Dalszy postęp ogniwa galwaniczne zawdzięczają przede wszystkim G. Leclanchemu, który w 1877 roku zbudował ogniwo nazwane potem jego imieniem, natomiast w 1893 roku E. Weston zbudował stosowane szeroko do dziś (jako wzorcowe) ogniwo galwaniczne o wyjątkowo stałej i powtarzalnej sile elektromotorycznej.

Przepływ ładunku elektrycznego, czyli prąd elektryczny, zaobserwował po raz pierwszy około 1663 roku niemiecki uczony Otto von Guericke. Zauważył on, że ciało obojętne połączone struną metalową z ciałem naładowanym zyskuje ładunek elektryczny. Badania S. Graya doprowadziły w 1734 roku do stwierdzenia, że najlepszymi (spośród wówczas znanych) przewodnikami elektryczności są metale. Sam prąd elektryczny jako zjawisko nie był jednak w tych czasach badany. Generatory elektrostatyczne pozwalały wprawdzie wytwarzać stosunkowo wysokie napięcie, jednakże prądy jakie uzyskiwano, były niezwykle słabe i krótkotrwałe. Przełomowe znaczenie dla badań miało wynalezienie ogniwa galwanicznego przez włoskiego fizyka Alessandro Volta w 1800 roku. Uczony ten zbudował też pierwszą baterię takich ogniw, nazwaną stosem Volty. Doświadczenia z prądem elektrycznym doprowadziły wkrótce do odkrycia zjawiska indukcji elektromagnetycznej (Faraday - 1831 rok), co z kolei podsunęło pomysł wynalazku prądnicy. Pierwszą prądnicę wirującą prądu zmiennego skonstruował już w 1832 roku Francuz Hippolyte Pixii. W 1866 roku inżynier niemiecki Werner Siemens wynalazł prądnicę samowzbudną tzw. dynamomaszynę, a w 1870 roku pracujący w Paryżu Belg Zenobe Gramme zbudował pierwszą prądnicę prądu stałego, tzw. dynamo. Chociaż prąd elektryczny pod koniec XIX wieku był już dość szeroko wykorzystywany, to nie myślano jeszcze o upowszechnieniu energii elektrycznej na skalę masową. Potrzebę dostarczania prądu elektrycznego większej liczbie odbiorców stworzył wynalazek praktycznej żarówki elektrycznej. Jej wynalazca Thomas A. Edison był zarazem założycielem pierwszej publicznej elektrowni zbudowanej w Nowym Jorku. Uruchomiona w 1882 roku miała 6 prądnic prądu stałego, z których każda poruszana była silnikiem parowym o mocy 125 KM. Ta pierwsza elektrownia miejska zasilała prądem o napięciu 110 V sieć elektryczną, do której włączono 7200 żarówek. Pierwsza duża elektrownia prądu zmiennego powstała w 1885 roku w Depford pod Londynem. W 1891 roku zbudowano pierwszą elektrownię wodną w pobliżu Portland w stanie Oregon (St. Zjednoczone). Pierwsza elektrownia atomowa została uruchomiona w 1954 roku w Obnińsku koło Kaługi (ZSRR).

Urządzenie chroniące budynki przed uderzeniem pioruna, przez odprowadzenie do ziemi prądu wyładowania o natężeniu rzędu kilkunastu tysięcy amperów. Najprostszy piorunochron to zaostrzony metalowy pręt, ustawiony pionowo w najwyższym punkcie zabezpieczanego obiektu, połączony z ziemią przewodem o znacznym przekroju poprzecznym (co najmniej 50 mm kwadratowych). W wyniku swych badań nad elektrycznością atmosferyczną w latach 1746 -1752 i stwierdzenia elektrycznej natury pioruna, Beniamin Franklin zaczął instalować w Filadelfii pierwsze piorunochrony własnego pomysłu w czerwcu lub lipcu 1752 roku, a we wrześniu wyposażył w piorunochron własny dom (w 1782 roku liczba piorunochronów w Filadelfii przekroczyła 400). W Londynie pierwszy piorunochron zainstalował na swym domu W. Watson w 1762 roku. W Polsce dzięki inicjatywie króla Stanisława Augusta Poniatowskiego wyposażono w tzw. wówczas "konduktory" Zamek Królewski w Warszawie. Początkowo nie wszyscy darzyli piorunochrony zaufaniem (zasłużony badacz elektryczności, ksiądz J. A. Nollet przekładał tradycyjny sposób przeciwdziałania piorunom za pomocą bicia w dzwony kościelne - jego zdaniem piorunochrony "raczej mogą ściągać na nas pioruny niż chronić nas przed nimi"). W przeciwieństwie do Franklina, niektórzy uczeni byli za tępym zakończeniem piorunochronu. Po wyzwoleniu się kolonii amerykańskich, niechętny Franklinowi król angielski Jerzy III usiłował skłonić Royal Society do zajęcia takiego stanowiska. Wówczas prezes Towarzystwa, J. Pringle dał mu słynną odpowiedź: "Sir, nie potrafię zmieniać praw ani zjawisk natury". "W takim razie, podaj się lepiej do dymisji" - poradził mu władca, nie odznaczający się błyskotliwym intelektem. Piorun porusza się z prędkością od 160 do 1600 kilometrów na sekundę, a miejsce w które piorun uderzył rozgrzewa się (w ciągu tysięcznej części sekundy), nawet do temperatury 30 000 stopni Celsjusza! - to aż sześć razy więcej, niż na zewnętrznej powłoce Słońca. Co minutę w Ziemię uderza 6000 piorunów. Natężenie prądu płynącego w piorunie wynosi 200 tysięcy amperów, rekord sięgał pół miliona amperów. Napięcie wyrażać się może w milionach woltów, a moc w tysiącach megawatów. Szerokość kanału pioruna zmienia się w czasie i rośnie od kilku milimetrów do 2 - 3 centymetrów, natomiast długość pioruna waha się w granicach kilometra, ale spotkano także takie, które miały więcej niż 10 kilometrów - zanotowano ponoć iskry o długości 40 -50 km, a nawet o długości. . . 150 kilometrów. Rocznie na świecie porażonych przez pioruny jest kilka tysięcy osób, dziennie kilkudziesięciu. To niesamowite, ale według "Księgi Guinessa" niejaki Roy C. Sullivan z USA, został porażony piorunem w roku 1977 aż siedem (!) razy. . . i przeżył.

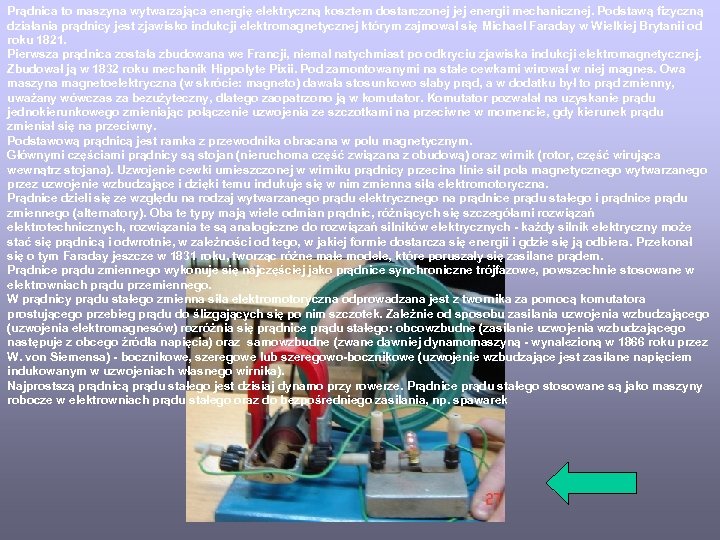

Prądnica to maszyna wytwarzająca energię elektryczną kosztem dostarczonej jej energii mechanicznej. Podstawą fizyczną działania prądnicy jest zjawisko indukcji elektromagnetycznej którym zajmował się Michael Faraday w Wielkiej Brytanii od roku 1821. Pierwsza prądnica została zbudowana we Francji, niemal natychmiast po odkryciu zjawiska indukcji elektromagnetycznej. Zbudował ją w 1832 roku mechanik Hippolyte Pixii. Pod zamontowanymi na stałe cewkami wirował w niej magnes. Owa maszyna magnetoelektryczna (w skrócie: magneto) dawała stosunkowo słaby prąd, a w dodatku był to prąd zmienny, uważany wówczas za bezużyteczny, dlatego zaopatrzono ją w komutator. Komutator pozwalał na uzyskanie prądu jednokierunkowego zmieniając połączenie uzwojenia ze szczotkami na przeciwne w momencie, gdy kierunek prądu zmieniał się na przeciwny. Podstawową prądnicą jest ramka z przewodnika obracana w polu magnetycznym. Głównymi częściami prądnicy są stojan (nieruchoma część związana z obudową) oraz wirnik (rotor, część wirująca wewnątrz stojana). Uzwojenie cewki umieszczonej w wirniku prądnicy przecina linie sił pola magnetycznego wytwarzanego przez uzwojenie wzbudzające i dzięki temu indukuje się w nim zmienna siła elektromotoryczna. Prądnice dzieli się ze względu na rodzaj wytwarzanego prądu elektrycznego na prądnice prądu stałego i prądnice prądu zmiennego (alternatory). Oba te typy mają wiele odmian prądnic, różniących się szczegółami rozwiązań elektrotechnicznych, rozwiązania te są analogiczne do rozwiązań silników elektrycznych - każdy silnik elektryczny może stać się prądnicą i odwrotnie, w zależności od tego, w jakiej formie dostarcza się energii i gdzie się ją odbiera. Przekonał się o tym Faraday jeszcze w 1831 roku, tworząc różne małe modele, które poruszały się zasilane prądem. Prądnice prądu zmiennego wykonuje się najczęściej jako prądnice synchroniczne trójfazowe, powszechnie stosowane w elektrowniach prądu przemiennego. W prądnicy prądu stałego zmienna siła elektromotoryczna odprowadzana jest z twornika za pomocą komutatora prostującego przebieg prądu do ślizgających się po nim szczotek. Zależnie od sposobu zasilania uzwojenia wzbudzającego (uzwojenia elektromagnesów) rozróżnia się prądnice prądu stałego: obcowzbudne (zasilanie uzwojenia wzbudzającego następuje z obcego źródła napięcia) oraz samowzbudne (zwane dawniej dynamomaszyną - wynalezioną w 1866 roku przez W. von Siemensa) - bocznikowe, szeregowe lub szeregowo-bocznikowe (uzwojenie wzbudzające jest zasilane napięciem indukowanym w uzwojeniach własnego wirnika). Najprostszą prądnicą prądu stałego jest dzisiaj dynamo przy rowerze. Prądnice prądu stałego stosowane są jako maszyny robocze w elektrowniach prądu stałego oraz do bezpośredniego zasilania, np. spawarek.

Nazwa tego urządzenia wykrywającego i określającego położenie jakiegoś obiektu w przestrzeni na podstawie rejestrowania odbitych od niego fal radiowych, jest skrótem angielskich słów Radio Angle Detection And Range. Zjawisko odbijania się fal radiowych, zwłaszcza od obiektów metalowych, znane było już w końcu XIX wieku. W 1922 roku Amerykanie A. H. Taylor i Leo C. Young stwierdzili zakłócenie łączności radiowej na falach o długości 5 m między nadajnikiem i odbiornikiem, które ustawione były na przeciwnych brzegach rzeki, gdy przepływał nią statek. To podsunęło im pomysł wykorzystania fal radiowych do wykrywania poruszających się w terenie przedmiotów. Jednak pierwszy zrealizował ten pomysł szkocki fizyk Robert A. Watson - Watt. W 1935 roku zademonstrował on Brytyjskiemu Komitetowi Obrony Powietrznej aparat, za pomocą którego wykrył z odległości 50 km nadlatujący samolot. W tym samym roku przystąpiono w Wielkiej Brytanii do budowy nadbrzeżnej sieci eksperymentalnych radarów, składającej się z 5 stacji pracujących na falach o długości 25 m. Sieć ta pozwalała wykrywać nadlatujące samoloty z odległości 90 km. W 1937 roku zbudowano w Anglii radar znacznie doskonalszy, pracujący na falach 1, 5 m, przy czym urządzenie miało takie wymiary, że mogło być umieszczane na samolotach. W przededniu II wojny światowej Wielka Brytania miała już sprawną sieć stacji radarowych pracujących na falach o długości 12 m, służących do zdalnego ostrzegania, i sieć stacji pracujących na falach o długości 1, 5 m. służących do wykrywania nisko lecących samolotów. Ta, zbudowana w całkowitej tajemnicy, osłona radarowa zdecydowała w dużej mierze o porażce Niemców w powietrznej bitwie o Anglię w sierpniu i wrześniu 1940 roku. Po wojnie radar znalazł również liczne zastosowania pokojowe.

Rozpoczęło się wcześnie, bo już w 1505 roku Leonardo da Vinci w "Kodeksie lotu ptasiego" sformułował zasady lotu. 9 października 1890 roku samolot "Eole" Francuza Clémenta Adera wykonał skok długości 50 m. Jednak pamiętna data w lotnictwie i zarazem data pierwszego prawidłowego lotu samolotem to 17 grudnia 1903 roku, kiedy to dwaj Amerykanie, bracia Wright wykonali serię udanych lotów pierwszym na świecie poprawnie latającym samolotem Flyer, własnej konstrukcji. W sylwestra 1903 roku Wilbur Wright przeleciał we Francji 125 kilometrów na swym samolocie. W tym roku także nastąpił gwałtowny rozwój lotnictwa francuskiego, co dało początek rozwojowi lotnictwa na świecie. 25 lipca 1909 roku Francuz Louis Bleriot przeleciał kanał La Manche z Francji do Anglii. Kolejne lata to wybuch I wojny światowej, która zawsze pociąga za sobą rozwój techniczny. Tak było i tym razem -szybki rozwój techniki nie ominął i lotnictwa. Powstawało coraz więcej doskonalszych samolotów dla potrzeb wojska, najpierw samolotów zwiadowczych, później także i myśliwców. Po tak przyspieszonym rozwoju 5 lutego 1919 roku otwarto pierwszą w Niemczech komunikacyjną linię lotniczą, co dało początek komunikacji pasażerskiej w Europie. - 14 czerwca 1919 roku Anglicy John Alcock i Artur Whitten Brown dokonali pierwszego przelotu samolotem nad Atlantykiem Północnym. - 9 maja 1926 roku to pierwszy lot w bardzo niesprzyjających warunkach atmosferycznych, a mianowicie w okolicach Bieguna Północnego. - 20 maja 1927 roku to pamiętny samotny przelot nad Atlantykiem Amerykanina Charles Lindbergha, który przeleciał tym samym pierwszy raz trasę z Nowego Yorku do Paryża. - 23 czerwca 1931 roku to rozpoczęcie 8 dniowego lotu Amerykanina Wileya Posta dookoła świata. Tuż przed wybuchem II wojny światowej, 2 sierpnia 1939 roku w Niemczech oblatano pierwszy samolot odrzutowy Heinkel He-178. Znów kolejna wojna światowa, i znów rozwój techniki lotniczej okupionej wieloma tysiącami istnień. Po wojnie w roku 1945 otwarto pierwszą transatlantycką linię lotniczą z Wielkiej Brytanii do USA, co jest zarazem początkiem regularnej transatlantyckiej komunikacji lotniczej. - 14 października 1947 roku Amerykanin Charles (Chuck? ) Yager przekroczył barierę dźwięku na samolocie rakietowym Bell X-1. Nazwał swój samolot "Glamorous Glennis" (zachwycająca Glennis) na cześć swojej żony. W przeddzień lotu złamał sobie dwa zebra. - 27 lipca 1949 roku wykonano pierwszy lot pierwszym pasażerskim samolotem odrzutowym - de Havilland Comet produkcji angielskiej. - 27 czerwca 1962 roku Amerykanin Robert White osiągnął prędkość 6693 km/h na samolocie rakietowym X-15. Natomiast 22 sierpnia 1963 roku także Amerykanin na tym samolocie Joseph Walker osiągnął wysokość 107 960 m. - 21 stycznia 1976 roku to dzień, w którym pasażerski samolot naddźwiękowy Concorde (produkowany wspólnie przez Francję i Wielką Brytanię) rozpoczął swoją podróż. Marzec 2004 roku przyniósł, po 50 latach badań i około 230 milionów dolarów wydanych na ten cel, ogromny sukces. Niepozorny, zaledwie czterometrowy, bezzałogowy samolot odrzutowy X-43 A z eksperymentalnym silnikiem (wykorzystującym tlen z atmosfery), pobił rekord szybkości.

Edisona. Pod koniec I połowy XIX wieku podjęto w różnych krajach próby skonstruowania żarówki elektrycznej, czyli urządzenia, którego włókno żarowe (tzw. żarnik) rozżarza się pod wpływem przepływającego przezeń prądu elektrycznego i świeci. Pionierzy żarówki mieli do przezwyciężenia duże trudności: musieli dobrać właściwy materiał na włókno żarowe, aby przewodził prąd elektryczny nie topiąc się jednocześnie pod wpływem gorąca, następnie zaś uzyskać stosunkowo wysoką próżnię, aby umieszczone w niej włókno nie utleniało się. Z uwagi na powyższe ograniczenia ich osiągnięcia były raczej znikome. Pierwszym odnotowanym w historii wynalazcą żarówki był Anglik Frederick de Moleyns, który w 1841 roku opatentował skonstruowaną przez siebie lampkę elektryczną. Lampka miała cienki drucik platynowy, który rozżarzał się pod wpływem prądu elektrycznego. Jego żarówki nie znalazły uznania, gdyż platyna pod wpływem wysokiej temperatury miękła i topiła się. Znacznie lepsza była żarówka wyposażona we włókienko węglowe, którą wynalazł w 1854 roku niemiecki emigrant, nowojorski optyk, mechanik i zegarmistrz Henry Goebel. Jako że przywiązywał dużą wagę do reklamy swojej firmy, pewnego wieczoru na dachu domu w którym mieszkał zapłonęła wielka lampa łukowa, która ponoć dawała fantastyczny efekt. Policja kazała mu jednak usunąć lampę w obawie o możliwość zaprószenia ognia. Nieustępliwy pan Goebel po kilku latach prób zareklamował się w inny sposób. Otóż oświetlił swoją wystawę dziwnie wyglądającymi lampkami. Zainteresowanym objaśniał, ze są to bańki próżniowe zawierające zwęglone włókna bambusa przez które przepływał prąd elektryczny. Były zasilane bateriami ogniw galwanicznych. Wówczas nie znano jeszcze dynamomaszyny - dopiero w kilka lat później Gramme i Siemens zbudowali pierwsze generatory elektryczne. Trzecim wynalazcą żarówki był rosyjski fizyk, mieszkaniec Petersburga, Aleksander Łodygin. Żarówka Łodygina wynaleziona w 1873 roku dawała silne światło, osiągnęła też dość długi, jak na ówczesne czasy, okres świecenia - pół godziny. Była to szklana kula z kawałkiem węgla w środku, rozżarzonym przez prąd elektryczny. Wśród wczesnych pionierów żarówki wyróżniał się Joseph Wilson Swan, stosujący włókno węglowe już w roku 1848, który uzyskał na tyle zadowalające wyniki w roku 1878, że otrzymał na swój wynalazek patent - jego żarówka świeciła przez 13, 5 godziny i miała włókno z bambusa, zasadniczą różnicą był cokół bagnetowy, w przeciwieństwie do edisonowskiego gwintu. Praktyczną, w pełni użyteczną żarówkę wynalazł zespół badawczy w laboratorium w Menlo Park (USA) pod kierownictwem T. A. Edisona. Jego pierwsza żarówka paliła się tylko 8 minut, ale po kilkumiesięcznych żmudnych pracach udało się im w roku 1879 skonstruować żarówkę z włóknem węglowym świecącą przez kilkadziesiąt godzin, a później przedłużyć czas jej świecenia do ponad 100 godzin. Przy następnych próbach wybrano pewien gatunek japońskiego bambusa, którego zwęglone włókna okazały się najtrwalsze. Umieszczone w szklanej banieczce, z której wypompowano powietrze paliły się przez kilkaset godzin jasnym żółtym światłem. W XX wieku zaczęto używać w żarówkach drucików z wolframu (1907) i wypełniać je rozrzedzonym gazem obojętnym (najpierw argonem, a następnie kryptonem). Nowoczesną żarówkę skonstruował w 1913 roku Irving Langmuir.

d2cc165bb22a8709c1ff61be5f7c0678.ppt