e7f1a5dd8f4c37f1f16a7d70d95f5949.ppt

- Количество слайдов: 120

Abteilung Informatik Informations- und Codierungstheorie a. F&E Prof. Dr. -Ing. Andreas Rinkel andreas. rinkel@hsr. ch Sprechstunde: Jeden Montag 10: 00 bis 11: 00, Raum: 6. 110 Tel. : +41 (0) 55 2224928 Mobil: +41 (0) 79 3320562 http: //rinkel. ita. hsr. ch

Struktur Abt. Informatik Prof. Dr. Ing. A. Rinkel Literaturempfehlungen Einführung • • • Motivation Modell der Informationsübertragung und Problemdefinition Exkurs Wahrscheinlichkeitsrechnung Einführung in die Informationstheorie • • Informationsgehalt, Entropie, Redundanz und mittlere Codewortlänge Binärcodierung Diskrete Quellen mit und ohne Gedächtnis Quellencodierung: Übersicht Kompressionsverfahren § Beispiele: Morse Alphabet, Fanao, Huffmann, ZIP, Kryptoverfahren • • Kanalmodell, Kanalmatrix, Maximum-Likelihood, Transinformation Kanalkodierung: Fehlererkennung und Behebung § § Verfahren von Hamming Binäre Gruppencodes Zyklische Codes (Beispiel: HDLC, X. 75, TCP) Faltungscodes Signale: Träger der Information • • • Klassifizierung von Signalen Zeit und Frequenzbereich der Signaldarstellung Abtastung und Quantisierung (Beispiel PCM) Leitungscodierung 2

Prüfung Abt. Informatik Prof. Dr. Ing. A. Rinkel • Keine Prüfungen während des Vorlesungszeitraums • Prüfung in der Prüfungszession • Prüfungsdauer 120 min, bitte pünktlich erscheinen! § Die Prüfung besteht aus zwei Teilen – Teil 1: Erlaubt sind keine Unterlagen (Prüfungsdauer 30 min) – Teil 2; Erlaubt sind Taschenrechner, Unterlagen, Bücher, . . (Prüfungsdauer 90 min) • Nicht erlaubt: Labtop, Kommunikationsmittel, . . • Gefragt werden § Wissen § Verständnis und § Transferleistung 3

Literatur I Abt. Informatik Prof. Dr. Ing. A. Rinkel Empfohlene Begleitliteratur Informatiionstheorie: • M. Werner, Information und Codierung, Vieweg Verlag uni-script. • H. Klimant, R. Piotrascheke, D. Schönfeld, Informations- und Kodierungstheorie, Teubner • H. Rohling, Einführung in die Informations- und Codierungstheorie, Teubner Studienbücher. Eine gute praxisorientierte Einführung in die Grundlagen der Informations- und Codierungstheorie und in ihre Anwendung Gute und detaillierte Einführung, beinhaltet auch einen kleinen Abschnitt zur Quantisierung, was den anderen Büchern fehlt. Eine allgemeine, gut verständliche Einführung. Zur Vertiefung empfohlene weiterführende Literatur: • W. Willems, Codierungstheorie, de Gruyter, Mathematische Einführung • Ralph-Hardo, Einführung in die Codierungstheorie, Schulz Vieweg Verlagsgesellschaft • A. Betten, H. Fripertinger, A. Kerber, A. Wassermann, K. -H. Zimmermann, Codierungstheorie. Konstruktion und Anwendung linearer Codes, Springer-Verlag Angesprochen werden Themen aus den Gebieten: Quellencodierung, Prüfzeichenverfahren, fehlerkorrigierende Codes und Kryptosysteme. Begriffe, Methoden und Sätze sind bis ins Detail ausführlich dargestellt und durch viele einfache Beispiele erläutert. Eine Einführung in die Theorie der linearen Codes, in der zyklische Codes besonders ausführlich behandelt werden. Großer Wert wird auch auf computerunterstützte Methoden gelegt. 4

Literatur II Abt. Informatik Prof. Dr. Ing. A. Rinkel Empfohlene Begleitliteratur Signale Werner, Nachrichtentechnik, Vieweg Verlag Sehr gute, leicht verständliche aber dennoch vollständige Darstellung der Thematik Glaser, Von Handy, Glasfaser und Internet, Vieweg Verlag sehr gute, leicht verständliche Einführung in die Thematik der Informations- und Nachrichtentechnik, hinreichend tief jedoch ohne mathematischen Ballast Beuth/Hanebuth/Kurz, Nachrichtentechnik, Vogel Verlag, Eine allgemeine Übersicht zur Thematik der Nachrichtentechnik, leicht Verständlich, nicht sehr tief. Zur Vertiefung empfohlene weiterführende Literatur Lüke, Signalübertragung, Springer Verlag Liefert eine detaillierte Einführung in die digitale und analoge Signalübertragung, mathematisch anspruchsvoll Schüssler, Digitale Signalverarbeitung, Springer-Verlag Stellt eine tiefe Darstellung der Analyse diskreter Signale und Systeme dar, mathematisch anspruchsvoll 5

Einführung: Exkurs Wahrscheinlichkeitsrechnung Abt. Informatik Prof. Dr. Ing. A. Rinkel Selbststudium mit Booklet 1 -Aufgaben in Übung besprechen! Bis wann? Bis Ende zweite Übung! 6

Abt. Informatik Prof. Dr. Ing. A. Rinkel ng ru h fü in E . 7

Einführung: Motivation Abt. Informatik Prof. Dr. Ing. A. Rinkel Troja, Agamemnon (siehe griechische Mythologie) • Leuchtfeuer 3. Punischer Krieg • Polybius tech. wissenschaftlicher Berater von Scipio (1. nachweisliche Veröffentlichung zur Codierungs- und Protokollproblematik) • Nachrichtensystem mit 5 Bit Wortlänge Bis der Kunstmaler Samuel Morse 1837 seinen ersten Apparat zur elektromagnetischen Datenübertragung vorführt keine wesentlichen Verbesserungen Anekdote Rothschild zur Bedeutung der Sicherheit in der Informationsübertragung Grundlegende Veröffentlichungen zur technischen Informationstheorie von • Hartly, 1928: „Transmission of Information“ • Shannon, 1948: „A Mathematical Theory of Communication“ 8

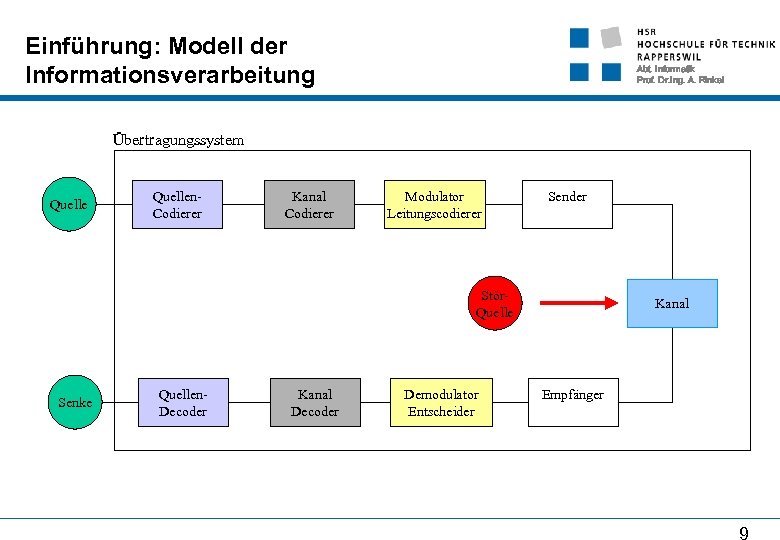

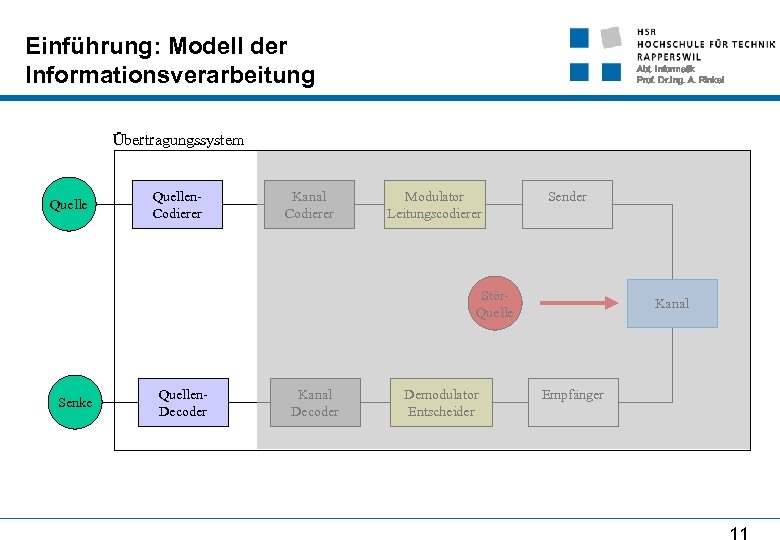

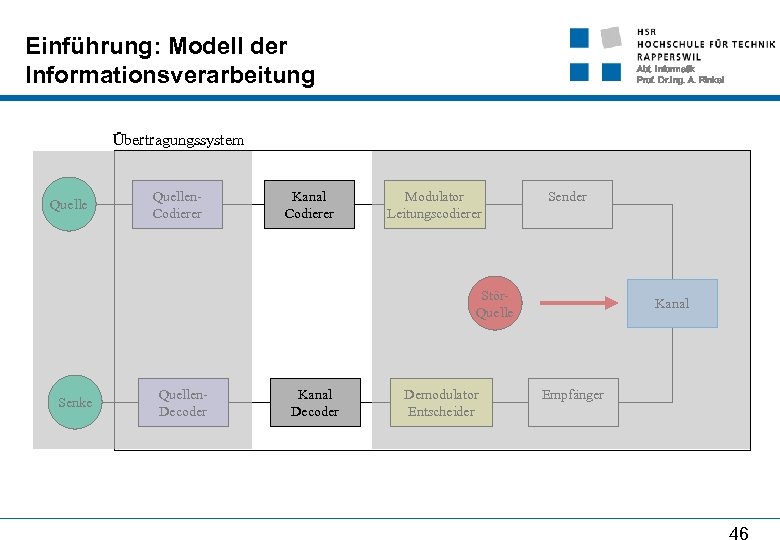

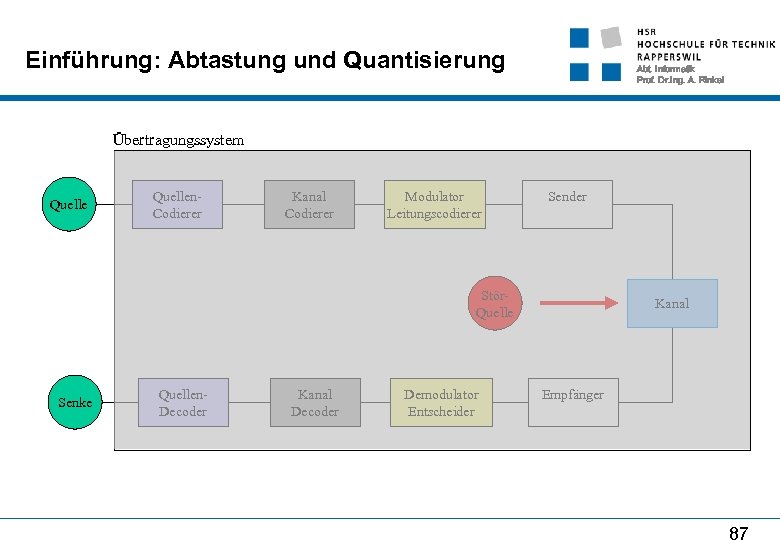

Einführung: Modell der Informationsverarbeitung Abt. Informatik Prof. Dr. Ing. A. Rinkel Übertragungssystem Quellen. Codierer Kanal Codierer Modulator Leitungscodierer Sender Stör. Quelle Senke Quellen. Decoder Kanal Decoder Demodulator Entscheider Kanal Empfänger 9

Abt. Informatik Prof. Dr. Ing. A. Rinkel or nf I rie eo th ns tio a m 10

Einführung: Modell der Informationsverarbeitung Abt. Informatik Prof. Dr. Ing. A. Rinkel Übertragungssystem Quellen. Codierer Kanal Codierer Modulator Leitungscodierer Sender Stör. Quelle Senke Quellen. Decoder Kanal Decoder Demodulator Entscheider Kanal Empfänger 11

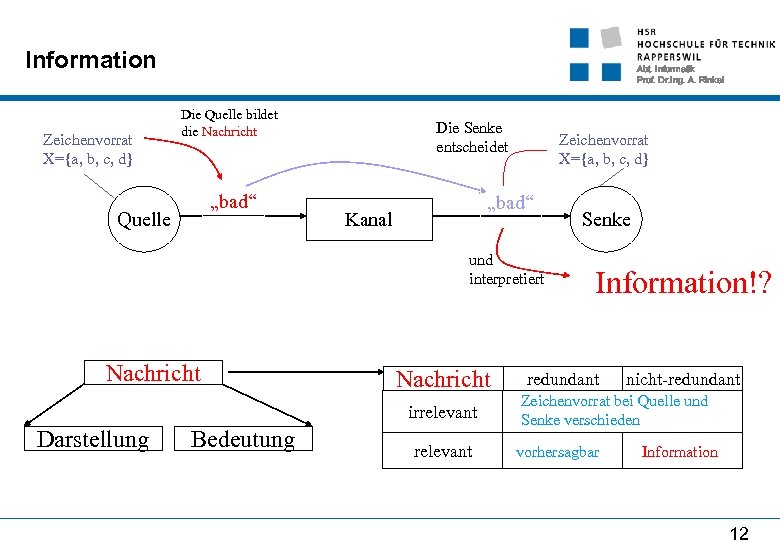

Information Zeichenvorrat X={a, b, c, d} Abt. Informatik Prof. Dr. Ing. A. Rinkel Die Quelle bildet die Nachricht „bad“ Quelle Die Senke entscheidet Zeichenvorrat X={a, b, c, d} „bad“ Kanal und interpretiert Nachricht irrelevant Darstellung Bedeutung relevant Senke Information!? redundant nicht-redundant Zeichenvorrat bei Quelle und Senke verschieden vorhersagbar Information 12

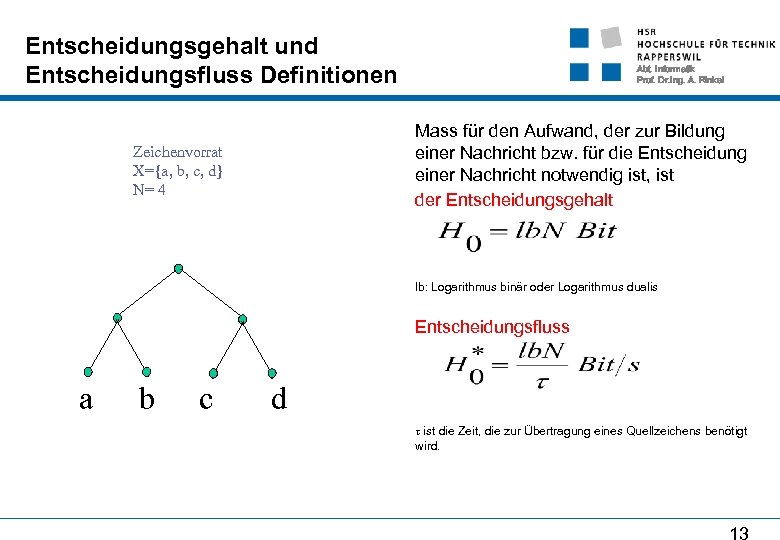

Entscheidungsgehalt und Entscheidungsfluss Definitionen Abt. Informatik Prof. Dr. Ing. A. Rinkel Mass für den Aufwand, der zur Bildung einer Nachricht bzw. für die Entscheidung einer Nachricht notwendig ist, ist der Entscheidungsgehalt Zeichenvorrat X={a, b, c, d} N= 4 lb: Logarithmus binär oder Logarithmus dualis Entscheidungsfluss a b c d t ist die Zeit, die zur Übertragung eines Quellzeichens benötigt wird. 13

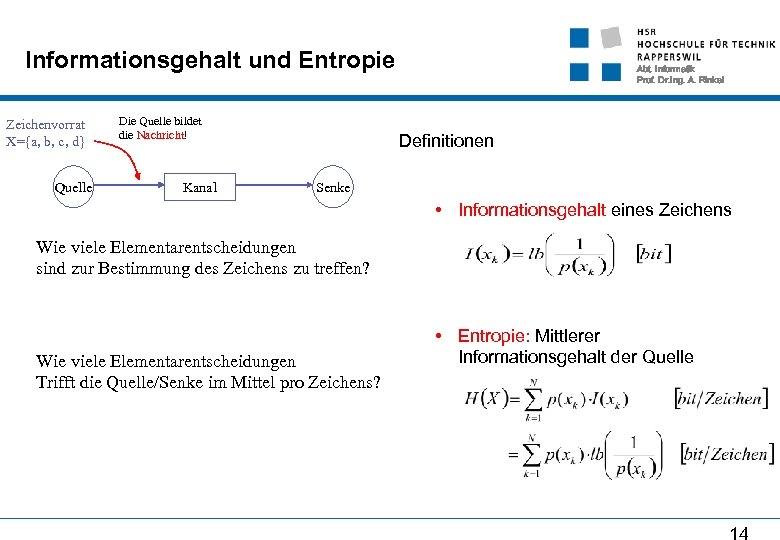

Informationsgehalt und Entropie Zeichenvorrat X={a, b, c, d} Quelle Die Quelle bildet die Nachricht! Kanal Abt. Informatik Prof. Dr. Ing. A. Rinkel Definitionen Senke • Informationsgehalt eines Zeichens Wie viele Elementarentscheidungen sind zur Bestimmung des Zeichens zu treffen? Wie viele Elementarentscheidungen Trifft die Quelle/Senke im Mittel pro Zeichens? • Entropie: Mittlerer Informationsgehalt der Quelle 14

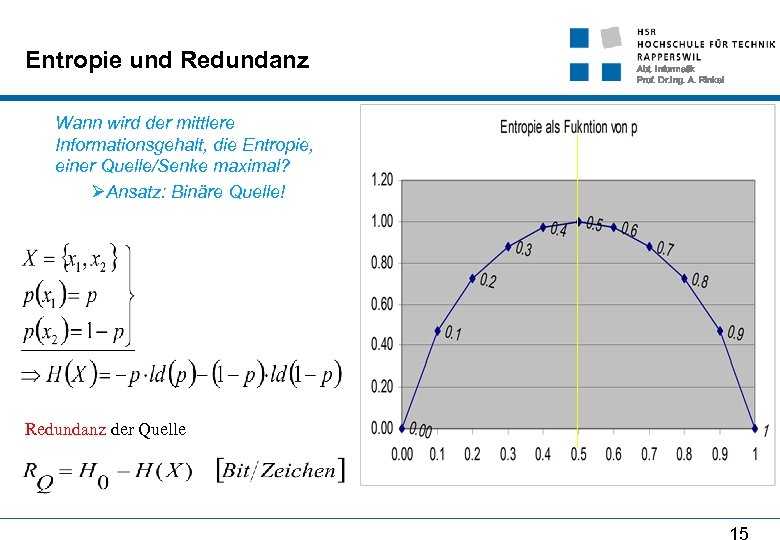

Entropie und Redundanz Abt. Informatik Prof. Dr. Ing. A. Rinkel Wann wird der mittlere Informationsgehalt, die Entropie, einer Quelle/Senke maximal? ØAnsatz: Binäre Quelle! Redundanz der Quelle 15

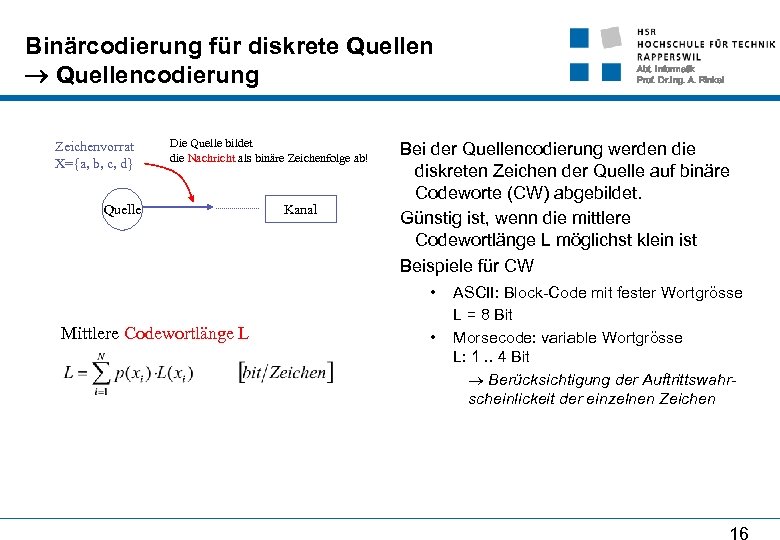

Binärcodierung für diskrete Quellencodierung Zeichenvorrat X={a, b, c, d} Die Quelle bildet die Nachricht als binäre Zeichenfolge ab! Quelle Kanal Bei der Quellencodierung werden die diskreten Zeichen der Quelle auf binäre Codeworte (CW) abgebildet. Günstig ist, wenn die mittlere Codewortlänge L möglichst klein ist Beispiele für CW • Mittlere Codewortlänge L Abt. Informatik Prof. Dr. Ing. A. Rinkel • ASCII: Block-Code mit fester Wortgrösse L = 8 Bit Morsecode: variable Wortgrösse L: 1. . 4 Bit Berücksichtigung der Auftrittswahrscheinlickeit der einzelnen Zeichen 16

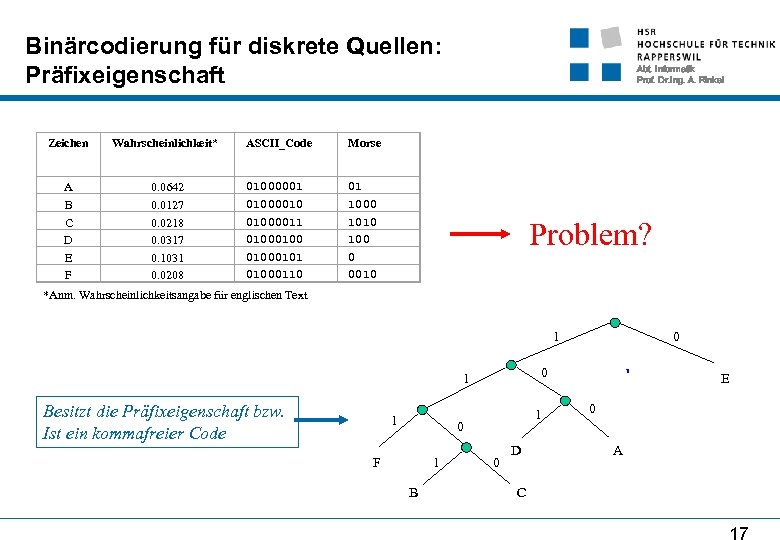

Binärcodierung für diskrete Quellen: Präfixeigenschaft Zeichen Wahrscheinlichkeit* A B C D E F 0. 0642 0. 0127 0. 0218 0. 0317 0. 1031 0. 0208 ASCII_Code Morse 01000001 01000010 01000011 01000101 01000110 Abt. Informatik Prof. Dr. Ing. A. Rinkel 01 1000 1010 100 0 0010 Problem? *Anm. Wahrscheinlichkeitsangabe für englischen Text 1 0 1 Besitzt die Präfixeigenschaft bzw. Ist ein kommafreier Code 1 1 0 F 1 B 0 0 D E 0 A C 17

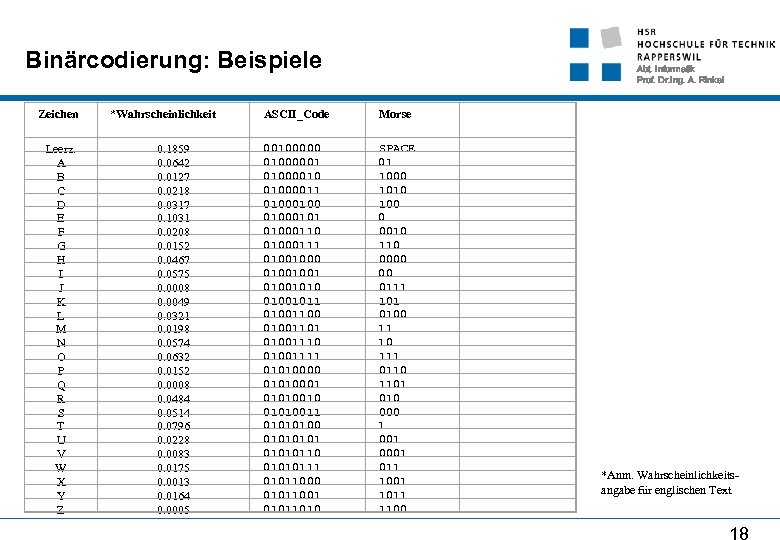

Binärcodierung: Beispiele Zeichen Leerz. A B C D E F G H I J K L M N O P Q R S T U V W X Y Z *Wahrscheinlichkeit 0. 1859 0. 0642 0. 0127 0. 0218 0. 0317 0. 1031 0. 0208 0. 0152 0. 0467 0. 0575 0. 0008 0. 0049 0. 0321 0. 0198 0. 0574 0. 0632 0. 0152 0. 0008 0. 0484 0. 0514 0. 0796 0. 0228 0. 0083 0. 0175 0. 0013 0. 0164 0. 0005 Abt. Informatik Prof. Dr. Ing. A. Rinkel ASCII_Code Morse 001000001 01000010 01000011 01000101 01000110 01000111 01001000 01001001010 01001011 01001100 01001101 01001110 01001111 01010000 01010001 01010010 01010011 01010100 01010110 01010111 01011000 01011001 01011010 SPACE 01 1000 1010 100 0 0010 110 0000 00 0111 101 0100 11 10 111 0110 1101 010 000 1 0001 011 1001 1011 1100 *Anm. Wahrscheinlichkeitsangabe für englischen Text 18

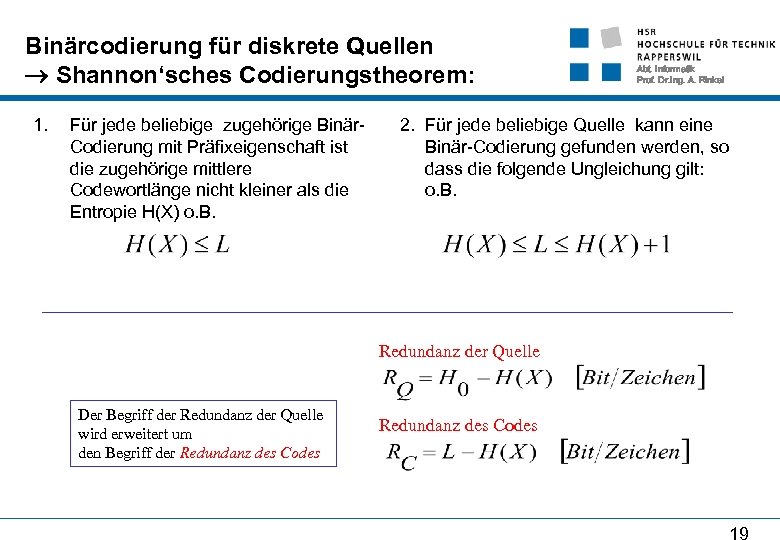

Binärcodierung für diskrete Quellen Shannon‘sches Codierungstheorem: 1. Für jede beliebige zugehörige Binär. Codierung mit Präfixeigenschaft ist die zugehörige mittlere Codewortlänge nicht kleiner als die Entropie H(X) o. B. Abt. Informatik Prof. Dr. Ing. A. Rinkel 2. Für jede beliebige Quelle kann eine Binär-Codierung gefunden werden, so dass die folgende Ungleichung gilt: o. B. Redundanz der Quelle Der Begriff der Redundanz der Quelle wird erweitert um den Begriff der Redundanz des Codes 19

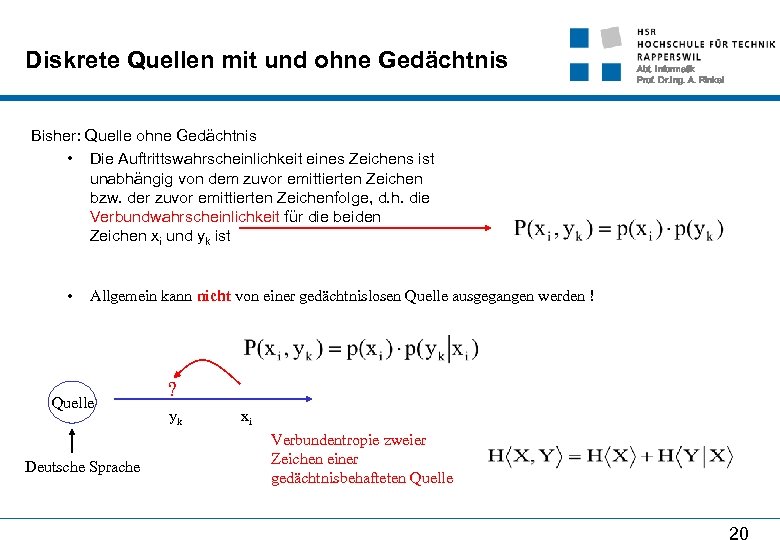

Diskrete Quellen mit und ohne Gedächtnis Abt. Informatik Prof. Dr. Ing. A. Rinkel Bisher: Quelle ohne Gedächtnis • Die Auftrittswahrscheinlichkeit eines Zeichens ist unabhängig von dem zuvor emittierten Zeichen bzw. der zuvor emittierten Zeichenfolge, d. h. die Verbundwahrscheinlichkeit für die beiden Zeichen xi und yk ist • Allgemein kann nicht von einer gedächtnislosen Quelle ausgegangen werden ! Q Quelle Deutsche Sprache ? yk xi Verbundentropie zweier Zeichen einer gedächtnisbehafteten Quelle 20

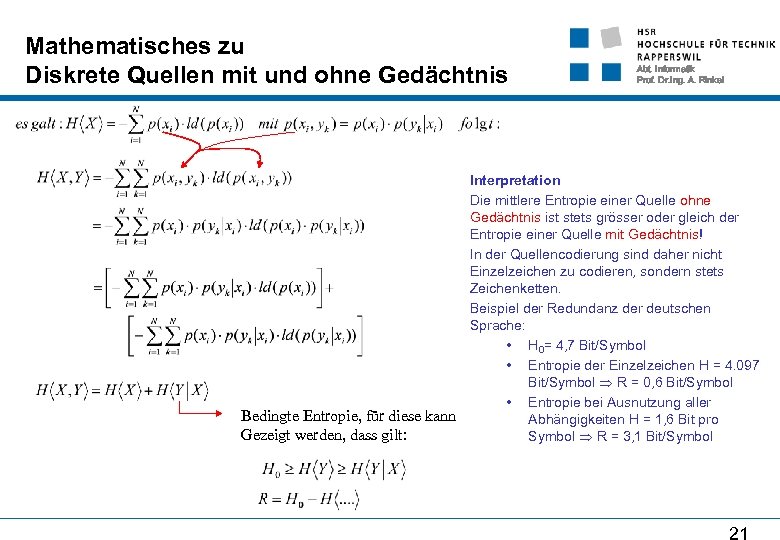

Mathematisches zu Diskrete Quellen mit und ohne Gedächtnis Abt. Informatik Prof. Dr. Ing. A. Rinkel Interpretation Die mittlere Entropie einer Quelle ohne Gedächtnis ist stets grösser oder gleich der Entropie einer Quelle mit Gedächtnis! In der Quellencodierung sind daher nicht Einzelzeichen zu codieren, sondern stets Zeichenketten. Beispiel der Redundanz der deutschen Sprache: • H 0= 4, 7 Bit/Symbol • Entropie der Einzelzeichen H = 4. 097 Bit/Symbol R = 0, 6 Bit/Symbol • Entropie bei Ausnutzung aller Bedingte Entropie, für diese kann Abhängigkeiten H = 1, 6 Bit pro Gezeigt werden, dass gilt: Symbol R = 3, 1 Bit/Symbol 21

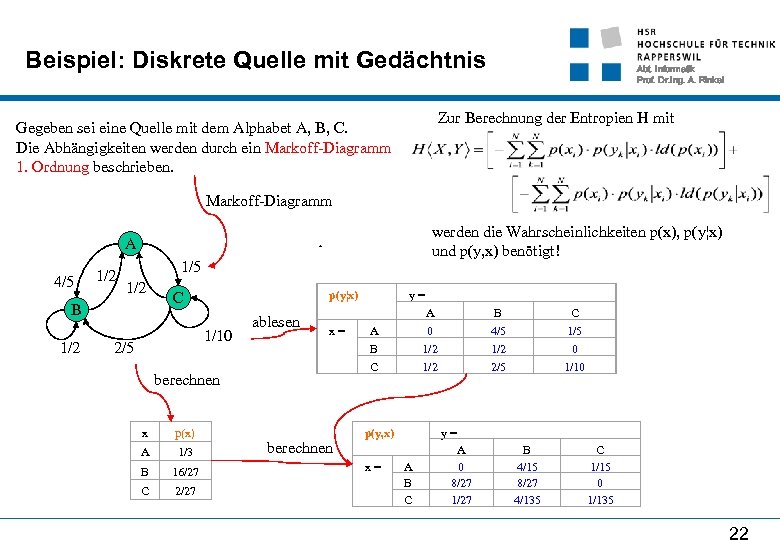

Beispiel: Diskrete Quelle mit Gedächtnis Abt. Informatik Prof. Dr. Ing. A. Rinkel Zur Berechnung der Entropien H mit Gegeben sei eine Quelle mit dem Alphabet A, B, C. Die Abhängigkeiten werden durch ein Markoff-Diagramm 1. Ordnung beschrieben. Markoff-Diagramm werden die Wahrscheinlichkeiten p(x), p(y¦x) und p(y, x) benötigt! A 4/5 1/2 1/5 1/2 B 1/2 p(y¦x) C 1/10 2/5 ablesen x = berechnen x p(x) A 1/3 B 16/27 C 2/27 berechnen y = A 0 1/2 A B C p(y, x) x = B 4/5 1/2 2/5 C 1/5 0 1/10 y = A B C A 0 8/27 1/27 B 4/15 8/27 4/135 C 1/15 0 1/135 22

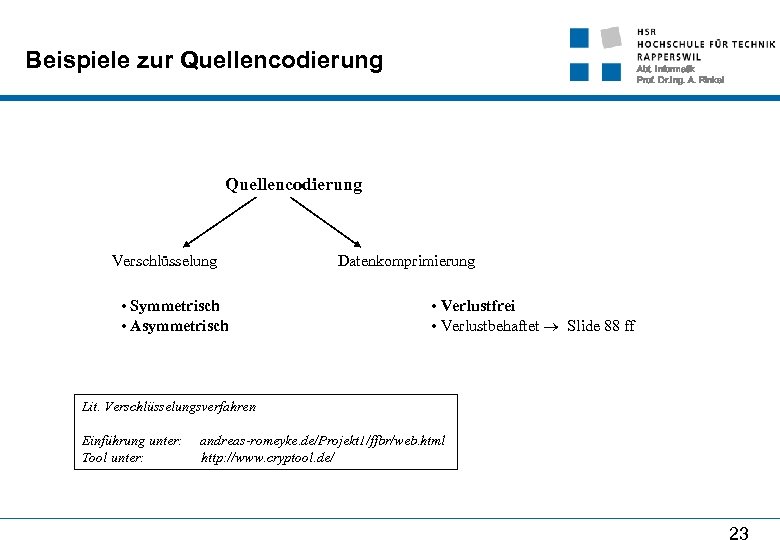

Beispiele zur Quellencodierung Abt. Informatik Prof. Dr. Ing. A. Rinkel Quellencodierung Verschlüsselung • Symmetrisch • Asymmetrisch Datenkomprimierung • Verlustfrei • Verlustbehaftet Slide 88 ff Lit. Verschlüsselungsverfahren Einführung unter: Tool unter: andreas-romeyke. de/Projekt 1/ffbr/web. html http: //www. cryptool. de/ 23

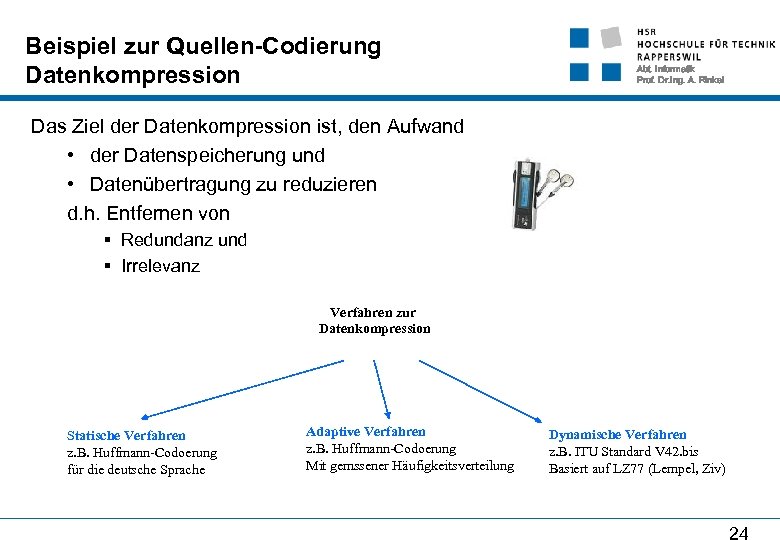

Beispiel zur Quellen-Codierung Datenkompression Abt. Informatik Prof. Dr. Ing. A. Rinkel Das Ziel der Datenkompression ist, den Aufwand • der Datenspeicherung und • Datenübertragung zu reduzieren d. h. Entfernen von § Redundanz und § Irrelevanz Verfahren zur Datenkompression Statische Verfahren z. B. Huffmann-Codoerung für die deutsche Sprache Adaptive Verfahren z. B. Huffmann-Codoerung Mit gemssener Häufigkeitsverteilung Dynamische Verfahren z. B. ITU Standard V 42. bis Basiert auf LZ 77 (Lempel, Ziv) 24

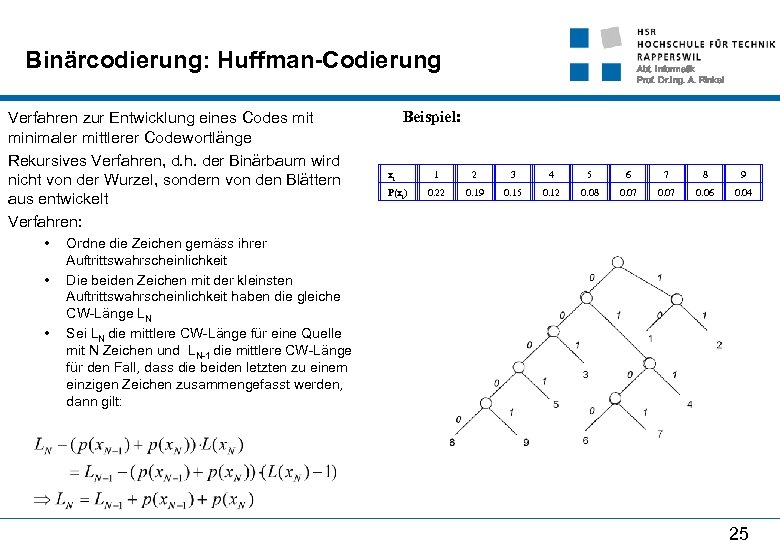

Binärcodierung: Huffman-Codierung Verfahren zur Entwicklung eines Codes mit minimaler mittlerer Codewortlänge Rekursives Verfahren, d. h. der Binärbaum wird nicht von der Wurzel, sondern von den Blättern aus entwickelt Verfahren: • • • Abt. Informatik Prof. Dr. Ing. A. Rinkel Beispiel: xi P(xi) 1 2 3 4 5 6 7 8 9 0. 22 0. 19 0. 15 0. 12 0. 08 0. 07 0. 06 0. 04 Ordne die Zeichen gemäss ihrer Auftrittswahrscheinlichkeit Die beiden Zeichen mit der kleinsten Auftrittswahrscheinlichkeit haben die gleiche CW-Länge LN Sei LN die mittlere CW-Länge für eine Quelle mit N Zeichen und LN-1 die mittlere CW-Länge für den Fall, dass die beiden letzten zu einem einzigen Zeichen zusammengefasst werden, dann gilt: 25

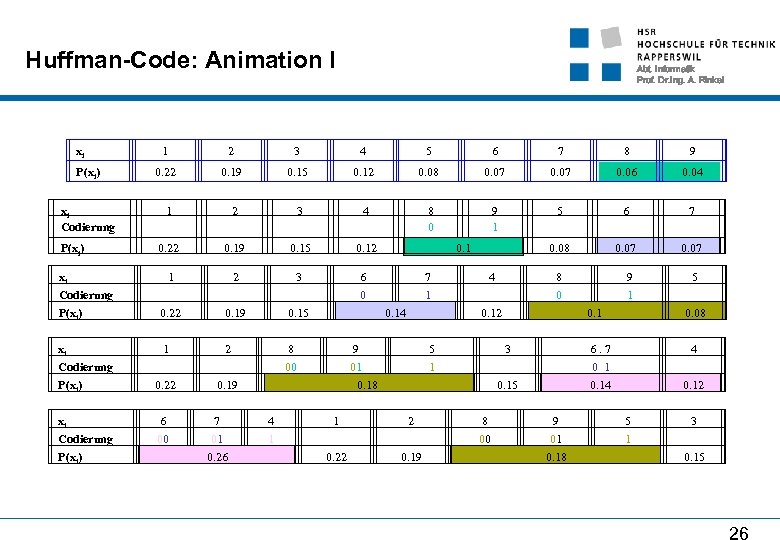

Huffman-Code: Animation I xi Abt. Informatik Prof. Dr. Ing. A. Rinkel 1 2 3 4 5 6 7 8 9 P(xi) 0. 22 0. 19 0. 15 0. 12 0. 08 0. 07 0. 06 0. 04 xi Codierung 1 2 3 4 8 0 9 1 5 6 7 P(xi) 0. 22 0. 19 0. 15 0. 12 0. 08 0. 07 xi Codierung P(xi) 1 0. 22 2 0. 19 3 0. 15 6 0 xi Codierung P(xi) 1 0. 22 xi Codierung P(xi) 6 00 2 0. 19 7 01 0. 26 7 1 0. 14 8 00 4 1 0. 1 9 01 0. 18 1 0. 22 4 0. 12 5 1 2 0. 19 8 0 0. 1 8 00 9 01 0. 18 5 0. 08 6. 7 0 1 0. 14 3 0. 15 9 1 4 0. 12 5 1 3 0. 15 26

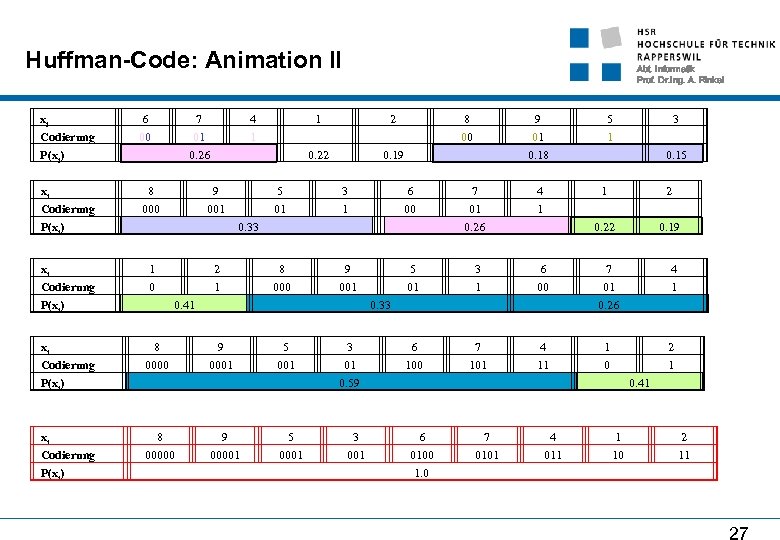

Huffman-Code: Animation II xi Codierung P(xi) 6 00 7 01 0. 26 xi Codierung P(xi) 8 000 xi Codierung P(xi) 1 0 xi Codierung P(xi) 8 00000 4 1 9 001 Abt. Informatik Prof. Dr. Ing. A. Rinkel 1 0. 22 2 0. 19 8 00 9 01 0. 18 3 0. 15 5 01 3 1 6 00 7 01 0. 26 8 000 9 001 5 01 3 1 6 00 7 01 0. 26 4 1 6 100 7 101 4 11 1 0 2 1 0. 33 2 1 0. 41 4 1 5 1 1 0. 22 0. 33 9 0001 9 00001 5 0001 3 01 0. 59 3 001 2 0. 19 0. 41 6 0100 1. 0 7 0101 4 011 1 10 2 11 27

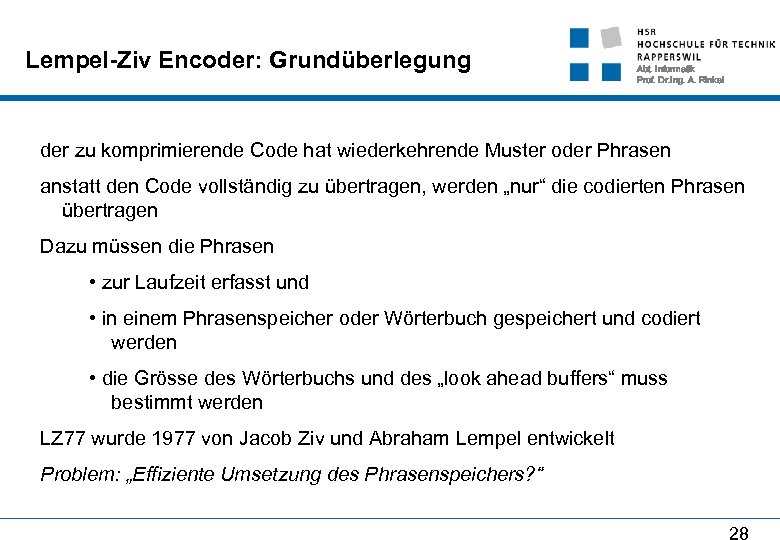

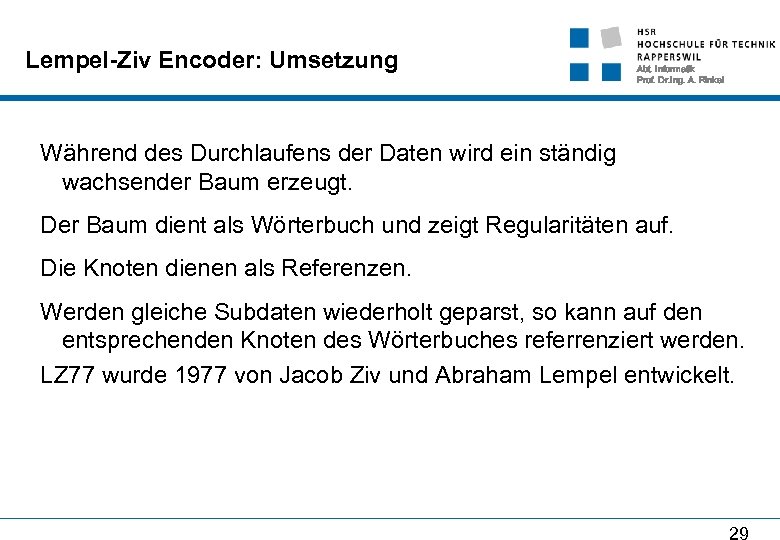

Lempel-Ziv Encoder: Grundüberlegung Abt. Informatik Prof. Dr. Ing. A. Rinkel der zu komprimierende Code hat wiederkehrende Muster oder Phrasen anstatt den Code vollständig zu übertragen, werden „nur“ die codierten Phrasen übertragen Dazu müssen die Phrasen • zur Laufzeit erfasst und • in einem Phrasenspeicher oder Wörterbuch gespeichert und codiert werden • die Grösse des Wörterbuchs und des „look ahead buffers“ muss bestimmt werden LZ 77 wurde 1977 von Jacob Ziv und Abraham Lempel entwickelt Problem: „Effiziente Umsetzung des Phrasenspeichers? “ 28

Lempel-Ziv Encoder: Umsetzung Abt. Informatik Prof. Dr. Ing. A. Rinkel Während des Durchlaufens der Daten wird ein ständig wachsender Baum erzeugt. Der Baum dient als Wörterbuch und zeigt Regularitäten auf. Die Knoten dienen als Referenzen. Werden gleiche Subdaten wiederholt geparst, so kann auf den entsprechenden Knoten des Wörterbuches referrenziert werden. LZ 77 wurde 1977 von Jacob Ziv und Abraham Lempel entwickelt. 29

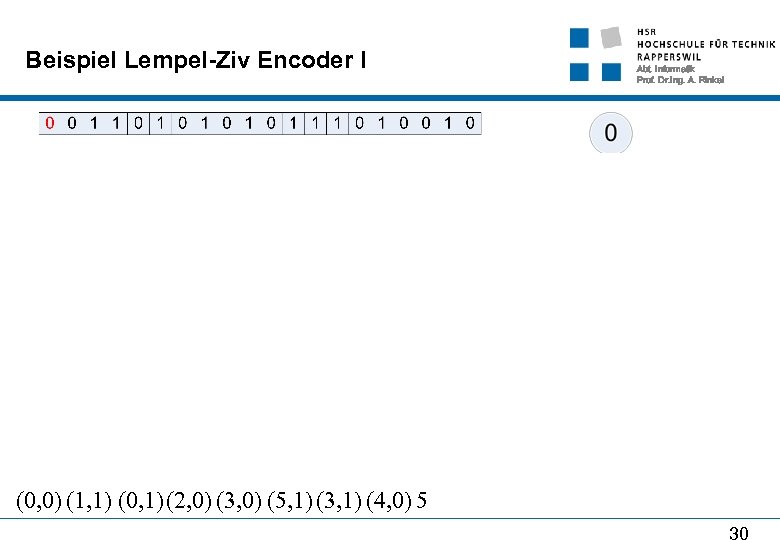

Beispiel Lempel-Ziv Encoder I Abt. Informatik Prof. Dr. Ing. A. Rinkel (0, 0) (1, 1) (0, 1)(2, 0) (3, 0) (5, 1) (3, 1) (4, 0) 5 30

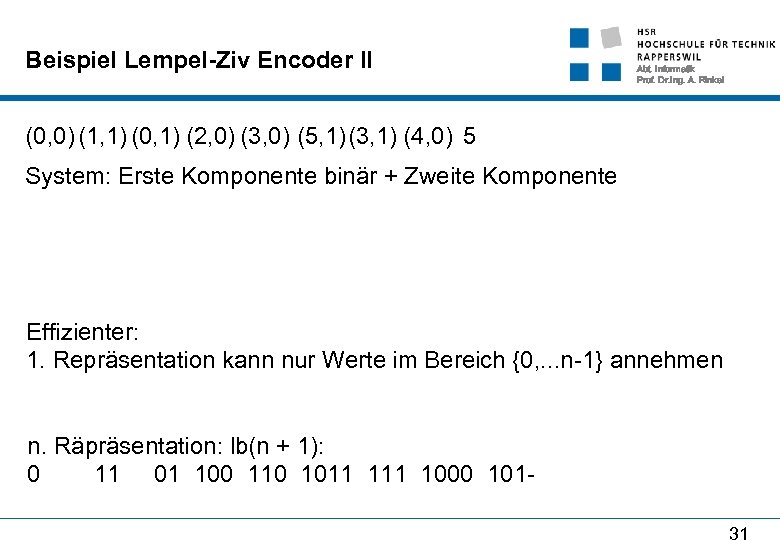

Beispiel Lempel-Ziv Encoder II Abt. Informatik Prof. Dr. Ing. A. Rinkel (0, 0) (1, 1) (0, 1) (2, 0) (3, 0) (5, 1) (3, 1) (4, 0) 5 System: Erste Komponente binär + Zweite Komponente Effizienter: 1. Repräsentation kann nur Werte im Bereich {0, . . . n-1} annehmen n. Räpräsentation: lb(n + 1): 0 11 01 100 110 1011 1000 10131

Komprimierung? Abt. Informatik Prof. Dr. Ing. A. Rinkel Komprimierter Text: 011001010011011110000101 Original: 0011010111010010 Voraussetzung: Text muss Regelmässigkeit beinhalten. Am effizientesten, wenn sich nur ein langer Pfad entwickelt, z. B. {00000} 32

Probleme Abt. Informatik Prof. Dr. Ing. A. Rinkel Wörterbuch-Management Effizient Suchen und Einfügen Grösse des Baumes In der Praxis wird der Baum nur bis zu einer gewissen Maximalgrösse angewachsen lassen und danach werden keine neue Knoten mehr hinzugefügt. 33

Beispiel zur Quellen-Codierung Kryptologie: Symmetrische Verfahren Abt. Informatik Prof. Dr. Ing. A. Rinkel Substitutionsverfahren • Die Buchstaben des Klartextes werden durch andere Symbole ersetzt Folgefolie Transpositionsverfahren • Die Zeichenfolge des Klartextes werden nicht ersetzt sondern verwürfelt Folgefolie Playfair-Chiffre • Geht auf Lord Playfair zurück. In diesem Verfahren werden Gruppen von Zeichen codiert siehe Literatur Vigenàir-Chiffre • Geht auf den französischen Diplomaten Blaise de Vigenère zurück. Er definierte ein polyalphabetisches Substitutionsverfahren Folgefolie Rotormaschine • Erste elektromechanische Chiffrier-Maschinen siehe Literatur. Enigma • Modifizierte Rotormaschine mit drei Rotoren und variabler interner Verkabelung, wurde im 2. Weltkrieg von der dt. Wehrmacht verwendet; siehe Literatur. DES RSA 34

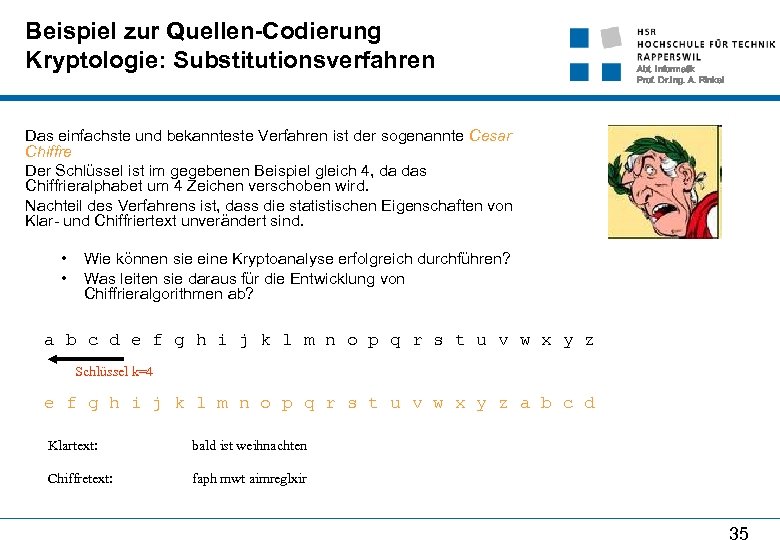

Beispiel zur Quellen-Codierung Kryptologie: Substitutionsverfahren Abt. Informatik Prof. Dr. Ing. A. Rinkel Das einfachste und bekannteste Verfahren ist der sogenannte Cesar Chiffre Der Schlüssel ist im gegebenen Beispiel gleich 4, da das Chiffrieralphabet um 4 Zeichen verschoben wird. Nachteil des Verfahrens ist, dass die statistischen Eigenschaften von Klar- und Chiffriertext unverändert sind. • • Wie können sie eine Kryptoanalyse erfolgreich durchführen? Was leiten sie daraus für die Entwicklung von Chiffrieralgorithmen ab? a b c d e f g h i j k l m n o p q r s t u v w x y z Schlüssel k=4 e f g h i j k l m n o p q r s t u v w x y z a b c d Klartext: bald ist weihnachten Chiffretext: faph mwt aimreglxir 35

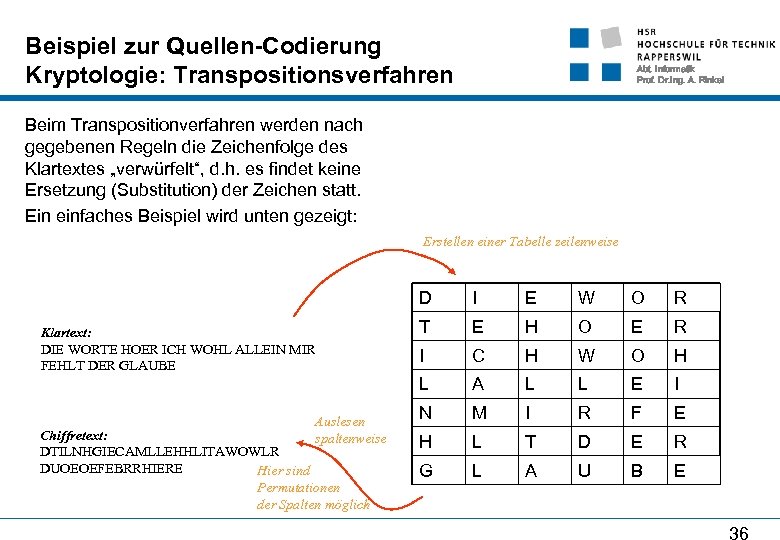

Beispiel zur Quellen-Codierung Kryptologie: Transpositionsverfahren Abt. Informatik Prof. Dr. Ing. A. Rinkel Beim Transpositionverfahren werden nach gegebenen Regeln die Zeichenfolge des Klartextes „verwürfelt“, d. h. es findet keine Ersetzung (Substitution) der Zeichen statt. Ein einfaches Beispiel wird unten gezeigt: Erstellen einer Tabelle zeilenweise D Auslesen spaltenweise Chiffretext: DTILNHGIECAMLLEHHLITAWOWLR DUOEOEFEBRRHIERE Hier sind Permutationen der Spalten möglich E W O R T E H O E R I C H W O H L Klartext: DIE WORTE HOER ICH WOHL ALLEIN MIR FEHLT DER GLAUBE I A L L E I N M I R F E H L T D E R G L A U B E 36

Beispiel zur Quellen-Codierung Kryptologie: RSA Abt. Informatik Prof. Dr. Ing. A. Rinkel IDEE: Gibt es ein asymmetrisches Kryptoverfahern? • Das heisst , lässt sich ein Verfahren finden, dass es erlaubt § einen Schlüssel zur Codierung und § einen zweiten Schlüssel zur De-Codierung benutzen. • Als Rahmenbedingung ist es weiterhin erforderlich, dass die Kenntnis eines Schlüssels nichts über die Identität des anderen „Partner“-Schlüssel verrät. Ursprünglich sind die drei Mathematiker Rivest, Shamir und Adleman (RSA) angetreten, um zu zeigen, dass das nicht möglich ist. Aber Sie haben gezeigt, ein asymmetrische Kryptoverfahren ist möglich heute auch bekannt als RSA-Verfahren 37

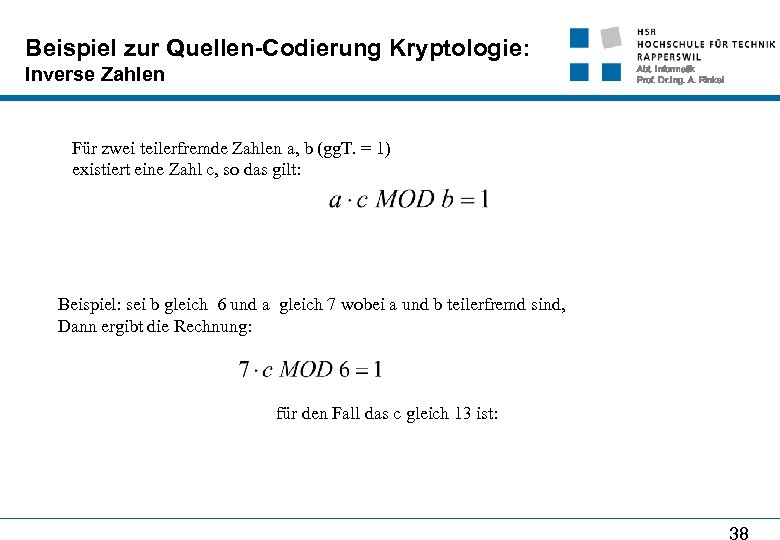

Beispiel zur Quellen-Codierung Kryptologie: Abt. Informatik Prof. Dr. Ing. A. Rinkel Inverse Zahlen Für zwei teilerfremde Zahlen a, b (gg. T. = 1) existiert eine Zahl c, so das gilt: Beispiel: sei b gleich 6 und a gleich 7 wobei a und b teilerfremd sind, Dann ergibt die Rechnung: für den Fall das c gleich 13 ist: 38

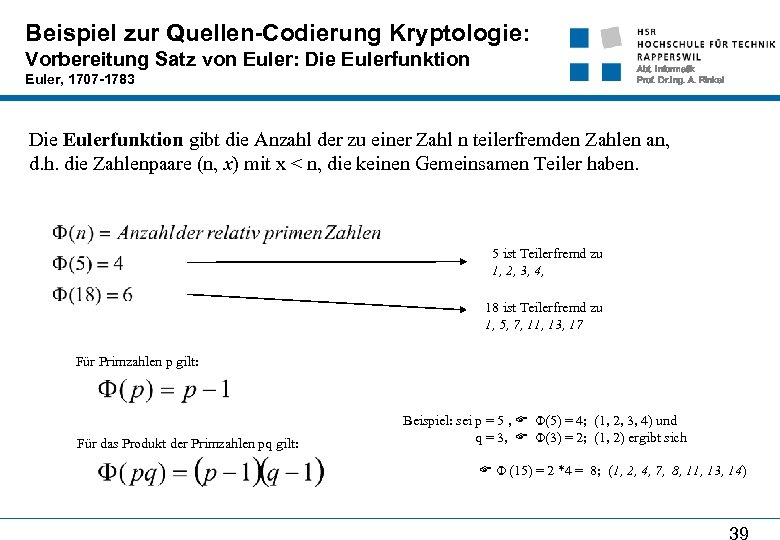

Beispiel zur Quellen-Codierung Kryptologie: Vorbereitung Satz von Euler: Die Eulerfunktion Abt. Informatik Prof. Dr. Ing. A. Rinkel Euler, 1707 -1783 Die Eulerfunktion gibt die Anzahl der zu einer Zahl n teilerfremden Zahlen an, d. h. die Zahlenpaare (n, x) mit x < n, die keinen Gemeinsamen Teiler haben. 5 ist Teilerfremd zu 1, 2, 3, 4, 18 ist Teilerfremd zu 1, 5, 7, 11, 13, 17 Für Primzahlen p gilt: Für das Produkt der Primzahlen pq gilt: Beispiel: sei p = 5 , Φ(5) = 4; (1, 2, 3, 4) und q = 3, Φ(3) = 2; (1, 2) ergibt sich Φ (15) = 2 *4 = 8; (1, 2, 4, 7, 8, 11, 13, 14) 39

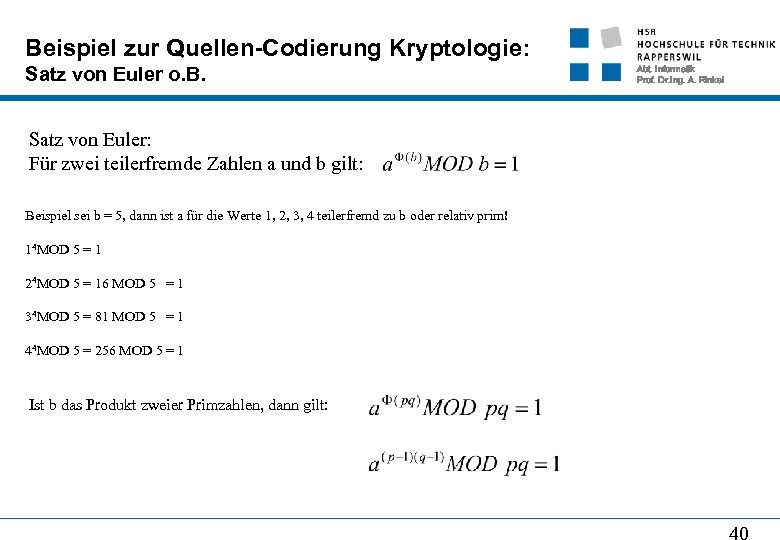

Beispiel zur Quellen-Codierung Kryptologie: Satz von Euler o. B. Abt. Informatik Prof. Dr. Ing. A. Rinkel Satz von Euler: Für zwei teilerfremde Zahlen a und b gilt: Beispiel sei b = 5, dann ist a für die Werte 1, 2, 3, 4 teilerfremd zu b oder relativ prim! 14 MOD 5 = 1 24 MOD 5 = 16 MOD 5 = 1 34 MOD 5 = 81 MOD 5 = 1 44 MOD 5 = 256 MOD 5 = 1 Ist b das Produkt zweier Primzahlen, dann gilt: 40

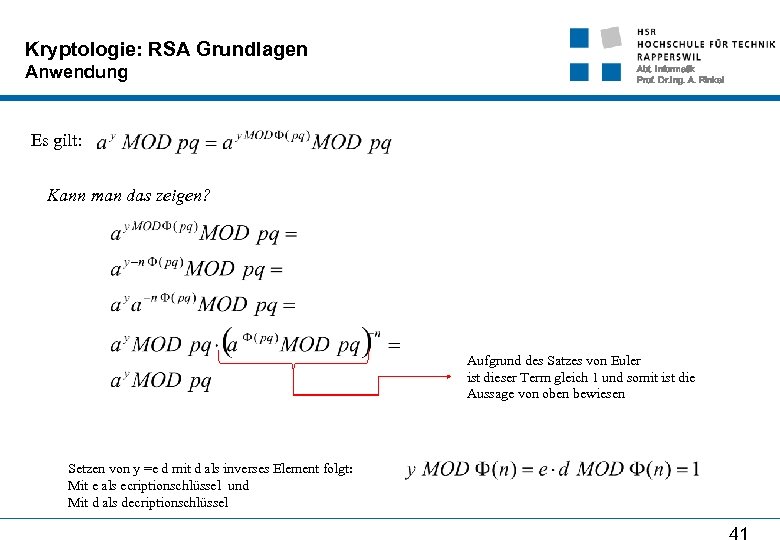

Kryptologie: RSA Grundlagen Anwendung Abt. Informatik Prof. Dr. Ing. A. Rinkel Es gilt: Kann man das zeigen? Aufgrund des Satzes von Euler ist dieser Term gleich 1 und somit ist die Aussage von oben bewiesen Setzen von y =e d mit d als inverses Element folgt: Mit e als ecriptionschlüssel und Mit d als decriptionschlüssel 41

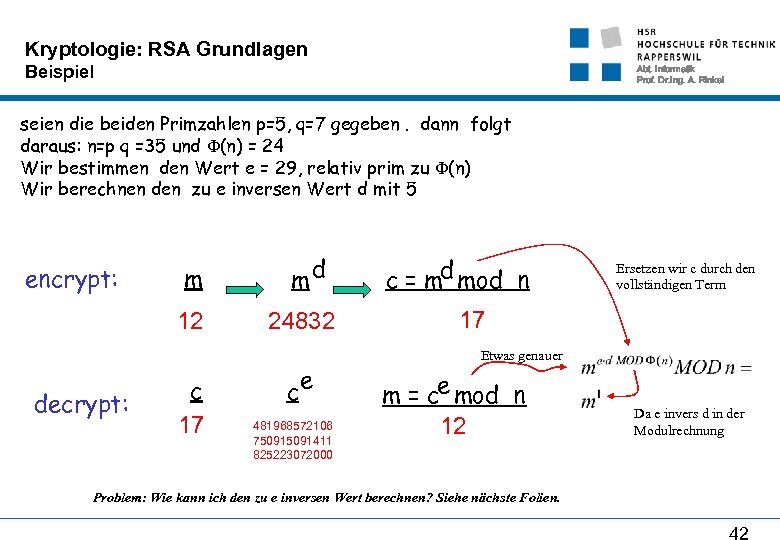

Kryptologie: RSA Grundlagen Beispiel Abt. Informatik Prof. Dr. Ing. A. Rinkel seien die beiden Primzahlen p=5, q=7 gegeben. dann folgt daraus: n=p q =35 und Φ(n) = 24 Wir bestimmen den Wert e = 29, relativ prim zu Φ(n) Wir berechnen den zu e inversen Wert d mit 5 decrypt: m md 12 encrypt: 24832 c 17 c e 481968572106 75091411 825223072000 c = md mod n Ersetzen wir c durch den vollständigen Term 17 Etwas genauer m = ce mod n 12 Da e invers d in der Modulrechnung Problem: Wie kann ich den zu e inversen Wert berechnen? Siehe nächste Folien. 42

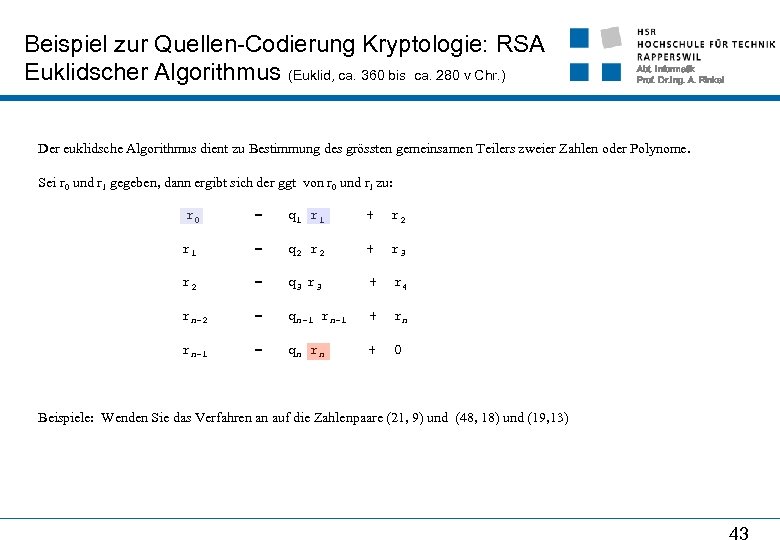

Beispiel zur Quellen-Codierung Kryptologie: RSA Euklidscher Algorithmus (Euklid, ca. 360 bis ca. 280 v Chr. ) Abt. Informatik Prof. Dr. Ing. A. Rinkel Der euklidsche Algorithmus dient zu Bestimmung des grössten gemeinsamen Teilers zweier Zahlen oder Polynome. Sei r 0 und r 1 gegeben, dann ergibt sich der ggt von r 0 und r 1 zu: r 0 = q 1 r 1 + r 2 r 1 = q 2 r 2 + r 3 r 2 = q 3 r 3 + r 4 rn-2 = qn-1 rn-1 + rn rn-1 = q n rn + 0 Beispiele: Wenden Sie das Verfahren an auf die Zahlenpaare (21, 9) und (48, 18) und (19, 13) 43

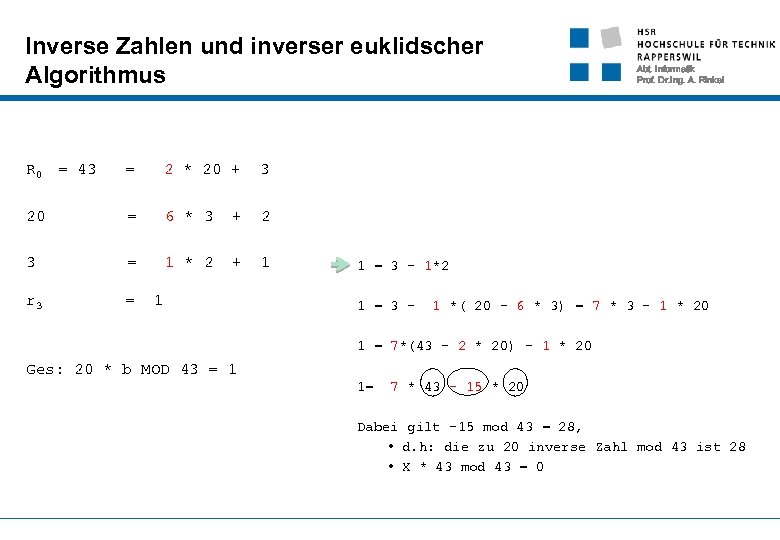

Inverse Zahlen und inverser euklidscher Algorithmus R 0 = 43 = 2 * 20 + 3 20 = 6 * 3 + 2 3 = 1 * 2 + 1 r 3 = Abt. Informatik Prof. Dr. Ing. A. Rinkel 1 1 = 3 - 1*2 1 = 3 - 1 *( 20 – 6 * 3) = 7 * 3 – 1 * 20 1 = 7*(43 – 2 * 20) – 1 * 20 Ges: 20 * b MOD 43 = 1 1= 7 * 43 – 15 * 20 Dabei gilt -15 mod 43 = 28, • d. h: die zu 20 inverse Zahl mod 43 ist 28 • X * 43 mod 43 = 0

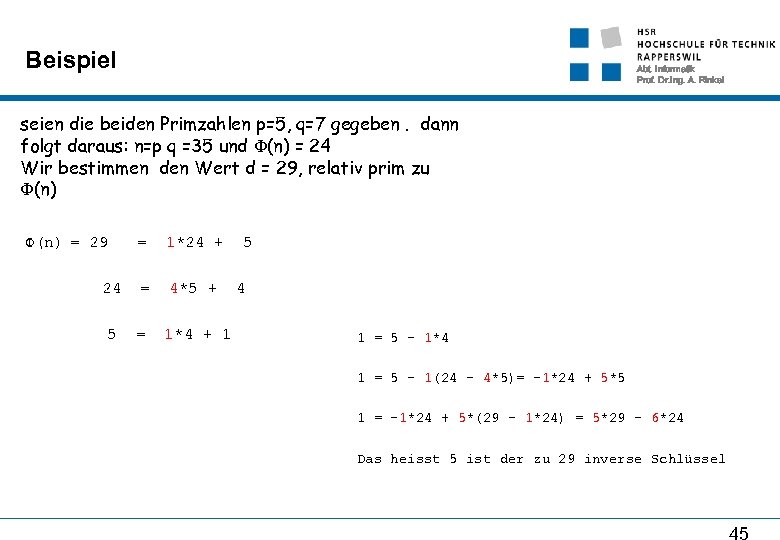

Beispiel Abt. Informatik Prof. Dr. Ing. A. Rinkel seien die beiden Primzahlen p=5, q=7 gegeben. dann folgt daraus: n=p q =35 und Φ(n) = 24 Wir bestimmen den Wert d = 29, relativ prim zu Φ(n) = 29 = 1*24 + 24 = 4*5 + 5 = 1*4 + 1 5 4 1 = 5 - 1*4 1 = 5 - 1(24 - 4*5)= -1*24 + 5*5 1 = -1*24 + 5*(29 - 1*24) = 5*29 - 6*24 Das heisst 5 ist der zu 29 inverse Schlüssel 45

Einführung: Modell der Informationsverarbeitung Abt. Informatik Prof. Dr. Ing. A. Rinkel Übertragungssystem Quellen. Codierer Kanal Codierer Modulator Leitungscodierer Sender Stör. Quelle Senke Quellen. Decoder Kanal Decoder Demodulator Entscheider Kanal Empfänger 46

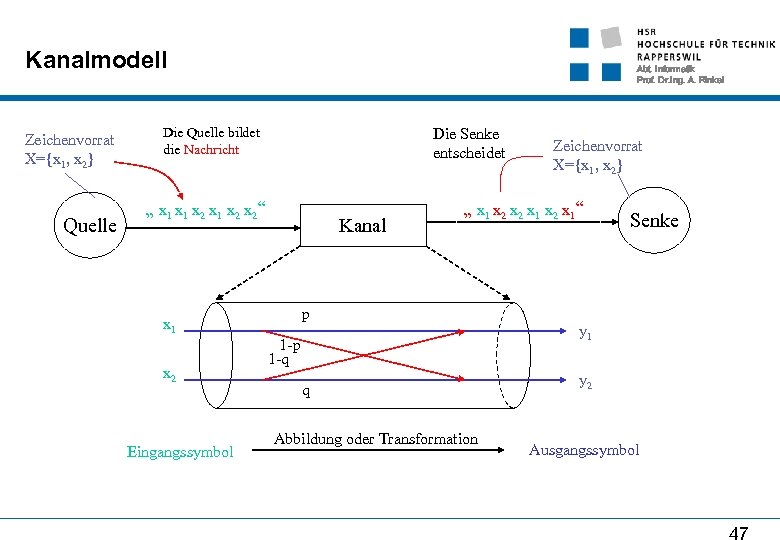

Kanalmodell Zeichenvorrat X={x 1, x 2} Quelle Abt. Informatik Prof. Dr. Ing. A. Rinkel Die Quelle bildet die Nachricht Die Senke entscheidet „ x 1 x 2“ Kanal x 2 Eingangssymbol „ x 1 x 2 x 1“ p x 1 Zeichenvorrat X={x 1, x 2} 1 -p 1 -q q Abbildung oder Transformation Senke y 1 y 2 Ausgangssymbol 47

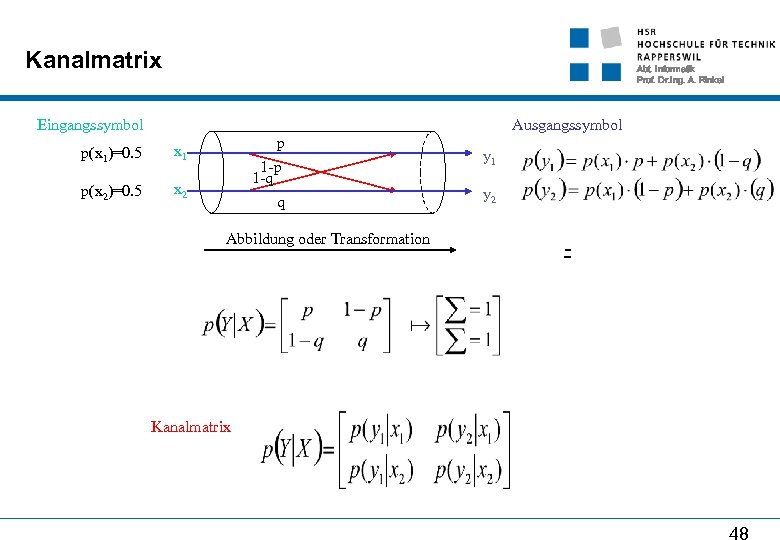

Kanalmatrix Abt. Informatik Prof. Dr. Ing. A. Rinkel Eingangssymbol Ausgangssymbol p(x 1)=0. 5 p(x 2)=0. 5 p x 1 x 2 1 -p 1 -q q y 1 y 2 Abbildung oder Transformation Kanalmatrix 48

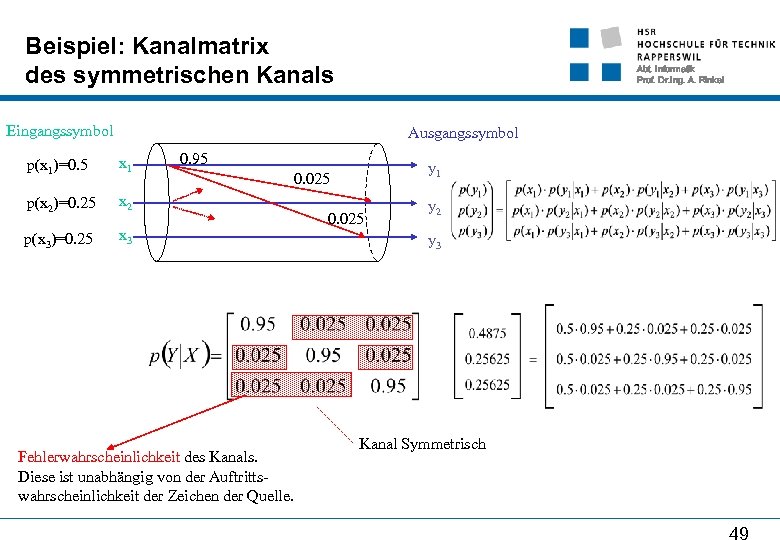

Beispiel: Kanalmatrix des symmetrischen Kanals Abt. Informatik Prof. Dr. Ing. A. Rinkel Eingangssymbol Ausgangssymbol p(x 1)=0. 5 x 1 p(x 2)=0. 25 x 2 p(x 3)=0. 25 0. 95 x 3 Fehlerwahrscheinlichkeit des Kanals. Diese ist unabhängig von der Auftrittswahrscheinlichkeit der Zeichen der Quelle. y 1 0. 025 y 2 y 3 Kanal Symmetrisch 49

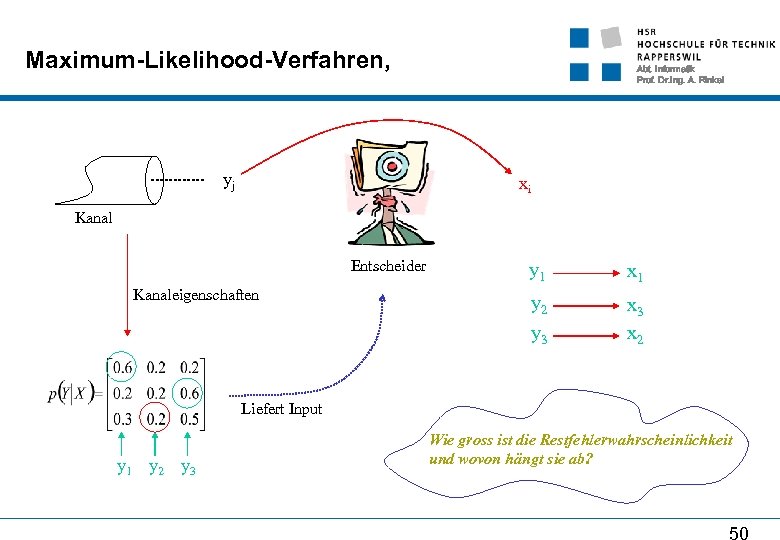

Maximum-Likelihood-Verfahren, yj Abt. Informatik Prof. Dr. Ing. A. Rinkel xi Kanal Entscheider Kanaleigenschaften y 1 x 1 y 2 y 3 x 2 Liefert Input y 1 y 2 y 3 Wie gross ist die Restfehlerwahrscheinlichkeit und wovon hängt sie ab? 50

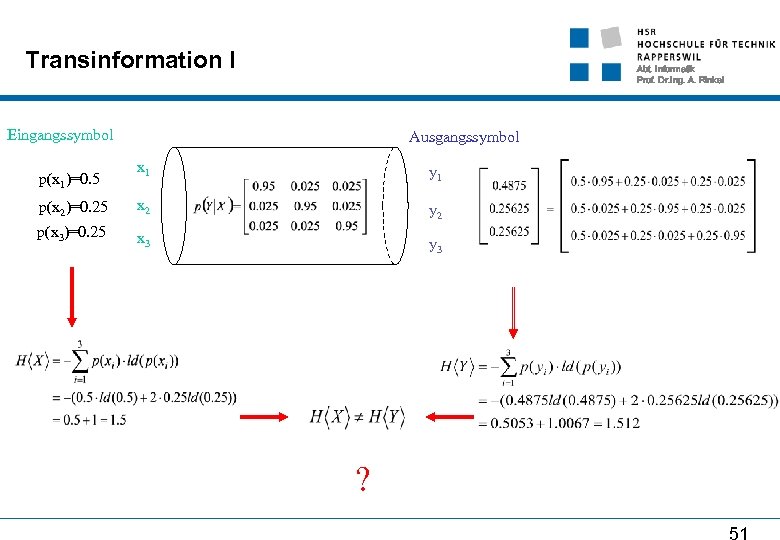

Transinformation I Abt. Informatik Prof. Dr. Ing. A. Rinkel Eingangssymbol Ausgangssymbol x 1 y 1 p(x 2)=0. 25 x 2 y 2 p(x 3)=0. 25 x 3 y 3 p(x 1)=0. 5 ? 51

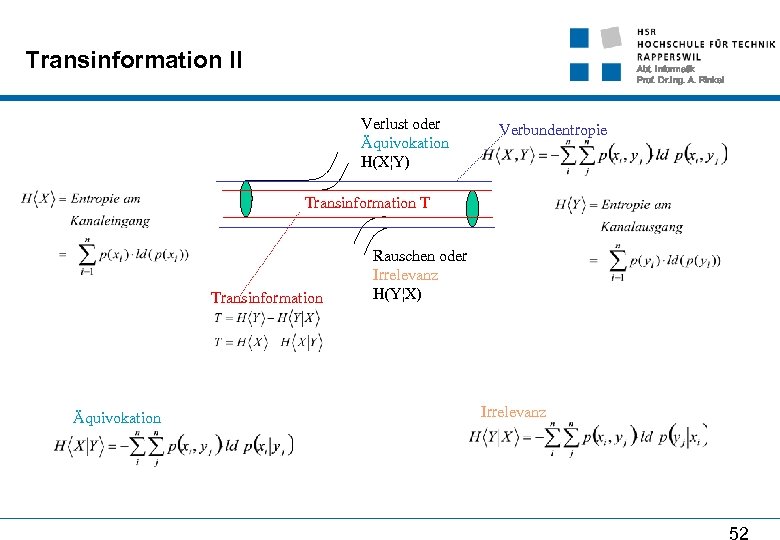

Transinformation II Abt. Informatik Prof. Dr. Ing. A. Rinkel Verlust oder Äquivokation H(X¦Y) Verbundentropie Transinformation T Transinformation Äquivokation Rauschen oder Irrelevanz H(Y¦X) Irrelevanz 52

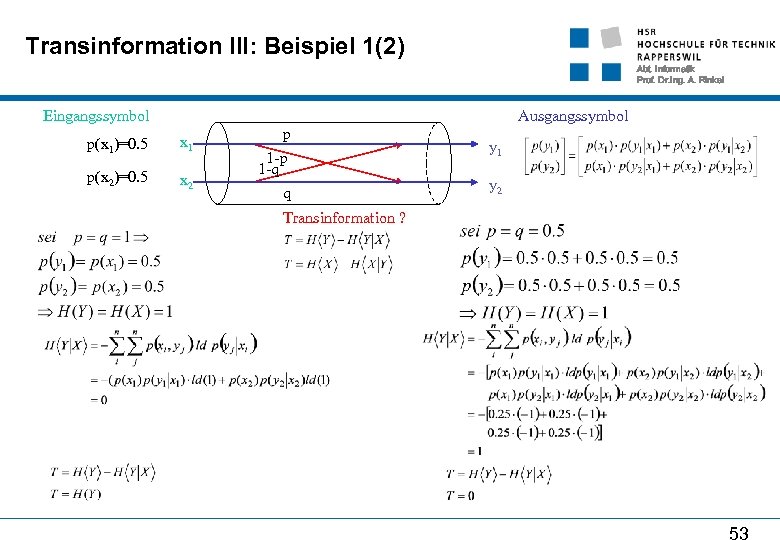

Transinformation III: Beispiel 1(2) Abt. Informatik Prof. Dr. Ing. A. Rinkel Eingangssymbol Ausgangssymbol p(x 1)=0. 5 x 1 p(x 2)=0. 5 x 2 p 1 -q q y 1 y 2 Transinformation ? 53

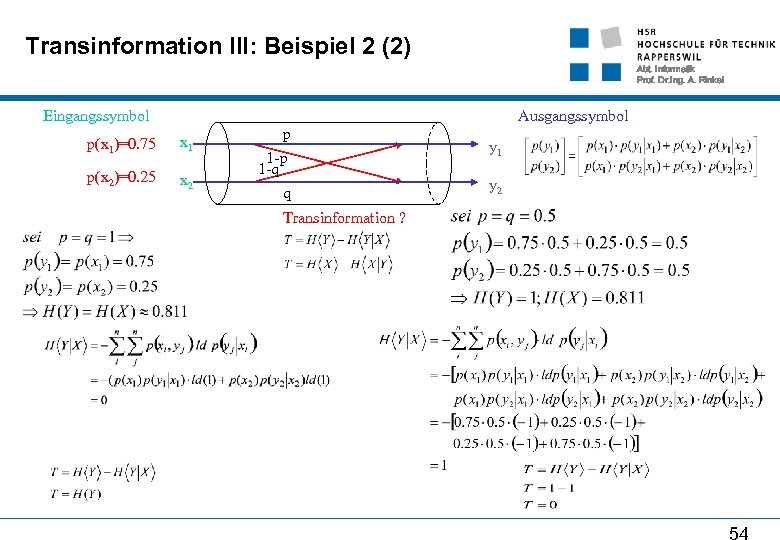

Transinformation III: Beispiel 2 (2) Abt. Informatik Prof. Dr. Ing. A. Rinkel Eingangssymbol Ausgangssymbol p(x 1)=0. 75 x 1 p(x 2)=0. 25 x 2 p 1 -q q y 1 y 2 Transinformation ? 54

Hausaufgabe Machen Sie mit einem Mind-Map eine Zusammenfassung des Erlernten und definieren Sie noch offene Fragen für die nächste Veranstaltung! Abt. Informatik Prof. Dr. Ing. A. Rinkel 55

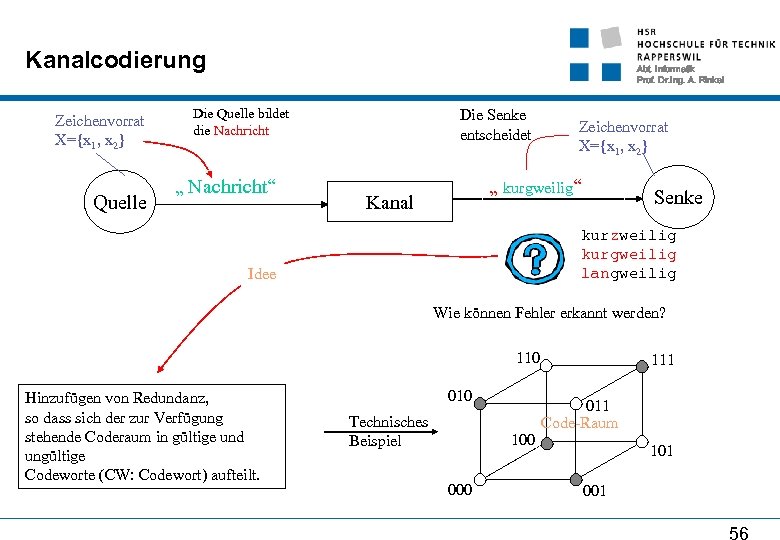

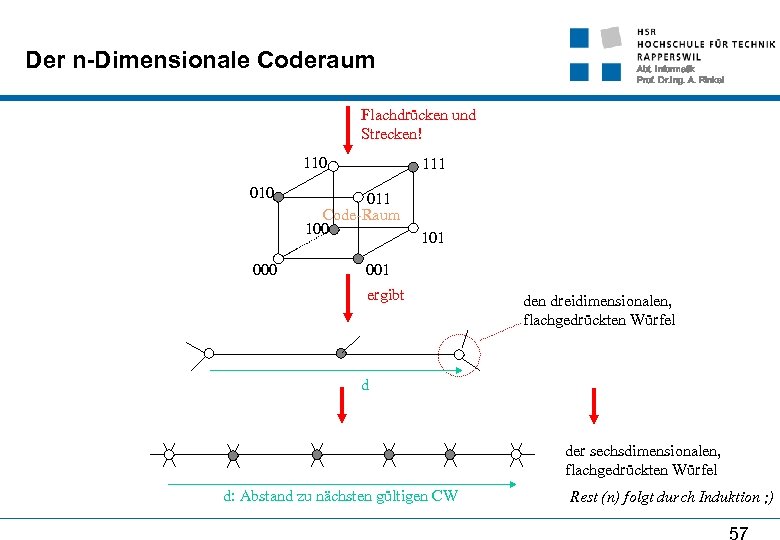

Kanalcodierung Zeichenvorrat X={x 1, x 2} Quelle Abt. Informatik Prof. Dr. Ing. A. Rinkel Die Quelle bildet die Nachricht „ Nachricht“ Die Senke entscheidet Zeichenvorrat X={x 1, x 2} „ kurgweilig“ Kanal Senke kurzweilig kurgweilig langweilig Idee Wie können Fehler erkannt werden? 110 Hinzufügen von Redundanz, so dass sich der zur Verfügung stehende Coderaum in gültige und ungültige Codeworte (CW: Codewort) aufteilt. 010 Technisches Beispiel 100 000 111 011 Code-Raum 101 001 56

Der n-Dimensionale Coderaum Abt. Informatik Prof. Dr. Ing. A. Rinkel Flachdrücken und Strecken! 110 000 111 011 Code-Raum 100 101 001 ergibt den dreidimensionalen, flachgedrückten Würfel d der sechsdimensionalen, flachgedrückten Würfel d: Abstand zu nächsten gültigen CW Rest (n) folgt durch Induktion ; ) 57

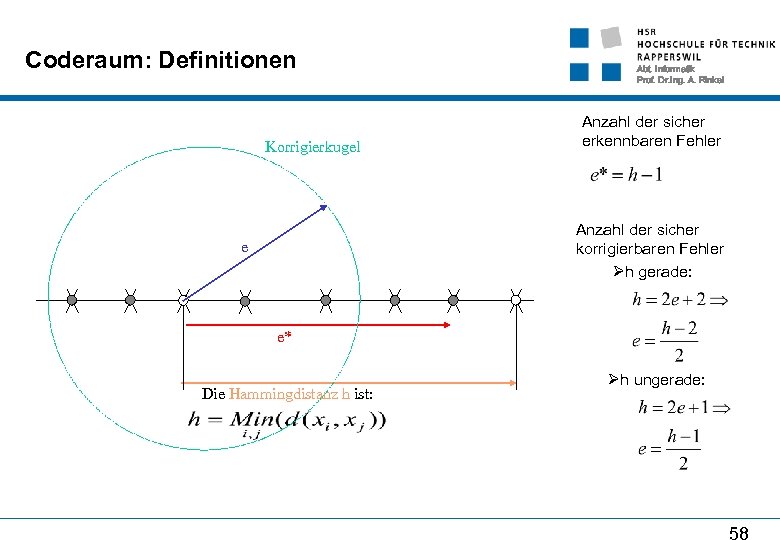

Coderaum: Definitionen Korrigierkugel Abt. Informatik Prof. Dr. Ing. A. Rinkel Anzahl der sicher erkennbaren Fehler Anzahl der sicher korrigierbaren Fehler Øh gerade: e e* Die Hammingdistanz h ist: Øh ungerade: 58

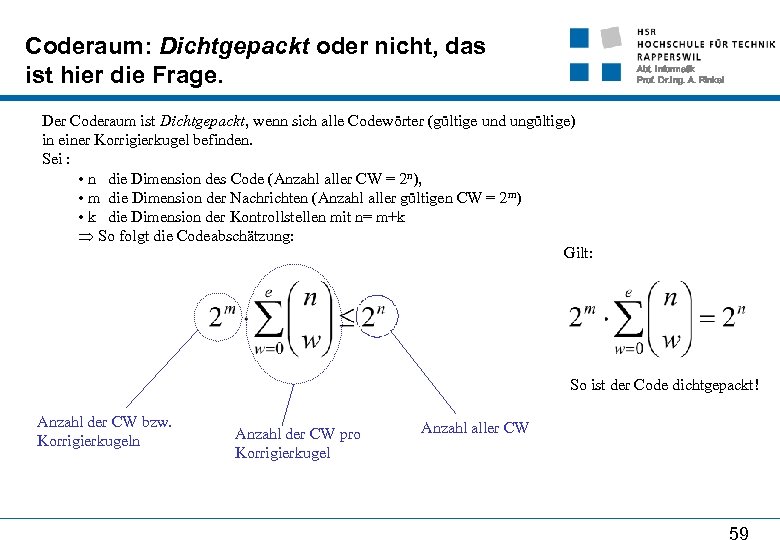

Coderaum: Dichtgepackt oder nicht, das ist hier die Frage. Abt. Informatik Prof. Dr. Ing. A. Rinkel Der Coderaum ist Dichtgepackt, wenn sich alle Codewörter (gültige und ungültige) in einer Korrigierkugel befinden. Sei : • n die Dimension des Code (Anzahl aller CW = 2 n), • m die Dimension der Nachrichten (Anzahl aller gültigen CW = 2 m) • k die Dimension der Kontrollstellen mit n= m+k So folgt die Codeabschätzung: Gilt: So ist der Code dichtgepackt! Anzahl der CW bzw. Korrigierkugeln Anzahl der CW pro Korrigierkugel Anzahl aller CW 59

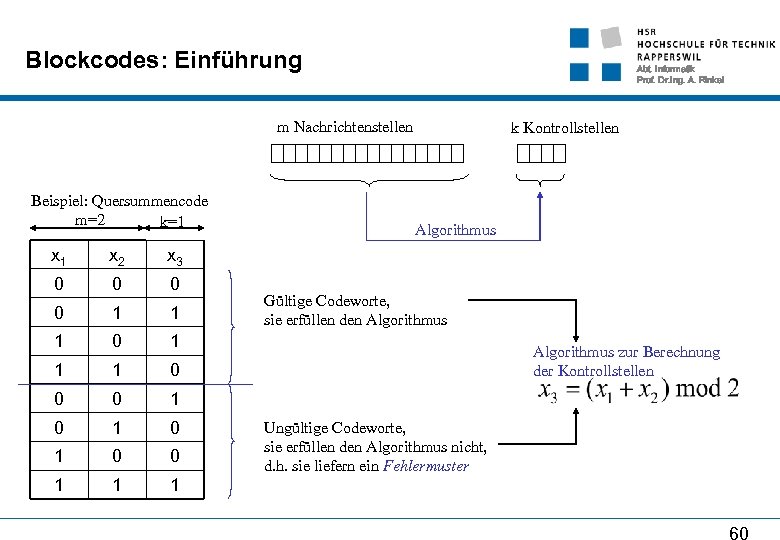

Blockcodes: Einführung Abt. Informatik Prof. Dr. Ing. A. Rinkel m Nachrichtenstellen Beispiel: Quersummencode m=2 k=1 x 2 0 0 0 1 1 1 0 0 0 1 0 1 0 0 1 1 1 Algorithmus x 3 0 k Kontrollstellen Gültige Codeworte, sie erfüllen den Algorithmus zur Berechnung der Kontrollstellen Ungültige Codeworte, sie erfüllen den Algorithmus nicht, d. h. sie liefern ein Fehlermuster 60

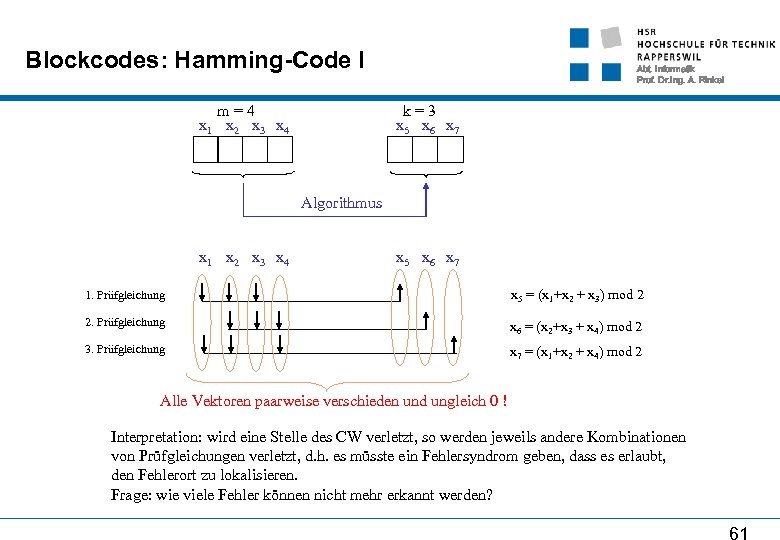

Blockcodes: Hamming-Code I m = 4 x 1 x 2 x 3 x 4 Abt. Informatik Prof. Dr. Ing. A. Rinkel k = 3 x 5 x 6 x 7 Algorithmus x 1 x 2 x 3 x 4 x 5 x 6 x 7 1. Prüfgleichung x 5 = (x 1+x 2 + x 3) mod 2 2. Prüfgleichung x 6 = (x 2+x 3 + x 4) mod 2 3. Prüfgleichung x 7 = (x 1+x 2 + x 4) mod 2 Alle Vektoren paarweise verschieden und ungleich 0 ! Interpretation: wird eine Stelle des CW verletzt, so werden jeweils andere Kombinationen von Prüfgleichungen verletzt, d. h. es müsste ein Fehlersyndrom geben, dass es erlaubt, den Fehlerort zu lokalisieren. Frage: wie viele Fehler können nicht mehr erkannt werden? 61

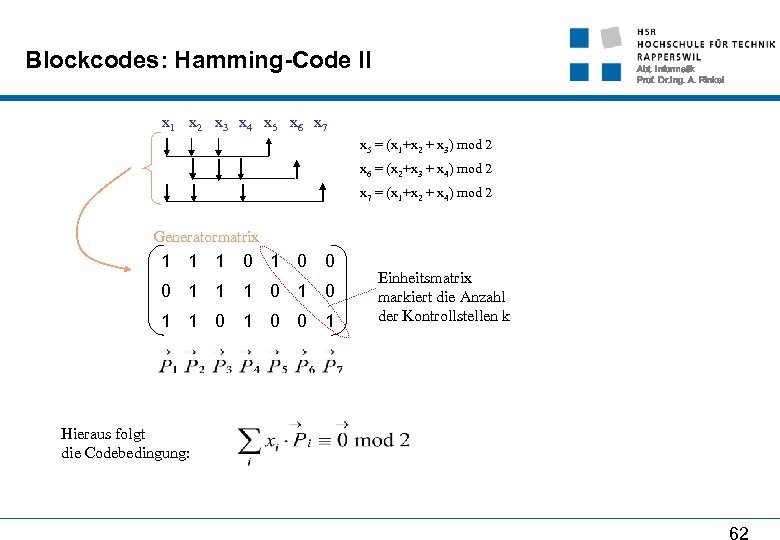

Blockcodes: Hamming-Code II Abt. Informatik Prof. Dr. Ing. A. Rinkel x 1 x 2 x 3 x 4 x 5 x 6 x 7 x 5 = (x 1+x 2 + x 3) mod 2 x 6 = (x 2+x 3 + x 4) mod 2 x 7 = (x 1+x 2 + x 4) mod 2 Generatormatrix 1 1 1 0 0 0 1 1 1 0 1 0 0 1 Einheitsmatrix markiert die Anzahl der Kontrollstellen k Hieraus folgt die Codebedingung: 62

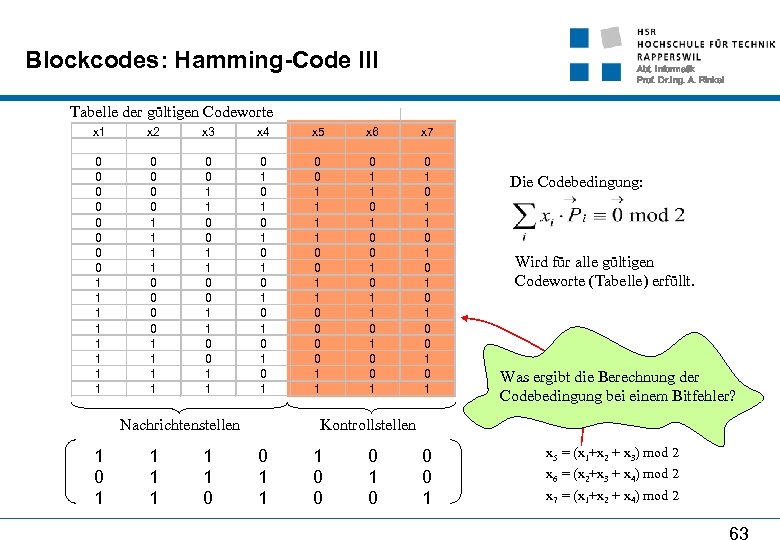

Blockcodes: Hamming-Code III Abt. Informatik Prof. Dr. Ing. A. Rinkel Tabelle der gültigen Codeworte x 1 x 2 x 3 x 4 x 5 x 6 x 7 0 0 0 0 1 1 1 1 0 0 1 1 0 1 0 1 0 0 1 1 0 0 1 1 0 1 0 0 1 0 1 1 0 1 0 0 1 Nachrichtenstellen 1 0 1 1 1 0 Die Codebedingung: Wird für alle gültigen Codeworte (Tabelle) erfüllt. Was ergibt die Berechnung der Codebedingung bei einem Bitfehler? Kontrollstellen 0 1 1 1 0 0 0 1 x 5 = (x 1+x 2 + x 3) mod 2 x 6 = (x 2+x 3 + x 4) mod 2 x 7 = (x 1+x 2 + x 4) mod 2 63

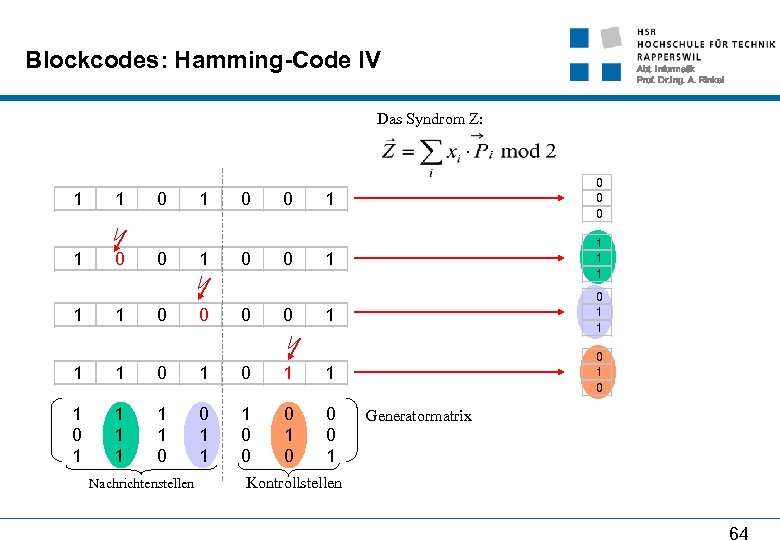

Blockcodes: Hamming-Code IV Abt. Informatik Prof. Dr. Ing. A. Rinkel Das Syndrom Z: 1 1 0 1 0 0 0 1 1 0 0 0 0 1 1 1 0 1 0 1 1 1 1 0 0 0 1 Nachrichtenstellen Generatormatrix Kontrollstellen 64

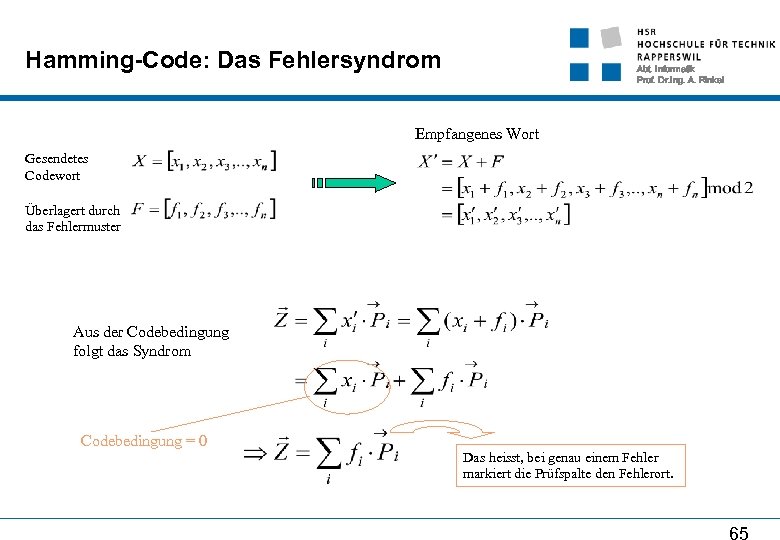

Hamming-Code: Das Fehlersyndrom Abt. Informatik Prof. Dr. Ing. A. Rinkel Empfangenes Wort Gesendetes Codewort Überlagert durch das Fehlermuster Aus der Codebedingung folgt das Syndrom Codebedingung = 0 Das heisst, bei genau einem Fehler markiert die Prüfspalte den Fehlerort. 65

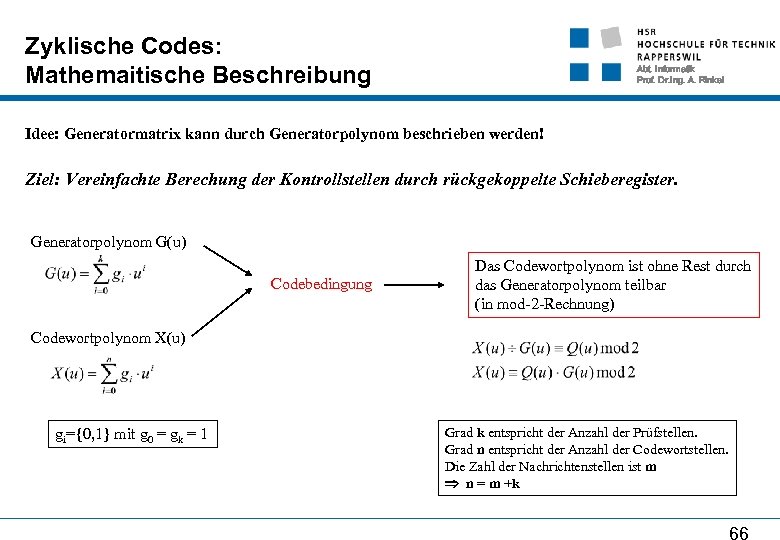

Zyklische Codes: Mathemaitische Beschreibung Abt. Informatik Prof. Dr. Ing. A. Rinkel Idee: Generatormatrix kann durch Generatorpolynom beschrieben werden! Ziel: Vereinfachte Berechung der Kontrollstellen durch rückgekoppelte Schieberegister. Generatorpolynom G(u) Codebedingung Das Codewortpolynom ist ohne Rest durch das Generatorpolynom teilbar (in mod-2 -Rechnung) Codewortpolynom X(u) gi={0, 1} mit g 0 = gk = 1 Grad k entspricht der Anzahl der Prüfstellen. Grad n entspricht der Anzahl der Codewortstellen. Die Zahl der Nachrichtenstellen ist m n = m +k 66

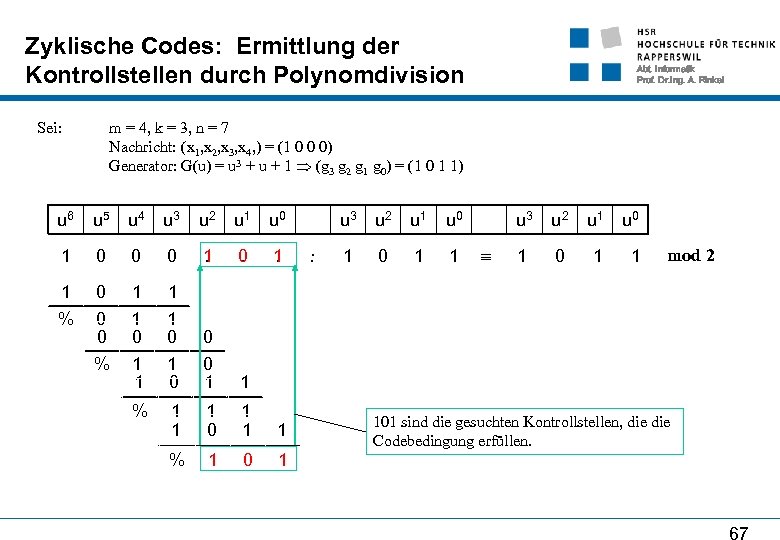

Zyklische Codes: Ermittlung der Kontrollstellen durch Polynomdivision Sei: Abt. Informatik Prof. Dr. Ing. A. Rinkel m = 4, k = 3, n = 7 Nachricht: (x 1, x 2, x 3, x 4, ) = (1 0 0 0) Generator: G(u) = u 3 + u + 1 (g 3 g 2 g 1 g 0) = (1 0 1 1) u 6 u 5 u 4 u 3 u 2 u 1 u 0 1 0 0 0 1. 0. 1 % 0 0 0 % 1 1 0 1 0 0 0 1 1 % 1 1 1 0 1 1 1 % 1 0 1 u 3 u 2 u 1 u 0 1 0 1 1 mod 2 101 sind die gesuchten Kontrollstellen, die Codebedingung erfüllen. 67

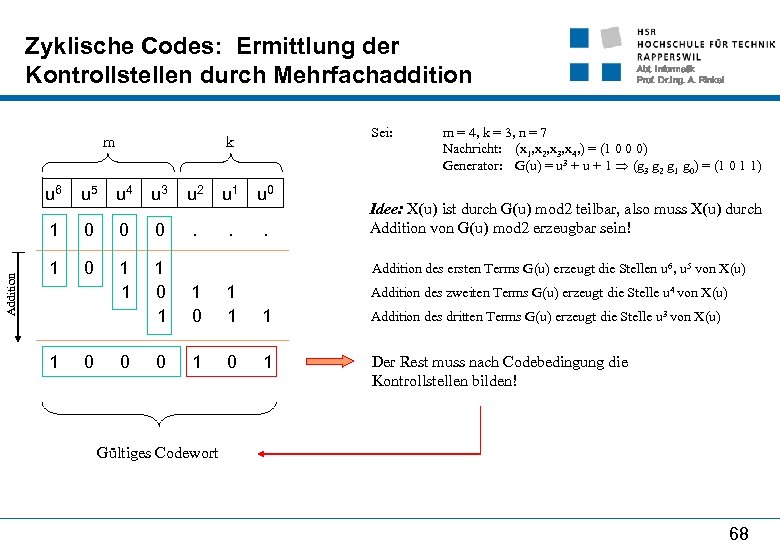

Zyklische Codes: Ermittlung der Kontrollstellen durch Mehrfachaddition m Sei: k Abt. Informatik Prof. Dr. Ing. A. Rinkel m = 4, k = 3, n = 7 Nachricht: (x 1, x 2, x 3, x 4, ) = (1 0 0 0) Generator: G(u) = u 3 + u + 1 (g 3 g 2 g 1 g 0) = (1 0 1 1) u 5 u 4 u 3 u 2 u 1 u 0 1 Addition u 6 0 0 0 . . . 1 0 1 1 1 Addition des dritten Terms G(u) erzeugt die Stelle u 3 von X(u) 0 1 Der Rest muss nach Codebedingung die Kontrollstellen bilden! 1 0 0 Idee: X(u) ist durch G(u) mod 2 teilbar, also muss X(u) durch Addition von G(u) mod 2 erzeugbar sein! Addition des ersten Terms G(u) erzeugt die Stellen u 6, u 5 von X(u) Addition des zweiten Terms G(u) erzeugt die Stelle u 4 von X(u) Gültiges Codewort 68

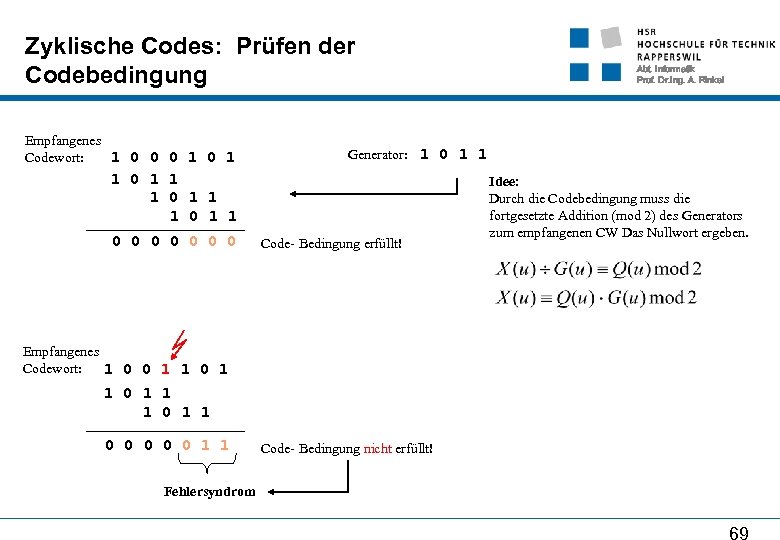

Zyklische Codes: Prüfen der Codebedingung Empfangenes 1 0 0 0 1 Codewort: Generator: 1 0 1 1 0 0 0 0 Abt. Informatik Prof. Dr. Ing. A. Rinkel Code- Bedingung erfüllt! Idee: Durch die Codebedingung muss die fortgesetzte Addition (mod 2) des Generators zum empfangenen CW Das Nullwort ergeben. Empfangenes Codewort: 1 0 0 1 1 1 0 0 0 1 1 Code- Bedingung nicht erfüllt! Fehlersyndrom 69

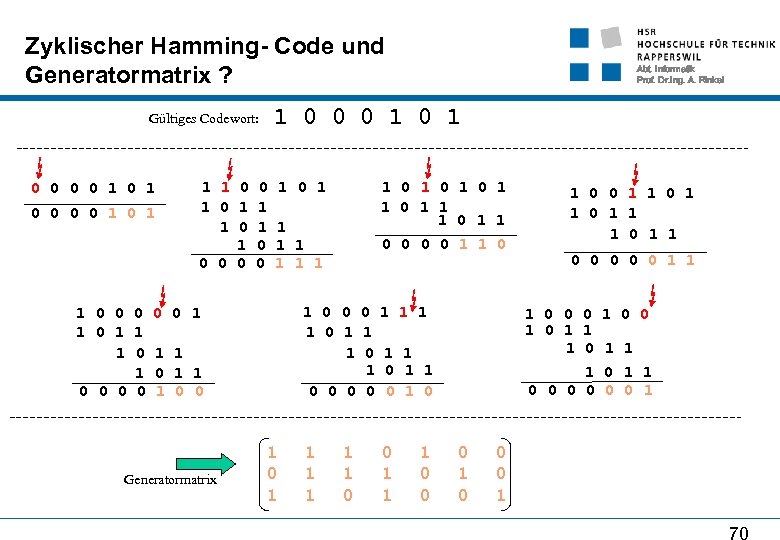

Zyklischer Hamming- Code und Generatormatrix ? 1 0 0 0 1 Gültiges Codewort: 0 0 0 0 1 0 1 1 0 0 0 1 1 1 0 1 0 0 0 0 1 1 0 0 1 0 1 1 0 0 1 1 1 1 0 0 0 1 1 1 0 1 1 0 0 0 1 1 0 0 Generatormatrix Abt. Informatik Prof. Dr. Ing. A. Rinkel 1 0 1 1 1 0 0 1 1 1 0 0 0 1 1 1 0 1 1 0 0 0 0 1 1 1 0 0 1 70

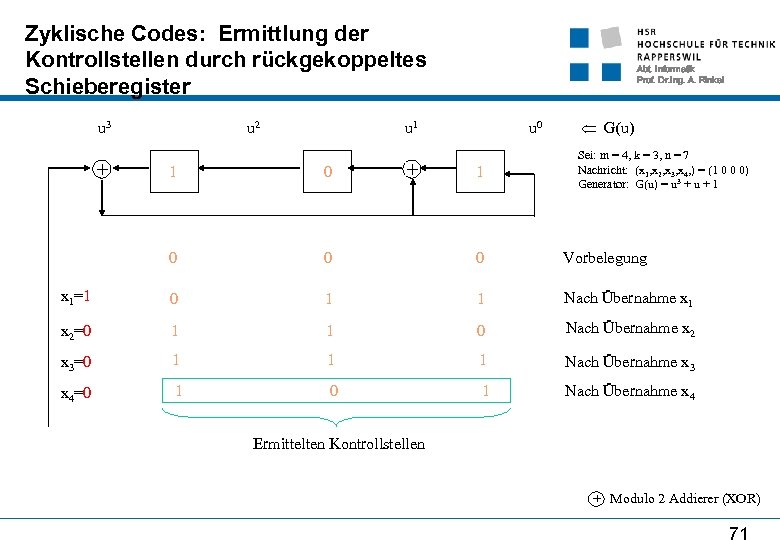

Zyklische Codes: Ermittlung der Kontrollstellen durch rückgekoppeltes Schieberegister u 3 u 2 + 1 0 0 1 1 Abt. Informatik Prof. Dr. Ing. A. Rinkel u 1 0 1 + u 0 0 1 1 0 1 0 G(u) Sei: m = 4, k = 3, n = 7 Nachricht: (x 1, x 2, x 3, x 4, ) = (1 0 0 0) Generator: G(u) = u 3 + u + 1 0 0 0 Vorbelegung x 1=1 0 1 1 Nach Übernahme x 1 x 2=0 1 1 0 Nach Übernahme x 2 x 3=0 1 1 1 Nach Übernahme x 3 x 4=0 1 Nach Übernahme x 4 Ermittelten Kontrollstellen + Modulo 2 Addierer (XOR) 71

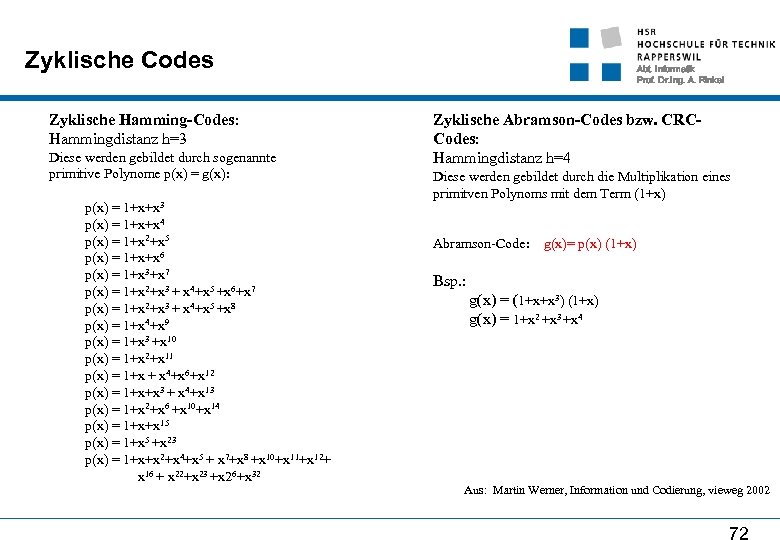

Zyklische Codes Zyklische Hamming-Codes: Hammingdistanz h=3 Diese werden gebildet durch sogenannte primitive Polynome p(x) = g(x): p(x) = 1+x+x 3 p(x) = 1+x+x 4 p(x) = 1+x 2+x 5 p(x) = 1+x+x 6 p(x) = 1+x 3+x 7 p(x) = 1+x 2+x 3 + x 4+x 5 +x 6+x 7 p(x) = 1+x 2+x 3 + x 4+x 5 +x 8 p(x) = 1+x 4+x 9 p(x) = 1+x 3 +x 10 p(x) = 1+x 2+x 11 p(x) = 1+x + x 4+x 6+x 12 p(x) = 1+x+x 3 + x 4+x 13 p(x) = 1+x 2+x 6 +x 10+x 14 p(x) = 1+x+x 15 p(x) = 1+x 5 +x 23 p(x) = 1+x+x 2+x 4+x 5 + x 7+x 8 +x 10+x 11+x 12+ x 16 + x 22+x 23 +x 26+x 32 Abt. Informatik Prof. Dr. Ing. A. Rinkel Zyklische Abramson-Codes bzw. CRCCodes: Hammingdistanz h=4 Diese werden gebildet durch die Multiplikation eines primitven Polynoms mit dem Term (1+x) Abramson-Code: g(x)= p(x) (1+x) Bsp. : g(x) = (1+x+x 3) (1+x) g(x) = 1+x 2 +x 3 +x 4 Aus: Martin Werner, Information und Codierung, vieweg 2002 72

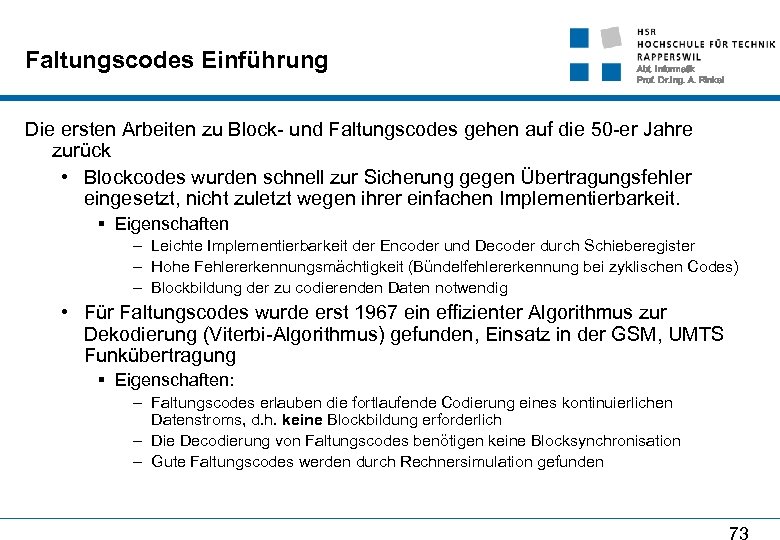

Faltungscodes Einführung Abt. Informatik Prof. Dr. Ing. A. Rinkel Die ersten Arbeiten zu Block- und Faltungscodes gehen auf die 50 -er Jahre zurück • Blockcodes wurden schnell zur Sicherung gegen Übertragungsfehler eingesetzt, nicht zuletzt wegen ihrer einfachen Implementierbarkeit. § Eigenschaften – Leichte Implementierbarkeit der Encoder und Decoder durch Schieberegister – Hohe Fehlererkennungsmächtigkeit (Bündelfehlererkennung bei zyklischen Codes) – Blockbildung der zu codierenden Daten notwendig • Für Faltungscodes wurde erst 1967 ein effizienter Algorithmus zur Dekodierung (Viterbi-Algorithmus) gefunden, Einsatz in der GSM, UMTS Funkübertragung § Eigenschaften: – Faltungscodes erlauben die fortlaufende Codierung eines kontinuierlichen Datenstroms, d. h. keine Blockbildung erforderlich – Die Decodierung von Faltungscodes benötigen keine Blocksynchronisation – Gute Faltungscodes werden durch Rechnersimulation gefunden 73

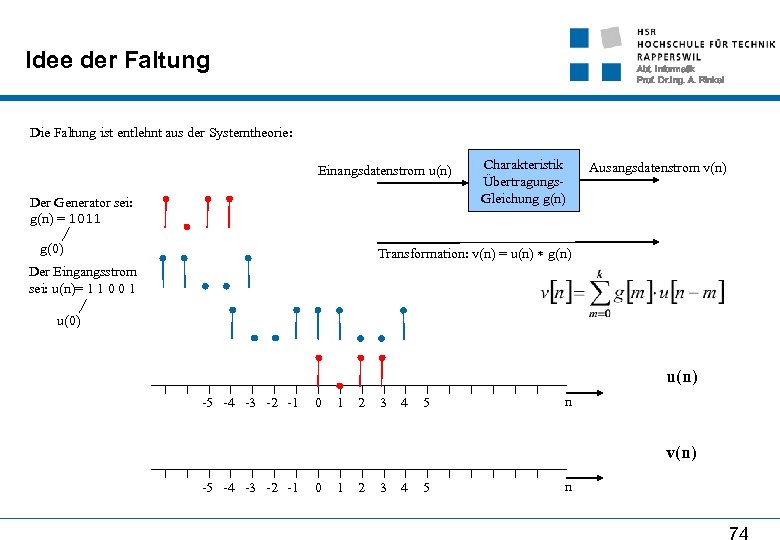

Idee der Faltung Abt. Informatik Prof. Dr. Ing. A. Rinkel Die Faltung ist entlehnt aus der Systemtheorie: Einangsdatenstrom u(n) Der Generator sei: g(n) = 1011 g(0) Charakteristik Übertragungs. Gleichung g(n) Ausangsdatenstrom v(n) Transformation: v(n) = u(n) g(n) Der Eingangsstrom sei: u(n)= 1 1 0 0 1 u(0) u(n) -5 -4 -3 -2 -1 0 1 2 3 4 5 n v(n) -5 -4 -3 -2 -1 0 1 2 3 4 5 n 74

![Idee des binären Faltungs-Encoders I Definitionen Ausgänge vj[n] u 1[n] u 2[n] v 1[n] Idee des binären Faltungs-Encoders I Definitionen Ausgänge vj[n] u 1[n] u 2[n] v 1[n]](https://present5.com/presentation/e7f1a5dd8f4c37f1f16a7d70d95f5949/image-75.jpg)

Idee des binären Faltungs-Encoders I Definitionen Ausgänge vj[n] u 1[n] u 2[n] v 1[n] v 2[n] uk[n] LTI System vn[n] MUX Nachrichtenfolge u[n 1] DEMUX Eingänge uj[n] Abt. Informatik Prof. Dr. Ing. A. Rinkel Codefolge v[n 2] Faltung Nachrichtenfolge: Codefolge: Die Ausgangsfolge wird durch die Faltung der Eingangsfolgen erzeugt! (zur Vertiefung siehe auch Z-Transformation) Eingangsfolgen: Ausgangsfolgen: Impulsantwort: LTI: Linear Time Invariant 75

![g 2, 0=1 s 0 g 1, 1 u 1[n] =0 u 2[n] g g 2, 0=1 s 0 g 1, 1 u 1[n] =0 u 2[n] g](https://present5.com/presentation/e7f1a5dd8f4c37f1f16a7d70d95f5949/image-76.jpg)

g 2, 0=1 s 0 g 1, 1 u 1[n] =0 u 2[n] g 1, 2=1 LTI System s 1 uk[n] g 2, 1=1 g 2, 2=1 s 2 Abt. Informatik Prof. Dr. Ing. A. Rinkel v 1[n] v 2[n] vn[n] v 1[n] g 1, 3=1 MUX g 1, 0=1 Nachrichtenfolge u[n 1] Nachrichtenfolge u[n] DEMUX Idee des binären Faltungs-Encoders II Encoderschaltung des (2, 1, 3) Encoders Codefolge v[n 2] g 2, 3=1 v 2[n] {g 1}={1, 0, 1, 1} {g 2}={1, 1, 1, 1} u S 1 S 2 v 1[n] v 2[n] V[n 2] - 0 0 0 - - - 1 Beispiel: sei {un}={1, 0, 1} die Speicherplätze S 0, S 1, S 2 sind mit 0 vorbelegt S 0 0 1 1 11 0 0 0 1 01 1 0 0 0 00 0 1 1 0 10 0 0 1 1 11 0 0 0 1 11 - 0 0 0 - - - Ausgangszustand erreicht 76

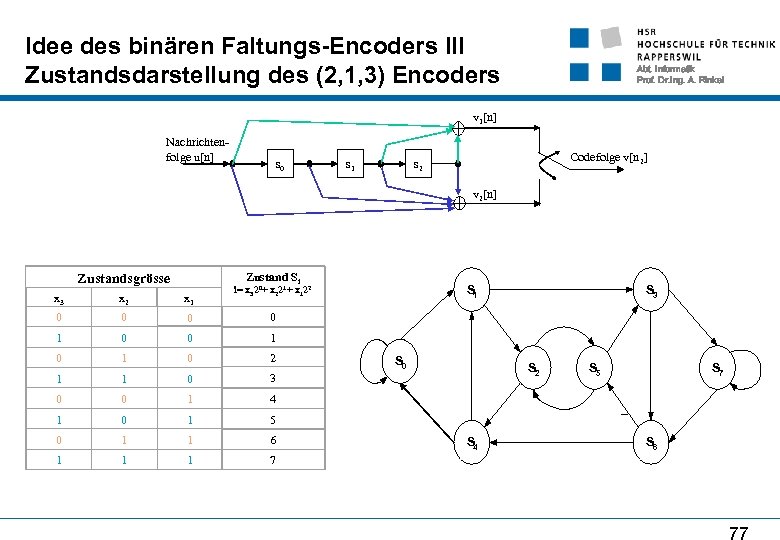

Idee des binären Faltungs-Encoders III Zustandsdarstellung des (2, 1, 3) Encoders Abt. Informatik Prof. Dr. Ing. A. Rinkel v 1[n] Nachrichtenfolge u[n] s 0 s 1 Codefolge v[n 2] s 2 v 2[n] Zustand Si Zustandsgrösse S 1 i= x 320+ x 221+ x 122 x 3 x 2 x 1 0 0 1 0 2 1 1 0 3 0 0 1 4 1 0 1 5 0 1 1 6 1 1 1 S 3 7 S 0 S 2 S 4 S 5 S 7 S 6 77

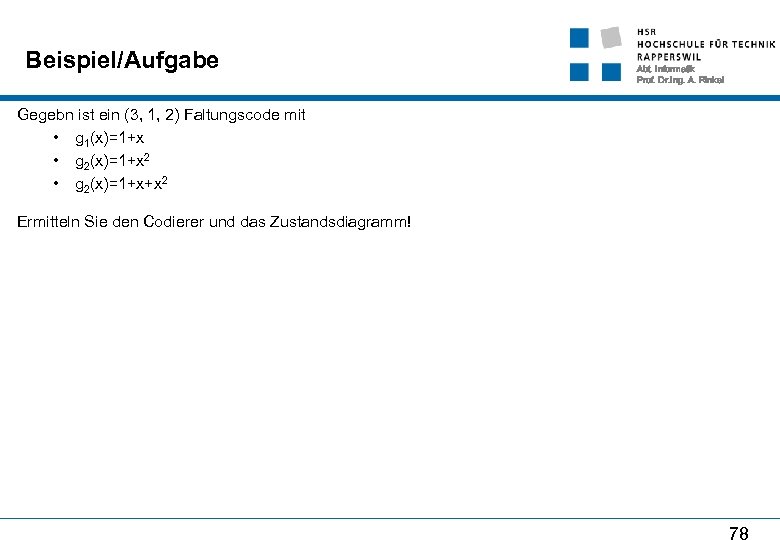

Beispiel/Aufgabe Abt. Informatik Prof. Dr. Ing. A. Rinkel Gegebn ist ein (3, 1, 2) Faltungscode mit • g 1(x)=1+x • g 2(x)=1+x 2 • g 2(x)=1+x+x 2 Ermitteln Sie den Codierer und das Zustandsdiagramm! 78

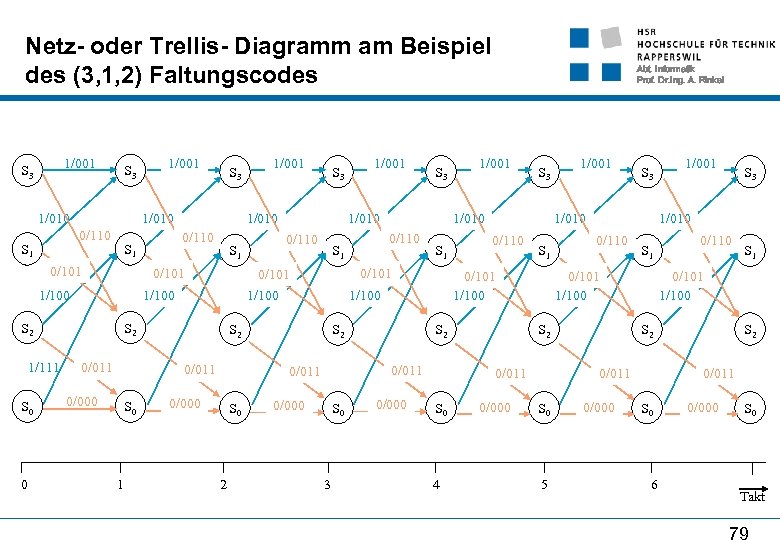

Netz- oder Trellis- Diagramm am Beispiel des (3, 1, 2) Faltungscodes 1/001 S 3 0/110 0 S 2 1/001 0/110 S 1 1/111 0/110 S 2 S 3 S 1 0/101 1/100 S 2 0/011 1/001 1/010 0/110 0/101 1/100 S 2 S 3 1/010 S 1 S 3 0/110 1/001 S 3 1/010 0/110 1/001 0/101 1/100 S 2 S 1 0/110 S 1 0/101 1/100 S 2 S 2 0/011 0/000 S 3 1/010 0/101 0/000 1/100 S 2 S 0 S 1 0/101 1/100 1/001 1/010 0/110 S 1 0/101 1/111 S 3 1/010 S 1 1/001 Abt. Informatik Prof. Dr. Ing. A. Rinkel 0/011 S 0 1 0/011 0/000 S 0 2 0/000 S 0 3 0/000 0/011 S 0 4 0/000 0/011 S 0 5 0/000 0/011 S 0 6 0/000 S 0 Takt 79

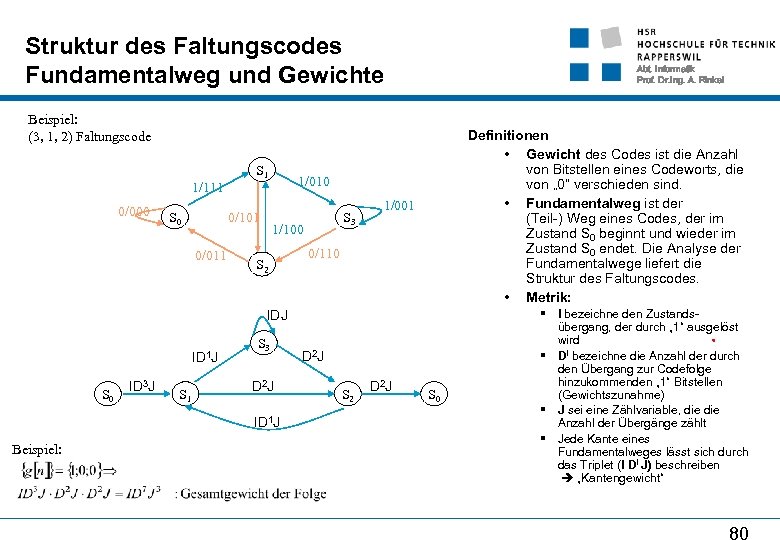

Struktur des Faltungscodes Fundamentalweg und Gewichte Abt. Informatik Prof. Dr. Ing. A. Rinkel Beispiel: (3, 1, 2) Faltungscode 1/111 0/000 S 1 0/101 0/011 Definitionen • Gewicht des Codes ist die Anzahl von Bitstellen eines Codeworts, die von „ 0“ verschieden sind. • Fundamentalweg ist der (Teil-) Weg eines Codes, der im Zustand S 0 beginnt und wieder im Zustand S 0 endet. Die Analyse der Fundamentalwege liefert die Struktur des Faltungscodes. • Metrik: 1/010 S 3 1/100 S 2 1/001 0/110 IDJ ID 1 J S 0 ID 3 J S 1 S 3 D 2 J ID 1 J Beispiel: D 2 J S 2 D 2 J S 0 § I bezeichne den Zustandsübergang, der durch „ 1“ ausgelöst wird § Dl bezeichne die Anzahl der durch den Übergang zur Codefolge hinzukommenden „ 1“ Bitstellen (Gewichtszunahme) § J sei eine Zählvariable, die Anzahl der Übergänge zählt § Jede Kante eines Fundamentalweges lässt sich durch das Triplet (I Dl J) beschreiben „Kantengewicht“ 80

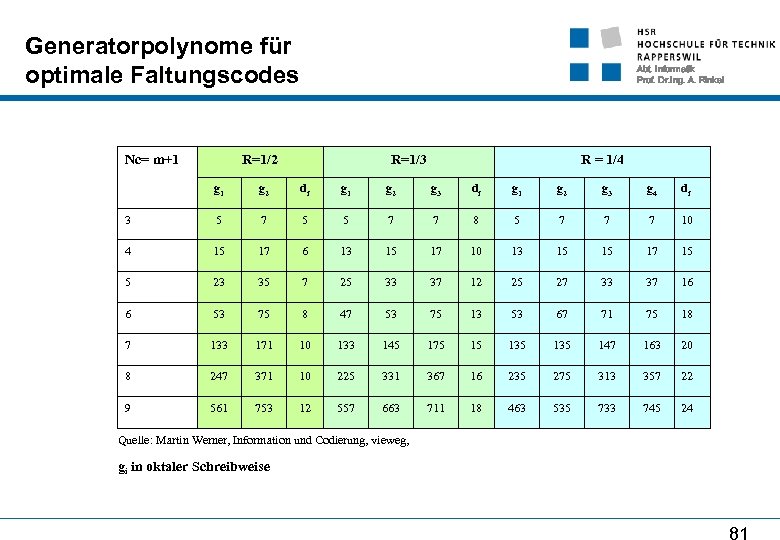

Generatorpolynome für optimale Faltungscodes Nc= m+1 Abt. Informatik Prof. Dr. Ing. A. Rinkel R=1/2 R=1/3 R = 1/4 g 1 g 2 df g 1 g 2 g 3 g 4 df 3 5 7 5 5 7 7 8 5 7 7 7 10 4 15 17 6 13 15 17 10 13 15 15 17 15 5 23 35 7 25 33 37 12 25 27 33 37 16 6 53 75 8 47 53 75 13 53 67 71 75 18 7 133 171 10 133 145 175 15 135 147 163 20 8 247 371 10 225 331 367 16 235 275 313 357 22 9 561 753 12 557 663 711 18 463 535 733 745 24 Quelle: Martin Werner, Information und Codierung, vieweg, gi in oktaler Schreibweise 81

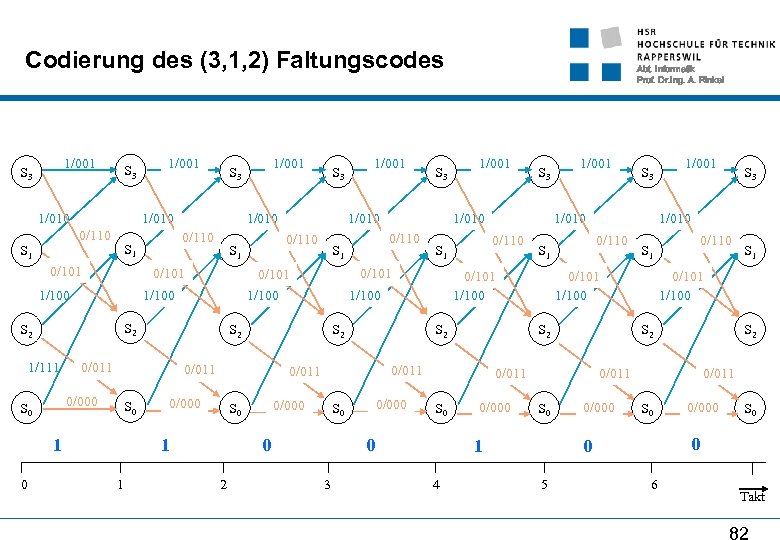

Codierung des (3, 1, 2) Faltungscodes 1/001 S 3 0/110 0/101 S 2 1/111 0/110 S 1 1/111 S 0 S 2 S 3 S 1 0/101 1/100 S 2 0/011 1/001 1/010 0/110 0/101 1/100 S 2 S 3 1/010 S 1 S 3 0/110 1/001 S 3 1/010 0/110 1/001 0/101 1/100 S 2 S 1 0/110 S 1 0/101 1/100 S 2 S 2 0/011 0/000 S 0 0/011 S 0 1 0 0/101 0/000 1/100 1/001 1/010 0/110 S 1 0/101 1/100 S 3 1/010 0/110 S 1 1/001 S 3 1/010 S 1 1/001 Abt. Informatik Prof. Dr. Ing. A. Rinkel 0/000 S 0 1 1 0/011 S 0 0 2 0/000 0/011 S 0 0 3 0/000 0/011 S 0 1 4 0/000 0/011 S 0 0 0 5 0/000 6 Takt 82

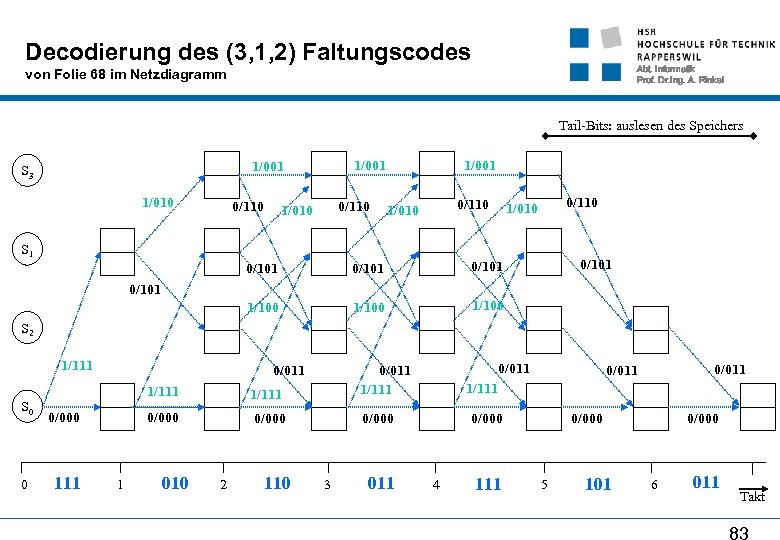

Decodierung des (3, 1, 2) Faltungscodes Abt. Informatik Prof. Dr. Ing. A. Rinkel von Folie 68 im Netzdiagramm Tail-Bits: auslesen des Speichers 1/001 S 3 1/010 0/110 1/001 0/110 1/010 S 1 0/101 1/100 0/110 1/010 1/100 0/101 S 2 1/111 S 0 0 0/011 1/111 0/000 111 1 1/111 0/000 0/011 1/111 0/000 010 2 110 3 011 0/000 4 111 0/011 0/000 5 101 0/000 6 011 Takt 83

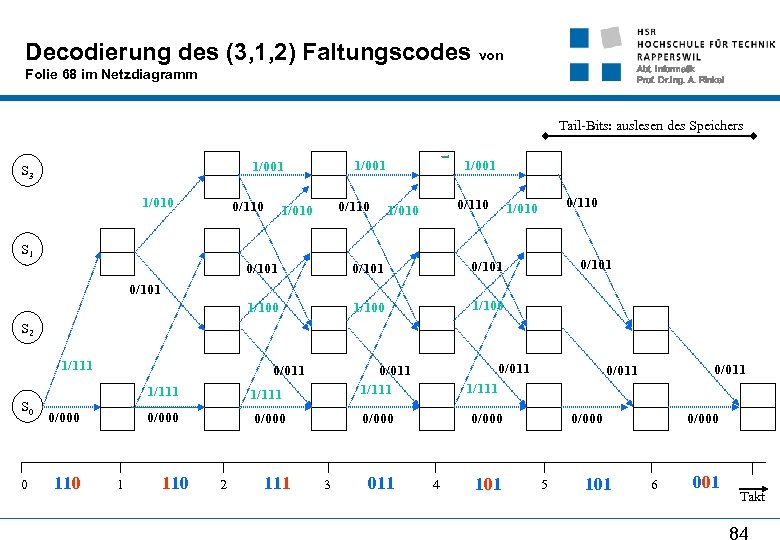

Decodierung des (3, 1, 2) Faltungscodes von Abt. Informatik Prof. Dr. Ing. A. Rinkel Folie 68 im Netzdiagramm Tail-Bits: auslesen des Speichers 1/001 S 3 1/010 0/110 1/001 0/110 1/010 S 1 0/101 1/100 0/110 1/010 1/100 0/101 S 2 1/111 S 0 0 0/011 1/111 0/000 110 1 1/111 0/000 0/011 1/111 0/000 110 2 111 3 011 0/000 4 101 0/011 0/000 5 101 0/000 6 001 Takt 84

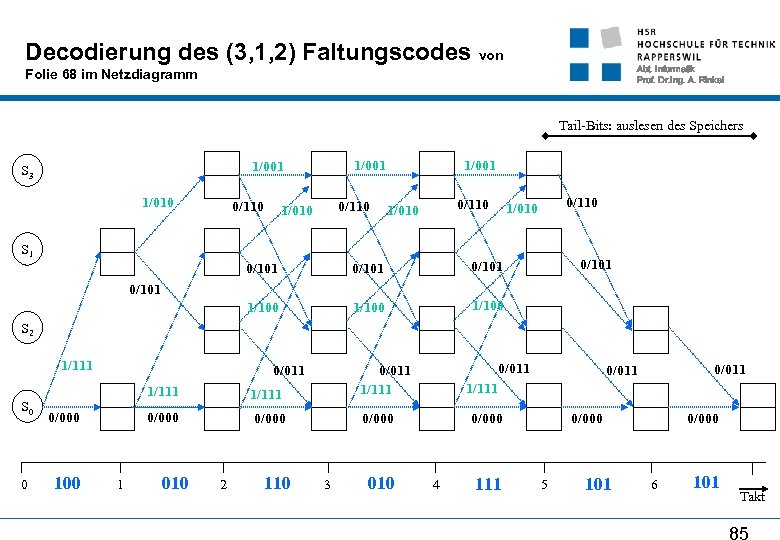

Decodierung des (3, 1, 2) Faltungscodes von Abt. Informatik Prof. Dr. Ing. A. Rinkel Folie 68 im Netzdiagramm Tail-Bits: auslesen des Speichers 1/001 S 3 1/010 0/110 1/001 0/110 1/010 S 1 0/101 1/100 0/110 1/010 1/100 0/101 S 2 1/111 S 0 0 0/011 1/111 0/000 100 1 1/111 0/000 0/011 1/111 0/000 010 2 110 3 010 0/000 4 111 0/011 0/000 5 101 0/000 6 101 Takt 85

Abt. Informatik Prof. Dr. Ing. A. Rinkel ge rä : T ale ion gn at Si rm fo In er rd Keep it simple, as simple as possible but not simpler. <Albert Einstein> 86

Einführung: Abtastung und Quantisierung Abt. Informatik Prof. Dr. Ing. A. Rinkel Übertragungssystem Quellen. Codierer Kanal Codierer Modulator Leitungscodierer Sender Stör. Quelle Senke Quellen. Decoder Kanal Decoder Demodulator Entscheider Kanal Empfänger 87

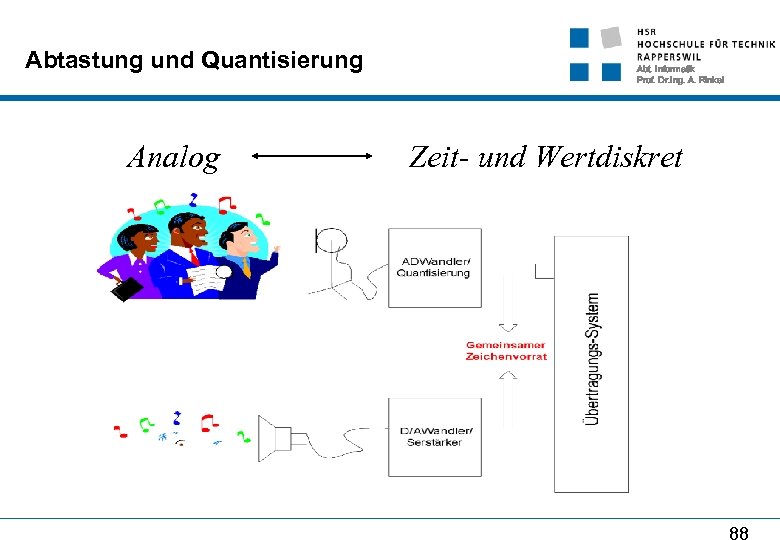

Abtastung und Quantisierung Analog Abt. Informatik Prof. Dr. Ing. A. Rinkel Zeit- und Wertdiskret 88

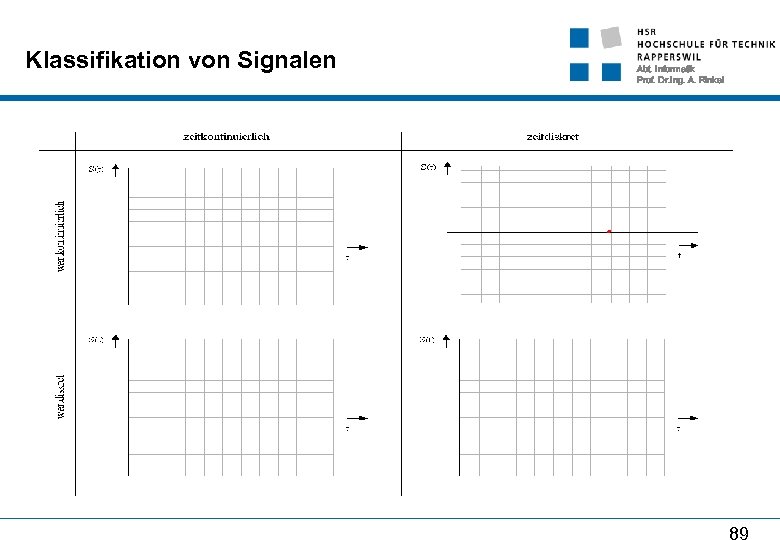

Klassifikation von Signalen Abt. Informatik Prof. Dr. Ing. A. Rinkel 89

Darstellung von Signalen I Abt. Informatik Prof. Dr. Ing. A. Rinkel 90

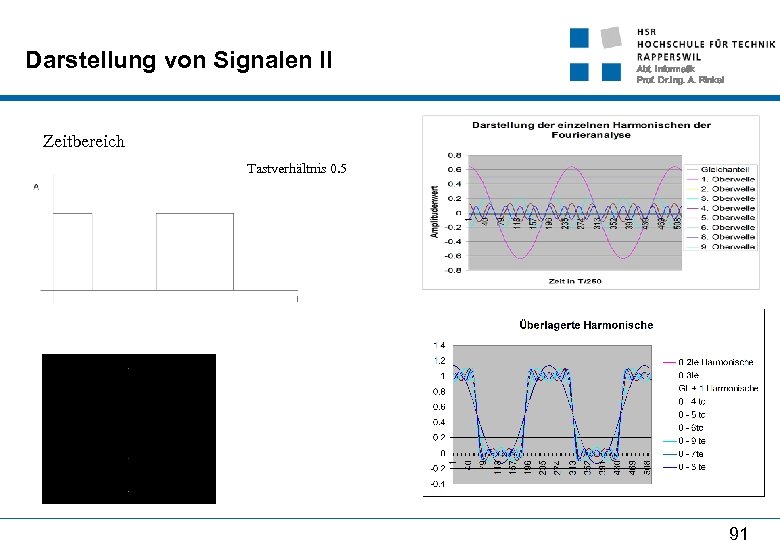

Darstellung von Signalen II Abt. Informatik Prof. Dr. Ing. A. Rinkel Zeitbereich Tastverhältnis 0. 5 91

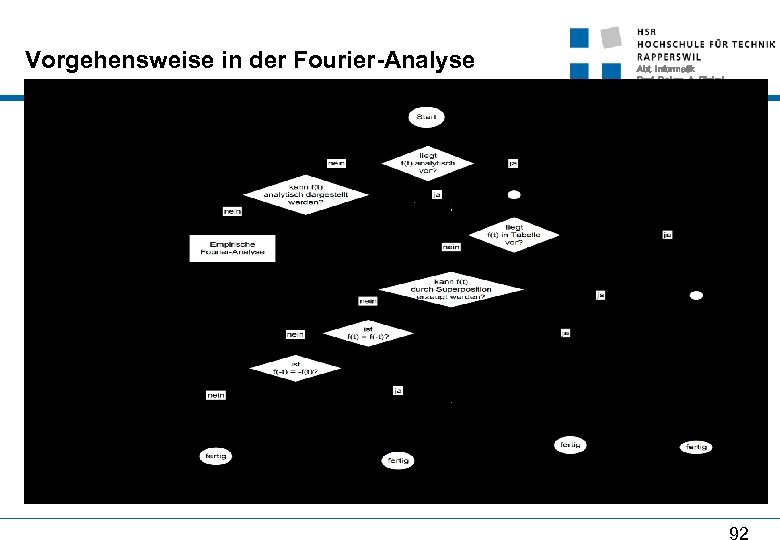

Vorgehensweise in der Fourier-Analyse Abt. Informatik Prof. Dr. Ing. A. Rinkel 92

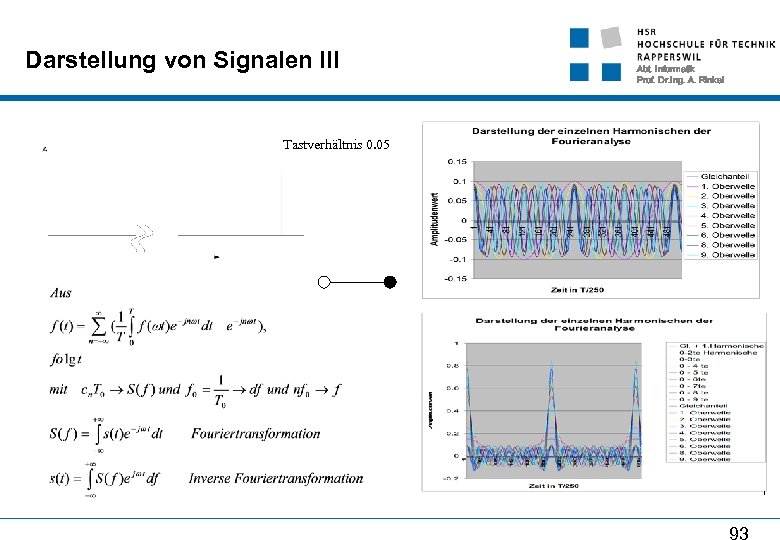

Darstellung von Signalen III Abt. Informatik Prof. Dr. Ing. A. Rinkel Tastverhältnis 0. 05 93

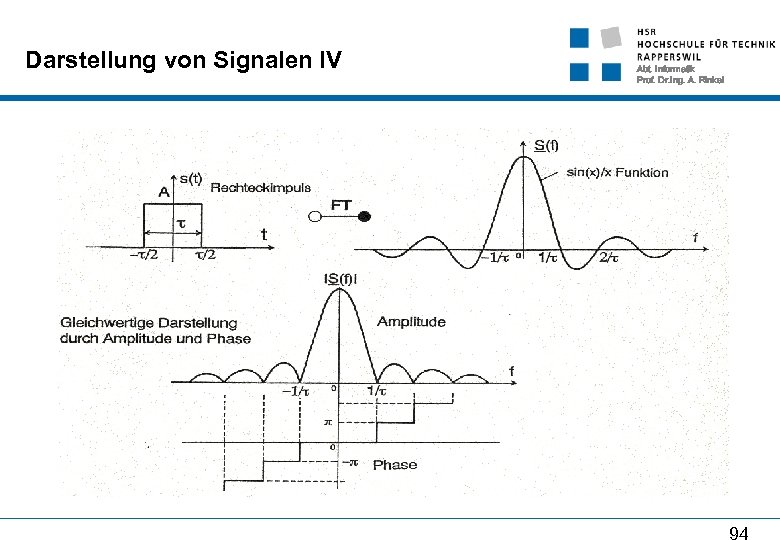

Darstellung von Signalen IV Abt. Informatik Prof. Dr. Ing. A. Rinkel 94

Bearbeitung von Signalen Abt. Informatik Prof. Dr. Ing. A. Rinkel Addition/Subtraktion Multiplikation Verstärkung/Dämpfung Integration/Differentiation Filterung • TP • HP • BP 95

Abt. Informatik Prof. Dr. Ing. A. Rinkel 96

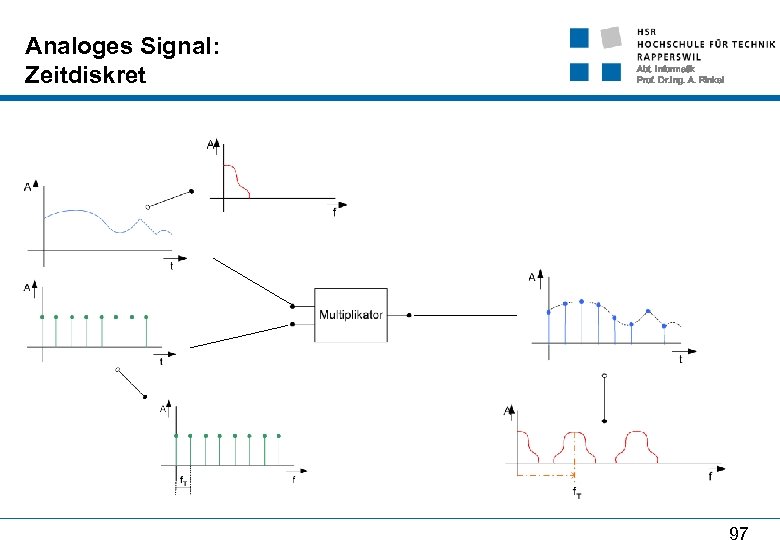

Analoges Signal: Zeitdiskret Abt. Informatik Prof. Dr. Ing. A. Rinkel 97

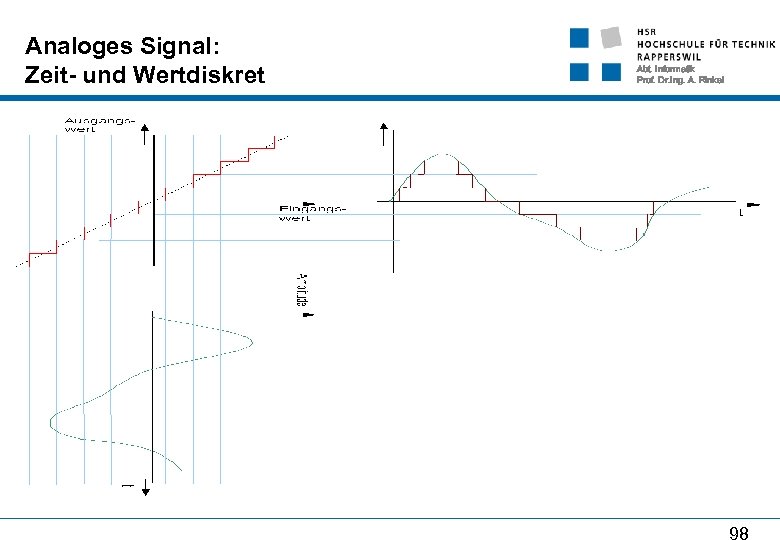

Analoges Signal: Zeit- und Wertdiskret Abt. Informatik Prof. Dr. Ing. A. Rinkel 98

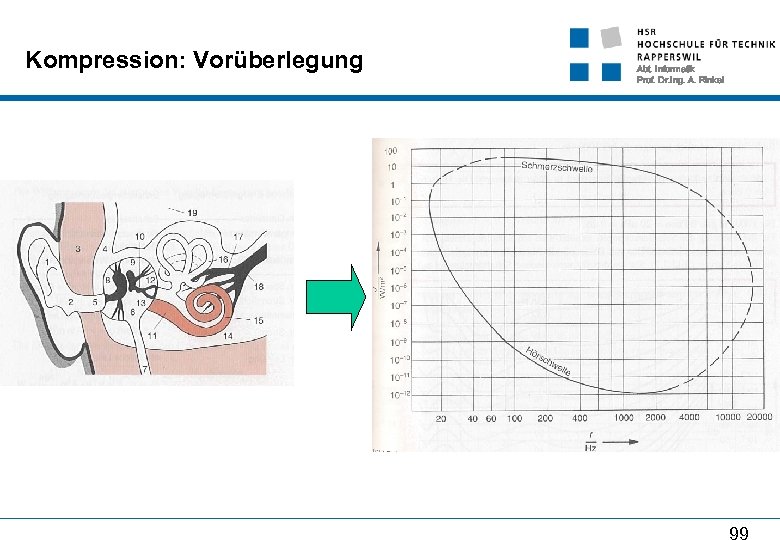

Kompression: Vorüberlegung Abt. Informatik Prof. Dr. Ing. A. Rinkel 99

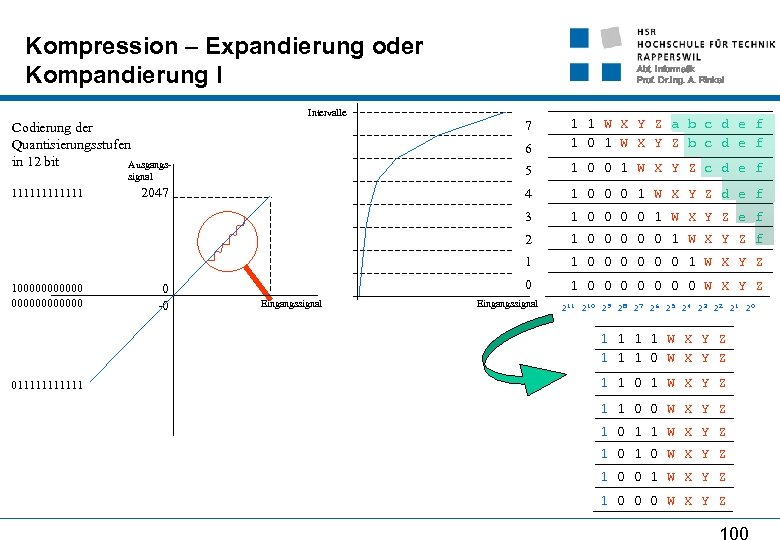

Kompression – Expandierung oder Kompandierung I Intervalle Abt. Informatik Prof. Dr. Ing. A. Rinkel 6 0 -0 1 0 0 0 1 W X Y Z 0 Eingangssignal 1 0 0 0 1 W X Y Z f 1 1000000 1 0 0 1 W X Y Z e f 2 2047 1 0 0 0 1 W X Y Z d e f 3 111111 1 0 0 1 W X Y Z c d e f 4 signal 1 1 W X Y Z a b c d e f 1 0 1 W X Y Z b c d e f 5 Codierung der Quantisierungsstufen in 12 bit Ausgangs- 1 0 0 0 0 W X Y Z 7 Eingangssignal 211 210 29 28 27 26 25 24 23 22 21 20 1 1 W X Y Z 1 1 1 0 W X Y Z 0111111 1 1 0 1 W X Y Z 1 1 0 0 W X Y Z 1 0 1 1 W X Y Z 1 0 0 1 W X Y Z 1 0 0 0 W X Y Z 100

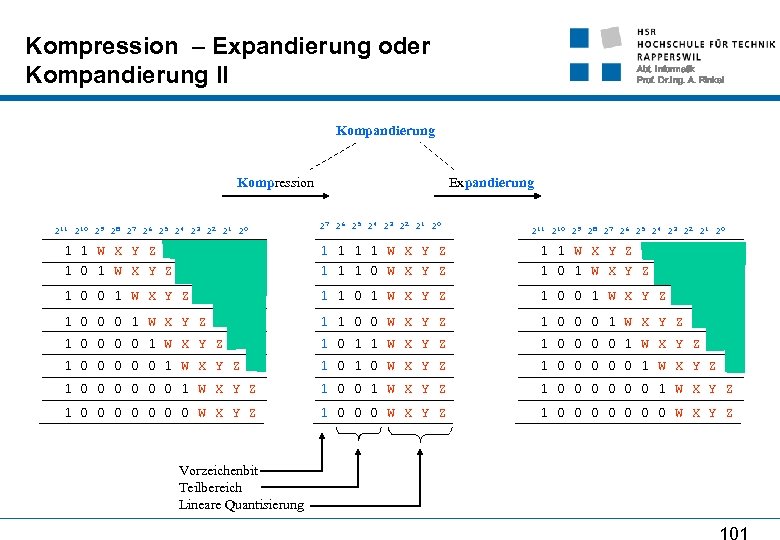

Kompression – Expandierung oder Kompandierung II Abt. Informatik Prof. Dr. Ing. A. Rinkel Kompandierung Kompression 211 210 29 28 27 26 25 24 23 22 21 20 Expandierung 27 26 25 24 23 22 21 20 211 210 29 28 27 26 25 24 23 22 21 20 1 1 W X Y Z 1 0 1 W X Y Z 1 1 1 0 W X Y Z 1 1 W X Y Z 1 0 0 0 1 W X Y Z 1 0 0 1 W X Y Z 1 1 0 1 W X Y Z 1 0 0 0 1 W X Y Z 1 1 0 0 W X Y Z 1 0 0 0 1 W X Y Z 1 0 1 1 W X Y Z 1 0 0 0 0 1 W X Y Z 1 0 1 0 W X Y Z 1 0 0 0 1 W X Y Z 1 0 0 0 0 1 W X Y Z 1 0 0 0 0 0 W X Y Z Vorzeichenbit Teilbereich Lineare Quantisierung 101

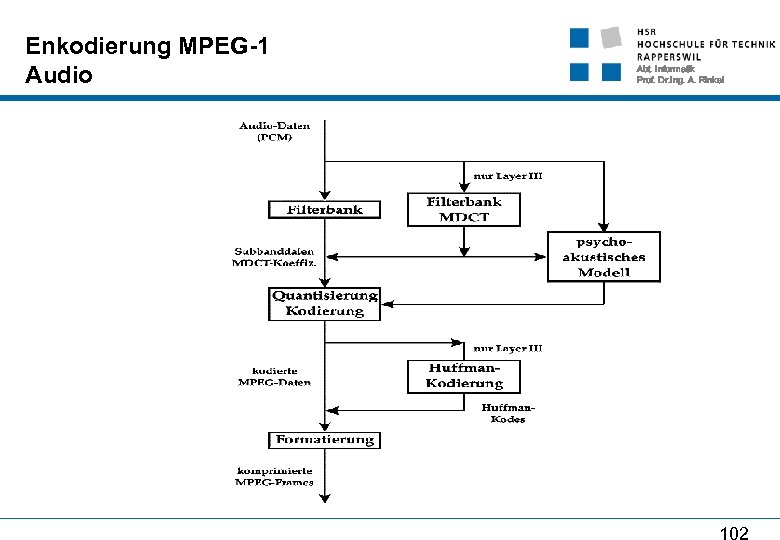

Enkodierung MPEG-1 Audio Abt. Informatik Prof. Dr. Ing. A. Rinkel 102

Hausaufgabe Machen Sie mit einem Mind-Map eine Zusammenfassung des Erlernten und definieren Sie noch offene Fragen für die nächste Veranstaltung! Abt. Informatik Prof. Dr. Ing. A. Rinkel 103

Abt. Informatik Prof. Dr. Ing. A. Rinkel di co gs un eit L ng ru e 104

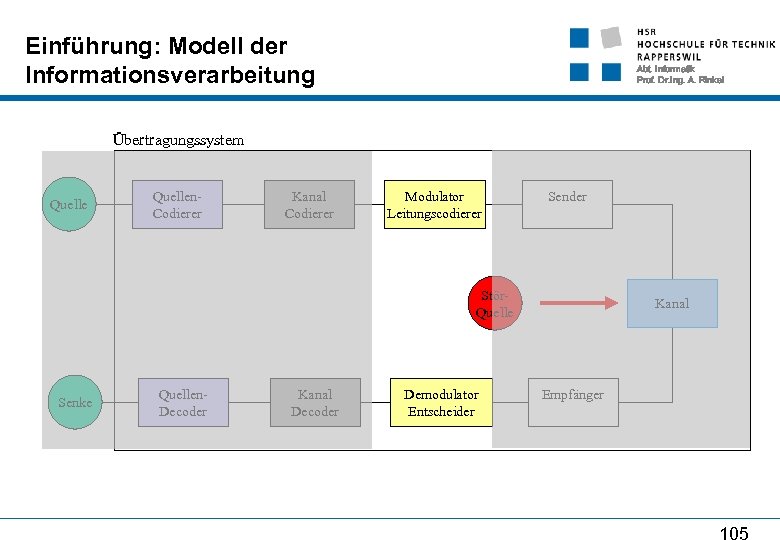

Einführung: Modell der Informationsverarbeitung Abt. Informatik Prof. Dr. Ing. A. Rinkel Übertragungssystem Quellen. Codierer Kanal Codierer Modulator Leitungscodierer Sender Stör. Quelle Senke Quellen. Decoder Kanal Decoder Demodulator Entscheider Kanal Empfänger 105

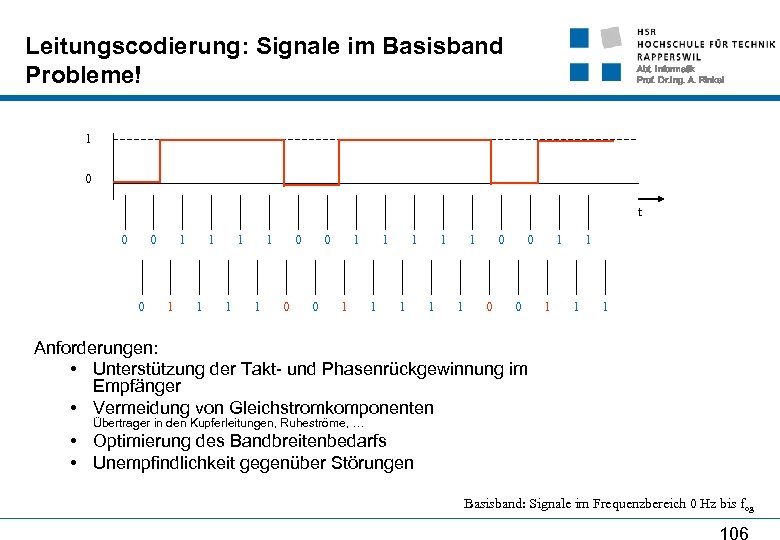

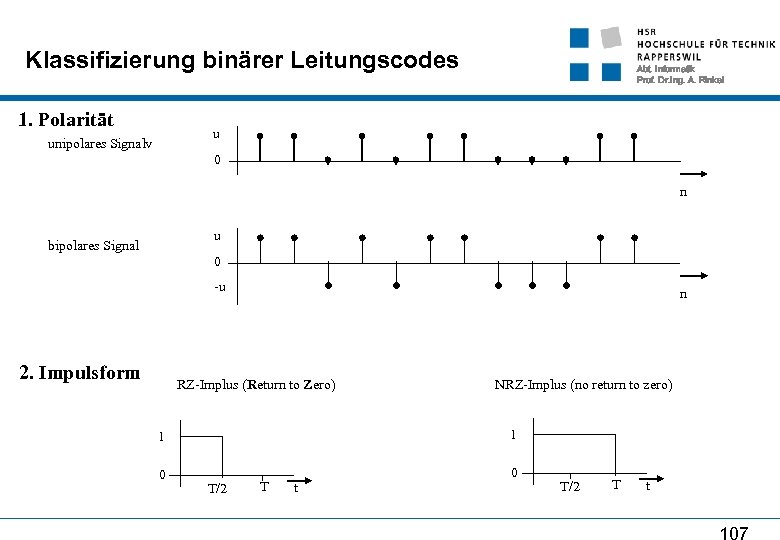

Leitungscodierung: Signale im Basisband Probleme! Abt. Informatik Prof. Dr. Ing. A. Rinkel 1 0 t 0 0 0 1 1 1 1 0 0 0 0 1 1 1 1 1 Anforderungen: • Unterstützung der Takt- und Phasenrückgewinnung im Empfänger • Vermeidung von Gleichstromkomponenten Übertrager in den Kupferleitungen, Ruheströme, … • Optimierung des Bandbreitenbedarfs • Unempfindlichkeit gegenüber Störungen Basisband: Signale im Frequenzbereich 0 Hz bis fog 106

Klassifizierung binärer Leitungscodes 1. Polarität Abt. Informatik Prof. Dr. Ing. A. Rinkel u unipolares Signalv 0 n u bipolares Signal 0 -u 2. Impulsform n RZ-Implus (Return to Zero) 1 1 0 NRZ-Implus (no return to zero) T/2 T t 0 T/2 T t 107

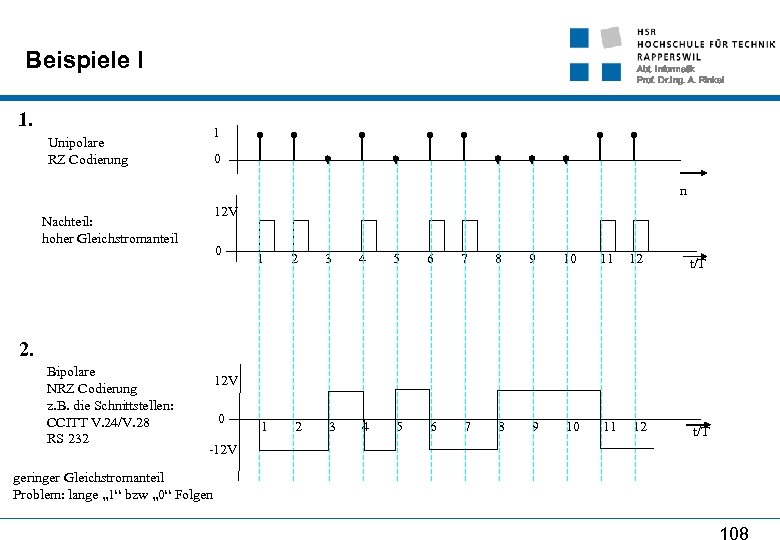

Beispiele I 1. Unipolare RZ Codierung Abt. Informatik Prof. Dr. Ing. A. Rinkel 1 0 n 12 V Nachteil: hoher Gleichstromanteil 0 1 2 3 4 5 6 7 8 9 10 11 12 t/T 2. Bipolare NRZ Codierung z. B. die Schnittstellen: CCITT V. 24/V. 28 RS 232 12 V 0 -12 V geringer Gleichstromanteil Problem: lange „ 1“ bzw „ 0“ Folgen 108

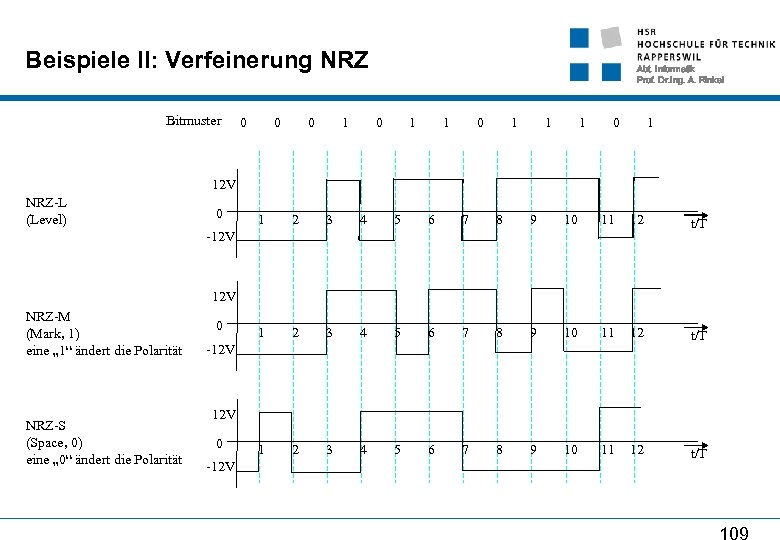

Beispiele II: Verfeinerung NRZ Bitmuster 0 0 0 1 Abt. Informatik Prof. Dr. Ing. A. Rinkel 0 1 1 1 0 1 12 V NRZ-L (Level) 0 1 2 3 4 5 6 7 8 9 10 11 12 t/T -12 V NRZ-M (Mark, 1) eine „ 1“ ändert die Polarität NRZ-S (Space, 0) eine „ 0“ ändert die Polarität 0 -12 V 109

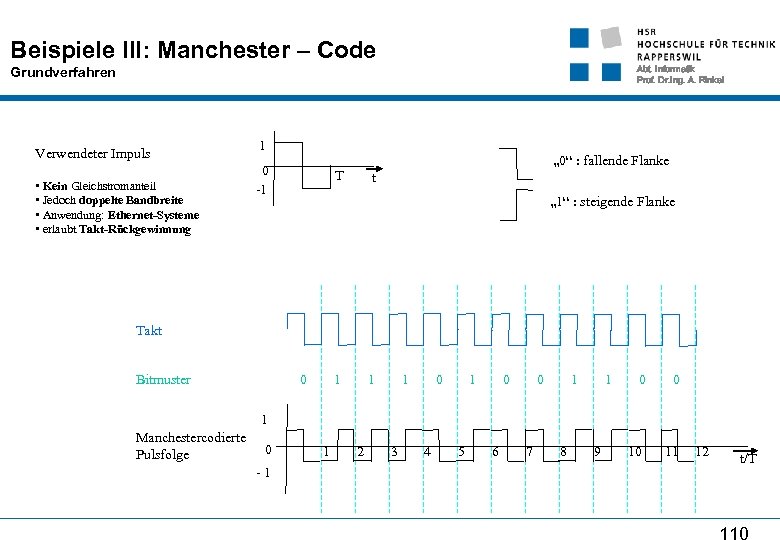

Beispiele III: Manchester – Code Abt. Informatik Prof. Dr. Ing. A. Rinkel Grundverfahren Verwendeter Impuls • Kein Gleichstromanteil • Jedoch doppelte Bandbreite • Anwendung: Ethernet-Systeme • erlaubt Takt-Rückgewinnung 1 0 -1 „ 0“ : fallende Flanke T t „ 1“ : steigende Flanke Takt 0 Bitmuster 1 1 1 0 0 10 11 1 Manchestercodierte Pulsfolge 0 - 1 1 2 3 4 5 6 7 8 9 12 t/T 110

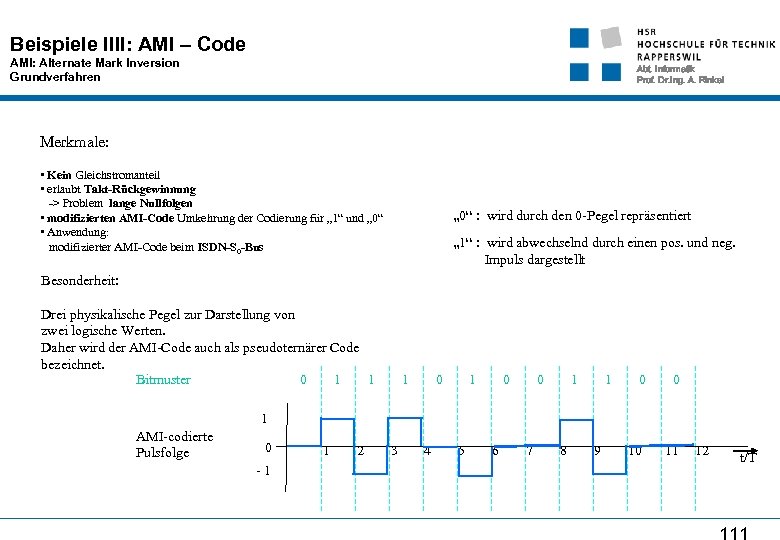

Beispiele IIII: AMI – Code AMI: Alternate Mark Inversion Grundverfahren Abt. Informatik Prof. Dr. Ing. A. Rinkel Merkmale: • Kein Gleichstromanteil • erlaubt Takt-Rückgewinnung -> Problem lange Nullfolgen • modifizierten AMI-Code Umkehrung der Codierung für „ 1“ und „ 0“ • Anwendung: modifizierter AMI-Code beim ISDN-S 0 -Bus „ 0“ : wird durch den 0 -Pegel repräsentiert „ 1“ : wird abwechselnd durch einen pos. und neg. Impuls dargestellt Besonderheit: Drei physikalische Pegel zur Darstellung von zwei logische Werten. Daher wird der AMI-Code auch als pseudoternärer Code bezeichnet. 0 1 1 Bitmuster 1 0 0 10 11 1 AMI-codierte Pulsfolge 0 - 1 1 2 3 4 5 6 7 8 9 12 t/T 111

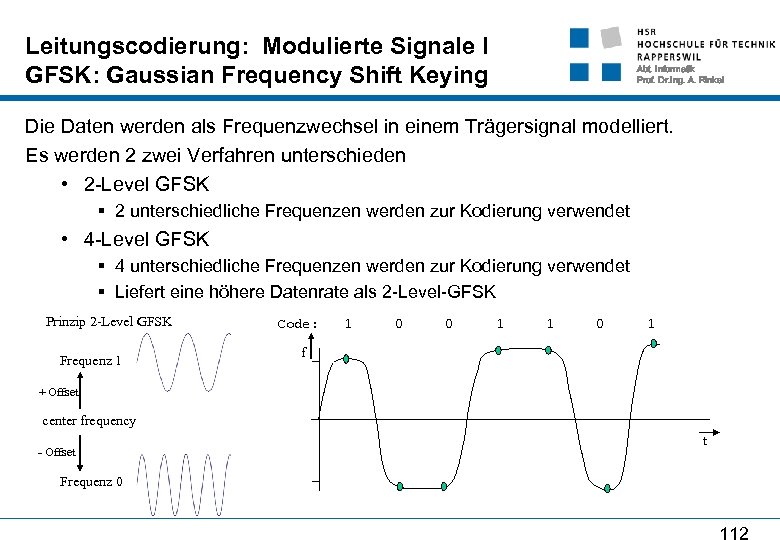

Leitungscodierung: Modulierte Signale I GFSK: Gaussian Frequency Shift Keying Abt. Informatik Prof. Dr. Ing. A. Rinkel Die Daten werden als Frequenzwechsel in einem Trägersignal modelliert. Es werden 2 zwei Verfahren unterschieden • 2 -Level GFSK § 2 unterschiedliche Frequenzen werden zur Kodierung verwendet • 4 -Level GFSK § 4 unterschiedliche Frequenzen werden zur Kodierung verwendet § Liefert eine höhere Datenrate als 2 -Level-GFSK Prinzip 2 -Level GFSK Frequenz 1 Code: 1 0 0 1 1 0 1 f + Offset center frequency - Offset t Frequenz 0 112

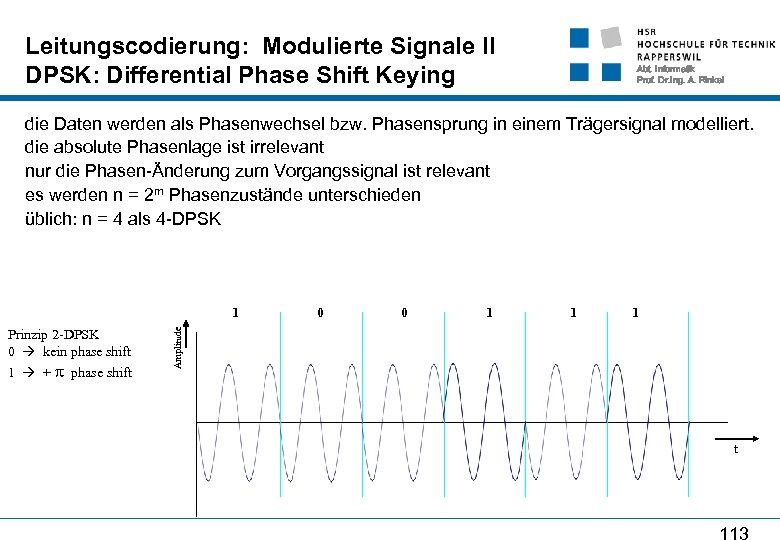

Leitungscodierung: Modulierte Signale II DPSK: Differential Phase Shift Keying Abt. Informatik Prof. Dr. Ing. A. Rinkel die Daten werden als Phasenwechsel bzw. Phasensprung in einem Trägersignal modelliert. die absolute Phasenlage ist irrelevant nur die Phasen-Änderung zum Vorgangssignal ist relevant es werden n = 2 m Phasenzustände unterschieden üblich: n = 4 als 4 -DPSK Prinzip 2 -DPSK 0 à kein phase shift 1 à + p phase shift 0 0 1 1 1 Amplitude 1 t 113

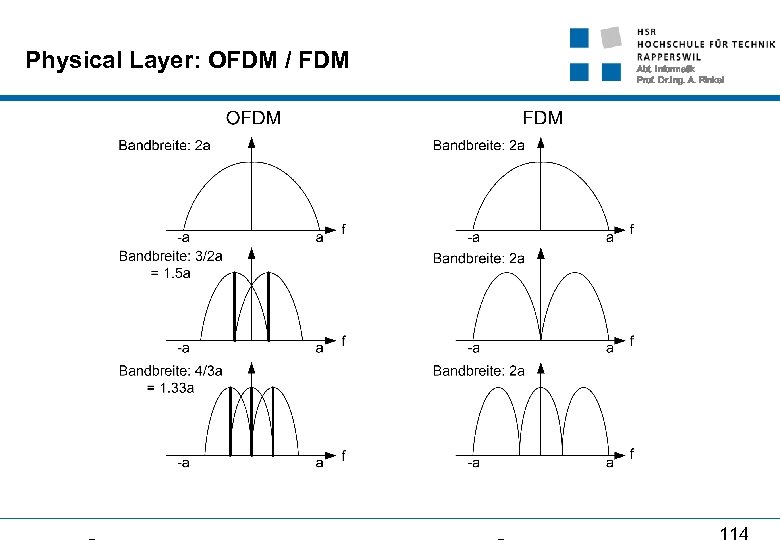

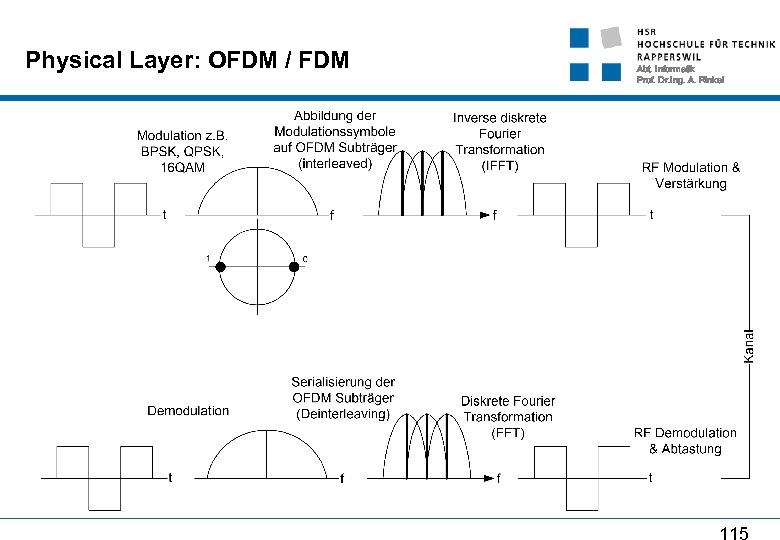

Physical Layer: OFDM / FDM Abt. Informatik Prof. Dr. Ing. A. Rinkel 114

Physical Layer: OFDM / FDM Abt. Informatik Prof. Dr. Ing. A. Rinkel 115

WCDMA (Spread Spectrum) Air Interface Abt. Informatik Prof. Dr. Ing. A. Rinkel Traditional radio communications focussed on the use of narrow band signals – FM radio etc. Spread spectrum works by taking a narrow band signal and using mathematical techniques to diffuse the signal power over a larger range of frequencies. Both the transmitter and receiver agree on the same technique, allowing the receiver to reconstitute the narrow band signal from the diffused signal. Looks like noise to narrow-band receivers Co-patented by Austrian-born actress Hedy Lamarr in 1942 (model for Catwoman in the original Batman comics and the first actress to appear nude on film in a German film, ‘Extasy’, in 1932 116

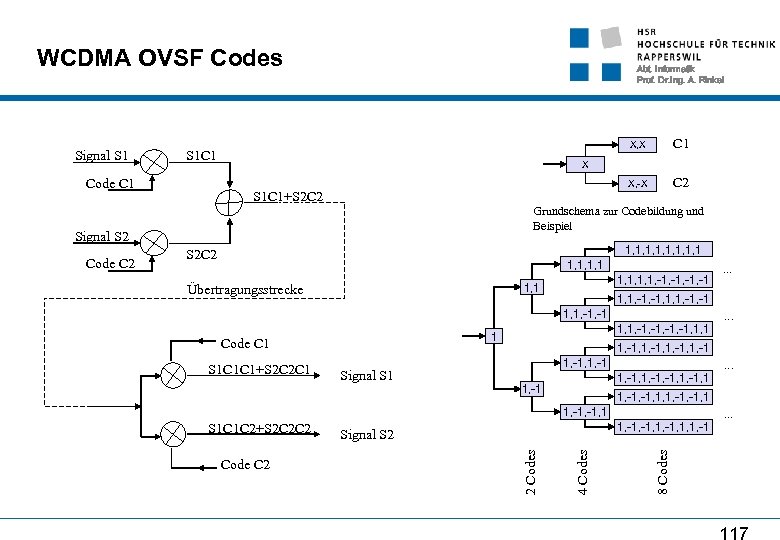

WCDMA OVSF Codes X, X Code C 1 C 2 X S 1 C 1+S 2 C 2 Grundschema zur Codebildung und Beispiel Signal S 2 1, 1, 1 S 2 C 2 1, 1, -1, -1 1, 1 Übertragungsstrecke 1, 1, -1 S 1 C 1 C 1+S 2 C 2 C 1 1, 1, -1, -1, 1, 1 1 Code C 1 Signal S 1 1, -1, -1, 1 1, -1 . . . 1, -1, 1, 1, -1, -1, 1, 1, -1 Signal S 2 . . . 8 Codes Code C 2 . . . 1, -1, 1, -1, -1, 1 S 1 C 1 C 2+S 2 C 2 C 2 . . . 1, 1, -1, 1, 1, -1 4 Codes Code C 2 C 1 X, -X S 1 C 1 2 Codes Signal S 1 Abt. Informatik Prof. Dr. Ing. A. Rinkel 117

WCDMA Interference before / after Despreading Abt. Informatik Prof. Dr. Ing. A. Rinkel 118

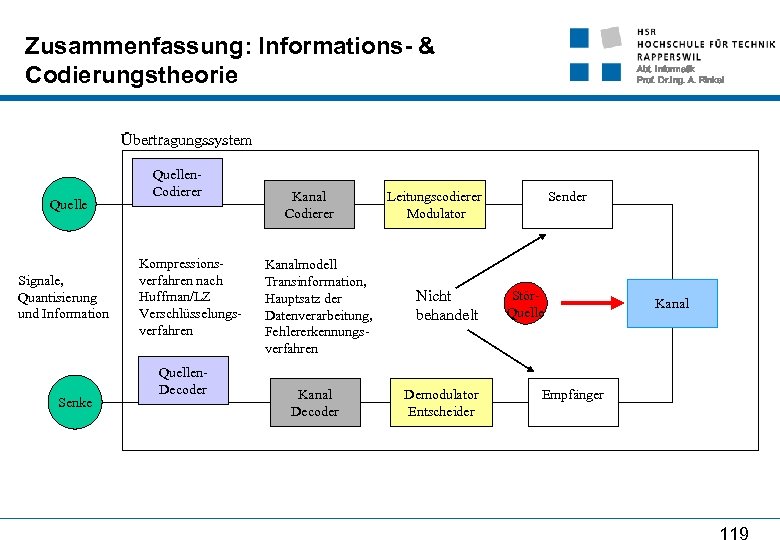

Zusammenfassung: Informations- & Codierungstheorie Abt. Informatik Prof. Dr. Ing. A. Rinkel Übertragungssystem Quelle Signale, Quantisierung und Information Senke Quellen. Codierer Kompressionsverfahren nach Huffman/LZ Verschlüsselungsverfahren Quellen. Decoder Kanal Codierer Kanalmodell Transinformation, Hauptsatz der Datenverarbeitung, Fehlererkennungsverfahren Kanal Decoder Sender Leitungscodierer Modulator Nicht behandelt Demodulator Entscheider Stör. Quelle Kanal Empfänger 119

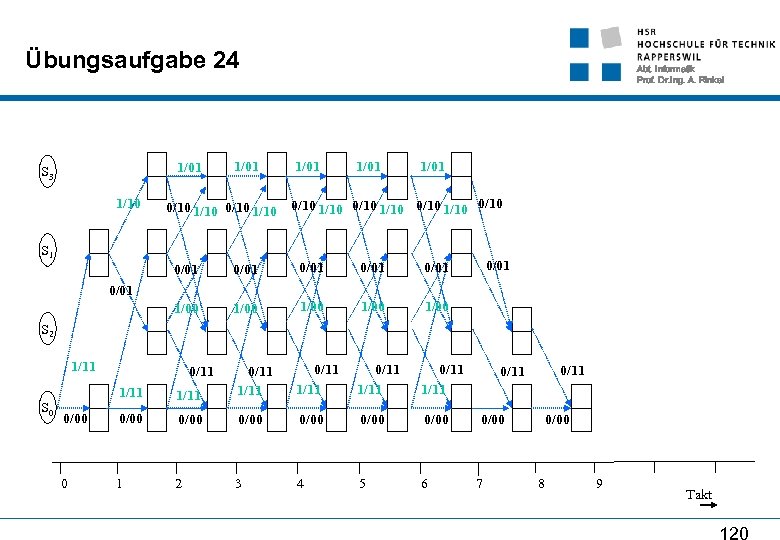

Übungsaufgabe 24 1/01 S 3 1/10 1/01 0/10 1/10 S 1 Abt. Informatik Prof. Dr. Ing. A. Rinkel 1/01 0/10 1/10 0/01 0/01 1/00 1/00 0/11 1/11 0/01 S 2 1/11 S 0 0/11 1/11 0/00 0/00 0 1 2 3 4 5 6 0/11 0/00 7 0/00 8 9 Takt 120

e7f1a5dd8f4c37f1f16a7d70d95f5949.ppt