§ 10. Случайная величина (СВ) и закон ее распределения (з. р. ). Рассмотрим примеры: 1. Бросаем игральную кость. Допустим, на верхней грани выпала « 6» . Это реализация некоторого случайного события и одновременно появление определенного значения , которое может принимать случайная величина – число очков, выпавших на верхней грани. Случайная величина обозначается заглавной буквой Х (если случайных величин несколько, то вводят У, Z и т. д. ); значение, которое принимает случайная величина, обозначается малой буквой х. Пишут Х = х. Это запись означает, что случайная величина приняла некоторое конкретное значение.

§ 10. Случайная величина (СВ) и закон ее распределения (з. р. ). Рассмотрим примеры: 1. Бросаем игральную кость. Допустим, на верхней грани выпала « 6» . Это реализация некоторого случайного события и одновременно появление определенного значения , которое может принимать случайная величина – число очков, выпавших на верхней грани. Случайная величина обозначается заглавной буквой Х (если случайных величин несколько, то вводят У, Z и т. д. ); значение, которое принимает случайная величина, обозначается малой буквой х. Пишут Х = х. Это запись означает, что случайная величина приняла некоторое конкретное значение.

2. Бросаем случайным образом точку на отрезок длины 1 метр и измеряем расстояние от левого конца до этой точки. Допустим, получили Х = 0. 22 метра. Ясно, что в данном эксперименте случайная величина, равная расстоянию от левого конца отрезка до места расположения точки, может принять любое действительное значение от 0 до 1. 1 метр О ОА =0. 22 м Мы рассмотрели тем самым два типа случайных величин – - дискретную случайную величину и непрерывную случайную величину.

2. Бросаем случайным образом точку на отрезок длины 1 метр и измеряем расстояние от левого конца до этой точки. Допустим, получили Х = 0. 22 метра. Ясно, что в данном эксперименте случайная величина, равная расстоянию от левого конца отрезка до места расположения точки, может принять любое действительное значение от 0 до 1. 1 метр О ОА =0. 22 м Мы рассмотрели тем самым два типа случайных величин – - дискретную случайную величину и непрерывную случайную величину.

Итак, дискретная случайная величина принимает отдельные изолированные значения, причем этих значений может быть конечное и даже бесконечное количество. Эти значения возникают с определенными конечными вероятностями (пример 1). Непрерывная случайная величина принимает значения, сплошь заполняющие отрезок на числовой оси. Говорят, что непрерывная случайная величина может принимать все значения из некоторого конечного и даже бесконечного промежутка (пример 2). Примеры: 1. Число бракованных изделий в партии из 100 одинаковых деталей, взятых на контроль, – это дискретная случайная величина. 2. Напряжение в бытовой электрической сети (напряжение колеблется вблизи значения 220 вольт) – это непрерывная случайная величина.

Итак, дискретная случайная величина принимает отдельные изолированные значения, причем этих значений может быть конечное и даже бесконечное количество. Эти значения возникают с определенными конечными вероятностями (пример 1). Непрерывная случайная величина принимает значения, сплошь заполняющие отрезок на числовой оси. Говорят, что непрерывная случайная величина может принимать все значения из некоторого конечного и даже бесконечного промежутка (пример 2). Примеры: 1. Число бракованных изделий в партии из 100 одинаковых деталей, взятых на контроль, – это дискретная случайная величина. 2. Напряжение в бытовой электрической сети (напряжение колеблется вблизи значения 220 вольт) – это непрерывная случайная величина.

Строгое определение СВ: Случайной величиной называется числовая функция , заданная на пространстве элементарных исходов случайного эксперимента (т. е. для каждого значения задается определенное значение Х). Следует отметить, что и вероятность является числовой функцией, заданной на пространстве элементарных исходов случайного эксперимента, т. е. Закон распределения случайной величины – это правило, устанавливающее связь между возможными значениями случайной величины и соответствующими им вероятностями.

Строгое определение СВ: Случайной величиной называется числовая функция , заданная на пространстве элементарных исходов случайного эксперимента (т. е. для каждого значения задается определенное значение Х). Следует отметить, что и вероятность является числовой функцией, заданной на пространстве элементарных исходов случайного эксперимента, т. е. Закон распределения случайной величины – это правило, устанавливающее связь между возможными значениями случайной величины и соответствующими им вероятностями.

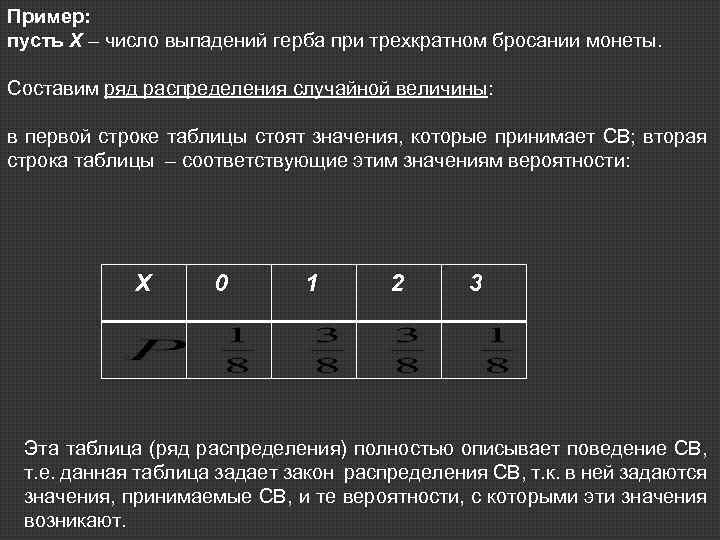

Пример: пусть Х – число выпадений герба при трехкратном бросании монеты. Составим ряд распределения случайной величины: в первой строке таблицы стоят значения, которые принимает СВ; вторая строка таблицы – соответствующие этим значениям вероятности: Х 0 1 2 3 Эта таблица (ряд распределения) полностью описывает поведение СВ, т. е. данная таблица задает закон распределения СВ, т. к. в ней задаются значения, принимаемые СВ, и те вероятности, с которыми эти значения возникают.

Пример: пусть Х – число выпадений герба при трехкратном бросании монеты. Составим ряд распределения случайной величины: в первой строке таблицы стоят значения, которые принимает СВ; вторая строка таблицы – соответствующие этим значениям вероятности: Х 0 1 2 3 Эта таблица (ряд распределения) полностью описывает поведение СВ, т. е. данная таблица задает закон распределения СВ, т. к. в ней задаются значения, принимаемые СВ, и те вероятности, с которыми эти значения возникают.

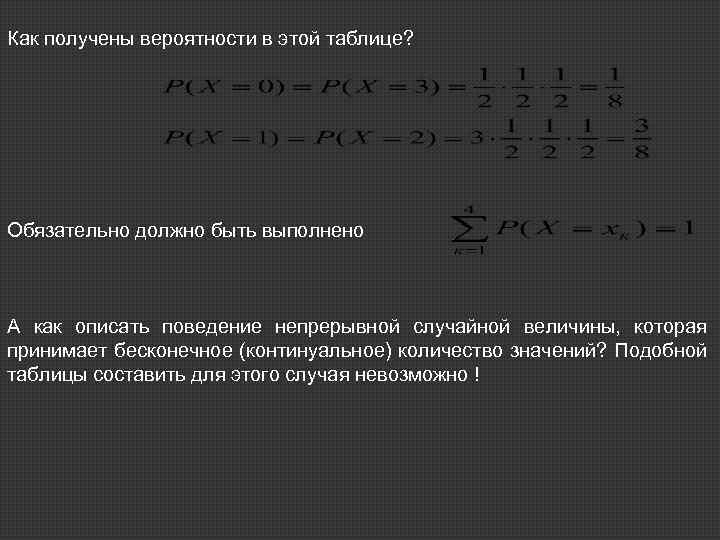

Как получены вероятности в этой таблице? Обязательно должно быть выполнено А как описать поведение непрерывной случайной величины, которая принимает бесконечное (континуальное) количество значений? Подобной таблицы составить для этого случая невозможно !

Как получены вероятности в этой таблице? Обязательно должно быть выполнено А как описать поведение непрерывной случайной величины, которая принимает бесконечное (континуальное) количество значений? Подобной таблицы составить для этого случая невозможно !

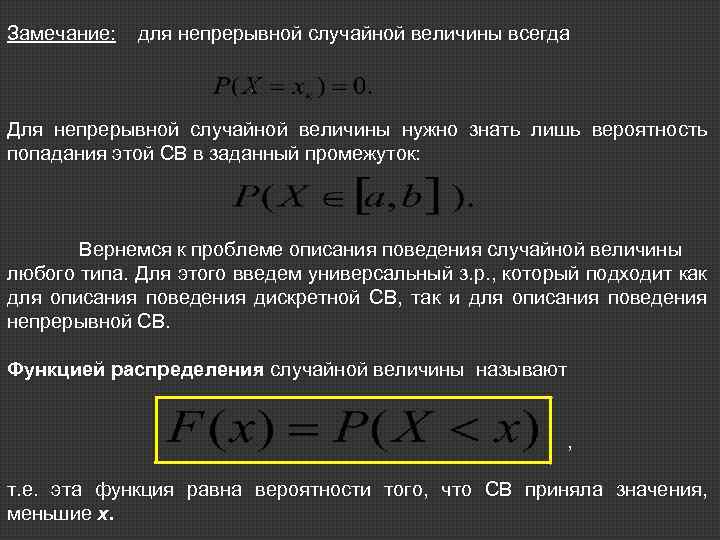

Замечание: для непрерывной случайной величины всегда Для непрерывной случайной величины нужно знать лишь вероятность попадания этой СВ в заданный промежуток: Вернемся к проблеме описания поведения случайной величины любого типа. Для этого введем универсальный з. р. , который подходит как для описания поведения дискретной СВ, так и для описания поведения непрерывной СВ. Функцией распределения случайной величины называют , т. е. эта функция равна вероятности того, что СВ приняла значения, меньшие х.

Замечание: для непрерывной случайной величины всегда Для непрерывной случайной величины нужно знать лишь вероятность попадания этой СВ в заданный промежуток: Вернемся к проблеме описания поведения случайной величины любого типа. Для этого введем универсальный з. р. , который подходит как для описания поведения дискретной СВ, так и для описания поведения непрерывной СВ. Функцией распределения случайной величины называют , т. е. эта функция равна вероятности того, что СВ приняла значения, меньшие х.

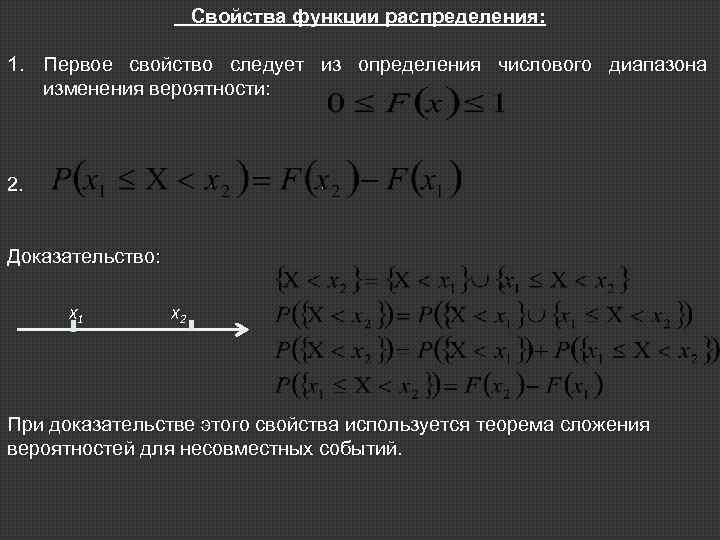

Свойства функции распределения: 1. Первое свойство следует из определения числового диапазона изменения вероятности: 2. Доказательство: Х 1 Х 2 При доказательстве этого свойства используется теорема сложения вероятностей для несовместных событий.

Свойства функции распределения: 1. Первое свойство следует из определения числового диапазона изменения вероятности: 2. Доказательство: Х 1 Х 2 При доказательстве этого свойства используется теорема сложения вероятностей для несовместных событий.

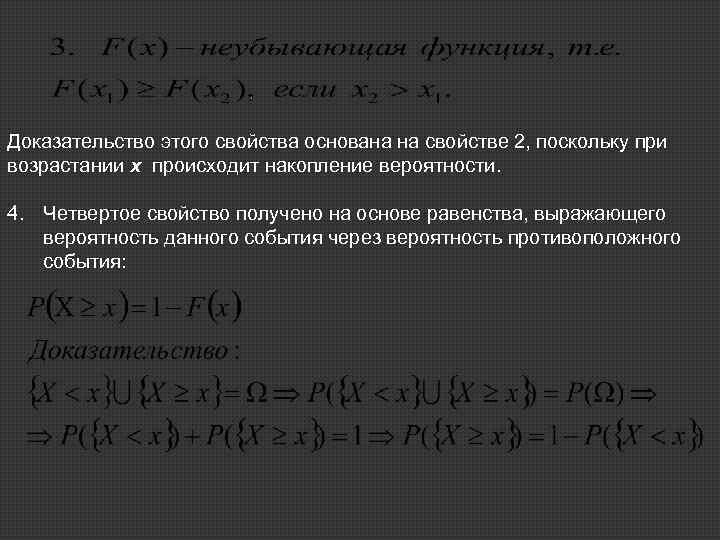

Доказательство этого свойства основана на свойстве 2, поскольку при возрастании х происходит накопление вероятности. 4. Четвертое свойство получено на основе равенства, выражающего вероятность данного события через вероятность противоположного события:

Доказательство этого свойства основана на свойстве 2, поскольку при возрастании х происходит накопление вероятности. 4. Четвертое свойство получено на основе равенства, выражающего вероятность данного события через вероятность противоположного события:

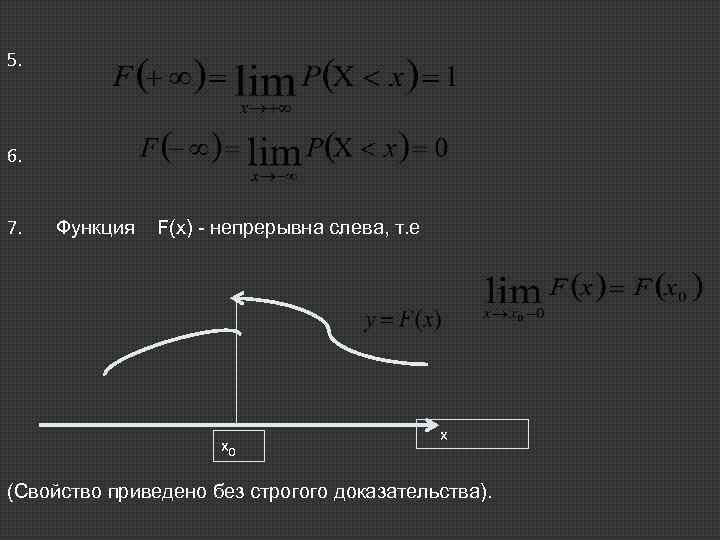

5. 6. 7. Функция F(x) - непрерывна слева, т. е х0 х (Свойство приведено без строгого доказательства).

5. 6. 7. Функция F(x) - непрерывна слева, т. е х0 х (Свойство приведено без строгого доказательства).

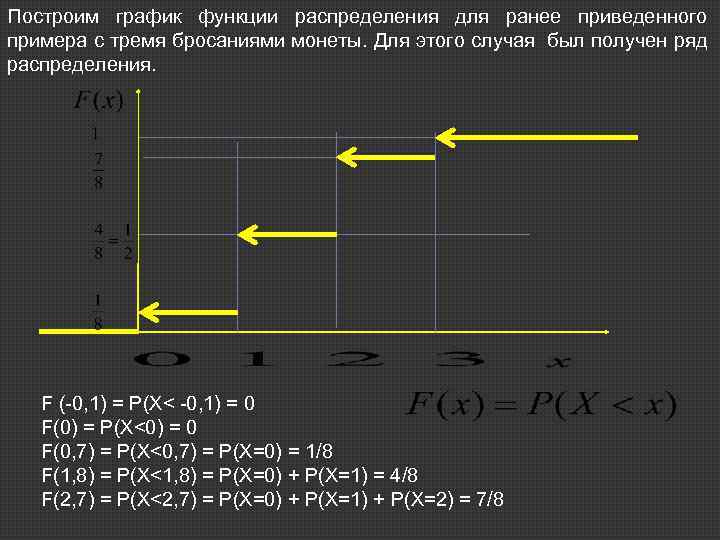

Построим график функции распределения для ранее приведенного примера с тремя бросаниями монеты. Для этого случая был получен ряд распределения. F (-0, 1) = P(X< -0, 1) = 0 F(0) = P(X<0) = 0 F(0, 7) = P(X<0, 7) = P(X=0) = 1/8 F(1, 8) = P(X<1, 8) = P(X=0) + P(X=1) = 4/8 F(2, 7) = P(X<2, 7) = P(X=0) + P(X=1) + P(X=2) = 7/8

Построим график функции распределения для ранее приведенного примера с тремя бросаниями монеты. Для этого случая был получен ряд распределения. F (-0, 1) = P(X< -0, 1) = 0 F(0) = P(X<0) = 0 F(0, 7) = P(X<0, 7) = P(X=0) = 1/8 F(1, 8) = P(X<1, 8) = P(X=0) + P(X=1) = 4/8 F(2, 7) = P(X<2, 7) = P(X=0) + P(X=1) + P(X=2) = 7/8

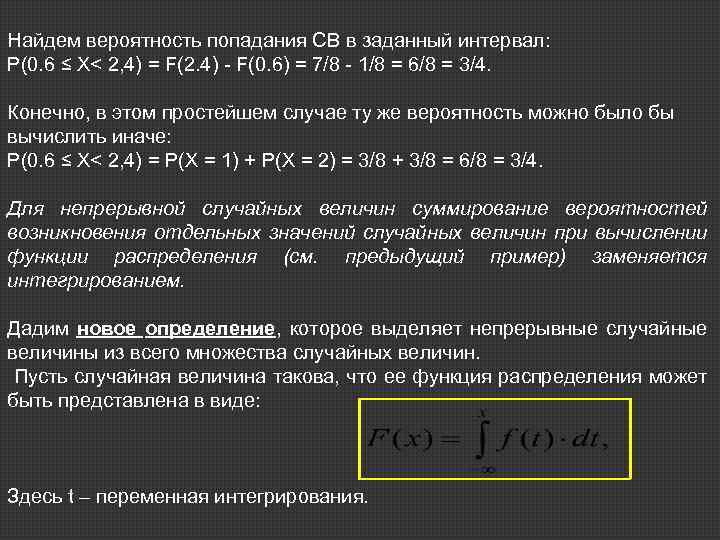

Найдем вероятность попадания СВ в заданный интервал: P(0. 6 ≤ X< 2, 4) = F(2. 4) - F(0. 6) = 7/8 - 1/8 = 6/8 = 3/4. Конечно, в этом простейшем случае ту же вероятность можно было бы вычислить иначе: P(0. 6 ≤ X< 2, 4) = P(X = 1) + P(X = 2) = 3/8 + 3/8 = 6/8 = 3/4. Для непрерывной случайных величин суммирование вероятностей возникновения отдельных значений случайных величин при вычислении функции распределения (см. предыдущий пример) заменяется интегрированием. Дадим новое определение, которое выделяет непрерывные случайные величины из всего множества случайных величин. Пусть случайная величина такова, что ее функция распределения может быть представлена в виде: Здесь t – переменная интегрирования.

Найдем вероятность попадания СВ в заданный интервал: P(0. 6 ≤ X< 2, 4) = F(2. 4) - F(0. 6) = 7/8 - 1/8 = 6/8 = 3/4. Конечно, в этом простейшем случае ту же вероятность можно было бы вычислить иначе: P(0. 6 ≤ X< 2, 4) = P(X = 1) + P(X = 2) = 3/8 + 3/8 = 6/8 = 3/4. Для непрерывной случайных величин суммирование вероятностей возникновения отдельных значений случайных величин при вычислении функции распределения (см. предыдущий пример) заменяется интегрированием. Дадим новое определение, которое выделяет непрерывные случайные величины из всего множества случайных величин. Пусть случайная величина такова, что ее функция распределения может быть представлена в виде: Здесь t – переменная интегрирования.

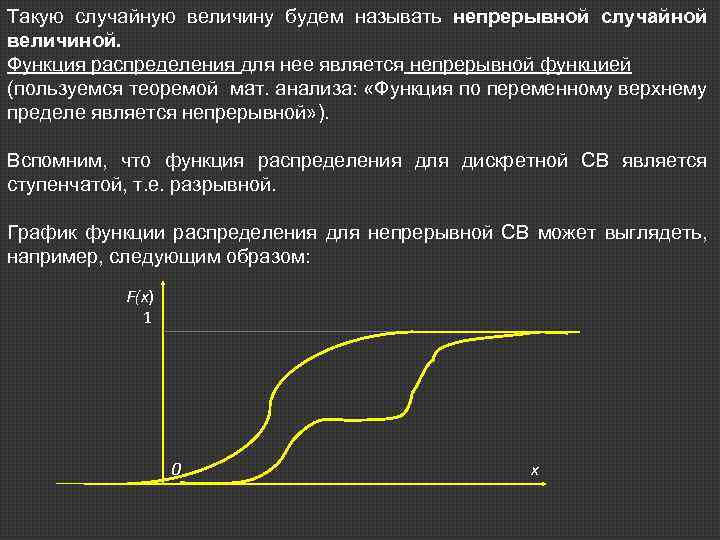

Такую случайную величину будем называть непрерывной случайной величиной. Функция распределения для нее является непрерывной функцией (пользуемся теоремой мат. анализа: «Функция по переменному верхнему пределе является непрерывной» ). Вспомним, что функция распределения для дискретной СВ является ступенчатой, т. е. разрывной. График функции распределения для непрерывной СВ может выглядеть, например, следующим образом: F(x) 1 0 x

Такую случайную величину будем называть непрерывной случайной величиной. Функция распределения для нее является непрерывной функцией (пользуемся теоремой мат. анализа: «Функция по переменному верхнему пределе является непрерывной» ). Вспомним, что функция распределения для дискретной СВ является ступенчатой, т. е. разрывной. График функции распределения для непрерывной СВ может выглядеть, например, следующим образом: F(x) 1 0 x

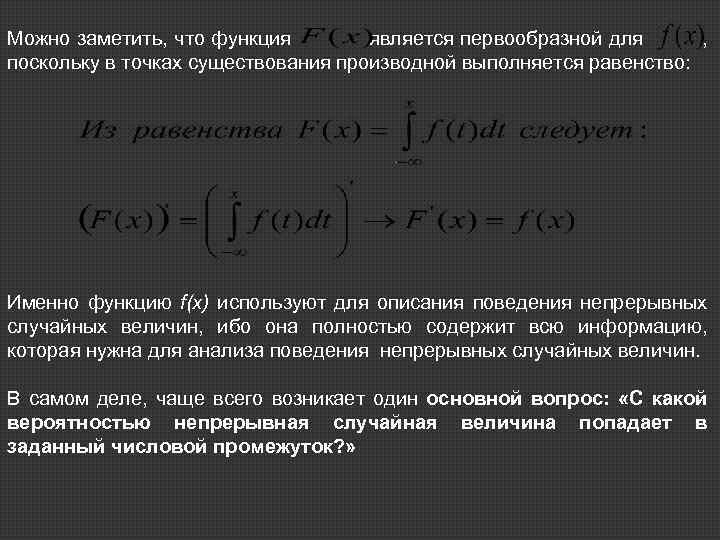

Можно заметить, что функция является первообразной для , поскольку в точках существования производной выполняется равенство: Именно функцию f(x) используют для описания поведения непрерывных случайных величин, ибо она полностью содержит всю информацию, которая нужна для анализа поведения непрерывных случайных величин. В самом деле, чаще всего возникает один основной вопрос: «С какой вероятностью непрерывная случайная величина попадает в заданный числовой промежуток? »

Можно заметить, что функция является первообразной для , поскольку в точках существования производной выполняется равенство: Именно функцию f(x) используют для описания поведения непрерывных случайных величин, ибо она полностью содержит всю информацию, которая нужна для анализа поведения непрерывных случайных величин. В самом деле, чаще всего возникает один основной вопрос: «С какой вероятностью непрерывная случайная величина попадает в заданный числовой промежуток? »

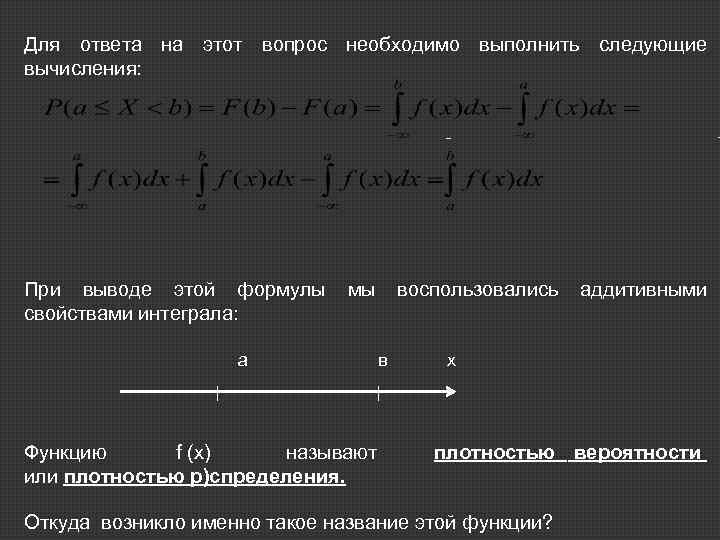

Для ответа на этот вопрос необходимо выполнить следующие вычисления: При выводе этой формулы свойствами интеграла: мы а Функцию f (x) называют или плотностью р)спределения. воспользовались в аддитивными х плотностью вероятности Откуда возникло именно такое название этой функции?

Для ответа на этот вопрос необходимо выполнить следующие вычисления: При выводе этой формулы свойствами интеграла: мы а Функцию f (x) называют или плотностью р)спределения. воспользовались в аддитивными х плотностью вероятности Откуда возникло именно такое название этой функции?

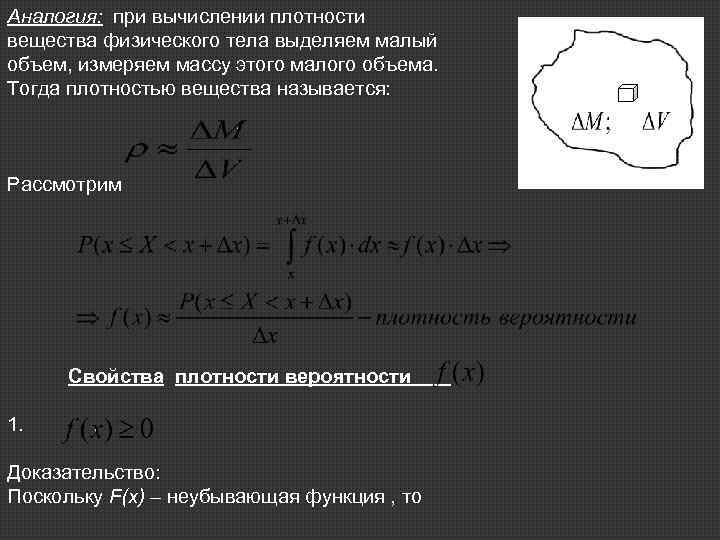

Аналогия: при вычислении плотности вещества физического тела выделяем малый объем, измеряем массу этого малого объема. Тогда плотностью вещества называется: Рассмотрим Свойства плотности вероятности 1. Доказательство: Поскольку F(x) – неубывающая функция , то

Аналогия: при вычислении плотности вещества физического тела выделяем малый объем, измеряем массу этого малого объема. Тогда плотностью вещества называется: Рассмотрим Свойства плотности вероятности 1. Доказательство: Поскольку F(x) – неубывающая функция , то

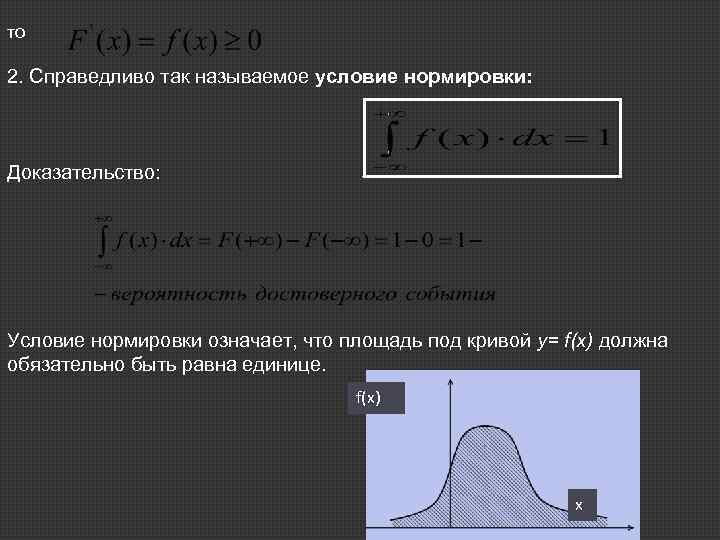

то 2. Справедливо так называемое условие нормировки: Доказательство: Условие нормировки означает, что площадь под кривой y= f(x) должна обязательно быть равна единице. f(x) x

то 2. Справедливо так называемое условие нормировки: Доказательство: Условие нормировки означает, что площадь под кривой y= f(x) должна обязательно быть равна единице. f(x) x

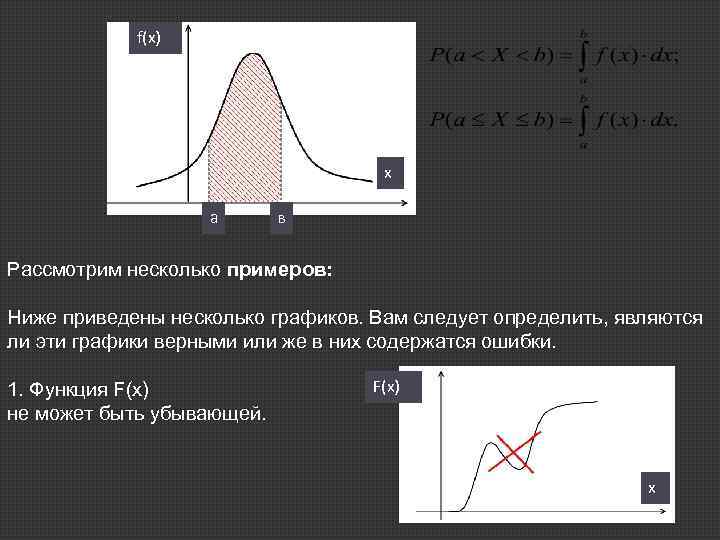

f(x) x а в Рассмотрим несколько примеров: Ниже приведены несколько графиков. Вам следует определить, являются ли эти графики верными или же в них содержатся ошибки. 1. Функция F(x) не может быть убывающей. F(x) x

f(x) x а в Рассмотрим несколько примеров: Ниже приведены несколько графиков. Вам следует определить, являются ли эти графики верными или же в них содержатся ошибки. 1. Функция F(x) не может быть убывающей. F(x) x

2. Функция f(x) не может быть отрицательной. f(x) x 3. Функция f(x) может иметь такой вид, поскольку выполняется условие нормировки – площадь под кривой равна единице. f(x) 1 x 0 1 2

2. Функция f(x) не может быть отрицательной. f(x) x 3. Функция f(x) может иметь такой вид, поскольку выполняется условие нормировки – площадь под кривой равна единице. f(x) 1 x 0 1 2

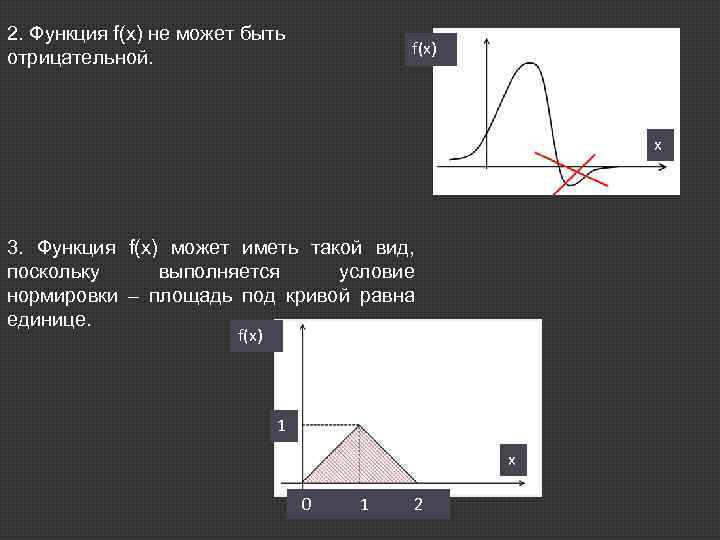

4. Функция f(x) может принимать значение, превосходящее единицу, если площадь под кривой равна единице. f(x) 5 x

4. Функция f(x) может принимать значение, превосходящее единицу, если площадь под кривой равна единице. f(x) 5 x

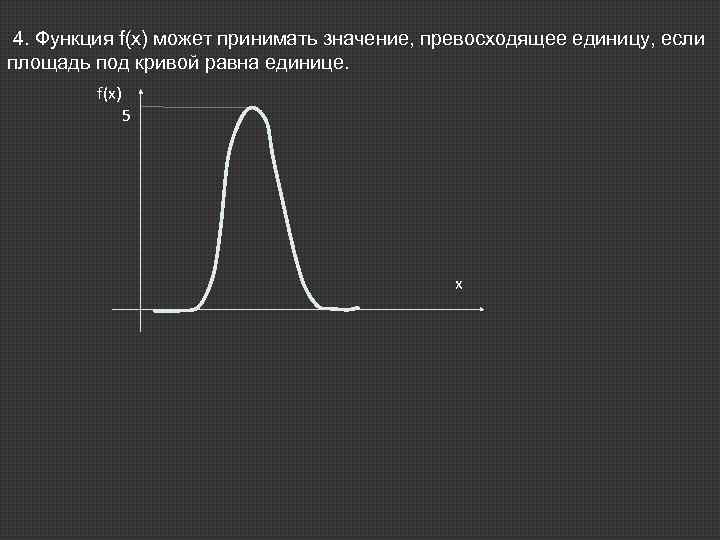

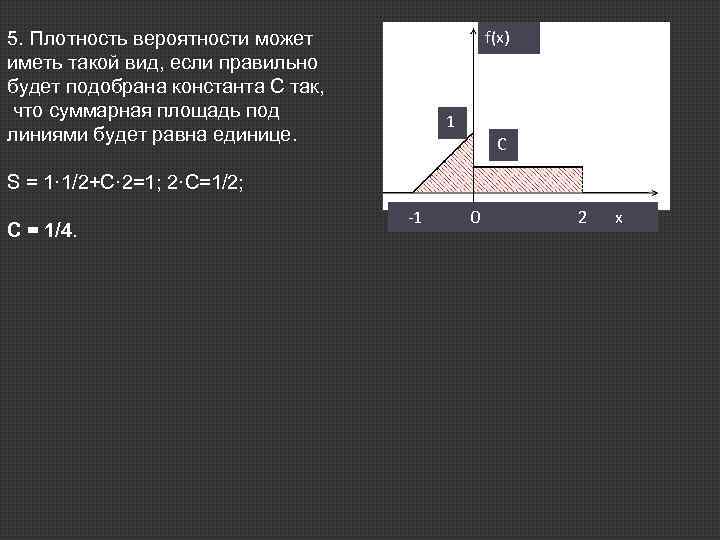

f(x) 5. Плотность вероятности может иметь такой вид, если правильно будет подобрана константа С так, что суммарная площадь под линиями будет равна единице. 1 C S = 1· 1/2+C· 2=1; 2·С=1/2; C = 1/4. -1 0 2 х

f(x) 5. Плотность вероятности может иметь такой вид, если правильно будет подобрана константа С так, что суммарная площадь под линиями будет равна единице. 1 C S = 1· 1/2+C· 2=1; 2·С=1/2; C = 1/4. -1 0 2 х

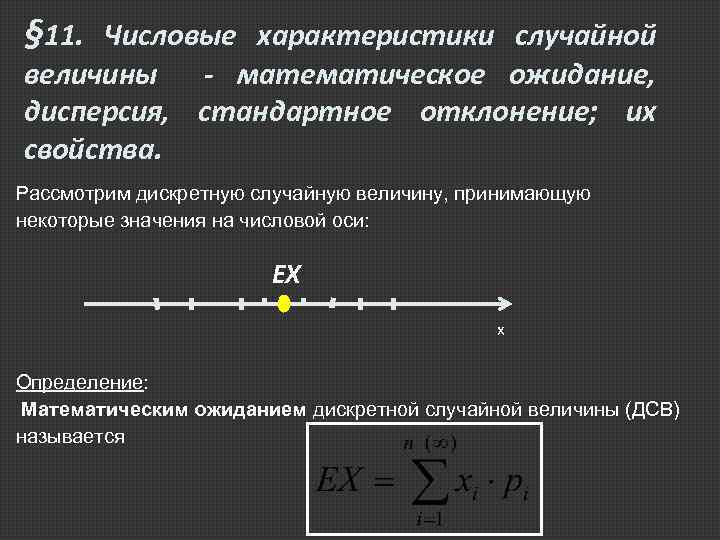

§ 11. Числовые характеристики случайной величины - математическое ожидание, дисперсия, стандартное отклонение; их свойства. Рассмотрим дискретную случайную величину, принимающую некоторые значения на числовой оси: ЕХ x Определение: Математическим ожиданием дискретной случайной величины (ДСВ) называется

§ 11. Числовые характеристики случайной величины - математическое ожидание, дисперсия, стандартное отклонение; их свойства. Рассмотрим дискретную случайную величину, принимающую некоторые значения на числовой оси: ЕХ x Определение: Математическим ожиданием дискретной случайной величины (ДСВ) называется

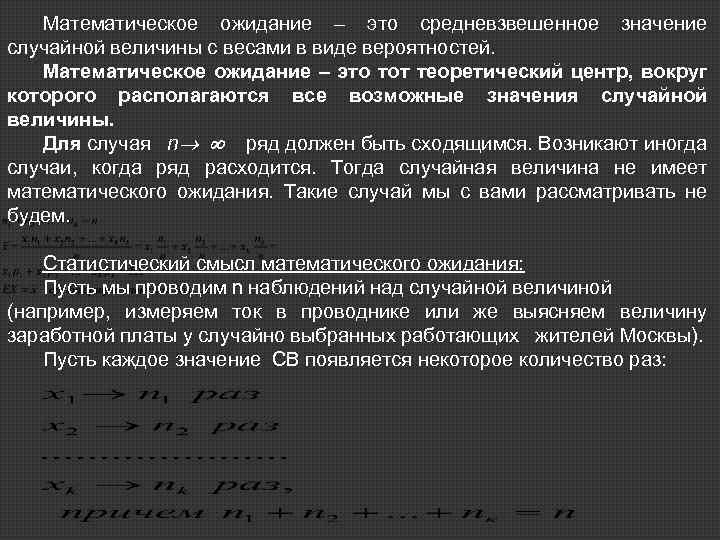

Математическое ожидание – это средневзвешенное значение случайной величины с весами в виде вероятностей. Математическое ожидание – это тот теоретический центр, вокруг которого располагаются все возможные значения случайной величины. Для случая n ряд должен быть сходящимся. Возникают иногда случаи, когда ряд расходится. Тогда случайная величина не имеет математического ожидания. Такие случай мы с вами рассматривать не будем. Статистический смысл математического ожидания: Пусть мы проводим n наблюдений над случайной величиной (например, измеряем ток в проводнике или же выясняем величину заработной платы у случайно выбранных работающих жителей Москвы). Пусть каждое значение СВ появляется некоторое количество раз:

Математическое ожидание – это средневзвешенное значение случайной величины с весами в виде вероятностей. Математическое ожидание – это тот теоретический центр, вокруг которого располагаются все возможные значения случайной величины. Для случая n ряд должен быть сходящимся. Возникают иногда случаи, когда ряд расходится. Тогда случайная величина не имеет математического ожидания. Такие случай мы с вами рассматривать не будем. Статистический смысл математического ожидания: Пусть мы проводим n наблюдений над случайной величиной (например, измеряем ток в проводнике или же выясняем величину заработной платы у случайно выбранных работающих жителей Москвы). Пусть каждое значение СВ появляется некоторое количество раз:

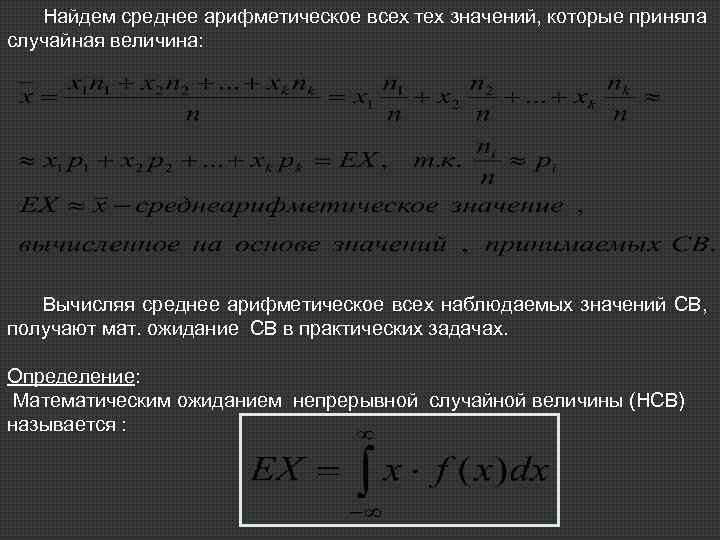

Найдем среднее арифметическое всех тех значений, которые приняла случайная величина: Вычисляя среднее арифметическое всех наблюдаемых значений СВ, получают мат. ожидание СВ в практических задачах. Определение: Математическим ожиданием непрерывной случайной величины (НСВ) называется :

Найдем среднее арифметическое всех тех значений, которые приняла случайная величина: Вычисляя среднее арифметическое всех наблюдаемых значений СВ, получают мат. ожидание СВ в практических задачах. Определение: Математическим ожиданием непрерывной случайной величины (НСВ) называется :

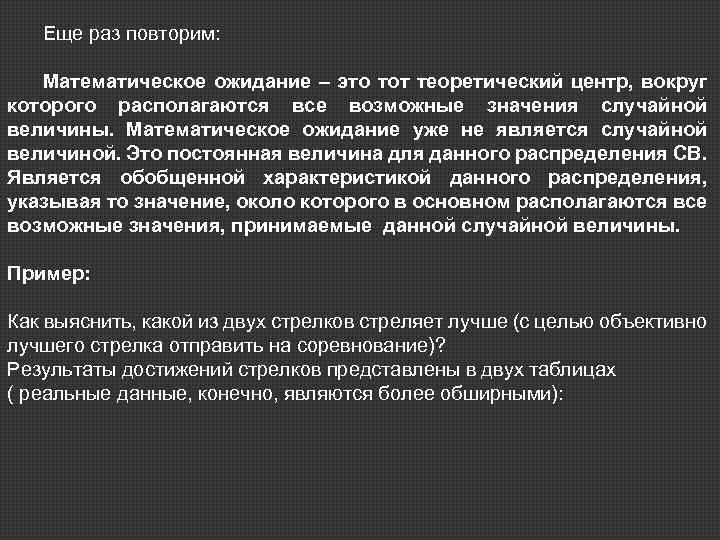

Еще раз повторим: Математическое ожидание – это тот теоретический центр, вокруг которого располагаются все возможные значения случайной величины. Математическое ожидание уже не является случайной величиной. Это постоянная величина для данного распределения СВ. Является обобщенной характеристикой данного распределения, указывая то значение, около которого в основном располагаются все возможные значения, принимаемые данной случайной величины. Пример: Как выяснить, какой из двух стрелков стреляет лучше (с целью объективно лучшего стрелка отправить на соревнование)? Результаты достижений стрелков представлены в двух таблицах ( реальные данные, конечно, являются более обширными):

Еще раз повторим: Математическое ожидание – это тот теоретический центр, вокруг которого располагаются все возможные значения случайной величины. Математическое ожидание уже не является случайной величиной. Это постоянная величина для данного распределения СВ. Является обобщенной характеристикой данного распределения, указывая то значение, около которого в основном располагаются все возможные значения, принимаемые данной случайной величины. Пример: Как выяснить, какой из двух стрелков стреляет лучше (с целью объективно лучшего стрелка отправить на соревнование)? Результаты достижений стрелков представлены в двух таблицах ( реальные данные, конечно, являются более обширными):

Первый стрелок : Х Р 8 0. 7 9 0. 1 Второй стрелок: 10 0. 2 ЕХ = 8· 0. 7+9· 0. 1+10· 0. 2 = 8. 5 Y Р 8 0. 5 9 0. 3 10 0. 2 ЕY = 8· 0. 5+9· 0. 3+10· 0. 2 = 8. 7 По данным вычислений ясно, что второй стрелок стреляет несколько лучше. Обратите внимание на то, что ЕХ именно теоретический центр распределения, ибо при выстрелах значение 8. 5 реально никогда не возникает, но вокруг этого значения группируются все возможные значения СВ с учетом того, насколько часто эти значения появляются, т. е. с учетом вероятности их появления. Особенно наглядно смысл такого теоретического центра проявляется при больших массивах значений.

Первый стрелок : Х Р 8 0. 7 9 0. 1 Второй стрелок: 10 0. 2 ЕХ = 8· 0. 7+9· 0. 1+10· 0. 2 = 8. 5 Y Р 8 0. 5 9 0. 3 10 0. 2 ЕY = 8· 0. 5+9· 0. 3+10· 0. 2 = 8. 7 По данным вычислений ясно, что второй стрелок стреляет несколько лучше. Обратите внимание на то, что ЕХ именно теоретический центр распределения, ибо при выстрелах значение 8. 5 реально никогда не возникает, но вокруг этого значения группируются все возможные значения СВ с учетом того, насколько часто эти значения появляются, т. е. с учетом вероятности их появления. Особенно наглядно смысл такого теоретического центра проявляется при больших массивах значений.

Вычислим математическое ожидание для ранее рассмотренной задачи: f(x)=(x+1) -1 f(x)=1/4 1 C=1/4 0 ЕХ=1/3 2 х

Вычислим математическое ожидание для ранее рассмотренной задачи: f(x)=(x+1) -1 f(x)=1/4 1 C=1/4 0 ЕХ=1/3 2 х

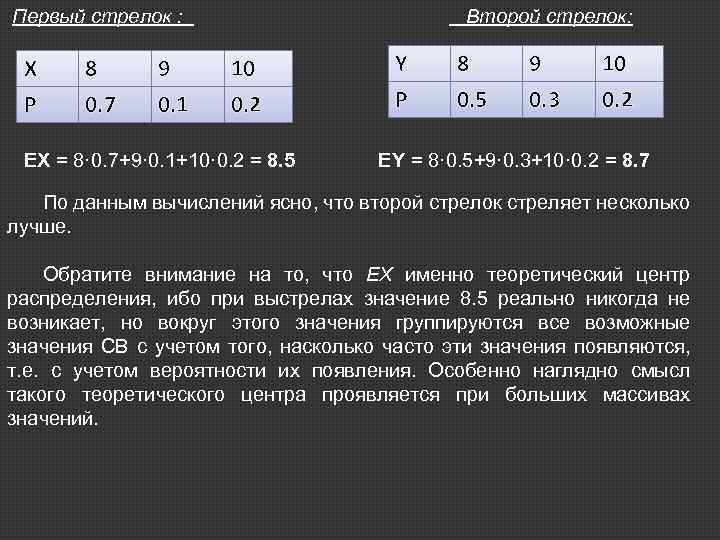

Могло ли математическое ожидание располагаться как-то иначе? На графике показаны места на числовой оси абсцисс, в которые не может попасть математическое ожидание для данной задачи. f(x) 1 С=1/4 -1 0 2 X

Могло ли математическое ожидание располагаться как-то иначе? На графике показаны места на числовой оси абсцисс, в которые не может попасть математическое ожидание для данной задачи. f(x) 1 С=1/4 -1 0 2 X

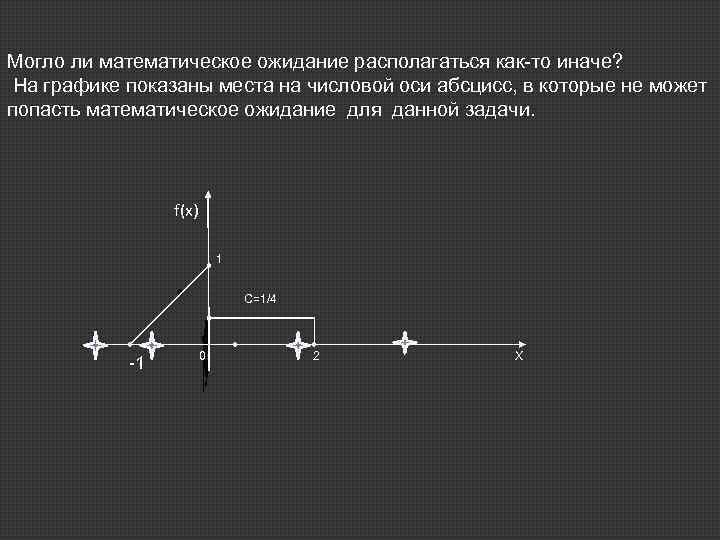

Свойства математического ожидания : Эти свойства приведены без доказательства. Доказательство свойств можно найти в книге Кремер «ТВ и МС» на стр. 97 -98. Для следующего свойства нам следует ввести понятие независимых случайных величин. Несколько позже мы дадим строгое определение понятия независимых случайных величин, а пока на интуитивном уровне отметит, что независимые случайные величины - это такие величины, которые не влияют на поведение друга.

Свойства математического ожидания : Эти свойства приведены без доказательства. Доказательство свойств можно найти в книге Кремер «ТВ и МС» на стр. 97 -98. Для следующего свойства нам следует ввести понятие независимых случайных величин. Несколько позже мы дадим строгое определение понятия независимых случайных величин, а пока на интуитивном уровне отметит, что независимые случайные величины - это такие величины, которые не влияют на поведение друга.

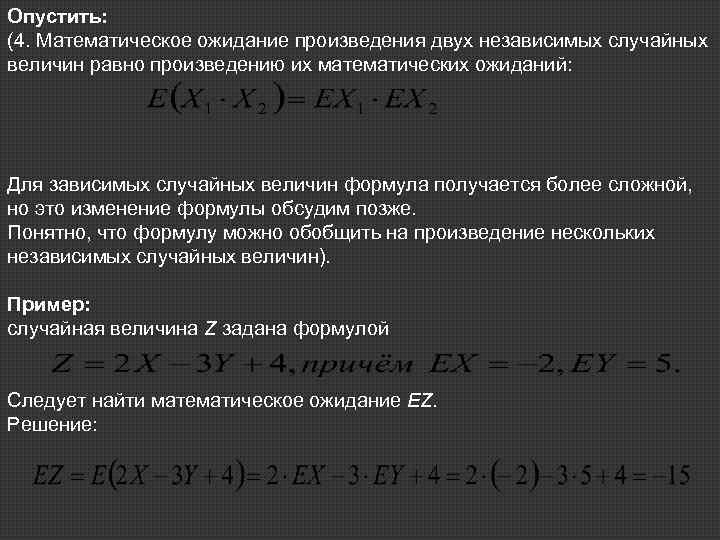

Опустить: (4. Математическое ожидание произведения двух независимых случайных величин равно произведению их математических ожиданий: Для зависимых случайных величин формула получается более сложной, но это изменение формулы обсудим позже. Понятно, что формулу можно обобщить на произведение нескольких независимых случайных величин). Пример: случайная величина Z задана формулой Следует найти математическое ожидание ЕZ. Решение:

Опустить: (4. Математическое ожидание произведения двух независимых случайных величин равно произведению их математических ожиданий: Для зависимых случайных величин формула получается более сложной, но это изменение формулы обсудим позже. Понятно, что формулу можно обобщить на произведение нескольких независимых случайных величин). Пример: случайная величина Z задана формулой Следует найти математическое ожидание ЕZ. Решение:

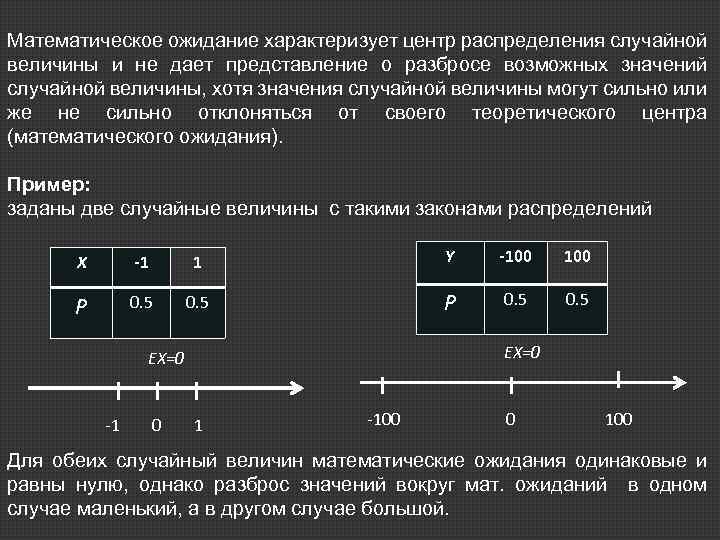

Математическое ожидание характеризует центр распределения случайной величины и не дает представление о разбросе возможных значений случайной величины, хотя значения случайной величины могут сильно или же не сильно отклоняться от своего теоретического центра (математического ожидания). Пример: заданы две случайные величины с такими законами распределений X -1 1 Y -100 Р 0. 5 ЕХ=0 -1 0 1 -100 0 100 Для обеих случайный величин математические ожидания одинаковые и равны нулю, однако разброс значений вокруг мат. ожиданий в одном случае маленький, а в другом случае большой.

Математическое ожидание характеризует центр распределения случайной величины и не дает представление о разбросе возможных значений случайной величины, хотя значения случайной величины могут сильно или же не сильно отклоняться от своего теоретического центра (математического ожидания). Пример: заданы две случайные величины с такими законами распределений X -1 1 Y -100 Р 0. 5 ЕХ=0 -1 0 1 -100 0 100 Для обеих случайный величин математические ожидания одинаковые и равны нулю, однако разброс значений вокруг мат. ожиданий в одном случае маленький, а в другом случае большой.

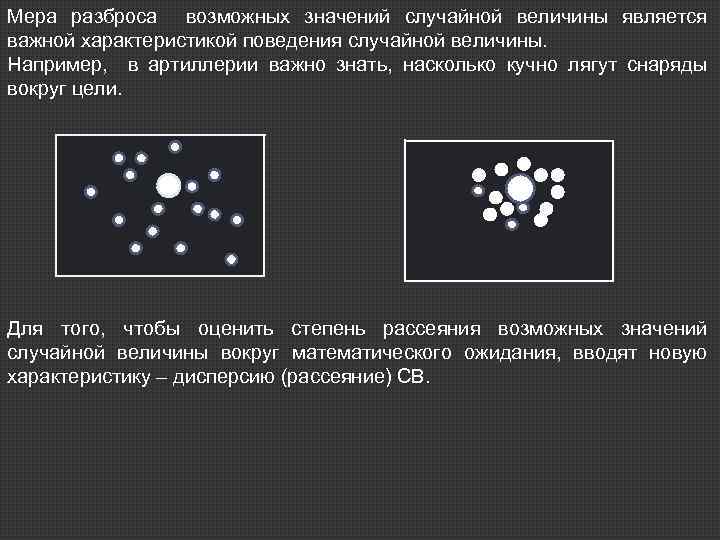

Мера разброса возможных значений случайной величины является важной характеристикой поведения случайной величины. Например, в артиллерии важно знать, насколько кучно лягут снаряды вокруг цели. Для того, чтобы оценить степень рассеяния возможных значений случайной величины вокруг математического ожидания, вводят новую характеристику – дисперсию (рассеяние) СВ.

Мера разброса возможных значений случайной величины является важной характеристикой поведения случайной величины. Например, в артиллерии важно знать, насколько кучно лягут снаряды вокруг цели. Для того, чтобы оценить степень рассеяния возможных значений случайной величины вокруг математического ожидания, вводят новую характеристику – дисперсию (рассеяние) СВ.

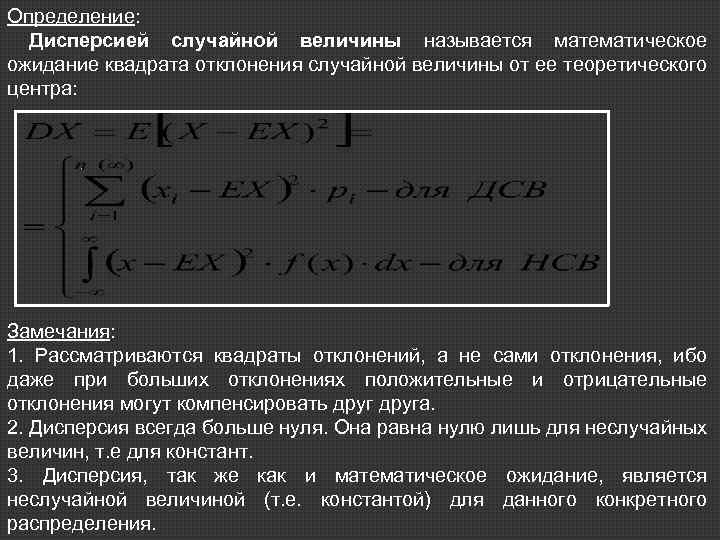

Определение: Дисперсией случайной величины называется математическое ожидание квадрата отклонения случайной величины от ее теоретического центра: Замечания: 1. Рассматриваются квадраты отклонений, а не сами отклонения, ибо даже при больших отклонениях положительные и отрицательные отклонения могут компенсировать друга. 2. Дисперсия всегда больше нуля. Она равна нулю лишь для неслучайных величин, т. е для констант. 3. Дисперсия, так же как и математическое ожидание, является неслучайной величиной (т. е. константой) для данного конкретного распределения.

Определение: Дисперсией случайной величины называется математическое ожидание квадрата отклонения случайной величины от ее теоретического центра: Замечания: 1. Рассматриваются квадраты отклонений, а не сами отклонения, ибо даже при больших отклонениях положительные и отрицательные отклонения могут компенсировать друга. 2. Дисперсия всегда больше нуля. Она равна нулю лишь для неслучайных величин, т. е для констант. 3. Дисперсия, так же как и математическое ожидание, является неслучайной величиной (т. е. константой) для данного конкретного распределения.

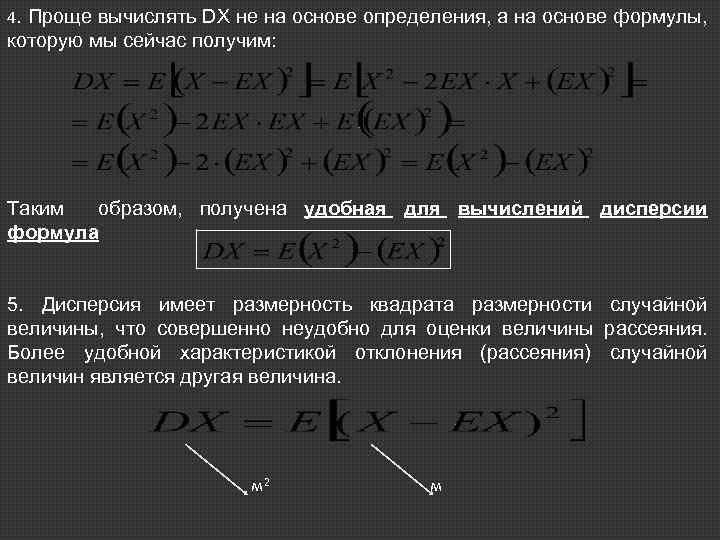

4. Проще вычислять DX не на основе определения, а на основе формулы, которую мы сейчас получим: Таким образом, получена удобная для вычислений дисперсии формула 5. Дисперсия имеет размерность квадрата размерности случайной величины, что совершенно неудобно для оценки величины рассеяния. Более удобной характеристикой отклонения (рассеяния) случайной величин является другая величина. м 2 м

4. Проще вычислять DX не на основе определения, а на основе формулы, которую мы сейчас получим: Таким образом, получена удобная для вычислений дисперсии формула 5. Дисперсия имеет размерность квадрата размерности случайной величины, что совершенно неудобно для оценки величины рассеяния. Более удобной характеристикой отклонения (рассеяния) случайной величин является другая величина. м 2 м

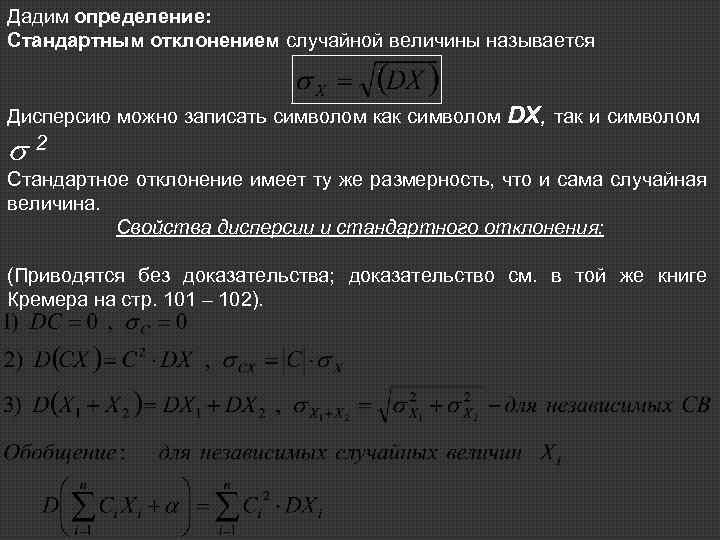

Дадим определение: Стандартным отклонением случайной величины называется Дисперсию можно записать символом как символом 2 DX, так и символом Стандартное отклонение имеет ту же размерность, что и сама случайная величина. Свойства дисперсии и стандартного отклонения: (Приводятся без доказательства; доказательство см. в той же книге Кремера на стр. 101 – 102).

Дадим определение: Стандартным отклонением случайной величины называется Дисперсию можно записать символом как символом 2 DX, так и символом Стандартное отклонение имеет ту же размерность, что и сама случайная величина. Свойства дисперсии и стандартного отклонения: (Приводятся без доказательства; доказательство см. в той же книге Кремера на стр. 101 – 102).

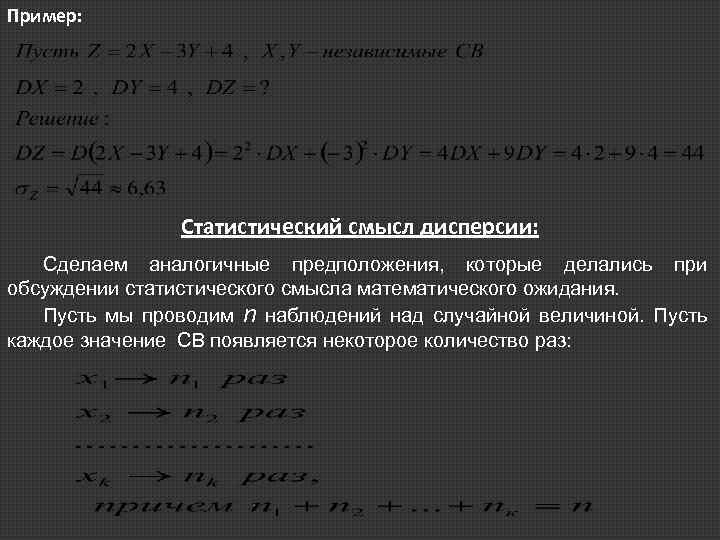

Пример: Статистический смысл дисперсии: Сделаем аналогичные предположения, которые делались при обсуждении статистического смысла математического ожидания. Пусть мы проводим n наблюдений над случайной величиной. Пусть каждое значение СВ появляется некоторое количество раз:

Пример: Статистический смысл дисперсии: Сделаем аналогичные предположения, которые делались при обсуждении статистического смысла математического ожидания. Пусть мы проводим n наблюдений над случайной величиной. Пусть каждое значение СВ появляется некоторое количество раз:

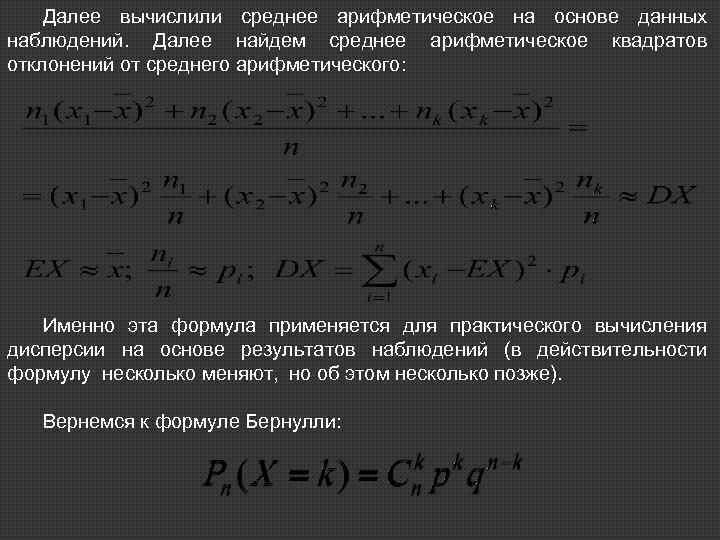

Далее вычислили среднее арифметическое на основе данных наблюдений. Далее найдем среднее арифметическое квадратов отклонений от среднего арифметического: Именно эта формула применяется для практического вычисления дисперсии на основе результатов наблюдений (в действительности формулу несколько меняют, но об этом несколько позже). Вернемся к формуле Бернулли:

Далее вычислили среднее арифметическое на основе данных наблюдений. Далее найдем среднее арифметическое квадратов отклонений от среднего арифметического: Именно эта формула применяется для практического вычисления дисперсии на основе результатов наблюдений (в действительности формулу несколько меняют, но об этом несколько позже). Вернемся к формуле Бернулли:

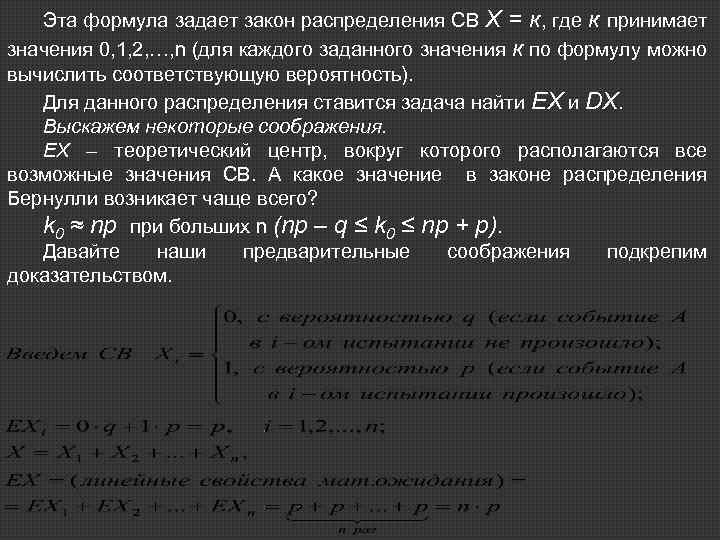

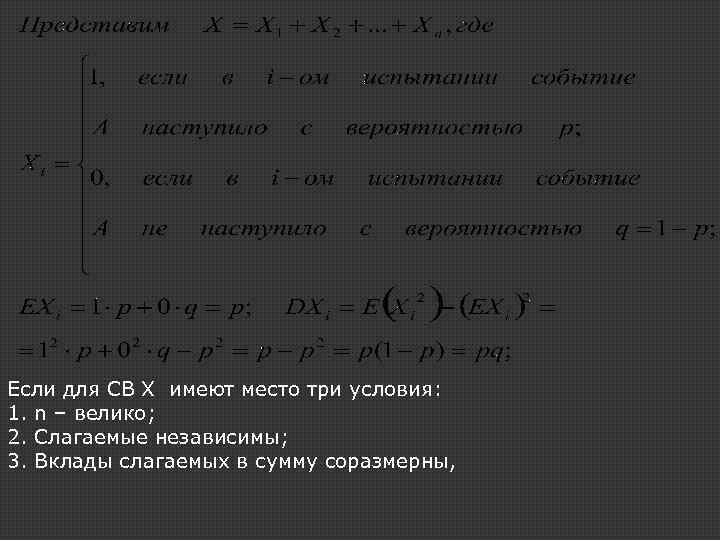

Эта формула задает закон распределения СВ Х = к, где к принимает значения 0, 1, 2, …, n (для каждого заданного значения к по формулу можно вычислить соответствующую вероятность). Для данного распределения ставится задача найти ЕХ и DX. Выскажем некоторые соображения. ЕХ – теоретический центр, вокруг которого располагаются все возможные значения СВ. А какое значение в законе распределения Бернулли возникает чаще всего? k 0 ≈ np при больших n (np – q ≤ k 0 ≤ np + p). Давайте наши предварительные соображения подкрепим доказательством.

Эта формула задает закон распределения СВ Х = к, где к принимает значения 0, 1, 2, …, n (для каждого заданного значения к по формулу можно вычислить соответствующую вероятность). Для данного распределения ставится задача найти ЕХ и DX. Выскажем некоторые соображения. ЕХ – теоретический центр, вокруг которого располагаются все возможные значения СВ. А какое значение в законе распределения Бернулли возникает чаще всего? k 0 ≈ np при больших n (np – q ≤ k 0 ≤ np + p). Давайте наши предварительные соображения подкрепим доказательством.

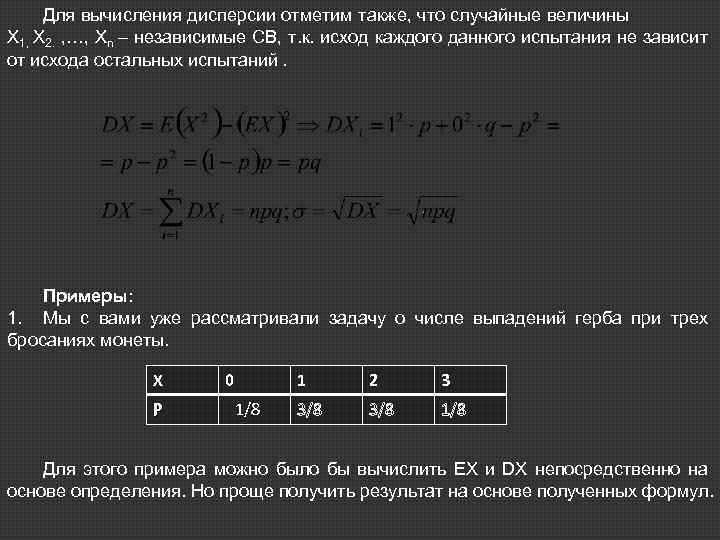

Для вычисления дисперсии отметим также, что случайные величины Х 1, Х 2. , …, Хn – независимые СВ, т. к. исход каждого данного испытания не зависит от исхода остальных испытаний. Примеры: 1. Мы с вами уже рассматривали задачу о числе выпадений герба при трех бросаниях монеты. X 0 1 2 3 P 11/8 3/8 1/8 Для этого примера можно было бы вычислить ЕХ и DX непосредственно на основе определения. Но проще получить результат на основе полученных формул.

Для вычисления дисперсии отметим также, что случайные величины Х 1, Х 2. , …, Хn – независимые СВ, т. к. исход каждого данного испытания не зависит от исхода остальных испытаний. Примеры: 1. Мы с вами уже рассматривали задачу о числе выпадений герба при трех бросаниях монеты. X 0 1 2 3 P 11/8 3/8 1/8 Для этого примера можно было бы вычислить ЕХ и DX непосредственно на основе определения. Но проще получить результат на основе полученных формул.

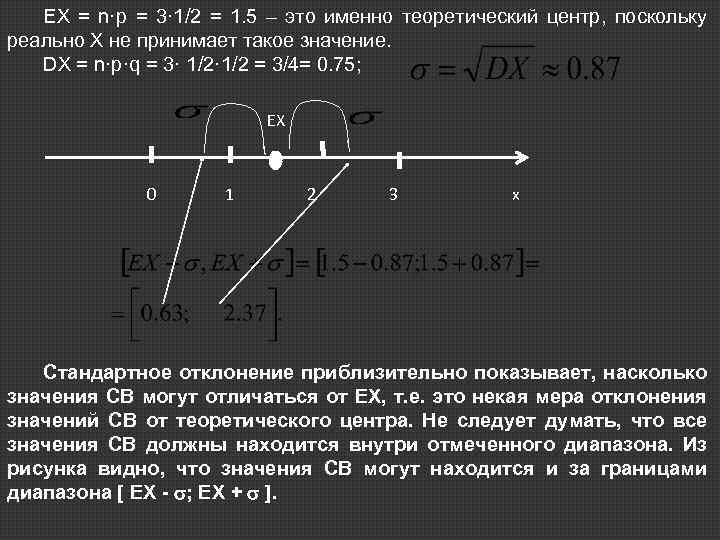

EX = n·p = 3· 1/2 = 1. 5 – это именно теоретический центр, поскольку реально Х не принимает такое значение. DX = n·p·q = 3· 1/2 = 3/4= 0. 75; EX 0 1 2 3 х Стандартное отклонение приблизительно показывает, насколько значения СВ могут отличаться от ЕХ, т. е. это некая мера отклонения значений СВ от теоретического центра. Не следует думать, что все значения СВ должны находится внутри отмеченного диапазона. Из рисунка видно, что значения СВ могут находится и за границами диапазона [ EX - ; EX + ].

EX = n·p = 3· 1/2 = 1. 5 – это именно теоретический центр, поскольку реально Х не принимает такое значение. DX = n·p·q = 3· 1/2 = 3/4= 0. 75; EX 0 1 2 3 х Стандартное отклонение приблизительно показывает, насколько значения СВ могут отличаться от ЕХ, т. е. это некая мера отклонения значений СВ от теоретического центра. Не следует думать, что все значения СВ должны находится внутри отмеченного диапазона. Из рисунка видно, что значения СВ могут находится и за границами диапазона [ EX - ; EX + ].

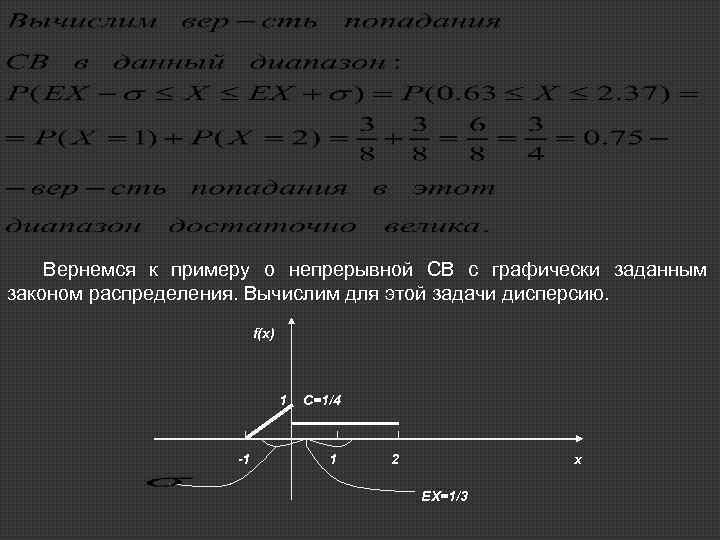

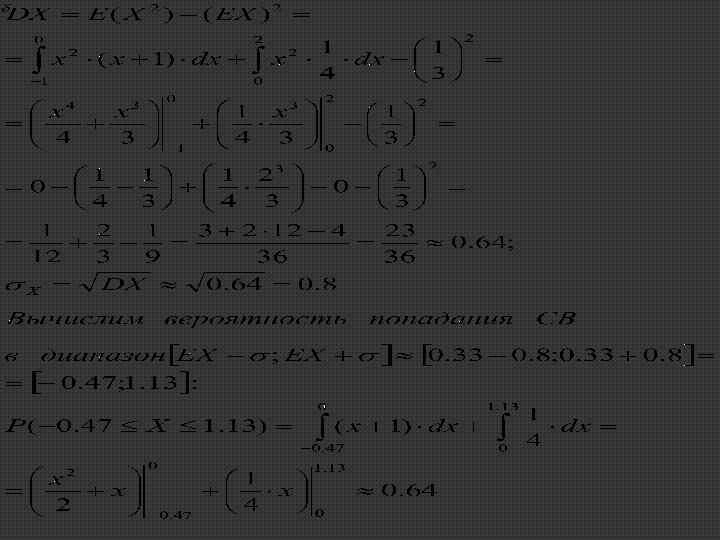

Вернемся к примеру о непрерывной СВ с графически заданным законом распределения. Вычислим для этой задачи дисперсию. f(x) 1 -1 C=1/4 1 2 x EX=1/3

Вернемся к примеру о непрерывной СВ с графически заданным законом распределения. Вычислим для этой задачи дисперсию. f(x) 1 -1 C=1/4 1 2 x EX=1/3

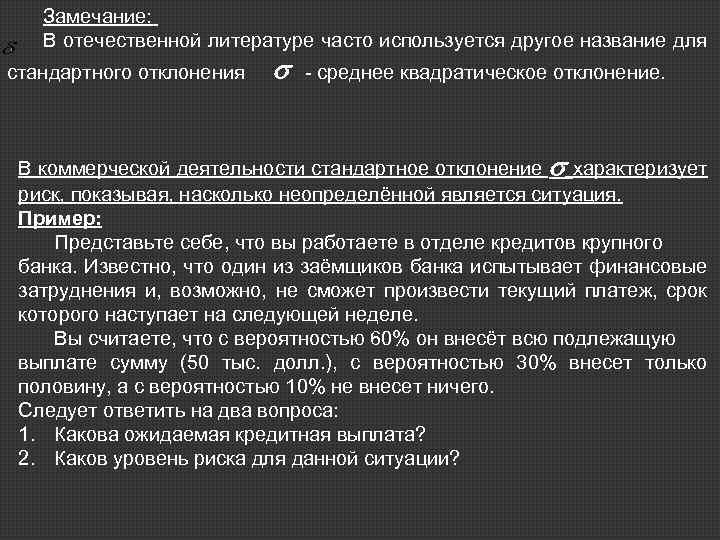

Замечание: В отечественной литературе часто используется другое название для стандартного отклонения - среднее квадратическое отклонение. В коммерческой деятельности стандартное отклонение характеризует риск, показывая, насколько неопределённой является ситуация. Пример: Представьте себе, что вы работаете в отделе кредитов крупного банка. Известно, что один из заёмщиков банка испытывает финансовые затруднения и, возможно, не сможет произвести текущий платеж, срок которого наступает на следующей неделе. Вы считаете, что с вероятностью 60% он внесёт всю подлежащую выплате сумму (50 тыс. долл. ), с вероятностью 30% внесет только половину, а с вероятностью 10% не внесет ничего. Следует ответить на два вопроса: 1. Какова ожидаемая кредитная выплата? 2. Каков уровень риска для данной ситуации?

Замечание: В отечественной литературе часто используется другое название для стандартного отклонения - среднее квадратическое отклонение. В коммерческой деятельности стандартное отклонение характеризует риск, показывая, насколько неопределённой является ситуация. Пример: Представьте себе, что вы работаете в отделе кредитов крупного банка. Известно, что один из заёмщиков банка испытывает финансовые затруднения и, возможно, не сможет произвести текущий платеж, срок которого наступает на следующей неделе. Вы считаете, что с вероятностью 60% он внесёт всю подлежащую выплате сумму (50 тыс. долл. ), с вероятностью 30% внесет только половину, а с вероятностью 10% не внесет ничего. Следует ответить на два вопроса: 1. Какова ожидаемая кредитная выплата? 2. Каков уровень риска для данной ситуации?

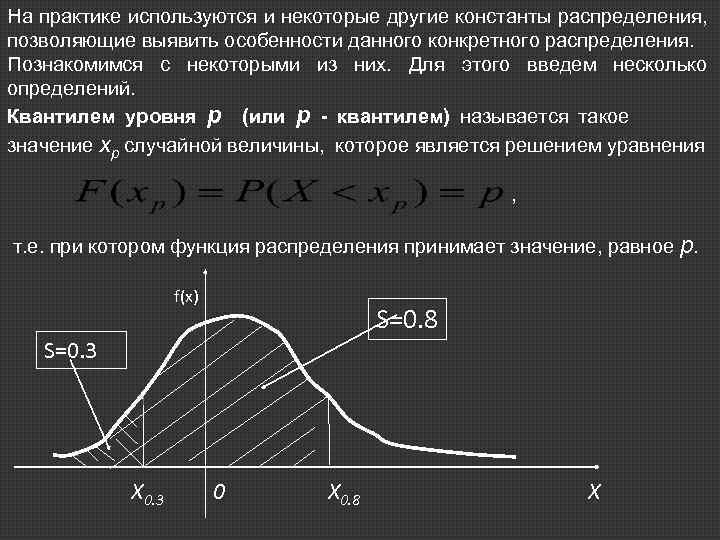

Решение: Построим ряд распределения случайной величины X, где Х – величина выплаты кредита: X 50 25 0 P 0, 6 0, 3 0, 1 EX=50 · 0, 6+25 · 0, 3+0 · 0, 1= 37, 5 тыс. долл. DX=E(X 2 ) - (EX)2 = 502 · 0, 6 + 252· 0, 3 + 02· 0, 1 - 37, 52 = 281, 25 (тыс. долл. )2 Стандартное отклонение характеризует меру неопределенности для ожидаемой величины выплаты. Итак, математическое ожидание и стандартное отклонение выражают в сжатой форме наиболее характерные черты закона распределения случайной величины, а именно, его теоретический центр и меру отклонения от этого теоретического центра. Эти величины для данного распределения являются константами (неслучайными величинами).

Решение: Построим ряд распределения случайной величины X, где Х – величина выплаты кредита: X 50 25 0 P 0, 6 0, 3 0, 1 EX=50 · 0, 6+25 · 0, 3+0 · 0, 1= 37, 5 тыс. долл. DX=E(X 2 ) - (EX)2 = 502 · 0, 6 + 252· 0, 3 + 02· 0, 1 - 37, 52 = 281, 25 (тыс. долл. )2 Стандартное отклонение характеризует меру неопределенности для ожидаемой величины выплаты. Итак, математическое ожидание и стандартное отклонение выражают в сжатой форме наиболее характерные черты закона распределения случайной величины, а именно, его теоретический центр и меру отклонения от этого теоретического центра. Эти величины для данного распределения являются константами (неслучайными величинами).

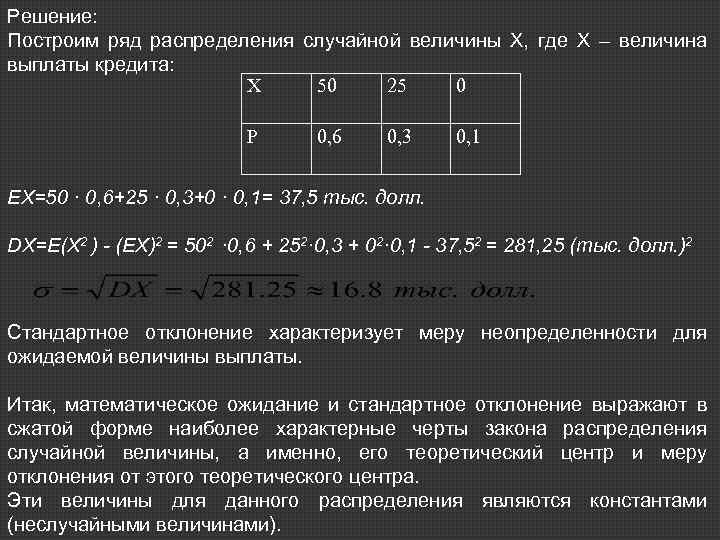

На практике используются и некоторые другие константы распределения, позволяющие выявить особенности данного конкретного распределения. Познакомимся с некоторыми из них. Для этого введем несколько определений. Квантилем уровня р (или р - квантилем) называется такое значение хр случайной величины, которое является решением уравнения , т. е. при котором функция распределения принимает значение, равное f(x) S=0. 8 S=0. 3 X 0. 3 0 X 0. 8 X р.

На практике используются и некоторые другие константы распределения, позволяющие выявить особенности данного конкретного распределения. Познакомимся с некоторыми из них. Для этого введем несколько определений. Квантилем уровня р (или р - квантилем) называется такое значение хр случайной величины, которое является решением уравнения , т. е. при котором функция распределения принимает значение, равное f(x) S=0. 8 S=0. 3 X 0. 3 0 X 0. 8 X р.

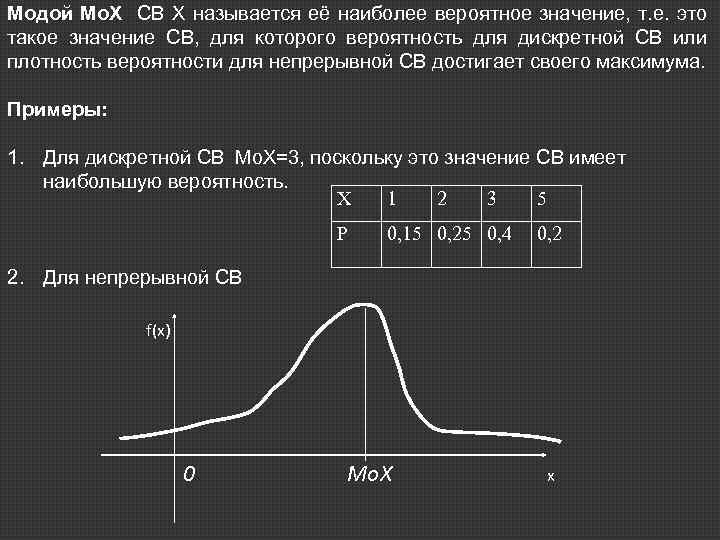

Модой Mо. X СВ X называется её наиболее вероятное значение, т. е. это такое значение СВ, для которого вероятность для дискретной СВ или плотность вероятности для непрерывной СВ достигает своего максимума. Примеры: 1. Для дискретной СВ Мо. Х=3, поскольку это значение СВ имеет наибольшую вероятность. X 1 2 3 5 P 0, 15 0, 25 0, 4 0, 2 2. Для непрерывной СВ f(x) 0 Mo. X x

Модой Mо. X СВ X называется её наиболее вероятное значение, т. е. это такое значение СВ, для которого вероятность для дискретной СВ или плотность вероятности для непрерывной СВ достигает своего максимума. Примеры: 1. Для дискретной СВ Мо. Х=3, поскольку это значение СВ имеет наибольшую вероятность. X 1 2 3 5 P 0, 15 0, 25 0, 4 0, 2 2. Для непрерывной СВ f(x) 0 Mo. X x

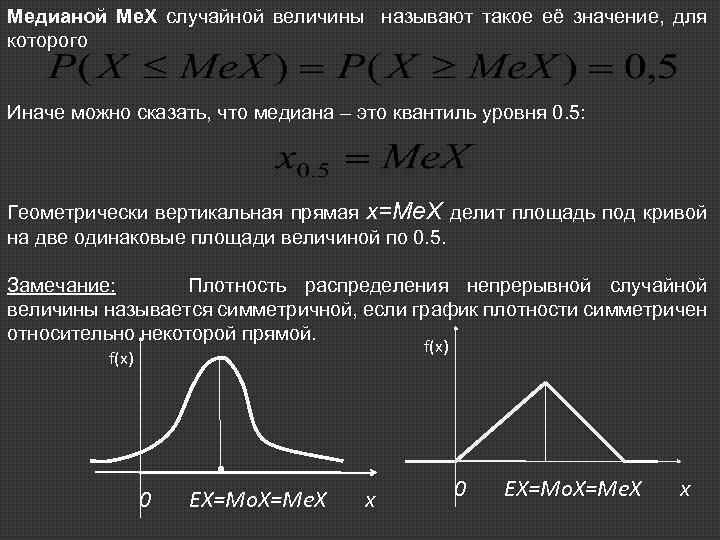

Медианой Ме. Х случайной величины называют такое её значение, для которого Иначе можно сказать, что медиана – это квантиль уровня 0. 5: Геометрически вертикальная прямая x=Me. X делит площадь под кривой на две одинаковые площади величиной по 0. 5. Замечание: Плотность распределения непрерывной случайной величины называется симметричной, если график плотности симметричен относительно некоторой прямой. f(x) 0 EX=Mo. X=Me. X x

Медианой Ме. Х случайной величины называют такое её значение, для которого Иначе можно сказать, что медиана – это квантиль уровня 0. 5: Геометрически вертикальная прямая x=Me. X делит площадь под кривой на две одинаковые площади величиной по 0. 5. Замечание: Плотность распределения непрерывной случайной величины называется симметричной, если график плотности симметричен относительно некоторой прямой. f(x) 0 EX=Mo. X=Me. X x

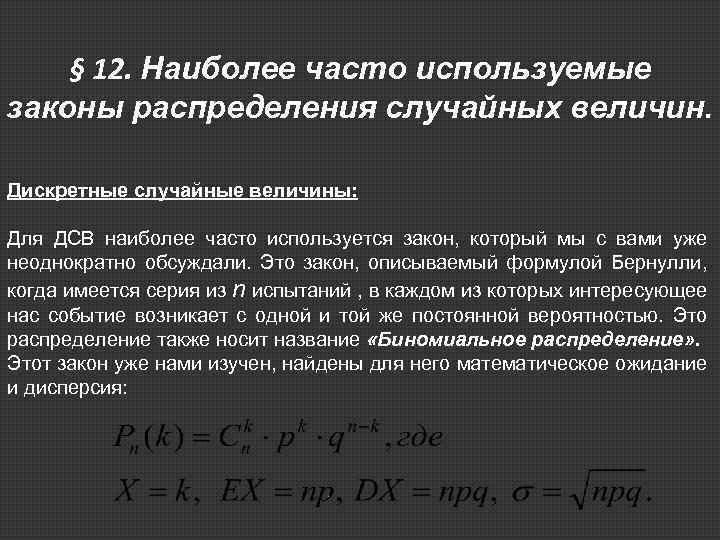

§ 12. Наиболее часто используемые законы распределения случайных величин. Дискретные случайные величины: Для ДСВ наиболее часто используется закон, который мы с вами уже неоднократно обсуждали. Это закон, описываемый формулой Бернулли, когда имеется серия из n испытаний , в каждом из которых интересующее нас событие возникает с одной и той же постоянной вероятностью. Это распределение также носит название «Биномиальное распределение» . Этот закон уже нами изучен, найдены для него математическое ожидание и дисперсия:

§ 12. Наиболее часто используемые законы распределения случайных величин. Дискретные случайные величины: Для ДСВ наиболее часто используется закон, который мы с вами уже неоднократно обсуждали. Это закон, описываемый формулой Бернулли, когда имеется серия из n испытаний , в каждом из которых интересующее нас событие возникает с одной и той же постоянной вероятностью. Это распределение также носит название «Биномиальное распределение» . Этот закон уже нами изучен, найдены для него математическое ожидание и дисперсия:

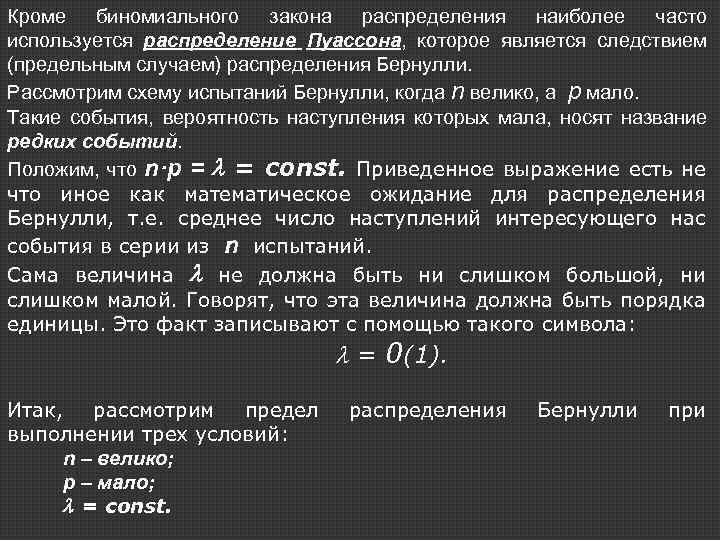

Кроме биномиального закона распределения наиболее часто используется распределение Пуассона, которое является следствием (предельным случаем) распределения Бернулли. Рассмотрим схему испытаний Бернулли, когда n велико, а р мало. Такие события, вероятность наступления которых мала, носят название редких событий. Положим, что n·p = = const. Приведенное выражение есть не что иное как математическое ожидание для распределения Бернулли, т. е. среднее число наступлений интересующего нас события в серии из n испытаний. Сама величина не должна быть ни слишком большой, ни слишком малой. Говорят, что эта величина должна быть порядка единицы. Это факт записывают с помощью такого символа: = 0(1). Итак, рассмотрим предел выполнении трех условий: n – велико; p – мало; = const. распределения Бернулли при

Кроме биномиального закона распределения наиболее часто используется распределение Пуассона, которое является следствием (предельным случаем) распределения Бернулли. Рассмотрим схему испытаний Бернулли, когда n велико, а р мало. Такие события, вероятность наступления которых мала, носят название редких событий. Положим, что n·p = = const. Приведенное выражение есть не что иное как математическое ожидание для распределения Бернулли, т. е. среднее число наступлений интересующего нас события в серии из n испытаний. Сама величина не должна быть ни слишком большой, ни слишком малой. Говорят, что эта величина должна быть порядка единицы. Это факт записывают с помощью такого символа: = 0(1). Итак, рассмотрим предел выполнении трех условий: n – велико; p – мало; = const. распределения Бернулли при

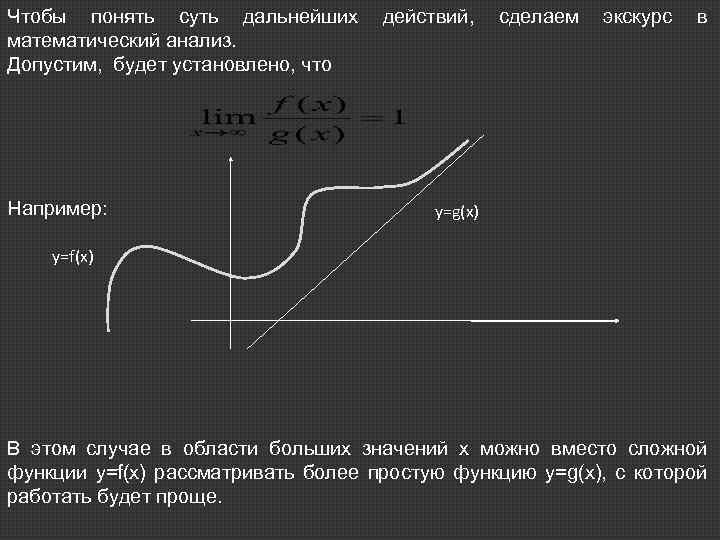

Чтобы понять суть дальнейших математический анализ. Допустим, будет установлено, что Например: действий, сделаем экскурс в y=g(x) y=f(x) В этом случае в области больших значений х можно вместо сложной функции y=f(x) рассматривать более простую функцию y=g(x), с которой работать будет проще.

Чтобы понять суть дальнейших математический анализ. Допустим, будет установлено, что Например: действий, сделаем экскурс в y=g(x) y=f(x) В этом случае в области больших значений х можно вместо сложной функции y=f(x) рассматривать более простую функцию y=g(x), с которой работать будет проще.

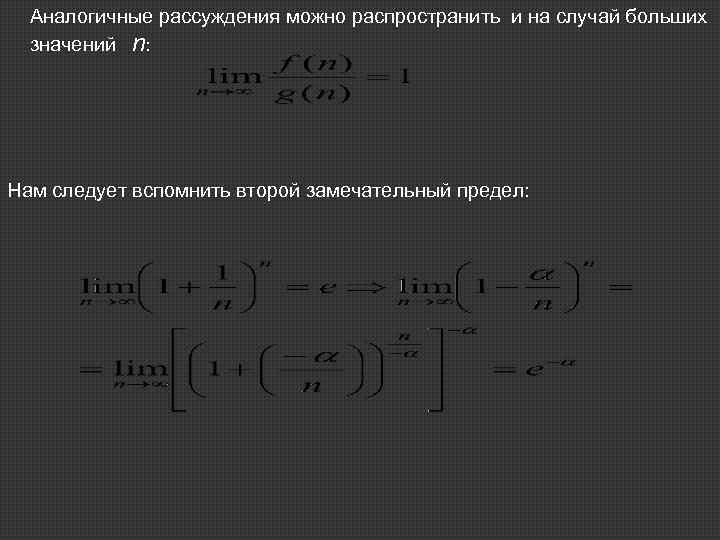

Аналогичные рассуждения можно распространить и на случай больших значений n: Нам следует вспомнить второй замечательный предел:

Аналогичные рассуждения можно распространить и на случай больших значений n: Нам следует вспомнить второй замечательный предел:

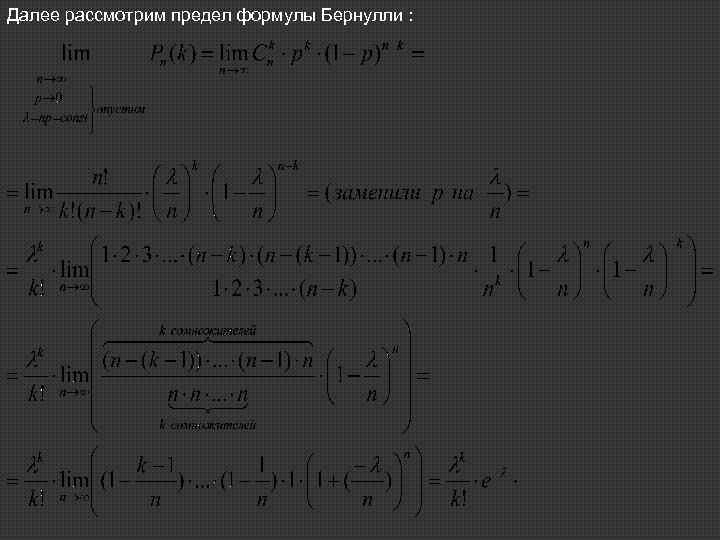

Далее рассмотрим предел формулы Бернулли :

Далее рассмотрим предел формулы Бернулли :

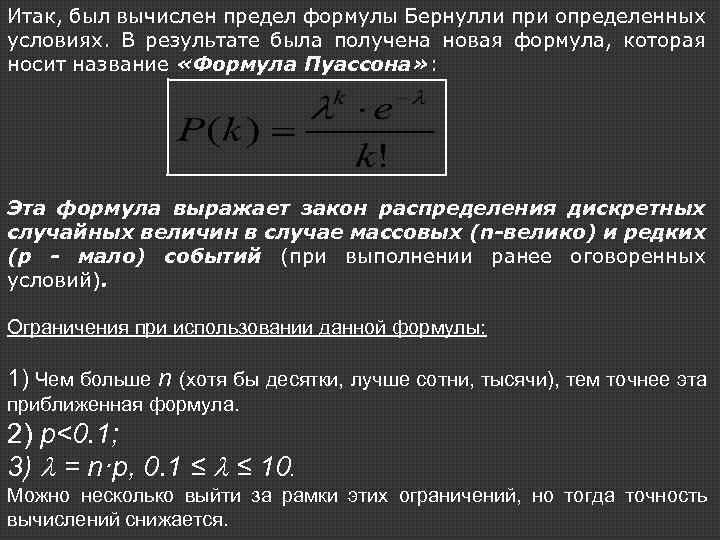

Итак, был вычислен предел формулы Бернулли при определенных условиях. В результате была получена новая формула, которая носит название «Формула Пуассона» : Эта формула выражает закон распределения дискретных случайных величин в случае массовых (n-велико) и редких (р - мало) событий (при выполнении ранее оговоренных условий). Ограничения при использовании данной формулы: 1) Чем больше n (хотя бы десятки, лучше сотни, тысячи), тем точнее эта приближенная формула. 2) р<0. 1; 3) = n·p, 0. 1 ≤ ≤ 10. Можно несколько выйти за рамки этих ограничений, но тогда точность вычислений снижается.

Итак, был вычислен предел формулы Бернулли при определенных условиях. В результате была получена новая формула, которая носит название «Формула Пуассона» : Эта формула выражает закон распределения дискретных случайных величин в случае массовых (n-велико) и редких (р - мало) событий (при выполнении ранее оговоренных условий). Ограничения при использовании данной формулы: 1) Чем больше n (хотя бы десятки, лучше сотни, тысячи), тем точнее эта приближенная формула. 2) р<0. 1; 3) = n·p, 0. 1 ≤ ≤ 10. Можно несколько выйти за рамки этих ограничений, но тогда точность вычислений снижается.

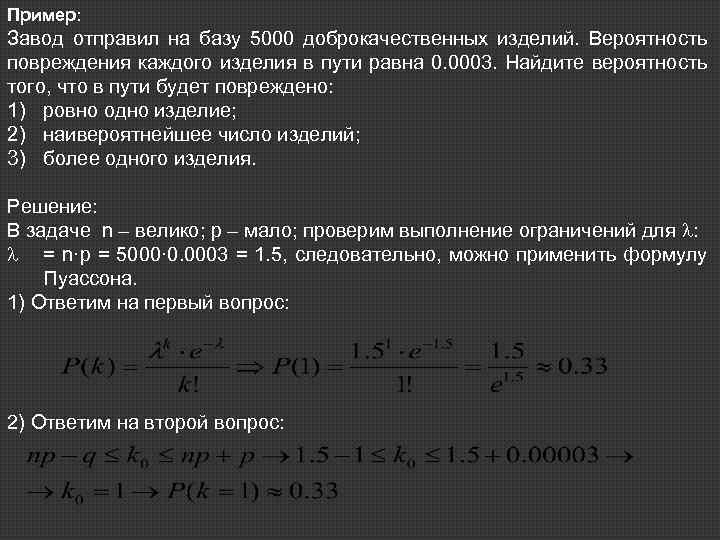

Пример: Завод отправил на базу 5000 доброкачественных изделий. Вероятность повреждения каждого изделия в пути равна 0. 0003. Найдите вероятность того, что в пути будет повреждено: 1) ровно одно изделие; 2) наивероятнейшее число изделий; 3) более одного изделия. Решение: В задаче n – велико; р – мало; проверим выполнение ограничений для : = n·p = 5000· 0. 0003 = 1. 5, следовательно, можно применить формулу Пуассона. 1) Ответим на первый вопрос: 2) Ответим на второй вопрос:

Пример: Завод отправил на базу 5000 доброкачественных изделий. Вероятность повреждения каждого изделия в пути равна 0. 0003. Найдите вероятность того, что в пути будет повреждено: 1) ровно одно изделие; 2) наивероятнейшее число изделий; 3) более одного изделия. Решение: В задаче n – велико; р – мало; проверим выполнение ограничений для : = n·p = 5000· 0. 0003 = 1. 5, следовательно, можно применить формулу Пуассона. 1) Ответим на первый вопрос: 2) Ответим на второй вопрос:

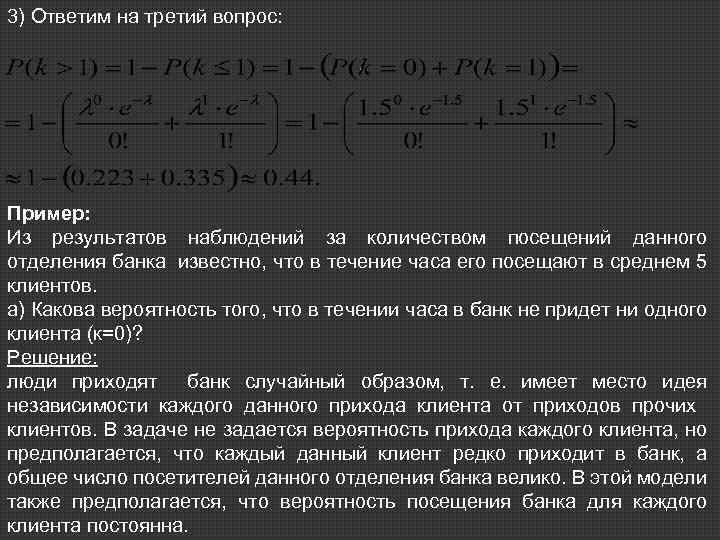

3) Ответим на третий вопрос: Пример: Из результатов наблюдений за количеством посещений данного отделения банка известно, что в течение часа его посещают в среднем 5 клиентов. а) Какова вероятность того, что в течении часа в банк не придет ни одного клиента (к=0)? Решение: люди приходят банк случайный образом, т. е. имеет место идея независимости каждого данного прихода клиента от приходов прочих клиентов. В задаче не задается вероятность прихода каждого клиента, но предполагается, что каждый данный клиент редко приходит в банк, а общее число посетителей данного отделения банка велико. В этой модели также предполагается, что вероятность посещения банка для каждого клиента постоянна.

3) Ответим на третий вопрос: Пример: Из результатов наблюдений за количеством посещений данного отделения банка известно, что в течение часа его посещают в среднем 5 клиентов. а) Какова вероятность того, что в течении часа в банк не придет ни одного клиента (к=0)? Решение: люди приходят банк случайный образом, т. е. имеет место идея независимости каждого данного прихода клиента от приходов прочих клиентов. В задаче не задается вероятность прихода каждого клиента, но предполагается, что каждый данный клиент редко приходит в банк, а общее число посетителей данного отделения банка велико. В этой модели также предполагается, что вероятность посещения банка для каждого клиента постоянна.

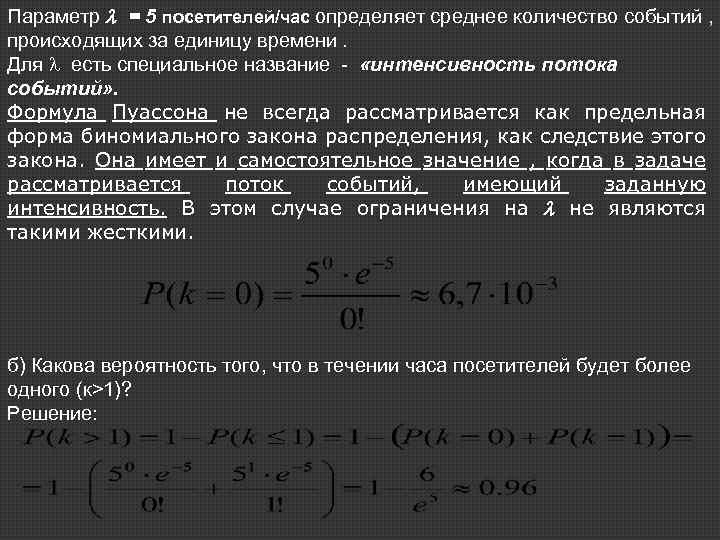

Параметр = 5 посетителей/час определяет среднее количество событий , происходящих за единицу времени. Для есть специальное название - «интенсивность потока событий» . Формула Пуассона не всегда рассматривается как предельная форма биномиального закона распределения, как следствие этого закона. Она имеет и самостоятельное значение , когда в задаче рассматривается поток событий, имеющий заданную интенсивность. В этом случае ограничения на не являются такими жесткими. б) Какова вероятность того, что в течении часа посетителей будет более одного (к>1)? Решение:

Параметр = 5 посетителей/час определяет среднее количество событий , происходящих за единицу времени. Для есть специальное название - «интенсивность потока событий» . Формула Пуассона не всегда рассматривается как предельная форма биномиального закона распределения, как следствие этого закона. Она имеет и самостоятельное значение , когда в задаче рассматривается поток событий, имеющий заданную интенсивность. В этом случае ограничения на не являются такими жесткими. б) Какова вероятность того, что в течении часа посетителей будет более одного (к>1)? Решение:

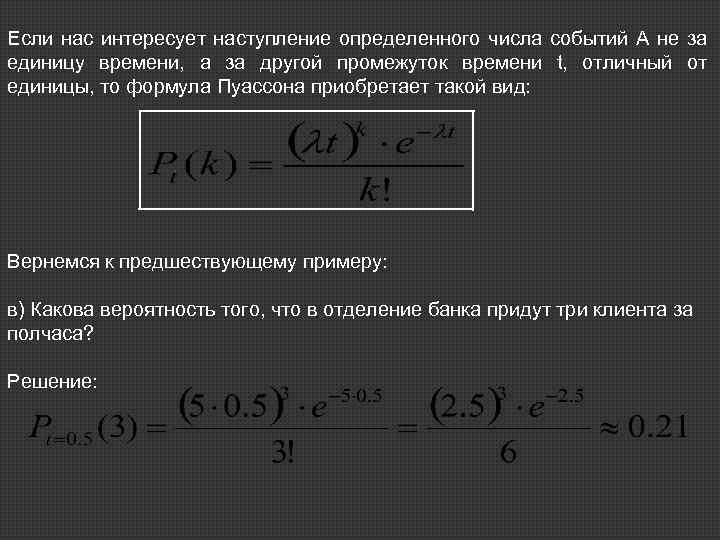

Если нас интересует наступление определенного числа событий А не за единицу времени, а за другой промежуток времени t, отличный от единицы, то формула Пуассона приобретает такой вид: Вернемся к предшествующему примеру: в) Какова вероятность того, что в отделение банка придут три клиента за полчаса? Решение:

Если нас интересует наступление определенного числа событий А не за единицу времени, а за другой промежуток времени t, отличный от единицы, то формула Пуассона приобретает такой вид: Вернемся к предшествующему примеру: в) Какова вероятность того, что в отделение банка придут три клиента за полчаса? Решение:

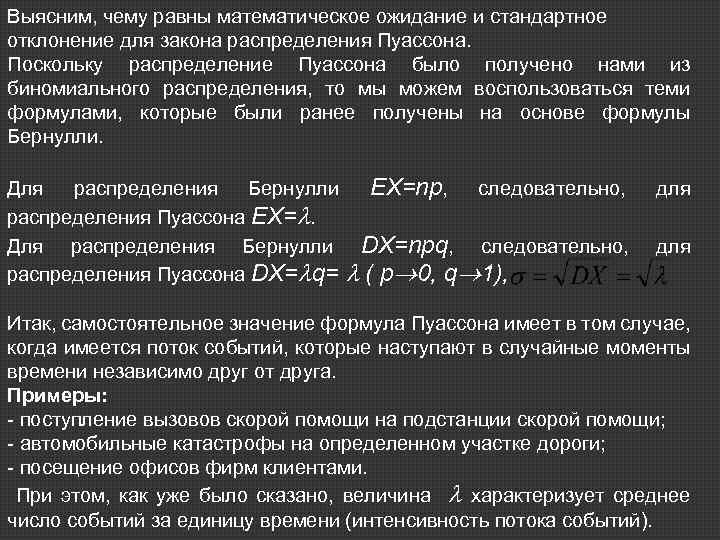

Выясним, чему равны математическое ожидание и стандартное отклонение для закона распределения Пуассона. Поскольку распределение Пуассона было получено нами из биномиального распределения, то мы можем воспользоваться теми формулами, которые были ранее получены на основе формулы Бернулли. Для распределения Бернулли распределения Пуассона EX=. Для распределения Бернулли распределения Пуассона DX= q= EX=np, следовательно, для DX=npq, следовательно, ( p 0, q 1), для Итак, самостоятельное значение формула Пуассона имеет в том случае, когда имеется поток событий, которые наступают в случайные моменты времени независимо друг от друга. Примеры: - поступление вызовов скорой помощи на подстанции скорой помощи; - автомобильные катастрофы на определенном участке дороги; - посещение офисов фирм клиентами. При этом, как уже было сказано, величина характеризует среднее число событий за единицу времени (интенсивность потока событий).

Выясним, чему равны математическое ожидание и стандартное отклонение для закона распределения Пуассона. Поскольку распределение Пуассона было получено нами из биномиального распределения, то мы можем воспользоваться теми формулами, которые были ранее получены на основе формулы Бернулли. Для распределения Бернулли распределения Пуассона EX=. Для распределения Бернулли распределения Пуассона DX= q= EX=np, следовательно, для DX=npq, следовательно, ( p 0, q 1), для Итак, самостоятельное значение формула Пуассона имеет в том случае, когда имеется поток событий, которые наступают в случайные моменты времени независимо друг от друга. Примеры: - поступление вызовов скорой помощи на подстанции скорой помощи; - автомобильные катастрофы на определенном участке дороги; - посещение офисов фирм клиентами. При этом, как уже было сказано, величина характеризует среднее число событий за единицу времени (интенсивность потока событий).

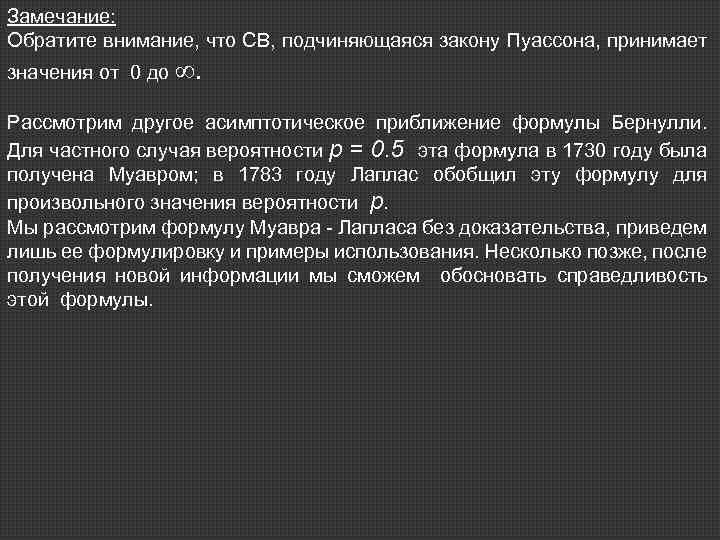

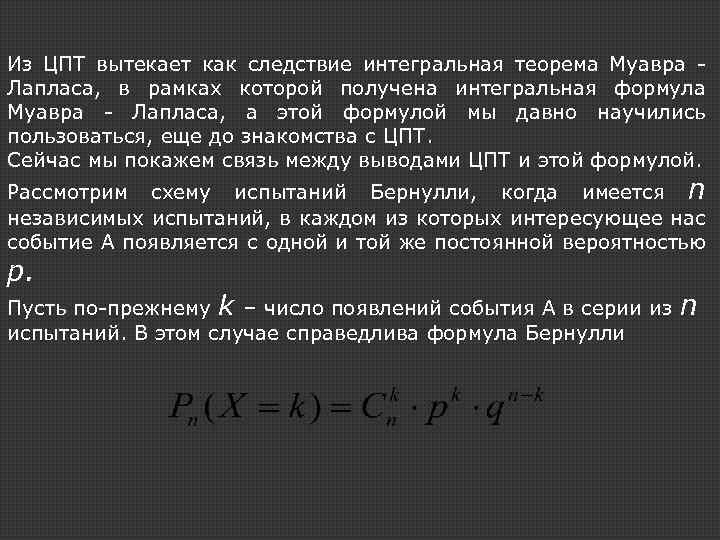

Замечание: Обратите внимание, что СВ, подчиняющаяся закону Пуассона, принимает значения от 0 до . Рассмотрим другое асимптотическое приближение формулы Бернулли. Для частного случая вероятности р = 0. 5 эта формула в 1730 году была получена Муавром; в 1783 году Лаплас обобщил эту формулу для произвольного значения вероятности р. Мы рассмотрим формулу Муавра - Лапласа без доказательства, приведем лишь ее формулировку и примеры использования. Несколько позже, после получения новой информации мы сможем обосновать справедливость этой формулы.

Замечание: Обратите внимание, что СВ, подчиняющаяся закону Пуассона, принимает значения от 0 до . Рассмотрим другое асимптотическое приближение формулы Бернулли. Для частного случая вероятности р = 0. 5 эта формула в 1730 году была получена Муавром; в 1783 году Лаплас обобщил эту формулу для произвольного значения вероятности р. Мы рассмотрим формулу Муавра - Лапласа без доказательства, приведем лишь ее формулировку и примеры использования. Несколько позже, после получения новой информации мы сможем обосновать справедливость этой формулы.

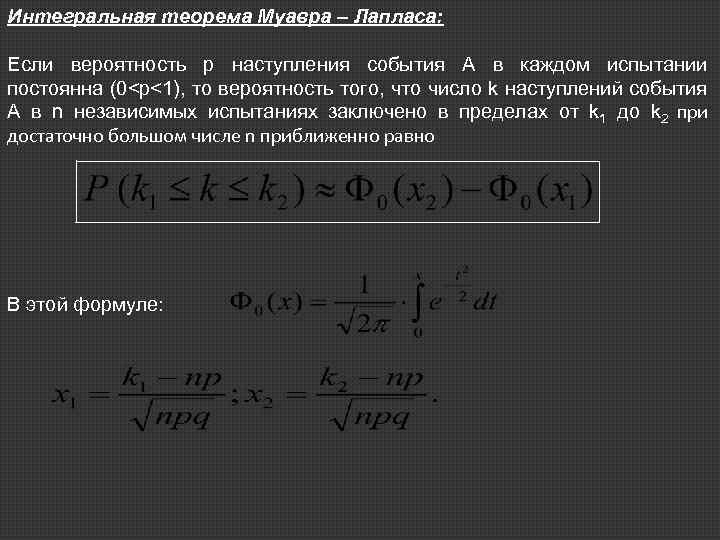

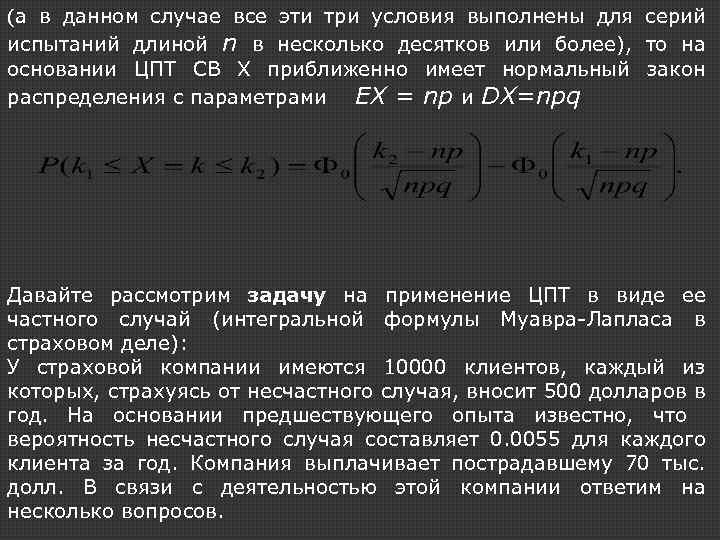

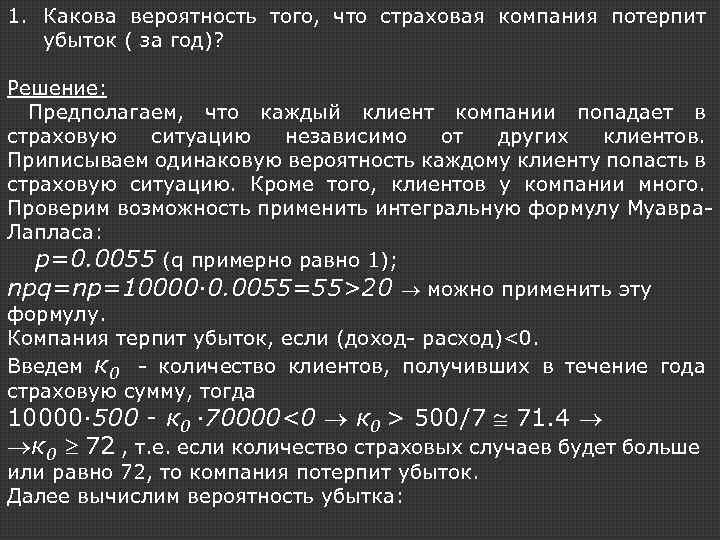

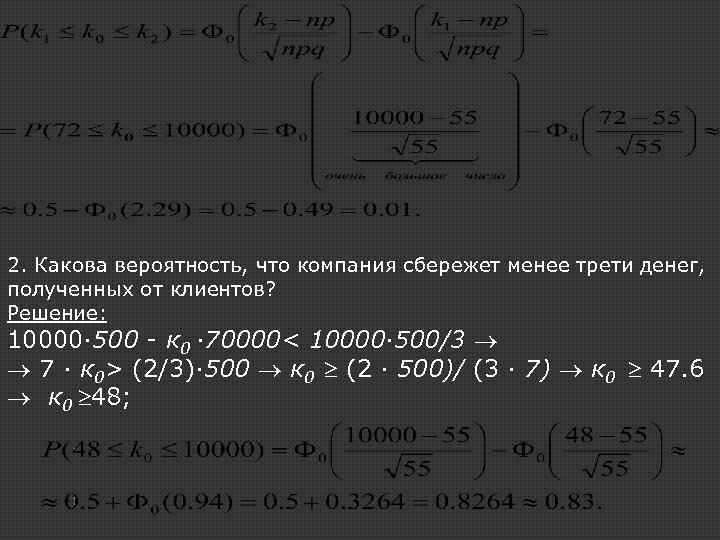

Интегральная теорема Муавра – Лапласа: Если вероятность p наступления события А в каждом испытании постоянна (0

Интегральная теорема Муавра – Лапласа: Если вероятность p наступления события А в каждом испытании постоянна (0

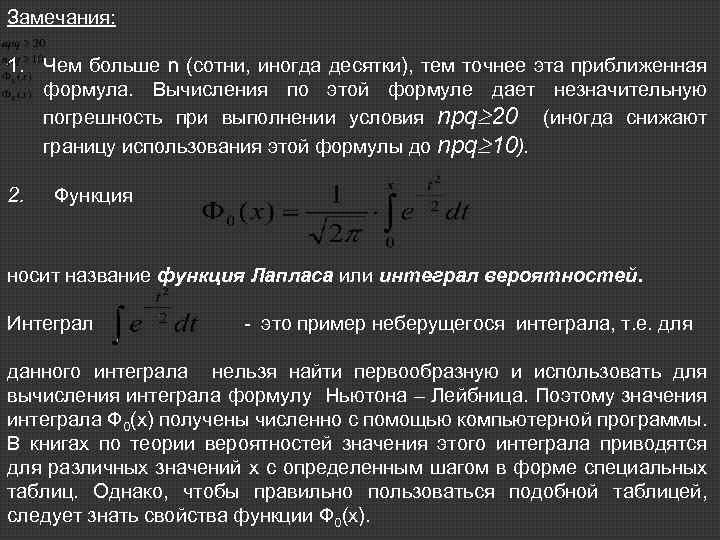

Замечания: 1. Чем больше n (сотни, иногда десятки), тем точнее эта приближенная формула. Вычисления по этой формуле дает незначительную погрешность при выполнении условия npq 20 (иногда снижают границу использования этой формулы до npq 10). 2. Функция носит название функция Лапласа или интеграл вероятностей. Интеграл - это пример неберущегося интеграла, т. е. для данного интеграла нельзя найти первообразную и использовать для вычисления интеграла формулу Ньютона – Лейбница. Поэтому значения интеграла Ф 0(х) получены численно с помощью компьютерной программы. В книгах по теории вероятностей значения этого интеграла приводятся для различных значений х с определенным шагом в форме специальных таблиц. Однако, чтобы правильно пользоваться подобной таблицей, следует знать свойства функции Ф 0(х).

Замечания: 1. Чем больше n (сотни, иногда десятки), тем точнее эта приближенная формула. Вычисления по этой формуле дает незначительную погрешность при выполнении условия npq 20 (иногда снижают границу использования этой формулы до npq 10). 2. Функция носит название функция Лапласа или интеграл вероятностей. Интеграл - это пример неберущегося интеграла, т. е. для данного интеграла нельзя найти первообразную и использовать для вычисления интеграла формулу Ньютона – Лейбница. Поэтому значения интеграла Ф 0(х) получены численно с помощью компьютерной программы. В книгах по теории вероятностей значения этого интеграла приводятся для различных значений х с определенным шагом в форме специальных таблиц. Однако, чтобы правильно пользоваться подобной таблицей, следует знать свойства функции Ф 0(х).

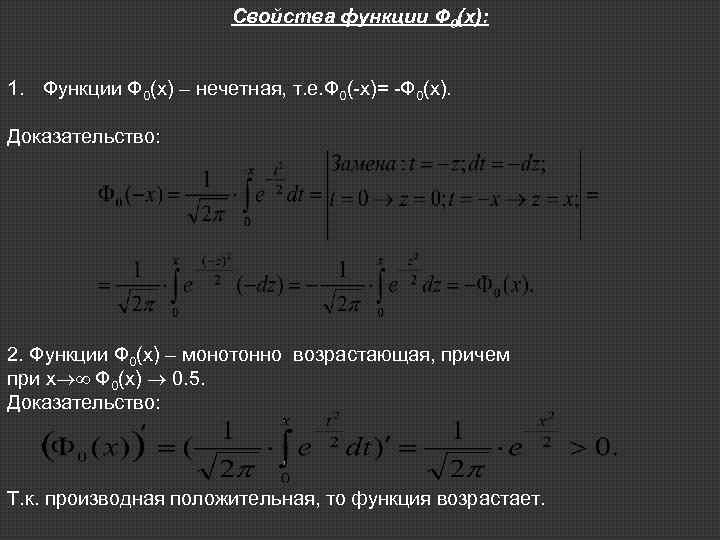

Свойства функции Ф 0(х): 1. Функции Ф 0(х) – нечетная, т. е. Ф 0(-х)= -Ф 0(х). Доказательство: 2. Функции Ф 0(х) – монотонно возрастающая, причем при х Ф 0(х) 0. 5. Доказательство: Т. к. производная положительная, то функция возрастает.

Свойства функции Ф 0(х): 1. Функции Ф 0(х) – нечетная, т. е. Ф 0(-х)= -Ф 0(х). Доказательство: 2. Функции Ф 0(х) – монотонно возрастающая, причем при х Ф 0(х) 0. 5. Доказательство: Т. к. производная положительная, то функция возрастает.

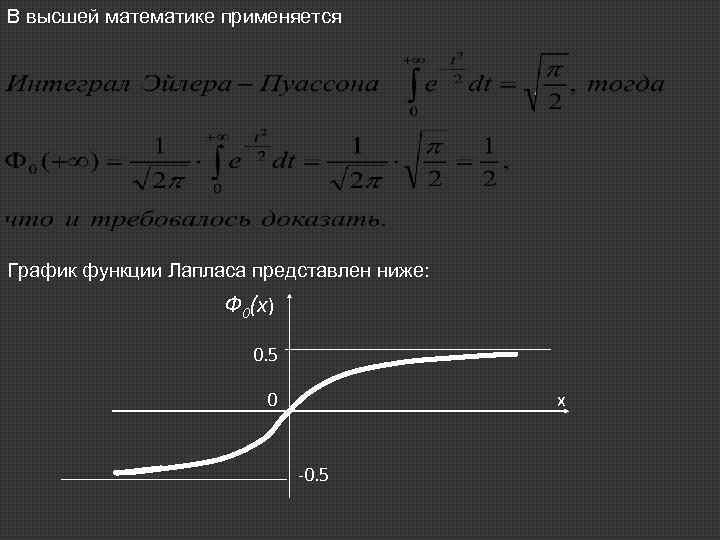

В высшей математике применяется График функции Лапласа представлен ниже: Ф 0(x) 0. 5 0 x -0. 5

В высшей математике применяется График функции Лапласа представлен ниже: Ф 0(x) 0. 5 0 x -0. 5

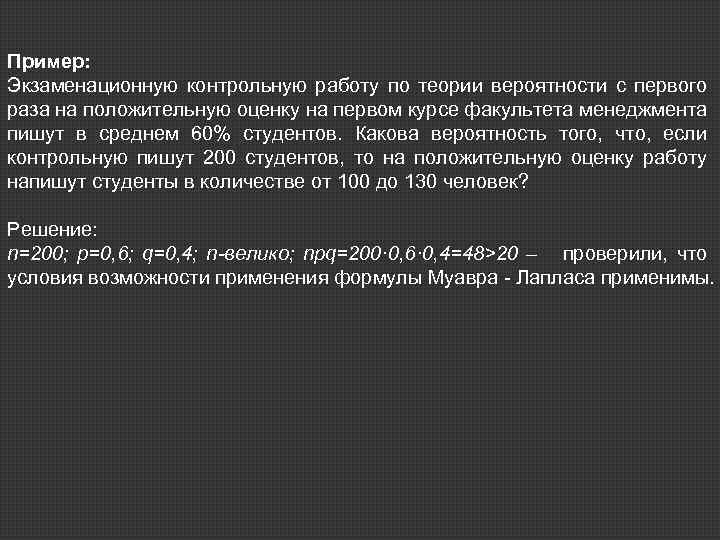

Пример: Экзаменационную контрольную работу по теории вероятности с первого раза на положительную оценку на первом курсе факультета менеджмента пишут в среднем 60% студентов. Какова вероятность того, что, если контрольную пишут 200 студентов, то на положительную оценку работу напишут студенты в количестве от 100 до 130 человек? Решение: n=200; p=0, 6; q=0, 4; n-велико; npq=200· 0, 6· 0, 4=48>20 – проверили, что условия возможности применения формулы Муавра - Лапласа применимы.

Пример: Экзаменационную контрольную работу по теории вероятности с первого раза на положительную оценку на первом курсе факультета менеджмента пишут в среднем 60% студентов. Какова вероятность того, что, если контрольную пишут 200 студентов, то на положительную оценку работу напишут студенты в количестве от 100 до 130 человек? Решение: n=200; p=0, 6; q=0, 4; n-велико; npq=200· 0, 6· 0, 4=48>20 – проверили, что условия возможности применения формулы Муавра - Лапласа применимы.

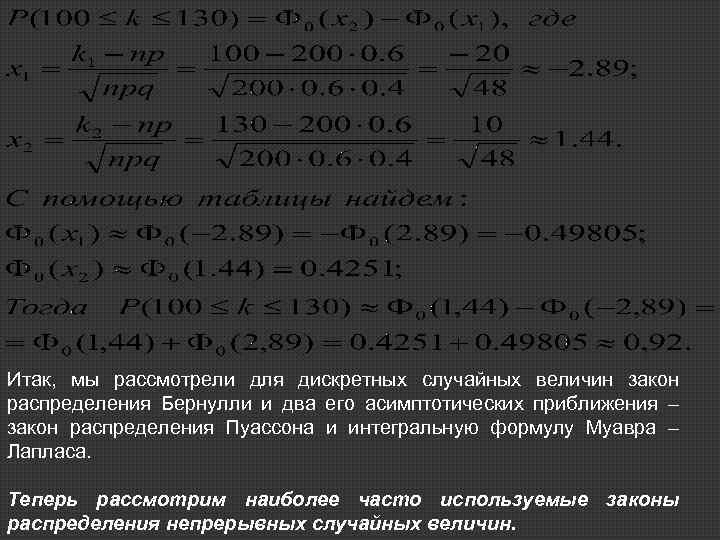

Итак, мы рассмотрели для дискретных случайных величин закон распределения Бернулли и два его асимптотических приближения – закон распределения Пуассона и интегральную формулу Муавра – Лапласа. Теперь рассмотрим наиболее часто используемые законы распределения непрерывных случайных величин.

Итак, мы рассмотрели для дискретных случайных величин закон распределения Бернулли и два его асимптотических приближения – закон распределения Пуассона и интегральную формулу Муавра – Лапласа. Теперь рассмотрим наиболее часто используемые законы распределения непрерывных случайных величин.

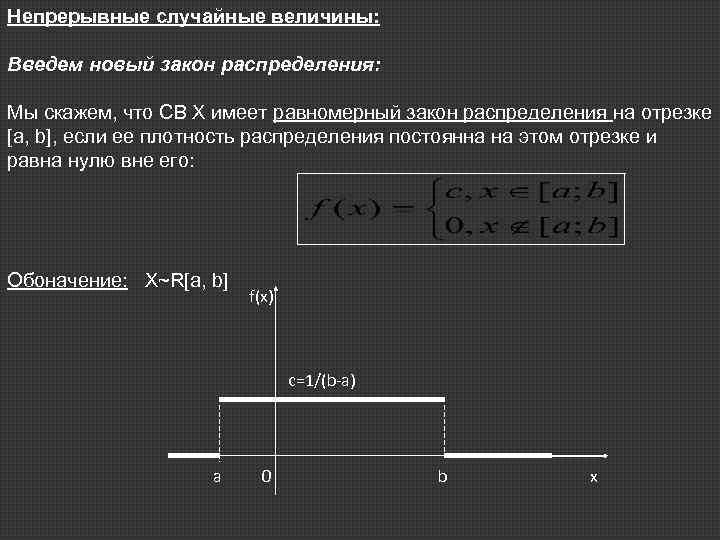

Непрерывные случайные величины: Введем новый закон распределения: Мы скажем, что СВ Х имеет равномерный закон распределения на отрезке [a, b], если ее плотность распределения постоянна на этом отрезке и равна нулю вне его: Обоначение: Х~R[a, b] f(x) c=1/(b-a) a 0 b x

Непрерывные случайные величины: Введем новый закон распределения: Мы скажем, что СВ Х имеет равномерный закон распределения на отрезке [a, b], если ее плотность распределения постоянна на этом отрезке и равна нулю вне его: Обоначение: Х~R[a, b] f(x) c=1/(b-a) a 0 b x

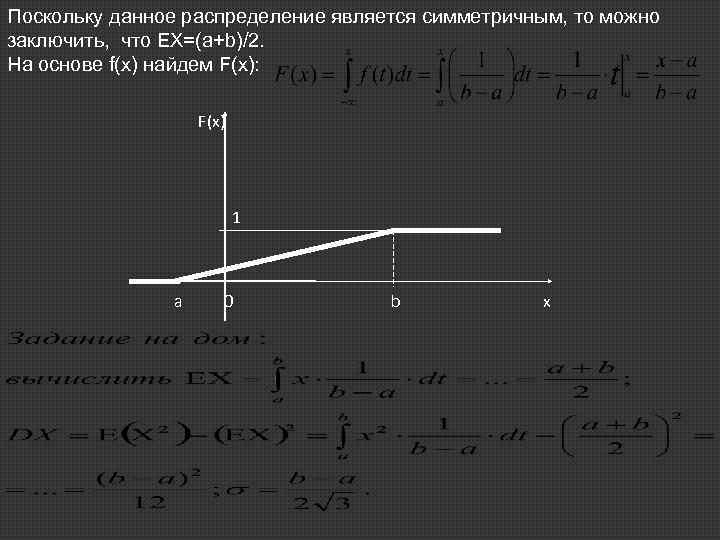

Поскольку данное распределение является симметричным, то можно заключить, что ЕХ=(а+b)/2. На основе f(x) найдем F(x): F(x) 1 a 0 b x

Поскольку данное распределение является симметричным, то можно заключить, что ЕХ=(а+b)/2. На основе f(x) найдем F(x): F(x) 1 a 0 b x

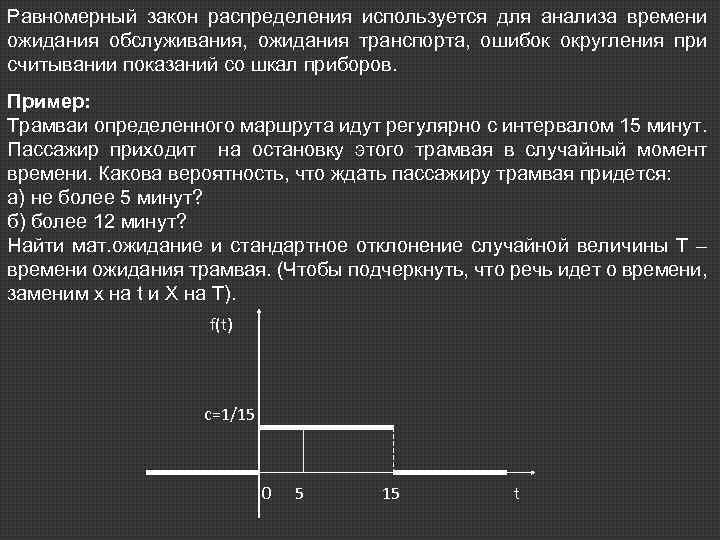

Равномерный закон распределения используется для анализа времени ожидания обслуживания, ожидания транспорта, ошибок округления при считывании показаний со шкал приборов. Пример: Трамваи определенного маршрута идут регулярно с интервалом 15 минут. Пассажир приходит на остановку этого трамвая в случайный момент времени. Какова вероятность, что ждать пассажиру трамвая придется: а) не более 5 минут? б) более 12 минут? Найти мат. ожидание и стандартное отклонение случайной величины Т – времени ожидания трамвая. (Чтобы подчеркнуть, что речь идет о времени, заменим х на t и X на Т). f(t) c=1/15 0 5 15 t

Равномерный закон распределения используется для анализа времени ожидания обслуживания, ожидания транспорта, ошибок округления при считывании показаний со шкал приборов. Пример: Трамваи определенного маршрута идут регулярно с интервалом 15 минут. Пассажир приходит на остановку этого трамвая в случайный момент времени. Какова вероятность, что ждать пассажиру трамвая придется: а) не более 5 минут? б) более 12 минут? Найти мат. ожидание и стандартное отклонение случайной величины Т – времени ожидания трамвая. (Чтобы подчеркнуть, что речь идет о времени, заменим х на t и X на Т). f(t) c=1/15 0 5 15 t

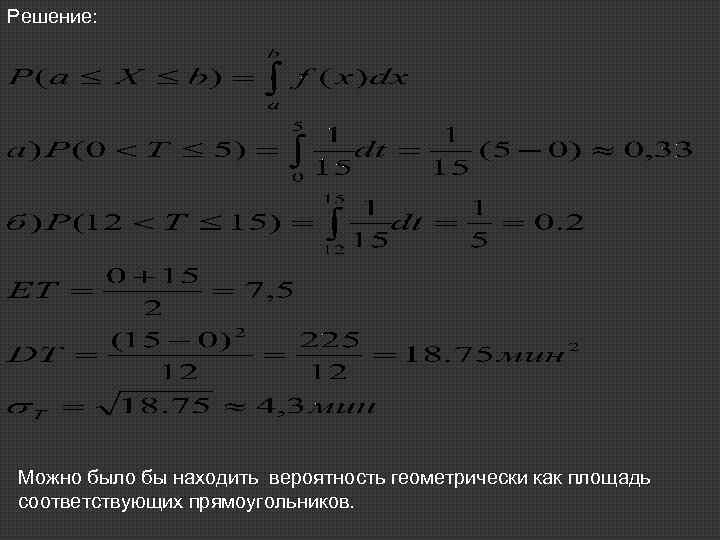

Решение: Можно было бы находить вероятность геометрически как площадь соответствующих прямоугольников.

Решение: Можно было бы находить вероятность геометрически как площадь соответствующих прямоугольников.

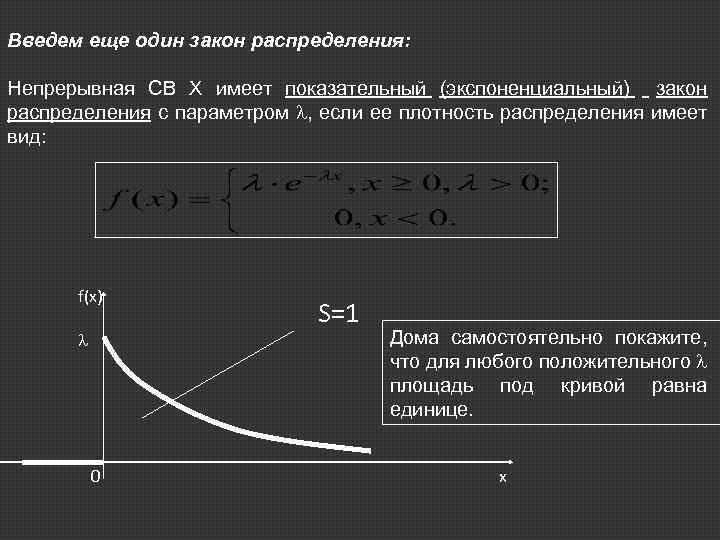

Введем еще один закон распределения: Непрерывная СВ Х имеет показательный (экспоненциальный) закон распределения с параметром , если ее плотность распределения имеет вид: f(x) 0 S=1 Дома самостоятельно покажите, что для любого положительного площадь под кривой равна единице. x

Введем еще один закон распределения: Непрерывная СВ Х имеет показательный (экспоненциальный) закон распределения с параметром , если ее плотность распределения имеет вид: f(x) 0 S=1 Дома самостоятельно покажите, что для любого положительного площадь под кривой равна единице. x

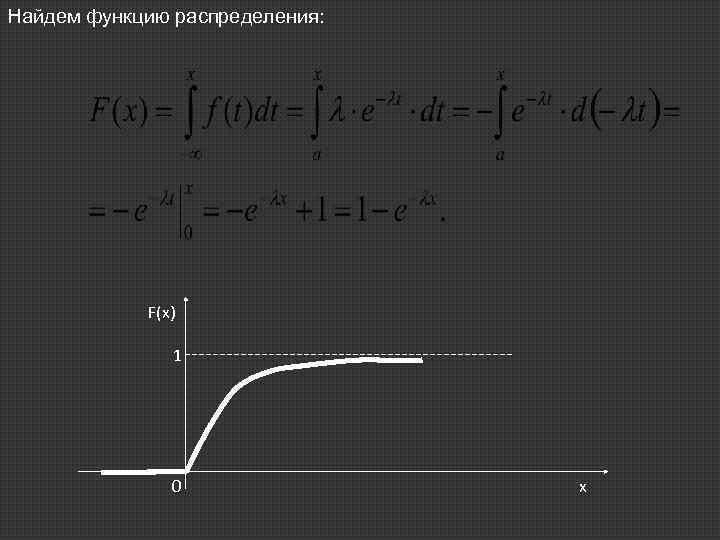

Найдем функцию распределения: F(x) 1 0 x

Найдем функцию распределения: F(x) 1 0 x

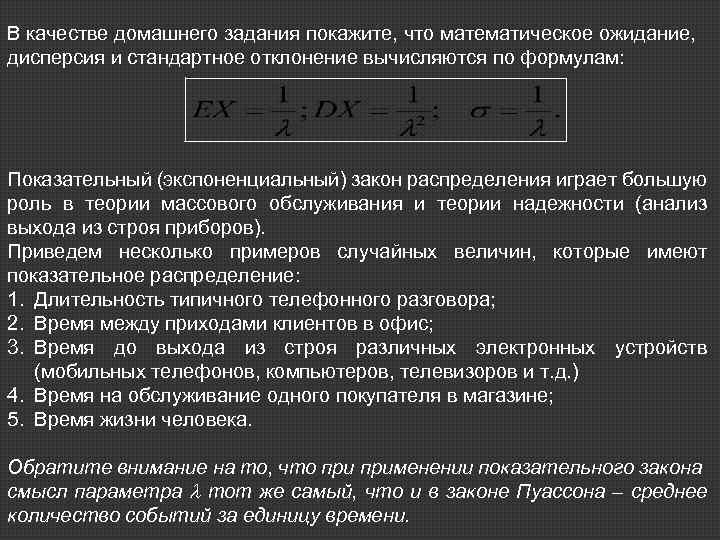

В качестве домашнего задания покажите, что математическое ожидание, дисперсия и стандартное отклонение вычисляются по формулам: Показательный (экспоненциальный) закон распределения играет большую роль в теории массового обслуживания и теории надежности (анализ выхода из строя приборов). Приведем несколько примеров случайных величин, которые имеют показательное распределение: 1. Длительность типичного телефонного разговора; 2. Время между приходами клиентов в офис; 3. Время до выхода из строя различных электронных устройств (мобильных телефонов, компьютеров, телевизоров и т. д. ) 4. Время на обслуживание одного покупателя в магазине; 5. Время жизни человека. Обратите внимание на то, что применении показательного закона смысл параметра тот же самый, что и в законе Пуассона – среднее количество событий за единицу времени.

В качестве домашнего задания покажите, что математическое ожидание, дисперсия и стандартное отклонение вычисляются по формулам: Показательный (экспоненциальный) закон распределения играет большую роль в теории массового обслуживания и теории надежности (анализ выхода из строя приборов). Приведем несколько примеров случайных величин, которые имеют показательное распределение: 1. Длительность типичного телефонного разговора; 2. Время между приходами клиентов в офис; 3. Время до выхода из строя различных электронных устройств (мобильных телефонов, компьютеров, телевизоров и т. д. ) 4. Время на обслуживание одного покупателя в магазине; 5. Время жизни человека. Обратите внимание на то, что применении показательного закона смысл параметра тот же самый, что и в законе Пуассона – среднее количество событий за единицу времени.

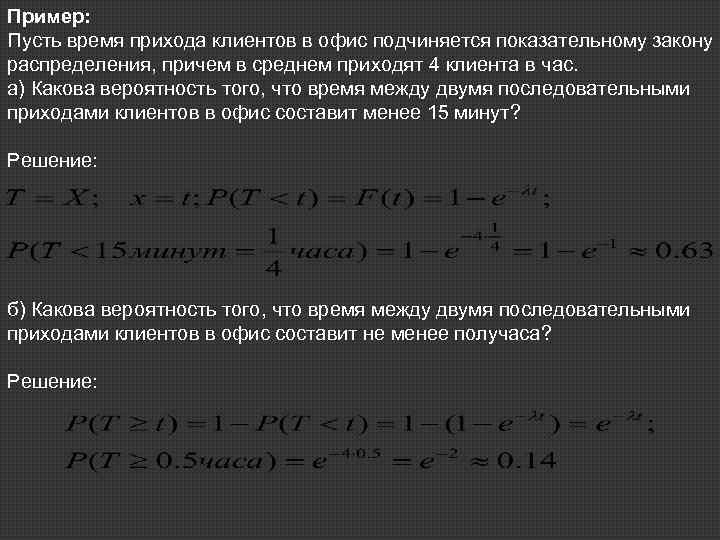

Пример: Пусть время прихода клиентов в офис подчиняется показательному закону распределения, причем в среднем приходят 4 клиента в час. а) Какова вероятность того, что время между двумя последовательными приходами клиентов в офис составит менее 15 минут? Решение: б) Какова вероятность того, что время между двумя последовательными приходами клиентов в офис составит не менее получаса? Решение:

Пример: Пусть время прихода клиентов в офис подчиняется показательному закону распределения, причем в среднем приходят 4 клиента в час. а) Какова вероятность того, что время между двумя последовательными приходами клиентов в офис составит менее 15 минут? Решение: б) Какова вероятность того, что время между двумя последовательными приходами клиентов в офис составит не менее получаса? Решение:

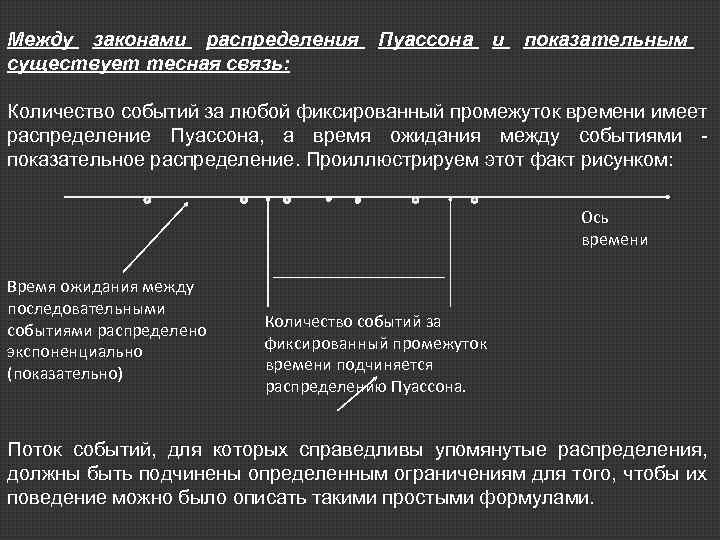

Между законами распределения Пуассона и показательным существует тесная связь: Количество событий за любой фиксированный промежуток времени имеет распределение Пуассона, а время ожидания между событиями показательное распределение. Проиллюстрируем этот факт рисунком: Ось времени Время ожидания между последовательными событиями распределено экспоненциально (показательно) Количество событий за фиксированный промежуток времени подчиняется распределению Пуассона. Поток событий, для которых справедливы упомянутые распределения, должны быть подчинены определенным ограничениям для того, чтобы их поведение можно было описать такими простыми формулами.

Между законами распределения Пуассона и показательным существует тесная связь: Количество событий за любой фиксированный промежуток времени имеет распределение Пуассона, а время ожидания между событиями показательное распределение. Проиллюстрируем этот факт рисунком: Ось времени Время ожидания между последовательными событиями распределено экспоненциально (показательно) Количество событий за фиксированный промежуток времени подчиняется распределению Пуассона. Поток событий, для которых справедливы упомянутые распределения, должны быть подчинены определенным ограничениям для того, чтобы их поведение можно было описать такими простыми формулами.

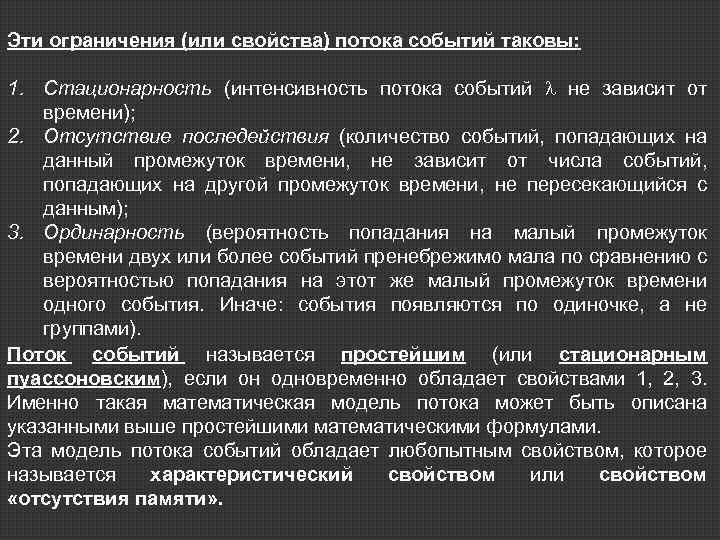

Эти ограничения (или свойства) потока событий таковы: 1. Стационарность (интенсивность потока событий не зависит от времени); 2. Отсутствие последействия (количество событий, попадающих на данный промежуток времени, не зависит от числа событий, попадающих на другой промежуток времени, не пересекающийся с данным); 3. Ординарность (вероятность попадания на малый промежуток времени двух или более событий пренебрежимо мала по сравнению с вероятностью попадания на этот же малый промежуток времени одного события. Иначе: события появляются по одиночке, а не группами). Поток событий называется простейшим (или стационарным пуассоновским), если он одновременно обладает свойствами 1, 2, 3. Именно такая математическая модель потока может быть описана указанными выше простейшими математическими формулами. Эта модель потока событий обладает любопытным свойством, которое называется характеристический свойством или свойством «отсутствия памяти» .

Эти ограничения (или свойства) потока событий таковы: 1. Стационарность (интенсивность потока событий не зависит от времени); 2. Отсутствие последействия (количество событий, попадающих на данный промежуток времени, не зависит от числа событий, попадающих на другой промежуток времени, не пересекающийся с данным); 3. Ординарность (вероятность попадания на малый промежуток времени двух или более событий пренебрежимо мала по сравнению с вероятностью попадания на этот же малый промежуток времени одного события. Иначе: события появляются по одиночке, а не группами). Поток событий называется простейшим (или стационарным пуассоновским), если он одновременно обладает свойствами 1, 2, 3. Именно такая математическая модель потока может быть описана указанными выше простейшими математическими формулами. Эта модель потока событий обладает любопытным свойством, которое называется характеристический свойством или свойством «отсутствия памяти» .

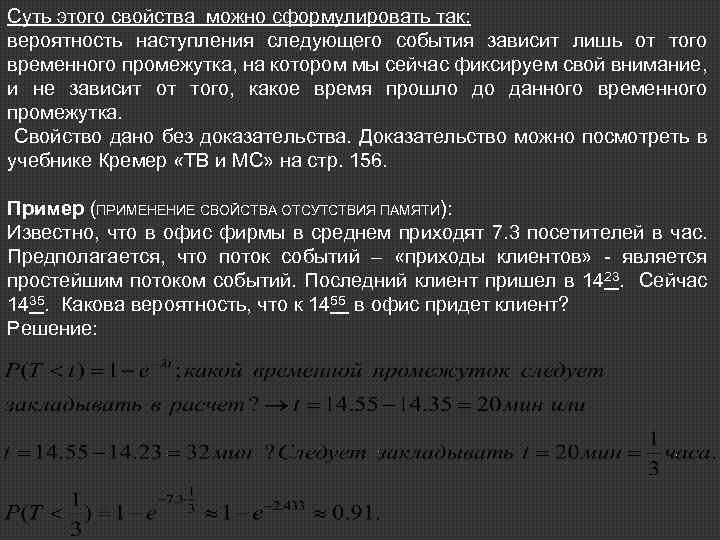

Суть этого свойства можно сформулировать так: вероятность наступления следующего события зависит лишь от того временного промежутка, на котором мы сейчас фиксируем свой внимание, и не зависит от того, какое время прошло до данного временного промежутка. Свойство дано без доказательства. Доказательство можно посмотреть в учебнике Кремер «ТВ и МС» на стр. 156. Пример (ПРИМЕНЕНИЕ СВОЙСТВА ОТСУТСТВИЯ ПАМЯТИ): Известно, что в офис фирмы в среднем приходят 7. 3 посетителей в час. Предполагается, что поток событий – «приходы клиентов» - является простейшим потоком событий. Последний клиент пришел в 1423. Сейчас 1435. Какова вероятность, что к 1455 в офис придет клиент? Решение:

Суть этого свойства можно сформулировать так: вероятность наступления следующего события зависит лишь от того временного промежутка, на котором мы сейчас фиксируем свой внимание, и не зависит от того, какое время прошло до данного временного промежутка. Свойство дано без доказательства. Доказательство можно посмотреть в учебнике Кремер «ТВ и МС» на стр. 156. Пример (ПРИМЕНЕНИЕ СВОЙСТВА ОТСУТСТВИЯ ПАМЯТИ): Известно, что в офис фирмы в среднем приходят 7. 3 посетителей в час. Предполагается, что поток событий – «приходы клиентов» - является простейшим потоком событий. Последний клиент пришел в 1423. Сейчас 1435. Какова вероятность, что к 1455 в офис придет клиент? Решение:

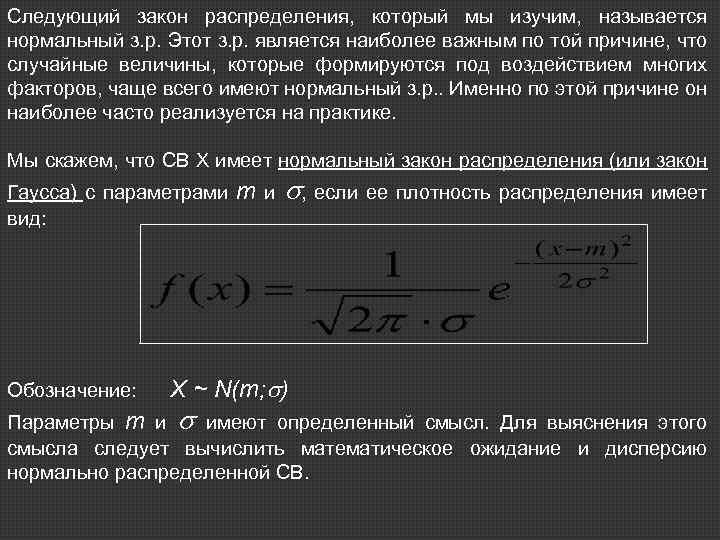

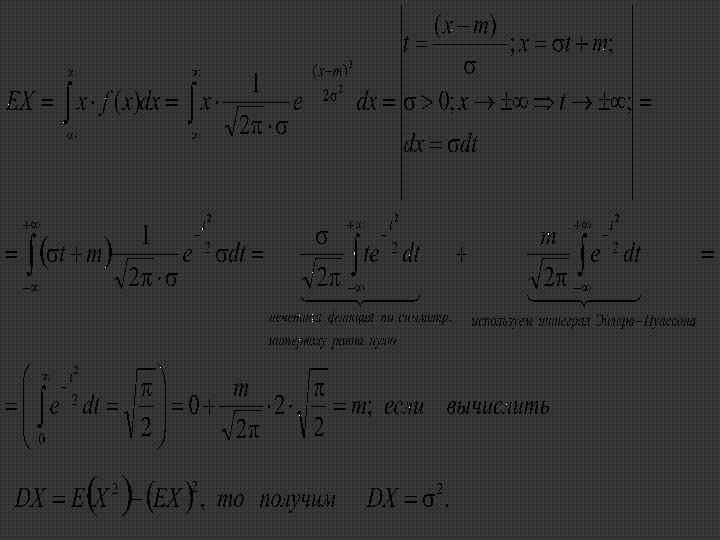

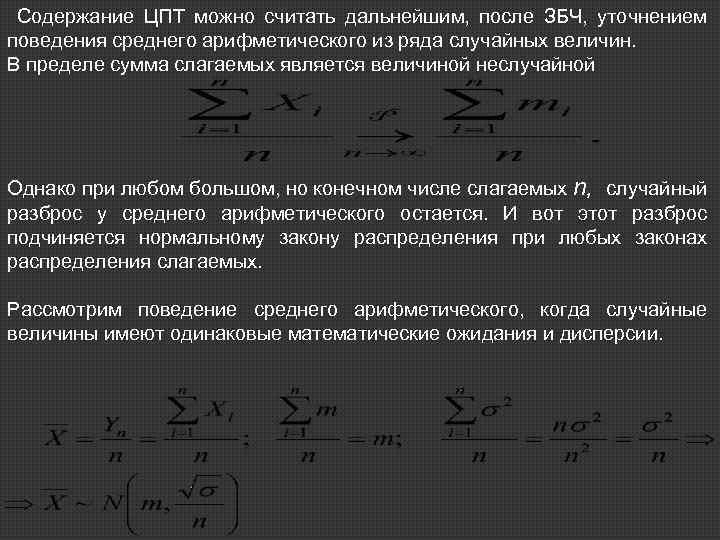

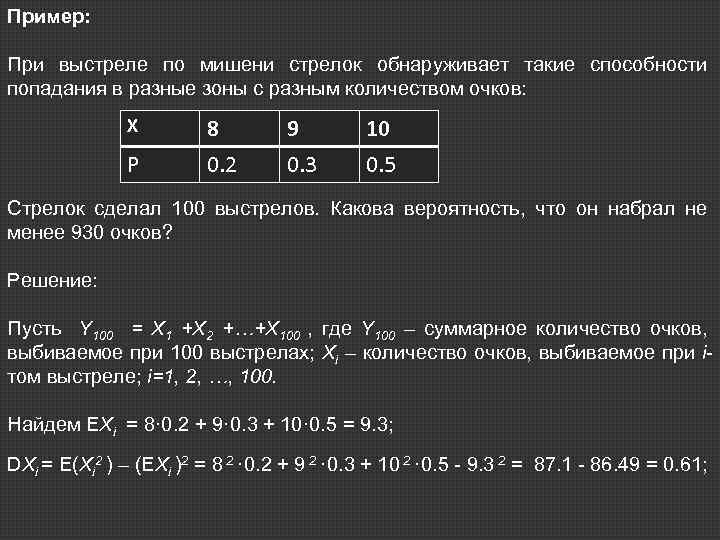

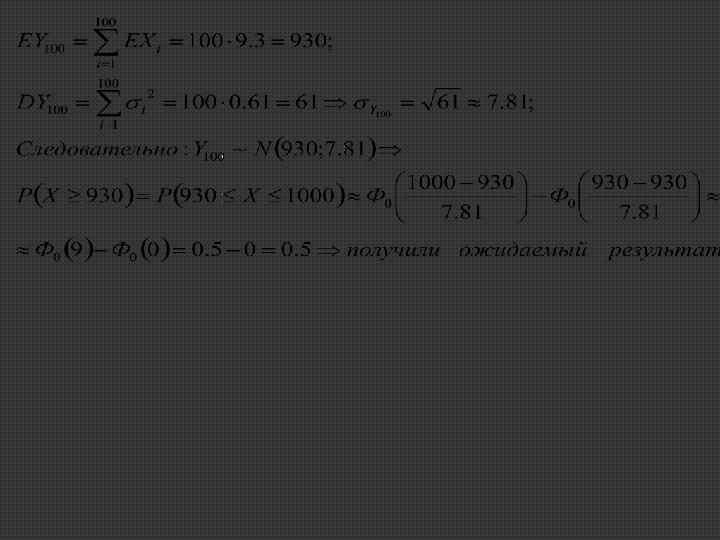

Следующий закон распределения, который мы изучим, называется нормальный з. р. Этот з. р. является наиболее важным по той причине, что случайные величины, которые формируются под воздействием многих факторов, чаще всего имеют нормальный з. р. . Именно по этой причине он наиболее часто реализуется на практике. Мы скажем, что СВ Х имеет нормальный закон распределения (или закон Гаусса) с параметрами вид: Обозначение: mи , если ее плотность распределения имеет X ~ N(m; ) Параметры m и имеют определенный смысл. Для выяснения этого смысла следует вычислить математическое ожидание и дисперсию нормально распределенной СВ.

Следующий закон распределения, который мы изучим, называется нормальный з. р. Этот з. р. является наиболее важным по той причине, что случайные величины, которые формируются под воздействием многих факторов, чаще всего имеют нормальный з. р. . Именно по этой причине он наиболее часто реализуется на практике. Мы скажем, что СВ Х имеет нормальный закон распределения (или закон Гаусса) с параметрами вид: Обозначение: mи , если ее плотность распределения имеет X ~ N(m; ) Параметры m и имеют определенный смысл. Для выяснения этого смысла следует вычислить математическое ожидание и дисперсию нормально распределенной СВ.

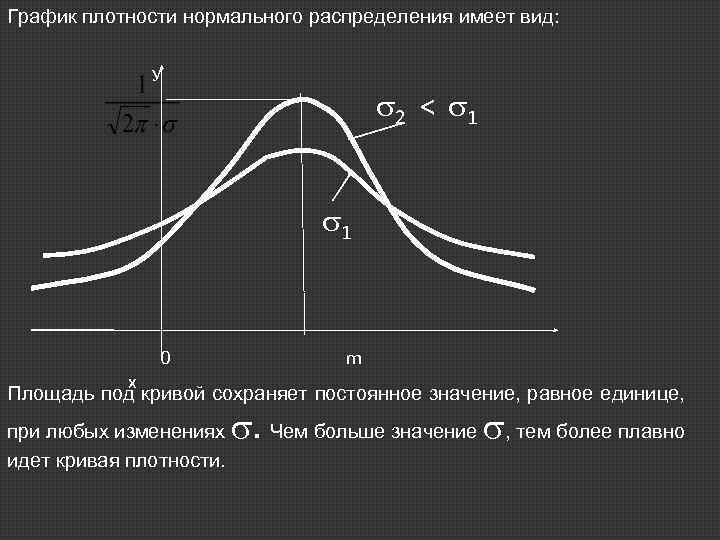

График плотности нормального распределения имеет вид: У 2 < 1 1 0 m x Площадь под кривой сохраняет постоянное значение, равное единице, при любых изменениях идет кривая плотности. . Чем больше значение , тем более плавно

График плотности нормального распределения имеет вид: У 2 < 1 1 0 m x Площадь под кривой сохраняет постоянное значение, равное единице, при любых изменениях идет кривая плотности. . Чем больше значение , тем более плавно

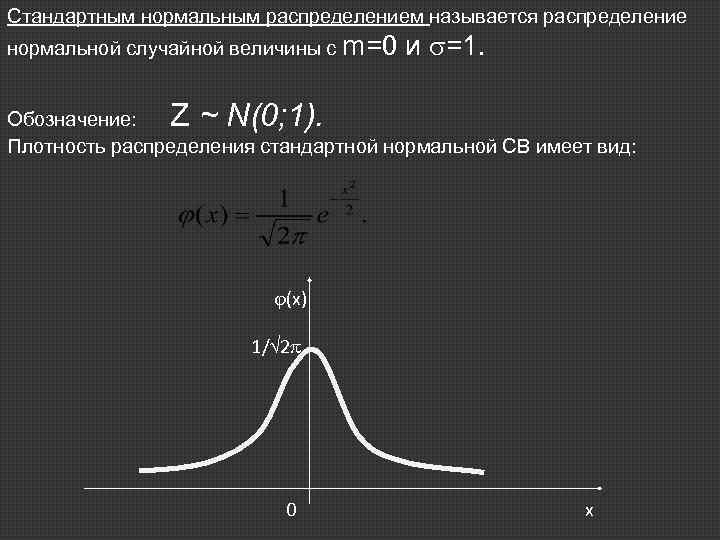

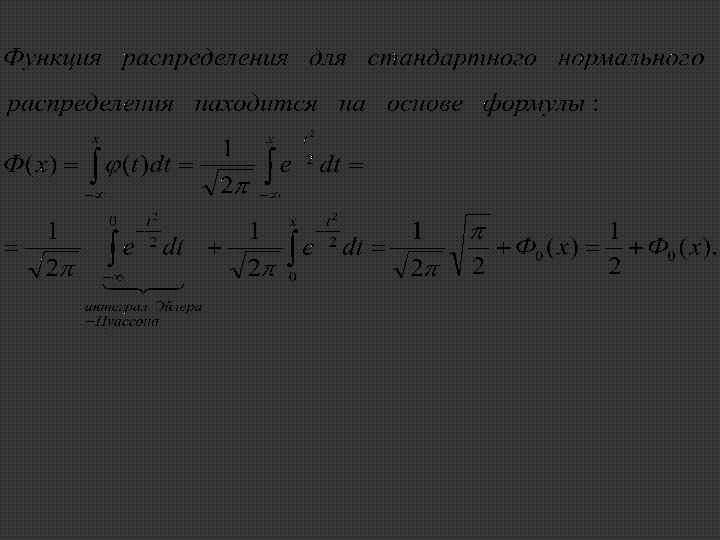

Стандартным нормальным распределением называется распределение нормальной случайной величины с m=0 и =1. Z ~ N(0; 1). Обозначение: Плотность распределения стандартной нормальной СВ имеет вид: (x) 1/ 2 0 x

Стандартным нормальным распределением называется распределение нормальной случайной величины с m=0 и =1. Z ~ N(0; 1). Обозначение: Плотность распределения стандартной нормальной СВ имеет вид: (x) 1/ 2 0 x

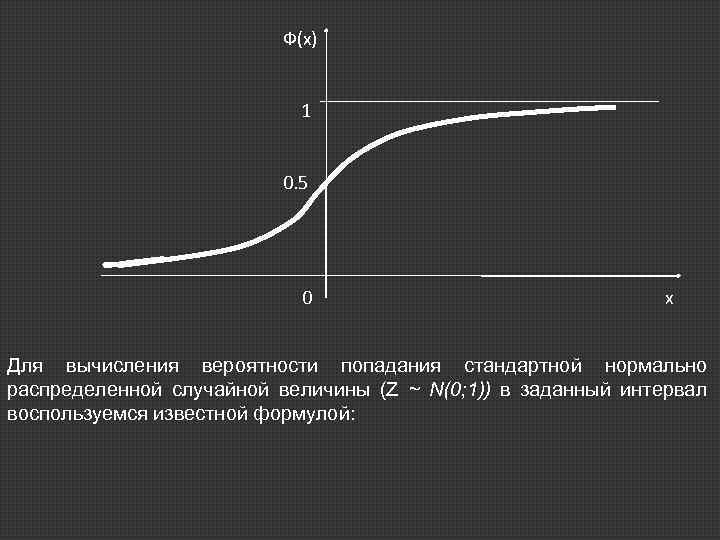

Ф(x) 1 0. 5 0 x Для вычисления вероятности попадания стандартной нормально распределенной случайной величины (Z ~ N(0; 1)) в заданный интервал воспользуемся известной формулой:

Ф(x) 1 0. 5 0 x Для вычисления вероятности попадания стандартной нормально распределенной случайной величины (Z ~ N(0; 1)) в заданный интервал воспользуемся известной формулой:

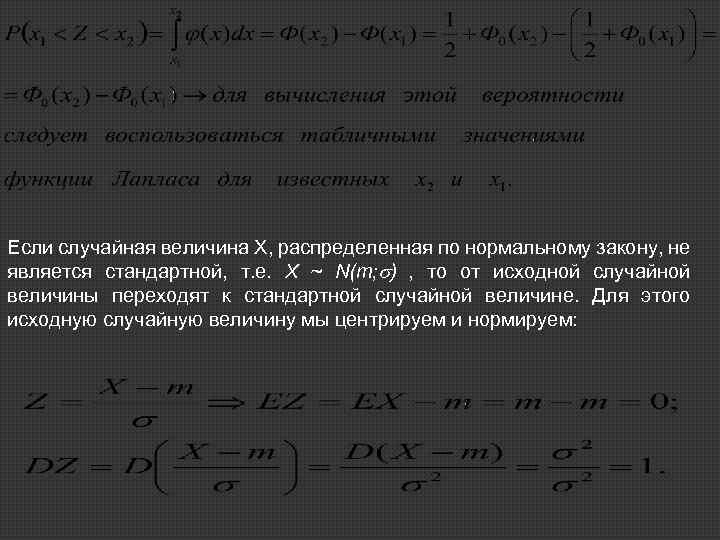

Если случайная величина Х, распределенная по нормальному закону, не является стандартной, т. е. X ~ N(m; ) , то от исходной случайной величины переходят к стандартной случайной величине. Для этого исходную случайную величину мы центрируем и нормируем:

Если случайная величина Х, распределенная по нормальному закону, не является стандартной, т. е. X ~ N(m; ) , то от исходной случайной величины переходят к стандартной случайной величине. Для этого исходную случайную величину мы центрируем и нормируем:

Отсюда получаем следующую формулу для вычисления вероятности попадания нормально распределенной СВ в заданный интервал: Пример: На основе анализа деятельности фирмы за год получено, что средний месячный доход фирмы равен 3 у. е. со стандартным отклонением 0. 5 у. е. Найти вероятность того, что : а) в следующем месяце доход фирмы будет лежать в пределах от 2. 7 у. е. до 3. 2 у. е. ; а) в следующем месяце доход фирмы будет выше 3. 2 у. е. Решение: Поскольку случайная величина дохода фирмы формируется под воздействием многих факторов, то есть основание полагать, что доход фирмы подчиняется нормальному закону распределения.

Отсюда получаем следующую формулу для вычисления вероятности попадания нормально распределенной СВ в заданный интервал: Пример: На основе анализа деятельности фирмы за год получено, что средний месячный доход фирмы равен 3 у. е. со стандартным отклонением 0. 5 у. е. Найти вероятность того, что : а) в следующем месяце доход фирмы будет лежать в пределах от 2. 7 у. е. до 3. 2 у. е. ; а) в следующем месяце доход фирмы будет выше 3. 2 у. е. Решение: Поскольку случайная величина дохода фирмы формируется под воздействием многих факторов, то есть основание полагать, что доход фирмы подчиняется нормальному закону распределения.

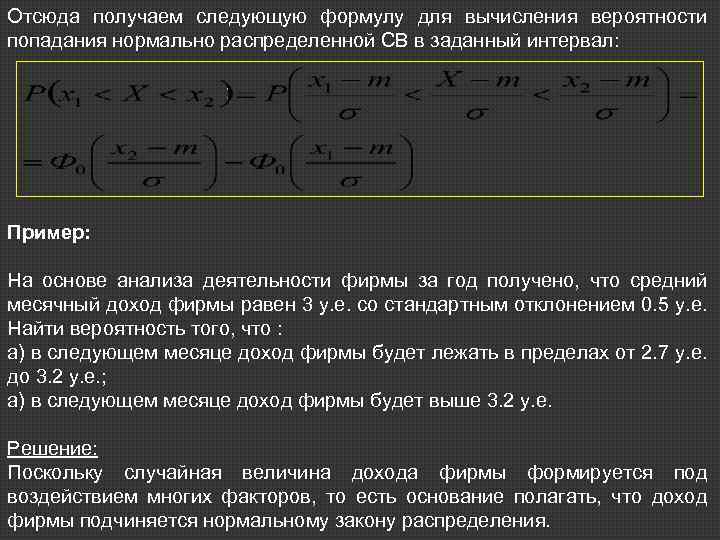

В задаче заданы параметры нормального закона: m=3 и =0. 5. Далее рассмотрим вероятность отклонения случайной величины Х от своего математического ожидания на величину меньше мы задаем сами): (эту величину

В задаче заданы параметры нормального закона: m=3 и =0. 5. Далее рассмотрим вероятность отклонения случайной величины Х от своего математического ожидания на величину меньше мы задаем сами): (эту величину

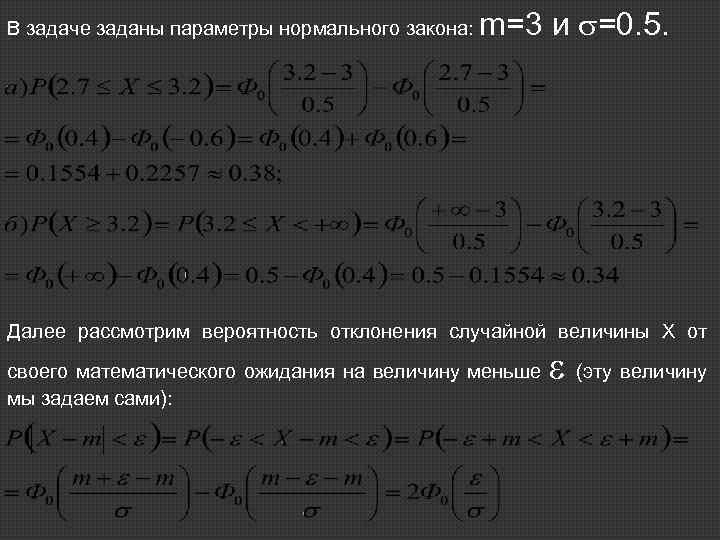

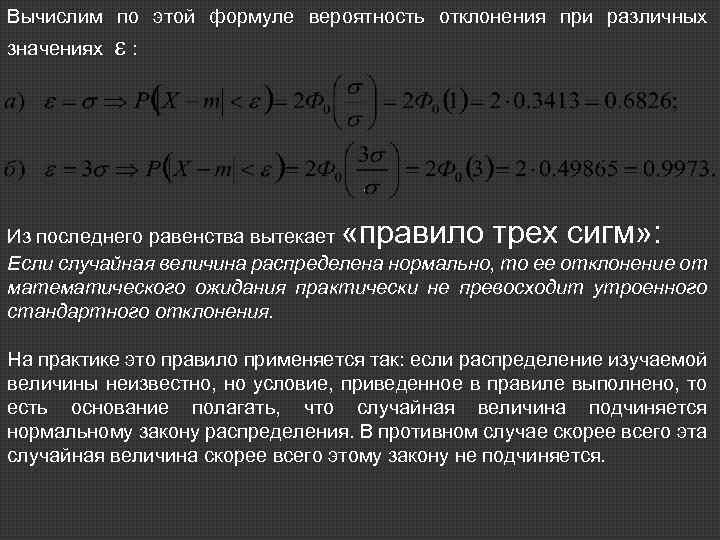

Вычислим по этой формуле вероятность отклонения при различных значениях : «правило трех сигм» : Из последнего равенства вытекает Если случайная величина распределена нормально, то ее отклонение от математического ожидания практически не превосходит утроенного стандартного отклонения. На практике это правило применяется так: если распределение изучаемой величины неизвестно, но условие, приведенное в правиле выполнено, то есть основание полагать, что случайная величина подчиняется нормальному закону распределения. В противном случае скорее всего эта случайная величина скорее всего этому закону не подчиняется.

Вычислим по этой формуле вероятность отклонения при различных значениях : «правило трех сигм» : Из последнего равенства вытекает Если случайная величина распределена нормально, то ее отклонение от математического ожидания практически не превосходит утроенного стандартного отклонения. На практике это правило применяется так: если распределение изучаемой величины неизвестно, но условие, приведенное в правиле выполнено, то есть основание полагать, что случайная величина подчиняется нормальному закону распределения. В противном случае скорее всего эта случайная величина скорее всего этому закону не подчиняется.

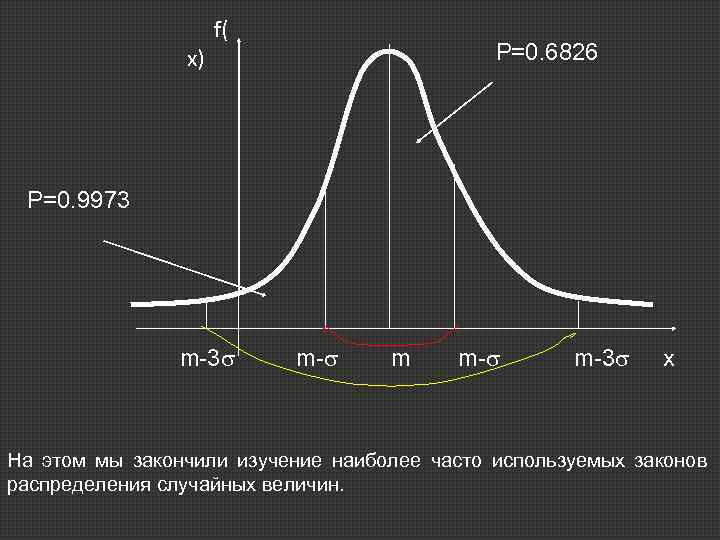

x) f( P=0. 6826 P=0. 9973 m-3 m- m-3 x На этом мы закончили изучение наиболее часто используемых законов распределения случайных величин.

x) f( P=0. 6826 P=0. 9973 m-3 m- m-3 x На этом мы закончили изучение наиболее часто используемых законов распределения случайных величин.

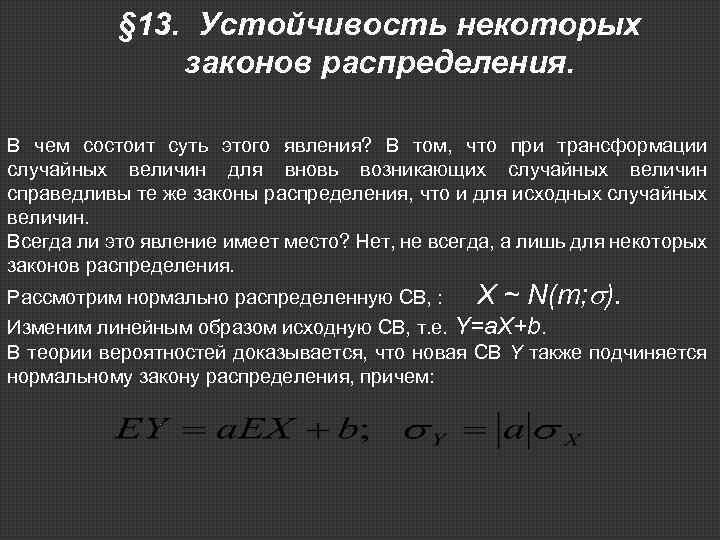

§ 13. Устойчивость некоторых законов распределения. В чем состоит суть этого явления? В том, что при трансформации случайных величин для вновь возникающих случайных величин справедливы те же законы распределения, что и для исходных случайных величин. Всегда ли это явление имеет место? Нет, не всегда, а лишь для некоторых законов распределения. Рассмотрим нормально распределенную СВ, : X ~ N(m; ). Изменим линейным образом исходную СВ, т. е. Y=a. X+b. В теории вероятностей доказывается, что новая СВ Y также подчиняется нормальному закону распределения, причем:

§ 13. Устойчивость некоторых законов распределения. В чем состоит суть этого явления? В том, что при трансформации случайных величин для вновь возникающих случайных величин справедливы те же законы распределения, что и для исходных случайных величин. Всегда ли это явление имеет место? Нет, не всегда, а лишь для некоторых законов распределения. Рассмотрим нормально распределенную СВ, : X ~ N(m; ). Изменим линейным образом исходную СВ, т. е. Y=a. X+b. В теории вероятностей доказывается, что новая СВ Y также подчиняется нормальному закону распределения, причем:

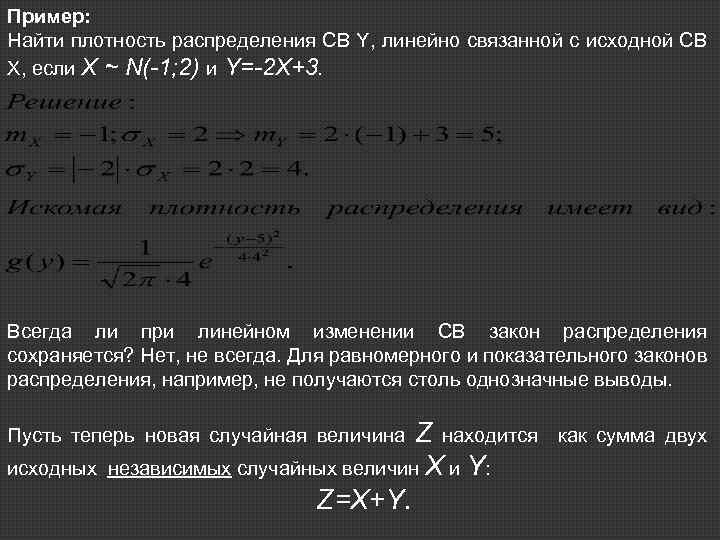

Пример: Найти плотность распределения СВ Y, линейно связанной с исходной СВ Х, если X ~ N(-1; 2) и Y=-2 X+3. Всегда ли при линейном изменении СВ закон распределения сохраняется? Нет, не всегда. Для равномерного и показательного законов распределения, например, не получаются столь однозначные выводы. Z находится независимых случайных величин X и Y: Z=X+Y. Пусть теперь новая случайная величина исходных как сумма двух

Пример: Найти плотность распределения СВ Y, линейно связанной с исходной СВ Х, если X ~ N(-1; 2) и Y=-2 X+3. Всегда ли при линейном изменении СВ закон распределения сохраняется? Нет, не всегда. Для равномерного и показательного законов распределения, например, не получаются столь однозначные выводы. Z находится независимых случайных величин X и Y: Z=X+Y. Пусть теперь новая случайная величина исходных как сумма двух

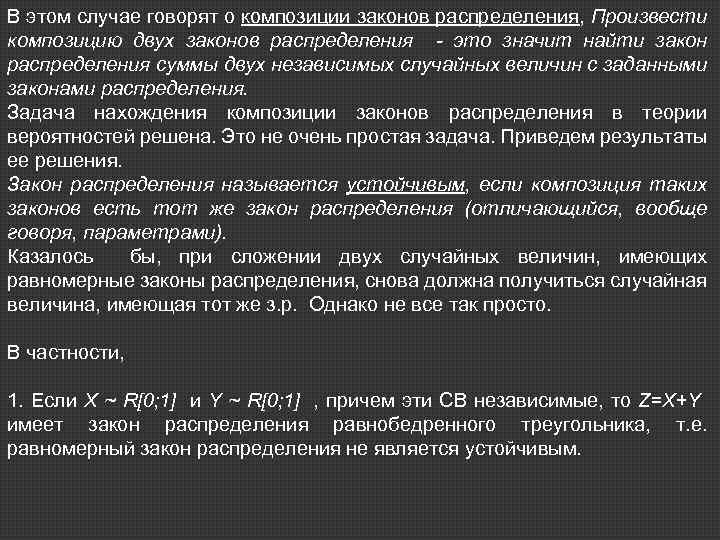

В этом случае говорят о композиции законов распределения, Произвести композицию двух законов распределения - это значит найти закон распределения суммы двух независимых случайных величин с заданными законами распределения. Задача нахождения композиции законов распределения в теории вероятностей решена. Это не очень простая задача. Приведем результаты ее решения. Закон распределения называется устойчивым, если композиция таких законов есть тот же закон распределения (отличающийся, вообще говоря, параметрами). Казалось бы, при сложении двух случайных величин, имеющих равномерные законы распределения, снова должна получиться случайная величина, имеющая тот же з. р. Однако не все так просто. В частности, 1. Если X ~ R[0; 1] и Y ~ R[0; 1] , причем эти СВ независимые, то Z=X+Y имеет закон распределения равнобедренного треугольника, т. е. равномерный закон распределения не является устойчивым.

В этом случае говорят о композиции законов распределения, Произвести композицию двух законов распределения - это значит найти закон распределения суммы двух независимых случайных величин с заданными законами распределения. Задача нахождения композиции законов распределения в теории вероятностей решена. Это не очень простая задача. Приведем результаты ее решения. Закон распределения называется устойчивым, если композиция таких законов есть тот же закон распределения (отличающийся, вообще говоря, параметрами). Казалось бы, при сложении двух случайных величин, имеющих равномерные законы распределения, снова должна получиться случайная величина, имеющая тот же з. р. Однако не все так просто. В частности, 1. Если X ~ R[0; 1] и Y ~ R[0; 1] , причем эти СВ независимые, то Z=X+Y имеет закон распределения равнобедренного треугольника, т. е. равномерный закон распределения не является устойчивым.

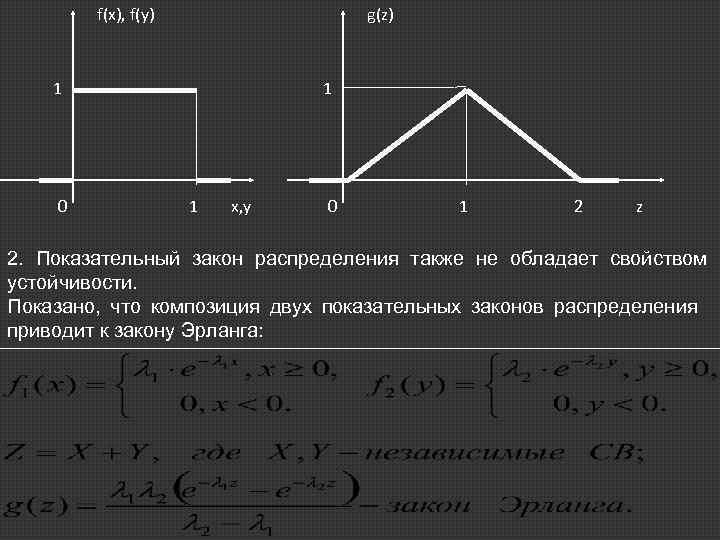

f(x), f(y) g(z) 1 0 1 1 x, y 0 1 2 z 2. Показательный закон распределения также не обладает свойством устойчивости. Показано, что композиция двух показательных законов распределения приводит к закону Эрланга:

f(x), f(y) g(z) 1 0 1 1 x, y 0 1 2 z 2. Показательный закон распределения также не обладает свойством устойчивости. Показано, что композиция двух показательных законов распределения приводит к закону Эрланга:

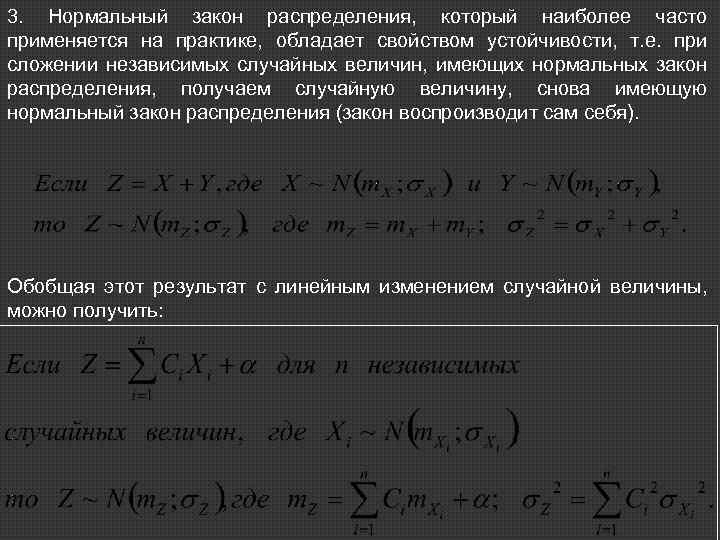

3. Нормальный закон распределения, который наиболее часто применяется на практике, обладает свойством устойчивости, т. е. при сложении независимых случайных величин, имеющих нормальных закон распределения, получаем случайную величину, снова имеющую нормальный закон распределения (закон воспроизводит сам себя). Обобщая этот результат с линейным изменением случайной величины, можно получить:

3. Нормальный закон распределения, который наиболее часто применяется на практике, обладает свойством устойчивости, т. е. при сложении независимых случайных величин, имеющих нормальных закон распределения, получаем случайную величину, снова имеющую нормальный закон распределения (закон воспроизводит сам себя). Обобщая этот результат с линейным изменением случайной величины, можно получить:

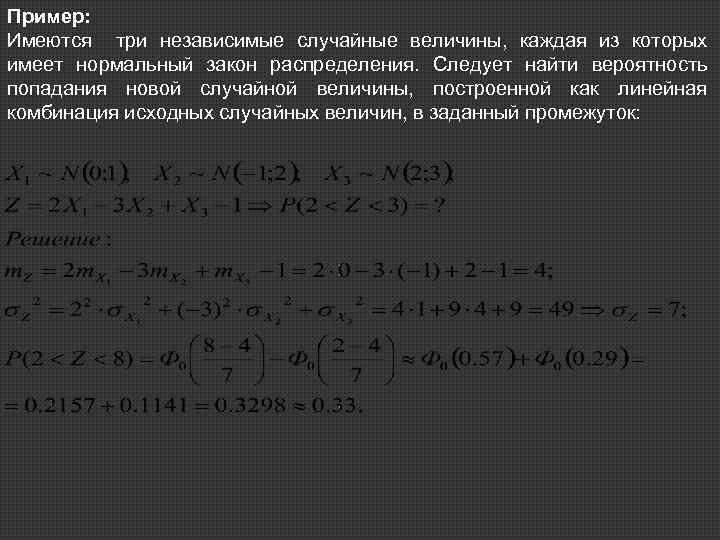

Пример: Имеются три независимые случайные величины, каждая из которых имеет нормальный закон распределения. Следует найти вероятность попадания новой случайной величины, построенной как линейная комбинация исходных случайных величин, в заданный промежуток:

Пример: Имеются три независимые случайные величины, каждая из которых имеет нормальный закон распределения. Следует найти вероятность попадания новой случайной величины, построенной как линейная комбинация исходных случайных величин, в заданный промежуток:

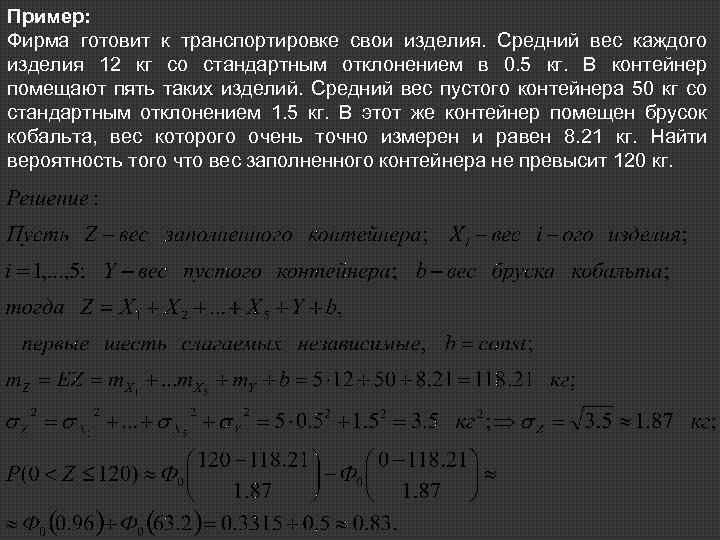

Пример: Фирма готовит к транспортировке свои изделия. Средний вес каждого изделия 12 кг со стандартным отклонением в 0. 5 кг. В контейнер помещают пять таких изделий. Средний вес пустого контейнера 50 кг со стандартным отклонением 1. 5 кг. В этот же контейнер помещен брусок кобальта, вес которого очень точно измерен и равен 8. 21 кг. Найти вероятность того что вес заполненного контейнера не превысит 120 кг.

Пример: Фирма готовит к транспортировке свои изделия. Средний вес каждого изделия 12 кг со стандартным отклонением в 0. 5 кг. В контейнер помещают пять таких изделий. Средний вес пустого контейнера 50 кг со стандартным отклонением 1. 5 кг. В этот же контейнер помещен брусок кобальта, вес которого очень точно измерен и равен 8. 21 кг. Найти вероятность того что вес заполненного контейнера не превысит 120 кг.

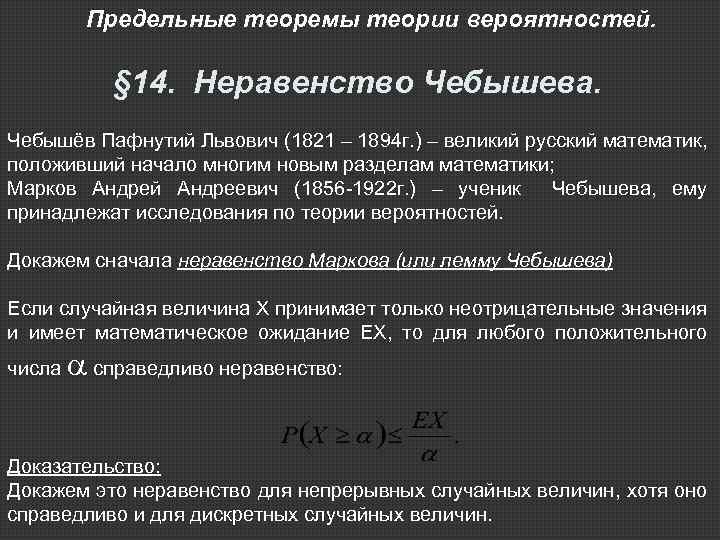

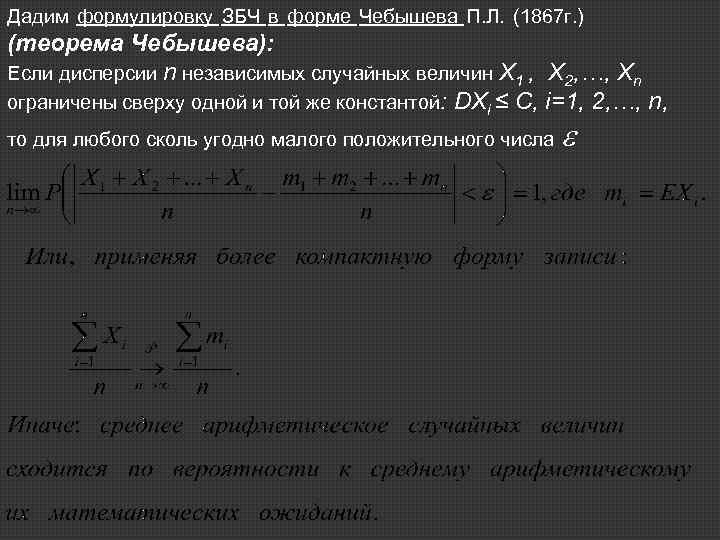

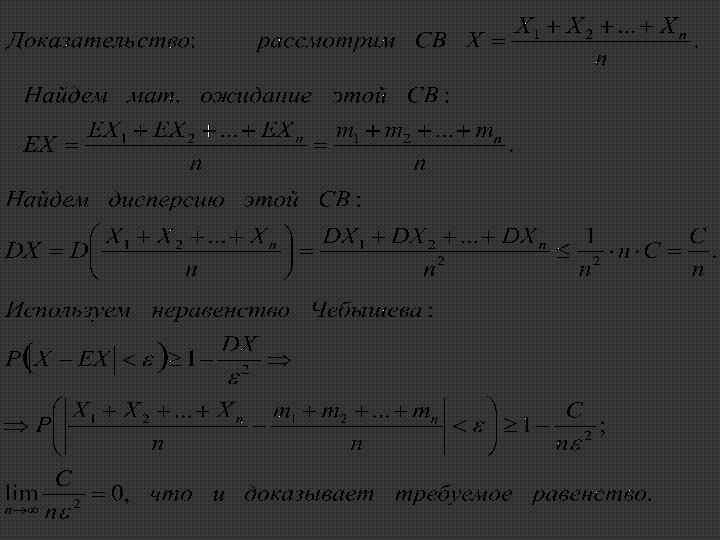

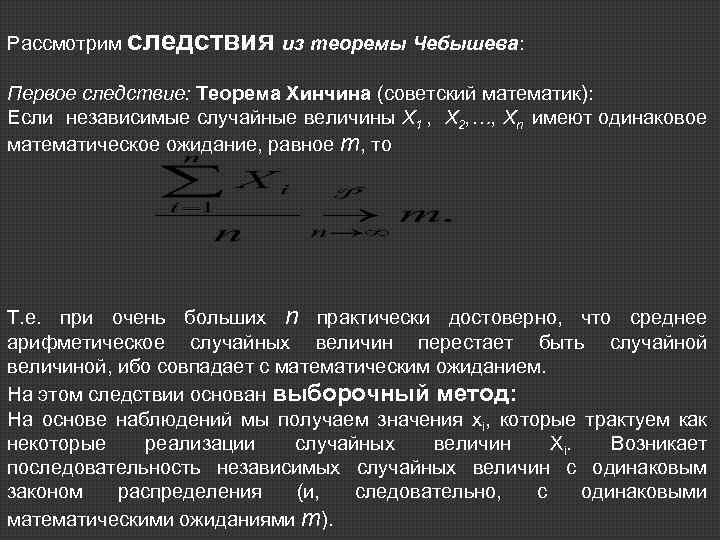

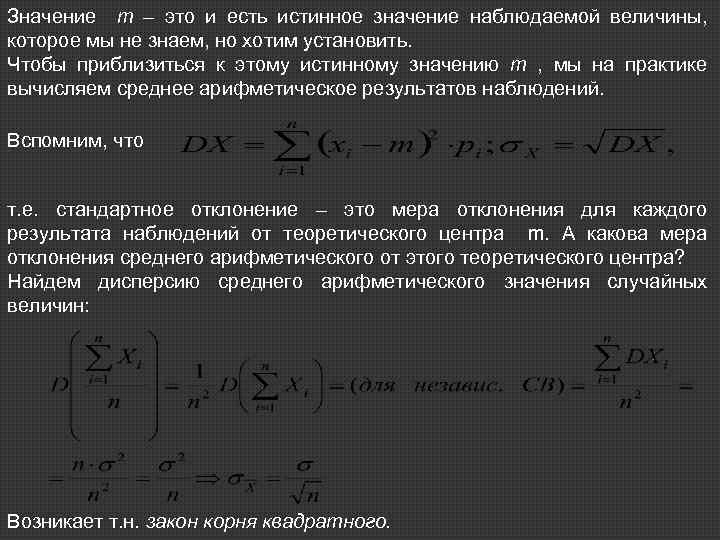

Предельные теоремы теории вероятностей. § 14. Неравенство Чебышева. Чебышёв Пафнутий Львович (1821 – 1894 г. ) – великий русский математик, положивший начало многим новым разделам математики; Марков Андрей Андреевич (1856 -1922 г. ) – ученик Чебышева, ему принадлежат исследования по теории вероятностей. Докажем сначала неравенство Маркова (или лемму Чебышева) Если случайная величина Х принимает только неотрицательные значения и имеет математическое ожидание ЕХ, то для любого положительного числа справедливо неравенство: Доказательство: Докажем это неравенство для непрерывных случайных величин, хотя оно справедливо и для дискретных случайных величин.

Предельные теоремы теории вероятностей. § 14. Неравенство Чебышева. Чебышёв Пафнутий Львович (1821 – 1894 г. ) – великий русский математик, положивший начало многим новым разделам математики; Марков Андрей Андреевич (1856 -1922 г. ) – ученик Чебышева, ему принадлежат исследования по теории вероятностей. Докажем сначала неравенство Маркова (или лемму Чебышева) Если случайная величина Х принимает только неотрицательные значения и имеет математическое ожидание ЕХ, то для любого положительного числа справедливо неравенство: Доказательство: Докажем это неравенство для непрерывных случайных величин, хотя оно справедливо и для дискретных случайных величин.

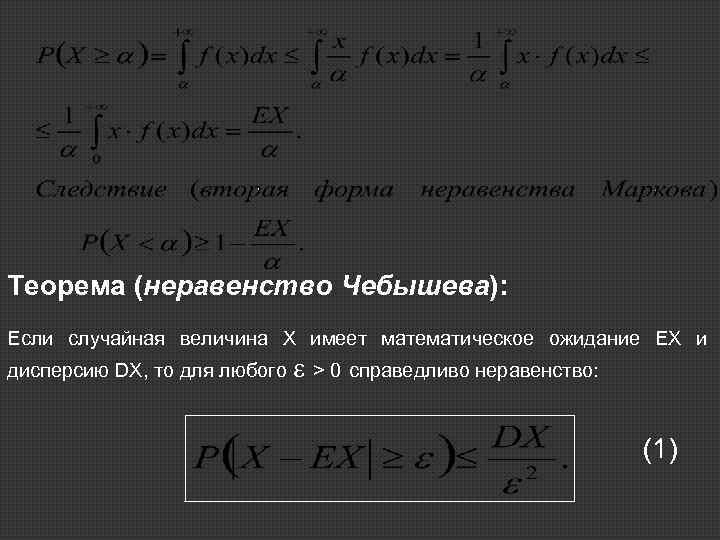

Теорема (неравенство Чебышева): Если случайная величина Х имеет математическое ожидание ЕХ и дисперсию DX, то для любого > 0 справедливо неравенство: (1)

Теорема (неравенство Чебышева): Если случайная величина Х имеет математическое ожидание ЕХ и дисперсию DX, то для любого > 0 справедливо неравенство: (1)

Доказательство: Применим неравенство Маркова к СВ положительного числа = 2 : (Х-ЕХ)2 , взяв в качестве

Доказательство: Применим неравенство Маркова к СВ положительного числа = 2 : (Х-ЕХ)2 , взяв в качестве

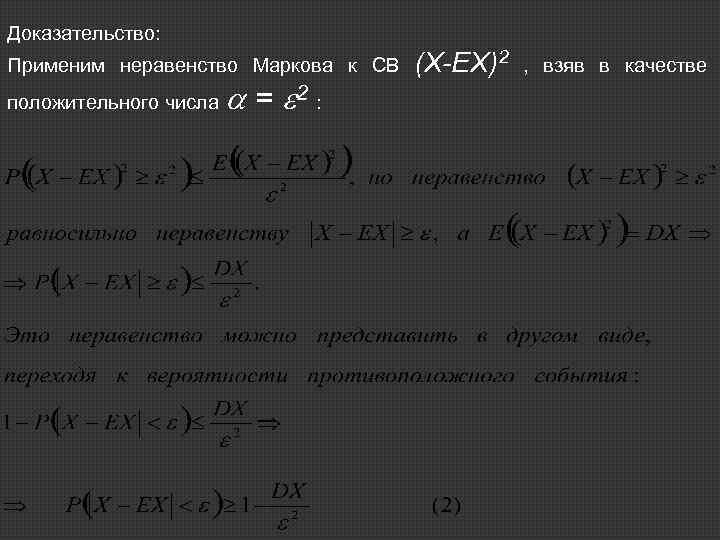

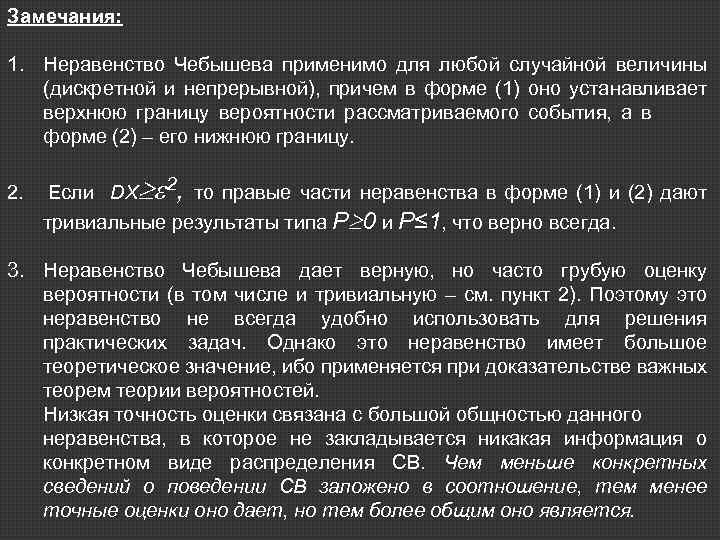

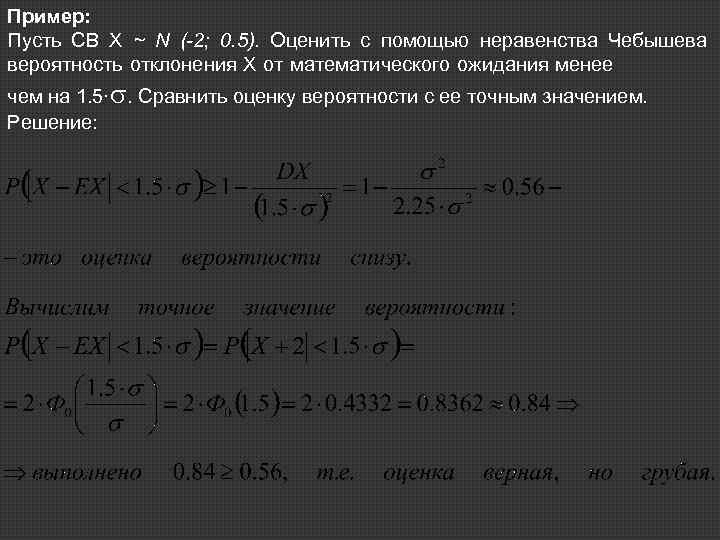

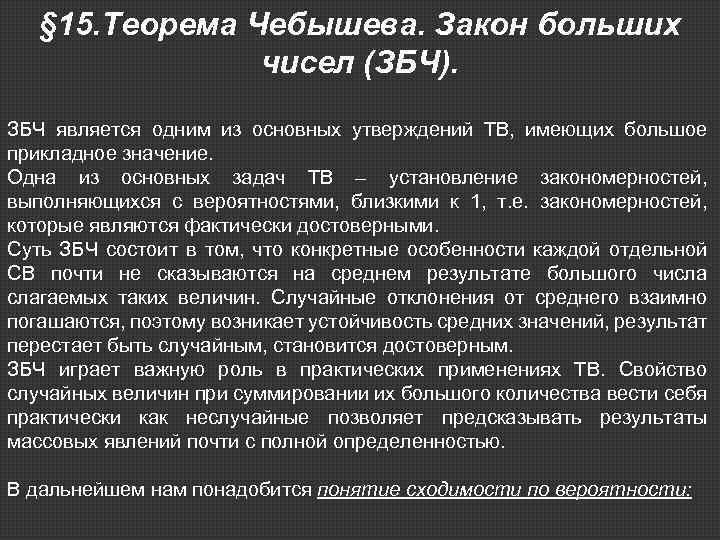

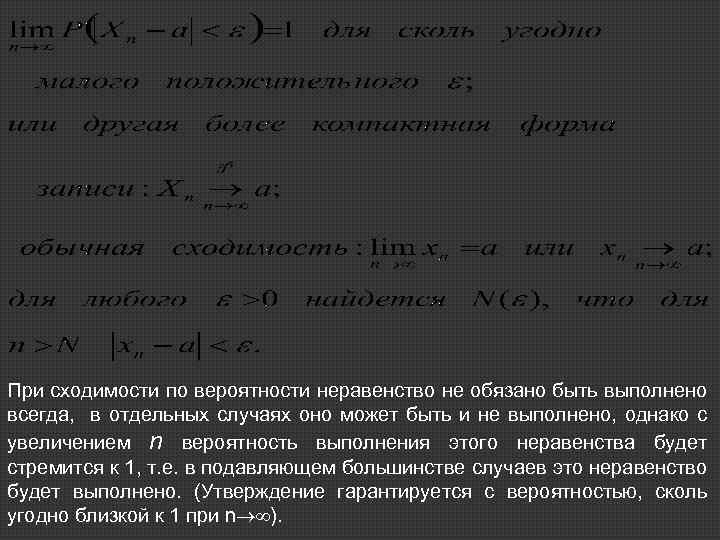

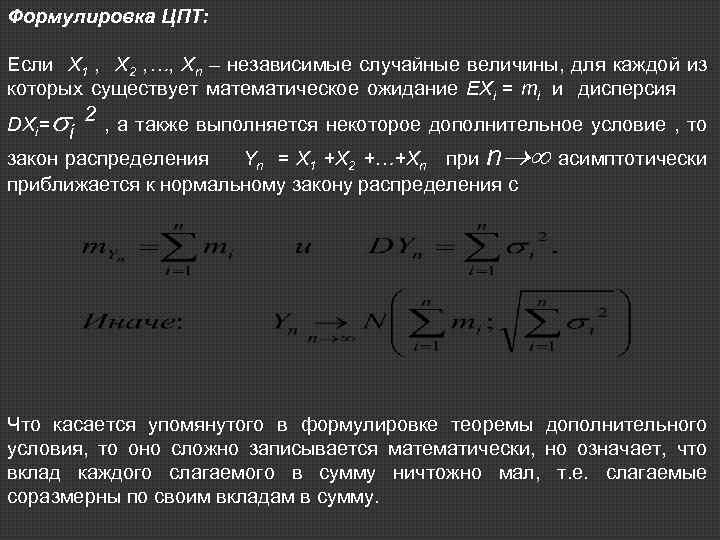

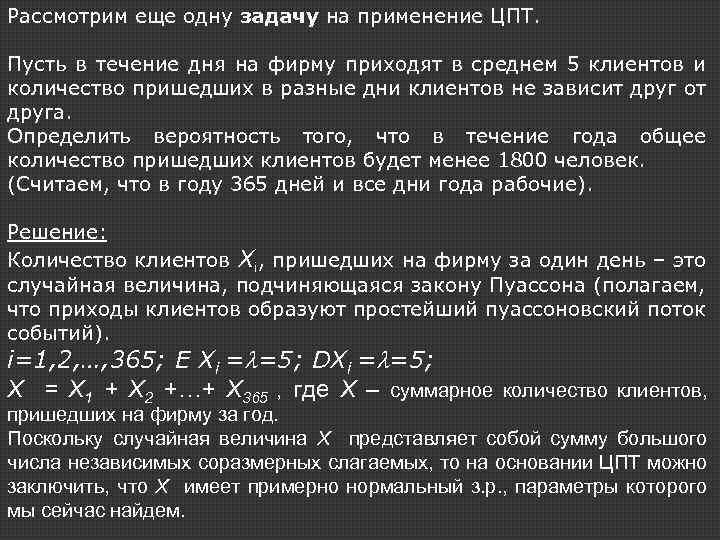

Замечания: 1. Неравенство Чебышева применимо для любой случайной величины (дискретной и непрерывной), причем в форме (1) оно устанавливает верхнюю границу вероятности рассматриваемого события, а в форме (2) – его нижнюю границу. 2. Если DX 2, то правые части неравенства в форме (1) и (2) дают тривиальные результаты типа Р 0 и Р≤ 1, что верно всегда. 3. Неравенство Чебышева дает верную, но часто грубую оценку вероятности (в том числе и тривиальную – см. пункт 2). Поэтому это неравенство не всегда удобно использовать для решения практических задач. Однако это неравенство имеет большое теоретическое значение, ибо применяется при доказательстве важных теорем теории вероятностей. Низкая точность оценки связана с большой общностью данного неравенства, в которое не закладывается никакая информация о конкретном виде распределения СВ. Чем меньше конкретных сведений о поведении СВ заложено в соотношение, тем менее точные оценки оно дает, но тем более общим оно является.